این پست با همکاری Balaji Chandrasekaran، Jennifer Cwagenberg و Andrew Sansom و Eiman Ebrahimi از Protopia AI نوشته شده است.

مدلهای جدید و قدرتمند زبان بزرگ (LLM) به سرعت در حال تغییر مشاغل هستند و کارایی و اثربخشی را برای انواع موارد استفاده سازمانی بهبود میبخشند. سرعت بسیار مهم است و پذیرش فناوری های LLM می تواند مزیت رقابتی یک کسب و کار را ایجاد کند یا از بین ببرد. AWS به ویژه برای ارائه ابزارهای لازم برای استقرار LLM در مقیاس به شرکت ها مناسب است تا تصمیم گیری های حیاتی را امکان پذیر کند.

در اجرای فناوری هوش مصنوعی مولد، شرکتها نگرانیهای واقعی در مورد قرار گرفتن در معرض دادهها و مالکیت اطلاعات محرمانهای دارند که ممکن است برای LLM ارسال شود. این نگرانی ها در مورد حفظ حریم خصوصی و حفاظت از داده ها می تواند استفاده از LLM ها را در سازمان ها کند یا محدود کند. شرکتها به روشی مسئولانه و ایمنتر برای ارسال اطلاعات حساس به مدلها نیاز دارند، بدون اینکه نیازی به پرداخت هزینههای سربار اغلب غیرقانونی DevOps داخلی داشته باشند.

این پست توضیح میدهد که چگونه میتوانید بر چالشهای حفظ مالکیت داده و حفظ حریم خصوصی دادهها در حین استفاده از LLM با استفاده از Stained Glass Transform Protopia AI برای محافظت از دادههای خود غلبه کنید. پروتوپیا AI با AWS برای ارائه بخش مهم حفاظت از داده ها و مالکیت برای پذیرش ایمن و کارآمد هوش مصنوعی مولد مشارکت کرده است. این پست راه حل را تشریح می کند و نشان می دهد که چگونه می توان از آن در AWS برای موارد استفاده سازمانی محبوب مانند استفاده کرد بازیابی نسل افزوده (RAG) و با LLM های پیشرفته مانند لاما 2.

نمای کلی تبدیل شیشه رنگی

سازمان ها به دنبال حفظ مالکیت و کنترل کامل داده های حساس سازمانی خود هستند. این یک ستون هوش مصنوعی مسئول و یک الزام در حال ظهور حفاظت از داده ها و حفظ حریم خصوصی است که بالاتر و فراتر از امنیت اولیه و تضمین های قانونی ارائه دهندگان LLM است.

اگرچه واحدهای تجاری سازمانی میخواهند از LLM برای کارهای مختلف استفاده کنند، اما نگران اسرار تجاری، مالکیت معنوی و سایر اطلاعات اختصاصی هستند که از طریق دادههای ارسال شده به این مدلها درز میکنند. در عین حال، دفاتر امنیت سازمانی، انطباق، مدیریت دادهها و دفاتر اطلاعات از افشای یا افشای اطلاعات مشتری متنی ساده یا سایر دادههای تنظیمشده در خارج از شرکت نگران هستند. AWS و Protopia AI برای ارائه مولفه حیاتی که این نیاز مشترک مشتریان سازمانی را برطرف می کند، شریک هستند.

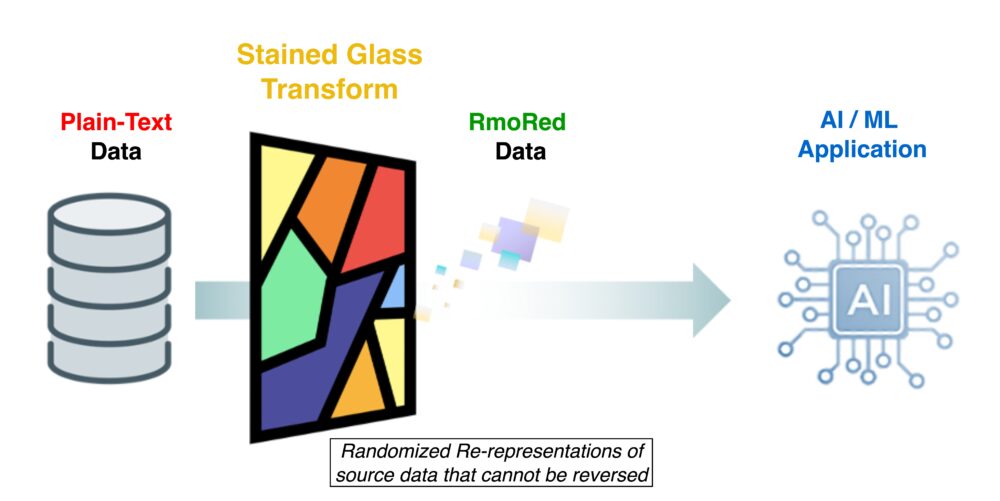

تبدیل شیشه ای رنگی پروتوپیا AI (SGT) این چالش ها را با تبدیل داده های سازمانی محافظت نشده به یک نمایش مجدد تصادفی، که به داده های RmoRed گفته می شود، حل می کند، همانطور که در شکل زیر نشان داده شده است. این نمایش یک جاسازی تصادفی از دادههای اصلی است که اطلاعاتی را که LLM هدف برای عملکرد نیاز دارد، بدون افشای درخواستها یا پرسوجوهای حساس، زمینه یا دادههای تنظیم دقیق حفظ میکند. این بازنمایی یک تحول یک طرفه است که نمیتوان آن را معکوس کرد و از حریم خصوصی کلنگر دادههای سازمانی و محافظت در برابر افشای اطلاعات حساس متن ساده به LLM اطمینان میدهد. کاربرد SGT به مدل های زبان محدود نمی شود. بازنمایشهای تصادفیسازیشده نیز میتوانند برای دادههای بصری و ساختار یافته تولید شوند. نام Stained Glass Transform ریشه در ظاهر بصری بازنمودهای تصادفی داده های بصری دارد که می تواند شبیه مشاهده داده ها از طریق شیشه رنگی باشد، همانطور که در این نشان داده شده است. مورد استفاده نیروی دریایی ایالات متحده.

SGT با پیشرفته ترین LLM ها مانند Llama 2 کار می کند. شکل زیر نمونه ای از اعمال SGT را در مدل Llama 2 برای دنبال کردن دستورالعمل ها نشان می دهد در حالی که یک لایه حفاظتی به دستورالعمل و زمینه اضافه می کند. سمت چپ شکل نمونه ای از یک سند مالی را به عنوان زمینه نشان می دهد، با دستورالعملی که از مدل می خواهد سند را خلاصه کند. در پایین سمت چپ، پاسخ ایجاد شده توسط Llama 2 هنگام کار بر روی اعلان خام نشان داده شده است. هنگام استفاده از SGT، جاسازی های مرتبط با این اعلان در سمت مشتری به جاسازی های تصادفی تبدیل می شوند، همانطور که در ادامه این پست با جزئیات بیشتر توضیح داده شده است. پایین سمت راست نشان میدهد که اگر دادههای RmoRed (جاسازیهای پس از تبدیل) به جای جاسازیهای محافظتنشده ارسال شوند، Llama 2 همچنان میتواند پاسخ درستی ایجاد کند. بالا سمت راست نشان می دهد که اگر داده های RmoRed به بیرون درز کند، بازسازی درخواست اصلی منجر به متن نامفهوم می شود.

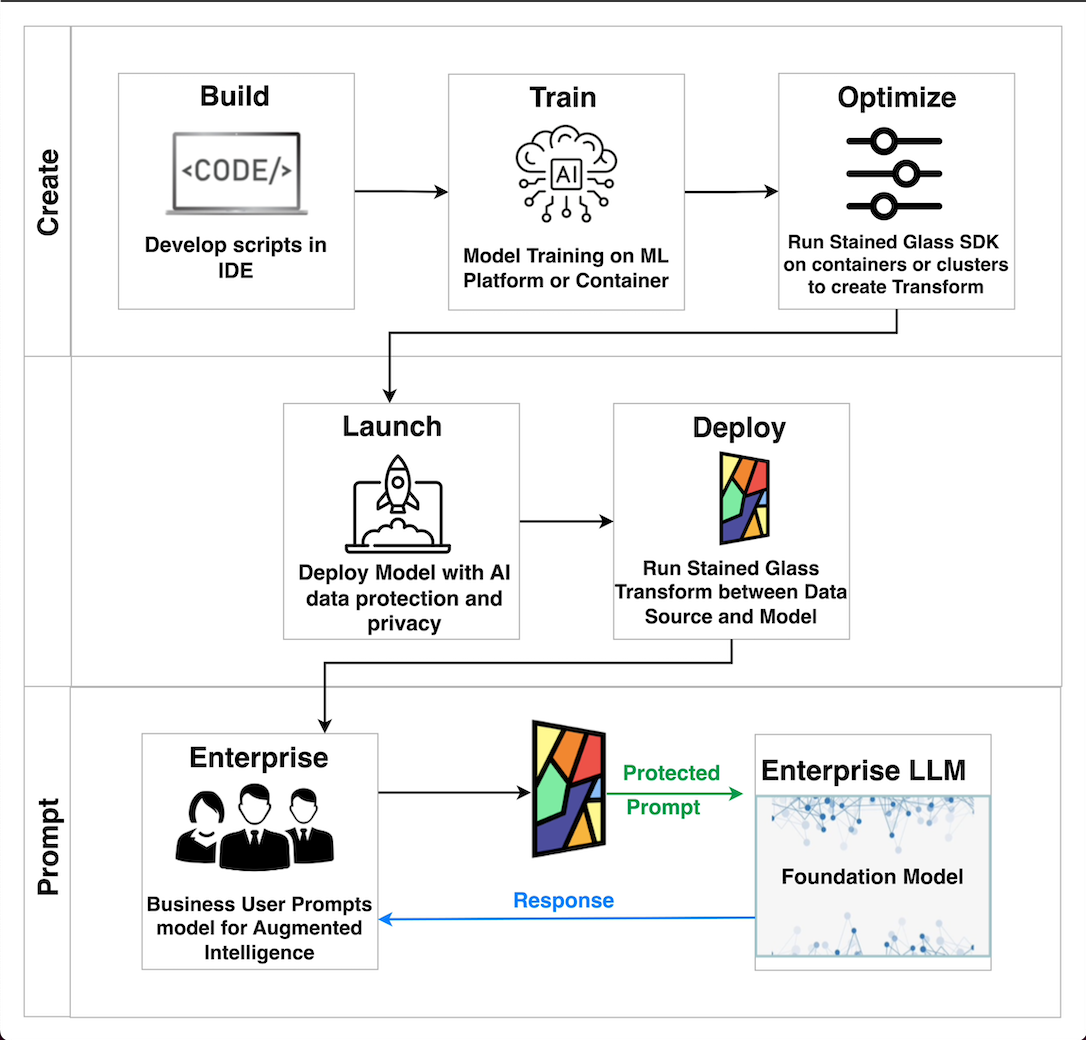

برای ایجاد یک SGT برای یک مدل معین مانند Llama 2، پروتوپیا AI یک کتابخانه سبک به نام Stained Glass SDK ارائه میکند که توسعه PyTorch است. همانطور که در شکل زیر نشان داده شده است، پس از ایجاد یک SGT، می توان آن را به روش های مختلف در خطوط لوله استقرار ادغام کرد. تبدیلی که از SDK ایجاد میشود، میتواند به صورت محلی، در یک راهاندازی ترکیبی یا به طور کامل در فضای ابری مستقر شود. این امکان پذیر است زیرا SGT به گونه ای طراحی شده است که یک فرآیند سبک وزن است که به منابع محاسباتی بسیار کمی نیاز دارد و به این ترتیب تأثیر حداقلی بر مسیر بحرانی استنتاج دارد. ارزیابی کلیدی دیگر، حفظ دقت مدل با استفاده از دادههای بازنمایششده است. مشاهده میکنیم که در انواع دادههای مختلف و تغییرات مدل، دقت در محدودههای تحمل مطلوب هنگام استفاده از دادههای بازنمایششده حفظ میشود.

این گزینهها برای استقرار و حفظ دقت، به پذیرش مطمئن SGT توسط همه سهامداران در یک سازمان سازمانی اجازه میدهد. برای محافظت بیشتر از خروجی LLM، پروتوپیا AI میتواند خروجیهای پرس و جو را به نمایشی که رمزگشای آن فقط برای صاحب دادههای سازمانی در دسترس است، رمزگذاری کند.

بررسی اجمالی راه حل

در بخش قبل توضیح داده شد که چگونه می توانید از Stained Glass Transform در معماری های مختلف استفاده کنید. شکل زیر مراحل مربوط به ایجاد، استقرار و استفاده از SGT برای LLM ها را شرح می دهد:

- ایجاد SGT – تیمی که مدل پایه پایه LLM را آموزش می دهد (ارائه دهندگان LLM های اختصاصی، ارائه دهندگان خدمات ابری، یا تیم های ML سازمانی که LLM های خود را ایجاد می کنند) نرم افزار Stained Glass SDK Protopia AI را بدون تغییر شیوه های موجود خود برای آموزش و استقرار LLM اجرا می کند. پس از تکمیل آموزش مدل پایه، SDK به عنوان یک پاس بهینه سازی بر روی مدل زبان برای محاسبه SGT اجرا می شود. این پاس بهینه سازی از طریق یک افزونه به PyTorch تحویل داده می شود. SDK مدل پایه را پیچیده می کند و به صورت ریاضی تبدیل شیشه ای منحصر به فرد را برای آن LLM کشف می کند. جزئیات بیشتر از ریاضیات اساسی را می توان در کاغذ سفید همراه. توجه داشته باشید که از آنجایی که تیمی که LLM را آموزش میدهد، Stained Glass SDK را نیز اجرا میکند، هیچ نوردهی یا ارسال وزنههای مدل لازم برای تکمیل این مرحله وجود ندارد.

- انتشار و استقرار SGT - SGT که از مرحله بهینه سازی قبلی خروجی می شود به عنوان بخشی از خط لوله داده که LLM آموزش دیده را تغذیه می کند، مستقر می شود. همانطور که در بخش قبل توضیح داده شد، SGT در سمت مشتری سازمانی قرار دارد.

- استفاده از SGT - SGT بر روی دستورات ایجاد شده توسط شرکت اجرا می شود و دستورات محافظت شده را تولید می کند که به LLM مستقر ارسال می شود. این شرکت را قادر می سازد تا مالکیت پرسش ها و زمینه حساس خود را حفظ کند. با استفاده از Protopia AI Stained Glass، داده های حساس محافظت نشده از سایت یا منطقه اعتماد شرکت خارج نمی شوند.

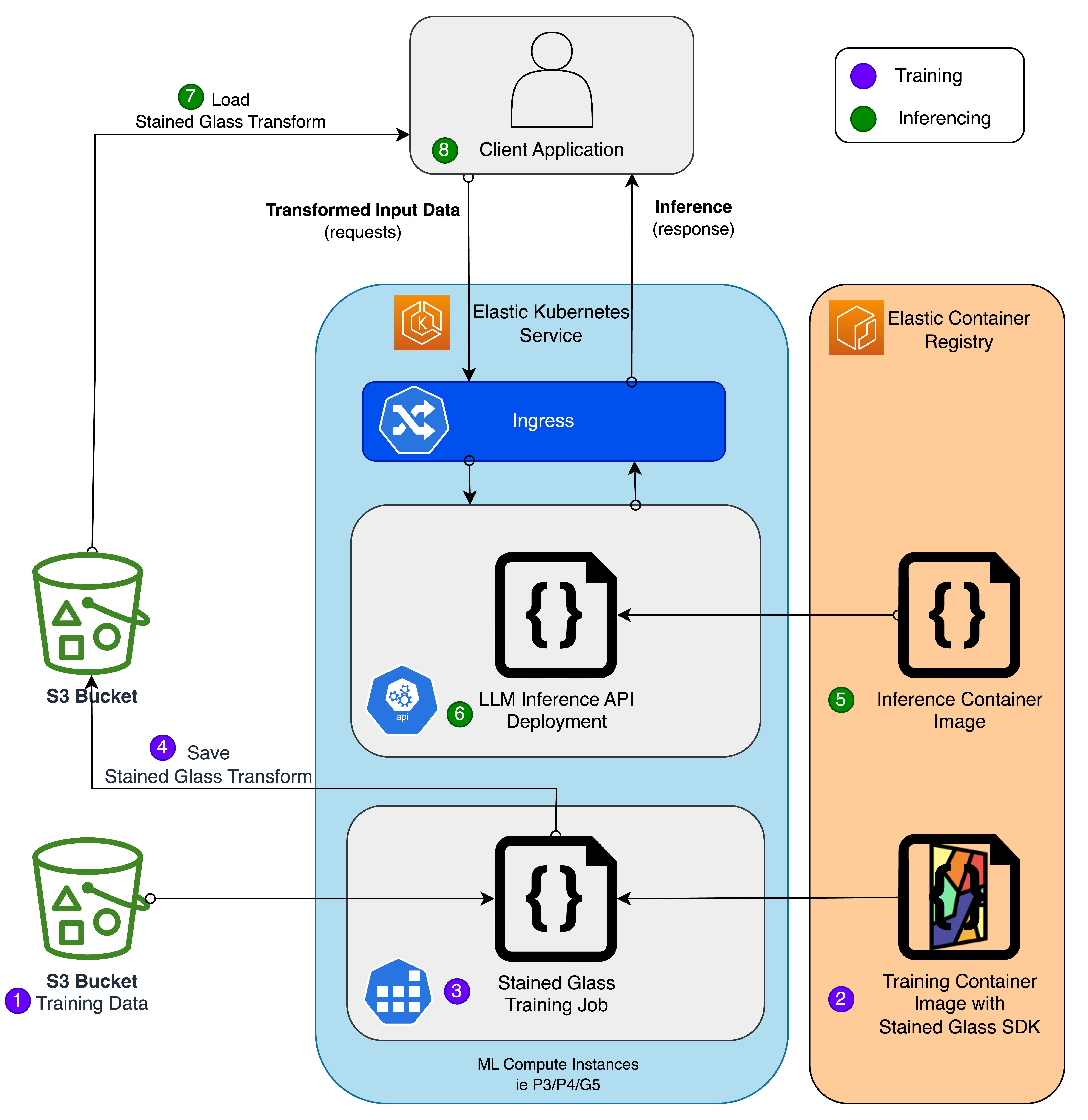

می توانید از Stained Glass SDK برای ایجاد SGT به روش های مختلف استفاده کنید. برای مثال، میتوانید از Stained Glass SDK در محیطهای یادگیری ماشینی خود مدیریتی (ML) استفاده کنید. سرویس الاستیک کوبرنتز آمازون (Amazon EKS) برای آموزش و استنباط یا درون ابر محاسبه الاستیک آمازون (Amazon EC2) به طور مستقیم. گزینه دیگر این است که می تواند در داخل اجرا شود آمازون SageMaker برای ایجاد یک SGT برای یک مدل آموزش داده شده. تبدیل ورودی برای استقرار در طول استنتاج از مشتری مستقل از پیاده سازی استقرار انتخاب شده است.

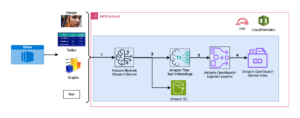

شکل زیر یک پیاده سازی ممکن را در یک محیط ML خود مدیریتی نشان می دهد که در آن آموزش Stained Glass Transform در Amazon EKS انجام می شود.

در این گردش کار، یک کانتینر با استفاده از Stained Glass SDK ایجاد می شود و در آن مستقر می شود رجیستری ظروف الاستیک آمازون (Amazon ECR). سپس این کانتینر در آمازون EKS برای آموزش SGT که در آن ذخیره شده است مستقر می شود سرویس ذخیره سازی ساده آمازون (Amazon S3). اگر از آمازون EC2 استفاده میکنید، میتوانید بهعنوان بخشی از راهاندازی ML خود، تغییر شکل را مستقیماً در نمونه خود آموزش دهید. Stained Glass SDK میتواند بر روی انواع مختلفی از نمونهها، از جمله خانوادههای نمونه آمازون P5، P4، یا G5، بر اساس الزامات پایه LLM شما اجرا شود. پس از استقرار LLM برای استفاده برای استنتاج، برنامه سرویس گیرنده از SGT ایجاد شده، که یک عملیات سبک وزن است، استفاده می کند تا دستورات و زمینه را قبل از ارسال آنها به LLM تغییر دهد. با انجام این کار، فقط داده های تبدیل شده در معرض LLM قرار می گیرند و مالکیت ورودی اصلی در سمت مشتری حفظ می شود.

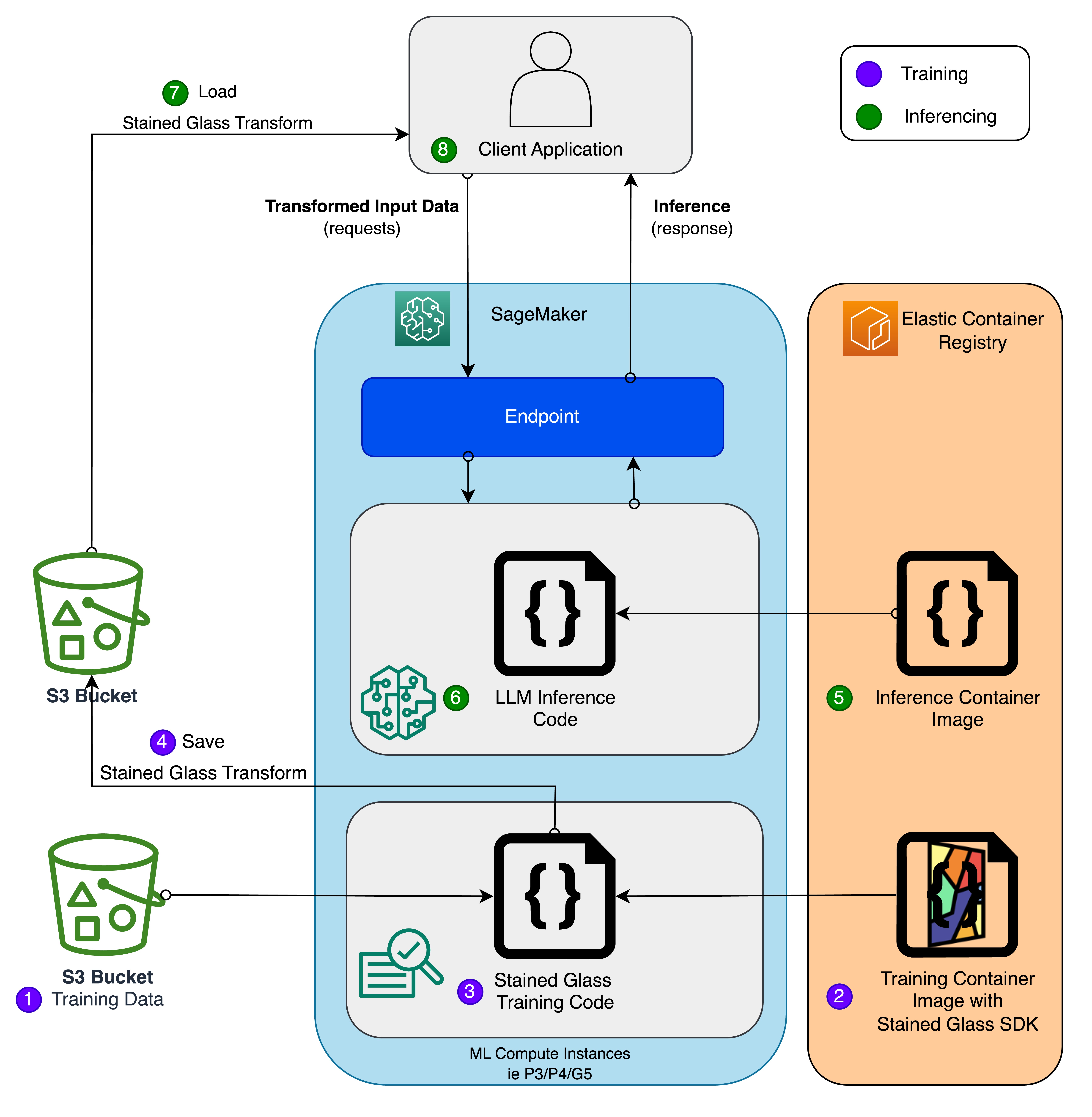

شکل زیر نشان می دهد که چگونه می توانید یک تبدیل را آموزش دهید و استنتاج را در SageMaker اجرا کنید.

ایجاد SGT مسیری مشابه راهاندازی Amazon EKS با مصرف دادههای آموزشی از Amazon S3، آموزش SGT در یک ظرف و ذخیره آن در Amazon S3 دنبال میکند. میتوانید از Stained Glass SDK در تنظیمات SageMaker موجود خود استفاده کنید Amazon SageMaker Studio, نوت بوک SageMakerو شغل آموزش SageMaker. LLM به عنوان یک نقطه پایانی SageMaker میزبانی می شود که توسط برنامه مشتری قابل دسترسی است. استنباط برای برنامه مشتری نیز مشابه راه اندازی Amazon EKS است، به جز مواردی که به مدل ارائه می شود.

بازنمایشهای تصادفیسازیشده برای محافظت از درخواستهای LLM و تنظیم دقیق دادهها

این بخش انواع موارد استفاده را پوشش می دهد که نشان می دهد چگونه بازنمایی تصادفی از درخواست های LLM محافظت می کند. این مثالها پیامدهای عمده تلاشهای هوش مصنوعی مولد سازمانی را نشان میدهند: باز کردن درهای جدیدی به روی موارد استفاده از هوش مصنوعی، سرعت بخشیدن به بازار و در عین حال حفاظت مناسب از دادههای سازمانی، و حفظ مالکیت دادههای حساس مورد نیاز برای استفاده در اعلانهای LLM.

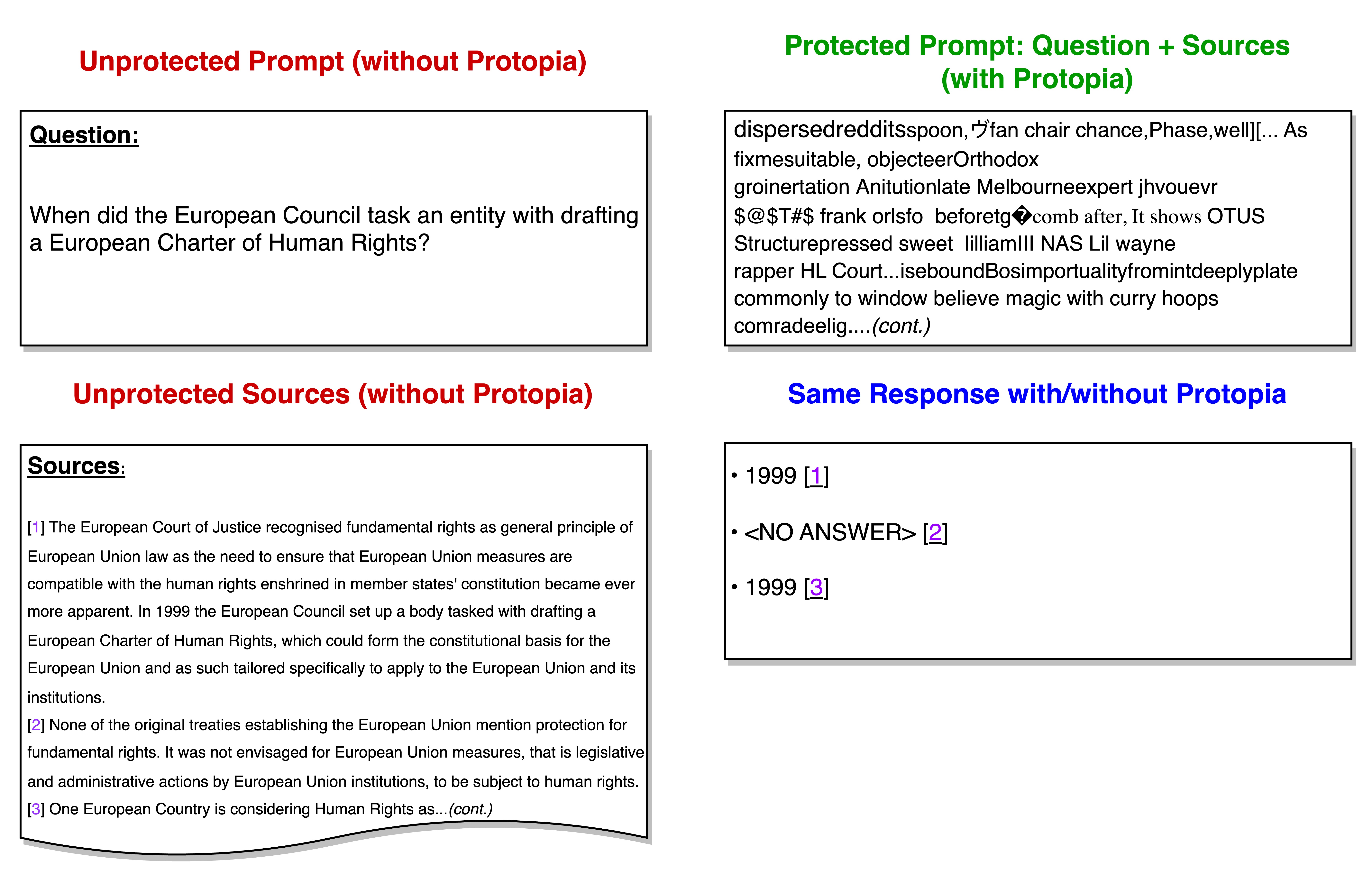

مورد استفاده RAG

یک مورد محبوب برای استفاده سازمانی برای LLMها، Retrieval Augmented Generation (RAG) است. شکل زیر یک مثال گویا را نشان می دهد که در آن اعلان ها و منابع با استفاده از شیشه رنگی محافظت می شوند. سمت چپ شکل اعلان های محافظت نشده و اطلاعات منبع را نشان می دهد. در پیاده سازی سازمانی RAG، منابع می توانند شامل اطلاعات حساسی مانند اسرار تجاری شرکت، مالکیت معنوی یا اطلاعات مالی باشند. سمت راست بهترین بازسازی ممکن را در متن قابل خواندن توسط انسان از دستورات RmoRed ایجاد شده توسط SGT نشان می دهد.

ما می توانیم مشاهده کنیم که حتی در بهترین بازسازی ممکن، اطلاعات کاملا مبهم است. با این حال، پاسخ مدل با و بدون تبدیل یکسان است، با اشاره به اسناد منبع اصلی، در نتیجه دقت سؤال و اسناد منبع در حین انجام این مورد استفاده تجاری محبوب حفظ میشود.

کاربرد گسترده در سراسر LLM ها و زبان ها

یکی از ویژگی های برجسته Stained Glass SDK این است که در برابر پیشرفت های مدل بسیار انعطاف پذیر است و با مدل های پیشرفته مانند لاما 2. شکل زیر یک SGT را نشان می دهد که روی Llama 2 LLM ایجاد شده است که قبلاً برای کار با متن ژاپنی تنظیم شده بود. این مثال بیشتر نشان میدهد که SGTها را میتوان برای هر زبانی ایجاد و اعمال کرد و حتی ورودیهای مدلهای تنظیمشده را نیز میتوان تغییر داد. کاربرد کلی SGT به دلیل پایه محکم Stained Glass SDK است که مدل و داده آگنوستیک است.

حفاظت از تنظیم دقیق داده ها و همچنین درخواست ها

Stained Glass Transform تنها به حفاظت از داده ها در زمان استنتاج محدود نمی شود. همچنین می تواند از داده های مورد استفاده برای تنظیم دقیق مدل پایه محافظت کند. فرآیند ایجاد تبدیل برای تنظیم دقیق مجموعه داده ها همان است که در بخش معماری راه حل قبلا در این پست توضیح داده شد. این تبدیل برای مدل پایه ایجاد می شود تا بدون دسترسی به داده های تنظیم دقیق تنظیم شود. پس از ایجاد و آموزش SGT برای مدل پایه، مجموعه داده های تنظیم دقیق به نمایش های مجدد تصادفی تبدیل می شود که سپس برای تنظیم دقیق مدل پایه استفاده می شود. این فرآیند با جزئیات بیشتر در بخش توضیح داده شده است کاغذ سفید همراه.

در مثال زیر، یک مشتری سازمانی باید یک مدل موجود را برای تشخیص ناهنجاری گزارش شبکه تنظیم کند. آنها از Stained Glass برای تبدیل مجموعه داده های تنظیم دقیق حساس به جاسازی های تصادفی استفاده کردند که برای تنظیم دقیق مدل پایه آنها استفاده شد. آنها دریافتند که مدل تشخیصی که روی نمایشهای تبدیلشده بهخوبی تنظیم شده بود، با دقت تقریباً یکسانی در مقایسه با سناریوی فرضی تنظیم دقیق مدل پایه روی مجموعه دادههای تنظیم دقیق محافظتنشده انجام شد. جدول زیر دو نمونه از رکوردهای داده متن ساده از مجموعه داده تنظیم دقیق و یک بازسازی به متن همان رکوردهای داده از مجموعه داده تنظیم دقیق را نشان می دهد.

زیر کاپوت Stained Glass Transform for LLMs

هنگامی که SGT برای بینایی کامپیوتر اعمال می شود، بر روی ویژگی های پیکسل ورودی عمل می کند، و برای LLM ها، در سطح جاسازی عمل می کند. برای برجسته کردن نحوه عملکرد Stained Glass Transform، تعبیههای سریع را به عنوان یک ماتریس تصور کنید، همانطور که در سمت چپ شکل زیر نشان داده شده است. در هر ورودی، یک مقدار قطعی وجود دارد. این مقدار را می توان به داده های اصلی نگاشت و درخواست محافظت نشده را در معرض دید قرار داد. Stained Glass Transform این ماتریس از مقادیر قطعی را به ماتریسی تبدیل می کند که عناصر آن ابری از احتمالات هستند.

درخواست تبدیل شده با نمونهبرداری از نویز از توزیعهای احتمالی تعریفشده توسط SGT و افزودن نویز نمونهبرداری شده به جاسازیهای قطعی ارائه میشود، که مقادیر اعلان اصلی را بهطور غیرقابل برگشت تصادفی میکند. این مدل همچنان دستور بازنمایش تصادفی شده را در سطح ریاضی درک می کند و می تواند وظیفه خود را به دقت انجام دهد.

نتیجه

در این پست بحث شد که چگونه Stained Glass Transform پروتوپیا AI مالکیت داده خام و محافظت از فرآیند عملیات ML را جدا میکند و شرکتها را قادر میسازد مالکیت و حفظ حریم خصوصی اطلاعات حساس را در درخواستهای LLM و تنظیم دقیق دادهها حفظ کنند. با استفاده از این پیشرفتهترین محافظت از دادهها برای استفاده از LLM، شرکتها میتوانند با نگرانی کمتر در مورد قرار گرفتن در معرض اطلاعات حساس، پذیرش مدلهای پایه و LLM را تسریع کنند. با باز کردن ایمن ارزش در دادههای واقعی سازمانی، سازمانها میتوانند کارایی و نتایج تجاری LLMهای قول داده شده را کارآمدتر و سریعتر فعال کنند. برای کسب اطلاعات بیشتر در مورد این فناوری، می توانید مطالب بیشتری را در ادامه مطلب بیابید کاغذ سفید همراه و با پروتوپیا AI ارتباط برقرار کنید دسترسی داشته باشید و آن را روی داده های سازمانی خود امتحان کنید.

درباره پروتوپیا AI

Protopia AI پیشرو در زمینه حفاظت از داده ها و فناوری های AI/ML حفظ حریم خصوصی مستقر در آستین، تگزاس است و متخصص در فعال کردن الگوریتم های هوش مصنوعی و پلتفرم های نرم افزاری بدون نیاز به دسترسی به اطلاعات متنی ساده است. طی 2 سال گذشته، Protopia AI محصول پرچمدار Stained Glass Transform خود را در انواع موارد استفاده ML و انواع داده با نیروی دریایی ایالات متحده، خدمات مالی پیشرو و ارائه دهندگان فناوری جهانی با موفقیت به نمایش گذاشته است.

Protopia AI با شرکت ها، ارائه دهندگان هوش مصنوعی و LLM مولد، و ارائه دهندگان خدمات ابری (CSP) کار می کند تا ضمن استفاده از راه حل های AI/ML، مالکیت و محرمانه بودن داده های سازمانی را حفظ کند. پروتوپیا AI با AWS برای ارائه بخش مهمی از حفاظت از داده ها و مالکیت برای پذیرش هوش مصنوعی مولد توسط شرکت ها شریک شده است و یکی از 21 استارت آپی بود که برای افتتاحیه انتخاب شد. AWS Generative AI Accelerator در سال 2023.

درباره نویسندگان

بالاجی چندراسهکاران معاون بخش Go-to-Market & Customer Enablement در Protopia AI است، با مشتریان همکاری نزدیکی می کند تا از هوش مصنوعی در کسب و کار خود استفاده کند و در عین حال حفاظت از داده ها و حریم خصوصی را در اولویت قرار دهد. قبل از پروتوپیا هوش مصنوعی، بالاجی رهبر محصول برای راه حل های هوش مصنوعی در Infor بود و محصولات ارزش محور را توسعه می داد و در عین حال به عنوان یک شریک قابل اعتماد برای مشتریان سازمانی در صنایع مختلف عمل می کرد. در خارج از محل کار، او از موسیقی، پیاده روی و سفر با خانواده لذت می برد.

بالاجی چندراسهکاران معاون بخش Go-to-Market & Customer Enablement در Protopia AI است، با مشتریان همکاری نزدیکی می کند تا از هوش مصنوعی در کسب و کار خود استفاده کند و در عین حال حفاظت از داده ها و حریم خصوصی را در اولویت قرار دهد. قبل از پروتوپیا هوش مصنوعی، بالاجی رهبر محصول برای راه حل های هوش مصنوعی در Infor بود و محصولات ارزش محور را توسعه می داد و در عین حال به عنوان یک شریک قابل اعتماد برای مشتریان سازمانی در صنایع مختلف عمل می کرد. در خارج از محل کار، او از موسیقی، پیاده روی و سفر با خانواده لذت می برد.

جنیفر کواگنبرگ تیم مهندسی در Protopia AI را رهبری می کند و تلاش می کند تا اطمینان حاصل کند که فناوری شیشه رنگی نیازهای مشتریان خود را برای محافظت از داده های آنها برآورده می کند. جنیفر دارای تجربه قبلی در زمینه امنیت کار در تویوتا در گروه امنیت سایبری محصولات آنها، مدیریت بارهای کاری Cloud در N-able و مسئول داده ها در Match.com است.

جنیفر کواگنبرگ تیم مهندسی در Protopia AI را رهبری می کند و تلاش می کند تا اطمینان حاصل کند که فناوری شیشه رنگی نیازهای مشتریان خود را برای محافظت از داده های آنها برآورده می کند. جنیفر دارای تجربه قبلی در زمینه امنیت کار در تویوتا در گروه امنیت سایبری محصولات آنها، مدیریت بارهای کاری Cloud در N-able و مسئول داده ها در Match.com است.

اندرو سانسوم مهندس راه حل های هوش مصنوعی در Protopia AI است که در آن به شرکت ها کمک می کند تا از هوش مصنوعی استفاده کنند و در عین حال اطلاعات خصوصی و حساس را در داده های خود حفظ کنند. قبل از Protopia AI، او به عنوان یک مشاور فنی با تمرکز بر فعال کردن راه حل های AI برای مشتریان در بسیاری از صنایع از جمله مالی، تولید، مراقبت های بهداشتی و آموزش کار می کرد. او همچنین علوم کامپیوتر و ریاضی را به دانش آموزان دبیرستانی، دانشگاهی و حرفه ای تدریس می کرد.

اندرو سانسوم مهندس راه حل های هوش مصنوعی در Protopia AI است که در آن به شرکت ها کمک می کند تا از هوش مصنوعی استفاده کنند و در عین حال اطلاعات خصوصی و حساس را در داده های خود حفظ کنند. قبل از Protopia AI، او به عنوان یک مشاور فنی با تمرکز بر فعال کردن راه حل های AI برای مشتریان در بسیاری از صنایع از جمله مالی، تولید، مراقبت های بهداشتی و آموزش کار می کرد. او همچنین علوم کامپیوتر و ریاضی را به دانش آموزان دبیرستانی، دانشگاهی و حرفه ای تدریس می کرد.

دکترایمن ابراهیمی یکی از بنیانگذاران و مدیر اجرایی Protopia AI است. دکتر ابراهیمی مشتاق است که هوش مصنوعی را قادر سازد تا تجربه انسانی را در سطوح مختلف اجتماعی و صنعتی غنی کند. پروتوپیا AI چشم اندازی برای تقویت عدسی است که از طریق آن هوش مصنوعی داده های ضروری و با کیفیت مورد نیاز خود را مشاهده می کند و در عین حال قابلیت های جدیدی را برای محافظت از اطلاعات حساس ایجاد می کند. قبل از پروتوپیا AI، او به مدت 9 سال دانشمند تحقیقاتی ارشد در NVIDIA بود. هدف او در تحقیقات NVIDIA حل مشکلات دسترسی به مجموعه داده های عظیم در ML/AI بود. او همچنین در تالیف نشریات بررسی شده در مورد چگونگی استفاده از قدرت هزاران پردازنده گرافیکی برای امکانپذیر ساختن آموزش مدلهای زبان بزرگ همکاری کرد.

دکترایمن ابراهیمی یکی از بنیانگذاران و مدیر اجرایی Protopia AI است. دکتر ابراهیمی مشتاق است که هوش مصنوعی را قادر سازد تا تجربه انسانی را در سطوح مختلف اجتماعی و صنعتی غنی کند. پروتوپیا AI چشم اندازی برای تقویت عدسی است که از طریق آن هوش مصنوعی داده های ضروری و با کیفیت مورد نیاز خود را مشاهده می کند و در عین حال قابلیت های جدیدی را برای محافظت از اطلاعات حساس ایجاد می کند. قبل از پروتوپیا AI، او به مدت 9 سال دانشمند تحقیقاتی ارشد در NVIDIA بود. هدف او در تحقیقات NVIDIA حل مشکلات دسترسی به مجموعه داده های عظیم در ML/AI بود. او همچنین در تالیف نشریات بررسی شده در مورد چگونگی استفاده از قدرت هزاران پردازنده گرافیکی برای امکانپذیر ساختن آموزش مدلهای زبان بزرگ همکاری کرد.

روهیت تالوری یک متخصص مولد AI GTM در خدمات وب آمازون (AWS) است. او با سازندگان برتر مدل AI مولد، مشتریان استراتژیک، شرکای کلیدی AI/ML و تیمهای خدمات AWS همکاری میکند تا نسل بعدی هوش مصنوعی، یادگیری ماشین و محاسبات تسریع را در AWS فعال کند. او قبلاً یک معمار راه حل های سازمانی و رهبر راه حل های جهانی برای مشاوره ادغام و خرید AWS بود.

روهیت تالوری یک متخصص مولد AI GTM در خدمات وب آمازون (AWS) است. او با سازندگان برتر مدل AI مولد، مشتریان استراتژیک، شرکای کلیدی AI/ML و تیمهای خدمات AWS همکاری میکند تا نسل بعدی هوش مصنوعی، یادگیری ماشین و محاسبات تسریع را در AWS فعال کند. او قبلاً یک معمار راه حل های سازمانی و رهبر راه حل های جهانی برای مشاوره ادغام و خرید AWS بود.

- محتوای مبتنی بر SEO و توزیع روابط عمومی. امروز تقویت شوید.

- PlatoData.Network Vertical Generative Ai. به خودت قدرت بده دسترسی به اینجا.

- PlatoAiStream. هوش وب 3 دانش تقویت شده دسترسی به اینجا.

- PlatoESG. کربن ، CleanTech، انرژی، محیط، خورشیدی، مدیریت پسماند دسترسی به اینجا.

- PlatoHealth. هوش بیوتکنولوژی و آزمایشات بالینی. دسترسی به اینجا.

- منبع: https://aws.amazon.com/blogs/machine-learning/foundational-data-protection-for-enterprise-llm-acceleration-with-protopia-ai/

- : دارد

- :است

- :نه

- :جایی که

- 100

- 1040

- 7

- 9

- a

- درباره ما

- بالاتر

- شتاب دادن

- تسریع شد

- تسریع

- شتاب

- شتاب دهنده

- دسترسی

- در دسترس

- دسترسی

- دقت

- به درستی

- جمع آوری

- در میان

- بازیگری

- اضافه کردن

- اتخاذ

- پیشرفت

- مزیت - فایده - سود - منفعت

- مشاوره

- پس از

- در برابر

- AI

- موارد استفاده ai

- AI / ML

- هدف

- الگوریتم

- معرفی

- اجازه می دهد تا

- تقریبا

- همچنین

- آمازون

- آمازون EC2

- آمازون خدمات وب

- خدمات وب آمازون (AWS)

- an

- و

- اندرو

- تشخیص ناهنجاری

- دیگر

- هر

- کاربرد

- اعمال می شود

- با استفاده از

- معماری

- هستند

- مصنوعی

- هوش مصنوعی

- AS

- خواهان

- مرتبط است

- At

- افزوده شده

- آستین

- در دسترس

- AWS

- بالجی

- پایه

- مستقر

- خط مقدم

- اساسی

- BE

- زیرا

- بوده

- قبل از

- بودن

- بهترین

- خارج از

- هر دو

- پایین

- شکستن

- سازندگان

- کسب و کار

- کسب و کار

- by

- نام

- CAN

- قابلیت های

- حمل

- مورد

- موارد

- چالش ها

- متغیر

- رئیس

- مدیر اجرایی

- مدیر اجرایی

- برگزیده

- مشتری

- مشتریان

- نزدیک

- ابر

- بنیانگذاران

- همکاری

- COM

- مشترک

- مقایسه

- رقابتی

- کامل

- تکمیل شده

- به طور کامل

- انطباق

- جزء

- محاسبه

- کامپیوتر

- علم کامپیوتر

- چشم انداز کامپیوتر

- محاسبه

- علاقمند

- نگرانی ها

- مطمئن

- محرمانه بودن

- مشاور

- ظرف

- زمینه

- کنترل

- تبدیل

- اصلاح

- میتوانست

- را پوشش می دهد

- ایجاد

- ایجاد شده

- ایجاد

- ایجاد

- بحرانی

- مشتری

- مشتریان

- امنیت سایبری

- داده ها

- اطلاعات به بیرون درز کرد

- مدیریت اطلاعات

- حریم خصوصی داده ها

- حفاظت از داده ها

- مجموعه داده ها

- تصمیم گیری

- مشخص

- ارائه

- تحویل داده

- نشان

- نشان می دهد

- نشان دادن

- مستقر

- استقرار

- گسترش

- شرح داده شده

- طراحی

- جزئیات

- جزئیات

- کشف

- در حال توسعه

- مختلف

- مستقیما

- کشف می کند

- بحث کردیم

- توزیع

- مختلف

- سند

- اسناد و مدارک

- میکند

- عمل

- درب

- پایین

- dr

- رانده

- در طی

- هر

- پیش از آن

- آموزش

- اثر

- بازده

- بهره وری

- موثر

- موثر

- تلاش

- عناصر

- تعبیه کردن

- سنگ سنباده

- قادر ساختن

- توانمندسازی

- را قادر می سازد

- را قادر می سازد

- نقطه پایانی

- مهندس

- مهندسی

- افزایش

- غنی سازی

- اطمینان حاصل شود

- حصول اطمینان از

- سرمایه گذاری

- پذیرش شرکت

- امنیت شرکت

- شرکت

- ورود

- محیط

- محیط

- به خصوص

- ماهیت

- ارزیابی

- حتی

- مثال

- مثال ها

- جز

- اجرایی

- مدیر اجرایی

- موجود

- تجربه

- توضیح داده شده

- قرار گرفتن در معرض

- ارائه

- گسترش

- خانواده

- خانواده

- امکان پذیر است

- امکانات

- شکل

- سرمایه گذاری

- مالی

- اطلاعات مالی

- خدمات مالی

- پیدا کردن

- کشتی دریادار

- متمرکز شده است

- پیروی

- به دنبال آن است

- برای

- یافت

- پایه

- بنیادین

- از جانب

- کامل

- تابع

- بیشتر

- سوالات عمومی

- تولید می کنند

- تولید

- تولید می کند

- نسل

- مولد

- هوش مصنوعی مولد

- دریافت کنید

- داده

- شیشه

- جهانی

- رفتن به بازار

- GPU ها

- گروه

- تضمین می کند

- آیا

- he

- بهداشت و درمان

- کمک می کند

- زیاد

- نماد

- های لایت

- خیلی

- خود را

- جامع

- کاپوت

- میزبانی

- چگونه

- چگونه

- اما

- HTML

- HTTPS

- انسان

- تجربه انسانی

- ترکیبی

- یکسان

- if

- نشان دادن

- نشان می دهد

- تصور کنید

- تأثیر

- پیاده سازی

- پیامدهای

- بهبود

- in

- افتتاحیه

- شامل

- از جمله

- مستقل

- لوازم

- صنعت

- اطلاعات

- ورودی

- ورودی

- نمونه

- در عوض

- یکپارچه

- فکری

- مالکیت معنوی

- اطلاعات

- به

- گرفتار

- IT

- ITS

- خود

- ژاپنی

- جنیفر

- JPG

- کلید

- زبان

- بزرگ

- بعد

- لایه

- رهبری

- رهبر

- برجسته

- یاد گرفتن

- یادگیری

- ترک کردن

- ترک کرد

- قانونی

- کمتر

- سطح

- قدرت نفوذ

- کتابخانه

- سبک وزن

- پسندیدن

- محدود

- محدود شده

- محدودیت

- کوچک

- پشم لاما

- LLM

- به صورت محلی

- ورود به سیستم

- دستگاه

- فراگیری ماشین

- حفظ

- حفظ

- عمده

- ساخت

- مدیریت

- مدیریت

- تولید

- بسیاری

- بازار

- عظیم

- مسابقه

- ریاضی

- ریاضی

- از نظر ریاضی

- ماتریس

- ممکن است..

- ملاقات

- ادغام

- ادغام و ادغام

- متا

- حداقل

- ML

- مدل

- مدل

- بیش

- چندگانه

- موسیقی

- N-توان

- نام

- لازم

- نیاز

- ضروری

- نیازمند

- نیازهای

- شبکه

- جدید

- بعد

- نه

- سر و صدا

- توجه داشته باشید

- رمان

- کارت گرافیک Nvidia

- مشاهده کردن

- مشاهده می کند

- of

- افسر

- دفاتر

- غالبا

- on

- ONE

- فقط

- افتتاح

- کار

- عمل می کند

- عملیاتی

- عمل

- عملیات

- بهینه سازی

- گزینه

- گزینه

- or

- کدام سازمان ها

- سازمان های

- اصلی

- دیگر

- خارج

- نتایج

- نمای کلی

- تولید

- خروجی

- خارج از

- روی

- غلبه بر

- خود

- مالک

- مالکیت

- بخش

- شریک

- مشارکت کرد

- همکاری

- شرکای

- عبور

- احساساتی

- گذشته

- مسیر

- بررسی شده توسط همکار

- انجام

- انجام

- دکترا

- ستون

- خط لوله

- پیکسل

- ساده

- سیستم عامل

- افلاطون

- هوش داده افلاطون

- PlatoData

- محبوب

- فرصت

- ممکن

- پست

- قدرت

- قوی

- شیوه های

- حفظ کردن

- قبلی

- قبلا

- قبلا

- اولویت بندی

- خلوت

- خصوصی

- مشکلات

- روند

- محصول

- محصولات

- حرفه ای

- وعده داده شده

- پرسیدن

- به درستی

- ویژگی

- اختصاصی

- محافظت از

- محفوظ

- حفاظت

- حفاظت

- محافظت می کند

- ارائه

- ارائه دهنده

- ارائه دهندگان

- فراهم می کند

- انتشارات

- مارماهی

- کیفیت

- نمایش ها

- سوال

- به سرعت

- تصادفی

- سریعا

- خام

- مطالعه

- واقعی

- سوابق

- اشاره

- تنظیم

- آزاد

- ارائه شده

- نمایندگی

- ضروری

- نیاز

- مورد نیاز

- تحقیق

- انعطاف پذیر

- منابع

- پاسخ

- مسئوليت

- نتیجه

- نگه داشتن

- حفظ

- نگهداری

- راست

- تنومند

- نشات گرفتن

- دویدن

- در حال اجرا

- اجرا می شود

- حفاظت

- با خیال راحت

- امن تر

- حکیم ساز

- همان

- نگهداری می شود

- صرفه جویی کردن

- مقیاس

- سناریو

- مدرسه

- علم

- دانشمند

- sdk

- اسرار

- بخش

- امن

- تیم امنیت لاتاری

- به دنبال

- انتخاب شد

- ارسال

- در حال ارسال

- ارشد

- حساس

- فرستاده

- سرویس

- ارائه دهنده خدمات

- ارائه دهندگان خدمات

- خدمات

- خدمت

- برپایی

- نشان داده شده

- نشان می دهد

- طرف

- مشابه

- ساده

- سایت

- نشسته است

- کند

- So

- اجتماعی

- نرم افزار

- فقط

- راه حل

- مزایا

- حل

- حل می کند

- منبع

- منابع

- متخصص

- تخصص دارد

- سرعت

- سهامداران

- نوپا

- وضعیت هنر

- گام

- مراحل

- هنوز

- ذخیره سازی

- استراتژیک

- ساخت یافته

- دانشجویان

- موفقیت

- چنین

- خلاصه کردن

- جدول

- گرفتن

- هدف

- کار

- وظایف

- تدریس کرد

- تیم

- تیم ها

- فنی

- فن آوری

- پیشرفته

- وابسته به تکزاس

- متن

- که

- La

- اطلاعات

- شان

- آنها

- سپس

- آنجا.

- در نتیجه

- اینها

- آنها

- این

- کسانی که

- هزاران نفر

- از طریق

- زمان

- به

- تحمل

- ابزار

- بالا

- تویوتا

- تجارت

- قطار

- آموزش دیده

- آموزش

- قطار

- دگرگون کردن

- دگرگونی

- مبدل

- تبدیل شدن

- سفر

- اعتماد

- مورد اعتماد

- شریک مورد اعتماد

- امتحان

- دو

- انواع

- اساسی

- درک می کند

- منحصر به فرد

- واحد

- دانشگاه

- باز کردن قفل

- us

- استفاده

- استفاده کنید

- مورد استفاده

- استفاده

- استفاده

- با استفاده از

- استفاده کنید

- ارزش

- ارزشها

- تنوع

- مختلف

- عمودی

- بسیار

- تماشا

- دید

- بصری

- vp

- می خواهم

- بود

- مسیر..

- راه

- we

- وب

- خدمات وب

- خوب

- بود

- چی

- چه شده است

- چه زمانی

- که

- در حین

- که

- اراده

- با

- در داخل

- بدون

- مهاجرت کاری

- مشغول به کار

- گردش کار

- کارگر

- با این نسخهها کار

- نگران کننده است

- خواهد بود

- کتبی

- سال

- شما

- شما

- زفیرنت