این یک پست وبلاگ مهمان است که با همکاری حسین جگیردار از Games24x7 نوشته شده است.

بازی 24x7 یکی از با ارزش ترین پلتفرم های چند بازی هند است و بیش از 100 میلیون گیمر را در بازی های مهارتی مختلف سرگرم می کند. با "علم بازی" به عنوان فلسفه اصلی آنها، آنها چشم اندازی از انفورماتیک پایان به انتها در مورد پویایی بازی، پلتفرم های بازی و بازیکنان را با ادغام جهت های تحقیقاتی متعامد هوش مصنوعی بازی، علم داده های بازی، و تحقیقات کاربران بازی، فعال کرده اند. تیم هوش مصنوعی و علم داده به انبوهی از داده های چند بعدی می پردازد و موارد استفاده مختلفی مانند بهینه سازی سفر بازیکن، تشخیص اکشن بازی، شخصی سازی بیش از حد، مشتری 360 و موارد دیگر را در AWS اجرا می کند.

Games24x7 از یک چارچوب خودکار، مبتنی بر داده و مبتنی بر هوش مصنوعی برای ارزیابی رفتار هر بازیکن از طریق تعاملات روی پلتفرم استفاده میکند و کاربران را با رفتار غیرعادی پرچمگذاری میکند. آنها یک مدل یادگیری عمیق ScarceGAN ساخته اند که بر شناسایی نمونه های بسیار نادر یا کمیاب از داده های تله متری طولی چند بعدی با برچسب های کوچک و ضعیف تمرکز دارد. این اثر در CIKM'21 و است منبع باز برای شناسایی کلاس نادر برای هر داده تله متری طولی. نیاز به تولید و پذیرش مدل برای ایجاد یک ستون فقرات در پشت فعال کردن بازی مسئولانه در پلتفرم خود بسیار مهم بود، جایی که کاربران پرچمدار را میتوان از طریق سفر متفاوتی از اعتدال و کنترل برد.

در این پست، ما به اشتراک می گذاریم که چگونه Games24x7 خطوط لوله آموزشی خود را برای پلت فرم بازی مسئول خود با استفاده از بهبود بخشیده است آمازون SageMaker.

چالش های مشتری

تیم DS/AI در Games24x7 از چندین سرویس ارائه شده توسط AWS، از جمله نوتبوکهای SageMaker، استفاده کرد. توابع مرحله AWS, AWS لامبداو آمازون EMR، برای ساخت خطوط لوله برای موارد استفاده مختلف. برای رسیدگی به رانش در توزیع داده، و بنابراین برای آموزش مجدد مدل ScarceGAN، آنها متوجه شدند که سیستم موجود به یک راه حل MLOps بهتر نیاز دارد.

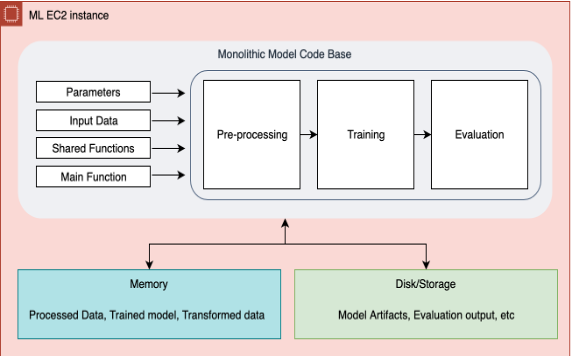

در خط لوله قبلی از طریق توابع مرحله، یک پایگاه کد یکپارچه، پیش پردازش، بازآموزی و ارزیابی داده ها را انجام داد. این به یک گلوگاه در عیب یابی، افزودن یا حذف یک مرحله یا حتی ایجاد برخی تغییرات کوچک در زیرساخت کلی تبدیل شد. این تابع مرحلهای مجموعهای از نمونهها را برای استخراج و پردازش دادهها از S3 نشان میدهد و مراحل بعدی پیشپردازش، آموزش، ارزیابی روی یک نمونه بزرگ EC2 اجرا میشود. در سناریوهایی که خط لوله در هر مرحله شکست می خورد، کل گردش کار نیاز به راه اندازی مجدد از ابتدا داشت که منجر به اجرای مکرر و افزایش هزینه می شد. تمام معیارهای آموزش و ارزیابی به صورت دستی از سرویس ذخیره سازی ساده آمازون (Amazon S3) بررسی شد. هیچ مکانیزمی برای انتقال و ذخیره ابرداده آزمایشهای چندگانه انجام شده روی مدل وجود نداشت. با توجه به نظارت غیرمتمرکز مدل، بررسی کامل و انتخاب بهترین مدل به ساعتها از تیم علم داده نیاز داشت. انباشت تمام این تلاش ها منجر به کاهش بهره وری تیم و افزایش هزینه های اضافی شده است. علاوه بر این، با تیمی که به سرعت در حال رشد است، اشتراک گذاری این دانش در بین تیم بسیار چالش برانگیز بود.

از آنجایی که مفاهیم MLOps بسیار گسترده هستند و اجرای تمام مراحل نیاز به زمان دارد، تصمیم گرفتیم که در مرحله اول به مسائل اصلی زیر بپردازیم:

- یک محیط امن، کنترلشده و قالبسازی شده برای آموزش مجدد مدل یادگیری عمیق داخلی ما با استفاده از بهترین شیوههای صنعت

- یک محیط آموزشی پارامتری برای ارسال مجموعه ای متفاوت از پارامترها برای هر کار بازآموزی و ممیزی آخرین دوره ها

- توانایی ردیابی بصری معیارهای آموزشی و معیارهای ارزیابی، و داشتن ابرداده برای ردیابی و مقایسه آزمایشها

- امکان مقیاس بندی هر مرحله به صورت جداگانه و استفاده مجدد از مراحل قبلی در موارد شکست مراحل

- یک محیط اختصاصی واحد برای ثبت مدلها، ذخیره ویژگیها و فراخوانی خطوط لوله استنتاج

- یک مجموعه ابزار مدرن که میتواند نیازهای محاسباتی را به حداقل برساند، هزینهها را کاهش دهد و توسعه پایدار و عملیات ML را با ترکیب انعطافپذیری استفاده از نمونههای مختلف برای مراحل مختلف هدایت کند.

- ایجاد یک الگوی معیار از پیشرفته ترین خط لوله MLOps که می تواند در تیم های مختلف علم داده استفاده شود

Games24x7 شروع به ارزیابی راه حل های دیگر از جمله آمازون SageMaker Studio Pipelines. راه حل موجود از طریق توابع مرحله دارای محدودیت هایی بود. خطوط لوله استودیو انعطاف پذیری افزودن یا حذف یک مرحله را در هر نقطه از زمان داشت. همچنین، معماری کلی و وابستگی های داده آنها بین هر مرحله را می توان از طریق DAG ها مشاهده کرد. ارزیابی و تنظیم دقیق مراحل بازآموزی پس از استفاده از قابلیتهای مختلف Amazon SageMaker مانند Amazon SageMaker Studio، Pipelines، Processing، Training، رجیستری مدل و آزمایشها و آزمایشها کاملاً کارآمد شد. تیم AWS Solution Architecture غواصی عمیقی را نشان داد و واقعاً در طراحی و اجرای این راه حل مؤثر بود.

بررسی اجمالی راه حل

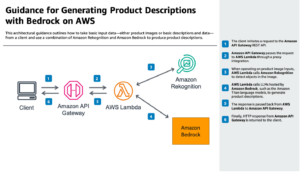

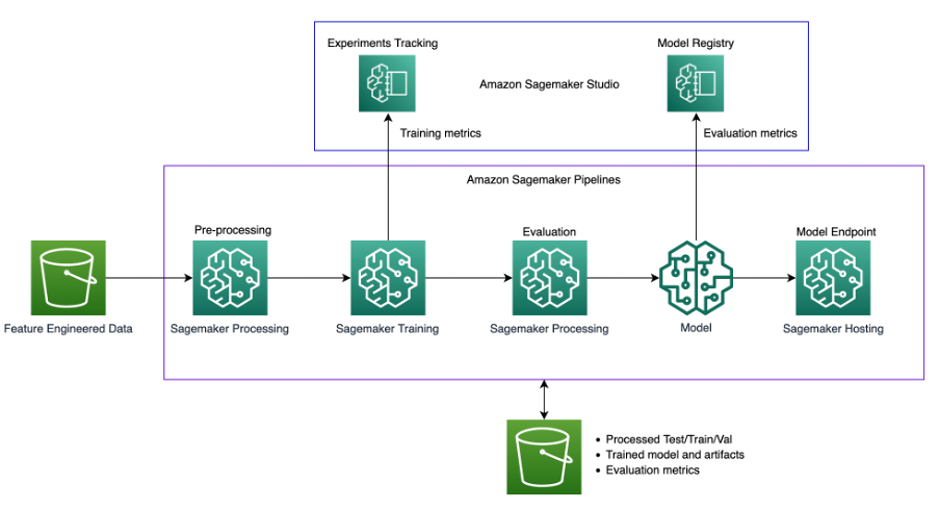

نمودار زیر معماری راه حل را نشان می دهد.

راه حل از a استفاده می کند SageMaker Studio محیطی برای اجرای آزمایش های بازآموزی کد فراخوانی اسکریپت خط لوله در نوتبوکهای استودیو موجود است، و ما میتوانیم در هنگام فراخوانی خط لوله، هایپرپارامترها و ورودی/خروجی را تغییر دهیم. این کاملاً با روش قبلی ما متفاوت است که در آن ما تمام پارامترها را در اسکریپت ها کدگذاری کرده بودیم و همه فرآیندها به طور جدانشدنی به هم مرتبط بودند. این مستلزم مدولارسازی کد یکپارچه در مراحل مختلف بود.

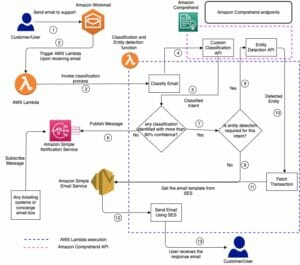

نمودار زیر روند یکپارچه اصلی ما را نشان می دهد.

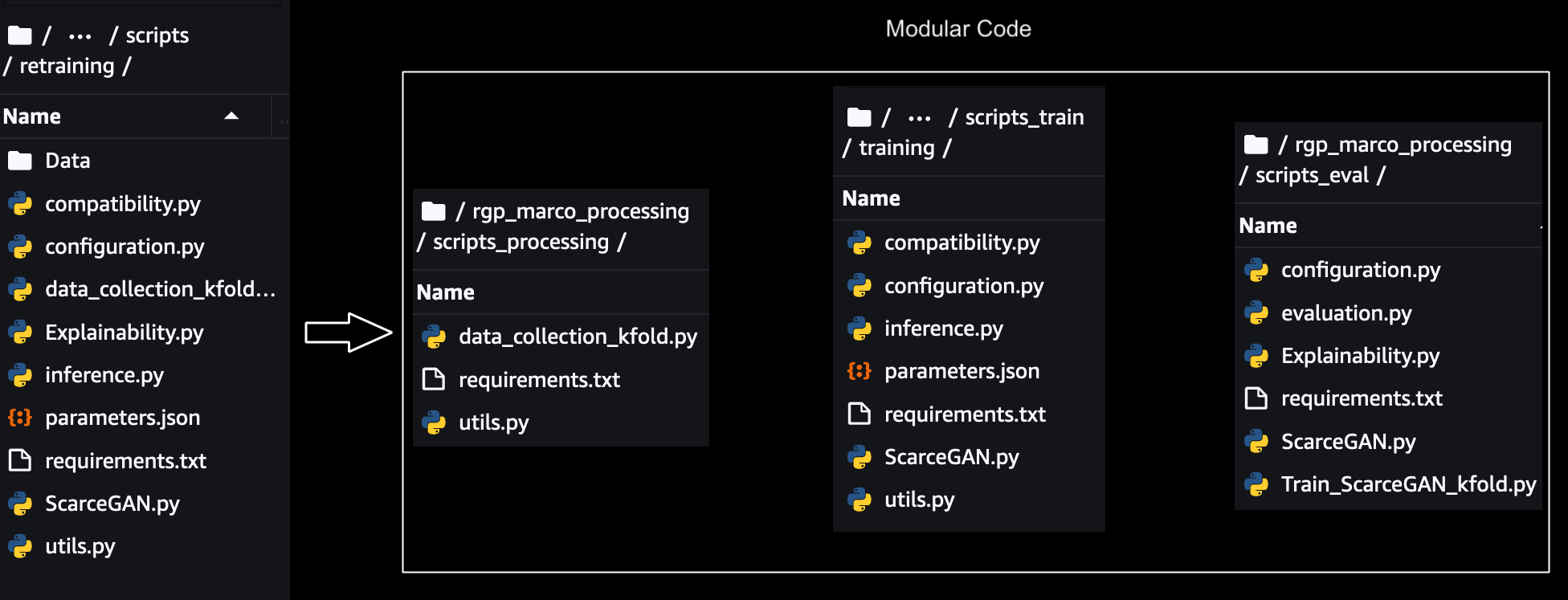

مدولار شدن

به منظور مقیاس، ردیابی و اجرای هر مرحله به صورت جداگانه، کد یکپارچه باید مدولار شود. پارامترها، دادهها و وابستگیهای کد بین هر مرحله حذف شد و ماژولهای مشترک برای اجزای مشترک در سراسر مراحل ایجاد شد. تصویری از مدولارسازی در زیر نشان داده شده است:

برای هر ماژول، آزمایش به صورت محلی با استفاده از SageMaker SDK انجام شد حالت اسکریپت برای آموزش، پردازش و ارزیابی که نیاز به تغییرات جزئی در کد برای اجرا با SageMaker. را تست حالت محلی برای یادگیری عمیق، اسکریپتها را میتوان در نوتبوکهای SageMaker در صورتی که قبلاً استفاده میشود یا با استفاده از آن انجام داد حالت محلی با استفاده از خطوط لوله SageMaker در صورت شروع مستقیم با خطوط لوله. این به تأیید اعتبار اسکریپت های سفارشی ما در نمونه های SageMaker کمک می کند.

سپس هر ماژول به صورت مجزا با استفاده از SageMaker Training/Processing SDK با استفاده از حالت اسکریپت و آنها را به صورت دستی با استفاده از نمونه های SageMaker برای هر مرحله مانند مرحله آموزش زیر اجرا کنید:

آمازون S3 برای پردازش داده های منبع و سپس ذخیره داده های میانی، فریم های داده و نتایج NumPy به آمازون S3 برای مرحله بعدی استفاده شد. پس از تست یکپارچه سازی بین ماژول های فردی برای پیش پردازش، آموزش، ارزیابی کامل شد SageMaker Pipeline SDK که با SageMaker Python SDK که قبلاً در مراحل بالا استفاده کردیم، ادغام شده است، به ما این امکان را میدهد تا با ارسال پارامترهای ورودی، دادهها، ابردادهها و خروجی هر مرحله به عنوان ورودی به مراحل بعدی، همه این ماژولها را به صورت برنامهنویسی زنجیرهای کنیم.

ما میتوانیم از کد قبلی Sagemaker Python SDK برای اجرای جداگانه ماژولها در اجرای Sagemaker Pipeline SDK استفاده کنیم. روابط بین هر مرحله از خط لوله توسط وابستگی داده ها بین مراحل تعیین می شود.

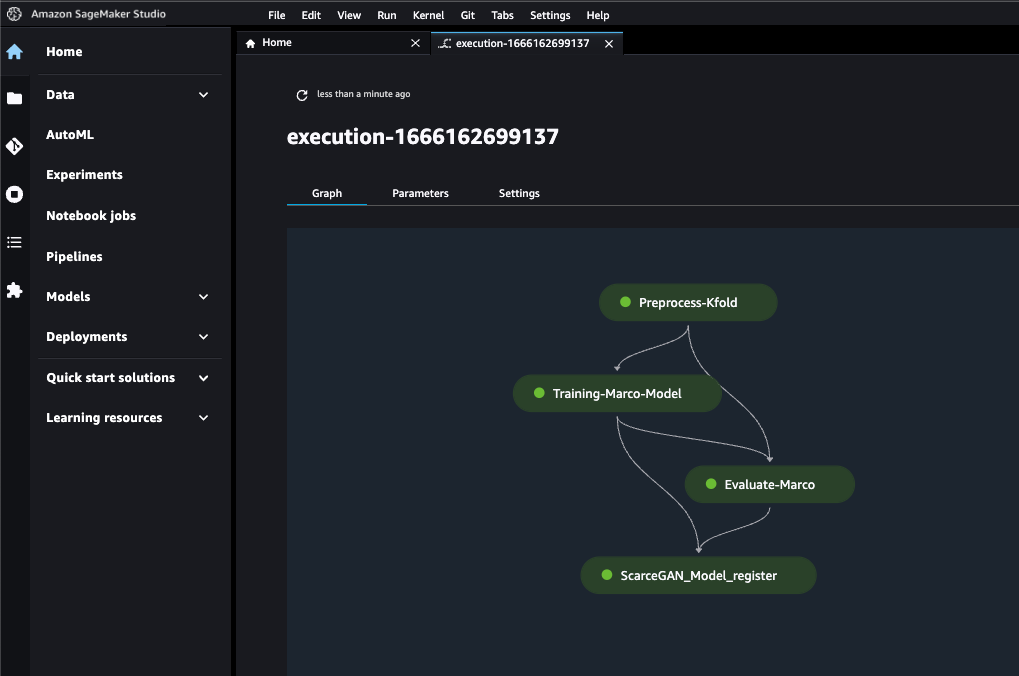

مراحل پایانی خط لوله به شرح زیر است:

- پردازش داده ها

- آموزش مجدد

- ارزیابی

- ثبت نام مدل

در بخشهای بعدی، هنگام اجرا با SageMaker Pipeline SDK، هر یک از مراحل را با جزئیات بیشتری مورد بحث قرار میدهیم.

پردازش داده ها

این مرحله دادههای ورودی خام و پیش پردازش را تبدیل میکند و به مجموعههای قطار، اعتبارسنجی و آزمایش تقسیم میشود. برای این مرحله پردازش، ما یک کار پردازشی SageMaker را با آن ارائه کردیم پردازشگر چارچوب TensorFlow، که اسکریپت ما را می گیرد، داده ها را از Amazon S3 کپی می کند و سپس یک تصویر Docker ارائه و نگهداری شده توسط SageMaker را می کشد. این کانتینر Docker به ما امکان میدهد تا وابستگیهای کتابخانه خود را در فایل requires.txt در حالی که همه کتابخانههای TensorFlow قبلاً گنجانده شده است، منتقل کنیم و مسیر source_dir را برای اسکریپت پاس کنیم. دادههای قطار و اعتبارسنجی به مرحله آموزش میروند و دادههای آزمون به مرحله ارزیابی ارسال میشوند. بهترین بخش استفاده از این کانتینر این بود که به ما امکان می داد انواع ورودی ها و خروجی ها را به عنوان مکان های مختلف S3 ارسال کنیم، که سپس به عنوان یک وابستگی مرحله ای به مراحل بعدی در خط لوله SageMaker منتقل می شد.

آموزش مجدد

ما ماژول آموزشی را از طریق پیچیدیم خطوط لوله SageMaker TrainingStep API و از تصاویر محفظه یادگیری عمیق موجود از طریق تخمینگر TensorFlow Framework (همچنین به عنوان حالت اسکریپت نیز شناخته می شود) استفاده کرد. آموزش SageMaker. حالت اسکریپت به ما این امکان را می دهد که حداقل تغییرات را در کد آموزشی خود داشته باشیم و ظرف Docker از پیش ساخته شده SageMaker نسخه های Python، Framework و غیره را کنترل می کند. ProcessingOutputs از Data_Preprocessing مرحله به عنوان ورودی آموزشی این مرحله ارسال شد.

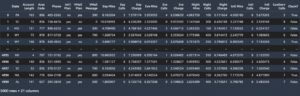

همه هایپرپارامترها از طریق تخمینگر از طریق یک فایل JSON منتقل شدند. برای هر دوره آموزشی، ما معیارهای آموزشی خود را از طریق stdOut در اسکریپت ارسال می کردیم. از آنجایی که میخواستیم معیارهای یک کار آموزشی در حال انجام را ردیابی کنیم و آنها را با مشاغل آموزشی قبلی مقایسه کنیم، فقط باید این StdOut را با تعریف تعاریف متریک از طریق regex تجزیه میکردیم تا معیارها را از StdOut برای هر دوره دریافت کنیم.

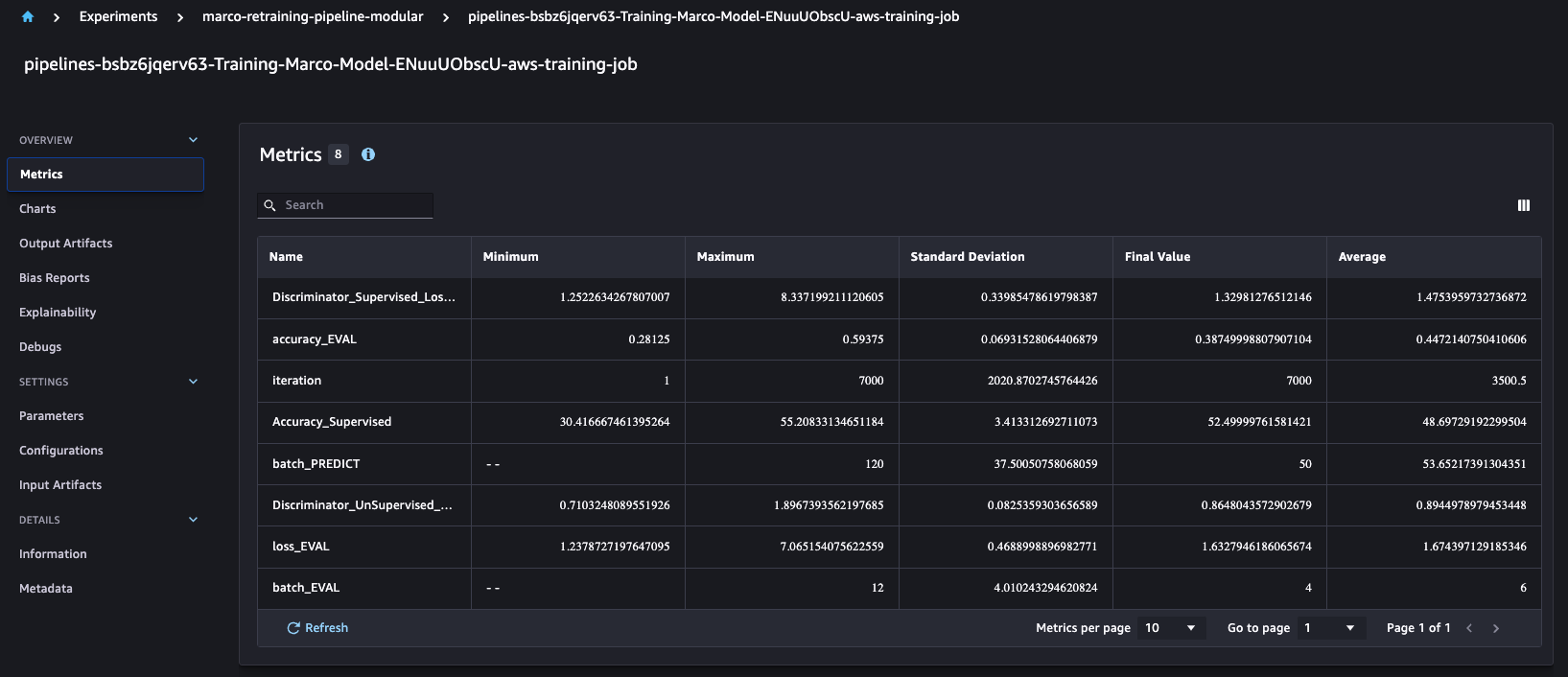

درک اینکه SageMaker Pipelines به صورت خودکار جالب بود با SageMaker Experiments API ادغام می شود، که به طور پیش فرض برای هر اجرا یک جزء آزمایشی، آزمایشی و آزمایشی ایجاد می کند. این به ما امکان میدهد تا معیارهای آموزشی مانند دقت و دقت را در چندین اجرا، همانطور که در زیر نشان داده شده است، مقایسه کنیم.

برای هر کار آموزشی اجرا شده، ما چهار مدل مختلف را بر اساس تعریف تجاری سفارشی خود برای آمازون S3 تولید می کنیم.

ارزیابی

این مرحله مدل های آموزش دیده را از Amazon S3 بارگیری می کند و معیارهای سفارشی ما را ارزیابی می کند. این ProcessingStep مدل و دادههای آزمایشی را به عنوان ورودی میگیرد و گزارشهای عملکرد مدل را در Amazon S3 ارسال میکند.

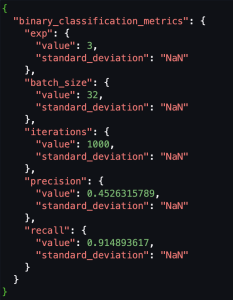

ما از معیارهای سفارشی استفاده می کنیم، بنابراین برای ثبت این معیارهای سفارشی در رجیستری مدل، باید طرح معیارهای ارزیابی ذخیره شده در Amazon S3 به عنوان CSV را به کیفیت مدل SageMaker خروجی JSON سپس میتوانیم مکان این ارزیابی معیارهای JSON را در رجیستری مدل ثبت کنیم.

اسکرین شات های زیر نمونه ای از نحوه تبدیل CSV به فرمت JSON با کیفیت مدل Sagemaker را نشان می دهد.

ثبت نام مدل

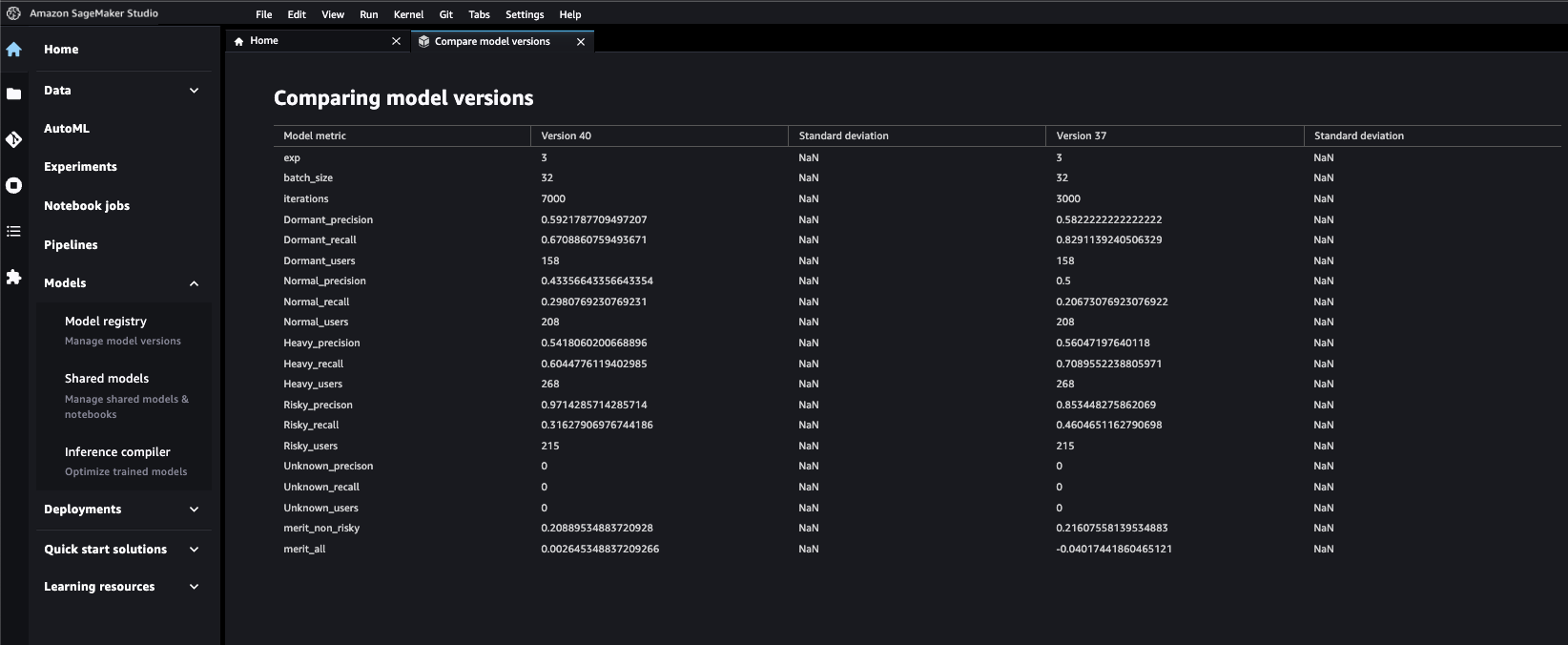

همانطور که قبلا ذکر شد، ما چندین مدل را در یک مرحله آموزشی ایجاد می کردیم، بنابراین مجبور شدیم از یک ادغام SageMaker Pipelines Lambda برای ثبت هر چهار مدل در یک رجیستری مدل استفاده کنیم. برای ثبت نام تک مدل می توانیم از ModelStep API برای ایجاد یک مدل SageMaker در رجیستری. برای هر مدل، تابع لامبدا مصنوع و معیار ارزیابی مدل را از آمازون S3 بازیابی می کند و یک بسته مدل برای یک ARN خاص ایجاد می کند، به طوری که هر چهار مدل می توانند در یک رجیستری مدل ثبت شوند. API های پایتون SageMaker همچنین به ما این امکان را می دهد که ابرداده های سفارشی را ارسال کنیم تا بهترین مدل ها را انتخاب کنیم. ثابت شد که این یک نقطه عطف بزرگ برای بهرهوری است، زیرا همه مدلها اکنون میتوانند از یک پنجره واحد مقایسه و حسابرسی شوند. ما متادیتا را ارائه کردیم تا مدل را از یکدیگر متمایز کنیم. این همچنین به تأیید یک مدل واحد با کمک بررسیهای همتا و بررسیهای مدیریتی بر اساس معیارهای مدل کمک کرد.

بلوک کد بالا نمونه ای از نحوه اضافه کردن ابرداده از طریق ورودی بسته مدل به رجیستری مدل همراه با معیارهای مدل را نشان می دهد.

اسکرین شات زیر نشان میدهد که به راحتی میتوانیم معیارهای نسخههای مدلهای مختلف را پس از ثبت آنها مقایسه کنیم.

فراخوان خط لوله

خط لوله را می توان از طریق فراخوانی کرد رویداد پل ، Sagemaker Studio یا SDK خود فراخوانی کارها را بر اساس وابستگی داده ها بین مراحل اجرا می کند.

نتیجه

در این پست، نشان دادیم که Games24x7 چگونه داراییهای MLOps خود را از طریق خطوط لوله SageMaker تغییر داده است. توانایی ردیابی بصری معیارهای آموزشی و معیارهای ارزیابی، با محیط پارامتری، مقیاس بندی مراحل به صورت جداگانه با بستر پردازش مناسب و یک رجیستری مدل مرکزی، نقطه عطفی در استانداردسازی و پیشرفت به یک گردش کاری قابل بازرسی، قابل استفاده مجدد، کارآمد و قابل توضیح است. . این پروژه طرحی در میان تیم های مختلف علم داده است و بهره وری کلی را با اجازه دادن به اعضا برای کار، مدیریت و همکاری با بهترین شیوه ها افزایش داده است.

اگر مورد استفاده مشابهی دارید و می خواهید شروع کنید، توصیه می کنیم از SageMaker استفاده کنید حالت اسکریپت و SageMaker از پایان به پایان مثال با استفاده از Sagemaker Studio این نمونه ها دارای جزئیات فنی هستند که در این وبلاگ پوشش داده شده است.

یک استراتژی داده مدرن به شما یک برنامه جامع برای مدیریت، دسترسی، تجزیه و تحلیل و اقدام بر روی داده ها می دهد. AWS کاملترین مجموعه خدمات را برای کل سفر داده سرتاسر برای همه بارهای کاری، همه انواع داده ها و همه نتایج کسب و کار مطلوب ارائه می دهد. به نوبه خود، این امر AWS را به بهترین مکان برای باز کردن قفل ارزش از داده های شما و تبدیل آن به بینش تبدیل می کند.

درباره نویسنده

حسین جگیردار یک دانشمند ارشد – تحقیقات کاربردی در Games24x7 است. او در حال حاضر در تلاش های تحقیقاتی در زمینه هوش مصنوعی قابل توضیح و یادگیری عمیق است. کار اخیر او شامل مدلسازی مولد عمیق، مدلسازی سریهای زمانی و زیر حوزههای مرتبط با یادگیری ماشین و هوش مصنوعی است. او همچنین مشتاق MLO ها و استانداردسازی پروژه هایی است که نیازمند محدودیت هایی مانند مقیاس پذیری، قابلیت اطمینان و حساسیت هستند.

حسین جگیردار یک دانشمند ارشد – تحقیقات کاربردی در Games24x7 است. او در حال حاضر در تلاش های تحقیقاتی در زمینه هوش مصنوعی قابل توضیح و یادگیری عمیق است. کار اخیر او شامل مدلسازی مولد عمیق، مدلسازی سریهای زمانی و زیر حوزههای مرتبط با یادگیری ماشین و هوش مصنوعی است. او همچنین مشتاق MLO ها و استانداردسازی پروژه هایی است که نیازمند محدودیت هایی مانند مقیاس پذیری، قابلیت اطمینان و حساسیت هستند.

سومیر کومار یک معمار راه حل در AWS است و بیش از 13 سال تجربه در صنعت فناوری دارد. در AWS، او از نزدیک با مشتریان کلیدی AWS برای طراحی و پیادهسازی راهحلهای مبتنی بر ابر که مشکلات پیچیده تجاری را حل میکند، همکاری میکند. او علاقه زیادی به تجزیه و تحلیل داده ها و یادگیری ماشینی دارد و سابقه اثبات شده ای در کمک به سازمان ها برای باز کردن پتانسیل کامل داده های خود با استفاده از AWS Cloud دارد.

سومیر کومار یک معمار راه حل در AWS است و بیش از 13 سال تجربه در صنعت فناوری دارد. در AWS، او از نزدیک با مشتریان کلیدی AWS برای طراحی و پیادهسازی راهحلهای مبتنی بر ابر که مشکلات پیچیده تجاری را حل میکند، همکاری میکند. او علاقه زیادی به تجزیه و تحلیل داده ها و یادگیری ماشینی دارد و سابقه اثبات شده ای در کمک به سازمان ها برای باز کردن پتانسیل کامل داده های خود با استفاده از AWS Cloud دارد.

- محتوای مبتنی بر SEO و توزیع روابط عمومی. امروز تقویت شوید.

- پلاتوبلاک چین. Web3 Metaverse Intelligence. دانش تقویت شده دسترسی به اینجا.

- ضرب کردن آینده با آدرین اشلی. دسترسی به اینجا.

- منبع: https://aws.amazon.com/blogs/machine-learning/how-games24x7-transformed-their-retraining-mlops-pipelines-with-amazon-sagemaker/

- :است

- 1

- 10

- 100

- 11

- 7

- a

- توانایی

- درباره ما

- بالاتر

- دسترسی

- تجمع

- دقت

- ACM

- در میان

- عمل

- عمل

- اضافه

- اضافی

- علاوه بر این

- نشانی

- به تصویب رسید

- اتخاذ

- پس از

- AI

- معرفی

- اجازه دادن

- اجازه می دهد تا

- قبلا

- آمازون

- آمازون SageMaker

- Amazon SageMaker Studio

- علم تجزیه و تحلیل

- تحلیل

- و

- API

- اعمال می شود

- معماری

- هستند

- محدوده

- دور و بر

- AS

- ارزیابی

- دارایی

- At

- حسابرسی

- قابل سنجش

- حسابرسی

- خودکار

- بطور خودکار

- در دسترس

- AWS

- به عقب

- ستون فقرات

- مستقر

- BE

- زیرا

- شروع

- پشت سر

- بودن

- در زیر

- محک

- بهترین

- بهترین شیوه

- بهتر

- میان

- مسدود کردن

- بلاگ

- بنا

- ساخته

- کسب و کار

- by

- CAN

- مورد

- موارد

- مرکزی

- زنجیر

- به چالش کشیدن

- تغییر دادن

- تبادل

- کلاس

- نزدیک

- ابر

- خوشه

- رمز

- پایه کد

- همکاری

- مقايسه كردن

- مقایسه

- کامل

- پیچیده

- جزء

- اجزاء

- جامع

- محاسبه

- مفاهیم

- تحکیم

- محدودیت ها

- ظرف

- ظروف

- کنترل

- کنترل

- تبدیل

- مبدل

- هسته

- هزینه

- هزینه

- میتوانست

- پوشش داده شده

- ایجاد

- ایجاد شده

- ایجاد

- ایجاد

- در حال حاضر

- سفارشی

- مشتری

- مشتریان

- داده ها

- تجزیه و تحلیل داده ها

- علم اطلاعات

- استراتژی داده

- داده محور

- غیر متمرکز

- مصمم

- اختصاصی

- عمیق

- شیرجه عمیق

- یادگیری عمیق

- به طور پیش فرض

- تعریف کردن

- تقاضا

- نشان

- وابستگی

- طرح

- مطلوب

- جزئیات

- جزئیات

- کشف

- مشخص

- پروژه

- مختلف

- مستقیما

- کشف

- بحث و تبادل نظر

- تمیز دادن

- توزیع

- کارگر بارانداز

- پایین

- راندن

- دینامیک

- هر

- پیش از آن

- به آسانی

- موثر

- تلاش

- هر دو

- کار می کند

- فعال

- را قادر می سازد

- پشت سر هم

- تمام

- محیط

- دوره

- ارزیابی

- ارزیابی

- حتی

- هر

- مثال

- مثال ها

- اعدام

- موجود

- سیستم موجود

- تجربه

- تجربه

- وسیع

- عصاره

- خیلی

- ناموفق

- امکانات

- پرونده

- نهایی

- نام خانوادگی

- پرچم گذاری شده

- پرچم ها

- انعطاف پذیری

- تمرکز

- پیروی

- به دنبال آن است

- برای

- قالب

- چارچوب

- از جانب

- کامل

- تابع

- ویژگی های

- توابع

- بیشتر

- بازی

- پارسه

- بازیها

- بازی

- پلت فرم بازی

- تولید می کنند

- مولد

- دریافت کنید

- می دهد

- Go

- می رود

- بزرگ

- مهمان

- دسته

- دستگیره

- سخت

- آیا

- داشتن

- کمک

- کمک کرد

- کمک

- کمک می کند

- ساعت ها

- چگونه

- HTML

- HTTPS

- شناسایی

- تصویر

- تصاویر

- انجام

- پیاده سازی

- اجرای

- واردات

- بهبود یافته

- in

- مشمول

- از جمله

- گنجاندن

- افزایش

- فرد

- به طور جداگانه

- صنعت

- شالوده

- ورودی

- بینش

- نمونه

- ابزاری

- یکپارچه

- ادغام

- فعل و انفعالات

- جالب

- تحقیق

- گرفتار

- انزوا

- مسائل

- IT

- تکرار

- ITS

- خود

- کار

- شغل ها

- سفر

- JPG

- json

- کلید

- دانش

- شناخته شده

- برچسب ها

- بزرگ

- یادگیری

- کتابخانه ها

- کتابخانه

- پسندیدن

- محدودیت

- مرتبط

- بارهای

- به صورت محلی

- محل

- مکان

- دستگاه

- فراگیری ماشین

- عمده

- باعث می شود

- ساخت

- مدیریت

- مدیریت

- دستی

- مکانیزم

- اعضا

- ذکر شده

- متاداده

- روش

- متری

- متریک

- مرحله مهمی از زندگی

- میلیون

- حداقل

- خردسال

- ML

- MLO ها

- حالت

- مدل

- مدل

- اعتدال

- مدرن

- ماژول ها

- ماژول ها

- نظارت بر

- یک پارچه

- بیش

- اکثر

- چندگانه

- نام

- نیاز

- بعد

- دفتر یادداشت

- بی حس

- of

- on

- ONE

- مداوم

- باز کن

- کار

- عملیات

- بهینه سازی

- سفارش

- سازمان های

- اصلی

- دیگر

- تولید

- به طور کلی

- بسته

- پارامترهای

- برترین

- بخش

- عبور

- گذشت

- عبور می کند

- عبور

- احساساتی

- مسیر

- کارایی

- فلسفه

- خط لوله

- محل

- برنامه

- سکو

- سیستم عامل

- افلاطون

- هوش داده افلاطون

- PlatoData

- بازی

- بازیکن

- بازیکنان

- کثیف

- نقطه

- پست

- پتانسیل

- صفحه اصلی

- شیوه های

- دقت

- قبلی

- مشکلات

- روند

- فرآیندهای

- در حال پردازش

- بهره وری

- پروژه

- پروژه ها

- املاک

- ثابت

- اثبات شده

- ارائه

- فراهم می کند

- منتشر شده

- کشد

- پــایتــون

- کیفیت

- نادر

- خام

- اخیر

- توصیه

- رکورد

- regex

- ثبت نام

- ثبت نام

- ثبت

- رجیستری

- مربوط

- روابط

- قابلیت اطمینان

- حذف شده

- از بین بردن

- مکرر

- گزارش ها

- ضروری

- مورد نیاز

- تحقیق

- مسئوليت

- بازی مسئولانه

- شروع مجدد

- نتایج

- برگشت

- قابل استفاده مجدد

- استفاده مجدد

- بررسی

- نقش

- دویدن

- در حال اجرا

- حکیم ساز

- خطوط لوله SageMaker

- مقیاس پذیری

- مقیاس

- مقیاس گذاری

- کمیاب

- سناریوها

- علم

- دانشمند

- تصاویر

- اسکریپت

- sdk

- بخش

- امن

- در حال ارسال

- ارشد

- حساسیت

- دنباله

- سرویس

- خدمات

- تنظیم

- مجموعه

- اشتراک گذاری

- به اشتراک گذاشته شده

- نشان

- نشان داده شده

- نشان می دهد

- مشابه

- ساده

- تنها

- مهارت

- کوچک

- So

- راه حل

- مزایا

- حل

- برخی از

- منبع

- خاص

- تقسیم می کند

- صحنه

- استاندارد

- آغاز شده

- راه افتادن

- وضعیت هنر

- ارقام

- گام

- مراحل

- ذخیره سازی

- opbevare

- ذخیره شده

- استراتژی

- استودیو

- چنین

- قابل تحمل

- سیستم

- طول می کشد

- تیم

- تیم ها

- فنی

- پیشرفته

- قالب

- جریان تنسور

- آزمون

- تست

- که

- La

- محوطه

- منبع

- شان

- آنها

- از این رو

- اینها

- از طریق

- زمان

- به

- مسیر

- قطار

- آموزش دیده

- آموزش

- مبدل

- محاکمه

- آزمایش های

- دور زدن

- انواع

- فهمیدن

- منحصر به فرد

- باز

- us

- استفاده کنید

- مورد استفاده

- کاربر

- کاربران

- اعتبار سنجی

- ارزشمند

- ارزش

- تنوع

- مختلف

- دید

- خواسته

- که

- در حین

- تمام

- اراده

- با

- در داخل

- مهاجرت کاری

- با این نسخهها کار

- خواهد بود

- پیچیده

- سال

- شما

- شما

- زفیرنت