PyTorch یک چارچوب یادگیری ماشینی (ML) است که به طور گسترده توسط مشتریان AWS برای برنامه های مختلف مانند بینایی کامپیوتر، پردازش زبان طبیعی، ایجاد محتوا و غیره استفاده می شود. با انتشار اخیر PyTorch 2.0، مشتریان AWS اکنون می توانند همان کارهایی را که می توانند با PyTorch 1.x انجام دهند، اما سریعتر و در مقیاس با سرعت آموزش بهبود یافته، استفاده از حافظه کمتر و قابلیت های افزایش یافته توزیع شده. چندین فناوری جدید از جمله torch.compile، TorchDynamo، AOTAutograd، PrimTorch و TorchInductor در نسخه PyTorch2.0 گنجانده شدهاند. رجوع شود به PyTorch 2.0: نسخه نسل بعدی ما که سریعتر، پایتونیک تر و پویاتر از همیشه است برای جزئیات بیشتر.

این پست عملکرد و سهولت اجرای آموزش و استقرار مدل توزیع شده ML در مقیاس بزرگ و با کارایی بالا با استفاده از PyTorch 2.0 در AWS را نشان می دهد. این پست بیشتر از طریق پیادهسازی گام به گام تنظیم دقیق مدل RoBERTa (رویکرد پیشآموزشی BERT بهینهسازی قوی) برای تحلیل احساسات با استفاده از AMI های یادگیری عمیق AWS (AWS DLAMI) و ظروف یادگیری عمیق AWS (DLC ها) روشن است ابر محاسبه الاستیک آمازون (Amazon EC2 p4d.24xlarge) با افزایش 42 درصدی مشاهده شده هنگام استفاده با PyTorch 2.0 torch.compile + bf16 + fused AdamW. سپس مدل تنظیم شده روی آن مستقر می شود AWS Gravitonبر اساس نمونه C7g EC2 در آمازون SageMaker با 10 درصد افزایش سرعت در مقایسه با PyTorch 1.13.

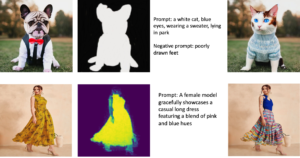

شکل زیر یک معیار عملکرد از تنظیم دقیق مدل RoBERTa در Amazon EC2 p4d.24xlarge با AWS PyTorch 2.0 DLAMI + DLC را نشان می دهد.

به مراجعه استنتاج PyTorch 2.0 با پردازنده های AWS Graviton بهینه شده است برای جزئیات بیشتر در مورد معیارهای عملکرد استنتاج نمونه مبتنی بر AWS Graviton برای PyTorch 2.0.

پشتیبانی از PyTorch 2.0 در AWS

پشتیبانی PyTorch2.0 به خدمات و محاسبات نشان داده شده در مثال مورد استفاده در این پست محدود نمی شود. آن را به بسیاری دیگر در AWS گسترش می دهد، که ما در این بخش بحث می کنیم.

الزامات تجاری

بسیاری از مشتریان AWS، در مجموعهای از صنایع مختلف، کسبوکار خود را با استفاده از هوش مصنوعی (AI) متحول میکنند، بهویژه در حوزه هوش مصنوعی مولد و مدلهای زبان بزرگ (LLM) که برای تولید متنی شبیه انسان طراحی شدهاند. اینها اساساً مدل های بزرگی هستند که مبتنی بر تکنیک های یادگیری عمیق هستند که با صدها میلیارد پارامتر آموزش داده می شوند. رشد در اندازه های مدل باعث افزایش زمان تمرین از روزها به هفته ها و حتی ماه ها در برخی موارد می شود. این امر باعث افزایش تصاعدی هزینههای آموزش و استنباط میشود که بیش از هر زمان دیگری به چارچوبی مانند PyTorch 2.0 با پشتیبانی داخلی از آموزش مدلهای شتابزده و زیرساخت بهینهسازی AWS متناسب با حجمهای کاری خاص و نیازهای عملکردی نیاز دارد.

انتخاب محاسبات

AWS پشتیبانی PyTorch 2.0 را در گستردهترین انتخاب از گزینههای محاسباتی قدرتمند، شبکههای پرسرعت، و گزینههای ذخیرهسازی با کارایی بالا مقیاسپذیر ارائه میکند که میتوانید برای هر پروژه یا برنامه ML استفاده کنید و متناسب با عملکرد و نیازهای بودجه خود آن را سفارشی کنید. این در نمودار در بخش بعدی آشکار می شود. در سطح پایین، مجموعه گستردهای از نمونههای محاسباتی ارائه شده توسط پردازندههای AWS Graviton، Nvidia، AMD و Intel ارائه میکنیم.

برای استقرار مدل، می توانید از پردازنده های مبتنی بر ARM مانند نمونه مبتنی بر AWS Graviton که اخیراً اعلام شده است استفاده کنید که عملکرد استنباط را برای PyTorch 2.0 با حداکثر سرعت 3.5 برابر برای Resnet50 در مقایسه با نسخه قبلی PyTorch و حداکثر 1.4 برابر سرعت برای BERT، نمونههای مبتنی بر AWS Graviton را به سریعترین نمونههای محاسباتی بهینهشده در AWS برای راهحلهای استنتاج مدل مبتنی بر CPU تبدیل میکند.

انتخاب خدمات ML

برای استفاده از محاسبات AWS، میتوانید از میان مجموعه گستردهای از خدمات جهانی مبتنی بر ابر برای توسعه ML، محاسبات و هماهنگسازی گردش کار انتخاب کنید. این انتخاب به شما امکان می دهد تا با استراتژی های تجاری و ابری خود هماهنگ شوید و مشاغل PyTorch 2.0 را در پلتفرم مورد نظر خود اجرا کنید. به عنوان مثال، اگر محدودیت های داخلی یا سرمایه گذاری های موجود در محصولات منبع باز دارید، می توانید از Amazon EC2 استفاده کنید. AWS ParallelCluster، یا AWS UltraCluster برای اجرای بارهای آموزشی توزیع شده بر اساس یک رویکرد خود مدیریتی. همچنین می توانید از یک سرویس کاملاً مدیریت شده مانند SageMaker برای زیرساخت آموزشی بهینه شده، کاملاً مدیریت شده و در مقیاس تولید استفاده کنید. SageMaker همچنین با ابزارهای مختلف MLOps ادغام می شود، که به شما امکان می دهد استقرار مدل خود را مقیاس بندی کنید، هزینه های استنتاج را کاهش دهید، مدل ها را به طور موثرتری در تولید مدیریت کنید و بار عملیاتی را کاهش دهید.

به طور مشابه، اگر سرمایه گذاری های Kubernetes موجود دارید، می توانید از آن نیز استفاده کنید سرویس الاستیک کوبرنتز آمازون (Amazon EKS) و Kubeflow در AWS برای پیاده سازی خط لوله ML برای آموزش توزیع شده یا استفاده از سرویس هماهنگ سازی کانتینر بومی AWS مانند سرویس کانتینر الاستیک آمازون (Amazon ECS) برای آموزش و استقرار مدل. گزینه های ساخت پلت فرم ML شما به این خدمات محدود نمی شود. شما می توانید بسته به نیازهای سازمانی خود برای مشاغل PyTorch 2.0 خود انتخاب و انتخاب کنید.

فعال کردن PyTorch 2.0 با AWS DLAMI و AWS DLC

برای استفاده از پشته خدمات AWS و محاسبات قدرتمند ذکر شده، باید یک نسخه کامپایل شده بهینه از چارچوب PyTorch2.0 و وابستگی های مورد نیاز آن را که بسیاری از آنها پروژه های مستقل هستند، نصب کنید و آنها را از سر به آخر آزمایش کنید. همچنین ممکن است به کتابخانههای مخصوص CPU برای روالهای ریاضی شتابدار، کتابخانههای مخصوص GPU برای روالهای ارتباطی شتابدار ریاضی و بین GPU، و درایورهای GPU که باید با کامپایلر GPU مورد استفاده برای کامپایل کتابخانههای GPU تراز شوند، نیاز داشته باشید. اگر مشاغل شما به آموزش چند گره در مقیاس بزرگ نیاز دارند، به شبکه ای بهینه نیاز دارید که بتواند کمترین تأخیر و بالاترین توان عملیاتی را ارائه دهد. پس از ساختن پشته خود، باید مرتباً آنها را از نظر آسیب پذیری های امنیتی اسکن و وصله کنید و پس از هر ارتقاء نسخه فریمورک، پشته را دوباره بسازید و دوباره آزمایش کنید.

AWS با ارائه مجموعه ای منسجم و ایمن از چارچوب ها، وابستگی ها و ابزارها برای تسریع یادگیری عمیق در فضای ابری، به کاهش این بار سنگین کمک می کند. AWS DLAMI و DLC های AWS. این تصاویر و کانتینرهای ماشینی از پیش ساخته و آزمایش شده برای یادگیری عمیق در انواع نمونه محاسباتی تسریع شده EC2 بهینه شده اند و به شما این امکان را می دهند که برای بارهای کاری توزیع شده کارآمدتر و آسان تر به گره های متعدد مقیاس دهید. شامل یک پیش ساخته است آداپتور پارچه ای الاستیک (EFA)، پشته GPU Nvidia، و بسیاری از چارچوبهای یادگیری عمیق (TensorFlow، MXNet، و PyTorch با آخرین نسخه 2.0) برای آموزش یادگیری عمیق توزیع شده با کارایی بالا. نیازی به صرف زمان برای نصب و عیبیابی نرمافزارها و درایورهای یادگیری عمیق یا ساخت زیرساختهای ML ندارید، و همچنین مجبور نیستید هزینههای مکرر وصله این تصاویر را برای آسیبپذیریهای امنیتی یا ایجاد مجدد تصاویر پس از هر ارتقاء نسخه جدید چارچوب متحمل شوید. درعوض، میتوانید روی تلاش با ارزش افزوده بالاتر مشاغل آموزشی در مقیاس در مدت زمان کوتاهتر تمرکز کنید و مدلهای ML خود را سریعتر تکرار کنید.

بررسی اجمالی راه حل

با توجه به اینکه آموزش در مورد GPU و استنتاج بر روی CPU یک مورد استفاده محبوب برای مشتریان AWS است، ما به عنوان بخشی از این پست پیاده سازی گام به گام یک معماری ترکیبی (همانطور که در نمودار زیر نشان داده شده است) قرار داده ایم. ما هنرهای ممکن را بررسی خواهیم کرد و از یک نمونه P4 EC2 با پشتیبانی از BF16 اولیه سازی شده با پایه GPU DLAMI شامل درایورهای NVIDIA، CUDA، NCCL، پشته EFA و PyTorch2.0 برای تنظیم دقیق مدل تحلیل احساسات RoBERTa استفاده خواهیم کرد. که به شما کنترل و انعطاف پذیری برای استفاده از هر کتابخانه منبع باز یا اختصاصی می دهد. سپس از SageMaker برای یک زیرساخت میزبانی مدل کاملاً مدیریت شده برای میزبانی مدل خود بر اساس AWS Graviton3 استفاده می کنیم. نمونه های C7g. ما C7g را در SageMaker انتخاب کردیم زیرا ثابت شده است که هزینه های استنباط را تا 50٪ نسبت به نمونه های EC2 قابل مقایسه کاهش می دهد. استنتاج بلادرنگ در SageMaker. نمودار زیر این معماری را نشان می دهد.

آموزش مدل و میزبانی در این مورد استفاده شامل مراحل زیر است:

- یک نمونه EC2 Ubuntu مبتنی بر GPU DLAMI را در VPC خود راه اندازی کنید و با استفاده از SSH به نمونه خود متصل شوید.

- پس از ورود به نمونه EC2 خود، DLC AWS PyTorch 2.0 را دانلود کنید.

- ظرف DLC خود را با یک اسکریپت آموزشی مدل اجرا کنید تا مدل RoBERTa را دقیق تنظیم کنید.

- پس از تکمیل آموزش مدل، مدل ذخیره شده، اسکریپت های استنتاج و چند فایل فراداده را در یک فایل tar که استنتاج SageMaker می تواند استفاده کند، بسته بندی کنید و بسته مدل را در یک فایل آپلود کنید. سرویس ذخیره سازی ساده آمازون سطل (Amazon S3).

- مدل را با استفاده از SageMaker اجرا کنید و یک نقطه پایانی استنتاج HTTPS ایجاد کنید. نقطه پایانی استنتاج SageMaker یک متعادل کننده بار و یک یا چند نمونه از محفظه استنتاج شما را در مناطق در دسترس بودن مختلف نگه می دارد. شما می توانید چندین نسخه از یک مدل یا مدل های کاملاً متفاوت را در پشت این نقطه پایانی واحد مستقر کنید. در این مثال، ما میزبان یک مدل واحد هستیم.

- با ارسال داده های آزمایشی، نقطه پایانی مدل خود را فراخوانی کنید و خروجی استنتاج را تأیید کنید.

در بخشهای بعدی، تنظیم دقیق یک مدل RoBERTa را برای تحلیل احساسات به نمایش میگذاریم. RoBERTa توسط فیسبوک AI توسعه داده شده است و مدل محبوب BERT را با اصلاح فراپارامترهای کلیدی و پیشآموزش در یک مجموعه بزرگتر بهبود میبخشد. این منجر به بهبود عملکرد در مقایسه با وانیلی BERT می شود.

ما با استفاده از ترانسفورماتور کتابخانه ای توسط Hugging Face برای اینکه مدل RoBERTa در حدود 124 میلیون توییت از قبل آموزش داده شود، و ما آن را در مجموعه داده توییتر برای تجزیه و تحلیل احساسات به خوبی تنظیم می کنیم.

پیش نیازها

مطمئن شوید که پیش نیازهای زیر را دارید:

- شما یک حساب AWS.

- مطمئن شوید که در

us-west-2منطقه برای اجرای این مثال. (این مثال در تست شده استus-west-2; با این حال، می توانید در هر منطقه دیگری اجرا کنید.) - نقش ایجاد کنید با نام

sagemakerrole. سیاست های مدیریت شده را اضافه کنیدAmazonSageMakerFullAccessوAmazonS3FullAccessبرای دسترسی SageMaker به سطل های S3. - یک نقش EC2 ایجاد کنید با نام

ec2_role. از سیاست مجوز زیر استفاده کنید:

1. نمونه توسعه خود را راه اندازی کنید

ما یک نمونه p4d.24xlarge ایجاد می کنیم که 8 پردازنده گرافیکی NVIDIA A100 Tensor Core را در us-west-2:

هنگام انتخاب AMI، موارد زیر را دنبال کنید یادداشت های انتشار برای اجرای این دستور با استفاده از رابط خط فرمان AWS (AWS CLI) برای یافتن شناسه AMI برای استفاده us-west-2:

مطمئن شوید که اندازه حجم ریشه gp3 200 گیگابایت باشد.

رمزگذاری حجم EBS به طور پیش فرض فعال نیست. هنگام انتقال این راه حل به تولید، این مورد را تغییر دهید.

2. یک ظرف یادگیری عمیق را دانلود کنید

DLCهای AWS به صورت تصاویر داکر در دسترس هستند ثبت عمومی ظروف الاستیک آمازون، یک سرویس رجیستری تصویر کانتینر مدیریت شده AWS که ایمن، مقیاس پذیر و قابل اعتماد است. هر تصویر Docker برای آموزش یا استنباط بر روی یک نسخه چارچوب یادگیری عمیق خاص، نسخه Python، با پشتیبانی از CPU یا GPU ساخته شده است. چارچوب PyTorch 2.0 را از لیست موجود انتخاب کنید تصاویر ظروف یادگیری عمیق.

برای دانلود DLC مراحل زیر را انجام دهید:

آ. SSH به نمونه. به طور پیش فرض، گروه امنیتی مورد استفاده با EC2 پورت SSH را برای همه باز می کند. اگر این راه حل را به سمت تولید منتقل می کنید، لطفاً این را در نظر بگیرید:

به طور پیش فرض، گروه امنیتی مورد استفاده با آمازون EC2 پورت SSH را برای همه باز می کند. اگر این راه حل را به سمت تولید منتقل می کنید، این مورد را تغییر دهید.

ب متغیرهای محیطی مورد نیاز برای اجرای مراحل باقی مانده از این پیاده سازی را تنظیم کنید:

Amazon ECR از مخازن تصویر عمومی با مجوزهای مبتنی بر منبع پشتیبانی می کند هویت AWS و مدیریت دسترسی (IAM) تا کاربران یا خدمات خاصی بتوانند به تصاویر دسترسی داشته باشند.

ج وارد رجیستری DLC شوید:

د آخرین کانتینر PyTorch 2.0 با پشتیبانی از GPU را به داخل بکشید us-west-2

اگر با خطای «عدم فضای خالی در دستگاه» مواجه شدید، مطمئن شوید افزایش دادن حجم EC2 EBS به 200 گیگابایت و سپس گسترش سیستم فایل لینوکس

3. آخرین اسکریپت های سازگار شده با PyTorch 2.0 را شبیه سازی کنید

اسکریپت ها را با کد زیر کلون کنید:

از آنجایی که ما از Hugging Face transformers API با آخرین نسخه 4.28.1 استفاده می کنیم، از قبل پشتیبانی PyTorch 2.0 را فعال کرده است. ما آرگومان زیر را به API trainer در اضافه کردیم train_sentiment.py برای فعال کردن ویژگی های جدید PyTorch 2.0:

- مشعل کامپایل – سرعت متوسط ۴۳ درصدی را در پردازندههای گرافیکی Nvidia A43 با یک خط تغییر تجربه کنید.

- نوع داده BF16 – پشتیبانی از نوع داده جدید (Brain Floating Point) برای پردازنده های گرافیکی آمپر یا جدیدتر.

- بهینه ساز ذوب شده AdamW - پیاده سازی AdamW برای سرعت بخشیدن به آموزش. این روش بهینهسازی تصادفی، اجرای معمولی کاهش وزن در آدام را با جدا کردن کاهش وزن از بهروزرسانی گرادیان، اصلاح میکند.

4. یک تصویر داکر جدید با وابستگی بسازید

ما تصویر DLC از پیش ساخته شده PyTorch 2.0 را گسترش می دهیم تا ترانسفورماتور Hugging Face و کتابخانه های دیگری را که برای تنظیم دقیق مدل خود نیاز داریم نصب کنیم. این به شما امکان می دهد از کتابخانه ها و تنظیمات یادگیری عمیق تست شده و بهینه شده استفاده کنید بدون اینکه نیازی به ایجاد یک تصویر از ابتدا داشته باشید. کد زیر را ببینید:

5. تمرین را با استفاده از ظرف شروع کنید

دستور Docker زیر را اجرا کنید تا تنظیم دقیق مدل روی آن آغاز شود tweet_eval مجموعه داده احساسات ما از آرگومانهای ظرف Docker (اندازه حافظه مشترک، حداکثر حافظه قفل شده و اندازه پشته) استفاده میکنیم. توسط Nvidia توصیه می شود برای حجم کار یادگیری عمیق

باید انتظار خروجی زیر را داشته باشید. این اسکریپت ابتدا مجموعه داده TweetEval را دانلود می کند، که شامل هفت وظیفه ناهمگن در توییتر است که همگی به عنوان دسته بندی توییت های چند کلاسه قاب شده اند. این وظایف شامل کنایه، نفرت، توهین آمیز، موضع گیری، شکلک، احساس، و احساسات است.

سپس اسکریپت مدل پایه را دانلود کرده و فرآیند تنظیم دقیق را آغاز می کند. معیارهای آموزش و ارزیابی در پایان هر دوره گزارش می شود.

آمار عملکرد

با PyTorch 2.0 و جدیدترین کتابخانه ترانسفورماتور Hugging Face 4.28.1، ما شاهد افزایش 42 درصدی در یک نمونه p4d.24xlarge با 8 پردازنده گرافیکی A100 40 گیگابایتی بودیم. بهبود عملکرد از ترکیبی از torch.compile، نوع داده BF16 و بهینهساز AdamW ترکیب شده است. کد زیر نتیجه نهایی دو دوره آموزشی با و بدون ویژگی های جدید است:

6. قبل از آماده شدن برای استنتاج SageMaker، مدل آموزش دیده را به صورت محلی آزمایش کنید

فایل های زیر را می توانید در زیر بیابید $ml_working_dir/saved_model/ بعد از تمرین:

بیایید قبل از آماده شدن برای استنتاج SageMaker مطمئن شویم که می توانیم استنتاج را به صورت محلی اجرا کنیم. ما می توانیم مدل ذخیره شده را بارگذاری کنیم و استنتاج را به صورت محلی با استفاده از آن اجرا کنیم test_trained_model.py متن:

باید انتظار خروجی زیر را با ورودی «موارد کووید به سرعت در حال افزایش هستند!» داشته باشید:

7. مدل tarball را برای استنتاج SageMaker آماده کنید

زیر دایرکتوری که مدل در آن قرار دارد، یک دایرکتوری جدید به نام ایجاد کنید code:

در پوشه جدید، فایل را ایجاد کنید inference.py و موارد زیر را به آن اضافه کنید:

در پایان، شما باید ساختار پوشه زیر را داشته باشید:

این مدل آماده بسته بندی و آپلود در آمازون S3 برای استفاده با استنباط SageMaker است:

8. مدل را در یک نمونه SageMaker AWS Graviton مستقر کنید

نسل های جدید CPU ها به دلیل دستورالعمل های داخلی تخصصی، بهبود عملکرد قابل توجهی را در استنتاج ML ارائه می دهند. در این مورد، ما از زیرساخت میزبانی کاملاً مدیریت شده SageMaker با نمونههای C3g مبتنی بر AWS Graviton7 استفاده میکنیم. AWS همچنین با نمونههای EC50 C3g مبتنی بر AWS Graviton2 در سراسر Torch Hub ResNet7 و چندین مدل Hugging Face نسبت به نمونههای قابل مقایسه EC50 تا 2% صرفهجویی در هزینه استنتاج PyTorch را اندازهگیری کرده است.

برای استقرار مدلها در نمونههای AWS Graviton، از DLCهای AWS استفاده میکنیم که از PyTorch 2.0 و TorchServe 0.8.0 پشتیبانی میکنند، یا میتوانید ظروف خود را بیاورید که با معماری ARMv8.2 سازگار هستند.

ما از مدلی که قبلا آموزش داده بودیم استفاده می کنیم: s3://<your-s3-bucket>/twitter-roberta-base-sentiment-latest.tar.gz. اگر قبلا از SageMaker استفاده نکرده اید، مرور کنید با Amazon SageMaker شروع کنید.

برای شروع، مطمئن شوید که بسته SageMaker به روز است:

چون این یک مثال است، یک فایل به نام ایجاد کنید start_endpoint.py و کد زیر را اضافه کنید این اسکریپت پایتون برای شروع یک نقطه پایانی استنتاج SageMaker با حالت زیر خواهد بود:

ما برای مثال از ml.c7g.4xlarge استفاده می کنیم و PT 2.0 را با دامنه تصویر بازیابی می کنیم inference_graviton. این نمونه AWS Graviton3 ما است.

در مرحله بعد، فایلی را ایجاد می کنیم که پیش بینی را اجرا می کند. ما اینها را به عنوان اسکریپت های جداگانه انجام می دهیم تا بتوانیم پیش بینی ها را هر چند بار که بخواهیم اجرا کنیم. ايجاد كردن predict.py با کد زیر:

با اسکریپتهای تولید شده، اکنون میتوانیم یک نقطه پایانی را شروع کنیم، پیشبینیهایی را نسبت به نقطه پایانی انجام دهیم و پس از اتمام کار، آن را پاکسازی کنیم:

9 پاک کردن

در نهایت، ما می خواهیم از این مثال پاک کنیم. cleanup.py را ایجاد کنید و کد زیر را اضافه کنید:

نتیجه

AWS DLAMI و DLC به استانداردی برای اجرای بارهای کاری یادگیری عمیق در مجموعه گسترده ای از خدمات محاسباتی و ML در AWS تبدیل شده اند. در کنار استفاده از DLCهای فریمورک خاص در سرویسهای AWS ML، میتوانید از یک فریمورک واحد در Amazon EC2 نیز استفاده کنید، که سختیهای لازم را برای توسعهدهندگان برای ساخت و نگهداری برنامههای یادگیری عمیق حذف میکند. رجوع شود به یادداشت های انتشار برای DLAMI و تصاویر ظروف یادگیری عمیق موجود برای شروع.

این پست یکی از بسیاری از امکانات را برای آموزش و ارائه مدل بعدی خود در AWS نشان میدهد و چندین فرمت را مورد بحث قرار میدهد که میتوانید برای رسیدن به اهداف تجاری خود اتخاذ کنید. این مثال را امتحان کنید یا از دیگر خدمات AWS ML ما برای گسترش بهره وری داده برای کسب و کار خود استفاده کنید. ما یک مشکل ساده تجزیه و تحلیل احساسات را گنجانده ایم تا مشتریان تازه وارد ML بتوانند بفهمند که شروع با PyTorch 2.0 در AWS چقدر ساده است. موارد استفاده پیشرفتهتر، مدلها و فناوریهای AWS را در پستهای وبلاگ آینده پوشش خواهیم داد.

درباره نویسندگان

کانوالجیت خرمی یک معمار اصلی راه حل در خدمات وب آمازون است. او با مشتریان AWS همکاری می کند تا راهنمایی و کمک فنی ارائه دهد تا به آنها کمک کند ارزش راه حل های خود را هنگام استفاده از AWS بهبود بخشند. Kanwaljit در کمک به مشتریان با برنامه های کاربردی کانتینری و یادگیری ماشین تخصص دارد.

کانوالجیت خرمی یک معمار اصلی راه حل در خدمات وب آمازون است. او با مشتریان AWS همکاری می کند تا راهنمایی و کمک فنی ارائه دهد تا به آنها کمک کند ارزش راه حل های خود را هنگام استفاده از AWS بهبود بخشند. Kanwaljit در کمک به مشتریان با برنامه های کاربردی کانتینری و یادگیری ماشین تخصص دارد.

مایک اشنایدر یک توسعه دهنده سیستم است که در Phoenix AZ مستقر است. او یکی از کانتینرهای Deep Learning است که از تصاویر کانتینر Framework مختلف پشتیبانی میکند تا Graviton Inference را نیز شامل شود. او به کارایی و ثبات زیرساخت اختصاص دارد.

مایک اشنایدر یک توسعه دهنده سیستم است که در Phoenix AZ مستقر است. او یکی از کانتینرهای Deep Learning است که از تصاویر کانتینر Framework مختلف پشتیبانی میکند تا Graviton Inference را نیز شامل شود. او به کارایی و ثبات زیرساخت اختصاص دارد.

لای وی یک مهندس نرم افزار ارشد در خدمات وب آمازون است. او بر روی ساخت چارچوبهای یادگیری عمیق با کارایی بالا و مقیاسپذیر برای تسریع در آموزش مدلهای توزیعشده تمرکز دارد. در خارج از محل کار، او از گذراندن وقت با خانواده، پیاده روی و اسکی لذت می برد.

لای وی یک مهندس نرم افزار ارشد در خدمات وب آمازون است. او بر روی ساخت چارچوبهای یادگیری عمیق با کارایی بالا و مقیاسپذیر برای تسریع در آموزش مدلهای توزیعشده تمرکز دارد. در خارج از محل کار، او از گذراندن وقت با خانواده، پیاده روی و اسکی لذت می برد.

- محتوای مبتنی بر SEO و توزیع روابط عمومی. امروز تقویت شوید.

- PlatoAiStream. Web3 Data Intelligence دانش تقویت شده دسترسی به اینجا.

- ضرب کردن آینده با آدرین اشلی. دسترسی به اینجا.

- خرید و فروش سهام در شرکت های PRE-IPO با PREIPO®. دسترسی به اینجا.

- منبع: https://aws.amazon.com/blogs/machine-learning/part-1-build-high-performance-ml-models-using-pytorch-2-0-on-aws/

- : دارد

- :است

- :نه

- :جایی که

- $UP

- 1

- 10

- 100

- 11

- 12

- 13

- 14

- ٪۱۰۰

- 16

- 17

- 20

- 200

- 23

- 25

- ٪۱۰۰

- 28

- 31

- 7

- 8

- 9

- a

- شتاب دادن

- تسریع شد

- تسریع

- پذیرفتن

- دسترسی

- در میان

- عمل

- آدم

- اضافه کردن

- اضافه

- اتخاذ

- پیشرفته

- پس از

- در برابر

- AI

- تراز

- هم راستا

- معرفی

- اجازه دادن

- اجازه دادن

- اجازه می دهد تا

- در امتداد

- قبلا

- همچنین

- آمازون

- آمازون EC2

- آمازون خدمات وب

- AMD

- مقدار

- an

- تحلیل

- تحلیل

- و

- اعلام کرد

- دیگر

- هر

- API

- کاربرد

- برنامه های کاربردی

- روش

- تقریبا

- معماری

- هستند

- محدوده

- استدلال

- استدلال

- مصنوعی

- هوش مصنوعی

- هوش مصنوعی (AI)

- AS

- کمک

- At

- دسترس پذیری

- در دسترس

- میانگین

- AWS

- متعادل کننده

- پایه

- مستقر

- اساسا

- BE

- زیرا

- شدن

- بوده

- قبل از

- شروع

- پشت سر

- محک

- معیار

- بزرگ

- میلیاردها

- BIN

- بلاگ

- پست های وبلاگ

- بدن

- پایین

- مغز

- پهن

- بودجه

- ساختن

- بنا

- ساخته

- ساخته شده در

- بار

- کسب و کار

- کسب و کار

- اما

- by

- صدا

- نام

- فراخوانی

- CAN

- قابلیت های

- مورد

- موارد

- CD

- تغییر دادن

- متغیر

- انتخاب

- را انتخاب کنید

- طبقه بندی

- مشتری

- ابر

- رمز

- COM

- ترکیب

- می آید

- ارتباط

- قابل مقایسه

- مقایسه

- سازگار

- کامل

- محاسبه

- کامپیوتر

- چشم انداز کامپیوتر

- محاسبه

- اتصال

- در نظر بگیرید

- تشکیل شده است

- کنسول

- ظرف

- ظروف

- محتوا

- تولید محتوا

- کنترل

- هسته

- هزینه

- صرفه جویی در هزینه

- هزینه

- میتوانست

- پوشش

- ایجاد

- ایجاد شده

- ایجاد

- مجوزها و اعتبارات

- سرپرستی

- جاری

- مشتریان

- سفارشی

- داده ها

- تاریخ

- روز

- اختصاصی

- عمیق

- یادگیری عمیق

- به طور پیش فرض

- نشان می دهد

- بستگی دارد

- گسترش

- مستقر

- گسترش

- اعزام ها

- طراحی

- جزئیات

- توسعه

- توسعه دهنده

- توسعه دهندگان

- پروژه

- مختلف

- هضم

- بحث و تبادل نظر

- بحث کردیم

- توزیع شده

- آموزش توزیع شده

- مختلف

- do

- کارگر بارانداز

- انجام شده

- آیا

- دانلود

- دانلود

- راننده

- درایور

- رانندگی

- دو

- پویا

- هر

- پیش از آن

- سهولت

- به آسانی

- ساده

- اثر

- به طور موثر

- بهره وری

- موثر

- تلاش

- هر دو

- قادر ساختن

- فعال

- رمزگذاری

- پایان

- نقطه پایانی

- مهندس

- افزایش

- به طور کامل

- محیط

- دوره

- خطا

- ارزیابی

- ارزیابی

- حتی

- تا کنون

- هر

- مثال

- موجود

- گسترش

- انتظار

- تجربه

- اکتشاف

- نمایی

- صادرات

- گسترش

- گسترش می یابد

- پارچه

- چهره

- فیس بوک

- خانواده

- سریعتر

- سریعترین

- امکانات

- کمی از

- شکل

- پرونده

- فایل ها

- نهایی

- پیدا کردن

- نام خانوادگی

- مناسب

- انعطاف پذیری

- شناور

- تمرکز

- تمرکز

- به دنبال

- پیروی

- برای

- چارچوب

- چارچوب

- از جانب

- کاملا

- بیشتر

- تولید می کنند

- تولید

- نسل

- نسل ها

- مولد

- هوش مصنوعی مولد

- دریافت کنید

- رفتن

- GitHub

- دادن

- می دهد

- جهانی

- GPU

- GPU ها

- گروه

- رشد

- راهنمایی

- آیا

- داشتن

- he

- سنگین

- بلند کردن سنگین

- کمک

- کمک می کند

- عملکرد بالا

- بالاتر

- بالاترین

- خود را

- دارای

- میزبان

- میزبانی وب

- چگونه

- اما

- HTML

- HTTP

- HTTPS

- قطب

- صدها نفر

- ترکیبی

- ID

- هویت

- if

- نشان می دهد

- تصویر

- تصاویر

- انجام

- پیاده سازی

- واردات

- بهبود

- بهبود یافته

- بهبود

- ارتقاء

- بهبود

- in

- شامل

- مشمول

- شامل

- از جمله

- افزایش

- افزایش

- مستقل

- لوازم

- شالوده

- ورودی

- نصب

- نصب شده

- نصب کردن

- نمونه

- در عوض

- دستورالعمل

- ادغام

- اینتل

- اطلاعات

- به

- سرمایه گذاری

- IP

- طنز

- IT

- ITS

- شغل ها

- JPG

- json

- کلید

- برچسب

- زبان

- بزرگ

- در مقیاس بزرگ

- بزرگتر

- تاخیر

- آخرین

- آخرین نسخه

- راه اندازی

- منجر می شود

- یادگیری

- ترک کرد

- کتابخانه ها

- کتابخانه

- بلند کردن اجسام

- پسندیدن

- محدود شده

- لاین

- لینوکس

- فهرست

- بار

- به صورت محلی

- واقع شده

- قفل شده

- ورود به سیستم

- ورود

- خاموش

- کاهش

- پایین ترین

- دستگاه

- فراگیری ماشین

- حفظ

- ساخت

- ساخت

- مدیریت

- اداره می شود

- بسیاری

- ریاضی

- حداکثر

- ممکن است..

- دیدار

- عضو

- حافظه

- ادغام می شود

- متاداده

- روش

- متریک

- میلیون

- ML

- MLO ها

- حالت

- مدل

- مدل

- ماژول ها

- ماه

- بیش

- متحرک

- چندگانه

- نام

- طبیعی

- پردازش زبان طبیعی

- لازم

- نیاز

- ضروری

- نیازهای

- منفی

- شبکه

- شبکه

- خنثی

- جدید

- ویژگی های جدید

- فناوری های نوین

- بعد

- گره

- یادداشت

- اطلاع..

- اکنون

- کارت گرافیک Nvidia

- اهداف

- of

- توهین آمیز

- ارائه

- ارائه

- پیشنهادات

- on

- ONE

- منبع باز

- باز می شود

- قابل استفاده

- بهینه سازی

- بهینه

- گزینه

- or

- تنظیم و ارکستراسیون

- سازمانی

- OS

- دیگر

- دیگران

- ما

- خارج

- تولید

- خارج از

- خود

- بسته

- بسته بندی

- پارامترهای

- بخش

- وصله

- پچ کردن

- کارایی

- اجازه

- مجوز

- عنقا

- انتخاب کنید

- برگزیده

- خط لوله

- سکو

- افلاطون

- هوش داده افلاطون

- PlatoData

- لطفا

- نقطه

- سیاست

- سیاست

- محبوب

- فرصت

- پست

- پست ها

- صفحه اصلی

- قوی

- پیش بینی

- پیش گویی

- پیش بینی

- آماده

- آماده

- پیش نیازها

- قبلی

- اصلی

- مشکل

- روند

- در حال پردازش

- پردازنده ها

- تولید

- بهره وری

- محصولات

- پروژه

- پروژه ها

- اختصاصی

- اثبات شده

- ارائه

- فراهم می کند

- عمومی

- قرار دادن

- پــایتــون

- مارماهی

- اماده

- اخیر

- تازه

- مکرر

- كاهش دادن

- منطقه

- رجیستری

- به طور منظم

- نسبی

- آزاد

- قابل اعتماد

- باقی مانده

- گزارش

- نیاز

- ضروری

- مورد نیاز

- نیاز

- منابع

- پاسخ

- محدودیت های

- نتیجه

- برگشت

- این فایل نقد می نویسید:

- نقش

- ریشه

- دویدن

- در حال اجرا

- حکیم ساز

- استنباط SageMaker

- همان

- پس انداز

- مقیاس پذیر

- مقیاس

- اسکن

- یادگیری

- حوزه

- نمره

- خراش

- اسکریپت

- بخش

- بخش

- امن

- تیم امنیت لاتاری

- دیدن

- انتخاب

- انتخاب

- در حال ارسال

- ارشد

- احساس

- جداگانه

- خدمت

- سرویس

- خدمات

- جلسه

- تنظیم

- تنظیمات

- برپایی

- هفت

- چند

- SHA256

- به اشتراک گذاشته شده

- باید

- نمایشگاه

- نشان داد

- نشان داده شده

- نشان می دهد

- قابل توجه

- ساده

- تنها

- اندازه

- اندازه

- So

- نرم افزار

- مهندس نرمافزار

- راه حل

- مزایا

- برخی از

- فضا

- تخصصی

- تخصص دارد

- خاص

- به طور خاص

- سرعت

- سرعت

- خرج کردن

- هزینه

- ثبات

- پشته

- استاندارد

- شروع

- آغاز شده

- شروع می شود

- بیانیه

- ارقام

- گام

- مراحل

- ذخیره سازی

- گزینه های ذخیره سازی

- استراتژی ها

- ساختار

- چنین

- پشتیبانی

- پشتیبانی

- حمایت از

- پشتیبانی از

- سیستم

- سیستم های

- طراحی شده

- وظایف

- فنی

- تکنیک

- فن آوری

- جریان تنسور

- آزمون

- آزمایش

- نسبت به

- که

- La

- محوطه

- شان

- آنها

- سپس

- اینها

- آنها

- اشیاء

- این

- اگر چه؟

- از طریق

- توان

- ردیف

- زمان

- بار

- به

- ابزار

- مشعل

- قطار

- آموزش دیده

- آموزش

- ترانسفورماتور

- ترانسفورماتور

- تبدیل شدن

- امتحان

- صدای جیر جیر

- توییت

- توییتر

- دو

- نوع

- انواع

- نوعی

- اوبونتو

- زیر

- فهمیدن

- نزدیک

- بروزرسانی

- به روز شده

- ارتقاء

- آپلود شده

- استفاده

- استفاده کنید

- مورد استفاده

- استفاده

- کاربران

- با استفاده از

- سودمندی

- ارزش

- تنوع

- مختلف

- بررسی

- نسخه

- دید

- حجم

- آسیب پذیری ها

- می خواهم

- we

- وب

- خدمات وب

- هفته

- وزن

- خوش آمد

- چه زمانی

- که

- به طور گسترده ای

- اراده

- با

- بدون

- مهاجرت کاری

- گردش کار

- با این نسخهها کار

- نوشتن

- نوشته

- X

- شما

- شما

- زفیرنت

- مناطق