PyTorch یک چارچوب یادگیری ماشینی (ML) است که بر اساس مشعل کتابخانه، برای کاربردهایی مانند بینایی کامپیوتر و پردازش زبان طبیعی استفاده می شود. یکی از دلایل اصلی که مشتریان چارچوب PyTorch را انتخاب می کنند، سادگی آن و این واقعیت است که برای کار با پایتون طراحی و مونتاژ شده است. PyTorch از نمودارهای محاسباتی پویا پشتیبانی می کند و امکان تغییر رفتار شبکه را در زمان اجرا فراهم می کند. این یک مزیت انعطافپذیری بزرگ را نسبت به اکثر چارچوبهای ML فراهم میکند، که نیاز دارند شبکههای عصبی قبل از زمان اجرا به عنوان اشیاء ثابت تعریف شوند. در این پست، ما به عمق می پردازیم تا ببینیم چگونه آمازون SageMaker می تواند این مدل های PyTorch را با استفاده از NVIDIA Triton Inference Server ارائه دهد.

SageMaker چندین گزینه را برای مشتریانی که به دنبال میزبانی مدل های ML خود هستند ارائه می دهد. یکی از ویژگی های کلیدی موجود SageMaker است نقاط پایانی استنتاج بلادرنگ. بارهای کاری بلادرنگ می توانند سطوح متفاوتی از انتظارات عملکرد و قراردادهای سطح خدمات (SLA) داشته باشند که به عنوان الزامات تاخیر و توان عملیاتی تحقق می یابند.

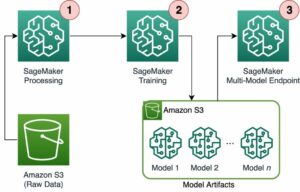

با نقاط پایانی بلادرنگ، گزینههای استقرار مختلف با سطوح مختلف عملکرد مورد انتظار تنظیم میشوند. به عنوان مثال، کسب و کار شما ممکن است بر مدلی تکیه کند که باید از SLAهای بسیار سختگیرانه برای تأخیر و توان عملیاتی با عملکرد قابل پیش بینی برخوردار باشد. در این مورد SageMaker فراهم می کند نقاط پایانی تک مدلی (SMEs)، به شما امکان می دهد یک مدل ML واحد را در یک نقطه پایانی منطقی مستقر کنید، که از شبکه و ظرفیت محاسبه سرور اصلی استفاده می کند. برای موارد استفاده دیگر که به تعادل بهتری بین عملکرد و هزینه نیاز دارید، نقاط پایانی چند مدلی (MMEs) به شما امکان می دهد چندین مدل را در پشت یک نقطه پایانی منطقی مستقر کنید و آنها را به صورت جداگانه فراخوانی کنید، در حالی که بارگذاری و تخلیه آنها را از حافظه انتزاعی کنید.

SageMaker از نقاط پایانی تک مدلی و چند مدلی پشتیبانی می کند سرور استنتاج تریتون NVIDIA. تریتون از پشتیبان های مختلف به عنوان موتور برای نیرو دادن به کار و سرویس دهی مختلف پشتیبانی می کند مدل های چارچوبمانند PyTorch، TensorFlow، TensorRT یا ONNX Runtime. برای هر استقرار تریتون، بسیار مهم است که بدانید چگونه رفتار backend بر حجم کاری شما تأثیر می گذارد و از پارامترهای پیکربندی منحصر به فرد آن چه انتظاری باید داشت. در این پست به شما کمک می کنیم تا این موضوع را درک کنید تریتون پای تورچ باطن عمیق.

تریتون با باطن PyTorch

باطن PyTorch برای اجرا طراحی شده است TorchScript مدل هایی با استفاده از PyTorch C++ API. TorchScript زیرمجموعه ایستا از پایتون است که ساختار یک مدل PyTorch را نشان می دهد. برای استفاده از این باطن، باید مدل PyTorch خود را با استفاده از کامپایل Just-In-Time (JIT) به TorchScript تبدیل کنید. JIT کد TorchScript را در یک نمایش متوسط بهینه سازی شده کامپایل می کند و آن را برای استقرار در محیط های غیر پایتون مناسب می کند. تریتون از TorchScript برای بهبود عملکرد و انعطاف پذیری استفاده می کند.

هر مدلی که با تریتون مستقر شده نیاز به یک فایل پیکربندی دارد (config.pbtxt) که فراداده مدل، مانند تانسورهای ورودی و خروجی، نام مدل و پلت فرم را مشخص می کند. فایل پیکربندی برای تریتون ضروری است تا نحوه بارگیری، اجرا و بهینه سازی مدل را درک کند. برای مدلهای PyTorch، فیلد پلتفرم در فایل پیکربندی باید روی آن تنظیم شود pytorch_libtorch. میتوانید مدلهای Triton PyTorch را روی GPU و CPU بارگیری کنید (نگاه کنید به نمونه های چندگانه مدل) و وزن مدل به ترتیب در حافظه GPU/VRAM یا در حافظه میزبان/RAM نگهداری می شود.

توجه داشته باشید که فقط مدل forward متد هنگام استفاده از باطن Pytorch فراخوانی می شود. اگر برای آمادهسازی، تکرار و تغییر پیشبینیهای مدل خام خود برای پاسخ به یک درخواست به منطق پیچیدهتری تکیه میکنید، باید آن را به عنوان یک مدل سفارشی به جلو بپیچید. به طور متناوب، می توانید از مدل های مجموعه یا برنامه نویسی منطق کسب و کار.

می توانید با استفاده از ترکیبی از ویژگی های مبتنی بر پیکربندی موجود، عملکرد مدل PyTorch را در تریتون بهینه کنید. برخی از اینها باطن-آگنوستیک هستند، مانند دسته بندی پویا و مدل همزمان اجرا می شود (نگاه کنید به با استفاده از NVIDIA Triton Inference Server در آمازون SageMaker، عملکرد فوق مقیاس را برای ارائه مدل به دست آورید برای کسب اطلاعات بیشتر)، و برخی از آنها مخصوص PyTorch هستند. بیایید نگاهی عمیق تر به این موارد بیندازیم پارامترهای پیکربندی و چگونه باید از آنها استفاده کنید:

- DISABLE_OPTIMIZED_EXECUTION – از این پارامتر برای بهینه سازی مدل های TorchScript در حال اجرا استفاده کنید. این پارامتر تماس اولیه با یک مدل TorchScript بارگذاری شده را کند می کند و ممکن است سودی ندارد و یا حتی مانع عملکرد مدل در برخی موارد تنظیم کنید

falseاگر تحمل شما در برابر پوسته پوسته شدن یا تاخیر شروع سرد بسیار کم است. - INFERENCE_MODE – از این پارامتر برای تغییر حالت استنتاج PyTorch استفاده کنید. در حالت استنتاج، محاسبات در نمودار عقب ثبت نمیشوند و به PyTorch اجازه میدهد تا سرعت مدل شما را افزایش دهد. این زمان اجرا بهتر با یک اشکال همراه است: شما نمی توانید از تانسورهای ایجاد شده در حالت استنتاج در محاسبات برای ضبط توسط autograd پس از خروج از حالت استنتاج استفاده کنید. تنظیم کنید

trueاگر شرایط قبلی در مورد استفاده شما اعمال شود (بیشتر برای بارهای کاری استنتاج صادق است). - ENABLE_NVFUSER – از این پارامتر برای فعال کردن استفاده کنید NvFuser بهینه سازی (CUDA Graph Fuser) برای مدل های TorchScript. اگر مشخص نشده باشد، از فیوزر پیش فرض PyTorch استفاده می شود.

- ENABLE_WEIGHT_SHARING - از این پارامتر استفاده کنید تا به نمونه های مدل (کپی) در همان دستگاه اجازه دهید وزن ها را به اشتراک بگذارند. این می تواند استفاده از حافظه بارگذاری مدل و استنتاج را کاهش دهد. نباید با مدل هایی که حالت را حفظ می کنند استفاده شود.

- ENABLE_CACHE_CLEANING – از این پارامتر برای فعال کردن پاکسازی حافظه پنهان CUDA پس از اجرای هر مدل استفاده کنید (فقط در صورتی که مدل بر روی GPU باشد تأثیر دارد). تنظیم این پرچم روی

trueبه دلیل عملیات تمیز کردن حافظه پنهان CUDA اضافی پس از هر اجرای مدل، بر عملکرد تأثیر منفی خواهد گذاشت. فقط در صورتی باید از این پرچم استفاده کنید که چندین مدل را با Triton سرو میکنید و در طول اجرای مدل با مشکلات حافظه CUDA مواجه میشوید. - ENABLE_JIT_EXECUTOR، ENABLE_JIT_PROFILING و ENABLE_TENSOR_FUSER – از این پارامترها برای غیرفعال کردن برخی بهینهسازیهای PyTorch استفاده کنید که گاهی اوقات میتوانند باعث رگرسیون تأخیر در مدلهایی با حالتهای اجرای پیچیده و اشکال پویا شوند.

استنباط تریتون در SageMaker

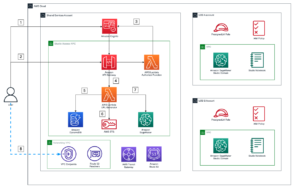

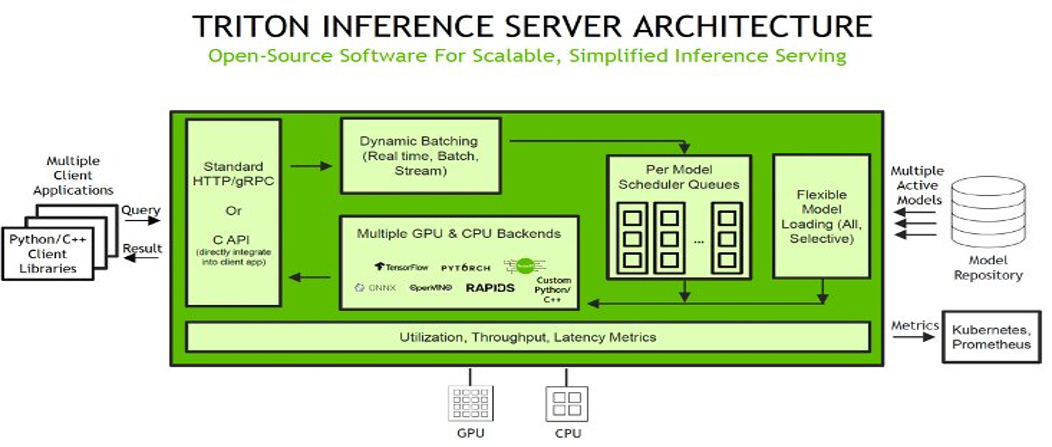

SageMaker اجازه می دهد تا شما می توانید هر دو SME و MME را با NVIDIA Triton Inference Server مستقر کنید. شکل زیر معماری سطح بالای تریتون را نشان می دهد. این مخزن مدل یک مخزن مبتنی بر سیستم فایل از مدل هایی است که تریتون برای استنتاج در دسترس قرار خواهد داد. درخواستهای استنتاج از طریق HTTPS به سرور میرسند و سپس به زمانبندی مناسب برای هر مدل هدایت میشوند. تریتون اجرا می کند چندین الگوریتم زمانبندی و دسته بندی که می تواند بر اساس مدل به مدل پیکربندی شود. زمانبندی هر مدل به صورت اختیاری دسته بندی درخواست های استنتاج را انجام می دهد و سپس درخواست ها را به آن ارسال می کند باطن مطابق با نوع مدل Backend استنتاج را با استفاده از ورودی های ارائه شده در درخواست های دسته ای انجام می دهد و سپس خروجی ها برگردانده می شوند.

هنگام پیکربندی گروه های مقیاس خودکار خود برای نقاط پایانی SageMaker، ممکن است بخواهید در نظر بگیرید SageMakerVariantInvocationsPerInstance به عنوان معیار اولیه برای تعیین ویژگی های مقیاس بندی گروه مقیاس خودکار شما. علاوه بر این، بر اساس اینکه آیا مدلهای شما روی GPU یا CPU اجرا میشوند، میتوانید از آن استفاده کنید CPUUtilization or GPUUtilization به عنوان معیارهای اضافی توجه داشته باشید که برای SMEها، از آنجایی که مدلهای به کار گرفتهشده همگی یکسان هستند، تنظیم سیاستهای مناسب برای مطابقت با SLAهای خود نسبتاً ساده است. برای MMEها، توصیه میکنیم مدلهای مشابه را در پشت نقطه پایانی معین به کار ببرید تا عملکرد پایدارتر و قابل پیشبینیتری داشته باشید. در موارد استفاده که از مدلهایی با اندازهها و الزامات مختلف استفاده میشود، ممکن است بخواهید آن حجمهای کاری را در چندین MME از هم جدا کنید، یا زمان بیشتری را صرف تنظیم دقیق خطمشی گروه مقیاس خودکار آنها کنید تا بهترین تعادل هزینه و عملکرد را به دست آورید. دیدن الگوهای میزبانی مدل در Amazon SageMaker، قسمت 3: اجرای و بهینه سازی استنتاج چند مدل با نقاط پایانی چند مدل Amazon SageMaker برای اطلاعات بیشتر در مورد ملاحظات سیاست مقیاس خودکار برای MMEها. (توجه داشته باشید که اگرچه تنظیمات MMS در این مورد اعمال نمی شود، ملاحظات خط مشی همچنان اعمال می شوند.)

برای لیستی از ظروف یادگیری عمیق NVIDIA Triton (DLC) که توسط استنتاج SageMaker پشتیبانی می شوند، به تصاویر ظروف یادگیری عمیق موجود.

بررسی اجمالی راه حل

در بخشهای بعدی، نمونهای را که در دسترس است بررسی میکنیم GitHub برای درک اینکه چگونه می توانیم از Triton و SageMaker MME در GPU برای استقرار یک مدل ResNet برای طبقه بندی تصاویر استفاده کنیم. برای اهداف نمایشی، ما از یک مدل ResNet50 از پیش آموزش دیده استفاده می کنیم که می تواند تصاویر را در 1,000 دسته طبقه بندی کند.

پیش نیازها

ابتدا به یک حساب کاربری AWS و یک هویت AWS و مدیریت دسترسی کاربر سرپرست (IAM). برای راهنمایی در مورد نحوه تنظیم یک حساب AWS، نگاه کنید چگونه یک حساب AWS جدید ایجاد و فعال کنم؟. برای راهنمایی در مورد نحوه ایمن کردن حساب خود با یک کاربر سرپرست IAM، ببینید ایجاد اولین کاربر و گروه کاربری سرپرست IAM شما.

SageMaker به دسترسی نیاز دارد سرویس ذخیره سازی ساده آمازون سطل (Amazon S3) که مدل شما را ذخیره می کند. یک نقش IAM با خط مشی ای ایجاد کنید که به SageMaker امکان دسترسی خواندن به سطل شما را می دهد.

اگر قصد دارید نوت بوک را در آن اجرا کنید Amazon SageMaker Studio، رجوع شود به شروع کنید برای دستورالعمل های راه اندازی

محیط خود را تنظیم کنید

برای تنظیم محیط خود، مراحل زیر را انجام دهید:

یک نمونه نوت بوک SageMaker را با یک نمونه g5.xlarge راه اندازی کنید.

شما همچنین می توانید این مثال را در یک نمونه نوت بوک استودیو اجرا کنید.

- انتخاب کنید یک مخزن git عمومی را فقط در این نمونه نوت بوک شبیه سازی کنید و مخزن GitHub را مشخص کنید URL.

- وقتی JupyterLab آماده شد، آن را اجرا کنید

resnet_pytorch_python_backend_MME.ipynbنوت بوک باconda_python3conda kernel و مرحله به مرحله این نوت بوک را اجرا کنید.

وابستگی ها را نصب کنید و کتابخانه مورد نیاز را وارد کنید

برای نصب وابستگی ها و وارد کردن کتابخانه مورد نیاز از کد زیر استفاده کنید:

مصنوعات مدل را آماده کنید

La generate_model_pytorch.sh فایل در دایرکتوری فضای کاری حاوی اسکریپت هایی برای بارگیری و ذخیره یک مدل PyTorch است. ابتدا یک مدل ResNet50 از قبل آموزش دیده را با استفاده از بارگذاری می کنیم torchvision پکیج مدل ها ما مدل را به عنوان یک ذخیره می کنیم model.pt فایل با فرمت TorchScript بهینه سازی شده و سریال. TorchScript برای انجام یک مدل به جلو به ورودیهای نمونه نیاز دارد، بنابراین یک نمونه از یک تصویر RGB را با سه کانال رنگی با ابعاد 224X224 ارسال میکنیم. اسکریپت برای صادرات این مدل را می توان در پیدا کرد GitHub repo.

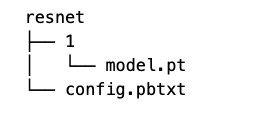

تریتون الزامات خاصی برای چیدمان مخزن مدل دارد. در دایرکتوری مخزن مدل سطح بالا، هر مدل فهرست فرعی خود را دارد که حاوی اطلاعات مدل مربوطه است. هر دایرکتوری مدل در تریتون باید حداقل یک زیردایرکتوری عددی داشته باشد که نسخه ای از مدل را نشان می دهد، همانطور که در مثال زیر نشان داده شده است. مقدار 1 نشان دهنده نسخه 1 مدل Pytorch ما است. هر مدل توسط باطن خاص خود اجرا می شود، بنابراین هر زیر شاخه نسخه باید دارای مصنوع مدل مورد نیاز آن باطن باشد. از آنجا که ما از یک باطن PyTorch استفاده می کنیم، a model.pt فایل در دایرکتوری نسخه مورد نیاز است. برای جزئیات بیشتر در مورد قراردادهای نامگذاری برای فایل های مدل، مراجعه کنید فایل های مدل.

هر مدل تریتون باید یک config.pbtxt فایلی که پیکربندی مدل را توصیف می کند. برای کسب اطلاعات بیشتر در مورد تنظیمات پیکربندی، مراجعه کنید پیکربندی مدل. بیرون config.pbtxt فایل باطن را به عنوان مشخص می کند pytorch_libtorch، و اشکال تانسور ورودی و خروجی و اطلاعات نوع داده را تعریف می کند. همچنین مشخص می کنیم که می خواهیم این مدل را از طریق GPU روی GPU اجرا کنیم instance_group پارامتر. کد زیر را ببینید:

برای instance_group پیکربندی، زمانی که به سادگی یک تعداد مشخص شده باشد، تریتون تعداد x مدل را در هر دستگاه GPU موجود بارگیری می کند. اگر میخواهید کنترل کنید که مدلهای خود در کدام دستگاههای GPU بارگذاری شوند، میتوانید این کار را به صراحت با مشخص کردن شناسههای دستگاه GPU انجام دهید. توجه داشته باشید که برای MMEها، مشخص کردن صریح چنین شناسههای دستگاه GPU ممکن است منجر به مدیریت ضعیف حافظه شود، زیرا ممکن است چندین مدل صراحتاً سعی کنند یک دستگاه GPU یکسان را اختصاص دهند.

سپس مصنوعات مدل را tar.gz می کنیم، که فرمت مورد انتظار SageMaker است:

اکنون که مصنوعات مدل را در آمازون S3 بارگذاری کرده ایم، می توانیم یک نقطه پایانی چند مدل SageMaker ایجاد کنیم.

مدل را مستقر کنید

ما اکنون مدل تریتون را در یک MME SageMaker مستقر می کنیم. در تعریف ظرف، را تعریف کنید ModelDataUrl برای تعیین دایرکتوری S3 که شامل تمام مدل هایی است که SageMaker MME از آنها برای بارگیری و ارائه پیش بینی ها استفاده می کند. حالت را روی MultiModel برای نشان دادن SageMaker نقطه پایانی را با مشخصات ظرف MME ایجاد می کند. ما ظرف را با تصویری تنظیم می کنیم که از استقرار MME با GPU پشتیبانی می کند (به MME مراجعه کنید تصاویر ظرف برای جزئیات بیشتر). توجه داشته باشید که پارامتر mode تنظیم شده است MultiModel. این تمایز کلیدی است.

با استفاده از کلاینت SageMaker Boto3، مدل را با استفاده از create_model API. ما تعریف ظرف را به create_model API همراه با ModelName و ExecutionRoleArn:

ایجاد تنظیمات MME با استفاده از create_endpoint_config Boto3 API. یک نمونه محاسباتی شتابدار GPU را در آن مشخص کنید InstanceType (برای این پست، از یک نمونه g4dn.4xlarge استفاده می کنیم). توصیه می کنیم نقاط پایانی خود را حداقل با دو نمونه پیکربندی کنید. این به SageMaker اجازه میدهد تا مجموعهای از پیشبینیهای بسیار در دسترس را در چندین منطقه در دسترس برای مدلها ارائه دهد.

با استفاده از پیکربندی نقطه پایانی قبلی، یک نقطه پایانی جدید SageMaker ایجاد می کنیم و منتظر می مانیم تا استقرار به پایان برسد. وضعیت به تغییر خواهد کرد InService زمانی که استقرار موفقیت آمیز باشد.

مدل را فراخوانی کنید و پیش بینی ها را اجرا کنید

روش زیر یک تصویر نمونه ای را که برای استنتاج استفاده خواهیم کرد به محموله ای تبدیل می کند که می تواند برای استنتاج به سرور تریتون ارسال شود.

La tritonclient پکیج روشهای مفیدی را برای تولید محموله بدون نیاز به دانستن جزئیات مشخصات ارائه می دهد. ما از روشهای زیر برای تبدیل درخواست استنتاج خود به فرمت باینری استفاده میکنیم که تأخیر کمتری برای استنتاج فراهم میکند:

پس از اینکه نقطه پایانی با موفقیت ایجاد شد، میتوانیم درخواستهای استنتاج را با استفاده از آن به MME ارسال کنیم invoke_enpoint API. را مشخص می کنیم TargetModel در فراخوانی فراخوانی و ارسال در محموله برای هر نوع مدل:

علاوه بر این، SageMaker MME معیارهای سطح نمونه را برای نظارت با استفاده از آن ارائه میکند CloudWatch آمازون:

- LoadedModelCount – تعداد مدل های بارگیری شده در کانتینرها

- GPUUtilization – درصد واحدهای GPU که توسط کانتینرها استفاده می شود

- GPUMemoryUtilization - درصد حافظه GPU استفاده شده توسط کانتینرها

- DiskUtilization – درصد فضای دیسک مورد استفاده کانتینرها

SageMaker MMEs همچنین معیارهای بارگیری مدل را ارائه می دهد مانند موارد زیر:

- ModelLoadingWaitTime – فاصله زمانی برای دانلود یا بارگذاری مدل

- ModelUnloadingTime – فاصله زمانی تخلیه مدل از کانتینر

- ModelDownloadingTime – زمان دانلود مدل از آمازون S3 است

- ModelCacheHit - تعداد فراخوانهایی به مدل که قبلاً روی کانتینر بارگذاری شدهاند تا بینشهای سطح فراخوانی مدل را دریافت کنید

برای جزئیات بیشتر ، به مراجعه کنید Amazon SageMaker را با Amazon CloudWatch مانیتور کنید.

پاک کردن

برای جلوگیری از تحمیل هزینه، نقطه پایانی مدل را حذف کنید:

بهترین شیوه

هنگام استفاده از باطن PyTorch، بیشتر تصمیمات بهینه سازی به تاخیر بار کاری خاص یا الزامات توان عملیاتی شما و معماری مدلی که استفاده می کنید بستگی دارد. به طور کلی، برای مقایسه پارامترهای پیکربندی مبتنی بر داده برای بهبود عملکرد، باید از تریتون استفاده کنید. آنالیز عملکرد. با استفاده از این ابزار، باید منطق تصمیم گیری زیر را اتخاذ کنید:

- آزمایش کنید و بررسی کنید که آیا معماری مدل شما می تواند به a تبدیل شود تنفر موتور و با تریتون مستقر شد باطن TensorRT. این روش ترجیحی برای استقرار مدلها با پردازندههای گرافیکی NVIDIA است زیرا هم فرمت مدل TensorRT و هم زمان اجرا بهترین استفاده را از قابلیتهای سختافزاری زیربنایی میکنند.

- همیشه تنظیم شده است

INFERENCE_MODEبهtrueبرای بارهای کاری استنتاج خالص که در آن محاسبات autograd مورد نیاز نیست. - در صورت استقرار SMEها، استفاده از سخت افزار را با تعریف مناسب به حداکثر برسانید پیکربندی گروه نمونه با توجه به حافظه GPU یا RAM موجود (از ابزار Performance Analyzer برای یافتن اندازه مناسب استفاده کنید).

برای بهترین روشهای خاص MME، مراجعه کنید الگوهای میزبانی مدل در Amazon SageMaker، قسمت 3: اجرای و بهینه سازی استنتاج چند مدل با نقاط پایانی چند مدل Amazon SageMaker.

نتیجه

در این پست، ما عمیقاً به باطن PyTorch پشتیبانی شده توسط Triton Inference Server، که شتاب را برای هر دو مدل مبتنی بر CPU و GPU ارائه میکند، وارد میشویم. ما برخی از پارامترهای پیکربندی را که میتوانید برای بهینهسازی عملکرد مدل تنظیم کنید، بررسی کردیم. در نهایت، ما یک راهنما از یک نمونه دفترچه یادداشت برای نشان دادن استقرار یک استقرار نقطه پایانی چند مدل SageMaker. حتما آن را امتحان کنید!

درباره نویسنده

نیلم کوشیا یک معمار راه حل های سازمانی در AWS است. او با پیشینه ای در مهندسی نرم افزار، به طور ارگانیک به سمت معماری رفت. تمرکز فعلی او کمک به مشتریان سازمانی در سفر پذیرش ابری برای نتایج استراتژیک کسب و کار با حوزه عمق AI/ML است. او مشتاق نوآوری و شمول است. در اوقات فراغت خود از مطالعه و بیرون بودن لذت می برد.

نیلم کوشیا یک معمار راه حل های سازمانی در AWS است. او با پیشینه ای در مهندسی نرم افزار، به طور ارگانیک به سمت معماری رفت. تمرکز فعلی او کمک به مشتریان سازمانی در سفر پذیرش ابری برای نتایج استراتژیک کسب و کار با حوزه عمق AI/ML است. او مشتاق نوآوری و شمول است. در اوقات فراغت خود از مطالعه و بیرون بودن لذت می برد.

ژائو مورا یک معمار راه حل های تخصصی AI/ML در AWS، مستقر در اسپانیا است. او در آموزش مدلهای یادگیری عمیق و بهینهسازی استنتاج و ساختن پلتفرمهای ML در مقیاس بزرگ در AWS به مشتریان کمک میکند. او همچنین یکی از حامیان فعال سخت افزارهای تخصصی ML و راه حل های ML با کد پایین است.

ژائو مورا یک معمار راه حل های تخصصی AI/ML در AWS، مستقر در اسپانیا است. او در آموزش مدلهای یادگیری عمیق و بهینهسازی استنتاج و ساختن پلتفرمهای ML در مقیاس بزرگ در AWS به مشتریان کمک میکند. او همچنین یکی از حامیان فعال سخت افزارهای تخصصی ML و راه حل های ML با کد پایین است.

ویوک گانگاسانی یک معمار ارشد راه حل های یادگیری ماشین در خدمات وب آمازون است. او با استارتآپهای یادگیری ماشینی کار میکند تا برنامههای AI/ML را روی AWS بسازد و استقرار دهد. او در حال حاضر بر ارائه راهحلهایی برای MLOps، استنتاج ML و ML با کد پایین متمرکز است. او روی پروژه هایی در حوزه های مختلف از جمله پردازش زبان طبیعی و بینایی کامپیوتری کار کرده است.

ویوک گانگاسانی یک معمار ارشد راه حل های یادگیری ماشین در خدمات وب آمازون است. او با استارتآپهای یادگیری ماشینی کار میکند تا برنامههای AI/ML را روی AWS بسازد و استقرار دهد. او در حال حاضر بر ارائه راهحلهایی برای MLOps، استنتاج ML و ML با کد پایین متمرکز است. او روی پروژه هایی در حوزه های مختلف از جمله پردازش زبان طبیعی و بینایی کامپیوتری کار کرده است.

- محتوای مبتنی بر SEO و توزیع روابط عمومی. امروز تقویت شوید.

- PlatoAiStream. Web3 Data Intelligence دانش تقویت شده دسترسی به اینجا.

- ضرب کردن آینده با آدرین اشلی. دسترسی به اینجا.

- خرید و فروش سهام در شرکت های PRE-IPO با PREIPO®. دسترسی به اینجا.

- منبع: https://aws.amazon.com/blogs/machine-learning/host-ml-models-on-amazon-sagemaker-using-triton-cv-model-with-pytorch-backend/

- : دارد

- :است

- :نه

- :جایی که

- $UP

- 000

- 1

- 10

- 100

- 13

- 17

- 224

- 23

- 40

- 7

- 8

- 9

- a

- قادر

- درباره ما

- تسریع شد

- دسترسی

- مطابق

- حساب

- در میان

- فعال

- اضافه

- اضافه

- اضافی

- مدیر سایت

- اتخاذ

- اتخاذ

- مزیت - فایده - سود - منفعت

- پس از

- موافقت نامه

- AI / ML

- معرفی

- اجازه دادن

- اجازه دادن

- اجازه می دهد تا

- در امتداد

- قبلا

- همچنین

- هر چند

- آمازون

- آمازون SageMaker

- آمازون خدمات وب

- an

- و

- هر

- API

- برنامه های کاربردی

- درخواست

- مناسب

- معماری

- هستند

- محدوده

- AS

- مونتاژ

- At

- خودکار

- دسترس پذیری

- در دسترس

- اجتناب از

- AWS

- بخش مدیریت

- زمینه

- برج میزان

- مستقر

- اساس

- BE

- زیرا

- قبل از

- پشت سر

- بودن

- بهترین

- بهترین شیوه

- بهتر

- میان

- بدن

- هر دو

- گسترده

- ساختن

- بنا

- کسب و کار

- by

- ++C

- مخزن

- محاسبات

- صدا

- نام

- CAN

- قابلیت های

- ظرفیت

- جلب

- مورد

- موارد

- دسته

- علت

- معین

- تغییر دادن

- تغییر

- کانال

- مشخصات

- بار

- بررسی

- انتخاب

- طبقه بندی

- طبقه بندی کنید

- تمیز کاری

- مشتری

- ابر

- پذیرش ابر

- رمز

- سرد

- رنگ

- ترکیب

- می آید

- مقایسه

- کامل

- پیچیده

- محاسبات

- محاسبه

- کامپیوتر

- چشم انداز کامپیوتر

- محاسبه

- شرایط

- پیکر بندی

- در نظر بگیرید

- ملاحظات

- شامل

- ظرف

- ظروف

- شامل

- کنترل

- تبدیل

- متناظر

- هزینه

- ایجاد

- ایجاد شده

- ضوابط

- بسیار سخت

- جاری

- در حال حاضر

- سفارشی

- مشتریان

- داده ها

- داده محور

- تصمیم

- تصمیم گیری

- عمیق

- یادگیری عمیق

- عمیق تر

- به طور پیش فرض

- مشخص

- تعریف می کند

- تعریف کردن

- تحویل

- نشان دادن

- گسترش

- مستقر

- استقرار

- گسترش

- عمق

- طراحی

- جزئیات

- مشخص کردن

- دستگاه

- دستگاه ها

- مختلف

- تمایز دهنده

- بعد

- do

- حوزه

- آیا

- فاخته

- پایین

- دانلود

- دو

- در طی

- پویا

- هر

- اثر

- هر دو

- قادر ساختن

- را قادر می سازد

- نقطه پایانی

- موتور

- مهندسی

- موتورهای حرفه ای

- سرمایه گذاری

- محیط

- محیط

- ضروری است

- حتی

- مثال

- خارج شدن

- انتظار

- انتظارات

- انتظار می رود

- واقعیت

- منصفانه

- امکانات

- رشته

- شکل

- پرونده

- فایل ها

- سرانجام

- پیدا کردن

- پایان

- نام خانوادگی

- انعطاف پذیری

- تمرکز

- متمرکز شده است

- پیروی

- برای

- قالب

- به جلو

- یافت

- چارچوب

- چارچوب

- از جانب

- سوالات عمومی

- تولید می کنند

- دریافت کنید

- رفتن

- GitHub

- داده

- می دهد

- GPU

- GPU ها

- گراف

- نمودار ها

- گروه

- گروه ها

- سخت افزار

- آیا

- داشتن

- he

- کمک

- کمک

- کمک می کند

- او

- در سطح بالا

- خیلی

- میزبان

- میزبانی وب

- چگونه

- چگونه

- HTML

- HTTP

- HTTPS

- i

- هویت

- شناسه

- if

- تصویر

- طبقه بندی تصویر

- تصاویر

- تأثیر

- اثرات

- پیاده سازی می کند

- واردات

- واردات

- بهبود

- بهبود یافته

- in

- از جمله

- گنجاندن

- نشان دادن

- به طور جداگانه

- اطلاعات

- اول

- ابداع

- ورودی

- ورودی

- نصب

- نمونه

- دستورالعمل

- به

- مسائل

- IT

- ITS

- JIT

- سفر

- JPG

- json

- نگه داشته شد

- کلید

- نوع

- دانستن

- زبان

- در مقیاس بزرگ

- تاخیر

- راه اندازی

- طرح

- رهبری

- یاد گرفتن

- یادگیری

- کمترین

- طول

- سطح

- سطح

- کتابخانه

- پسندیدن

- فهرست

- بار

- بارگیری

- بارهای

- منطق

- منطقی

- نگاه کنيد

- به دنبال

- کم

- کاهش

- دستگاه

- فراگیری ماشین

- حفظ

- عمده

- اکثریت

- ساخت

- ساخت

- مدیریت

- بیشینه ساختن

- ممکن است..

- دیدار

- حافظه

- متاداده

- روش

- روش

- متریک

- قدرت

- ML

- MLO ها

- حالت

- مدل

- مدل

- حالت های

- مانیتور

- بیش

- اکثر

- اغلب

- نقطه پایانی چند مدل

- چندگانه

- باید

- نام

- نامگذاری

- طبیعی

- پردازش زبان طبیعی

- نیاز

- نیازهای

- منفی است

- شبکه

- شبکه

- شبکه

- شبکه های عصبی

- جدید

- نه

- دفتر یادداشت

- اکنون

- عدد

- بی حس

- کارت گرافیک Nvidia

- اشیاء

- گرفتن

- of

- on

- ONE

- فقط

- عملیات

- بهینه سازی

- بهینه سازی

- بهینه

- گزینه

- or

- سفارش

- ارگانیک

- دیگر

- ما

- خارج

- نتایج

- خارج از منزل

- تولید

- روی

- خود

- بسته

- پارامتر

- پارامترهای

- بخش

- عبور

- عبور می کند

- احساساتی

- الگوهای

- درصد

- کارایی

- انجام می دهد

- برنامه

- سکو

- سیستم عامل

- افلاطون

- هوش داده افلاطون

- PlatoData

- سیاست

- سیاست

- فقیر

- پست

- قدرت

- شیوه های

- قابل پیش بینی

- پیش بینی

- ترجیح دادن

- آماده

- اصلی

- در حال پردازش

- پروژه ها

- مناسب

- به درستی

- طرفدار

- ارائه

- ارائه

- فراهم می کند

- عمومی

- اهداف

- پــایتــون

- مارماهی

- رم

- خام

- خواندن

- مطالعه

- اماده

- زمان واقعی

- دلایل

- توصیه

- ثبت

- كاهش دادن

- تکیه

- مخزن

- نمایندگی

- نمایندگی

- نشان دهنده

- درخواست

- درخواست

- نیاز

- ضروری

- مورد نیاز

- نیاز

- پاسخ

- پاسخ

- نتیجه

- برگشت

- RGB

- راست

- نقش

- دویدن

- در حال اجرا

- حکیم ساز

- استنباط SageMaker

- همان

- ذخیره

- مقیاس گذاری

- زمان بندی

- اسکریپت

- بخش

- امن

- دیدن

- ارسال

- ارشد

- فرستاده

- جداگانه

- خدمت

- سرویس

- خدمات

- خدمت

- تنظیم

- محیط

- تنظیمات

- برپایی

- چند

- اشکال

- اشتراک گذاری

- او

- باید

- نشان داده شده

- نشان می دهد

- مشابه

- ساده

- سادگی

- به سادگی

- تنها

- اندازه

- اندازه

- کند می شود

- شرکتهای کوچک و متوسط

- So

- نرم افزار

- مهندسی نرم افزار

- مزایا

- برخی از

- فضا

- اسپانیا

- متخصص

- خاص

- مشخصات

- مشخصات

- مشخص شده

- سرعت

- خرج کردن

- شروع

- نوپا

- دولت

- وضعیت

- ثابت

- گام

- مراحل

- هنوز

- ذخیره سازی

- پرده

- ساده

- استراتژیک

- کسب و کار استراتژیک

- سخت

- ساختار

- استودیو

- موفق

- موفقیت

- چنین

- مناسب

- پشتیبانی

- پشتیبانی

- پشتیبانی از

- گرفتن

- جریان تنسور

- که

- La

- محوطه

- اطلاعات

- شان

- آنها

- سپس

- اینها

- این

- کسانی که

- سه

- از طریق

- توان

- زمان

- به

- تحمل

- ابزار

- سطح عالی

- آموزش

- دگرگون کردن

- مبدل

- تبدیل می شود

- تریتون

- درست

- امتحان

- دو

- نوع

- اساسی

- فهمیدن

- منحصر به فرد

- واحد

- آپلود شده

- استفاده

- استفاده کنید

- مورد استفاده

- استفاده

- کاربر

- استفاده

- با استفاده از

- سودمندی

- ارزش

- مختلف

- نسخه

- بسیار

- از طريق

- دید

- صبر کنيد

- خرید

- می خواهم

- مسیر..

- we

- وب

- خدمات وب

- رفت

- چی

- چه زمانی

- چه

- که

- در حین

- WHO

- ویکیپدیا

- اراده

- با

- در داخل

- بدون

- مهاجرت کاری

- مشغول به کار

- با این نسخهها کار

- بسته بندی کردن

- X

- شما

- شما

- زفیرنت

- مناطق