در عصر داده های بزرگ و هوش مصنوعی، شرکت ها به طور مداوم به دنبال راه هایی برای استفاده از این فناوری ها برای به دست آوردن مزیت رقابتی هستند. یکی از داغ ترین حوزه های هوش مصنوعی در حال حاضر، هوش مصنوعی مولد است و دلیل خوبی هم دارد. هوش مصنوعی مولد راهحلهای قدرتمندی را ارائه میکند که از نظر خلاقیت و نوآوری، مرزهای ممکن را افزایش میدهد. در هسته این راه حل های پیشرفته، یک مدل پایه (FM) نهفته است، یک مدل یادگیری ماشینی بسیار پیشرفته که از قبل بر روی حجم وسیعی از داده ها آموزش دیده است. بسیاری از این مدلهای پایه توانایی قابلتوجهی در درک و تولید متنهای انسانمانند از خود نشان دادهاند که آنها را به ابزاری ارزشمند برای کاربردهای مختلف، از تولید محتوا گرفته تا اتوماسیون پشتیبانی مشتری تبدیل میکند.

با این حال، این مدل ها بدون چالش نیستند. آنها فوق العاده بزرگ هستند و برای آموزش به داده ها و منابع محاسباتی زیادی نیاز دارند. علاوه بر این، بهینه سازی فرآیند آموزش و کالیبره کردن پارامترها می تواند یک فرآیند پیچیده و تکراری باشد که نیاز به تخصص و آزمایش دقیق دارد. اینها می تواند موانعی برای بسیاری از سازمان هایی باشد که به دنبال ایجاد مدل های بنیادی خود هستند. برای غلبه بر این چالش، بسیاری از مشتریان به دنبال تنظیم دقیق مدل های فونداسیون موجود هستند. این یک تکنیک محبوب برای تنظیم بخش کوچکی از پارامترهای مدل برای برنامههای خاص است و در عین حال همچنان دانش کدگذاری شده در مدل را حفظ میکند. این به سازمانها اجازه میدهد تا از قدرت این مدلها استفاده کنند و در عین حال منابع مورد نیاز برای سفارشیسازی به یک دامنه یا کار خاص را کاهش دهند.

دو رویکرد اصلی برای مدلهای فونداسیون تنظیم دقیق وجود دارد: تنظیم دقیق سنتی و تنظیم دقیق پارامترها. تنظیم دقیق سنتی شامل به روز رسانی تمام پارامترهای مدل از پیش آموزش دیده برای یک کار پایین دستی خاص است. از سوی دیگر، تنظیم دقیق پارامتر کارآمد شامل تکنیکهای مختلفی است که امکان سفارشیسازی یک مدل را بدون بهروزرسانی تمام پارامترهای مدل اصلی فراهم میکند. یکی از این تکنیکها سازگاری با رتبه پایین (LoRA) نام دارد. این شامل اضافه کردن ماژول های کوچک و مختص کار به مدل از پیش آموزش دیده و آموزش آنها و در عین حال ثابت نگه داشتن بقیه پارامترها همانطور که در تصویر زیر نشان داده شده است.

منبع: هوش مصنوعی مولد در AWS (O'Reilly، 2023)

LoRA اخیراً به دلایل مختلفی محبوبیت پیدا کرده است. آموزش سریعتر، کاهش نیاز به حافظه و توانایی استفاده مجدد از مدلهای از پیش آموزشدیدهشده برای چندین کار پاییندستی را ارائه میدهد. مهمتر از آن، مدل پایه و آداپتور را می توان به طور جداگانه ذخیره کرد و در هر زمان با هم ترکیب کرد و ذخیره، توزیع و به اشتراک گذاری نسخه های تنظیم شده را آسان تر می کند. با این حال، این یک چالش جدید را معرفی میکند: نحوه مدیریت صحیح این نوع جدید از مدلهای تنظیمشده. آیا باید مدل پایه و آداپتور را ترکیب کنید یا آنها را جدا نگه دارید؟ در این پست، بهترین روشها را برای مدیریت مدلهای تنظیمشده LoRA روی آنها مرور میکنیم آمازون SageMaker برای پرداختن به این سوال نوظهور

کار با FM ها در SageMaker Model Registry

در این پست، نمونهای از تنظیم دقیق مدل زبان بزرگ Llama2 (LLM) با استفاده از روش QLoRA را مرور میکنیم. QLoRA مزایای تنظیم دقیق پارامترها را با کوانتیزاسیون 4 بیتی/8 بیتی ترکیب می کند تا منابع مورد نیاز برای تنظیم دقیق یک FM برای یک کار خاص یا مورد استفاده را کاهش دهد. برای این کار، از مدل Llama7 با پارامتر 2 میلیاردی از پیش آموزشدیده استفاده میکنیم و آن را روی مجموعه داده databricks-dolly-15k تنظیم میکنیم. LLMهایی مانند Llama2 میلیاردها پارامتر دارند و روی مجموعه داده های متنی عظیم از قبل آموزش داده شده اند. تنظیم دقیق یک LLM را با استفاده از یک مجموعه داده کوچکتر با یک کار پایین دستی تطبیق می دهد. با این حال، تنظیم دقیق مدل های بزرگ از نظر محاسباتی گران است. به همین دلیل است که از روش QLoRA برای کمی کردن وزن ها در حین تنظیم دقیق استفاده می کنیم تا این هزینه محاسباتی کاهش یابد.

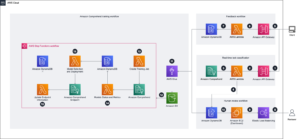

در مثال های ما، دو دفترچه یادداشت (llm-finetune-combined-with-registry.ipynb و llm-finetune-separate-with-registry.ipynb). همانطور که در نمودار زیر نشان داده شده است، هر کدام از روشهای متفاوتی برای مدیریت مدلهای تنظیمشده LoRA کار میکنند:

- ابتدا مدل Llama2 از پیش آموزش دیده با ۷ میلیارد پارامتر را با استفاده از SageMaker Studio Notebook دانلود می کنیم. LLMها، مانند Llama7، عملکرد پیشرفتهای را در وظایف پردازش زبان طبیعی (NLP) هنگام تنظیم دقیق دادههای دامنه خاص نشان دادهاند.

- در مرحله بعد، Llama2 را روی مجموعه داده databricks-dolly-15k با استفاده از روش QLoRA تنظیم می کنیم. QLoRA هزینه محاسباتی تنظیم دقیق را با کمی کردن وزن مدل کاهش می دهد.

- در طول تنظیم دقیق، ما SageMaker Experiments Plus را با Transformers API ادغام می کنیم تا به طور خودکار معیارهایی مانند گرادیان، از دست دادن و غیره را ثبت کنیم.

- سپس مدل Llama2 تنظیم شده را در SageMaker Model Registry با استفاده از دو رویکرد نسخه می کنیم:

- ذخیره سازی مدل کامل

- آداپتور و مدل پایه را جداگانه ذخیره کنید.

- در نهایت، ما مدلهای Llama2 با تنظیم دقیق را با استفاده از سرویسدهی کتابخانه عمیق جاوا (DJL) در یک نقطه پایانی بلادرنگ SageMaker میزبانی میکنیم.

در بخشهای بعدی، به هر یک از این مراحل عمیقتر خواهیم پرداخت تا انعطافپذیری SageMaker برای گردشهای کاری مختلف LLM و اینکه چگونه این ویژگیها میتوانند به بهبود عملکرد مدلهای شما کمک کنند، نشان میدهیم.

پیش نیازها

برای شروع آزمایش کد، پیش نیازهای زیر را کامل کنید.

- ایجاد یک دامنه SageMaker Studio: Amazon SageMaker Studio، به ویژه استودیو نوت بوک، برای شروع کار تنظیم دقیق Llama2 و سپس ثبت نام و مشاهده مدل ها در داخل استفاده می شود. رجیستری مدل SageMaker. آزمایش های SageMaker همچنین برای مشاهده و مقایسه سیاهههای کار تنظیم دقیق Llama2 (از دست دادن آموزش / از دست دادن آزمایش / غیره) استفاده می شود.

- یک سطل سرویس ذخیره سازی ساده آمازون (S3) ایجاد کنید: دسترسی به سطل S3 برای ذخیره مصنوعات آموزشی و وزنه های مدل مورد نیاز است. برای دستورالعمل، مراجعه کنید ایجاد یک سطل. کد نمونه استفاده شده برای این پست از سطل S3 پیشفرض SageMaker استفاده میکند، اما میتوانید آن را برای استفاده از هر سطل S3 مربوطه سفارشی کنید.

- مجموعههای مدل را راهاندازی کنید (مجوزهای IAM): نقش اجرای SageMaker خود را با مجوزهایی برای گروههای منبع بهروزرسانی کنید که در زیر فهرست شده است. راهنمای توسعه دهنده مجموعه های رجیستری مدل برای پیاده سازی گروه بندی رجیستری مدل با استفاده از مجموعه های مدل.

- شرایط و ضوابط Llama2 را بپذیرید: برای استفاده از مدل پایه Llama2 باید قرارداد مجوز کاربر نهایی و خط مشی استفاده قابل قبول را بپذیرید.

نمونه ها در دسترس هستند مخزن GitHub. فایلهای نوتبوک با استفاده از نوتبوکهای استودیو که روی هسته PyTorch 2.0.0 Python 3.10 GPU Optimized و نوع نمونه ml.g4dn.xlarge اجرا میشوند، آزمایش میشوند.

آزمایشها بهعلاوه ادغام پاسخ به تماس

آزمایشات آمازون SageMaker به شما امکان میدهد آزمایشهای یادگیری ماشین (ML) را سازماندهی، ردیابی، مقایسه و ارزیابی کنید و نسخههای مدلسازی را از هر محیط توسعه یکپارچه (IDE)، از جمله نوتبوکهای محلی Jupyter، با استفاده از SageMaker Python SDK یا boto3 انجام دهید. این انعطافپذیری را برای ثبت معیارهای مدل، پارامترها، فایلها، مصنوعات، نمودارهای نمودار از معیارهای مختلف، گرفتن ابردادههای مختلف، جستجو در میان آنها و پشتیبانی از تکرارپذیری مدل شما فراهم میکند. دانشمندان داده می توانند به سرعت عملکرد و فراپارامترها را برای ارزیابی مدل از طریق نمودارها و جداول بصری مقایسه کنند. آنها همچنین می توانند از SageMaker Experiments برای دانلود نمودارهای ایجاد شده استفاده کنند و ارزیابی مدل را با سهامداران خود به اشتراک بگذارند.

آموزش LLM می تواند یک فرآیند آهسته، پرهزینه و تکراری باشد. برای کاربر بسیار مهم است که آزمایش LLM را در مقیاس ردیابی کند تا از تجربه تنظیم مدل ناسازگار جلوگیری کند. API های HuggingFace Transformer به کاربران این امکان را می دهد که معیارها را در طول وظایف آموزشی از طریق ردیابی کنند پاسخگویی. Callback ها قطعات کد "فقط خواندنی" هستند که می توانند رفتار حلقه آموزشی را در PyTorch Trainer سفارشی کنند که می تواند وضعیت حلقه آموزشی را برای گزارش پیشرفت، ورود به TensorBoard یا SageMaker Experiments Plus از طریق منطق سفارشی (که به عنوان بخشی گنجانده شده است) بررسی کند. از این پایگاه کد).

میتوانید کد پاسخ به تماس SageMaker Experiments موجود در مخزن کد این پست را همانطور که در بلوک کد زیر نشان داده شده است وارد کنید:

این فراخوان به طور خودکار اطلاعات زیر را به عنوان بخشی از اجرای آموزشی در SageMaker Experiments ثبت می کند:

- پارامترهای آموزشی و فراپارامترها

- آموزش مدل و از دست دادن اعتبارسنجی در مرحله، دوره و نهایی

- مصنوعات ورودی و خروجی مدل (دادههای آموزشی، مجموعه دادههای اعتبارسنجی، مکان خروجی مدل، اشکالزدای آموزشی و موارد دیگر)

نمودار زیر نمونه هایی از نمودارهایی را نشان می دهد که می توانید با استفاده از آن اطلاعات نمایش دهید.

این به شما امکان می دهد با استفاده از ویژگی Analyze SageMaker Experiments به راحتی چندین اجرا را مقایسه کنید. میتوانید آزمایشهایی را که میخواهید مقایسه کنید انتخاب کنید، و آنها بهطور خودکار نمودارهای مقایسه را پر میکنند.

مدلهای تنظیمشده را در مجموعههای رجیستری مدل ثبت کنید

مجموعه های رجیستری مدل یک ویژگی است رجیستری مدل SageMaker که به شما امکان می دهد مدل های ثبت شده را که به یکدیگر مرتبط هستند گروه بندی کنید و آنها را در سلسله مراتب سازماندهی کنید تا قابلیت کشف مدل را در مقیاس بهبود بخشد. ما از Model Registry Collections برای پیگیری مدل پایه و انواع تنظیم شده استفاده خواهیم کرد.

روش کپی مدل کامل

روش اول مدل پایه و آداپتور LoRA را ترکیب می کند و مدل کامل تنظیم شده را ذخیره می کند. کد زیر فرآیند ادغام مدل را نشان می دهد و مدل ترکیبی را با استفاده از آن ذخیره می کند model.save_pretrained().

ترکیب آداپتور LoRA و مدل پایه در یک آرتیفکت تک مدل پس از تنظیم دقیق، مزایا و معایبی دارد. مدل ترکیبی مستقل است و می تواند به طور مستقل مدیریت و بدون نیاز به مدل پایه اصلی اجرا شود. مدل را می توان به عنوان موجودیت خود با نام نسخه که منعکس کننده مدل پایه و داده های تنظیم دقیق است، ردیابی کرد. ما می توانیم یک نامگذاری را با استفاده از base_model_name + تنظیم دقیق dataset_name برای سازماندهی گروه های مدل به صورت اختیاری، مجموعههای مدل میتوانند مدلهای اصلی و تنظیمشده را به هم مرتبط کنند، اما این ممکن است ضروری نباشد زیرا مدل ترکیبی مستقل است. قطعه کد زیر نحوه ثبت مدل تنظیم شده را به شما نشان می دهد.

برای ثبت مدل در Model Registry می توانید از برآوردگر آموزشی استفاده کنید.

از Model Registry، می توانید بسته مدل را بازیابی کرده و آن مدل را مستقیماً مستقر کنید.

با این حال، این رویکرد دارای اشکالاتی است. ترکیب مدلها منجر به ناکارآمدی ذخیرهسازی و افزونگی میشود زیرا مدل پایه در هر نسخه تنظیمشده بهخوبی تکرار میشود. همانطور که اندازه مدل و تعداد مدل های تنظیم شده افزایش می یابد، این به طور تصاعدی نیازهای ذخیره سازی را افزایش می دهد. با در نظر گرفتن مدل lama2 7b به عنوان مثال، مدل پایه تقریباً 13 گیگابایت و مدل دقیق تنظیم شده 13.6 گیگابایت است. 96 درصد از مدل باید پس از هر تنظیم دقیق کپی شود. علاوه بر این، توزیع و به اشتراک گذاری فایل های مدل بسیار بزرگ نیز دشوارتر می شود و با افزایش هزینه های انتقال و مدیریت فایل با افزایش اندازه مدل و تنظیم دقیق کارها، چالش های عملیاتی را ایجاد می کند.

روش آداپتور و پایه جدا

روش دوم بر جداسازی وزن پایه و وزن آداپتور با ذخیره آنها به عنوان اجزای مدل مجزا و بارگذاری متوالی آنها در زمان اجرا تمرکز دارد.

صرفه جویی در وزن پایه و آداپتور مانند روش Full Model Copy مزایا و معایبی دارد. یک مزیت این است که می تواند فضای ذخیره سازی را ذخیره کند. وزنه های پایه، که بزرگترین جزء یک مدل تنظیم شده هستند، فقط یک بار ذخیره می شوند و می توانند با وزنه های آداپتور دیگر که برای کارهای مختلف تنظیم شده اند، دوباره استفاده شوند. به عنوان مثال، وزن پایه Llama2-7B حدود 13 گیگابایت است، اما هر کار تنظیم دقیق فقط نیاز به ذخیره حدود 0.6 گیگابایت وزن آداپتور دارد که 95 درصد در فضا صرفه جویی می کند. مزیت دیگر این است که وزن های پایه را می توان جدا از وزن های آداپتور با استفاده از رجیستری مدل فقط وزن پایه مدیریت کرد. این میتواند برای دامنههای SageMaker که در حالت VPC فقط بدون دروازه اینترنت اجرا میشوند مفید باشد، زیرا میتوان به وزنهای پایه بدون نیاز به رفتن از طریق اینترنت دسترسی داشت.

گروه بسته مدل را برای وزن های پایه ایجاد کنید

گروه بسته مدل را برای وزنه های QLoRA ایجاد کنید

کد زیر نشان میدهد که چگونه وزنهای QLoRA را با مجموعه داده/وظیفه برچسبگذاری کنید و وزنهای دلتای تنظیمشده را در یک رجیستری مدل جداگانه ثبت کنید و وزنهای دلتا را جداگانه دنبال کنید.

قطعه زیر نمایی از رجیستری مدل را نشان می دهد که در آن مدل ها به وزن های پایه و تنظیم دقیق تقسیم می شوند.

مدیریت مدلها، مجموعههای داده و وظایف برای LLMهای بیششخصیشده میتواند به سرعت طاقتفرسا شود. مجموعههای رجیستری مدل SageMaker می تواند به شما کمک کند مدل های مرتبط را با هم گروه بندی کنید و آنها را در یک سلسله مراتب سازماندهی کنید تا قابلیت کشف مدل را بهبود بخشد. این امر ردیابی روابط بین وزن پایه، وزن آداپتور و تنظیم دقیق مجموعه داده های وظایف را آسان تر می کند. همچنین می توانید روابط و پیوندهای پیچیده ای بین مدل ها ایجاد کنید.

یک مجموعه جدید ایجاد کنید و وزن های مدل پایه خود را به این مجموعه اضافه کنید

همه وزنهای دلتا آداپتور LoRA با تنظیم دقیق خود را بر اساس وظیفه و/یا مجموعه داده به این مجموعه پیوند دهید

این منجر به یک سلسله مراتب مجموعه می شود که بر اساس نوع مدل/وظیفه و مجموعه داده مورد استفاده برای تنظیم دقیق مدل پایه به هم مرتبط می شوند.

این روش جداسازی مدل پایه و آداپتور دارای اشکالاتی است. یکی از اشکالات پیچیدگی در استقرار مدل است. از آنجایی که دو آرتیفکت مدل جداگانه وجود دارد، به جای استقرار مستقیم از Model Registry، به مراحل بیشتری برای بسته بندی مجدد مدل نیاز دارید. در مثال کد زیر، ابتدا آخرین نسخه مدل پایه را دانلود و دوباره بسته بندی کنید.

سپس جدیدترین وزنههای آداپتور LoRA با تنظیم دقیق را دانلود و دوباره بستهبندی کنید.

از آنجایی که از سرویس DJL با سرعت عمیق برای میزبانی مدل استفاده خواهید کرد، دایرکتوری استنتاج شما باید مانند زیر باشد.

در نهایت، کد استنتاج سفارشی، مدل پایه و آداپتور LoRA را در یک فایل .tar.gz برای استقرار بسته بندی کنید.

پاک کردن

با دنبال کردن دستورالعملهای موجود در بخش پاکسازی نوتبوک، منابع خود را تمیز کنید. رجوع شود به قیمت گذاری آمازون SageMaker برای جزئیات در مورد هزینه نمونه های استنتاج.

نتیجه

این پست شما را از طریق بهترین روشها برای مدیریت مدلهای تنظیمشده LoRA در Amazon SageMaker راهنمایی کرد. ما دو روش اصلی را پوشش دادیم: ترکیب وزن پایه و آداپتور در یک مدل مستقل، و جداسازی وزن پایه و آداپتور. هر دو رویکرد دارای معاوضههایی هستند، اما جدا کردن وزنها به بهینهسازی ذخیرهسازی کمک میکند و تکنیکهای مدیریت مدل پیشرفته مانند مجموعههای SageMaker Model Registry را فعال میکند. این به شما امکان می دهد سلسله مراتب و روابط بین مدل ها را برای بهبود سازماندهی و قابلیت کشف ایجاد کنید. توصیه می کنیم کد نمونه را امتحان کنید مخزن GitHub تا خودتان این روش ها را آزمایش کنید. همانطور که هوش مصنوعی مولد به سرعت پیشرفت میکند، پیروی از بهترین شیوههای مدیریت مدل به شما کمک میکند آزمایشها را ردیابی کنید، مدل مناسب را برای کار خود پیدا کنید، و LLMهای تخصصی را به طور کارآمد در مقیاس مدیریت کنید.

منابع

درباره نویسندگان

جیمز وو یک معمار ارشد راه حل متخصص AI/ML در AWS است. کمک به مشتریان در طراحی و ساخت راه حل های AI/ML. کار جیمز طیف گستردهای از موارد استفاده از ML را پوشش میدهد، با علاقه اولیه به بینایی رایانه، یادگیری عمیق، و مقیاسبندی ML در سراسر سازمان. قبل از پیوستن به AWS، جیمز بیش از 10 سال معمار، توسعهدهنده و رهبر فناوری بود، از جمله 6 سال در مهندسی و 4 سال در صنایع بازاریابی و تبلیغات.

جیمز وو یک معمار ارشد راه حل متخصص AI/ML در AWS است. کمک به مشتریان در طراحی و ساخت راه حل های AI/ML. کار جیمز طیف گستردهای از موارد استفاده از ML را پوشش میدهد، با علاقه اولیه به بینایی رایانه، یادگیری عمیق، و مقیاسبندی ML در سراسر سازمان. قبل از پیوستن به AWS، جیمز بیش از 10 سال معمار، توسعهدهنده و رهبر فناوری بود، از جمله 6 سال در مهندسی و 4 سال در صنایع بازاریابی و تبلیغات.

پراناو مورتی یک معمار راه حل های تخصصی AI/ML در AWS است. او بر کمک به مشتریان در ساخت، آموزش، استقرار و انتقال بارهای کاری یادگیری ماشینی (ML) به SageMaker تمرکز دارد. او قبلاً در صنعت نیمه هادی ها کار می کرد و مدل های بینایی کامپیوتری بزرگ (CV) و پردازش زبان طبیعی (NLP) را برای بهبود فرآیندهای نیمه هادی توسعه می داد. در اوقات فراغت از بازی شطرنج و مسافرت لذت می برد.

پراناو مورتی یک معمار راه حل های تخصصی AI/ML در AWS است. او بر کمک به مشتریان در ساخت، آموزش، استقرار و انتقال بارهای کاری یادگیری ماشینی (ML) به SageMaker تمرکز دارد. او قبلاً در صنعت نیمه هادی ها کار می کرد و مدل های بینایی کامپیوتری بزرگ (CV) و پردازش زبان طبیعی (NLP) را برای بهبود فرآیندهای نیمه هادی توسعه می داد. در اوقات فراغت از بازی شطرنج و مسافرت لذت می برد.

Mecit Gungor یک معمار راه حل تخصصی AI/ML در AWS است که به مشتریان در طراحی و ساخت راه حل های AI/ML در مقیاس کمک می کند. او طیف وسیعی از موارد استفاده از AI/ML را برای مشتریان مخابرات پوشش میدهد و در حال حاضر بر روی هوش مصنوعی، LLMها و آموزش و بهینهسازی استنتاج تمرکز دارد. او را اغلب می توان در حال پیاده روی در بیابان یا بازی های رومیزی با دوستانش در اوقات فراغت خود یافت.

Mecit Gungor یک معمار راه حل تخصصی AI/ML در AWS است که به مشتریان در طراحی و ساخت راه حل های AI/ML در مقیاس کمک می کند. او طیف وسیعی از موارد استفاده از AI/ML را برای مشتریان مخابرات پوشش میدهد و در حال حاضر بر روی هوش مصنوعی، LLMها و آموزش و بهینهسازی استنتاج تمرکز دارد. او را اغلب می توان در حال پیاده روی در بیابان یا بازی های رومیزی با دوستانش در اوقات فراغت خود یافت.

شلبی ایگنبرود یک معمار اصلی راه حل های تخصصی هوش مصنوعی و یادگیری ماشین در خدمات وب آمازون (AWS) است. او 24 سال است که در زمینه فناوری فعالیت می کند و صنایع، فناوری ها و نقش های متعددی را در بر می گیرد. او در حال حاضر بر ترکیب پیشینه DevOps و ML خود در حوزه MLOps تمرکز دارد تا به مشتریان در ارائه و مدیریت حجم کاری ML در مقیاس کمک کند. با بیش از 35 پتنت اعطا شده در حوزه های مختلف فناوری، او اشتیاق به نوآوری مداوم و استفاده از داده ها برای هدایت نتایج کسب و کار دارد. Shelbee یکی از خالقان و مربیان تخصص عملی علم داده در Coursera است. او همچنین مدیر مشترک زنان در داده های بزرگ (WiBD)، بخش دنور است. او در اوقات فراغت خود دوست دارد با خانواده، دوستان و سگ های پرکارش وقت بگذراند.

شلبی ایگنبرود یک معمار اصلی راه حل های تخصصی هوش مصنوعی و یادگیری ماشین در خدمات وب آمازون (AWS) است. او 24 سال است که در زمینه فناوری فعالیت می کند و صنایع، فناوری ها و نقش های متعددی را در بر می گیرد. او در حال حاضر بر ترکیب پیشینه DevOps و ML خود در حوزه MLOps تمرکز دارد تا به مشتریان در ارائه و مدیریت حجم کاری ML در مقیاس کمک کند. با بیش از 35 پتنت اعطا شده در حوزه های مختلف فناوری، او اشتیاق به نوآوری مداوم و استفاده از داده ها برای هدایت نتایج کسب و کار دارد. Shelbee یکی از خالقان و مربیان تخصص عملی علم داده در Coursera است. او همچنین مدیر مشترک زنان در داده های بزرگ (WiBD)، بخش دنور است. او در اوقات فراغت خود دوست دارد با خانواده، دوستان و سگ های پرکارش وقت بگذراند.

- محتوای مبتنی بر SEO و توزیع روابط عمومی. امروز تقویت شوید.

- PlatoData.Network Vertical Generative Ai. به خودت قدرت بده دسترسی به اینجا.

- PlatoAiStream. هوش وب 3 دانش تقویت شده دسترسی به اینجا.

- PlatoESG. کربن ، CleanTech، انرژی، محیط، خورشیدی، مدیریت پسماند دسترسی به اینجا.

- PlatoHealth. هوش بیوتکنولوژی و آزمایشات بالینی. دسترسی به اینجا.

- منبع: https://aws.amazon.com/blogs/machine-learning/model-management-for-lora-fine-tuned-models-using-llama2-and-amazon-sagemaker/

- : دارد

- :است

- :نه

- :جایی که

- $UP

- 10

- 100

- 11

- 12

- 13

- ٪۱۰۰

- 16

- 20

- 2023

- 23

- 24

- 25

- 28

- 31

- ٪۱۰۰

- 7

- 8

- ٪۱۰۰

- a

- توانایی

- درباره ما

- پذیرفتن

- قابل قبول

- دسترسی

- قابل دسترسی است

- در میان

- انطباق

- تطبیق می دهد

- اضافه کردن

- اضافه کردن

- اضافی

- علاوه بر این

- نشانی

- اتخاذ

- پیشرفته

- مزیت - فایده - سود - منفعت

- مزایای

- تبلیغات

- پس از

- توافق

- AI

- هوش مصنوعی درسته

- AI / ML

- معرفی

- اجازه دادن

- اجازه می دهد تا

- قبلا

- همچنین

- آمازون

- آمازون SageMaker

- Amazon SageMaker Studio

- سرویس ذخیره سازی ساده آمازون (S3)

- آمازون خدمات وب

- خدمات وب آمازون (AWS)

- مقدار

- an

- تحلیل

- و

- دیگر

- هر

- API

- برنامه های کاربردی

- روش

- رویکردها

- تایید کرد

- تقریبا

- هستند

- مناطق

- AS

- وابسته

- At

- بطور خودکار

- اتوماسیون

- در دسترس

- AWS

- به عقب

- زمینه

- موانع

- پایه

- BE

- زیرا

- شدن

- شود

- بوده

- رفتار

- مزایای

- بهترین

- بهترین شیوه

- میان

- بزرگ

- بزرگ داده

- بیلیون

- میلیاردها

- مسدود کردن

- تخته

- بازی ها و بنگاه

- هر دو

- مرز

- ساختن

- کسب و کار

- اما

- by

- تماس با ما

- نام

- CAN

- قابلیت

- گرفتن

- دقیق

- مورد

- موارد

- به چالش

- چالش ها

- فصل

- نمودار

- شطرنج

- کلاس

- واضح

- رمز

- پایه کد

- مجموعه

- مجموعه

- ترکیب

- ترکیب شده

- ترکیب

- ترکیب

- شرکت

- مقايسه كردن

- مقایسه

- رقابتی

- پیچیده

- پیچیدگی

- جزء

- اجزاء

- محاسبه

- محاسباتی

- کامپیوتر

- چشم انداز کامپیوتر

- شرایط

- با توجه به

- محتوا

- تولید محتوا

- به طور مستمر

- مداوم

- هسته

- هزینه

- میتوانست

- پوشش داده شده

- را پوشش می دهد

- ایجاد

- ایجاد شده

- ایجاد

- خلاقیت

- در حال حاضر

- سفارشی

- مشتری

- پشتیبانی مشتریان

- مشتریان

- سفارشی سازی

- سفارشی

- لبه برش

- داده ها

- علم اطلاعات

- مجموعه داده ها

- عمیق

- یادگیری عمیق

- عمیق تر

- به طور پیش فرض

- از

- ارائه

- دلتا

- نشان دادن

- دنور

- گسترش

- مستقر

- استقرار

- گسترش

- طرح

- جزئیات

- توسعه دهنده

- در حال توسعه

- پروژه

- مختلف

- مشکل

- مستقیما

- نمایش دادن

- توزیع کردن

- توزیع

- شیرجه رفتن

- دامنه

- حوزه

- دانلود

- اشکالاتی

- راندن

- در طی

- هر

- آسان تر

- به آسانی

- لبه

- موثر

- موثر

- دیگر

- سنگ سنباده

- را قادر می سازد

- تشویق

- پشت سر هم

- نقطه پایانی

- مهندسی

- سرمایه گذاری

- موجودیت

- محیط

- دوره

- عصر

- و غیره

- ارزیابی

- ارزیابی

- مثال

- مثال ها

- به طور انحصاری

- اعدام

- موجود

- گران

- تجربه

- تجربه

- آزمایش

- تخصص

- نمایی

- چهره

- شکست

- خانواده

- سریعتر

- ویژگی

- امکانات

- پرونده

- فایل ها

- پیدا کردن

- پایان

- نام خانوادگی

- ثابت

- انعطاف پذیری

- تمرکز

- تمرکز

- پیروی

- برای

- یافت

- پایه

- رایگان

- دوستان

- از جانب

- کامل

- تابع

- بیشتر

- آینده

- افزایش

- به دست آورد

- بازیها

- دروازه

- مولد

- مولد

- هوش مصنوعی مولد

- Go

- رفتن

- خوب

- GPU

- اعطا شده

- گراف

- نمودار ها

- گروه

- گروه ها

- دست

- دسته

- آیا

- داشتن

- he

- کمک

- کمک

- کمک می کند

- او

- سلسله مراتب

- خیلی

- خود را

- میزبان

- داغترین

- چگونه

- چگونه

- اما

- HTML

- HTTPS

- صورت در آغوش گرفته

- نشان می دهد

- تصویر

- انجام

- پیاده سازی

- واردات

- مهم

- مهمتر

- واردات

- بهبود

- in

- مشمول

- شامل

- از جمله

- افزایش

- افزایش

- افزایش

- مستقل

- به طور مستقل

- لوازم

- صنعت

- بی کفایتی

- باد می کند

- اطلاعات

- ابداع

- ورودی

- نمونه

- در عوض

- دستورالعمل

- ادغام

- یکپارچه

- علاقه

- اینترنت

- به

- معرفی می کند

- IT

- ITS

- جیمز

- جاوه

- کار

- شغل ها

- پیوستن

- JPG

- نگاه داشتن

- نگهداری

- کلید

- پا زدن

- دانش

- زبان

- بزرگ

- بزرگترین

- آخرین

- رهبر

- منجر می شود

- یادگیری

- اجازه می دهد تا

- سطح

- کتابخانه

- مجوز

- نهفته است

- پسندیدن

- دوست دارد

- ارتباط دادن

- مرتبط

- ذکر شده

- LLM

- بار

- بارگیری

- محلی

- محل

- ورود به سیستم

- ورود به سیستم

- منطق

- نگاه کنيد

- شبیه

- به دنبال

- خاموش

- دستگاه

- فراگیری ماشین

- اصلی

- باعث می شود

- ساخت

- مدیریت

- اداره می شود

- مدیریت

- مدیریت

- بسیاری

- بازار یابی (Marketing)

- بازاریابی و تبلیغات

- عظیم

- ممکن است..

- حافظه

- ادغام کردن

- ادغام

- متاداده

- روش

- روش

- متریک

- مهاجرت

- ML

- MLO ها

- حالت

- مدل

- مدل

- ماژول ها

- بیش

- چندگانه

- نام

- طبیعی

- پردازش زبان طبیعی

- لازم

- نیاز

- نیازمند

- نیازهای

- جدید

- nlp

- دفتر یادداشت

- اکنون

- عدد

- of

- خاموش

- پیشنهادات

- غالبا

- on

- یک بار

- ONE

- فقط

- قابل استفاده

- عملیات

- بهینه سازی

- بهینه سازی

- بهینه

- بهینه سازی

- or

- کدام سازمان ها

- سازمان های

- اصلی

- دیگر

- ما

- نتایج

- تولید

- روی

- غلبه بر

- قریب به اتفاق

- خود

- بسته

- پارامتر

- پارامترهای

- بخش

- شور

- اختراعات

- مسیر

- در صد

- کارایی

- مجوز

- قطعات

- افلاطون

- هوش داده افلاطون

- PlatoData

- بازی

- به علاوه

- سیاست

- محبوب

- محبوبیت

- بخشی

- ممکن

- پست

- قدرت

- قوی

- عملی

- شیوه های

- پیش نیازها

- هدیه

- حفظ کردن

- جلوگیری از

- قبلا

- اصلی

- اصلی

- قبلا

- روند

- فرآیندهای

- در حال پردازش

- پیشرفت

- به درستی

- املاک

- فراهم می کند

- فشار

- پــایتــون

- مارماهی

- سوال

- به سرعت

- محدوده

- سریعا

- زمان واقعی

- دلیل

- دلایل

- تازه

- كاهش دادن

- کاهش

- را کاهش می دهد

- کاهش

- مراجعه

- بازتاب

- ثبت نام

- ثبت نام

- رجیستری

- مربوط

- روابط

- مربوط

- قابل توجه

- گزارش

- مخزن

- نیاز

- ضروری

- مورد نیاز

- منابع

- REST

- نتیجه

- استفاده مجدد

- راست

- نقش

- نقش

- دویدن

- در حال اجرا

- اجرا می شود

- زمان اجرا

- حکیم ساز

- ذخیره

- نگهداری می شود

- صرفه جویی کردن

- پس انداز

- مقیاس

- مقیاس گذاری

- علم

- دانشمندان

- sdk

- جستجو

- دوم

- بخش

- بخش

- به دنبال

- نیمه هادی

- ارشد

- جداگانه

- جدا کردن

- سرویس

- خدمات

- خدمت

- چند

- اشتراک گذاری

- اشتراک

- او

- باید

- نشان داده شده

- نشان می دهد

- مشابه

- ساده

- پس از

- تنها

- اندازه

- کند

- کوچک

- کوچکتر

- قطعه

- راه حل

- مزایا

- برخی از

- منبع

- فضا

- تنش

- متخصص

- تخصصی

- خاص

- به طور خاص

- خرج کردن

- انشعاب

- سهامداران

- شروع

- دولت

- وضعیت هنر

- وضعیت

- گام

- مراحل

- هنوز

- ذخیره سازی

- opbevare

- ذخیره شده

- استودیو

- چنین

- پشتیبانی

- TAG

- مصرف

- کار

- وظایف

- تکنیک

- تکنیک

- فن آوری

- پیشرفته

- ارتباط از راه دور

- قوانین و مقررات

- آزمایش

- متن

- که

- La

- شان

- آنها

- سپس

- آنجا.

- اینها

- آنها

- این

- از طریق

- زمان

- به

- با هم

- ابزار

- مشعل

- مسیر

- سنتی

- قطار

- آموزش

- انتقال

- ترانسفورماتور

- ترانسفورماتور

- سفر

- درست

- امتحان

- اهنگ

- کوک شده

- میزان سازی

- دو

- نوع

- انواع

- زیر

- درک

- بروزرسانی

- به روز رسانی

- آپلود شده

- URL

- استفاده کنید

- مورد استفاده

- استفاده

- کاربر

- کاربران

- با استفاده از

- اعتبار سنجی

- ارزشمند

- ارزش

- تنوع

- مختلف

- وسیع

- نسخه

- نسخه

- بسیار

- از طريق

- چشم انداز

- دید

- بصری

- راه رفتن

- راه می رفت

- می خواهم

- بود

- مسیر..

- راه

- we

- وب

- خدمات وب

- چه زمانی

- که

- در حین

- چرا

- وسیع

- دامنه گسترده

- اراده

- با

- در داخل

- بدون

- زنان

- مهاجرت کاری

- مشغول به کار

- گردش کار

- با این نسخهها کار

- سال

- شما

- شما

- خودت

- زفیرنت