آمازون SageMaker نقاط پایانی چند مدلی (MME) یک قابلیت کاملاً مدیریت شده از استنتاج SageMaker است که به شما امکان می دهد هزاران مدل را در یک نقطه پایانی واحد استقرار دهید. پیش از این، MMEها به طور از پیش تعیین شده قدرت محاسباتی CPU را بدون توجه به بار ترافیک مدل، به صورت ایستا به مدل ها اختصاص می دادند. سرور چند مدل (MMS) به عنوان سرور مدل آن در این پست، راهحلی را مورد بحث قرار میدهیم که در آن یک MME میتواند به صورت پویا توان محاسباتی اختصاص داده شده به هر مدل را بر اساس الگوی ترافیک مدل تنظیم کند. این راه حل شما را قادر می سازد تا از محاسبات زیربنایی MME ها به طور موثرتری استفاده کنید و در هزینه ها صرفه جویی کنید.

MMEها به صورت پویا مدل ها را بر اساس ترافیک ورودی به نقطه پایانی بارگیری و تخلیه می کنند. هنگامی که از MMS به عنوان سرور مدل استفاده می شود، MMEها تعداد ثابتی از کارگران مدل را برای هر مدل اختصاص می دهند. برای اطلاعات بیشتر مراجعه کنید الگوهای میزبانی مدل در Amazon SageMaker، قسمت 3: اجرای و بهینه سازی استنتاج چند مدل با نقاط پایانی چند مدل Amazon SageMaker.

با این حال، زمانی که الگوی ترافیک شما متغیر است، این می تواند منجر به مشکلاتی شود. فرض کنید شما یک مدل یا چند مدل دارید که حجم زیادی از ترافیک دریافت می کند. شما میتوانید MMS را برای تخصیص تعداد زیادی کارگر برای این مدلها پیکربندی کنید، اما این به همه مدلهای پشت MME اختصاص داده میشود، زیرا یک پیکربندی ثابت است. این منجر به استفاده تعداد زیادی از کارگران از محاسبات سخت افزاری می شود - حتی مدل های بیکار. اگر مقدار کمی برای تعداد کارگران تعیین کنید، مشکل برعکس ممکن است رخ دهد. مدلهای محبوب، کارگران کافی در سطح سرور مدل برای تخصیص صحیح سختافزار کافی در پشت نقطه پایانی برای این مدلها ندارند. مسئله اصلی این است که اگر نتوانید به صورت پویا کارگران خود را در سطح سرور مدل برای تخصیص مقدار لازم محاسبات، مقیاس بندی کنید، مشکل است که الگوی ترافیک را ناشناس باقی بمانید.

راه حلی که در این پست به آن اشاره می کنیم از آن استفاده می کند سرویس DJLS بهعنوان سرور مدل، که میتواند به کاهش برخی از مسائلی که در مورد آنها بحث کردیم کمک کند و مقیاسبندی هر مدل را فعال کند و MMEها را قادر میسازد تا الگوی ترافیک را ناشناس باشند.

معماری MME

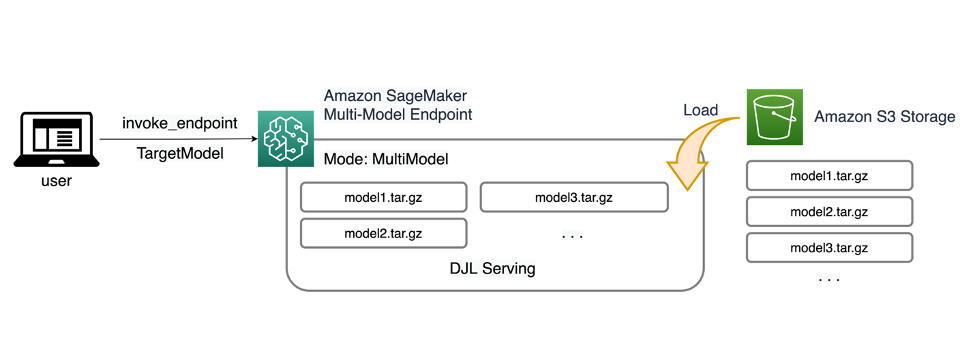

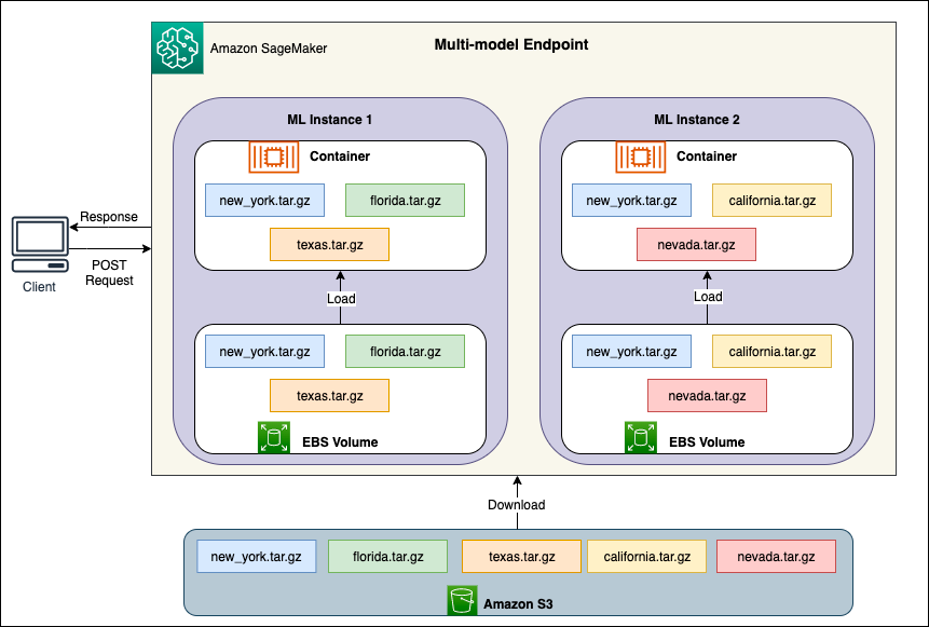

SageMaker MME به شما امکان می دهد چندین مدل را در پشت یک نقطه پایان استنتاج که ممکن است شامل یک یا چند نمونه باشد، مستقر کنید. هر نمونه برای بارگیری و سرویس دهی چندین مدل تا ظرفیت حافظه و CPU/GPU طراحی شده است. با این معماری، یک کسب و کار نرم افزار به عنوان سرویس (SaaS) می تواند هزینه های خطی در حال افزایش میزبانی مدل های متعدد را بشکند و به استفاده مجدد از زیرساخت منطبق با مدل چند اجاره ای اعمال شده در جاهای دیگر در پشته برنامه دست یابد. نمودار زیر این معماری را نشان می دهد.

SageMaker MME به صورت پویا مدل ها را بارگیری می کند سرویس ذخیره سازی ساده آمازون (Amazon S3) در هنگام فراخوانی، به جای دانلود همه مدل ها هنگام ایجاد نقطه پایانی برای اولین بار. در نتیجه، فراخوانی اولیه به یک مدل ممکن است تأخیر استنتاج بالاتری نسبت به استنتاجهای بعدی داشته باشد که با تأخیر کم تکمیل میشوند. اگر مدل در هنگام فراخوانی از قبل روی کانتینر بارگذاری شده باشد، مرحله دانلود نادیده گرفته میشود و مدل استنتاجها را با تأخیر کم برمیگرداند. به عنوان مثال، فرض کنید مدلی دارید که فقط چند بار در روز استفاده می شود. این به طور خودکار در صورت تقاضا بارگذاری می شود، در حالی که مدل هایی که اغلب به آنها دسترسی دارند در حافظه نگهداری می شوند و با تأخیر به طور مداوم کم فراخوانی می شوند.

همانطور که در نمودار زیر نشان داده شده است، در پشت هر MME نمونه های میزبانی مدل قرار دارند. این نمونه ها چندین مدل را بر اساس الگوهای ترافیکی به مدل ها بارگذاری و از حافظه خارج می کنند.

SageMaker به مسیریابی درخواستهای استنتاج برای یک مدل به نمونهای که مدل قبلاً بارگذاری شده است ادامه میدهد، به طوری که درخواستها از یک کپی مدل حافظه پنهان ارائه میشوند (نمودار زیر را ببینید، که مسیر درخواست اولین درخواست پیشبینی در مقابل پیشبینی ذخیرهشده را نشان میدهد. مسیر درخواست). با این حال، اگر مدل درخواستهای فراخوانی زیادی دریافت کند، و نمونههای اضافی برای MME وجود داشته باشد، SageMaker برخی از درخواستها را به نمونه دیگری هدایت میکند تا با افزایش سازگار شود. برای استفاده از مقیاس خودکار مدل در SageMaker، مطمئن شوید که دارید تنظیم مقیاس خودکار برای مثال برای تامین ظرفیت نمونه اضافی. خطمشی مقیاسبندی سطح نقطه پایانی خود را با پارامترهای سفارشی یا فراخوانی در دقیقه (توصیه میشود) تنظیم کنید تا نمونههای بیشتری به ناوگان نقطه پایانی اضافه کنید.

نمای کلی سرور مدل

سرور مدل یک جزء نرم افزاری است که یک محیط زمان اجرا برای استقرار و ارائه مدل های یادگیری ماشینی (ML) فراهم می کند. این به عنوان یک رابط بین مدل های آموزش دیده و برنامه های مشتری که می خواهند با استفاده از آن مدل ها پیش بینی کنند، عمل می کند.

هدف اصلی یک سرور مدل، اجازه دادن به یکپارچه سازی بدون زحمت و استقرار کارآمد مدل های ML در سیستم های تولید است. به جای تعبیه مستقیم مدل در یک برنامه کاربردی یا یک چارچوب خاص، سرور مدل یک پلت فرم متمرکز را فراهم می کند که در آن چندین مدل می توانند مستقر، مدیریت و ارائه شوند.

سرورهای مدل معمولاً عملکردهای زیر را ارائه می دهند:

- بارگذاری مدل - سرور مدل های آموزش دیده ML را در حافظه بارگذاری می کند و آنها را برای پیش بینی های ارائه شده آماده می کند.

- Inference API - سرور یک API را نشان می دهد که به برنامه های کاربردی سرویس گیرنده اجازه می دهد داده های ورودی را ارسال کرده و پیش بینی ها را از مدل های مستقر دریافت کنند.

- مقیاس گذاری - سرورهای مدل برای رسیدگی به درخواست های همزمان از چندین مشتری طراحی شده اند. آنها مکانیسم هایی را برای پردازش موازی و مدیریت کارآمد منابع برای اطمینان از توان عملیاتی بالا و تأخیر کم ارائه می دهند.

- ادغام با موتورهای باطن - سرورهای مدل با فریم ورکهای باطنی مانند DeepSpeed و FasterTransformer ادغام میشوند تا مدلهای بزرگ را پارتیشن بندی کنند و استنتاج بسیار بهینهشده را اجرا کنند.

معماری DJL

سرویس DJL یک سرور منبع باز، با کارایی بالا و مدل جهانی است. سرویس DJL در بالای آن ساخته شده است Djlیک کتابخانه یادگیری عمیق که به زبان برنامه نویسی جاوا نوشته شده است. میتواند یک مدل یادگیری عمیق، چندین مدل یا گردش کار گرفته و آنها را از طریق یک نقطه پایانی HTTP در دسترس قرار دهد. سرویس DJL از استقرار مدلها از فریمورکهای متعدد مانند PyTorch، TensorFlow، Apache MXNet، ONNX، TensorRT، Hugging Face Transformers، DeepSpeed، FasterTransformer و غیره پشتیبانی میکند.

سرویس DJL ویژگی های زیادی را ارائه می دهد که به شما امکان می دهد مدل های خود را با کارایی بالا مستقر کنید:

- سهولت استفاده – DJL Serving می تواند بیشتر مدل ها را به صورت خارج از جعبه ارائه دهد. فقط مصنوعات مدل را بیاورید و سرویس DJL می تواند آنها را میزبانی کند.

- پشتیبانی از چندین دستگاه و شتاب دهنده – DJL Serving از استقرار مدل ها بر روی CPU، GPU و استنتاج AWS.

- عملکرد - سرویس DJL استنتاج چند رشته ای را در یک JVM اجرا می کند تا توان عملیاتی را افزایش دهد.

- دسته بندی پویا - سرویس DJL از دسته بندی پویا برای افزایش توان پشتیبانی می کند.

- مقیاس بندی خودکار - سرویس DJL به طور خودکار کارگران را بر اساس بار ترافیکی بالا و پایین می کند.

- پشتیبانی از چند موتور – سرویس DJL می تواند به طور همزمان مدل ها را با استفاده از چارچوب های مختلف (مانند PyTorch و TensorFlow) میزبانی کند.

- مدل های مجموعه و گردش کار – سرویس DJL از استقرار گردشهای کاری پیچیده متشکل از مدلهای متعدد پشتیبانی میکند و بخشهایی از گردش کار را روی CPU و بخشهایی را روی GPU اجرا میکند. مدلهای درون یک گردش کار میتوانند از چارچوبهای مختلفی استفاده کنند.

به ویژه، ویژگی مقیاس خودکار DJL Serving اطمینان از مقیاس بندی مناسب مدل ها برای ترافیک ورودی را آسان می کند. بهطور پیشفرض، DJL Serving حداکثر تعداد کارگران را برای مدلی که میتواند بر اساس سختافزار موجود (هستههای CPU، دستگاههای GPU) پشتیبانی شود، تعیین میکند. میتوانید برای هر مدل کرانهای پایینتر و بالایی را تعیین کنید تا مطمئن شوید که حداقل سطح ترافیک همیشه میتواند ارائه شود و یک مدل واحد تمام منابع موجود را مصرف نمیکند.

سرویس DJL از a Netty جلویی در بالای استخرهای نخ کارگر باطن. فرانتاند از یک راهاندازی Netty با چندگانه استفاده میکند HttpRequestHandlers. کنترلکنندههای درخواستهای مختلف، از آن پشتیبانی میکنند Inference API, مدیریت API، یا سایر API های موجود از پلاگین های مختلف.

پشتیبان حول محور است WorkLoadManager ماژول (WLM). WLM از چندین رزوه کارگر برای هر مدل به همراه بچینگ و درخواست مسیریابی به آنها مراقبت می کند. هنگامی که چندین مدل ارائه می شود، WLM ابتدا اندازه صف درخواست استنتاج هر مدل را بررسی می کند. اگر اندازه صف بزرگتر از دو برابر اندازه دسته ای یک مدل باشد، WLM تعداد کارگران اختصاص داده شده به آن مدل را افزایش می دهد.

بررسی اجمالی راه حل

اجرای DJL با MME با تنظیم پیش فرض MMS متفاوت است. برای سرویس DJL با یک MME، فایلهای زیر را با فرمت model.tar.gz که SageMaker Inference انتظار دارد فشرده میکنیم:

- model.joblib - برای این پیاده سازی، ما به طور مستقیم فراداده مدل را به تاربال فشار می دهیم. در این مورد، ما در حال کار با a

.joblibفایل، بنابراین ما آن فایل را در تاربال خود برای خواندن اسکریپت استنتاج خود ارائه می کنیم. اگر مصنوع بیش از حد بزرگ است، میتوانید آن را به Amazon S3 نیز فشار دهید و در پیکربندی سرویسی که برای DJL تعریف کردهاید، به آن اشاره کنید. - خدمت.خواص - در اینجا می توانید هر مدلی را که مربوط به سرور است پیکربندی کنید متغیرهای محیطی. قدرت DJL در اینجا این است که می توانید پیکربندی کنید

minWorkersوmaxWorkersبرای هر مدل تربال این به هر مدل اجازه میدهد تا در سطح سرور مدل، بزرگتر و پایینتر شود. به عنوان مثال، اگر یک مدل منفرد بیشتر ترافیک یک MME را دریافت کند، سرور مدل کارگران را به صورت پویا افزایش می دهد. در این مثال، ما این متغیرها را پیکربندی نمیکنیم و به DJL اجازه میدهیم تعداد کارگران لازم را بسته به الگوی ترافیک ما تعیین کند. - model.py - این اسکریپت استنتاج برای هر پیش پردازش یا پس پردازش سفارشی است که می خواهید پیاده سازی کنید. model.py انتظار دارد که منطق شما به طور پیشفرض در یک متد handle کپسوله شود.

- requires.txt (اختیاری) – به طور پیشفرض، DJL با PyTorch نصب میشود، اما هر وابستگی اضافی که نیاز دارید را میتوانید در اینجا فشار دهید.

برای این مثال، ما قدرت DJL را با یک MME با نمونه برداری از مدل SKLearn به نمایش می گذاریم. ما یک کار آموزشی با این مدل اجرا می کنیم و سپس 1,000 نسخه از این مصنوع مدل را برای پشتیبان MME خود ایجاد می کنیم. سپس نشان میدهیم که چگونه DJL میتواند به صورت پویا مقیاسبندی کند تا هر نوع الگوی ترافیکی را که MME شما ممکن است دریافت کند، مدیریت کند. این می تواند شامل توزیع یکنواخت ترافیک در همه مدل ها یا حتی چند مدل محبوب باشد که اکثریت ترافیک را دریافت می کنند. شما می توانید تمام کدها را در ادامه مطلب پیدا کنید GitHub repo.

پیش نیازها

برای این مثال، ما از یک نمونه نوت بوک SageMaker با هسته conda_python3 و نمونه ml.c5.xlarge استفاده می کنیم. برای انجام تست های بار می توانید از یک ابر محاسبه الاستیک آمازون نمونه (Amazon EC2) یا نمونه بزرگتر نوت بوک SageMaker. در این مثال، ما به بیش از هزار تراکنش در ثانیه (TPS) مقیاس میدهیم، بنابراین پیشنهاد میکنیم یک نمونه EC2 سنگینتر مانند ml.c5.18xlarge را آزمایش کنید تا محاسبات بیشتری برای کار کردن داشته باشید.

یک مصنوع مدل ایجاد کنید

ابتدا باید مصنوعات مدل و داده هایی را که در این مثال استفاده می کنیم ایجاد کنیم. برای این مورد، ما برخی از داده های مصنوعی را با NumPy تولید می کنیم و با استفاده از یک مدل رگرسیون خطی SKLearn با قطعه کد زیر آموزش می دهیم:

پس از اجرای کد قبلی، باید a داشته باشید model.joblib فایل ایجاد شده در محیط محلی شما

تصویر DJL Docker را بکشید

Docker image djl-inference:0.23.0-cpu-full-v1.0 ظرف سرویس دهی DJL ما است که در این مثال استفاده شده است. می توانید URL زیر را بسته به منطقه خود تنظیم کنید:

inference_image_uri = "474422712127.dkr.ecr.us-east-1.amazonaws.com/djl-serving-cpu:latest"

در صورت تمایل، میتوانید از این تصویر به عنوان تصویر پایه نیز استفاده کنید و آن را گسترش دهید تا تصویر Docker خود را روی آن بسازید رجیستری ظروف الاستیک آمازون (Amazon ECR) با هر وابستگی دیگری که نیاز دارید.

فایل مدل را ایجاد کنید

ابتدا یک فایل به نام ایجاد می کنیم serving.properties. این به DJLServing دستور می دهد تا از موتور پایتون استفاده کند. ما نیز تعریف می کنیم max_idle_time یک کارگر 600 ثانیه باشد. این اطمینان حاصل می کند که برای کاهش تعداد کارگرانی که در هر مدل داریم، زمان بیشتری طول می کشد. تعدیل نمی کنیم minWorkers و maxWorkers که می توانیم تعریف کنیم و به DJL اجازه می دهیم به صورت پویا تعداد کارگران مورد نیاز را بسته به ترافیکی که هر مدل دریافت می کند محاسبه کند. serving.properties به صورت زیر نشان داده شده است. برای مشاهده لیست کامل گزینه های پیکربندی به ادامه مطلب مراجعه کنید پیکربندی موتور.

در مرحله بعد، فایل model.py خود را ایجاد می کنیم که بارگذاری مدل و منطق استنتاج را تعریف می کند. برای MME ها، هر فایل model.py برای یک مدل خاص است. مدل ها در مسیرهای خود در زیر فروشگاه مدل ذخیره می شوند (معمولا /opt/ml/model/). هنگام بارگذاری مدل ها، آنها در مسیر ذخیره مدل در فهرست خود بارگذاری می شوند. نمونه کامل model.py در این دمو را می توان در قسمت مشاهده کرد GitHub repo.

ما ایجاد می کنیم model.tar.gz فایلی که شامل مدل ما (model.joblib), model.pyو serving.properties:

برای اهداف نمایشی، ما 1,000 نسخه از آن تولید می کنیم model.tar.gz فایل برای نشان دادن تعداد زیادی مدل برای میزبانی. در تولید، شما نیاز به ایجاد یک model.tar.gz فایل برای هر یک از مدل های شما.

در نهایت، ما این مدل ها را در آمازون S3 آپلود می کنیم.

یک مدل SageMaker ایجاد کنید

اکنون یک را ایجاد می کنیم مدل SageMaker. برای ایجاد مدل SageMaker از تصویر ECR که قبلاً تعریف شده بود و از آرتیفکت مدل مرحله قبل استفاده می کنیم. در تنظیمات مدل، Mode را به صورت MultiModel پیکربندی می کنیم. این به DJLServing می گوید که ما در حال ایجاد یک MME هستیم.

یک نقطه پایانی SageMaker ایجاد کنید

در این نسخه نمایشی، ما از 20 نمونه ml.c5d.18xlarge برای مقیاس کردن به TPS در محدوده هزاران استفاده میکنیم. اطمینان حاصل کنید که در صورت لزوم، برای دستیابی به TPS مورد نظر خود، محدودیتی را در نوع نمونه خود افزایش دهید.

تست بار

در زمان نگارش، ابزار تست بار داخلی SageMaker توصیه کننده استنباط آمازون SageMaker به طور بومی از تست برای MME ها پشتیبانی نمی کند. بنابراین از ابزار منبع باز پایتون استفاده می کنیم ملخ. راه اندازی Locust ساده است و می تواند معیارهایی مانند TPS و تأخیر سرتاسر را ردیابی کند. برای درک کامل نحوه تنظیم آن با SageMaker، ببینید بهترین روش ها برای آزمایش بارگذاری نقاط پایانی استنتاج بیدرنگ Amazon SageMaker.

در این مورد، ما سه الگوی ترافیک مختلف داریم که میخواهیم با MME شبیهسازی کنیم، بنابراین سه اسکریپت پایتون زیر را داریم که با هر الگوی همسو میشوند. هدف ما در اینجا این است که ثابت کنیم، صرف نظر از اینکه الگوی ترافیک ما چیست، میتوانیم به همان TPS و مقیاس مناسب دست یابیم.

ما میتوانیم وزنی را در اسکریپت Locust تعیین کنیم تا ترافیک را در بخشهای مختلف مدلهایمان تخصیص دهیم. به عنوان مثال، با مدل تک داغ خود، دو روش را به شرح زیر اجرا می کنیم:

سپس میتوانیم وزن مشخصی را به هر متد اختصاص دهیم، یعنی زمانی که یک متد درصد مشخصی از ترافیک را دریافت میکند:

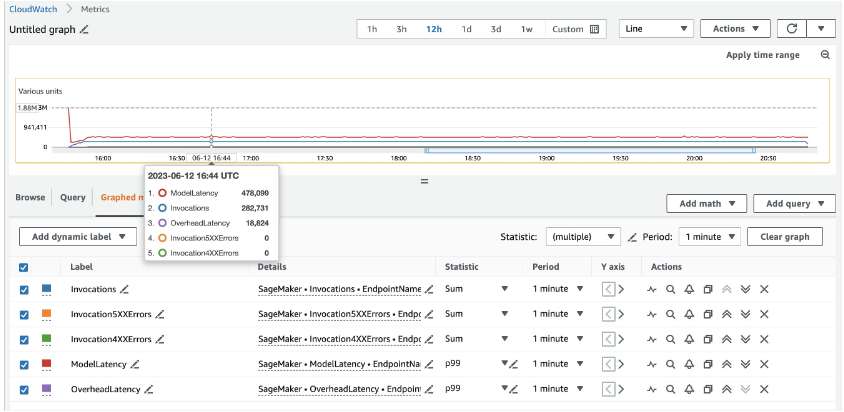

برای نمونههای 20 ml.c5d.18xlarge، معیارهای فراخوانی زیر را در CloudWatch آمازون کنسول. این مقادیر در هر سه الگوی ترافیک نسبتاً ثابت باقی می مانند. برای درک بهتر معیارهای CloudWatch برای استنتاج بلادرنگ SageMaker و MMEها، به معیارهای فراخوانی نقطه پایانی SageMaker.

میتوانید بقیه اسکریپتهای Locust را در قسمت پیدا کنید فهرست logust-utils در مخزن GitHub.

خلاصه

در این پست، ما بحث کردیم که چگونه یک MME می تواند به صورت پویا توان محاسباتی اختصاص داده شده به هر مدل را بر اساس الگوی ترافیک مدل تنظیم کند. این ویژگی تازه راهاندازی شده در تمام مناطق AWS که SageMaker در آنها در دسترس است در دسترس است. توجه داشته باشید که در زمان اعلام، فقط نمونه های CPU پشتیبانی می شوند. برای کسب اطلاعات بیشتر به ادامه مطلب مراجعه نمایید الگوریتم ها، چارچوب ها و نمونه های پشتیبانی شده.

درباره نویسنده

رام وجیراجو یک معمار ML با تیم خدمات SageMaker است. او بر کمک به مشتریان در ساخت و بهینه سازی راه حل های AI/ML خود در Amazon SageMaker تمرکز می کند. او در اوقات فراغت خود عاشق سفر و نوشتن است.

رام وجیراجو یک معمار ML با تیم خدمات SageMaker است. او بر کمک به مشتریان در ساخت و بهینه سازی راه حل های AI/ML خود در Amazon SageMaker تمرکز می کند. او در اوقات فراغت خود عاشق سفر و نوشتن است.

کینگوی لی یک متخصص یادگیری ماشین در خدمات وب آمازون است. او دکترای خود را دریافت کرد. در تحقیقات عملیات پس از اینکه حساب کمک هزینه تحقیقاتی مشاورش را شکست و نتوانست جایزه نوبل را که وعده داده بود تحویل دهد. در حال حاضر او به مشتریان در صنعت خدمات مالی و بیمه کمک می کند تا راه حل های یادگیری ماشینی را در AWS بسازند. در اوقات فراغت به مطالعه و تدریس علاقه دارد.

کینگوی لی یک متخصص یادگیری ماشین در خدمات وب آمازون است. او دکترای خود را دریافت کرد. در تحقیقات عملیات پس از اینکه حساب کمک هزینه تحقیقاتی مشاورش را شکست و نتوانست جایزه نوبل را که وعده داده بود تحویل دهد. در حال حاضر او به مشتریان در صنعت خدمات مالی و بیمه کمک می کند تا راه حل های یادگیری ماشینی را در AWS بسازند. در اوقات فراغت به مطالعه و تدریس علاقه دارد.

جیمز وو یک معمار ارشد راه حل متخصص AI/ML در AWS است. کمک به مشتریان در طراحی و ساخت راه حل های AI/ML. کار جیمز طیف گستردهای از موارد استفاده از ML را پوشش میدهد، با علاقه اولیه به بینایی رایانه، یادگیری عمیق، و مقیاسبندی ML در سراسر سازمان. قبل از پیوستن به AWS، جیمز بیش از 10 سال معمار، توسعهدهنده و رهبر فناوری بود، از جمله 6 سال در مهندسی و 4 سال در صنایع بازاریابی و تبلیغات.

جیمز وو یک معمار ارشد راه حل متخصص AI/ML در AWS است. کمک به مشتریان در طراحی و ساخت راه حل های AI/ML. کار جیمز طیف گستردهای از موارد استفاده از ML را پوشش میدهد، با علاقه اولیه به بینایی رایانه، یادگیری عمیق، و مقیاسبندی ML در سراسر سازمان. قبل از پیوستن به AWS، جیمز بیش از 10 سال معمار، توسعهدهنده و رهبر فناوری بود، از جمله 6 سال در مهندسی و 4 سال در صنایع بازاریابی و تبلیغات.

ساوراب تریکاند مدیر محصول ارشد Amazon SageMaker Inference است. او مشتاق کار با مشتریان است و هدفش دموکراتیک کردن یادگیری ماشین است. او بر چالشهای اصلی مربوط به استقرار برنامههای کاربردی پیچیده ML، مدلهای ML چند مستاجر، بهینهسازی هزینهها و در دسترستر کردن استقرار مدلهای یادگیری عمیق تمرکز میکند. Saurabh در اوقات فراغت خود از پیاده روی، یادگیری در مورد فن آوری های نوآورانه، دنبال کردن TechCrunch و گذراندن وقت با خانواده خود لذت می برد.

ساوراب تریکاند مدیر محصول ارشد Amazon SageMaker Inference است. او مشتاق کار با مشتریان است و هدفش دموکراتیک کردن یادگیری ماشین است. او بر چالشهای اصلی مربوط به استقرار برنامههای کاربردی پیچیده ML، مدلهای ML چند مستاجر، بهینهسازی هزینهها و در دسترستر کردن استقرار مدلهای یادگیری عمیق تمرکز میکند. Saurabh در اوقات فراغت خود از پیاده روی، یادگیری در مورد فن آوری های نوآورانه، دنبال کردن TechCrunch و گذراندن وقت با خانواده خود لذت می برد.

خو دنگ یک مدیر مهندس نرم افزار با تیم SageMaker است. او بر کمک به مشتریان برای ساخت و بهینه سازی تجربه استنتاج AI/ML خود در Amazon SageMaker تمرکز می کند. او در اوقات فراغت خود عاشق سفر و اسنوبورد است.

خو دنگ یک مدیر مهندس نرم افزار با تیم SageMaker است. او بر کمک به مشتریان برای ساخت و بهینه سازی تجربه استنتاج AI/ML خود در Amazon SageMaker تمرکز می کند. او در اوقات فراغت خود عاشق سفر و اسنوبورد است.

سیذارت ونکاتسان یک مهندس نرم افزار در AWS Deep Learning است. او در حال حاضر بر ساخت راه حل هایی برای استنتاج مدل های بزرگ تمرکز دارد. قبل از AWS او در سازمان خواربارفروشی آمازون کار می کرد و ویژگی های پرداخت جدید را برای مشتریان در سراسر جهان ایجاد می کرد. خارج از محل کار، او از اسکی، فضای باز و تماشای ورزش لذت می برد.

سیذارت ونکاتسان یک مهندس نرم افزار در AWS Deep Learning است. او در حال حاضر بر ساخت راه حل هایی برای استنتاج مدل های بزرگ تمرکز دارد. قبل از AWS او در سازمان خواربارفروشی آمازون کار می کرد و ویژگی های پرداخت جدید را برای مشتریان در سراسر جهان ایجاد می کرد. خارج از محل کار، او از اسکی، فضای باز و تماشای ورزش لذت می برد.

روهیت نالامادی مهندس توسعه نرم افزار در AWS است. او روی بهینهسازی حجمهای کاری یادگیری عمیق در GPUها، ایجاد استنتاج ML با کارایی بالا و ارائه راهحلها کار میکند. قبل از این، او بر روی ساخت میکروسرویس های مبتنی بر AWS برای تجارت آمازون F3 کار می کرد. خارج از محل کار از بازی کردن و تماشای ورزش لذت می برد.

روهیت نالامادی مهندس توسعه نرم افزار در AWS است. او روی بهینهسازی حجمهای کاری یادگیری عمیق در GPUها، ایجاد استنتاج ML با کارایی بالا و ارائه راهحلها کار میکند. قبل از این، او بر روی ساخت میکروسرویس های مبتنی بر AWS برای تجارت آمازون F3 کار می کرد. خارج از محل کار از بازی کردن و تماشای ورزش لذت می برد.

- محتوای مبتنی بر SEO و توزیع روابط عمومی. امروز تقویت شوید.

- PlatoData.Network Vertical Generative Ai. به خودت قدرت بده دسترسی به اینجا.

- PlatoAiStream. هوش وب 3 دانش تقویت شده دسترسی به اینجا.

- PlatoESG. کربن ، CleanTech، انرژی، محیط، خورشیدی، مدیریت پسماند دسترسی به اینجا.

- PlatoHealth. هوش بیوتکنولوژی و آزمایشات بالینی. دسترسی به اینجا.

- منبع: https://aws.amazon.com/blogs/machine-learning/run-ml-inference-on-unplanned-and-spiky-traffic-using-amazon-sagemaker-multi-model-endpoints/

- :است

- :جایی که

- $UP

- 000

- 1

- 10

- 100

- 116

- 118

- 12

- 16

- 17

- 20

- 23

- 31

- 600

- 7

- 9

- a

- درباره ما

- شتاب دهنده

- قابل دسترسی است

- در دسترس

- تطبیق

- حساب

- رسیدن

- در میان

- اعمال

- اضافه کردن

- اضافی

- مزیت - فایده - سود - منفعت

- تبلیغات

- پس از

- AI / ML

- الگوریتم

- تراز

- معرفی

- اختصاص دادن

- اختصاص داده شده است

- اجازه دادن

- اجازه می دهد تا

- در امتداد

- قبلا

- همچنین

- همیشه

- آمازون

- آمازون EC2

- آمازون SageMaker

- آمازون خدمات وب

- مقدار

- an

- و

- خبر

- دیگر

- هر

- آپاچی

- API

- رابط های برنامه کاربردی

- کاربرد

- برنامه های کاربردی

- اعمال می شود

- به درستی

- معماری

- هستند

- دور و بر

- مصنوعی

- AS

- اختصاص داده

- فرض

- At

- خودکار

- خودکار

- بطور خودکار

- در دسترس

- AWS

- به عقب

- بخش مدیریت

- پایه

- مستقر

- دسته

- BE

- زیرا

- پشت سر

- بهتر

- میان

- بدن

- بالا بردن

- مرزها

- جعبه

- شکستن

- به ارمغان بیاورد

- شکست

- ساختن

- بنا

- ساخته

- کسب و کار

- اما

- by

- نام

- CAN

- قابلیت

- ظرفیت

- اهميت دادن

- مورد

- موارد

- سلول

- متمرکز

- معین

- چالش ها

- چک

- کلاس

- مشتری

- مشتریان

- رمز

- می آید

- کامل

- تکمیل شده

- پیچیده

- جزء

- شامل

- محاسبه

- کامپیوتر

- چشم انداز کامپیوتر

- محاسبه

- قدرت پردازش

- رقیب

- پیکر بندی

- استوار

- همواره

- کنسول

- مصرف

- شامل

- ظرف

- زمینه

- ادامه

- هسته

- هزینه

- هزینه

- را پوشش می دهد

- ایجاد

- ایجاد شده

- ایجاد

- در حال حاضر

- سفارشی

- مشتریان

- داده ها

- روز

- عمیق

- یادگیری عمیق

- به طور پیش فرض

- تعريف كردن

- مشخص

- تعریف می کند

- ارائه

- تقاضا

- نسخه ی نمایشی

- دموکراتیک کردن

- وابستگی

- بستگی دارد

- نشان داده شده است

- گسترش

- مستقر

- استقرار

- گسترش

- طرح

- طراحی

- مشخص کردن

- تعیین می کند

- توسعه دهنده

- پروژه

- دستگاه

- دستگاه ها

- نمودار

- مختلف

- مشکل

- مستقیما

- فهرست راهنما

- بحث و تبادل نظر

- بحث کردیم

- توزیع

- کارگر بارانداز

- نمی کند

- آیا

- پایین

- دانلود

- دانلود

- پویا

- بطور پویا

- هر

- پیش از آن

- موثر

- موثر

- بدون دردسر

- هر دو

- در جای دیگر

- تعبیه کردن

- قادر ساختن

- را قادر می سازد

- بسته بندی شده

- پشت سر هم

- نقطه پایانی

- موتور

- مهندس

- مهندسی

- کافی

- اطمینان حاصل شود

- سرمایه گذاری

- محیط

- خطا

- حتی

- مثال

- استثنا

- منتظر

- انتظار می رود

- تجربه

- گسترش

- چهره

- ناموفق

- منصفانه

- خانواده

- ویژگی

- امکانات

- کمی از

- پرونده

- فایل ها

- مالی

- خدمات مالی

- پیدا کردن

- نام خانوادگی

- ثابت

- ناوگان

- تمرکز

- پیروی

- به دنبال آن است

- برای

- قالب

- چارچوب

- چارچوب

- غالبا

- از جانب

- ظاهر

- کامل

- کاملا

- ویژگی های

- تولید می کنند

- دریافت کنید

- می شود

- GitHub

- هدف

- GPU

- GPU ها

- اعطا کردن

- بیشتر

- دسته

- رخ دادن

- سخت افزار

- آیا

- he

- کمک

- کمک

- کمک می کند

- اینجا کلیک نمایید

- زیاد

- بالاتر

- خیلی

- خود را

- میزبان

- میزبانی

- میزبانی وب

- HOT

- چگونه

- چگونه

- اما

- HTML

- HTTP

- HTTPS

- آرام

- if

- نشان می دهد

- تصویر

- انجام

- پیاده سازی

- واردات

- in

- شامل

- شامل

- از جمله

- وارد شونده

- افزایش

- افزایش

- لوازم

- صنعت

- اطلاعات

- شالوده

- اول

- ابتکاری

- فن آوری های نوآورانه

- ورودی

- نصب شده

- نمونه

- در عوض

- بیمه

- ادغام

- یکپارچگی

- علاقه

- رابط

- به

- استناد کرد

- موضوع

- مسائل

- IT

- ITS

- جیمز

- جاوه

- کار

- پیوستن

- JPG

- تنها

- زبان

- بزرگ

- بزرگتر

- تاخیر

- آخرین

- راه اندازی

- رهبری

- رهبر

- منجر می شود

- یاد گرفتن

- یادگیری

- اجازه

- سطح

- کتابخانه

- پسندیدن

- دوست دارد

- محدود

- خطی

- فهرست

- بار

- بارگیری

- بارهای

- محلی

- منطق

- دیگر

- دوست دارد

- کم

- کاهش

- دستگاه

- فراگیری ماشین

- اصلی

- اکثریت

- ساخت

- باعث می شود

- ساخت

- اداره می شود

- مدیر

- مدیریت

- بسیاری

- بازار یابی (Marketing)

- بازاریابی و تبلیغات

- بیشترین

- ممکن است..

- مکانیسم

- حافظه

- متاداده

- روش

- روش

- متریک

- خدمات میکرو

- قدرت

- حد اقل

- دقیقه

- کاهش

- ML

- حالت

- مدل

- مدل

- ماژول ها

- بیش

- اکثر

- انگیزه

- چندگانه

- نام

- بومی

- لازم

- نیاز

- ضروری

- جدید

- به تازگی

- جایزه نوبل

- هیچ

- توجه داشته باشید

- دفتر یادداشت

- اکنون

- عدد

- بی حس

- of

- ارائه

- پیشنهادات

- on

- ONE

- فقط

- باز کن

- منبع باز

- عملیات

- مقابل

- بهینه سازی

- بهینه سازی

- بهینه

- بهینه سازی

- گزینه

- or

- دیگر

- ما

- خارج

- خارج از منزل

- تولید

- خارج از

- روی

- خود

- موازی

- پارامترهای

- بخش

- ویژه

- بخش

- احساساتی

- مسیر

- راه ها

- الگو

- الگوهای

- پرداخت

- برای

- درصد

- انجام

- کارایی

- لوله

- سکو

- افلاطون

- هوش داده افلاطون

- PlatoData

- بازی

- پلاگین ها

- نقطه

- سیاست

- استخرها

- محبوب

- پست

- قدرت

- شیوه های

- ماقبل

- پیش گویی

- پیش بینی

- قبلی

- قبلا

- اصلی

- قبلا

- جایزه

- مشکل

- روند

- در حال پردازش

- محصول

- مدیر تولید

- تولید

- برنامه نويسي

- وعده داده شده

- به درستی

- املاک

- ثابت كردن

- ارائه

- فراهم می کند

- تدارک

- هدف

- اهداف

- فشار

- تحت فشار قرار دادند

- پــایتــون

- مارماهی

- تصادفی

- محدوده

- خواندن

- مطالعه

- اماده

- زمان واقعی

- گرفتن

- اخذ شده

- دریافت

- دریافت

- توصیه می شود

- مراجعه

- بدون در نظر گرفتن

- منطقه

- مناطق

- مربوط

- ماندن

- جایگزین کردن

- مخزن

- نشان دادن

- درخواست

- درخواست

- مورد نیاز

- تحقیق

- منابع

- پاسخ

- REST

- نتیجه

- بازده

- استفاده مجدد

- مسیر

- مسیرها

- مسیریابی

- دویدن

- اجرا می شود

- زمان اجرا

- SAAS

- حکیم ساز

- استنباط SageMaker

- همان

- نمونه

- ذخیره

- گفتن

- مقیاس

- مقیاس پذیر

- مقیاس ها

- مقیاس گذاری

- خط

- اسکریپت

- دوم

- ثانیه

- دیدن

- مشاهده گردید

- خود

- ارسال

- ارشد

- خدمت

- خدمت کرده است

- سرور

- سرور

- سرویس

- خدمات

- خدمت

- تنظیم

- مجموعه

- برپایی

- چند

- باید

- نمایشگاه

- نشان داده شده

- نشان می دهد

- ساده

- شبیه سازی

- به طور همزمان

- تنها

- مفرد

- اندازه

- کوچک

- قطعه

- So

- نرم افزار

- نرم افزار به عنوان یک سرویس

- توسعه نرم افزار

- مهندس نرمافزار

- راه حل

- مزایا

- برخی از

- منبع

- متخصص

- خاص

- هزینه

- انشعاب

- ورزش ها

- پشته

- ایستا

- گام

- ذخیره سازی

- opbevare

- ذخیره شده

- ساده

- متعاقب

- چنین

- نشان می دهد

- پشتیبانی

- پشتیبانی

- پشتیبانی از

- مطمئن

- سیستم های

- گرفتن

- طول می کشد

- مصرف

- هدف

- هدف گذاری

- تعلیم

- تیم

- TechCrunch

- فن آوری

- پیشرفته

- می گوید

- جریان تنسور

- تست

- تست

- نسبت به

- که

- La

- شان

- آنها

- سپس

- آنجا.

- از این رو

- اینها

- آنها

- این

- کسانی که

- هزار

- هزاران نفر

- سه

- از طریق

- توان

- زمان

- بار

- به

- هم

- ابزار

- بالا

- طرف

- thps

- مسیر

- ترافیک

- قطار

- آموزش دیده

- آموزش

- معاملات

- ترانسفورماتور

- سفر

- امتحان

- دو

- نوع

- به طور معمول

- زیر

- اساسی

- فهمیدن

- درک

- جهانی

- URL

- استفاده کنید

- مورد استفاده

- استفاده

- استفاده

- با استفاده از

- معمولا

- با استفاده از

- ارزش

- ارزشها

- متغیر

- مختلف

- دید

- vs

- می خواهم

- بود

- تماشای

- we

- وب

- خدمات وب

- وزن

- چی

- چه زمانی

- در حالیکه

- که

- وسیع

- دامنه گسترده

- اراده

- با

- در داخل

- مهاجرت کاری

- مشغول به کار

- کارگر

- کارگران

- گردش کار

- گردش کار

- کارگر

- با این نسخهها کار

- خواهد بود

- نوشته

- کتبی

- X

- سال

- شما

- شما

- زفیرنت