Nykypäivän tiedon aikakaudella lukemattomiin asiakirjoihin tallennetut valtavat tietomäärät tarjoavat yrityksille sekä haasteen että mahdollisuuden. Perinteiset asiakirjankäsittelymenetelmät ovat usein tehottomia ja tarkkoja, mikä jättää tilaa innovaatioille, kustannustehokkuudelle ja optimoinnille. Asiakirjojen käsittelyssä on tapahtunut merkittäviä edistysaskeleita älykkään asiakirjojen käsittelyn (IDP) myötä. IDP:n avulla yritykset voivat muuntaa eri asiakirjatyypeistä peräisin olevaa jäsentämätöntä dataa jäsennellyiksi, käyttökelpoisiksi oivalluksiksi, mikä parantaa merkittävästi tehokkuutta ja vähentää manuaalista työtä. Potentiaali ei kuitenkaan lopu tähän. Integroimalla generatiivisen tekoälyn (AI) prosessiin voimme entisestään parantaa IDP-valmiuksia. Generatiivinen tekoäly ei ainoastaan tuo parannettuja ominaisuuksia asiakirjojen käsittelyyn, vaan se tarjoaa myös dynaamisen mukautumiskyvyn muuttuviin tietokuvioihin. Tämä postaus vie sinut IDP:n ja generatiivisen tekoälyn synergiaan ja paljastaa, kuinka ne edustavat asiakirjankäsittelyn seuraavaa rajaa.

Käsittelemme IDP:tä yksityiskohtaisesti sarjassamme Älykäs asiakirjankäsittely AWS AI -palveluilla (Osa 1 ja Osa 2). Tässä viestissä keskustelemme uuden tai olemassa olevan IDP-arkkitehtuurin laajentamisesta suurilla kielimalleilla (LLM). Tarkemmin sanottuna keskustelemme siitä, kuinka voimme integroida Amazonin teksti with LangChain asiakirjojen lataajana ja Amazonin kallioperä poimia tietoja asiakirjoista ja käyttää generatiivisia tekoälyominaisuuksia IDP-vaiheissa.

Amazon Textract on koneoppimispalvelu (ML), joka poimii automaattisesti tekstin, käsinkirjoituksen ja datan skannatuista asiakirjoista. Amazon Bedrock on täysin hallittu palvelu, joka tarjoaa valikoiman tehokkaita perusmalleja (FM) helppokäyttöisten API-liittymien kautta.

Seuraava kaavio on korkean tason referenssiarkkitehtuuri, joka selittää, kuinka voit edelleen parantaa IDP-työnkulkua perustusmalleilla. Voit käyttää LLM:itä yhdessä tai kaikissa IDP:n vaiheissa käyttötapauksesta ja halutusta tuloksesta riippuen.

Seuraavissa osioissa sukeltaamme syvälle siihen, kuinka Amazon Textract integroidaan generatiivisiin tekoälytyönkulkuihin LangChainin avulla dokumenttien käsittelemiseen jokaista näistä erityistehtävistä. Tässä annetut koodilohkot on leikattu lyhyyden vuoksi. Katso meidän GitHub-arkisto yksityiskohtaiset Python-muistikirjat ja vaiheittaiset esittelyt.

Tekstin poimiminen asiakirjoista on ratkaiseva näkökohta, kun käsitellään asiakirjoja LLM:n kanssa. Amazon Textractin avulla voit poimia asiakirjoista jäsentämätöntä raakatekstiä ja säilyttää alkuperäiset puolirakenteiset tai strukturoidut objektit, kuten asiakirjassa olevat avainarvoparit ja taulukot. Asiakirjapaketit, kuten terveydenhuolto- ja vakuutuskorvaukset tai asuntolainat, koostuvat monimutkaisista lomakkeista, jotka sisältävät paljon tietoa jäsennellyissä, puolirakenteisissa ja jäsentelemättömissä muodoissa. Asiakirjojen purkaminen on tärkeä askel tässä, koska LLM:t hyötyvät rikkaasta sisällöstä tuottaakseen tarkempia ja osuvampia vastauksia, jotka muuten voisivat vaikuttaa LLM:iden tulosten laatuun.

LangChain on tehokas avoimen lähdekoodin kehys integrointiin LLM:ien kanssa. LLM:t ovat yleensä monipuolisia, mutta voivat kamppailla toimialuekohtaisissa tehtävissä, joissa tarvitaan syvempää kontekstia ja vivahteikkaampia vastauksia. LangChain antaa tällaisten skenaarioiden kehittäjille mahdollisuuden rakentaa agentteja, jotka voivat pilkkoa monimutkaiset tehtävät pienemmiksi osatehtäviksi. Alatehtävät voivat sitten tuoda kontekstin ja muistin LLM:ihin yhdistämällä ja ketjuttamalla LLM-kehotteita.

LangChain tarjoaa asiakirjalataajat joka voi ladata ja muuntaa tietoja asiakirjoista. Niiden avulla voit jäsentää asiakirjoja haluttuihin muotoihin, joita LLM:t voivat käsitellä. The AmazonTextractPDFLoader on palvelulataustyyppinen asiakirjalataaja, joka tarjoaa nopean tavan automatisoida asiakirjojen käsittely käyttämällä Amazon Textractia yhdessä LangChainin kanssa. Lisätietoja aiheesta AmazonTextractPDFLoader, Viittaavat LangChain dokumentointi. Jos haluat käyttää Amazon Textract -dokumenttien latausohjelmaa, aloita tuomalla se LangChain-kirjastosta:

from langchain.document_loaders import AmazonTextractPDFLoaderhttps_loader = AmazonTextractPDFLoader("https://sample-website.com/sample-doc.pdf")

https_document = https_loader.load() s3_loader = AmazonTextractPDFLoader("s3://sample-bucket/sample-doc.pdf")

s3_document = s3_loader.load()Voit myös tallentaa asiakirjoja Amazon S3:een ja viitata niihin käyttämällä URL-osoitemallia s3://, kuten kohdassa selitetään Säilön käyttäminen S3://:lläja välitä tämä S3-polku Amazon Textract PDF -latausohjelmaan:

import boto3

textract_client = boto3.client('textract', region_name='us-east-2') file_path = "s3://amazon-textract-public-content/langchain/layout-parser-paper.pdf"

loader = AmazonTextractPDFLoader(file_path, client=textract_client)

documents = loader.load()Monisivuinen asiakirja sisältää useita sivuja tekstiä, jota voidaan sitten käyttää asiakirjaobjektin kautta, joka on sivuluettelo. Seuraava koodi käy läpi asiakirjaobjektin sivut ja tulostaa asiakirjan tekstin, joka on saatavilla page_content määrite:

print(len(documents)) for document in documents: print(document.page_content)Amazon Comprehendia ja LLM:itä voidaan käyttää tehokkaasti asiakirjojen luokittelussa. Amazon Comprehend on luonnollisen kielen käsittelypalvelu (NLP), joka käyttää ML:ää oivallusten poimimiseen tekstistä. Amazon Comprehend tukee myös räätälöityjä luokitusmallien koulutusta asettelutietoisuuden avulla asiakirjoissa, kuten PDF-, Word- ja kuvamuodoissa. Lisätietoja Amazon Comprehend -dokumenttien luokittelijan käytöstä on kohdassa Amazon Comprehend -dokumenttien luokitin lisää asettelutuen tarkkuuden parantamiseksi.

Kun asiakirjojen luokittelu yhdistetään LLM:ien kanssa, siitä tulee tehokas tapa hallita suuria asiakirjamääriä. LLM:t ovat hyödyllisiä asiakirjojen luokittelussa, koska he voivat analysoida asiakirjan tekstiä, kuvioita ja kontekstuaalisia elementtejä käyttämällä luonnollisen kielen ymmärtämistä. Voit myös hienosäätää niitä tiettyjä asiakirjaluokkia varten. Kun IDP-liukuhihnaan lisätty uusi dokumenttityyppi tarvitsee luokituksen, LLM voi käsitellä tekstiä ja luokitella asiakirjan tietyn luokan perusteella. Seuraavassa on esimerkkikoodi, joka käyttää Amazon Textractin tuottamaa LangChain-asiakirjalataajaa tekstin poimimiseen asiakirjasta ja käyttää sitä asiakirjan luokitteluun. Käytämme Antrooppinen Claude v2 malli Amazon Bedrockin kautta luokituksen suorittamiseksi.

Seuraavassa esimerkissä poimimme ensin tekstin potilaan kotiutusraportista ja luokittelemme sen LLM:n avulla kolmen eri asiakirjatyypin luettelon perusteella:DISCHARGE_SUMMARY, RECEIPTja PRESCRIPTION. Seuraava kuvakaappaus näyttää raporttimme.

from langchain.document_loaders import AmazonTextractPDFLoader

from langchain.llms import Bedrock

from langchain.prompts import PromptTemplate

from langchain.chains import LLMChain loader = AmazonTextractPDFLoader("./samples/document.png")

document = loader.load() template = """ Given a list of classes, classify the document into one of these classes. Skip any preamble text and just give the class name. <classes>DISCHARGE_SUMMARY, RECEIPT, PRESCRIPTION</classes>

<document>{doc_text}<document>

<classification>""" prompt = PromptTemplate(template=template, input_variables=["doc_text"])

bedrock_llm = Bedrock(client=bedrock, model_id="anthropic.claude-v2") llm_chain = LLMChain(prompt=prompt, llm=bedrock_llm)

class_name = llm_chain.run(document[0].page_content) print(f"The provided document is = {class_name}")

Yhteenveto sisältää tietyn tekstin tai asiakirjan tiivistämisen lyhyemmäksi versioksi säilyttäen samalla sen keskeiset tiedot. Tämä tekniikka on hyödyllinen tehokkaassa tiedonhaussa, jonka avulla käyttäjät voivat nopeasti ymmärtää asiakirjan keskeiset kohdat lukematta koko sisältöä. Vaikka Amazon Textract ei suoraan tee tekstin yhteenvetoa, se tarjoaa perustavanlaatuiset ominaisuudet koko tekstin poimimiseen asiakirjoista. Tämä poimittu teksti toimii syötteenä LLM-malliimme tekstin yhteenvetotehtävien suorittamiseen.

Käytämme samaa näytepurkausraporttia AmazonTextractPDFLoader poimiaksesi tekstiä tästä asiakirjasta. Kuten ennenkin, käytämme Claude v2 -mallia Amazon Bedrockin kautta ja alustamme sen kehotteella, joka sisältää ohjeet tekstin tekemiseen (tässä tapauksessa yhteenveto). Lopuksi suoritamme LLM-ketjun välittämällä poimitun tekstin asiakirjan lataajasta. Tämä suorittaa päättelytoiminnon LLM:ssä kehotteen kanssa, joka koostuu yhteenvedon tekemisohjeista ja dokumentin tekstistä, joka on merkitty Document. Katso seuraava koodi:

Koodi luo yhteenvedon potilaan kotiutuksen yhteenvetoraportista:

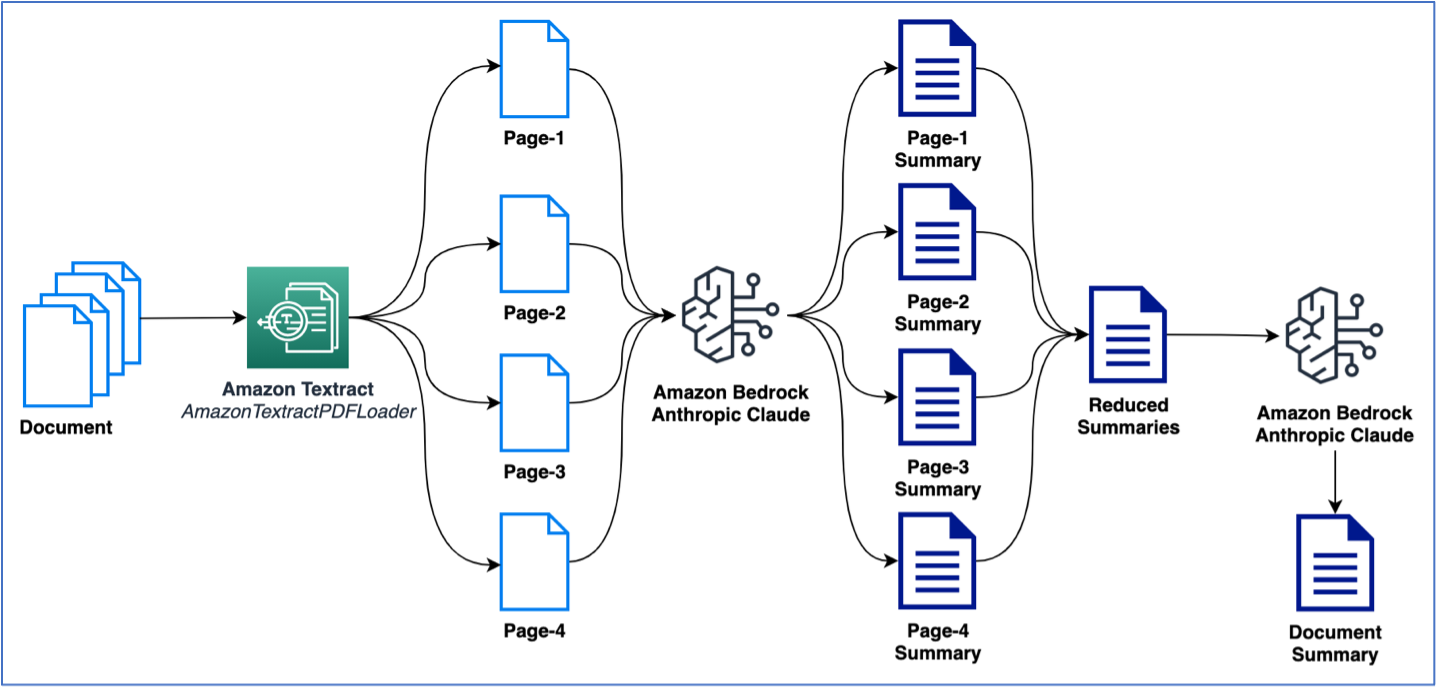

Edellisessä esimerkissä käytettiin yksisivuista asiakirjaa yhteenvedon tekemiseen. Käsittelet kuitenkin todennäköisesti asiakirjoja, jotka sisältävät useita sivuja ja jotka vaativat yhteenvedon. Yleinen tapa tehdä yhteenveto useille sivuille on luoda ensin tiivistelmät pienemmistä tekstipaloista ja sitten yhdistää pienemmät tiivistelmät lopullisen yhteenvedon saamiseksi asiakirjasta. Huomaa, että tämä menetelmä vaatii useita puheluita LLM:lle. Logiikka tälle voidaan muotoilla helposti; LangChain tarjoaa kuitenkin sisäänrakennetun yhteenvetoketjun, joka voi tehdä yhteenvedon suurista teksteistä (monisivuisista asiakirjoista). Yhteenveto voi tapahtua joko kautta map_reduce tai stuff vaihtoehdot, jotka ovat käytettävissä vaihtoehtoina useiden LLM:n puhelujen hallintaan. Seuraavassa esimerkissä käytämme map_reduce tehdäksesi yhteenvedon monisivuisesta asiakirjasta. Seuraava kuva havainnollistaa työnkulkuamme.

Aloitetaan purkamalla asiakirja ja katsotaan token kokonaismäärä sivua kohden ja sivujen kokonaismäärä:

Seuraavaksi käytämme LangChainin sisäänrakennettua load_summarize_chain tiivistääksesi koko asiakirjan:

from langchain.chains.summarize import load_summarize_chain summary_chain = load_summarize_chain(llm=bedrock_llm, chain_type='map_reduce')

output = summary_chain.run(document)

print(output.strip())Standardointi ja Q&A

Tässä osiossa käsittelemme standardointi- ja Q&A-tehtäviä.

Standardointi

Tulosteiden standardointi on tekstin luontitehtävä, jossa LLM:itä käytetään tuottamaan tulostekstin johdonmukainen muotoilu. Tämä tehtävä on erityisen hyödyllinen avaimen entiteettien poimimisen automatisoinnissa, joka edellyttää tulosteen kohdistamista haluttuun muotoon. Voimme esimerkiksi noudattaa nopeita suunnittelun parhaita käytäntöjä hienosäätääksemme LLM:n muotoilemaan päivämäärät KK/PP/VVVV-muotoon, mikä saattaa olla yhteensopiva tietokannan PÄIVÄMÄÄRÄ-sarakkeen kanssa. Seuraava koodilohko näyttää esimerkin siitä, kuinka tämä tehdään käyttämällä LLM:ää ja kehotesuunnittelua. Sen lisäksi, että standardoimme päivämääräarvojen tulostusmuotoa, kehotamme mallia luomaan lopullisen tulosteen JSON-muodossa, jotta se on helposti kulutettavissa loppupään sovelluksissamme. Käytämme LangChain Expression Language (LCEL) yhdistää kaksi toimenpidettä. Ensimmäinen toiminto kehottaa LLM:ää luomaan JSON-muotoisen tulosteen vain päivämääristä asiakirjasta. Toinen toiminto ottaa JSON-ulostulon ja standardoi päivämäärämuodon. Huomaa, että tämä kaksivaiheinen toiminto voidaan suorittaa myös yhdessä vaiheessa asianmukaisella nopealla suunnittelulla, kuten näemme normalisoinnissa ja mallintamisessa.

Edellisen koodinäytteen tulos on JSON-rakenne, jonka päivämäärät ovat 07/09/2020 ja 08/09/2020, jotka ovat muotoa PP/KK/VVVV ja vastaavasti potilaan vastaanotto- ja kotiutuspäivämäärät sairaalasta. vastuuvapauden yhteenvetoraporttiin.

Kysymyksiä ja vastauksia noudon lisätyn sukupolven kanssa

LLM:ien tiedetään säilyttävän faktatietoa, jota usein kutsutaan heidän maailmantietämyksensä tai maailmankuvansa. Hienosäädettynä ne voivat tuottaa huippuluokan tuloksia. On kuitenkin olemassa rajoituksia sille, kuinka tehokkaasti LLM voi käyttää tätä tietoa ja muokata sitä. Tämän seurauksena tehtävissä, jotka perustuvat vahvasti tiettyyn tietoon, niiden suorituskyky ei ehkä ole optimaalinen tietyissä käyttötapauksissa. Esimerkiksi Q&A-skenaarioissa on olennaista, että malli noudattaa tiukasti asiakirjassa annettua kontekstia ilman, että se luottaisi pelkästään sen maailmantietoisuuteen. Tästä poikkeaminen voi johtaa vääriin käsityksiin, epätarkkuuksiin tai jopa vääriin vastauksiin. Yleisimmin käytetty menetelmä tämän ongelman ratkaisemiseksi tunnetaan nimellä Haku laajennettu sukupolvi (RÄTTI). Tämä lähestymistapa synergisoi sekä hakumallien että kielimallien vahvuudet, mikä parantaa syntyvien vastausten tarkkuutta ja laatua.

LLM:t voivat myös asettaa token-rajoituksia muistirajoitustensa ja käyttämänsä laitteiston rajoitusten vuoksi. Tämän ongelman ratkaisemiseksi käytetään tekniikoita, kuten paloittelua, jakaa suuret asiakirjat pienempiin osiin, jotka mahtuvat LLM:ien tunnusrajoihin. Toisaalta upotuksia käytetään NLP:ssä ensisijaisesti sanojen semanttisen merkityksen ja niiden suhteiden ja muiden sanojen kaappaamiseen korkeaulotteisessa tilassa. Nämä upotukset muuttavat sanat vektoreiksi, jolloin mallit voivat käsitellä ja ymmärtää tekstidataa tehokkaasti. Ymmärtämällä sanojen ja ilmausten väliset semanttiset vivahteet, upotukset antavat LLM:ille mahdollisuuden luoda johdonmukaisia ja asiayhteyteen liittyviä tuloksia. Huomaa seuraavat keskeiset termit:

- tiivistämistä – Tämä prosessi jakaa suuret tekstimäärät asiakirjoista pienemmiksi, merkityksellisiksi tekstipaloiksi.

- upotukset – Nämä ovat kiinteäulotteisia vektorimuunnoksia jokaisesta palasta, jotka säilyttävät palasten semanttisen tiedon. Nämä upotukset ladataan myöhemmin vektoritietokantaan.

- Vektoritietokanta – Tämä on tietokanta sanojen upotuksista tai vektoreista, jotka edustavat sanojen kontekstia. Se toimii tietolähteenä, joka auttaa NLP-tehtävissä dokumenttien käsittelyssä. Vektoritietokannan etuna tässä on se, että se sallii vain tarvittavan kontekstin tarjoamisen LLM:ille tekstin luomisen aikana, kuten selitämme seuraavassa osiossa.

RAG käyttää upotusten voimaa ymmärtääkseen ja hakeakseen asiaankuuluvia asiakirjasegmenttejä hakuvaiheen aikana. Näin toimimalla RAG voi työskennellä LLM:n token-rajoitusten puitteissa ja varmistaa, että olennaisimmat tiedot valitaan luomista varten, mikä johtaa tarkempiin ja kontekstuaalisesti merkityksellisempiin tulosteisiin.

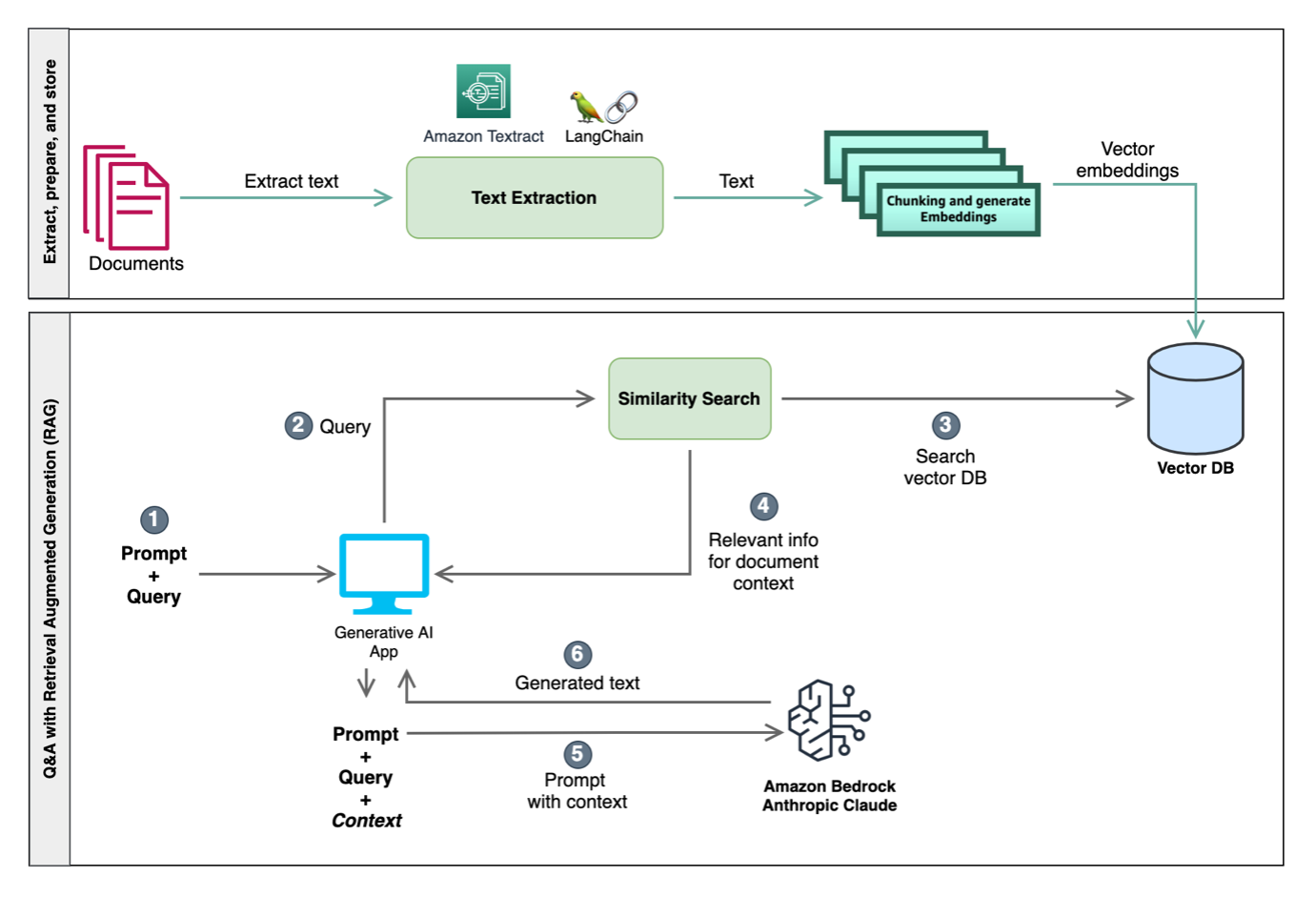

Seuraava kaavio havainnollistaa näiden tekniikoiden integrointia LLM:ien syöttämiseen, mikä parantaa heidän kontekstuaalista ymmärrystään ja mahdollistaa osuvammat kontekstin sisäiset vastaukset. Yksi lähestymistapa sisältää samankaltaisuushaun, jossa käytetään sekä vektoritietokantaa että paloittelua. Vektoritietokanta tallentaa semanttista tietoa edustavat upotukset, ja paloittelu jakaa tekstin hallittaviin osiin. Käyttämällä tätä samankaltaisuushaun kontekstia LLM:t voivat suorittaa tehtäviä, kuten kysymyksiin vastaamista ja toimialuekohtaisia toimintoja, kuten luokittelua ja rikastamista.

Käytämme tässä viestissä RAG-pohjaista lähestymistapaa asiakirjoihin liittyvien kysymysten ja vastausten tekemiseen. Seuraavassa koodiesimerkissä poimimme tekstiä asiakirjasta ja jaamme sitten asiakirjan pienempiin tekstipaloihin. Jakaminen on pakollista, koska meillä voi olla suuria monisivuisia asiakirjoja ja LLM:illämme voi olla tunnusrajoituksia. Nämä palaset ladataan sitten vektoritietokantaan samankaltaisuushaun suorittamiseksi seuraavissa vaiheissa. Seuraavassa esimerkissä käytämme Amazon Titan Embed Text v1 -mallia, joka suorittaa dokumenttipalojen vektoriupotukset:

Koodi luo relevantin kontekstin LLM:lle käyttämällä vektoritietokannasta samankaltaisuushakutoiminnon palauttamia tekstipalstoja. Tässä esimerkissä käytämme avointa lähdekoodia FAISS vektorikauppa esimerkkivektoritietokannana jokaisesta tekstipalasta vektoriupotusten tallentamiseen. Sitten määrittelemme vektoritietokannan a LangChain-noutaja, joka siirretään RetrievalQA ketju. Tämä suorittaa sisäisesti samankaltaisuushakukyselyn vektoritietokannassa, joka palauttaa ylin n (jossa n=3 esimerkissämme) tekstiä, jotka liittyvät kysymykseen. Lopuksi LLM-ketjua ajetaan asiaankuuluvalla kontekstilla (ryhmä relevantteja tekstipalstoja) ja kysymyksellä, johon LLM:n on vastattava. Katso vaiheittaiset Q&A-koodin esittelyt RAG:n kanssa Python-muistikirjasta GitHub.

Vaihtoehtona FAISSille voit myös käyttää Amazon OpenSearch Service vektoritietokantaominaisuudet, Amazon Relational Database Service (Amazon RDS) PostgreSQL:lle jossa pgvector laajennus vektoritietokantoina tai avoimen lähdekoodin Chroma Database.

Q&A taulukkotiedoilla

Asiakirjoissa olevien taulukkotietojen käsittely voi olla haastavaa LLM:ille sen rakenteellisen monimutkaisuuden vuoksi. Amazon Textractia voidaan täydentää LLM:illä, koska se mahdollistaa taulukoiden purkamisen asiakirjoista elementtien, kuten sivun, taulukon ja solujen, sisäkkäisessä muodossa. Q&A:n suorittaminen taulukkotiedoilla on monivaiheinen prosessi, ja se voidaan saavuttaa itse kyselevä. Seuraavassa on yleiskatsaus vaiheista:

- Pura taulukot asiakirjoista Amazon Textractin avulla. Amazon Textractin avulla taulukkorakenne (rivit, sarakkeet, otsikot) voidaan poimia asiakirjasta.

- Tallenna taulukkomuotoiset tiedot vektoritietokantaan metatietotietojen, kuten otsikon nimien ja kunkin otsikon kuvauksen kanssa.

- Käytä kehotetta strukturoidun kyselyn luomiseen LLM:n avulla tietojen johtamiseksi taulukosta.

- Käytä kyselyä poimimaan asiaankuuluvat taulukkotiedot vektoritietokannasta.

Esimerkiksi pankkitiliotteessa kehote "Mitä ovat tapahtumat, joissa talletukset ovat yli 1000 dollaria" LLM suorittaa seuraavat vaiheet:

- Tee kysely, esim

“Query: transactions” , “filter: greater than (Deposit$)”. - Muunna kysely jäsennellyksi kyselyksi.

- Käytä strukturoitua kyselyä vektoritietokantaan, johon taulukkotietomme on tallennettu.

Katso vaiheittaiset esimerkkikoodiesittelyt Q&A taulukon avulla Python-muistikirjasta GitHub.

Malli ja normalisoinnit

Tässä osiossa tarkastellaan, kuinka nopean suunnittelutekniikan ja LangChainin sisäänrakennetun mekanismin avulla luodaan tuloste, joka sisältää poimintoja asiakirjasta tietyssä skeemassa. Suoritamme myös jonkin verran standardisointia erotetuille tiedoille käyttämällä aiemmin käsiteltyjä tekniikoita. Aloitamme määrittämällä mallin halutulle tuloksellemme. Tämä toimii skeemana ja kapseloi jokaisen entiteetin tiedot, jotka haluamme poimia asiakirjan tekstistä.

Huomaa, että käytämme kuvausta kunkin entiteetin osalta selittämään, mikä entiteetti on, auttaaksemme LLM:ää poimimaan arvon asiakirjan tekstistä. Seuraavassa esimerkkikoodissa käytämme tätä mallia LLM-kehotteen laatimiseen yhdessä asiakirjasta poimitun tekstin kanssa AmazonTextractPDFLoader ja tee sitten päättely mallin perusteella:

Kuten näette, {keys} osa kehotteesta on avaimet mallistamme ja {details} ovat avaimet ja niiden kuvaus. Tässä tapauksessa emme kehota mallia nimenomaisesti antamaan tulosteen muotoa muulla kuin ohjeessa määritellyllä tulosteen luomiseksi JSON-muodossa. Tämä toimii suurimmaksi osaksi; Kuitenkin, koska LLM:iden tulos on ei-determinististä tekstintuotantoa, haluamme määrittää muodon nimenomaisesti osana kehotteen käskyä. Tämän ratkaisemiseksi voimme käyttää LangChain'sia strukturoitu tulosten jäsentäjä moduuli hyödyntää automatisoitua kehotteen suunnittelua, joka auttaa muuttamaan mallimme muotoohjekehotteeksi. Käytämme aiemmin määritettyä mallia muoto-ohjekehotteen luomiseen seuraavasti:

Käytämme sitten tätä muuttujaa alkuperäisessä kehotteessa ohjeena LLM:lle, jotta se purkaa ja muotoilee lähdön haluttuun skeemaan tekemällä pienen muokkauksen kehotteeseen:

Toistaiseksi olemme poimineet tiedot asiakirjasta vain halutussa skeemassa. Meidän on kuitenkin vielä suoritettava jonkin verran standardointia. Haluamme esimerkiksi, että potilaan tulopäivä ja kotiutuspäivämäärä poimitaan muodossa PP/KK/VVVV. Tässä tapauksessa lisäämme description avaimesta muotoiluohjeella:

Katso Python-muistikirja GitHub saadaksesi täydellisen vaiheittaisen esittelyn ja selityksen.

Oikeinkirjoituksen tarkistukset ja korjaukset

LLM:t ovat osoittaneet merkittäviä kykyjä ymmärtää ja luoda ihmisen kaltaista tekstiä. Yksi vähemmän käsitellyistä, mutta erittäin hyödyllisistä LLM-sovelluksista on niiden potentiaali kieliopin tarkistuksissa ja virkkeen korjaamisessa asiakirjoissa. Toisin kuin perinteiset kieliopin tarkistajat, jotka luottavat ennalta määritettyihin sääntöihin, LLM:t käyttävät malleja, jotka ne ovat tunnistaneet valtavasta tekstidatamääristä määrittääkseen, mikä on oikeaa tai sujuvaa kieltä. Tämä tarkoittaa, että he voivat havaita vivahteita, kontekstin ja hienouksia, jotka sääntöpohjaiset järjestelmät saattavat jättää huomiotta.

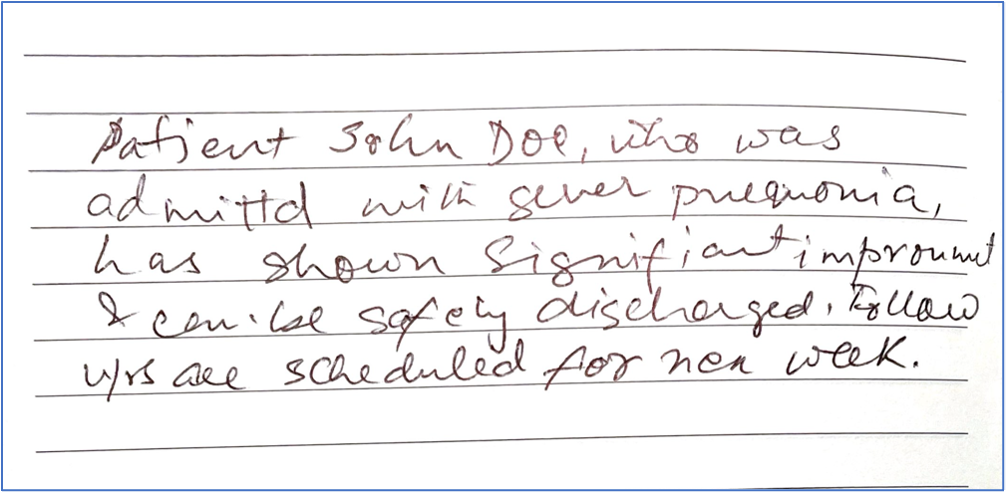

Kuvittele potilaan kotiutusyhteenvedosta poimittua tekstiä, jossa lukee: "Potilas Jon Doe, joka otettiin sairaalaan vakavasta keuhkokuumeesta, on parantunut merkittävästi ja hänet voidaan kotiuttaa turvallisesti. Seuranta on suunniteltu ensi viikolle." Perinteinen oikoluku saattaa tunnistaa "admittd", "keuhkokuume", "parannus" ja "seuraava" virheiksi. Näiden virheiden konteksti voi kuitenkin johtaa uusiin virheisiin tai yleisiin ehdotuksiin. LLM, jolla on laaja koulutus, saattaa ehdottaa: ”Potilas John Doe, joka joutui sairaalaan vakavalla keuhkokuumeella, on osoittanut merkittävää paranemista ja hänet voidaan turvallisesti kotiuttaa. Seuranta on suunniteltu ensi viikolle."

Seuraava on huonosti käsinkirjoitettu esimerkkiasiakirja, jossa on sama teksti kuin aiemmin selitettiin.

Puramme asiakirjan Amazon Textract -asiakirjalatausohjelmalla ja opastamme sitten LLM:tä korjaamaan puretun tekstin mahdollisten kirjoitus- ja/tai kielioppivirheiden korjaamiseksi:

Edellisen koodin tulos näyttää asiakirjan lataajan poimiman alkuperäisen tekstin, jota seuraa LLM:n luoma korjattu teksti:

Muista, että niin tehokkaita kuin LLM:t ovatkin, on tärkeää nähdä heidän ehdotuksensa juuri sellaisina - ehdotuksina. Vaikka ne vangitsevat kielen hienoudet vaikuttavasti, ne eivät ole erehtymättömiä. Jotkut ehdotukset saattavat muuttaa alkuperäisen tekstin tarkoitusta tai sävyä. Siksi on erittäin tärkeää, että arvioijat käyttävät LLM:n luomia korjauksia ohjeena, ei ehdottomana. Ihmisen intuition yhteistyö LLM-ominaisuuksien kanssa lupaa tulevaisuuden, jossa kirjallinen viestinnämme ei ole vain virheetöntä, vaan myös rikkaampaa ja vivahteikaisempaa.

Yhteenveto

Generatiivinen tekoäly muuttaa tapaa, jolla voit käsitellä asiakirjoja IDP:n avulla oivallusten saamiseksi. Postissa AWS-älykkään asiakirjojen käsittelyn tehostaminen generatiivisella tekoälyllä, keskustelimme putkilinjan eri vaiheista ja siitä, kuinka AWS-asiakas Ricoh parantaa IDP-putkistoaan LLM:illä. Tässä viestissä keskustelimme erilaisista mekanismeista IDP-työnkulun lisäämiseksi LLM:iden kanssa Amazon Bedrockin, Amazon Textractin ja suositun LangChain-kehyksen kautta. Voit aloittaa uuden Amazon Textract -dokumenttien lataajan LangChainilla tänään käyttämällä mallimuistikirjoja, jotka ovat saatavilla meidän GitHub-arkisto. Lisätietoja generatiivisen tekoälyn kanssa työskentelystä AWS:ssä on kohdassa Ilmoitamme uusista työkaluista rakentamiseen generatiivisella tekoälyllä AWS:ssä.

Tietoja Tekijät

Sonali Sahu on johtava älykäs asiakirjojen käsittely AWS:n AI/ML-palvelutiimin kanssa. Hän on kirjailija, ajatusjohtaja ja intohimoinen tekniikan asiantuntija. Hänen painopistealueensa ovat tekoäly ja ML, ja hän puhuu usein tekoäly- ja ML-konferensseissa ja tapaamisissa ympäri maailmaa. Hänellä on sekä laaja että syvällinen kokemus teknologiasta ja teknologiateollisuudesta, ja hänellä on alan asiantuntemusta terveydenhuollon, rahoitussektorin ja vakuutuksen aloilta.

Sonali Sahu on johtava älykäs asiakirjojen käsittely AWS:n AI/ML-palvelutiimin kanssa. Hän on kirjailija, ajatusjohtaja ja intohimoinen tekniikan asiantuntija. Hänen painopistealueensa ovat tekoäly ja ML, ja hän puhuu usein tekoäly- ja ML-konferensseissa ja tapaamisissa ympäri maailmaa. Hänellä on sekä laaja että syvällinen kokemus teknologiasta ja teknologiateollisuudesta, ja hänellä on alan asiantuntemusta terveydenhuollon, rahoitussektorin ja vakuutuksen aloilta.

Anjan Biswas on vanhempi AI-palveluratkaisuarkkitehti, joka keskittyy tekoälyyn/ML:ään ja data-analyyseihin. Anjan on osa maailmanlaajuista tekoälypalvelutiimiä ja työskentelee asiakkaiden kanssa auttaakseen heitä ymmärtämään ja kehittämään ratkaisuja tekoälyn ja ML:n liiketoimintaongelmiin. Anjanilla on yli 14 vuoden kokemus työskentelystä maailmanlaajuisten toimitusketju-, valmistus- ja vähittäismyyntiorganisaatioiden kanssa, ja hän auttaa aktiivisesti asiakkaita pääsemään alkuun ja skaalaamaan AWS AI -palveluita.

Anjan Biswas on vanhempi AI-palveluratkaisuarkkitehti, joka keskittyy tekoälyyn/ML:ään ja data-analyyseihin. Anjan on osa maailmanlaajuista tekoälypalvelutiimiä ja työskentelee asiakkaiden kanssa auttaakseen heitä ymmärtämään ja kehittämään ratkaisuja tekoälyn ja ML:n liiketoimintaongelmiin. Anjanilla on yli 14 vuoden kokemus työskentelystä maailmanlaajuisten toimitusketju-, valmistus- ja vähittäismyyntiorganisaatioiden kanssa, ja hän auttaa aktiivisesti asiakkaita pääsemään alkuun ja skaalaamaan AWS AI -palveluita.

Chinmayee Rane on AI/ML Specialist Solutions -arkkitehti Amazon Web Servicesissä. Hän on intohimoinen soveltavaan matematiikkaan ja koneoppimiseen. Hän keskittyy älykkäiden asiakirjojen käsittelyyn ja luovien tekoälyratkaisujen suunnitteluun AWS-asiakkaille. Työn ulkopuolella hän harrastaa salsaa ja bachata-tanssia.

Chinmayee Rane on AI/ML Specialist Solutions -arkkitehti Amazon Web Servicesissä. Hän on intohimoinen soveltavaan matematiikkaan ja koneoppimiseen. Hän keskittyy älykkäiden asiakirjojen käsittelyyn ja luovien tekoälyratkaisujen suunnitteluun AWS-asiakkaille. Työn ulkopuolella hän harrastaa salsaa ja bachata-tanssia.

- SEO-pohjainen sisällön ja PR-jakelu. Vahvista jo tänään.

- PlatoData.Network Vertical Generatiivinen Ai. Vahvista itseäsi. Pääsy tästä.

- PlatoAiStream. Web3 Intelligence. Tietoa laajennettu. Pääsy tästä.

- PlatoESG. hiili, CleanTech, energia, ympäristö, Aurinko, Jätehuolto. Pääsy tästä.

- PlatonHealth. Biotekniikan ja kliinisten kokeiden älykkyys. Pääsy tästä.

- Lähde: https://aws.amazon.com/blogs/machine-learning/intelligent-document-processing-with-amazon-textract-amazon-bedrock-and-langchain/

- :on

- :On

- :ei

- :missä

- .liite

- $1000

- $ YLÖS

- 1

- 10

- 100

- 11

- 12

- 13

- 14

- 15%

- 16

- 22

- 23

- 33

- 35%

- 7

- 9

- a

- kyvyt

- Meistä

- absoluuttinen

- pääsy

- Accessed

- Mukaan

- tarkkuus

- tarkka

- saavutettu

- poikki

- Toiminta

- toimet

- aktiivisesti

- toiminta

- säädökset

- Ad

- osoite

- Lisää

- noudattaa

- myöntää

- hyväksytty

- edistysaskeleet

- Etu

- tulo

- ikä

- aineet

- AI

- Tekoälyn palvelut

- AI / ML

- linjassa

- Kaikki

- Salliminen

- mahdollistaa

- pitkin

- Myös

- vaihtoehto

- Vaikka

- Amazon

- Amazonin käsitys

- Amazon RDS

- Amazonin teksti

- Amazon Web Services

- määrät

- an

- Analytics

- analysoida

- ja

- vastaus

- Antropinen

- Kaikki

- API

- sovellukset

- sovellettu

- nimitykset

- lähestymistapa

- arkkitehtuuri

- OVAT

- ALUE

- noin

- Art

- keinotekoinen

- tekoäly

- Tekoäly (AI)

- AS

- ulkomuoto

- auttaa

- Avustaja

- At

- lisätä

- täydennetty

- kirjoittaja

- automatisoida

- Automatisoitu

- automaattisesti

- Automaatio

- saatavissa

- tietoisuus

- AWS

- AWS asiakas

- Pankki

- BE

- koska

- tulee

- ollut

- ennen

- suotuisa

- hyödyttää

- PARAS

- parhaat käytännöt

- välillä

- Tukkia

- Blocks

- sekä

- leveys

- Tauko

- taukoja

- rakentaa

- Rakentaminen

- sisäänrakennettu

- liiketoiminta

- yritykset

- mutta

- by

- Puhelut

- CAN

- Voi saada

- kyvyt

- kaapata

- tapaus

- tapauksissa

- Solut

- tietty

- ketju

- kahleet

- haaste

- haastava

- muuttaa

- Muutokset

- muuttuviin

- Tarkastukset

- valinta

- vaatimukset

- luokka

- luokat

- luokittelu

- luokitella

- koodi

- JOHDONMUKAINEN

- yhteistyö

- Sarake

- Pylväät

- yhdistelmä

- yhdistää

- tulee

- Yhteinen

- yleisesti

- Viestintä

- yhteensopiva

- täydellinen

- monimutkainen

- monimutkaisuus

- ymmärtää

- suppea

- konferenssit

- Kytkeminen

- johdonmukainen

- muodostuu

- rajoitteet

- rakentaa

- sisältää

- sisälsi

- sisältää

- pitoisuus

- tausta

- asiayhteyteen

- muuntaa

- Ydin

- korjata

- korjattu

- Korjaukset

- voisi

- veneet

- muotoillun

- luo

- ratkaiseva

- asiakassuhde

- asiakas

- Asiakkaat

- tanssi

- tiedot

- Data Analytics

- tietokanta

- tietokannat

- Päivämäärä

- Päivämäärät

- sopimus

- syvä

- syvempää

- määritellä

- määritelty

- määrittelemällä

- osoittivat

- Riippuen

- talletukset

- syvyys

- on kuvattu

- kuvaus

- suunnittelu

- haluttu

- yksityiskohta

- yksityiskohtainen

- yksityiskohdat

- havaita

- Määrittää

- kehittää

- kehittäjille

- Ruokavalio

- eri

- suoraan

- pohtia

- keskusteltiin

- sukellus

- jakaa

- jakaa

- do

- Lääkäri

- asiakirja

- dokumentointi

- asiakirjat

- naarasjänis

- ei

- tekee

- Don

- tehty

- Dont

- alas

- dramaattisesti

- kaksi

- aikana

- dynaaminen

- e

- kukin

- Aikaisemmin

- helposti

- helppo käyttää

- tehokkaasti

- tehokkuus

- tehokas

- tehokkaasti

- ponnisteluja

- myöskään

- elementtejä

- Upottaa

- Työllisiä

- valtuutetaan

- mahdollistaa

- mahdollistaa

- mahdollistaa

- loppu

- Tekniikka

- parantaa

- tehostettu

- parantaa

- varmistaa

- varmistamalla

- Koko

- yksiköt

- kokonaisuus

- varustettu

- virheet

- olennainen

- Jopa

- esimerkki

- Paitsi

- poikkeus

- olemassa

- experience

- asiantuntemus

- Selittää

- selitti

- selittää

- selitys

- nimenomaisesti

- lauseke

- laajentaa

- laajentaminen

- laaja

- uute

- uuttaminen

- otteet

- Pudota

- väärä

- paljon

- väsymys

- Fields

- Kuva

- lopullinen

- Vihdoin

- taloudellinen

- Taloussektori

- Etunimi

- sovittaa

- Keskittää

- keskittyy

- seurata

- seurannut

- jälkeen

- seuraa

- varten

- muoto

- lomakkeet

- löytyi

- perusta

- Puitteet

- Ilmainen

- usein

- alkaen

- Raja

- koko

- täysin

- edelleen

- tulevaisuutta

- general

- tuottaa

- syntyy

- synnyttää

- tuottaa

- sukupolvi

- generatiivinen

- Generatiivinen AI

- saada

- Antaa

- tietty

- Global

- kielioppi

- ymmärtää

- suurempi

- Ryhmä

- ohjaavat

- käsi

- kahva

- tapahtua

- Happening

- Palvelimet

- Olla

- otsikot

- terveydenhuollon

- raskaasti

- auttaa

- hyödyllinen

- auttaa

- auttaa

- hänen

- tätä

- korkean tason

- suorituskykyinen

- korkeampi

- pitää

- sairaala

- Miten

- Miten

- Kuitenkin

- HTML

- HTTPS

- ihmisen

- i

- ID

- tunnistettu

- if

- havainnollistaa

- kuva

- suunnattomasti

- Vaikutus

- tuoda

- tärkeä

- tuovan

- määrätä

- parannus

- in

- Mukaan lukien

- indeksi

- teollisuus

- tiedot

- Tietokausi

- Innovaatio

- panos

- oivalluksia

- esimerkki

- ohjeet

- vakuutus

- yhdistää

- integroitu

- Integrointi

- integraatio

- Älykkyys

- Älykäs

- Älykäs asiakirjojen käsittely

- tarkoitettu

- sisäisesti

- tulee

- koukerot

- esitellä

- käyttöön

- Esittelee

- IT

- SEN

- Jackson

- Johannes

- JOHN DOE

- jon

- jpg

- json

- vain

- avain

- avaimet

- Tietää

- tuntemus

- tunnettu

- Kieli

- suuri

- Layout

- johtaa

- johtaja

- johtava

- oppiminen

- jättäen

- Kirjasto

- pitää

- Todennäköisesti

- rajoitukset

- rajat

- Lista

- OTK

- kuormitus

- loader

- logiikka

- katso

- Erä

- kone

- koneoppiminen

- Tekeminen

- hoitaa

- hallittavissa

- onnistui

- toimitusjohtaja

- manuaalinen

- valmistus

- merkitty

- matematiikka

- Saattaa..

- me

- merkitys

- mielekäs

- välineet

- mekanismi

- mekanismit

- Meetups

- Muisti

- Meta

- Metadata

- menetelmä

- menetelmät

- ehkä

- mielessä

- menettää

- virheitä

- ML

- malli

- mallit

- Moduulit

- lisää

- kiinnitykset

- eniten

- moninkertainen

- nimi

- nimet

- Luonnollinen

- Luonnollinen kielen käsittely

- välttämätön

- Tarve

- tarvitaan

- tarpeet

- Uusi

- seuraava

- ensi viikko

- NLP

- muistikirja

- nyt

- vivahteet

- numero

- objekti

- esineet

- of

- Tarjoukset

- usein

- on

- ONE

- vain

- avoimen lähdekoodin

- Operations

- Tilaisuus

- optimaalinen

- Vaihtoehdot

- or

- organisaatioiden

- alkuperäinen

- Muut

- muuten

- meidän

- ulos

- Tulos

- ulostulo

- lähdöt

- ulkopuolella

- yli

- yleiskatsaus

- paketit

- sivulla

- sivut

- Kipu

- pariksi

- paria

- osa

- erityisesti

- kulkea

- Hyväksytty

- Ohimenevä

- intohimoinen

- polku

- potilas

- Kuvio

- kuviot

- varten

- Suorittaa

- suorituskyky

- suoritettu

- esittävä

- suorittaa

- vaihe

- phd

- lausekkeet

- putki

- suunnitelma

- Platon

- Platonin tietotieto

- PlatonData

- Ole hyvä

- keuhkokuume

- pistettä

- Suosittu

- mahdollinen

- Kirje

- mahdollinen

- teho

- powered

- voimakas

- käytännöt

- tarkasti

- Tarkkuus

- Suositut

- esittää

- aiemmin

- pääasiallisesti

- Painaa

- tulosteet

- Ongelma

- ongelmia

- prosessi

- Käsitelty

- käsittely

- tuottaa

- Promises

- asianmukainen

- toimittaa

- mikäli

- toimittaja

- tarjoaa

- Python

- Kysymyksiä ja vastauksia

- laatu

- kysymys

- nopea

- nopeasti

- raaka

- Lukeminen

- tunnistaa

- vähentämällä

- katso

- viite

- tarkoitettuja

- Ihmissuhteet

- merkityksellinen

- luottaa

- luottaen

- huomattava

- raportti

- edustaa

- edustavat

- tarvitaan

- Vaatii

- vastaavasti

- vasteet

- rajoitukset

- johtua

- Saatu ja

- tulokset

- vähittäiskauppa

- säilyttää

- säilyttäen

- Tuotto

- Rikas

- Huone

- säännöt

- ajaa

- toimii

- s

- turvallisesti

- sama

- sanoa

- Asteikko

- skenaariot

- suunniteltu

- Haku

- Toinen

- Osa

- osiot

- sektori

- nähdä

- segmentit

- valittu

- vanhempi

- tuomita

- Sarjat

- palvella

- palvelee

- palvelu

- Palvelut

- setti

- vaikea

- hän

- Lyhyt

- shouldnt

- esitetty

- Näytä

- merkittävä

- single

- pieni

- pienempiä

- pätkä

- So

- Yksin

- Ratkaisumme

- SOLVE

- jonkin verran

- lähde

- Tila

- puhuu

- asiantuntija

- erityinen

- erityisesti

- määritelty

- oikeinkirjoitus

- jakaa

- vaiheissa

- standardointi

- Alkaa

- alkoi

- huippu-

- Lausunto

- Vaihe

- Askeleet

- Yhä

- verkkokaupasta

- tallennettu

- varastot

- vahvuudet

- jono

- rakenteellinen

- rakenne

- jäsennelty

- taistelu

- myöhempi

- Myöhemmin

- niin

- ehdottaa

- yhteenveto

- YHTEENVETO

- toimittaa

- toimitusketju

- tuki

- Tukee

- synergia

- järjestelmät

- taulukko

- ottaa

- vie

- Tehtävä

- tehtävät

- joukkue-

- tekniikka

- tekniikat

- teknologi

- Elektroniikka

- sapluuna

- ehdot

- teksti

- teksti-

- kuin

- että

- -

- maailma

- heidän

- Niitä

- sitten

- Siellä.

- siksi

- Nämä

- ne

- tätä

- ajatus

- kolmella

- Kautta

- Titaani

- että

- tänään

- tämän päivän

- yhdessä

- symbolinen

- tokens

- TONE

- työkalut

- ylin

- Yhteensä

- perinteinen

- Kumulatiivinen

- koulutus

- Liiketoimet

- Muuttaa

- muunnokset

- totta

- yrittää

- kaksi

- tyyppi

- tyypit

- ymmärtää

- ymmärtäminen

- toisin kuin

- paljastus

- URL

- käyttää

- käyttölaukku

- käytetty

- Käyttäjät

- käyttötarkoituksiin

- käyttämällä

- hyödynnetty

- Hyödyntämällä

- v1

- arvo

- arvot

- muuttuja

- eri

- valtava

- monipuolinen

- versio

- kautta

- Näytä

- volyymit

- läpikäynti

- haluta

- oli

- Tapa..

- we

- verkko

- verkkopalvelut

- viikko

- HYVIN

- Mitä

- kun

- joka

- vaikka

- KUKA

- tulee

- with

- sisällä

- ilman

- todistamassa

- sana

- sanoja

- Referenssit

- työnkulku

- työnkulkuja

- työskentely

- toimii

- maailman-

- olisi

- kirjallinen

- X

- vuotta

- Voit

- zephyrnet