Ottaessaan malleja tuotantoon organisaatiot etsivät jatkuvasti tapoja optimoida uusimmilla kiihdyttimillä toimivien perusmalliensa (FM) suorituskykyä, kuten esim. AWS Inferencia ja GPU:t, jotta ne voivat alentaa kustannuksiaan ja lyhentää vastausviivettä tarjotakseen loppukäyttäjille parhaan kokemuksen. Jotkut FM:t eivät kuitenkaan hyödynnä täysin niiden esiintymien kanssa saatavilla olevia kiihdyttimiä, joissa ne on otettu käyttöön, mikä johtaa laitteistoresurssien tehottomaan käyttöön. Jotkut organisaatiot ottavat käyttöön useita FM-laitteita samaan esiintymään hyödyntääkseen paremmin kaikkia saatavilla olevia kiihdyttimiä, mutta tämä vaatii monimutkaista infrastruktuurin organisointia, joka on aikaa vievää ja vaikeasti hallittavaa. Kun useat FM:t jakavat saman ilmentymän, jokaisella FM:llä on omat skaalaustarpeensa ja käyttömallinsa, joten on haastavaa ennustaa, milloin esiintymiä on lisättävä tai poistettava. Esimerkiksi yhtä mallia voidaan käyttää tehostamaan käyttäjäsovellusta, jossa käyttö voi nousta tiettyinä tunteina, kun taas toisella mallilla voi olla johdonmukaisempi käyttömalli. Kustannusten optimoinnin lisäksi asiakkaat haluavat tarjota parhaan loppukäyttäjäkokemuksen vähentämällä viivettä. Tätä varten he käyttävät usein useita FM-kopioita käyttäjien pyyntöihin rinnakkain. Koska FM-ulostulot voivat vaihdella yhdestä lauseesta useisiin kappaleisiin, päättelypyynnön suorittamiseen kuluva aika vaihtelee huomattavasti, mikä johtaa arvaamattomiin piikeihin latenssissa, jos pyynnöt reititetään satunnaisesti esiintymien välillä. Amazon Sage Maker tukee nyt uusia päättelyominaisuuksia, jotka auttavat sinua vähentämään käyttöönottokustannuksia ja viivettä.

Voit nyt luoda päättelykomponentteihin perustuvia päätepisteitä ja ottaa koneoppimismalleja (ML) käyttöön SageMaker-päätepisteeseen. Päätelmäkomponentti (IC) abstraktioi ML-mallistasi ja antaa sinun määrittää prosessorit, grafiikkasuorittimet tai AWS Neuron kiihdyttimiä ja mallikohtaisia skaalauskäytäntöjä. Päätelmäkomponentit tarjoavat seuraavat edut:

- SageMaker sijoittaa ja pakkaa mallit optimaalisesti ML-esiintymiin maksimoidakseen käytön, mikä johtaa kustannussäästöihin.

- SageMaker skaalaa jokaisen mallin ylös ja alas kokoonpanosi perusteella vastaamaan ML-sovellusvaatimuksiasi.

- SageMaker skaalautuu ja lisää ja poistaa ilmentymiä dynaamisesti varmistaakseen kapasiteetin olevan käytettävissä pitäen tyhjäkäynnin laskennan minimissä.

- Voit skaalata mallin nollaan kopioita vapauttaaksesi resursseja muille malleille. Voit myös määrittää, että tärkeät mallit pysyvät aina ladattuina ja valmiina palvelemaan liikennettä.

Näiden ominaisuuksien avulla voit vähentää mallin käyttöönottokustannuksia keskimäärin 50 %. Kustannussäästöt vaihtelevat työmääräsi ja liikennemalleidesi mukaan. Otetaan yksinkertainen esimerkki havainnollistaaksesi, kuinka useiden mallien pakkaaminen yhteen päätepisteeseen voi maksimoida käytön ja säästää kustannuksia. Oletetaan, että sinulla on chat-sovellus, joka auttaa turisteja ymmärtämään paikallisia tapoja ja parhaita käytäntöjä, jotka on rakennettu käyttämällä kahta Llama 2 -versiota: toinen on hienosäädetty eurooppalaisille vierailijoille ja toinen amerikkalaisille vierailijoille. Odotamme liikennettä eurooppalaiselle mallille klo 00–01 UTC ja amerikkalaisen mallille klo 11–59 UTC. Sen sijaan, että ottaisit nämä mallit käyttöön omissa tapauksissa, joissa ne ovat käyttämättömänä puolet ajasta, voit nyt ottaa ne käyttöön yhdessä päätepisteessä kustannusten säästämiseksi. Amerikkalaisen mallin voi pienentää nollaan, kun sitä ei tarvita kapasiteettia vapauttamaan eurooppalaiseen malliin ja päinvastoin. Näin voit hyödyntää laitteistoasi tehokkaasti ja välttää hukkaa. Tämä on yksinkertainen esimerkki kahdesta mallista, mutta voit helposti laajentaa tätä ideaa pakataksesi satoja malleja yhteen päätepisteeseen, joka skaalautuu automaattisesti ylös ja alas työkuormasi mukaan.

Tässä viestissä näytämme sinulle IC-pohjaisten SageMaker-päätepisteiden uudet ominaisuudet. Ohjaamme sinut myös useiden mallien käyttöönotossa päättelykomponenttien ja API:iden avulla. Lopuksi kerromme yksityiskohtaisesti joitain uusia havainnointiominaisuuksia ja kuinka voit määrittää automaattisen skaalauskäytännön malleillesi ja hallita päätepisteidesi ilmentymien skaalausta. Voit myös ottaa malleja käyttöön uuden yksinkertaistetun, interaktiivisen käyttökokemuksemme kautta. Tuemme myös edistyneitä reititysominaisuuksia optimoidaksemme päättelykuormituksiesi viiveen ja suorituskyvyn.

Rakennuspalikoita

Katsotaanpa tarkemmin ja ymmärrämme, miten nämä uudet ominaisuudet toimivat. Seuraavassa on joitain uutta terminologiaa SageMaker-isännöinnille:

- Päätelmäkomponentti – SageMaker-isäntäobjekti, jonka avulla voit ottaa mallin käyttöön päätepisteeseen. Voit luoda päättelykomponentin toimittamalla seuraavat tiedot:

- SageMaker-malli tai SageMaker-yhteensopivan kuvan ja mallin artefaktien spesifikaatio.

- Laske resurssivaatimukset, jotka määrittävät mallisi jokaisen kopion tarpeet, mukaan lukien suorittimen ytimet, isäntämuisti ja kiihdyttimien määrä.

- Mallin kopio – Ajonaikainen kopio päättelykomponentista, joka pystyy palvelemaan pyyntöjä.

- Hallitun ilmentymän automaattinen skaalaus – SageMaker-isännöintikyky suurentaa tai vähentää päätepisteessä käytettävien laskentaesiintymien määrää. Instanssiskaalaus reagoi päättelykomponenttien skaalaukseen.

Voit luoda uuden päättelykomponentin määrittämällä säilön kuvan ja malliartefaktin tai voit käyttää SageMaker-malleja, jotka olet ehkä jo luonut. Sinun on myös määritettävä laskentaresurssivaatimukset, kuten isäntäprosessoriytimien määrä, isäntämuisti tai kiihdyttimien määrä, jota mallisi tarvitsee suorittaakseen.

Kun otat käyttöön päättelykomponentin, voit määrittää MinCopies varmistaaksesi, että mallia on jo ladattu tarvitsemassasi määrässä ja valmiina palvelemaan pyyntöjä.

Voit myös määrittää käytännöt niin, että päättelykomponenttien kopiot skaalautuvat nollaan. Jos esimerkiksi IC:tä vastaan ei kohdistu kuormaa, mallin kopio puretaan. Tämä voi vapauttaa resursseja, jotka voidaan korvata aktiivisilla työkuormilla päätepisteesi käytön ja tehokkuuden optimoimiseksi.

Kun päättelypyynnöt lisääntyvät tai vähenevät, IC:iden kopioiden määrä voi myös skaalata ylös tai alas automaattisen skaalauskäytäntöjesi mukaan. SageMaker hoitaa sijoittelun optimoidakseen malliesi pakkauksen saatavuuden ja kustannusten mukaan.

Lisäksi, jos otat hallitun ilmentymän automaattisen skaalaus käyttöön, SageMaker skaalaa ilmentymät niiden päättelykomponenttien lukumäärän mukaan, jotka on ladattava tietyllä hetkellä liikenteen palvelemiseksi. SageMaker skaalaa ilmentymiä ja pakkaa ilmentymäsi ja päättelykomponentit optimoidaksesi kustannukset säilyttäen samalla mallin suorituskyvyn. Vaikka suosittelemmekin hallitun ilmentymän skaalauksen käyttöä, voit halutessasi myös hallita skaalausta itse sovelluksen automaattisen skaalauksen avulla.

SageMaker tasapainottaa päättelykomponentit ja pienentää esiintymiä, jos päättelykomponentit eivät enää tarvitse niitä, ja säästää kustannuksia.

API:iden esittely

SageMaker on ottanut käyttöön uuden kokonaisuuden nimeltä InferenceComponent. Tämä erottaa ML-mallin isännöinnin yksityiskohdat itse päätepisteestä. The InferenceComponent Voit määrittää mallin isännöinnin tärkeimmät ominaisuudet, kuten käytettävän SageMaker-mallin tai säilön tiedot ja mallin artefaktit. Voit myös määrittää itse otettavien komponenttien kopioiden määrän ja vaadittavien kiihdyttimien (GPU-, Inf- tai Trn-kiihdytin) tai suorittimen (vCPU:t) määrän. Tämä tarjoaa enemmän joustavuutta, jotta voit käyttää yhtä päätepistettä useille malleille, jotka aiot ottaa siihen käyttöön tulevaisuudessa.

Katsotaanpa Boto3 API -kutsuja päätepisteen luomiseksi päätelmäkomponentilla. Huomaa, että on joitain parametreja, joita käsittelemme myöhemmin tässä viestissä.

Seuraava on esimerkkikoodi CreateEndpointConfig:

Seuraava on esimerkkikoodi CreateEndpoint:

Seuraava on esimerkkikoodi CreateInferenceComponent:

Tämä irrottaminen InferenceComponent päätepisteeseen tarjoaa joustavuutta. Voit isännöidä useita malleja samassa infrastruktuurissa ja lisätä tai poistaa niitä tarpeidesi muuttuessa. Jokainen malli voidaan päivittää itsenäisesti tarpeen mukaan. Lisäksi voit skaalata malleja yrityksesi tarpeiden mukaan. InferenceComponent Voit myös ohjata kapasiteettia mallikohtaisesti. Toisin sanoen voit määrittää, kuinka monta kopiota kustakin mallista isännöidä. Tämä ennustettava skaalaus auttaa sinua täyttämään kunkin mallin erityiset latenssivaatimukset. Yleensä ottaen, InferenceComponent antaa sinulle paljon enemmän hallintaa isännöityihin malleihisi.

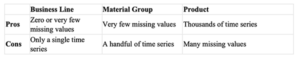

Seuraavassa taulukossa näytämme vertailun korkean tason lähestymistavasta päätepisteen luomiseen ja kutsumiseen ilman InferenceComponent ja InferenceComponent. Huomaa, että CreateModel() on nyt valinnainen IC-pohjaisissa päätepisteissä.

| Vaihe | Mallipohjaiset päätepisteet | Päättele komponenttipohjaiset päätepisteet |

| 1 | Luo malli (…) | CreateEndpointConfig(…) |

| 2 | CreateEndpointConfig(…) | Luo päätepiste (…) |

| 3 | Luo päätepiste (…) | CreateInferenceComponent(…) |

| 4 | InvokeEndpoint (…) | InvokeEndpoint(InferneceComponentName='arvo'…) |

Käyttöönotto InferenceComponent voit skaalata mallitasolla. Katso Tutustu ilmentymien ja IC:n automaattiseen skaalaukseen saadaksesi lisätietoja miten InferenceComponent toimii automaattisen skaalauksen kanssa.

Kun kutsut SageMaker-päätepistettä, voit nyt määrittää uuden parametrin InferenceComponentName osumaan haluttuun InferenceComponentName. SageMaker käsittelee pyynnön reitityksen instanssiin, joka isännöi pyydettyä InferenceComponentName. Katso seuraava koodi:

Oletusarvoisesti SageMaker käyttää pyyntöjen satunnaista reititystä päätepistettäsi tukeviin esiintymiin. Jos haluat ottaa käyttöön vähiten jäljellä olevien pyyntöjen reitityksen, voit määrittää reititysstrategian päätepisteen asetuksissa. RoutingConfig:

Vähiten jäljellä olevat pyynnöt reitittävät reitit tiettyihin esiintymiin, joilla on enemmän kapasiteettia käsitellä pyyntöjä. Tämä takaa tasaisemman kuormituksen ja resurssien käytön.

Lisäksi CreateInferenceComponent, seuraavat sovellusliittymät ovat nyt saatavilla:

DescribeInferenceComponentDeleteInferenceComponentUpdateInferenceComponentListInferenceComponents

InferenceComponent lokit ja mittarit

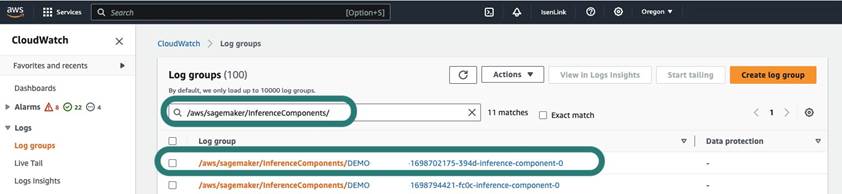

InferenceComponent lokit sijaitsevat /aws/sagemaker/InferenceComponents/<InferenceComponentName>. Kaikki stderr- ja stdout-lokit säilössä lähetetään näihin lokeihin amazonin pilvikello.

IC-pohjaisten päätepisteiden käyttöönoton myötä sinulla on nyt mahdollisuus tarkastella muita ilmentymän mittareita, päättelykomponenttien mittareita ja kutsumittareita.

SageMaker-esiintymien osalta voit nyt seurata GPUReservation ja CPUReservation mittareita, jotta näet päätepisteelle varatut resurssit käyttämiesi päättelykomponenttien perusteella. Nämä tiedot voivat auttaa sinua määrittämään päätepisteesi ja automaattisen skaalauskäytännön. Voit myös tarkastella kaikkiin päätepisteeseen otettuihin malleihin liittyviä koostetietoja.

SageMaker paljastaa myös mittareita päättelykomponenttitasolla, mikä voi näyttää yksityiskohtaisemman kuvan käyttämiesi päättelykomponenttien resurssien käytöstä. Näin voit saada näkemyksen siitä, kuinka paljon resurssien kokonaiskäyttöä käytetään esim GPUUtilizationNormalized ja GPUMemoryUtilizationNormalized jokaiselle käyttämäsi päättelykomponentille, jolla voi olla nolla tai monta kopiota.

Lopuksi SageMaker tarjoaa kutsumittareita, jotka nyt seuraavat päättelykomponenttien kutsuja aggregoidusti (Invocations) tai instantoitua kopiota kohti (InvocationsPerCopy)

Kattava luettelo mittareista on kohdassa SageMaker Endpoint Invocation Metrics.

Mallitason automaattinen skaalaus

Kuvailemamme automaattisen skaalauskäyttäytymisen toteuttamiseksi luodessasi SageMaker-päätepisteen konfiguraatiota ja päättelykomponenttia määrität alkuperäisen esiintymän määrän ja alkuperäisen mallin kopioiden määrän. Kun olet luonut päätepisteen ja vastaavat IC:t, sinun on ensin rekisteröitävä skaalauskohde ja liitettävä skaalauskäytäntö IC:hen, jotta voit käyttää automaattista skaalausta IC-tasolla.

Skaalauskäytäntöä toteutettaessa käytämme SageMakerInferenceComponentInvocationsPerCopy, joka on SageMakerin uusi mittari. Se tallentaa kutsujen keskimääräisen määrän mallikopiota kohti minuutissa.

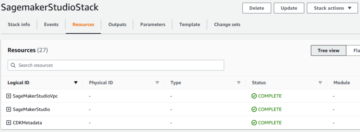

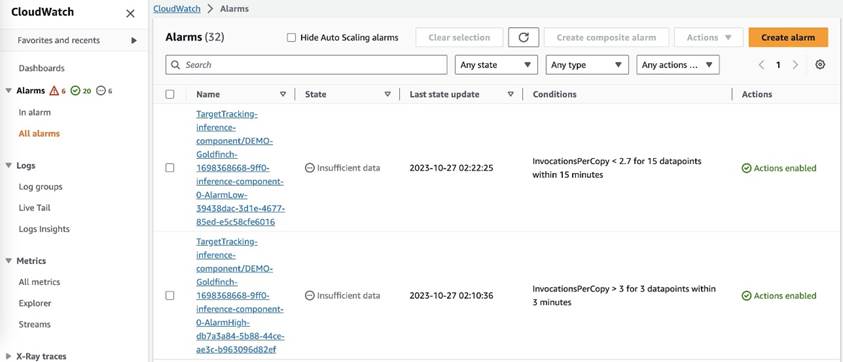

Kun olet asettanut skaalauskäytännön, SageMaker luo kaksi CloudWatch-hälytystä kullekin automaattisen skaalauksen kohteelle: yhden laukaisemaan skaalauksen, jos hälytyksessä on 3 minuuttia (kolme 1 minuutin datapistettä) ja toisen laukaisemaan skaalauksen, jos hälytys on 15 minuuttia. (15 1 minuutin datapistettä), kuten seuraavassa kuvakaappauksessa näkyy. Aika skaalaustoiminnon käynnistämiseen on yleensä 1–2 minuuttia pidempi kuin nämä minuutit, koska kuluu aikaa, ennen kuin päätepiste julkaisee mittareita CloudWatchiin, ja vie aikaa myös AutoScaling reagoida. Jäähtymisjakso on sekunteina ilmoitettu aika, joka kuluu laajennus- tai laajennustoiminnon päättymisen jälkeen, ennen kuin uusi laajennustoiminto voi alkaa. Jos skaalauksen jäähdytys on lyhyempi kuin päätepisteen päivitysaika, sillä ei ole vaikutusta, koska ei ole mahdollista päivittää SageMaker-päätepistettä, kun se on Päivittäminen tila.

Huomaa, että kun määrität IC-tason automaattista skaalausta, sinun on varmistettava, että MaxInstanceCount parametri on yhtä suuri tai pienempi kuin tämän päätepisteen käsittelemien IC:iden enimmäismäärä. Jos päätepisteesi on esimerkiksi määritetty sisältämään vain yksi ilmentymä päätepistemäärityksessä ja tämä ilmentymä voi isännöidä enintään neljää mallin kopiota, MaxInstanceCount on oltava yhtä suuri tai pienempi kuin 4. Voit kuitenkin myös käyttää SageMakerin tarjoamaa hallittua automaattista skaalausominaisuutta skaalataksesi ilmentymien määrän automaattisesti vaaditun mallin kopionumeron perusteella, jotta voidaan täyttää enemmän laskentaresursseja. Seuraava koodinpätkä näyttää, kuinka hallitun ilmentymän skaalaus määritetään päätepistemäärityksen luomisen aikana. Tällä tavalla, kun IC-tason automaattinen skaalaus vaatii enemmän esiintymien määrää mallikopioiden isännöimiseksi, SageMaker skaalaa automaattisesti ilmentymän numeron, jotta IC-tason skaalaus onnistuisi.

Voit soveltaa useita automaattisia skaalauskäytäntöjä samaan päätepisteeseen, mikä tarkoittaa, että voit soveltaa perinteistä automaattista skaalauskäytäntöä IC:illä luotuihin päätepisteisiin ja skaalata ylös ja alas muiden päätepistemittareiden perusteella. Lisätietoja on kohdassa Optimoi koneoppimisen käyttöönottosi automaattisella skaalauksella Amazon SageMakerissa. Vaikka tämä on mahdollista, suosittelemme kuitenkin käyttämään hallitun ilmentymän skaalausta itse skaalauksen hallinnan sijaan.

Yhteenveto

Tässä viestissä esittelimme SageMaker-päätelmän uuden ominaisuuden, joka auttaa sinua maksimoimaan laskentaesiintymien käytön, skaalata satoihin malleihin ja optimoimaan kustannukset samalla, kun se tarjoaa ennustettavan suorituskyvyn. Lisäksi esitimme sovellusliittymien esittelyn ja osoitimme, kuinka voit määrittää ja ottaa käyttöön päättelykomponentteja työkuormituksillesi.

Tuemme myös kehittyneet reititysominaisuudet optimoidaksesi päättelytyökuormien viiveen ja suorituskyvyn. SageMaker voi auttaa sinua optimoimaan päättelytyökuormituksen kustannusten ja suorituskyvyn kannalta ja antaa sinulle mallitason tarkkuuden hallintaan. Olemme luoneet a sarja muistikirjoja joka näyttää, kuinka voit ottaa käyttöön kolme eri mallia käyttämällä eri säilöjä ja käyttämällä automaattisia skaalauskäytäntöjä GitHubissa. Suosittelemme aloittamaan Notebook 1:llä ja tutustumaan SageMakerin uusiin hosting-ominaisuuksiin jo tänään!

Tietoja kirjoittajista

James Park on ratkaisuarkkitehti Amazon Web Servicesissä. Hän työskentelee Amazon.comin kanssa suunnitella, rakentaa ja ottaa käyttöön teknologiaratkaisuja AWS:ssä, ja hän on erityisen kiinnostunut tekoälystä ja koneoppimisesta. Vapaa-ajallaan hän nauttii uusien kulttuurien, uusien kokemusten etsimisestä ja uusimpien teknologiatrendien pysymisestä. Löydät hänet LinkedIn.

James Park on ratkaisuarkkitehti Amazon Web Servicesissä. Hän työskentelee Amazon.comin kanssa suunnitella, rakentaa ja ottaa käyttöön teknologiaratkaisuja AWS:ssä, ja hän on erityisen kiinnostunut tekoälystä ja koneoppimisesta. Vapaa-ajallaan hän nauttii uusien kulttuurien, uusien kokemusten etsimisestä ja uusimpien teknologiatrendien pysymisestä. Löydät hänet LinkedIn.

Melanie Li, PhD, on vanhempi AI/ML-asiantuntija TAM AWS:ssä Sydneyssä, Australiassa. Hän auttaa yritysasiakkaita rakentamaan ratkaisuja käyttämällä huippuluokan AI/ML-työkaluja AWS:ssä ja opastaa ML-ratkaisujen suunnittelussa ja toteuttamisessa parhaiden käytäntöjen mukaisesti. Vapaa-ajallaan hän rakastaa tutkia luontoa ja viettää aikaa perheen ja ystävien kanssa.

Melanie Li, PhD, on vanhempi AI/ML-asiantuntija TAM AWS:ssä Sydneyssä, Australiassa. Hän auttaa yritysasiakkaita rakentamaan ratkaisuja käyttämällä huippuluokan AI/ML-työkaluja AWS:ssä ja opastaa ML-ratkaisujen suunnittelussa ja toteuttamisessa parhaiden käytäntöjen mukaisesti. Vapaa-ajallaan hän rakastaa tutkia luontoa ja viettää aikaa perheen ja ystävien kanssa.

Marc Karp on ML-arkkitehti Amazon SageMaker Service -tiimin kanssa. Hän keskittyy auttamaan asiakkaita suunnittelemaan, ottamaan käyttöön ja hallitsemaan ML-työkuormia laajasti. Vapaa-ajallaan hän nauttii matkustamisesta ja uusien paikkojen tutkimisesta.

Marc Karp on ML-arkkitehti Amazon SageMaker Service -tiimin kanssa. Hän keskittyy auttamaan asiakkaita suunnittelemaan, ottamaan käyttöön ja hallitsemaan ML-työkuormia laajasti. Vapaa-ajallaan hän nauttii matkustamisesta ja uusien paikkojen tutkimisesta.

Alan Tan on SageMakerin vanhempi tuotepäällikkö, joka johtaa suuria mallipäätelmiä. Hän on intohimoinen koneoppimisen soveltamisesta analytiikan alalla. Työn ulkopuolella hän viihtyy ulkona.

Alan Tan on SageMakerin vanhempi tuotepäällikkö, joka johtaa suuria mallipäätelmiä. Hän on intohimoinen koneoppimisen soveltamisesta analytiikan alalla. Työn ulkopuolella hän viihtyy ulkona.

Raghu Ramesha on vanhempi ML-ratkaisuarkkitehti Amazon SageMaker Service -tiimissä. Hän keskittyy auttamaan asiakkaita rakentamaan, ottamaan käyttöön ja siirtämään ML-tuotannon työmäärät SageMakeriin suuressa mittakaavassa. Hän on erikoistunut koneoppimiseen, tekoälyyn ja tietokonenäköalueisiin, ja hänellä on tietojenkäsittelytieteen maisterin tutkinto UT Dallasista. Vapaa-ajallaan hän nauttii matkustamisesta ja valokuvaamisesta.

Raghu Ramesha on vanhempi ML-ratkaisuarkkitehti Amazon SageMaker Service -tiimissä. Hän keskittyy auttamaan asiakkaita rakentamaan, ottamaan käyttöön ja siirtämään ML-tuotannon työmäärät SageMakeriin suuressa mittakaavassa. Hän on erikoistunut koneoppimiseen, tekoälyyn ja tietokonenäköalueisiin, ja hänellä on tietojenkäsittelytieteen maisterin tutkinto UT Dallasista. Vapaa-ajallaan hän nauttii matkustamisesta ja valokuvaamisesta.

Rupinder Grewal on AWS:n Sr Ai/ML Specialist Solutions -arkkitehti. Tällä hetkellä hän keskittyy mallien ja MLO:iden tarjoamiseen SageMakerissa. Ennen tätä roolia hän on työskennellyt koneoppimisinsinöörinä mallien rakentamisessa ja isännöinnissa. Työn ulkopuolella hän pelaa tennistä ja pyöräilee vuoristopoluilla.

Rupinder Grewal on AWS:n Sr Ai/ML Specialist Solutions -arkkitehti. Tällä hetkellä hän keskittyy mallien ja MLO:iden tarjoamiseen SageMakerissa. Ennen tätä roolia hän on työskennellyt koneoppimisinsinöörinä mallien rakentamisessa ja isännöinnissa. Työn ulkopuolella hän pelaa tennistä ja pyöräilee vuoristopoluilla.

Dhawal Patel on AWS:n koneoppimisarkkitehti. Hän on työskennellyt organisaatioiden kanssa suurista yrityksistä keskikokoisiin startup-yrityksiin hajautettuun tietojenkäsittelyyn ja tekoälyyn liittyvien ongelmien parissa. Hän keskittyy syväoppimiseen, mukaan lukien NLP- ja Computer Vision -alueet. Hän auttaa asiakkaita tekemään korkean suorituskyvyn mallipäätelmiä SageMakerissa.

Dhawal Patel on AWS:n koneoppimisarkkitehti. Hän on työskennellyt organisaatioiden kanssa suurista yrityksistä keskikokoisiin startup-yrityksiin hajautettuun tietojenkäsittelyyn ja tekoälyyn liittyvien ongelmien parissa. Hän keskittyy syväoppimiseen, mukaan lukien NLP- ja Computer Vision -alueet. Hän auttaa asiakkaita tekemään korkean suorituskyvyn mallipäätelmiä SageMakerissa.

Saurabh Trikande on Amazon SageMaker Inferencen -tuotepäällikkö. Hän on intohimoinen asiakkaiden kanssa työskentelyyn, ja häntä motivoi tavoite demokratisoida koneoppimista. Hän keskittyy ydinhaasteisiin, jotka liittyvät monimutkaisten ML-sovellusten käyttöönottoon, usean vuokralaisen ML-malleihin, kustannusten optimointiin ja syvän oppimismallien käyttöönoton helpottamiseen. Vapaa-ajallaan Saurabh nauttii vaeltamisesta, innovatiivisten teknologioiden oppimisesta, TechCrunchien seuraamisesta ja perheensä kanssa viettämisestä.

Saurabh Trikande on Amazon SageMaker Inferencen -tuotepäällikkö. Hän on intohimoinen asiakkaiden kanssa työskentelyyn, ja häntä motivoi tavoite demokratisoida koneoppimista. Hän keskittyy ydinhaasteisiin, jotka liittyvät monimutkaisten ML-sovellusten käyttöönottoon, usean vuokralaisen ML-malleihin, kustannusten optimointiin ja syvän oppimismallien käyttöönoton helpottamiseen. Vapaa-ajallaan Saurabh nauttii vaeltamisesta, innovatiivisten teknologioiden oppimisesta, TechCrunchien seuraamisesta ja perheensä kanssa viettämisestä.

Lakshmi Ramakrishnan on AWS: n Amazon SageMaker Machine Learning (ML) -alustiimin pääinsinööri, joka tarjoaa tuotteelle teknisen johtajuuden. Hän on työskennellyt useissa insinööritehtävissä Amazonissa yli 9 vuoden ajan. Hänellä on insinöörin kandidaatin tutkinto tietotekniikasta Karnatakan Intian kansallisesta instituutista ja tietojenkäsittelytieteen maisteri Minnesotan kaksoiskaupunkien yliopistosta.

Lakshmi Ramakrishnan on AWS: n Amazon SageMaker Machine Learning (ML) -alustiimin pääinsinööri, joka tarjoaa tuotteelle teknisen johtajuuden. Hän on työskennellyt useissa insinööritehtävissä Amazonissa yli 9 vuoden ajan. Hänellä on insinöörin kandidaatin tutkinto tietotekniikasta Karnatakan Intian kansallisesta instituutista ja tietojenkäsittelytieteen maisteri Minnesotan kaksoiskaupunkien yliopistosta.

David Nigenda on vanhempi ohjelmistokehitysinsinööri Amazon SageMaker -tiimissä, joka työskentelee parhaillaan tuotannon koneoppimisen työnkulkujen parantamiseksi sekä uusien päättelyominaisuuksien lanseeraamiseksi. Vapaa-ajallaan hän yrittää pysyä lastensa kanssa.

David Nigenda on vanhempi ohjelmistokehitysinsinööri Amazon SageMaker -tiimissä, joka työskentelee parhaillaan tuotannon koneoppimisen työnkulkujen parantamiseksi sekä uusien päättelyominaisuuksien lanseeraamiseksi. Vapaa-ajallaan hän yrittää pysyä lastensa kanssa.

- SEO-pohjainen sisällön ja PR-jakelu. Vahvista jo tänään.

- PlatoData.Network Vertical Generatiivinen Ai. Vahvista itseäsi. Pääsy tästä.

- PlatoAiStream. Web3 Intelligence. Tietoa laajennettu. Pääsy tästä.

- PlatoESG. hiili, CleanTech, energia, ympäristö, Aurinko, Jätehuolto. Pääsy tästä.

- PlatonHealth. Biotekniikan ja kliinisten kokeiden älykkyys. Pääsy tästä.

- Lähde: https://aws.amazon.com/blogs/machine-learning/reduce-model-deployment-costs-by-50-on-average-using-sagemakers-latest-features/

- :on

- :On

- :ei

- :missä

- $ YLÖS

- 1

- 10

- 100

- 114

- 12

- 13

- 15%

- 150

- 16

- 22

- 360

- 362

- 500

- 7

- 9

- a

- kyky

- pystyy

- Meistä

- abstrakteja

- kiihdyttimiä

- saatavilla

- Mukaan

- Saavuttaa

- Toiminta

- aktiivinen

- toiminta

- lisätä

- lisää

- Lisäksi

- lisä-

- Lisäksi

- osoite

- kehittynyt

- Jälkeen

- vastaan

- aggregaatti

- AI

- AI / ML

- Alan

- hälytys

- Kaikki

- sallia

- mahdollistaa

- jo

- Myös

- Vaikka

- aina

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- Amazon.com

- Amerikkalainen

- määrä

- an

- Analytics

- ja

- Toinen

- Kaikki

- api

- API

- Hakemus

- sovellukset

- käyttää

- Hakeminen

- lähestymistapa

- OVAT

- ALUE

- keinotekoinen

- tekoäly

- AS

- Työtoveri

- liittyvä

- At

- Australia

- auto

- automaattisesti

- saatavuus

- saatavissa

- keskimäärin

- välttää

- AWS

- tausta

- perustua

- BE

- koska

- ennen

- käyttäytyminen

- Hyödyt

- PARAS

- parhaat käytännöt

- Paremmin

- välillä

- rakentaa

- Rakentaminen

- rakennettu

- liiketoiminta

- mutta

- by

- nimeltään

- Puhelut

- CAN

- kyvyt

- valmiudet

- kykenee

- Koko

- kaappaa

- tietty

- haasteet

- haastava

- muuttaa

- Valita

- Kaupungit

- koodi

- KOM

- vertailu

- täydellinen

- Täydentää

- monimutkainen

- komponentti

- osat

- kattava

- Laskea

- tietokone

- Tietojenkäsittelyoppi

- Tietokoneen visio

- tietojenkäsittely

- Konfigurointi

- määritetty

- johdonmukainen

- alituisesti

- kuluttaa

- Kontti

- Kontit

- ohjaus

- Ydin

- vastaava

- Hinta

- kustannussäästöjä

- kustannukset

- voisi

- luoda

- luotu

- luo

- Luominen

- luominen

- Tällä hetkellä

- Asiakkaat

- tulli

- Dallas

- tiedot

- datapisteet

- Päivämäärä

- vähentää

- omistautunut

- syvä

- syvä oppiminen

- syvempää

- oletusarvo

- määritellä

- Aste

- kaivaa

- Democratizing

- osoittaa

- Riippuen

- sijoittaa

- käyttöön

- levityspinnalta

- käyttöönotto

- käyttöönotot

- on kuvattu

- Malli

- haluttu

- yksityiskohta

- yksityiskohdat

- Määrittää

- Kehitys

- eri

- vaikea

- jaettu

- hajautettu laskenta

- do

- verkkotunnuksia

- Dont

- alas

- aikana

- dynaamisesti

- kukin

- helposti

- vaikutus

- tehokkuus

- tehokkaasti

- ponnisteluja

- mahdollistaa

- käytössä

- mahdollistaa

- kannustaa

- päätepiste

- insinööri

- Tekniikka

- varmistaa

- yritys

- yrityksille

- kokonaisuus

- yhtäläinen

- Eurooppalainen

- esimerkki

- odottaa

- experience

- Elämykset

- tutkia

- Tutkiminen

- laajentaa

- perhe

- Ominaisuus

- Ominaisuudet

- ala

- Löytää

- Etunimi

- Joustavuus

- keskittyy

- jälkeen

- varten

- perusta

- neljä

- Ilmainen

- ystäviä

- alkaen

- täysin

- Lisäksi

- tulevaisuutta

- saada

- gif

- GitHub

- Antaa

- tietty

- antaa

- tavoite

- GPU

- GPU

- rakeinen

- ohjaus

- Puoli

- kahva

- käsissä

- Palvelimet

- Olla

- he

- auttaa

- auttaa

- auttaa

- hänen

- Korkea

- korkean tason

- häntä

- hänen

- Osuma

- pitää

- isäntä

- isännöi

- hotellit

- TUNTIA

- Miten

- Miten

- Kuitenkin

- http

- HTTPS

- Sadat

- ajatus

- Idle

- if

- valaista

- kuva

- toteuttaa

- täytäntöönpanosta

- tärkeä

- parantaminen

- in

- Muilla

- Mukaan lukien

- Kasvaa

- itsenäisesti

- Intia

- tehoton

- tiedot

- tietotekniikka

- Infrastruktuuri

- ensimmäinen

- innovatiivinen

- innovatiivisia tekniikoita

- esimerkki

- sen sijaan

- Instituutti

- Älykkyys

- vuorovaikutteinen

- korko

- tulee

- käyttöön

- esittely

- IT

- SEN

- itse

- jpg

- Pitää

- pito

- avain

- Lasten

- suuri

- Suuret yritykset

- lopuksi

- Viive

- myöhemmin

- uusin

- käynnistäminen

- Johto

- johtava

- oppiminen

- vähiten

- Taso

- pitää

- Lista

- liekki

- kuormitus

- paikallinen

- sijaitsevat

- kauemmin

- katso

- näköinen

- rakastaa

- kone

- koneoppiminen

- tehdä

- Tekeminen

- hoitaa

- onnistui

- johto

- johtaja

- toimitusjohtaja

- monet

- mestari

- maisterin

- Maksimoida

- maksimi

- Saattaa..

- välineet

- Tavata

- Muisti

- metrinen

- Metrics

- vaeltaa

- minimi

- minuutti

- minuuttia

- ML

- MLOps

- malli

- mallit

- lisää

- motivoituneita

- Vuori

- paljon

- moninkertainen

- kansallinen

- luonto

- Tarve

- tarvitaan

- tarpeet

- Uusi

- NLP

- Nro

- huomata

- muistikirja

- nyt

- numero

- objekti

- of

- kampanja

- usein

- on

- ONE

- vain

- päälle

- Optimoida

- optimoimalla

- Vaihtoehto

- or

- orkestrointi

- organisaatioiden

- Muut

- meidän

- ulos

- ulkona

- lähdöt

- ulkopuolella

- erinomainen

- yli

- yleinen

- oma

- Pakkaus

- Parallel

- parametri

- parametrit

- erityinen

- intohimoinen

- Kuvio

- kuviot

- varten

- suorituskyky

- aika

- phd

- valokuvaus

- Paikka

- sijoitus

- paikat

- suunnitelma

- foorumi

- Platon

- Platonin tietotieto

- PlatonData

- pelaa

- pistettä

- politiikkaa

- politiikka

- mahdollinen

- Kirje

- teho

- käytännöt

- ennustaa

- Ennustettavissa

- säilöntä

- Pääasiallinen

- Aikaisempi

- ongelmia

- prosessi

- Tuotteet

- tuotepäällikkö

- tuotanto

- ominaisuudet

- toimittaa

- mikäli

- tarjoaa

- tarjoamalla

- julkaista

- määrä

- satunnainen

- alue

- alainen

- suhtautua

- Reagoi

- valmis

- tasapainottaa

- suositella

- vähentää

- vähentämällä

- katso

- ilmoittautua

- liittyvä

- poistaa

- poistamalla

- korvataan

- pyyntö

- pyynnöt

- edellyttää

- tarvitaan

- vaatimukset

- Vaatii

- varattu

- resurssi

- Esittelymateriaalit

- vastaavasti

- vastaus

- Rooli

- roolit

- reitit

- reititys

- ajaa

- juoksu

- runtime

- sagemaker

- SageMaker-johtopäätös

- sama

- Säästä

- Säästöt

- sanoa

- Asteikko

- asteikot

- skaalaus

- tiede

- sekuntia

- nähdä

- etsiä

- vanhempi

- lähetetty

- tuomita

- palvella

- palvelu

- Palvelut

- palvelevat

- setti

- asetus

- useat

- Jaa:

- hän

- shouldnt

- näyttää

- osoittivat

- esitetty

- merkittävästi

- Yksinkertainen

- yksinkertaistettu

- single

- istua

- Koko

- pienempiä

- pätkä

- So

- Tuotteemme

- ohjelmistokehitys

- Ratkaisumme

- jonkin verran

- asiantuntija

- erikoistunut

- erityinen

- määrittely

- viettää

- menot

- piikki

- piikkarit

- Alkaa

- Startups

- huippu-

- Tila

- pysyminen

- Yhä

- Strategia

- onnistunut

- niin

- toimittaa

- tuki

- Tukee

- varma

- sydney

- taulukko

- ottaa

- vie

- Kohde

- joukkue-

- TechCrunch

- Tekninen

- Technologies

- Elektroniikka

- tennis

- terminologia

- kuin

- että

- -

- Alue

- Tulevaisuus

- heidän

- Niitä

- sitten

- Siellä.

- Nämä

- ne

- tätä

- ne

- kolmella

- Kautta

- aika

- että

- työkalut

- raita

- perinteinen

- liikenne

- Matkustaminen

- Trendit

- laukaista

- twin

- kaksi

- ymmärtää

- yliopisto

- ennalta arvaamaton

- Päivitykset

- päivitetty

- Käyttö

- käyttää

- käytetty

- käyttäjä

- Käyttäjäkokemus

- Käyttäjät

- käyttötarkoituksiin

- käyttämällä

- yleensä

- UTC

- käyttää

- pahe

- Näytä

- visio

- Vierailijat

- kävellä

- läpikäynti

- haluta

- Jätteet

- Tapa..

- tavalla

- we

- verkko

- verkkopalvelut

- HYVIN

- kun

- taas

- joka

- vaikka

- tulee

- with

- ilman

- sanoja

- Referenssit

- työskenteli

- työnkulkuja

- työskentely

- toimii

- vuotta

- Voit

- Sinun

- itse

- zephyrnet

- nolla-