Pyrkiessämme rajoittamaan tekoälyn tuhoisaa potentiaalia, uusi Cambridgen yliopiston paperi on ehdottanut etätappamiskytkimien ja -sulkujen käyttöä, kuten ne, jotka on kehitetty estämään luvaton ydinaseiden laukaisu, sitä käyttävään laitteistoon.

Paperi [PDF], joka sisältää ääniä lukuisista akateemisista instituutioista ja useista OpenAI:sta, osoittaa, että näiden mallien tukeman laitteiston säätely voi olla paras tapa estää sen väärinkäyttö.

"Tekoälyyn liittyvä laskenta on erityisen tehokas interventiopiste: se on havaittavissa, poissuljettavissa ja kvantifioitavissa, ja se tuotetaan erittäin keskittyneen toimitusketjun kautta", tutkijat väittävät.

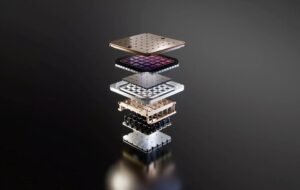

Tuotteliaisimpien mallien, joiden uskotaan ylittävän biljoona parametria, kouluttaminen vaatii valtavaa fyysistä infrastruktuuria: kymmeniä tuhansia GPU:ita tai kiihdyttimiä ja viikkoja tai jopa kuukausia käsittelyaikaa. Tämän vuoksi näiden resurssien olemassaolo ja suhteellinen suorituskyky on tutkijoiden mukaan vaikea piilottaa.

Lisäksi edistyneimmät sirut, joita käytetään näiden mallien koulutukseen, on valmistanut suhteellisen pieni määrä yrityksiä, kuten Nvidia, AMD ja Intel, jolloin päätöksentekijät voivat rajoittaa näiden tavaroiden myyntiä henkilöille tai maille, joita asia koskee.

Nämä tekijät, kuten muut, kuten puolijohteiden valmistuksen toimitusketjun rajoitukset, tarjoavat päätöksentekijöille keinot ymmärtää paremmin, miten ja missä tekoälyinfrastruktuuria käytetään, kuka saa ja ei saa käyttää sitä, ja määräävät rangaistuksia sen väärinkäytöstä, paperi väittää. .

Infrastruktuurin hallinta

Paperi korostaa lukuisia tapoja, joilla päätöksentekijät voivat lähestyä tekoälylaitteiston sääntelyä. Monet ehdotuksista – mukaan lukien ne, jotka on suunniteltu parantamaan näkyvyyttä ja rajoittamaan tekoälykiihdyttimien myyntiä – ovat jo käytössä kansallisella tasolla.

Viime vuonna Yhdysvaltain presidentti Joe Biden esitti toimeenpaneva määräys Tavoitteena on tunnistaa suuria kaksikäyttöisiä tekoälymalleja kehittäviä yrityksiä sekä niihin kykenevät infrastruktuuritoimittajat kouluttaa niitä. Jos et ole perehtynyt, "kaksoiskäyttö" tarkoittaa teknologioita, jotka voivat palvella kaksinkertaisesti siviili- ja sotilassovelluksissa.

Viime aikoina Yhdysvaltain kauppaministeriö ehdotettu asetus, joka vaatisi amerikkalaisia pilvipalveluntarjoajia ottamaan käyttöön tiukempia "tunte-asiakas" -käytäntöjä estääkseen huolta aiheuttavia henkilöitä tai maita kiertämästä vientirajoituksia.

Tällainen näkyvyys on arvokasta, tutkijat huomauttavat, koska se voisi auttaa välttämään toisen asevarustelun, kuten ohjusvälikiistan laukaiseman kilpailun, jossa virheelliset raportit johtivat massiiviseen ballististen ohjusten kertymiseen. Vaikka se on arvokasta, he varoittavat, että näiden raportointivaatimusten noudattaminen voi loukata asiakkaiden yksityisyyttä ja jopa johtaa arkaluonteisten tietojen vuotamiseen.

Samaan aikaan kaupan rintamalla kauppaministeriö on jatkanut astua rajoituksia, jotka rajoittavat Kiinaan myytävien kiihdyttimien suorituskykyä. Mutta kuten olemme aiemmin raportoineet, vaikka nämä ponnistelut ovat tehneet Kiinan kaltaisten maiden vaikeuksia saada käsiinsä amerikkalaisia pelimerkkejä, ne ovat kaukana täydellisyydestä.

Näiden rajoitusten korjaamiseksi tutkijat ovat ehdottaneet maailmanlaajuisen AI-sirujen myyntirekisterin käyttöönottoa, joka jäljittäisi niitä heidän elinkaarensa aikana, jopa sen jälkeen, kun he ovat lähteneet kotimaastaan. He ehdottavat, että tällainen rekisteri voisi sisällyttää jokaiseen siruun yksilöllisen tunnisteen, mikä voisi auttaa torjumaan salakuljetus komponenteista.

Spektrin äärimmäisemmässä päässä tutkijat ovat ehdottaneet, että piikytkimet voitaisiin leipoa piin sisään niiden käytön estämiseksi haitallisissa sovelluksissa.

Teoriassa tämä voisi antaa sääntelijöille mahdollisuuden reagoida nopeammin herkkien tekniikoiden väärinkäyttöön katkaisemalla sirujen etäkäyttö, mutta kirjoittajat varoittavat, että tämä ei ole riskitöntä. Seurauksena on, että jos se toteutetaan väärin, tällaisesta tappamiskytkimestä voi tulla kyberrikollisten kohde.

Toinen ehdotus edellyttäisi, että useat osapuolet allekirjoittavat mahdollisesti riskialttiita tekoälyn koulutustehtäviä ennen kuin ne voidaan ottaa käyttöön laajassa mittakaavassa. "Ydinaseet käyttävät samanlaisia mekanismeja, joita kutsutaan salliviksi toimintalinkeiksi", he kirjoittivat.

Ydinaseita varten nämä turvalukot on suunniteltu estämään yhtä henkilöä tekemästä roistoa ja käynnistämästä ensimmäistä iskua. Tekoälyn ajatuksena on kuitenkin se, että jos henkilö tai yritys haluaa kouluttaa mallin tietyn kynnyksen yli pilvessä, heidän on ensin hankittava siihen lupa.

Vaikka se onkin tehokas työkalu, tutkijat havaitsevat, että tämä voi kostautua estämällä halutun tekoälyn kehittymisen. Argumentti näyttää olevan se, että vaikka ydinaseiden käytöllä on melko selkeä lopputulos, tekoäly ei aina ole niin mustavalkoinen.

Mutta jos tämä tuntuu hieman liian dystopiselta makuusi, paperi omistaa kokonaisen osan tekoälyresurssien uudelleen jakamiseen koko yhteiskunnan parantamiseksi. Ajatuksena on, että poliittiset päättäjät voisivat kokoontua tekemään tekoälylaskennasta helpommin saatavilla ryhmille, jotka eivät todennäköisesti käytä sitä pahaan, käsitettä kutsutaan "allokaatioksi".

Mitä vikaa tekoälykehityksen säätelyssä on?

Miksi vaivautua tähän kaikkeen? No, paperin kirjoittajat väittävät, että fyysistä laitteistoa on luonnostaan helpompi hallita.

Laitteisiin verrattuna "muut tekoälykehityksen syötteet ja lähdöt - data, algoritmit ja koulutetut mallit - ovat helposti jaettavia, ei-kilpailevia aineettomia hyödykkeitä, mikä tekee niistä luonnostaan vaikeasti hallittavissa", lehdessä lukee.

Argumentti on se, että kun malli on julkaistu, joko avoimena tai vuotaneena, ei ole olemassa genien laittamista takaisin pulloon ja sen leviämisen estämistä verkossa.

Tutkijat korostivat myös, että pyrkimykset estää mallien väärinkäyttö ovat osoittautuneet epäluotettavaksi. Yhdessä esimerkissä kirjoittajat korostivat sitä, kuinka helposti tutkijat pystyivät purkamaan Meta's Llama 2:n suojalaitteet, joiden tarkoituksena oli estää mallia luomasta loukkaavaa kieltä.

Äärimmäisyyteen otettuna pelätään, että riittävän kehittynyttä kaksikäyttömallia voitaisiin käyttää nopeuttamaan kehitys kemiallisia tai biologisia aseita.

Paperi myöntää, että tekoälylaitteistosääntely ei ole hopealuoti eikä poista sääntelyn tarvetta alan muilla osa-alueilla.

Useiden OpenAI-tutkijoiden osallistumista on kuitenkin vaikea sivuuttaa, kun otetaan huomioon toimitusjohtaja Sam Altman yrityksiä ohjata tekoälyn säätelyä koskevaa narratiivia. ®

- SEO-pohjainen sisällön ja PR-jakelu. Vahvista jo tänään.

- PlatoData.Network Vertical Generatiivinen Ai. Vahvista itseäsi. Pääsy tästä.

- PlatoAiStream. Web3 Intelligence. Tietoa laajennettu. Pääsy tästä.

- PlatoESG. hiili, CleanTech, energia, ympäristö, Aurinko, Jätehuolto. Pääsy tästä.

- PlatonHealth. Biotekniikan ja kliinisten kokeiden älykkyys. Pääsy tästä.

- Lähde: https://go.theregister.com/feed/www.theregister.com/2024/02/16/boffins_propose_regulating_ai_hardware/

- :on

- :On

- :ei

- :missä

- $ YLÖS

- 7

- a

- pystyy

- väärinkäytökset

- AC

- akateeminen

- kiihdyttää

- kiihdyttimiä

- pääsy

- saatavilla

- poikki

- Toiminta

- osoite

- kehittynyt

- Jälkeen

- AI

- AI-mallit

- AI-koulutus

- jonka tarkoituksena

- algoritmit

- Kaikki

- jako

- sallia

- sallittu

- Salliminen

- pitkin

- jo

- Myös

- aina

- AMD

- Amerikkalainen

- an

- ja

- Toinen

- sovellukset

- lähestymistapa

- OVAT

- kiistellä

- perustelu

- aseet

- noin

- keinotekoinen

- tekoäly

- AS

- näkökohdat

- At

- lupa

- Tekijät

- välttää

- takaisin

- BE

- tulevat

- ennen

- ovat

- uskoi

- PARAS

- Paremmin

- parannus

- Biden

- Musta

- rakentaa

- mutta

- by

- nimeltään

- Cambridge

- CAN

- kykenee

- tapaus

- toimitusjohtaja

- tietty

- ketju

- kemiallinen

- Kiina

- siru

- sirut

- siviili-

- pilvi

- CO

- torjumiseksi

- Tulla

- Kaupankäynti

- Yritykset

- yritys

- osat

- Laskea

- Keskitetty

- käsite

- Koskea

- ottaen huomioon

- rajoitteet

- jatkui

- ohjaus

- kiista

- voisi

- maahan

- maa

- Kurssi

- asiakas

- leikkaus

- verkkorikollisille

- tiedot

- osasto

- käyttöön

- on kuvattu

- suunniteltu

- kehitetty

- kehittämällä

- Kehitys

- vaikea

- do

- doesnt

- tekee

- kaksinkertainen

- Dystopia

- kukin

- helpottaa

- helpompaa

- helposti

- Tehokas

- ponnisteluja

- myöskään

- poistaa

- Työllisiä

- loppu

- valvoa

- Koko

- Jopa

- esimerkki

- ylittää

- täytäntöönpanosta

- olemassaolo

- vienti

- äärimmäinen

- erittäin

- tekijät

- tuttu

- paljon

- nopeampi

- pelätty

- tuntuu

- Etunimi

- varten

- Eteenpäin

- alkaen

- etuosa

- kuilu

- tuottaa

- henki

- saada

- saada

- Global

- Go

- menee

- tavarat

- GPU

- Ryhmän

- käsissä

- Kova

- kovemmin

- Palvelimet

- Olla

- auttaa

- Piilottaa

- Korostettu

- raidat

- Miten

- Kuitenkin

- HTTPS

- ajatus

- tunniste

- tunnistaminen

- if

- sivuuttaa

- valtava

- toteuttaa

- täytäntöön

- täytäntöönpanosta

- parantaa

- in

- Muilla

- sisältää

- Mukaan lukien

- sisällyttää

- virheellisesti

- henkilökohtainen

- teollisuus

- Infrastruktuuri

- luonnostaan

- tuloa

- laitokset

- aineettomien

- Intel

- Älykkyys

- interventio

- tulee

- ISN

- IT

- SEN

- JOE

- Joe Biden

- jpg

- Tappaa

- laji

- Kieli

- suuri

- käynnistää

- käynnistäminen

- johtaa

- Led

- vasemmalle

- Taso

- elinkaari

- pitää

- RAJOITA

- rajoitukset

- rajoittamalla

- linkit

- vähän

- liekki

- Lukot

- tehty

- tehdä

- TEE

- Tekeminen

- ilkeä

- valmistus

- monet

- massiivinen

- Saattaa..

- välineet

- tarkoitti

- mekanismit

- Meta

- ehkä

- Sotilaallinen

- Sotilaalliset sovellukset

- ohjukset

- väärinkäyttö

- malli

- mallit

- kk

- lisää

- eniten

- moninkertainen

- KERTOMUKSEN

- kansallinen

- Tarve

- netto

- Uusi

- Nro

- huomata

- ydin-

- numero

- useat

- Nvidia

- tarkkailla

- of

- pois

- hyökkäys

- kampanja

- on

- kerran

- ONE

- avata

- OpenAI

- or

- alkuperä

- Muut

- Muuta

- meidän

- ulos

- Tulos

- lähdöt

- yli

- Paperi

- parametrit

- osallistuminen

- erityisesti

- osapuolet

- seuraamukset

- täydellinen

- suorituskyky

- henkilö

- henkilöt

- fyysinen

- Platon

- Platonin tietotieto

- PlatonData

- pelaa

- Kohta

- politiikkaa

- poliittisten päättäjien

- voimakas

- mahdollinen

- mahdollisesti

- valtuudet

- puheenjohtaja

- presidentti joe biden

- aika

- estää

- estää

- aiemmin

- yksityisyys

- käsittely

- valmistettu

- hedelmällinen

- ehdotus

- ehdotettu

- todistettu

- tarjoajat

- julkaistu

- laittaa

- Putting

- mitattavissa

- etsintä

- Rotu

- RE

- äskettäin

- viittaa

- rekisterin

- Säännellä

- säätö-

- Asetus

- Säätimet

- suhteellinen

- suhteellisesti

- luottaa

- kaukosäädin

- kaukaista

- raportoitu

- Raportointi

- Raportit

- edellyttää

- vaatimukset

- Vaatii

- Tutkijat

- Esittelymateriaalit

- Vastata

- rajoittaa

- rajoitukset

- Riski

- riskit

- riskialtis

- s

- takeita

- myynti

- myynti

- Sam

- Sam Altman

- sanoa

- Asteikko

- Osa

- turvallisuus

- näyttää

- puolijohde

- sensible

- palvella

- useat

- merkki

- Pii

- Hopea

- samankaltainen

- pieni

- So

- yhteiskunta

- myyty

- spektri

- levitä

- Alkaa

- stop

- pysäyttäminen

- lakko

- tiukka

- niin

- ehdottaa

- toimittaa

- toimitusketju

- Vaihtaa

- Kohde

- tehtävät

- maistuu

- Technologies

- kymmeniä

- että

- -

- heidän

- Niitä

- teoria

- Siellä.

- Nämä

- ne

- tätä

- ne

- tuhansia

- kynnys

- aika

- että

- yhdessä

- liian

- työkalu

- raita

- kauppaa

- Juna

- koulutettu

- koulutus

- laukeaa

- Biljoona

- ongelmia

- luvaton

- ymmärtää

- unique

- yliopisto

- Cambridgen yliopisto

- epätodennäköinen

- us

- Yhdysvaltain presidentti

- käyttää

- käytetty

- arvokas

- Ve

- myyjät

- kautta

- näkyvyys

- ÄÄNTÄ

- halusi

- Tapa..

- tavalla

- we

- Aseet

- viikkoa

- HYVIN

- olivat

- joka

- vaikka

- valkoinen

- KUKA

- koko

- with

- ilman

- olisi

- Väärä

- kirjoitti

- vuosi

- Voit

- Sinun

- zephyrnet