Dans cet article, nous montrons comment utiliser l'élagage structurel basé sur la recherche d'architecture neuronale (NAS) pour compresser un modèle BERT affiné afin d'améliorer les performances du modèle et de réduire les temps d'inférence. Les modèles linguistiques pré-entraînés (PLM) sont rapidement adoptés par les entreprises et les entreprises dans les domaines des outils de productivité, du service client, de la recherche et des recommandations, de l'automatisation des processus métier et de la création de contenu. Le déploiement de points de terminaison d'inférence PLM est généralement associé à une latence plus élevée et à des coûts d'infrastructure plus élevés en raison des exigences de calcul, ainsi qu'à une efficacité de calcul réduite en raison du grand nombre de paramètres. L'élagage d'un PLM réduit la taille et la complexité du modèle tout en conservant ses capacités prédictives. Les PLM élagués permettent d'obtenir une empreinte mémoire plus petite et une latence plus faible. Nous démontrons cela en élaguant un PLM et en compromettant le nombre de paramètres et l'erreur de validation pour une tâche cible spécifique, et sommes en mesure d'obtenir des temps de réponse plus rapides par rapport au modèle PLM de base.

L'optimisation multi-objectifs est un domaine de prise de décision qui optimise plusieurs fonctions objectives, telles que la consommation de mémoire, le temps de formation et les ressources de calcul, afin d'être optimisées simultanément. L'élagage structurel est une technique permettant de réduire la taille et les exigences de calcul du PLM en élaguant les couches ou les neurones/nœuds tout en essayant de préserver la précision du modèle. En supprimant des couches, l'élagage structurel permet d'obtenir des taux de compression plus élevés, ce qui conduit à une parcimonie structurée respectueuse du matériel qui réduit les temps d'exécution et de réponse. L'application d'une technique d'élagage structurel à un modèle PLM permet d'obtenir un modèle plus léger avec une empreinte mémoire inférieure qui, lorsqu'il est hébergé en tant que point final d'inférence dans SageMaker, offre une meilleure efficacité des ressources et une réduction des coûts par rapport au PLM original optimisé.

Les concepts illustrés dans cet article peuvent être appliqués aux applications qui utilisent les fonctionnalités PLM, telles que les systèmes de recommandation, l'analyse des sentiments et les moteurs de recherche. Plus précisément, vous pouvez utiliser cette approche si vous disposez d'équipes dédiées au machine learning (ML) et à la science des données qui affinent leurs propres modèles PLM à l'aide d'ensembles de données spécifiques au domaine et déploient un grand nombre de points de terminaison d'inférence à l'aide de Amazon Sage Maker. Un exemple est celui d'un détaillant en ligne qui déploie un grand nombre de points de terminaison d'inférence pour le résumé de texte, la classification du catalogue de produits et la classification des sentiments des commentaires sur les produits. Un autre exemple pourrait être un prestataire de soins de santé qui utilise des points de terminaison d'inférence PLM pour la classification des documents cliniques, la reconnaissance d'entités nommées à partir de rapports médicaux, les chatbots médicaux et la stratification des risques des patients.

Vue d'ensemble de la solution

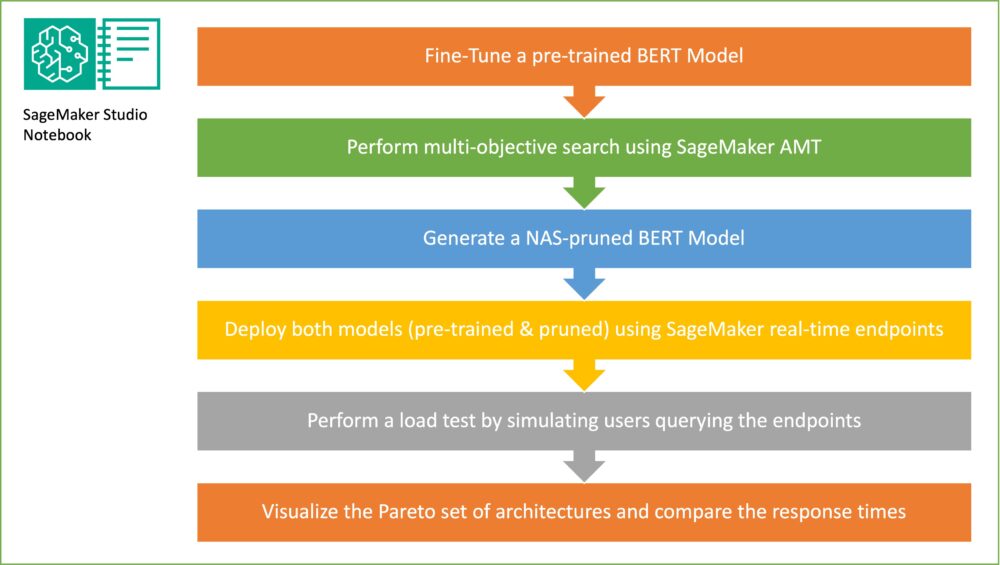

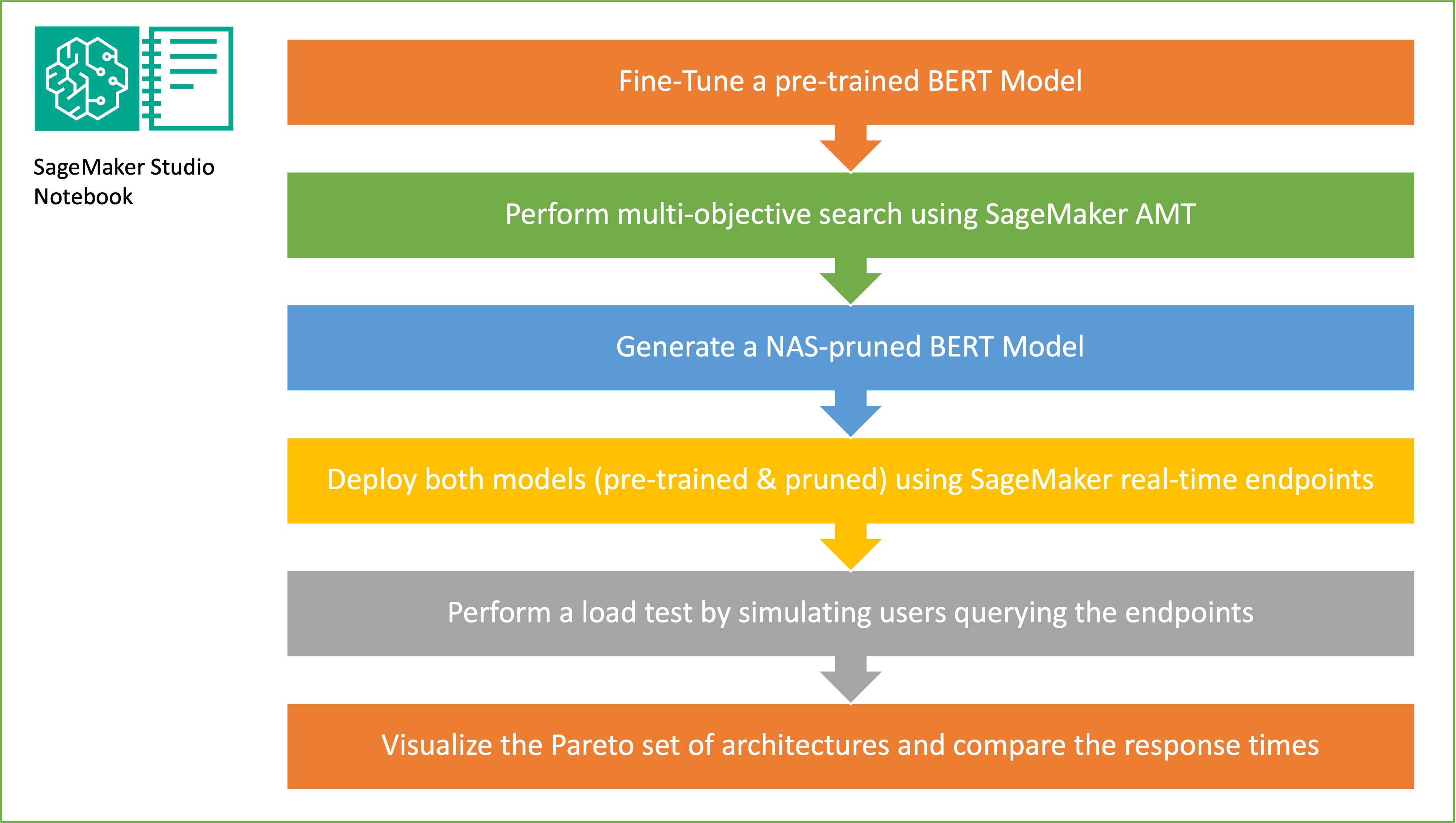

Dans cette section, nous présentons le flux de travail global et expliquons l'approche. Tout d'abord, nous utilisons un Amazon SageMakerStudio cahier pour affiner un modèle BERT pré-entraîné sur une tâche cible à l'aide d'un ensemble de données spécifique au domaine. BERT (Bidirectionnel Encoder Representations from Transformers) est un modèle de langage pré-entraîné basé sur le architecture du transformateur utilisé pour les tâches de traitement du langage naturel (NLP). La recherche d'architecture neuronale (NAS) est une approche permettant d'automatiser la conception de réseaux de neurones artificiels et est étroitement liée à l'optimisation des hyperparamètres, une approche largement utilisée dans le domaine de l'apprentissage automatique. L'objectif du NAS est de trouver l'architecture optimale pour un problème donné en recherchant parmi un large ensemble d'architectures candidates à l'aide de techniques telles que l'optimisation sans gradient ou en optimisant les métriques souhaitées. Les performances de l'architecture sont généralement mesurées à l'aide de mesures telles que la perte de validation. Réglage automatique du modèle SageMaker (AMT) automatise le processus fastidieux et complexe de recherche des combinaisons optimales d'hyperparamètres du modèle ML qui génèrent les meilleures performances du modèle. AMT utilise des algorithmes de recherche intelligents et des évaluations itératives à l'aide d'une gamme d'hyperparamètres que vous spécifiez. Il choisit les valeurs d'hyperparamètres qui créent un modèle qui fonctionne le mieux, tel que mesuré par des mesures de performances telles que la précision et le score F-1.

L'approche de réglage fin décrite dans cet article est générique et peut être appliquée à n'importe quel ensemble de données textuelles. La tâche affectée au BERT PLM peut être une tâche basée sur du texte telle qu'une analyse des sentiments, une classification de texte ou des questions-réponses. Dans cette démo, la tâche cible est un problème de classification binaire dans lequel BERT est utilisé pour identifier, à partir d'un ensemble de données constitué d'une collection de paires de fragments de texte, si la signification d'un fragment de texte peut être déduite de l'autre fragment. Nous utilisons le Reconnaître l'ensemble de données d'implication textuelle de la suite d'analyse comparative GLUE. Nous effectuons une recherche multi-objectifs à l'aide de SageMaker AMT pour identifier les sous-réseaux qui offrent des compromis optimaux entre le nombre de paramètres et la précision des prédictions pour la tâche cible. Lorsque nous effectuons une recherche multi-objectifs, nous commençons par définir la précision et le nombre de paramètres comme objectifs que nous visons à optimiser.

Au sein du réseau BERT PLM, il peut y avoir des sous-réseaux modulaires et autonomes qui permettent au modèle de disposer de capacités spécialisées telles que la compréhension du langage et la représentation des connaissances. BERT PLM utilise un sous-réseau d'auto-attention à plusieurs têtes et un sous-réseau de rétroaction. Une couche d'auto-attention à plusieurs têtes permet à BERT de relier différentes positions d'une seule séquence afin de calculer une représentation de la séquence en permettant à plusieurs têtes de s'occuper de plusieurs signaux contextuels. L'entrée est divisée en plusieurs sous-espaces et l'auto-attention est appliquée séparément à chacun des sous-espaces. Plusieurs têtes dans un transformateur PLM permettent au modèle de s'occuper conjointement des informations provenant de différents sous-espaces de représentation. Un sous-réseau à action directe est un simple réseau neuronal qui prend la sortie du sous-réseau d'auto-attention à plusieurs têtes, traite les données et renvoie les représentations finales de l'encodeur.

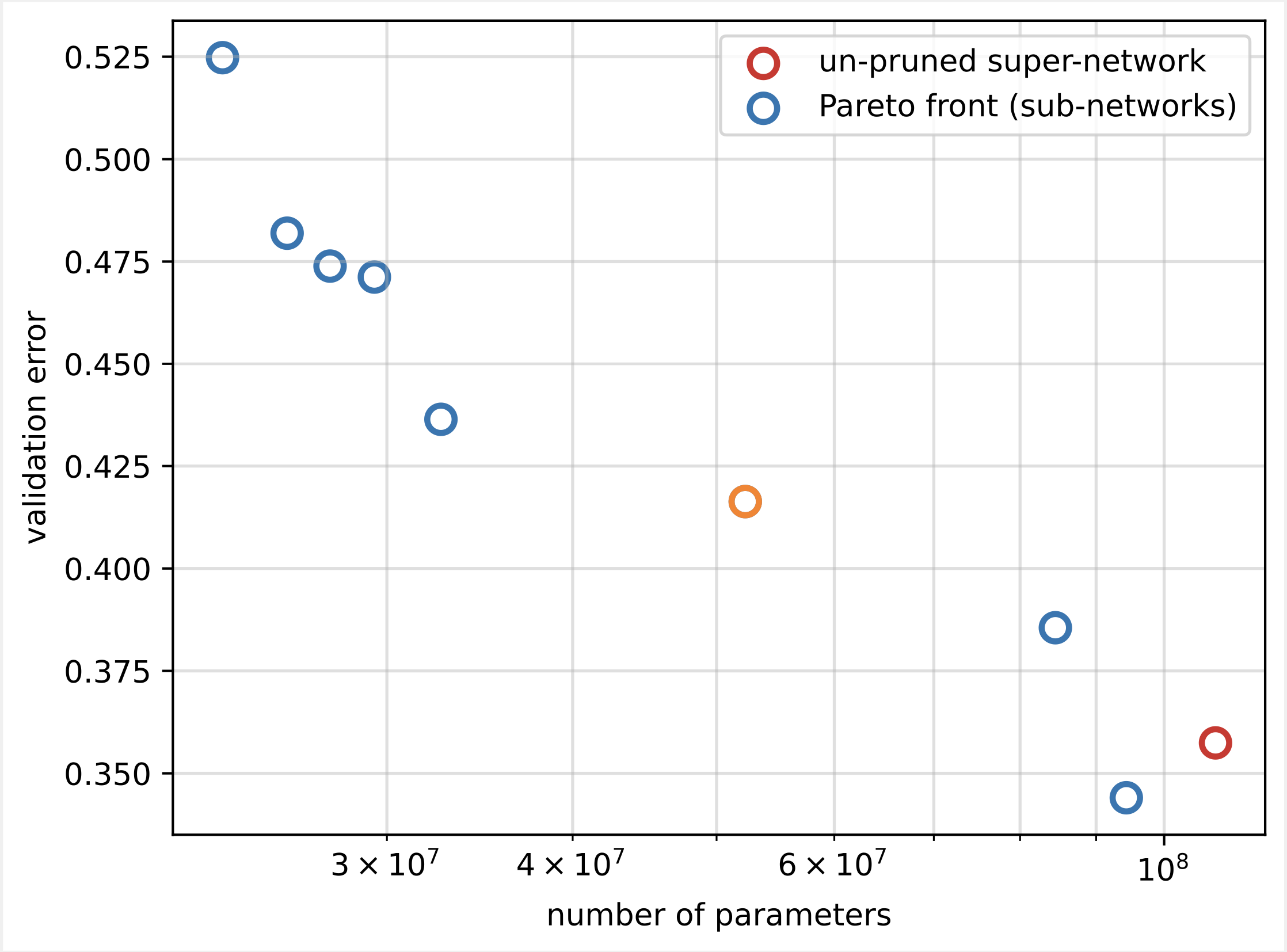

L'objectif de l'échantillonnage aléatoire de sous-réseaux est de former des modèles BERT plus petits capables de fonctionner suffisamment bien sur les tâches cibles. Nous échantillonnons 100 sous-réseaux aléatoires à partir du modèle BERT de base affiné et évaluons 10 réseaux simultanément. Les sous-réseaux formés sont évalués pour les métriques objectives et le modèle final est choisi en fonction des compromis trouvés entre les métriques objectives. Nous visualisons le Face Pareto pour les sous-réseaux échantillonnés, qui contient le modèle élagué qui offre le compromis optimal entre la précision du modèle et la taille du modèle. Nous sélectionnons le sous-réseau candidat (modèle BERT élagué par le NAS) en fonction de la taille du modèle et de la précision du modèle que nous sommes prêts à faire un compromis. Ensuite, nous hébergeons les points de terminaison, le modèle de base BERT pré-entraîné et le modèle BERT élagué par le NAS à l'aide de SageMaker. Pour effectuer des tests de charge, nous utilisons Criquet, un outil de test de charge open source que vous pouvez implémenter à l'aide de Python. Nous effectuons des tests de charge sur les deux points de terminaison à l'aide de Locust et visualisons les résultats à l'aide du front de Pareto pour illustrer le compromis entre les temps de réponse et la précision pour les deux modèles. Le diagramme suivant donne un aperçu du flux de travail expliqué dans cet article.

Pré-requis

Pour ce poste, les prérequis suivants sont requis :

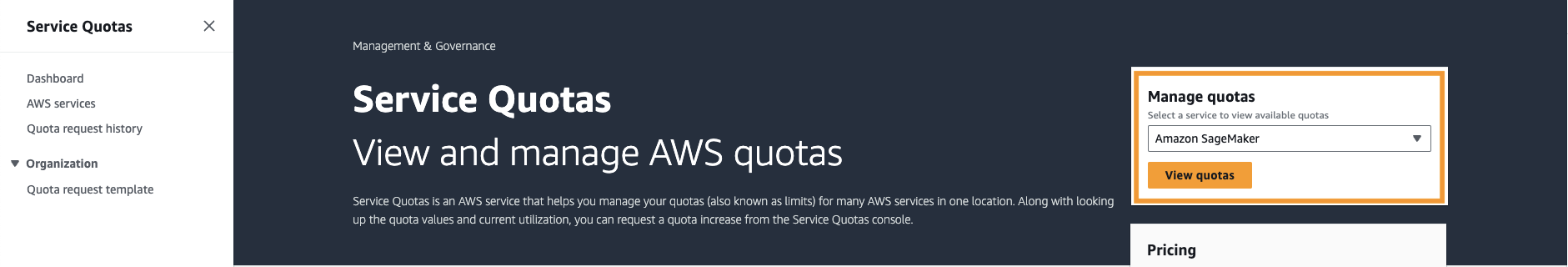

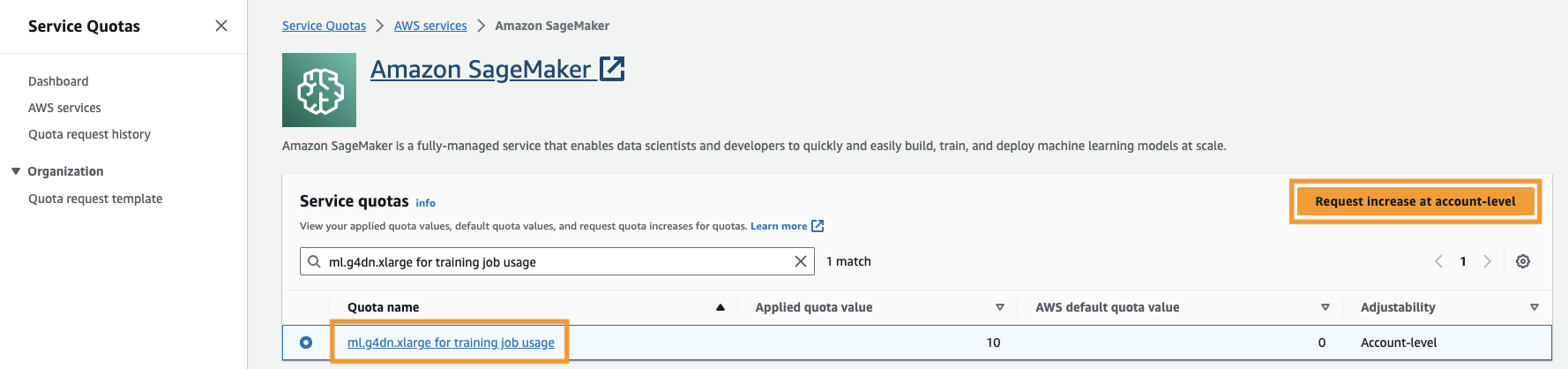

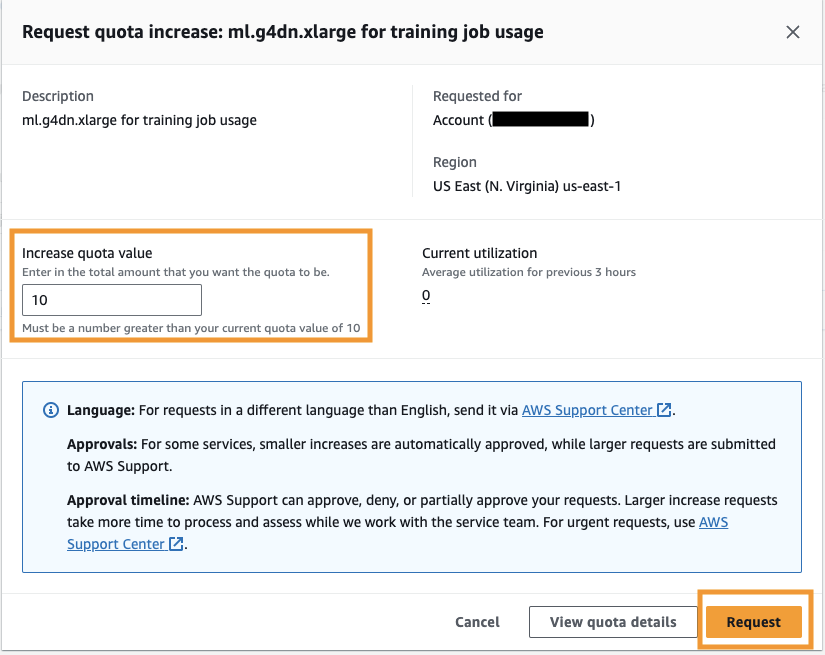

Il faut également augmenter le quota de services pour accéder à au moins trois instances d'instances ml.g4dn.xlarge dans SageMaker. Le type d'instance ml.g4dn.xlarge est l'instance GPU rentable qui vous permet d'exécuter PyTorch de manière native. Pour augmenter le quota de service, procédez comme suit :

- Sur la console, accédez à Quotas de service.

- Pour Gérer les quotas, choisissez Amazon Sage Maker, Puis choisissez Afficher les quotas.

- Recherchez « ml-g4dn.xlarge pour l'utilisation des tâches de formation » et sélectionnez l'élément de quota.

- Selectionnez Demander une augmentation au niveau du compte.

- Pour Augmenter la valeur du quota, entrez une valeur de 5 ou plus.

- Selectionnez Demande.

L'approbation du quota demandé peut prendre un certain temps en fonction des autorisations du compte.

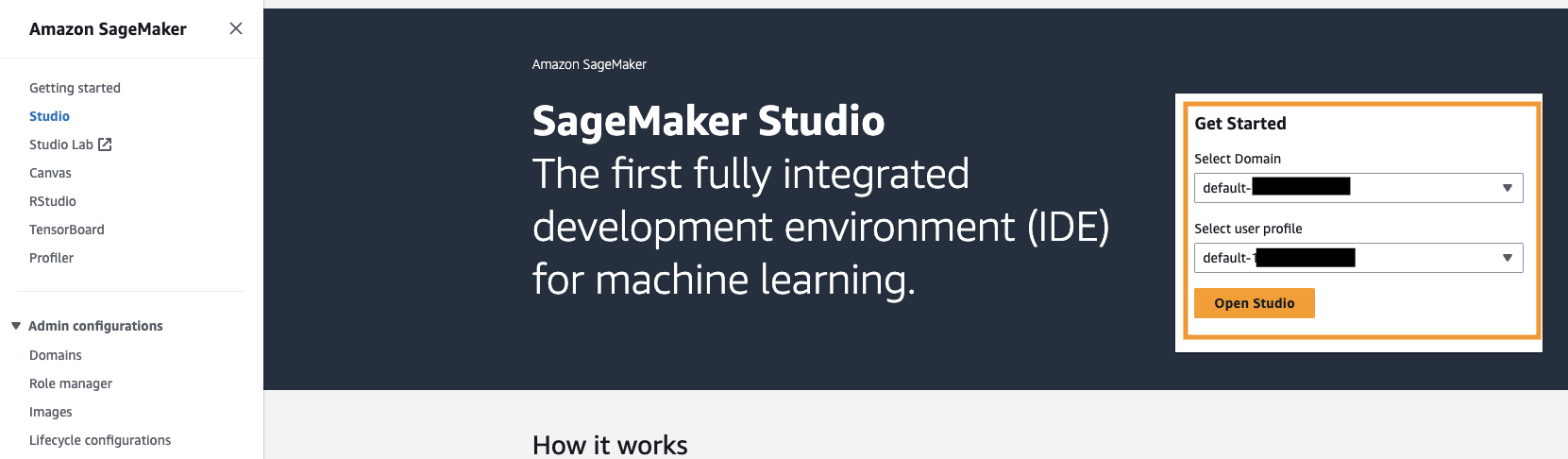

- Ouvrez SageMaker Studio depuis la console SageMaker.

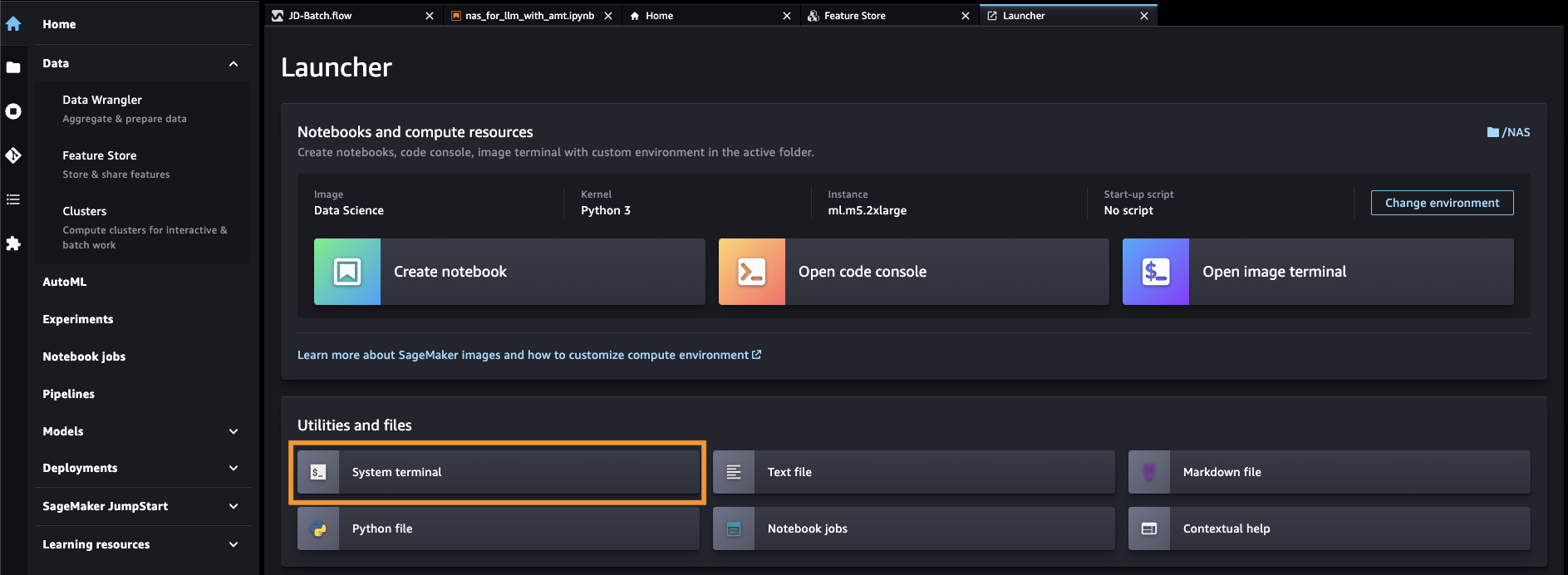

- Selectionnez Terminal système sous Utilitaires et fichiers.

- Exécutez la commande suivante pour cloner le GitHub repo à l'instance de SageMaker Studio :

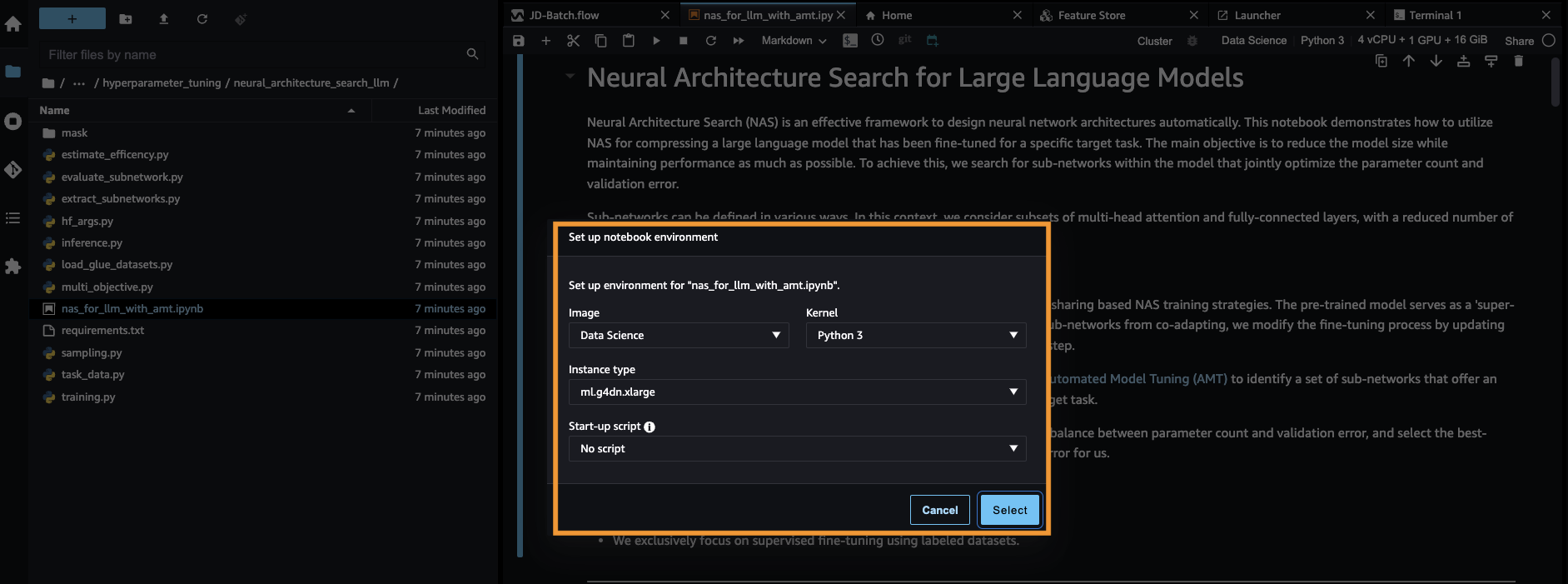

- Accédez à

amazon-sagemaker-examples/hyperparameter_tuning/neural_architecture_search_llm. - Ouvrez le fichier

nas_for_llm_with_amt.ipynb. - Configurer l'environnement avec un

ml.g4dn.xlargeinstance et choisissez Sélectionnez.

Configurer le modèle BERT pré-entraîné

Dans cette section, nous importons l'ensemble de données Recognizing Textual Entailment à partir de la bibliothèque d'ensembles de données et divisons l'ensemble de données en ensembles de formation et de validation. Cet ensemble de données est constitué de paires de phrases. La tâche du BERT PLM est de reconnaître, à partir de deux fragments de texte, si la signification d'un fragment de texte peut être déduite de l'autre fragment. Dans l’exemple suivant, nous pouvons déduire la signification de la première phrase à partir de la deuxième phrase :

Nous chargeons l'ensemble de données d'implication de reconnaissance textuelle à partir du LA COLLE suite d'analyse comparative via le bibliothèque de jeux de données de Hugging Face dans notre script de formation (./training.py). Nous divisons l'ensemble de données de formation d'origine de GLUE en un ensemble de formation et de validation. Dans notre approche, nous affinons le modèle BERT de base à l'aide de l'ensemble de données de formation, puis nous effectuons une recherche multi-objectif pour identifier l'ensemble de sous-réseaux qui équilibrent de manière optimale entre les métriques objectives. Nous utilisons l'ensemble de données de formation exclusivement pour affiner le modèle BERT. Cependant, nous utilisons les données de validation pour la recherche multi-objectifs en mesurant la précision sur l'ensemble de données de validation retenu.

Affinez le BERT PLM à l'aide d'un ensemble de données spécifique au domaine

Les cas d'utilisation typiques d'un modèle BERT brut incluent la prédiction de la phrase suivante ou la modélisation du langage masqué. Pour utiliser le modèle BERT de base pour des tâches en aval telles que l'implication de reconnaissance textuelle, nous devons affiner davantage le modèle à l'aide d'un ensemble de données spécifique au domaine. Vous pouvez utiliser un modèle BERT affiné pour des tâches telles que la classification de séquences, la réponse aux questions et la classification de jetons. Cependant, pour les besoins de cette démo, nous utilisons le modèle affiné pour la classification binaire. Nous affinons le modèle BERT pré-entraîné avec l'ensemble de données d'entraînement que nous avons préparé précédemment, en utilisant les hyperparamètres suivants :

Nous enregistrons le point de contrôle de la formation du modèle dans un Service de stockage simple Amazon (Amazon S3), afin que le modèle puisse être chargé pendant la recherche multi-objectif basée sur le NAS. Avant d'entraîner le modèle, nous définissons les métriques telles que l'époque, la perte d'entraînement, le nombre de paramètres et l'erreur de validation :

Une fois le processus de réglage fin lancé, le travail de formation prend environ 15 minutes.

Effectuer une recherche multi-objectifs pour sélectionner des sous-réseaux et visualiser les résultats

Dans l'étape suivante, nous effectuons une recherche multi-objectifs sur le modèle BERT de base affiné en échantillonnant des sous-réseaux aléatoires à l'aide de SageMaker AMT. Pour accéder à un sous-réseau au sein du super-réseau (le modèle BERT affiné), nous masquons tous les composants du PLM qui ne font pas partie du sous-réseau. Le masquage d'un super-réseau pour rechercher des sous-réseaux dans un PLM est une technique utilisée pour isoler et identifier les modèles de comportement du modèle. Notez que les transformateurs Hugging Face nécessitent que la taille cachée soit un multiple du nombre de têtes. La taille cachée dans un PLM de transformateur contrôle la taille de l'espace vectoriel d'état caché, ce qui a un impact sur la capacité du modèle à apprendre des représentations et des modèles complexes dans les données. Dans un BERT PLM, le vecteur d'état caché est d'une taille fixe (768). Nous ne pouvons pas changer la taille cachée, et donc le nombre de têtes doit être dans [1, 3, 6, 12].

Contrairement à l’optimisation à objectif unique, dans le contexte multi-objectifs, nous n’avons généralement pas de solution unique qui optimise simultanément tous les objectifs. Au lieu de cela, nous visons à collecter un ensemble de solutions qui dominent toutes les autres solutions dans au moins un objectif (comme l'erreur de validation). Nous pouvons maintenant lancer la recherche multi-objectifs via AMT en définissant les métriques que nous souhaitons réduire (erreur de validation et nombre de paramètres). Les sous-réseaux aléatoires sont définis par le paramètre max_jobs et le nombre de tâches simultanées est défini par le paramètre max_parallel_jobs. Le code pour charger le point de contrôle du modèle et évaluer le sous-réseau est disponible dans le evaluate_subnetwork.py scripts.

L’exécution de la tâche de réglage AMT prend environ 2 heures et 20 minutes. Une fois la tâche de réglage AMT exécutée avec succès, nous analysons l'historique de la tâche et collectons les configurations du sous-réseau, telles que le nombre de têtes, le nombre de couches, le nombre d'unités et les métriques correspondantes telles que l'erreur de validation et le nombre de paramètres. La capture d'écran suivante montre le résumé d'une tâche de tuner AMT réussie.

Ensuite, nous visualisons les résultats à l'aide d'un ensemble de Pareto (également connu sous le nom de frontière de Pareto ou ensemble optimal de Pareto), qui nous aide à identifier les ensembles optimaux de sous-réseaux qui dominent tous les autres sous-réseaux dans la métrique objective (erreur de validation) :

Tout d’abord, nous collectons les données de la tâche de réglage AMT. Ensuite, nous traçons l'ensemble de Pareto en utilisant matplotlob.pyplot avec nombre de paramètres sur l'axe x et erreur de validation sur l'axe y. Cela implique que lorsque nous passons d'un sous-réseau de l'ensemble de Pareto à un autre, nous devons soit sacrifier les performances, soit la taille du modèle, mais améliorer l'autre. En fin de compte, l'ensemble de Pareto nous offre la flexibilité de choisir le sous-réseau qui correspond le mieux à nos préférences. Nous pouvons décider dans quelle mesure nous souhaitons réduire la taille de notre réseau et dans quelle mesure nous sommes prêts à sacrifier les performances.

Déployez le modèle BERT affiné et le modèle de sous-réseau optimisé pour NAS à l'aide de SageMaker

Ensuite, nous déployons le plus grand modèle de notre ensemble Pareto qui conduit à la plus petite dégénérescence des performances à un Point de terminaison SageMaker. Le meilleur modèle est celui qui fournit un compromis optimal entre l’erreur de validation et le nombre de paramètres pour notre cas d’utilisation.

Modèle de comparaison

Nous avons pris un modèle BERT de base pré-entraîné, l'avons affiné à l'aide d'un ensemble de données spécifique au domaine, avons effectué une recherche NAS pour identifier les sous-réseaux dominants en fonction des métriques objectives et avons déployé le modèle élagué sur un point de terminaison SageMaker. De plus, nous avons pris le modèle BERT de base pré-entraîné et déployé le modèle de base sur un deuxième point de terminaison SageMaker. Ensuite, nous avons couru test de charge en utilisant Locust sur les deux points finaux d'inférence et en évaluant les performances en termes de temps de réponse.

Tout d’abord, nous importons les bibliothèques Locust et Boto3 nécessaires. Ensuite, nous construisons des métadonnées de requête et enregistrons l'heure de début à utiliser pour les tests de charge. Ensuite, la charge utile est transmise à l'API d'appel du point de terminaison SageMaker via le BotoClient pour simuler les demandes réelles des utilisateurs. Nous utilisons Locust pour générer plusieurs utilisateurs virtuels afin d'envoyer des requêtes en parallèle et mesurer les performances du point de terminaison sous la charge. Les tests sont exécutés en augmentant respectivement le nombre d'utilisateurs pour chacun des deux points de terminaison. Une fois les tests terminés, Locust génère un fichier CSV de statistiques de requête pour chacun des modèles déployés.

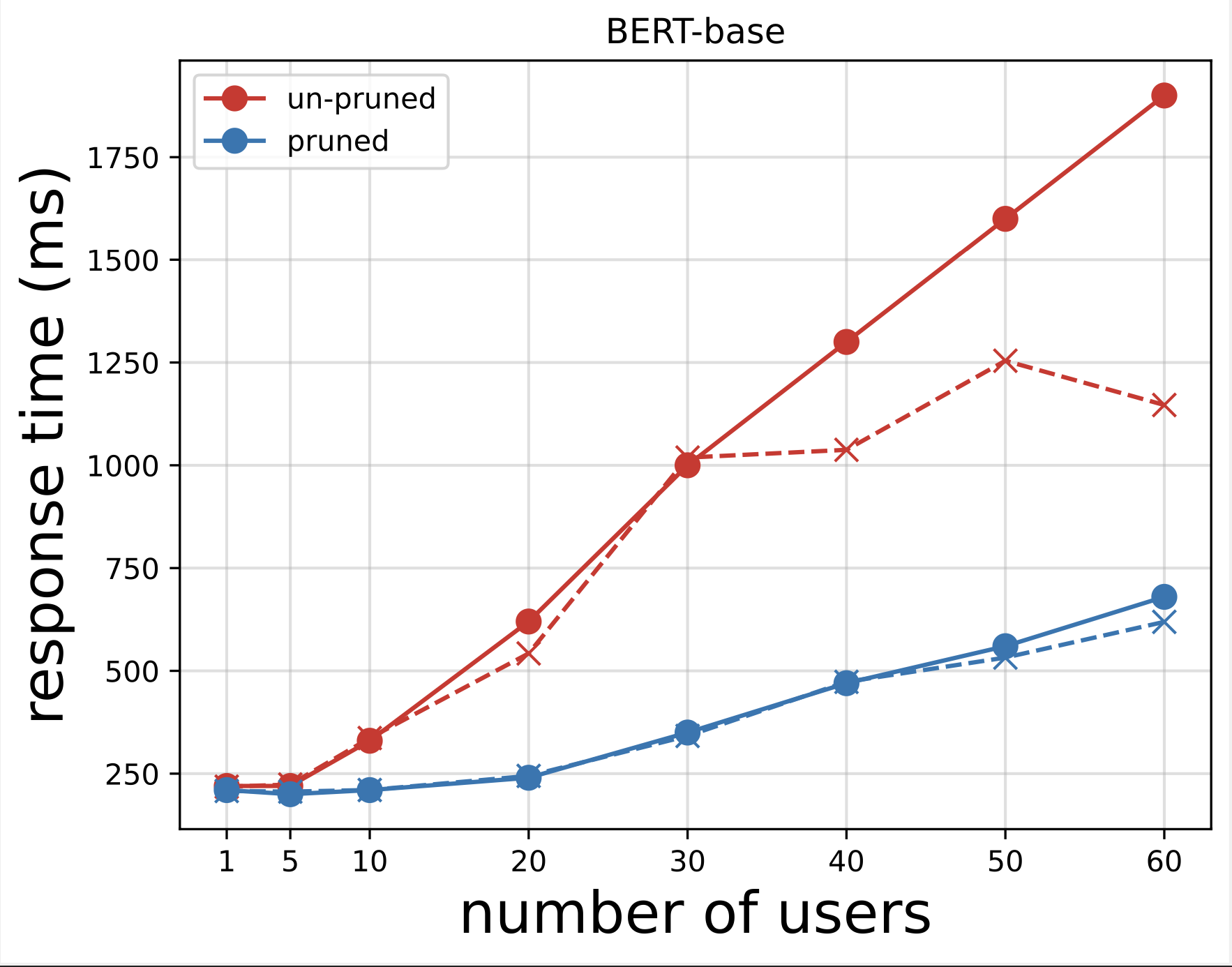

Ensuite, nous générons les tracés de temps de réponse à partir des fichiers CSV téléchargés après avoir exécuté les tests avec Locust. Le but du tracé du temps de réponse en fonction du nombre d'utilisateurs est d'analyser les résultats des tests de charge en visualisant l'impact du temps de réponse des points de terminaison du modèle. Dans le graphique suivant, nous pouvons voir que le point de terminaison du modèle élagué NAS atteint un temps de réponse inférieur par rapport au point de terminaison du modèle BERT de base.

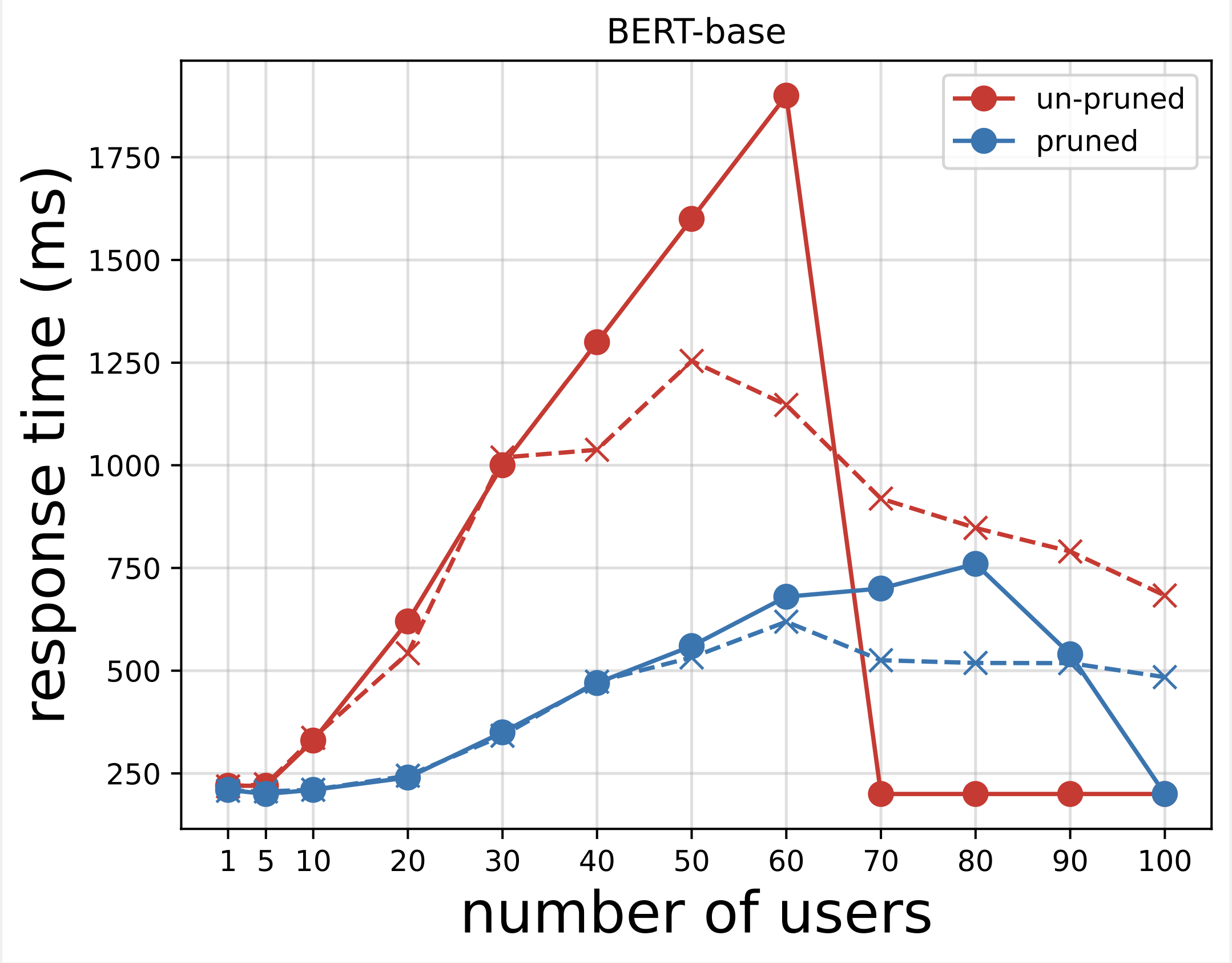

Dans le deuxième graphique, qui est une extension du premier graphique, nous observons qu'après environ 70 utilisateurs, SageMaker commence à limiter le point de terminaison du modèle BERT de base et lève une exception. Cependant, pour le point de terminaison du modèle NAS élagué, la limitation se produit entre 90 et 100 utilisateurs et avec un temps de réponse plus faible.

À partir des deux graphiques, nous observons que le modèle élagué a un temps de réponse plus rapide et évolue mieux que le modèle non élagué. À mesure que nous augmentons le nombre de points de terminaison d'inférence, comme c'est le cas pour les utilisateurs qui déploient un grand nombre de points de terminaison d'inférence pour leurs applications PLM, les avantages en termes de coûts et d'amélioration des performances commencent à devenir assez substantiels.

Nettoyer

Pour supprimer les points de terminaison SageMaker pour le modèle BERT de base affiné et le modèle élagué NAS, procédez comme suit :

- Sur la console SageMaker, choisissez Inférence ainsi que Endpoints dans le volet de navigation.

- Sélectionnez le point de terminaison et supprimez-le.

Vous pouvez également, à partir du bloc-notes SageMaker Studio, exécuter les commandes suivantes en fournissant les noms des points de terminaison :

Conclusion

Dans cet article, nous avons expliqué comment utiliser le NAS pour élaguer un modèle BERT affiné. Nous avons d'abord formé un modèle BERT de base à l'aide de données spécifiques au domaine et l'avons déployé sur un point de terminaison SageMaker. Nous avons effectué une recherche multi-objectifs sur le modèle de base BERT affiné à l'aide de SageMaker AMT pour une tâche cible. Nous avons visualisé le front Pareto et sélectionné le modèle BERT optimisé par NAS Pareto et déployé le modèle sur un deuxième point de terminaison SageMaker. Nous avons effectué des tests de charge à l'aide de Locust pour simuler des utilisateurs interrogeant les deux points de terminaison, et mesuré et enregistré les temps de réponse dans un fichier CSV. Nous avons tracé le temps de réponse en fonction du nombre d'utilisateurs pour les deux modèles.

Nous avons observé que le modèle BERT élagué fonctionnait nettement mieux en termes de temps de réponse et de seuil de limitation des instances. Nous avons conclu que le modèle NAS élagué était plus résistant à une charge accrue sur le point final, maintenant un temps de réponse plus faible même si davantage d'utilisateurs stressaient le système par rapport au modèle BERT de base. Vous pouvez appliquer la technique NAS décrite dans cet article à n'importe quel grand modèle de langage pour trouver un modèle élagué capable d'effectuer la tâche cible avec un temps de réponse nettement inférieur. Vous pouvez optimiser davantage l'approche en utilisant la latence comme paramètre en plus de la perte de validation.

Bien que nous utilisions NAS dans cet article, la quantification est une autre approche couramment utilisée pour optimiser et compresser les modèles PLM. La quantification réduit la précision des poids et des activations dans un réseau entraîné d'une virgule flottante de 32 bits à des largeurs de bits inférieures telles que des entiers de 8 ou 16 bits, ce qui aboutit à un modèle compressé qui génère une inférence plus rapide. La quantification ne réduit pas le nombre de paramètres ; au lieu de cela, il réduit la précision des paramètres existants pour obtenir un modèle compressé. L'élagage du NAS supprime les réseaux redondants dans un PLM, ce qui crée un modèle clairsemé avec moins de paramètres. En règle générale, l'élagage et la quantification NAS sont utilisés ensemble pour compresser de grands PLM afin de maintenir la précision du modèle, de réduire les pertes de validation tout en améliorant les performances et de réduire la taille du modèle. Les autres techniques couramment utilisées pour réduire la taille des PLM comprennent distillation des connaissances, factorisation matricielleet une cascades de distillation.

L'approche proposée dans l'article de blog convient aux équipes qui utilisent SageMaker pour former et affiner les modèles à l'aide de données spécifiques au domaine et déployer les points de terminaison pour générer des inférences. Si vous recherchez un service entièrement géré offrant un choix de modèles de base hautes performances nécessaires à la création d'applications d'IA générative, envisagez d'utiliser Socle amazonien. Si vous recherchez des modèles open source pré-entraînés pour un large éventail de cas d'utilisation commerciale et souhaitez accéder à des modèles de solution et des exemples de blocs-notes, envisagez d'utiliser Amazon SageMaker JumpStart. Une version pré-entraînée du modèle de base Hugging Face BERT que nous avons utilisé dans cet article est également disponible auprès de SageMaker JumpStart.

À propos des auteurs

Aparajithan Vaidyanathan est architecte principal de solutions d'entreprise chez AWS. Il est un architecte cloud avec plus de 24 ans d'expérience dans la conception et le développement de systèmes logiciels d'entreprise, à grande échelle et distribués. Il se spécialise dans l’IA générative et l’ingénierie des données d’apprentissage automatique. Il est un aspirant marathonien et ses passe-temps incluent la randonnée, le vélo et passer du temps avec sa femme et ses deux garçons.

Aparajithan Vaidyanathan est architecte principal de solutions d'entreprise chez AWS. Il est un architecte cloud avec plus de 24 ans d'expérience dans la conception et le développement de systèmes logiciels d'entreprise, à grande échelle et distribués. Il se spécialise dans l’IA générative et l’ingénierie des données d’apprentissage automatique. Il est un aspirant marathonien et ses passe-temps incluent la randonnée, le vélo et passer du temps avec sa femme et ses deux garçons.

Aaron Klein est un scientifique appliqué senior chez AWS qui travaille sur des méthodes d'apprentissage automatique automatisées pour les réseaux neuronaux profonds.

Aaron Klein est un scientifique appliqué senior chez AWS qui travaille sur des méthodes d'apprentissage automatique automatisées pour les réseaux neuronaux profonds.

Jacek Golebiowski est scientifique appliquée senior chez AWS.

Jacek Golebiowski est scientifique appliquée senior chez AWS.

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- PlatoData.Network Ai générative verticale. Autonomisez-vous. Accéder ici.

- PlatoAiStream. Intelligence Web3. Connaissance Amplifiée. Accéder ici.

- PlatonESG. Carbone, Technologie propre, Énergie, Environnement, Solaire, La gestion des déchets. Accéder ici.

- PlatoHealth. Veille biotechnologique et essais cliniques. Accéder ici.

- La source: https://aws.amazon.com/blogs/machine-learning/reduce-inference-time-for-bert-models-using-neural-architecture-search-and-sagemaker-automated-model-tuning/

- :possède

- :est

- :ne pas

- :où

- ][p

- $UP

- 1

- 10

- 100

- 11

- 12

- 13

- 15%

- 17

- 19

- 20

- 26%

- 30

- 31

- 320

- 7

- 70

- 72

- 8

- 9

- a

- capacité

- Capable

- accès

- Compte

- précision

- atteindre

- Atteint

- activations

- ajout

- Adoption

- Après

- AI

- objectif

- Visée

- algorithmes

- Tous

- permettre

- Permettre

- permet

- aussi

- Amazon

- Amazon Web Services

- montant

- an

- selon une analyse de l’Université de Princeton

- analytique

- il analyse

- ainsi que

- Une autre

- répondre

- tous

- api

- applications

- appliqué

- Appliquer

- Application

- une approche

- approbation

- d'environ

- architecture

- SONT

- Réservé

- domaines

- arguments

- autour

- artificiel

- AS

- en herbe

- attribué

- associé

- At

- tenter

- pour participer

- Automatisation

- Automates

- Automatique

- automatiser

- Automation

- disponibles

- AWS

- Axis

- Balance

- base

- basé

- BE

- devenez

- before

- humain

- analyse comparative

- avantages.

- LES MEILLEURS

- Améliorée

- jusqu'à XNUMX fois

- Bit

- corps

- tous les deux

- construire

- la performance des entreprises

- PROCESSUS D'AFFAIRE

- mais

- by

- CAN

- candidat

- capacités

- maisons

- cas

- catalogue

- Change

- Graphique

- Charts

- Chatbots

- le choix

- Selectionnez

- choisi

- classe

- classification

- Infos sur les

- étroitement

- le cloud

- code

- recueillir

- collection

- комбинации

- commercial

- Commun

- communément

- par rapport

- complet

- Complété

- complexe

- complexité

- composants électriques

- calcul

- calcul

- concepts

- conclu

- Considérer

- consiste

- Console

- contraintes

- construire

- consommation

- contient

- contenu

- création de contenu

- contexte

- continuer

- contraste

- contrôles

- Correspondant

- Prix

- Costs

- compter

- engendrent

- crée des

- création

- des clients

- Service à la clientèle

- données

- science des données

- ensembles de données

- datetime

- décider

- La prise de décision

- dévoué

- profond

- Vous permet de définir

- défini

- définir

- demo

- démontrer

- Selon

- déployer

- déployé

- déployer

- déploie

- décrit

- Conception

- conception

- voulu

- développement

- différent

- discuté

- distribué

- document

- Ne fait pas

- dominant

- Dominer

- Ne pas

- deux

- pendant

- e

- chacun

- efficace

- efficace

- non plus

- Endpoint

- ENGINEERING

- Moteurs

- assez

- Entrer

- Entreprise

- adoption en entreprise

- entité

- entrée

- Environment

- époque

- erreur

- évaluer

- évalué

- évaluations

- Pourtant, la

- événements

- exemple

- Sauf

- exception

- uniquement au

- existant

- d'experience

- Expliquer

- expliqué

- extension

- Visage

- non

- plus rapide

- Fonctionnalités:

- Réactions

- moins

- champ

- Déposez votre dernière attestation

- Fichiers

- finale

- Trouvez

- trouver

- Prénom

- fixé

- Flexibilité

- flottant

- Abonnement

- numérique

- Pour

- trouvé

- Fondation

- De

- avant

- frontière

- d’étiquettes électroniques entièrement

- fonction

- plus

- générer

- génère

- génératif

- IA générative

- obtenez

- donné

- objectif

- GPU

- gris

- arrive

- Vous avez

- he

- front

- têtes

- la médecine

- aide

- caché

- haute performance

- augmentation

- sa

- Histoire

- hôte

- organisé

- HEURES

- Comment

- How To

- Cependant

- HTML

- http

- HTTPS

- Étreindre

- Optimisation hyperparamétrique

- Réglage des hyperparamètres

- i

- identifier

- IDX

- if

- illustrer

- Impact

- Impacts

- Mettre en oeuvre

- importer

- améliorer

- amélioré

- amélioration

- l'amélioration de

- in

- comprendre

- Améliore

- increased

- croissant

- d'information

- Infrastructure

- contribution

- instance

- plutôt ;

- Intelligent

- développement

- IT

- SES

- Emploi

- Emplois

- jpg

- json

- spécialisées

- connu

- langue

- gros

- grande échelle

- le plus grand

- Latence

- couche

- poules pondeuses

- Conduit

- APPRENTISSAGE

- apprentissage

- au

- laisser

- bibliothèques

- Bibliothèque

- Gamme

- charge

- enregistrer

- enregistrement

- recherchez-

- perte

- pertes

- baisser

- click

- machine learning

- maintenir

- Maintenir

- man

- gérés

- Marathon

- masque

- matplotlib

- maximales

- Mai..

- sens

- mesurer

- mesure

- médical

- Découvrez

- Mémoire

- Métadonnées

- méthodes

- métrique

- Métrique

- pourrait

- Minutes

- ML

- modèle

- modélisation statistique

- numériques jumeaux (digital twin models)

- application

- PLUS

- Bougez

- beaucoup

- plusieurs

- must

- prénom

- Nommé

- noms

- à l'

- Nature

- Traitement du langage naturel

- NAVIGUER

- Navigation

- nécessaire

- Besoin

- nécessaire

- Besoins

- réseau et

- réseaux

- neural

- Réseau neuronal

- les réseaux de neurones

- next

- nlp

- Aucun

- noter

- cahier

- maintenant

- nombre

- objet

- objectif

- objectifs

- observer

- of

- de rabais

- code

- Offres Speciales

- on

- ONE

- en ligne

- détaillant en ligne

- uniquement

- ouvert

- open source

- optimaux

- à mettre en œuvre pour gérer une entreprise rentable. Ce guide est basé sur trois décennies d'expérience

- Optimiser

- optimisé

- Optimise

- l'optimisation

- or

- de commander

- original

- Autre

- nos

- ande

- sortie

- sorties

- plus de

- global

- vue d'ensemble

- propre

- paires

- pain

- Parallèle

- paramètre

- paramètres

- Pareto

- partie

- passé

- chemin

- patientforward

- motifs

- Effectuer

- performant

- effectué

- effectuer

- effectue

- autorisations

- Platon

- Intelligence des données Platon

- PlatonDonnées

- Point

- des notes bonus

- positions

- Post

- La précision

- prédiction

- Predictor

- préférences

- préparé

- conditions préalables

- représentent

- précédemment

- Directeur

- Problème

- processus

- Process Automation

- les process

- traitement

- Produit

- productivité

- proposé

- de voiture.

- fournit

- aportando

- tirant

- RÉSERVES

- but

- des fins

- Python

- pytorch

- Questions et réponses

- question

- assez

- aléatoire

- gamme

- Nos tests de diagnostic produisent des résultats rapides et précis sans nécessiter d'équipement de laboratoire complexe et coûteux,

- Tarifs

- raw

- réal

- reconnaissance

- reconnaître

- reconnaissant

- Recommandation

- recommandations

- record

- enregistré

- Rouge

- réduire

- Prix Réduit

- réduit

- regex

- en relation

- supprime

- enlever

- Rapports

- représentation

- nécessaire

- demandes

- conditions

- Exigences

- résilient

- ressource

- Resources

- respectivement

- réponse

- Résultats

- détaillant

- retenue

- Retours

- équitation

- Analyse

- RANGÉE

- Courir

- coureur

- pour le running

- fonctionne

- s

- sacrifier

- sagemaker

- Inférence SageMaker

- Épargnez

- Escaliers intérieurs

- Balance

- Sciences

- Scientifique

- But

- scénario

- Rechercher

- Les moteurs de recherche

- recherche

- Deuxièmement

- Section

- sur le lien

- Sélectionner

- choisi

- AUTO

- envoyer

- phrase

- sentiment

- Séquence

- service

- Services

- Session

- set

- Sets

- mise

- Spectacles

- signaux

- de façon significative

- étapes

- simultanément

- unique

- Taille

- faibles

- So

- Logiciels

- sur mesure

- Solutions

- quelques

- Identifier

- Space

- spécialisé

- spécialise

- groupe de neurones

- spécifiquement

- Dépenses

- scission

- Commencer

- départs

- Région

- statistiques

- étapes

- Étapes

- storage

- de construction

- structuré

- studio

- Ces

- réussi

- Avec succès

- tel

- convient

- suite

- RÉSUMÉ

- combustion propre

- Système

- Prenez

- prend

- Target

- Tâche

- tâches

- équipes

- technique

- techniques

- modèles

- conditions

- Essais

- tests

- texte

- Classification du texte

- textuel

- que

- qui

- La

- leur

- puis

- Là.

- donc

- Ces

- this

- trois

- порог

- Avec

- fiable

- fois

- à

- ensemble

- jeton

- a

- outil

- les outils

- commerce

- Commerce

- Train

- qualifié

- Formation

- transformateur

- transformateurs

- oui

- Essai

- réglage

- deux

- type

- types

- débutante

- typiquement

- En fin de compte

- sous

- en cours

- compréhension

- unités

- us

- utilisé

- cas d'utilisation

- d'utiliser

- Utilisateur

- utilisateurs

- Usages

- en utilisant

- validation

- Plus-value

- Valeurs

- version

- via

- Salle de conférence virtuelle

- visualiser

- vs

- souhaitez

- était

- we

- web

- services Web

- WELL

- quand

- que

- qui

- tout en

- WHO

- large

- Large gamme

- largement

- femme

- Wikipédia

- sera

- prêt

- comprenant

- dans les

- activités principales

- workflow

- de travail

- X

- années

- Rendement

- Vous n'avez

- Votre

- zéphyrnet