Les chatbots modernes peuvent servir d’agents numériques, offrant ainsi une nouvelle voie pour fournir un service client et une assistance 24h/7 et XNUMXj/XNUMX dans de nombreux secteurs. Leur popularité vient de leur capacité à répondre aux demandes des clients en temps réel et à traiter plusieurs requêtes simultanément dans différentes langues. Les chatbots offrent également de précieuses informations basées sur des données sur le comportement des clients tout en évoluant sans effort à mesure que la base d'utilisateurs augmente ; par conséquent, ils présentent une solution rentable pour engager les clients. Les chatbots utilisent les capacités avancées de langage naturel des grands modèles de langage (LLM) pour répondre aux questions des clients. Ils peuvent comprendre le langage conversationnel et répondre naturellement. Cependant, les chatbots qui répondent simplement à des questions simples ont une utilité limitée. Pour devenir des conseillers de confiance, les chatbots doivent apporter des réponses réfléchies et personnalisées.

Une façon de permettre des conversations plus contextuelles consiste à relier le chatbot aux bases de connaissances et aux systèmes d'information internes. L'intégration de données d'entreprise propriétaires provenant de bases de connaissances internes permet aux chatbots de contextualiser leurs réponses en fonction des besoins et des intérêts individuels de chaque utilisateur. Par exemple, un chatbot pourrait suggérer des produits qui correspondent aux préférences et aux achats antérieurs d'un acheteur, expliquer les détails dans un langage adapté au niveau d'expertise de l'utilisateur, ou fournir une assistance au compte en accédant aux enregistrements spécifiques du client. La capacité d’incorporer intelligemment des informations, de comprendre le langage naturel et de fournir des réponses personnalisées dans un flux conversationnel permet aux chatbots d’apporter une réelle valeur commerciale dans divers cas d’utilisation.

Le modèle architectural populaire de Récupération Génération Augmentée (RAG) est souvent utilisé pour augmenter le contexte et les réponses des requêtes des utilisateurs. RAG combine les capacités des LLM avec la base des faits et des connaissances du monde réel provenant de la récupération de textes et de passages pertinents à partir d'un corpus de données. Ces textes récupérés sont ensuite utilisés pour informer et étayer le résultat, réduisant ainsi les hallucinations et améliorant la pertinence.

Dans cet article, nous illustrons l'amélioration contextuelle d'un chatbot en utilisant Bases de connaissances pour Amazon Bedrock, un service sans serveur entièrement géré. L'intégration des bases de connaissances pour Amazon Bedrock permet à notre chatbot de fournir des réponses plus pertinentes et personnalisées en reliant les requêtes des utilisateurs aux points de données d'informations associés. Intérieurement, Socle amazonien utilise des intégrations stockées dans une base de données vectorielle pour augmenter le contexte des requêtes utilisateur au moment de l'exécution et activer une solution d'architecture RAG gérée. Nous utilisons le Lettres d'Amazon aux actionnaires ensemble de données pour développer cette solution.

Récupération Génération Augmentée

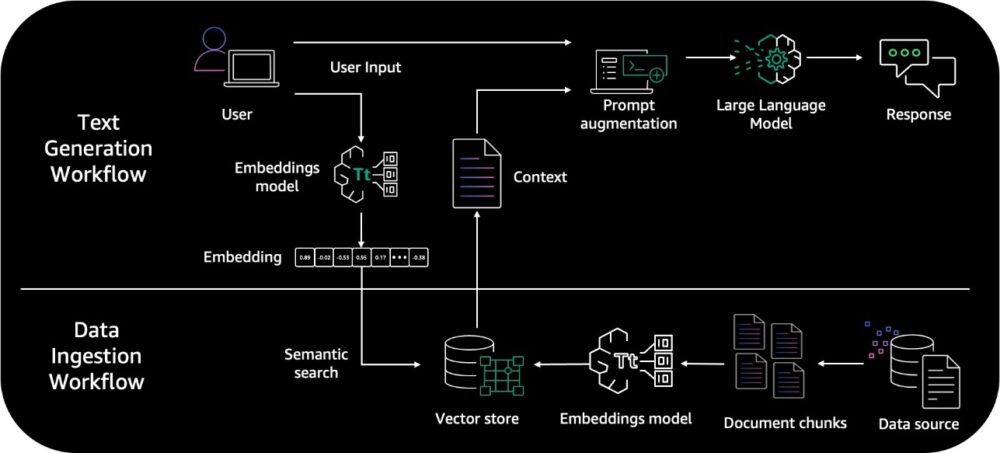

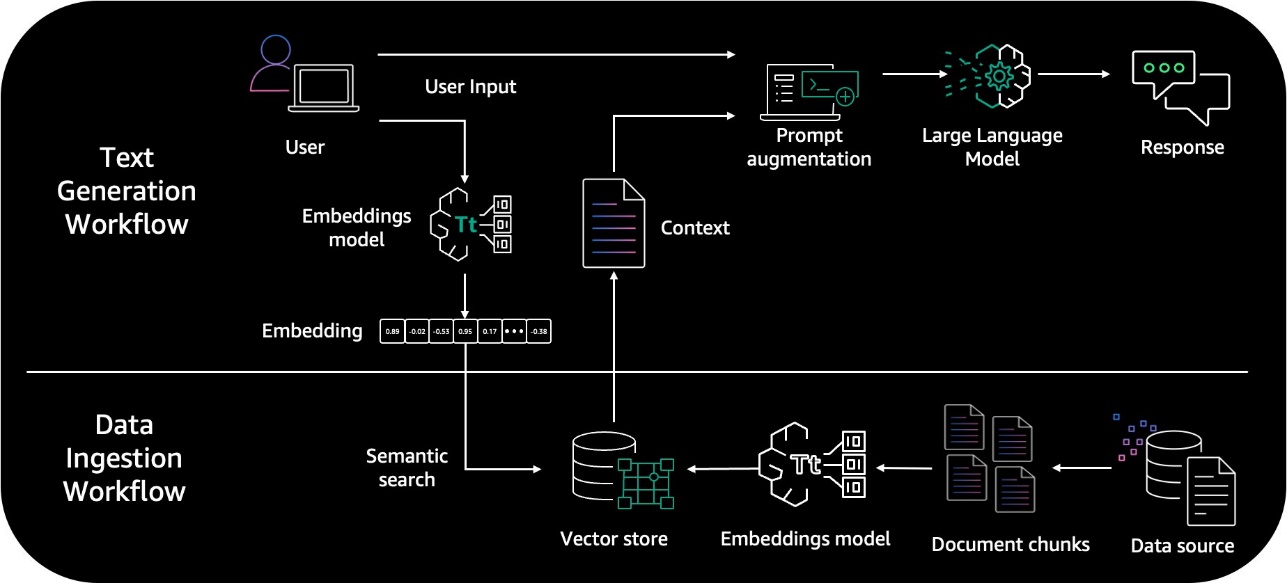

RAG est une approche de génération de langage naturel qui intègre la récupération d'informations dans le processus de génération. L'architecture RAG implique deux flux de travail clés : le prétraitement des données via l'ingestion et la génération de texte à l'aide d'un contexte amélioré.

Le workflow d'ingestion de données utilise des LLM pour créer des vecteurs d'intégration qui représentent la signification sémantique des textes. Des intégrations sont créées pour les documents et les questions des utilisateurs. Les intégrations de documents sont divisées en morceaux et stockées sous forme d'index dans une base de données vectorielle. Le flux de travail de génération de texte prend ensuite le vecteur d'intégration d'une question et l'utilise pour récupérer les morceaux de document les plus similaires en fonction de la similarité des vecteurs. Il augmente les invites avec ces éléments pertinents pour générer une réponse à l'aide du LLM. Pour plus de détails, reportez-vous au Introduction à la génération augmentée de récupération, aux intégrations et aux bases de données vectorielles section Aperçu – Connectez les modèles Foundation aux sources de données de votre entreprise avec des agents pour Amazon Bedrock.

Le diagramme suivant illustre l'architecture RAG de haut niveau.

Bien que l'architecture RAG présente de nombreux avantages, elle implique plusieurs composants, notamment une base de données, un mécanisme de récupération, une invite et un modèle génératif. La gestion de ces éléments interdépendants peut introduire des complexités dans le développement et le déploiement du système. L'intégration de la récupération et de la génération nécessite également des efforts d'ingénierie et des ressources informatiques supplémentaires. Certaines bibliothèques open source fournissent des wrappers pour réduire cette surcharge ; cependant, les modifications apportées aux bibliothèques peuvent introduire des erreurs et ajouter une surcharge supplémentaire de gestion des versions. Même avec des bibliothèques open source, des efforts importants sont nécessaires pour écrire du code, déterminer la taille optimale des fragments, générer des intégrations, etc. Ce travail de configuration à lui seul peut prendre des semaines en fonction du volume de données.

Par conséquent, une solution gérée qui gère ces tâches indifférenciées pourrait rationaliser et accélérer le processus de mise en œuvre et de gestion des applications RAG.

Bases de connaissances pour Amazon Bedrock

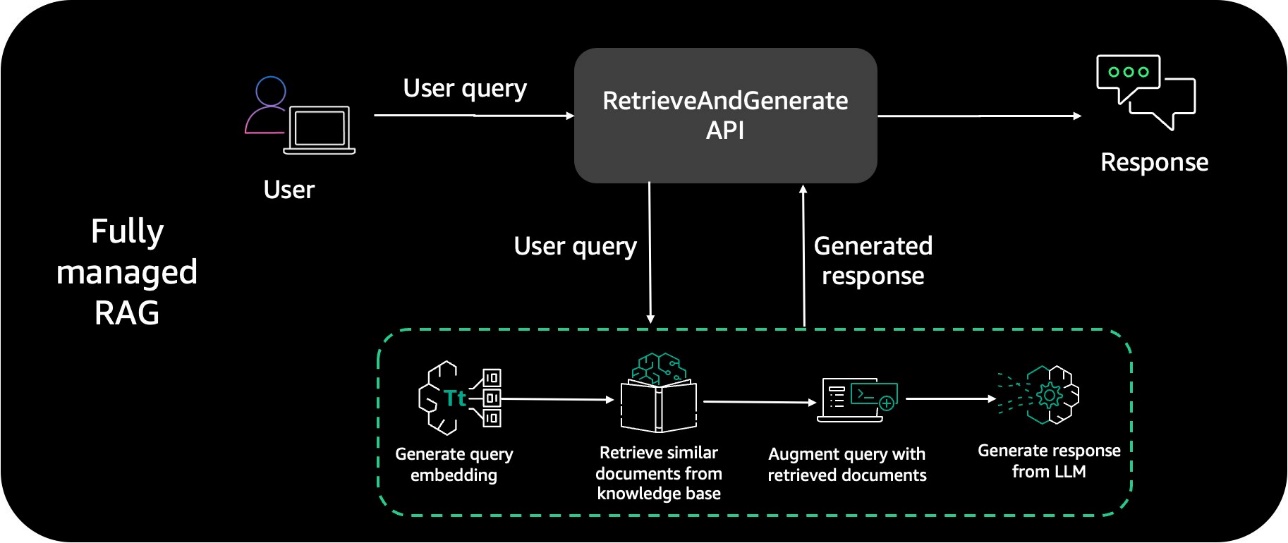

Les bases de connaissances pour Amazon Bedrock sont une option sans serveur permettant de créer de puissants systèmes d'IA conversationnelle à l'aide de RAG. Il offre des flux de travail d’ingestion de données et de génération de texte entièrement gérés.

Pour l'ingestion de données, il gère automatiquement la création, le stockage, la gestion et la mise à jour des intégrations de texte des données du document dans la base de données vectorielle. Il divise les documents en morceaux gérables pour une récupération efficace. Les morceaux sont ensuite convertis en intégrations et écrits dans un index vectoriel, tout en vous permettant de voir les documents sources lorsque vous répondez à une question.

Pour la génération de texte, Amazon Bedrock fournit le Récupérer et générer API pour créer des intégrations de requêtes utilisateur et récupérer les morceaux pertinents de la base de données vectorielles pour générer des réponses précises. Il prend également en charge l'attribution de source et la mémoire à court terme nécessaires aux applications RAG.

Cela vous permet de vous concentrer sur vos applications métier principales et de supprimer les tâches lourdes et indifférenciées.

Vue d'ensemble de la solution

La solution présentée dans cet article utilise un chatbot créé à l'aide d'un Rationalisé application et comprend les services AWS suivants :

Le diagramme suivant est un modèle d'architecture de solution courant que vous pouvez utiliser pour intégrer n'importe quelle application de chatbot aux bases de connaissances pour Amazon Bedrock.

Cette architecture comprend les étapes suivantes :

- Un utilisateur interagit avec l'interface du chatbot Streamlit et soumet une requête en langage naturel

- Cela déclenche une fonction Lambda, qui appelle les bases de connaissances

RetrieveAndGenerateAPI. En interne, les bases de connaissances utilisent un Titan d'Amazonie modèle d'intégration, convertit la requête de l'utilisateur en vecteur et trouve des morceaux sémantiquement similaires à la requête de l'utilisateur. L'invite utilisateur est ensuite complétée par les morceaux récupérés de la base de connaissances. L'invite accompagnée du contexte supplémentaire est ensuite envoyée à un LLM pour la génération de réponse. Dans cette solution, nous utilisons Anthropique Claude Instantané comme notre LLM pour générer des réponses des utilisateurs en utilisant un contexte supplémentaire. Notez que cette solution est prise en charge dans les régions où Anthropic Claude sur Amazon Bedrock est présent. disponibles. - Une réponse contextuellement pertinente est renvoyée à l'application chatbot et à l'utilisateur.

Pré-requis

Les utilisateurs d'Amazon Bedrock doivent demander l'accès aux modèles de base avant qu'ils ne soient disponibles. Il s'agit d'une action unique qui prend moins d'une minute. Pour cette solution, vous devrez activer l'accès au modèle Titan Embeddings G1 – Text et Claude Instant – v1.2 dans Amazon Bedrock. Pour plus d'informations, reportez-vous à Accès au modèle.

Cloner le dépôt GitHub

La solution présentée dans cet article est disponible dans ce qui suit GitHub repo. Vous devez cloner le référentiel GitHub sur votre machine locale. Ouvrez une fenêtre de terminal et exécutez la commande suivante. Notez qu'il s'agit d'une seule commande git clone.

Téléchargez votre ensemble de données de connaissances sur Amazon S3

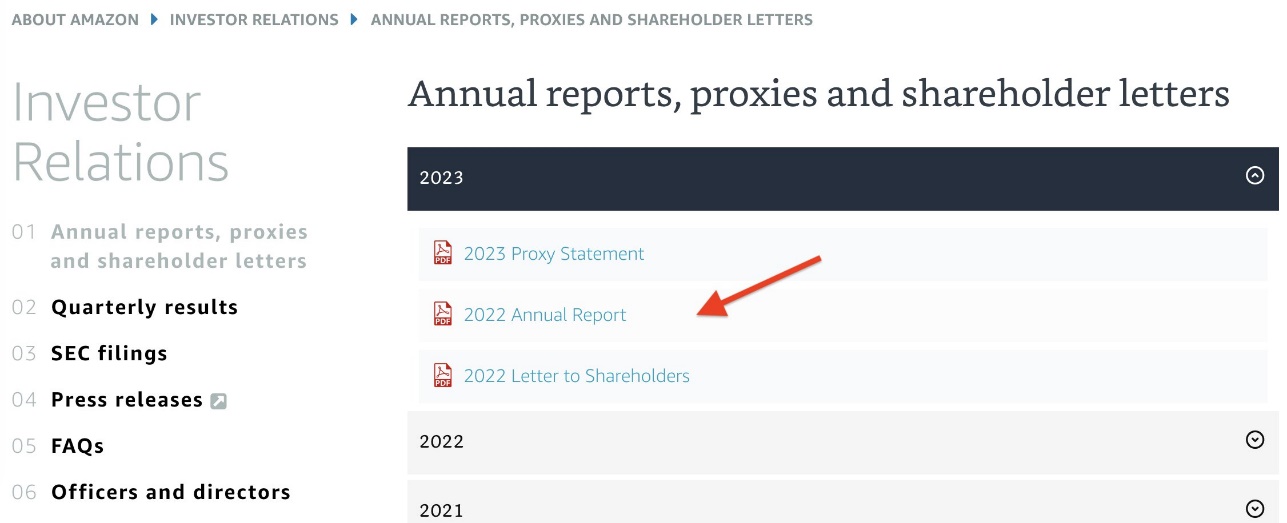

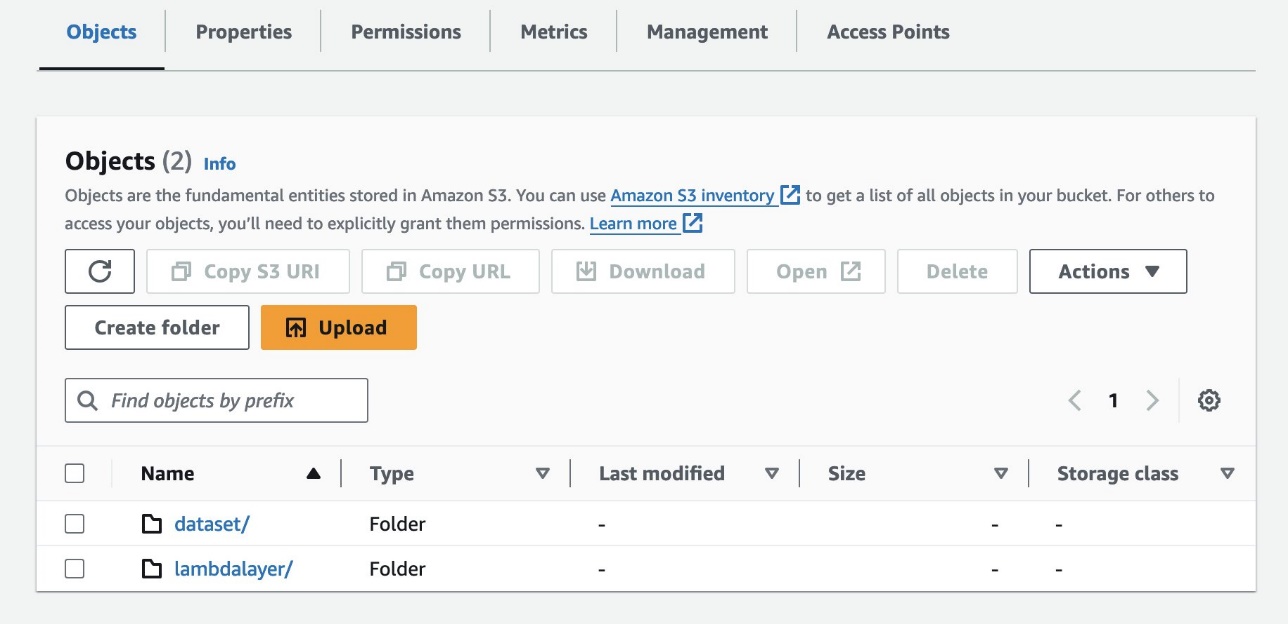

Nous téléchargeons l'ensemble de données pour notre base de connaissances et le téléchargeons dans un compartiment S3. Cet ensemble de données alimentera et alimentera la base de connaissances. Effectuez les étapes suivantes :

- Accédez à la Rapports annuels, procurations et lettres aux actionnaires référentiel de données et téléchargez les lettres des actionnaires d'Amazon des dernières années.

- Sur la console Amazon S3, choisissez Chapeaux cloche dans le volet de navigation.

- Selectionnez Créer un seau.

- Nommez le seau

knowledgebase-<your-awsaccount-number>. - Laissez tous les autres paramètres du compartiment par défaut et choisissez Création.

- Accédez à la

knowledgebase-<your-awsaccount-number>seau. - Selectionnez Créer un dossier et nommez-le ensemble de données.

- Laissez tous les autres paramètres de dossier par défaut et choisissez Création.

- Revenez à l'accueil du bucket et choisissez Créer un dossier pour créer un nouveau dossier et le nommer

lambdalayer. - Laissez tous les autres paramètres par défaut et choisissez Création.

- Accédez à la

datasetdossier. - Téléchargez les fichiers de l'ensemble de données des rapports annuels, des procurations et des lettres aux actionnaires que vous avez téléchargés précédemment dans ce compartiment et choisissez Téléchargement.

- Accédez à la

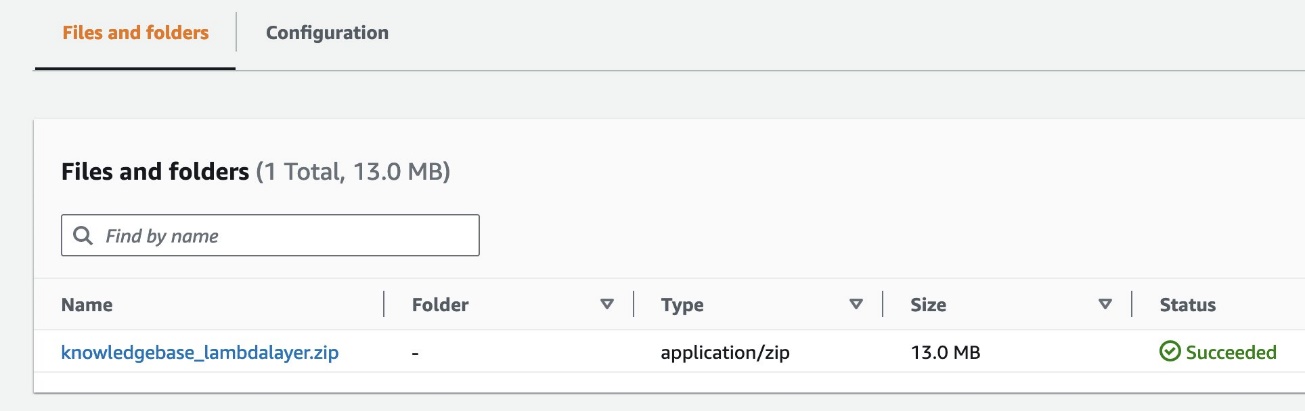

lambdalayerdossier. - Télécharger le

knowledgebase-lambdalayer.zipdossier disponible sous le/lambda/layerdossier dans le dépôt GitHub que vous avez cloné précédemment et choisissez Téléchargement. Vous utiliserez ce code de couche Lambda ultérieurement pour créer la fonction Lambda.

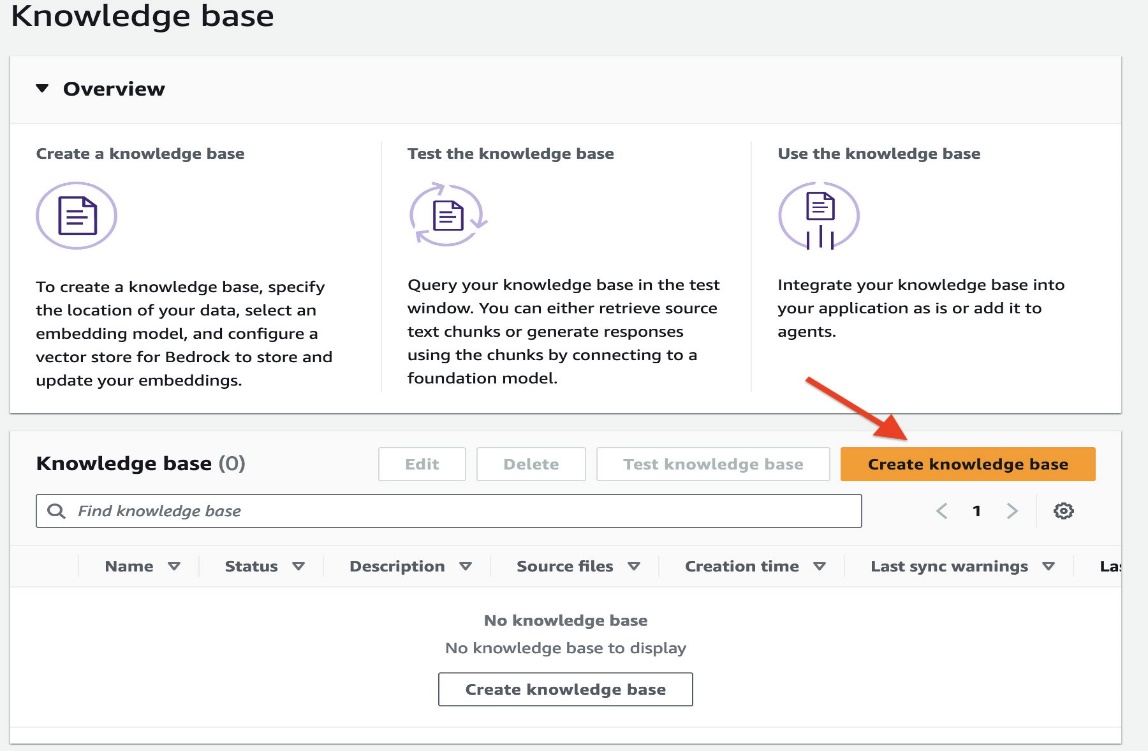

Créer une base de connaissances

Au cours de cette étape, nous créons une base de connaissances à l'aide de l'ensemble de données de lettres d'actionnaires d'Amazon que nous avons téléchargé dans notre compartiment S3 à l'étape précédente.

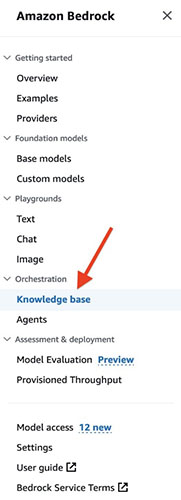

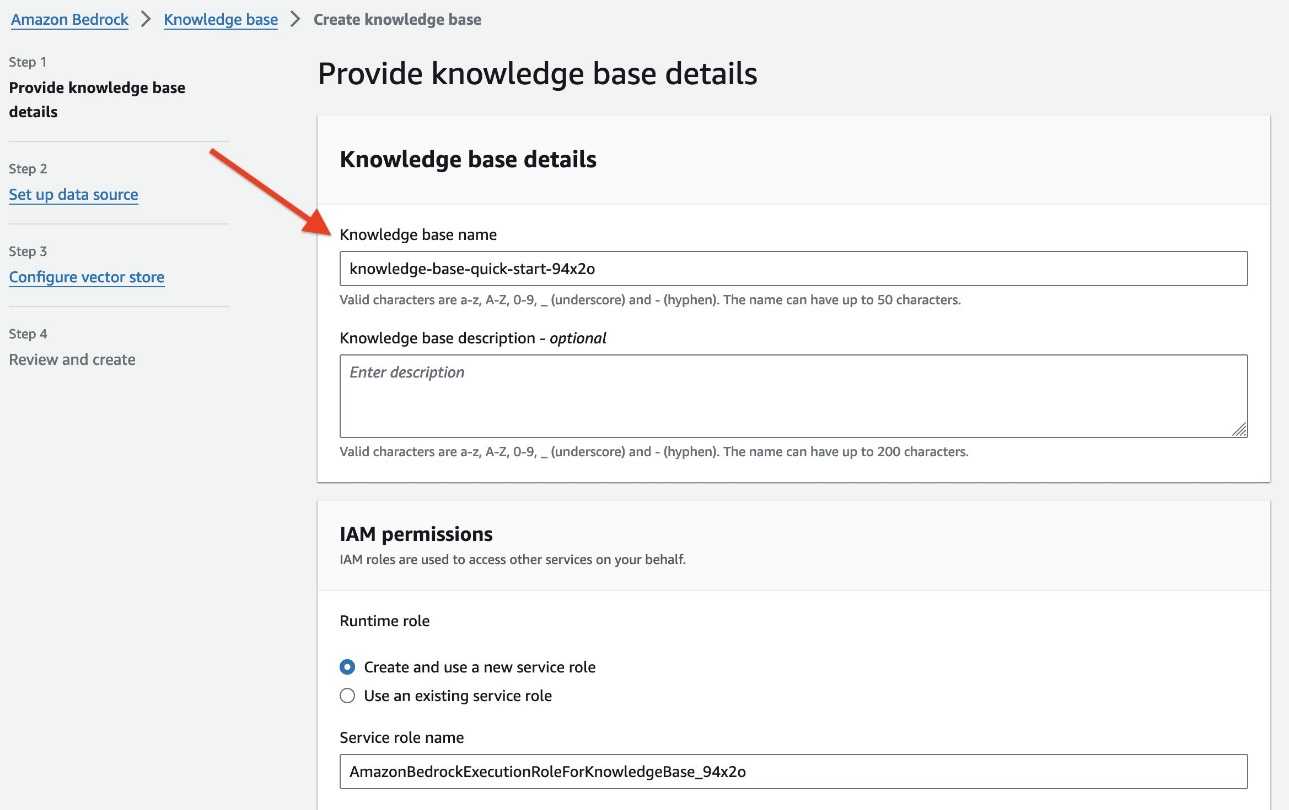

- Sur la console Amazon Bedrock, sous Orchestration dans le volet de navigation, choisissez Base de connaissances.

- Selectionnez Créer une base de connaissances.

- Dans le Détails de la base de connaissances , entrez un nom et une description facultative.

- Dans le Autorisations IAM section, sélectionnez Créer et utiliser un nouveau rôle de service et entrez un nom pour le rôle.

- Ajoutez des balises si nécessaire.

- Selectionnez Suivant.

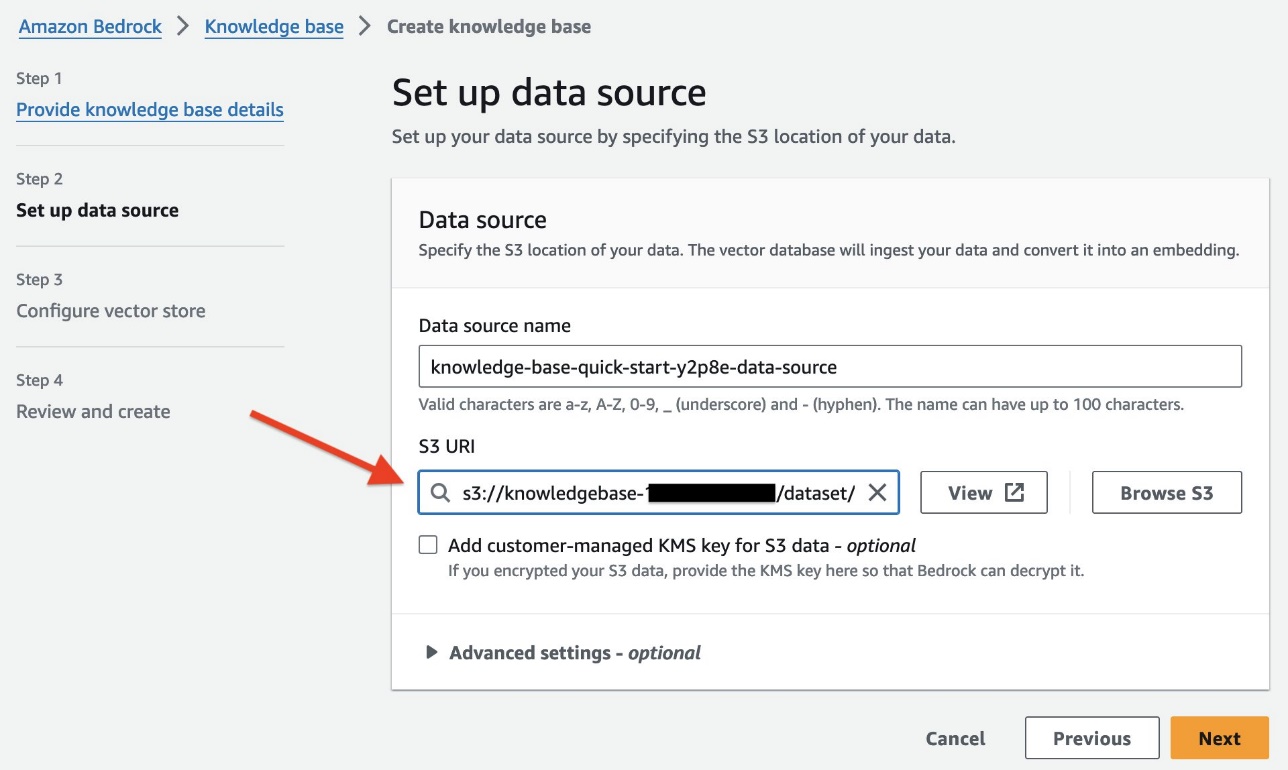

- Laisser Nom de la source de données comme nom par défaut.

- Pour URI S3, choisissez Parcourir S3 pour choisir le bucket S3

knowledgebase-<your-account-number>/dataset/.Vous devez pointer vers le dossier du compartiment et de l'ensemble de données que vous avez créés lors des étapes précédentes. - Dans le paramètres avancés section, laissez les valeurs par défaut (si vous le souhaitez, vous pouvez modifier la stratégie de segmentation par défaut et spécifier la taille du segment et la superposition en pourcentage).

- Selectionnez Suivant.

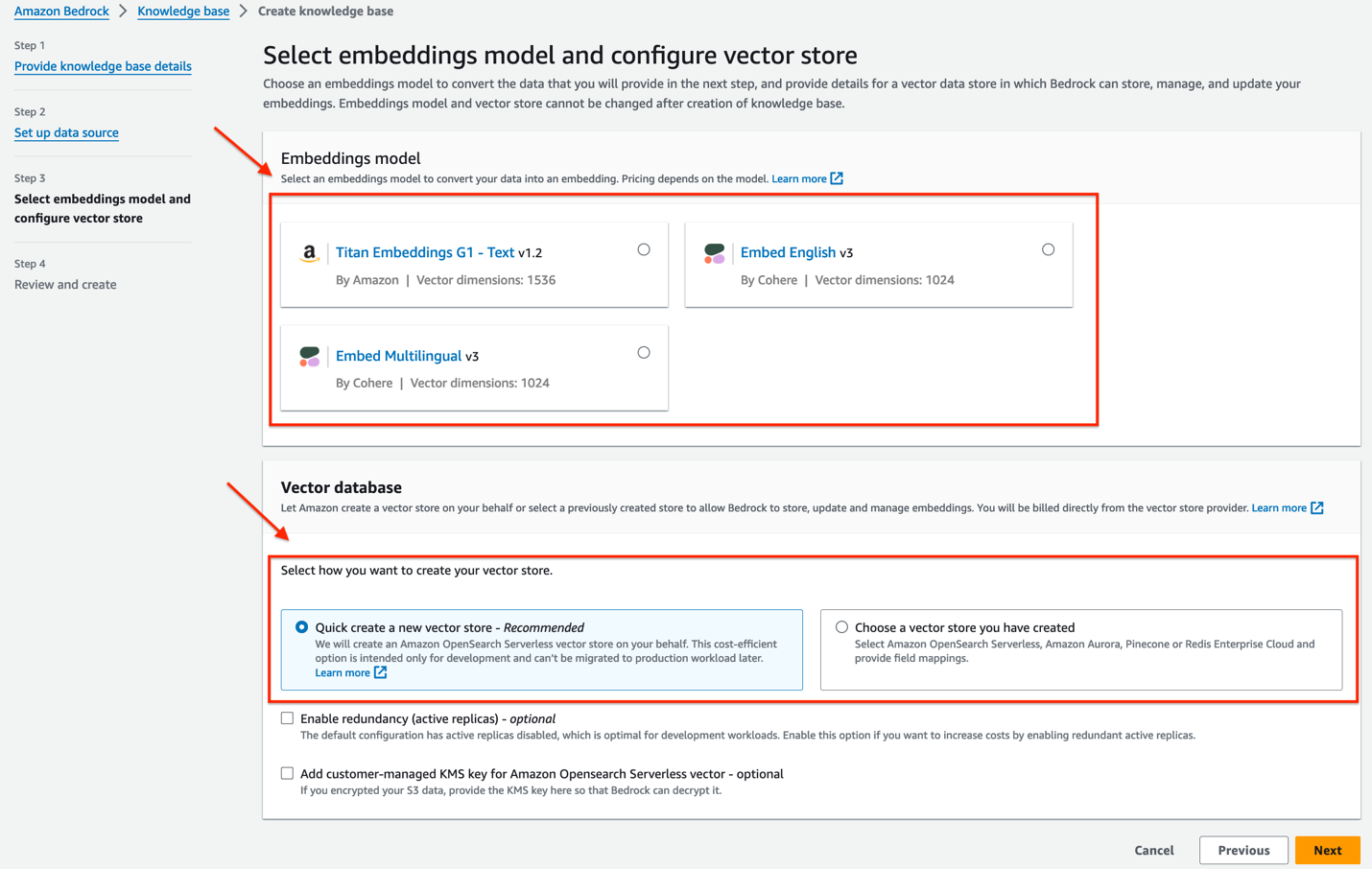

- Pour Modèle d'intégration, sélectionnez Titan Embedding G1 – Texte.

- Pour Base de données vectorielle, vous pouvez soit sélectionner Créez rapidement un nouveau magasin de vecteurs or Choisissez un magasin de vecteurs que vous avez créé. Notez que, pour utiliser le magasin de vecteurs de votre choix, vous devez disposer d'un magasin de vecteurs préconfiguré à utiliser. Nous prenons actuellement en charge quatre types de moteurs vectoriels : le moteur vectoriel pour Amazon OpenSearch Serverless, Amazon Aurora, Pinecone et Redis Enterprise Cloud. Pour cet article, nous sélectionnons Création rapide d'un nouveau magasin de vecteurs, qui crée par défaut un nouveau magasin de vecteurs OpenSearch Serverless dans votre compte.

- Selectionnez Suivant.

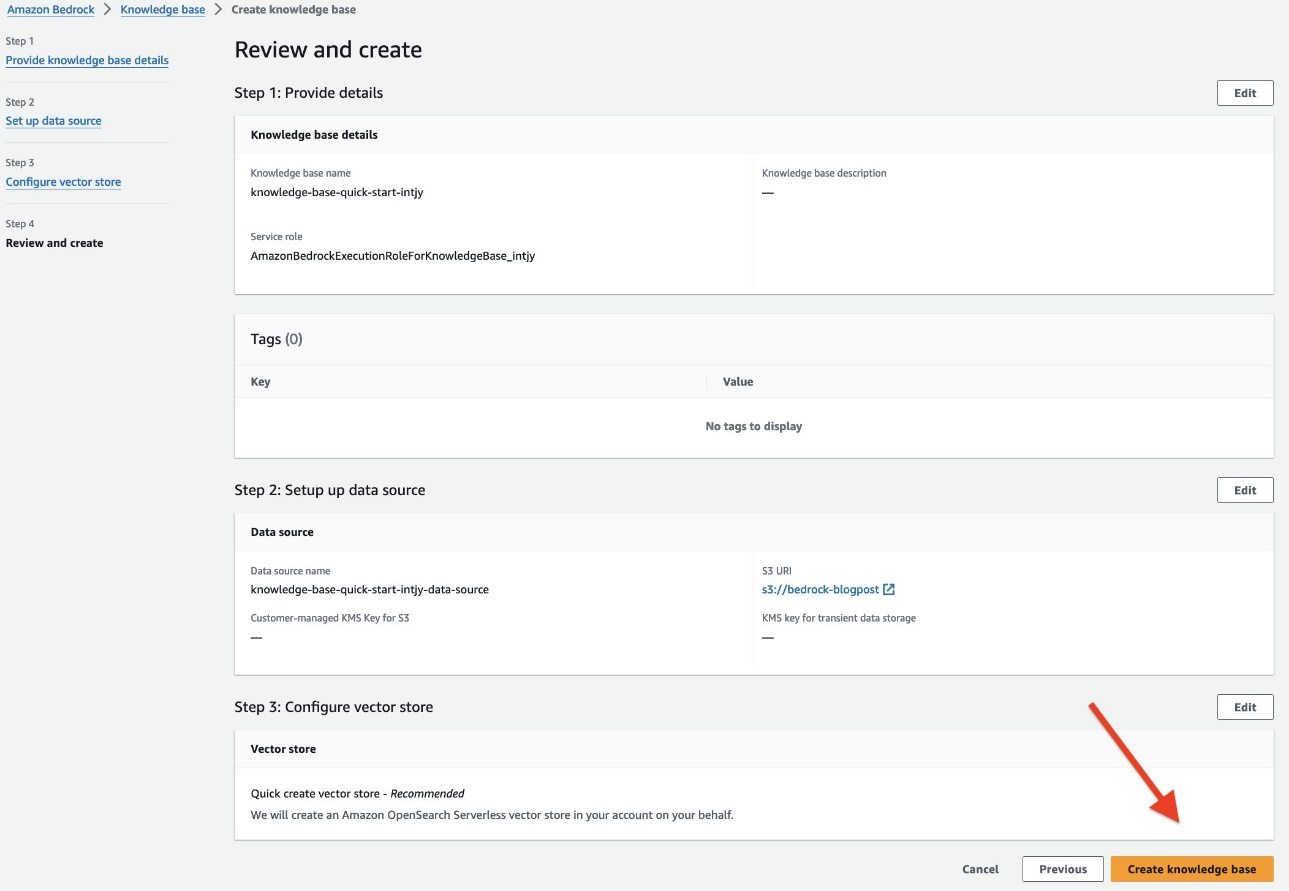

- Sur le Examiner et créer page, vérifiez toutes les informations ou choisissez Précédent pour modifier les options.

- Selectionnez Créer une base de connaissances.

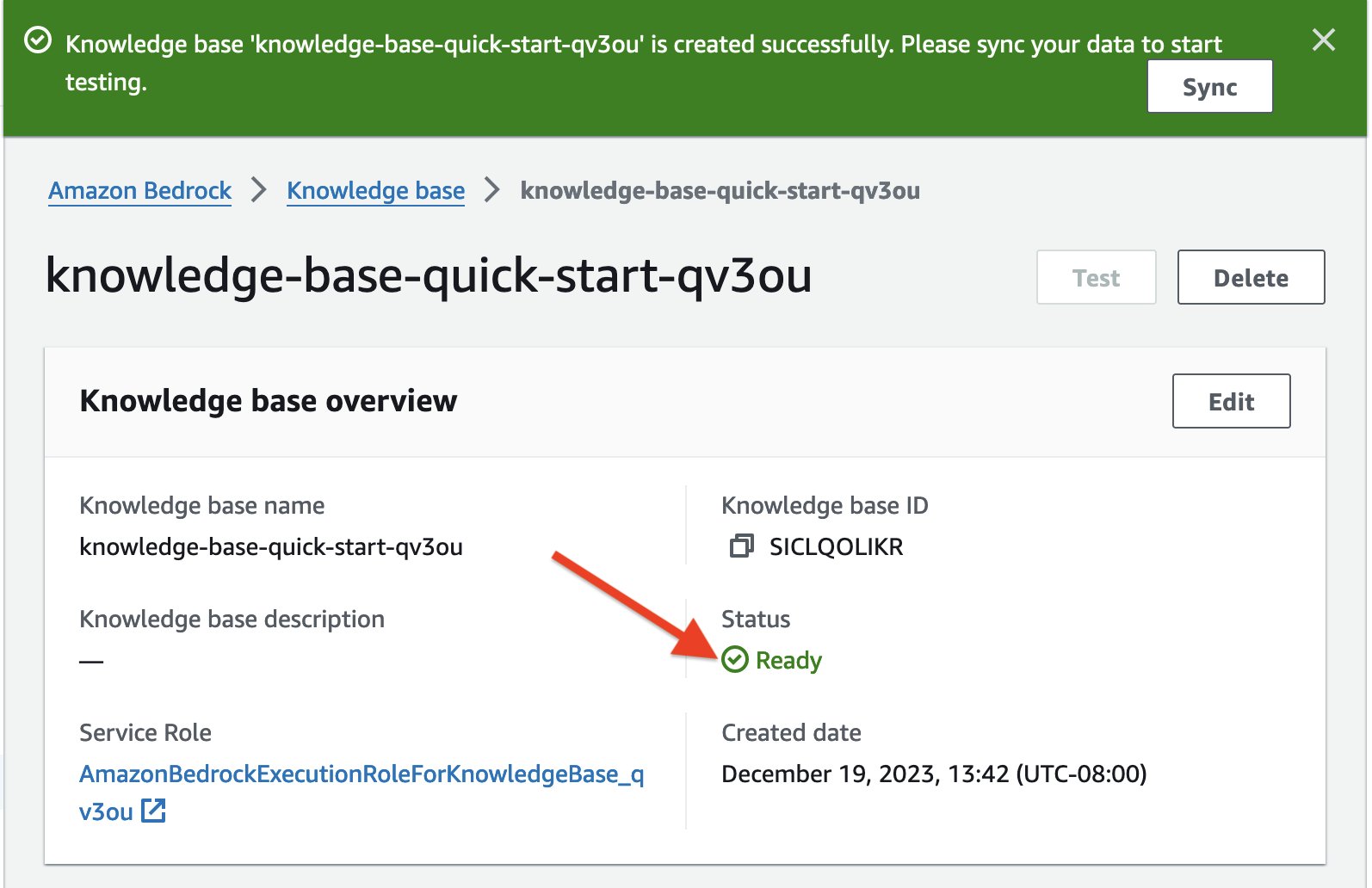

Notez que le processus de création de la base de connaissances commence et que le statut est En cours. La création du magasin de vecteurs et de la base de connaissances prendra quelques minutes. Ne quittez pas la page, sinon la création échouera.

Notez que le processus de création de la base de connaissances commence et que le statut est En cours. La création du magasin de vecteurs et de la base de connaissances prendra quelques minutes. Ne quittez pas la page, sinon la création échouera. - Lorsque l'état de la base de connaissances est dans

Readyétat, notez l’ID de la base de connaissances. Vous l'utiliserez dans les étapes suivantes pour configurer la fonction Lambda.

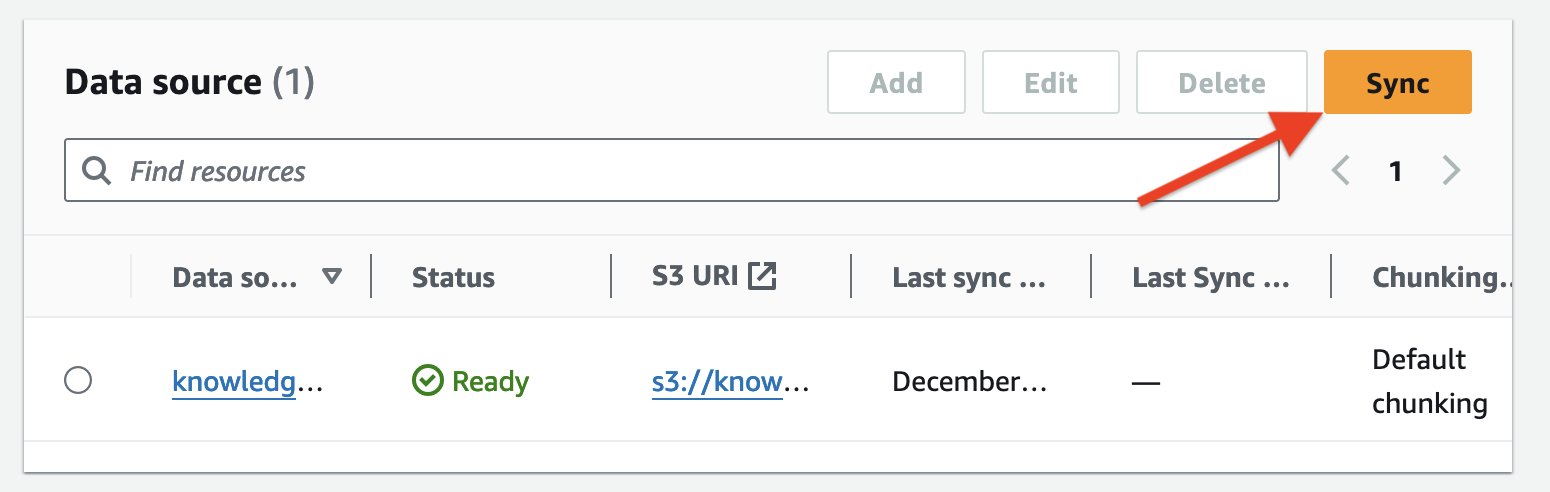

- Maintenant que la base de connaissances est prête, nous devons y synchroniser les données de nos lettres aux actionnaires d'Amazon. Dans le La source de données section de la page de détails de la base de connaissances, choisissez Sync pour déclencher le processus d'ingestion de données du compartiment S3 vers la base de connaissances.

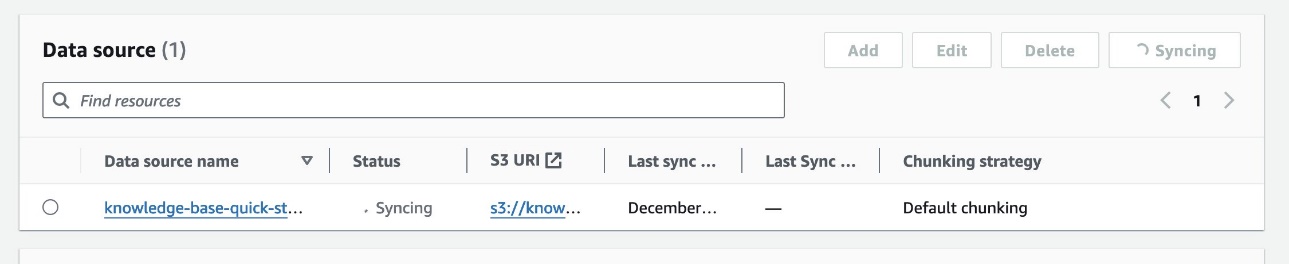

Ce processus de synchronisation divise les fichiers de document en morceaux plus petits de la taille spécifiée précédemment, génère des intégrations vectorielles à l'aide du modèle d'incorporation de texte sélectionné et les stocke dans le magasin de vecteurs géré par les bases de connaissances pour Amazon Bedrock.

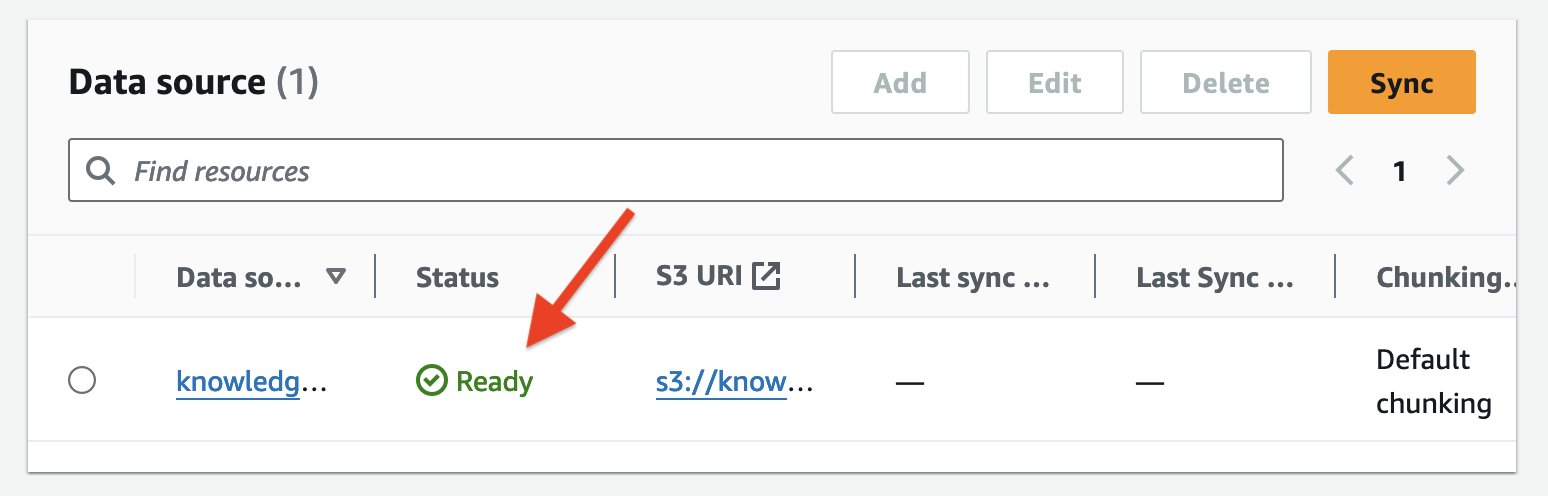

Une fois la synchronisation de l'ensemble de données terminée, l'état de la source de données passera à Ready État. Notez que si vous ajoutez des documents supplémentaires dans le dossier de données S3, vous devez resynchroniser la base de connaissances.

Félicitations, votre base de connaissances est prête.

Notez que vous pouvez également utiliser les bases de connaissances pour les API du service Amazon Bedrock et le Interface de ligne de commande AWS (AWS CLI) pour créer par programme une base de connaissances. Vous devrez exécuter différentes sections du notebook Jupyter fourni dans le cadre du /notebook dossier dans le dépôt GitHub.

Créer une fonction Lambda

Cette fonction Lambda est déployée à l'aide d'un AWS CloudFormation modèle disponible dans le dépôt GitHub sous le /cfn dossier. Le modèle nécessite deux paramètres : le nom du compartiment S3 et l'ID de la base de connaissances.

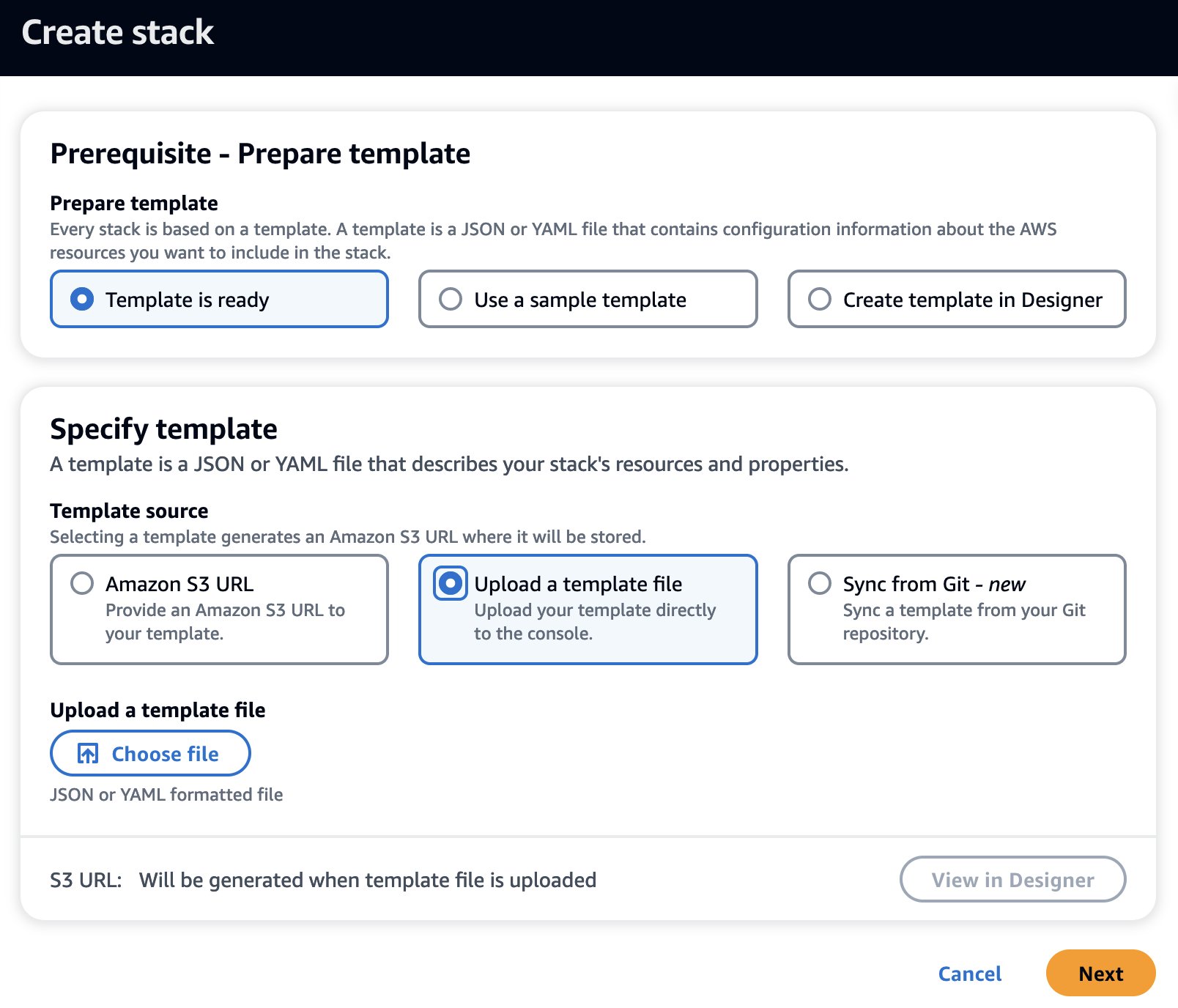

- Sur la page d'accueil du service AWS CloudFormation, choisissez Créer une pile pour créer une nouvelle pile.

- Sélectionnez Le modèle est prêt en Préparer le modèle.

- Sélectionnez Téléchargez le fichier modèle en Source du modèle.

- Selectionnez Choisir le fichier, accédez au dépôt GitHub que vous avez cloné précédemment et choisissez le fichier .yaml sous le

/cfndossier. - Selectionnez Suivant.

- Pour Nom de la pile, entrez un nom.

- Dans le Paramètres , saisissez l'ID de la base de connaissances et le nom du compartiment S3 que vous avez notés précédemment.

- Selectionnez Suivant.

- Laissez toutes les options par défaut telles quelles, choisissez Suivantet choisissez Envoyer.

- Vérifiez que le modèle CloudFormation s'est exécuté correctement et qu'il n'y a aucune erreur.

Félicitations, vous avez créé avec succès une fonction Lambda, des rôles associés et des stratégies.

Testez l'application de chatbot contextuel

Pour tester votre application chatbot, procédez comme suit :

- Ouvrez un nouveau terminal ou une fenêtre de ligne de commande sur votre machine.

- Exécutez la commande suivante pour installer le AWS SDK pour Python (Boto3). Boto3 facilite l'intégration d'une application, d'une bibliothèque ou d'un script Python aux services AWS.

- Exécutez la commande suivante pour installer et configurer un environnement de développement Python local afin d'exécuter l'application Streamlit :

- Accédez à la

/streamlitdossier dans le dossier du référentiel GitHub que vous avez cloné précédemment. - Exécutez la commande suivante pour instancier l'application chatbot :

Cela devrait ouvrir une application de chat Web optimisée par Streamlit dans votre navigateur Web par défaut.

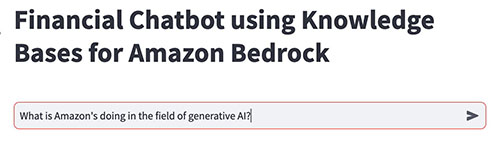

- Utilisez cette application de chatbot Streamlit pour publier des questions en langage naturel afin de démarrer les conversations alimentées par les bases de connaissances pour Amazon Bedrock.

Lorsque vous soumettez une invite, l'application Streamlit déclenche la fonction Lambda, qui appelle les bases de connaissances RetrieveAndGenerate API pour rechercher et générer des réponses.

Le tableau suivant comprend quelques exemples de questions et les réponses associées de la base de connaissances. Essayez certaines de ces questions en utilisant des invites.

| fréquemment posées | Forum |

| Que fait Amazon dans le domaine de l’IA générative ? | Amazon travaille sur ses propres grands modèles de langage (LLM) pour l'IA générative et pense que cela transformera et améliorera chaque expérience client. Ils prévoient de continuer à investir considérablement dans ces modèles dans toutes leurs expériences de consommateur, de vendeur, de marque et de créateur. |

| Quel est le chiffre d'affaires d'AWS d'une année sur l'autre en 2022 ? | Les revenus d'AWS ont augmenté de 29 % d'une année sur l'autre en 2022 sur une base de revenus de 62 milliards de dollars. |

| Combien de jours Amazon a-t-il demandé à ses employés de venir travailler au bureau ? | Amazon a demandé aux employés de l'entreprise de revenir au bureau au moins trois jours par semaine à partir de mai 2022. |

| De quel pourcentage les revenus d'AWS ont-ils augmenté d'une année sur l'autre en 2022 ? | AWS a enregistré un chiffre d'affaires de 29 % d'une année sur l'autre (« YoY ») en 2022. |

| Par rapport aux processeurs Graviton2, quelle amélioration de performances les puces Graviton3 ont-elles apporté selon le passage ? | En 2022, AWS a livré ses puces Graviton3, offrant des performances 25 % supérieures à celles des processeurs Graviton2. |

| Quelle a été la première puce d'inférence lancée par AWS selon le passage ? | AWS a lancé ses premières puces d'inférence (« Inferentia ») en 2019, et a permis à des entreprises comme Amazon d'économiser plus de cent millions de dollars en dépenses d'investissement. |

| Selon le contexte, en quelle année le chiffre d'affaires annuel d'Amazon est-il passé de 245 milliards de dollars à 434 milliards de dollars ? | Le chiffre d'affaires annuel d'Amazon est passé de 245 milliards de dollars en 2019 à 434 milliards de dollars en 2022. |

| Redites-moi quels ont été les revenus en 2019 ? | Le chiffre d'affaires d'Amazon en 2019 s'élevait à 245 milliards de dollars. |

| et, 2021 ? | Le chiffre d'affaires d'Amazon en 2021 s'élevait à 469.8 milliards de dollars, soit une augmentation de 22 % par rapport à 2020. |

| Et rappelez-moi encore quand la première puce d’inférence a-t-elle été lancée ? | La première puce d'inférence d'Amazon était Inferentia, lancée en 2019. |

Lors du premier appel à la fonction Lambda, le RetrieveAndGenerate L'API renvoie un sessionId, qui est ensuite transmis par l'application Streamlit avec l'invite utilisateur suivante en tant qu'entrée à l'API RetrieveAndGenerate pour poursuivre la conversation dans la même session. Le RetrieveAndGenerate L'API gère la mémoire à court terme et utilise l'historique des discussions tant que le même sessionId est transmis en entrée dans les appels successifs.

Félicitations, vous avez créé et testé avec succès une application de chatbot à l'aide des bases de connaissances pour Amazon Bedrock.

Nettoyer

Ne pas supprimer des ressources telles que le compartiment S3, la collection OpenSearch Serverless et la base de connaissances entraînera des frais. Pour nettoyer ces ressources, supprimez la pile CloudFormation, supprimez le compartiment S3 (y compris tous les dossiers de documents et fichiers stockés dans ce compartiment), supprimez la collection OpenSearch Serverless, supprimez la base de connaissances et supprimez tous les rôles, politiques et autorisations que vous avez. créé plus tôt.

Conclusion

Dans cet article, nous avons fourni un aperçu des chatbots contextuels et expliqué pourquoi ils sont importants. Nous avons décrit les complexités impliquées dans les workflows d'ingestion de données et de génération de texte pour une architecture RAG. Nous avons ensuite présenté comment les bases de connaissances pour Amazon Bedrock créent un système RAG sans serveur entièrement géré, comprenant un magasin de vecteurs. Enfin, nous avons fourni une architecture de solution et un exemple de code dans un GitHub repo pour récupérer et générer des réponses contextuelles pour une application de chatbot à l'aide d'une base de connaissances.

En expliquant la valeur des chatbots contextuels, les défis des systèmes RAG et comment les bases de connaissances pour Amazon Bedrock répondent à ces défis, cet article visait à montrer comment Amazon Bedrock vous permet de créer des applications d'IA conversationnelles sophistiquées avec un minimum d'effort.

Pour plus d'informations, consultez le Guide du développeur Amazon Bedrock ainsi que API de la base de connaissances.

À propos des auteurs

Manish Chugh est architecte de solutions principal chez AWS basé à San Francisco, en Californie. Il se spécialise dans l’apprentissage automatique et l’IA générative. Il travaille avec des organisations allant des grandes entreprises aux start-ups sur des problèmes liés à l'apprentissage automatique. Son rôle consiste à aider ces organisations à concevoir des charges de travail évolutives, sécurisées et rentables sur AWS. Il présente régulièrement lors de conférences AWS et d'autres événements partenaires. En dehors du travail, il aime faire de la randonnée sur les sentiers d'East Bay, faire du vélo de route et regarder (et jouer) au cricket.

Manish Chugh est architecte de solutions principal chez AWS basé à San Francisco, en Californie. Il se spécialise dans l’apprentissage automatique et l’IA générative. Il travaille avec des organisations allant des grandes entreprises aux start-ups sur des problèmes liés à l'apprentissage automatique. Son rôle consiste à aider ces organisations à concevoir des charges de travail évolutives, sécurisées et rentables sur AWS. Il présente régulièrement lors de conférences AWS et d'autres événements partenaires. En dehors du travail, il aime faire de la randonnée sur les sentiers d'East Bay, faire du vélo de route et regarder (et jouer) au cricket.

Mani Khanouja est responsable technique – Spécialistes de l'IA générative, auteur du livre Applied Machine Learning and High Performance Computing sur AWS, et membre du conseil d'administration de la Women in Manufacturing Education Foundation. Elle dirige des projets d'apprentissage automatique dans divers domaines tels que la vision par ordinateur, le traitement du langage naturel et l'IA générative. Elle prend la parole lors de conférences internes et externes telles qu'AWS re:Invent, Women in Manufacturing West, les webinaires YouTube et GHC 23. Pendant son temps libre, elle aime faire de longues courses le long de la plage.

Mani Khanouja est responsable technique – Spécialistes de l'IA générative, auteur du livre Applied Machine Learning and High Performance Computing sur AWS, et membre du conseil d'administration de la Women in Manufacturing Education Foundation. Elle dirige des projets d'apprentissage automatique dans divers domaines tels que la vision par ordinateur, le traitement du langage naturel et l'IA générative. Elle prend la parole lors de conférences internes et externes telles qu'AWS re:Invent, Women in Manufacturing West, les webinaires YouTube et GHC 23. Pendant son temps libre, elle aime faire de longues courses le long de la plage.

Pallavi Nargund est architecte de solutions principal chez AWS. Dans son rôle de facilitateur de technologie cloud, elle travaille avec les clients pour comprendre leurs objectifs et leurs défis, et leur donne des conseils prescriptifs pour atteindre leur objectif avec les offres AWS. Elle est passionnée par les femmes dans la technologie et est un membre principal de Women in AI/ML chez Amazon. Elle intervient lors de conférences internes et externes telles qu'AWS re:Invent, AWS Summits et webinaires. En dehors de son travail, elle aime faire du bénévolat, du jardinage, du vélo et de la randonnée.

Pallavi Nargund est architecte de solutions principal chez AWS. Dans son rôle de facilitateur de technologie cloud, elle travaille avec les clients pour comprendre leurs objectifs et leurs défis, et leur donne des conseils prescriptifs pour atteindre leur objectif avec les offres AWS. Elle est passionnée par les femmes dans la technologie et est un membre principal de Women in AI/ML chez Amazon. Elle intervient lors de conférences internes et externes telles qu'AWS re:Invent, AWS Summits et webinaires. En dehors de son travail, elle aime faire du bénévolat, du jardinage, du vélo et de la randonnée.

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- PlatoData.Network Ai générative verticale. Autonomisez-vous. Accéder ici.

- PlatoAiStream. Intelligence Web3. Connaissance Amplifiée. Accéder ici.

- PlatonESG. Carbone, Technologie propre, Énergie, Environnement, Solaire, La gestion des déchets. Accéder ici.

- PlatoHealth. Veille biotechnologique et essais cliniques. Accéder ici.

- La source: https://aws.amazon.com/blogs/machine-learning/build-a-contextual-chatbot-application-using-knowledge-bases-for-amazon-bedrock/

- :possède

- :est

- :où

- $UP

- 100

- 125

- 2019

- 2020

- 2021

- 2022

- 23

- 27

- 500

- 7

- 8

- 9

- a

- capacité

- A Propos

- accélérer

- accès

- accès

- Selon

- Compte

- Avec cette connaissance vient le pouvoir de prendre

- atteindre

- à travers

- Action

- ajouter

- Supplémentaire

- adresses

- Avancée

- avantages

- conseillers

- encore

- agents

- AI

- Systèmes d'IA

- AI / ML

- Destinée

- Tous

- Permettre

- permet

- seul

- le long de

- aux côtés de

- aussi

- Amazon

- Amazon Web Services

- an

- ainsi que

- annuel

- REVENU ANNUEL

- répondre

- répondre

- Anthropique

- tous

- api

- Apis

- appli

- Application

- applications

- appliqué

- une approche

- architecture

- SONT

- AS

- At

- augmenter

- augmentée

- augmentations

- Aurora

- auteur

- automatiquement

- disponibles

- avenue

- et

- AWS

- AWS CloudFormation

- AWS re: Invent

- RETOUR

- base

- basé

- Essentiel

- baie

- Plage

- devenez

- était

- before

- Début

- commence

- humain

- croit

- Améliorée

- Milliards

- planche

- conseil d'administration

- livre

- brand

- navigateur

- construire

- la performance des entreprises

- applications commerciales

- by

- CA

- Appelez-nous

- Appels

- CAN

- capacités

- capital

- cas

- CD

- globaux

- Change

- Modifications

- des charges

- le chat

- Chatbot

- Chatbots

- Passer au paiement

- puce

- chips

- le choix

- Selectionnez

- espace extérieur plus propre,

- cli

- le cloud

- TECHNOLOGIE CLOUD

- code

- collection

- moissonneuses-batteuses

- comment

- vient

- Commun

- Sociétés

- Société

- complet

- complexités

- composants électriques

- calcul

- ordinateur

- Vision par ordinateur

- informatique

- conférences

- NOUS CONTACTER

- Console

- consommateur

- contexte

- contextuel

- contextualiser

- continuer

- Conversation

- de la conversation

- IA conversationnel

- conversations

- converti

- Core

- Entreprises

- rentable

- pourriez

- engendrent

- créée

- crée des

- La création

- création

- créateur

- cricket

- Lecture

- des clients

- comportement de la clientèle

- expérience client

- Service à la clientèle

- Clients

- sont adaptées

- données

- points de données

- data-driven

- Base de données

- jours

- Réglage par défaut

- livrer

- livré

- livrer

- Selon

- déployé

- déploiement

- décrit

- la description

- détails

- Déterminer

- développer

- Développeur

- Développement

- diagramme

- DID

- différent

- numérique

- Administration

- plusieurs

- document

- INSTITUTIONNELS

- faire

- dollars

- domaines

- Ne pas

- down

- download

- chacun

- Plus tôt

- stade précoce

- Est

- Éducation

- efficace

- effort

- d'effort

- non plus

- enrobage

- employés

- permettre

- activateur

- permet

- engageant

- Moteur

- ENGINEERING

- améliorée

- améliorer

- Entrer

- Entreprise

- entreprises

- Environment

- Erreurs

- Pourtant, la

- événements

- Chaque

- exemple

- d'experience

- Expériences

- nous a permis de concevoir

- Expliquer

- expliqué

- expliquant

- externe

- réalités

- FAIL

- few

- champ

- Déposez votre dernière attestation

- Fichiers

- finalement

- trouve

- Prénom

- flux

- Focus

- Abonnement

- Pour

- Fondation

- quatre

- Francisco

- Gratuit

- De

- d’étiquettes électroniques entièrement

- fonction

- g1

- générer

- génère

- génération

- génératif

- IA générative

- Git

- GitHub

- Donner

- Go

- Objectifs

- a augmenté de

- Sol

- Croître

- Pousse

- l'orientation

- ait eu

- manipuler

- Poignées

- Vous avez

- he

- lourd

- levage de charges lourdes

- aider

- ici

- Haute

- de haut niveau

- sa

- Histoire

- Accueil

- Comment

- Cependant

- HTML

- http

- HTTPS

- cent

- ID

- if

- illustrer

- illustre

- la mise en œuvre

- important

- améliorer

- amélioration

- l'amélioration de

- in

- inclut

- Y compris

- intégrer

- incorpore

- Améliore

- increased

- indice

- index

- individuel

- secteurs

- informer

- d'information

- Systèmes D'Information

- contribution

- Messages

- idées.

- installer

- instantané

- intégrer

- Intégration

- l'intégration

- interagit

- intérêts

- Interfaces

- interne

- intérieurement

- développement

- introduire

- introduit

- sueñortiendo

- invoque

- impliqué

- implique

- IT

- jpg

- ACTIVITES

- spécialisées

- langue

- Langues

- gros

- Grandes entreprises

- Nom de famille

- plus tard

- lancé

- couche

- conduire

- Conduit

- apprentissage

- au

- Laisser

- moins

- lettre

- Niveau

- bibliothèques

- Bibliothèque

- lifting

- comme

- aime

- limité

- Gamme

- lien

- LLM

- locales

- Location

- click

- machine learning

- Entrée

- FAIT DU

- maniable

- gérés

- gère

- les gérer

- fabrication

- de nombreuses

- Match

- Mai..

- me

- sens

- mécanisme

- membre

- Mémoire

- seulement

- million

- million de dollars

- minimal

- minute

- Minutes

- modèle

- numériques jumeaux (digital twin models)

- modifier

- PLUS

- (en fait, presque toutes)

- plusieurs

- prénom

- Nature

- Traitement du langage naturel

- NAVIGUER

- Navigation

- Besoin

- nécessaire

- Besoins

- Nouveauté

- next

- aucune

- Aucun

- noter

- cahier

- noté

- objectif

- of

- code

- Offrandes

- Offres Speciales

- Bureaux

- souvent

- on

- ONE

- ouvert

- open source

- optimaux

- Option

- Options

- or

- organisations

- Autre

- autrement

- nos

- ande

- sortie

- au contrôle

- plus de

- aérien

- vue d'ensemble

- propre

- page

- pain

- paramètres

- les partenaires

- les pièces

- passage

- des billets

- passé

- passionné

- passé

- Patron de Couture

- pourcentage

- performant

- autorisations

- Personnalisé

- plan

- Platon

- Intelligence des données Platon

- PlatonDonnées

- jouer

- Point

- des notes bonus

- politiques

- Populaire

- popularité

- Post

- power

- alimenté

- solide

- préférences

- représentent

- présenté

- cadeaux

- précédent

- Directeur

- d'ouvrabilité

- processus

- traitement

- processeurs

- Produits

- Progrès

- projets

- instructions

- propriétaire

- fournir

- à condition de

- fournit

- aportando

- achats

- Python

- requêtes

- question

- question

- fréquemment posées

- Rapide

- chiffon

- allant

- RE

- solutions

- réal

- monde réel

- en temps réel

- Articles

- réduire

- réduire

- reportez-vous

- régions

- régulièrement

- en relation

- pertinence

- pertinent

- supprime

- Rapports

- dépôt

- représentent

- nécessaire

- conditions

- a besoin

- Resources

- Réagir

- réponse

- réponses

- récupération

- Retours

- de revenus

- Avis

- routières

- Rôle

- rôle

- Courir

- fonctionne

- d'exécution

- même

- échantillon

- San

- San Francisco

- sauvé

- évolutive

- mise à l'échelle

- scénario

- Sdk

- Rechercher

- Section

- les sections

- sécurisé

- sur le lien

- Sélectionner

- choisi

- sémantique

- envoyé

- besoin

- Sans serveur

- service

- Services

- Session

- set

- Paramétres

- installation

- actionnaire

- Actionnaires

- elle

- assistance technique à court terme

- devrait

- vitrine

- significative

- similaires

- simultanément

- unique

- Taille

- faibles

- sur mesure

- Solutions

- quelques

- sophistiqué

- Identifier

- Sources

- parle

- spécialistes

- spécialise

- groupe de neurones

- spécifié

- scission

- splits

- empiler

- Commencer

- Startups

- Région

- Statut

- découle

- étapes

- Étapes

- Boutique

- stockée

- STORES

- stockage

- simple

- de Marketing

- rationaliser

- soumettre

- ultérieur

- substantiellement

- Avec succès

- tel

- suggérer

- Sommets

- Support

- Appareils

- Les soutiens

- synchroniser.

- combustion propre

- Système

- table

- Prenez

- prend

- tâches

- technologie

- Technologie

- modèle

- terminal

- tester

- examiné

- texte

- que

- qui

- La

- les informations

- La Source

- leur

- Les

- puis

- Là.

- donc

- Ces

- l'ont

- this

- ceux

- trois

- Avec

- fiable

- Titan

- à

- Transformer

- déclencher

- confiance

- Essai

- deux

- types

- sous

- comprendre

- la mise à jour

- téléchargé

- utilisé

- d'utiliser

- Utilisateur

- utilisateurs

- Usages

- en utilisant

- utilitaire

- v1

- Précieux

- Plus-value

- Valeurs

- divers

- vision

- le volume

- souhaitez

- était

- personne(s) regarde(nt) cette fiche produit

- Façon..

- we

- web

- navigateur web

- services Web

- Basé sur le Web

- Webinaires

- semaine

- Semaines

- Ouest

- Quoi

- quand

- qui

- tout en

- why

- sera

- fenêtre

- comprenant

- Femme

- femmes dans la technologie

- activités principales

- workflow

- workflows

- de travail

- vos contrats

- écrire

- écrire du code

- code écrit

- yaml

- an

- années

- Vous n'avez

- Votre

- Youtube

- zéphyrnet