Les fausses nouvelles, définies comme des informations qui véhiculent ou incorporent des informations fausses, fabriquées ou délibérément trompeuses, existent dès l’émergence de l’imprimerie. La propagation rapide des fausses nouvelles et de la désinformation en ligne est non seulement trompeuse pour le public, mais peut également avoir un impact profond sur la société, la politique, l’économie et la culture. Les exemples comprennent:

- Cultiver la méfiance envers les médias

- Saper le processus démocratique

- Diffuser des données scientifiques fausses ou discréditées (par exemple, le mouvement anti-vax)

Les progrès de l’intelligence artificielle (IA) et de l’apprentissage automatique (ML) ont rendu encore plus facile le développement d’outils permettant de créer et de partager de fausses nouvelles. Les premiers exemples incluent des robots sociaux avancés et des comptes automatisés qui dynamisent la phase initiale de diffusion de fausses nouvelles. En général, il n’est pas anodin pour le public de déterminer si ces comptes sont des personnes ou des robots. De plus, les robots sociaux ne sont pas des outils illégaux et de nombreuses entreprises les achètent légalement dans le cadre de leur stratégie marketing. Il n’est donc pas facile de freiner systématiquement l’utilisation des robots sociaux.

Les découvertes récentes dans le domaine de l’IA générative permettent de produire du contenu textuel à un rythme sans précédent à l’aide de grands modèles linguistiques (LLM). Les LLM sont des modèles de texte d'IA génératifs avec plus d'un milliard de paramètres, et ils facilitent la synthèse de texte de haute qualité.

Dans cet article, nous explorons comment vous pouvez utiliser les LLM pour résoudre le problème répandu de la détection des fausses nouvelles. Nous suggérons que les LLM sont suffisamment avancés pour cette tâche, surtout si des techniques d'invite améliorées telles que Chaîne de pensée ainsi que Réagir sont utilisés conjointement avec des outils de recherche d’informations.

Nous illustrons cela en créant un LangChaîne application qui, à partir d'une nouvelle, informe l'utilisateur si l'article est vrai ou faux en langage naturel. La solution utilise également Socle amazonien, un service entièrement géré qui rend les modèles de base (FM) d'Amazon et de fournisseurs de modèles tiers accessibles via le Console de gestion AWS et les API.

LLM et fausses nouvelles

Le phénomène des fausses nouvelles a commencé à évoluer rapidement avec l’avènement d’Internet et plus particulièrement des médias sociaux (Nielsen et al., 2017). Sur les réseaux sociaux, les fausses nouvelles peuvent être partagées rapidement sur le réseau d'un utilisateur, conduisant le public à se forger une mauvaise opinion collective. En outre, les gens propagent souvent de fausses nouvelles de manière impulsive, ignorant le caractère factuel du contenu si les nouvelles correspondent à leurs normes personnelles (Tsipursky et coll. 2018). Des recherches en sciences sociales ont suggéré que les biais cognitifs (biais de confirmation, effet d’entraînement et biais favorable au choix) sont l’un des facteurs les plus essentiels dans la prise de décisions irrationnelles en termes de création et de consommation de fausses nouvelles (Kim et al., 2021). Cela implique également que les consommateurs d’informations partagent et consomment des informations uniquement dans le but de renforcer leurs convictions.

La capacité de l’IA générative à produire du contenu textuel et riche à un rythme sans précédent aggrave le problème des fausses nouvelles. Un exemple digne de mention est la technologie deepfake, qui combine diverses images sur une vidéo originale et génère une vidéo différente. Outre l’intention de désinformation apportée par les acteurs humains, les LLM ajoutent une toute nouvelle série de défis :

- Erreurs factuelles – Les LLM ont un risque accru de contenir des erreurs factuelles en raison de la nature de leur formation et de leur capacité à faire preuve de créativité tout en générant les mots suivants dans une phrase. La formation LLM est basée sur la présentation répétée d'un modèle avec une entrée incomplète, puis sur l'utilisation de techniques de formation ML jusqu'à ce qu'il comble correctement les lacunes, apprenant ainsi la structure du langage et un modèle mondial basé sur le langage. Par conséquent, bien que les LLM soient d’excellents comparateurs de modèles et recombineurs (« perroquets stochastiques »), ils échouent dans un certain nombre de tâches simples qui nécessitent un raisonnement logique ou une déduction mathématique, et peuvent halluciner des réponses. De plus, la température est l'un des paramètres d'entrée LLM qui contrôle le comportement du modèle lors de la génération du mot suivant dans une phrase. En sélectionnant une température plus élevée, le modèle utilisera un mot de probabilité plus faible, fournissant ainsi une réponse plus aléatoire.

- Longue – Les textes générés ont tendance à être longs et manquent d’une granularité clairement définie pour les faits individuels.

- Manque de vérification des faits – Il n'existe aucun outil standardisé disponible pour vérifier les faits pendant le processus de génération de texte.

Dans l’ensemble, la combinaison de la psychologie humaine et des limites des systèmes d’IA a créé une tempête parfaite pour la prolifération des fausses nouvelles et de la désinformation en ligne.

Vue d'ensemble de la solution

Les LLM démontrent des capacités exceptionnelles en matière de génération, de compréhension et d'apprentissage du langage. Ils sont formés sur un vaste corpus de textes provenant d’Internet, dont la qualité et l’exactitude du langage naturel extrait peuvent ne pas être garanties.

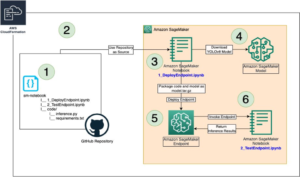

Dans cet article, nous proposons une solution pour détecter les fausses nouvelles basée à la fois sur des approches rapides de chaîne de pensée et de réaction (raisonnement et action). Tout d'abord, nous discutons de ces deux techniques d'ingénierie rapide, puis nous montrons leur mise en œuvre à l'aide de LangChain et Amazon Bedrock.

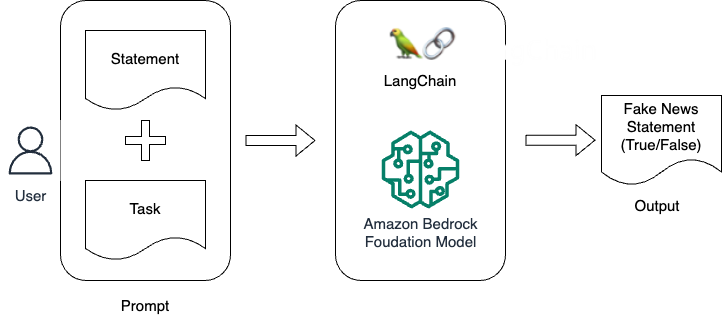

Le schéma d'architecture suivant présente la solution pour notre détecteur de fausses nouvelles.

Schéma d'architecture pour la détection des fausses nouvelles.

Nous utilisons un sous-ensemble de Ensemble de données FIÈVRE contenant une déclaration et la vérité terrain sur la déclaration indiquant des affirmations fausses, vraies ou invérifiables (Thorne J. et coll., 2018).

Le flux de travail peut être décomposé en les étapes suivantes :

- L'utilisateur sélectionne l'une des déclarations pour vérifier si elle est fausse ou vraie.

- La déclaration et la tâche de détection des fausses nouvelles sont intégrées à l'invite.

- L'invite est transmise à LangChain, qui appelle le FM dans Amazon Bedrock.

- Amazon Bedrock renvoie une réponse à la demande de l'utilisateur avec l'instruction True ou False.

Dans cet article, nous utilisons le modèle Claude v2 d'Anthropic (anthropic.claude-v2). Claude est un LLM génératif basé sur les recherches d'Anthropic sur la création de systèmes d'IA fiables, interprétables et orientables. Créé à l'aide de techniques telles que l'IA constitutionnelle et la formation à l'innocuité, Claude excelle dans le dialogue réfléchi, la création de contenu, le raisonnement complexe, la créativité et le codage. Cependant, en utilisant Amazon Bedrock et notre architecture de solution, nous avons également la possibilité de choisir parmi d'autres FM fournis par Amazon, AI21labs, Adhéreret une Stabilité.ai.

Vous pouvez trouver les détails de mise en œuvre dans les sections suivantes. Le code source est disponible dans le référentiel GitHub.

Pré-requis

Pour ce didacticiel, vous avez besoin d'un terminal bash avec Python 3.9 ou supérieur installé sur Linux, Mac ou un sous-système Windows pour Linux et d'un compte AWS.

Nous recommandons également d'utiliser soit un Amazon SageMakerStudio cahier, un AWSCloud9 exemple, ou un Cloud de calcul élastique Amazon (Amazon EC2).

Déployez la détection des fausses nouvelles à l'aide de l'API Amazon Bedrock

La solution utilise l'API Amazon Bedrock, accessible via le Interface de ligne de commande AWS (AWS CLI), le AWS SDK pour Python (Boto3), Ou une Amazon Sage Maker carnet de notes. Se référer au Guide de l'utilisateur d'Amazon Bedrock pour plus d'informations. Pour cet article, nous utilisons l'API Amazon Bedrock via le SDK AWS pour Python.

Configurer l'environnement API Amazon Bedrock

Pour configurer votre environnement API Amazon Bedrock, procédez comme suit :

- Téléchargez la dernière version de Boto3 ou mettez-la à niveau :

- Assurez-vous de configurer les informations d'identification AWS à l'aide du

aws configurecommande ou transmettez-les au client Boto3. - Installez la dernière version de LangChaîne:

Vous pouvez maintenant tester votre configuration à l'aide du script shell Python suivant. Le script instancie le client Amazon Bedrock à l'aide de Boto3. Ensuite, nous appelons le list_foundation_models API pour obtenir la liste des modèles de fondation disponibles.

Après avoir exécuté avec succès la commande précédente, vous devriez obtenir la liste des FM d'Amazon Bedrock.

LangChain comme solution de chaînage rapide

Pour détecter les fausses nouvelles pour une phrase donnée, nous suivons le processus de raisonnement en chaîne de pensée zéro (Wei J. et coll., 2022), qui se compose des étapes suivantes :

- Initialement, le modèle tente de créer une déclaration sur les nouvelles proposées.

- Le modèle crée une liste à puces d'assertions.

- Pour chaque assertion, le modèle détermine si l'assertion est vraie ou fausse. A noter qu'en utilisant cette méthodologie, le modèle s'appuie exclusivement sur ses connaissances internes (poids calculés en phase de pré-entraînement) pour parvenir à un verdict. Les informations ne sont vérifiées par rapport à aucune donnée externe à ce stade.

- Compte tenu des faits, le modèle répond VRAI ou FAUX pour l'instruction donnée dans l'invite.

Pour réaliser ces étapes, nous utilisons LangChain, un framework de développement d'applications alimentées par des modèles de langage. Ce framework nous permet d'augmenter les FM en enchaînant divers composants pour créer des cas d'utilisation avancés. Dans cette solution, nous utilisons le SimpleSequentialChain dans LangChain pour créer une chaîne séquentielle simple. C’est très utile, car nous pouvons prendre la sortie d’une chaîne et l’utiliser comme entrée dans une autre.

Amazon Bedrock est intégré à LangChain, il vous suffit donc de l'instancier en passant le model_id lors de l'instanciation de l'objet Amazon Bedrock. Si nécessaire, les paramètres d'inférence du modèle peuvent être fournis via le model_kwargs argument, tel que :

- maxTokenCount – Le nombre maximum de jetons dans la réponse générée

- stopSéquences – La séquence d’arrêt utilisée par le modèle

- la réactivité – Une valeur comprise entre 0 et 1, 0 étant la plus déterministe et 1 la plus créative

- top – Une valeur comprise entre 0 et 1 et utilisée pour contrôler les choix des jetons en fonction de la probabilité des choix potentiels.

Si c'est la première fois que vous utilisez un modèle fondamental Amazon Bedrock, assurez-vous de demander l'accès au modèle en sélectionnant dans la liste des modèles sur le Accès au modèle page sur la console Amazon Bedrock, qui dans notre cas est claude-v2 d'Anthropic.

La fonction suivante définit la chaîne d'invites de chaîne de pensée que nous avons mentionnée précédemment pour détecter les fausses nouvelles. La fonction prend l'objet Amazon Bedrock (llm) et l'invite utilisateur (q) comme arguments. LangChain's Modèle d'invite la fonctionnalité est utilisée ici pour prédéfinir une recette pour générer des invites.

Le code suivant appelle la fonction que nous avons définie précédemment et fournit la réponse. La déclaration est TRUE or FALSE. TRUE signifie que la déclaration fournie contient des faits exacts, et FALSE signifie que la déclaration contient au moins un fait incorrect.

Un exemple d'instruction et de réponse de modèle est fourni dans le résultat suivant :

ReAct et outils

Dans l'exemple précédent, le modèle a correctement identifié que l'instruction est fausse. Cependant, soumettre à nouveau la requête démontre l'incapacité du modèle à distinguer l'exactitude des faits. Le modèle ne dispose pas des outils nécessaires pour vérifier la véracité des déclarations au-delà de sa propre mémoire d'entraînement, de sorte que les exécutions ultérieures de la même invite peuvent l'amener à étiqueter à tort les fausses déclarations comme étant vraies. Dans le code suivant, vous avez une exécution différente du même exemple :

Une technique pour garantir la véracité est ReAct. Réagir (Yao S. et coll., 2023) est une technique d'invite qui augmente le modèle de base avec l'espace d'action d'un agent. Dans cet article, ainsi que dans l'article ReAct, l'espace d'action implémente la récupération d'informations à l'aide d'actions de recherche, de recherche et de fin à partir d'une simple API Web Wikipédia.

La raison derrière l'utilisation de ReAct par rapport à Chain-of-Thought est d'utiliser la récupération de connaissances externes pour augmenter le modèle de base afin de détecter si une nouvelle donnée est fausse ou vraie.

Dans cet article, nous utilisons l'implémentation de ReAct par LangChain via l'agent ZERO_SHOT_REACT_DESCRIPTION. Nous modifions la fonction précédente pour implémenter ReAct et utiliser Wikipedia en utilisant la fonction load_tools du langchain.agents.

Nous devons également installer le package Wikipedia :

!pip install Wikipedia

Ci-dessous le nouveau code :

Ce qui suit est le résultat de la fonction précédente avec la même instruction utilisée auparavant :

Nettoyer

Pour réduire les coûts, supprimez toutes les ressources que vous avez déployées dans le cadre du didacticiel. Si vous avez lancé AWS Cloud9 ou une instance EC2, vous pouvez la supprimer via la console ou à l'aide de l'AWS CLI. De même, vous pouvez supprimer le notebook SageMaker que vous avez éventuellement créé via la console SageMaker.

Limites et travaux connexes

Le domaine de la détection des fausses nouvelles fait activement l’objet de recherches dans la communauté scientifique. Dans cet article, nous avons utilisé les techniques de chaîne de pensée et de ReAct et, lors de l'évaluation des techniques, nous nous sommes uniquement concentrés sur l'exactitude de la classification des techniques d'invite (si une déclaration donnée est vraie ou fausse). Par conséquent, nous n’avons pas pris en compte d’autres aspects importants tels que la rapidité de réponse, ni étendu la solution à des sources de connaissances supplémentaires en dehors de Wikipédia.

Bien que cet article se concentre sur deux techniques, Chain-of-Thought et ReAct, de nombreux travaux ont exploré comment les LLM peuvent détecter, éliminer ou atténuer les fausses nouvelles. Lee et al. a proposé l'utilisation d'un modèle codeur-décodeur utilisant NER (reconnaissance d'entité nommée) pour masquer les entités nommées afin de garantir que le jeton masqué utilise réellement les connaissances codées dans le modèle de langage. Chern et al. a développé FacTool, qui utilise les principes de la chaîne de pensée pour extraire les affirmations de l'invite et, par conséquent, collecter les preuves pertinentes des affirmations. Le LLM juge ensuite de la factualité de l'affirmation compte tenu de la liste des preuves récupérées. Du E. et coll. présente une approche complémentaire où plusieurs LLM proposent et débattent de leurs réponses individuelles et de leurs processus de raisonnement sur plusieurs tours afin d'arriver à une réponse finale commune.

Sur la base de la littérature, nous constatons que l'efficacité des LLM dans la détection des fausses nouvelles augmente lorsque les LLM sont complétés par des connaissances externes et une capacité de conversation multi-agents. Cependant, ces approches sont plus complexes sur le plan informatique, car elles nécessitent plusieurs appels et interactions de modèle, des invites plus longues et des appels de couche réseau plus longs. En fin de compte, cette complexité se traduit par un coût global accru. Nous recommandons d'évaluer le rapport coût/performance avant de déployer des solutions similaires en production.

Conclusion

Dans cet article, nous avons expliqué comment utiliser les LLM pour lutter contre le problème répandu des fausses nouvelles, qui constituent l'un des défis majeurs de notre société d'aujourd'hui. Nous avons commencé par décrire les défis posés par les fausses nouvelles, en mettant l’accent sur leur potentiel à influencer l’opinion publique et à provoquer des perturbations sociétales.

Nous avons ensuite introduit le concept de LLM en tant que modèles d’IA avancés entraînés sur une quantité substantielle de données. Grâce à cette formation approfondie, ces modèles possèdent une compréhension impressionnante du langage, leur permettant de produire un texte de type humain. Grâce à cette capacité, nous avons démontré comment les LLM peuvent être exploités dans la lutte contre les fausses nouvelles en utilisant deux techniques d'invite différentes, Chain-of-Thought et ReAct.

Nous avons souligné comment les LLM peuvent faciliter les services de vérification des faits à une échelle sans précédent, compte tenu de leur capacité à traiter et analyser rapidement de grandes quantités de textes. Ce potentiel d’analyse en temps réel peut conduire à une détection précoce et à l’endiguement des fausses nouvelles. Nous avons illustré cela en créant un script Python qui, à partir d'une déclaration, indique à l'utilisateur si l'article est vrai ou faux en utilisant un langage naturel.

Nous avons conclu en soulignant les limites de l'approche actuelle et avons terminé sur une note d'espoir, en soulignant que, avec des garanties appropriées et des améliorations continues, les LLM pourraient devenir des outils indispensables dans la lutte contre les fausses nouvelles.

Nous aimerions recevoir de vos nouvelles. Faites-nous savoir ce que vous pensez dans la section commentaires ou utilisez le forum des problèmes dans le référentiel GitHub.

Avertissement : le code fourni dans cet article est uniquement destiné à des fins éducatives et d'expérimentation. Il ne faut pas s’y fier pour détecter les fausses nouvelles ou la désinformation dans les systèmes de production du monde réel. Aucune garantie n'est donnée quant à l'exactitude ou à l'exhaustivité de la détection des fausses nouvelles à l'aide de ce code. Les utilisateurs doivent faire preuve de prudence et faire preuve de diligence raisonnable avant d’utiliser ces techniques dans des applications sensibles.

Pour démarrer avec Amazon Bedrock, visitez le Console Amazon Bedrock.

À propos des auteurs

Anamaria Todor est un architecte de solutions principal basé à Copenhague, au Danemark. Elle a vu son premier ordinateur à l’âge de 4 ans et n’a depuis jamais abandonné l’informatique, les jeux vidéo et l’ingénierie. Elle a occupé divers postes techniques, de freelance, développeur full-stack, ingénieur de données, responsable technique et CTO, dans diverses entreprises au Danemark, en se concentrant sur les secteurs du jeu et de la publicité. Elle travaille chez AWS depuis plus de 3 ans, où elle travaille en tant qu'architecte de solutions principale, se concentrant principalement sur les sciences de la vie et l'IA/ML. Anamaria est titulaire d'un baccalauréat en ingénierie appliquée et en informatique, d'une maîtrise en informatique et de plus de 10 ans d'expérience AWS. Lorsqu'elle ne travaille pas ou ne joue pas à des jeux vidéo, elle aide des filles et des professionnelles à comprendre et à trouver leur chemin à travers la technologie.

Anamaria Todor est un architecte de solutions principal basé à Copenhague, au Danemark. Elle a vu son premier ordinateur à l’âge de 4 ans et n’a depuis jamais abandonné l’informatique, les jeux vidéo et l’ingénierie. Elle a occupé divers postes techniques, de freelance, développeur full-stack, ingénieur de données, responsable technique et CTO, dans diverses entreprises au Danemark, en se concentrant sur les secteurs du jeu et de la publicité. Elle travaille chez AWS depuis plus de 3 ans, où elle travaille en tant qu'architecte de solutions principale, se concentrant principalement sur les sciences de la vie et l'IA/ML. Anamaria est titulaire d'un baccalauréat en ingénierie appliquée et en informatique, d'une maîtrise en informatique et de plus de 10 ans d'expérience AWS. Lorsqu'elle ne travaille pas ou ne joue pas à des jeux vidéo, elle aide des filles et des professionnelles à comprendre et à trouver leur chemin à travers la technologie.

Marcel Castro est un architecte de solutions senior basé à Oslo, en Norvège. Dans son rôle, Marcel aide les clients dans l'architecture, la conception et le développement d'une infrastructure optimisée pour le cloud. Il est membre de l'équipe AWS Generative AI Ambassador dont l'objectif est de guider et de soutenir les clients EMEA dans leur parcours d'IA générative. Il est titulaire d'un doctorat en informatique obtenu en Suède ainsi que d'une maîtrise et d'une licence en génie électrique et télécommunications obtenues au Brésil.

Marcel Castro est un architecte de solutions senior basé à Oslo, en Norvège. Dans son rôle, Marcel aide les clients dans l'architecture, la conception et le développement d'une infrastructure optimisée pour le cloud. Il est membre de l'équipe AWS Generative AI Ambassador dont l'objectif est de guider et de soutenir les clients EMEA dans leur parcours d'IA générative. Il est titulaire d'un doctorat en informatique obtenu en Suède ainsi que d'une maîtrise et d'une licence en génie électrique et télécommunications obtenues au Brésil.

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- PlatoData.Network Ai générative verticale. Autonomisez-vous. Accéder ici.

- PlatoAiStream. Intelligence Web3. Connaissance Amplifiée. Accéder ici.

- PlatonESG. Carbone, Technologie propre, Énergie, Environnement, Solaire, La gestion des déchets. Accéder ici.

- PlatoHealth. Veille biotechnologique et essais cliniques. Accéder ici.

- La source: https://aws.amazon.com/blogs/machine-learning/harness-large-language-models-in-fake-news-detection/

- :possède

- :est

- :ne pas

- :où

- 100 millions de dollars

- $UP

- 1

- 10

- 100

- 12

- 13

- 14

- 20

- 2022

- 21

- 26%

- 27

- 32

- 36

- 7

- 9

- a

- capacité

- A Propos

- au dessus de

- AC

- académique

- recherche universitaire

- Académie

- accès

- accédé

- accessible

- Compte

- hybrides

- précision

- atteindre

- réalisations

- à travers

- intérim

- Action

- actes

- activement

- acteurs

- actually

- ajouter

- ajout

- Supplémentaire

- Avancée

- avènement

- Numérique

- encore

- à opposer à

- Agent

- agents

- AI

- Modèles AI

- Systèmes d'IA

- AI / ML

- AL

- Tous

- permet

- seul

- aussi

- Bien que

- Amazon

- Amazon EC2

- Amazon Web Services

- Ambassadeur

- Américaine

- parmi

- quantités

- an

- selon une analyse de l’Université de Princeton

- il analyse

- Ancien

- ainsi que

- Annuellement

- Une autre

- répondre

- réponses

- Anthropique

- tous

- api

- Apis

- apparaît

- Application

- applications

- appliqué

- nommé

- une approche

- approches

- d'environ

- architecture

- SONT

- argument

- arguments

- autour

- article

- artificiel

- intelligence artificielle

- Intelligence artificielle (AI)

- Les arts

- AS

- aspects

- Évaluation

- évaluations

- hypothèses

- assuré

- astronomie

- At

- Tentatives

- augmenter

- augmentée

- augmentations

- Automatisation

- disponibles

- attribué

- AWS

- AWSCloud9

- base

- basé

- bash

- Bataille

- BE

- car

- devenez

- devenir

- était

- before

- humain

- derrière

- va

- croyances

- outre

- jusqu'à XNUMX fois

- Au-delà

- biais

- Milliards

- biologie

- biomédical

- corps

- tous les deux

- les robots

- Brasil

- apporter

- Cassé

- intégré

- homme d'affaires

- mais

- by

- Appelez-nous

- Appels

- CAN

- capacités

- aptitude

- Compétences

- maisons

- cas

- Causes

- prudence

- siècle

- chaîne

- Chaînes

- globaux

- chang

- vérifier

- chimie

- chinois

- choix

- Selectionnez

- réclamer

- prétentions

- classe

- classification

- clairement

- client

- Fermer

- Cloud9

- entraînement

- code

- Codage

- cognitif

- recueillir

- Collective

- Université

- COLUMBIA

- combinaison

- commentaires

- Commun

- communément

- Communautés

- Sociétés

- Comparaison

- complémentaire

- complet

- complexe

- complexité

- composants électriques

- composé

- calcul

- ordinateur

- Informatique

- concept

- conclu

- Confirmer

- confirmation

- conjonction

- par conséquent

- considéré

- cohérent

- consiste

- Console

- consommer

- Les consommateurs

- consommation

- CONFINEMENT

- contient

- contenu

- création de contenu

- continu

- contribution

- des bactéries

- contrôles

- Conversation

- correct

- correctement

- Prix

- Costs

- pourriez

- d'exportation

- Pays

- engendrent

- créée

- crée des

- La création

- création

- Conception

- notre créativité

- Lettres de créance

- CTO

- Culture

- freiner

- Courant

- Clients

- données

- débat

- décisions

- défini

- Définit

- Degré

- démocratique

- démontré

- démontre

- démontrer

- Danemark

- Département

- déployé

- déployer

- Conception

- détails

- détecter

- Détection

- Déterminer

- détermine

- développé

- Développeur

- développement

- Développement

- développements

- Dialogue

- différent

- diligence

- direction

- discuter

- désinformation

- Commande

- perturbations

- distinguer

- méfiance

- Docteur

- Ne fait pas

- down

- dr

- motivation

- deux

- pendant

- e

- E & T

- chacun

- Plus tôt

- "Early Bird"

- gagner

- Notre expertise

- Terre

- plus facilement

- Easy

- Économie

- économie

- pédagogique

- éducateurs

- effet

- efficacité

- non plus

- éliminé

- ailleurs

- EMEA

- émergence

- l'accent

- permettant

- terminé

- ingénieur

- ENGINEERING

- améliorations

- assurer

- entrant

- entités

- entité

- Environment

- égalité

- Erreurs

- notamment

- établies

- évaluer

- Pourtant, la

- événements

- évolution

- exemple

- exemples

- uniquement au

- Exercises

- d'experience

- Expliquer

- explorez

- Exploré

- les

- externe

- extrait

- faciliter

- facilité

- fait

- facteurs

- réalités

- FAIL

- faux

- fausses nouvelles

- non

- célèbre

- femelle

- champ

- bats toi

- remplissages

- finale

- la traduction de documents financiers

- Trouvez

- trouver

- finition

- Prénom

- première fois

- Flexibilité

- concentré

- se concentre

- mettant l'accent

- suivre

- Abonnement

- Pour

- formulaire

- formel

- Forum

- Fondation

- Fondationale

- Fondée

- Framework

- De

- fu

- d’étiquettes électroniques entièrement

- fonction

- Games

- jeux

- lacunes

- Sexe

- Parité des Genres

- Général

- générer

- généré

- générateur

- génération

- génératif

- IA générative

- obtenez

- filles

- GitHub

- donné

- Go

- objectif

- l'

- Sol

- garantit

- ait eu

- harnais

- Vous avez

- he

- entendre

- vous aider

- aide

- ici

- ici

- de haute qualité

- augmentation

- Faits saillants

- très

- sa

- Histoire

- détient

- honneur

- plein d'espoir

- logement

- Comment

- How To

- Cependant

- HTML

- http

- HTTPS

- humain

- i

- IBM

- identifié

- if

- Illégal

- illustrer

- satellite

- Impact

- Mettre en oeuvre

- la mise en oeuvre

- met en oeuvre

- importer

- important

- impressionnant

- amélioré

- in

- incapacité

- comprendre

- inclut

- Y compris

- Incorporée

- incorpore

- increased

- Augmente

- indique

- individuel

- secteurs

- d'information

- informe

- Infrastructure

- initiale

- contribution

- à l'intérieur

- installer

- Installé

- instance

- Institut

- les établissements privés

- des services

- Intelligence

- intention

- interactions

- interne

- Internet

- développement

- introduit

- invoque

- impliqué

- aide

- vous aider à faire face aux problèmes qui vous perturbent

- IT

- SES

- chemin

- jpg

- json

- juges

- kenneth

- Savoir

- spécialisées

- connu

- Peindre

- langue

- gros

- En retard

- Nouveautés

- Danses latines

- lancé

- couche

- conduire

- conduisant

- apprentissage

- au

- légalement

- laisser

- VIE

- Life Sciences

- comme

- limites

- Gamme

- Gauche

- linux

- Liste

- Listé

- littérature

- LLM

- logique

- plus long

- rechercher

- love

- mac

- click

- machine learning

- LES PLANTES

- principalement

- maintient

- majeur

- a prendre une

- FAIT DU

- Fabrication

- gérés

- gestion

- de nombreuses

- Stratégie

- masque

- maîtrise

- mathématique

- mathématiques

- maximales

- Mai..

- veux dire

- signifiait

- Médias

- médical

- médecine

- membre

- Membres

- Mémoire

- mentionné

- Méthodologie

- Michigan

- million

- mines

- Désinformation

- trompeur

- MIT

- Réduire les

- mélanger

- ML

- modèle

- numériques jumeaux (digital twin models)

- modifier

- PLUS

- (en fait, presque toutes)

- mouvement

- plusieurs

- my

- Nommé

- NASA

- Nationales

- Nature

- Nature

- Besoin

- nécessaire

- réseau et

- n'allons jamais

- Nouveauté

- nouvelles

- next

- aucune

- Lauréat du Prix Nobel

- normes

- la Norvège

- notable

- cahier

- maintenant

- nombre

- objet

- observation

- octobre

- of

- présenté

- souvent

- Vieux

- on

- ONE

- en ligne

- uniquement

- Opérations

- Opinion

- or

- de commander

- original

- Autre

- autrement

- nos

- grandes lignes

- décrivant

- sortie

- exceptionnel

- plus de

- global

- propre

- propriété

- Rythme

- paquet

- page

- pages

- Papier

- paramètres

- partie

- pass

- passé

- En passant

- Brevets

- chemin

- Patron de Couture

- Personnes

- parfaite

- Effectuer

- personnel

- phase

- phd

- phénomène

- philosophie

- Physique

- pièce

- pivot

- Platon

- Intelligence des données Platon

- PlatonDonnées

- jouer

- Point

- politique

- possible

- Post

- défaillances

- power

- alimenté

- présenté

- cadeaux

- Press

- répandue

- précédent

- précédemment

- qui se déroulent

- Directeur

- principes

- impression

- Presse d'imprimerie

- Avant

- prix

- Problème

- processus

- les process

- produire

- Vidéo

- ,une équipe de professionnels qualifiés

- profond

- Programme

- proposer

- proposé

- fournir

- à condition de

- fournisseurs

- fournit

- aportando

- Psychologie

- public

- achat

- des fins

- Python

- qualité

- Quantité

- vite.

- Radio

- aléatoire

- gammes

- classé

- Nos tests de diagnostic produisent des résultats rapides et précis sans nécessiter d'équipement de laboratoire complexe et coûteux,

- rapidement

- rapport

- nous joindre

- Réagir

- monde réel

- en temps réel

- raison

- recevoir

- reçu

- recette

- reconnaissance

- recommander

- reportez-vous

- se réfère

- en relation

- relativement

- pertinent

- fiable

- À PLUSIEURS REPRISES

- dépôt

- nécessaire

- exigent

- conditions

- un article

- Résonne

- Resources

- Réagir

- réponse

- réponses

- responsables

- retourner

- Retours

- Rich

- Analyse

- Rôle

- rôle

- tours

- Courir

- pour le running

- fonctionne

- s

- garanties

- sagemaker

- même

- Épargnez

- scie

- Escaliers intérieurs

- L'école

- École de génie

- Sciences

- STARFLEET SCIENCES

- sur une base scientifique

- scientifiques

- scénario

- Sdk

- Rechercher

- Section

- les sections

- sur le lien

- la sélection

- supérieur

- sensible

- phrase

- sentiment

- Séquence

- service

- Services

- set

- installation

- Partager

- commun

- Partages

- partage

- elle

- coquillage

- devrait

- montrer

- similaires

- De même

- étapes

- depuis

- sœur

- So

- Réseaux sociaux

- réseaux sociaux

- sociétal

- Société

- sur mesure

- Solutions

- quelques

- Identifier

- code source

- Sources

- Space

- enjambant

- spécifiquement

- vitesse

- propagation

- Diffusion

- Étape

- Standard

- Stanford

- Stanford University

- j'ai commencé

- Déclaration

- déclarations

- États

- Étapes

- Arrêter

- tempête

- de Marketing

- renforcement

- structure

- Étudiante

- Étude

- ultérieur

- Ces

- Avec succès

- tel

- suggérer

- RÉSUMÉ

- Surchargez

- Support

- sûr

- Balancement

- Suède

- rapidement

- synthèse

- Système

- tacle

- Prenez

- prend

- Tâche

- tâches

- équipe

- Technique

- technique

- techniques

- technologique

- Technologie

- monde de télécommunications

- modèle

- terminal

- conditions

- tester

- texte

- textuel

- qui

- La

- les informations

- La Source

- le monde

- leur

- Les

- puis

- Là.

- ainsi

- donc

- Ces

- l'ont

- penser

- des tiers.

- this

- ceux

- pensée

- Avec

- tout au long de

- ATTACHER

- fiable

- calendrier

- à

- ensemble

- jeton

- Tokens

- les outils

- qualifié

- Formation

- oui

- Vérité

- tutoriel

- deux

- En fin de compte

- souligné

- compréhension

- Uni

- États-Unis

- Universités

- université

- sans précédent

- sans précédent

- jusqu'à

- améliorer

- sur

- us

- utilisé

- d'utiliser

- Utilisateur

- utilisateurs

- Usages

- en utilisant

- Utilisant

- Plus-value

- divers

- Vaste

- Verdict

- vérifié

- vérifier

- version

- très

- via

- Vidéo

- jeux vidéo

- Visiter

- était

- we

- web

- services Web

- WELL

- Quoi

- quand

- que

- qui

- tout en

- WHO

- la totalité

- why

- Wikipédia

- sera

- fenêtres

- comprenant

- dans les

- femme

- Femme

- A gagné

- Word

- des mots

- activités principales

- travaillé

- workflow

- de travail

- world

- vaut

- faux

- années

- Vous n'avez

- Votre

- zéphyrnet