Dans de nombreux secteurs, il est essentiel d'extraire rapidement les entités personnalisées des documents. Cela peut être difficile. Les réclamations d'assurance, par exemple, contiennent souvent des dizaines d'attributs importants (tels que des dates, des noms, des lieux et des rapports) éparpillés sur des documents longs et denses. L'analyse et l'extraction manuelles de ces informations peuvent être source d'erreurs et prendre beaucoup de temps. Les logiciels basés sur des règles peuvent aider, mais ils sont finalement trop rigides pour s'adapter aux nombreux types et mises en page de documents variés.

Pour automatiser et accélérer ce processus, vous pouvez utiliser Amazon comprendre pour détecter rapidement et avec précision des entités personnalisées à l'aide de l'apprentissage automatique (ML). Cette approche est flexible et précise, car le système peut s'adapter à de nouveaux documents en utilisant ce qu'il a appris dans le passé. Jusqu'à récemment, cependant, cette fonctionnalité ne pouvait être appliquée qu'aux documents en texte brut, ce qui signifiait que les informations de position étaient perdues lors de la conversion des documents à partir de leur format natif. Pour remédier à cela, il était a récemment annoncé qu'Amazon Comprehend peut extraire des entités personnalisées dans des fichiers PDF, des images et des formats de fichiers Word.

Dans cet article, nous passons en revue un exemple concret du secteur de l'assurance sur la façon dont vous pouvez créer un outil de reconnaissance personnalisé à l'aide d'annotations PDF.

Vue d'ensemble de la solution

Nous vous accompagnons dans les étapes de haut niveau suivantes :

- Créez des annotations PDF.

- Utilisez les annotations PDF pour former un modèle personnalisé à l'aide de l'API Python.

- Obtenez des métriques d'évaluation à partir du modèle formé.

- Effectuez une inférence sur un document invisible.

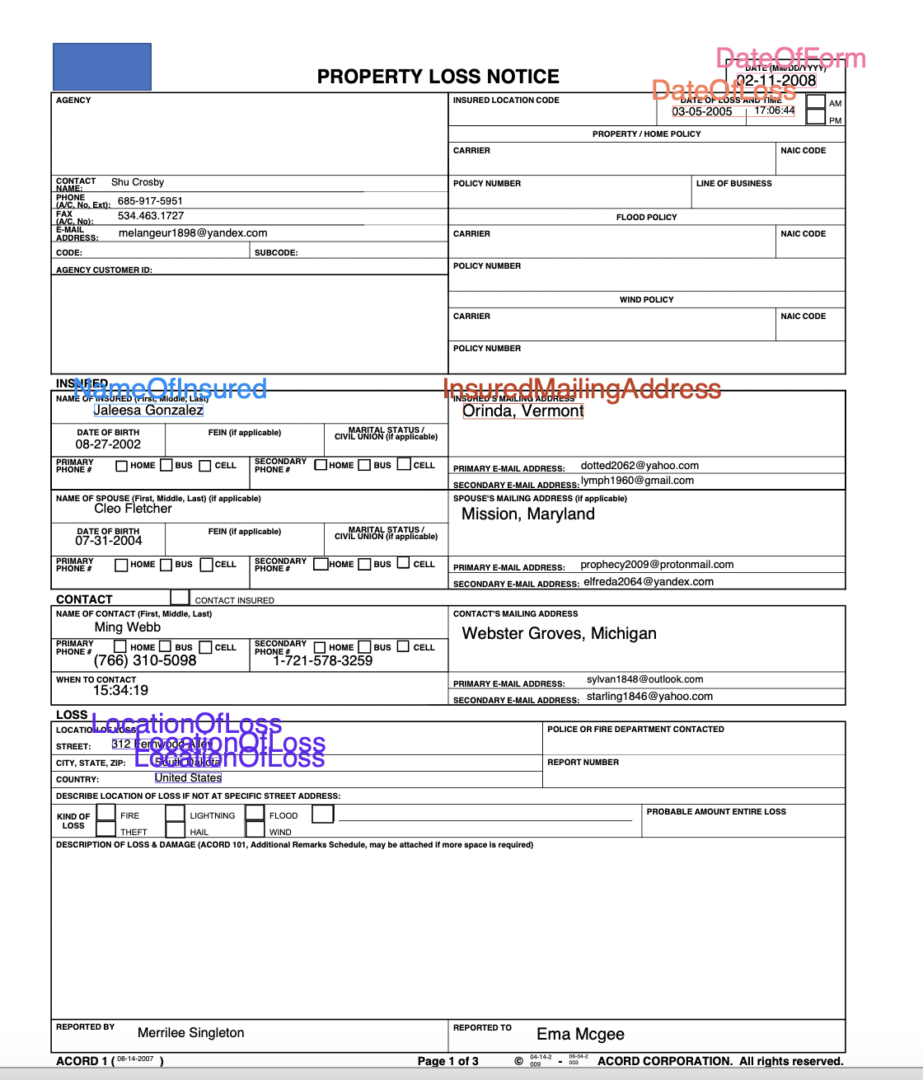

À la fin de cet article, nous voulons être en mesure d'envoyer un document PDF brut à notre modèle formé et de lui faire produire un fichier structuré contenant des informations sur nos étiquettes d'intérêt. En particulier, nous entraînons notre modèle pour détecter les cinq entités suivantes que nous avons choisies en raison de leur pertinence pour les réclamations d'assurance : DateOfForm, DateOfLoss, NameOfInsured, LocationOfLosset InsuredMailingAddress. Après avoir lu la sortie structurée, nous pouvons visualiser les informations de l'étiquette directement sur le document PDF, comme dans l'image suivante.

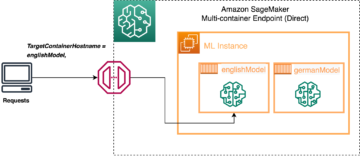

Ce billet est accompagné d'un cahier Jupyter qui contient les mêmes étapes. N'hésitez pas à suivre tout en exécutant les étapes de ce cahier. Notez que vous devez configurer le Amazon Sage Maker environnement pour permettre à Amazon Comprehend de lire Service de stockage simple Amazon (Amazon S3) comme décrit en haut du bloc-notes.

Créer des annotations PDF

Pour créer des annotations pour les documents PDF, vous pouvez utiliser Vérité au sol Amazon SageMaker, un service d'étiquetage de données entièrement géré qui facilite la création d'ensembles de données de formation très précis pour le ML.

Pour ce didacticiel, nous avons déjà annoté les fichiers PDF dans leur forme native (sans conversion en texte brut) à l'aide de Ground Truth. Le travail Ground Truth génère trois chemins dont nous avons besoin pour former notre modèle Amazon Comprehend personnalisé :

- Sources – Le chemin d'accès aux fichiers PDF d'entrée.

- Annotations – Le chemin d'accès aux fichiers JSON d'annotation contenant les informations sur l'entité étiquetée.

- Manifeste – Le fichier qui pointe vers l'emplacement des annotations et des PDF sources. Ce fichier est utilisé pour créer une tâche de formation de reconnaissance d'entité personnalisée Amazon Comprehend et former un modèle personnalisé.

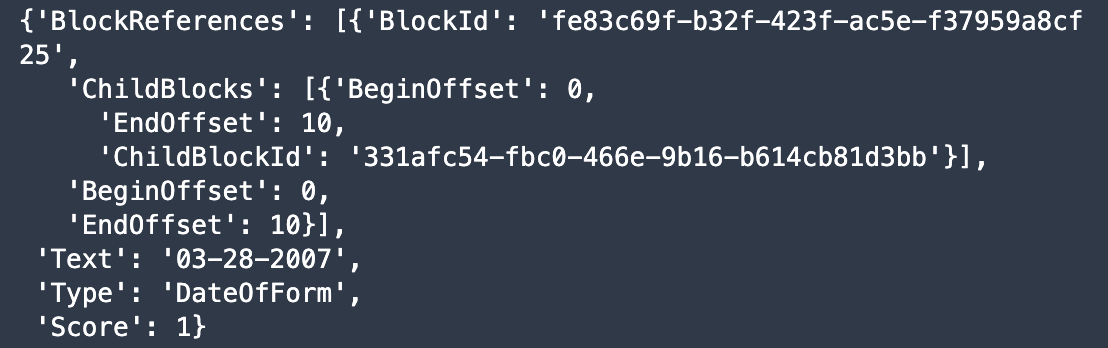

La capture d'écran suivante montre un exemple d'annotation.

La tâche Ground Truth personnalisée génère une annotation PDF qui capture des informations au niveau du bloc sur l'entité. Ces informations au niveau du bloc fournissent les coordonnées de position précises de l'entité (les blocs enfants représentant chaque mot dans le bloc d'entité). Ceci est distinct d'un travail Ground Truth standard dans lequel les données du PDF sont aplaties au format textuel et seules les informations de décalage, mais pas les informations de coordonnées précises, sont capturées lors de l'annotation. Les informations de position riches que nous obtenons avec ce paradigme d'annotation personnalisé nous permettent de former un modèle plus précis.

Le manifeste généré à partir de ce type de tâche est appelé manifeste augmenté, par opposition à un CSV utilisé pour les annotations standard. Pour plus d'informations, voir Annotations.

Utilisez les annotations PDF pour former un modèle personnalisé à l'aide de l'API Python

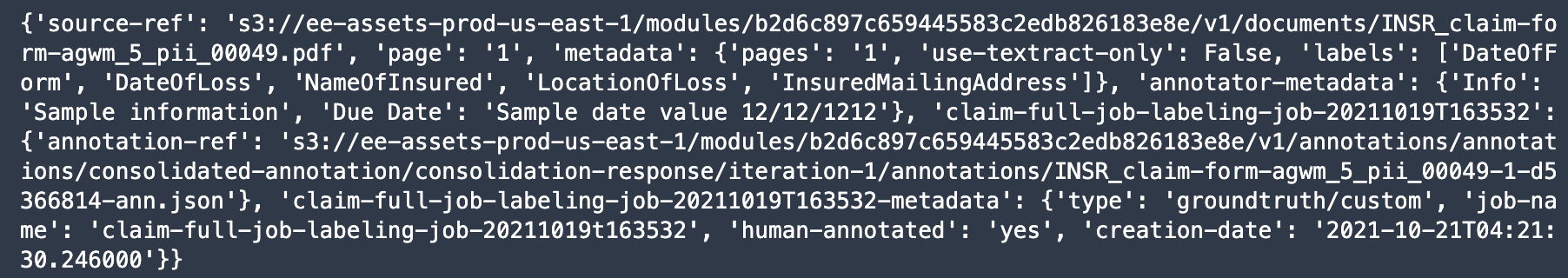

Un fichier manifeste augmenté doit être formaté au format JSON Lines. Au format JSON Lines, chaque ligne du fichier est un objet JSON complet suivi d'un séparateur de nouvelle ligne.

Le code suivant est une entrée dans ce fichier manifeste augmenté.

Quelques choses à noter:

- Cinq types d'étiquetage sont associés à ce travail :

DateOfForm,DateOfLoss,NameOfInsured,LocationOfLossetInsuredMailingAddress. - Le fichier manifeste fait référence à la fois à l'emplacement du PDF source et à l'emplacement de l'annotation.

- Les métadonnées relatives à la tâche d'annotation (telles que la date de création) sont capturées.

Use-textract-onlyest fixé àFalse, ce qui signifie que l'outil d'annotation décide d'utiliser PDFPlumber (pour un PDF natif) ou Extrait d'Amazon (pour un PDF scanné). Si réglé surtrue, Amazon Textract est utilisé dans les deux cas (ce qui est plus coûteux mais potentiellement plus précis).

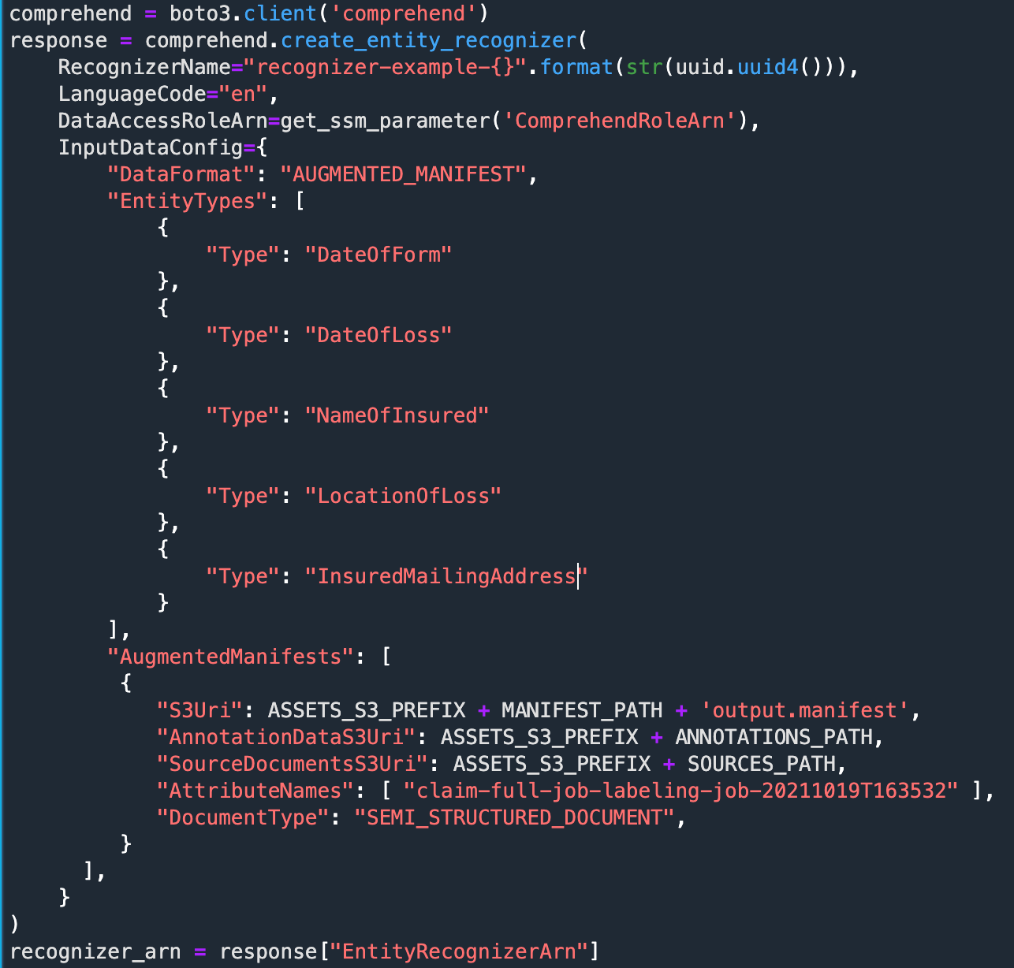

Nous pouvons maintenant former le module de reconnaissance, comme illustré dans l'exemple de code suivant.

Nous créons un outil de reconnaissance pour reconnaître les cinq types d'entités. Nous aurions pu utiliser un sous-ensemble de ces entités si nous avions préféré. Vous pouvez utiliser jusqu'à 25 entités.

Pour plus de détails sur chaque paramètre, reportez-vous à create_entity_recognizer.

Selon la taille de l'ensemble d'entraînement, le temps d'entraînement peut varier. Pour cet ensemble de données, la formation prend environ 1 heure. Pour surveiller l'état de la tâche d'entraînement, vous pouvez utiliser le describe_entity_recognizer API.

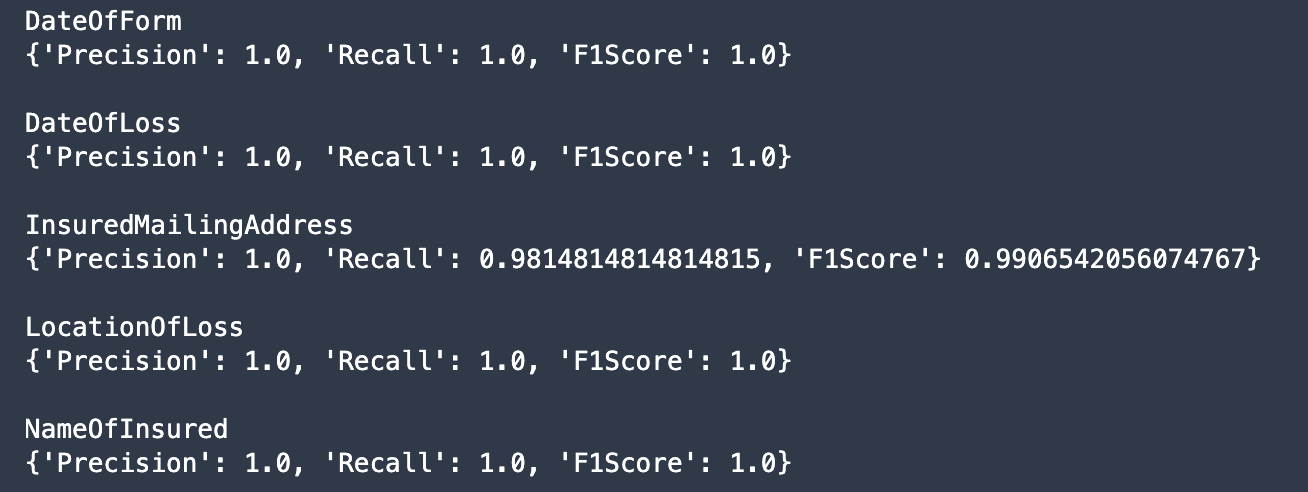

Obtenir des métriques d'évaluation à partir du modèle formé

Amazon Comprehend fournit des métriques de performances de modèle pour un modèle formé, qui indiquent dans quelle mesure le modèle formé est censé faire des prédictions à l'aide d'entrées similaires. Nous pouvons obtenir à la fois des métriques globales de précision et de rappel ainsi que des métriques par entité. Un modèle précis a une précision élevée et un rappel élevé. Une haute précision signifie que le modèle est généralement correct lorsqu'il indique une étiquette particulière ; un rappel élevé signifie que le modèle a trouvé la plupart des étiquettes. F1 est une métrique composite (moyenne harmonique) de ces mesures, et est donc élevée lorsque les deux composantes sont élevées. Pour une description détaillée des métriques, voir Mesures de reconnaissance d'entité personnalisées.

Lorsque vous fournissez les documents à la tâche de formation, Amazon Comprehend les sépare automatiquement en un ensemble d'entraînement et de test. Lorsque le modèle a atteint TRAINED statut, vous pouvez utiliser le describe_entity_recognizer API à nouveau pour obtenir les métriques d'évaluation sur l'ensemble de test.

Voici un exemple de mesures globales.

Voici un exemple de métriques par entité.

Les scores élevés indiquent que le modèle a bien appris à détecter ces entités.

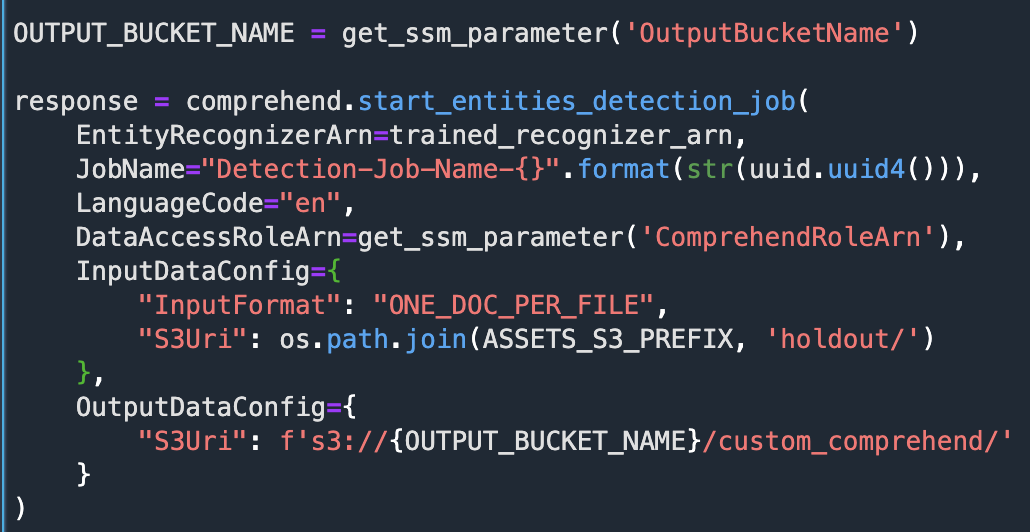

Effectuer une inférence sur un document invisible

Exécutons l'inférence avec notre modèle formé sur un document qui ne faisait pas partie de la procédure de formation. Nous pouvons utiliser cette API asynchrone pour le NER standard ou personnalisé. Si vous l'utilisez pour un NER personnalisé (comme dans cet article), nous devons transmettre l'ARN du modèle formé.

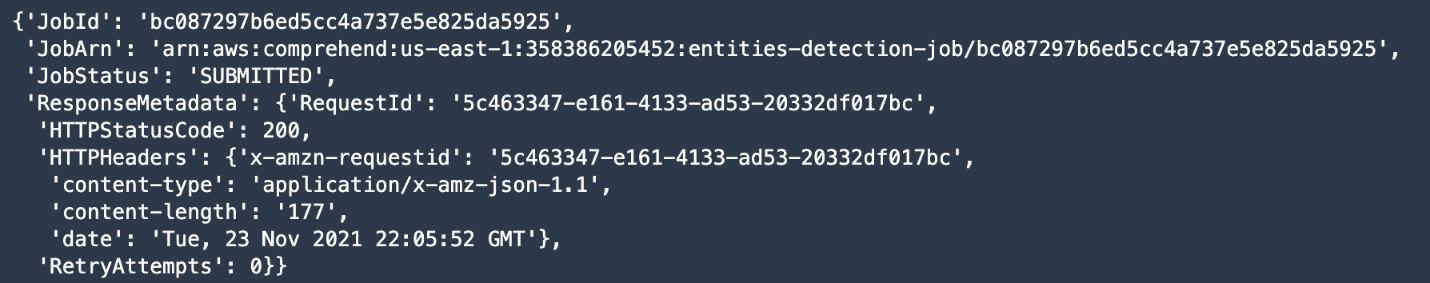

Nous pouvons examiner le travail soumis en imprimant la réponse.

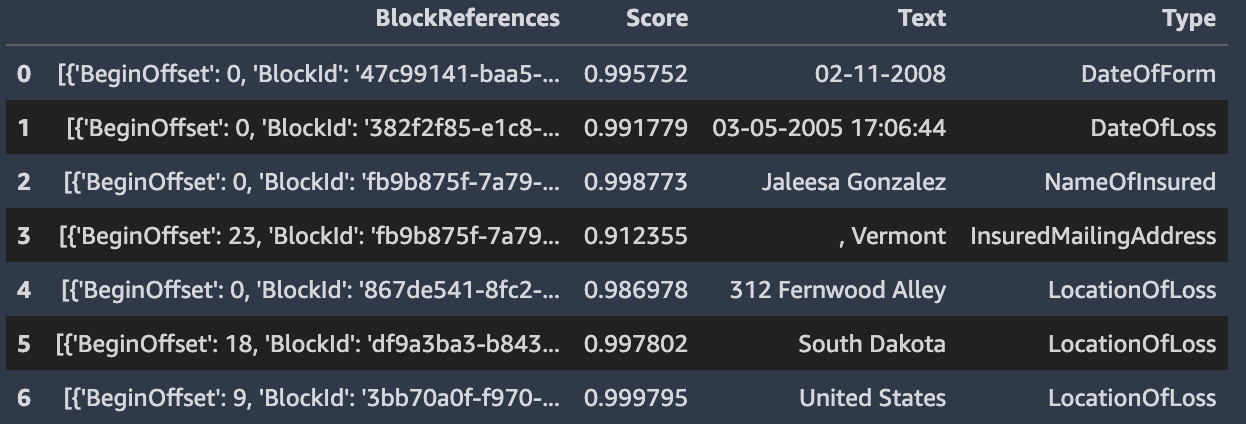

Nous pouvons formater la sortie du travail de détection avec Pandas dans un tableau. Le Score La valeur indique le niveau de confiance du modèle concernant l'entité.

Enfin, on peut superposer les prédictions sur les documents non vus, ce qui donne le résultat comme indiqué en haut de ce post.

Conclusion

Dans cet article, vous avez vu comment extraire des entités personnalisées dans leur format PDF natif à l'aide d'Amazon Comprehend. Comme prochaines étapes, envisagez de plonger plus profondément :

- Entraînez votre propre outil de reconnaissance à l'aide du cahier d'accompagnement ici. N'oubliez pas de supprimer toutes les ressources lorsque vous avez terminé pour éviter de futurs frais.

- Configurez votre propre tâche d'annotation personnalisée pour collecter des annotations PDF pour vos entités d'intérêt. Pour plus d'informations, reportez-vous à Annotation de document personnalisée pour extraire des entités nommées dans des documents à l'aide d'Amazon Comprehend.

- Entraînez un modèle NER personnalisé sur la console Amazon Comprehend. Pour plus d'informations, voir Extrayez des entités personnalisées à partir de documents dans leur format natif avec Amazon Comprehend.

À propos des auteurs

Josué Lévy est Senior Applied Scientist dans le laboratoire Amazon Machine Learning Solutions, où il aide les clients à concevoir et à créer des solutions d'IA/ML pour résoudre les problèmes commerciaux clés.

Josué Lévy est Senior Applied Scientist dans le laboratoire Amazon Machine Learning Solutions, où il aide les clients à concevoir et à créer des solutions d'IA/ML pour résoudre les problèmes commerciaux clés.

André Ang est ingénieur en apprentissage automatique au sein du laboratoire de solutions d'apprentissage automatique d'Amazon, où il aide les clients d'un large éventail d'industries à identifier et à créer des solutions d'IA/ML pour résoudre leurs problèmes commerciaux les plus urgents. En dehors du travail, il aime regarder des vlogs sur les voyages et la nourriture.

André Ang est ingénieur en apprentissage automatique au sein du laboratoire de solutions d'apprentissage automatique d'Amazon, où il aide les clients d'un large éventail d'industries à identifier et à créer des solutions d'IA/ML pour résoudre leurs problèmes commerciaux les plus urgents. En dehors du travail, il aime regarder des vlogs sur les voyages et la nourriture.

Alex Chirayath est ingénieur logiciel au Amazon Machine Learning Solutions Lab et se concentre sur la création de solutions basées sur des cas d'utilisation qui montrent aux clients comment libérer la puissance des services AWS AI/ML pour résoudre des problèmes commerciaux réels.

Alex Chirayath est ingénieur logiciel au Amazon Machine Learning Solutions Lab et se concentre sur la création de solutions basées sur des cas d'utilisation qui montrent aux clients comment libérer la puissance des services AWS AI/ML pour résoudre des problèmes commerciaux réels.

Jennifer Zhu est un scientifique appliqué d'Amazon AI Machine Learning Solutions Lab. Elle travaille avec les clients d'AWS pour créer des solutions d'IA/ML pour leurs besoins commerciaux prioritaires.

Jennifer Zhu est un scientifique appliqué d'Amazon AI Machine Learning Solutions Lab. Elle travaille avec les clients d'AWS pour créer des solutions d'IA/ML pour leurs besoins commerciaux prioritaires.

Niharika Jayanthi est ingénieur front-end au sein de l'équipe Amazon Machine Learning Solutions Lab - Human in the Loop. Elle aide à créer des solutions d'expérience utilisateur pour les clients d'Amazon SageMaker Ground Truth.

Niharika Jayanthi est ingénieur front-end au sein de l'équipe Amazon Machine Learning Solutions Lab - Human in the Loop. Elle aide à créer des solutions d'expérience utilisateur pour les clients d'Amazon SageMaker Ground Truth.

Boris Aronchik est responsable au sein d'Amazon AI Machine Learning Solutions Lab, où il dirige une équipe de scientifiques et d'ingénieurs ML pour aider les clients AWS à atteindre leurs objectifs commerciaux en tirant parti des solutions IA/ML.

Boris Aronchik est responsable au sein d'Amazon AI Machine Learning Solutions Lab, où il dirige une équipe de scientifiques et d'ingénieurs ML pour aider les clients AWS à atteindre leurs objectifs commerciaux en tirant parti des solutions IA/ML.

- Coinsmart. Le meilleur échange Bitcoin et Crypto d'Europe.

- Platoblockchain. Intelligence métaverse Web3. Connaissance amplifiée. ACCÈS LIBRE.

- CryptoHawk. Radar Altcoins. Essai gratuit.

- Source : https://aws.amazon.com/blogs/machine-learning/build-a-custom-entity-recognizer-for-pdf-documents-using-amazon-comprehend/

- "

- &

- 100

- Description

- Avec cette connaissance vient le pouvoir de prendre

- à travers

- propos

- AI

- Tous

- déjà

- Amazon

- api

- une approche

- d'environ

- attributs

- augmentée

- automatiser

- AWS

- Block

- construire

- Développement

- la performance des entreprises

- difficile

- des charges

- enfant

- prétentions

- code

- recueillir

- confiance

- Console

- contient

- coordonner

- pourriez

- création

- critique

- Customiser

- Clients

- données

- Dates

- profond

- Conception

- Détection

- directement

- INSTITUTIONNELS

- ingénieur

- Les ingénieurs

- entités

- Environment

- exemple

- attendu

- Découvrez

- flexible

- suivre

- Abonnement

- nourriture

- formulaire

- le format

- trouvé

- Test d'anglais

- avenir

- Global

- Objectifs

- aider

- aide

- Haute

- très

- Comment

- How To

- HTTPS

- humain

- identifier

- image

- important

- secteurs

- industrie

- d'information

- contribution

- Assurance

- intérêt

- IT

- Emploi

- clés / KEY :

- laboratoire

- l'étiquetage

- Etiquettes

- Conduit

- savant

- apprentissage

- Niveau

- en tirant parti

- Gamme

- emplacement

- emplacements

- click

- machine learning

- FAIT DU

- gérés

- manager

- manière

- manuellement

- sens

- Métrique

- ML

- modèle

- Surveiller

- PLUS

- (en fait, presque toutes)

- noms

- cahier

- compenser

- propre

- paradigme

- performant

- power

- Prédictions

- d'ouvrabilité

- processus

- fournir

- fournit

- vite.

- raw

- en cours

- monde réel

- réaliser

- reconnaître

- Rapports

- Ressources

- réponse

- Avis

- Courir

- pour le running

- balayage

- Scientifique

- scientifiques

- service

- Services

- set

- similaires

- étapes

- Taille

- Logiciels

- Software Engineer

- Solutions

- RÉSOUDRE

- vitesse

- Standard

- Statut

- storage

- structuré

- soumis

- combustion propre

- équipe

- tester

- La Source

- Avec

- fiable

- long

- outil

- top

- Formation

- Voyage

- ouvrir

- us

- utilisé

- d'habitude

- Plus-value

- Quoi

- que

- tout en

- dans les

- sans

- Activités:

- vos contrats

- world