Les entreprises ont accès à des quantités massives de données, dont la plupart sont difficiles à découvrir car elles ne sont pas structurées. Approches conventionnelles d’analyse données non structurées utilisez la correspondance de mots clés ou de synonymes. Ils ne capturent pas l’intégralité du contexte d’un document, ce qui les rend moins efficaces dans le traitement des données non structurées.

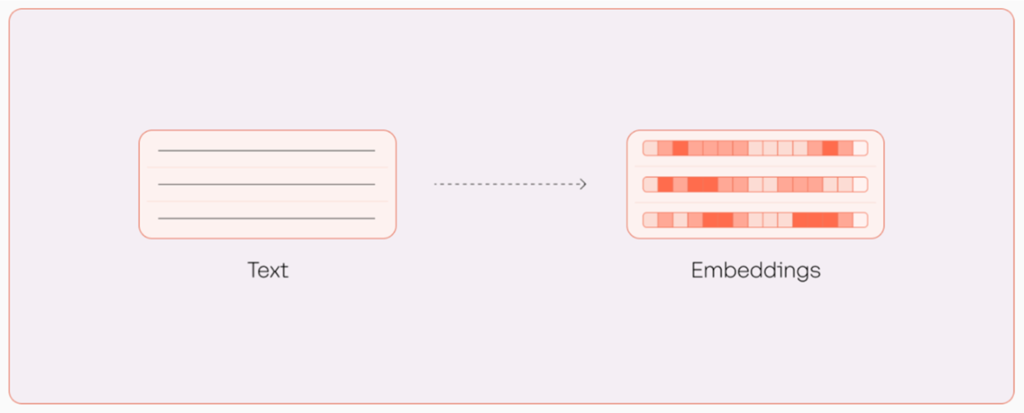

En revanche, les incorporations de texte utilisent machine learning (ML) pour capturer la signification des données non structurées. Les intégrations sont générées par des modèles de langage représentationnels qui traduisent le texte en vecteurs numériques et codent les informations contextuelles dans un document. Cela permet des applications telles que la recherche sémantique, Récupération Génération Augmentée (RAG), modélisation de sujets et classification de textes.

Par exemple, dans le secteur des services financiers, les applications incluent l'extraction d'informations à partir de rapports sur les bénéfices, la recherche d'informations à partir d'états financiers et l'analyse des sentiments sur les actions et les marchés trouvés dans l'actualité financière. L'intégration de texte permet aux professionnels du secteur d'extraire des informations à partir de documents, de minimiser les erreurs et d'augmenter leurs performances.

Dans cet article, nous présentons une application capable de rechercher et d'interroger des actualités financières dans différentes langues à l'aide de Cohere. Intégrer ainsi que le Reclasser modèles avec Socle amazonien.

Le modèle d’intégration multilingue de Cohere

Cohere est une plateforme d'IA d'entreprise de premier plan qui crée des modèles de langage étendus (LLM) de classe mondiale et des solutions basées sur LLM qui permettent aux ordinateurs de rechercher, de capturer du sens et de converser dans du texte. Ils offrent une facilité d’utilisation et de solides contrôles de sécurité et de confidentialité.

Le modèle d’intégration multilingue de Cohere génère des représentations vectorielles de documents dans plus de 100 langues et est disponible sur Amazon Bedrock. Cela permet aux clients AWS d'y accéder en tant qu'API, ce qui élimine le besoin de gérer l'infrastructure sous-jacente et garantit que les informations sensibles restent gérées et protégées en toute sécurité.

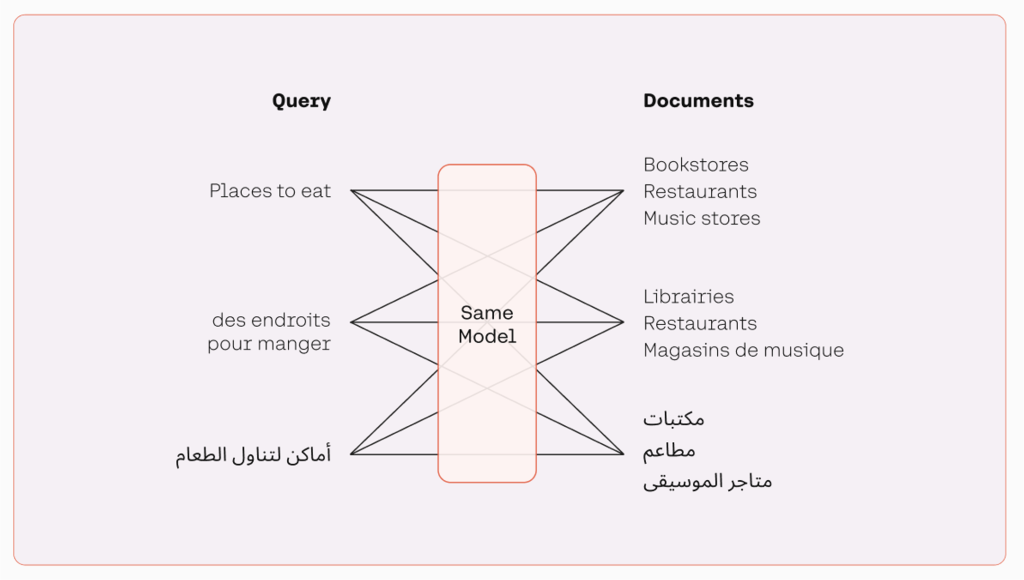

Le modèle multilingue regroupe les textes ayant des significations similaires en leur attribuant des positions proches les unes des autres dans un espace vectoriel sémantique. Avec un modèle d'intégration multilingue, les développeurs peuvent traiter du texte dans plusieurs langues sans avoir besoin de basculer entre différents modèles, comme illustré dans la figure suivante. Cela rend le traitement plus efficace et améliore les performances des applications multilingues.

Voici quelques-uns des points forts du modèle d’intégration de Cohere :

- Focus sur la qualité des documents – Les modèles d'intégration typiques sont formés pour mesurer la similarité entre les documents, mais le modèle de Cohere mesure également la qualité des documents.

- Meilleure récupération pour les applications RAG – Les applications RAG nécessitent un bon système de récupération, dans lequel le modèle d’intégration de Cohere excelle.

- Compression de données rentable – Cohere utilise une méthode de formation spéciale prenant en compte la compression, ce qui entraîne des économies substantielles pour votre base de données vectorielles.

Cas d'utilisation pour l'intégration de texte

Les intégrations de texte transforment les données non structurées en un formulaire structuré. Cela vous permet de comparer, de décortiquer et de tirer des enseignements objectifs de tous ces documents. Voici des exemples de cas d’utilisation que le modèle d’intégration de Cohere permet :

- Recherche sémantique – Permet des applications de recherche puissantes lorsqu'elles sont associées à une base de données vectorielles, avec une excellente pertinence basée sur la signification de l'expression de recherche

- Moteur de recherche pour un système plus vaste – Recherche et récupère les informations les plus pertinentes à partir des sources de données d'entreprise connectées pour les systèmes RAG

- Classification de texte – Prend en charge la reconnaissance d’intention, l’analyse des sentiments et l’analyse avancée des documents

- Modélisation de sujets – Transforme une collection de documents en groupes distincts pour découvrir des sujets et des thèmes émergents

Systèmes de recherche améliorés avec Rerank

Dans les entreprises où des systèmes de recherche par mots-clés conventionnels sont déjà présents, comment introduire des capacités de recherche sémantique modernes ? Pour de tels systèmes qui font partie de l’architecture d’information d’une entreprise depuis longtemps, une migration complète vers une approche basée sur l’intégration n’est, dans de nombreux cas, tout simplement pas réalisable.

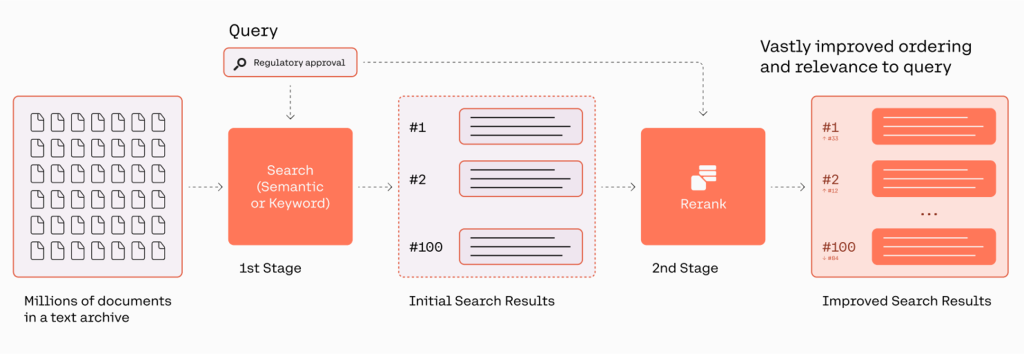

Point de terminaison Rerank de Cohere est conçu pour combler cette lacune. Il constitue la deuxième étape d’un flux de recherche pour fournir un classement des documents pertinents en fonction de la requête d’un utilisateur. Les entreprises peuvent conserver un système de mots clés (ou même sémantique) existant pour la récupération de première étape et améliorer la qualité des résultats de recherche avec le point de terminaison Rerank lors du reclassement de deuxième étape.

Rerank offre une option rapide et simple pour améliorer les résultats de recherche en introduisant la technologie de recherche sémantique dans la pile d'un utilisateur avec une seule ligne de code. Le point de terminaison est également livré avec un support multilingue. La figure suivante illustre le flux de travail de récupération et de reclassement.

Vue d'ensemble de la solution

Les analystes financiers doivent digérer de nombreux contenus, tels que les publications financières et les médias d'information, afin de rester informés. Selon le Association des professionnels de la finance (AFP), les analystes financiers passent 75 % de leur temps à collecter des données ou à administrer le processus au lieu de procéder à des analyses à valeur ajoutée. Trouver la réponse à une question à partir de diverses sources et documents est un travail long et fastidieux. Le modèle d'intégration Cohere aide les analystes à rechercher rapidement parmi de nombreux titres d'articles dans plusieurs langues pour trouver et classer les articles les plus pertinents pour une requête particulière, économisant ainsi énormément de temps et d'efforts.

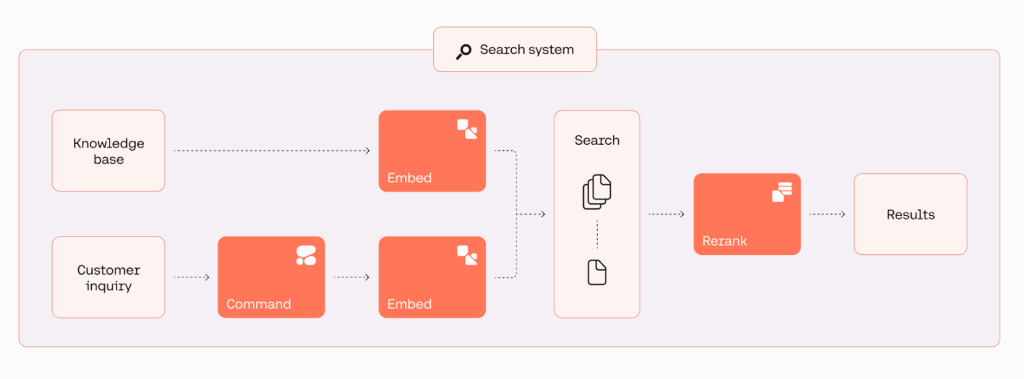

Dans l’exemple de cas d’utilisation suivant, nous montrons comment le modèle Embed de Cohere effectue des recherches et des requêtes sur l’actualité financière dans différentes langues dans un seul pipeline. Ensuite, nous démontrons comment l'ajout de Rerank à votre récupération d'intégrations (ou son ajout à une recherche lexicale existante) peut encore améliorer les résultats.

Le carnet de support est disponible sur GitHub.

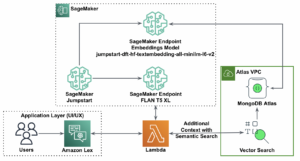

Le diagramme suivant illustre le flux de travail de l'application.

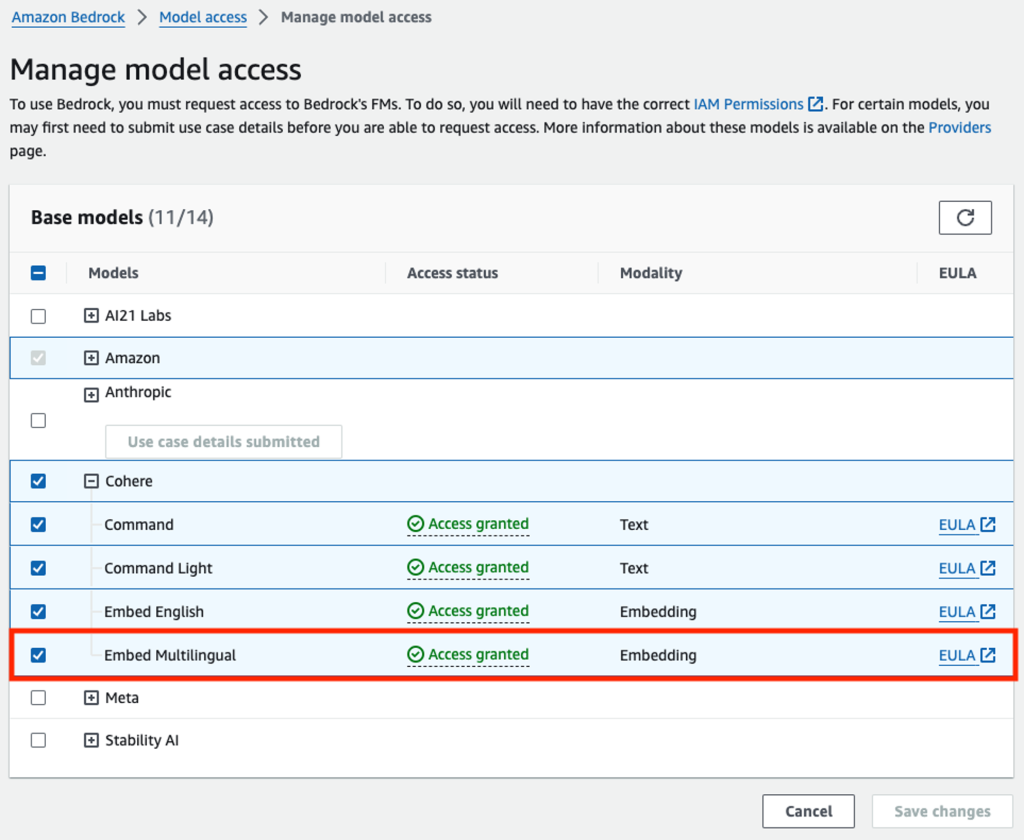

Activer l'accès aux modèles via Amazon Bedrock

Les utilisateurs d'Amazon Bedrock doivent demander l'accès aux modèles pour les rendre disponibles. Pour demander l'accès à des modèles supplémentaires, choisissez Accès au modèle le volet de navigation sur le substrat rocheux amazonien console. Pour plus d'informations, voir Accès au modèle. Pour cette procédure pas à pas, vous devez demander l'accès au modèle Cohere Embed Multilingual.

Installer des packages et importer des modules

Tout d’abord, nous installons les packages nécessaires et importons les modules que nous utiliserons dans cet exemple :

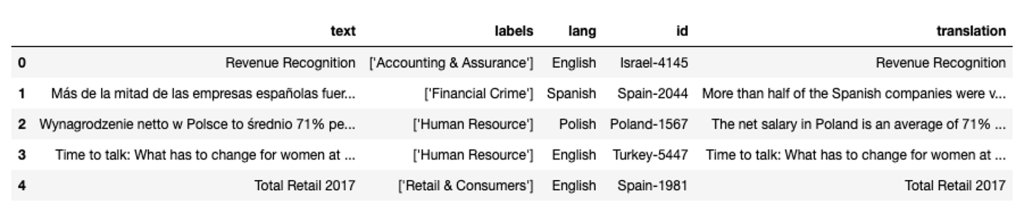

Les documents d'importation

Nous utilisons un ensemble de données (MultiFIN) contenant une liste de titres d'articles réels couvrant 15 langues (anglais, turc, danois, espagnol, polonais, grec, finnois, hébreu, japonais, hongrois, norvégien, russe, italien, islandais et suédois). ). Il s'agit d'un ensemble de données open source organisé pour le traitement du langage naturel (NLP) financier et disponible sur un site Web. GitHub référentiel.

Dans notre cas, nous avons créé un fichier CSV avec les données de MultiFIN ainsi qu'une colonne avec les traductions. Nous n'utilisons pas cette colonne pour alimenter le modèle ; nous l'utilisons pour nous aider à suivre lorsque nous imprimons les résultats pour ceux qui ne parlent ni danois ni espagnol. Nous pointons vers ce CSV pour créer notre dataframe :

Sélectionnez une liste de documents à interroger

MultiFIN compte plus de 6,000 15 enregistrements dans XNUMX langues différentes. Pour notre exemple de cas d'utilisation, nous nous concentrons sur trois langues : l'anglais, l'espagnol et le danois. Nous trions également les en-têtes par longueur et sélectionnons les plus longs.

Parce que nous sélectionnons les articles les plus longs, nous veillons à ce que la longueur ne soit pas due à des séquences répétées. Le code suivant montre un exemple où c'est le cas. Nous allons nettoyer ça.

df['text'].iloc[2215]

Notre liste de documents est joliment répartie dans les trois langues :

Voici l’en-tête d’article le plus long de notre ensemble de données :

Incorporer et indexer des documents

Maintenant, nous voulons intégrer nos documents et stocker les intégrations. Les plongements sont de très grands vecteurs qui encapsulent la signification sémantique de notre document. En particulier, nous utilisons le modèle embed-multilingual-v3.0 de Cohere, qui crée des intégrations avec 1,024 XNUMX dimensions.

Lorsqu'une requête est transmise, nous intégrons également la requête et utilisons la bibliothèque hnswlib pour trouver les voisins les plus proches.

Quelques lignes de code suffisent pour établir un client Cohere, intégrer les documents et créer l'index de recherche. Nous gardons également une trace de la langue et de la traduction du document pour enrichir l'affichage des résultats.

Construire un système de récupération

Ensuite, nous construisons une fonction qui prend une requête en entrée, l'intègre et trouve les quatre en-têtes qui y sont plus étroitement liés :

Interroger le système de récupération

Explorons ce que notre système fait avec quelques requêtes différentes. On commence par l'anglais :

Les résultats sont les suivants:

Notez ce qui suit :

- Nous posons des questions connexes, mais légèrement différentes, et le modèle est suffisamment nuancé pour présenter les résultats les plus pertinents en haut.

- Notre modèle n'effectue pas de recherche par mots-clés, mais une recherche sémantique. Même si nous utilisons un terme comme « science des données » au lieu de « IA », notre modèle est capable de comprendre ce qui est demandé et de renvoyer le résultat le plus pertinent en haut.

Que diriez-vous d'une requête en danois ? Regardons la requête suivante :

Dans l'exemple précédent, l'acronyme anglais « PP&E » signifie « propriété, usine et équipement » et notre modèle a pu le connecter à notre requête.

Dans ce cas, tous les résultats renvoyés sont en danois, mais le modèle peut renvoyer un document dans une langue autre que celle de la requête si sa signification sémantique est plus proche. Nous disposons d'une flexibilité totale et, avec quelques lignes de code, nous pouvons spécifier si le modèle doit uniquement examiner les documents dans la langue de la requête ou s'il doit examiner tous les documents.

Améliorez vos résultats avec Cohere Rerank

Les intégrations sont très puissantes. Cependant, nous allons maintenant voir comment affiner encore plus nos résultats avec le point de terminaison Rerank de Cohere, qui a été formé pour évaluer la pertinence des documents par rapport à une requête.

Un autre avantage de Rerank est qu’il peut fonctionner sur un ancien moteur de recherche par mots clés. Vous n’avez pas besoin de passer à une base de données vectorielle ni d’apporter des modifications drastiques à votre infrastructure, et cela ne prend que quelques lignes de code. Le reclassement est disponible dans Amazon Sage Maker.

Essayons une nouvelle requête. Nous utilisons SageMaker cette fois :

Dans ce cas, une recherche sémantique a pu récupérer notre réponse et l’afficher dans les résultats, mais elle n’est pas en haut. Cependant, lorsque nous transmettons à nouveau la requête à notre point de terminaison Rerank avec la liste des documents récupérés, Rerank est capable de faire apparaître le document le plus pertinent en haut.

Tout d’abord, nous créons le client et le point de terminaison Rerank :

Lorsque nous transmettons les documents à Rerank, le modèle est capable de sélectionner avec précision le plus pertinent :

Conclusion

Cet article présente une présentation pas à pas de l'utilisation du modèle d'intégration multilingue de Cohere dans Amazon Bedrock dans le domaine des services financiers. En particulier, nous avons présenté un exemple d’application de recherche d’articles financiers multilingues. Nous avons vu comment le modèle d'intégration permet une découverte efficace et précise des informations, augmentant ainsi la productivité et la qualité des résultats d'un analyste.

Le modèle d’intégration multilingue de Cohere prend en charge plus de 100 langues. Cela supprime la complexité de la création d’applications qui nécessitent de travailler avec un corpus de documents dans différentes langues. Le Modèle Cohere Embed est formé pour fournir des résultats dans des applications du monde réel. Il gère les données bruitées comme entrées, s'adapte aux systèmes RAG complexes et offre une rentabilité grâce à sa méthode de formation prenant en compte la compression.

Commencez dès aujourd’hui à créer avec le modèle d’intégration multilingue de Cohere dans Amazon Bedrock.

À propos des auteurs

James Yi est architecte senior de solutions partenaires IA/ML au sein de l'équipe technologique COE Tech des partenaires technologiques d'Amazon Web Services. Il est passionné par le travail avec des entreprises clientes et partenaires pour concevoir, déployer et faire évoluer des applications IA/ML afin d'en tirer de la valeur commerciale. En dehors du travail, il aime jouer au football, voyager et passer du temps avec sa famille.

James Yi est architecte senior de solutions partenaires IA/ML au sein de l'équipe technologique COE Tech des partenaires technologiques d'Amazon Web Services. Il est passionné par le travail avec des entreprises clientes et partenaires pour concevoir, déployer et faire évoluer des applications IA/ML afin d'en tirer de la valeur commerciale. En dehors du travail, il aime jouer au football, voyager et passer du temps avec sa famille.

Gonzalo Betegon est architecte de solutions chez Cohere, un fournisseur de technologies de pointe en matière de traitement du langage naturel. Il aide les organisations à répondre à leurs besoins commerciaux grâce au déploiement de grands modèles linguistiques.

Gonzalo Betegon est architecte de solutions chez Cohere, un fournisseur de technologies de pointe en matière de traitement du langage naturel. Il aide les organisations à répondre à leurs besoins commerciaux grâce au déploiement de grands modèles linguistiques.

Meor Amer est Developer Advocate chez Cohere, un fournisseur de technologie de pointe de traitement du langage naturel (NLP). Il aide les développeurs à créer des applications de pointe avec les grands modèles linguistiques (LLM) de Cohere.

Meor Amer est Developer Advocate chez Cohere, un fournisseur de technologie de pointe de traitement du langage naturel (NLP). Il aide les développeurs à créer des applications de pointe avec les grands modèles linguistiques (LLM) de Cohere.

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- PlatoData.Network Ai générative verticale. Autonomisez-vous. Accéder ici.

- PlatoAiStream. Intelligence Web3. Connaissance Amplifiée. Accéder ici.

- PlatonESG. Carbone, Technologie propre, Énergie, Environnement, Solaire, La gestion des déchets. Accéder ici.

- PlatoHealth. Veille biotechnologique et essais cliniques. Accéder ici.

- La source: https://aws.amazon.com/blogs/machine-learning/build-financial-search-applications-using-the-amazon-bedrock-cohere-multilingual-embedding-model/

- :possède

- :est

- :ne pas

- :où

- $UP

- 000

- 1

- 10

- 100

- 11

- 13

- 15%

- 16

- 2030

- 22

- 29

- 33

- 7

- 8

- 80

- 9

- a

- Capable

- A Propos

- accès

- Selon

- Compte

- Avec cette connaissance vient le pouvoir de prendre

- avec précision

- atteindre

- à travers

- actes

- s'adapte

- ajoutant

- Supplémentaire

- propos

- Avancée

- Avantage

- avocat

- AFP

- encore

- à opposer à

- AI

- Plateforme IA

- AI / ML

- Tous

- permettre

- permet

- le long de

- déjà

- aussi

- Amazon

- Amazon Web Services

- montant

- quantités

- an

- selon une analyse de l’Université de Princeton

- analyste

- Analystes

- l'analyse

- ainsi que le

- répondre

- api

- Application

- applications

- une approche

- approches

- architecture

- SONT

- article

- sur notre blog

- AS

- demandant

- At

- augmentée

- disponibles

- AWS

- basé

- car

- était

- va

- Améliorée

- jusqu'à XNUMX fois

- Blocs

- renforcer

- stimuler

- le Brexit

- PONT

- construire

- Développement

- construit

- la performance des entreprises

- Des chefs d'entreprise

- entreprises

- mais

- by

- CAN

- capacités

- capturer

- maisons

- cas

- plafond

- CFO

- challenge

- globaux

- Change

- Modifications

- Selectionnez

- classification

- espace extérieur plus propre,

- client

- Fermer

- étroitement

- plus

- CO

- code

- collection

- Colonne

- vient

- Sociétés

- De l'entreprise

- comparer

- complet

- complexe

- complexité

- ordinateurs

- concerné

- NOUS CONTACTER

- connecté

- contenu

- contexte

- contextuel

- contraste

- contrôles

- conventionnel

- Entreprises

- Prix

- les économies de coûts

- pourriez

- Couples

- accouplé

- couvrant

- COVID-19

- engendrent

- créée

- crée des

- crédit

- crise

- critères

- organisée

- Courant

- Clients

- En investissant dans une technologie de pointe, les restaurants peuvent non seulement rester compétitifs dans un marché en constante évolution, mais aussi améliorer significativement l'expérience de leurs clients.

- Cybersécurité

- danois

- danske

- données

- science des données

- Base de données

- de

- date limite

- traitement

- dévoué

- de la

- livrer

- Donner des résultats

- offre

- démontrer

- démontré

- déployer

- déploiement

- Cautions

- dériver

- Conception

- un

- Développeur

- mobiles

- Développement

- différent

- difficile

- Digérer

- dimensions

- découvrez

- découverte

- Commande

- distinct

- distribué

- distribution

- do

- document

- INSTITUTIONNELS

- domaine

- Ne pas

- down

- motivation

- deux

- e

- chacun

- "Early Bird"

- Mes Revenus

- facilité

- facilité d'utilisation

- économie

- Efficace

- efficace

- effort

- el

- élimine

- d'autre

- enchâsser

- enrobage

- économies émergentes.

- Emissions

- Employés

- permettre

- permet

- fin

- Endpoint

- participation

- Moteur

- Anglais

- énorme

- assez

- enrichir

- assurer

- Assure

- Entreprise

- entreprises

- Environment

- l'équipements

- Erreurs

- (ESG)

- établir

- Pourtant, la

- exemple

- excellent

- existant

- expérimenté

- explorez

- extrait

- Chutes

- famille

- RAPIDE

- réalisable

- few

- Figure

- Déposez votre dernière attestation

- la traduction de documents financiers

- nouvelles financières

- services financiers

- Trouvez

- trouver

- trouve

- finlandais

- cinq

- Flexibilité

- flux

- Focus

- suivre

- Abonnement

- suit

- Pour

- formulaire

- trouvé

- quatre

- Frist

- De

- plein

- fonction

- plus

- écart

- GAS

- rassemblement

- PIB

- généré

- génère

- Global

- Économie mondiale

- Go

- Objectifs

- aller

- Bien

- grec

- Groupes

- guide

- Poignées

- Vous avez

- he

- têtes

- Titres

- hébreu

- vous aider

- aide

- Faits saillants

- sa

- Frappé

- Comment

- How To

- Cependant

- HTML

- HTTPS

- Hongrois

- i

- if

- illustre

- la mise en œuvre

- importer

- améliorer

- améliore

- l'amélioration de

- in

- comprendre

- Améliore

- indice

- industrie

- info

- d'information

- Actualités

- Infrastructure

- contribution

- entrées

- idées.

- installer

- plutôt ;

- intégrer

- l'intégration

- intention

- développement

- introduire

- Découvrez le tout nouveau

- IP

- IT

- italien

- SES

- Janvier

- Japonais

- Emplois

- jpg

- juste

- XNUMX éléments à

- paysage d'été

- LANGUE

- langue

- Langues

- gros

- plus importantes

- le plus grand

- LAS

- Nom de famille

- Nouveautés

- dirigeants

- conduisant

- crédit-bail

- Legacy

- Législatives

- proposition législative

- Longueur

- moins

- Bibliothèque

- comme

- Gamme

- lignes

- Liste

- Listé

- Prêts

- Location

- Longtemps

- Style

- les

- Lot

- Entrée

- a prendre une

- FAIT DU

- Fabrication

- man

- gérer

- gérés

- gestion

- de nombreuses

- Localisation

- Mars

- Marché

- valeur marchande

- Marchés

- massif

- assorti

- sens

- significations

- mesurer

- les mesures

- Médias

- Découvrez

- réunion

- simple

- méthode

- migration

- ML

- Mode

- modèle

- modélisation statistique

- numériques jumeaux (digital twin models)

- Villas Modernes

- Modules

- PLUS

- plus efficace

- (en fait, presque toutes)

- beaucoup

- plusieurs

- prénom

- Nature

- Traitement du langage naturel

- Navigation

- nécessaire

- Besoin

- Besoins

- voisins

- Nouveauté

- nouvelles

- next

- nlp

- aucune

- Norvégien

- cahier

- maintenant

- nombreux

- NY

- NYE

- NYT

- objectivement

- of

- on

- ONE

- et, finalement,

- uniquement

- assaut

- ouvert

- open source

- Option

- or

- de commander

- organisations

- original

- OS

- Autre

- nos

- sortie

- au contrôle

- plus de

- paquet

- Forfaits

- pandas

- pain

- partie

- particulier

- les partenaires

- partenaires,

- pass

- passé

- passionné

- Paiement

- Paie

- /

- Effectuer

- performant

- en particulier pendant la préparation

- cueillette

- pipeline

- plan

- plateforme

- Platon

- Intelligence des données Platon

- PlatonDonnées

- jouer

- Podcast

- Point

- Polonais

- positions

- Post

- défaillances

- solide

- précédant

- représentent

- présenté

- Directeur

- Imprimé

- la confidentialité

- processus

- traitement

- productivité

- ,une équipe de professionnels qualifiés

- Progrès

- propriété

- proposition

- protégé

- fournir

- de voiture.

- fournit

- publications

- but

- PWC

- qualité

- requêtes

- question

- fréquemment posées

- vite.

- R

- augmenter

- classer

- Classement

- RE

- solutions

- monde réel

- reconnaissance

- Articles

- réduire

- référence

- affiner

- réforme

- région

- en relation

- pertinence

- pertinent

- rester

- reste

- supprime

- rouvrir

- répété

- remplacer

- Rapports

- Rapports

- nécessaire

- exigent

- résultat

- résultant

- Résultats

- conserver

- retourner

- retour

- russe

- s

- sagemaker

- économie

- Épargnes

- scie

- Escaliers intérieurs

- Sciences

- But

- Rechercher

- moteur de recherche

- recherches

- recherche

- SEC

- Deuxièmement

- en toute sécurité

- sécurité

- sur le lien

- choisi

- supérieur

- sensible

- sentiment

- Services

- Session

- actionnaire

- devrait

- vitrine

- Spectacles

- similaires

- unique

- Sites

- légèrement différente

- Lentement

- Football

- Solutions

- quelques

- Identifier

- Sources

- Space

- Espagnol

- parler

- spécial

- passer

- Dépenses

- empiler

- L'équipe

- Étape

- Standard

- peuplements

- Commencer

- Commencez

- déclarations

- rester

- stock

- marché boursier

- Actions

- Boutique

- simple

- de Marketing

- STRONG

- structuré

- Ces

- tel

- Support

- Appareils

- Appuyer

- Les soutiens

- Surface

- Sondage

- Durabilité

- durable

- développement durable

- Suédois

- Interrupteur

- Synonyme

- combustion propre

- Système

- prend

- objectifs

- impôt

- équipe

- technologie

- Technologie

- terme

- texte

- Classification du texte

- que

- qui

- La

- leur

- Les

- puis

- Là.

- ainsi

- Ces

- l'ont

- this

- ceux

- trois

- Avec

- fiable

- titres

- à

- aujourd'hui

- top

- sujet

- Les sujets

- suivre

- qualifié

- Formation

- traduire

- Traduction

- Voyages

- Essai

- Turc

- TOUR

- se tourne

- débutante

- UN

- devoiler

- sous-jacent

- comprendre

- expérience unique et authentique

- URL

- us

- utilisé

- cas d'utilisation

- utilisateurs

- Usages

- en utilisant

- Plus-value

- variété

- très

- walkthrough

- souhaitez

- était

- Vague

- Façon..

- we

- web

- services Web

- WELL

- Quoi

- quand

- que

- qui

- WHO

- sera

- comprenant

- sans

- activités principales

- workflow

- de travail

- world

- Classe mondiale

- années

- encore

- Vous n'avez

- Votre

- zéphyrnet