Dans le paysage actuel des interactions individuelles avec les clients pour passer des commandes, la pratique dominante continue de s'appuyer sur des agents humains, même dans des contextes tels que les cafés avec service au volant et les établissements de restauration rapide. Cette approche traditionnelle pose plusieurs défis : elle dépend fortement de processus manuels, a du mal à s'adapter efficacement aux demandes croissantes des clients, introduit un risque d'erreurs humaines et fonctionne dans des heures spécifiques de disponibilité. De plus, sur des marchés concurrentiels, les entreprises qui adhèrent uniquement à des processus manuels peuvent avoir du mal à fournir un service efficace et compétitif. Malgré les progrès technologiques, le modèle centré sur l’humain reste profondément ancré dans le traitement des commandes, ce qui entraîne ces limites.

La perspective d’utiliser la technologie pour une assistance individuelle au traitement des commandes existe depuis un certain temps. Cependant, les solutions existantes peuvent souvent se diviser en deux catégories : les systèmes basés sur des règles qui nécessitent beaucoup de temps et d'efforts pour la configuration et la maintenance, ou les systèmes rigides qui n'ont pas la flexibilité requise pour des interactions humaines avec les clients. En conséquence, les entreprises et les organisations sont confrontées à des difficultés pour mettre en œuvre de telles solutions de manière rapide et efficace. Heureusement, avec l'avènement de IA générative ainsi que les grands modèles de langage (LLM), il est désormais possible de créer des systèmes automatisés capables de gérer efficacement le langage naturel et avec un calendrier de montée en puissance accéléré.

Socle amazonien est un service entièrement géré qui offre un choix de modèles de base (FM) hautes performances provenant de grandes sociétés d'IA telles que AI21 Labs, Anthropic, Cohere, Meta, Stability AI et Amazon via une seule API, ainsi qu'un large ensemble de fonctionnalités dont vous avez besoin. Nous devons créer des applications d’IA génératives offrant sécurité, confidentialité et IA responsable. En plus d'Amazon Bedrock, vous pouvez utiliser d'autres services AWS comme Amazon SageMaker JumpStart ainsi que les Amazon Lex pour créer des agents de traitement des commandes génératifs d’IA entièrement automatisés et facilement adaptables.

Dans cet article, nous vous montrons comment créer un agent de traitement des commandes vocal à l'aide d'Amazon Lex, Amazon Bedrock et AWS Lambda.

Vue d'ensemble de la solution

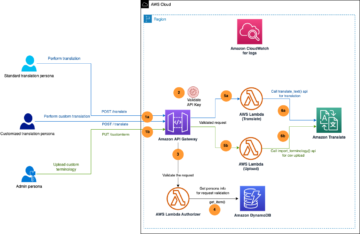

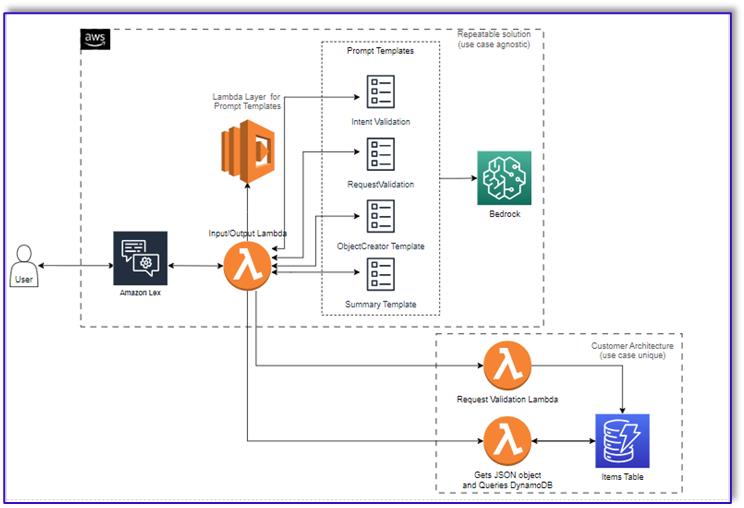

Le diagramme suivant illustre notre architecture de solution.

Le flux de travail comprend les étapes suivantes :

- Un client passe la commande via Amazon Lex.

- Le bot Amazon Lex interprète les intentions du client et déclenche une

DialogCodeHook. - Une fonction Lambda extrait le modèle d'invite approprié de la couche Lambda et formate les invites du modèle en ajoutant l'entrée du client dans le modèle d'invite associé.

- Les

RequestValidationL'invite vérifie la commande avec l'élément de menu et informe le client via Amazon Lex s'il souhaite commander quelque chose qui ne fait pas partie du menu et fournira des recommandations. L'invite effectue également une validation préliminaire de l'intégralité de la commande. - Les

ObjectCreatorL'invite convertit les requêtes en langage naturel en une structure de données (format JSON). - La fonction Lambda du validateur client vérifie les attributs requis pour la commande et confirme si toutes les informations nécessaires sont présentes pour traiter la commande.

- Une fonction Lambda client prend la structure de données comme entrée pour le traitement de la commande et renvoie le total de la commande à la fonction Lambda d'orchestration.

- La fonction Lambda d'orchestration appelle le point de terminaison Amazon Bedrock LLM pour générer un récapitulatif final de la commande incluant le total de la commande à partir du système de base de données client (par exemple, Amazon DynamoDB).

- Le récapitulatif de la commande est communiqué au client via Amazon Lex. Une fois que le client aura confirmé la commande, la commande sera traitée.

Pré-requis

Cet article suppose que vous disposez d'un compte AWS actif et que vous êtes familier avec les concepts et services suivants :

De plus, pour accéder à Amazon Bedrock à partir des fonctions Lambda, vous devez vous assurer que le runtime Lambda dispose des bibliothèques suivantes :

- boto3>=1.28.57

- awscli>=1.29.57

- botocore>=1.31.57

Cela peut être fait avec un Couche lambda ou en utilisant une AMI spécifique avec les bibliothèques requises.

De plus, ces bibliothèques sont requises lors de l'appel de l'API Amazon Bedrock depuis Amazon SageMakerStudio. Cela peut être fait en exécutant une cellule avec le code suivant :

Enfin, vous créez la stratégie suivante et l'attachez ultérieurement à n'importe quel rôle accédant à Amazon Bedrock :

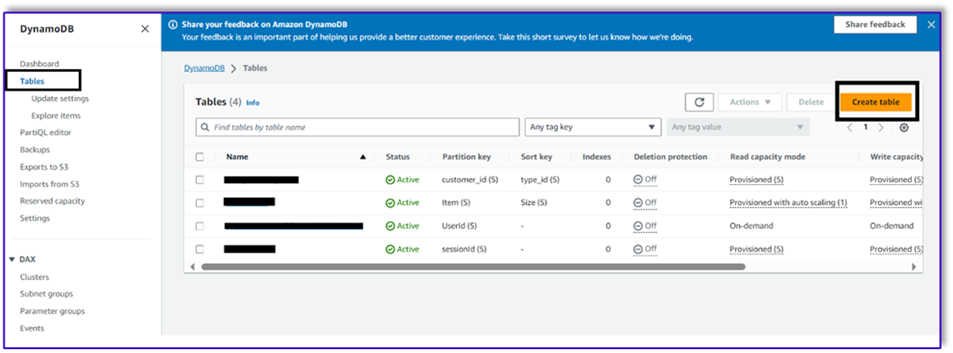

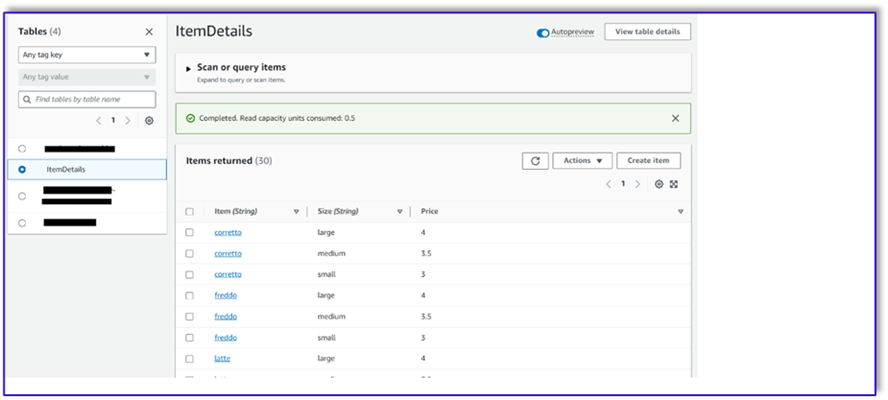

Créer une table DynamoDB

Dans notre scénario spécifique, nous avons créé une table DynamoDB comme système de base de données client, mais vous pouvez également utiliser Service de base de données relationnelle Amazon (AmazonRDS). Effectuez les étapes suivantes pour provisionner votre table DynamoDB (ou personnaliser les paramètres selon les besoins de votre cas d'utilisation) :

- Sur la console DynamoDB, choisissez Tables dans le volet de navigation.

- Selectionnez Créer une table.

- Pour Nom de la table, entrez un nom (par exemple,

ItemDetails). - Pour Clé de partition, entrez une clé (pour ce post, nous utilisons

Item). - Pour Clé de tri, entrez une clé (pour ce post, nous utilisons

Size). - Selectionnez Créer une table.

Vous pouvez maintenant charger les données dans la table DynamoDB. Pour cet article, nous utilisons un fichier CSV. Vous pouvez charger les données dans la table DynamoDB à l'aide du code Python dans un notebook SageMaker.

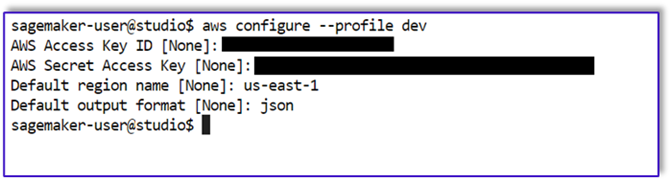

Tout d’abord, nous devons créer un profil nommé dev.

- Ouvrez un nouveau terminal dans SageMaker Studio et exécutez la commande suivante :

Cette commande vous invitera à saisir votre ID de clé d'accès AWS, votre clé d'accès secrète, votre région AWS par défaut et votre format de sortie.

- Revenez au notebook SageMaker et écrivez un code Python pour configurer une connexion à DynamoDB à l'aide de la bibliothèque Boto3 en Python. Cet extrait de code crée une session à l'aide d'un profil AWS spécifique nommé dev, puis crée un client DynamoDB à l'aide de cette session. Voici l'exemple de code pour charger les données :

Alternativement, vous pouvez utiliser Établi NoSQL ou d'autres outils pour charger rapidement les données dans votre table DynamoDB.

Ce qui suit est une capture d'écran une fois les exemples de données insérés dans le tableau.

Créez des modèles dans un bloc-notes SageMaker à l'aide de l'API d'appel Amazon Bedrock

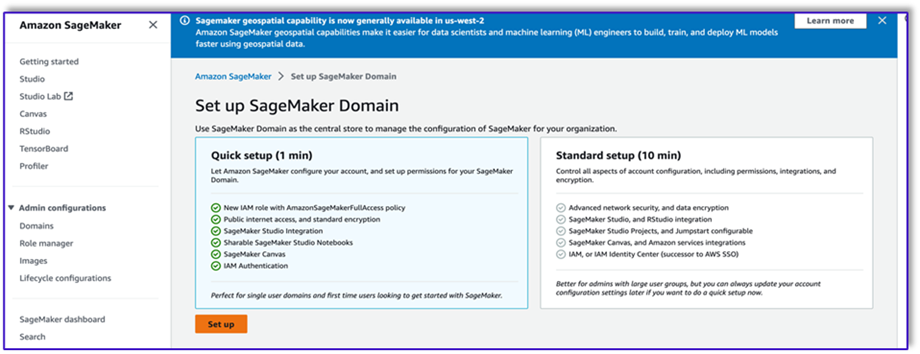

Pour créer notre modèle d'invite pour ce cas d'utilisation, nous utilisons Amazon Bedrock. Vous pouvez accéder à Amazon Bedrock à partir du Console de gestion AWS et via des invocations d'API. Dans notre cas, nous accédons à Amazon Bedrock via l'API à partir du confort d'un bloc-notes SageMaker Studio pour créer non seulement notre modèle d'invite, mais également notre code d'invocation API complet que nous pourrons ensuite utiliser sur notre fonction Lambda.

- Sur la console SageMaker, accédez à un domaine SageMaker Studio existant ou créez-en un nouveau pour accéder à Amazon Bedrock à partir d'un bloc-notes SageMaker.

- Après avoir créé le domaine et l'utilisateur SageMaker, choisissez l'utilisateur et choisissez Lancement ainsi que les Studio. Cela ouvrira un environnement JupyterLab.

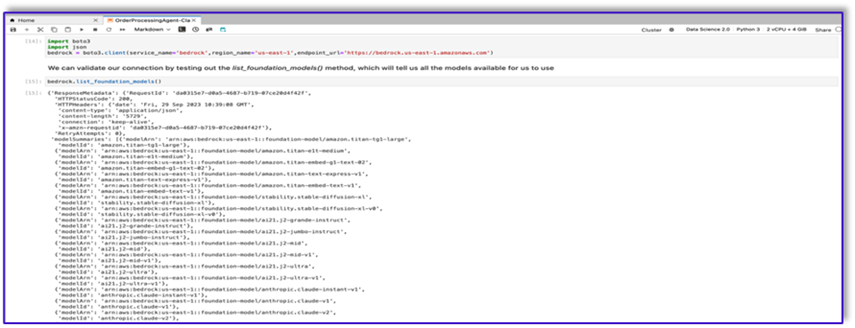

- Lorsque l'environnement JupyterLab est prêt, ouvrez un nouveau bloc-notes et commencez à importer les bibliothèques nécessaires.

De nombreux FM sont disponibles via le SDK Amazon Bedrock Python. Dans ce cas, nous utilisons Claude V2, un puissant modèle fondateur développé par Anthropic.

L’agent de traitement des commandes a besoin de quelques modèles différents. Cela peut changer en fonction du cas d'utilisation, mais nous avons conçu un flux de travail général qui peut s'appliquer à plusieurs paramètres. Pour ce cas d'utilisation, le modèle Amazon Bedrock LLM accomplira les tâches suivantes :

- Valider l'intention du client

- Valider la demande

- Créer la structure des données de commande

- Transmettre un récapitulatif de la commande au client

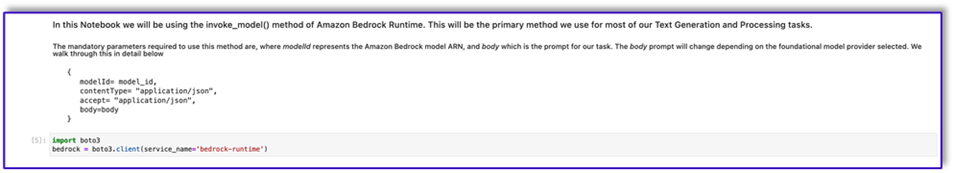

- Pour appeler le modèle, créez un objet d'exécution de base à partir de Boto3.

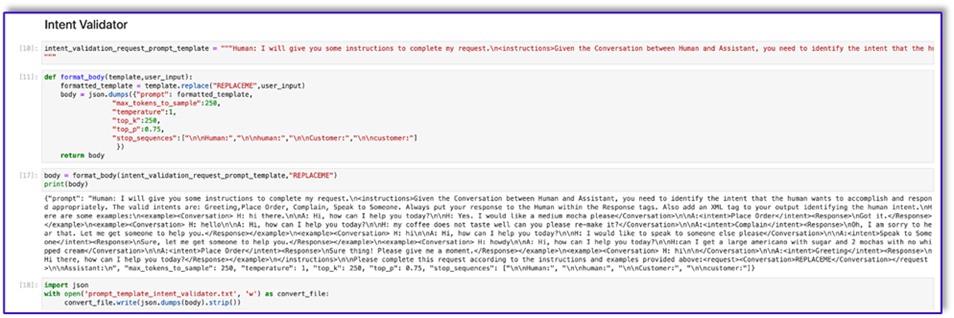

Commençons par travailler sur le modèle d'invite du validateur d'intention. Il s'agit d'un processus itératif, mais grâce au guide d'ingénierie des invites d'Anthropic, vous pouvez rapidement créer une invite capable d'accomplir la tâche.

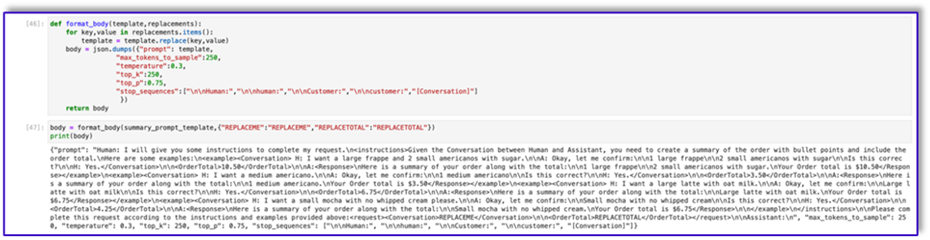

- Créez le premier modèle d'invite avec une fonction utilitaire qui aidera à préparer le corps pour les invocations d'API.

Voici le code de prompt_template_intent_validator.txt :

- Enregistrez ce modèle dans un fichier afin de le télécharger sur Amazon S3 et de l'appeler depuis la fonction Lambda si nécessaire. Enregistrez les modèles sous forme de chaînes sérialisées JSON dans un fichier texte. La capture d'écran précédente montre également l'exemple de code permettant d'accomplir cela.

- Répétez les mêmes étapes avec les autres modèles.

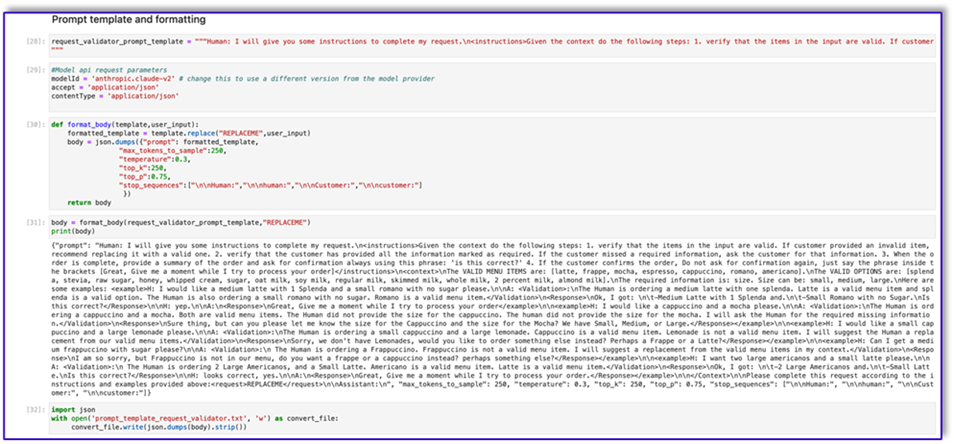

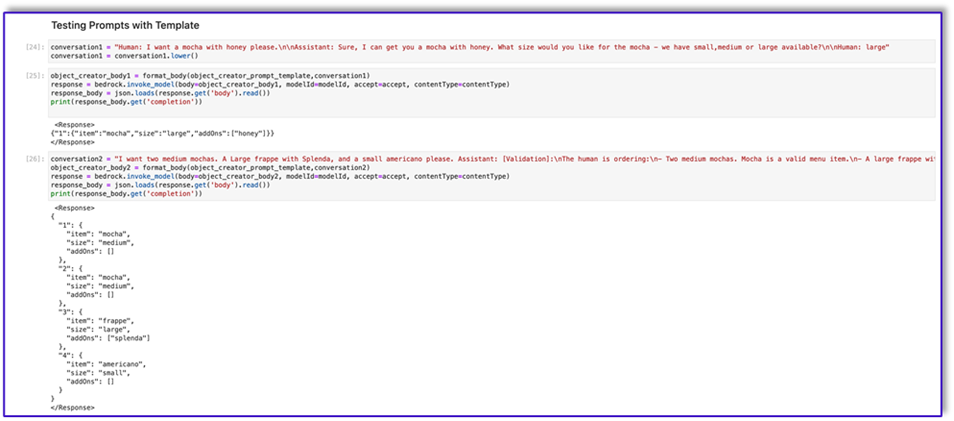

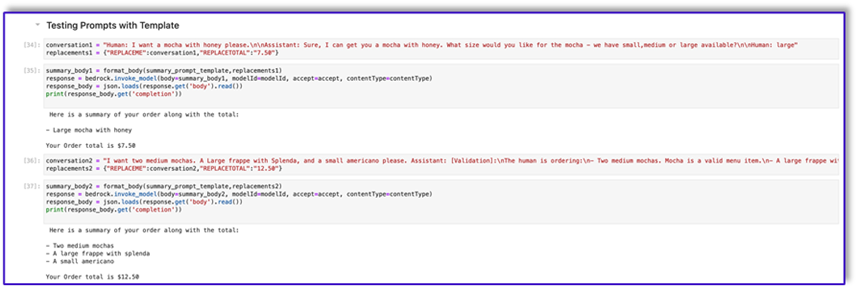

Voici quelques captures d'écran des autres modèles et les résultats lors de l'appel d'Amazon Bedrock avec certains d'entre eux.

Voici le code de prompt_template_request_validator.txt :

Voici notre réponse d'Amazon Bedrock utilisant ce modèle.

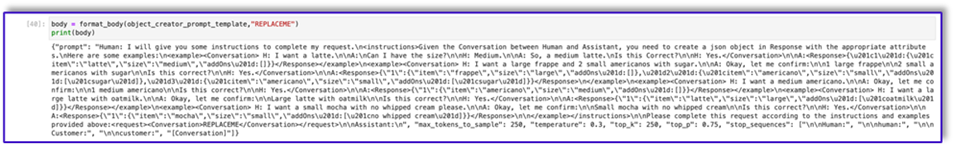

Voici le code pour prompt_template_object_creator.txt:

Voici le code de prompt_template_order_summary.txt :

Comme vous pouvez le constater, nous avons utilisé nos modèles d'invite pour valider les éléments de menu, identifier les informations requises manquantes, créer une structure de données et résumer la commande. Les modèles fondamentaux disponibles sur Amazon Bedrock sont très puissants, vous pouvez donc accomplir encore plus de tâches via ces modèles.

Vous avez terminé l'ingénierie des invites et enregistré les modèles dans des fichiers texte. Vous pouvez maintenant commencer à créer le bot Amazon Lex et les fonctions Lambda associées.

Créer une couche Lambda avec les modèles d'invite

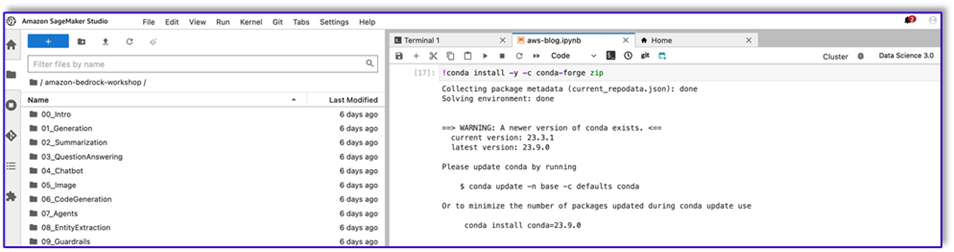

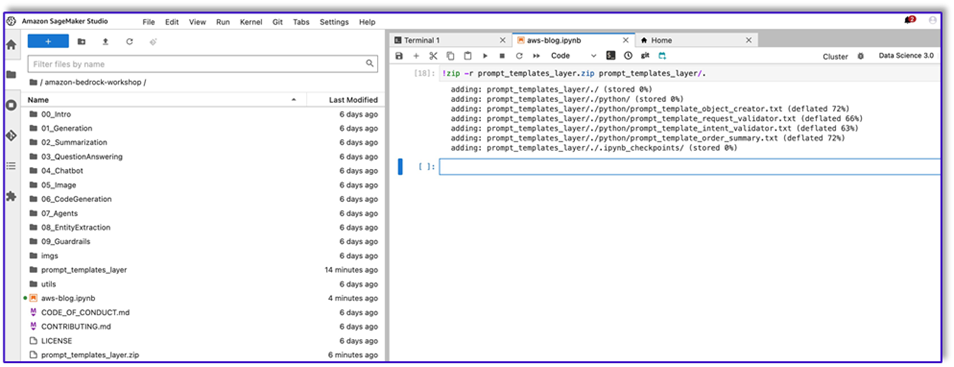

Effectuez les étapes suivantes pour créer votre couche Lambda :

- Dans SageMaker Studio, créez un nouveau dossier avec un sous-dossier nommé

python. - Copiez vos fichiers d'invite dans le

pythondossier.

- Vous pouvez ajouter la bibliothèque ZIP à votre instance de notebook en exécutant la commande suivante.

- Maintenant, exécutez la commande suivante pour créer le fichier ZIP à télécharger sur la couche Lambda.

- Après avoir créé le fichier ZIP, vous pouvez télécharger le fichier. Accédez à Lambda, créez une nouvelle couche en téléchargeant le fichier directement ou en le téléchargeant d'abord sur Amazon S3.

- Attachez ensuite cette nouvelle couche à la fonction Lambda d'orchestration.

Vos fichiers de modèles d'invite sont désormais stockés localement dans votre environnement d'exécution Lambda. Cela accélérera le processus lors des exécutions de votre bot.

Créez une couche Lambda avec les bibliothèques requises

Effectuez les étapes suivantes pour créer votre couche Lambda avec les bibliothèques requises :

- Ouvrez un AWSCloud9 environnement d'instance, créez un dossier avec un sous-dossier appelé

python. - Ouvrez un terminal à l'intérieur du

pythondossier. - Exécutez les commandes suivantes depuis le terminal :

- Courir

cd ..et positionnez-vous dans votre nouveau dossier où vous avez également lepythonsous-dossier. - Exécutez la commande suivante:

- Après avoir créé le fichier ZIP, vous pouvez télécharger le fichier. Accédez à Lambda, créez une nouvelle couche en téléchargeant le fichier directement ou en le téléchargeant d'abord sur Amazon S3.

- Attachez ensuite cette nouvelle couche à la fonction Lambda d'orchestration.

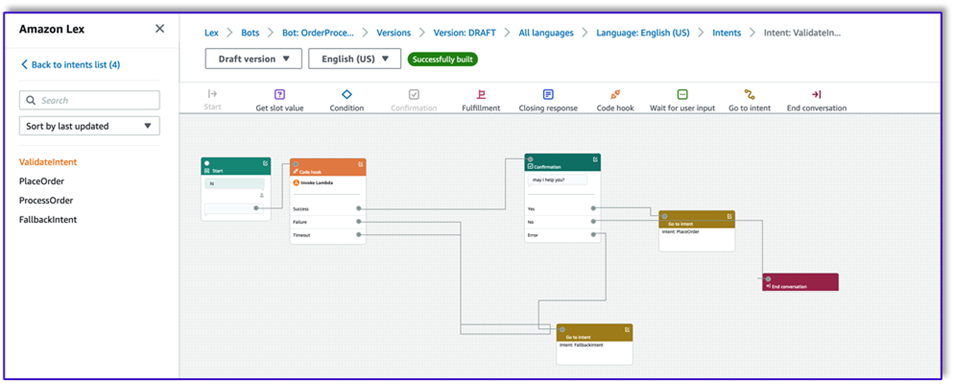

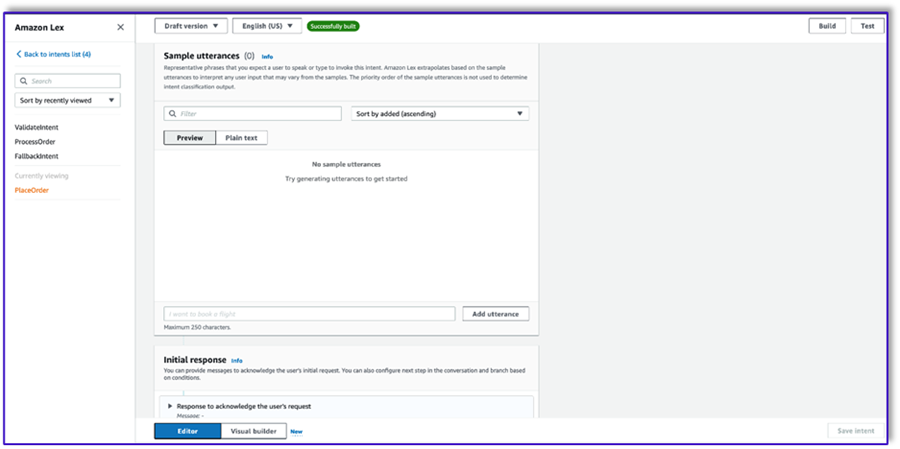

Créer le bot dans Amazon Lex v2

Pour ce cas d'utilisation, nous construisons un bot Amazon Lex qui peut fournir une interface d'entrée/sortie pour l'architecture afin d'appeler Amazon Bedrock en utilisant la voix ou le texte depuis n'importe quelle interface. Étant donné que le LLM gérera l'élément de conversation de cet agent de traitement des commandes et que Lambda orchestrera le flux de travail, vous pouvez créer un bot avec trois intentions et aucun emplacement.

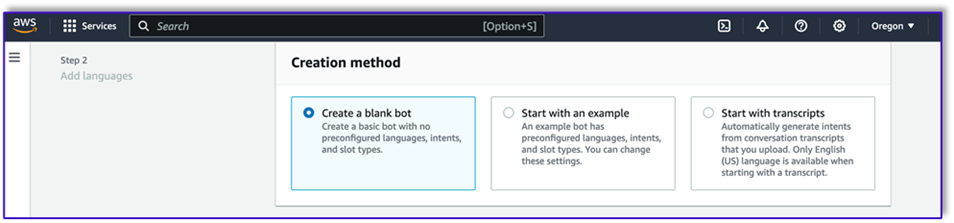

- Sur la console Amazon Lex, créez un nouveau bot avec la méthode Créer un bot vierge.

Vous pouvez désormais ajouter une intention avec n'importe quel énoncé initial approprié pour que les utilisateurs finaux puissent démarrer la conversation avec le bot. Nous utilisons des salutations simples et ajoutons une réponse initiale du robot afin que les utilisateurs finaux puissent répondre à leurs demandes. Lors de la création du bot, assurez-vous d'utiliser un hook de code Lambda avec les intentions ; cela déclenchera une fonction Lambda qui orchestrera le flux de travail entre le client, Amazon Lex et le LLM.

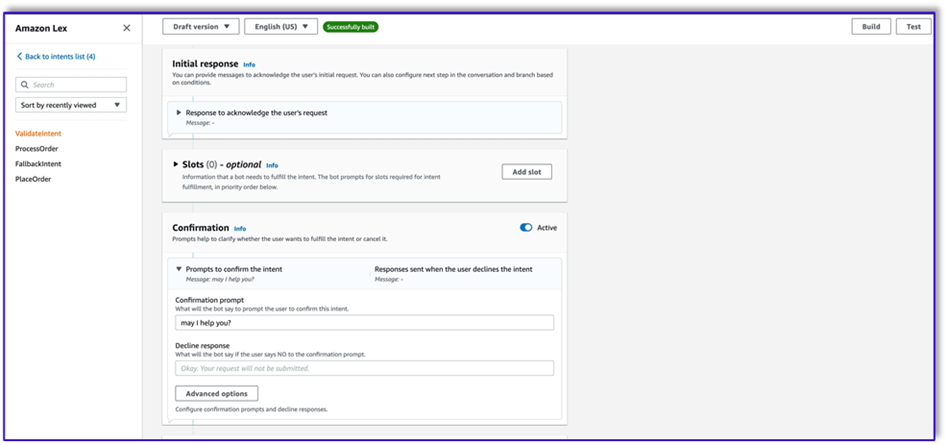

- Ajoutez votre première intention, qui déclenche le flux de travail et utilise le modèle d'invite de validation d'intention pour appeler Amazon Bedrock et identifier ce que le client essaie d'accomplir. Ajoutez quelques énoncés simples pour que les utilisateurs finaux puissent démarrer la conversation.

Vous n'avez pas besoin d'utiliser d'emplacements ou de lecture initiale dans aucune des intentions du bot. En fait, vous n'avez pas besoin d'ajouter des énoncés à la deuxième ou à la troisième intention. En effet, le LLM guidera Lambda tout au long du processus.

- Ajoutez une invite de confirmation. Vous pourrez personnaliser ce message dans la fonction Lambda ultérieurement.

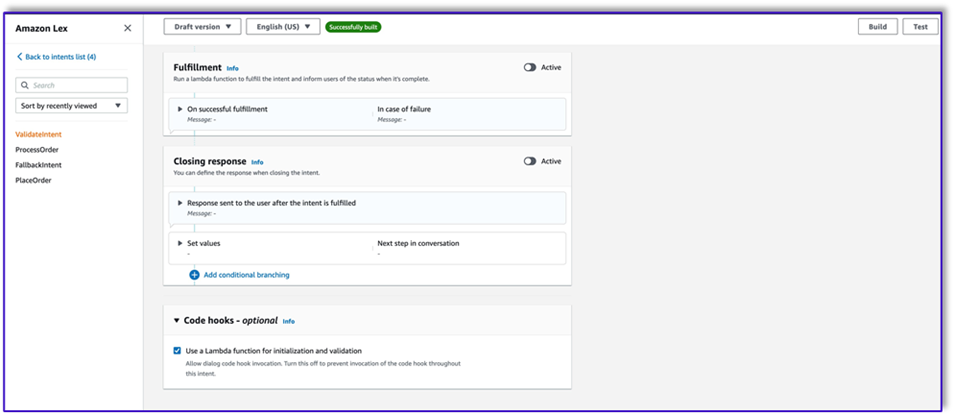

- Sous Crochets de code, sélectionnez Utiliser une fonction Lambda pour l'initialisation et la validation.

- Créez une seconde intention sans énoncé ni réponse initiale. C'est le

PlaceOrderintention.

Lorsque le LLM identifie que le client essaie de passer une commande, la fonction Lambda déclenchera cette intention et validera la demande du client par rapport au menu, et s'assurera qu'aucune information requise ne manque. N'oubliez pas que tout cela figure dans les modèles d'invite. Vous pouvez donc adapter ce flux de travail à n'importe quel cas d'utilisation en modifiant les modèles d'invite.

- N'ajoutez aucun créneau, mais ajoutez une invite de confirmation et refusez la réponse.

- Sélectionnez Utiliser une fonction Lambda pour l'initialisation et la validation.

- Créez une troisième intention nommée

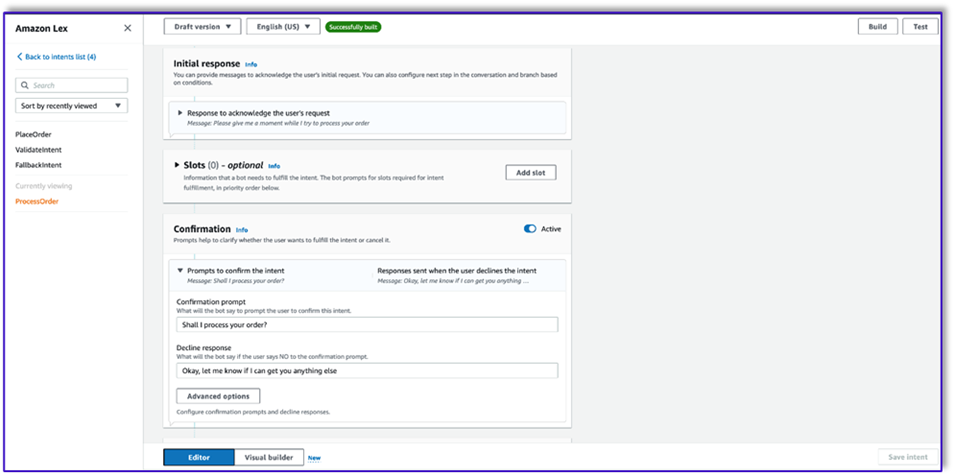

ProcessOrdersans exemples d'énoncés et sans créneaux. - Ajoutez une réponse initiale, une invite de confirmation et une réponse de refus.

Une fois que le LLM a validé la demande du client, la fonction Lambda déclenche la troisième et dernière intention de traitement de la commande. Ici, Lambda utilisera le modèle de créateur d'objet pour générer la structure de données JSON de commande afin d'interroger la table DynamoDB, puis utilisera le modèle de résumé de commande pour résumer l'intégralité de la commande ainsi que le total afin qu'Amazon Lex puisse la transmettre au client.

- Sélectionnez Utiliser une fonction Lambda pour l'initialisation et la validation. Celui-ci peut utiliser n'importe quelle fonction Lambda pour traiter la commande une fois que le client a donné la confirmation finale.

- Après avoir créé les trois intents, accédez au générateur visuel pour le

ValidateIntent, ajoutez une étape d'intention de référence et connectez la sortie de la confirmation positive à cette étape. - Après avoir ajouté l'intention de référence, modifiez-la et choisissez l'intention PlaceOrder comme nom de l'intention.

- De même, pour accéder au générateur visuel pour le

PlaceOrderintention et connectez la sortie de la confirmation positive auProcessOrderaller à l'intention. Aucune modification n'est requise pour leProcessOrderintention. - Vous devez maintenant créer la fonction Lambda qui orchestre Amazon Lex et appelle la table DynamoDB, comme détaillé dans la section suivante.

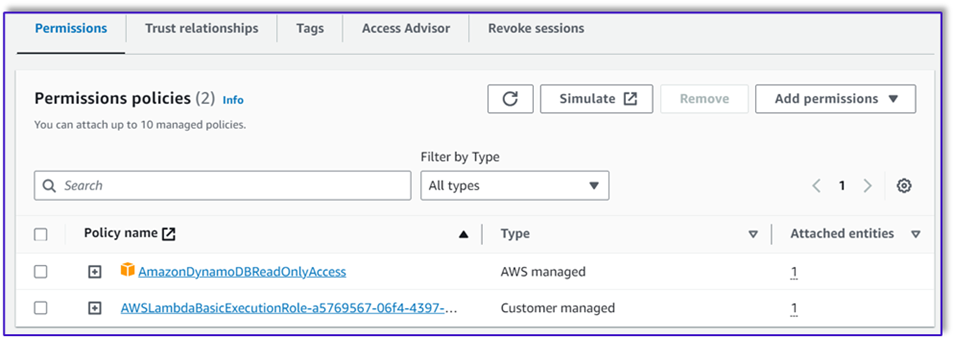

Créer une fonction Lambda pour orchestrer le bot Amazon Lex

Vous pouvez désormais créer la fonction Lambda qui orchestre le bot et le flux de travail Amazon Lex. Effectuez les étapes suivantes :

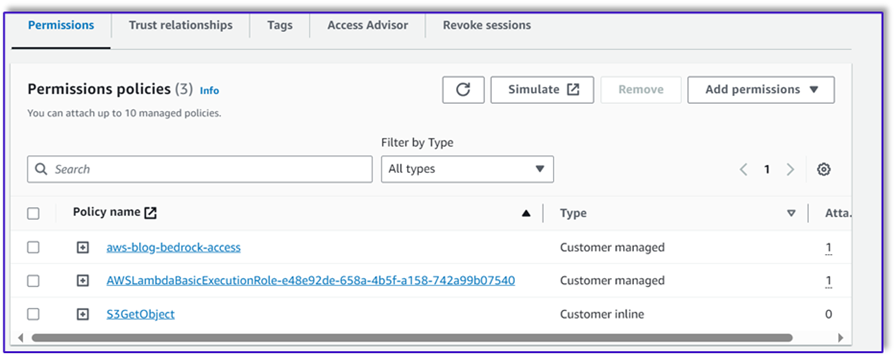

- Créez une fonction Lambda avec la stratégie d'exécution standard et laissez Lambda créer un rôle pour vous.

- Dans la fenêtre de code de votre fonction, ajoutez quelques fonctions utilitaires qui vous aideront : formatez les invites en ajoutant le contexte lex au modèle, appelez l'API Amazon Bedrock LLM, extrayez le texte souhaité des réponses, et plus encore. Voir le code suivant :

- Attachez la couche Lambda que vous avez créée précédemment à cette fonction.

- De plus, attachez le calque aux modèles d'invite que vous avez créés.

- Dans le rôle d'exécution Lambda, attachez la stratégie pour accéder à Amazon Bedrock, qui a été créée précédemment.

Le rôle d'exécution Lambda doit disposer des autorisations suivantes.

Attachez la fonction Orchestration Lambda au bot Amazon Lex

- Après avoir créé la fonction dans la section précédente, revenez à la console Amazon Lex et accédez à votre bot.

- Sous Langues dans le volet de navigation, choisissez Anglais.

- Pour Identifier, choisissez votre robot de traitement des commandes.

- Pour Version ou alias de la fonction Lambda, choisissez $DERNIER.

- Selectionnez Épargnez.

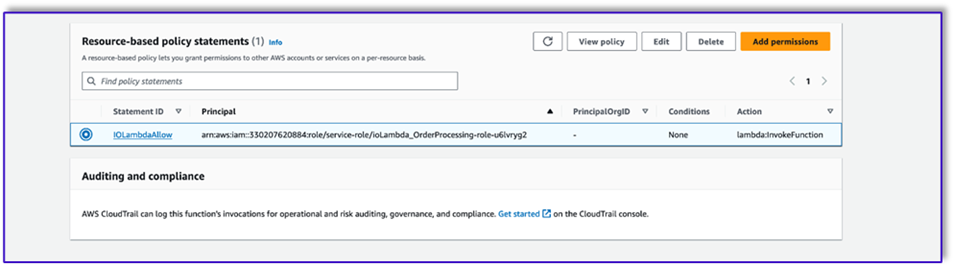

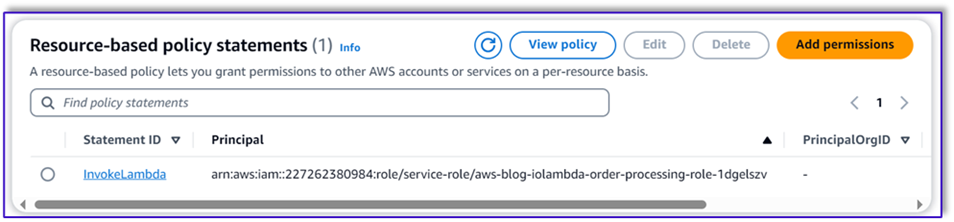

Créer des fonctions Lambda d'assistance

Effectuez les étapes suivantes pour créer des fonctions Lambda supplémentaires :

- Créez une fonction Lambda pour interroger la table DynamoDB que vous avez créée précédemment :

- Accédez à la configuration dans la fonction Lambda et choisissez Permissions.

- Joignez une déclaration de stratégie basée sur les ressources permettant à la fonction Lambda de traitement des commandes d'appeler cette fonction.

- Accédez au rôle d'exécution IAM pour cette fonction Lambda et ajoutez une stratégie pour accéder à la table DynamoDB.

- Créez une autre fonction Lambda pour vérifier si tous les attributs requis ont été transmis par le client. Dans l'exemple suivant, nous vérifions si l'attribut size est capturé pour une commande :

- Accédez à la configuration dans la fonction Lambda et choisissez Permissions.

- Joignez une déclaration de stratégie basée sur les ressources permettant à la fonction Lambda de traitement des commandes d'appeler cette fonction.

Testez la solution

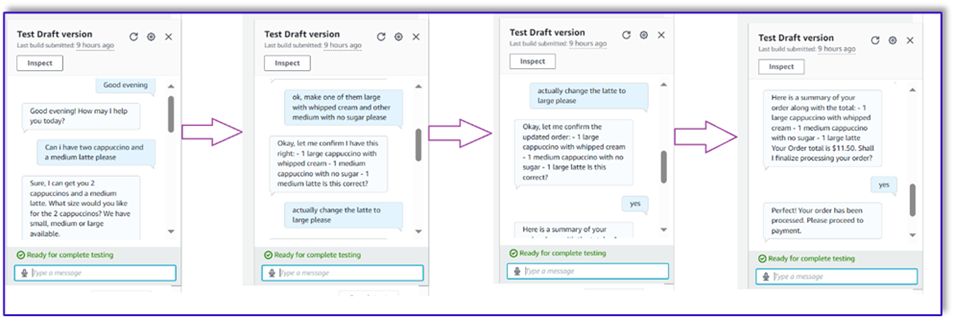

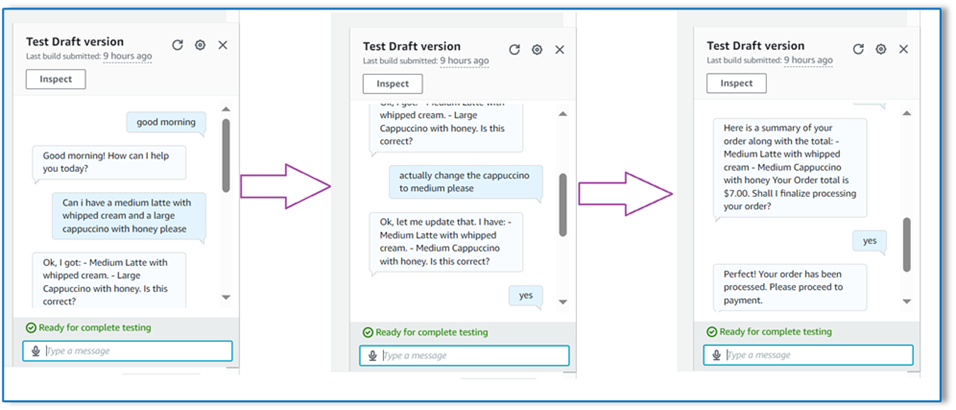

Nous pouvons désormais tester la solution avec des exemples de commandes que les clients passent via Amazon Lex.

Pour notre premier exemple, le client a demandé un frappuccino, qui ne figure pas au menu. Le modèle valide à l'aide du modèle de validateur de commande et suggère quelques recommandations basées sur le menu. Une fois que le client a confirmé sa commande, il est informé du total de la commande et du récapitulatif de la commande. La commande sera traitée sur la base de la confirmation finale du client.

Dans notre exemple suivant, le client commande un grand cappuccino, puis modifie la taille de grand à moyen. Le modèle capture toutes les modifications nécessaires et demande au client de confirmer la commande. Le modèle présente le total de la commande et le récapitulatif de la commande, et traite la commande en fonction de la confirmation finale du client.

Pour notre dernier exemple, le client a passé une commande pour plusieurs articles et la taille manque pour quelques articles. Le modèle et la fonction Lambda vérifieront si tous les attributs requis sont présents pour traiter la commande, puis demanderont au client de fournir les informations manquantes. Une fois que le client a fourni les informations manquantes (dans ce cas, la taille du café), le total et le récapitulatif de la commande lui sont présentés. La commande sera traitée sur la base de la confirmation finale du client.

Limites du LLM

Les résultats du LLM sont par nature stochastiques, ce qui signifie que les résultats de notre LLM peuvent varier en format, voire sous la forme de contenu mensonger (hallucinations). Par conséquent, les développeurs doivent s'appuyer sur une bonne logique de gestion des erreurs dans tout leur code afin de gérer ces scénarios et d'éviter une expérience utilisateur finale dégradée.

Nettoyer

Si vous n'avez plus besoin de cette solution, vous pouvez supprimer les ressources suivantes :

- Fonctions Lambda

- Boîte Amazon Lex

- Table DynamoDB

- Seau S3

De plus, arrêtez l'instance de SageMaker Studio si l'application n'est plus requise.

Évaluation des coûts

Pour obtenir des informations sur les tarifs des principaux services utilisés par cette solution, consultez les informations suivantes :

Notez que vous pouvez utiliser Claude v2 sans avoir besoin de provisionnement, les coûts globaux restent donc au minimum. Pour réduire davantage les coûts, vous pouvez configurer la table DynamoDB avec le paramètre à la demande.

Conclusion

Cet article a montré comment créer un agent de traitement des commandes doté d'une IA vocale à l'aide d'Amazon Lex, d'Amazon Bedrock et d'autres services AWS. Nous avons montré comment une ingénierie rapide avec un puissant modèle d'IA générative comme Claude peut permettre une compréhension robuste du langage naturel et des flux de conversation pour le traitement des commandes sans avoir besoin de données de formation approfondies.

L'architecture de la solution utilise des composants sans serveur tels que Lambda, Amazon S3 et DynamoDB pour permettre une mise en œuvre flexible et évolutive. Le stockage des modèles d'invite dans Amazon S3 vous permet de personnaliser la solution pour différents cas d'utilisation.

Les prochaines étapes pourraient inclure l'extension des capacités de l'agent pour gérer un plus large éventail de demandes des clients et de cas extrêmes. Les modèles d'invites permettent d'améliorer de manière itérative les compétences de l'agent. Des personnalisations supplémentaires pourraient impliquer l'intégration des données de commande avec des systèmes backend tels que l'inventaire, le CRM ou le point de vente. Enfin, l'agent pourrait être mis à disposition sur divers points de contact client tels que les applications mobiles, le service au volant, les kiosques, etc. en utilisant les capacités multicanaux d'Amazon Lex.

Pour en savoir plus, reportez-vous aux ressources connexes suivantes :

- Déployer et gérer des bots multicanaux :

- Ingénierie rapide pour Claude et autres modèles :

- Modèles architecturaux sans serveur pour les assistants IA évolutifs :

À propos des auteurs

Moumita Dutta est architecte de solutions partenaire chez Amazon Web Services. Dans son rôle, elle collabore étroitement avec des partenaires pour développer des actifs évolutifs et réutilisables qui rationalisent les déploiements cloud et améliorent l'efficacité opérationnelle. Elle est membre de la communauté AI/ML et experte en IA générative chez AWS. Dans ses loisirs, elle aime jardiner et faire du vélo.

Moumita Dutta est architecte de solutions partenaire chez Amazon Web Services. Dans son rôle, elle collabore étroitement avec des partenaires pour développer des actifs évolutifs et réutilisables qui rationalisent les déploiements cloud et améliorent l'efficacité opérationnelle. Elle est membre de la communauté AI/ML et experte en IA générative chez AWS. Dans ses loisirs, elle aime jardiner et faire du vélo.

Fernando Lammoglia est un architecte de solutions partenaires chez Amazon Web Services, travaillant en étroite collaboration avec les partenaires AWS pour diriger le développement et l'adoption de solutions d'IA de pointe dans toutes les unités commerciales. Un leader stratégique possédant une expertise en architecture cloud, en IA générative, en apprentissage automatique et en analyse de données. Il se spécialise dans l’exécution de stratégies de commercialisation et dans la fourniture de solutions d’IA percutantes alignées sur les objectifs organisationnels. Pendant son temps libre, il aime passer du temps avec sa famille et voyager dans d'autres pays.

Fernando Lammoglia est un architecte de solutions partenaires chez Amazon Web Services, travaillant en étroite collaboration avec les partenaires AWS pour diriger le développement et l'adoption de solutions d'IA de pointe dans toutes les unités commerciales. Un leader stratégique possédant une expertise en architecture cloud, en IA générative, en apprentissage automatique et en analyse de données. Il se spécialise dans l’exécution de stratégies de commercialisation et dans la fourniture de solutions d’IA percutantes alignées sur les objectifs organisationnels. Pendant son temps libre, il aime passer du temps avec sa famille et voyager dans d'autres pays.

Mitul Patel est architecte de solutions senior chez Amazon Web Services. Dans son rôle de facilitateur de technologie cloud, il travaille avec les clients pour comprendre leurs objectifs et leurs défis, et fournit des conseils prescriptifs pour atteindre leur objectif avec les offres AWS. Il est membre de la communauté AI/ML et ambassadeur de l'IA générative chez AWS. Pendant son temps libre, il aime faire de la randonnée et jouer au football.

Mitul Patel est architecte de solutions senior chez Amazon Web Services. Dans son rôle de facilitateur de technologie cloud, il travaille avec les clients pour comprendre leurs objectifs et leurs défis, et fournit des conseils prescriptifs pour atteindre leur objectif avec les offres AWS. Il est membre de la communauté AI/ML et ambassadeur de l'IA générative chez AWS. Pendant son temps libre, il aime faire de la randonnée et jouer au football.

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- PlatoData.Network Ai générative verticale. Autonomisez-vous. Accéder ici.

- PlatoAiStream. Intelligence Web3. Connaissance Amplifiée. Accéder ici.

- PlatonESG. Carbone, Technologie propre, Énergie, Environnement, Solaire, La gestion des déchets. Accéder ici.

- PlatoHealth. Veille biotechnologique et essais cliniques. Accéder ici.

- La source: https://aws.amazon.com/blogs/machine-learning/transform-one-on-one-customer-interactions-build-speech-capable-order-processing-agents-with-aws-and-generative-ai/

- :possède

- :est

- :ne pas

- :où

- $3

- $UP

- 1

- 10

- 100

- 11

- 12

- 13

- 15%

- 173

- 200

- 24

- 250

- 28

- 29

- 31

- 320

- 385

- 40

- 400

- 500

- 7

- 75

- 8

- 9

- 900

- a

- au dessus de

- accéléré

- Accepter

- accès

- accès

- accomplir

- Selon

- Compte

- atteindre

- à travers

- Action

- infection

- adapter

- ajouter

- ajoutée

- ajoutant

- ajout

- Supplémentaire

- En outre

- adhérant

- régler

- Adoption

- progrès

- avènement

- Après

- encore

- à opposer à

- Agent

- agents

- AI

- AI / ML

- aligné

- Tous

- permettre

- Permettre

- permet

- le long de

- aussi

- toujours

- am

- Amazon

- Amazon Lex

- Amazon RDS

- Amazon Web Services

- Ambassadeur

- an

- analytique

- ainsi que les

- Une autre

- Anthropique

- tous

- api

- Application

- applications

- Appliquer

- une approche

- approprié

- de manière appropriée

- applications

- architectural

- architecture

- SONT

- AS

- demander

- Outils

- Assistance

- Assistante gérante

- assistants

- assistant

- associé

- suppose

- At

- joindre

- Préposés

- attributs

- Automatisation

- disponibilité

- disponibles

- éviter

- AWS

- RETOUR

- backend

- basé

- BE

- car

- était

- commencer

- jusqu'à XNUMX fois

- corps

- Bot

- tous les deux

- les robots

- vaste

- construire

- constructeur

- la performance des entreprises

- entreprises

- mais

- by

- calculer

- Appelez-nous

- appelé

- appel

- Appels

- CAN

- capacités

- capturé

- captures

- maisons

- cas

- catégories

- cellule

- globaux

- difficile

- Change

- Modifications

- en changeant

- caractères

- vérifier

- le choix

- Selectionnez

- client

- Fermer

- étroitement

- le cloud

- TECHNOLOGIE CLOUD

- code

- Café

- collabore

- recueillir

- communiqué

- Communautés

- Sociétés

- compétitif

- complet

- Complété

- compléter

- achèvement

- composants électriques

- concepts

- Confirmer

- confirmation

- CONFIRMÉ

- NOUS CONTACTER

- connexion

- consiste

- Console

- contenu

- contexte

- continue

- commodité

- Conversation

- convertir

- correct

- Costs

- pourriez

- d'exportation

- Couples

- engendrent

- créée

- crée des

- La création

- création

- créateur

- CRM

- Courant

- Customiser

- des clients

- Clients

- personnaliser

- En investissant dans une technologie de pointe, les restaurants peuvent non seulement rester compétitifs dans un marché en constante évolution, mais aussi améliorer significativement l'expérience de leurs clients.

- données

- Analyse de Donnée

- Structure de données

- Base de données

- Refuser

- profondément

- Réglage par défaut

- Vous permet de définir

- livrer

- livrer

- Demande

- demandes

- démontré

- dénié

- Selon

- dépend

- déploiements

- un

- voulu

- Malgré

- détaillé

- dev

- développer

- développé

- mobiles

- Développement

- diagramme

- DID

- différent

- directement

- expédition

- do

- domaine

- Don

- fait

- Ne pas

- down

- download

- pendant

- e

- chacun

- Plus tôt

- même

- Edge

- effet

- efficace

- efficace

- efficacement

- effort

- d'autre

- permettre

- activateur

- Endpoint

- ENGINEERING

- de renforcer

- Entrer

- Environment

- erreur

- Erreurs

- Pourtant, la

- événement

- exemple

- exemples

- Sauf

- exception

- exécution

- exécution

- existant

- Quitter

- expansion

- d'experience

- expert

- nous a permis de concevoir

- les

- extrait

- Visage

- fait

- Automne

- Familiarité

- famille

- few

- Déposez votre dernière attestation

- Fichiers

- finale

- finaliser

- Trouvez

- Prénom

- Flexibilité

- flexible

- Flux

- Abonnement

- Pour

- formulaire

- le format

- Heureusement

- trouvé

- Fondation

- Fondationale

- Gratuit

- de

- d’étiquettes électroniques entièrement

- fonction

- fonctions

- plus

- Général

- générer

- génératif

- IA générative

- obtenez

- Donner

- donné

- Go

- Aller au marché

- Objectifs

- Bien

- eu

- grandiose

- l'

- salutation

- Salutations

- l'orientation

- guide

- manipuler

- Maniabilité

- Vous avez

- ayant

- he

- entendre

- fortement

- vous aider

- ici

- ici

- hi

- haute performance

- sa

- Miel

- HEURES

- Comment

- How To

- Cependant

- HTML

- http

- HTTPS

- humain

- i

- ID

- identifie

- identifier

- identifier

- if

- illustre

- percutants

- la mise en oeuvre

- la mise en œuvre

- importer

- l'importation

- améliorer

- in

- comprendre

- Y compris

- Nouveau

- croissant

- indice

- d'information

- enraciné

- initiale

- contribution

- entrées

- à l'intérieur

- installer

- instance

- plutôt ;

- Des instructions

- Intégration

- intention

- interactions

- Interfaces

- développement

- Introduit

- inventaire

- impliquer

- IT

- articles

- jpg

- json

- juste

- XNUMX éléments à

- ACTIVITES

- kiosques

- Savoir

- Labs

- Peindre

- paysage d'été

- langue

- gros

- Nom de famille

- enfin

- plus tard

- couche

- leader

- conduisant

- APPRENTISSAGE

- apprentissage

- limonade

- laisser

- Allons-y

- bibliothèques

- Bibliothèque

- comme

- limites

- Liste

- LLM

- charge

- localement

- enregistrement

- logique

- plus long

- LOOKS

- aime

- click

- machine learning

- LES PLANTES

- Entrée

- a prendre une

- gérés

- gestion

- les gérer

- Manuel

- de nombreuses

- marqué

- Marchés

- me

- veux dire

- moyenne

- membre

- Menu

- message

- messages

- Meta

- méthode

- pourrait

- Lait

- minimum

- manqué

- manquant

- Breeze Mobile

- application mobile

- modèle

- numériques jumeaux (digital twin models)

- modifié

- modifier

- moment

- PLUS

- plusieurs

- my

- prénom

- Nommé

- Nature

- Nature

- NAVIGUER

- Navigation

- nécessaire

- Besoin

- nécessaire

- Besoins

- Nouveauté

- next

- aucune

- Aucun

- cahier

- maintenant

- objet

- objectif

- a eu lieu

- of

- Offrandes

- Offres Speciales

- souvent

- Bien

- on

- À la demande

- ONE

- uniquement

- ouvert

- exploite

- opérationnel

- Option

- Options

- or

- orchestrer

- orchestration

- de commander

- passer commande

- organisationnel

- organisations

- Autre

- nos

- sortie

- sorties

- global

- pain

- paramètres

- partie

- les partenaires

- partenaires,

- pass

- passé

- passes

- chemin

- motifs

- Paiement

- pour cent

- effectue

- être

- autorisations

- pièce

- Place

- Des endroits

- placement

- Platon

- Intelligence des données Platon

- PlatonDonnées

- jouer

- veuillez cliquer

- des notes bonus

- politique

- PoS

- pose

- position

- positif

- possible

- Post

- défaillances

- solide

- pratique

- préliminaire

- Préparer

- Prépare

- en train de préparer

- représentent

- cadeaux

- précédent

- prix

- établissement des prix

- la confidentialité

- procéder

- processus

- Traité

- les process

- traitement

- Profil

- instructions

- perspective

- fournir

- à condition de

- de voiture.

- fournit

- disposition

- RÉSERVES

- mettre

- Python

- question

- vite.

- R

- augmenter

- gamme

- raw

- RE

- Lire

- en cours

- solutions

- recommander

- recommandations

- réduire

- reportez-vous

- région

- Standard

- en relation

- compter

- rester

- reste

- rappeler

- enlever

- remplacement

- nécessaire

- demandes

- conditions

- ressource

- Resources

- Réagir

- réponse

- réponses

- responsables

- résultat

- Résultats

- retourner

- Retours

- réutilisable

- rigide

- robuste

- Rôle

- Itinéraire

- RANGÉE

- Courir

- pour le running

- fonctionne

- d'exécution

- s

- sagemaker

- même

- échantillon

- Épargnez

- sauvé

- dire

- évolutive

- Escaliers intérieurs

- scénario

- scénarios

- screenshots

- Sdk

- Deuxièmement

- secret

- Section

- sécurité

- sur le lien

- Sélectionner

- supérieur

- Sans serveur

- service

- Services

- Session

- set

- mise

- Paramétres

- installation

- plusieurs

- elle

- coquillage

- magasins

- devrait

- montrer

- montré

- montré

- Spectacles

- fermer

- arrêter

- étapes

- unique

- Taille

- compétences

- fente

- fentes

- petit

- Fragment

- So

- Football

- uniquement

- sur mesure

- Solutions

- quelques

- Quelqu'un

- quelque chose

- parler

- le fer de lance

- spécial

- spécialise

- groupe de neurones

- vitesse

- passer

- Stabilité

- Standard

- Commencer

- Commencez

- Région

- Déclaration

- étapes

- Étapes

- stockée

- stockage

- Stratégique

- les stratégies

- rationaliser

- structure

- Luttes

- studio

- Ces

- Avec succès

- tel

- sucre

- suggérer

- Suggère

- résumé

- RÉSUMÉ

- Appareils

- sûr

- rapidement

- combustion propre

- Système

- table

- TAG

- prend

- Tâche

- tâches

- clés

- technologique

- Technologie

- modèle

- modèles

- terminal

- tester

- texte

- Merci

- qui

- Les

- les informations

- leur

- Les

- puis

- Là.

- donc

- Ces

- l'ont

- chose

- Troisièmement

- this

- trois

- Avec

- tout au long de

- fiable

- calendrier

- à

- aujourd'hui

- aujourd'hui

- les outils

- Total

- traditionnel

- Formation

- Transformer

- Voyage

- déclencher

- difficulté

- Essai

- essayer

- deux

- type

- comprendre

- compréhension

- unités

- Téléchargement

- utilisé

- cas d'utilisation

- d'utiliser

- Utilisateur

- Usages

- en utilisant

- utilitaire

- Utilisant

- Info de contact.

- VALIDER

- validé

- validation

- Validateur

- Plus-value

- Valeurs

- variable

- divers

- varier

- vérifier

- version

- très

- via

- visuel

- Voix

- souhaitez

- veut

- était

- Façon..

- we

- web

- services Web

- WELL

- ont été

- Quoi

- quand

- qui

- tout en

- la totalité

- plus large

- sera

- fenêtre

- comprenant

- dans les

- sans

- workflow

- de travail

- vos contrats

- pourra

- écrire

- XML

- Oui

- Vous n'avez

- Votre

- vous-même

- zéphyrnet

- Zip