टिप्पणी एआई पीसी में क्या होता है और क्या नहीं, इसकी माइक्रोसॉफ्ट की परिभाषा आकार ले रही है। विंडोज़ के नवीनतम संस्करण, एक समर्पित कोपायलट कुंजी और प्रति सेकंड कम से कम 40 ट्रिलियन संचालन में सक्षम एनपीयू के साथ, आप जल्द ही अपनी मशीन पर माइक्रोसॉफ्ट कोपायलट को स्थानीय रूप से चलाने में सक्षम होंगे।

रेडमंड के आवश्यकताओं विंडोज़ पर इसके एआई मॉडल को इंटेल द्वारा आधिकारिक बना दिया गया - एआई पीसी श्रेणी के सबसे मजबूत चीयरलीडर्स में से एक - चिप दिग्गज के दौरान एआई समिट इस सप्ताह ताइपे में।

स्थानीय स्तर पर एक बड़े भाषा मॉडल (एलएलएम) को चलाने के कुछ आंतरिक लाभ हैं। अंतिम उपयोगकर्ताओं के पास कम विलंबता होनी चाहिए और इसलिए प्रतिक्रिया समय में सुधार होना चाहिए, क्योंकि सैद्धांतिक रूप से प्रश्नों को दूरस्थ डेटासेंटर से भेजने और अधिक गोपनीयता की आवश्यकता नहीं होती है। इस बीच, Microsoft के लिए, AI कार्यभार को ग्राहक उपकरणों पर स्थानांतरित करने से अन्य कार्यों के लिए उसके स्वयं के संसाधन मुक्त हो जाते हैं, जैसे कि अगले OpenAI मॉडल को प्रशिक्षित करने में मदद करना या इसे क्लाउड API के रूप में पेश करना।

माइक्रोसॉफ्ट को उम्मीद है कि वह अंततः लोगों के विंडोज एआई पीसी में अपने कोपायलट एलएलएम को पूरी तरह से एनपीयू, या न्यूरल प्रोसेसिंग यूनिट पर चलाएगा। जाहिरा तौर पर टिप्पणियाँ शिखर सम्मेलन में इंटेल के अधिकारियों द्वारा बनाया गया। हम कल्पना कर सकते हैं कि x86 गोलियथ उस लाइन को आगे बढ़ाकर हर किसी को यह विश्वास दिलाएगा कि उसका सिलिकॉन घर या कार्यालय में रेडमंड के सामान को चलाने के लिए पर्याप्त शक्तिशाली है।

हालांकि कोपायलट को एज़्योर की नाभि से खोलने का विचार कुछ लोगों के लिए आकर्षक हो सकता है, लेकिन हर कोई इसका प्रशंसक नहीं लगता है क्लिप्पी अवतार और निकट भविष्य में कम से कम कुछ मात्रा में प्रसंस्करण निश्चित रूप से क्लाउड में किया जाएगा।

इंटेल के अधिकारियों ने इतना ही कहा है: तेज़ हार्डवेयर कोपायलट के अधिक "तत्वों" को स्थानीय रूप से चलाने में सक्षम करेगा। दूसरे शब्दों में, आप अभी भी कम से कम कुछ कार्यक्षमता के लिए नेटवर्क कनेक्शन पर निर्भर रहेंगे, और बाकी एआई पीसी खुद ही संभाल लेगा।

कारण से बहुत अधिक आश्चर्य नहीं होना चाहिए। इन एआई पीसी में सीमित संसाधन हैं और कोपायलट को शक्ति देने वाला मॉडल - ओपनएआई का जीपीटी-4 - बहुत बड़ा है। हम ठीक से नहीं जानते कि Microsoft जिस संस्करण का उपयोग कर रहा है वह कितना बड़ा है, लेकिन अनुमान संपूर्ण GPT-4 मॉडल को लगभग 1.7 ट्रिलियन मापदंडों पर रखें। यहां तक कि परिमाणीकरण या मॉडल को INT4 पर चलाने पर भी, आपको लगभग 900GB मेमोरी की आवश्यकता होगी।

हम कैसे सोचते हैं कि यह काम करेगा

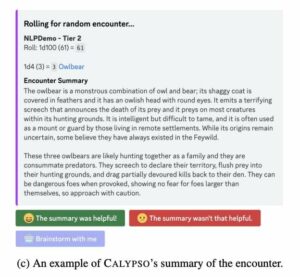

GPT-4 एक तथाकथित मिश्रण-विशेषज्ञ मॉडल है। संक्षेप में, इसका मतलब यह है कि यह वास्तव में कई छोटे, विशेष पूर्व-प्रशिक्षित मॉडलों से इकट्ठा किया गया है, जिन पर प्रश्नों को रूट किया जाता है। टेक्स्ट-जनरेशन, संक्षेपण, कोड निर्माण आदि के लिए कई मॉडलों को अनुकूलित करके, अनुमान प्रदर्शन में सुधार किया जा सकता है क्योंकि किसी कार्य को पूरा करने के लिए पूरे मॉडल को चलाने की आवश्यकता नहीं होती है।

स्थानीय स्तर पर कोपायलट सुविधाओं को चलाने का वर्णन करने के लिए इंटेल द्वारा "एलिमेंट्स" शब्द का उपयोग करने से पता चलता है कि इनमें से कुछ विशेषज्ञों को लैपटॉप हार्डवेयर पर चलने में सक्षम छोटे, तेज़ मॉडल के लिए प्रतिस्थापित किया जा सकता है। जैसा कि हमने पहले पता लगाया है, मौजूदा व्यक्तिगत हार्डवेयर मिस्ट्रल या मेटा जैसे छोटे एआई मॉडल चलाने में सक्षम है।

संयोग से, Microsoft ने हाल ही में पंप फ्रांसीसी मिनी-मॉडल बिल्डर मिस्ट्रल एआई में €15 मिलियन ($16.3 मिलियन), एज़्योर ग्राहकों के लिए अपना काम उपलब्ध कराने की योजना के साथ। आकार में केवल 7 बिलियन मापदंडों पर, मिस्ट्रल-7बी निश्चित रूप से एआई पीसी की मेमोरी में आराम से फिट होने के लिए काफी छोटा है, 4-बिट क्वांटाइजेशन का उपयोग करते समय 4 जीबी मेमोरी की आवश्यकता होती है।

और यह एक सामान्य प्रयोजन मॉडल के लिए है। संभवतः, आप स्रोत कोड जनरेशन के लिए ट्यून किए गए छोटे मॉडलों के साथ भी काम कर सकते हैं जो केवल तभी मेमोरी में लोड होते हैं जब एप्लिकेशन, मान लीजिए विजुअल स्टूडियो कोड लॉन्च होता है और एक सक्रिय जीथब कोपायलट सदस्यता का पता चलता है। याद रखें, कोपायलट सिर्फ एक चैटबॉट से कहीं अधिक है; यह एआई सुविधाओं का एक सूट है जिसे माइक्रोसॉफ्ट के ओएस और सॉफ्टवेयर लाइब्रेरी में शामिल किया जा रहा है।

रेडमंड ने यह नहीं बताया है कि उसके एआई पीसी स्पेक के लिए कितनी मेमोरी की आवश्यकता है, लेकिन, हमारे अनुभव के अनुसार स्थानीय एलएलएम, 16GB की तेज़ DDR5 पर्याप्त होनी चाहिए।

Microsoft चाहे जो भी मार्ग अपनाए, स्थानीय और दूरस्थ मॉडलों के संयोजन से कुछ दिलचस्प व्यवहार हो सकता है। हम अभी तक नहीं जानते कि ये स्थानीय मॉडल किस परिस्थिति में अपना स्थान लेंगे, लेकिन विंडोज डिवाइसेज के माइक्रोसॉफ्ट कॉर्पोरेट वीप पवन दावुलुरी ने सुझाव दिया है कि मिश्रण गतिशील हो सकता है।

उन्होंने एएमडी के एडवांसिंग एआई के दौरान मंच पर कहा, "हम उन दोनों दुनियाओं में सर्वोत्तम कंप्यूटिंग प्रदान करने के लिए क्लाउड और क्लाइंट के बीच शिफ्ट लोड करने में सक्षम होना चाहते हैं।" घटना दिसंबर में। "यह स्थानीय गणना के लाभों, बढ़ी हुई गोपनीयता और जवाबदेही और क्लाउड की शक्ति के साथ विलंबता, उच्च प्रदर्शन मॉडल, बड़े डेटा सेट, क्रॉस प्लेटफ़ॉर्म अनुमान जैसी चीज़ों को एक साथ लाता है।"

इस प्रकार, हम कुछ परिदृश्य देख सकते हैं कि Microsoft स्थानीय AI का उपयोग कैसे कर सकता है। पहला है माइक्रोसॉफ्ट सर्वर से काम को हटाना और प्रतिक्रिया समय में सुधार करना। जैसे-जैसे हार्डवेयर में सुधार होता है, अधिक कोपायलट सुविधाओं को क्लाउड से बाहर और उपयोगकर्ता उपकरणों पर भेजा जा सकता है।

दूसरा यह होगा कि इसे नेटवर्क व्यवधान की स्थिति में वापस लाया जाए। आप कल्पना कर सकते हैं कि आपका एआई पीसी नेट से कट जाने पर पूरी तरह से रुकने के बजाय सुस्त हो रहा है।

हार्डवेयर की कमी

इससे पहले कि आप ऑफ-ग्रिड घोषणापत्र तैयार करने वाले स्प्लिट-ब्रेन वाले एआई पीसी के बारे में बहुत उत्साहित हों, वर्तमान में ऐसी कोई मशीन नहीं है जो हार्डवेयर आवश्यकताओं को पूरा करती हो, और यह कोपायलट कुंजी की कमी के कारण नहीं है।

मुद्दा यह है कि x86 सिलिकॉन में एनपीयू अभी भी अपेक्षाकृत नए हैं, और जो मौजूद है वह पर्याप्त शक्तिशाली नहीं है। एएमडी 2023 की शुरुआत में अपने मोबाइल प्रोसेसर में एनपीयू जोड़ने वाले पहले लोगों में से एक था। Ryzen 7040 श्रृंखला चिप्स.

दिसंबर में हाउस ऑफ़ ज़ेन के एडवांसिंग एआई इवेंट के दौरान उस लाइनअप को एक बड़ा झटका मिला। एएमडी ने अपने लॉन्च के साथ अपने एनपीयू को डेस्कटॉप पर भी लाया 8000जी एपीयू इस साल जनवरी में सीईएस में।

इंटेल ने लॉन्च के साथ ही अपने समर्पित एआई एक्सेलेरेटर ब्लॉक को लॉन्च किया उल्का झील दिसंबर के अंत में माइक्रोप्रोसेसर पार्ट्स। इन कोर अल्ट्रा चिप्स में इंटेल की मोविडियस विज़न प्रोसेसिंग यूनिट (वीपीयू) से प्राप्त एक एनपीयू है, जो इंटेल है डेमो पिछले साल अपने इनोवेशन इवेंट के दौरान कई तरह के कार्यभार संभाले।

दुर्भाग्य से, चिप्स प्रति सेकंड केवल 10 से 16 ट्रिलियन (आमतौर पर INT4) संचालन करने में सक्षम हैं, जो माइक्रोसॉफ्ट के 40 TOPS विनिर्देश से काफी कम है। इसका मतलब है कि बाजार में अधिकांश तथाकथित एआई पीसी आवश्यकताओं को पूरा नहीं करेंगे - अंतर को पूरा करने के लिए जीपीयू पर निर्भर हुए बिना नहीं।

इंटेल और एएमडी दोनों के पास क्रमशः लूनर लेक और स्ट्रिक्स प्वाइंट सिलिकॉन के साथ आने वाले अधिक सक्षम चिप्स हैं। हालाँकि, निकट भविष्य में, ऐसा लग रहा है कि क्वालकॉम बाजार पर कब्जा करने जा रहा है।

क्वालकॉम के स्नैपड्रैगन एक्स एलीट को स्पोर्ट करने वाले नोटबुक मोबाइल प्रोसेसर 2024 के मध्य में किसी समय आने वाले हैं और इसमें 45 टॉप्स में सक्षम एनपीयू की सुविधा होगी। एफपी4.6 प्रदर्शन के 32 टेराफ्लॉप्स में सक्षम एड्रेनो जीपीयू के साथ संयुक्त, क्वालकॉम का कहना है कि यह हिस्सा पूरी तरह से डिवाइस पर 13 बिलियन पैरामीटर तक एआई मॉडल चलाने में सक्षम होगा और छोटे 30-बिलियन-पैरामीटर एलएलएम चलाने पर प्रति सेकंड 7 टोकन उत्पन्न करेगा।

जैसे-जैसे उच्च प्रदर्शन वाले एनपीयू और बड़े मेमोरी स्टोर वाले पीसी आते हैं, और छोटे मॉडल अधिक सक्षम होते जाते हैं, हमें संदेह है कि माइक्रोसॉफ्ट स्थानीय उपकरणों पर अधिक कार्यक्षमता को उतारना शुरू कर देगा - एक बार हार्डवेयर इसे संभाल लेगा। ®

- एसईओ संचालित सामग्री और पीआर वितरण। आज ही प्रवर्धित हो जाओ।

- प्लेटोडेटा.नेटवर्क वर्टिकल जेनरेटिव एआई। स्वयं को शक्तिवान बनाएं। यहां पहुंचें।

- प्लेटोआईस्ट्रीम। Web3 इंटेलिजेंस। ज्ञान प्रवर्धित। यहां पहुंचें।

- प्लेटोईएसजी. कार्बन, क्लीनटेक, ऊर्जा, पर्यावरण, सौर, कचरा प्रबंधन। यहां पहुंचें।

- प्लेटोहेल्थ। बायोटेक और क्लिनिकल परीक्षण इंटेलिजेंस। यहां पहुंचें।

- स्रोत: https://go.theregister.com/feed/www.theregister.com/2024/03/31/microsoft_copilot_hardware/

- :हैस

- :है

- :नहीं

- $यूपी

- 1

- 10

- 13

- 16

- 2023

- 30

- 40

- 7

- a

- योग्य

- About

- त्वरक

- के पार

- सक्रिय

- वास्तव में

- जोड़ना

- पर्याप्त

- आगे बढ़ने

- AI

- एआई मॉडल

- लगभग

- भी

- एएमडी

- के बीच में

- राशि

- an

- और

- कोई

- एपीआई

- आवेदन

- हैं

- चारों ओर

- AS

- इकट्ठे

- At

- आकर्षक

- उपलब्ध

- नीला

- वापस

- BE

- शुरू करना

- व्यवहार

- नीचे

- लाभ

- BEST

- के बीच

- बड़ा

- बिलियन

- ब्लॉक

- के छात्रों

- लाता है

- लाया

- निर्माता

- लेकिन

- by

- कॉल

- कर सकते हैं

- सक्षम

- मामला

- वर्ग

- निश्चित रूप से

- CES

- chatbot

- टुकड़ा

- चिप्स

- हालत

- ग्राहक

- घड़ी

- बादल

- CO

- कोड

- संयोजन

- संयुक्त

- कैसे

- अ रहे है

- पूरा

- गणना करना

- कंप्यूटिंग

- संबंध

- का गठन

- समझाने

- मूल

- हड़प

- कॉर्पोरेट

- सका

- युगल

- निर्माण

- क्रॉस

- वर्तमान में

- ग्राहक

- ग्राहक

- कट गया

- तिथि

- डेटा सेट

- डेटासेंटर

- दिसंबर

- समर्पित

- परिभाषा

- निकाली गई

- वर्णन

- डेस्कटॉप

- पता चला

- युक्ति

- डिवाइस

- अंतर

- अवरोधों

- कर देता है

- नहीं करता है

- डॉन

- किया

- दो

- दौरान

- गतिशील

- शीघ्र

- तत्व

- कुलीन

- सक्षम

- समाप्त

- समाप्त होता है

- वर्धित

- विशाल

- पर्याप्त

- संपूर्ण

- पूरी तरह से

- और भी

- कार्यक्रम

- अंत में

- हर कोई

- ठीक ठीक

- उत्तेजित

- अधिकारियों

- एक्जीक्यूटिव

- मौजूद

- मौजूदा

- अनुभव

- विशेषज्ञों

- पता लगाया

- गिरना

- प्रशंसक

- दूर

- और तेज

- Feature

- विशेषताएं

- प्रथम

- फिट

- के लिए

- निकट

- फ्रेंच

- से

- पूर्ण

- कार्यक्षमता

- भविष्य

- सामान्य जानकारी

- उत्पन्न

- पीढ़ी

- मिल

- मिल रहा

- विशाल

- GitHub

- जा

- GPU

- आगे बढ़ें

- संभालना

- हार्डवेयर

- है

- होने

- he

- मदद

- हाई

- उच्चतर

- होम

- उम्मीद है

- मकान

- कैसे

- तथापि

- HTTPS

- विचार

- कल्पना करना

- में सुधार

- उन्नत

- सुधार

- in

- अन्य में

- नवोन्मेष

- इंटेल

- दिलचस्प

- में

- आंतरिक

- प्रतिसाद नहीं

- मुद्दा

- IT

- आईटी इस

- खुद

- जनवरी

- जेपीजी

- केवल

- कुंजी

- जानना

- लेबल

- रंग

- झील

- भाषा

- लैपटॉप

- बड़ा

- बड़ा

- पिछली बार

- पिछले साल

- देर से

- विलंब

- ताज़ा

- लांच

- शुभारंभ

- नेतृत्व

- कम से कम

- पुस्तकालय

- पसंद

- को यह पसंद है

- लाइन

- पंक्ति बनायें

- ll

- एलएलएम

- भार

- स्थानीय

- स्थानीय स्तर पर

- लग रहा है

- कम

- चांद्र

- मशीन

- मशीनें

- बनाया गया

- बनाना

- बाजार

- मई..

- साधन

- तब तक

- मिलना

- याद

- मेटा

- माइक्रोसॉफ्ट

- हो सकता है

- दस लाख

- मिश्रण

- मोबाइल

- आदर्श

- मॉडल

- अधिक

- अधिकांश

- बहुत

- विभिन्न

- निकट

- लगभग

- आवश्यकता

- जाल

- नेटवर्क

- तंत्रिका

- नया

- अगला

- अभी

- संख्या

- संक्षेप

- of

- बंद

- की पेशकश

- Office

- सरकारी

- on

- एक बार

- ONE

- केवल

- पर

- OpenAI

- संचालन

- अनुकूलित

- or

- OS

- अन्य

- हमारी

- आउट

- के ऊपर

- अपना

- पैरामीटर

- भाग

- भागों

- PC

- पीसी

- स्टाफ़

- प्रति

- प्रदर्शन

- स्टाफ़

- योजनाओं

- मंच

- प्लेटो

- प्लेटो डेटा इंटेलिजेंस

- प्लेटोडाटा

- प्लस

- बिन्दु

- बिजली

- शक्तिशाली

- शक्ति

- पहले से

- एकांत

- प्रसंस्करण

- प्रोसेसर

- प्रदान करना

- उद्देश्य

- धकेल दिया

- धक्का

- रखना

- जो भी

- प्रश्नों

- बल्कि

- RE

- कारण

- प्राप्त

- हाल ही में

- अपेक्षाकृत

- याद

- दूरस्थ

- आवश्यकताएँ

- उपयुक्त संसाधन चुनें

- क्रमश

- प्रतिक्रिया

- बाकी

- लुढ़का हुआ

- मार्ग

- कराई

- रन

- दौड़ना

- s

- कहा

- कहना

- कहते हैं

- परिदृश्यों

- दूसरा

- देखना

- लगता है

- भेजा

- कई

- सर्वर

- सेट

- आकार

- पाली

- स्थानांतरण

- चाहिए

- सिलिकॉन

- के बाद से

- आकार

- छोटा

- छोटे

- अजगर का चित्र

- So

- सॉफ्टवेयर

- कुछ

- जल्दी

- स्रोत

- स्रोत कोड

- विशेषीकृत

- खेल

- ट्रेनिंग

- फिर भी

- रोक

- भंडार

- मजबूत

- स्टूडियो

- अंशदान

- ऐसा

- पता चलता है

- सूट

- शिखर सम्मेलन

- आश्चर्य

- लेना

- ले जा

- कार्य

- कार्य

- अवधि

- से

- कि

- RSI

- सिद्धांत

- वहाँ।

- इसलिये

- इन

- चीज़ें

- सोचना

- इसका

- इस सप्ताह

- इस वर्ष

- उन

- बार

- सेवा मेरे

- एक साथ

- टोकन

- भी

- सबसे ऊपर है

- रेलगाड़ी

- खरब

- देखते

- आम तौर पर

- अति

- के अंतर्गत

- इकाई

- इकाइयों

- उपयोग

- उपयोगकर्ता

- उपयोगकर्ताओं

- का उपयोग

- विविधता

- Ve

- संस्करण

- दृष्टि

- दृश्य

- था

- we

- सप्ताह

- थे

- क्या

- कब

- कौन कौन से

- क्यों

- मर्जी

- खिड़कियां

- साथ में

- बिना

- जीत लिया

- शब्द

- काम

- दुनिया की

- होगा

- X

- वर्ष

- अभी तक

- आप

- आपका

- यूट्यूब

- जेन

- जेफिरनेट