धोखाधड़ी का पता लगाना एक महत्वपूर्ण समस्या है जिसका वित्तीय सेवाओं, सोशल मीडिया, ई-कॉमर्स, गेमिंग और अन्य उद्योगों में अनुप्रयोग है। यह पोस्ट संभाव्यता की भविष्यवाणी करने के लिए रिलेशनल ग्राफ़ कनवॉल्यूशनल नेटवर्क (आरजीसीएन) मॉडल का उपयोग करके एक धोखाधड़ी का पता लगाने वाले समाधान का कार्यान्वयन प्रस्तुत करता है कि ट्रांसडक्टिव और इंडक्टिव इनफरेंस मोड दोनों के माध्यम से लेनदेन धोखाधड़ी है। आप हमारे कार्यान्वयन को एक पर तैनात कर सकते हैं अमेज़न SageMaker एक वास्तविक समय धोखाधड़ी का पता लगाने के समाधान के रूप में एंडपॉइंट, बाहरी ग्राफ स्टोरेज या ऑर्केस्ट्रेशन की आवश्यकता के बिना, जिससे मॉडल की तैनाती लागत में काफी कमी आई है।

धोखाधड़ी का पता लगाने के लिए पूरी तरह से प्रबंधित AWS AI सेवा की तलाश करने वाले व्यवसाय भी उपयोग कर सकते हैं अमेज़ॅन फ्रॉड डिटेक्टर, जिसका उपयोग आप संदिग्ध ऑनलाइन भुगतानों की पहचान करने, नए खाता धोखाधड़ी का पता लगाने, परीक्षण और लॉयल्टी कार्यक्रम के दुरुपयोग को रोकने, या खाता अधिग्रहण का पता लगाने में सुधार करने के लिए कर सकते हैं।

समाधान अवलोकन

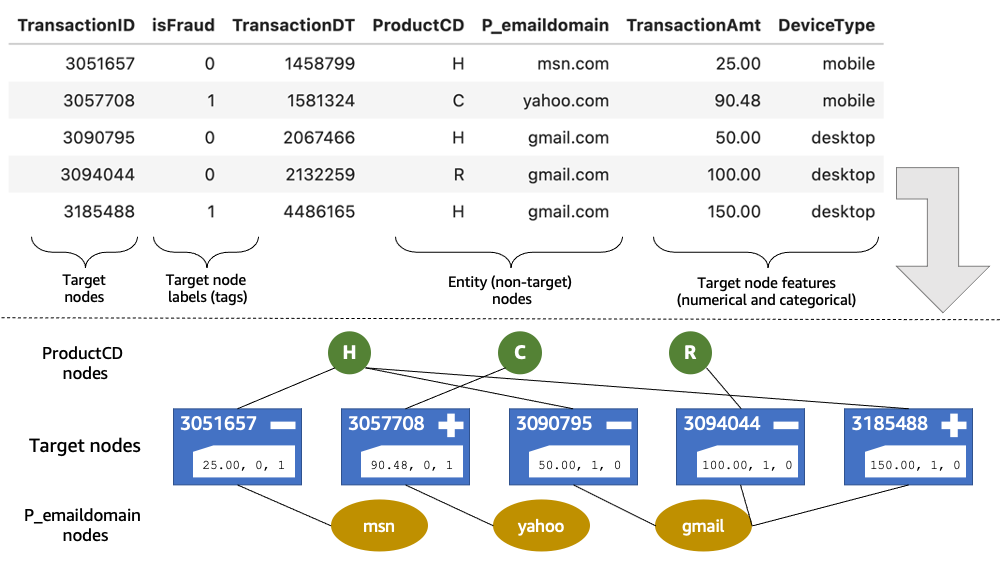

निम्नलिखित आरेख एक अनुकरणीय वित्तीय लेनदेन नेटवर्क का वर्णन करता है जिसमें विभिन्न प्रकार की जानकारी शामिल होती है। प्रत्येक लेन-देन में उपकरण पहचानकर्ता, वाई-फाई आईडी, आईपी पते, भौतिक स्थान, टेलीफोन नंबर और बहुत कुछ जैसी जानकारी शामिल होती है। हम विभिन्न प्रकार के नोड्स और किनारों वाले एक विषम ग्राफ के माध्यम से लेनदेन डेटासेट का प्रतिनिधित्व करते हैं। फिर, इस विषम ग्राफ पर धोखाधड़ी का पता लगाने की समस्या को नोड वर्गीकरण कार्य के रूप में नियंत्रित किया जाता है।

ग्राफ न्यूरल नेटवर्क्स (जीएनएन) ने धोखाधड़ी का पता लगाने की समस्याओं से निपटने में बहुत अच्छा वादा दिखाया है, बेंचमार्किंग डेटासेट पर ग्रैडिएंट-बूस्टेड डिसीजन ट्री या पूरी तरह से कनेक्टेड फीड-फॉरवर्ड नेटवर्क जैसे लोकप्रिय पर्यवेक्षित शिक्षण विधियों को बेहतर प्रदर्शन किया है। एक विशिष्ट धोखाधड़ी का पता लगाने के सेटअप में, प्रशिक्षण चरण के दौरान, GNN मॉडल को लेबल किए गए लेनदेन के एक सेट पर प्रशिक्षित किया जाता है। प्रत्येक प्रशिक्षण लेनदेन को एक बाइनरी लेबल प्रदान किया जाता है जो दर्शाता है कि यह धोखाधड़ी है। इस प्रशिक्षित मॉडल का उपयोग अनुमान चरण के दौरान बिना लेबल वाले लेन-देन के एक सेट के बीच धोखाधड़ी लेनदेन का पता लगाने के लिए किया जा सकता है। अनुमान के दो अलग-अलग तरीके मौजूद हैं: ट्रांसडक्टिव इंट्रेंस बनाम इंडक्टिव इंट्रेंस (जिस पर हम इस पोस्ट में बाद में चर्चा करेंगे)।

जीएनएन-आधारित मॉडल, जैसे आरजीसीएन, वैध लेनदेन से दुर्भावनापूर्ण लेनदेन को अलग करने वाले सार्थक प्रतिनिधित्व को सीखने के लिए ग्राफ़ संरचना और नोड्स और किनारों की विशेषताओं दोनों के संयोजन से टोपोलॉजिकल जानकारी का लाभ उठा सकते हैं। आरजीसीएन विषम ग्राफ एम्बेडिंग के माध्यम से विभिन्न प्रकार के नोड्स और किनारों (संबंधों) का प्रभावी ढंग से प्रतिनिधित्व करना सीख सकता है। पिछले आरेख में, प्रत्येक लेन-देन को लक्ष्य नोड के रूप में प्रतिरूपित किया जा रहा है, और प्रत्येक लेन-देन से जुड़ी कई संस्थाओं को गैर-लक्षित नोड प्रकार के रूप में प्रतिरूपित किया जाता है, जैसे ProductCD और P_emaildomain. लक्ष्य नोड्स में संख्यात्मक और श्रेणीबद्ध विशेषताएँ निर्दिष्ट होती हैं, जबकि अन्य नोड प्रकार फ़ीचर रहित होते हैं। आरजीसीएन मॉडल प्रत्येक गैर-लक्षित नोड प्रकार के लिए एम्बेडिंग सीखता है। लक्ष्य नोड के एम्बेडिंग के लिए, इसकी विशेषताओं और पड़ोस एम्बेडिंग का उपयोग करके इसके एम्बेडिंग की गणना करने के लिए एक कनवल्शनल ऑपरेशन का उपयोग किया जाता है। पोस्ट के बाकी हिस्सों में, हम GNN और RGCN शब्दों का परस्पर उपयोग करते हैं।

यह ध्यान देने योग्य है कि वैकल्पिक रणनीतियाँ, जैसे कि गैर-लक्षित संस्थाओं को सुविधाओं के रूप में मानना और उन्हें एक-हॉट-एन्कोडिंग करना, अक्सर इन संस्थाओं की बड़ी कार्डिनैलिटी के कारण अव्यवहार्य होगी। इसके विपरीत, उन्हें ग्राफ़ संस्थाओं के रूप में एन्कोडिंग करने से GNN मॉडल को इकाई संबंधों में निहित टोपोलॉजी का लाभ उठाने में सक्षम बनाता है। उदाहरण के लिए, ज्ञात कपटपूर्ण लेन-देन के साथ फ़ोन नंबर साझा करने वाले लेन-देन के भी कपटपूर्ण होने की संभावना अधिक होती है।

जीएनएन द्वारा नियोजित ग्राफ प्रतिनिधित्व उनके कार्यान्वयन में कुछ जटिलता पैदा करता है। यह धोखाधड़ी का पता लगाने जैसे अनुप्रयोगों के लिए विशेष रूप से सच है, जिसमें नए जोड़े गए नोड्स के साथ अनुमान के दौरान ग्राफ प्रतिनिधित्व को बढ़ाया जा सकता है जो मॉडल प्रशिक्षण के दौरान अज्ञात संस्थाओं के अनुरूप है। इस अनुमान परिदृश्य को आमतौर पर कहा जाता है आगमनात्मक मोड। इसके विपरीत, ट्रांसडक्टिव मोड एक ऐसा परिदृश्य है जो मानता है कि मॉडल प्रशिक्षण के दौरान निर्मित ग्राफ प्रतिनिधित्व अनुमान के दौरान नहीं बदलेगा। जीएनएन मॉडल का मूल्यांकन अक्सर प्रशिक्षण और परीक्षण उदाहरणों के एक संयुक्त सेट से ग्राफ प्रस्तुतियों का निर्माण करके ट्रांसडक्टिव मोड में किया जाता है, जबकि बैक-प्रचार के दौरान परीक्षण लेबल को मास्क किया जाता है। यह सुनिश्चित करता है कि ग्राफ का प्रतिनिधित्व स्थिर है, और वहां जीएनएन मॉडल को अनुमान के दौरान नए नोड्स के साथ ग्राफ का विस्तार करने के लिए संचालन के कार्यान्वयन की आवश्यकता नहीं है। दुर्भाग्य से, वास्तविक दुनिया की सेटिंग में धोखाधड़ी वाले लेनदेन का पता लगाने पर स्थिर ग्राफ़ प्रतिनिधित्व नहीं माना जा सकता है। इसलिए, उत्पादन वातावरण में धोखाधड़ी का पता लगाने के लिए GNN मॉडल को तैनात करते समय आगमनात्मक अनुमान के लिए समर्थन की आवश्यकता होती है।

इसके अलावा, वास्तविक समय में धोखाधड़ी वाले लेनदेन का पता लगाना महत्वपूर्ण है, विशेष रूप से व्यावसायिक मामलों में जहां अवैध गतिविधियों को रोकने का केवल एक मौका होता है। उदाहरण के लिए, धोखाधड़ी करने वाले उपयोगकर्ता एक खाते के साथ केवल एक बार दुर्भावनापूर्ण व्यवहार कर सकते हैं और फिर कभी उसी खाते का उपयोग नहीं कर सकते हैं। जीएनएन मॉडल पर रीयल-टाइम निष्कर्ष कार्यान्वयन के लिए अतिरिक्त जटिलता पेश करता है। वास्तविक समय के अनुमान का समर्थन करने के लिए अक्सर सबग्राफ निष्कर्षण संचालन को लागू करना आवश्यक होता है। जब ग्राफ़ प्रतिनिधित्व बड़ा होता है और पूरे ग्राफ़ पर अनुमान लगाना निषेधात्मक रूप से महंगा हो जाता है, तो अनुमान विलंबता को कम करने के लिए सबग्राफ निष्कर्षण ऑपरेशन की आवश्यकता होती है। आरजीसीएन मॉडल के साथ रीयल-टाइम आगमनात्मक अनुमान के लिए एल्गोरिदम निम्नानुसार चलता है:

- लेन-देन के एक बैच और एक प्रशिक्षित RGCN मॉडल को देखते हुए, बैच से संस्थाओं के साथ ग्राफ़ प्रतिनिधित्व का विस्तार करें।

- नए गैर-लक्ष्य नोड्स के एम्बेडिंग वैक्टर को उनके संबंधित नोड प्रकार के औसत एम्बेडिंग वेक्टर के साथ असाइन करें।

- द्वारा प्रेरित एक सबग्राफ निकालें kबैच से लक्ष्य नोड्स के आस-पड़ोस को हॉप करें।

- सबग्राफ पर अनुमान लगाएं और बैच के लक्षित नोड्स के लिए भविष्यवाणी स्कोर लौटाएं।

- नए जोड़े गए नोड्स को हटाकर ग्राफ़ प्रतिनिधित्व को साफ़ करें (यह चरण सुनिश्चित करता है कि मॉडल अनुमान के लिए स्मृति आवश्यकता स्थिर रहती है)।

इस पोस्ट का मुख्य योगदान आरजीसीएन मॉडल प्रस्तुत करना है जो वास्तविक समय आगमनात्मक अनुमान एल्गोरिथम को लागू करता है। आप हमारे आरजीसीएन कार्यान्वयन को रीयल-टाइम धोखाधड़ी पहचान समाधान के रूप में एक सैजमेकर एंडपॉइंट पर तैनात कर सकते हैं। हमारे समाधान के लिए बाहरी ग्राफ़ स्टोरेज या ऑर्केस्ट्रेशन की आवश्यकता नहीं होती है, और धोखाधड़ी का पता लगाने वाले कार्यों के लिए RGCN मॉडल की परिनियोजन लागत को महत्वपूर्ण रूप से कम कर देता है। मॉडल ट्रांसडक्टिव इन्वेंशन मोड को भी लागू करता है, जिससे हमें आगमनात्मक और ट्रांसडक्टिव मोड में मॉडल के प्रदर्शन की तुलना करने के लिए प्रयोग करने में मदद मिलती है। प्रयोगों के साथ मॉडल कोड और नोटबुक्स तक पहुँचा जा सकता है AWS उदाहरण GitHub रेपो.

यह पोस्ट पोस्ट पर बनाता है अमेज़ॅन सेजमेकर, अमेज़ॅन नेपच्यून और डीप ग्राफ लाइब्रेरी का उपयोग करके जीएनएन-आधारित रीयल-टाइम धोखाधड़ी का पता लगाने वाला समाधान बनाएं. पिछली पोस्ट में SageMaker का उपयोग करके RGCN-आधारित रीयल-टाइम धोखाधड़ी पहचान समाधान बनाया गया था, अमेज़न नेपच्यून, और डीप ग्राफ लाइब्रेरी (डीजीएल)। पूर्व समाधान ने नेप्च्यून डेटाबेस को बाहरी ग्राफ़ स्टोरेज के रूप में उपयोग किया, आवश्यक है AWS लाम्बा वास्तविक समय के अनुमान के लिए ऑर्केस्ट्रेशन के लिए, और केवल ट्रांसडक्टिव मोड में प्रयोग शामिल थे।

इस पोस्ट में पेश किया गया आरजीसीएन मॉडल केवल डीजीएल को एक निर्भरता के रूप में उपयोग करके रीयल-टाइम इंडक्टिव इन्वेंशन एल्गोरिथम के सभी संचालन को लागू करता है, और तैनाती के लिए बाहरी ग्राफ स्टोरेज या ऑर्केस्ट्रेशन की आवश्यकता नहीं होती है।

हम पहले एक बेंचमार्क डेटासेट पर ट्रांसडक्टिव और इंडक्टिव मोड में आरजीसीएन मॉडल के प्रदर्शन का मूल्यांकन करते हैं। जैसा कि अपेक्षित था, आगमनात्मक मोड में मॉडल का प्रदर्शन ट्रांसडक्टिव मोड की तुलना में थोड़ा कम है। हम हाइपरपैरामीटर के प्रभाव का भी अध्ययन करते हैं k मॉडल के प्रदर्शन पर। हाइपरपैरामीटर k रीयल-टाइम अनुमान एल्गोरिदम के चरण 3 में सबग्राफ निकालने के लिए किए गए हॉप्स की संख्या को नियंत्रित करता है। के उच्च मान k बड़े सबग्राफ उत्पन्न करेगा और उच्च विलंबता की कीमत पर बेहतर निष्कर्ष प्रदर्शन का नेतृत्व कर सकता है। इस प्रकार, हम रीयल-टाइम एप्लिकेशन के लिए आरजीसीएन मॉडल की व्यवहार्यता का मूल्यांकन करने के लिए समय प्रयोग भी करते हैं।

डेटासेट

हम उपयोग IEEE- सीआईएस धोखाधड़ी डेटासेट, वही डेटासेट जो पिछले में इस्तेमाल किया गया था पद. डेटासेट में 590,000 से अधिक लेनदेन रिकॉर्ड होते हैं जिनमें बाइनरी धोखाधड़ी लेबल ( isFraud कॉलम)। डेटा को दो तालिकाओं में विभाजित किया गया है: लेन-देन और पहचान। हालाँकि, सभी लेन-देन के रिकॉर्ड में संबंधित पहचान की जानकारी नहीं होती है। हम दो तालिकाओं में शामिल होते हैं TransactionID कॉलम, जो हमें कुल 144,233 लेनदेन रिकॉर्ड के साथ छोड़ देता है। हम लेन-देन टाइमस्टैम्प द्वारा तालिका को सॉर्ट करते हैं ( TransactionDT कॉलम) और प्रशिक्षण और परीक्षण के लिए क्रमशः 80 और 20 लेनदेन का उत्पादन करते हुए, समय के अनुसार 115,386/28,847 प्रतिशत विभाजन बनाएँ।

डेटासेट पर अधिक विवरण के लिए और डीजीएल की इनपुट आवश्यकता के अनुरूप इसे कैसे प्रारूपित करें, देखें अमेज़ॅन सैजमेकर और डीप ग्राफ़ लाइब्रेरी का उपयोग करके विषम नेटवर्क में धोखाधड़ी का पता लगाना.

ग्राफ निर्माण

हम उपयोग TransactionID स्तंभ लक्ष्य नोड्स उत्पन्न करने के लिए। हम 11 प्रकार के गैर-लक्षित नोड उत्पन्न करने के लिए निम्नलिखित कॉलम का उपयोग करते हैं:

card1पूज्य गुरुदेव के मार्गदर्शन से संपन्न कर सकते हैं -card6ProductCDaddr1औरaddr2P_emaildomainऔरR_emaildomain

हम लक्ष्य नोड्स की श्रेणीबद्ध विशेषताओं के रूप में 38 स्तंभों का उपयोग करते हैं:

M1पूज्य गुरुदेव के मार्गदर्शन से संपन्न कर सकते हैं -M9DeviceTypeऔरDeviceInfoid_12पूज्य गुरुदेव के मार्गदर्शन से संपन्न कर सकते हैं -id_38

हम लक्ष्य नोड्स की संख्यात्मक विशेषताओं के रूप में 382 स्तंभों का उपयोग करते हैं:

TransactionAmtdist1औरdist2id_01पूज्य गुरुदेव के मार्गदर्शन से संपन्न कर सकते हैं -id_11C1पूज्य गुरुदेव के मार्गदर्शन से संपन्न कर सकते हैं -C14D1पूज्य गुरुदेव के मार्गदर्शन से संपन्न कर सकते हैं -D15V1पूज्य गुरुदेव के मार्गदर्शन से संपन्न कर सकते हैं -V339

प्रशिक्षण लेनदेन से निर्मित हमारे ग्राफ में 217,935 नोड और 2,653,878 किनारे हैं।

हाइपरपैरामीटर

अन्य पैरामीटर पिछले में रिपोर्ट किए गए पैरामीटर से मेल खाने के लिए सेट किए गए हैं पद. निम्नलिखित स्निपेट आरजीसीएन मॉडल को ट्रांसडक्टिव और इंडक्टिव मोड में प्रशिक्षण दिखाता है:

आगमनात्मक बनाम ट्रांसडक्टिव मोड

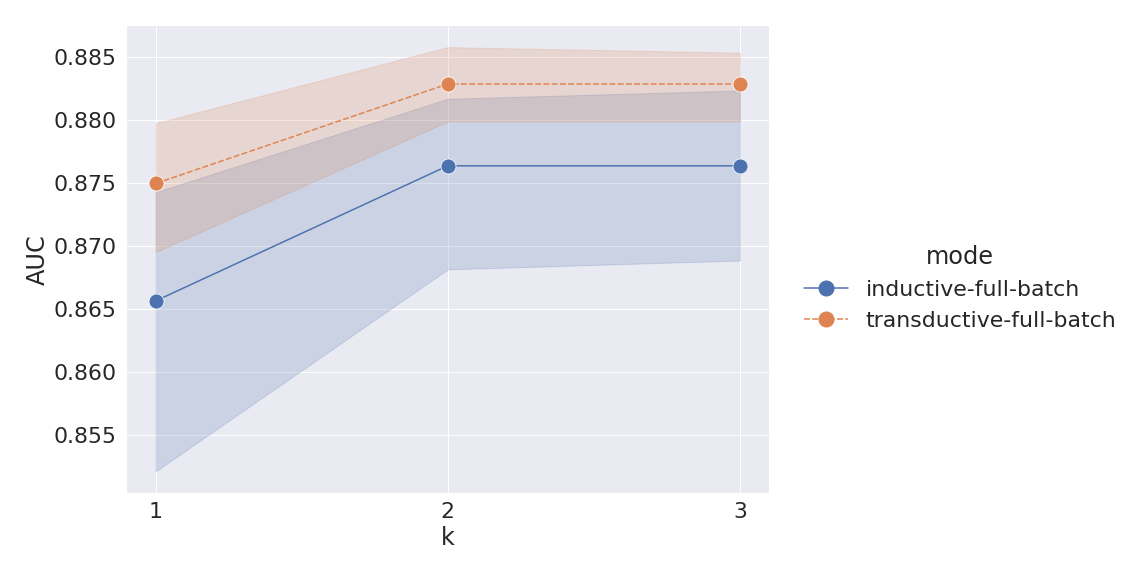

हम इंडक्टिव के लिए पांच ट्रायल और ट्रांसडक्टिव मोड के लिए पांच ट्रायल करते हैं। प्रत्येक परीक्षण के लिए, हम एक RGCN मॉडल को प्रशिक्षित करते हैं और इसे डिस्क में सहेजते हैं, 10 मॉडल प्राप्त करते हैं। हम हॉप्स की संख्या में वृद्धि करते हुए परीक्षण उदाहरणों पर प्रत्येक मॉडल का मूल्यांकन करते हैं (पैरामीटर k) अनुमान, सेटिंग के लिए एक सबग्राफ निकालने के लिए प्रयोग किया जाता है k 1, 2, और 3 तक। हम एक बार में सभी परीक्षण उदाहरणों पर भविष्यवाणी करते हैं, और प्रत्येक परीक्षण के लिए आरओसी एयूसी स्कोर की गणना करते हैं। निम्नलिखित प्लॉट AUC स्कोर के माध्य और 95% विश्वास अंतराल को दर्शाता है।

हम देख सकते हैं कि आगमनात्मक मोड की तुलना में ट्रांसडक्टिव मोड में प्रदर्शन थोड़ा अधिक है। के लिए k= 2, आगमनात्मक और ट्रांसडक्टिव मोड के लिए एयूसी स्कोर क्रमशः 0.876 और 0.883 हैं। यह अपेक्षित है क्योंकि आरजीसीएन मॉडल ट्रांसडक्टिव मोड में सभी इकाई नोड्स के एम्बेडिंग को सीखने में सक्षम है, जिसमें परीक्षण सेट भी शामिल है। इसके विपरीत, आगमनात्मक मोड केवल मॉडल को इकाई नोड्स के एम्बेडिंग को सीखने की अनुमति देता है जो प्रशिक्षण उदाहरणों में मौजूद हैं, और इसलिए कुछ नोड्स को अनुमान के दौरान माध्य भरना पड़ता है। इसी समय, ट्रांसडक्टिव और इंडक्टिव मोड के बीच प्रदर्शन में गिरावट महत्वपूर्ण नहीं है, और आगमनात्मक मोड में भी, आरजीसीएन मॉडल 0.876 के एयूसी के साथ अच्छा प्रदर्शन प्राप्त करता है। हम यह भी देखते हैं कि के मूल्यों के लिए मॉडल प्रदर्शन में सुधार नहीं होता है k> 2। इसका मतलब है कि सेटिंग k= 2 अनुमान के दौरान पर्याप्त रूप से बड़ा सबग्राफ निकालेगा, जिसके परिणामस्वरूप इष्टतम प्रदर्शन होगा। इस अवलोकन की पुष्टि हमारे अगले प्रयोग से भी होती है।

यह भी ध्यान देने योग्य है कि, ट्रांसडक्टिव मोड के लिए, हमारे मॉडल का 0.883 का एयूसी पिछले में रिपोर्ट किए गए 0.870 के संबंधित एयूसी से अधिक है। पद. हम लक्ष्य नोड्स की संख्यात्मक और श्रेणीबद्ध विशेषताओं के रूप में अधिक स्तंभों का उपयोग करते हैं, जो उच्च एयूसी स्कोर की व्याख्या कर सकते हैं। हम यह भी ध्यान देते हैं कि पिछली पोस्ट में किए गए प्रयोगों ने केवल एक ही परीक्षण किया था।

एक छोटे से बैच पर निष्कर्ष

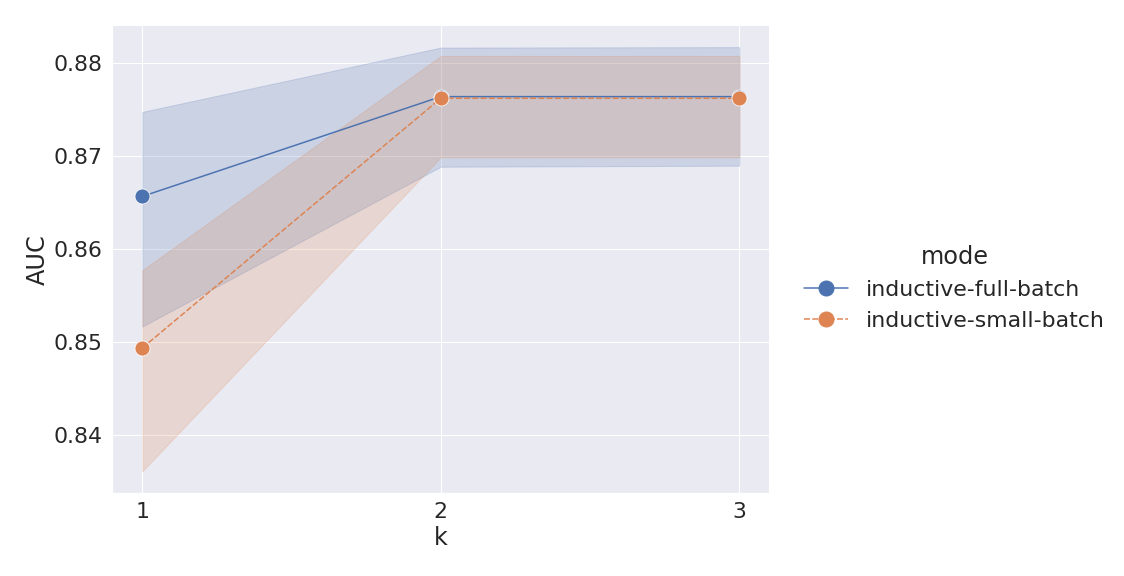

इस प्रयोग के लिए, हम RGCN मॉडल का मूल्यांकन एक छोटे बैच के अनुमान सेटिंग में करते हैं। हम पांच मॉडलों का उपयोग करते हैं जिन्हें पिछले प्रयोग में आगमनात्मक मोड में प्रशिक्षित किया गया था। हम दो सेटिंग्स में भविष्यवाणी करते समय इन मॉडलों के प्रदर्शन की तुलना करते हैं: पूर्ण और छोटे बैच अनुमान। पूर्ण बैच अनुमान के लिए, हम पूरे परीक्षण सेट पर भविष्यवाणी करते हैं, जैसा कि पिछले प्रयोग में किया गया था। छोटे बैच के अनुमान के लिए, हम प्रत्येक बैच में लगभग 28 लेनदेन के साथ समान आकार के 1,000 बैचों में परीक्षण सेट को विभाजित करके छोटे बैचों में भविष्यवाणी करते हैं। हम के विभिन्न मूल्यों का उपयोग करके दोनों सेटिंग्स के लिए एयूसी स्कोर की गणना करते हैं k. निम्नलिखित प्लॉट पूर्ण और छोटे बैच अनुमान सेटिंग्स के लिए माध्य और 95% विश्वास अंतराल दिखाता है।

हम उस प्रदर्शन को छोटे बैच के अनुमान के लिए देखते हैं जब k=1 पूरे बैच की तुलना में कम है। हालाँकि, छोटे बैच का अनुमान प्रदर्शन पूर्ण बैच से मेल खाता है जब k> 1। इसे छोटे बैचों के लिए निकाले जा रहे बहुत छोटे सबग्राफ के लिए जिम्मेदार ठहराया जा सकता है। हम प्रशिक्षण लेनदेन से निर्मित पूरे ग्राफ के आकार के साथ सबग्राफ के आकार की तुलना करके इसकी पुष्टि करते हैं। हम नोड्स की संख्या के संदर्भ में ग्राफ़ आकार की तुलना करते हैं। के लिए k= 1, छोटे बैच के अनुमान के लिए औसत सबग्राफ आकार प्रशिक्षण ग्राफ के 2% से कम है। और जब पूर्ण बैच अनुमान के लिए k=1, सबग्राफ का आकार 22% है। कब k=2, छोटे और पूर्ण बैच अनुमान के लिए सबग्राफ आकार क्रमशः 54% और 64% हैं। अंत में, दोनों अनुमान सेटिंग्स के लिए सबग्राफ आकार 100% तक पहुंच जाते हैं k=3. दूसरे शब्दों में, कब k> 1, एक छोटे बैच के लिए सबग्राफ पर्याप्त रूप से बड़ा हो जाता है, जिससे छोटे बैच का अनुमान पूरे बैच के अनुमान के समान प्रदर्शन तक पहुंच जाता है।

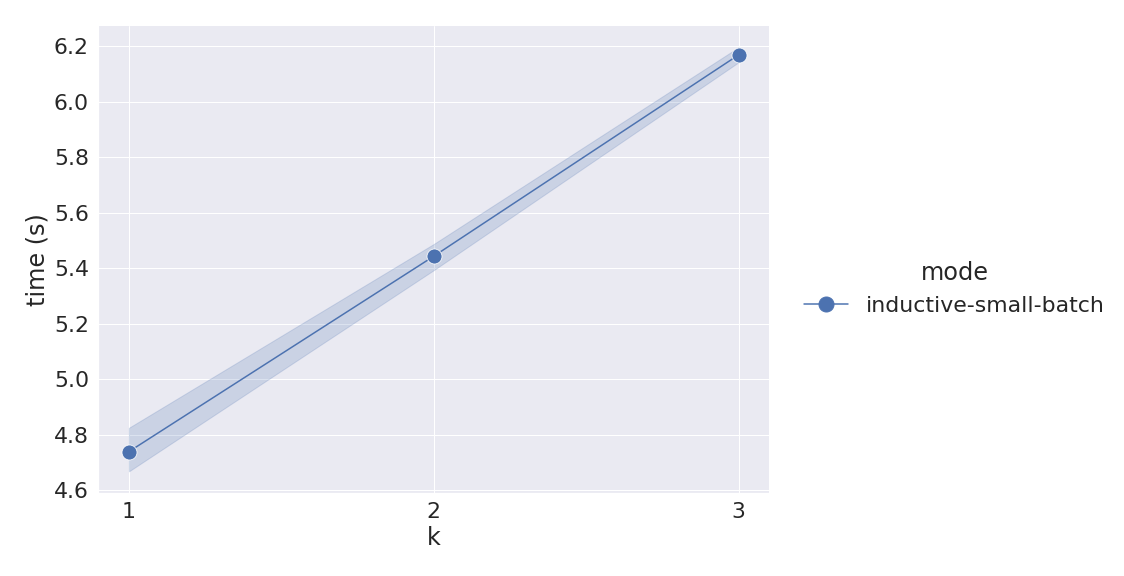

हम प्रत्येक बैच के लिए पूर्वानुमान विलंबता भी रिकॉर्ड करते हैं। हम अपने प्रयोग ml.r5.12xlarge इंस्टेंस पर करते हैं, लेकिन आप उन्हीं प्रयोगों को चलाने के लिए 64 G मेमोरी वाले छोटे इंस्टेंस का उपयोग कर सकते हैं। निम्नलिखित प्लॉट के विभिन्न मूल्यों के लिए छोटे बैच भविष्यवाणी विलंबता के माध्य और 95% विश्वास अंतराल को दर्शाता है k.

विलंबता में रीयल-टाइम आगमनात्मक अनुमान एल्गोरिथम के सभी पांच चरण शामिल हैं। हम देखते हैं कि कब k= 2, 1,030 लेनदेन पर भविष्यवाणी करने में औसतन 5.4 सेकंड लगते हैं, जिसके परिणामस्वरूप प्रति सेकंड 190 लेनदेन का प्रवाह होता है। यह पुष्टि करता है कि आरजीसीएन मॉडल कार्यान्वयन वास्तविक समय में धोखाधड़ी का पता लगाने के लिए उपयुक्त है। हम यह भी ध्यान दें कि पिछले पद उनके कार्यान्वयन के लिए कठिन विलंबता मान प्रदान नहीं किया।

निष्कर्ष

इस पोस्ट के साथ जारी आरजीसीएन मॉडल रीयल-टाइम आगमनात्मक अनुमान के लिए एल्गोरिदम लागू करता है, और बाहरी ग्राफ स्टोरेज या ऑर्केस्ट्रेशन की आवश्यकता नहीं होती है। पैरामीटर k एल्गोरिथ्म के चरण 3 में अनुमान के लिए सबग्राफ निकालने के लिए किए गए हॉप्स की संख्या निर्दिष्ट करता है, और मॉडल सटीकता और भविष्यवाणी विलंबता के बीच एक व्यापार बंद होता है। हमने इस्तेमाल किया IEEE- सीआईएस धोखाधड़ी डेटासेट हमारे प्रयोगों में, और अनुभवजन्य रूप से मान्य है कि पैरामीटर का इष्टतम मूल्य k इस डेटासेट के लिए 2 है, 0.876 का एयूसी स्कोर प्राप्त करना और प्रति 6 लेनदेन पर 1,000 सेकंड से कम की भविष्यवाणी विलंबता।

यह पोस्ट रीयल-टाइम धोखाधड़ी का पता लगाने के लिए आरजीसीएन मॉडल के प्रशिक्षण और मूल्यांकन के लिए चरण-दर-चरण प्रक्रिया प्रदान करती है। शामिल मॉडल वर्ग पूरे मॉडल जीवनचक्र के लिए विधियों को लागू करता है, जिसमें क्रमांकन और अक्रमांकन विधियाँ शामिल हैं। यह मॉडल को रीयल-टाइम धोखाधड़ी पहचान के लिए उपयोग करने में सक्षम बनाता है। आप मॉडल को PyTorch SageMaker अनुमानक के रूप में प्रशिक्षित कर सकते हैं और फिर निम्नलिखित का उपयोग करके इसे SageMaker समापन बिंदु पर तैनात कर सकते हैं नोटबुक एक टेम्पलेट के रूप में। समापन बिंदु वास्तविक समय में कच्चे लेनदेन के छोटे बैचों पर धोखाधड़ी की भविष्यवाणी करने में सक्षम है। आप भी उपयोग कर सकते हैं अमेज़ॅन सेजमेकर अनुमान अनुशंसाकर्ता अपने वर्कलोड के आधार पर निष्कर्ष समापन बिंदु के लिए सर्वोत्तम उदाहरण प्रकार और कॉन्फ़िगरेशन का चयन करने के लिए।

इस विषय और कार्यान्वयन के बारे में अधिक जानकारी के लिए, हम आपको प्रोत्साहित करते हैं कि आप स्वयं हमारी स्क्रिप्ट का अन्वेषण और परीक्षण करें। आप नोटबुक्स और संबंधित मॉडल क्लास कोड को यहाँ से एक्सेस कर सकते हैं AWS उदाहरण GitHub रेपो.

लेखक के बारे में

दिमित्री बेस्पालोव अमेज़न मशीन लर्निंग सॉल्यूशंस लैब में एक वरिष्ठ एप्लाइड साइंटिस्ट हैं, जहाँ वे विभिन्न उद्योगों में AWS ग्राहकों को उनके AI और क्लाउड अपनाने में तेजी लाने में मदद करते हैं।

दिमित्री बेस्पालोव अमेज़न मशीन लर्निंग सॉल्यूशंस लैब में एक वरिष्ठ एप्लाइड साइंटिस्ट हैं, जहाँ वे विभिन्न उद्योगों में AWS ग्राहकों को उनके AI और क्लाउड अपनाने में तेजी लाने में मदद करते हैं।

रयान ब्रांड अमेज़न मशीन लर्निंग सॉल्यूशंस लैब में एप्लाइड साइंटिस्ट हैं। उन्हें स्वास्थ्य सेवा और जीवन विज्ञान में समस्याओं के लिए मशीन लर्निंग को लागू करने का विशिष्ट अनुभव है। अपने खाली समय में उन्हें इतिहास और विज्ञान कथा पढ़ने में आनंद आता है।

रयान ब्रांड अमेज़न मशीन लर्निंग सॉल्यूशंस लैब में एप्लाइड साइंटिस्ट हैं। उन्हें स्वास्थ्य सेवा और जीवन विज्ञान में समस्याओं के लिए मशीन लर्निंग को लागू करने का विशिष्ट अनुभव है। अपने खाली समय में उन्हें इतिहास और विज्ञान कथा पढ़ने में आनंद आता है।

यंजुन क्यूई अमेज़न मशीन लर्निंग सॉल्यूशन लैब में सीनियर एप्लाइड साइंस मैनेजर हैं। वह AWS ग्राहकों को उनके AI और क्लाउड अपनाने में तेजी लाने में मदद करने के लिए मशीन लर्निंग में नवाचार करती है और लागू करती है।

यंजुन क्यूई अमेज़न मशीन लर्निंग सॉल्यूशन लैब में सीनियर एप्लाइड साइंस मैनेजर हैं। वह AWS ग्राहकों को उनके AI और क्लाउड अपनाने में तेजी लाने में मदद करने के लिए मशीन लर्निंग में नवाचार करती है और लागू करती है।

- एसईओ संचालित सामग्री और पीआर वितरण। आज ही प्रवर्धित हो जाओ।

- प्लेटोब्लॉकचैन। Web3 मेटावर्स इंटेलिजेंस। ज्ञान प्रवर्धित। यहां पहुंचें।

- स्रोत: https://aws.amazon.com/blogs/machine-learning/build-a-gnn-based-real-time-fraud-detection-solution-using-the-deep-graph-library-without-using-external-graph-storage/

- 000

- 1

- 10

- 100

- 11

- 2%

- 28

- 7

- 95% तक

- a

- योग्य

- About

- गाली

- में तेजी लाने के

- पहुँच

- पहुँचा

- लेखा

- शुद्धता

- प्राप्त

- प्राप्त करने

- के पार

- गतिविधियों

- जोड़ा

- इसके अलावा

- अतिरिक्त

- पतों

- दत्तक ग्रहण

- लाभ

- AI

- कलन विधि

- सब

- की अनुमति देता है

- वैकल्पिक

- वीरांगना

- अमेज़ॅन मशीन लर्निंग

- अमेज़न नेपच्यून

- अमेज़न SageMaker

- के बीच में

- और

- आवेदन

- अनुप्रयोगों

- लागू

- लागू

- लगभग

- ऐरे

- सौंपा

- जुड़े

- ग्रहण

- संवर्धित

- औसत

- एडब्ल्यूएस

- आधारित

- क्योंकि

- हो जाता है

- जा रहा है

- बेंचमार्क

- बेंच मार्किंग

- BEST

- बेहतर

- के बीच

- ब्रांड

- निर्माण

- बनाता है

- बनाया गया

- व्यापार

- ले जाना

- मामलों

- संयोग

- परिवर्तन

- कक्षा

- वर्गीकरण

- बादल

- बादल को गोद लेना

- कोड

- स्तंभ

- स्तंभ

- संयुक्त

- संयोजन

- तुलना

- की तुलना

- जटिलता

- गणना करना

- आचरण

- आत्मविश्वास

- विन्यास

- पुष्टि करें

- की पुष्टि

- जुड़ा हुआ

- स्थिर

- निर्माण

- निर्माण

- शामिल हैं

- इसके विपरीत

- योगदान

- नियंत्रण

- इसी

- लागत

- बनाना

- बनाता है

- महत्वपूर्ण

- ग्राहक

- तिथि

- डाटाबेस

- डेटासेट

- निर्णय

- गहरा

- चूक

- परिभाषित

- निर्भरता

- तैनात

- तैनाती

- तैनाती

- विवरण

- खोज

- युक्ति

- डीजीएलई

- डीआईडी

- विभिन्न

- चर्चा करना

- नहीं करता है

- बूंद

- दौरान

- से प्रत्येक

- ई-कॉमर्स

- प्रभाव

- प्रभावी रूप से

- सक्षम बनाता है

- समर्थकारी

- प्रोत्साहित करना

- endpoint

- सुनिश्चित

- संपूर्ण

- संस्थाओं

- सत्ता

- वातावरण

- विशेष रूप से

- मूल्यांकन करें

- मूल्यांकित

- का मूल्यांकन

- और भी

- प्रत्येक

- उदाहरण

- उदाहरण

- अपेक्षित

- महंगा

- अनुभव

- प्रयोग

- समझाना

- का पता लगाने

- विस्तार

- बाहरी

- उद्धरण

- विशेषताएं

- कल्पना

- अंत में

- वित्तीय

- वित्तीय सेवाओं

- प्रथम

- निम्नलिखित

- इस प्रकार है

- प्रारूप

- धोखा

- धोखाधड़ी का पता लगाना

- कपटपूर्ण

- मुक्त

- से

- पूर्ण

- पूरी तरह से

- जुआ

- उत्पन्न

- मिल

- GitHub

- अच्छा

- ग्राफ

- महान

- कठिन

- स्वास्थ्य सेवा

- मदद

- मदद करता है

- उच्चतर

- इतिहास

- कैसे

- How To

- तथापि

- एचटीएमएल

- HTTPS

- पहचान करना

- पहचान

- अवैध

- लागू करने के

- कार्यान्वयन

- कार्यान्वयन

- औजार

- आयात

- महत्वपूर्ण

- में सुधार

- in

- अन्य में

- शामिल

- शामिल

- सहित

- बढ़ती

- उद्योगों

- करें-

- निवेश

- उदाहरण

- शुरू की

- द्वारा प्रस्तुत

- IP

- आईपी पतों

- IT

- में शामिल होने

- कुंजी

- जानने वाला

- प्रयोगशाला

- लेबल

- लेबल

- बड़ा

- बड़ा

- विलंब

- नेतृत्व

- जानें

- सीख रहा हूँ

- पुस्तकालय

- जीवन

- जीवन विज्ञान

- जीवन चक्र

- संभावित

- भार

- स्थानों

- देख

- निष्ठा

- वफादारी कार्यक्रम

- मशीन

- यंत्र अधिगम

- प्रबंधक

- मैच

- सार्थक

- मीडिया

- याद

- तरीकों

- ML

- मोड

- आदर्श

- मॉडल

- मोड

- अधिक

- आवश्यक

- वरूण

- नेटवर्क

- नेटवर्क

- तंत्रिका जाल

- नया

- अगला

- नोड

- नोड्स

- संख्या

- संख्या

- निरीक्षण

- प्राप्त करने के

- ONE

- ऑनलाइन

- ऑनलाइन भुगतान

- आपरेशन

- संचालन

- इष्टतम

- आर्केस्ट्रा

- अन्य

- बेहतर प्रदर्शन करने

- अपना

- पांडा

- प्राचल

- पैरामीटर

- पारित कर दिया

- भुगतान

- प्रतिशतता

- निष्पादन

- प्रदर्शन

- प्रदर्शन

- चरण

- फ़ोन

- भौतिक

- प्लेटो

- प्लेटो डेटा इंटेलिजेंस

- प्लेटोडाटा

- लोकप्रिय

- पद

- भविष्यवाणी करना

- की भविष्यवाणी

- भविष्यवाणी

- वर्तमान

- प्रस्तुत

- को रोकने के

- पिछला

- पूर्व

- मुसीबत

- समस्याओं

- प्रक्रिया

- उत्पादन

- उत्पादन

- कार्यक्रम

- वादा

- प्रदान करना

- बशर्ते

- pytorch

- Qi

- कच्चा

- पहुंच

- पढ़ना

- वास्तविक

- असली दुनिया

- वास्तविक समय

- रिकॉर्ड

- अभिलेख

- को कम करने

- कम कर देता है

- को कम करने

- निर्दिष्ट

- सम्बंधित

- संबंधों

- रिश्ते

- रिहा

- हटाने

- की सूचना दी

- प्रतिनिधित्व

- प्रतिनिधित्व

- की आवश्यकता होती है

- अपेक्षित

- आवश्यकता

- कि

- बाकी

- जिसके परिणामस्वरूप

- परिणाम

- वापसी

- रन

- रयान

- sagemaker

- सेजमेकर अनुमान

- वही

- सहेजें

- परिदृश्य

- विज्ञान

- साइंस फिक्शन

- विज्ञान

- वैज्ञानिक

- लिपियों

- दूसरा

- सेकंड

- वरिष्ठ

- सेवा

- सेवाएँ

- सेट

- की स्थापना

- सेटिंग्स

- व्यवस्था

- कई

- Share

- दिखाया

- दिखाता है

- महत्वपूर्ण

- काफी

- एक

- आकार

- आकार

- छोटा

- छोटे

- So

- सोशल मीडिया

- सोशल मीडिया

- समाधान

- समाधान ढूंढे

- कुछ

- विशिष्ट

- गति

- विभाजित

- विभाजन

- कदम

- कदम

- रोक

- भंडारण

- रणनीतियों

- संरचना

- अध्ययन

- subgraph

- सबग्राफ

- ऐसा

- सूट

- उपयुक्त

- समर्थन

- संदेहजनक

- तालिका

- लेना

- अधिग्रहण

- लेता है

- लक्ष्य

- कार्य

- कार्य

- टेम्पलेट

- शर्तों

- परीक्षण

- परीक्षण

- RSI

- लेखाचित्र

- लेकिन हाल ही

- जिसके चलते

- इसलिये

- यहाँ

- THROUGHPUT

- पहर

- टाइमस्टैम्प

- समय

- सेवा मेरे

- भी

- विषय

- कुल

- रेलगाड़ी

- प्रशिक्षित

- प्रशिक्षण

- ट्रांजेक्शन

- लेनदेन

- इलाज

- पेड़

- परीक्षण

- परीक्षण

- <strong>उद्देश्य</strong>

- प्रकार

- ठेठ

- us

- उपयोग

- उपयोगकर्ताओं

- आमतौर पर

- मान्य

- मूल्य

- मान

- के माध्यम से

- कौन कौन से

- जब

- वाई फाई

- मर्जी

- बिना

- शब्द

- लायक

- होगा

- आप

- आपका

- जेफिरनेट