मशीन लर्निंग (एमएल) अनुप्रयोगों को तैनात करना जटिल है और अक्सर हाइपर-स्केल की क्षमता की आवश्यकता होती है, और इसमें अल्ट्रा-लो विलंबता आवश्यकताएं और कड़े लागत बजट होते हैं। धोखाधड़ी का पता लगाना, उत्पाद अनुशंसाएं और ट्रैफ़िक भविष्यवाणी जैसे उपयोग के मामले ऐसे उदाहरण हैं जहां मिलीसेकंड मायने रखते हैं और व्यावसायिक सफलता के लिए महत्वपूर्ण हैं। सख्त सेवा स्तर समझौतों (एसएलए) को पूरा करने की आवश्यकता है, और एक विशिष्ट अनुरोध के लिए प्रीप्रोसेसिंग, डेटा ट्रांसफॉर्मेशन, फीचर इंजीनियरिंग, मॉडल चयन तर्क, मॉडल एकत्रीकरण और पोस्टप्रोसेसिंग जैसे कई चरणों की आवश्यकता हो सकती है।

अनुकूलित लागत और गणना दक्षता के साथ बड़े पैमाने पर एमएल मॉडल तैनात करना एक कठिन और बोझिल काम हो सकता है। बाहरी डेटा स्रोतों के साथ-साथ अंतर्निहित कंप्यूट संसाधनों की सीपीयू/जीपीयू शक्ति जैसे रनटाइम वातावरण के आधार पर प्रत्येक मॉडल की अपनी खूबियां और निर्भरताएं होती हैं। किसी एकल अनुमान अनुरोध को पूरा करने के लिए किसी एप्लिकेशन को एकाधिक एमएल मॉडल की आवश्यकता हो सकती है। कुछ परिदृश्यों में, एक अनुरोध कई मॉडलों में प्रवाहित हो सकता है। कोई एक आकार-सभी के लिए फिट दृष्टिकोण नहीं है, और एमएल अभ्यासकर्ताओं के लिए आवर्ती एमएल होस्टिंग चुनौतियों का समाधान करने के लिए आजमाए हुए और सिद्ध तरीकों की तलाश करना महत्वपूर्ण है। इससे एमएल मॉडल होस्टिंग के लिए डिज़ाइन पैटर्न का विकास हुआ है।

इस पोस्ट में, हम एमएल अनुप्रयोगों के निर्माण के लिए सामान्य डिज़ाइन पैटर्न का पता लगाते हैं अमेज़न SageMaker.

एमएल अनुप्रयोगों के निर्माण के लिए डिज़ाइन पैटर्न

आइए एमएल अनुप्रयोगों को होस्ट करने के लिए उपयोग करने के लिए निम्नलिखित डिज़ाइन पैटर्न देखें।

एकल-मॉडल आधारित एमएल अनुप्रयोग

यह एक बढ़िया विकल्प है जब आपके एमएल उपयोग के मामले में अनुरोध को पूरा करने के लिए एकल मॉडल की आवश्यकता होती है। मॉडल को इनपुट ट्रैफ़िक के आधार पर स्केल करने की क्षमता के साथ एक समर्पित कंप्यूट इंफ्रास्ट्रक्चर पर तैनात किया गया है। यह विकल्प तब भी आदर्श होता है जब क्लाइंट एप्लिकेशन में कम-विलंबता (मिलीसेकंड या सेकंड के क्रम में) अनुमान की आवश्यकता होती है।

मल्टी-मॉडल आधारित एमएल अनुप्रयोग

होस्टिंग को अधिक लागत प्रभावी बनाने के लिए, यह डिज़ाइन पैटर्न आपको एक ही किरायेदार बुनियादी ढांचे पर कई मॉडल होस्ट करने की अनुमति देता है। एकाधिक एमएल मॉडल होस्ट या कंटेनर संसाधनों को साझा कर सकते हैं, जिसमें मेमोरी में सबसे अधिक उपयोग किए जाने वाले एमएल मॉडल को कैश करना शामिल है, जिसके परिणामस्वरूप मेमोरी और कंप्यूटिंग संसाधनों का बेहतर उपयोग होता है। आपके द्वारा तैनात किए जाने वाले मॉडल के प्रकार के आधार पर, मॉडल सह-होस्टिंग निम्नलिखित विधियों का उपयोग कर सकती है:

- मल्टी-मॉडल होस्टिंग - यह विकल्प आपको एक ही एंडपॉइंट पर साझा सर्विंग कंटेनर का उपयोग करके कई मॉडल होस्ट करने की अनुमति देता है। यह सुविधा तब आदर्श होती है जब आपके पास बड़ी संख्या में समान मॉडल होते हैं जिन्हें आप एक साझा सर्विंग कंटेनर के माध्यम से परोस सकते हैं और एक ही समय में सभी मॉडलों तक पहुंचने की आवश्यकता नहीं होती है।

- मल्टी-कंटेनर होस्टिंग - यह विकल्प तब आदर्श होता है जब आपके पास समान संसाधन आवश्यकताओं के साथ अलग-अलग सर्विंग स्टैक पर चलने वाले कई मॉडल होते हैं, और जब व्यक्तिगत मॉडल के पास एंडपॉइंट इंस्टेंस की पूरी क्षमता का उपयोग करने के लिए पर्याप्त ट्रैफ़िक नहीं होता है। मल्टी-कंटेनर होस्टिंग आपको कई कंटेनरों को तैनात करने की अनुमति देती है जो एक ही एंडपॉइंट पर विभिन्न मॉडल या फ्रेमवर्क का उपयोग करते हैं। मॉडल अपने स्वयं के स्वतंत्र सर्विंग स्टैक के साथ पूरी तरह से विषम हो सकते हैं।

- मॉडल पहनावा - बहुत सारे उत्पादन उपयोग के मामलों में, अक्सर कई अपस्ट्रीम मॉडल किसी दिए गए डाउनस्ट्रीम मॉडल में इनपुट फीड कर सकते हैं। यहीं पर पहनावा उपयोगी होता है। एन्सेम्बल पैटर्न में कम करने के लिए एक या अधिक बेस मॉडल से आउटपुट को मिलाना शामिल होता है सामान्यीकरण त्रुटि भविष्यवाणी का. आधार मॉडल विविध हो सकते हैं और विभिन्न एल्गोरिदम द्वारा प्रशिक्षित किए जा सकते हैं। मॉडल पहनावा एकल मॉडल से बेहतर प्रदर्शन कर सकता है क्योंकि जब पहनावा दृष्टिकोण का उपयोग किया जाता है तो मॉडल की भविष्यवाणी त्रुटि कम हो जाती है।

निम्नलिखित संयोजन पैटर्न और उनके संबंधित डिज़ाइन पैटर्न आरेखों के सामान्य उपयोग के मामले हैं:

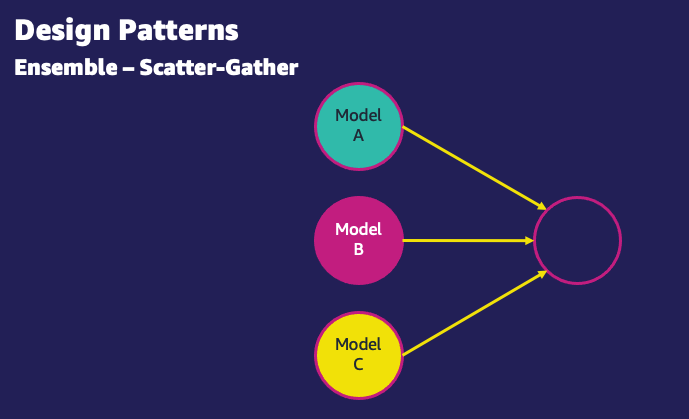

- बिखराव-इकट्ठा - स्कैटर-इकट्ठा पैटर्न में, अनुमान के लिए अनुरोध को कई मॉडलों पर भेजा जाता है। फिर एक एग्रीगेटर का उपयोग प्रतिक्रियाओं को एकत्र करने और उन्हें एकल अनुमान प्रतिक्रिया में वितरित करने के लिए किया जाता है। उदाहरण के लिए, एक छवि वर्गीकरण उपयोग मामला कार्य करने के लिए तीन अलग-अलग मॉडल का उपयोग कर सकता है। स्कैटर-इकट्ठा पैटर्न आपको तीन अलग-अलग मॉडलों पर चलने वाले अनुमानों से परिणामों को संयोजित करने और सबसे संभावित वर्गीकरण मॉडल चुनने की अनुमति देता है।

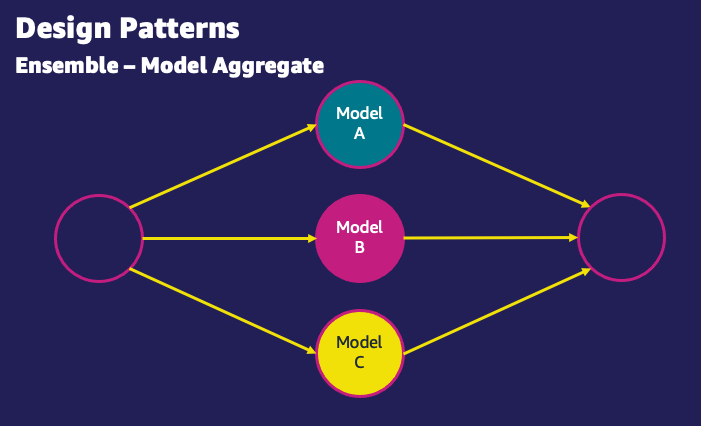

- मॉडल समुच्चय - एक एकत्रीकरण पैटर्न में, कई मॉडलों से आउटपुट औसत होते हैं। वर्गीकरण मॉडल के लिए, सबसे अधिक वोट प्राप्त करने वाले वर्ग को निर्धारित करने के लिए कई मॉडलों की भविष्यवाणियों का मूल्यांकन किया जाता है और इसे समूह का अंतिम आउटपुट माना जाता है। उदाहरण के लिए, फलों के एक सेट को संतरे या सेब के रूप में वर्गीकृत करने के लिए दो-वर्ग वर्गीकरण समस्या में, यदि दो मॉडल एक नारंगी के लिए वोट करते हैं और एक मॉडल एक सेब के लिए वोट करता है, तो कुल आउटपुट एक नारंगी होगा। एकत्रीकरण व्यक्तिगत मॉडलों में अशुद्धि से निपटने में मदद करता है और आउटपुट को अधिक सटीक बनाता है।

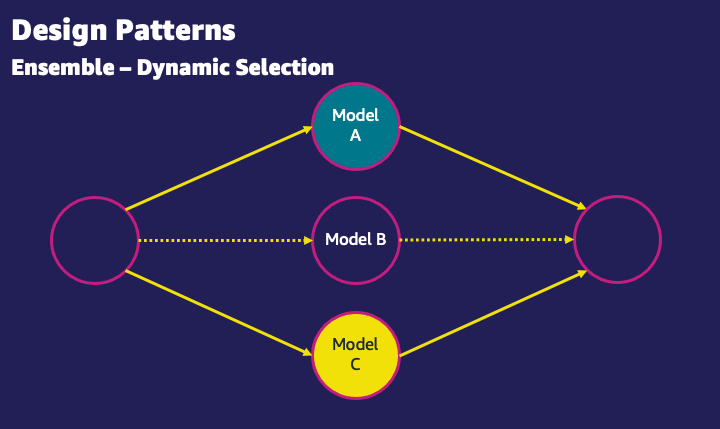

- गतिशील चयन - संयोजन मॉडल के लिए एक अन्य पैटर्न दिए गए इनपुट विशेषताओं के लिए गतिशील रूप से मॉडल चयन करना है। उदाहरण के लिए, फलों की छवियों के दिए गए इनपुट में, यदि इनपुट में एक नारंगी है, तो मॉडल ए का उपयोग किया जाएगा क्योंकि यह संतरे के लिए विशेष है। यदि इनपुट में सेब है, तो मॉडल बी का उपयोग किया जाएगा क्योंकि यह सेब के लिए विशिष्ट है।

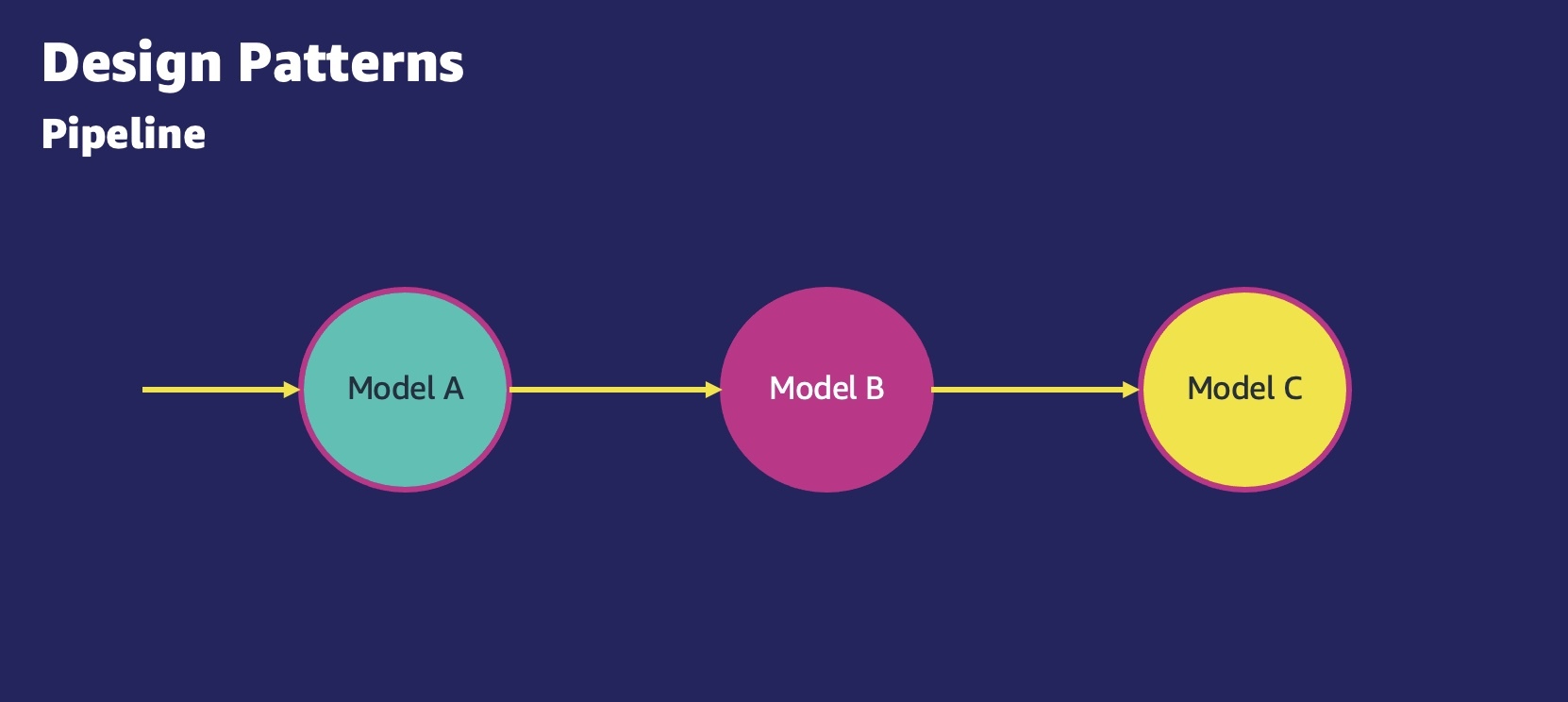

- सीरियल अनुमान एमएल अनुप्रयोग - एक क्रमिक अनुमान पैटर्न के साथ, जिसे अनुमान पाइपलाइन के रूप में भी जाना जाता है, उपयोग के मामलों में अनुमान उत्पन्न करने के लिए पूर्व-प्रशिक्षित एमएल मॉडल को लागू करने से पहले आने वाले डेटा को प्रीप्रोसेस करने की आवश्यकता होती है। इसके अतिरिक्त, कुछ मामलों में, उत्पन्न अनुमानों को आगे संसाधित करने की आवश्यकता हो सकती है, ताकि उन्हें डाउनस्ट्रीम अनुप्रयोगों द्वारा आसानी से उपभोग किया जा सके। एक अनुमान पाइपलाइन आपको भविष्यवाणियों के लिए उपयोग किए गए अनुमान अनुरोध डेटा को संसाधित करने के लिए मॉडल प्रशिक्षण के दौरान उपयोग किए गए समान प्रीप्रोसेसिंग कोड का पुन: उपयोग करने की अनुमति देती है।

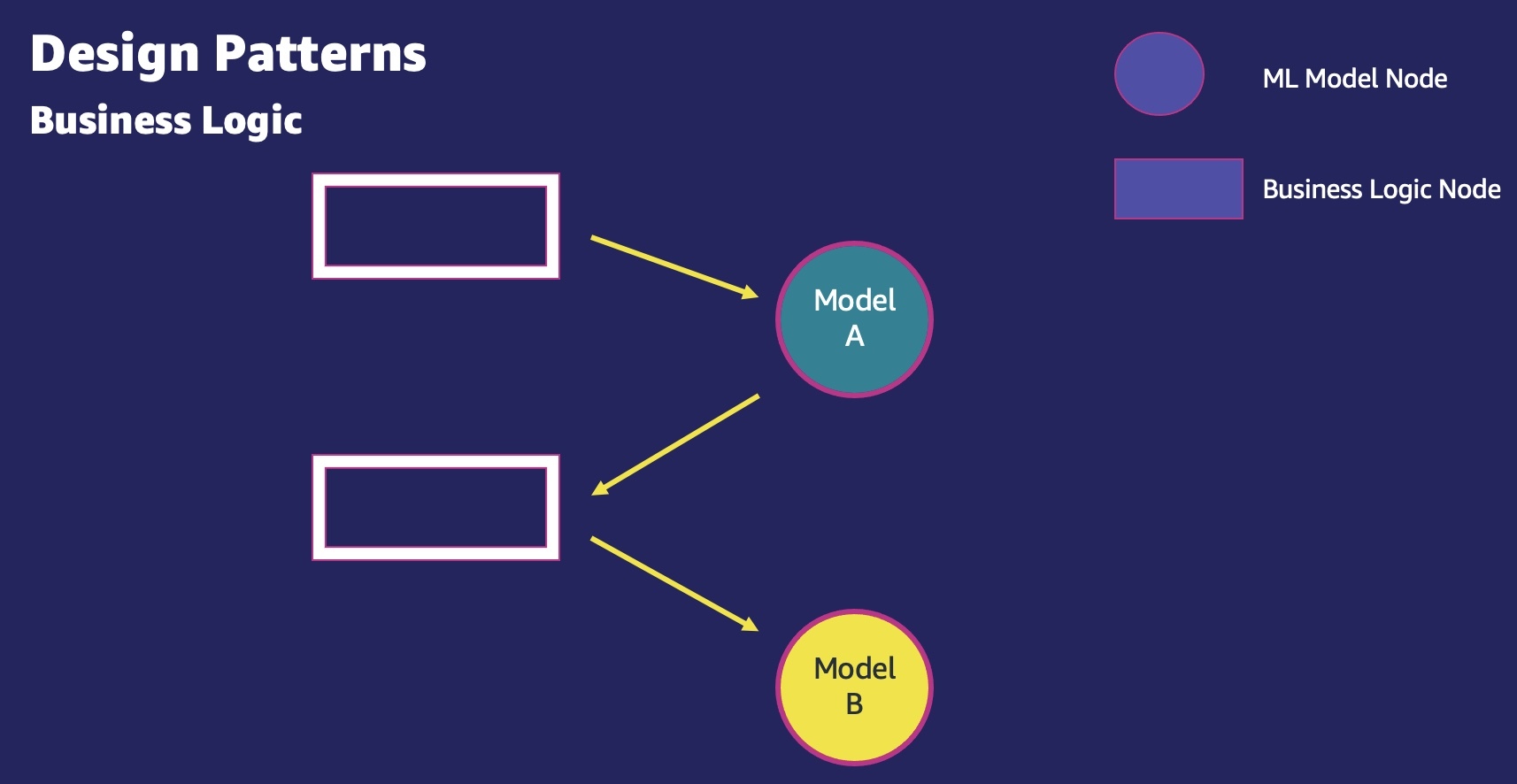

- व्यापार का तर्क - एमएल के उत्पादन में हमेशा व्यावसायिक तर्क शामिल होता है। व्यावसायिक तर्क पैटर्न में वह सब कुछ शामिल होता है जो एक एमएल कार्य करने के लिए आवश्यक होता है जो एमएल मॉडल अनुमान नहीं है। इसमें मॉडल को लोड करना शामिल है अमेज़न सरल भंडारण सेवा (अमेज़ॅन एस3), उदाहरण के लिए, इनपुट को सत्यापित करने के लिए डेटाबेस लुकअप, फीचर स्टोर से पूर्व-गणना की गई सुविधाएं प्राप्त करना, इत्यादि। इन व्यावसायिक तर्क चरणों के पूरा होने के बाद, इनपुट को एमएल मॉडल में भेज दिया जाता है।

एमएल अनुमान विकल्प

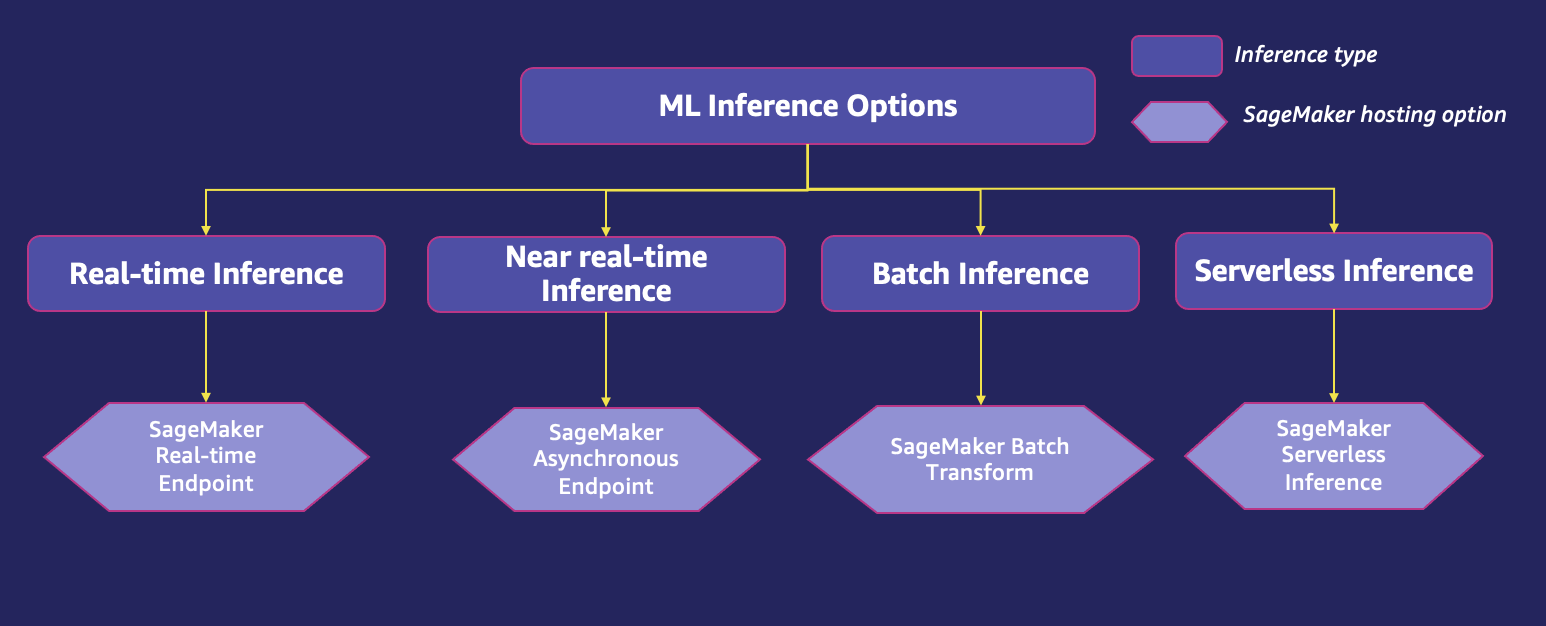

मॉडल परिनियोजन के लिए, आपके उपयोग के मामले से पीछे की ओर काम करना महत्वपूर्ण है। भविष्यवाणी की आवृत्ति क्या है? क्या आप अपने एप्लिकेशन पर लाइव ट्रैफ़िक और अपने ग्राहकों से वास्तविक समय पर प्रतिक्रिया की उम्मीद करते हैं? क्या आपके पास एक ही उपयोग के मामले में डेटा के विभिन्न उपसमूहों के लिए प्रशिक्षित कई मॉडल हैं? क्या पूर्वानुमानित ट्रैफ़िक में उतार-चढ़ाव होता है? क्या अनुमान की विलंबता एक चिंता का विषय है? इन विवरणों के आधार पर, सभी पूर्ववर्ती डिज़ाइन पैटर्न को निम्नलिखित परिनियोजन विकल्पों का उपयोग करके कार्यान्वित किया जा सकता है:

- वास्तविक समय अनुमान - वास्तविक समय अनुमान अनुमान कार्यभार के लिए आदर्श है जहां आपके पास वास्तविक समय, इंटरैक्टिव, कम विलंबता आवश्यकताएं हैं। वास्तविक समय एमएल अनुमान वर्कलोड में एकल-मॉडल आधारित एमएल एप्लिकेशन शामिल हो सकता है, जहां एक एप्लिकेशन को एकल अनुरोध को पूरा करने के लिए केवल एक एमएल मॉडल की आवश्यकता होती है, या एक बहु-मॉडल आधारित एमएल एप्लिकेशन, जहां एक एप्लिकेशन को एकल सेवा के लिए कई एमएल मॉडल की आवश्यकता होती है अनुरोध।

- निकट-वास्तविक समय (अतुल्यकालिक) अनुमान – लगभग वास्तविक समय अनुमान के साथ, आप आने वाले अनुरोधों को कतारबद्ध कर सकते हैं। इसका उपयोग सैकड़ों एमबी के इनपुट पर अनुमान चलाने के लिए किया जा सकता है। यह लगभग वास्तविक समय में संचालित होता है और उपयोगकर्ताओं को अनुमान के लिए इनपुट का उपयोग करने और S3 बकेट से समापन बिंदु से आउटपुट को पढ़ने की अनुमति देता है। यह विशेष रूप से एनएलपी और कंप्यूटर विज़न के मामलों में उपयोगी हो सकता है, जहां बड़े पेलोड होते हैं जिनके लिए लंबे समय तक प्रीप्रोसेसिंग समय की आवश्यकता होती है।

- बैच का अनुमान - बड़े डेटासेट पर ऑफ़लाइन अनुमान चलाने के लिए बैच अनुमान का उपयोग किया जा सकता है। क्योंकि यह ऑफ़लाइन चलता है, बैच अनुमान न्यूनतम विलंबता प्रदान नहीं करता है। यहां, अनुमान अनुरोध को बैच अनुमान कार्य के निर्धारित या ईवेंट-आधारित ट्रिगर के साथ संसाधित किया जाता है।

- सर्वर रहित अनुमान - सर्वर रहित अनुमान उन कार्यभारों के लिए आदर्श है जिनमें ट्रैफ़िक उछाल के बीच निष्क्रिय अवधि होती है और निष्क्रिय अवधि के बाद पहले आह्वान के लिए कुछ अतिरिक्त सेकंड की विलंबता (ठंडी शुरुआत) को सहन कर सकते हैं। उदाहरण के लिए, एक चैटबॉट सेवा या प्रपत्रों को संसाधित करने या दस्तावेज़ों से डेटा का विश्लेषण करने के लिए एक एप्लिकेशन। इस मामले में, आप एक ऑनलाइन अनुमान विकल्प चाह सकते हैं जो अनुमान अनुरोधों की मात्रा के आधार पर स्वचालित रूप से प्रावधान और गणना क्षमता को मापने में सक्षम हो। और निष्क्रिय समय के दौरान, यह गणना क्षमता को पूरी तरह से बंद करने में सक्षम होना चाहिए ताकि आपसे शुल्क न लिया जाए। सर्वर रहित अनुमान स्वचालित रूप से गणना संसाधनों को लॉन्च करके और ट्रैफ़िक के आधार पर उन्हें अंदर और बाहर स्केल करके सर्वर को चुनने और प्रबंधित करने की अपरिभाषित भारी ज़िम्मेदारी को दूर कर देता है।

सही एमएल अनुमान विकल्प का चयन करने के लिए फिटनेस फ़ंक्शन का उपयोग करें

सही होस्टिंग विकल्प पर निर्णय लेना महत्वपूर्ण है क्योंकि यह आपके एप्लिकेशन द्वारा प्रदान किए गए अंतिम-उपयोगकर्ताओं को प्रभावित करता है। इस प्रयोजन के लिए, हम की अवधारणा उधार ले रहे हैं फिटनेस कार्य, जिसे AWS पार्टनर थॉटवर्क्स के नील फोर्ड और उनके सहयोगियों ने अपने काम में गढ़ा था विकासवादी वास्तुकला का निर्माण. फिटनेस फ़ंक्शन ग्राहक के उद्देश्यों के आधार पर विभिन्न होस्टिंग विकल्पों का एक निर्देशात्मक मूल्यांकन प्रदान करते हैं। फिटनेस फ़ंक्शन आपके आर्किटेक्चर के नियोजित विकास के लिए आवश्यक डेटा प्राप्त करने में आपकी सहायता करते हैं। वे यह आकलन करने के लिए मापने योग्य मान निर्धारित करते हैं कि आपका समाधान आपके निर्धारित लक्ष्यों को प्राप्त करने के कितना करीब है। वांछित परिवर्तन प्रक्रिया का मार्गदर्शन करने के लिए वास्तुकला विकसित होने पर फिटनेस कार्यों को अनुकूलित किया जा सकता है और किया जाना चाहिए। यह आर्किटेक्ट्स को टीम की स्वायत्तता बनाए रखते हुए अपनी टीमों का मार्गदर्शन करने के लिए एक उपकरण प्रदान करता है।

जब अपने एमएल मॉडल और एप्लिकेशन को होस्ट करने के लिए सही एमएल अनुमान विकल्प का चयन करने की बात आती है तो ग्राहक पांच मुख्य फिटनेस कार्यों पर ध्यान देते हैं।

| फिटनेस कार्य | Description |

| लागत |

स्केलेबल फ्रेमवर्क पर एमएल मॉडल और एमएल एप्लिकेशन को तैनात करना और बनाए रखना एक महत्वपूर्ण व्यावसायिक प्रक्रिया है, और मॉडल होस्टिंग इंफ्रास्ट्रक्चर, होस्टिंग विकल्प, एमएल फ्रेमवर्क, एमएल मॉडल विशेषताओं, अनुकूलन, स्केलिंग नीति के बारे में किए गए विकल्पों के आधार पर लागत काफी भिन्न हो सकती है। और अधिक। यह सुनिश्चित करने के लिए कि लागत नियंत्रण में रहे, कार्यभार को हार्डवेयर बुनियादी ढांचे का इष्टतम उपयोग करना चाहिए। यह फिटनेस फ़ंक्शन विशेष रूप से बुनियादी ढांचे की लागत को संदर्भित करता है, जो स्वामित्व की कुल लागत (टीसीओ) का एक हिस्सा है। बुनियादी ढांचे की लागत भंडारण, नेटवर्क और गणना की संयुक्त लागत है। परिचालन लागत और सुरक्षा और अनुपालन लागत सहित टीसीओ के अन्य घटकों को समझना भी महत्वपूर्ण है। परिचालन लागत एमएल बुनियादी ढांचे के संचालन, निगरानी और रखरखाव की संयुक्त लागत है। परिचालन लागत की गणना प्रत्येक परिदृश्य के आधार पर आवश्यक इंजीनियरों की संख्या और एक विशिष्ट अवधि में एकत्रित इंजीनियरों के वार्षिक वेतन के आधार पर की जाती है। स्व-प्रबंधित एमएल समाधानों का उपयोग करने वाले ग्राहक अमेज़ॅन इलास्टिक कम्प्यूट क्लाउड (अमेज़ॅन ईसी 2), अमेज़ॅन इलास्टिक कंटेनर सेवा (अमेज़ॅन ईसीएस), और अमेज़ॅन इलास्टिक कुबेरनेट्स सेवा (अमेज़ॅन ईकेएस) को स्वयं परिचालन टूलींग बनाने की आवश्यकता है। सेजमेकर का उपयोग करने वाले ग्राहकों को काफी कम टीसीओ खर्च करना पड़ता है। सेजमेकर अनुमान एक पूरी तरह से प्रबंधित सेवा है और अनुमान के लिए एमएल मॉडल को तैनात करने के लिए बॉक्स से बाहर क्षमताएं प्रदान करता है। आपको इंस्टेंस का प्रावधान करने, इंस्टेंस स्वास्थ्य की निगरानी करने, सुरक्षा अपडेट या पैच प्रबंधित करने, परिचालन मेट्रिक्स उत्सर्जित करने या अपने एमएल अनुमान वर्कलोड के लिए निगरानी बनाने की आवश्यकता नहीं है। इसमें उच्च उपलब्धता और लचीलापन सुनिश्चित करने की अंतर्निहित क्षमताएं हैं। सेजमेकर आराम और पारगमन के दौरान एंड-टू-एंड एन्क्रिप्शन के साथ सुरक्षा का समर्थन करता है, जिसमें रूट वॉल्यूम का एन्क्रिप्शन भी शामिल है अमेज़न इलास्टिक ब्लॉक स्टोर (अमेज़ॅन ईबीएस) वॉल्यूम, अमेज़ॅन वर्चुअल प्राइवेट क्लाउड (अमेज़ॅन वीपीसी) समर्थन, एडब्ल्यूएस प्राइवेटलिंक, ग्राहक-प्रबंधित कुंजियाँ, AWS पहचान और अभिगम प्रबंधन (आईएएम) सुक्ष्म अभिगम नियंत्रण, AWS क्लाउडट्रिल ऑडिट, प्रशिक्षण के लिए इंटरनोड एन्क्रिप्शन, टैग-आधारित एक्सेस कंट्रोल, नेटवर्क आइसोलेशन और इंटरएक्टिव एप्लिकेशन प्रॉक्सी। ये सभी सुरक्षा सुविधाएँ सेजमेकर में बॉक्स से बाहर प्रदान की जाती हैं, और 3 साल की अवधि में व्यवसायों को दसियों विकास महीनों के इंजीनियरिंग प्रयास से बचा सकती हैं। सेजमेकर एक HIPAA-योग्य सेवा है, और PCI, SOC, GDPR और ISO के तहत प्रमाणित है। सेजमेकर FIPS एंडपॉइंट्स का भी समर्थन करता है। टीसीओ के बारे में अधिक जानकारी के लिए देखें Amazon SageMaker के स्वामित्व की कुल लागत. |

| अनुमान विलंबता | कई एमएल मॉडल और एप्लिकेशन विलंबता महत्वपूर्ण हैं, जिसमें अनुमान विलंबता सेवा स्तर के उद्देश्य द्वारा निर्दिष्ट सीमा के भीतर होनी चाहिए। अनुमान विलंबता मॉडल आकार और जटिलता, हार्डवेयर प्लेटफ़ॉर्म, सॉफ़्टवेयर वातावरण और नेटवर्क आर्किटेक्चर सहित कई कारकों पर निर्भर करती है। उदाहरण के लिए, बड़े और अधिक जटिल मॉडलों को अनुमान लगाने में अधिक समय लग सकता है। |

| थ्रूपुट (प्रति सेकंड लेनदेन) | मॉडल अनुमान के लिए, प्रदर्शन ट्यूनिंग और एमएल एप्लिकेशन के व्यावसायिक उद्देश्य को प्राप्त करने के लिए थ्रूपुट का अनुकूलन महत्वपूर्ण है। जैसा कि हम चिप डिजाइन में गणितीय संचालन के निम्न-स्तरीय कार्यान्वयन सहित एमएल के सभी पहलुओं में तेजी से आगे बढ़ना जारी रखते हैं, हार्डवेयर-विशिष्ट पुस्तकालय प्रदर्शन अनुकूलन में एक बड़ी भूमिका निभाते हैं। पेलोड आकार, नेटवर्क हॉप्स, हॉप्स की प्रकृति, मॉडल ग्राफ़ सुविधाएँ, मॉडल में ऑपरेटर और मॉडल होस्टिंग इंस्टेंसेस के सीपीयू, जीपीयू और मेमोरी प्रोफाइल जैसे विभिन्न कारक एमएल मॉडल के थ्रूपुट को प्रभावित करते हैं। |

| स्केलिंग कॉन्फ़िगरेशन जटिलता | एमएल मॉडल या एप्लिकेशन के लिए स्केलेबल फ्रेमवर्क पर चलना महत्वपूर्ण है जो अलग-अलग ट्रैफ़िक की मांग को संभाल सके। यह सीपीयू और जीपीयू संसाधनों के अधिकतम उपयोग की भी अनुमति देता है और कंप्यूट संसाधनों के अति-प्रावधान को रोकता है। |

| अपेक्षित यातायात पैटर्न | एमएल मॉडल या एप्लिकेशन में अलग-अलग ट्रैफ़िक पैटर्न हो सकते हैं, जिनमें निरंतर वास्तविक समय के लाइव ट्रैफ़िक से लेकर प्रति सेकंड हजारों अनुरोधों के आवधिक शिखर तक और बड़े डेटासेट पर दुर्लभ, अप्रत्याशित अनुरोध पैटर्न से लेकर ऑफ़लाइन बैच अनुरोध तक शामिल हैं। आपके एमएल मॉडल के लिए सही होस्टिंग विकल्प का चयन करने के लिए अपेक्षित ट्रैफ़िक पैटर्न से पीछे की ओर काम करने की अनुशंसा की जाती है। |

सेजमेकर के साथ मॉडल तैनात करना

SageMaker एक पूरी तरह से प्रबंधित AWS सेवा है जो प्रत्येक डेवलपर और डेटा वैज्ञानिक को बड़े पैमाने पर एमएल मॉडल को त्वरित रूप से बनाने, प्रशिक्षित करने और तैनात करने की क्षमता प्रदान करती है। सेजमेकर अनुमान के साथ, आप अपने एमएल मॉडल को होस्टेड एंडपॉइंट पर तैनात कर सकते हैं और अनुमान परिणाम प्राप्त कर सकते हैं। सेजमेकर आपकी कार्यभार आवश्यकताओं को पूरा करने के लिए हार्डवेयर और सुविधाओं का एक विस्तृत चयन प्रदान करता है, जिससे आप हार्डवेयर त्वरण के साथ 70 से अधिक उदाहरण प्रकारों का चयन कर सकते हैं। यदि आप सुनिश्चित नहीं हैं कि आपके कार्यभार के लिए कौन सा सबसे इष्टतम होगा, तो सेजमेकर सेजमेकर इनफेरेंस रिकमेंडर्स नामक एक नई सुविधा का उपयोग करके अनुमान उदाहरण प्रकार की सिफारिश भी प्रदान कर सकता है।

आप अपने उपयोग के मामलों को सर्वोत्तम तरीके से पूरा करने के लिए परिनियोजन विकल्प चुन सकते हैं, जैसे वास्तविक समय अनुमान, एसिंक्रोनस, बैच और यहां तक कि सर्वर रहित एंडपॉइंट भी। इसके अलावा, सेजमेकर कैनरी, जैसी विभिन्न तैनाती रणनीतियों की पेशकश करता है। नीले हरे, छाया, और मल्टी-मॉडल, मल्टी-कंटेनर एंडपॉइंट और इलास्टिक स्केलिंग के साथ लागत प्रभावी तैनाती के साथ-साथ मॉडल परिनियोजन के लिए ए/बी परीक्षण। सेजमेकर अनुमान के साथ, आप अपने एंडपॉइंट के लिए प्रदर्शन मेट्रिक्स देख सकते हैं अमेज़ॅन क्लाउडवॉच, स्वचालित रूप से समापन बिंदुओं को स्केल करें ट्रैफ़िक के आधार पर, और किसी भी उपलब्धता को खोए बिना अपने मॉडलों को उत्पादन में अपडेट करें।

सेजमेकर आपके मॉडल को तैनात करने के लिए चार विकल्प प्रदान करता है ताकि आप पूर्वानुमान लगाना शुरू कर सकें:

- वास्तविक समय अनुमान - यह मिलीसेकंड विलंबता आवश्यकताओं, 6 एमबी तक के पेलोड आकार और 60 सेकंड तक के प्रसंस्करण समय वाले वर्कलोड के लिए उपयुक्त है।

- बैच परिवर्तन - यह डेटा के बड़े बैचों पर ऑफ़लाइन भविष्यवाणियों के लिए आदर्श है जो पहले से उपलब्ध हैं।

- अतुल्यकालिक अनुमान - यह उन वर्कलोड के लिए डिज़ाइन किया गया है जिनमें उप-सेकंड विलंबता आवश्यकताएं नहीं हैं, पेलोड आकार 1 जीबी तक है, और प्रसंस्करण समय 15 मिनट तक है।

- सर्वर रहित अनुमान - सर्वर रहित अनुमान के साथ, आप अंतर्निहित बुनियादी ढांचे को कॉन्फ़िगर या प्रबंधित किए बिना अनुमान के लिए एमएल मॉडल को जल्दी से तैनात कर सकते हैं। इसके अतिरिक्त, आप केवल अनुमान अनुरोधों को संसाधित करने के लिए उपयोग की जाने वाली गणना क्षमता के लिए भुगतान करते हैं, जो रुक-रुक कर होने वाले कार्यभार के लिए आदर्श है।

निम्नलिखित आरेख आपको संबंधित फिटनेस फ़ंक्शन मूल्यांकन के साथ सेजमेकर होस्टिंग मॉडल परिनियोजन विकल्पों को समझने में मदद कर सकता है।

आइए प्रत्येक परिनियोजन विकल्प को अधिक विस्तार से देखें।

सेजमेकर में वास्तविक समय का अनुमान

यदि आपके पास निरंतर ट्रैफ़िक है और 6 एमबी तक के पेलोड आकार और 60 सेकंड तक के प्रसंस्करण समय के साथ आपके अनुरोधों के लिए कम और लगातार विलंबता की आवश्यकता है, तो सेजमेकर वास्तविक समय अनुमान की सिफारिश की जाती है। आप अपने मॉडल को सेजमेकर होस्टिंग सेवाओं पर तैनात करते हैं और एक समापन बिंदु प्राप्त करते हैं जिसका उपयोग अनुमान के लिए किया जा सकता है। ये समापन बिंदु पूरी तरह से प्रबंधित हैं और ऑटो स्केलिंग का समर्थन करते हैं। वास्तविक समय का अनुमान उन उपयोग के मामलों के लिए लोकप्रिय है जहां आप कम-विलंबता, पूर्वानुमानित ट्रैफ़िक पैटर्न के साथ समकालिक प्रतिक्रिया की उम्मीद करते हैं, जैसे उत्पादों और सेवाओं के लिए वैयक्तिकृत अनुशंसाएं या लेनदेन संबंधी धोखाधड़ी का पता लगाने के उपयोग के मामले।

आमतौर पर, एक क्लाइंट एप्लिकेशन एक तैनात मॉडल से निष्कर्ष प्राप्त करने के लिए सेजमेकर HTTPS एंडपॉइंट को अनुरोध भेजता है। आप एक मॉडल के कई वेरिएंट को एक ही सेजमेकर HTTPS एंडपॉइंट पर तैनात कर सकते हैं। यह उत्पादन में किसी मॉडल की विविधताओं के परीक्षण के लिए उपयोगी है। ऑटो स्केलिंग आपको अपने कार्यभार में परिवर्तन के जवाब में मॉडल के लिए प्रावधानित उदाहरणों की संख्या को गतिशील रूप से समायोजित करने की अनुमति देता है।

निम्नलिखित तालिका फिटनेस कार्यों के आधार पर सेजमेकर के वास्तविक समय के अनुमान के मूल्यांकन पर मार्गदर्शन प्रदान करती है।

| फिटनेस कार्य | Description |

| लागत |

वास्तविक समय के समापन बिंदु अनुमान अनुरोधों के लिए समकालिक प्रतिक्रिया प्रदान करते हैं। क्योंकि समापन बिंदु हमेशा चल रहा है और वास्तविक समय तुल्यकालिक अनुमान प्रतिक्रिया प्रदान करने के लिए उपलब्ध है, आप उदाहरण का उपयोग करने के लिए भुगतान करते हैं। जब आप कई एंडपॉइंट तैनात करते हैं तो लागत तेजी से बढ़ सकती है, खासकर यदि एंडपॉइंट अंतर्निहित उदाहरणों का पूरी तरह से उपयोग नहीं करते हैं। अपने मॉडल के लिए सही उदाहरण चुनने से यह सुनिश्चित करने में मदद मिलती है कि आपके पास अपने मॉडल के लिए सबसे कम लागत पर सबसे अधिक प्रदर्शन करने वाला उदाहरण है। संभावित न्यूनतम लागत पर स्थिर और पूर्वानुमानित प्रदर्शन बनाए रखने के लिए ट्रैफ़िक के आधार पर क्षमता को गतिशील रूप से समायोजित करने के लिए ऑटो स्केलिंग की अनुशंसा की जाती है। SageMaker Graviton2 और Graviton3-आधारित ML इंस्टेंस परिवारों तक पहुंच बढ़ाता है। एडब्ल्यूएस ग्रेविटन अमेज़ॅन EC64 पर चलने वाले आपके क्लाउड वर्कलोड के लिए सर्वोत्तम मूल्य प्रदर्शन प्रदान करने के लिए प्रोसेसर को अमेज़ॅन वेब सर्विसेज द्वारा 2-बिट आर्म नियोवर्स कोर का उपयोग करके कस्टम बनाया गया है। ग्रेविटॉन-आधारित उदाहरणों के साथ, सेजमेकर पर अपने एमएल मॉडल को तैनात करते समय आपके पास लागत और प्रदर्शन को अनुकूलित करने के लिए अधिक विकल्प होते हैं। सेजमेकर भी सपोर्ट करता है Inf1 उदाहरण, उच्च प्रदर्शन और लागत प्रभावी एमएल अनुमान प्रदान करना। 1-16 के साथ AWS इनफेरेंटिया चिप्स प्रति उदाहरण, Inf1 उदाहरण प्रदर्शन में स्केल कर सकते हैं और AWS GPU-आधारित उदाहरणों की तुलना में तीन गुना अधिक थ्रूपुट और प्रति अनुमान 50% कम लागत तक प्रदान कर सकते हैं। SageMaker में Inf1 इंस्टेंस का उपयोग करने के लिए, आप अपने प्रशिक्षित मॉडल का उपयोग करके संकलित कर सकते हैं अमेज़न SageMaker नियो और SageMaker पर संकलित मॉडल को तैनात करने के लिए Inf1 इंस्टेंसेस का चयन करें। आप भी एक्सप्लोर कर सकते हैं सेजमेकर के लिए बचत योजनाएं ऑन-डिमांड मूल्य की तुलना में 64% तक लागत बचत का लाभ उठाएं। जब आप एक एंडपॉइंट बनाते हैं, तो सेजमेकर प्रत्येक एमएल कंप्यूट इंस्टेंस में एक ईबीएस स्टोरेज वॉल्यूम जोड़ता है जो एंडपॉइंट को होस्ट करता है। स्टोरेज वॉल्यूम का आकार इंस्टेंस प्रकार पर निर्भर करता है। रीयल-टाइम एंडपॉइंट के लिए अतिरिक्त लागत में प्रावधानित भंडारण के जीबी-माह की लागत, प्लस जीबी डेटा संसाधित और जीबी डेटा एंडपॉइंट इंस्टेंस से बाहर संसाधित की लागत शामिल है। |

| अनुमान विलंबता | जब आपको मिलीसेकंड विलंबता आवश्यकताओं के साथ एक सतत समापन बिंदु की आवश्यकता होती है तो वास्तविक समय का अनुमान आदर्श होता है। यह 6 एमबी तक के पेलोड आकार और 60 सेकंड तक के प्रसंस्करण समय का समर्थन करता है। |

| प्रवाह |

अनुमान थ्रूपुट का एक आदर्श मान मॉडल, मॉडल इनपुट आकार, बैच आकार और एंडपॉइंट इंस्टेंस प्रकार जैसे कारकों पर निर्भर है। सर्वोत्तम अभ्यास के रूप में, इनपुट अनुरोधों और संसाधन उपयोग के लिए क्लाउडवॉच मेट्रिक्स की समीक्षा करें, और इष्टतम थ्रूपुट प्राप्त करने के लिए उपयुक्त इंस्टेंस प्रकार का चयन करें। एक व्यावसायिक एप्लिकेशन या तो थ्रूपुट अनुकूलित या विलंबता अनुकूलित हो सकता है। उदाहरण के लिए, डायनामिक बैचिंग वास्तविक समय अनुमान का उपयोग करके विलंबता-संवेदनशील ऐप्स के लिए थ्रूपुट को बढ़ाने में मदद कर सकती है। हालाँकि, बैच आकार की सीमाएँ हैं, जिनके बिना अनुमान विलंबता प्रभावित हो सकती है। जैसे-जैसे आप थ्रूपुट में सुधार करने के लिए बैच का आकार बढ़ाएंगे, अनुमान विलंबता बढ़ती जाएगी। इसलिए, विलंबता-संवेदनशील अनुप्रयोगों के लिए वास्तविक समय अनुमान एक आदर्श विकल्प है। सेजमेकर अतुल्यकालिक अनुमान और बैच परिवर्तन के विकल्प प्रदान करता है, जो वास्तविक समय अनुमान की तुलना में उच्च थ्रूपुट देने के लिए अनुकूलित होते हैं यदि व्यावसायिक अनुप्रयोग थोड़ी अधिक विलंबता को सहन कर सकते हैं। |

| स्केलिंग कॉन्फ़िगरेशन जटिलता |

सेजमेकर रीयल-टाइम एंडपॉइंट समर्थन ऑटो स्केलिंग अलग सोच। जब कार्यभार बढ़ता है, तो ऑटो स्केलिंग अधिक उदाहरण ऑनलाइन लाती है। जब कार्यभार कम हो जाता है, तो ऑटो स्केलिंग अनावश्यक उदाहरणों को हटा देती है, जिससे आपको अपनी गणना लागत कम करने में मदद मिलती है। ऑटो स्केलिंग के बिना, आपको अधिकतम ट्रैफ़िक या जोखिम मॉडल की अनुपलब्धता के लिए प्रावधान करना होगा। जब तक आपके मॉडल पर ट्रैफ़िक पूरे दिन स्थिर नहीं रहेगा, तब तक अतिरिक्त अप्रयुक्त क्षमता रहेगी। इससे कम उपयोग होता है और संसाधनों की बर्बादी होती है। सेजमेकर के साथ, आप अपेक्षित ट्रैफ़िक पैटर्न के आधार पर विभिन्न स्केलिंग विकल्पों को कॉन्फ़िगर कर सकते हैं। जब आप किसी विशिष्ट क्लाउडवॉच मीट्रिक के आधार पर स्केल करना चाहते हैं तो सरल स्केलिंग या लक्ष्य ट्रैकिंग स्केलिंग आदर्श है। आप एक विशिष्ट मीट्रिक चुनकर और सीमा मान सेट करके ऐसा कर सकते हैं। इस विकल्प के लिए अनुशंसित मीट्रिक औसत हैं यदि आपको उन्नत कॉन्फ़िगरेशन की आवश्यकता है, तो आप अलार्म उल्लंघन के आकार के आधार पर उदाहरणों की संख्या को गतिशील रूप से समायोजित करने के लिए एक चरण स्केलिंग नीति सेट कर सकते हैं। जब मांग एक निश्चित स्तर तक पहुंच जाती है तो यह आपको अधिक आक्रामक प्रतिक्रिया कॉन्फ़िगर करने में मदद करता है। आप एक निर्धारित स्केलिंग विकल्प का उपयोग तब कर सकते हैं जब आप जानते हैं कि मांग दिन, सप्ताह, महीने या वर्ष में एक विशेष कार्यक्रम का पालन करती है। यह आपको एक बार के शेड्यूल या आवर्ती शेड्यूल या क्रॉन अभिव्यक्तियों को प्रारंभ और समाप्ति समय के साथ निर्दिष्ट करने में मदद करता है, जो ऑटो स्केलिंग कार्रवाई शुरू होने और रुकने की सीमाएं बनाते हैं। अधिक जानकारी के लिए देखें Amazon SageMaker में ऑटोस्केलिंग इंट्रेंस एंडपॉइंट्स को कॉन्फ़िगर करना और स्वचालित स्केलिंग का उपयोग करके अमेज़ॅन सेजमेकर एंडपॉइंट को लोड परीक्षण और अनुकूलित करें. |

| यातायात का स्वरूप | निरंतर या नियमित ट्रैफ़िक पैटर्न वाले कार्यभार के लिए वास्तविक समय का अनुमान आदर्श है। |

सेजमेकर में अतुल्यकालिक अनुमान

सेजमेकर एसिंक्रोनस इंट्रेंस सेजमेकर में एक नई क्षमता है जो आने वाले अनुरोधों को कतारबद्ध करती है और उन्हें एसिंक्रोनस रूप से संसाधित करती है। यह विकल्प बड़े पेलोड आकार (1 जीबी तक), लंबे प्रसंस्करण समय (15 मिनट तक) और लगभग वास्तविक समय विलंबता आवश्यकताओं वाले अनुरोधों के लिए आदर्श है। अतुल्यकालिक अनुमान के लिए उदाहरण कार्यभार में विसंगतियों का पता लगाने के लिए इकोकार्डियोग्राम जैसे उच्च-रिज़ॉल्यूशन बायोमेडिकल छवियों या वीडियो को संसाधित करने वाली स्वास्थ्य सेवा कंपनियां शामिल हैं। इन एप्लिकेशन को दिन में अलग-अलग समय पर आने वाले ट्रैफ़िक का विस्फोट प्राप्त होता है और कम लागत पर लगभग वास्तविक समय प्रसंस्करण की आवश्यकता होती है। इन अनुरोधों के लिए प्रसंस्करण समय मिनटों के क्रम में हो सकता है, जिससे वास्तविक समय अनुमान चलाने की आवश्यकता समाप्त हो जाती है। इसके बजाय, इनपुट पेलोड को अमेज़ॅन एस 3 जैसे ऑब्जेक्ट स्टोर से स्वचालित कतार और पूर्वनिर्धारित समवर्ती सीमा के साथ अतुल्यकालिक रूप से संसाधित किया जा सकता है। प्रसंस्करण के बाद, सेजमेकर अनुमान प्रतिक्रिया को पहले लौटाए गए अमेज़ॅन एस3 स्थान पर रखता है। आप वैकल्पिक रूप से सफलता या त्रुटि सूचनाएं प्राप्त करना चुन सकते हैं अमेज़न सरल अधिसूचना सेवा (अमेज़ॅन एसएनएस)।

निम्नलिखित तालिका फिटनेस कार्यों के आधार पर सेजमेकर एसिंक्रोनस अनुमान के मूल्यांकन पर मार्गदर्शन प्रदान करती है।

| फिटनेस कार्य | Description |

| लागत | बड़े पेलोड और बर्स्ट ट्रैफ़िक वाले लागत-संवेदनशील कार्यभार के लिए अतुल्यकालिक अनुमान एक बढ़िया विकल्प है। जब प्रक्रिया के लिए कोई अनुरोध नहीं होता है तो एसिंक्रोनस अनुमान आपको इंस्टेंस गिनती को स्वचालित रूप से शून्य पर स्केल करके लागत बचाने में सक्षम बनाता है, इसलिए आप केवल तभी भुगतान करते हैं जब आपका एंडपॉइंट अनुरोध संसाधित कर रहा हो। शून्य इंस्टेंसेस होने पर प्राप्त होने वाले अनुरोधों को एंडपॉइंट स्केल बढ़ने के बाद प्रसंस्करण के लिए कतारबद्ध किया जाता है। |

| अनुमान विलंबता | अतुल्यकालिक अनुमान लगभग वास्तविक समय विलंबता आवश्यकताओं के लिए आदर्श है। अनुरोधों को एक कतार में रखा जाता है और गणना उपलब्ध होते ही संसाधित किया जाता है। इसके परिणामस्वरूप आम तौर पर दसियों मिलीसेकंड विलंबता होती है। |

| प्रवाह | अतुल्यकालिक अनुमान गैर-विलंबता संवेदनशील उपयोग के मामलों के लिए आदर्श है, क्योंकि अनुप्रयोगों को थ्रूपुट पर समझौता नहीं करना पड़ता है। ट्रैफ़िक स्पाइक्स के दौरान अनुरोध नहीं छोड़े जाते क्योंकि अतुल्यकालिक अनुमान समापन बिंदु अनुरोधों को छोड़ने के बजाय कतारबद्ध कर देता है। |

| स्केलिंग कॉन्फ़िगरेशन जटिलता |

सेजमेकर समर्थन करता है ऑटो स्केलिंग अतुल्यकालिक समापन बिंदु के लिए. वास्तविक समय में होस्ट किए गए समापन बिंदुओं के विपरीत, अतुल्यकालिक अनुमान समापन बिंदु न्यूनतम क्षमता को शून्य पर सेट करके उदाहरणों को शून्य तक स्केल करने का समर्थन करते हैं। अतुल्यकालिक समापन बिंदुओं के लिए, सेजमेकर दृढ़ता से अनुशंसा करता है कि आप एक तैनात मॉडल (वेरिएंट) के लिए लक्ष्य-ट्रैकिंग स्केलिंग के लिए एक नीति कॉन्फ़िगरेशन बनाएं। ऐसे उपयोग के मामलों के लिए जो कुछ मिनटों की कोल्ड स्टार्ट पेनल्टी को सहन कर सकते हैं, आप वैकल्पिक रूप से कोई बकाया अनुरोध न होने पर एंडपॉइंट इंस्टेंस गिनती को शून्य तक कम कर सकते हैं और नए अनुरोध आने पर स्केल को बढ़ा सकते हैं ताकि आप केवल उस अवधि के लिए भुगतान करें। एंडपॉइंट सक्रिय रूप से अनुरोधों को संसाधित कर रहे हैं। |

| यातायात का स्वरूप | एसिंक्रोनस एंडपॉइंट आने वाले अनुरोधों को कतारबद्ध करते हैं और उन्हें एसिंक्रोनस रूप से संसाधित करते हैं। वे रुक-रुक कर या कम ट्रैफ़िक पैटर्न के लिए एक अच्छा विकल्प हैं। |

सेजमेकर में बैच अनुमान

सेजमेकर बैच ट्रांसफ़ॉर्म डेटा के बड़े बैचों पर ऑफ़लाइन भविष्यवाणियों के लिए आदर्श है जो पहले से उपलब्ध हैं। बैच ट्रांसफ़ॉर्म सुविधा डेटा को बदलने और अनुमान उत्पन्न करने के लिए एक उच्च-प्रदर्शन और उच्च-थ्रूपुट विधि है। यह उन परिदृश्यों के लिए आदर्श है जहां आप डेटा के बड़े बैच के साथ काम कर रहे हैं, उपसेकंड विलंबता की आवश्यकता नहीं है, या प्रशिक्षण डेटा को प्रीप्रोसेस और ट्रांसफॉर्म करने की आवश्यकता नहीं है। विज्ञापन और विपणन या स्वास्थ्य देखभाल जैसे कुछ डोमेन में ग्राहकों को अक्सर हाइपरस्केल डेटासेट पर ऑफ़लाइन भविष्यवाणियां करने की आवश्यकता होती है जहां उच्च थ्रूपुट अक्सर उपयोग के मामले का उद्देश्य होता है और विलंबता चिंता का विषय नहीं होती है।

जब एक बैच ट्रांसफ़ॉर्म कार्य शुरू होता है, तो सेजमेकर गणना उदाहरणों को आरंभ करता है और उनके बीच अनुमान कार्यभार वितरित करता है। यह कार्य पूरा होने पर संसाधन जारी करता है, इसलिए आप केवल उसी के लिए भुगतान करते हैं जिसका उपयोग आपके कार्य के दौरान किया गया था। जब कार्य पूरा हो जाता है, तो सेजमेकर आपके द्वारा निर्दिष्ट S3 बकेट में भविष्यवाणी परिणामों को सहेजता है। बैच अनुमान कार्य आमतौर पर क्षैतिज स्केलिंग के लिए अच्छे उम्मीदवार होते हैं। क्लस्टर के भीतर प्रत्येक कार्यकर्ता अन्य श्रमिकों के साथ जानकारी के आदान-प्रदान की आवश्यकता के बिना डेटा के एक अलग उपसमूह पर काम कर सकता है। AWS कई स्टोरेज और कंप्यूट विकल्प प्रदान करता है जो क्षैतिज स्केलिंग को सक्षम बनाता है। सेजमेकर बैच ट्रांसफ़ॉर्म के उदाहरण वर्कलोड में ऑफ़लाइन एप्लिकेशन शामिल हैं जैसे ग्राहक मंथन की भविष्यवाणी के लिए बैंकिंग एप्लिकेशन जहां ऑफ़लाइन कार्य को समय-समय पर चलाने के लिए निर्धारित किया जा सकता है।

निम्नलिखित तालिका फिटनेस कार्यों के आधार पर सेजमेकर बैच परिवर्तन के मूल्यांकन पर मार्गदर्शन प्रदान करती है।

| फिटनेस कार्य | Description |

| लागत | सेजमेकर बैच ट्रांसफॉर्म आपको बड़े या छोटे बैच डेटासेट पर भविष्यवाणियां चलाने की अनुमति देता है। उपयोग की अवधि के आधार पर, आपके द्वारा चुने गए इंस्टेंस प्रकार के लिए आपसे शुल्क लिया जाता है। सेजमेकर कार्य की शुरुआत में संसाधनों के प्रावधान का प्रबंधन करता है और कार्य पूरा होने पर उन्हें जारी करता है। कोई अतिरिक्त डेटा प्रोसेसिंग लागत नहीं है. |

| अनुमान विलंबता | आप ईवेंट-आधारित या निर्धारित आमंत्रण का उपयोग कर सकते हैं। विलंबता अनुमान डेटा के आकार, कार्य समवर्तीता, मॉडल की जटिलता और गणना उदाहरण क्षमता के आधार पर भिन्न हो सकती है। |

| प्रवाह |

बैच ट्रांसफ़ॉर्म कार्य विभिन्न प्रकार के डेटासेट पर किए जा सकते हैं, डेटा के पेटाबाइट से लेकर बहुत छोटे डेटासेट तक। बड़े डेटासेट को डेटा के छोटे टुकड़ों में बदलने की कोई आवश्यकता नहीं है। जैसे पैरामीटर के लिए इष्टतम मानों का उपयोग करके आप बैच ट्रांसफ़ॉर्म नौकरियों को तेज़ कर सकते हैं मैक्सपेलोडइनएमबी, मैक्सकंकरंटट्रांसफॉर्मया, बैचरणनीति. के लिए आदर्श मूल्य बैच प्रोसेसिंग थ्रूपुट को बढ़ा सकती है और आपके संसाधनों को अनुकूलित कर सकती है क्योंकि यह विलंबता की कीमत पर एक निश्चित समय में बड़ी संख्या में अनुमानों को पूरा करने में मदद करती है। उच्च थ्रूपुट के लिए मॉडल परिनियोजन को अनुकूलित करने के लिए, सामान्य दिशानिर्देश बैच आकार को तब तक बढ़ाना है जब तक कि थ्रूपुट कम न हो जाए। |

| स्केलिंग कॉन्फ़िगरेशन जटिलता | सेजमेकर बैच ट्रांसफॉर्म का उपयोग ऑफ़लाइन अनुमान के लिए किया जाता है जो विलंबता संवेदनशील नहीं है। |

| यातायात का स्वरूप | ऑफ़लाइन अनुमान के लिए, एक इवेंट-आधारित ट्रिगर का उपयोग करके एक बैच ट्रांसफ़ॉर्म कार्य निर्धारित किया जाता है या शुरू किया जाता है। |

सेजमेकर में सर्वर रहित अनुमान

सेजमेकर सर्वर रहित अनुमान आपको अंतर्निहित बुनियादी ढांचे को कॉन्फ़िगर या प्रबंधित किए बिना अनुमान के लिए एमएल मॉडल तैनात करने की अनुमति देता है। आपके मॉडल को प्राप्त होने वाले अनुमान अनुरोधों की मात्रा के आधार पर, सेजमेकर सर्वर रहित अनुमान स्वचालित रूप से गणना क्षमता का प्रावधान, माप और बंद कर देता है। परिणामस्वरूप, आप केवल अपने अनुमान कोड को चलाने के लिए गणना समय और संसाधित डेटा की मात्रा के लिए भुगतान करते हैं, निष्क्रिय समय के लिए नहीं। आप अपने मॉडल को सर्वर रहित अनुमान समापन बिंदु पर तैनात करने के लिए सेजमेकर के अंतर्निहित एल्गोरिदम और एमएल फ्रेमवर्क-सर्विंग कंटेनर का उपयोग कर सकते हैं या अपना खुद का कंटेनर लाने का विकल्प चुन सकते हैं। यदि ट्रैफ़िक पूर्वानुमानित और स्थिर हो जाता है, तो आप अपनी कंटेनर छवि में परिवर्तन करने की आवश्यकता के बिना सर्वर रहित अनुमान समापन बिंदु से सेजमेकर वास्तविक समय समापन बिंदु पर आसानी से अपडेट कर सकते हैं। सर्वर रहित अनुमान के साथ, आप अन्य सेजमेकर सुविधाओं से भी लाभान्वित होते हैं, जिसमें अंतर्निहित मेट्रिक्स जैसे कि इनवोकेशन काउंट, दोष, विलंबता, होस्ट मेट्रिक्स और क्लाउडवॉच में त्रुटियां शामिल हैं।

निम्नलिखित तालिका फिटनेस कार्यों के आधार पर सेजमेकर सर्वर रहित अनुमान के मूल्यांकन पर मार्गदर्शन प्रदान करती है।

| फिटनेस कार्य | Description |

| लागत | यदि आपके पास अनियमित या रुक-रुक कर आने वाला ट्रैफ़िक पैटर्न है, तो भुगतान-जैसा-चलाने वाले मॉडल के साथ, सर्वर रहित अनुमान एक लागत प्रभावी विकल्प है। आप केवल उस अवधि के लिए भुगतान करते हैं जिसके लिए एंडपॉइंट अनुरोध को संसाधित करता है, और इसलिए यदि ट्रैफ़िक पैटर्न रुक-रुक कर होता है तो आप लागत बचा सकते हैं। |

| अनुमान विलंबता |

सर्वर रहित एंडपॉइंट कम अनुमान विलंबता (मिलीसेकंड से सेकंड के क्रम में) प्रदान करते हैं, उपयोग पैटर्न के आधार पर सेकंड के भीतर दसियों से हजारों अनुमानों को तुरंत स्केल करने की क्षमता के साथ, यह रुक-रुक कर या अप्रत्याशित ट्रैफ़िक वाले एमएल अनुप्रयोगों के लिए आदर्श बनाता है। क्योंकि सर्वर रहित एंडपॉइंट मांग पर संसाधनों की गणना करने का प्रावधान करते हैं, आपके एंडपॉइंट को निष्क्रिय अवधि के बाद पहले आह्वान के लिए कुछ अतिरिक्त सेकंड की विलंबता (कोल्ड स्टार्ट) का अनुभव हो सकता है। कोल्ड स्टार्ट का समय आपके मॉडल के आकार, आपके मॉडल को डाउनलोड करने में कितना समय लगता है और आपके कंटेनर के स्टार्टअप समय पर निर्भर करता है। |

| प्रवाह | अपने सर्वर रहित एंडपॉइंट को कॉन्फ़िगर करते समय, आप मेमोरी आकार और समवर्ती इनवोकेशन की अधिकतम संख्या निर्दिष्ट कर सकते हैं। सेजमेकर सर्वर रहित अनुमान आपके द्वारा चुनी गई मेमोरी के अनुपात में संसाधनों की गणना स्वचालित रूप से करता है। यदि आप बड़ा मेमोरी आकार चुनते हैं, तो आपके कंटेनर के पास अधिक वीसीपीयू तक पहुंच है। एक सामान्य नियम के रूप में, मेमोरी का आकार कम से कम आपके मॉडल के आकार जितना बड़ा होना चाहिए। आप जो मेमोरी साइज़ चुन सकते हैं वे हैं 1024 एमबी, 2048 एमबी, 3072 एमबी, 4096 एमबी, 5120 एमबी और 6144 एमबी। आपके द्वारा चुने गए मेमोरी आकार के बावजूद, सर्वर रहित एंडपॉइंट में 5 जीबी अल्पकालिक डिस्क स्टोरेज उपलब्ध है। |

| स्केलिंग कॉन्फ़िगरेशन जटिलता | सर्वर रहित एंडपॉइंट स्वचालित रूप से गणना संसाधनों को लॉन्च करते हैं और ट्रैफ़िक के आधार पर उन्हें अंदर और बाहर स्केल करते हैं, जिससे इंस्टेंस प्रकार चुनने या स्केलिंग नीतियों को प्रबंधित करने की आवश्यकता समाप्त हो जाती है। इससे सर्वरों को चुनने और प्रबंधित करने का बोझ कम हो जाता है। |

| यातायात का स्वरूप | कम या रुक-रुक कर आने वाले ट्रैफ़िक पैटर्न वाले कार्यभार के लिए सर्वर रहित अनुमान आदर्श है। |

सेजमेकर में मॉडल होस्टिंग डिज़ाइन पैटर्न

सेजमेकर अनुमान समापन बिंदु एमएल मॉडल की मेजबानी के लिए डॉकर कंटेनर का उपयोग करते हैं। कंटेनर आपको सॉफ़्टवेयर को मानकीकृत इकाइयों में पैकेज करने की अनुमति देते हैं जो डॉकर का समर्थन करने वाले किसी भी प्लेटफ़ॉर्म पर लगातार चलते हैं। यह सभी प्लेटफार्मों पर पोर्टेबिलिटी, अपरिवर्तनीय बुनियादी ढांचे की तैनाती और आसान परिवर्तन प्रबंधन और सीआई/सीडी कार्यान्वयन सुनिश्चित करता है। सेजमेकर Apache MXNet, TensorFlow, PyTorch, Sklearn और Hugging Face जैसे लोकप्रिय फ्रेमवर्क के लिए पूर्व-निर्मित प्रबंधित कंटेनर प्रदान करता है। उपलब्ध सेजमेकर कंटेनर छवियों की पूरी सूची के लिए, देखें उपलब्ध डीप लर्निंग कंटेनर इमेज. यदि सेजमेकर के पास समर्थित कंटेनर नहीं है, तो आप अपना खुद का कंटेनर (बीवाईओसी) भी बना सकते हैं और अपने मॉडल के लिए आवश्यक निर्भरताएं स्थापित करते हुए अपनी खुद की कस्टम छवि बना सकते हैं।

सेजमेकर पर एक मॉडल को तैनात करने के लिए, आपको कंटेनर को होस्ट करने के लिए एक कंटेनर (सेजमेकर प्रबंधित फ्रेमवर्क कंटेनर या बीवाईओसी) और एक कंप्यूट इंस्टेंस की आवश्यकता होती है। सेजमेकर सामान्य एमएल मॉडल होस्टिंग डिज़ाइन पैटर्न के लिए कई उन्नत विकल्पों का समर्थन करता है जहां मॉडल को एक कंटेनर पर होस्ट किया जा सकता है या एक साझा कंटेनर पर सह-होस्ट किया जा सकता है।

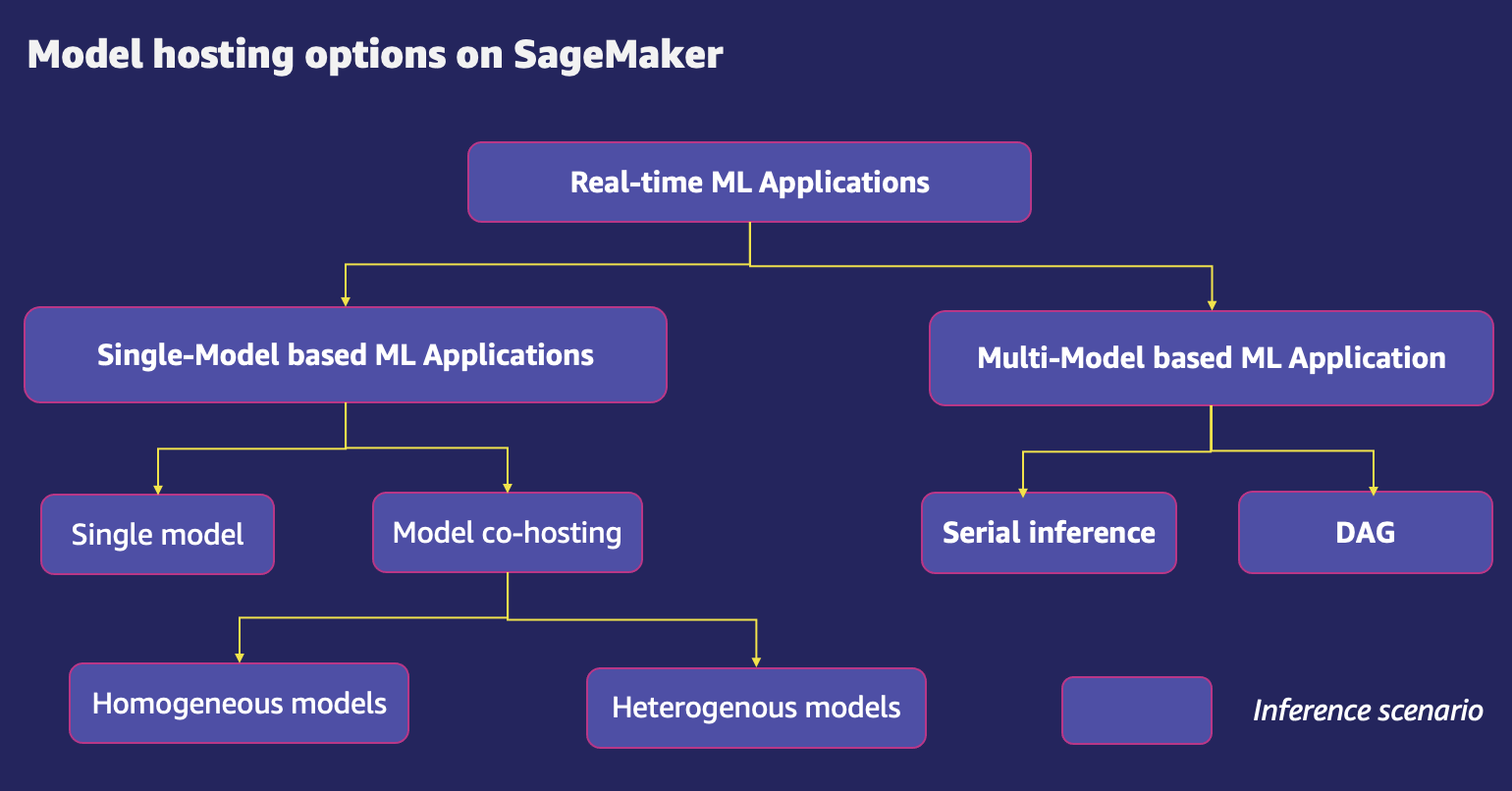

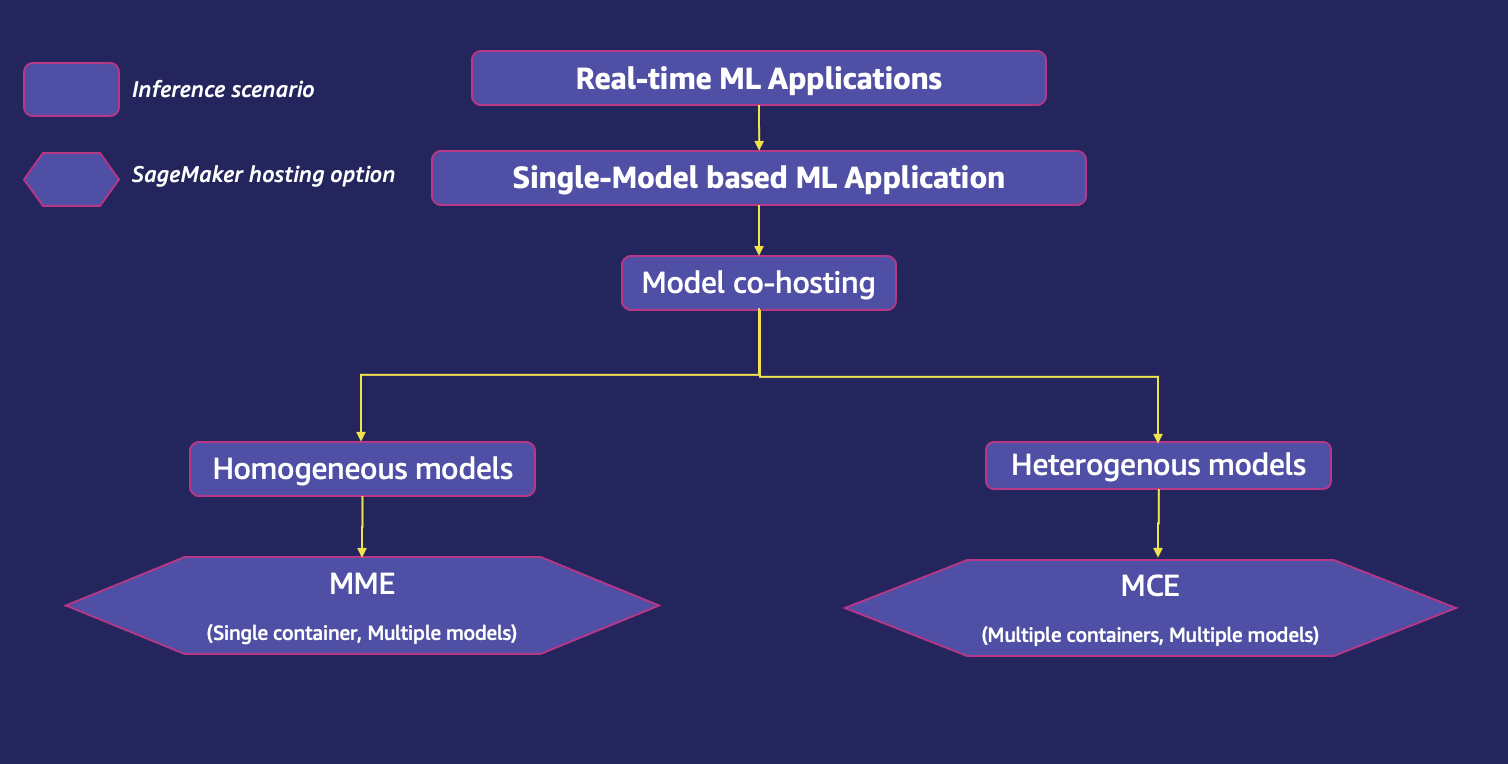

एक वास्तविक समय एमएल एप्लिकेशन एकल भविष्यवाणी अनुरोध को पूरा करने के लिए एकल मॉडल या एकाधिक मॉडल का उपयोग कर सकता है। निम्नलिखित आरेख एक एमएल एप्लिकेशन के लिए विभिन्न अनुमान परिदृश्य दिखाता है।

आइए पूर्ववर्ती अनुमान परिदृश्यों में से प्रत्येक के लिए एक उपयुक्त सेजमेकर होस्टिंग विकल्प का पता लगाएं। आप यह आकलन करने के लिए फिटनेस फ़ंक्शन का संदर्भ ले सकते हैं कि क्या यह दिए गए उपयोग के मामले के लिए सही विकल्प है।

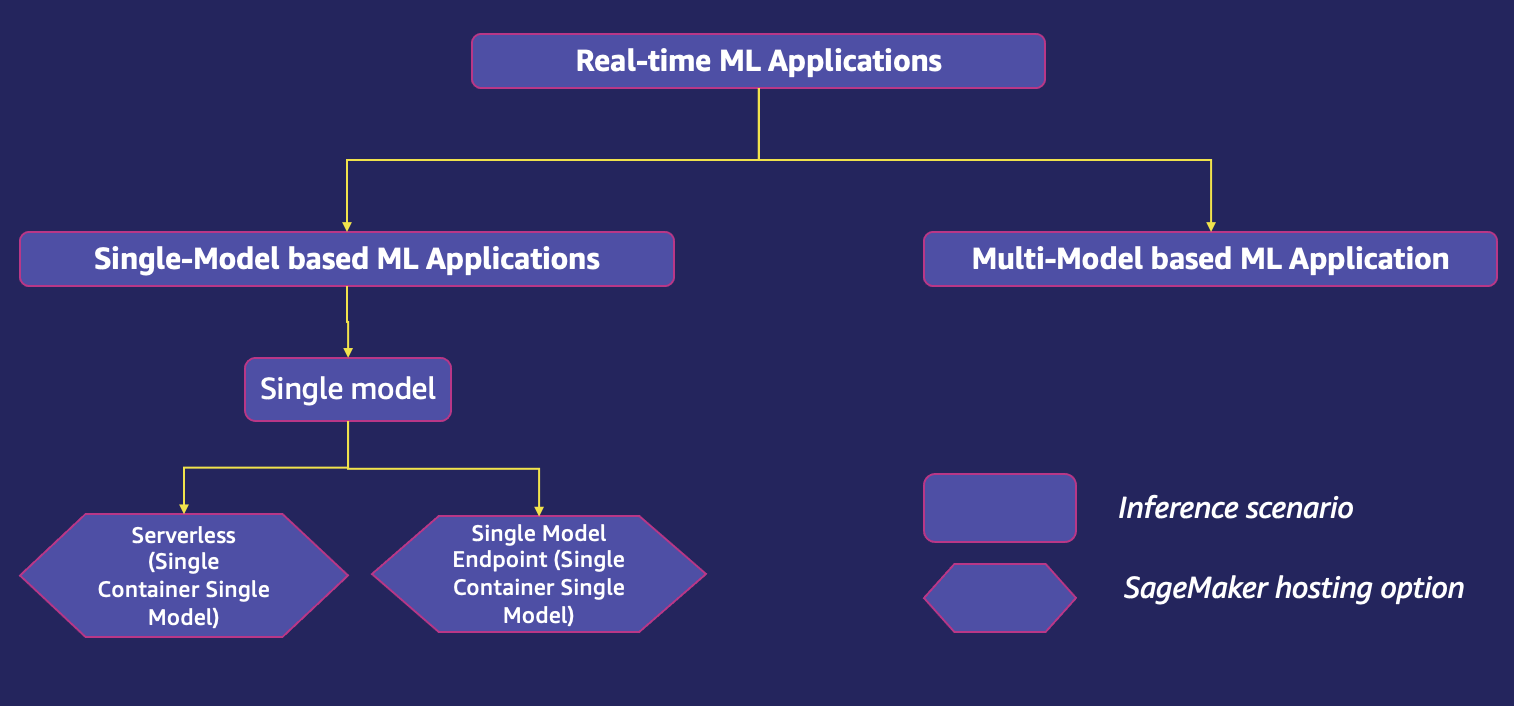

एकल-मॉडल आधारित एमएल एप्लिकेशन की मेजबानी करना

परिनियोजन परिदृश्य के आधार पर सेजमेकर होस्टिंग सेवाओं का उपयोग करके एकल-मॉडल आधारित एमएल अनुप्रयोगों को होस्ट करने के कई विकल्प हैं।

एकल-मॉडल समापन बिंदु

सेजमेकर सिंगल-मॉडल एंडपॉइंट आपको कम विलंबता और उच्च थ्रूपुट के लिए समर्पित उदाहरणों पर होस्ट किए गए कंटेनर पर एक मॉडल होस्ट करने की अनुमति देता है। ये समापन बिंदु पूरी तरह से प्रबंधित हैं और ऑटो स्केलिंग का समर्थन करते हैं। आप एकल-मॉडल एंडपॉइंट को एक प्रावधानित एंडपॉइंट के रूप में कॉन्फ़िगर कर सकते हैं जहां आप एंडपॉइंट इंफ्रास्ट्रक्चर कॉन्फ़िगरेशन जैसे कि इंस्टेंस प्रकार और गिनती, या सर्वर रहित एंडपॉइंट पास करते हैं जहां सेजमेकर स्वचालित रूप से गणना संसाधनों को लॉन्च करता है और ट्रैफ़िक के आधार पर उन्हें अंदर और बाहर स्केल करता है, जिससे आवश्यकता समाप्त हो जाती है उदाहरण प्रकार चुनने या स्केलिंग नीतियों को प्रबंधित करने के लिए। सर्वर रहित एंडपॉइंट रुक-रुक कर या अप्रत्याशित ट्रैफ़िक वाले अनुप्रयोगों के लिए हैं।

निम्नलिखित आरेख एकल-मॉडल समापन बिंदु अनुमान परिदृश्य दिखाता है।

निम्नलिखित तालिका एक प्रावधानित एकल-मॉडल समापन बिंदु के लिए फिटनेस कार्यों के मूल्यांकन पर मार्गदर्शन प्रदान करती है। सर्वर रहित एंडपॉइंट फिटनेस फ़ंक्शन मूल्यांकन के लिए, इस पोस्ट में सर्वर रहित एंडपॉइंट अनुभाग देखें।

| फिटनेस कार्य | Description |

| लागत | आपके द्वारा चुने गए इंस्टेंस प्रकार के उपयोग के लिए आपसे शुल्क लिया जाएगा। क्योंकि समापन बिंदु हमेशा चालू और उपलब्ध रहता है, लागत तेजी से बढ़ सकती है। अपने मॉडल के लिए सही उदाहरण चुनने से यह सुनिश्चित करने में मदद मिलती है कि आपके पास अपने मॉडल के लिए सबसे कम लागत पर सबसे अधिक प्रदर्शन करने वाला उदाहरण है। संभावित न्यूनतम लागत पर स्थिर और पूर्वानुमानित प्रदर्शन बनाए रखने के लिए ट्रैफ़िक के आधार पर क्षमता को गतिशील रूप से समायोजित करने के लिए ऑटो स्केलिंग की अनुशंसा की जाती है। |

| अनुमान विलंबता | एक एकल-मॉडल समापन बिंदु मिलीसेकंड विलंबता आवश्यकताओं के साथ वास्तविक समय, इंटरैक्टिव, तुल्यकालिक अनुमान प्रदान करता है। |

| प्रवाह | थ्रूपुट विभिन्न कारकों से प्रभावित हो सकता है, जैसे मॉडल इनपुट आकार, बैच आकार, एंडपॉइंट इंस्टेंस प्रकार, इत्यादि। इनपुट अनुरोधों और संसाधन उपयोग के लिए क्लाउडवॉच मेट्रिक्स की समीक्षा करने और इष्टतम थ्रूपुट प्राप्त करने के लिए उपयुक्त इंस्टेंस प्रकार का चयन करने की अनुशंसा की जाती है। सेजमेकर एमएल मॉडल तैनात करते समय संसाधनों को प्रबंधित करने और अनुमान प्रदर्शन को अनुकूलित करने के लिए सुविधाएं प्रदान करता है। तुम कर सकते हो नियो का उपयोग करके मॉडल प्रदर्शन को अनुकूलित करें, या अपने एंडपॉइंट के लिए GPU इंस्टेंस का उपयोग करके अपने SageMaker द्वारा होस्ट किए गए मॉडल के बेहतर थ्रूपुट के लिए Inf1 इंस्टेंस का उपयोग करें। |

| स्केलिंग कॉन्फ़िगरेशन जटिलता | बॉक्स के बाहर ऑटो स्केलिंग समर्थित है। सेजमेकर एक उपयुक्त विकल्प चुनने की अनुशंसा करता है स्केलिंग कॉन्फ़िगरेशन प्रदर्शन द्वारा लोड परीक्षण. |

| यातायात का स्वरूप | पूर्वानुमानित ट्रैफ़िक पैटर्न वाले कार्यभार के लिए एकल-मॉडल समापन बिंदु आदर्श है। |

कई मॉडलों की सह-मेजबानी

जब आप बड़ी संख्या में मॉडलों के साथ काम कर रहे हैं, तो प्रत्येक को एक समर्पित कंटेनर और उदाहरण के साथ एक व्यक्तिगत समापन बिंदु पर तैनात करने से लागत में उल्लेखनीय वृद्धि हो सकती है। इसके अतिरिक्त, उत्पादन में इतने सारे मॉडलों को प्रबंधित करना भी मुश्किल हो जाता है, खासकर जब आपको एक ही समय में सभी मॉडलों को लागू करने की आवश्यकता नहीं होती है, लेकिन फिर भी उन्हें हर समय उपलब्ध रहने की आवश्यकता होती है। समान अंतर्निहित कंप्यूट संसाधनों पर एकाधिक मॉडलों की सह-होस्टिंग से बड़े पैमाने पर एमएल परिनियोजन को प्रबंधित करना आसान हो जाता है और एंडपॉइंट और इसके अंतर्निहित कंप्यूट संसाधनों के बढ़ते उपयोग के माध्यम से आपकी होस्टिंग लागत कम हो जाती है। सेजमेकर उन्नत मॉडल सह-होस्टिंग विकल्पों का समर्थन करता है जैसे समरूप मॉडल के लिए मल्टी-मॉडल एंडपॉइंट (एमएमई) और विषम मॉडल के लिए मल्टी-कंटेनर एंडपॉइंट (एमसीई)। सजातीय मॉडल एक साझा सेवा कंटेनर पर समान एमएल ढांचे का उपयोग करते हैं, जबकि विषम मॉडल आपको कई सेवारत कंटेनरों को तैनात करने की अनुमति देते हैं जो एक ही समापन बिंदु पर विभिन्न मॉडल या ढांचे का उपयोग करते हैं।

निम्नलिखित आरेख SageMaker का उपयोग करके मॉडल सह-होस्टिंग विकल्प दिखाता है।

सेजमेकर बहु-मॉडल समापन बिंदु

SageMaker एमएमई आपको एक ही एंडपॉइंट पर साझा सर्विंग कंटेनर का उपयोग करके कई मॉडल होस्ट करने की अनुमति देता है। यह बड़ी संख्या में मॉडलों को तैनात करने के लिए एक स्केलेबल और लागत प्रभावी समाधान है जो समान उपयोग के मामले, ढांचे या अनुमान तर्क को पूरा करता है। एमएमई कॉलर द्वारा बुलाए गए मॉडल के आधार पर गतिशील रूप से अनुरोधों को पूरा कर सकते हैं। यह परिनियोजन ओवरहेड को भी कम करता है क्योंकि सेजमेकर मेमोरी में मॉडल लोड करने और उन पर ट्रैफ़िक पैटर्न के आधार पर उन्हें स्केल करने का प्रबंधन करता है। यह सुविधा तब आदर्श होती है जब आपके पास बड़ी संख्या में समान मॉडल होते हैं जिन्हें आप एक साझा सर्विंग कंटेनर के माध्यम से परोस सकते हैं और एक ही समय में सभी मॉडलों तक पहुंचने की आवश्यकता नहीं होती है। मल्टी-मॉडल एंडपॉइंट आपके मॉडलों में मेमोरी संसाधनों के समय-साझाकरण को भी सक्षम बनाता है। यह तब सबसे अच्छा काम करता है जब मॉडल आकार और आमंत्रण विलंबता में काफी समान होते हैं, जिससे एमएमई को सभी मॉडलों में उदाहरणों का प्रभावी ढंग से उपयोग करने की अनुमति मिलती है। सेजमेकर एमएमई सीपीयू और जीपीयू समर्थित मॉडल दोनों की मेजबानी का समर्थन करते हैं। जीपीयू समर्थित मॉडल का उपयोग करके, आप एंडपॉइंट और इसके अंतर्निहित त्वरित गणना उदाहरणों के बढ़ते उपयोग के माध्यम से अपने मॉडल परिनियोजन लागत को कम कर सकते हैं। एमएमई के वास्तविक विश्व उपयोग के मामले के लिए, देखें बहु-किरायेदार सास उपयोग के मामलों के लिए मशीन सीखने के अनुमान को कैसे मापें.

निम्नलिखित तालिका एमएमई के लिए फिटनेस कार्यों के मूल्यांकन पर मार्गदर्शन प्रदान करती है।

| फिटनेस कार्य | Description |

| लागत |

एमएमई एक ही एंडपॉइंट पर हजारों मॉडलों को होस्ट करने के लिए एक साझा सर्विंग कंटेनर का उपयोग करने में सक्षम बनाता है। यह एकल-मॉडल एंडपॉइंट के उपयोग की तुलना में एंडपॉइंट उपयोग में सुधार करके होस्टिंग लागत को काफी कम कर देता है। उदाहरण के लिए, यदि आपके पास ml.c10.large इंस्टेंस का उपयोग करके तैनात करने के लिए 5 मॉडल हैं, तो इसके आधार पर सेजमेकर मूल्य निर्धारण, 10 एकल-मॉडल लगातार समापन बिंदु रखने की लागत है: 10 * $0.102 = $1.02 प्रति घंटा। जबकि 10 मॉडलों की मेजबानी करने वाले एक एमएमई के साथ, हम 10 गुना लागत बचत प्राप्त करते हैं: 1 * $0.102 = $0.102 प्रति घंटा। |

| अनुमान विलंबता |

डिफ़ॉल्ट रूप से, एमएमई कैश अक्सर कम-विलंबता अनुमान प्रदान करने के लिए मेमोरी और डिस्क पर मॉडल का उपयोग करता है। कैश्ड मॉडल को डिस्क से तभी अनलोड या डिलीट किया जाता है जब कंटेनर में नए लक्षित मॉडल को समायोजित करने के लिए मेमोरी या डिस्क स्थान खत्म हो जाता है। एमएमई मॉडलों की आलसी लोडिंग की अनुमति देते हैं, जिसका अर्थ है कि मॉडल पहली बार लागू होने पर मेमोरी में लोड हो जाते हैं। यह मेमोरी उपयोग को अनुकूलित करता है; हालाँकि, यह पहले लोड पर प्रतिक्रिया समय में वृद्धि का कारण बनता है, जिसके परिणामस्वरूप कोल्ड स्टार्ट की समस्या होती है। इसलिए, एमएमई उन परिदृश्यों के लिए भी उपयुक्त हैं जो कभी-कभी उपयोग किए जाने वाले मॉडलों को लागू करते समय होने वाली कोल्ड-स्टार्ट-संबंधी विलंबता दंड को सहन कर सकते हैं। एमएल अनुप्रयोगों की विलंबता और थ्रूपुट लक्ष्यों को पूरा करने के लिए, सीपीयू इंस्टेंसेस (कम्प्यूटेशनल पावर जीपीयू ऑफ़र को देखते हुए) पर जीपीयू इंस्टेंसेस को प्राथमिकता दी जाती है। जीपीयू के लिए एमएमई समर्थन के साथ, आप एक सेजमेकर एंडपॉइंट के पीछे हजारों गहन शिक्षण मॉडल तैनात कर सकते हैं। एमएमई एक जीपीयू कोर पर कई मॉडल चला सकते हैं, कई मॉडलों में एक एंडपॉइंट के पीछे जीपीयू इंस्टेंस साझा कर सकते हैं, और आने वाले ट्रैफिक के आधार पर मॉडल को गतिशील रूप से लोड और अनलोड कर सकते हैं। इससे, आप लागत में उल्लेखनीय रूप से बचत कर सकते हैं और सर्वोत्तम मूल्य प्रदर्शन प्राप्त कर सकते हैं। यदि आपका उपयोग मामला प्रति सेकंड (टीपीएस) या विलंबता आवश्यकताओं में काफी अधिक लेनदेन की मांग करता है, तो हम मॉडल को समर्पित एंडपॉइंट पर होस्ट करने की सलाह देते हैं। |

| प्रवाह |

एमएमई अनुमान थ्रूपुट का एक आदर्श मूल्य मॉडल, पेलोड आकार और एंडपॉइंट इंस्टेंस प्रकार जैसे कारकों पर निर्भर करता है। इंस्टेंस मेमोरी की अधिक मात्रा आपको अधिक मॉडल लोड करने और अनुमान अनुरोधों को पूरा करने के लिए तैयार करने में सक्षम बनाती है। आपको मॉडल लोड करने में समय बर्बाद करने की आवश्यकता नहीं है। वीसीपीयू की अधिक मात्रा आपको एक साथ अधिक अद्वितीय मॉडल लागू करने में सक्षम बनाती है। एमएमई गतिशील रूप से मॉडल को इंस्टेंस मेमोरी से लोड और अनलोड करते हैं, जो I/O प्रदर्शन को प्रभावित कर सकता है। जीपीयू के साथ सेजमेकर एमएमई काम करते हैं NVIDIA ट्राइटन अनुमान सर्वर, जो एक ओपन-सोर्स अनुमान सर्विंग सॉफ्टवेयर है जो अनुमान सर्विंग प्रक्रिया को सरल बनाता है और उच्च अनुमान प्रदर्शन प्रदान करता है। सेजमेकर मॉडल को GPU त्वरित उदाहरण पर NVIDIA ट्राइटन कंटेनर की मेमोरी में लोड करता है और अनुमान अनुरोध प्रदान करता है। GPU कोर को एक उदाहरण में सभी मॉडलों द्वारा साझा किया जाता है। यदि मॉडल पहले से ही कंटेनर मेमोरी में लोड है, तो बाद के अनुरोधों को तेजी से पूरा किया जाता है क्योंकि सेजमेकर को इसे फिर से डाउनलोड और लोड करने की आवश्यकता नहीं होती है। सफल उत्पादन परिनियोजन में उचित प्रदर्शन परीक्षण और विश्लेषण की सिफारिश की जाती है। सेजमेकर मल्टी-मॉडल एंडपॉइंट्स के लिए क्लाउडवॉच मेट्रिक्स प्रदान करता है ताकि आप अपने एंडपॉइंट को अनुकूलित करने में सहायता के लिए एंडपॉइंट उपयोग और कैश हिट दर निर्धारित कर सकें। |

| स्केलिंग कॉन्फ़िगरेशन जटिलता | सेजमेकर मल्टी-मॉडल एंडपॉइंट पूरी तरह से ऑटो स्केलिंग का समर्थन करता है, जो ट्रैफ़िक पैटर्न के आधार पर मॉडल स्केल सुनिश्चित करने के लिए मॉडल की प्रतिकृतियां प्रबंधित करता है। हालाँकि, एंडपॉइंट को ऑटो स्केल करने के लिए इंस्टेंस के इष्टतम आकार को निर्धारित करने के लिए एक उचित लोड परीक्षण की सिफारिश की जाती है। बहुत सारे मॉडल उतारने से बचने के लिए एमएमई बेड़े का सही आकार बनाना महत्वपूर्ण है। कुछ बड़े उदाहरणों पर सैकड़ों मॉडल लोड करने से कुछ मामलों में थ्रॉटलिंग हो सकती है, और अधिक और छोटे उदाहरणों का उपयोग करने को प्राथमिकता दी जा सकती है। सेजमेकर में स्वचालित मॉडल स्केलिंग का लाभ उठाने के लिए, सुनिश्चित करें कि आपके पास है इंस्टेंस ऑटो स्केलिंग सेट अप अतिरिक्त उदाहरण क्षमता का प्रावधान करना। एंडपॉइंट बेड़े में अधिक उदाहरण जोड़ने के लिए अपनी एंडपॉइंट-स्तरीय स्केलिंग नीति को कस्टम पैरामीटर या इनवोकेशन प्रति मिनट (अनुशंसित) के साथ सेट करें। ऑटो स्केल ईवेंट को ट्रिगर करने के लिए उपयोग की जाने वाली आमंत्रण दरें एंडपॉइंट द्वारा पेश किए गए मॉडलों के पूरे सेट में भविष्यवाणियों के समग्र सेट पर आधारित होती हैं। |

| यातायात का स्वरूप | एमएमई तब आदर्श होते हैं जब आपके पास बड़ी संख्या में समान आकार के मॉडल होते हैं जिन्हें आप एक साझा सर्विंग कंटेनर के माध्यम से परोस सकते हैं और एक ही समय में सभी मॉडलों तक पहुंचने की आवश्यकता नहीं होती है। |

सेजमेकर मल्टी-कंटेनर एंडपॉइंट

SageMaker एमसीई एक ही समापन बिंदु पर विभिन्न मॉडलों या ढांचे का उपयोग करने वाले 15 कंटेनरों को तैनात करने और कम-विलंबता अनुमान और लागत बचत के लिए उन्हें स्वतंत्र रूप से या अनुक्रम में लागू करने का समर्थन करता है। मॉडल अपने स्वयं के स्वतंत्र सर्विंग स्टैक के साथ पूरी तरह से विषम हो सकते हैं। एक ही इंस्टेंस पर अलग-अलग फ्रेमवर्क से कई मॉडलों को सुरक्षित रूप से होस्ट करने से आप लागत में 90% तक की बचत कर सकते हैं।

एमसीई मंगलाचरण पैटर्न इस प्रकार हैं:

- अनुमान पाइपलाइन - एमएमई में कंटेनरों को एक रैखिक अनुक्रम में लागू किया जा सकता है, जिसे ए के रूप में भी जाना जाता है क्रमिक अनुमान पाइपलाइन. इनका उपयोग आमतौर पर प्रीप्रोसेसिंग, मॉडल अनुमान और पोस्टप्रोसेसिंग को स्वतंत्र कंटेनरों में अलग करने के लिए किया जाता है। वर्तमान कंटेनर से आउटपुट को अगले कंटेनर में इनपुट के रूप में पास किया जाता है। उन्हें सेजमेकर में एकल पाइपलाइन मॉडल के रूप में दर्शाया गया है। एक अनुमान पाइपलाइन को एमएमई के रूप में तैनात किया जा सकता है, जहां पाइपलाइन में कंटेनरों में से एक गतिशील रूप से लागू किए गए मॉडल के आधार पर अनुरोधों को पूरा कर सकता है।

- प्रत्यक्ष आह्वान - साथ में प्रत्यक्ष आह्वान, एक अनुरोध एमसीई पर होस्ट किए गए एक विशिष्ट अनुमान कंटेनर को भेजा जा सकता है।

निम्नलिखित तालिका एमसीई के लिए फिटनेस कार्यों के मूल्यांकन पर मार्गदर्शन प्रदान करती है।

| फिटनेस कार्य | Description |

| लागत | एमसीई आपको एक ही एंडपॉइंट पर 15 अलग-अलग एमएल कंटेनरों को चलाने और उन्हें स्वतंत्र रूप से लागू करने में सक्षम बनाता है, जिससे लागत बचत होती है। यह विकल्प तब आदर्श होता है जब आपके पास समान संसाधन आवश्यकताओं के साथ अलग-अलग सर्विंग स्टैक पर चलने वाले कई मॉडल होते हैं, और जब व्यक्तिगत मॉडल के पास एंडपॉइंट इंस्टेंस की पूरी क्षमता का उपयोग करने के लिए पर्याप्त ट्रैफ़िक नहीं होता है। इसलिए एमसीई एकल-मॉडल समापन बिंदु की तुलना में अधिक लागत प्रभावी हैं। एमसीई समकालिक अनुमान प्रतिक्रिया प्रदान करते हैं, जिसका अर्थ है कि समापन बिंदु हमेशा उपलब्ध है और आप उदाहरण के अपटाइम के लिए भुगतान करते हैं। उदाहरणों की संख्या और प्रकार के आधार पर लागत बढ़ सकती है। |

| अनुमान विलंबता | एमसीई प्रत्येक मॉडल के लिए अलग-अलग एमएल फ्रेमवर्क और एल्गोरिदम के साथ एमएल ऐप्स चलाने के लिए आदर्श हैं, जिन्हें कभी-कभी एक्सेस किया जाता है लेकिन फिर भी कम-विलंबता अनुमान की आवश्यकता होती है। मॉडल हमेशा कम-विलंबता अनुमान के लिए उपलब्ध होते हैं और कोल्ड स्टार्ट की कोई समस्या नहीं होती है। |

| प्रवाह | एमसीई मल्टी-कंटेनर एंडपॉइंट पर 15 कंटेनर तक सीमित हैं, और संसाधन विवाद के कारण जीपीयू अनुमान समर्थित नहीं है। डायरेक्ट इनवोकेशन मोड का उपयोग करने वाले मल्टी-कंटेनर एंडपॉइंट्स के लिए, सेजमेकर न केवल इंस्टेंस-स्तरीय मेट्रिक्स प्रदान करता है, जैसा कि यह अन्य सामान्य एंडपॉइंट्स के साथ करता है, बल्कि प्रति-कंटेनर मेट्रिक्स का भी समर्थन करता है। सर्वोत्तम अभ्यास के रूप में, इनपुट अनुरोधों और संसाधन उपयोग के लिए क्लाउडवॉच मेट्रिक्स की समीक्षा करें, और इष्टतम थ्रूपुट प्राप्त करने के लिए उपयुक्त इंस्टेंस प्रकार का चयन करें। |

| स्केलिंग कॉन्फ़िगरेशन जटिलता | एमसीई ऑटो स्केलिंग का समर्थन करते हैं। हालाँकि, स्वचालित स्केलिंग को कॉन्फ़िगर करने के लिए, यह अनुशंसा की जाती है कि प्रत्येक कंटेनर में मॉडल प्रत्येक अनुमान अनुरोध पर समान सीपीयू उपयोग और विलंबता प्रदर्शित करे। इसकी अनुशंसा की जाती है क्योंकि यदि मल्टी-कंटेनर एंडपॉइंट पर ट्रैफ़िक कम सीपीयू उपयोग मॉडल से उच्च सीपीयू उपयोग मॉडल में स्थानांतरित हो जाता है, लेकिन समग्र कॉल वॉल्यूम समान रहता है, तो एंडपॉइंट स्केल आउट नहीं होता है, और पर्याप्त उदाहरण नहीं हो सकते हैं उच्च CPU उपयोग मॉडल के सभी अनुरोधों को संभालने के लिए। |

| यातायात का स्वरूप | एमसीई निरंतर या नियमित ट्रैफ़िक पैटर्न वाले वर्कलोड के लिए आदर्श हैं, विभिन्न फ़्रेमवर्क (जैसे टेन्सरफ़्लो, पायटोरच, या स्केलेरन) में मॉडल होस्ट करने के लिए जिनमें एंडपॉइंट इंस्टेंस की पूरी क्षमता को संतृप्त करने के लिए पर्याप्त ट्रैफ़िक नहीं हो सकता है। |

मल्टी-मॉडल आधारित एमएल एप्लिकेशन होस्ट करना

कई व्यावसायिक अनुप्रयोगों को अपने उपभोक्ताओं को एकल भविष्यवाणी अनुरोध प्रदान करने के लिए कई एमएल मॉडल का उपयोग करने की आवश्यकता होती है। उदाहरण के लिए, एक खुदरा कंपनी जो अपने उपयोगकर्ताओं को अनुशंसाएँ प्रदान करना चाहती है। इस उपयोग के मामले में एमएल एप्लिकेशन विभिन्न श्रेणियों के उत्पादों की सिफारिश करने के लिए विभिन्न कस्टम मॉडल का उपयोग करना चाह सकता है। यदि कंपनी व्यक्तिगत उपयोगकर्ता जानकारी का उपयोग करके अनुशंसाओं में वैयक्तिकरण जोड़ना चाहती है, तो कस्टम मॉडल की संख्या और बढ़ जाती है। प्रत्येक कस्टम मॉडल को एक अलग कंप्यूट इंस्टेंस पर होस्ट करना न केवल लागत निषेधात्मक है, बल्कि यदि सभी मॉडलों का अक्सर उपयोग नहीं किया जाता है, तो होस्टिंग संसाधनों का कम उपयोग भी होता है। सेजमेकर मल्टी-मॉडल आधारित एमएल अनुप्रयोगों के लिए कुशल होस्टिंग विकल्प प्रदान करता है।

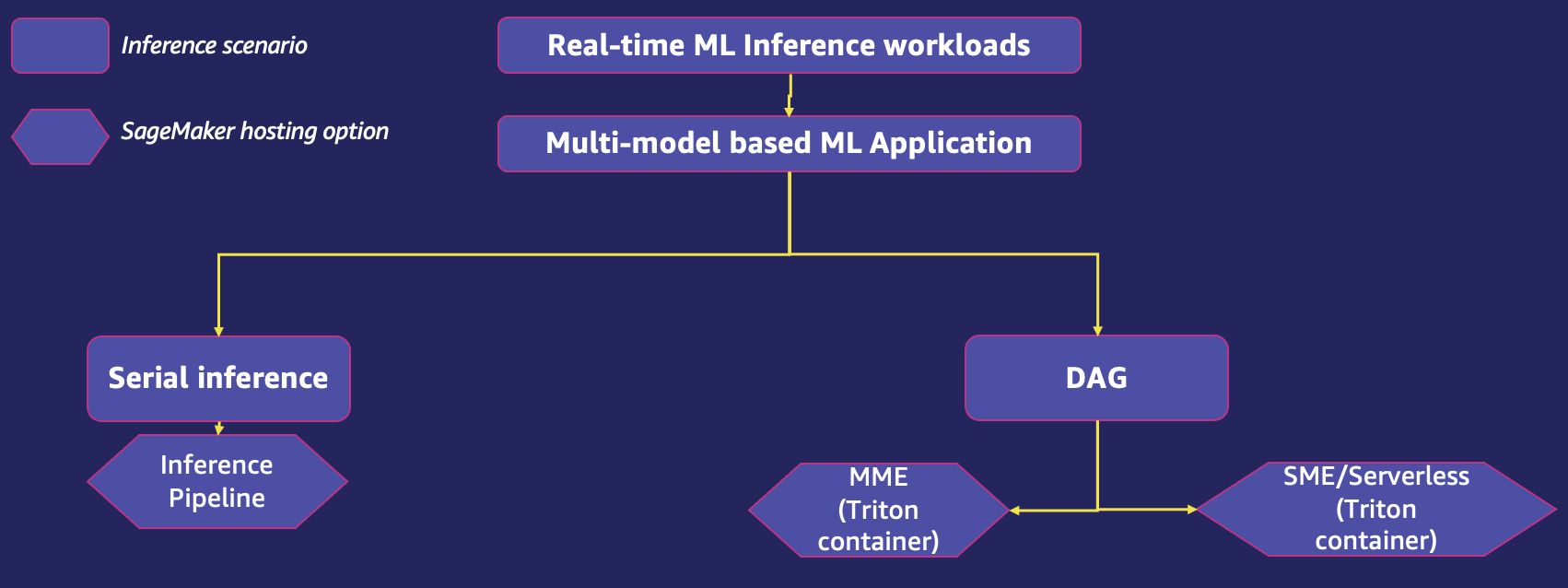

निम्नलिखित आरेख SageMaker का उपयोग करके एकल समापन बिंदु के लिए मल्टी-मॉडल होस्टिंग विकल्प दिखाता है।

क्रमिक अनुमान पाइपलाइन

एक अनुमान पाइपलाइन एक सेजमेकर मॉडल है जो 2-15 कंटेनरों के एक रैखिक अनुक्रम से बना है जो डेटा पर अनुमान के लिए अनुरोधों को संसाधित करता है। आप पूर्व-प्रशिक्षित सेजमेकर अंतर्निहित एल्गोरिदम और डॉकर कंटेनरों में पैक किए गए अपने स्वयं के कस्टम एल्गोरिदम के किसी भी संयोजन को परिभाषित और तैनात करने के लिए एक अनुमान पाइपलाइन का उपयोग करते हैं। आप प्रीप्रोसेसिंग, पूर्वानुमान और पोस्टप्रोसेसिंग डेटा विज्ञान कार्यों को संयोजित करने के लिए एक अनुमान पाइपलाइन का उपयोग कर सकते हैं। एक कंटेनर से आउटपुट को अगले कंटेनर में इनपुट के रूप में पास किया जाता है। पाइपलाइन मॉडल के लिए कंटेनरों को परिभाषित करते समय, आप उस क्रम को भी निर्दिष्ट करते हैं जिसमें कंटेनर चलाए जाते हैं। उन्हें सेजमेकर में एकल पाइपलाइन मॉडल के रूप में दर्शाया गया है। अनुमान पाइपलाइन को एमएमई के रूप में तैनात किया जा सकता है, जहां पाइपलाइन में कंटेनरों में से एक गतिशील रूप से लागू किए गए मॉडल के आधार पर अनुरोधों को पूरा कर सकता है। आप भी चला सकते हैं बैच परिवर्तन एक अनुमान पाइपलाइन के साथ कार्य। अनुमान पाइपलाइनें पूरी तरह से प्रबंधित हैं।

निम्नलिखित तालिका एक क्रमिक अनुमान पाइपलाइन का उपयोग करके एमएल मॉडल होस्टिंग के लिए फिटनेस कार्यों के मूल्यांकन पर मार्गदर्शन प्रदान करती है।

| फिटनेस कार्य | Description |

| लागत | सीरियल अनुमान पाइपलाइन आपको एक ही समापन बिंदु पर 15 अलग-अलग एमएल कंटेनरों को चलाने में सक्षम बनाती है, जिससे अनुमान कंटेनरों को होस्ट करने की लागत प्रभावशीलता बढ़ जाती है। इस सुविधा का उपयोग करने के लिए कोई अतिरिक्त लागत नहीं है। आप केवल समापन बिंदु पर चल रहे इंस्टेंस के लिए भुगतान करते हैं। उदाहरणों की संख्या और प्रकार के आधार पर लागत बढ़ सकती है। |

| अनुमान विलंबता | जब एक एमएल एप्लिकेशन को एक अनुमान पाइपलाइन के रूप में तैनात किया जाता है, तो विभिन्न मॉडलों के बीच का डेटा कंटेनर स्थान नहीं छोड़ता है। फ़ीचर प्रोसेसिंग और अनुमान कम विलंबता के साथ चलते हैं क्योंकि कंटेनर समान EC2 उदाहरणों पर सह-स्थित होते हैं। |

| प्रवाह | एक अनुमान पाइपलाइन मॉडल के भीतर, सेजमेकर HTTP अनुरोधों के अनुक्रम के रूप में आमंत्रणों को संभालता है। पाइपलाइन में पहला कंटेनर प्रारंभिक अनुरोध को संभालता है, फिर मध्यवर्ती प्रतिक्रिया दूसरे कंटेनर को अनुरोध के रूप में भेजी जाती है, और इसी तरह, पाइपलाइन में प्रत्येक कंटेनर के लिए। सेजमेकर क्लाइंट को अंतिम प्रतिक्रिया लौटाता है। थ्रूपुट मॉडल, मॉडल इनपुट आकार, बैच आकार और एंडपॉइंट इंस्टेंस प्रकार जैसे कारकों पर निर्भर है। सर्वोत्तम अभ्यास के रूप में, इनपुट अनुरोधों और संसाधन उपयोग के लिए क्लाउडवॉच मेट्रिक्स की समीक्षा करें, और इष्टतम थ्रूपुट प्राप्त करने के लिए उपयुक्त इंस्टेंस प्रकार का चयन करें। |

| स्केलिंग कॉन्फ़िगरेशन जटिलता | सीरियल अनुमान पाइपलाइन ऑटो स्केलिंग का समर्थन करती हैं। हालाँकि, स्वचालित स्केलिंग को कॉन्फ़िगर करने के लिए, यह अनुशंसा की जाती है कि प्रत्येक कंटेनर में मॉडल प्रत्येक अनुमान अनुरोध पर समान सीपीयू उपयोग और विलंबता प्रदर्शित करे। इसकी अनुशंसा की जाती है क्योंकि यदि मल्टी-कंटेनर एंडपॉइंट पर ट्रैफ़िक कम सीपीयू उपयोग मॉडल से उच्च सीपीयू उपयोग मॉडल में स्थानांतरित हो जाता है, लेकिन समग्र कॉल वॉल्यूम समान रहता है, तो एंडपॉइंट स्केल आउट नहीं होता है और पर्याप्त उदाहरण नहीं हो सकते हैं उच्च CPU उपयोग मॉडल के सभी अनुरोधों को संभालें। |

यातायात का स्वरूप |

सीरियल इंट्रेंस पाइपलाइन उन मॉडलों के साथ पूर्वानुमानित ट्रैफ़िक पैटर्न के लिए आदर्श हैं जो एक ही समापन बिंदु पर क्रमिक रूप से चलते हैं। |

मॉडल पहनावा तैनात करना (ट्राइटन डीएजी):

सेजमेकर के साथ एकीकरण की पेशकश करता है NVIDIA ट्राइटन अनुमान सर्वर पूज्य गुरुदेव के मार्गदर्शन से संपन्न कर सकते हैं - ट्राइटन अनुमान सर्वर कंटेनर. इन कंटेनरों में NVIDIA ट्राइटन इन्फेरेंस सर्वर, सामान्य एमएल फ्रेमवर्क के लिए समर्थन और उपयोगी पर्यावरण चर शामिल हैं जो आपको सेजमेकर पर प्रदर्शन को अनुकूलित करने देते हैं। NVIDIA ट्राइटन कंटेनर छवियों के साथ, आप आसानी से ML मॉडल की सेवा कर सकते हैं और NVIDIA ट्राइटन द्वारा प्रदान किए गए प्रदर्शन अनुकूलन, गतिशील बैचिंग और मल्टी-फ्रेमवर्क समर्थन से लाभ उठा सकते हैं। ट्राइटन जीपीयू और सीपीयू के उपयोग को अधिकतम करने में मदद करता है, जिससे अनुमान की लागत कम हो जाती है।

व्यावसायिक उपयोग के मामलों में जहां एमएल एप्लिकेशन भविष्यवाणी अनुरोध को पूरा करने के लिए कई मॉडलों का उपयोग करते हैं, यदि प्रत्येक मॉडल एक अलग ढांचे का उपयोग करता है या एक अलग उदाहरण पर होस्ट किया जाता है, तो इससे कार्यभार और लागत में वृद्धि हो सकती है और साथ ही समग्र विलंबता में भी वृद्धि हो सकती है। SageMaker NVIDIA ट्राइटन इन्फेरेंस सर्वर सभी प्रमुख फ्रेमवर्क से मॉडलों की तैनाती का समर्थन करता है, जैसे कि TensorFlow GraphDef, TensorFlow SavedModel, ONNX, PyTorch TorchScript, TensorRT, और Python/C++ मॉडल प्रारूप और बहुत कुछ। ट्राइटन मॉडल पहनावा एक या एक से अधिक मॉडल या प्रीप्रोसेसिंग और पोस्टप्रोसेसिंग लॉजिक की पाइपलाइन और उनके बीच इनपुट और आउटपुट टेंसर के कनेक्शन का प्रतिनिधित्व करता है। किसी समूह के लिए एक एकल अनुमान अनुरोध संपूर्ण पाइपलाइन के संचालन को ट्रिगर करता है। ट्राइटन में कई अंतर्निहित शेड्यूलिंग और बैचिंग एल्गोरिदम भी हैं जो अनुमान थ्रूपुट को बेहतर बनाने के लिए व्यक्तिगत अनुमान अनुरोधों को जोड़ते हैं। ये शेड्यूलिंग और बैचिंग निर्णय अनुमान का अनुरोध करने वाले ग्राहक के लिए पारदर्शी हैं। अधिकतम लचीलेपन और विविध कंप्यूटिंग आवश्यकताओं का समर्थन करने के लिए मॉडल को सीपीयू या जीपीयू पर चलाया जा सकता है।

मल्टी-मॉडल एंडपॉइंट पर एकाधिक जीपीयू समर्थित मॉडल होस्ट करना इसके माध्यम से समर्थित है सेजमेकर ट्राइटन अनुमान सर्वर. इसे लागू करने के लिए NVIDIA ट्राइटन इन्फेरेंस सर्वर का विस्तार किया गया है एमएमई एपीआई अनुबंध, एमएमई के साथ एकीकृत करने के लिए। आप ऑटो स्केलिंग के साथ एमएमई को तैनात करने के लिए एनवीआईडीआईए ट्राइटन इंट्रेंस सर्वर का उपयोग कर सकते हैं, जो विभिन्न फ्रेमवर्क बैकएंड के लिए एक मॉडल रिपॉजिटरी कॉन्फ़िगरेशन बनाता है। यह सुविधा आपको सैकड़ों हाइपर-वैयक्तिकृत मॉडलों को स्केल करने की अनुमति देती है जो एआई अनुप्रयोगों में अद्वितीय अंतिम-उपयोगकर्ता अनुभवों को पूरा करने के लिए ठीक से ट्यून किए गए हैं। आप फ्रैक्शनल जीपीयू का उपयोग करके अपने अनुमान एप्लिकेशन के लिए आवश्यक मूल्य प्रदर्शन प्राप्त करने के लिए भी इस सुविधा का उपयोग कर सकते हैं। अधिक जानने के लिए, देखें Amazon SageMaker मल्टी-मॉडल एंडपॉइंट के साथ GPU पर कई डीप लर्निंग मॉडल चलाएं.

निम्नलिखित तालिका ट्राइटन अनुमान कंटेनरों पर जीपीयू समर्थन के साथ एमएमई का उपयोग करके एमएल मॉडल होस्टिंग के लिए फिटनेस कार्यों के मूल्यांकन पर मार्गदर्शन प्रदान करती है। एकल-मॉडल एंडपॉइंट और सर्वर रहित एंडपॉइंट फिटनेस फ़ंक्शन मूल्यांकन के लिए, इस पोस्ट के पिछले अनुभाग देखें।

| फिटनेस कार्य | Description |

| लागत | ट्राइटन इन्फेरेंस सर्वर का उपयोग करके जीपीयू समर्थन के साथ सेजमेकर एमएमई एक सेजमेकर एंडपॉइंट के पीछे बड़ी संख्या में गहन शिक्षण मॉडल को तैनात करने के लिए एक स्केलेबल और लागत प्रभावी तरीका प्रदान करते हैं। एमएमई के साथ, कई मॉडल एक एंडपॉइंट के पीछे जीपीयू इंस्टेंस साझा करते हैं। यह आपको कई मॉडलों की मेजबानी की रैखिक रूप से बढ़ती लागत को कम करने और सभी मॉडलों में बुनियादी ढांचे का पुन: उपयोग करने में सक्षम बनाता है। आप उदाहरण के अपटाइम के लिए भुगतान करते हैं। |

| अनुमान विलंबता |

ट्राइटन इंट्रेंस सर्वर के साथ सेजमेकर को अल्ट्रा-लो (एकल-अंक मिलीसेकंड) इंट्रेंस विलंबता के साथ थ्रूपुट और हार्डवेयर उपयोग को अधिकतम करने के उद्देश्य से बनाया गया है। इसमें समर्थित ML फ्रेमवर्क (TensorFlow, PyTorch, ONNX, XGBoost, और NVIDIA TensorRT सहित) और इन्फ्रास्ट्रक्चर बैकएंड की एक विस्तृत श्रृंखला है, जिसमें NVIDIA GPU, CPU और शामिल हैं। एडब्ल्यूएस इन्फेंटेंटिया. सेजमेकर ट्राइटन इन्फेरेंस सर्वर का उपयोग करके जीपीयू के लिए एमएमई समर्थन के साथ, आप एक सेजमेकर एंडपॉइंट के पीछे हजारों गहन शिक्षण मॉडल तैनात कर सकते हैं। सेजमेकर मॉडल को GPU त्वरित उदाहरण पर NVIDIA ट्राइटन कंटेनर की मेमोरी में लोड करता है और अनुमान अनुरोध प्रदान करता है। GPU कोर को एक उदाहरण में सभी मॉडलों द्वारा साझा किया जाता है। यदि मॉडल पहले से ही कंटेनर मेमोरी में लोड है, तो बाद के अनुरोधों को तेजी से पूरा किया जाता है क्योंकि सेजमेकर को इसे फिर से डाउनलोड और लोड करने की आवश्यकता नहीं होती है। |

| प्रवाह |

एमएमई, ट्राइटन इन्फेरेंस सर्वर के साथ एक ही समय में जीपीयू पर कई गहन शिक्षण या एमएल मॉडल चलाने की क्षमता प्रदान करते हैं। यह आपको सेजमेकर पूरी तरह से प्रबंधित मॉडल परिनियोजन के साथ सेवारत एनवीआईडीआईए ट्राइटन मल्टी-फ्रेमवर्क, उच्च-प्रदर्शन अनुमान का आसानी से उपयोग करने की अनुमति देता है। ट्राइटन सभी NVIDIA GPU-, x86-, Arm® CPU- और AWS Inferentia-आधारित अनुमान का समर्थन करता है। यह थ्रूपुट और उपयोग को अधिकतम करने के लिए गतिशील बैचिंग, समवर्ती रन, इष्टतम मॉडल कॉन्फ़िगरेशन, मॉडल संयोजन और स्ट्रीमिंग ऑडियो और वीडियो इनपुट प्रदान करता है। नेटवर्क और पेलोड आकार जैसे अन्य कारक अनुमान से जुड़े ओवरहेड में न्यूनतम भूमिका निभा सकते हैं। |

| स्केलिंग कॉन्फ़िगरेशन जटिलता |

एमएमई ऑटो स्केलिंग नीति का उपयोग करके क्षैतिज रूप से स्केल कर सकते हैं, और मेट्रिक्स के आधार पर अतिरिक्त जीपीयू गणना उदाहरणों का प्रावधान कर सकते हैं जैसे ट्राइटन अनुमान सर्वर के साथ, आप आसानी से एक कस्टम कंटेनर बना सकते हैं जिसमें ट्राइटन के साथ आपका मॉडल शामिल है और इसे सेजमेकर में ला सकते हैं। SageMaker Inference अनुरोधों को संभालेगा और उपयोग बढ़ने पर कंटेनर को स्वचालित रूप से स्केल करेगा, जिससे AWS पर ट्राइटन के साथ मॉडल परिनियोजन आसान हो जाएगा। |

| यातायात का स्वरूप |

एमएमई पूर्वानुमानित ट्रैफ़िक पैटर्न के लिए आदर्श हैं और मॉडल एक ही समापन बिंदु पर डीएजी के रूप में चलते हैं। सेजमेकर एमएमई एंडपॉइंट तक यातायात को आकार देने का ख्याल रखता है और सर्वोत्तम मूल्य प्रदर्शन के लिए जीपीयू इंस्टेंस पर इष्टतम मॉडल प्रतियां रखता है। यह ट्रैफ़िक को उस उदाहरण तक रूट करना जारी रखता है जहां मॉडल लोड किया गया है। यदि उच्च उपयोग के कारण इंस्टेंस संसाधन क्षमता तक पहुँच जाते हैं, तो सेजमेकर अधिक बार उपयोग किए जाने वाले मॉडल को लोड करने के लिए संसाधनों को मुक्त करने के लिए कंटेनर से कम से कम उपयोग किए गए मॉडल को उतार देता है। |

सर्वोत्तम प्रथाएं

निम्नलिखित सर्वोत्तम प्रथाओं पर विचार करें:

- मॉडलों के बीच उच्च सामंजस्य और कम युग्मन - मॉडलों को एक ही कंटेनर में होस्ट करें जिसमें उच्च सामंजस्य हो (एकल-व्यवसाय कार्यक्षमता को संचालित करता है) और अपग्रेड और प्रबंधन में आसानी के लिए उन्हें एक साथ समाहित करें। साथ ही, उन मॉडलों को एक-दूसरे से अलग करें (उन्हें अलग-अलग कंटेनर में रखें) ताकि आप अन्य मॉडलों को प्रभावित किए बिना एक मॉडल को आसानी से अपग्रेड कर सकें। कई मॉडलों को होस्ट करें जो एक समापन बिंदु के पीछे विभिन्न कंटेनरों का उपयोग करते हैं और फिर स्वतंत्र रूप से आह्वान करते हैं या एक सीरियल अनुमान पाइपलाइन के रूप में मॉडल प्रीप्रोसेसिंग और पोस्टप्रोसेसिंग तर्क जोड़ते हैं।

- अनुमान विलंबता - उन मॉडलों को समूहित करें जो एकल-व्यवसाय कार्यक्षमता संचालित हैं और हॉप्स की संख्या को कम करने के लिए उन्हें एक ही कंटेनर में होस्ट करें और इसलिए समग्र विलंबता को कम करें। अन्य चेतावनियाँ भी हैं, जैसे यदि समूहीकृत मॉडल एकाधिक ढाँचों का उपयोग करते हैं; आप एकाधिक कंटेनरों में होस्ट करना भी चुन सकते हैं लेकिन विलंबता को कम करने और लागत को कम करने के लिए एक ही होस्ट पर चलाएं।

- उच्च सामंजस्य के साथ तार्किक रूप से समूह एमएल मॉडल - तार्किक समूह में ऐसे मॉडल शामिल हो सकते हैं जो सजातीय हों (उदाहरण के लिए, सभी XGBoost मॉडल) या विषम (उदाहरण के लिए, कुछ XGBoost और कुछ BERT)। इसमें ऐसे मॉडल शामिल हो सकते हैं जो कई व्यावसायिक कार्यक्षमताओं में साझा किए जाते हैं या केवल एक व्यावसायिक कार्यक्षमता को पूरा करने के लिए विशिष्ट हो सकते हैं।

- साझा मॉडल - यदि तार्किक समूह में साझा मॉडल शामिल हैं, तो मॉडल को अपग्रेड करने में आसानी और विलंबता सेजमेकर एंडपॉइंट को तैयार करने में प्रमुख भूमिका निभाएगी। उदाहरण के लिए, यदि विलंबता एक प्राथमिकता है, तो एकाधिक हॉप्स से बचने के लिए सभी मॉडलों को एक ही सेजमेकर एंडपॉइंट के पीछे एक ही कंटेनर में रखना बेहतर है। नकारात्मक पक्ष यह है कि यदि किसी मॉडल को अपग्रेड करने की आवश्यकता है, तो इसके परिणामस्वरूप इस मॉडल को होस्ट करने वाले सभी प्रासंगिक सेजमेकर एंडपॉइंट को अपग्रेड करना होगा।

- गैर-साझा मॉडल - यदि तार्किक समूह में केवल व्यावसायिक सुविधा विशिष्ट मॉडल शामिल हैं और इसे अन्य समूहों के साथ साझा नहीं किया जाता है, तो पैकेजिंग जटिलता और विलंबता आयाम प्राप्त करने की कुंजी बन जाएंगे। इन मॉडलों को एक ही सेजमेकर एंडपॉइंट के पीछे एक ही कंटेनर में होस्ट करने की सलाह दी जाती है।

- हार्डवेयर का कुशल उपयोग (सीपीयू, जीपीयू) - सीपीयू-आधारित मॉडलों को एक साथ समूहित करें और उन्हें एक ही होस्ट पर होस्ट करें ताकि आप सीपीयू का कुशलतापूर्वक उपयोग कर सकें। इसी तरह, GPU-आधारित मॉडलों को एक साथ समूहित करें ताकि आप उनका कुशलतापूर्वक उपयोग और स्केल कर सकें। ऐसे हाइब्रिड वर्कलोड हैं जिनके लिए एक ही होस्ट पर सीपीयू और जीपीयू दोनों की आवश्यकता होती है। एक ही होस्ट पर सीपीयू-ओनली और जीपीयू-ओनली मॉडल को होस्ट करना उच्च सामंजस्य और एप्लिकेशन विलंबता आवश्यकताओं द्वारा संचालित होना चाहिए। इसके अतिरिक्त, लागत, स्केल करने की क्षमता, और विफलता के मामले में प्रभाव पर विस्फोट त्रिज्या ध्यान देने योग्य प्रमुख आयाम हैं।

- फिटनेस कार्य – एमएल होस्टिंग विकल्प चुनने के लिए फिटनेस फ़ंक्शंस को दिशानिर्देश के रूप में उपयोग करें।

निष्कर्ष

जब एमएल होस्टिंग की बात आती है, तो कोई एक आकार-फिट-सभी दृष्टिकोण नहीं है। एमएल अभ्यासकर्ताओं को अपनी एमएल होस्टिंग चुनौतियों का समाधान करने के लिए सही डिज़ाइन पैटर्न चुनने की आवश्यकता है। फिटनेस कार्यों का मूल्यांकन सही एमएल होस्टिंग विकल्प चुनने पर अनुदेशात्मक मार्गदर्शन प्रदान करता है।

प्रत्येक होस्टिंग विकल्प पर अधिक विवरण के लिए, इस श्रृंखला में निम्नलिखित पोस्ट देखें:

लेखक के बारे में

धवल पटेल AWS में प्रिंसिपल मशीन लर्निंग आर्किटेक्ट हैं। उन्होंने वितरित कंप्यूटिंग और आर्टिफिशियल इंटेलिजेंस से संबंधित समस्याओं पर बड़े उद्यमों से लेकर मध्यम आकार के स्टार्टअप तक के संगठनों के साथ काम किया है। वह एनएलपी और कंप्यूटर विज़न डोमेन सहित डीप लर्निंग पर ध्यान केंद्रित करता है। वह ग्राहकों को सेजमेकर पर उच्च प्रदर्शन मॉडल अनुमान प्राप्त करने में मदद करता है।

धवल पटेल AWS में प्रिंसिपल मशीन लर्निंग आर्किटेक्ट हैं। उन्होंने वितरित कंप्यूटिंग और आर्टिफिशियल इंटेलिजेंस से संबंधित समस्याओं पर बड़े उद्यमों से लेकर मध्यम आकार के स्टार्टअप तक के संगठनों के साथ काम किया है। वह एनएलपी और कंप्यूटर विज़न डोमेन सहित डीप लर्निंग पर ध्यान केंद्रित करता है। वह ग्राहकों को सेजमेकर पर उच्च प्रदर्शन मॉडल अनुमान प्राप्त करने में मदद करता है।

दीपाली राजले अमेज़ॅन वेब सर्विसेज में एआई/एमएल विशेषज्ञ तकनीकी खाता प्रबंधक हैं। वह सर्वोत्तम प्रथाओं के साथ मशीन लर्निंग समाधानों को लागू करने पर तकनीकी मार्गदर्शन प्रदान करने वाले उद्यम ग्राहकों के साथ काम करती है। अपने खाली समय में, वह लंबी पैदल यात्रा, फिल्में और परिवार और दोस्तों के साथ घूमना पसंद करती हैं।

दीपाली राजले अमेज़ॅन वेब सर्विसेज में एआई/एमएल विशेषज्ञ तकनीकी खाता प्रबंधक हैं। वह सर्वोत्तम प्रथाओं के साथ मशीन लर्निंग समाधानों को लागू करने पर तकनीकी मार्गदर्शन प्रदान करने वाले उद्यम ग्राहकों के साथ काम करती है। अपने खाली समय में, वह लंबी पैदल यात्रा, फिल्में और परिवार और दोस्तों के साथ घूमना पसंद करती हैं।

सौरभ त्रिकंडे Amazon SageMaker Inference के वरिष्ठ उत्पाद प्रबंधक हैं। उन्हें ग्राहकों के साथ काम करने का शौक है और वह मशीन लर्निंग को लोकतांत्रिक बनाने के लक्ष्य से प्रेरित हैं। वह जटिल एमएल अनुप्रयोगों, बहु-किरायेदार एमएल मॉडल, लागत अनुकूलन, और गहन शिक्षण मॉडल की तैनाती को और अधिक सुलभ बनाने से संबंधित मुख्य चुनौतियों पर ध्यान केंद्रित करता है। अपने खाली समय में, सौरभ को लंबी पैदल यात्रा, नवीन तकनीकों के बारे में सीखना, टेकक्रंच का अनुसरण करना और अपने परिवार के साथ समय बिताना पसंद है।

सौरभ त्रिकंडे Amazon SageMaker Inference के वरिष्ठ उत्पाद प्रबंधक हैं। उन्हें ग्राहकों के साथ काम करने का शौक है और वह मशीन लर्निंग को लोकतांत्रिक बनाने के लक्ष्य से प्रेरित हैं। वह जटिल एमएल अनुप्रयोगों, बहु-किरायेदार एमएल मॉडल, लागत अनुकूलन, और गहन शिक्षण मॉडल की तैनाती को और अधिक सुलभ बनाने से संबंधित मुख्य चुनौतियों पर ध्यान केंद्रित करता है। अपने खाली समय में, सौरभ को लंबी पैदल यात्रा, नवीन तकनीकों के बारे में सीखना, टेकक्रंच का अनुसरण करना और अपने परिवार के साथ समय बिताना पसंद है।

- एसईओ संचालित सामग्री और पीआर वितरण। आज ही प्रवर्धित हो जाओ।

- प्लेटोब्लॉकचैन। Web3 मेटावर्स इंटेलिजेंस। ज्ञान प्रवर्धित। यहां पहुंचें।

- स्रोत: https://aws.amazon.com/blogs/machine-learning/model-hosting-patterns-in-amazon-sagemaker-part-1-common-design-patterns-for-building-ml-applications-on-amazon-sagemaker/

- 1

- 10

- 100

- 11

- 39

- 7

- 70

- a

- क्षमता

- योग्य

- About

- त्वरित

- पहुँच

- पहुँचा

- सुलभ

- समायोजित

- लेखा

- सही

- पाना

- प्राप्त करने

- के पार

- कार्य

- सक्रिय रूप से

- इसके अलावा

- अतिरिक्त

- इसके अतिरिक्त

- पता

- उन्नत

- उन्नत

- लाभ

- विज्ञापन

- को प्रभावित

- बाद

- एकत्रीकरण

- एग्रीगेटर

- आक्रामक

- समझौतों

- AI

- ऐ / एमएल

- अलार्म

- एल्गोरिदम

- सब

- की अनुमति दे

- की अनुमति देता है

- पहले ही

- हमेशा

- वीरांगना

- अमेज़ॅन EC2

- अमेज़न SageMaker

- अमेज़ॅन वेब सेवा

- राशि

- विश्लेषण

- विश्लेषण करें

- और

- और बुनियादी ढांचे

- वार्षिक

- अन्य

- अपाचे

- एपीआई

- Apple

- आवेदन

- अनुप्रयोगों

- दृष्टिकोण

- उपयुक्त

- क्षुधा

- स्थापत्य

- एआरएम

- कृत्रिम

- कृत्रिम बुद्धिमत्ता

- पहलुओं

- मूल्यांकन

- जुड़े

- विशेषताओं

- ऑडियो

- आडिट

- स्वत:

- स्वचालित

- स्वचालित

- स्वतः

- उपलब्धता

- उपलब्ध

- औसत

- एडब्ल्यूएस

- वापस

- अस्तरवाला

- बैंकिंग

- आधार

- आधारित

- क्योंकि

- बन

- हो जाता है

- से पहले

- पीछे

- जा रहा है

- लाभ

- BEST

- सर्वोत्तम प्रथाओं

- बेहतर

- के बीच

- बायोमेडिकल

- खंड

- उधार

- सीमाओं

- मुक्केबाज़ी

- भंग

- टूटना

- लाना

- लाता है

- बजट

- निर्माण

- इमारत

- बनाया गया

- में निर्मित

- व्यापार

- व्यावसायिक अनुप्रयोग

- व्यापार प्रक्रिया

- व्यवसायों

- कैश

- परिकलित

- कॉल

- बुलाया

- कोलर

- उम्मीदवारों

- क्षमताओं

- क्षमता

- कौन

- मामला

- मामलों

- श्रेणियाँ

- का कारण बनता है

- कुछ

- प्रमाणित

- चुनौतियों

- परिवर्तन

- परिवर्तन

- विशेषताएँ

- आरोप लगाया

- chatbot

- चेक

- टुकड़ा

- चुनाव

- विकल्प

- चुनें

- चुनने

- कक्षा

- वर्गीकरण

- वर्गीकृत

- ग्राहक

- ग्राहकों

- समापन

- बादल

- समूह

- कोड

- गढ़ा

- सहयोगियों

- इकट्ठा

- का मुकाबला

- संयोजन

- गठबंधन

- संयुक्त

- सामान्य

- कंपनियों

- कंपनी

- तुलना

- पूरा

- पूरी तरह से

- जटिल

- जटिलता

- अनुपालन

- घटकों

- प्रकृतिस्थ

- समझौता

- कम्प्यूटेशनल शक्ति

- गणना करना

- कंप्यूटर

- Computer Vision

- कंप्यूटिंग

- संकल्पना

- चिंता

- समवर्ती

- विन्यास

- संबंध

- संगत

- प्रयुक्त

- उपभोक्ताओं

- कंटेनर

- कंटेनरों

- शामिल हैं

- जारी रखने के

- जारी

- निरंतर

- नियंत्रण

- मूल

- इसी

- लागत

- लागत बचत

- प्रभावी लागत

- लागत

- सका

- बनाना

- बनाता है

- महत्वपूर्ण

- महत्वपूर्ण

- वर्तमान

- रिवाज

- ग्राहक

- ग्राहक

- डेग

- तिथि

- डेटा संसाधन

- डेटा विज्ञान

- आँकड़े वाला वैज्ञानिक

- डाटाबेस

- डेटासेट

- दिन

- व्यवहार

- निर्णय

- समर्पित

- गहरा

- ध्यान लगा के पढ़ना या सीखना

- चूक

- परिभाषित करने

- उद्धार

- मांग

- मांग

- लोकतंत्रीकरण

- निर्भर करता है

- निर्भर करता है

- तैनात

- तैनात

- तैनाती

- तैनाती

- तैनाती

- डिज़ाइन

- डिजाइन पैटर्न्स

- बनाया गया

- विस्तार

- विवरण

- खोज

- निर्धारित करना

- डेवलपर

- विकास

- चित्र

- विभिन्न

- मुश्किल

- आयाम

- प्रत्यक्ष

- अलग

- वितरित

- वितरित अभिकलन

- कई

- डाक में काम करनेवाला मज़दूर

- दस्तावेजों

- नहीं करता है

- डोमेन

- dont

- नीचे

- डाउनलोड

- नकारात्मक पक्ष यह है

- संचालित

- गिरा

- छोड़ने

- दौरान

- गतिशील

- से प्रत्येक

- पूर्व

- आसान

- आसानी

- प्रभावी

- प्रभावी रूप से

- प्रभावशीलता

- क्षमता

- कुशल

- कुशलता

- प्रयास

- भी

- नष्ट

- सक्षम

- सक्षम बनाता है

- एन्क्रिप्शन

- शुरू से अंत तक

- endpoint

- अभियांत्रिकी

- इंजीनियर्स

- पर्याप्त

- सुनिश्चित

- सुनिश्चित

- उद्यम

- उद्यम

- संपूर्ण

- वातावरण

- त्रुटि

- त्रुटियाँ

- विशेष रूप से

- मूल्यांकित

- मूल्यांकन

- और भी

- कार्यक्रम

- सब कुछ

- विकास

- उदाहरण

- उदाहरण

- एक्सचेंज

- प्रदर्श

- उम्मीद

- अपेक्षित

- अनुभव

- अनुभव

- का पता लगाने

- भाव

- बाहरी

- अतिरिक्त

- चेहरा

- कारकों

- विफलता

- काफी

- परिवारों

- परिवार

- और तेज

- Feature

- विशेषताएं

- भोजन

- कुछ

- अंतिम

- प्रथम

- पहली बार

- फिटनेस

- बेड़ा

- लचीलापन

- प्रवाह

- उतार चढ़ाव

- केंद्रित

- निम्नलिखित

- इस प्रकार है

- पायाब

- प्रपत्र

- रूपों

- आंशिक

- ढांचा

- चौखटे

- धोखा

- धोखाधड़ी का पता लगाना

- मुक्त

- आवृत्ति

- अक्सर

- मित्रों

- से

- फल

- पूर्ण

- पूरी तरह से

- समारोह

- कार्यक्षमताओं

- कार्यक्षमता

- कार्यों

- आगे

- GDPR

- सामान्य जानकारी

- उत्पन्न

- सृजन

- मिल

- देना

- दी

- लक्ष्य

- लक्ष्यों

- अच्छा

- GPU

- GPUs

- ग्राफ

- महान

- अधिक से अधिक

- बहुत

- समूह

- समूह की

- आगे बढ़ें

- गाइड

- संभालना

- हैंडल

- सुविधाजनक

- हार्डवेयर

- होने

- स्वास्थ्य

- स्वास्थ्य सेवा

- मदद

- मदद

- मदद करता है

- यहाँ उत्पन्न करें

- हाई

- उच्च प्रदर्शन

- उच्च संकल्प

- उच्चतर

- मारो

- क्षैतिज

- मेजबान

- मेजबानी

- होस्टिंग

- होस्टिंग लागत

- होस्टिंग सेवाएँ

- कैसे

- तथापि

- एचटीएमएल

- HTTPS

- सैकड़ों

- संकर

- आदर्श

- पहचान

- निष्क्रिय

- की छवि

- छवि वर्गीकरण

- छवियों

- अडिग

- प्रभाव

- असर पड़ा

- Impacts

- लागू करने के

- कार्यान्वित

- कार्यान्वयन

- महत्वपूर्ण

- में सुधार

- में सुधार लाने

- in

- शामिल

- शामिल

- सहित

- आवक

- बढ़ना

- वृद्धि हुई

- बढ़ जाती है

- बढ़ती

- स्वतंत्र

- स्वतंत्र रूप से

- व्यक्ति

- करें-

- इंफ्रास्ट्रक्चर

- प्रारंभिक

- अभिनव

- नवीन प्रौद्योगिकियां

- निवेश

- स्थापित कर रहा है

- उदाहरण

- बजाय

- एकीकृत

- एकीकरण

- बुद्धि

- इंटरैक्टिव

- शामिल करना

- आईएसओ

- अलगाव

- IT

- काम

- नौकरियां

- कुंजी

- Instagram पर

- जानना

- जानने वाला

- बड़ा

- बड़ा

- विलंब

- लांच

- शुरूआत

- शुरू करने

- नेतृत्व

- प्रमुख

- बिक्रीसूत्र

- जानें

- सीख रहा हूँ

- छोड़ना

- नेतृत्व

- स्तर

- पुस्तकालयों

- उत्तोलक

- सीमित

- सीमाएं

- सूची

- जीना

- भार

- लोड हो रहा है

- भार

- स्थान

- लंबा

- लंबे समय तक

- देखिए

- हार

- लॉट

- निम्न

- मशीन

- यंत्र अधिगम

- बनाया गया

- मुख्य

- बनाए रखना

- का कहना है

- प्रमुख

- बनाना

- बनाता है

- निर्माण

- प्रबंधन

- कामयाब

- प्रबंध

- प्रबंधक

- प्रबंधन करता है

- प्रबंध

- बहुत

- विपणन (मार्केटिंग)

- गणितीय

- बात

- अधिकतम करने के लिए

- अधिकतम

- साधन

- मिलना

- याद

- तरीका

- तरीकों

- मीट्रिक

- मेट्रिक्स

- हो सकता है

- कम से कम

- न्यूनतम

- मिनटों

- मिश्रण

- ML

- मोड

- आदर्श

- मॉडल

- मॉनिटर

- निगरानी

- महीना

- महीने

- अधिक

- अधिकांश

- प्रेरित

- चलचित्र

- बहु-मॉडल समापन बिंदु

- विभिन्न

- भीड़

- प्रकृति

- आवश्यक

- आवश्यकता

- की जरूरत है

- नेटवर्क

- नया

- अगला

- NLP

- अधिसूचना

- सूचनाएं

- संख्या

- Nvidia

- वस्तु

- उद्देश्य

- उद्देश्य

- प्राप्त करने के

- प्रासंगिक

- प्रस्ताव

- ऑफर

- ऑफ़लाइन

- ONE

- ऑनलाइन

- खुला स्रोत

- संचालित

- संचालित

- परिचालन

- परिचालन

- संचालन

- ऑपरेटरों

- इष्टतम

- इष्टतमीकरण

- ऑप्टिमाइज़ करें

- अनुकूलित

- अनुकूलन

- के अनुकूलन के

- विकल्प

- ऑप्शंस

- नारंगी

- आदेश

- संगठनों

- अन्य

- बकाया

- कुल

- अपना

- स्वामित्व

- पैकेज

- पैकेजिंग

- पैरामीटर

- भाग

- विशेष

- साथी

- पारित कर दिया

- आवेशपूर्ण

- पैच

- पैटर्न

- पैटर्न उपयोग करें

- वेतन

- शिखर

- निष्पादन

- प्रदर्शन

- प्रदर्शन

- अवधि

- समय-समय

- अवधि

- निजीकरण

- निजीकृत

- चुनना

- पाइपलाइन

- जगह

- गंतव्य

- की योजना बनाई

- योजनाओं

- मंच

- प्लेटफार्म

- प्लेटो

- प्लेटो डेटा इंटेलिजेंस

- प्लेटोडाटा

- प्ले

- प्लस

- नीतियाँ

- नीति

- लोकप्रिय

- संभव

- पद

- पोस्ट

- बिजली

- अभ्यास

- प्रथाओं

- उम्मीद के मुताबिक

- की भविष्यवाणी

- भविष्यवाणी

- भविष्यवाणियों

- वरीय

- पहले से

- मूल्य

- प्रिंसिपल

- प्राथमिकता

- निजी

- मुसीबत

- समस्याओं

- प्रक्रिया

- प्रसंस्कृत

- प्रक्रियाओं

- प्रसंस्करण

- प्रोसेसर

- एस्ट्रो मॉल

- उत्पादन प्रबंधक

- उत्पादन

- उत्पाद

- प्रोफाइल

- उचित

- प्रदान करना

- बशर्ते

- प्रदान करता है

- प्रदान कर

- प्रावधान

- प्रतिनिधि

- उद्देश्य

- धक्का

- pytorch

- जल्दी से

- रेंज

- लेकर

- तेजी

- मूल्यांकन करें

- दरें

- पहुंच

- पहुँचती है

- पढ़ना

- तैयार

- वास्तविक

- असली दुनिया

- वास्तविक समय

- प्राप्त करना

- प्राप्त

- प्राप्त

- की सिफारिश

- सिफारिश

- सिफारिशें

- की सिफारिश की

- की सिफारिश

- की सिफारिश की

- आवर्ती

- को कम करने

- कम कर देता है

- संदर्भित करता है

- भले ही

- नियमित

- सम्बंधित

- विज्ञप्ति

- प्रासंगिक

- बाकी है

- कोष

- प्रतिनिधित्व

- का प्रतिनिधित्व करता है

- का अनुरोध

- अनुरोधों

- की आवश्यकता होती है

- अपेक्षित

- आवश्यकता

- आवश्यकताएँ

- की आवश्यकता होती है

- संसाधन

- उपयुक्त संसाधन चुनें

- प्रतिक्रिया

- बाकी

- परिणाम

- जिसके परिणामस्वरूप

- परिणाम

- खुदरा

- रिटर्न

- की समीक्षा

- जोखिम

- भूमिका

- जड़

- मार्ग

- नियम

- रन

- दौड़ना

- सास

- sagemaker

- सेजमेकर अनुमान

- वेतन

- वही

- सहेजें

- बचत

- बचत

- स्केलेबल

- स्केल

- तराजू

- स्केलिंग

- परिदृश्यों

- अनुसूची

- अनुसूचित

- विज्ञान

- वैज्ञानिक

- दूसरा

- सेकंड

- अनुभाग

- वर्गों

- सुरक्षित रूप से

- सुरक्षा

- का चयन

- चयन

- वरिष्ठ

- संवेदनशील

- अनुक्रम

- धारावाहिक

- कई

- सेवा

- serverless

- सर्वर

- कार्य करता है

- सेवा

- सेवाएँ

- सेवारत

- सेट

- की स्थापना

- कई

- आकार देने

- Share

- साझा

- परिवर्तन

- चाहिए

- दिखाता है

- महत्वपूर्ण

- काफी

- समान

- उसी प्रकार

- सरल

- एक

- आकार

- आकार

- छोटा

- छोटे

- So

- सॉफ्टवेयर

- समाधान

- समाधान ढूंढे

- कुछ

- सूत्रों का कहना है

- अंतरिक्ष

- विशेषज्ञ

- विशेषीकृत

- विशिष्ट

- विशेष रूप से

- विनिर्दिष्ट

- गति

- खर्च

- spikes के

- स्थिर

- धुआँरा

- ढेर

- प्रारंभ

- शुरू

- शुरू होता है

- स्टार्टअप

- स्टार्टअप

- स्थिर

- कदम

- कदम

- फिर भी

- बंद हो जाता है

- भंडारण

- की दुकान

- रणनीतियों

- स्ट्रीमिंग

- कठोर

- दृढ़ता से

- आगामी

- सफलता

- सफल

- ऐसा

- पर्याप्त

- उपयुक्त

- समर्थन

- समर्थित

- समर्थन करता है

- रेला

- तालिका

- लेना

- लेता है

- लक्ष्य

- लक्षित

- कार्य

- कार्य

- टीम

- टीमों

- TechCrunch

- तकनीकी

- टेक्नोलॉजीज

- किरायेदार

- tensorflow

- परीक्षण

- परीक्षण

- RSI

- लेकिन हाल ही

- अपने

- जिसके चलते

- इसलिये

- हजारों

- तीन

- द्वार

- यहाँ

- भर

- THROUGHPUT

- पहर

- बार

- सेवा मेरे

- एक साथ

- भी

- साधन

- कुल

- टी पी एस

- ट्रैकिंग

- यातायात

- रेलगाड़ी

- प्रशिक्षित

- प्रशिक्षण

- लेन-देन संबंधी

- लेनदेन

- बदालना

- परिवर्तन

- बदलने

- पारगमन

- पारदर्शी

- ट्रिगर

- नरमीन

- मोड़

- प्रकार

- ठेठ

- आम तौर पर

- के अंतर्गत

- आधारभूत

- समझना

- अद्वितीय

- इकाइयों

- अप्रत्याशित

- अप्रयुक्त

- अपडेट

- अपडेट

- उन्नयन

- उन्नत

- उपरिकाल

- प्रयोग

- उपयोग

- उदाहरण

- उपयोगकर्ता

- उपयोगकर्ताओं

- आमतौर पर

- उपयोग

- उपयोग किया

- सत्यापित करें

- मूल्य

- मान

- प्रकार

- विभिन्न

- के माध्यम से

- वीडियो

- वीडियो

- देखें

- वास्तविक

- दृष्टि

- आयतन

- वोट

- वोट

- बेकार

- वेब

- वेब सेवाओं

- सप्ताह

- क्या

- एचएमबी क्या है?

- कौन कौन से

- जब

- चौड़ा

- विस्तृत श्रृंखला

- मर्जी