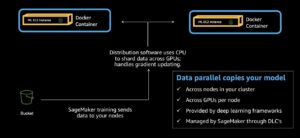

Az elmúlt évek elképesztő növekedést mutattak a mély tanulási neurális hálózatok (DNN-ek) terén. Ez a növekedés megmutatkozik a pontosabb modellekben, sőt új lehetőségeket is nyit a generatív mesterséges intelligencia révén: a természetes nyelvet szintetizáló nagy nyelvi modellekben (LLM), szöveg-kép generátorokban stb. A DNN-ek ezen megnövekedett képességei a hatalmas modellek költségével járnak, amelyek képzéséhez jelentős számítási erőforrások szükségesek. Az elosztott képzés ezt a problémát két technikával kezeli: az adatok párhuzamosságával és a modell párhuzamosságával. Az adatpárhuzamot arra használják, hogy a képzési folyamatot több csomóponton és dolgozón át skálázzák, a modell-párhuzamosság pedig felosztja a modellt, és a kijelölt infrastruktúrára illeszti őket. Amazon SageMaker elosztott képzés A jobok segítségével egyetlen kattintással (vagy egy API-hívással) létrehozhat egy elosztott számítási klasztert, betaníthat egy modellt, és elmentheti az eredményt Amazon egyszerű tárolási szolgáltatás (Amazon S3), és állítsa le a fürtöt, ha kész. Ezenkívül a SageMaker folyamatosan újított az elosztott képzési területen, és olyan funkciókat indított el, mint pl heterogén klaszterek és kiosztott oktatókönyvtárak számára adatok párhuzamossága és a modell párhuzamosság.

Az elosztott környezetben való hatékony képzéshez a hiperparaméterek módosítása szükséges. A több GPU-n való oktatás során a bevált gyakorlat gyakori példája a köteg (vagy mini köteg) méretének megszorzása a GPU-számmal annak érdekében, hogy GPU-nként ugyanaz a kötegméret maradjon. A hiperparaméterek módosítása azonban gyakran befolyásolja a modell konvergenciáját. Ezért az elosztott képzésnek három tényezőt kell egyensúlyba hoznia: az eloszlást, a hiperparamétereket és a modell pontosságát.

Ebben a bejegyzésben megvizsgáljuk az elosztott képzés hatását a konvergenciára és a felhasználás módját Amazon SageMaker automatikus modellhangolás a modell hiperparamétereinek finomhangolása az elosztott képzéshez adatpárhuzamot használva.

Az ebben a bejegyzésben említett forráskód megtalálható a GitHub tárház (ajánlott egy m5.xlarge példány).

Növelje a képzést egyetlen környezetről elosztott környezetre

Az adatok párhuzamossága egy módja annak, hogy a képzési folyamatot több számítási erőforrásra méretezzük, és gyorsabb képzési időt érjünk el. Az adatok párhuzamosságával az adatok particionálva vannak a számítási csomópontok között, és mindegyik csomópont a partíciójuk alapján számítja ki a gradienseket, és frissíti a modellt. Ezeket a frissítéseket egy vagy több paraméteres kiszolgáló használatával lehet elvégezni aszinkron, egy a többhez vagy az összeshez módban. Egy másik lehetőség az AllReduce algoritmus használata. Például a ring-all-redduce algoritmusban minden csomópont csak két szomszédos csomópontjával kommunikál, ezáltal csökkentve a teljes adatátvitelt. Ha többet szeretne megtudni a paraméterkiszolgálókról és a ring-allreduce funkcióról, lásd: A TensorFlow elosztott képzések egyszerű elindítása a Horovod vagy a Parameter Servers segítségével az Amazon SageMakerben. Ami az adatparticionálást illeti, ha van ilyen n csomópontok kiszámítása, akkor minden csomópontnak meg kell kapnia az adatok egy részhalmazát, körülbelül 1/n méretben.

Két egyszerű kísérletet hajtunk végre, hogy bemutassuk a kiegyenlített képzés modellkonvergenciára gyakorolt hatását:

Minden modellképzés kétszer futott le: egyetlen példányon és több példányon elosztva. A DNN elosztott képzéshez az elosztott processzorok teljes kihasználása érdekében a mini köteg méretét megszoroztuk a példányok számával (négy). Az alábbi táblázat összefoglalja a beállítást és az eredményeket.

| Probléma típusa | Képosztályozás | Bináris osztályozás | ||

| Modell | DNN | XGBoost | ||

| Példa | ml.c4.xnagy | ml.m5.2xnagy | ||

| Adatkészlet |

(Címkézett képek) |

Direkt marketing (táblázatos, numerikus és vektoros kategóriák) |

||

| Érvényesítési mérőszám | Pontosság | AUC | ||

| Epocs/Kör | 20 | 150 | ||

| Példányok száma | 1 | 4 | 1 | 3 |

| Elosztás típusa | N / A | Paraméter szerver | N / A | AllReduce |

| Edzésidő (perc) | 8 | 3 | 3 | 1 |

| Végső érvényesítési pontszám | 0.97 | 0.11 | 0.78 | 0.63 |

Mindkét modell esetében a képzési időt szinte lineárisan csökkentette az eloszlási tényező. A modellkonvergencia azonban jelentős visszaesést szenvedett el. Ez a viselkedés konzisztens a két különböző modellnél, a különböző számítási példányoknál, a különböző terjesztési módszereknél és a különböző adattípusoknál. Tehát miért befolyásolta a modell pontosságát a képzési folyamat elosztása?

Számos elmélet próbálja megmagyarázni ezt a hatást:

- Ha a tenzorfrissítések nagy méretűek, a dolgozók és a paraméterkiszolgáló közötti forgalom torlódást okozhat. Emiatt az aszinkron paraméter-kiszolgálók lényegesen rosszabb konvergenciát szenvednek el a súlyozási frissítések késése miatt [1].

- A köteg méretének növelése túlillesztéshez és rossz általánosításhoz vezethet, ami csökkenti az érvényesítési pontosságot [2].

- A modellparaméterek aszinkron frissítésekor előfordulhat, hogy egyes DNN-ek nem a legutóbb frissített modellsúlyokat használják; ezért a gradienseket néhány iterációval elmaradó súlyok alapján fogják kiszámítani. Ez súlyelhasználódáshoz [3] vezet, és számos ok okozhatja.

- Egyes hiperparaméterek modell- vagy optimalizálóspecifikusak. Például az XGBoost hivatalos dokumentációja azt mondja, hogy a

exactérték atree_modehiperparaméter nem támogatja az elosztott képzést, mert az XGBoost sorfelosztó adatelosztást alkalmaz, míg aexactA fa módszer rendezett oszlopformátumon működik. - Egyes kutatók azt javasolták, hogy egy nagyobb mini-tétel konfigurálása kisebb sztochaszticitású gradiensekhez vezethet. Ez akkor fordulhat elő, ha a veszteségfüggvény lokális minimumokat és nyeregpontokat tartalmaz, és nem történik változás a lépésméretben, az optimalizálás elakad az ilyen lokális minimumokban vagy nyeregpontokban [4].

Optimalizálja az elosztott képzést

A hiperparaméter-optimalizálás (HPO) a tanulási algoritmus számára optimális hiperparaméter-készlet keresésének és kiválasztásának folyamata. A SageMaker Automatic Model Tuning (AMT) a HPO-t felügyelt szolgáltatásként biztosítja azáltal, hogy több képzési feladatot futtat a megadott adatkészleten. A SageMaker AMT megkeresi az Ön által megadott hiperparaméter-tartományokat, és a legjobb értékeket adja vissza, az Ön által kiválasztott mérőszámmal mérve. Használhatja a SageMaker AMT-t a beépített algoritmusokkal, vagy használhatja egyéni algoritmusait és tárolóit.

Az elosztott képzésre való optimalizálás azonban eltér a hagyományos HPO-tól, mivel ahelyett, hogy képzési feladatonként egyetlen példányt indítana el, minden feladat egy példánycsoportot indít el. Ez nagyobb hatást jelent a költségekre (különösen, ha figyelembe vesszük a költséges GPU-gyorsítású példányokat, amelyek jellemzőek a DNN-re). Továbbá AMT limitek, esetleg megüthetnéd SageMaker fiókkorlátok egyidejű számú képzési példányhoz. Végül a fürtök elindítása működési többletköltséget jelenthet a hosszabb kezdési idő miatt. A SageMaker AMT speciális funkciókkal rendelkezik ezeknek a problémáknak a megoldására. Hipersáv korai leállással biztosítja, hogy a jól teljesítő hiperparaméter-konfigurációk finomhangolásra kerüljenek, és az alulteljesítőket automatikusan leállítsák. Ez lehetővé teszi a képzési idő hatékony felhasználását és csökkenti a felesleges költségeket. Ezenkívül a SageMaker AMT teljes mértékben támogatja az Amazon EC2 spot példányok használatát, amelyek optimalizálhatják a képzési költség akár 90% igény szerinti példányok felett. Ami a hosszú indítási időt illeti, a SageMaker AMT automatikusan újrafelhasználja a betanítási példányokat minden egyes hangolási munkán belül, ezáltal csökkentve az egyes hangolási munkák átlagos indítási idejét. képzési munka 20-szorosával. Ezenkívül követnie kell Az AMT legjobb gyakorlatai, mint például a releváns hiperparaméterek, azok megfelelő tartományai és skálái, valamint az egyidejű képzési feladatok legjobb száma, valamint véletlenszerű mag beállítása az eredmények reprodukálásához.

A következő részben ezeket a funkciókat láthatjuk működés közben, miközben konfigurálunk, futtatunk és elemezünk egy AMT-feladatot a korábban tárgyalt XGBoost példával.

Hangolási feladat konfigurálása, futtatása és elemzése

Mint korábban említettük, a forráskód megtalálható a GitHub repo. Az 1–5. lépésben letöltjük és előkészítjük az adatokat, létrehozzuk a xgb3 becslő (az elosztott XGBoost becslő három példány használatára van beállítva), futtassa a betanítási feladatokat, és figyelje meg az eredményeket. Ebben a részben leírjuk, hogyan kell beállítani a hangolási feladatot az adott becslőhöz, feltételezve, hogy már végigment az 1–5. lépéseken.

A hangolási feladatok optimális hiperparamétereket számítanak ki az általa elindított betanítási feladatokhoz egy metrika segítségével a teljesítmény értékelésére. tudsz állítsa be a saját mérőszámát, amelyet a SageMaker az Ön által konfigurált és kibocsátott reguláris kifejezések alapján értelmez stdout, vagy használja a mérőszámait SageMaker beépített algoritmusok. Ebben a példában a beépített XGBoost objektív mérőszám, így nem kell reguláris kifejezést konfigurálnunk. A modellkonvergenciára való optimalizáláshoz az érvényesítési AUC-mutató alapján optimalizálunk:

Hét hiperparamétert hangolunk:

- kerek_szám – Az edzés alatti erősítés köreinek száma.

- eta – A frissítéseknél alkalmazott lépcsős zsugorodás a túlillesztés megelőzésére.

- alfa – L1 szabályzási kifejezés a súlyoknál.

- min_gyerek_súly – A gyermeknél szükséges legkisebb példánysúly összege (hessian). Ha a fa partíciós lépése olyan levélcsomópontot eredményez, amelynek példánysúlyának összege kisebb, mint

min_child_weight, az építési folyamat feladja a további particionálást. - maximális mélység – A fa maximális mélysége.

- colsample_bylevel – Az oszlopok alminta aránya minden felosztáshoz, minden szinten. Ez a részmintavétel minden egyes fában elért új mélységszinthez egyszer megtörténik.

- colsample_bytree – Oszlopok alminta-aránya az egyes fák felépítésénél. Minden megépített fánál egyszer megtörténik a részmintavétel.

Ha többet szeretne megtudni az XGBoost hiperparaméterekről, lásd: XGBoost hiperparaméterek. A következő kód a hét hiperparamétert és azok tartományát mutatja:

Ezt követően biztosítjuk a konfiguráció a hipersávos stratégiához és a tuner objektum konfigurációja a SageMaker SDK használatával. HyperbandStrategyConfig két paramétert használhat: max_resource (opcionális) a cél elérése érdekében egy képzési munkához felhasználható iterációk maximális számához, és min_resource – a képzési feladat által a képzés leállítása előtt felhasználandó iterációk minimális száma. Használjuk HyperbandStrategyConfig konfigurálni StrategyConfig, amelyet később a hangolási feladat definíciója használ. Lásd a következő kódot:

Most létrehozunk a HyperparameterTuner objektum, amelyhez a következő információkat adjuk át:

- Az XGBoost becslő, amely három példányban fut

- Az objektív mérőszám neve és meghatározása

- Hiperparaméter tartományaink

- Erőforrás-konfigurációk hangolása, például a futtatandó oktatási feladatok száma összesen és hány képzési feladat futtatható párhuzamosan

- Hyperband beállítások (az utolsó lépésben konfigurált stratégia és konfiguráció)

- Korai megállás (

early_stopping_type) állítvaOff

Miért állítjuk a korai megállást Off értékre? A betanítási feladatok korán leállíthatók, ha nem valószínű, hogy javítják a hiperparaméter-hangolási feladat objektív mérőszámát. Ez csökkentheti a számítási időt, és elkerülheti a modell túlillesztését. A Hyperband azonban fejlett beépített mechanizmust használ a korai leállításhoz. Ezért a paraméter early_stopping_type értékre kell állítani Off a Hyperband belső korai leállítás funkció használatakor. Lásd a következő kódot:

Végül elindítjuk az automatikus modellhangolási munkát a megfelelő módszer. Ha aszinkron módon szeretné elindítani a munkát, állítsa be wait nak nek False. Lásd a következő kódot:

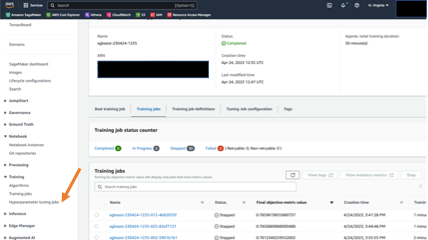

A munka előrehaladását és összefoglalóját a SageMaker konzolon követheti nyomon. A navigációs ablakban a Képzések, választ Hiperparaméter hangolási munkák, majd válassza ki a megfelelő hangolási munkát. A következő képernyőképen a hangolási feladat látható, a betanítási feladatok állapotának és teljesítményének részleteivel.

A hangolási munka végeztével áttekinthetjük az eredményeket. A jegyzetfüzet példájában megmutatjuk, hogyan nyerhet ki eredményeket a SageMaker SDK használatával. Először is megvizsgáljuk, hogy a hangolási munka hogyan növelte a modellkonvergenciát. Csatolhatja a HyperparameterTuner objektumot a feladat nevével, és hívja meg a leírni módszer. A metódus a hangolási feladat metaadatait és eredményeit tartalmazó szótárat ad vissza.

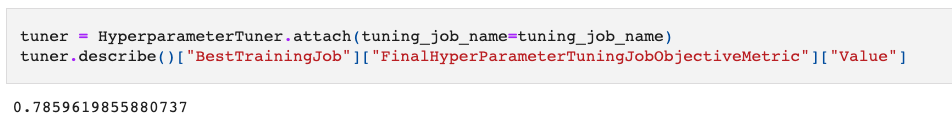

A következő kódban lekérjük a legjobban teljesítő képzési feladat értékét, amelyet az objektív mérőszámunkkal (érvényesítési AUC) mérünk:

Az eredmény 0.78 az AUC-ban az érvényesítési halmazon. Ez jelentős előrelépés a kezdeti 0.63-hoz képest!

Ezután nézzük meg, milyen gyorsan futott az edzésmunkánk. Ehhez használjuk a HyperparameterTuningJobAnalytics módszert az SDK-ban a hangolási feladattal kapcsolatos eredmények lekéréséhez, és a Pandas adatkeretbe való beolvasásához elemzés és megjelenítés céljából:

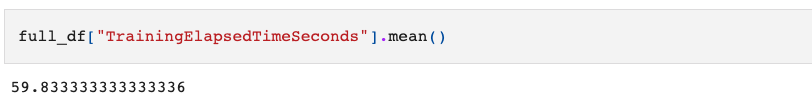

Nézzük meg, hogy átlagosan mennyi időt vett igénybe egy képzési munka a Hyperband stratégiával:

Az átlagos idő körülbelül 1 percet vett igénybe. Ez összhangban van a Hyperband stratégiai mechanizmussal, amely korán leállítja az alulteljesítő képzési feladatokat. Ami a költségeket illeti, a tuningmunka összesen 30 perc edzésidőt rótt ki ránk. A Hyperband korai leállítása nélkül a teljes számlázható képzési időtartam 90 perc volt (30 munka * 1 perc munkánként * 3 alkalom munkánként). Ez háromszor jobb költségmegtakarítást jelent! Végül azt látjuk, hogy a hangolási munka 30 képzési feladatot futtatott, és összesen 12 percet vett igénybe. Ez közel 50%-kal kevesebb a várható időhöz képest (30 munka/4 munka párhuzamosan * munkánként 3 perc).

Következtetés

Ebben a bejegyzésben leírtunk néhány megfigyelt konvergencia problémát az elosztott környezetekkel rendelkező modellek betanítása során. Láttuk, hogy a SageMaker AMT a Hyperband használatával megoldotta azokat a fő aggályokat, amelyeket az adatok párhuzamos elosztott képzése vezetett be: konvergencia (ami több mint 10%-kal javult), működési hatékonyság (a hangolási munka 50%-kal kevesebb időt vett igénybe, mint egy szekvenciális, nem optimalizált feladat költséghatékonyság (30 vs. a 90 számlázható perc képzési munkaidő). Eredményeinket az alábbi táblázat foglalja össze:

| Fejlesztési mérőszám | Nincs hangolás/naiv modellhangolás megvalósítása | SageMaker hipersávos automatikus modellhangolás | Mért javulás |

| Modell minőség (Érvényesítési AUC alapján mérve) |

0.63 | 0.78 | 15% |

| Költség (Számlázható edzéspercekben mérve) |

90 | 30 | 66% |

| Működési hatékonyság (A teljes működési idő alapján mérve) |

24 | 12 | 50% |

A méretezés (fürtméret) finomhangolása érdekében megismételheti a hangolási feladatot több fürtkonfigurációval, és összehasonlíthatja az eredményeket, hogy megtalálja az optimális hiperparamétereket, amelyek kielégítik a sebességet és a modell pontosságát.

Ennek eléréséhez szükséges lépéseket a cikk utolsó részében foglaltuk össze jegyzetfüzet.

Referenciák

[1] Lian, Xiangru és mtsai. "Aszinkron decentralizált párhuzamos sztochasztikus gradiens süllyedés." Nemzetközi Gépi tanulási Konferencia. PMLR, 2018.

[2] Keskar, Nitish Shirish et al. "A mélytanulás nagy tételes képzéséről: Általánosítási rés és éles minimumok." arXiv preprint arXiv: 1609.04836 (2016).

[3] Dai, Wei et al. „Az elavultság hatásának megértése felé az elosztott gépi tanulásban.” arXiv preprint arXiv: 1810.03264 (2018).

[4] Dauphin, Yann N. et al. "A nyeregpont-probléma azonosítása és megtámadása a nagy dimenziós nem-konvex optimalizálásban." A neurális információfeldolgozó rendszerek fejlődése 27 (2014).

A szerzőről

Uri Rosenberg európai, közel-keleti és afrikai mesterséges intelligenciára és ML-re szakosodott műszaki menedzser. Az izraeli székhelyű Uri azon dolgozik, hogy a vállalati ügyfeleket képessé tegye az ML munkaterhelések méretarányos tervezésére, építésére és üzemeltetésére. Szabadidejében szeret biciklizni, kirándulni, panaszkodni az adatok előkészítésére.

Uri Rosenberg európai, közel-keleti és afrikai mesterséges intelligenciára és ML-re szakosodott műszaki menedzser. Az izraeli székhelyű Uri azon dolgozik, hogy a vállalati ügyfeleket képessé tegye az ML munkaterhelések méretarányos tervezésére, építésére és üzemeltetésére. Szabadidejében szeret biciklizni, kirándulni, panaszkodni az adatok előkészítésére.

- SEO által támogatott tartalom és PR terjesztés. Erősödjön még ma.

- PlatoData.Network Vertical Generative Ai. Erősítse meg magát. Hozzáférés itt.

- PlatoAiStream. Web3 Intelligence. Felerősített tudás. Hozzáférés itt.

- PlatoESG. Autóipar / elektromos járművek, Carbon, CleanTech, Energia, Környezet, Nap, Hulladékgazdálkodás. Hozzáférés itt.

- BlockOffsets. A környezetvédelmi ellentételezési tulajdon korszerűsítése. Hozzáférés itt.

- Forrás: https://aws.amazon.com/blogs/machine-learning/effectively-solve-distributed-training-convergence-issues-with-amazon-sagemaker-hyperband-automatic-model-tuning/

- :van

- :is

- :nem

- $ UP

- 1

- 10

- 100

- 12

- 15%

- 20

- 200

- 2014

- 2016

- 2018

- 24

- 27

- 30

- 7

- 8

- 9

- a

- Rólunk

- Fiók

- pontosság

- pontos

- Elérése

- Akció

- tulajdonképpen

- mellett

- Ezen kívül

- cím

- címek

- fejlett

- érint

- Afrika

- AI

- AL

- algoritmus

- algoritmusok

- Alpha

- már

- Is

- elképesztő

- amazon

- Amazon EC2

- Amazon SageMaker

- Az Amazon Web Services

- között

- an

- elemzés

- analitika

- elemez

- és a

- Másik

- api

- alkalmaz

- megfelelő

- körülbelül

- VANNAK

- AS

- At

- csatolja

- Támadó

- Automatikus

- automatikusan

- átlagos

- elkerülése érdekében

- AWS

- Egyenleg

- alapján

- BE

- mert

- előtt

- viselkedés

- mögött

- BEST

- Jobb

- között

- Nagy

- fellendítése

- mindkét

- épít

- Épület

- beépített

- by

- kiszámítása

- hívás

- hívás

- TUD

- Kaphat

- képességek

- kategóriák

- okozott

- változik

- töltött

- gyermek

- A pop-art design, négy időzóna kijelzése egyszerre és méretének arányai azok az érvek, amelyek a NeXtime Time Zones-t kiváló választássá teszik. Válassza a

- választja

- kettyenés

- Fürt

- kód

- Oszlop

- Oszlopok

- hogyan

- Közös

- összehasonlítani

- teljes

- Kiszámít

- aggodalmak

- egyidejű

- Konferencia

- Configuration

- konfigurálva

- Fontolja

- következetes

- Konzol

- építése

- Konténerek

- tartalmaz

- folyamatosan

- Konvergencia

- Költség

- drága

- kiadások

- tudott

- teremt

- szokás

- Ügyfelek

- DAI

- dátum

- Adatok előkészítése

- decentralizált

- mély

- mély tanulás

- definíció

- késedelmek

- bizonyítani

- mélység

- leírni

- leírt

- Design

- kijelölt

- részletek

- DID

- különböző

- tárgyalt

- megosztott

- elosztott képzés

- elosztó

- terjesztés

- do

- dokumentáció

- Nem

- csinált

- ne

- le-

- letöltés

- Csepp

- két

- időtartama

- alatt

- E&T

- minden

- Korábban

- Korai

- könnyen

- Keleti

- hatás

- hatékonyan

- hatékonyság

- hatékony

- alkalmaz

- képessé

- lehetővé

- lehetővé teszi

- biztosítja

- Vállalkozás

- Környezet

- környezetek

- különösen

- Európa

- értékelni

- Még

- Minden

- megvizsgálni

- példa

- várható

- kísérletek

- Magyarázza

- feltárása

- kivonat

- tényező

- tényezők

- Divat

- GYORS

- gyorsabb

- Funkció

- Jellemzők

- kevés

- Végül

- Találjon

- vezetéknév

- megfelelő

- következik

- következő

- A

- formátum

- talált

- négy

- KERET

- ból ből

- teljesen

- funkció

- további

- Továbbá

- rés

- nemző

- Generatív AI

- generátorok

- kap

- szerzés

- ad

- jó

- GPU

- GPU

- színátmenetek

- nagyobb

- Növekedés

- történik

- Legyen

- tekintettel

- he

- segít

- övé

- Találat

- Hogyan

- How To

- azonban

- HTML

- http

- HTTPS

- Hiperparaméter hangolás

- if

- képek

- Hatás

- Hatások

- javul

- javított

- javulás

- in

- beleértve

- <p></p>

- információ

- Infrastruktúra

- kezdetben

- példa

- helyette

- belső

- bele

- bevezet

- Bevezetett

- Izrael

- kérdések

- IT

- iterációk

- ITS

- Munka

- Állások

- Tart

- L1

- nyelv

- nagy

- nagyobb

- keresztnév

- a későbbiekben

- indít

- elindítja

- indítás

- vezet

- vezetékek

- TANUL

- tanulás

- kevesebb

- szint

- könyvtárak

- mint

- helyi

- Hosszú

- hosszabb

- le

- gép

- gépi tanulás

- készült

- Fő

- sikerült

- menedzser

- sok

- tömeges

- maximális

- Lehet..

- eszközök

- mechanizmus

- említett

- Metaadatok

- módszer

- mód

- metrikus

- Metrics

- Középső

- Közel-Kelet

- esetleg

- minimum

- perc

- Perc

- ML

- modell

- modellek

- több

- a legtöbb

- többszörös

- szorozva

- kell

- név

- Természetes

- Navigáció

- Szükség

- szükséges

- igények

- hálózatok

- neurális hálózatok

- Új

- következő

- nem

- csomópont

- csomópontok

- jegyzetfüzet

- szám

- tárgy

- célkitűzés

- megfigyelni

- of

- kedvezmény

- hivatalos

- gyakran

- on

- Igény szerint

- egyszer

- ONE

- csak

- nyitás

- működik

- operatív

- optimálisan

- optimalizálás

- Optimalizálja

- optimalizálása

- or

- érdekében

- mi

- ki

- felett

- átfogó

- saját

- pandák

- üvegtábla

- Párhuzamos

- paraméter

- paraméterek

- elhalad

- mert

- teljesítmény

- Hely

- Plató

- Platón adatintelligencia

- PlatoData

- pont

- pont

- szegény

- lehetőségek

- esetleg

- állás

- gyakorlat

- előkészítés

- Készít

- megakadályozása

- Probléma

- folyamat

- feldolgozás

- processzorok

- Haladás

- javasolt

- ad

- feltéve,

- biztosít

- véletlen

- hányados

- elérte

- Olvass

- miatt

- új

- ajánlott

- csökkenteni

- Csökkent

- csökkenti

- csökkentő

- tekintetében

- regex

- ismétlés

- szükség

- megköveteli,

- kutatók

- forrás

- Tudástár

- eredményez

- Eredmények

- Visszatér

- Kritika

- fordulóban

- SOR

- futás

- futás

- sagemaker

- SageMaker automatikus modellhangolás

- azonos

- Megtakarítás

- látta

- azt mondja,

- SC

- Skála

- Mérleg

- skálázás

- sdk

- keres

- Rész

- lát

- mag

- látott

- kiválasztása

- Szerverek

- szolgáltatás

- Szolgáltatások

- készlet

- beállítás

- beállítások

- felépítés

- hét

- éles

- kellene

- előadás

- mutatott

- Műsorok

- Állítsa le

- jelentős

- jelentősen

- Egyszerű

- egyetlen

- Méret

- So

- SOLVE

- néhány

- forrás

- forráskód

- Hely

- szakember

- különleges

- sebesség

- osztott

- szakadások

- Spot

- kezdet

- Kezdve

- indítás

- Állapot

- Lépés

- Lépései

- megállt

- megállítás

- Leállítja

- tárolás

- Stratégia

- ilyen

- elszenvedett

- ÖSSZEFOGLALÓ

- támogatás

- Támogatja

- táblázat

- meghozott

- tart

- Műszaki

- technikák

- tensorflow

- kifejezés

- feltételek

- mint

- hogy

- A

- The Source

- azok

- Őket

- akkor

- Ott.

- ezáltal

- ebből adódóan

- Ezek

- ők

- ezt

- azok

- három

- Keresztül

- idő

- alkalommal

- nak nek

- vett

- Végösszeg

- forgalom

- Vonat

- kiképzett

- Képzések

- transzferek

- fa

- megpróbál

- Kétszer

- kettő

- típusok

- tipikus

- alatt

- megértés

- valószínűtlen

- felesleges

- frissítve

- Frissítés

- frissítése

- us

- használ

- használt

- használ

- segítségével

- hasznosít

- érvényesítés

- érték

- Értékek

- megjelenítés

- vs

- akar

- volt

- Út..

- we

- háló

- webes szolgáltatások

- súly

- ment

- amikor

- mivel

- ami

- miért

- Wikipedia

- lesz

- val vel

- belül

- nélkül

- dolgozók

- művek

- rosszabb

- lenne

- XGBoost

- év

- te

- A te

- zephyrnet