A generatív mesterséges intelligencia modellek az elmúlt hónapokban gyors növekedést mutattak a valósághű szövegek, képek, kódok és hangok létrehozására szolgáló lenyűgöző képességeik miatt. Ezek közül a modellek közül a Stable Diffusion modellek kiemelkednek egyedülálló erejével a szöveges felszólítások alapján készült kiváló minőségű képek létrehozásában. A Stabil diffúzió sokféle kiváló minőségű képet készíthet, beleértve a valósághű portrékat, tájképeket és még absztrakt művészeteket is. Más generatív AI-modellekhez hasonlóan a stabil diffúziós modellek is nagy teljesítményű számítástechnikát igényelnek az alacsony késleltetésű következtetések levonásához.

Ebben a bejegyzésben bemutatjuk, hogyan futtathat Stable Diffusion modelleket és érhet el nagy teljesítményt a legalacsonyabb költséggel Amazon rugalmas számítási felhő (Amazon EC2) segítségével Amazon EC2 Inf2 példányok powered by AWS Inferentia2. Megnézzük a stabil diffúziós modell architektúráját, és végigjárjuk a stabil diffúziós modell összeállításának lépéseit a AWS Neuron és üzembe helyezi egy Inf2 példányban. Megvitatjuk azokat az optimalizálásokat is, amelyeket a Neuron SDK automatikusan végrehajt a teljesítmény javítása érdekében. Az AWS Inferentia2.1-n költséghatékonyan futtathatja a Stable Diffusion 1.5-es és 2-ös verzióit is. Végül bemutatjuk, hogyan telepíthet Stable Diffusion modellt egy Inf2-példányra Amazon SageMaker.

A Stable Diffusion 2.1 modell mérete lebegőpontos 32-ben (FP32) 5 GB és 2.5 GB bfoat16-ban (BF16). Egyetlen inf2.xlarge példány egy AWS Inferentia2 gyorsítóval rendelkezik 32 GB HBM memóriával. A Stable Diffusion 2.1 modell egyetlen inf2.xlarge példányon elfér. A Stable Diffusion egy szöveg-kép modell, amellyel különböző stílusú és tartalmú képeket hozhat létre, egyszerűen szöveges bevitellel. Ha többet szeretne megtudni a Stable Diffusion modell architektúráról, lásd: Hozzon létre kiváló minőségű képeket a Stable Diffusion modellekkel, és telepítse azokat költséghatékonyan az Amazon SageMaker segítségével.

Hogyan optimalizálja a Neuron SDK a stabil diffúziós teljesítményt

Mielőtt telepíthetnénk a Stable Diffusion 2.1 modellt AWS Inferentia2 példányokon, össze kell fordítanunk a modell összetevőit a Neuron SDK. A Neuron SDK, amely mély tanulási fordítót, futtatókörnyezetet és eszközöket tartalmaz, lefordítja és automatikusan optimalizálja a mély tanulási modelleket, hogy azok hatékonyan futhassanak Inf2-példányokon, és kivonják az AWS Inferentia2 gyorsító teljes teljesítményét. Vannak példák a Stable Diffusion 2.1 modellhez GitHub repo. Ez a notebook teljes körű példát mutat be a stabil diffúziós modell összeállítására, a lefordított Neuron modellek mentésére és a futási környezetbe való betöltésére következtetés céljából.

Az általunk használt StableDiffusionPipeline az Ölelő Arctól diffusers könyvtárat a modell betöltéséhez és lefordításához. Ezután összeállítjuk a modell összes összetevőjét a Neuron számára torch_neuronx.trace() és mentse az optimalizált modellt TorchScript-ként. A fordítási folyamatok meglehetősen memóriaigényesek lehetnek, és jelentős mennyiségű RAM-ot igényelnek. Ennek megkerülésére az egyes modellek nyomon követése előtt létrehozunk a deepcopy a csővezeték nyomon követett részének. Ezt követően a csővezeték objektumot a segítségével töröljük a memóriából del pipe. Ez a technika különösen hasznos alacsony RAM-mal rendelkező példányokon történő fordításkor.

Emellett a Stable Diffusion modellek optimalizálását is elvégezzük. Az UNet rendelkezik a következtetés legszámításigényesebb aspektusával. Az UNet komponens kettős kötegmérettel rendelkező bemeneti tenzorokon működik, és létrehoz egy megfelelő kimeneti tenzort, szintén kettős kötegmérettel, egyetlen kép létrehozásához. Az ezekben a tételekben lévő elemek teljesen függetlenek egymástól. Ezt a viselkedést kihasználva optimális késleltetést érhetünk el, ha minden Neuron magon egy köteget futtatunk. Az UNetet egy köteghez fordítjuk (egy köteggel bemeneti tenzorok használatával), majd használjuk a torch_neuronx.DataParallel API ennek az egyetlen kötegelt modellnek az egyes magokra való betöltéséhez. Ennek az API-nak a kimenete egy zökkenőmentes, két köteges modul: átadhatjuk az UNet-nek két köteg bemenetét, és egy két köteges kimenet kerül visszaadásra, de belsőleg a két egyköteges modell a két Neuron magon fut. . Ez a stratégia optimalizálja az erőforrás-kihasználást és csökkenti a késleltetést.

Fordítson le és helyezzen üzembe egy stabil diffúziós modellt egy Inf2 EC2 példányon

A Stable Diffusion modell Inf2 EC2 példányon történő fordításához és üzembe helyezéséhez jelentkezzen be a AWS felügyeleti konzol és hozzon létre egy inf2.8xlarge példányt. Ne feledje, hogy az inf2.8xlarge példányra csak a modell fordításához van szükség, mert a fordításhoz nagyobb gazdagépmemória szükséges. A Stable Diffusion modell egy inf2.xlarge példányon tárolható. A Neuron könyvtárakkal rendelkező legújabb AMI-t az alábbiak segítségével találhatja meg AWS parancssori interfész (AWS CLI) parancs:

Ebben a példában létrehoztunk egy EC2 példányt a Deep Learning AMI Neuron PyTorch 1.13 (Ubuntu 20.04) használatával. Ezután létrehozhat egy JupyterLab laborkörnyezetet, ha csatlakozik a példányhoz, és futtassa a következő lépéseket:

Itt található egy notebook, amely a modell összeállításának és tárolásának összes lépését tartalmazza GitHub.

Nézzük meg az egyik szövegkódoló blokk összeállítási lépéseit. Más blokkok, amelyek a Stable Diffusion pipeline részét képezik, hasonlóan összeállíthatók.

Az első lépés az előképzett modell betöltése Hugging Face-ből. A StableDiffusionPipeline.from_pretrained metódus betölti az előre betanított modellt a folyamat objektumunkba, pipe. Ezután létrehozzuk a deepcopy a szövegkódolót a csővezetékünkből, hatékonyan klónozva azt. A del pipe A paranccsal törölhető az eredeti csővezeték objektum, felszabadítva az általa elfoglalt memóriát. Itt kvantáljuk a modellt BF16 súlyokra:

Ez a lépés magában foglalja a szövegkódolónk becsomagolását a NeuronTextEncoder csomagolás. A lefordított szövegkódoló modul kimenete a következő lesz dict. Átalakítjuk a list írja be ezt a csomagolóanyagot:

Inicializáljuk a PyTorch tenzort emb néhány értékkel. A emb tenzort használjuk példa bemenetként a torch_neuronx.trace funkció. Ez a függvény nyomon követi a szövegkódolónkat, és egy Neuronra optimalizált formátumba fordítja. A lefordított modell könyvtárútvonala összekapcsolással jön létre COMPILER_WORKDIR_ROOT az alkönyvtárral text_encoder:

A lefordított szövegkódoló a segítségével kerül mentésre torch.jit.save. Model.pt fájlnév alatt van tárolva a text_encoder fordítóprogramunk munkaterületének könyvtára:

A jegyzetfüzet hasonló lépéseket tartalmaz a modell további összetevőinek összeállításához: UNet, VAE dekóder és VAE post_quant_conv. Miután az összes modellt összeállította, az alábbi lépésekkel töltheti be és futtathatja a modellt:

- Határozza meg a lefordított modellek elérési útját.

- Töltsön be egy előképzett

StableDiffusionPipelinemodell, amelynek konfigurációja a bfloat16 adattípus használatára van megadva. - Töltse fel az UNet modellt két Neuron magra a segítségével

torch_neuronx.DataParallelAPI. Ez lehetővé teszi az adatok párhuzamos következtetésének végrehajtását, ami jelentősen felgyorsíthatja a modell teljesítményét. - Töltse be a modell többi részeit (

text_encoder,decoderéspost_quant_conv) egyetlen neuronmagra.

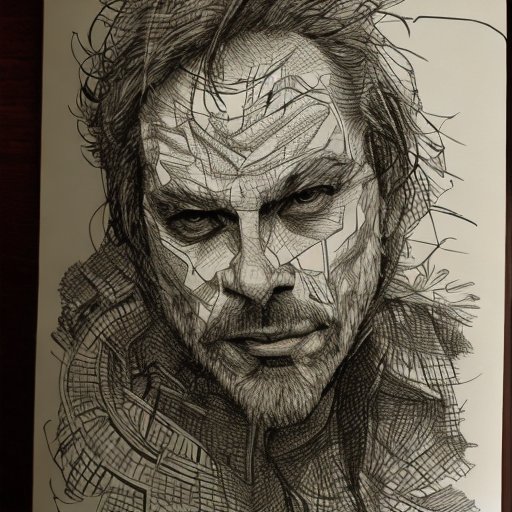

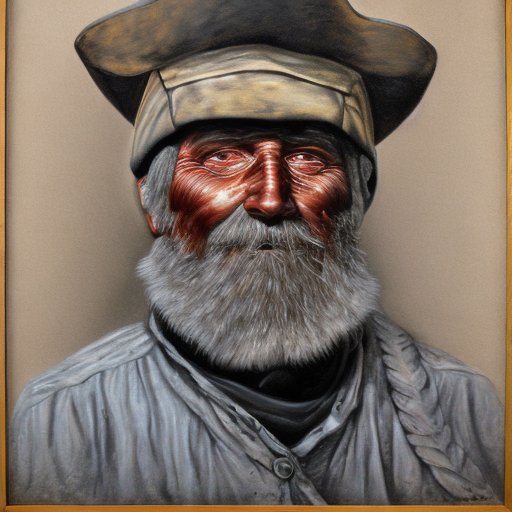

Ezután futtathatja a folyamatot úgy, hogy beviteli szöveget ad meg promptként. Íme néhány kép, amelyet a modell generált a promptokhoz:

- Renaud Sechan portréja, toll és tus, bonyolult vonalas rajzok, készítette: Craig Mullins, Ruan Jia, Kentaro Miura, greg Rutkowski, Loundraw

- Régi szénbányász portréja a 19. században, gyönyörű festmény, greg rutkowski rendkívül részletgazdag arcfestményével

- Egy kastély az erdő közepén

Host Stable Diffusion 2.1 az AWS Inferentia2-n és a SageMakeren

A Stable Diffusion modellek SageMakerrel való üzemeltetéséhez a Neuron SDK-val való fordítás is szükséges. Az összeállítást idő előtt vagy futás közben is befejezheti a Large Model Inference (LMI) tárolók használatával. Az idő előtti összeállítás gyorsabb modellbetöltési időt tesz lehetővé, és ez az előnyben részesített lehetőség.

A SageMaker LMI konténerek kétféleképpen helyezhetik üzembe a modellt:

- Egy kód nélküli opció, ahol csak a

serving.propertiesfájl a szükséges konfigurációkkal - Hozd el a saját következtetési szkriptedet

Megnézzük mindkét megoldást, és átmegyünk a konfigurációkon és a következtetési szkripten (model.py). Ebben a bejegyzésben bemutatjuk a telepítést egy előre lefordított modell segítségével, amely egy an Amazon egyszerű tárolási szolgáltatás (Amazon S3) vödör. Ezt az előre összeállított modellt használhatja a telepítésekhez.

Konfigurálja a modellt a megadott szkripttel

Ebben a részben bemutatjuk, hogyan konfigurálhatja az LMI-tárolót a stabil diffúziós modellek tárolására. Az SD2.1 notebook a következőn érhető el GitHub. Az első lépés a modell konfigurációs csomag létrehozása a következő könyvtárstruktúra szerint. Célunk, hogy a modell hosztolásához szükséges minimális modellkonfigurációkat használjuk. A szükséges könyvtárstruktúra a következő:

Ezután létrehozzuk a kiszolgáló.tulajdonságok fájl a következő paraméterekkel:

A paraméterek a következőket határozzák meg:

- option.model_id – Az LMI konténerek s5cmd segítségével töltik be a modellt az S3 helyről, ezért meg kell adnunk azt a helyet, ahol az összeállított súlyaink vannak.

- option.entryPoint – A beépített kezelők használatához a transzformátorok-neuronx osztályt adjuk meg. Ha rendelkezik egyéni következtetési szkripttel, akkor azt kell megadnia.

- opció.dtype – Ez határozza meg, hogy a súlyokat meghatározott méretben kell betölteni. Ehhez a bejegyzéshez a BF16-ot használjuk, ami tovább csökkenti a memóriaigényünket az FP32-höz képest, és ennek köszönhetően csökkenti a késleltetést.

- opció.tensor_parallel_degree – Ez a paraméter határozza meg az ehhez a modellhez használt gyorsítók számát. Az AWS Inferentia2 chipgyorsítónak két Neuron magja van, így a 2-es érték megadása azt jelenti, hogy egy gyorsítót (két magot) használunk. Ez azt jelenti, hogy több dolgozót is létrehozhatunk a végpont átviteli sebességének növelése érdekében.

- opció.motor – Ez Pythonra van állítva, jelezve, hogy nem használunk más fordítókat, például a DeepSpeed-et vagy a Faster Transformert ehhez a tárhelyhez.

Hozd el a saját forgatókönyvedet

Ha saját egyéni következtetési szkriptet szeretne vinni, el kell távolítania a option.entryPoint ból ből serving.properties. Az LMI tároló ebben az esetben megkeresi a model.py fájl ugyanazon a helyen, mint a serving.properties és ezzel futtassa le a következtetést.

Készítse el saját következtetési szkriptjét (model.py)

Saját következtetési szkript létrehozása viszonylag egyszerű az LMI-tároló használatával. A konténer megköveteli az Ön model.py fájlt, hogy a következő módszer megvalósítása legyen:

Vizsgáljuk meg a néhány kritikus területet csatolt jegyzetfüzet, amely bemutatja a hozza a saját script funkciót.

Cseréljük ki a cross_attention modul az optimalizált verzióval:

Ezek a lefordított súlyfájlok nevei, amelyeket a fordítások létrehozásakor használtunk. Nyugodtan módosíthatja a fájlneveket, de győződjön meg arról, hogy a súlyozási fájlnevek megegyeznek az itt megadottakkal.

Ezután be kell töltenünk őket a Neuron SDK segítségével, és be kell állítani őket a tényleges modellsúlyokba. Az UNet optimalizált súlyok betöltésekor vegye figyelembe, hogy megadjuk azoknak a Neuron magoknak a számát is, amelyekre ezeket be kell töltenünk. Itt egyetlen gyorsítóba töltünk be két maggal:

A következtetés prompttal történő futtatása meghívja a pipe objektumot egy kép létrehozásához.

Hozza létre a SageMaker végpontot

Boto3 API-kat használunk a SageMaker végpont létrehozásához. Hajtsa végre a következő lépéseket:

- Készítse el a tarballt csak a tálalással és az opcionálissal

model.pyfájlokat, és töltse fel az Amazon S3-ra. - Hozza létre a modellt a képtároló és a korábban feltöltött modell tarball segítségével.

- Hozza létre a végpont konfigurációját a következő kulcsparaméterekkel:

- Használja a

ml.inf2.xlargepélda. - Készlet

ContainerStartupHealthCheckTimeoutInSeconds240-re, hogy az állapotellenőrzés a modell üzembe helyezése után elinduljon. - Készlet

VolumeInGBnagyobb értékre, így a 32 GB méretű modellsúlyok betöltésére is használható.

- Használja a

Hozzon létre egy SageMaker modellt

Miután létrehozta a model.tar.gz fájlt, és feltöltötte az Amazon S3-ba, létre kell hoznunk egy SageMaker modellt. A SageMaker modell létrehozásához az előző lépésből származó LMI-tárolót és a modellműterméket használjuk. A SageMaker lehetővé teszi különböző környezeti változók testreszabását és beillesztését. Ehhez a munkafolyamathoz mindent alapértelmezettként hagyhatunk. Lásd a következő kódot:

Hozzon létre egy modellobjektumot, amely lényegében egy zárolási tárolót hoz létre, amely betöltődik a példányba, és következtetésekhez használja:

Hozzon létre egy SageMaker végpontot

Ebben a bemutatóban egy ml.inf2.xlarge példányt használunk. Be kell állítanunk a VolumeSizeInGB paramétereket, hogy biztosítsák a szükséges lemezterületet a modell és a súlyok betöltéséhez. Ez a paraméter azokra a példányokra vonatkozik, amelyek támogatják a Amazon Elastic Block Store (Amazon EBS) kötetcsatlakozó. A modellletöltési időtúllépést és a konténer indítási állapotellenőrzését hagyhatjuk magasabb értékre, ami elegendő időt ad a konténernek, hogy kihúzza a súlyokat az Amazon S3-ból és betöltse az AWS Inferentia2 gyorsítókba. További részletekért lásd: Create EndpointConfig.

Végül létrehozunk egy SageMaker végpontot:

Hívja meg a modell végpontját

Ez egy generatív modell, ezért átadjuk azt a promptot, amelyet a modell a kép generálásához használ. A hasznos teher JSON típusú:

A stabil diffúziós modell összehasonlítása az Inf2-n

Néhány tesztet lefuttattunk a stabil diffúziós modell összehasonlítására a BF 16 adattípussal az Inf2-n, és képesek vagyunk olyan késleltetési számokat származtatni, amelyek vetekednek vagy meghaladják a stabil diffúzió más gyorsítóit. Ez az AWS Inferentia2 chipek alacsonyabb költségével párosulva rendkívül értékes ajánlattá teszi ezt.

A következő számok az inf2.xl példányon telepített Stable Diffusion modellből származnak. A költségekkel kapcsolatos további információkért lásd: Amazon EC2 Inf2 példányok.

| Modell | Felbontás | Adattípus | Iterációk | P95 késés (ms) | Inf2.xl On-Demand óra költség | Inf2.xl (képenkénti költség) |

| Stabil diffúzió 1.5 | 512 × 512 | bf16 | 50 | 2,427.4 | $0.76 | $0.0005125 |

| Stabil diffúzió 1.5 | 768 × 768 | bf16 | 50 | 8,235.9 | $0.76 | $0.0017387 |

| Stabil diffúzió 1.5 | 512 × 512 | bf16 | 30 | 1,456.5 | $0.76 | $0.0003075 |

| Stabil diffúzió 1.5 | 768 × 768 | bf16 | 30 | 4,941.6 | $0.76 | $0.0010432 |

| Stabil diffúzió 2.1 | 512 × 512 | bf16 | 50 | 1,976.9 | $0.76 | $0.0004174 |

| Stabil diffúzió 2.1 | 768 × 768 | bf16 | 50 | 6,836.3 | $0.76 | $0.0014432 |

| Stabil diffúzió 2.1 | 512 × 512 | bf16 | 30 | 1,186.2 | $0.76 | $0.0002504 |

| Stabil diffúzió 2.1 | 768 × 768 | bf16 | 30 | 4,101.8 | $0.76 | $0.0008659 |

Következtetés

Ebben a bejegyzésben a Stable Diffusion 2.1 modell összeállításában, optimalizálásában és telepítésében mutatkozunk be az Inf2 példányok használatával. Bemutattuk a Stable Diffusion modellek telepítését is a SageMaker segítségével. Az Inf2 példányok kiváló ár-teljesítményt is nyújtanak a Stable Diffusion 1.5-höz. Ha többet szeretne megtudni arról, hogy az Inf2-példányok miért kiválóak a generatív mesterséges intelligencia és a nagy nyelvi modellek számára, tekintse meg a következőt Az alacsony költségű, nagy teljesítményű generatív mesterséges intelligencia következtetések Amazon EC2 Inf2 példányai már általánosan elérhetőek. A teljesítmény részleteit lásd: Inf2 teljesítmény. Tekintse meg a további példákat a GitHub repo.

Külön köszönet Matthew Mclainnek, Beni Hegedusnak, Kamran Khannak, Shruti Koparkarnak és Qing Lannak az áttekintésért és az értékes hozzászólásokért.

A szerzőkről

Vivek Gangasani az Amazon Web Services vezető gépi tanulási megoldások építésze. Gépi tanulással foglalkozó induló vállalkozásokkal dolgozik, hogy AI/ML alkalmazásokat építsen és telepítsen AWS-en. Jelenleg az MLOp-k, az ML következtetések és az alacsony kódú ML megoldások szállítására összpontosít. Különféle területeken dolgozott projekteken, beleértve a természetes nyelvi feldolgozást és a számítógépes látást.

Vivek Gangasani az Amazon Web Services vezető gépi tanulási megoldások építésze. Gépi tanulással foglalkozó induló vállalkozásokkal dolgozik, hogy AI/ML alkalmazásokat építsen és telepítsen AWS-en. Jelenleg az MLOp-k, az ML következtetések és az alacsony kódú ML megoldások szállítására összpontosít. Különféle területeken dolgozott projekteken, beleértve a természetes nyelvi feldolgozást és a számítógépes látást.

KC Tung az AWS Annapurna Labs vezető megoldástervezője. Szakterülete a nagy mélységű tanulási modellek képzése és a felhőben történő nagyszabású telepítés. Ph.D fokozata van. molekuláris biofizikában a Texasi Egyetem Délnyugati Orvosi Központjában, Dallasiban. Felszólalt az AWS Summits és az AWS Reinvent rendezvényeken. Ma segít ügyfeleinek a nagy PyTorch és TensorFlow modellek betanításában és üzembe helyezésében az AWS felhőben. Két könyv szerzője: Ismerje meg a TensorFlow Enterprise-t és a TensorFlow 2 Pocket Reference.

KC Tung az AWS Annapurna Labs vezető megoldástervezője. Szakterülete a nagy mélységű tanulási modellek képzése és a felhőben történő nagyszabású telepítés. Ph.D fokozata van. molekuláris biofizikában a Texasi Egyetem Délnyugati Orvosi Központjában, Dallasiban. Felszólalt az AWS Summits és az AWS Reinvent rendezvényeken. Ma segít ügyfeleinek a nagy PyTorch és TensorFlow modellek betanításában és üzembe helyezésében az AWS felhőben. Két könyv szerzője: Ismerje meg a TensorFlow Enterprise-t és a TensorFlow 2 Pocket Reference.

Rupinder Grewal Sr Ai/ML Specialist Solutions Architect, az AWS-vel. Jelenleg a SageMaker modellek és MLOp-k kiszolgálására összpontosít. Ezt megelőzően gépi tanulási mérnökként dolgozott modellek építésében és üzemeltetésében. Munkán kívül szeret teniszezni és hegyi ösvényeken kerékpározni.

Rupinder Grewal Sr Ai/ML Specialist Solutions Architect, az AWS-vel. Jelenleg a SageMaker modellek és MLOp-k kiszolgálására összpontosít. Ezt megelőzően gépi tanulási mérnökként dolgozott modellek építésében és üzemeltetésében. Munkán kívül szeret teniszezni és hegyi ösvényeken kerékpározni.

- SEO által támogatott tartalom és PR terjesztés. Erősödjön még ma.

- PlatoData.Network Vertical Generative Ai. Erősítse meg magát. Hozzáférés itt.

- PlatoAiStream. Web3 Intelligence. Felerősített tudás. Hozzáférés itt.

- PlatoESG. Autóipar / elektromos járművek, Carbon, CleanTech, Energia, Környezet, Nap, Hulladékgazdálkodás. Hozzáférés itt.

- BlockOffsets. A környezetvédelmi ellentételezési tulajdon korszerűsítése. Hozzáférés itt.

- Forrás: https://aws.amazon.com/blogs/machine-learning/maximize-stable-diffusion-performance-and-lower-inference-costs-with-aws-inferentia2/

- :van

- :is

- :nem

- :ahol

- $ UP

- 1

- 10

- 100

- 12

- 13

- 14

- 16

- 20

- 32

- 7

- 8

- 9

- a

- Képes

- Rólunk

- KIVONAT

- gázpedál

- gyorsítók

- Elérése

- tényleges

- További

- Előny

- Után

- előre

- AI

- AI / ML

- cél

- Minden termék

- lehetővé teszi, hogy

- Is

- amazon

- Amazon EC2

- Az Amazon Web Services

- között

- összeg

- an

- és a

- api

- API-k

- alkalmazható

- alkalmazások

- építészet

- VANNAK

- területek

- Művészet

- AS

- megjelenés

- At

- hang-

- szerző

- automatikusan

- elérhető

- AWS

- alapján

- BE

- szép

- mert

- óta

- előtt

- viselkedés

- hogy

- benchmark

- Jobb

- Biofizika

- Blokk

- Blocks

- Könyvek

- mindkét

- hoz

- épít

- Épület

- beépített

- de

- by

- TUD

- képességek

- eset

- Központ

- Század

- változik

- ellenőrizze

- csip

- játékpénz

- osztály

- felhő

- Szén

- kód

- teljes

- összetevő

- alkatrészek

- Kiszámít

- számítógép

- Számítógépes látás

- számítástechnika

- Configuration

- Csatlakozó

- fogyasztott

- Konténer

- Konténerek

- tartalom

- megtérít

- Mag

- Megfelelő

- Költség

- kiadások

- összekapcsolt

- Craig

- teremt

- készítette

- teremt

- létrehozása

- kritikai

- Jelenleg

- szokás

- Ügyfelek

- testre

- Dallas

- dátum

- mély

- mély tanulás

- alapértelmezett

- szállít

- átadó

- demó

- bizonyítani

- igazolták

- mutatja

- telepíteni

- telepített

- bevezetéséhez

- bevetés

- bevetések

- részletes

- részletek

- különböző

- Diffusion

- megvitatni

- domainek

- galamb

- letöltés

- Rajzok

- két

- alatt

- minden

- Korábban

- hatékonyan

- eredményesen

- elemek

- végtől végig

- Endpoint

- mérnök

- biztosítására

- teljesen

- Környezet

- lényegében

- Még

- minden

- megvizsgálni

- példa

- példák

- haladja meg

- tapasztal

- kivonat

- rendkívüli módon

- Arc

- gyorsabb

- érez

- kevés

- filé

- Fájlok

- Találjon

- vezetéknév

- megfelelő

- úszó

- összpontosított

- koncentrál

- következő

- következik

- A

- formátum

- Ingyenes

- ból ből

- Tele

- funkció

- további

- általában

- generál

- generált

- generáló

- nemző

- Generatív AI

- kap

- Ad

- Go

- nagy

- Növekedés

- Legyen

- he

- Egészség

- segít

- itt

- Magas

- nagy teljesítményű

- jó minőségű

- <p></p>

- nagyon

- tart

- vendéglátó

- házigazdája

- tárhely

- Hogyan

- How To

- HTML

- http

- HTTPS

- IDX

- if

- kép

- képek

- végrehajtás

- hatásos

- javul

- in

- magában foglalja a

- Beleértve

- Növelje

- független

- jelez

- információ

- injekciót

- bemenet

- bemenet

- telepíteni

- példa

- helyette

- belsőleg

- bele

- behívja

- IT

- ITS

- JIT

- csatlakozott

- jpg

- json

- éppen

- Kulcs

- labor

- Labs

- táj

- nyelv

- nagy

- nagyobb

- Késleltetés

- legutolsó

- TANUL

- tanulás

- Szabadság

- könyvtárak

- könyvtár

- mint

- vonal

- linux

- kiszámításának

- betöltés

- terhelések

- található

- elhelyezkedés

- zárlatot

- fakitermelés

- néz

- Elő/Utó

- olcsó

- alacsonyabb

- legalacsonyabb

- gép

- gépi tanulás

- csinál

- KÉSZÍT

- vezetés

- Mérkőzés

- matthew

- Maximize

- eszközök

- orvosi

- Memory design

- módszer

- Középső

- bányász

- minimális

- ML

- MLOps

- modell

- modellek

- Modulok

- molekuláris

- hónap

- több

- a legtöbb

- hegy

- MS

- többszörös

- név

- nevek

- Természetes

- Természetes nyelvi feldolgozás

- elengedhetetlen

- Szükség

- szükséges

- jegyzetfüzet

- Most

- szám

- számok

- Nvidia

- tárgy

- of

- Régi

- on

- Igény szerint

- ONE

- csak

- -ra

- működik

- optimálisan

- optimalizálás

- optimalizált

- Optimalizálja

- opció

- or

- eredeti

- OS

- Más

- mi

- ki

- teljesítmény

- kívül

- felett

- saját

- csomag

- festmény

- Párhuzamos

- paraméter

- paraméterek

- rész

- különösen

- alkatrészek

- elhalad

- ösvény

- mert

- Teljesít

- teljesítmény

- teljesített

- képek

- cső

- csővezeték

- Plató

- Platón adatintelligencia

- PlatoData

- játék

- pont

- portrék

- állás

- powered

- erős

- előnyben részesített

- ajándékot

- előző

- ár

- Előzetes

- Folyamatok

- feldolgozás

- gyárt

- projektek

- ingatlanait

- ajánlat

- ad

- feltéve,

- amely

- Piton

- pytorch

- RAM

- gyors

- valószerű

- új

- csökkenti

- viszonylag

- megmaradó

- eltávolítása

- cserélni

- szükség

- kötelező

- követelmények

- megköveteli,

- forrás

- Visszatér

- felülvizsgálata

- Vetélytárs

- Szerep

- futás

- futás

- sagemaker

- azonos

- Megtakarítás

- Skála

- sdk

- zökkenőmentes

- Rész

- lát

- idősebb

- Szolgáltatások

- szolgáló

- készlet

- előadás

- <p></p>

- jelentős

- jelentősen

- hasonló

- Hasonlóképpen

- Egyszerű

- egyszerűen

- egyetlen

- Méret

- So

- megoldások

- Megoldások

- néhány

- forrás

- Hely

- szakember

- specializálódott

- különleges

- meghatározott

- sebesség

- beszélt

- stabil

- állvány

- kezdődik

- indítás

- Startups

- Lépés

- Lépései

- tárolás

- memorizált

- egyértelmű

- Stratégia

- erő

- struktúra

- Csúcstalálkozók

- Támogató

- biztos

- Vesz

- tensorflow

- tesztek

- Texas

- Kösz

- hogy

- A

- azok

- Őket

- akkor

- ebből adódóan

- Ezek

- ők

- ezt

- Keresztül

- áteresztőképesség

- idő

- alkalommal

- nak nek

- Ma

- szerszámok

- fáklya

- nyomkövetés

- Vonat

- Képzések

- transzformátor

- kettő

- típus

- Ubuntu

- alatt

- egyedi

- egyetemi

- feltöltve

- us

- használ

- használt

- használ

- segítségével

- Értékes

- érték

- Értékek

- fajta

- különféle

- változat

- verzió

- látomás

- kötet

- vs

- akar

- volt

- módon

- we

- háló

- webes szolgáltatások

- Mit

- amikor

- ami

- miért

- széles

- lesz

- val vel

- belül

- Munka

- dolgozott

- dolgozók

- munkafolyamat

- művek

- te

- A te

- zephyrnet