Generatív mesterséges intelligencia (GenAI) és nagy nyelvi modellek (LLM), például a hamarosan elérhetők Amazon alapkőzet és a Amazon Titan átalakítják azt a módot, ahogy a fejlesztők és a vállalkozások képesek megoldani a természetes nyelv feldolgozásával és megértésével kapcsolatos, hagyományosan összetett kihívásokat. Az LLM-ek által kínált előnyök közé tartozik az a képesség, hogy hatékonyabb és meggyőzőbb társalgási AI-élményeket teremtsenek az ügyfélszolgálati alkalmazásokhoz, valamint az alkalmazottak termelékenységének javítása intuitívabb és pontosabb válaszok révén.

Ezekben a felhasználási esetekben azonban kritikus fontosságú, hogy a beszélgetési élményeket megvalósító GenAI-alkalmazások megfeleljenek két kulcsfontosságú kritériumnak: korlátozzák a válaszokat a vállalati adatokra, ezáltal mérsékelve a modellhallucinációkat (helytelen állításokat), és a válaszokat a végfelhasználói tartalomhoz való hozzáférésnek megfelelően szűrjék. engedélyeket.

Ahhoz, hogy a GenAI-alkalmazás válaszait csak a vállalati adatokra korlátozzuk, a Retrieval Augmented Generation (RAG) nevű technikát kell használnunk. A RAG-megközelítést használó alkalmazás lekéri a vállalati tudásbázisból vagy tartalomból a felhasználó kérése szempontjából legrelevánsabb információkat, kontextusként csomagolja azokat a felhasználó kérésével együtt promptként, majd elküldi az LLM-nek, hogy GenAI választ kapjon. Az LLM-ek korlátozzák a beviteli prompt maximális szószámát, ezért a vállalaton belüli több ezer vagy milliónyi dokumentum közül a megfelelő szövegrészek kiválasztása közvetlen hatással van az LLM pontosságára.

A hatékony RAG megtervezése során a tartalom visszakeresése kritikus lépés annak biztosítására, hogy az LLM a legrelevánsabb és legtömörebb kontextust kapja meg a vállalati tartalomból a pontos válaszok generálásához. Itt található a rendkívül pontos, gépi tanulással (ML) működő intelligens keresés in Amazon Kendra fontos szerepet játszik. Az Amazon Kendra egy teljesen felügyelt szolgáltatás, amely azonnali szemantikai keresési lehetőségeket biztosít a dokumentumok és szövegrészek legkorszerűbb rangsorolásához. Használhatja az Amazon Kendra nagy pontosságú keresését, hogy megszerezze a legrelevánsabb tartalmat és dokumentumokat, hogy maximalizálja a RAG rakomány minőségét, és jobb LLM-válaszokat adjon, mint a hagyományos vagy kulcsszóalapú keresési megoldások használata. Az Amazon Kendra könnyen használható mély tanulási keresési modelleket kínál, amelyek 14 tartományra vannak előtanulva, és nem igényelnek ML szakértelmet, így nincs szükség szóbeágyazásokkal, dokumentumok darabolásával és egyéb, általában szükséges alacsonyabb szintű bonyolultságokkal. RAG implementációkhoz. Az Amazon Kendra előre beépített csatlakozókkal is rendelkezik olyan népszerű adatforrásokhoz, mint pl Amazon egyszerű tárolási szolgáltatás (Amazon S3), SharePoint, Confluence és webhelyek, valamint támogatja az olyan általános dokumentumformátumokat, mint a HTML, Word, PowerPoint, PDF, Excel és a tiszta szöveges fájlok. A válaszok szűréséhez csak azon dokumentumok alapján, amelyeket a végfelhasználói engedélyek engedélyeznek, az Amazon Kendra hozzáférés-vezérlési lista (ACL) támogatással rendelkező csatlakozókat kínál. Az Amazon Kendra is kínál AWS Identity and Access Management (IAM) és AWS IAM Identity Center (az AWS Single Sign-On utódja) integráció a felhasználói csoportok információinak szinkronizálásához az ügyfél-identitásszolgáltatókkal, például az Okta és az Azure AD.

Ebben a bejegyzésben bemutatjuk, hogyan valósíthat meg egy RAG-munkafolyamatot az Amazon Kendra és az LLM-k képességeinek kombinálásával, hogy a legkorszerűbb GenAI-alkalmazásokat hozzon létre, amelyek társalgási élményt nyújtanak a vállalati tartalom felett. Után Amazon alapkőzet elindítása után egy következő bejegyzést teszünk közzé, amely bemutatja, hogyan lehet hasonló GenAI-alkalmazásokat implementálni az Amazon Bedrock használatával, úgyhogy maradjon velünk.

Megoldás áttekintése

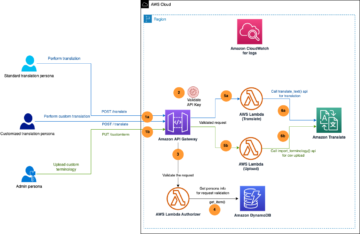

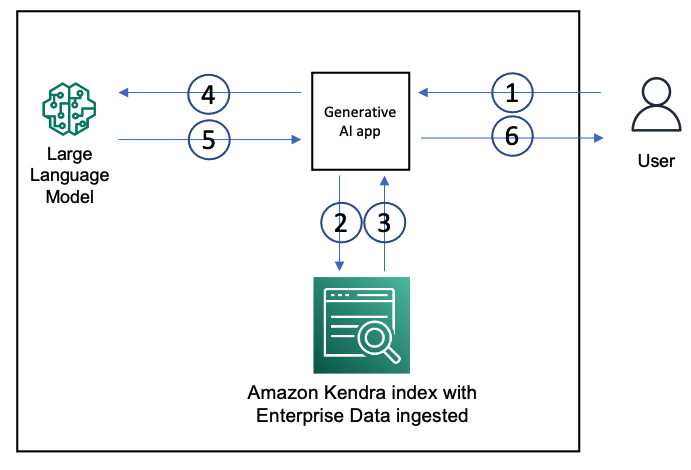

A következő diagram egy GenAI-alkalmazás architektúráját mutatja RAG-megközelítéssel.

Az Amazon Kendra indexet használjuk a vállalati strukturálatlan adatok feldolgozására olyan adatforrásokból, mint a wikioldalak, MS SharePoint webhelyek, Atlassian Confluence és dokumentumtárak, például az Amazon S3. Amikor a felhasználó interakcióba lép a GenAI alkalmazással, a folyamat a következő:

- A felhasználó kérést intéz a GenAI alkalmazáshoz.

- Az alkalmazás a felhasználói kérés alapján keresési lekérdezést ad ki az Amazon Kendra indexnek.

- Az index keresési eredményeket ad vissza a releváns dokumentumok kivonataival a feldolgozott vállalati adatokból.

- Az alkalmazás elküldi a felhasználói kérelmet és az indexből lekért adatokkal együtt kontextusként az LLM promptban.

- Az LLM tömör választ ad vissza a felhasználói kérésre a visszakeresett adatok alapján.

- Az LLM válaszát visszaküldi a felhasználónak.

Ezzel az architektúrával kiválaszthatja a legmegfelelőbb LLM-et az Ön használati esetéhez. Az LLM lehetőségek között szerepel a Hugging Face, az AI21 Labs, a Cohere és mások, amelyek egy Amazon SageMaker végpont, valamint olyan cégek modelljei, mint a Antropikus és a OpenAI. A Amazon alapkőzet, akkor választhat Amazon Titan, az Amazon saját LLM-je vagy a partner LLM-ek, például az AI21 Labs és az Anthropic API-kkal rendelkező LLM-ei biztonságosan anélkül, hogy adatainak el kellene hagyniuk az AWS-ökoszisztémát. Az Amazon Bedrock további előnyei közé tartozik a szerver nélküli architektúra, egyetlen API a támogatott LLM-ek hívásához, valamint egy felügyelt szolgáltatás a fejlesztői munkafolyamat egyszerűsítésére.

A legjobb eredmény elérése érdekében a GenAI-alkalmazásoknak meg kell tervezniük a promptot a felhasználói kérés és a használt LLM alapján. A társalgási AI-alkalmazásoknak a csevegési előzményeket és a kontextust is kezelniük kell. A GenAI alkalmazásfejlesztői használhatnak nyílt forráskódú keretrendszereket, mint pl LangChain amelyek modulokat biztosítanak a választott LLM-hez való integrációhoz, valamint hangszerelési eszközöket olyan tevékenységekhez, mint a csevegési előzmények kezelése és az azonnali tervezés. Mi biztosítottuk a KendraIndexRetriever osztály, amely megvalósítja a LangChain retriever interfész, amelyet az alkalmazások más LangChain interfészekkel együtt használhatnak, mint pl láncok adatok lekéréséhez egy Amazon Kendra indexből. Néhány pályázati mintát is bemutattunk a GitHub repo. Ezt a megoldást telepítheti AWS-fiókjában az ebben a bejegyzésben található lépésenkénti útmutató segítségével.

Előfeltételek

Ehhez az oktatóanyaghoz szüksége lesz egy bash terminálra, amely Python 3.9-es vagy újabb verzióját telepítette Linuxra, Macre vagy Windows alrendszerre Linuxra, valamint egy AWS-fiókra. Javasoljuk továbbá egy AWS Cloud9 példány vagy an Amazon rugalmas számítási felhő (Amazon EC2) példány.

Valósítson meg egy RAG-munkafolyamatot

A RAG munkafolyamat konfigurálásához hajtsa végre a következő lépéseket:

- Használja a mellékelt AWS felhőképződés sablon új Amazon Kendra index létrehozásához.

Ez a sablon mintaadatokat tartalmaz, amelyek az Amazon Kendra AWS online dokumentációját tartalmazzák, Amazon Lexés Amazon SageMaker. Alternatív megoldásként, ha rendelkezik Amazon Kendra indexel, és indexelte saját adatkészletét, használhatja azt. A verem elindítása körülbelül 30 percet vesz igénybe, majd körülbelül 15 percet vesz igénybe a szinkronizálás és az indexben lévő adatok feldolgozása. Ezért várjon körülbelül 45 percet a verem elindítása után. Jegyezze fel az indexazonosítót és az AWS régiót a veremben Kimenetek Tab.

- A jobb GenAI élmény érdekében javasoljuk, hogy kérjen egy Az Amazon Kendra szolgáltatási kvóta növelése maximumért

DocumentExcerptméretű, így az Amazon Kendra nagyobb dokumentumrészleteket biztosít az LLM szemantikai kontextusának javítása érdekében. - Telepítse a AWS SDK Pythonhoz az Ön által választott parancssori felületen.

- Ha szeretné használni a minta webalkalmazásokat, amelyek segítségével készült Áramlatos, először meg kell telepítse a Streamlitet. Ez a lépés nem kötelező, ha csak a példaalkalmazások parancssori verzióit szeretné futtatni.

- Telepítse a LangChaint.

- Az oktatóanyagban használt példaalkalmazásokhoz hozzáféréssel kell rendelkeznie egy vagy több LLM-hez a Flan-T5-XL, Flan-T5-XXL, Anthropic Claud-V1 és OpenAI-text-davinci-003 termékekből.

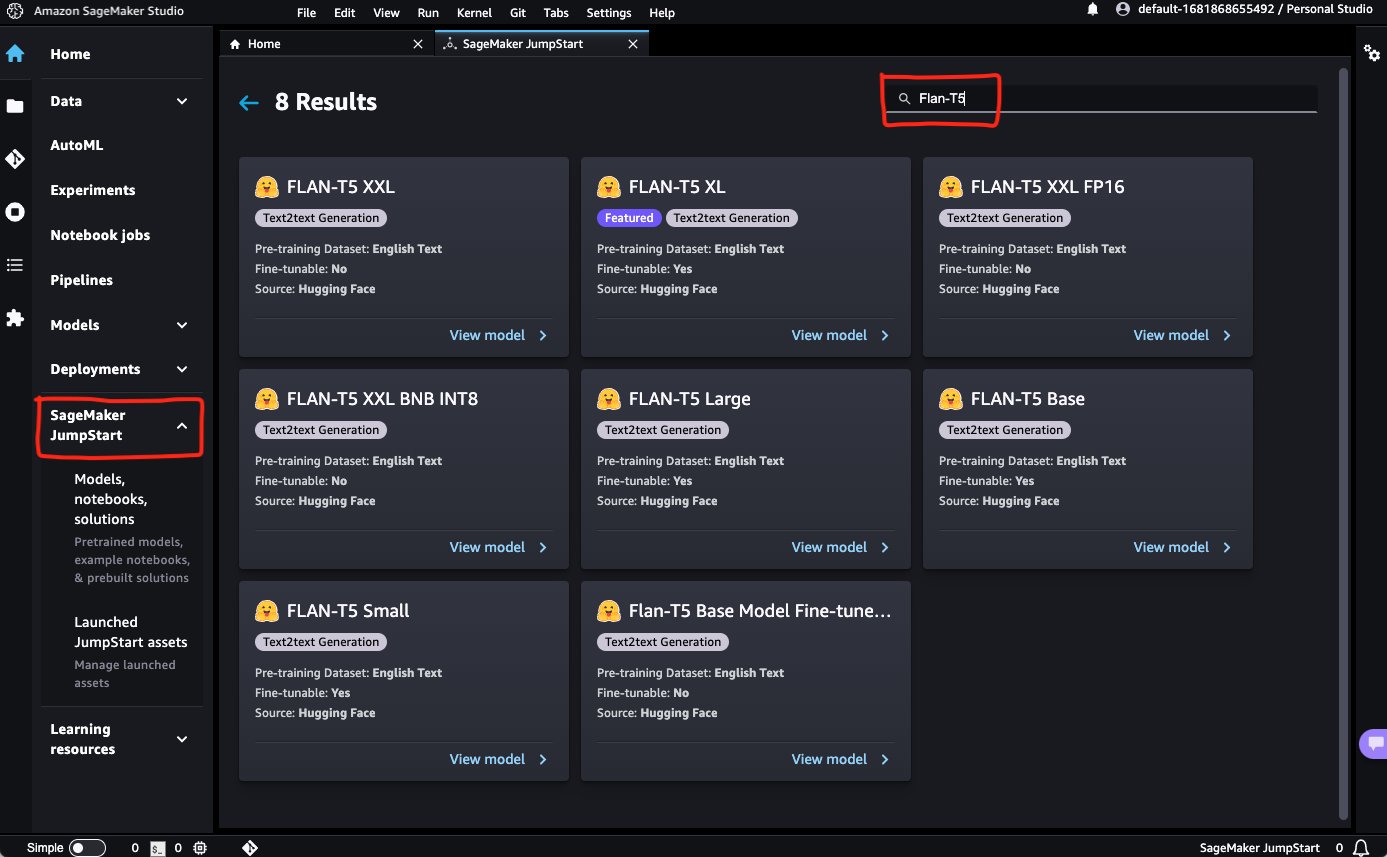

- Ha a Flan-T5-XL vagy Flan-T5-XXL fájlt szeretné használni, telepítse őket egy végpontra a következtetéshez Amazon SageMaker Studio Jumpstart.

- Ha az Anthropic Claud-V1 vagy OpenAI-da-vinci-003 programokkal szeretne dolgozni, szerezze be az Önt érdeklő LLM-ek API-kulcsait a következő címen: https://www.anthropic.com/ és a https://openai.com/, Ill.

- Ha a Flan-T5-XL vagy Flan-T5-XXL fájlt szeretné használni, telepítse őket egy végpontra a következtetéshez Amazon SageMaker Studio Jumpstart.

- Kövesse a GitHub repo a

KendraIndexRetrieverfelület és példaalkalmazások. - A példaalkalmazások futtatása előtt be kell állítania a környezeti változókat az Amazon Kendra index részleteivel és az előnyben részesített LLM API-kulcsokkal vagy a Flan-T5-XL vagy Flan-T5-XXL telepítései SageMaker végpontjaival. A következő egy példaszkript a környezeti változók beállításához:

- A parancssori ablakban váltson a

samplesalkönyvtár, ahol klónoztad a GitHub adattárat. A parancssori alkalmazásokat a parancssorból futtathatja, mintpython <sample-file-name.py>. Az egyszerűsített webalkalmazás futtatásához módosítsa a könyvtárat a következőresamplesés futásstreamlit run app.py <anthropic|flanxl|flanxxl|openai>. - Nyissa meg a mintafájlt

kendra_retriever_flan_xxl.pyaz Ön által választott szerkesztőben.

Figyeld meg az állítást result = run_chain(chain, "What's SageMaker?"). Ez a felhasználói lekérdezés („Mi az a SageMaker?”), amely azon a láncon fut végig, amely a Flan-T-XXL-t használja LLM-ként és az Amazon Kendra-t retrieverként. Amikor ez a fájl fut, a kimenetet az alábbiak szerint figyelheti meg. A lánc elküldte a felhasználói lekérdezést az Amazon Kendra indexnek, lekérte az első három eredménykivonatot, és kontextusként elküldte a lekérdezéssel együtt, amelyre az LLM tömör választ adott. Megadta a forrásokat is (a válasz generálásához használt dokumentumok URL-jeit).

- Most futtassuk a webalkalmazást

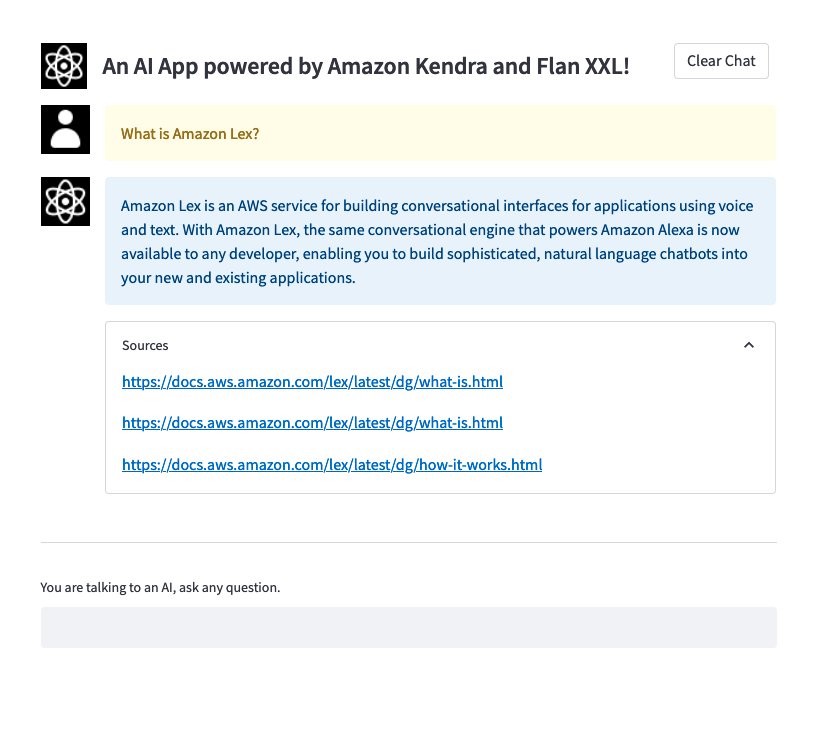

app.pyasstreamlit run app.py flanxxl. Ehhez a konkrét futtatáshoz egy Flan-T-XXL modellt használunk LLM-ként.

Megnyit egy böngészőablakot a webes felülettel. Megadhat egy lekérdezést, amely ebben az esetben a „Mi az Amazon Lex?” Amint az a következő képernyőképen látható, az alkalmazás választ ad, és a Források szakasz biztosítja azoknak a dokumentumoknak az URL-címét, amelyekből a kivonatokat az Amazon Kendra indexből lekérték, és a promptban elküldték az LLM-nek a lekérdezéssel együtt.

- Most pedig fussunk

app.pyújra, és átérezheti a beszélgetési élménytstreamlit run app.py anthropic. Itt az alapul szolgáló LLM az Anthropic Claud-V1.

Amint az a következő videóban is látható, az LLM részletes választ ad a felhasználó kérdésére az Amazon Kendra indexből lekért dokumentumok alapján, majd a választ a forrásdokumentumok URL-jeivel támasztja alá, amelyeket a válasz generálásához használtak. Vegye figyelembe, hogy a következő lekérdezések nem említik kifejezetten az Amazon Kendrát; Azonban a ConversationalRetrievalChain (egy lánctípus, amely a LangChain keretrendszer része, és egyszerű mechanizmust biztosít a retriever-példányokból lekért, párbeszédes alkalmazásalapú információk fejlesztéséhez, amelyet ebben a LangChain alkalmazásban használnak), kezeli a csevegési előzményeket és a kontextust, hogy megfelelő választ kapjon.

Vegye figyelembe azt is, hogy a következő képernyőképen az Amazon Kendra megtalálja a kivonatoló választ a lekérdezésre, és kivonatokkal felsorolja a legjobb dokumentumokat. Ezután az LLM tömörebb választ tud generálni ezekre a kiolvasott kivonatok alapján.

A következő szakaszokban a Generative AI használatának két felhasználási esetét vizsgáljuk meg az Amazon Kendrával.

1. használati eset: Generatív AI pénzügyi szolgáltató cégek számára

A pénzügyi szervezetek különféle adattárakból hoznak létre és tárolnak adatokat, beleértve a pénzügyi jelentéseket, jogi dokumentumokat és tanulmányokat. Szigorú kormányzati előírásokat és felügyeletet kell betartaniuk, ami azt jelenti, hogy az alkalmazottaknak gyorsan meg kell találniuk a releváns, pontos és megbízható információkat. Ezen túlmenően a különböző adatforrások közötti statisztikák keresése és összesítése nehézkes és hibás. Az AWS-en futó Generatív mesterségesintelligencia segítségével a felhasználók gyorsan generálhatnak válaszokat különböző adatforrásokból és -típusokból, így szintetizálva a pontos válaszokat vállalati szinten.

Az Amazon Kendra és az AI21 Lab Jurassic-2 Jumbo Instruct LLM-jét használó megoldást választottuk. Az Amazon Kendra segítségével könnyedén feldolgozhat adatokat több adatforrásból, például az Amazon S3-ból, webhelyekről és a ServiceNow-ról. Ezután az Amazon Kendra az AI21 Lab Jurassic-2 Jumbo Instruct LLM-jét használja a vállalati adatokra vonatkozó következtetési tevékenységek elvégzésére, például adatösszegzésre, jelentéskészítésre és egyebekre. Az Amazon Kendra kiegészíti az LLM-eket, hogy pontos és ellenőrizhető információkat nyújtson a végfelhasználóknak, ami csökkenti az LLM-ekkel kapcsolatos hallucinációs problémákat. A javasolt megoldással a pénzügyi elemzők pontos adatok felhasználásával gyorsabban hozhatnak döntéseket, így gyorsan részletes és átfogó portfóliókat hozhatnak létre. Terveink szerint a közeljövőben nyílt forráskódú projektként elérhetővé tesszük ezt a megoldást.

Példa

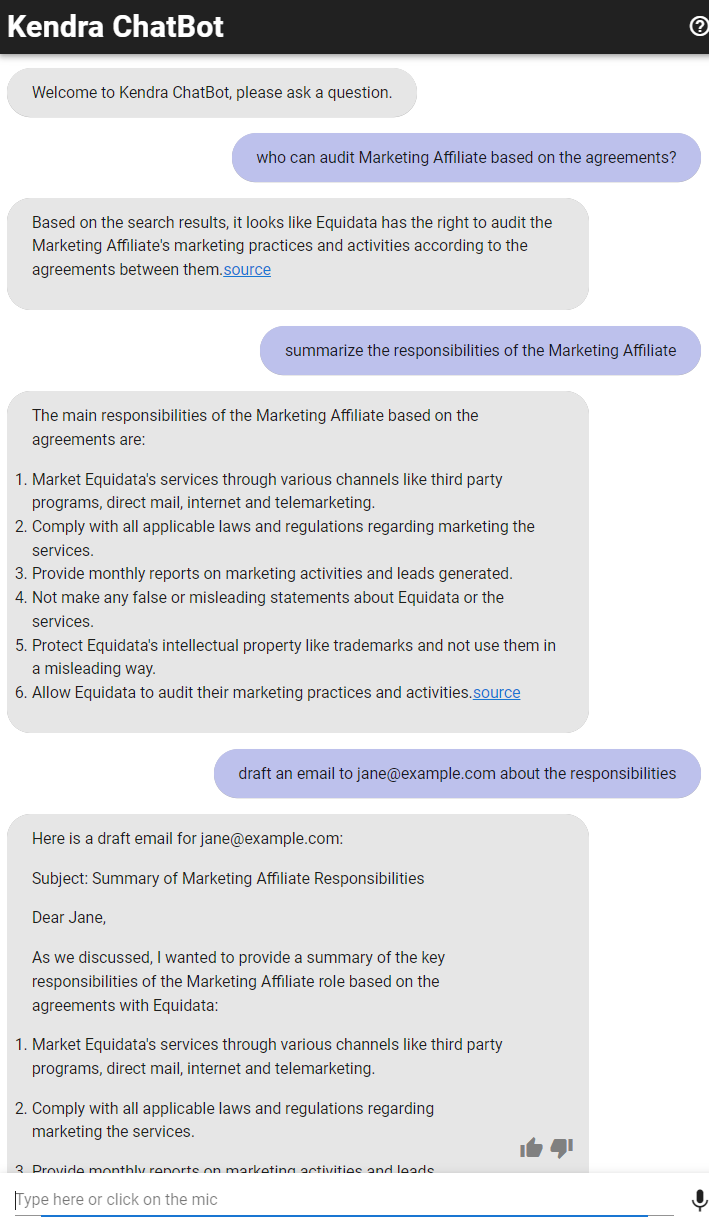

A Kendra Chatbot megoldással a pénzügyi elemzők és könyvvizsgálók kölcsönhatásba léphetnek vállalati adataikkal (pénzügyi jelentések és megállapodások), hogy megbízható válaszokat találjanak az ellenőrzéssel kapcsolatos kérdésekre. A Kendra ChatBot válaszokat ad a forráshivatkozásokkal együtt, és képes összefoglalni a hosszabb válaszokat. A következő képernyőkép egy példa beszélgetést mutat Kendra ChatBottal.

Építészeti áttekintés

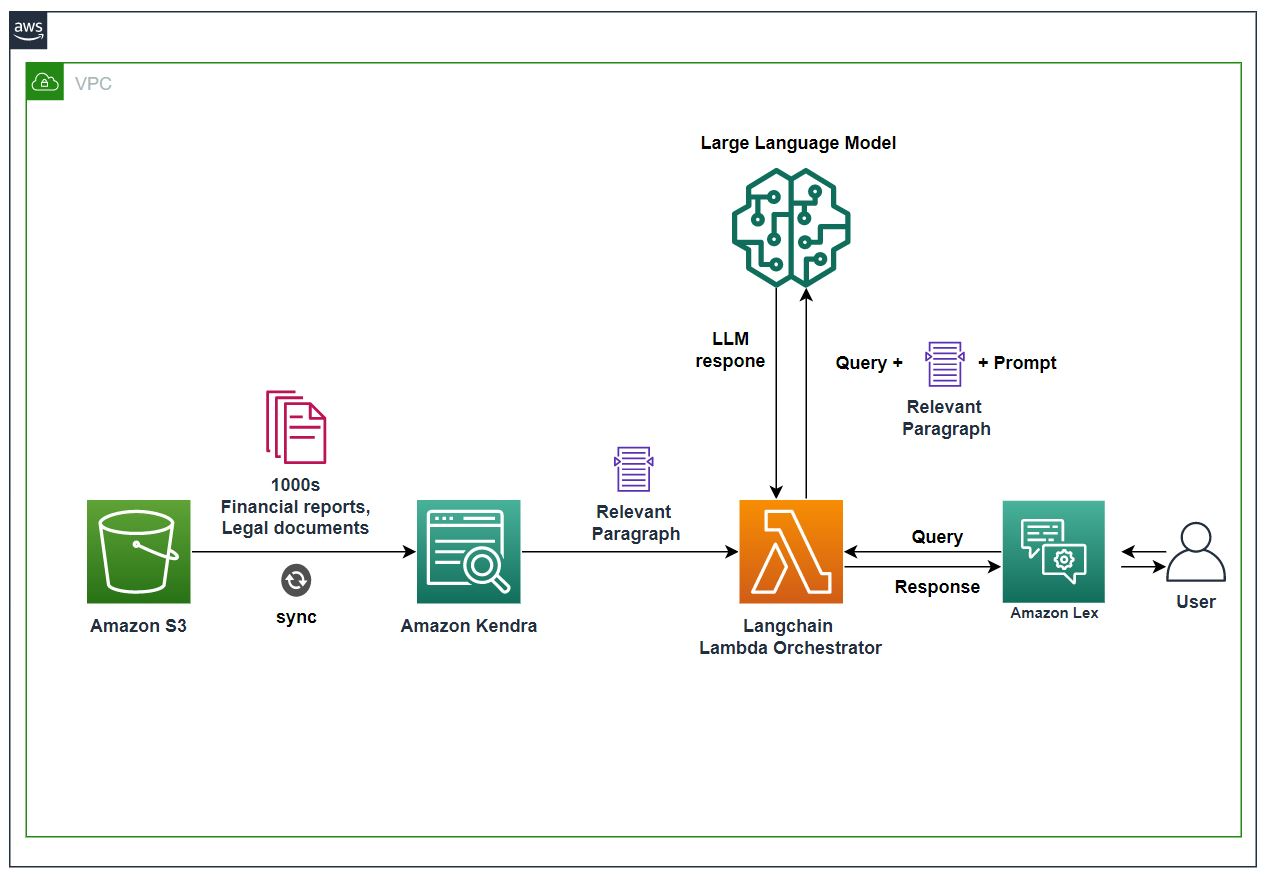

A következő ábra a megoldás architektúráját mutatja be.

A munkafolyamat a következő lépéseket tartalmazza:

- A pénzügyi dokumentumokat és megállapodásokat az Amazon S3 tárolja, és az S3 adatforrás-csatlakozó segítségével egy Amazon Kendra indexbe tölti be.

- Az LLM egy SageMaker végponton található.

- Az Amazon Lex chatbotot használjuk a felhasználóval való interakcióhoz a Amazon Lex webes felhasználói felület.

- A megoldás egy AWS Lambda funkció a LangChain segítségével az Amazon Kendra, az Amazon Lex és az LLM közötti hangszereléshez.

- Amikor a felhasználók egy pénzügyi dokumentumból kérnek választ az Amazon Lex chatbottól, az Amazon Lex felhívja a LangChain orchestratort, hogy teljesítse a kérést.

- A lekérdezés alapján a LangChain orchestrator lekéri a vonatkozó pénzügyi nyilvántartásokat és bekezdéseket az Amazon Kendráról.

- A LangChain orchestrator átadja ezeket a releváns rekordokat az LLM-nek, a lekérdezéssel és a megfelelő felszólítással együtt a szükséges tevékenység végrehajtásához.

- Az LLM feldolgozza a LangChain orchestratortól érkező kérést, és visszaküldi az eredményt.

- A LangChain orchestrator megkapja az eredményt az LLM-től, és elküldi a végfelhasználónak az Amazon Lex chatboton keresztül.

2. használati eset: Generatív mesterséges intelligencia egészségügyi kutatók és klinikusok számára

A klinikusok és kutatók kutatásaik részeként gyakran több ezer cikket elemeznek orvosi folyóiratokból vagy kormányzati egészségügyi webhelyekről. Ennél is fontosabb, hogy megbízható adatforrásokat szeretnének, amelyekkel igazolhatják és alátámaszthatják megállapításaikat. A folyamat több órás intenzív kutatást, elemzést és adatszintézist igényel, ami meghosszabbítja az értékteremtéshez és az innovációhoz szükséges időt. Az AWS-en futó Generatív AI segítségével megbízható adatforrásokhoz csatlakozhat, és természetes nyelvű lekérdezéseket futtathat, hogy másodpercek alatt betekintést nyerhessen ezekbe a megbízható adatforrásokba. Áttekintheti a válasz generálásához használt forrásokat is, és ellenőrizheti annak pontosságát.

A Hugging Face Amazon Kendra és Flan-T5-XXL használatával választottunk megoldást. Először is az Amazon Kendra segítségével azonosítjuk a szemantikailag releváns dokumentumok szövegrészleteit a teljes korpuszban. Ezután egy LLM, például a Flan-T5-XXL erejét használjuk, hogy az Amazon Kendra szövegrészleteit kontextusként használjuk, és tömör, természetes nyelvű választ kapjunk. Ebben a megközelítésben az Amazon Kendra index a passzázs retriever komponenseként működik a RAG mechanizmusban. Végül az Amazon Lexet használjuk a kezelőfelület működtetésére, zökkenőmentes és rugalmas élményt biztosítva a végfelhasználóknak. Terveink szerint a közeljövőben nyílt forráskódú projektként elérhetővé tesszük ezt a megoldást.

Példa

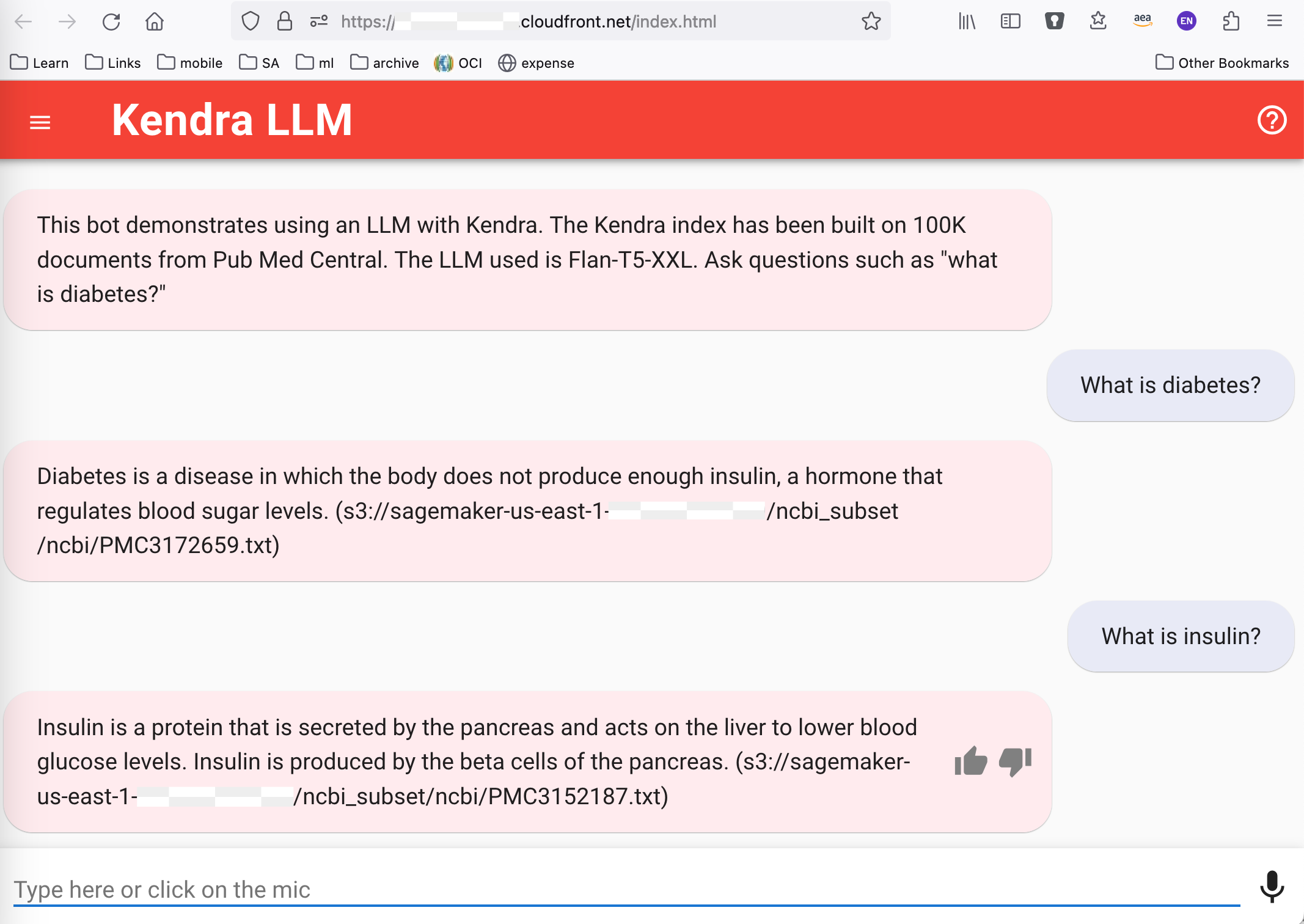

A következő képernyőkép egy webes felhasználói felületről készült, amely a megoldáshoz készült a webhelyen elérhető sablon használatával GitHub. A rózsaszínű szöveg az Amazon Kendra LLM rendszer válaszai, a kék szöveg pedig a felhasználói kérdések.

Építészeti áttekintés

Ennek a megoldásnak az architektúrája és a megoldás munkafolyamata hasonló az 1. használati esetéhez.

Tisztítsuk meg

A költségek megtakarítása érdekében törölje az oktatóanyag részeként telepített összes erőforrást. Ha elindította a CloudFormation veremet, törölheti azt az AWS CloudFormation konzolon keresztül. Hasonlóképpen törölheti a SageMaker konzolon keresztül esetleg létrehozott SageMaker-végpontokat.

Következtetés

A nagy nyelvi modelleken alapuló generatív mesterséges intelligencia megváltoztatja azt, ahogyan az emberek betekintést nyernek és alkalmaznak az információkból. Vállalati felhasználási esetekben azonban a betekintést a vállalati tartalom alapján kell előállítani, hogy a válaszok a tartományon belül maradjanak, és a hallucinációk enyhítése érdekében a Retrieval Augmented Generation megközelítést alkalmazva. A RAG-megközelítésben az LLM által generált betekintések minősége az alapul szolgáló visszakeresett információk szemantikai relevanciájától függ, így egyre inkább szükségessé válik olyan megoldások alkalmazása, mint például az Amazon Kendra, amelyek nagy pontosságú szemantikai keresési eredményeket biztosítanak. a doboz. Az adatforrás-csatlakozók átfogó ökoszisztémája, a gyakori fájlformátumok támogatása és a biztonság révén gyorsan elkezdheti használni a Generative AI-megoldásokat a vállalati felhasználási esetekben, az Amazon Kendra-val mint visszakeresési mechanizmussal.

Az AWS-en a Generative AI használatával kapcsolatos további információkért lásd: Új eszközök bejelentése a generatív AI-val való építéshez az AWS-en. Elkezdheti a kísérletezést és a RAG proof of concept (POC) létrehozását vállalati GenAI alkalmazásaihoz az ebben a blogban ismertetett módszerrel. Mint korábban említettük, egyszer Amazon alapkőzet elérhető, egy nyomon követési blogot teszünk közzé, amely bemutatja, hogyan építhet RAG-ot az Amazon Bedrock használatával.

A szerzőkről

Abhinav Jawadekar az AWS AI/ML nyelvi szolgáltatások csapatában az Amazon Kendrára összpontosító fő megoldások építésze. Az Abhinav együttműködik az AWS-ügyfelekkel és -partnerekkel, hogy segítsen nekik intelligens keresési megoldásokat kiépíteni az AWS-en.

Abhinav Jawadekar az AWS AI/ML nyelvi szolgáltatások csapatában az Amazon Kendrára összpontosító fő megoldások építésze. Az Abhinav együttműködik az AWS-ügyfelekkel és -partnerekkel, hogy segítsen nekik intelligens keresési megoldásokat kiépíteni az AWS-en.

Jean-Pierre Dodel az Amazon Kendra fő termékmenedzsere, és a kulcsfontosságú stratégiai termékképességekért és az ütemterv priorizálásáért felelős. Kiterjedt vállalati keresési és ML/AI tapasztalattal gazdagítja a csapatot, korábban vezető szerepet töltött be az Autonomy-nál, a HP-nál és a kereső startupoknál, mielőtt 7 évvel ezelőtt csatlakozott az Amazonhoz.

Jean-Pierre Dodel az Amazon Kendra fő termékmenedzsere, és a kulcsfontosságú stratégiai termékképességekért és az ütemterv priorizálásáért felelős. Kiterjedt vállalati keresési és ML/AI tapasztalattal gazdagítja a csapatot, korábban vezető szerepet töltött be az Autonomy-nál, a HP-nál és a kereső startupoknál, mielőtt 7 évvel ezelőtt csatlakozott az Amazonhoz.

Mithil Shah az AWS ML/AI szakértője. Jelenleg az AWS-en gépi tanulási megoldások kiépítésével segíti a közszféra ügyfeleit a polgárok életének javításában.

Mithil Shah az AWS ML/AI szakértője. Jelenleg az AWS-en gépi tanulási megoldások kiépítésével segíti a közszféra ügyfeleit a polgárok életének javításában.

Firaz Akmal az Amazon Kendra idősebb termékmenedzsere az AWS-nél. Ügyfélvédő, segít az ügyfeleknek megérteni a keresési és generatív mesterséges intelligencia felhasználási eseteiket Kendra segítségével az AWS-en. Munkán kívül Firaz szívesen tölt időt a PNW hegyeiben, vagy a világot lánya szemszögéből tapasztalja meg.

Firaz Akmal az Amazon Kendra idősebb termékmenedzsere az AWS-nél. Ügyfélvédő, segít az ügyfeleknek megérteni a keresési és generatív mesterséges intelligencia felhasználási eseteiket Kendra segítségével az AWS-en. Munkán kívül Firaz szívesen tölt időt a PNW hegyeiben, vagy a világot lánya szemszögéből tapasztalja meg.

Abhishek Maligehalli Shivalingaiah az AWS vezető mesterséges intelligencia-szolgáltatási építésze, aki az Amazon Kendrára összpontosít. Szenvedélye az Amazon Kendra, a Generative AI és az NLP segítségével történő alkalmazások készítése. Körülbelül 10 éves tapasztalattal rendelkezik az ügyfelek és a vállalkozások számára értéket teremtő Data & AI megoldások építésében. Szórakozásból (személyes) chatbotot épített, hogy megválaszolja a karrierjével és szakmai útjával kapcsolatos kérdéseket. A munkán kívül szeret portrékat készíteni családjáról és barátairól, és szeret műalkotásokat készíteni.

Abhishek Maligehalli Shivalingaiah az AWS vezető mesterséges intelligencia-szolgáltatási építésze, aki az Amazon Kendrára összpontosít. Szenvedélye az Amazon Kendra, a Generative AI és az NLP segítségével történő alkalmazások készítése. Körülbelül 10 éves tapasztalattal rendelkezik az ügyfelek és a vállalkozások számára értéket teremtő Data & AI megoldások építésében. Szórakozásból (személyes) chatbotot épített, hogy megválaszolja a karrierjével és szakmai útjával kapcsolatos kérdéseket. A munkán kívül szeret portrékat készíteni családjáról és barátairól, és szeret műalkotásokat készíteni.

- SEO által támogatott tartalom és PR terjesztés. Erősödjön még ma.

- PlatoAiStream. Web3 adatintelligencia. Felerősített tudás. Hozzáférés itt.

- A jövő pénzverése – Adryenn Ashley. Hozzáférés itt.

- Forrás: https://aws.amazon.com/blogs/machine-learning/quickly-build-high-accuracy-generative-ai-applications-on-enterprise-data-using-amazon-kendra-langchain-and-large-language-models/

- :van

- :is

- :ahol

- $ UP

- 1

- 10

- 100

- 11

- 12

- 14

- 15%

- 30

- 7

- 9

- a

- képesség

- Képes

- Rólunk

- hozzáférés

- Szerint

- Fiók

- pontosság

- pontos

- szerez

- át

- tevékenységek

- tevékenység

- Ad

- További

- Ezen kívül

- tapad

- szószóló

- Után

- újra

- összesítés

- Augusztus

- megállapodások

- AI

- AI szolgáltatások

- AI / ML

- Minden termék

- lehetővé

- mentén

- Is

- amazon

- Amazon EC2

- Amazon Kendra

- Amazon Lex

- között

- an

- elemzés

- Az elemzők

- elemez

- és a

- válasz

- válaszok

- bármilyen

- api

- API KULCSOK

- API-k

- app

- Alkalmazás

- alkalmazások

- alkalmaz

- megközelítés

- megfelelő

- alkalmazások

- építészet

- VANNAK

- körül

- cikkek

- műalkotások

- AS

- At

- könyvvizsgálók

- bővített

- elérhető

- AWS

- AWS felhőképződés

- Égszínkék

- vissza

- bázis

- alapján

- horpadás

- BE

- hogy

- Előnyök

- BEST

- Jobb

- között

- Blog

- Kék

- Doboz

- Bring

- böngésző

- épít

- Épület

- épült

- kötegek

- by

- hívás

- hívott

- kéri

- TUD

- képességek

- képes

- Karrier

- visz

- eset

- esetek

- lánc

- kihívások

- változik

- változó

- chatbot

- választás

- A pop-art design, négy időzóna kijelzése egyszerre és méretének arányai azok az érvek, amelyek a NeXtime Time Zones-t kiváló választássá teszik. Válassza a

- választja

- választotta

- Állampolgárok

- osztály

- kombinálása

- jön

- Közös

- Companies

- vállalat

- kényszerítő

- teljes

- bonyolult

- bonyodalmak

- összetevő

- átfogó

- Kiszámít

- koncepció

- Csatlakozás

- Konzol

- tartalom

- kontextus

- ellenőrzés

- hagyományos

- Beszélgetés

- társalgó

- társalgási AI

- kiadások

- teremt

- készítette

- létrehozása

- kritériumok

- kritikai

- Jelenleg

- vevő

- Vevőszolgálat

- Ügyfelek

- dátum

- üzlet

- határozatok

- mély

- mély tanulás

- bizonyítani

- függ

- telepíteni

- telepített

- bevetések

- tervezés

- részletes

- részletek

- Fejleszt

- Fejlesztő

- fejlesztők

- közvetlen

- dokumentum

- dokumentáció

- dokumentumok

- domainek

- ne

- Korábban

- könnyen

- könnyű

- könnyen használható

- ökoszisztéma

- szerkesztő

- Hatékony

- munkavállaló

- alkalmazottak

- végén

- Endpoint

- mérnök

- Mérnöki

- biztosítására

- belép

- Vállalkozás

- Vállalatok

- Egész

- Környezet

- hiba

- példa

- Excel

- tapasztalat

- Tapasztalatok

- tapasztal

- szakvélemény

- feltárása

- export

- kiterjedt

- Arc

- család

- gyorsabb

- érez

- kevés

- filé

- Fájlok

- szűrő

- pénzügyi

- pénzügyi szolgáltatás

- Találjon

- leletek

- vezetéknév

- áramlási

- Összpontosít

- összpontosított

- következik

- követ

- következő

- következik

- A

- Keretrendszer

- keretek

- barátok

- ból ből

- front

- Front end

- eleget tesz

- teljesen

- móka

- funkció

- funkciók

- jövő

- generál

- generált

- generáló

- generáció

- nemző

- Generatív AI

- kap

- GitHub

- Kormány

- útmutató

- Legyen

- he

- Egészség

- egészségügyi

- segít

- segít

- segít

- itt

- <p></p>

- nagyon

- övé

- történelem

- házigazdája

- NYITVATARTÁS

- Hogyan

- How To

- azonban

- HTML

- http

- HTTPS

- ID

- azonosítani

- Identitás

- if

- illusztrálja

- Hatás

- végre

- végrehajtási

- munkagépek

- fontos

- javul

- javított

- javuló

- in

- tartalmaz

- magában foglalja a

- Beleértve

- egyre inkább

- index

- információ

- Innováció

- bemenet

- meglátások

- telepíteni

- telepítve

- példa

- utasítás

- integrálni

- integráció

- Intelligens

- kölcsönhatásba

- kölcsönhatásba lép

- kamat

- Felület

- interfészek

- intuitív

- kérdések

- IT

- ITS

- csatlakozott

- utazás

- jpg

- Tart

- Kulcs

- kulcsok

- tudás

- Labs

- nyelv

- nagy

- nagyobb

- indított

- elindítja

- indítás

- vezető

- vezetékek

- tanulás

- Szabadság

- Jogi

- mint

- LIMIT

- korlátozások

- vonal

- linkek

- linux

- Lista

- életek

- LLM

- hosszabb

- esőkabát

- gép

- gépi tanulás

- csinál

- KÉSZÍT

- Gyártás

- kezelése

- sikerült

- vezetés

- menedzser

- kezeli

- Maximize

- maximális

- Lehet..

- eszközök

- mechanizmus

- orvosi

- Találkozik

- említett

- módszer

- Több millió

- Perc

- Enyhít

- enyhítő

- ML

- modell

- modellek

- Modulok

- több

- a legtöbb

- MS

- többszörös

- kell

- Természetes

- Természetes nyelvi feldolgozás

- Közel

- elengedhetetlen

- Szükség

- igények

- Új

- NLP

- nem

- megfigyelni

- szerez

- of

- ajánlat

- felajánlott

- Ajánlatok

- gyakran

- OKTA

- on

- egyszer

- ONE

- online

- csak

- nyílt forráskódú

- nyit

- Opciók

- or

- hangszerelés

- szervezetek

- Más

- Egyéb

- mi

- ki

- vázolt

- teljesítmény

- kívül

- felett

- Felügyelet

- saját

- rész

- partner

- partnerek

- szenvedélyes

- Emberek (People)

- engedélyek

- személyes

- perspektíva

- terv

- Plató

- Platón adatintelligencia

- PlatoData

- játszik

- Népszerű

- portfóliók

- állás

- hatalom

- powered

- előnyben részesített

- Fő

- Előzetes

- fontossági sorrend

- folyamat

- Folyamatok

- feldolgozás

- Termékek

- termék menedzser

- termelékenység

- szakmai

- program

- igazolások

- javasolt

- ad

- feltéve,

- szolgáltatók

- biztosít

- amely

- nyilvános

- közzétesz

- Húz

- Piton

- világítás

- lekérdezések

- Kérdések

- gyorsan

- Ranking

- kap

- ajánl

- nyilvántartások

- csökkenti

- vidék

- előírások

- összefüggő

- relevancia

- megbízható

- jelentést

- Jelentések

- raktár

- kérni

- szükség

- kötelező

- megköveteli,

- kutatás

- kutatók

- Tudástár

- illetőleg

- válasz

- válaszok

- fogékony

- korlátoz

- eredményez

- Eredmények

- Visszatér

- Kritika

- ütemterv

- Szerep

- szerepek

- futás

- futás

- s

- sagemaker

- Megtakarítás

- Skála

- sdk

- zökkenőmentes

- Keresés

- keres

- másodperc

- szakaszok

- szektor

- biztosan

- biztonság

- lát

- látott

- küld

- idősebb

- vagy szerver

- szolgáltatás

- Szolgáltatások

- készlet

- Műsorok

- hasonló

- Hasonlóképpen

- Egyszerű

- egyetlen

- Webhely (ek)

- Méret

- So

- megoldások

- Megoldások

- SOLVE

- néhány

- forrás

- Források

- szakember

- különleges

- Költési

- verem

- kezdet

- Startups

- csúcs-

- nyilatkozat

- nyilatkozatok

- tartózkodás

- Lépés

- Lépései

- tárolás

- tárolni

- memorizált

- Stratégiai

- áramvonal

- Szigorú

- stúdió

- későbbi

- ilyen

- megfelelő

- összegez

- támogatás

- Támogatott

- Támogatja

- rendszer

- csapat

- sablon

- terminál

- mint

- hogy

- A

- The Source

- a világ

- azok

- Őket

- akkor

- ezáltal

- ebből adódóan

- Ezek

- ők

- ezt

- azok

- ezer

- három

- Keresztül

- idő

- nak nek

- szerszámok

- felső

- hagyományosan

- transzformáló

- Megbízható

- megbízható

- oktatói

- kettő

- típus

- típusok

- jellemzően

- ui

- mögöttes

- megért

- megértés

- használ

- használati eset

- felhasználási esetek

- használt

- használó

- Felhasználók

- segítségével

- ÉRVÉNYESÍT

- érték

- különféle

- igazolható

- keresztül

- videó

- várjon

- akar

- Út..

- we

- háló

- honlapok

- JÓL

- voltak

- Mit

- amikor

- ami

- Fehér papírok

- lesz

- ablakok

- val vel

- nélkül

- szó

- Munka

- dolgozó

- művek

- világ

- yaml

- év

- így

- te

- A te

- zephyrnet