Posting ini ditulis bersama Jad Chamoun, Direktur Teknik di Forethought Technologies, Inc. dan Salina Wu, Insinyur ML Senior di Forethought Technologies, Inc.

Pemikiran sebelumnya adalah suite AI generatif terkemuka untuk layanan pelanggan. Inti dari rangkaiannya adalah inovasi DukunganGPT™ teknologi yang menggunakan pembelajaran mesin untuk mengubah siklus hidup dukungan pelanggan—meningkatkan defleksi, meningkatkan CSAT, dan meningkatkan produktivitas agen. SupportGPT™ memanfaatkan sistem Pengambilan Informasi (IR) canggih dan model bahasa besar (LLM) untuk menggerakkan lebih dari 30 juta interaksi pelanggan setiap tahun.

Kasus penggunaan utama SupportGPT adalah meningkatkan kualitas dan efisiensi interaksi dan operasi dukungan pelanggan. Dengan menggunakan sistem IR canggih yang didukung oleh penyematan dan model peringkat, SupportGPT dapat dengan cepat mencari informasi yang relevan, memberikan jawaban yang akurat dan ringkas untuk pertanyaan pelanggan. Pemikiran ke depan menggunakan model yang disesuaikan per pelanggan untuk mendeteksi niat pelanggan untuk menyelesaikan interaksi pelanggan. Integrasi model bahasa besar membantu memanusiakan interaksi dengan agen otomatis, menciptakan pengalaman dukungan yang lebih menarik dan memuaskan.

SupportGPT juga membantu agen dukungan pelanggan dengan menawarkan saran pelengkapan otomatis dan menyusun tanggapan yang sesuai untuk tiket pelanggan yang selaras dengan perusahaan berdasarkan balasan sebelumnya. Dengan menggunakan model bahasa tingkat lanjut, agen dapat menangani masalah pelanggan dengan lebih cepat dan lebih akurat, sehingga menghasilkan kepuasan pelanggan yang lebih tinggi.

Selain itu, arsitektur SupportGPT memungkinkan pendeteksian celah dalam basis pengetahuan dukungan, yang membantu agen memberikan informasi yang lebih akurat kepada pelanggan. Setelah kesenjangan ini teridentifikasi, SupportGPT dapat secara otomatis membuat artikel dan konten lain untuk mengisi kekosongan pengetahuan ini, memastikan basis pengetahuan dukungan tetap berpusat pada pelanggan dan terkini.

Dalam posting ini, kami membagikan cara penggunaan Forethink Amazon SageMaker titik akhir multi-model dalam kasus penggunaan AI generatif untuk menghemat biaya lebih dari 66%.

Tantangan infrastruktur

Untuk membantu menghadirkan kemampuan ini ke pasar, Forethink secara efisien menskalakan beban kerja ML-nya dan memberikan solusi yang sangat dipersonalisasi yang disesuaikan dengan kasus penggunaan khusus setiap pelanggan. Hiper-personalisasi ini dicapai melalui penyetelan halus model penyematan dan pengklasifikasi pada data pelanggan, memastikan hasil pengambilan informasi yang akurat dan pengetahuan domain yang memenuhi kebutuhan unik setiap klien. Model pelengkapan otomatis yang disesuaikan juga disesuaikan dengan data pelanggan untuk lebih meningkatkan akurasi dan relevansi respons yang dihasilkan.

Salah satu tantangan signifikan dalam pemrosesan AI adalah penggunaan sumber daya perangkat keras yang efisien seperti GPU. Untuk mengatasi tantangan ini, Forethought menggunakan titik akhir multi-model (MME) SageMaker untuk menjalankan beberapa model AI pada titik akhir dan skala inferensi tunggal. Karena hiper-personalisasi model memerlukan model unik untuk dilatih dan diterapkan, jumlah model berskala linier dengan jumlah klien, yang dapat menjadi mahal.

Untuk mencapai keseimbangan performa yang tepat untuk inferensi real-time dan biaya, Forethought memilih untuk menggunakan MME SageMaker, yang mendukung akselerasi GPU. MME SageMaker memungkinkan Forethought memberikan solusi berkinerja tinggi, dapat diskalakan, dan hemat biaya dengan latensi subdetik, menangani beberapa skenario dukungan pelanggan dalam skala besar.

SageMaker dan Forethought

SageMaker adalah layanan yang terkelola sepenuhnya yang memberi pengembang dan ilmuwan data kemampuan untuk membuat, melatih, dan menerapkan model ML dengan cepat. MME SageMaker memberikan solusi yang dapat diskalakan dan hemat biaya untuk menerapkan sejumlah besar model untuk inferensi real-time. MME menggunakan wadah penyajian bersama dan kumpulan sumber daya yang dapat menggunakan instans yang dipercepat seperti GPU untuk menghosting semua model Anda. Ini mengurangi biaya hosting dengan memaksimalkan pemanfaatan titik akhir dibandingkan dengan menggunakan titik akhir model tunggal. Ini juga mengurangi overhead penerapan karena SageMaker mengelola pemuatan dan pembongkaran model dalam memori dan menskalakannya berdasarkan pola lalu lintas titik akhir. Selain itu, semua titik akhir waktu nyata SageMaker mendapat manfaat dari kemampuan bawaan untuk mengelola dan memantau model, seperti varian bayangan, penskalaan otomatis, dan integrasi asli dengan amazoncloudwatch (untuk informasi lebih lanjut, lihat Metrik CloudWatch untuk Penerapan Titik Akhir Multi-Model).

Saat Forethink berkembang menjadi host ratusan model yang juga memerlukan sumber daya GPU, kami melihat peluang untuk menciptakan arsitektur yang lebih hemat biaya, andal, dan dapat dikelola melalui MME SageMaker. Sebelum bermigrasi ke MME SageMaker, model kami diterapkan di Kubernetes Layanan Amazon Elastic Kubernetes (AmazonEKS). Meskipun Amazon EKS menyediakan kemampuan manajemen, segera terlihat bahwa kami mengelola infrastruktur yang tidak dirancang khusus untuk inferensi. Pemikiran ke depan harus mengelola inferensi model di Amazon EKS sendiri, yang membebani efisiensi rekayasa. Misalnya, untuk berbagi sumber daya GPU yang mahal di antara beberapa model, kami bertanggung jawab untuk mengalokasikan fraksi memori kaku ke model yang ditentukan selama penerapan. Kami ingin mengatasi masalah utama berikut dengan infrastruktur kami yang ada:

- Harga tinggi – Untuk memastikan bahwa setiap model memiliki sumber daya yang cukup, kami akan sangat konservatif dalam jumlah model yang sesuai untuk setiap instans. Ini menghasilkan biaya yang jauh lebih tinggi untuk hosting model daripada yang diperlukan.

- Keandalan rendah – Meskipun konservatif dalam alokasi memori kami, tidak semua model memiliki persyaratan yang sama, dan kadang-kadang beberapa model akan membuang kesalahan memori (OOM).

- Manajemen yang tidak efisien – Kami harus mengelola manifes penerapan yang berbeda untuk setiap jenis model (seperti pengklasifikasi, penyematan, dan pelengkapan otomatis), yang memakan waktu dan rawan kesalahan. Kami juga harus menjaga logika untuk menentukan alokasi memori untuk tipe model yang berbeda.

Pada akhirnya, kami membutuhkan platform inferensi untuk melakukan tugas berat dalam mengelola model kami pada waktu proses untuk meningkatkan biaya, keandalan, dan pengelolaan penyajian model kami. MME SageMaker memungkinkan kami memenuhi kebutuhan ini.

Melalui pemuatan dan pembongkaran model yang cerdas dan dinamis, serta kemampuan penskalaannya, MME SageMaker memberikan solusi yang jauh lebih murah dan lebih andal untuk menghosting model kami. Kami sekarang dapat menyesuaikan lebih banyak model per instans dan tidak perlu khawatir tentang kesalahan OOM karena MME SageMaker menangani pemuatan dan pembongkaran model secara dinamis. Selain itu, penerapan sekarang semudah memanggil API Boto3 SageMaker dan melampirkan kebijakan penskalaan otomatis yang tepat.

Diagram berikut mengilustrasikan arsitektur warisan kami.

Untuk memulai migrasi ke MME SageMaker, kami mengidentifikasi kasus penggunaan terbaik untuk MME dan model mana yang paling diuntungkan dari perubahan ini. MME paling baik digunakan untuk hal-hal berikut:

- Model yang diharapkan memiliki latensi rendah tetapi dapat menahan waktu mulai dingin (saat pertama kali dimuat)

- Model yang sering dipanggil dan konsisten

- Model yang membutuhkan resource GPU parsial

- Model yang berbagi persyaratan umum dan logika inferensi

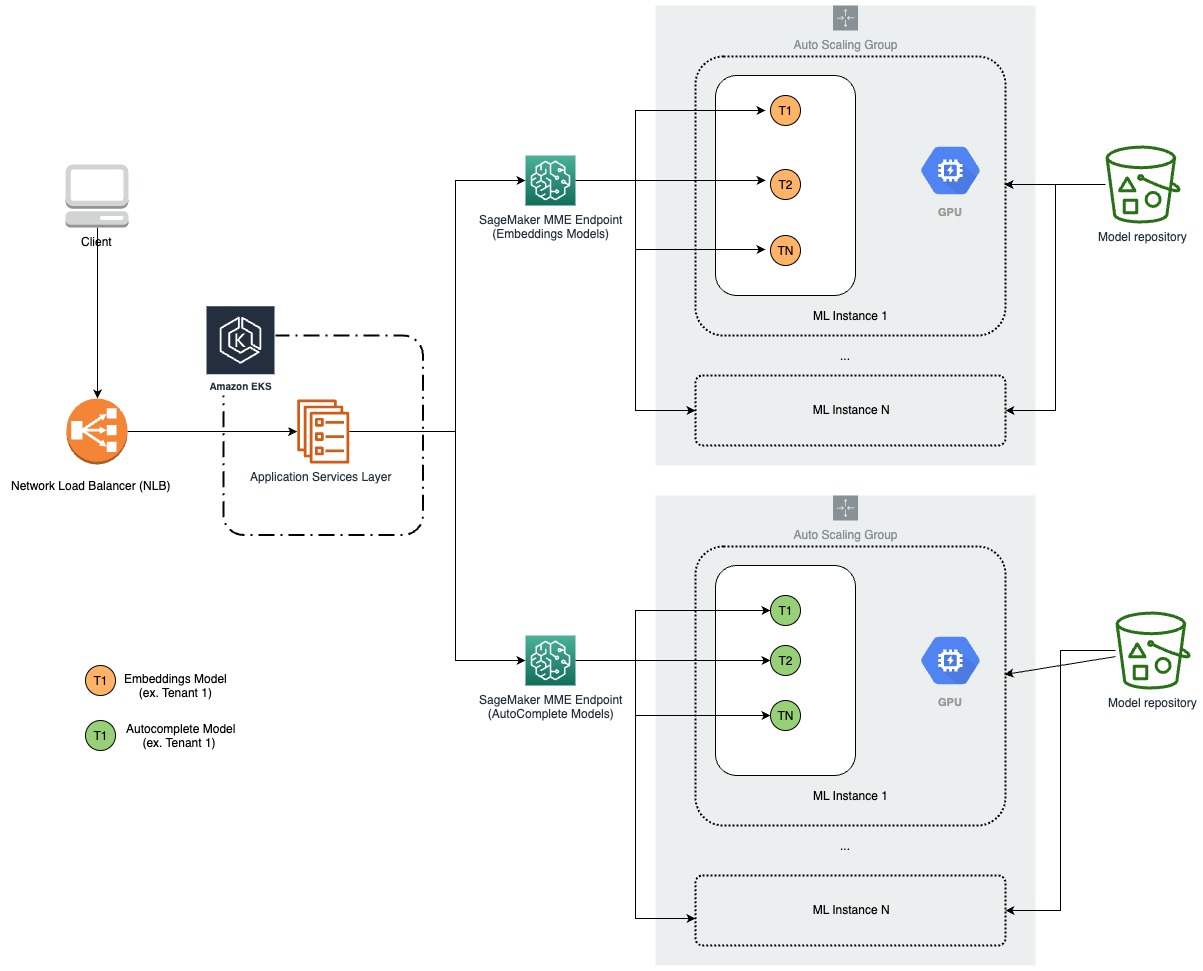

Kami mengidentifikasi model penyematan dan model bahasa pelengkapan otomatis kami sebagai kandidat terbaik untuk migrasi kami. Untuk mengatur model ini di bawah MME, kami akan membuat satu MME per jenis model, atau tugas, satu untuk model penyematan kami, dan satu lagi untuk model bahasa pelengkapan otomatis.

Kami sudah memiliki lapisan API di atas model kami untuk manajemen dan inferensi model. Tugas kami saat ini adalah mengerjakan ulang cara API ini menerapkan dan menangani inferensi pada model di bawah tenda dengan SageMaker, dengan sedikit perubahan pada cara klien dan tim produk berinteraksi dengan API. Kami juga perlu mengemas model dan logika inferensi khusus kami agar kompatibel dengan Server Inferensi NVIDIA Triton menggunakan MME SageMaker.

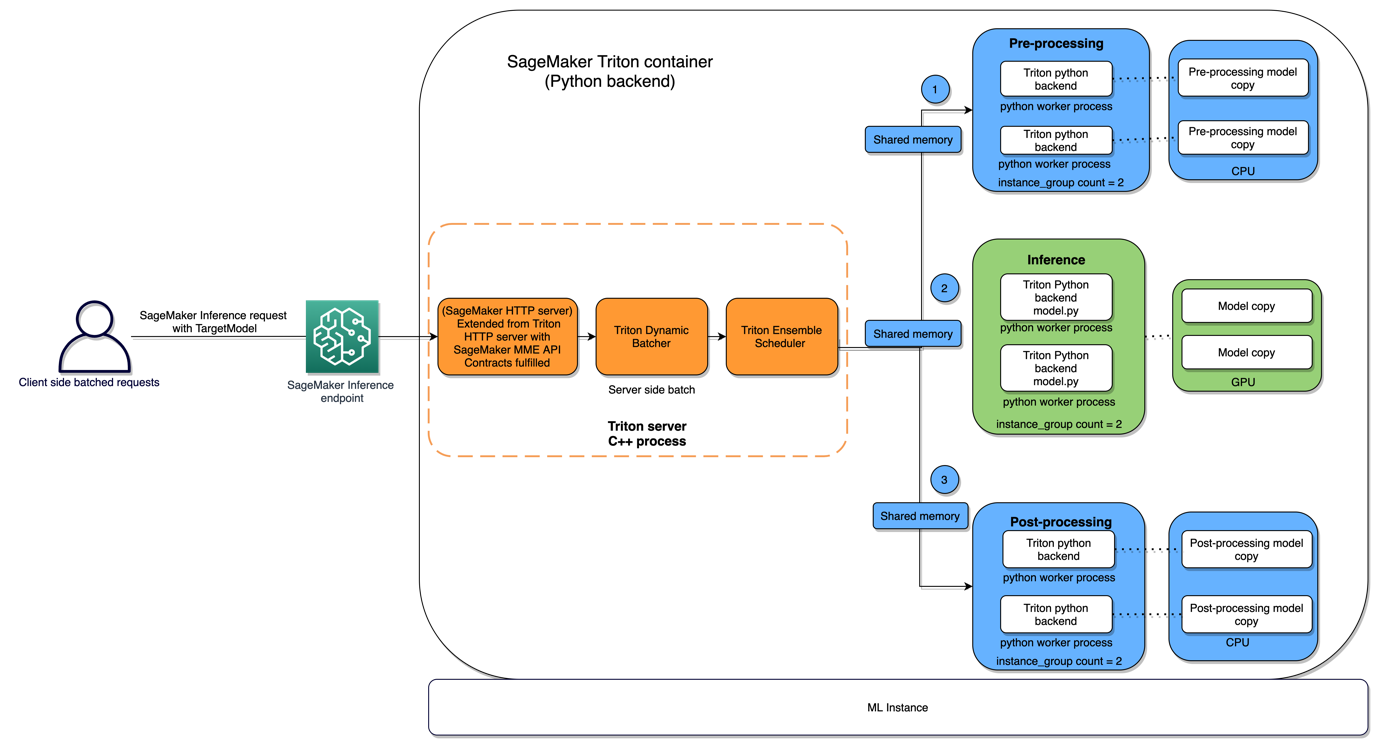

Diagram berikut mengilustrasikan arsitektur baru kami.

Logika inferensi khusus

Sebelum bermigrasi ke SageMaker, kode inferensi khusus Forethought (prapemrosesan dan pascapemrosesan) berjalan di lapisan API saat model dipanggil. Tujuannya adalah untuk mentransfer fungsionalitas ini ke model itu sendiri untuk mengklarifikasi pemisahan tanggung jawab, memodulasi dan menyederhanakan kode mereka, dan mengurangi beban pada API.

Penyematan

Model penyematan pemikiran ke depan terdiri dari dua artefak model PyTorch, dan permintaan inferensi menentukan model mana yang akan dipanggil. Setiap model memerlukan teks yang telah diproses sebelumnya sebagai masukan. Tantangan utama adalah mengintegrasikan langkah preprocessing dan mengakomodasi dua artefak model per definisi model. Untuk mengatasi kebutuhan akan beberapa langkah dalam logika inferensi, Forethought mengembangkan model ansambel Triton dengan dua langkah: proses prapemrosesan backend Python dan panggilan model backend PyTorch. Model ansambel memungkinkan untuk menentukan dan mengurutkan langkah-langkah dalam logika inferensi, dengan setiap langkah diwakili oleh model Triton dari jenis backend apa pun. Untuk memastikan kompatibilitas dengan backend Triton PyTorch, artefak model yang ada dikonversi ke format TorchScript. Model Triton terpisah dibuat untuk setiap definisi model, dan lapisan API Forethought bertanggung jawab untuk menentukan yang sesuai TargetModel untuk memohon berdasarkan permintaan yang masuk.

Autocomplete

Model pelengkapan otomatis (urutan ke urutan) menyajikan serangkaian persyaratan yang berbeda. Secara khusus, kami perlu mengaktifkan kemampuan untuk melakukan loop melalui beberapa panggilan model dan meng-cache input substansial untuk setiap panggilan, sambil mempertahankan latensi rendah. Selain itu, model ini memerlukan langkah preprocessing dan postprocessing. Untuk mengatasi persyaratan ini dan mencapai fleksibilitas yang diinginkan, Forethought mengembangkan model MME pelengkapan otomatis menggunakan backend Triton Python, yang menawarkan keuntungan menulis model sebagai kode Python.

benchmarking

Setelah bentuk model Triton ditentukan, kami menerapkan model ke staging endpoint dan melakukan pembandingan sumber daya dan kinerja. Tujuan utama kami adalah menentukan latensi untuk model mulai dingin vs dalam memori, dan bagaimana latensi dipengaruhi oleh ukuran permintaan dan konkurensi. Kami juga ingin mengetahui berapa banyak model yang dapat ditampung pada setiap instans, berapa banyak model yang akan menyebabkan instans ditingkatkan dengan kebijakan penskalaan otomatis kami, dan seberapa cepat peningkatan akan terjadi. Sesuai dengan jenis instans yang telah kami gunakan, kami melakukan pembandingan dengan instans ml.g4dn.xlarge dan ml.g4dn.2xlarge.

Hasil

Tabel berikut merangkum hasil kami.

| Ukuran Permintaan | Latensi Mulai Dingin | Latensi Inferensi Tembolok | Latensi Serentak (5 permintaan) |

| Kecil (30 token) | 12.7 detik | 0.03 detik | 0.12 detik |

| Sedang (250 token) | 12.7 detik | 0.05 detik | 0.12 detik |

| Besar (550 token) | 12.7 detik | 0.13 detik | 0.12 detik |

Secara nyata, latensi untuk permintaan cold start secara signifikan lebih tinggi daripada latensi untuk permintaan inferensi yang di-cache. Ini karena model perlu dimuat dari disk atau Layanan Penyimpanan Sederhana Amazon (Amazon S3) saat permintaan cold start dibuat. Latensi untuk permintaan bersamaan juga lebih tinggi daripada latensi untuk permintaan tunggal. Hal ini karena model harus dibagi antara permintaan bersamaan, yang dapat menyebabkan pertengkaran.

Tabel berikut membandingkan latensi model lama dan model SageMaker.

| Ukuran Permintaan | Model Warisan | Model SageMaker |

| Kecil (30 token) | 0.74 detik | 0.24 detik |

| Sedang (250 token) | 0.74 detik | 0.24 detik |

| Besar (550 token) | 0.80 detik | 0.32 detik |

Secara keseluruhan, model SageMaker adalah pilihan yang lebih baik untuk menghosting model pelengkapan otomatis daripada model lawas. Mereka menawarkan latensi, skalabilitas, keandalan, dan keamanan yang lebih rendah.

Penggunaan sumber daya

Dalam upaya kami untuk menentukan jumlah model optimal yang dapat ditampung pada setiap instans, kami melakukan serangkaian pengujian. Eksperimen kami melibatkan pemuatan model ke titik akhir kami menggunakan jenis instans ml.g4dn.xlarge, tanpa kebijakan penskalaan otomatis.

Instans khusus ini menawarkan memori 15.5 GB, dan kami bertujuan untuk mencapai sekitar 80% penggunaan memori GPU per instans. Mempertimbangkan ukuran setiap artefak model pembuat enkode, kami berhasil menemukan jumlah pembuat enkode Triton yang optimal untuk dimuat pada instans guna mencapai penggunaan memori GPU yang ditargetkan. Selain itu, mengingat bahwa setiap model penyematan kami sesuai dengan dua model pembuat enkode Triton, kami dapat menampung sejumlah model penyematan per instans. Hasilnya, kami menghitung jumlah total instans yang diperlukan untuk melayani semua model penyematan kami. Eksperimen ini sangat penting dalam mengoptimalkan penggunaan sumber daya kami dan meningkatkan efisiensi model kami.

Kami melakukan pembandingan serupa untuk model pelengkapan otomatis kami. Model-model ini masing-masing berukuran sekitar 292.0 MB. Saat kami menguji berapa banyak model yang muat pada satu instans ml.g4dn.xlarge, kami melihat bahwa kami hanya dapat memuat empat model sebelum instans kami mulai menurunkan model, meskipun model memiliki ukuran kecil. Perhatian utama kami adalah:

- Penyebab lonjakan penggunaan memori CPU

- Penyebab model diturunkan saat kami mencoba memuat dalam satu model lagi, bukan hanya model yang paling jarang digunakan (LRU)

Kami dapat menentukan akar penyebab lonjakan penggunaan memori yang berasal dari menginisialisasi lingkungan runtime CUDA kami dalam model Python kami, yang diperlukan untuk memindahkan model dan data kami ke dalam dan ke luar perangkat GPU. CUDA memuat banyak dependensi eksternal ke dalam memori CPU saat runtime diinisialisasi. Karena backend Triton PyTorch menangani dan memisahkan data yang dipindahkan ke dalam dan ke luar perangkat GPU, kami tidak mengalami masalah ini untuk model penyematan kami. Untuk mengatasinya, kami mencoba menggunakan instans ml.g4dn.2xlarge, yang memiliki jumlah memori GPU yang sama tetapi memori CPU dua kali lipat. Selain itu, kami menambahkan beberapa pengoptimalan kecil dalam kode backend Python kami, termasuk menghapus tensor setelah digunakan, mengosongkan cache, menonaktifkan gradien, dan pengumpulan sampah. Dengan jenis instans yang lebih besar, kami dapat memuat 10 model per instans, dan pemanfaatan memori CPU dan GPU menjadi jauh lebih selaras.

Diagram berikut menggambarkan arsitektur ini.

Penskalaan otomatis

Kami melampirkan kebijakan penskalaan otomatis ke penyematan dan MME pelengkapan otomatis kami. Kebijakan kami untuk titik akhir sematan kami menargetkan penggunaan memori GPU rata-rata 80% menggunakan metrik khusus. Model pelengkapan otomatis kami melihat pola lalu lintas tinggi selama jam kerja dan lalu lintas minimal dalam semalam. Karena itu, kami membuat kebijakan penskalaan otomatis berdasarkan InvocationsPerInstance sehingga kami dapat menskalakan menurut pola lalu lintas, menghemat biaya tanpa mengorbankan keandalan. Berdasarkan tolok ukur penggunaan sumber daya, kami mengonfigurasi kebijakan penskalaan dengan target 225 InvocationsPerInstance.

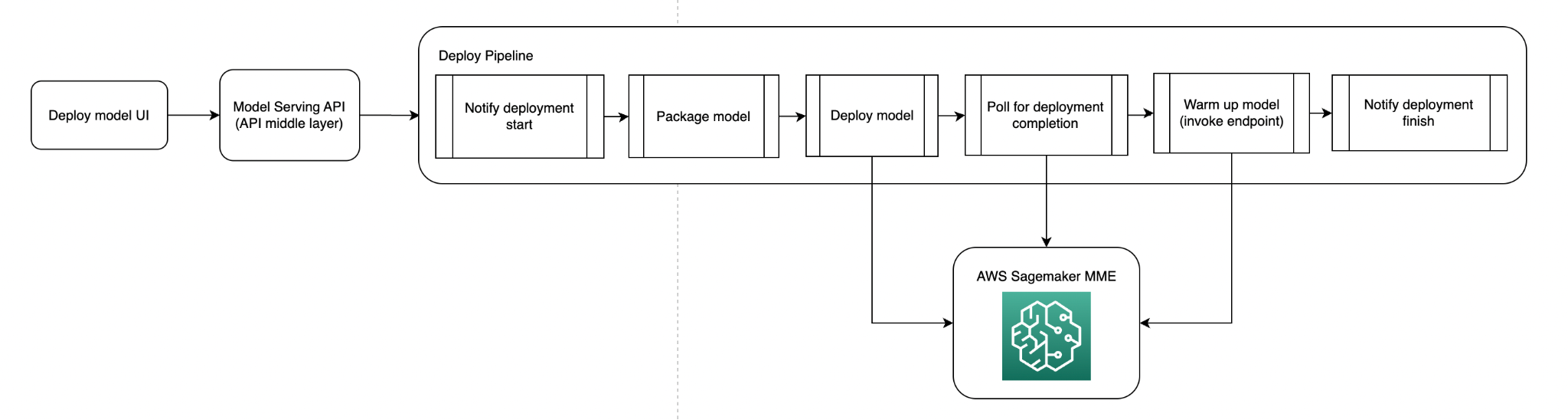

Men-deploy logika dan pipeline

Membuat MME di SageMaker sangat mudah dan mirip dengan membuat titik akhir lainnya di SageMaker. Setelah titik akhir dibuat, menambahkan model tambahan ke titik akhir semudah memindahkan artefak model ke jalur S3 yang menjadi target titik akhir; pada titik ini, kita dapat membuat permintaan inferensi ke model baru kita.

Kami mendefinisikan logika yang akan mengambil metadata model, memformat titik akhir secara deterministik berdasarkan metadata, dan memeriksa apakah ada titik akhir. Jika tidak, kami membuat titik akhir dan menambahkan artefak model Triton ke tambalan S3 untuk titik akhir (juga diformat secara deterministik). Misalnya, jika metadata model menunjukkan bahwa itu adalah model pelengkapan otomatis, itu akan membuat titik akhir untuk model pelengkapan otomatis dan jalur S3 terkait untuk artefak model pelengkapan otomatis. Jika titik akhir ada, kami akan menyalin artefak model ke jalur S3.

Sekarang setelah kami memiliki bentuk model untuk model MME kami dan fungsionalitas untuk menerapkan model kami ke MME, kami memerlukan cara untuk mengotomatiskan penerapan. Pengguna kami harus menentukan model mana yang ingin mereka gunakan; kami menangani pengemasan dan penyebaran model. Kode inferensi khusus yang dikemas dengan model diberi versi dan didorong ke Amazon S3; pada langkah pengemasan, kita tarik kode inferensi sesuai dengan versi yang ditentukan (atau versi terbaru) dan menggunakan file YAML yang menunjukkan struktur file dari model Triton.

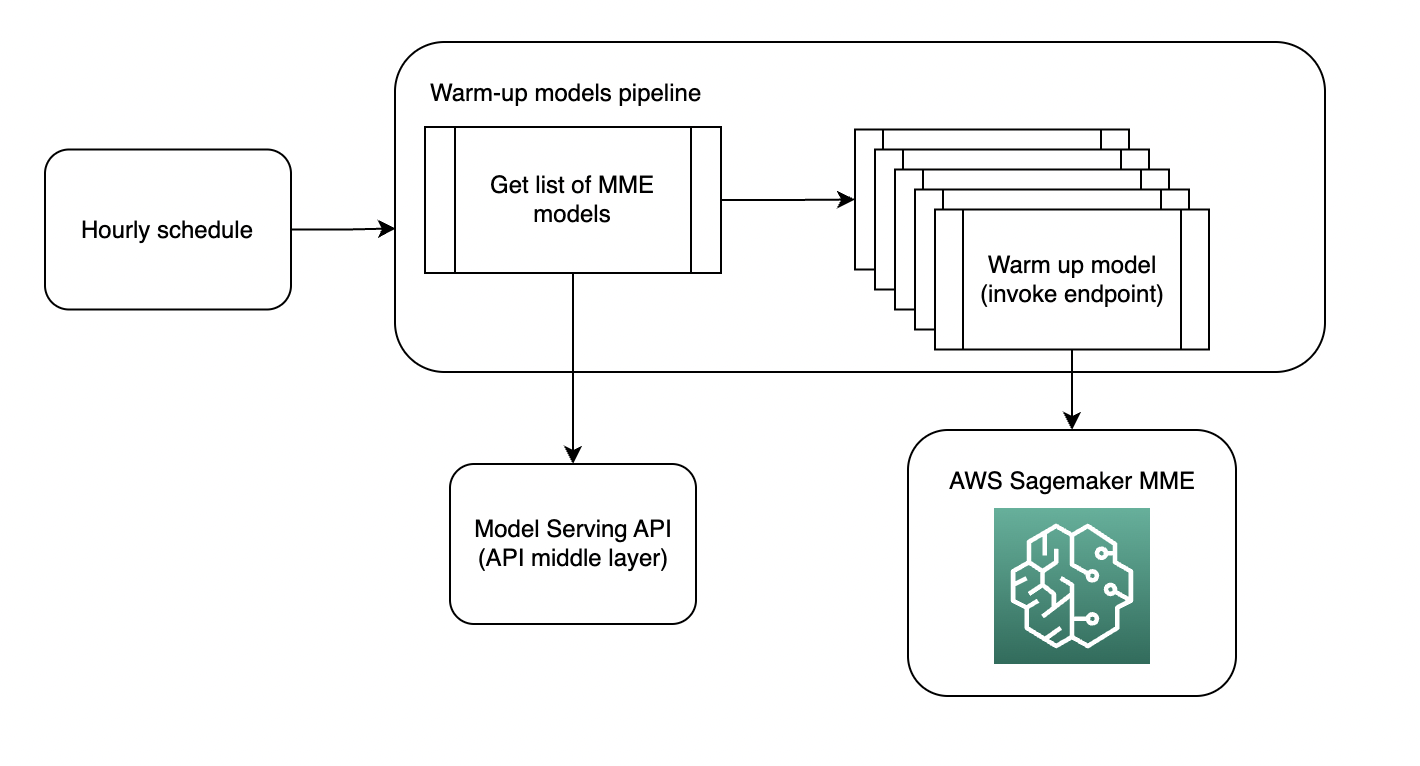

Salah satu persyaratan bagi kami adalah bahwa semua model MME kami akan dimuat ke dalam memori untuk menghindari latensi cold start selama permintaan inferensi produksi untuk dimuat dalam model. Untuk mencapai hal ini, kami menyediakan sumber daya yang cukup agar sesuai dengan semua model kami (berdasarkan pembandingan sebelumnya) dan memanggil setiap model di MME kami dengan irama per jam.

Diagram berikut mengilustrasikan pipa penerapan model.

Diagram berikut mengilustrasikan pipa pemanasan model.

Doa model

Lapisan API kami yang ada menyediakan abstraksi bagi penelepon untuk membuat inferensi pada semua model ML kami. Artinya, kami hanya perlu menambahkan fungsionalitas ke lapisan API untuk memanggil MME SageMaker dengan model target yang benar bergantung pada permintaan inferensi, tanpa perubahan apa pun pada kode panggilan. Kode inferensi SageMaker menerima permintaan inferensi, memformat input Triton yang ditentukan dalam model Triton kami, dan memanggil MME menggunakan Boto3.

Manfaat biaya

Pemikiran ke depan membuat langkah signifikan dalam mengurangi biaya hosting model dan memitigasi kesalahan OOM model, berkat migrasi ke MME SageMaker. Sebelum perubahan ini, instans ml.g4dn.xlarge berjalan di Amazon EKS. Dengan transisi ke MME, kami menemukan bahwa ini dapat menampung 12 model penyematan per instans sekaligus mencapai penggunaan memori GPU 80%. Hal ini menyebabkan penurunan yang signifikan dalam pengeluaran bulanan kami. Singkatnya, kami menyadari penghematan biaya hingga 80%. Selain itu, untuk mengelola lalu lintas yang lebih tinggi, kami mempertimbangkan untuk meningkatkan replika. Dengan asumsi skenario di mana kami menggunakan tiga replika, kami menemukan bahwa penghematan biaya kami akan tetap besar bahkan dalam kondisi ini, berkisar sekitar 43%.

Perjalanan dengan MME SageMaker telah terbukti bermanfaat secara finansial, mengurangi pengeluaran kami sambil memastikan performa model yang optimal. Sebelumnya, model bahasa pelengkapan otomatis kami diterapkan di Amazon EKS, memerlukan jumlah instans ml.g4dn.xlarge yang bervariasi berdasarkan alokasi memori per model. Hal ini mengakibatkan biaya bulanan yang cukup besar. Namun, dengan migrasi kami baru-baru ini ke MME SageMaker, kami dapat mengurangi biaya ini secara substansial. Sekarang kami menghosting semua model kami di instans ml.g4dn.2xlarge, memberi kami kemampuan untuk mengemas model secara lebih efisien. Hal ini telah memangkas pengeluaran bulanan kami secara signifikan, dan kami sekarang telah menyadari penghematan biaya dalam kisaran 66–74%. Langkah ini telah menunjukkan bagaimana pemanfaatan sumber daya yang efisien dapat menghasilkan penghematan finansial yang signifikan dengan menggunakan MME SageMaker.

Kesimpulan

Dalam postingan ini, kami meninjau bagaimana Forethink menggunakan titik akhir multi-model SageMaker untuk mengurangi biaya inferensi real-time. SageMaker melakukan pekerjaan berat yang tidak berbeda-beda, sehingga Forethought dapat meningkatkan efisiensi teknik. Ini juga memungkinkan Forethink untuk secara dramatis menurunkan biaya inferensi real-time sambil mempertahankan kinerja yang diperlukan untuk operasi bisnis penting. Dengan melakukan itu, Forethink mampu memberikan penawaran yang berbeda untuk pelanggan mereka menggunakan model yang sangat dipersonalisasi. Gunakan SageMaker MME untuk menghosting model Anda dalam skala besar dan mengurangi biaya hosting dengan meningkatkan penggunaan titik akhir. Ini juga mengurangi overhead penerapan karena Amazon SageMaker mengelola pemuatan model dalam memori dan menskalakannya berdasarkan pola lalu lintas ke titik akhir Anda. Anda dapat menemukan contoh kode di hosting beberapa model menggunakan SageMaker MME di GitHub.

Tentang Penulis

Jad Chamun adalah Director of Core Engineering di Forethought. Timnya berfokus pada rekayasa platform yang mencakup Rekayasa Data, Infrastruktur Pembelajaran Mesin, dan Infrastruktur Cloud. Anda dapat menemukannya di LinkedIn.

Jad Chamun adalah Director of Core Engineering di Forethought. Timnya berfokus pada rekayasa platform yang mencakup Rekayasa Data, Infrastruktur Pembelajaran Mesin, dan Infrastruktur Cloud. Anda dapat menemukannya di LinkedIn.

Salina Wu adalah Sr. Insinyur Infrastruktur Pembelajaran Mesin di Forethought.ai. Dia bekerja sama dengan tim Machine Learning untuk membangun dan memelihara pelatihan end-to-end, penyajian, dan infrastruktur data mereka. Dia sangat termotivasi dengan memperkenalkan cara baru untuk meningkatkan efisiensi dan mengurangi biaya di seluruh ruang ML. Saat tidak bekerja, Salina menikmati berselancar, membuat tembikar, dan berada di alam bebas.

Salina Wu adalah Sr. Insinyur Infrastruktur Pembelajaran Mesin di Forethought.ai. Dia bekerja sama dengan tim Machine Learning untuk membangun dan memelihara pelatihan end-to-end, penyajian, dan infrastruktur data mereka. Dia sangat termotivasi dengan memperkenalkan cara baru untuk meningkatkan efisiensi dan mengurangi biaya di seluruh ruang ML. Saat tidak bekerja, Salina menikmati berselancar, membuat tembikar, dan berada di alam bebas.

James Taman adalah Arsitek Solusi di Amazon Web Services. Dia bekerja dengan Amazon.com untuk merancang, membangun, dan menerapkan solusi teknologi di AWS, dan memiliki minat khusus pada AI dan pembelajaran mesin. Di waktu senggangnya, dia senang mencari budaya baru, pengalaman baru, dan tetap up to date dengan tren teknologi terkini. Anda dapat menemukannya di LinkedIn.

James Taman adalah Arsitek Solusi di Amazon Web Services. Dia bekerja dengan Amazon.com untuk merancang, membangun, dan menerapkan solusi teknologi di AWS, dan memiliki minat khusus pada AI dan pembelajaran mesin. Di waktu senggangnya, dia senang mencari budaya baru, pengalaman baru, dan tetap up to date dengan tren teknologi terkini. Anda dapat menemukannya di LinkedIn.

Sunil Padmanabhan adalah Arsitek Solusi Startup di AWS. Sebagai mantan pendiri dan CTO startup, dia sangat menyukai pembelajaran mesin dan berfokus membantu startup memanfaatkan AI/ML untuk hasil bisnis mereka dan merancang serta menerapkan solusi ML/AI dalam skala besar.

Sunil Padmanabhan adalah Arsitek Solusi Startup di AWS. Sebagai mantan pendiri dan CTO startup, dia sangat menyukai pembelajaran mesin dan berfokus membantu startup memanfaatkan AI/ML untuk hasil bisnis mereka dan merancang serta menerapkan solusi ML/AI dalam skala besar.

Dhawal Patel adalah Arsitek Pembelajaran Mesin Utama di AWS. Dia telah bekerja dengan organisasi mulai dari perusahaan besar hingga perusahaan rintisan menengah pada masalah yang terkait dengan komputasi terdistribusi, dan Kecerdasan Buatan. Dia berfokus pada Deep learning termasuk domain NLP dan Computer Vision. Dia membantu pelanggan mencapai inferensi model kinerja tinggi di SageMaker.

Dhawal Patel adalah Arsitek Pembelajaran Mesin Utama di AWS. Dia telah bekerja dengan organisasi mulai dari perusahaan besar hingga perusahaan rintisan menengah pada masalah yang terkait dengan komputasi terdistribusi, dan Kecerdasan Buatan. Dia berfokus pada Deep learning termasuk domain NLP dan Computer Vision. Dia membantu pelanggan mencapai inferensi model kinerja tinggi di SageMaker.

- Konten Bertenaga SEO & Distribusi PR. Dapatkan Amplifikasi Hari Ini.

- Keuangan EVM. Antarmuka Terpadu untuk Keuangan Terdesentralisasi. Akses Di Sini.

- Grup Media Kuantum. IR/PR Diperkuat. Akses Di Sini.

- PlatoAiStream. Kecerdasan Data Web3. Pengetahuan Diperkuat. Akses Di Sini.

- Sumber: https://aws.amazon.com/blogs/machine-learning/how-forethought-saves-over-66-in-costs-for-generative-ai-models-using-amazon-sagemaker/

- :memiliki

- :adalah

- :bukan

- :Di mana

- $NAIK

- 1

- 10

- 100

- 12

- 13

- 15%

- 24

- 250

- 30

- 32

- 7

- 80

- a

- kemampuan

- Sanggup

- Tentang Kami

- abstraksi

- abstrak

- dipercepat

- Menurut

- ketepatan

- tepat

- akurat

- Mencapai

- dicapai

- mencapai

- di seluruh

- menambahkan

- menambahkan

- menambahkan

- tambahan

- Tambahan

- Selain itu

- alamat

- menangani

- maju

- Keuntungan

- Setelah

- Agen

- agen

- AI

- saya menggunakan kasus

- AI / ML

- ditujukan

- meluruskan

- selaras

- Semua

- alokasi

- mengizinkan

- memungkinkan

- sudah

- juga

- Meskipun

- Amazon

- Amazon SageMaker

- Amazon Web Services

- Amazon.com

- jumlah

- an

- dan

- Setiap tahun

- Lain

- jawaban

- Apa pun

- api

- Lebah

- semu

- sesuai

- sekitar

- arsitektur

- ADALAH

- sekitar

- artikel

- buatan

- kecerdasan buatan

- AS

- membantu

- terkait

- At

- mobil

- mengotomatisasikan

- Otomatis

- secara otomatis

- rata-rata

- menghindari

- jauh

- AWS

- Backend

- Saldo

- mendasarkan

- berdasarkan

- BE

- menjadi

- karena

- menjadi

- menjadi

- sebelum

- mulai

- makhluk

- benchmarking

- bermanfaat

- manfaat

- TERBAIK

- Lebih baik

- antara

- meningkatkan

- kedua

- membawa

- membangun

- built-in

- beban

- bisnis

- tapi

- by

- Cache

- dihitung

- panggilan

- bernama

- panggilan

- Panggilan

- CAN

- calon

- kemampuan

- kasus

- kasus

- melayani

- Menyebabkan

- menantang

- tantangan

- perubahan

- Perubahan

- memeriksa

- pilihan

- memilih

- klien

- rapat

- awan

- infrastruktur cloud

- kode

- dingin

- Mengumpulkan

- COM

- kedatangan

- Umum

- Perusahaan

- dibandingkan

- kesesuaian

- cocok

- komputer

- Visi Komputer

- komputasi

- Kekhawatiran

- bersamaan

- Kondisi

- dilakukan

- dikonfigurasi

- konservatif

- besar

- dianggap

- mengingat

- Wadah

- Konten

- dikonversi

- Core

- benar

- berkorespondensi

- Biaya

- penghematan biaya

- hemat biaya

- mahal

- Biaya

- bisa

- penutup

- membuat

- dibuat

- membuat

- sangat penting

- CTO

- adat

- pelanggan

- data pelanggan

- Kepuasan pelanggan

- Layanan Pelanggan

- Customer Support

- pelanggan

- disesuaikan

- data

- Tanggal

- Tolak

- mengurangi

- mendalam

- belajar mendalam

- didefinisikan

- mendefinisikan

- menyampaikan

- mengantarkan

- menunjukkan

- Tergantung

- menyebarkan

- dikerahkan

- penggelaran

- penyebaran

- penyebaran

- Mendesain

- diinginkan

- Meskipun

- Menentukan

- ditentukan

- ditentukan

- menentukan

- dikembangkan

- pengembang

- alat

- MELAKUKAN

- berbeda

- dibedakan

- Kepala

- ditemukan

- berbeda

- didistribusikan

- komputasi terdistribusi

- melakukan

- domain

- domain

- Dont

- secara dramatis

- selama

- dinamis

- dinamis

- setiap

- efisiensi

- efisien

- efisien

- embedding

- aktif

- memungkinkan

- ujung ke ujung

- Titik akhir

- menarik

- insinyur

- Teknik

- mempertinggi

- meningkatkan

- cukup

- memastikan

- memastikan

- perusahaan

- Lingkungan Hidup

- kesalahan

- Bahkan

- Setiap

- contoh

- ada

- diharapkan

- biaya

- mahal

- pengalaman

- Pengalaman

- eksperimen

- luar

- lebih cepat

- File

- File

- mengisi

- keuangan

- secara finansial

- Menemukan

- Pertama

- cocok

- ARMADA KAPAL

- keluwesan

- berfokus

- berikut

- Untuk

- format

- Bekas

- ditemukan

- pendiri

- empat

- dari

- sepenuhnya

- fungsi

- lebih lanjut

- Selanjutnya

- kesenjangan

- menghasilkan

- dihasilkan

- generatif

- AI generatif

- mendapatkan

- gif

- diberikan

- Pemberian

- tujuan

- GPU

- GPU

- gradien

- memiliki

- tangan

- menangani

- Menangani

- Penanganan

- terjadi

- Perangkat keras

- Memiliki

- memiliki

- he

- berat

- angkat berat

- membantu

- membantu

- membantu

- High

- kinerja tinggi

- lebih tinggi

- dia

- -nya

- kap

- tuan rumah

- tuan

- biaya hosting

- JAM

- Rumah

- Seterpercayaapakah Olymp Trade? Kesimpulan

- Namun

- HTML

- http

- HTTPS

- Ratusan

- diidentifikasi

- if

- menggambarkan

- segera

- memperbaiki

- meningkatkan

- in

- Inc

- Termasuk

- masuk

- Meningkatkan

- menunjukkan

- menunjukkan

- informasi

- Infrastruktur

- infrastruktur

- inovatif

- memasukkan

- input

- contoh

- sebagai gantinya

- Mengintegrasikan

- integrasi

- Intelijen

- interaksi

- interaksi

- bunga

- ke

- memperkenalkan

- dipanggil

- memanggil

- terlibat

- isu

- IT

- NYA

- Diri

- perjalanan

- jpg

- hanya

- pemeliharaan

- kunci

- Tahu

- pengetahuan

- bahasa

- besar

- Perusahaan besar

- lebih besar

- Latensi

- Terbaru

- lapisan

- memimpin

- terkemuka

- pengetahuan

- paling sedikit

- Dipimpin

- Warisan

- kurang

- Leverage

- memanfaatkan

- pengangkatan

- memuat

- pemuatan

- beban

- logika

- Rendah

- menurunkan

- mesin

- Mesin belajar

- terbuat

- Utama

- memelihara

- mempertahankan

- membuat

- mengelola

- berhasil

- pengelolaan

- mengelola

- pelaksana

- banyak

- Pasar

- memaksimalkan

- berarti

- Memori

- Metadata

- Metrik

- bermigrasi

- migrasi

- juta

- minimal

- minor

- meringankan

- ML

- model

- model

- Memantau

- bulanan

- lebih

- Selain itu

- paling

- termotivasi

- pindah

- bergerak

- banyak

- Titik Akhir Multi-Model

- beberapa

- harus

- asli

- Alam

- perlu

- Perlu

- dibutuhkan

- kebutuhan

- New

- nLP

- sekarang

- jumlah

- Nvidia

- tujuan

- of

- lepas

- menawarkan

- menawarkan

- Penawaran

- sering

- on

- sekali

- ONE

- hanya

- Operasi

- Kesempatan

- optimal

- mengoptimalkan

- or

- urutan

- organisasi

- Lainnya

- kami

- diri

- di luar

- hasil

- lebih

- semalam

- pak

- paket

- dikemas

- pengemasan

- tertentu

- khususnya

- bergairah

- tambalan

- path

- pola

- pola

- prestasi

- perspektif

- pipa saluran

- Platform

- plato

- Kecerdasan Data Plato

- Data Plato

- Titik

- Kebijakan

- kebijaksanaan

- Pos

- kekuasaan

- didukung

- disajikan

- sebelumnya

- sebelumnya

- primer

- Utama

- Sebelumnya

- masalah

- proses

- pengolahan

- Produk

- Produksi

- produktifitas

- tepat

- terbukti

- memberikan

- disediakan

- menyediakan

- ketentuan

- terdorong

- menempatkan

- Ular sanca

- pytorch

- kualitas

- query

- pencarian

- segera

- jarak

- mulai

- Peringkat

- mencapai

- real-time

- menyadari

- baru

- baru-baru ini

- menurunkan

- mengurangi

- mengurangi

- terkait

- relevansi

- relevan

- keandalan

- dapat diandalkan

- sisa

- diwakili

- permintaan

- permintaan

- wajib

- kebutuhan

- Persyaratan

- membutuhkan

- sumber

- Sumber

- tanggapan

- tanggung jawab

- tanggung jawab

- mengakibatkan

- dihasilkan

- Hasil

- review jurnal

- benar

- kaku

- akar

- Run

- berjalan

- berkorban

- pembuat bijak

- Inferensi SageMaker

- sama

- kepuasan

- Save

- penghematan

- Tabungan

- melihat

- Skalabilitas

- terukur

- Skala

- meningkatkan

- sisik

- skala

- skenario

- skenario

- ilmuwan

- Pencarian

- keamanan

- pencarian

- senior

- terpisah

- Urutan

- Seri

- melayani

- layanan

- Layanan

- porsi

- set

- beberapa

- bayangan

- bentuk

- Share

- berbagi

- dia

- penting

- signifikan

- mirip

- Sederhana

- menyederhanakan

- tunggal

- Ukuran

- kecil

- pintar

- So

- larutan

- Solusi

- MEMECAHKAN

- beberapa

- Space

- tertentu

- Secara khusus

- ditentukan

- paku

- pementasan

- awal

- mulai

- startup

- Startups

- state-of-the-art

- Langkah

- Tangga

- Masih

- penyimpanan

- mudah

- langkah

- besar

- seperti itu

- rangkaian

- mendukung

- sistem

- tabel

- memecahkan

- disesuaikan

- Mengambil

- Dibutuhkan

- target

- ditargetkan

- target

- tugas

- tim

- tim

- Teknologi

- Teknologi

- diuji

- tes

- dari

- Terima kasih

- bahwa

- Grafik

- mereka

- Mereka

- Ini

- mereka

- ini

- tiga

- Melalui

- tiket

- waktu

- membuang-buang waktu

- untuk

- Token

- puncak

- Total

- lalu lintas

- Pelatihan VE

- terlatih

- Pelatihan

- transfer

- Mengubah

- transisi

- Tren

- mencoba

- Pelaut

- Dua kali

- dua

- mengetik

- jenis

- bawah

- unik

- us

- penggunaan

- menggunakan

- gunakan case

- bekas

- Pengguna

- kegunaan

- menggunakan

- Memanfaatkan

- versi

- sangat

- penglihatan

- vs

- ingin

- ingin

- adalah

- Cara..

- cara

- we

- jaringan

- layanan web

- adalah

- ketika

- apakah

- yang

- sementara

- dengan

- tanpa

- Kerja

- bekerja

- bekerja

- kuatir

- akan

- penulisan

- wu

- yaml

- Kamu

- Anda

- zephyrnet.dll