Dalam 2021, yang industri farmasi menghasilkan pendapatan AS sebesar $550 miliar. Perusahaan farmasi menjual berbagai jenis obat yang berbeda, sering kali baru, di pasaran, yang terkadang menimbulkan efek samping serius yang tidak disengaja.

Peristiwa ini dapat dilaporkan di mana saja, dari rumah sakit atau di rumah, dan harus dipantau secara bertanggung jawab dan efisien. Pemrosesan kejadian buruk yang dilakukan secara manual menjadi sulit karena meningkatnya jumlah data dan biaya kesehatan. Secara keseluruhan, $384 miliar diproyeksikan sebagai biaya aktivitas farmakovigilans bagi industri layanan kesehatan secara keseluruhan pada tahun 2022. Untuk mendukung aktivitas farmakovigilans secara menyeluruh, pelanggan farmasi kami ingin menggunakan kekuatan pembelajaran mesin (ML) untuk mengotomatiskan deteksi kejadian buruk dari berbagai sumber data. , seperti umpan media sosial, panggilan telepon, email, dan catatan tulisan tangan, dan memicu tindakan yang sesuai.

Dalam postingan ini, kami menunjukkan cara mengembangkan solusi berbasis ML menggunakan Amazon SageMaker untuk mendeteksi efek samping menggunakan Kumpulan Data Reaksi Merugikan Obat pada Wajah Memeluk yang tersedia untuk umum. Dalam solusi ini, kami menyempurnakan berbagai model Hugging Face yang telah dilatih sebelumnya tentang data medis dan menggunakan model BioBERT, yang telah dilatih sebelumnya tentang Kumpulan data yang dipublikasikan dan melakukan yang terbaik dari yang telah dicoba.

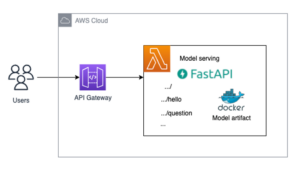

Kami menerapkan solusi menggunakan Kit Pengembangan AWS Cloud (AWSCDK). Namun, kami tidak membahas secara spesifik pembuatan solusi dalam postingan ini. Untuk informasi lebih lanjut tentang penerapan solusi ini, lihat Bangun sistem untuk menangkap kejadian buruk secara real-time menggunakan Amazon SageMaker dan Amazon QuickSight.

Posting ini menggali beberapa bidang utama, memberikan eksplorasi komprehensif tentang topik-topik berikut:

- Tantangan data yang dihadapi oleh AWS Professional Services

- Lanskap dan penerapan model bahasa besar (LLM):

- Transformer, BERT, dan GPT

- Wajah Memeluk

- Solusi LLM yang disempurnakan dan komponennya:

- Persiapan data

- Pelatihan model

Tantangan data

Kemiringan data sering kali menjadi masalah saat melakukan tugas klasifikasi. Idealnya Anda ingin memiliki kumpulan data yang seimbang, dan kasus penggunaan ini tidak terkecuali.

Kami mengatasi ketidaksesuaian ini dengan AI generatif model (Falcon-7B dan Falcon-40B), yang diminta untuk menghasilkan sampel peristiwa berdasarkan lima contoh dari set pelatihan untuk meningkatkan keragaman semantik dan meningkatkan ukuran sampel dari peristiwa merugikan yang diberi label. Ini menguntungkan bagi kami untuk menggunakan model Falcon di sini karena, tidak seperti beberapa LLM di Hugging Face, Falcon memberi Anda set data pelatihan yang mereka gunakan, sehingga Anda dapat yakin bahwa tidak ada contoh set pengujian Anda yang terdapat dalam set pelatihan Falcon dan menghindari data kontaminasi.

Tantangan data lainnya bagi pelanggan layanan kesehatan adalah persyaratan kepatuhan HIPAA. Enkripsi saat diam dan dalam perjalanan harus dimasukkan ke dalam solusi untuk memenuhi persyaratan ini.

Transformer, BERT, dan GPT

Arsitektur transformator adalah arsitektur jaringan saraf yang digunakan untuk tugas pemrosesan bahasa alami (NLP). Ini pertama kali diperkenalkan di koran “Perhatian Adalah Yang Anda Butuhkan” oleh Vaswani dkk. (2017). Arsitektur transformator didasarkan pada mekanisme perhatian, yang memungkinkan model mempelajari ketergantungan jangka panjang antar kata. Transformator, sebagaimana diuraikan dalam makalah aslinya, terdiri dari dua komponen utama: encoder dan decoder. Encoder mengambil urutan masukan sebagai masukan dan menghasilkan urutan keadaan tersembunyi. Dekoder kemudian mengambil keadaan tersembunyi ini sebagai masukan dan menghasilkan urutan keluaran. Mekanisme perhatian digunakan baik di encoder maupun decoder. Mekanisme perhatian memungkinkan model memperhatikan kata-kata tertentu dalam urutan masukan saat menghasilkan urutan keluaran. Hal ini memungkinkan model mempelajari ketergantungan jangka panjang antar kata, yang penting untuk banyak tugas NLP, seperti terjemahan mesin dan peringkasan teks.

Salah satu arsitektur transformator yang lebih populer dan berguna, Representasi Encoder Dua Arah dari Transformers (BERT), adalah model representasi bahasa yang diperkenalkan di 2018. BERT dilatih pada urutan di mana beberapa kata dalam kalimat disamarkan, dan BERT harus mengisi kata-kata tersebut dengan mempertimbangkan kata sebelum dan sesudah kata yang disamarkan. BERT dapat disesuaikan untuk berbagai tugas NLP, termasuk menjawab pertanyaan, inferensi bahasa alami, dan analisis sentimen.

Arsitektur trafo populer lainnya yang telah menggemparkan dunia adalah Generative Pre-trained Transformer (GPT). Model GPT pertama adalah diperkenalkan pada tahun 2018 oleh OpenAI. Ia bekerja dengan dilatih untuk secara ketat memprediksi kata berikutnya secara berurutan, hanya menyadari konteks sebelum kata tersebut. Model GPT dilatih pada kumpulan data teks dan kode yang sangat besar, dan model tersebut dapat disesuaikan untuk berbagai tugas NLP, termasuk pembuatan teks, menjawab pertanyaan, dan ringkasan.

Secara umum, BERT lebih baik dalam tugas-tugas yang membutuhkan pemahaman lebih dalam tentang konteks kata GPT lebih cocok untuk tugas-tugas yang memerlukan pembuatan teks.

Wajah Memeluk

Hugging Face adalah perusahaan kecerdasan buatan yang berspesialisasi dalam NLP. Ini menyediakan platform dengan alat dan sumber daya yang memungkinkan pengembang membangun, melatih, dan menerapkan model ML yang berfokus pada tugas NLP. Salah satu penawaran utama Hugging Face adalah perpustakaannya, transformer, yang mencakup model terlatih yang dapat disesuaikan untuk berbagai tugas bahasa seperti klasifikasi teks, terjemahan, peringkasan, dan menjawab pertanyaan.

Hugging Face terintegrasi secara lancar dengan SageMaker, yang merupakan layanan terkelola sepenuhnya yang memungkinkan pengembang dan ilmuwan data membangun, melatih, dan menerapkan model ML dalam skala besar. Sinergi ini menguntungkan pengguna dengan menyediakan infrastruktur yang kuat dan terukur untuk menangani tugas-tugas NLP dengan model canggih yang ditawarkan Hugging Face, dikombinasikan dengan layanan ML yang kuat dan fleksibel dari AWS. Anda juga dapat mengakses model Hugging Face langsung dari Mulai Lompatan Amazon SageMaker, sehingga memudahkan untuk memulai dengan solusi yang sudah dibuat sebelumnya.

Ikhtisar solusi

Kami menggunakan perpustakaan Hugging Face Transformers untuk menyempurnakan model transformator di SageMaker untuk tugas klasifikasi kejadian buruk. Pekerjaan pelatihan dibuat menggunakan estimator SageMaker PyTorch. SageMaker JumpStart juga memiliki beberapa integrasi pelengkap dengan Hugging Face yang memudahkan penerapannya. Di bagian ini, kami menjelaskan langkah-langkah utama yang terlibat dalam persiapan data dan pelatihan model.

Persiapan data

Kami menggunakan Data Reaksi Obat yang Merugikan (ade_corpus_v2) dalam kumpulan data Hugging Face dengan pembagian pelatihan/pengujian 80/20. Struktur data yang diperlukan untuk pelatihan dan inferensi model kami memiliki dua kolom:

- Satu kolom untuk konten teks sebagai data input model.

- Kolom lain untuk kelas label. Kami memiliki dua kemungkinan kelas untuk sebuah teks:

Not_AEdanAdverse_Event.

Pelatihan dan eksperimen model

Untuk mengeksplorasi secara efisien ruang kemungkinan model Hugging Face untuk menyempurnakan data gabungan kejadian buruk kami, kami membuat tugas optimasi hyperparameter (HPO) SageMaker dan meneruskan model Hugging Face yang berbeda sebagai hyperparameter, bersama dengan hyperparameter penting lainnya seperti ukuran batch pelatihan, panjang urutan, model, dan kecepatan pembelajaran. Tugas pelatihan menggunakan instans ml.p3dn.24xlarge dan memerlukan waktu rata-rata 30 menit per tugas dengan jenis instans tersebut. Metrik pelatihan ditangkap melalui Eksperimen Amazon SageMaker alat, dan setiap tugas pelatihan dijalankan melalui 10 periode.

Kami menentukan yang berikut ini dalam kode kami:

- Ukuran batch pelatihan – Jumlah sampel yang diproses bersama sebelum bobot model diperbarui

- Panjang urutan – Panjang maksimum urutan masukan yang dapat diproses BERT

- Tingkat belajar – Seberapa cepat model memperbarui bobotnya selama pelatihan

- Model – Model terlatih Memeluk Wajah

Hasil

Model yang memiliki performa terbaik dalam kasus penggunaan kami adalah monologg/biobert_v1.1_pubmed model yang dihosting di Hugging Face, yang merupakan versi arsitektur BERT yang telah dilatih sebelumnya pada kumpulan data Pubmed, yang terdiri dari 19,717 publikasi ilmiah. BERT pra-pelatihan pada kumpulan data ini memberi model ini keahlian ekstra dalam mengidentifikasi konteks seputar istilah ilmiah yang terkait dengan medis. Hal ini meningkatkan performa model untuk tugas deteksi kejadian buruk karena model tersebut telah dilatih sebelumnya tentang sintaksis khusus medis yang sering muncul di kumpulan data kami.

Tabel berikut merangkum metrik evaluasi kami.

| Model | Ketelitian | Mengingat kembali | F1 |

| Basis BERT | 0.87 | 0.95 | 0.91 |

| BioBert | 0.89 | 0.95 | 0.92 |

| BioBERT dengan HPO | 0.89 | 0.96 | 0.929 |

| BioBERT dengan HPO dan efek samping yang dihasilkan secara sintetis | 0.90 | 0.96 | 0.933 |

Meskipun perbaikan ini relatif kecil dan bersifat bertahap dibandingkan model BERT dasar, hal ini menunjukkan beberapa strategi yang layak untuk meningkatkan kinerja model melalui metode ini. Pembuatan data sintetis dengan Falcon tampaknya menjanjikan dan berpotensi meningkatkan kinerja, terutama karena model AI generatif ini semakin baik seiring berjalannya waktu.

Membersihkan

Untuk menghindari timbulnya biaya di masa mendatang, hapus semua sumber daya yang dibuat seperti model dan titik akhir model yang Anda buat dengan kode berikut:

Kesimpulan

Banyak perusahaan farmasi saat ini ingin mengotomatiskan proses mengidentifikasi efek samping dari interaksi pelanggan mereka dengan cara yang sistematis untuk membantu meningkatkan keselamatan dan hasil pelanggan. Seperti yang kami tunjukkan di postingan ini, LLM BioBERT yang disempurnakan dengan efek samping yang dihasilkan secara sintetis yang ditambahkan ke data mengklasifikasikan efek samping dengan skor F1 tinggi dan dapat digunakan untuk membangun solusi yang sesuai dengan HIPAA bagi pelanggan kami.

Seperti biasa, AWS menyambut baik masukan Anda. Silakan tinggalkan pemikiran dan pertanyaan Anda di bagian komentar.

Tentang penulis

Zack Peterson adalah ilmuwan data di AWS Professional Services. Dia telah terlibat dalam memberikan solusi pembelajaran mesin kepada pelanggan selama bertahun-tahun dan memiliki gelar master di bidang Ekonomi.

Zack Peterson adalah ilmuwan data di AWS Professional Services. Dia telah terlibat dalam memberikan solusi pembelajaran mesin kepada pelanggan selama bertahun-tahun dan memiliki gelar master di bidang Ekonomi.

Dr.Adewale Akinfaderin adalah ilmuwan data senior di bidang Kesehatan dan Ilmu Hayati di AWS. Keahliannya adalah dalam metode AI/ML yang dapat direproduksi dan end-to-end, implementasi praktis, dan membantu pelanggan layanan kesehatan global merumuskan dan mengembangkan solusi terukur untuk masalah interdisipliner. Ia memiliki dua gelar sarjana di bidang Fisika dan gelar doktor di bidang Teknik.

Dr.Adewale Akinfaderin adalah ilmuwan data senior di bidang Kesehatan dan Ilmu Hayati di AWS. Keahliannya adalah dalam metode AI/ML yang dapat direproduksi dan end-to-end, implementasi praktis, dan membantu pelanggan layanan kesehatan global merumuskan dan mengembangkan solusi terukur untuk masalah interdisipliner. Ia memiliki dua gelar sarjana di bidang Fisika dan gelar doktor di bidang Teknik.

Ekta Walia Bhullar, PhD, adalah konsultan AI/ML senior di unit bisnis Layanan Profesional AWS Healthcare and Life Sciences (HCLS). Beliau memiliki pengalaman luas dalam penerapan AI/ML dalam domain perawatan kesehatan, khususnya di bidang radiologi. Di luar pekerjaan, saat tidak membahas AI di bidang radiologi, ia suka berlari dan mendaki.

Ekta Walia Bhullar, PhD, adalah konsultan AI/ML senior di unit bisnis Layanan Profesional AWS Healthcare and Life Sciences (HCLS). Beliau memiliki pengalaman luas dalam penerapan AI/ML dalam domain perawatan kesehatan, khususnya di bidang radiologi. Di luar pekerjaan, saat tidak membahas AI di bidang radiologi, ia suka berlari dan mendaki.

Han Man adalah Senior Data Science & Machine Learning Manager dengan AWS Professional Services yang berbasis di San Diego, CA. Beliau memiliki gelar PhD di bidang Teknik dari Northwestern University dan memiliki pengalaman beberapa tahun sebagai konsultan manajemen yang memberikan nasihat kepada klien di bidang manufaktur, jasa keuangan, dan energi. Saat ini, dia dengan penuh semangat bekerja dengan pelanggan utama dari berbagai vertikal industri untuk mengembangkan dan menerapkan solusi ML dan AI generatif di AWS.

Han Man adalah Senior Data Science & Machine Learning Manager dengan AWS Professional Services yang berbasis di San Diego, CA. Beliau memiliki gelar PhD di bidang Teknik dari Northwestern University dan memiliki pengalaman beberapa tahun sebagai konsultan manajemen yang memberikan nasihat kepada klien di bidang manufaktur, jasa keuangan, dan energi. Saat ini, dia dengan penuh semangat bekerja dengan pelanggan utama dari berbagai vertikal industri untuk mengembangkan dan menerapkan solusi ML dan AI generatif di AWS.

- Konten Bertenaga SEO & Distribusi PR. Dapatkan Amplifikasi Hari Ini.

- PlatoData.Jaringan Vertikal Generatif Ai. Berdayakan Diri Anda. Akses Di Sini.

- PlatoAiStream. Intelijen Web3. Pengetahuan Diperkuat. Akses Di Sini.

- PlatoESG. Karbon, teknologi bersih, energi, Lingkungan Hidup, Tenaga surya, Penanganan limbah. Akses Di Sini.

- PlatoHealth. Kecerdasan Uji Coba Biotek dan Klinis. Akses Di Sini.

- Sumber: https://aws.amazon.com/blogs/machine-learning/deploy-large-language-models-for-a-healthtech-use-case-on-amazon-sagemaker/

- :memiliki

- :adalah

- :bukan

- :Di mana

- $NAIK

- 1

- 10

- 100

- 16

- 19

- 2017

- 2018

- 2021

- 2022

- 30

- 32

- 7

- a

- mengakses

- Akun

- ACM

- tindakan

- kegiatan

- menambahkan

- alamat

- menguntungkan

- merugikan

- menasihati

- Setelah

- AI

- Model AI

- AI / ML

- AL

- Semua

- memungkinkan

- sepanjang

- juga

- selalu

- Amazon

- Amazon SageMaker

- Amazon Web Services

- jumlah

- an

- analisis

- dan

- menjawab

- Apa pun

- di manapun

- Aplikasi

- sesuai

- arsitektur

- arsitektur

- ADALAH

- daerah

- sekitar

- buatan

- kecerdasan buatan

- AS

- At

- menghadiri

- perhatian

- mengotomatisasikan

- tersedia

- rata-rata

- menghindari

- sadar

- AWS

- Layanan Profesional AWS

- seimbang

- mendasarkan

- berdasarkan

- BE

- karena

- menjadi

- sebelum

- makhluk

- Manfaat

- TERBAIK

- Lebih baik

- antara

- bidirectional

- Milyar

- meningkatkan

- kedua

- batas-batas

- membangun

- Bangunan

- dibangun di

- bisnis

- tapi

- by

- CA

- Panggilan

- CAN

- ditangkap

- kasus

- menantang

- tantangan

- menantang

- beban

- kelas

- kelas-kelas

- klasifikasi

- klien

- awan

- kode

- Kolom

- Kolom

- bergabung

- datang

- kedatangan

- komentar

- Perusahaan

- perusahaan

- komplementer

- pemenuhan

- komponen

- luas

- terdiri

- dibangun

- konsultan

- berisi

- Konten

- konteks

- Mudah

- Biaya

- Biaya

- menutupi

- membuat

- dibuat

- pelanggan

- pelanggan

- data

- Persiapan data

- ilmu data

- ilmuwan data

- Struktur data

- lebih dalam

- menetapkan

- Derajat

- mengantarkan

- menggali

- menunjukkan

- ketergantungan

- menyebarkan

- menggambarkan

- Deteksi

- mengembangkan

- pengembang

- Pengembangan

- Diego

- berbeda

- langsung

- mendiskusikan

- Keragaman

- domain

- Dont

- obat

- Obat-obatan

- selama

- E&T

- setiap

- Ekonomi

- efisien

- aktif

- memungkinkan

- enkripsi

- ujung ke ujung

- energi

- Teknik

- zaman

- terutama

- penting

- evaluasi

- Acara

- peristiwa

- contoh

- pengecualian

- pengalaman

- keahlian

- eksplorasi

- menyelidiki

- luas

- Pengalaman yang luas

- tambahan

- f1

- Menghadapi

- umpan balik

- mengisi

- keuangan

- jasa keuangan

- Pertama

- lima

- fleksibel

- terfokus

- berikut

- Untuk

- dari

- sepenuhnya

- masa depan

- Umum

- menghasilkan

- dihasilkan

- menghasilkan

- generasi

- generatif

- AI generatif

- mendapatkan

- memberikan

- Aksi

- lulus

- menangani

- tangan

- Memiliki

- he

- Kesehatan

- kesehatan

- industri kesehatan

- Teknologi Kesehatan

- membantu

- membantu

- di sini

- Tersembunyi

- High

- Kenaikan

- -nya

- memegang

- Beranda

- rumah sakit

- host

- Seterpercayaapakah Olymp Trade? Kesimpulan

- How To

- Namun

- HTTPS

- Optimalisasi Hyperparameter

- idealnya

- mengidentifikasi

- melaksanakan

- implementasi

- implementasi

- diimplementasikan

- mengimpor

- penting

- memperbaiki

- perbaikan

- in

- termasuk

- Termasuk

- Tergabung

- Meningkatkan

- meningkatkan

- inkremental

- industri

- informasi

- Infrastruktur

- memasukkan

- contoh

- Terintegrasi

- integrasi

- Intelijen

- interaksi

- ke

- diperkenalkan

- terlibat

- IT

- NYA

- Pekerjaan

- Jobs

- jpg

- kunci

- Area Utama

- label

- diletakkan

- pemandangan

- bahasa

- besar

- BELAJAR

- pengetahuan

- Meninggalkan

- Panjang

- Perpustakaan

- Hidup

- Biologi

- 'like'

- 'like

- LLM

- Lot

- mesin

- Mesin belajar

- terbuat

- Utama

- utama

- MEMBUAT

- Membuat

- pria

- berhasil

- pengelolaan

- manajer

- panduan

- pabrik

- banyak

- Pasar

- besar-besaran

- tuan

- Maksimalkan

- maksimum

- mekanisme

- Media

- medis

- data medis

- Pelajari

- metode

- Metrik

- menit

- ML

- model

- model

- dipantau

- lebih

- harus

- nama

- Alam

- Pengolahan Bahasa alami

- jaringan

- saraf

- saraf jaringan

- Namun

- berikutnya

- nLP

- tidak

- None

- Catatan

- novel

- jumlah

- terjadi

- of

- Penawaran

- Penawaran

- sering

- on

- ONE

- hanya

- optimasi

- or

- urutan

- asli

- Lainnya

- kami

- di luar

- hasil

- keluaran

- di luar

- lebih

- secara keseluruhan

- menyeluruh

- kertas

- Lulus

- untuk

- prestasi

- dilakukan

- melakukan

- farmasi

- phd

- telepon

- panggilan telepon

- Fisika

- Platform

- plato

- Kecerdasan Data Plato

- Data Plato

- silahkan

- Populer

- mungkin

- Pos

- potensi

- kekuasaan

- kuat

- Praktis

- meramalkan

- persiapan

- Masalah

- masalah

- proses

- Diproses

- pengolahan

- menghasilkan

- profesional

- diproyeksikan

- janji

- menyediakan

- menyediakan

- publikasi

- di depan umum

- pytorch

- pertanyaan

- Pertanyaan

- segera

- jarak

- Penilaian

- reaksi

- real-time

- lihat

- regex

- terkait

- relatif

- Dilaporkan

- perwakilan

- membutuhkan

- wajib

- Persyaratan

- Sumber

- bertanggung jawab

- ISTIRAHAT

- kuat

- Run

- Safety/keselamatan

- pembuat bijak

- mencicipi

- San

- San Diego

- terukur

- Skala

- Ilmu

- ILMU PENGETAHUAN

- ilmiah

- ilmuwan

- ilmuwan

- mulus

- Bagian

- tampaknya

- menjual

- semantik

- senior

- putusan pengadilan

- sentimen

- Urutan

- serius

- layanan

- Layanan

- set

- beberapa

- dia

- Menunjukkan

- menunjukkan

- Pertunjukkan

- Ukuran

- condong

- kecil

- So

- Sosial

- media sosial

- larutan

- Solusi

- beberapa

- kadang-kadang

- sumber

- Space

- spesialisasi

- tertentu

- spesifik

- membagi

- awal

- state-of-the-art

- Negara

- Tangga

- badai

- mudah

- strategi

- struktur

- seperti itu

- mendukung

- yakin

- sinergi

- sintaksis

- sintetis

- data sintetis

- secara sintetis

- sistem

- tabel

- diambil

- Dibutuhkan

- pengambilan

- tugas

- tugas

- istilah

- uji

- teks

- Klasifikasi Teks

- bahwa

- Grafik

- Dunia

- mereka

- kemudian

- Ini

- mereka

- ini

- itu

- meskipun?

- Melalui

- waktu

- untuk

- hari ini

- bersama

- mengambil

- alat

- alat

- Topik

- tradisional

- Pelatihan VE

- terlatih

- Pelatihan

- transformator

- transformer

- transit

- Terjemahan

- mencoba

- memicu

- dua

- mengetik

- pemahaman

- satuan

- universitas

- tidak seperti

- Pembaruan

- us

- menggunakan

- gunakan case

- bekas

- berguna

- Pengguna

- menggunakan

- variasi

- berbagai

- versi

- vertikal

- giat

- ingin

- adalah

- Cara..

- we

- jaringan

- layanan web

- Selamat datang

- adalah

- ketika

- sedangkan

- yang

- dengan

- dalam

- Word

- kata

- Kerja

- kerja

- bekerja

- dunia

- akan

- tahun

- Kamu

- Anda

- zephyrnet.dll