Kami baru saja memperkenalkan kemampuan baru di SDK Python Amazon SageMaker yang memungkinkan ilmuwan data menjalankan kode pembelajaran mesin (ML) mereka yang ditulis dalam lingkungan pengembang terintegrasi (IDE) pilihan mereka dan notebook bersama dengan dependensi runtime terkait sebagai Amazon SageMaker pekerjaan pelatihan dengan perubahan kode minimal untuk eksperimen yang dilakukan secara lokal. Ilmuwan data biasanya melakukan beberapa iterasi eksperimen dalam pemrosesan data dan model pelatihan sambil mengerjakan masalah ML apa pun. Mereka ingin menjalankan kode ML ini dan melakukan eksperimen dengan kemudahan penggunaan dan perubahan kode yang minimal. Pelatihan Model Amazon SageMaker membantu ilmuwan data menjalankan tugas pelatihan berskala besar yang terkelola sepenuhnya pada infrastruktur komputasi AWS. Pelatihan SageMaker juga membantu ilmuwan data dengan alat canggih seperti Debugger Amazon SageMaker dan Profiler untuk men-debug dan menganalisis pekerjaan pelatihan skala besar mereka.

Untuk pelanggan dengan anggaran kecil, tim kecil, dan jadwal yang ketat, setiap konsep dan baris kode baru yang ditulis ulang untuk dijalankan di SageMaker membuat mereka kurang produktif dalam tugas inti mereka, yaitu pemrosesan data dan pelatihan model ML. Mereka ingin sekali menulis kode dalam kerangka pilihan mereka dan dapat beralih dengan lancar dari menjalankan kode di notebook atau laptop mereka ke menjalankan kode dalam skala besar menggunakan kemampuan SageMaker.

Dengan kemampuan baru SageMaker Python SDK ini, ilmuwan data dapat memasukkan kode ML mereka ke platform Pelatihan SageMaker dalam beberapa menit. Anda hanya perlu menambahkan satu baris kode ke kode ML Anda, dan SageMaker dengan cerdas memahami kode Anda bersama dengan set data dan pengaturan lingkungan ruang kerja dan menjalankannya sebagai tugas Pelatihan SageMaker. Anda kemudian dapat memanfaatkan kemampuan utama platform Pelatihan SageMaker, seperti kemampuan untuk menskalakan pekerjaan dengan mudah, dan alat terkait lainnya seperti Debugger dan Profiler. Dalam rilis ini, Anda dapat menjalankan kode Python pembelajaran mesin (ML) lokal Anda sebagai tugas pelatihan Amazon SageMaker node tunggal atau beberapa tugas paralel. Pekerjaan pelatihan terdistribusi (di beberapa node) tidak didukung oleh fungsi jarak jauh.

Dalam postingan ini, kami menunjukkan cara menggunakan kemampuan baru ini untuk menjalankan kode ML lokal sebagai tugas Pelatihan SageMaker.

Ikhtisar solusi

Anda kini dapat menjalankan kode ML yang ditulis di IDE atau notebook Anda sebagai tugas Pelatihan SageMaker dengan memberi anotasi pada fungsi, yang berfungsi sebagai titik masuk ke basis kode pengguna, dengan dekorator sederhana. Setelah pemanggilan, kemampuan ini secara otomatis mengambil snapshot dari semua variabel terkait, fungsi, paket, variabel lingkungan, dan persyaratan runtime lainnya dari kode ML Anda, membuat serial, dan mengirimkannya sebagai tugas Pelatihan SageMaker. Ini terintegrasi dengan yang baru diumumkan Fitur SageMaker Python SDK untuk mengatur nilai default untuk parameter. Kemampuan ini menyederhanakan konstruksi SageMaker yang perlu Anda pelajari agar dapat menjalankan kode menggunakan Pelatihan SageMaker. Ilmuwan data dapat menulis, men-debug, dan mengulangi kode mereka dalam IDE pilihan apa pun (seperti Studio Amazon SageMaker, notebook, VS Code, atau PyCharm). Jika sudah siap, Anda dapat membubuhi keterangan fungsi Python Anda dengan @remote dekorator dan menjalankannya sebagai tugas SageMaker dalam skala besar.

Kemampuan ini mengambil objek Python sumber terbuka yang sudah dikenal sebagai argumen dan keluaran. Selain itu, Anda tidak perlu memahami manajemen siklus hidup container dan cukup menjalankan beban kerja Anda di berbagai konteks komputasi (seperti IDE lokal, Studio, atau tugas pelatihan) dengan overhead konfigurasi yang minimal. Untuk menjalankan kode lokal apa pun sebagai tugas Pelatihan SageMaker, kemampuan ini menyimpulkan konfigurasi yang diperlukan untuk menjalankan tugas, seperti Identitas AWS dan Manajemen Akses (IAM), kunci enkripsi, dan konfigurasi jaringan, dari pengaturan Studio atau IDE (yang dapat berupa pengaturan standar) dan meneruskannya ke platform secara default. Anda memiliki fleksibilitas untuk menyesuaikan waktu proses Anda di infrastruktur terkelola SageMaker menggunakan konfigurasi yang disimpulkan atau menimpanya di tingkat SDK dengan meneruskannya sebagai argumen ke dekorator.

Kemampuan baru dari SageMaker Python SDK ini mengubah kode ML Anda di lingkungan ruang kerja yang ada dan setiap kode pemrosesan data terkait serta kumpulan data menjadi tugas Pelatihan SageMaker. Kemampuan ini mencari kode ML yang terbungkus di dalam a @remote dekorator dan secara otomatis menerjemahkannya menjadi pekerjaan yang dijalankan di Studio atau IDE lokal seperti PyCharm.

Di bagian berikut, kita membahas fitur kemampuan baru ini dan cara meluncurkan fungsi python sebagai tugas Pelatihan SageMaker.

Prasyarat

Untuk menggunakan kemampuan SageMaker Python SDK baru ini dan menjalankan kode yang terkait dengan postingan ini, Anda memerlukan prasyarat berikut:

- Akun AWS yang akan berisi semua sumber daya AWS Anda

- Peran IAM untuk mengakses SageMaker

- Akses ke Studio atau instans notebook SageMaker atau IDE seperti PyCharm

Gunakan SDK dari notebook Studio dan SageMaker

Anda dapat menggunakan kemampuan ini dari Studio dengan meluncurkan notebook dan membungkus kode Anda dengan a @remote dekorator di dalam notebook. Pertama-tama Anda perlu mengimpor fungsi jarak jauh menggunakan kode berikut:

from sagemaker.remote_function import remoteSaat Anda menggunakan fungsi dekorator, kemampuan ini akan secara otomatis menginterpretasikan fungsi kode Anda dan menjalankannya sebagai tugas Pelatihan SageMaker.

Anda juga dapat menggunakan kemampuan ini dari instans notebook SageMaker. Pertama-tama Anda harus memulai instance notebook, buka Jupyter atau Jupyter Lab di atasnya, dan luncurkan notebook. Kemudian impor fungsi jarak jauh seperti yang ditunjukkan pada kode sebelumnya dan bungkus kode Anda dengan @remote penghias. Kami menyertakan contoh cara menggunakan fungsi dekorator dan pengaturan terkait nanti di postingan ini.

Gunakan SDK dari lingkungan lokal Anda

Anda juga dapat menggunakan kemampuan ini dari IDE lokal Anda. Sebagai prasyarat, Anda harus memiliki Antarmuka Baris Perintah AWS (AWS CLI), SageMaker Python SDK, dan AWS SDK untuk Python (Boto3) diinstal di lingkungan lokal Anda. Anda perlu mengimpor pustaka ini dalam kode Anda, menyetel sesi SageMaker, menentukan setelan, dan menghias fungsi Anda dengan @remote penghias. Dalam kode contoh berikut, kami menjalankan fungsi pembagian sederhana sebagai tugas Pelatihan SageMaker:

import boto3

import sagemaker

from sagemaker.remote_function import remote sm_session = sagemaker.Session(boto_session=boto3.session.Session(region_name="us-west-2"))

settings = dict(

sagemaker_session=sm_session,

role=<IAM_ROLE_NAME>

instance_type="ml.m5.xlarge",

)

@remote(**settings)

def divide(x, y):

return x / y

if __name__ == "__main__":

print(divide(2, 3.0))Kita dapat menggunakan metodologi serupa untuk menjalankan fungsi lanjutan sebagai tugas pelatihan, seperti yang ditunjukkan di bagian berikutnya.

Luncurkan fungsi Python sebagai pekerjaan SageMaker

Fitur baru SageMaker Python SDK memungkinkan Anda menjalankan fungsi Python sebagai Pekerjaan Pelatihan SageMaker. Setiap kode Python, kode pelatihan ML yang dikembangkan oleh ilmuwan data menggunakan IDE lokal pilihan mereka (PyCharm, VS Code), notebook SageMaker, atau notebook Studio dapat diluncurkan sebagai pekerjaan SageMaker terkelola.

Dalam beban kerja ML yang menggunakan kemampuan ini, set data terkait, dependensi, dan penyiapan lingkungan ruang kerja diserialkan menggunakan kode ML dan dijalankan sebagai tugas SageMaker secara sinkron dan asinkron.

Anda dapat menambahkan @remote anotasi dekorator ke kode Python apa pun termasuk fungsi pemrosesan atau pelatihan ML lokal untuk meluncurkannya sebagai tugas Pelatihan SageMaker terkelola, sehingga memanfaatkan manfaat skala, kinerja, dan biaya SageMaker. Ini dapat dicapai dengan sedikit perubahan kode dengan menambahkan dekorator ke kode fungsi Python. Pemanggilan ke fungsi yang didekorasi dijalankan secara sinkron, dan fungsi yang dijalankan menunggu hingga tugas SageMaker selesai.

Pada contoh berikut, kami menggunakan the @remote dekorator untuk meluncurkan tugas SageMaker dalam mode dekorator menggunakan instance ml.m5.large. SageMaker menggunakan tugas pelatihan untuk meluncurkan fungsi ini sebagai tugas terkelola.

from sagemaker.remote_function import remote

from numpy as np @remote(instance_type="ml.m5.large")

def matrix_multiply(a, b): return np.matmul(a, b) a = np.array([[1, 0], [0, 1]])

b = np.array([1, 2]) assert matrix_multiply(a, b) == np.array([1,2])Anda juga dapat menggunakan mode dekorator untuk meluncurkan tugas SageMaker, paket Python, dan dependensi. Anda dapat menyertakan variabel lingkungan seperti VPC, subnet, dan grup keamanan untuk meluncurkan tugas pelatihan SageMaker di environment.yml mengajukan. Hal ini memungkinkan engineer dan admin ML untuk mengonfigurasi variabel lingkungan ini sehingga data scientist dapat berfokus pada pembuatan model ML dan melakukan iterasi lebih cepat. Lihat kode berikut:

from sagemaker.remote_function import remote @remote(instance_type="ml.g4dn.xlarge",dependencies = "./environment.yml")

def train_hf_model(

train_input_path,test_input_path,s3_output_path = None,

*,epochs = 1, train_batch_size = 32, eval_batch_size = 64,

warmup_steps = 500,learning_rate = 5e-5

):

model_name = "distilbert-base-uncased"

model = AutoModelForSequenceClassification.from_pretrained(model_name)

... <TRUCNATED>

return os.path.join(s3_output_path, model_dir), eval_resultAnda dapat menggunakan RemoteExecutor untuk meluncurkan fungsi Python sebagai pekerjaan SageMaker secara asinkron. Pelaksana secara asinkron memungut tugas Pelatihan SageMaker untuk memperbarui status tugas. Itu RemoteExecutor kelas merupakan implementasi dari bersamaan.futures.Executor, yang digunakan untuk mengirimkan tugas Pelatihan SageMaker secara asinkron. Lihat kode berikut:

from sagemaker.remote_function import RemoteExecutor def train_hf_model(

train_input_path,test_input_path,s3_output_path = None,

*,epochs = 1, train_batch_size = 32, eval_batch_size = 64,

warmup_steps = 500,learning_rate = 5e-5

):

model_name = "distilbert-base-uncased"

model = AutoModelForSequenceClassification.from_pretrained(model_name)

...<TRUNCATED>

return os.path.join(s3_output_path, model_dir), eval_result with RemoteExecutor(instance_type="ml.g4dn.xlarge", dependencies = './requirements.txt') as e:

future = e.submit(train_hf_model, train_input_path,test_input_path,s3_output_path,

epochs, train_batch_size, eval_batch_size,warmup_steps,learning_rate)Sesuaikan lingkungan runtime

Mode dekorator dan RemoteExecutor memungkinkan Anda menentukan dan menyesuaikan lingkungan runtime untuk tugas SageMaker. Dependensi waktu proses, termasuk paket Python dan variabel lingkungan untuk tugas SageMaker, dapat ditentukan untuk menyesuaikan waktu proses. Untuk menjalankan kode Python lokal sebagai tugas terkelola SageMaker, paket dan dependensi Python harus disediakan untuk SageMaker. Insinyur ML atau administrator ilmu data dapat mengonfigurasi jaringan dan konfigurasi keamanan seperti VPC, subnet, dan grup keamanan untuk tugas SageMaker, sehingga ilmuwan data dapat menggunakan konfigurasi yang dikelola secara terpusat ini saat meluncurkan tugas SageMaker. Anda dapat menggunakan salah satu a requirements.txt file atau Conda environment.yaml file.

Ketika dependensi didefinisikan dengan requirements.txt, paket akan diinstal menggunakan pip di runtime pekerjaan. Jika image yang digunakan untuk menjalankan pekerjaan dilengkapi dengan lingkungan Conda, paket akan diinstal di lingkungan Conda yang dinyatakan digunakan untuk pekerjaan. Kode berikut menunjukkan contoh requirements.txt File:

datasets

transformers

torch

scikit-learn

s3fs==0.4.2

sagemaker>=2.148.0Anda dapat melewati Anda Conda environment.yaml file untuk membuat lingkungan Conda tempat Anda ingin menjalankan kode selama pekerjaan pelatihan. Jika gambar yang digunakan untuk menjalankan pekerjaan mendeklarasikan lingkungan Conda untuk menjalankan kode di bawah, kami akan memperbarui lingkungan Conda yang dideklarasikan dengan spesifikasi yang diberikan. Kode berikut adalah contoh dari a Conda environment.yaml File:

name: sagemaker_example

channels: - conda-forge

dependencies: - python=3.10 - pandas - pip: - sagemakerAtau, Anda dapat mengatur dependencies=”auto_capture” untuk membiarkan SageMaker Python SDK menangkap dependensi yang terinstal di lingkungan Conda yang aktif. Anda harus memiliki lingkungan Conda aktif untuk auto_capture bekerja. Perhatikan bahwa ada prasyarat untuk auto_capture bekerja; kami menyarankan Anda meneruskan dependensi Anda sebagai a requirement.txt or Conda environment.yml file seperti yang dijelaskan di bagian sebelumnya.

Untuk lebih jelasnya, lihat Jalankan kode lokal Anda sebagai tugas Pelatihan SageMaker.

Konfigurasi untuk tugas SageMaker

Pengaturan terkait infrastruktur dapat dipindahkan ke file konfigurasi yang dapat diatur oleh pengguna admin. Anda hanya perlu mengaturnya satu kali. Pengaturan infrastruktur mencakup konfigurasi jaringan, peran IAM, Layanan Penyimpanan Sederhana Amazon (Amazon S3) folder untuk input, output data, dan tag. Mengacu pada Mengonfigurasi dan menggunakan default dengan SageMaker Python SDK lebih lanjut.

SchemaVersion: '1.0'

SageMaker:

PythonSDK:

Modules:

RemoteFunction:

Dependencies: path/to/requirements.txt

EnvironmentVariables: {"EnvVarKey": "EnvVarValue"}

ImageUri: 366666666666.dkr.ecr.us-west-2.amazonaws.com/my-image:latest

InstanceType: ml.m5.large

RoleArn: arn:aws:iam::366666666666:role/MyRole

S3KmsKeyId: somekmskeyid

S3RootUri: s3://my-bucket/my-project

SecurityGroupIds:

- sg123

Subnets:

- subnet-1234

Tags:

- {"Key": "someTagKey", "Value": "someTagValue"}

VolumeKmsKeyId: somekmskeyidOrganisasi

Model pembelajaran mendalam seperti PyTorch atau TensorFlow juga dapat dijalankan di dalam Studio dengan menjalankan kode sebagai tugas pelatihan di dalam notebook. Untuk menampilkan kemampuan ini di Studio, Anda dapat mengkloning repo ini ke Studio Anda dan menjalankan notebook yang terletak di GitHub gudang.

Contoh ini menunjukkan kasus penggunaan klasifikasi teks biner end-to-end. Kami menggunakan transformer Hugging Face dan perpustakaan dataset untuk menyempurnakan transformer terlatih pada klasifikasi teks biner. Secara khusus, model pra-pelatihan akan disesuaikan dengan menggunakan Kumpulan data IMDb.

Saat Anda mengkloning repositori, Anda harus mencari file-file berikut:

- config.yaml – Sebagian besar argumen dekorator dapat diturunkan ke file konfigurasi untuk memisahkan pengaturan terkait infrastruktur dari basis kode

- pelukanwajah.ipynb – Ini berisi kode untuk melatih model HuggingFace yang telah dilatih sebelumnya, yang akan disesuaikan dengan menggunakan dataset IMDB

- requirement.txt – File ini berisi semua dependensi untuk menjalankan fungsi yang akan digunakan di notebook ini untuk menjalankan kode dan menjalankan pelatihan dari jarak jauh di instans GPU sebagai tugas pelatihan

Saat Anda membuka buku catatan, Anda akan diminta untuk menyiapkan lingkungan buku catatan. Anda dapat memilih citra Data Science 3.0 dengan kernel Python 3 dan ml.m5.large sebagai jenis instans peluncuran cepat untuk menjalankan kode notebook. Jenis instans ini jauh lebih cepat dalam menjalankan lingkungan.

Tugas pelatihan akan dijalankan dalam instance ml.g4dn.xlarge seperti yang ditentukan di config.yaml File:

SchemaVersion: '1.0'

SageMaker:

PythonSDK:

Modules:

RemoteFunction:

# role arn is not required if in SageMaker Notebook instance or SageMaker Studio

# Uncomment the following line and replace with the right execution role if in a local IDE

# RoleArn: <IAM_ROLE_ARN>

InstanceType: ml.g4dn.xlarge

Dependencies: ./requirements.txtGrafik requirements.txt dependensi file untuk menjalankan fungsi untuk melatih model Hugging Face termasuk yang berikut:

datasets

transformers

torch

scikit-learn

# lock s3fs to this specific version as more recent ones introduce dependency on aiobotocore, which is not compatible with botocore

s3fs==0.4.2

sagemaker>=2.148.0,<3Buku catatan Hugging Face menampilkan cara menjalankan pelatihan dari jarak jauh melalui @remote fungsi, yang dijalankan secara sinkron. Oleh karena itu, fungsi dijalankan untuk melatih model akan menunggu hingga tugas Pelatihan SageMaker selesai. Pelatihan akan dijalankan dari jarak jauh dengan instans GPU yang jenis instansnya ditentukan dalam file konfigurasi sebelumnya.

Setelah Anda menjalankan tugas pelatihan, Anda dapat menjalankan sisa sel di notebook untuk memeriksa metrik evaluasi dan mengklasifikasikan teks pada model terlatih kami.

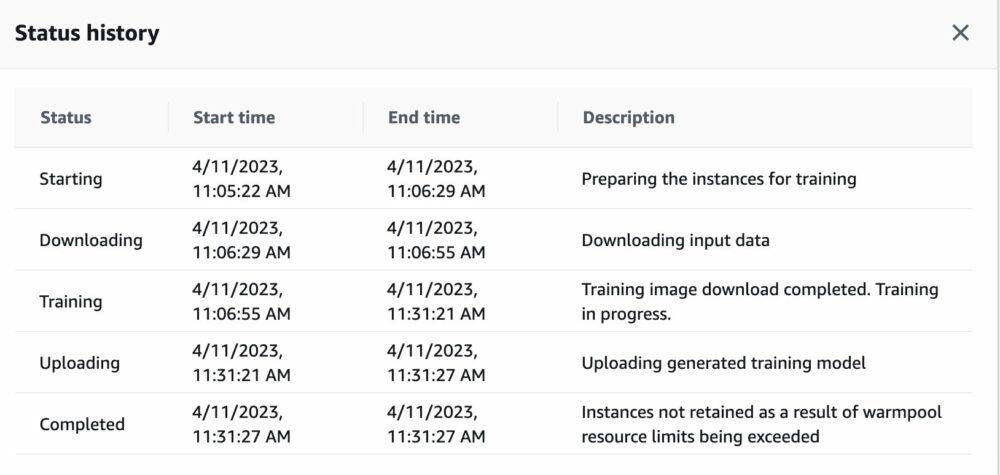

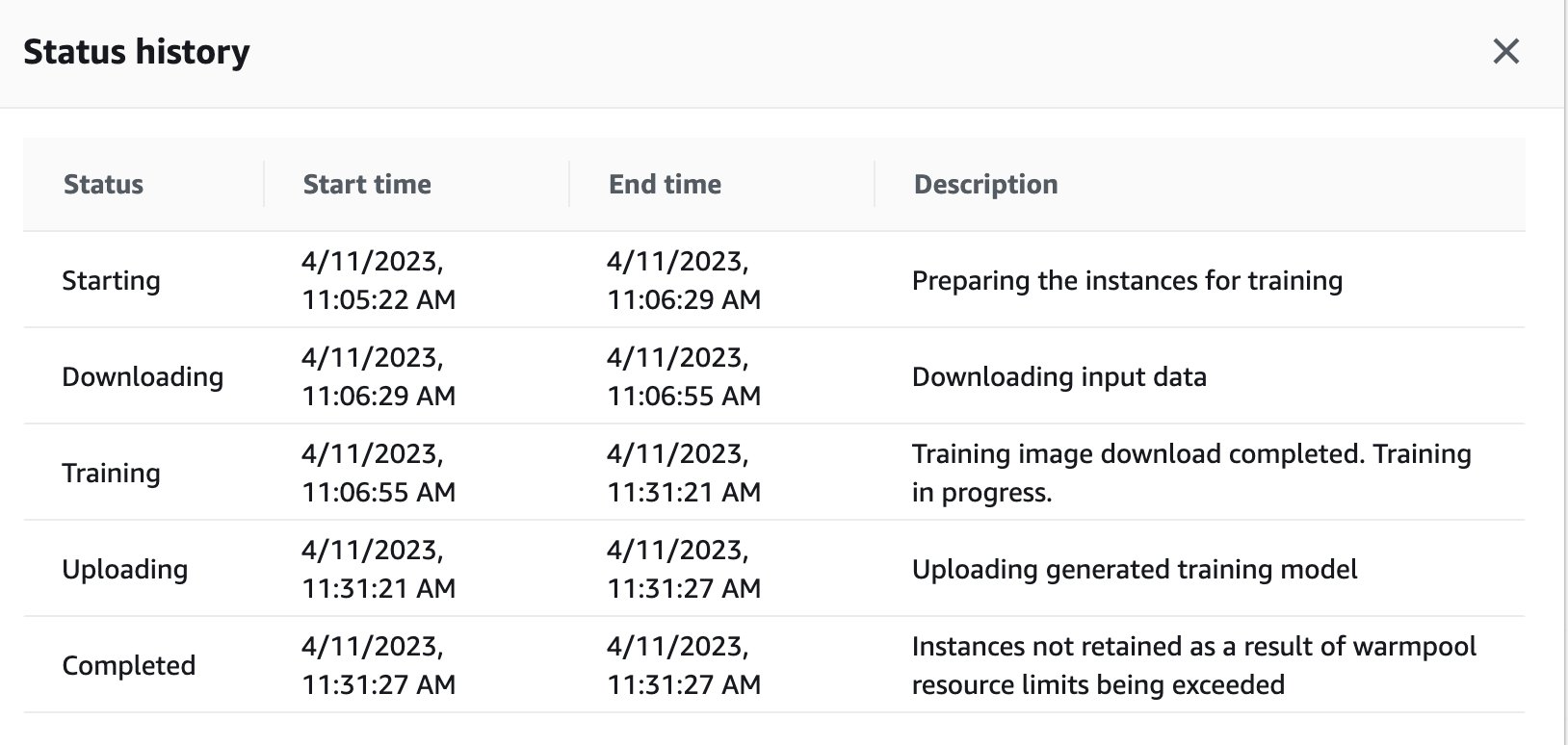

Anda juga dapat melihat status tugas pelatihan yang dipicu dari jarak jauh di instans GPU di dasbor SageMaker dengan menavigasi kembali ke konsol SageMaker.

Segera setelah pekerjaan pelatihan selesai, itu terus menjalankan instruksi di notebook untuk evaluasi dan klasifikasi. Pekerjaan serupa dapat dilatih dan dijalankan melalui fungsi pelaksana jarak jauh yang disematkan di dalam notebook Studio untuk menjalankan proses secara asinkron.

Integrasi dengan eksperimen SageMaker di dalam fungsi @remote

Anda dapat meneruskan nama eksperimen, nama proses, dan parameter lainnya ke fungsi jarak jauh untuk membuat proses eksperimen SageMaker. Contoh kode berikut mengimpor nama eksperimen, nama proses, dan parameter yang akan dicatat dalam log untuk setiap proses:

from sagemaker.remote_function import remote

from sagemaker.experiments.run import Run

# Define your remote function

@remote

def train(value_1, value_2, exp_name, run_name):

...

...

#Creates the experiment

with Run( experiment_name=exp_name, run_name=run_name, sagemaker_session=sagemaker_session

) as run:

...

...

#Define values for the parameters to log

run.log_parameter("param_1", value_1)

run.log_parameter("param_2", value_2)

...

...

#Define metrics to log

run.log_metric("metric_a", 0.5)

run.log_metric("metric_b", 0.1) # Invoke your remote function

train(1.0, 2.0, "my-exp-name", "my-run-name") Pada contoh sebelumnya, parameter p1 dan p2 dicatat dari waktu ke waktu di dalam loop pelatihan. Parameter umum mungkin termasuk ukuran batch atau zaman. Dalam contoh, metrik A dan B dicatat untuk run over waktu di dalam loop pelatihan. Metrik umum dapat mencakup akurasi atau kerugian. Untuk informasi lebih lanjut, lihat Buat Eksperimen Amazon SageMaker.

Kesimpulan

Dalam postingan ini, kami memperkenalkan kemampuan SageMaker Python SDK baru yang memungkinkan ilmuwan data menjalankan kode ML mereka dalam IDE pilihan mereka sebagai tugas Pelatihan SageMaker. Kami membahas prasyarat yang diperlukan untuk menggunakan kemampuan ini beserta fitur-fiturnya. Kami juga menunjukkan cara menggunakan kemampuan ini di Studio, instans notebook SageMaker, dan IDE lokal Anda. Selain itu, kami menyediakan contoh kode contoh untuk mendemonstrasikan cara menggunakan kemampuan ini. Sebagai langkah selanjutnya, kami sarankan untuk mencoba kemampuan ini di IDE atau SageMaker Anda dengan mengikuti contoh kode dirujuk dalam posting ini.

Tentang Penulis

Patroli Dipankar adalah Insinyur Pengembangan Perangkat Lunak di AWS SageMaker, berinovasi dan membangun solusi MLOps untuk membantu pelanggan mengadopsi solusi AI/ML dalam skala besar. Dia memiliki gelar MS dalam Ilmu Komputer dan bidang minatnya adalah Keamanan Komputer, Sistem Terdistribusi dan AI/ML.

Patroli Dipankar adalah Insinyur Pengembangan Perangkat Lunak di AWS SageMaker, berinovasi dan membangun solusi MLOps untuk membantu pelanggan mengadopsi solusi AI/ML dalam skala besar. Dia memiliki gelar MS dalam Ilmu Komputer dan bidang minatnya adalah Keamanan Komputer, Sistem Terdistribusi dan AI/ML.

Farooq Sabir adalah Arsitek Solusi Spesialis Kecerdasan Buatan dan Pembelajaran Mesin Senior di AWS. Dia memegang gelar PhD dan MS di bidang Teknik Listrik dari University of Texas di Austin dan MS di bidang Ilmu Komputer dari Georgia Institute of Technology. Dia memiliki lebih dari 15 tahun pengalaman kerja dan juga suka mengajar dan membimbing mahasiswa. Di AWS, dia membantu pelanggan merumuskan dan memecahkan masalah bisnis mereka dalam ilmu data, pembelajaran mesin, visi komputer, kecerdasan buatan, pengoptimalan numerik, dan domain terkait. Berbasis di Dallas, Texas, dia dan keluarganya suka bepergian dan melakukan perjalanan jauh.

Farooq Sabir adalah Arsitek Solusi Spesialis Kecerdasan Buatan dan Pembelajaran Mesin Senior di AWS. Dia memegang gelar PhD dan MS di bidang Teknik Listrik dari University of Texas di Austin dan MS di bidang Ilmu Komputer dari Georgia Institute of Technology. Dia memiliki lebih dari 15 tahun pengalaman kerja dan juga suka mengajar dan membimbing mahasiswa. Di AWS, dia membantu pelanggan merumuskan dan memecahkan masalah bisnis mereka dalam ilmu data, pembelajaran mesin, visi komputer, kecerdasan buatan, pengoptimalan numerik, dan domain terkait. Berbasis di Dallas, Texas, dia dan keluarganya suka bepergian dan melakukan perjalanan jauh.

Manoj Ravi adalah Manajer Produk Senior untuk Amazon SageMaker. Dia bersemangat membangun produk AI generasi berikutnya dan bekerja pada perangkat lunak dan alat untuk mempermudah pembelajaran mesin skala besar bagi pelanggan. Dia memegang gelar MBA dari Haas School of Business dan Magister Manajemen Sistem Informasi dari Universitas Carnegie Mellon. Di waktu senggangnya, Manoj senang bermain tenis dan menekuni fotografi lanskap.

Manoj Ravi adalah Manajer Produk Senior untuk Amazon SageMaker. Dia bersemangat membangun produk AI generasi berikutnya dan bekerja pada perangkat lunak dan alat untuk mempermudah pembelajaran mesin skala besar bagi pelanggan. Dia memegang gelar MBA dari Haas School of Business dan Magister Manajemen Sistem Informasi dari Universitas Carnegie Mellon. Di waktu senggangnya, Manoj senang bermain tenis dan menekuni fotografi lanskap.

Shikhar Kwatra adalah Arsitek Solusi Spesialis AI/ML di Amazon Web Services, bekerja dengan Integrator Sistem Global terkemuka. Dia telah mendapatkan gelar sebagai salah satu Penemu Master India Termuda dengan lebih dari 500 paten di domain AI/ML dan IoT. Shikhar membantu dalam merancang, membangun, dan memelihara lingkungan cloud yang dapat diskalakan dan hemat biaya untuk organisasi, dan mendukung mitra GSI dalam membangun solusi industri strategis di AWS. Shikhar senang bermain gitar, menggubah musik, dan melatih mindfulness di waktu luangnya.

Shikhar Kwatra adalah Arsitek Solusi Spesialis AI/ML di Amazon Web Services, bekerja dengan Integrator Sistem Global terkemuka. Dia telah mendapatkan gelar sebagai salah satu Penemu Master India Termuda dengan lebih dari 500 paten di domain AI/ML dan IoT. Shikhar membantu dalam merancang, membangun, dan memelihara lingkungan cloud yang dapat diskalakan dan hemat biaya untuk organisasi, dan mendukung mitra GSI dalam membangun solusi industri strategis di AWS. Shikhar senang bermain gitar, menggubah musik, dan melatih mindfulness di waktu luangnya.

Vikram Elango adalah Sr. AI/ML Specialist Solutions Architect di AWS, berbasis di Virginia, AS. Dia saat ini berfokus pada AI generatif, LLM, rekayasa cepat, pengoptimalan inferensi model besar, dan penskalaan ML di seluruh perusahaan. Vikram membantu pelanggan industri keuangan dan asuransi dengan desain dan pemikiran kepemimpinan untuk membangun dan menerapkan aplikasi pembelajaran mesin dalam skala besar. Di waktu luangnya, dia suka bepergian, hiking, memasak, dan berkemah.

Vikram Elango adalah Sr. AI/ML Specialist Solutions Architect di AWS, berbasis di Virginia, AS. Dia saat ini berfokus pada AI generatif, LLM, rekayasa cepat, pengoptimalan inferensi model besar, dan penskalaan ML di seluruh perusahaan. Vikram membantu pelanggan industri keuangan dan asuransi dengan desain dan pemikiran kepemimpinan untuk membangun dan menerapkan aplikasi pembelajaran mesin dalam skala besar. Di waktu luangnya, dia suka bepergian, hiking, memasak, dan berkemah.

- Konten Bertenaga SEO & Distribusi PR. Dapatkan Amplifikasi Hari Ini.

- PlatoAiStream. Kecerdasan Data Web3. Pengetahuan Diperkuat. Akses Di Sini.

- Mencetak Masa Depan bersama Adryenn Ashley. Akses Di Sini.

- Sumber: https://aws.amazon.com/blogs/machine-learning/run-your-local-machine-learning-code-as-amazon-sagemaker-training-jobs-with-minimal-code-changes/

- :memiliki

- :adalah

- :bukan

- $NAIK

- 1

- 10

- 100

- 15 tahun

- 500

- 7

- a

- kemampuan

- Sanggup

- Tentang Kami

- mengakses

- Akun

- ketepatan

- dicapai

- di seluruh

- aktif

- tindakan

- menambahkan

- menambahkan

- tambahan

- admin

- administrator

- mengambil

- maju

- Keuntungan

- AI

- AI / ML

- bantu

- Semua

- memungkinkan

- sepanjang

- juga

- Amazon

- Amazon SageMaker

- Amazon Web Services

- an

- menganalisa

- dan

- mengumumkan

- Apa pun

- aplikasi

- ADALAH

- daerah

- argumen

- buatan

- kecerdasan buatan

- Kecerdasan Buatan dan Pembelajaran Mesin

- AS

- terkait

- At

- austin

- secara otomatis

- tersedia

- AWS

- kembali

- mendasarkan

- berdasarkan

- BE

- Manfaat

- Anggaran

- membangun

- Bangunan

- bisnis

- by

- CAN

- kemampuan

- menangkap

- Carnegie Mellon

- membawa

- kasus

- Sel

- perubahan

- Perubahan

- saluran

- pilihan

- kelas

- klasifikasi

- Klasifikasi

- awan

- kode

- basis kode

- Perguruan tinggi

- datang

- Umum

- cocok

- lengkap

- menghitung

- komputer

- Komputer Ilmu

- Keamanan komputer

- Visi Komputer

- konsep

- konfigurasi

- konsul

- mengandung

- Wadah

- mengandung

- Konteks

- terus

- Core

- Biaya

- bisa

- menutupi

- membuat

- Sekarang

- pelanggan

- menyesuaikan

- Dallas

- dasbor

- data

- pengolahan data

- ilmu data

- kumpulan data

- menyatakan

- Default

- default

- didefinisikan

- mendemonstrasikan

- menunjukkan

- Ketergantungan

- menyebarkan

- dijelaskan

- Mendesain

- rincian

- dikembangkan

- Pengembang

- Pengembangan

- berbeda

- dibahas

- didistribusikan

- sistem terdistribusi

- pelatihan terdistribusi

- domain

- dilakukan

- Dont

- selama

- e

- setiap

- memperoleh

- kemudahan penggunaan

- mudah

- mudah

- antara

- tertanam

- memungkinkan

- enkripsi

- ujung ke ujung

- insinyur

- Teknik

- Insinyur

- perusahaan

- masuk

- Lingkungan Hidup

- lingkungan

- masa

- zaman

- evaluasi

- Setiap

- contoh

- contoh

- eksekusi

- ada

- pengalaman

- eksperimen

- Menghadapi

- akrab

- keluarga

- FAST

- lebih cepat

- Fitur

- Fitur

- beberapa

- File

- File

- keuangan

- Pertama

- keluwesan

- Fokus

- terfokus

- berikut

- Untuk

- Kerangka

- dari

- sepenuhnya

- fungsi

- fungsi

- Selanjutnya

- masa depan

- Futures

- generatif

- AI generatif

- Georgia

- diberikan

- Aksi

- Go

- GPU

- Grup

- Memiliki

- he

- membantu

- membantu

- -nya

- memegang

- Seterpercayaapakah Olymp Trade? Kesimpulan

- How To

- HTML

- http

- HTTPS

- MemelukWajah

- identitas

- if

- gambar

- implementasi

- mengimpor

- impor

- in

- memasukkan

- Termasuk

- India

- industri

- informasi

- Sistem Informasi

- Infrastruktur

- berinovasi

- memasukkan

- diinstal

- contoh

- Lembaga

- instruksi

- asuransi

- terpadu

- Terintegrasi

- Intelijen

- bunga

- ke

- memperkenalkan

- diperkenalkan

- Penemu

- idiot

- IT

- iterasi

- NYA

- Pekerjaan

- Jobs

- jpg

- hanya

- kunci

- laboratorium

- pemandangan

- laptop

- besar

- besar-besaran

- Terbaru

- jalankan

- diluncurkan

- peluncuran

- Kepemimpinan

- terkemuka

- BELAJAR

- pengetahuan

- membiarkan

- Lets

- perpustakaan

- Perpustakaan

- siklus hidup

- 'like'

- 'like

- baris

- lokal

- lokal

- terletak

- mencatat

- login

- Panjang

- TERLIHAT

- lepas

- cinta

- mesin

- Mesin belajar

- terbuat

- mempertahankan

- membuat

- MEMBUAT

- berhasil

- pengelolaan

- manajer

- menguasai

- Mungkin..

- Mellon

- Metodologi

- Metrik

- Mindfulness

- minimal

- menit

- ML

- MLOps

- mode

- model

- model

- Modul

- lebih

- paling

- pindah

- MS

- beberapa

- musik

- nama

- yaitu

- menavigasi

- Perlu

- dibutuhkan

- jaringan

- jaringan

- New

- berikutnya

- node

- buku catatan

- sekarang

- mati rasa

- objek

- of

- on

- Di atas kapal

- sekali

- ONE

- hanya

- Buka

- open source

- optimasi

- or

- urutan

- organisasi

- OS

- Lainnya

- kami

- di luar

- keluaran

- lebih

- mengesampingkan

- paket

- paket

- panda

- Paralel

- parameter

- tertentu

- pasangan

- lulus

- melewati

- Lewat

- bergairah

- Paten

- path

- prestasi

- fotografi

- Platform

- plato

- Kecerdasan Data Plato

- Data Plato

- bermain

- Titik

- Pos

- disukai

- prasyarat

- sebelumnya

- Masalah

- masalah

- pengolahan

- Produk

- manajer produk

- produktif

- Produk

- disediakan

- Ular sanca

- pytorch

- siap

- baru

- baru-baru ini

- sarankan

- terkait

- melepaskan

- terpencil

- menggantikan

- gudang

- wajib

- Persyaratan

- ISTIRAHAT

- kembali

- jalan

- Peran

- peran

- Run

- berjalan

- pembuat bijak

- terukur

- Skala

- skala

- Sekolah

- Ilmu

- ilmuwan

- scikit-belajar

- SDK

- mulus

- Bagian

- bagian

- keamanan

- melihat

- senior

- terpisah

- Layanan

- Sidang

- set

- pengaturan

- pengaturan

- penyiapan

- beberapa

- harus

- Menunjukkan

- menampilkan

- ditunjukkan

- Pertunjukkan

- signifikan

- mirip

- Sederhana

- hanya

- tunggal

- Ukuran

- kecil

- Potret

- So

- Perangkat lunak

- pengembangan perangkat lunak

- Solusi

- MEMECAHKAN

- spesialis

- tertentu

- spesifikasi

- ditentukan

- awal

- Mulai

- Status

- Langkah

- penyimpanan

- Strategis

- Siswa

- studio

- menyerahkan

- subnet

- seperti itu

- Didukung

- Mendukung

- sistem

- sistem

- Mengambil

- Dibutuhkan

- pengambilan

- tugas

- tim

- Teknologi

- tensorflow

- texas

- Klasifikasi Teks

- bahwa

- Grafik

- mereka

- Mereka

- kemudian

- Sana.

- dengan demikian

- karena itu

- Ini

- mereka

- ini

- pikir

- pemikiran kepemimpinan

- Melalui

- waktu

- Judul

- untuk

- alat

- obor

- terhadap

- Pelatihan VE

- terlatih

- Pelatihan

- transformer

- perjalanan

- Perjalanan

- dipicu

- mengetik

- khas

- bawah

- memahami

- universitas

- Memperbarui

- us

- menggunakan

- gunakan case

- bekas

- Pengguna

- menggunakan

- nilai

- Nilai - Nilai

- versi

- melalui

- View

- virginia

- penglihatan

- vs

- vs kode

- menunggu

- ingin

- we

- jaringan

- layanan web

- ketika

- yang

- sementara

- akan

- dengan

- dalam

- Kerja

- kerja

- bekerja

- akan

- membungkus

- dibungkus

- menulis

- tulis kode

- tertulis

- X

- tahun

- Kamu

- Termuda

- Anda

- zephyrnet.dll