Dalam postingan ini, kami mendemonstrasikan cara menggunakan pemangkasan struktural berbasis neural architecture search (NAS) untuk mengompresi model BERT yang telah disesuaikan guna meningkatkan kinerja model dan mengurangi waktu inferensi. Model bahasa terlatih (PLM) sedang menjalani adopsi komersial dan perusahaan dengan cepat di bidang alat produktivitas, layanan pelanggan, pencarian dan rekomendasi, otomatisasi proses bisnis, dan pembuatan konten. Penerapan titik akhir inferensi PLM biasanya dikaitkan dengan latensi yang lebih tinggi dan biaya infrastruktur yang lebih tinggi karena persyaratan komputasi dan berkurangnya efisiensi komputasi karena banyaknya parameter. Pemangkasan PLM mengurangi ukuran dan kompleksitas model sekaligus mempertahankan kemampuan prediktifnya. PLM yang dipangkas menghasilkan jejak memori yang lebih kecil dan latensi yang lebih rendah. Kami mendemonstrasikannya dengan memangkas PLM dan menukar jumlah parameter dan kesalahan validasi untuk tugas target tertentu, dan mampu mencapai waktu respons yang lebih cepat jika dibandingkan dengan model PLM dasar.

Pengoptimalan multi-tujuan adalah area pengambilan keputusan yang mengoptimalkan lebih dari satu fungsi tujuan, seperti konsumsi memori, waktu pelatihan, dan sumber daya komputasi, untuk dioptimalkan secara bersamaan. Pemangkasan struktural adalah teknik untuk mengurangi ukuran dan persyaratan komputasi PLM dengan memangkas lapisan atau neuron/node sambil mencoba menjaga akurasi model. Dengan menghilangkan lapisan, pemangkasan struktural mencapai tingkat kompresi yang lebih tinggi, yang menghasilkan ketersebaran terstruktur yang ramah perangkat keras sehingga mengurangi waktu proses dan waktu respons. Penerapan teknik pemangkasan struktural pada model PLM menghasilkan model berbobot lebih ringan dengan jejak memori lebih rendah yang, ketika dihosting sebagai titik akhir inferensi di SageMaker, menawarkan peningkatan efisiensi sumber daya dan pengurangan biaya bila dibandingkan dengan PLM asli yang telah disempurnakan.

Konsep yang diilustrasikan dalam postingan ini dapat diterapkan pada aplikasi yang menggunakan fitur PLM, seperti sistem rekomendasi, analisis sentimen, dan mesin pencari. Secara khusus, Anda dapat menggunakan pendekatan ini jika Anda memiliki tim pembelajaran mesin (ML) dan ilmu data khusus yang menyempurnakan model PLM mereka sendiri menggunakan kumpulan data khusus domain dan menerapkan sejumlah besar titik akhir inferensi menggunakan Amazon SageMaker. Salah satu contohnya adalah pengecer online yang menyebarkan sejumlah besar titik akhir inferensi untuk peringkasan teks, klasifikasi katalog produk, dan klasifikasi sentimen umpan balik produk. Contoh lainnya adalah penyedia layanan kesehatan yang menggunakan titik akhir inferensi PLM untuk klasifikasi dokumen klinis, pengenalan entitas bernama dari laporan medis, chatbot medis, dan stratifikasi risiko pasien.

Ikhtisar solusi

Di bagian ini, kami menyajikan keseluruhan alur kerja dan menjelaskan pendekatannya. Pertama, kita menggunakan Studio Amazon SageMaker buku catatan untuk menyempurnakan model BERT terlatih pada tugas target menggunakan kumpulan data khusus domain. BERTI (Representasi Encoder Dua Arah dari Transformers) adalah model bahasa terlatih berdasarkan arsitektur transformator digunakan untuk tugas pemrosesan bahasa alami (NLP). Pencarian arsitektur saraf (NAS) adalah pendekatan untuk mengotomatisasi desain jaringan saraf tiruan dan terkait erat dengan pengoptimalan hyperparameter, pendekatan yang banyak digunakan di bidang pembelajaran mesin. Tujuan NAS adalah menemukan arsitektur optimal untuk masalah tertentu dengan mencari sejumlah besar kandidat arsitektur menggunakan teknik seperti pengoptimalan bebas gradien atau dengan mengoptimalkan metrik yang diinginkan. Performa arsitektur biasanya diukur menggunakan metrik seperti kehilangan validasi. Penyetelan Model Otomatis SageMaker (AMT) mengotomatiskan proses yang membosankan dan kompleks dalam menemukan kombinasi optimal hyperparameter model ML yang menghasilkan performa model terbaik. AMT menggunakan algoritme penelusuran cerdas dan evaluasi berulang menggunakan rentang hyperparameter yang Anda tentukan. Ini memilih nilai hyperparameter yang menghasilkan model dengan performa terbaik, yang diukur dengan metrik performa seperti akurasi dan skor F-1.

Pendekatan penyesuaian yang dijelaskan dalam postingan ini bersifat umum dan dapat diterapkan pada kumpulan data berbasis teks apa pun. Tugas yang diberikan ke BERT PLM dapat berupa tugas berbasis teks seperti analisis sentimen, klasifikasi teks, atau tanya jawab. Dalam demo ini, target tugas adalah masalah klasifikasi biner dimana BERT digunakan untuk mengidentifikasi, dari suatu dataset yang terdiri dari kumpulan pasangan fragmen teks, apakah makna suatu fragmen teks dapat disimpulkan dari fragmen lainnya. Kami menggunakan Mengenali kumpulan data Textual Entailment dari rangkaian pembandingan GLUE. Kami melakukan pencarian multi-tujuan menggunakan SageMaker AMT untuk mengidentifikasi sub-jaringan yang menawarkan trade-off optimal antara jumlah parameter dan akurasi prediksi untuk tugas target. Saat melakukan pencarian multi-tujuan, kami mulai dengan menentukan akurasi dan jumlah parameter sebagai tujuan yang ingin kami optimalkan.

Dalam jaringan BERT PLM, terdapat sub-jaringan modular dan mandiri yang memungkinkan model memiliki kemampuan khusus seperti pemahaman bahasa dan representasi pengetahuan. BERT PLM menggunakan sub-jaringan perhatian mandiri multi-kepala dan sub-jaringan feed-forward. Lapisan perhatian mandiri dengan banyak kepala memungkinkan BERT untuk menghubungkan posisi berbeda dari satu urutan untuk menghitung representasi urutan dengan memungkinkan banyak kepala untuk memperhatikan beberapa sinyal konteks. Masukan dibagi menjadi beberapa subruang dan perhatian mandiri diterapkan ke masing-masing subruang secara terpisah. Beberapa kepala dalam PLM transformator memungkinkan model untuk bersama-sama menangani informasi dari subruang representasi yang berbeda. Sub-jaringan feed-forward adalah jaringan neural sederhana yang mengambil output dari sub-jaringan perhatian mandiri multi-head, memproses data, dan mengembalikan representasi encoder akhir.

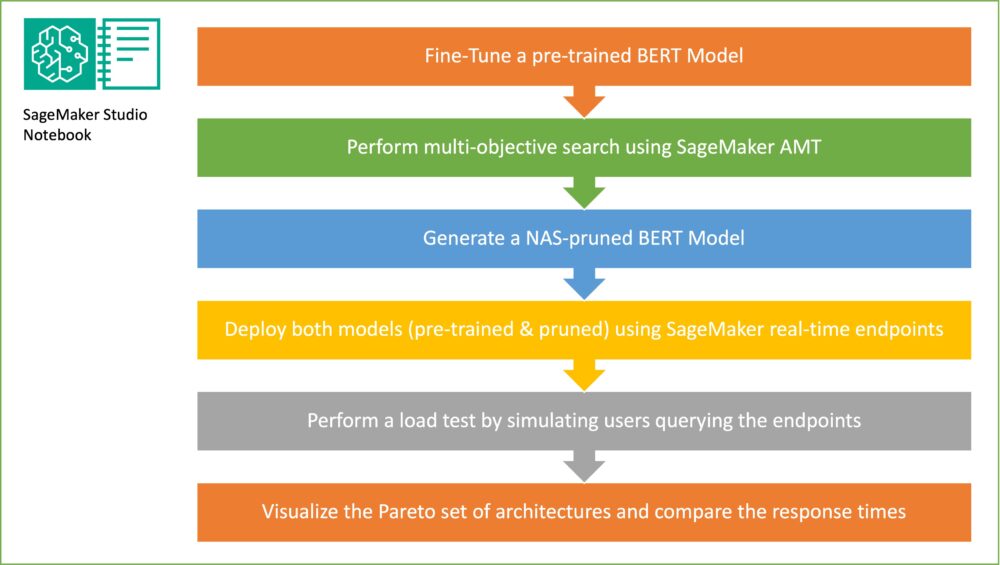

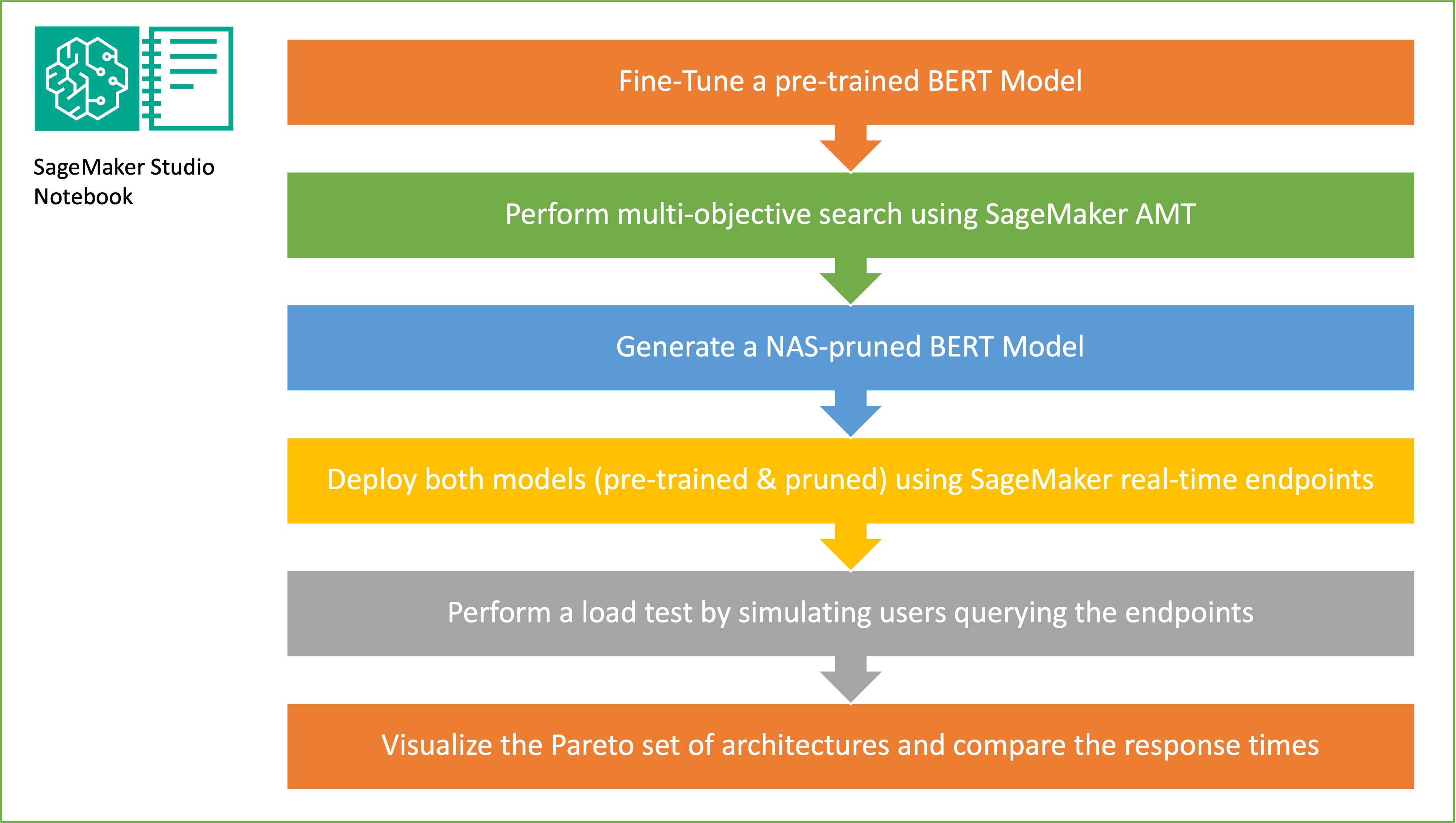

Tujuan dari pengambilan sampel sub-jaringan acak adalah untuk melatih model BERT yang lebih kecil yang dapat melakukan tugas target dengan cukup baik. Kami mengambil sampel 100 sub-jaringan acak dari model BERT dasar yang telah disempurnakan dan mengevaluasi 10 jaringan secara bersamaan. Sub-jaringan yang dilatih dievaluasi untuk metrik objektif dan model akhir dipilih berdasarkan trade-off yang ditemukan antara metrik objektif. Kami memvisualisasikan Pareto depan untuk sub-jaringan sampel, yang berisi model yang dipangkas yang menawarkan trade-off optimal antara akurasi model dan ukuran model. Kami memilih kandidat sub-jaringan (model BERT yang dipangkas NAS) berdasarkan ukuran model dan akurasi model yang ingin kami tukarkan. Selanjutnya, kami menghosting titik akhir, model dasar BERT yang telah dilatih sebelumnya, dan model BERT yang dipangkas NAS menggunakan SageMaker. Untuk melakukan pengujian beban, kami menggunakan Belalang, alat pengujian beban sumber terbuka yang dapat Anda implementasikan menggunakan Python. Kami menjalankan pengujian beban pada kedua titik akhir menggunakan Locust dan memvisualisasikan hasilnya menggunakan bagian depan Pareto untuk mengilustrasikan trade-off antara waktu respons dan akurasi untuk kedua model. Diagram berikut memberikan gambaran umum alur kerja yang dijelaskan dalam postingan ini.

Prasyarat

Untuk posting ini, prasyarat berikut diperlukan:

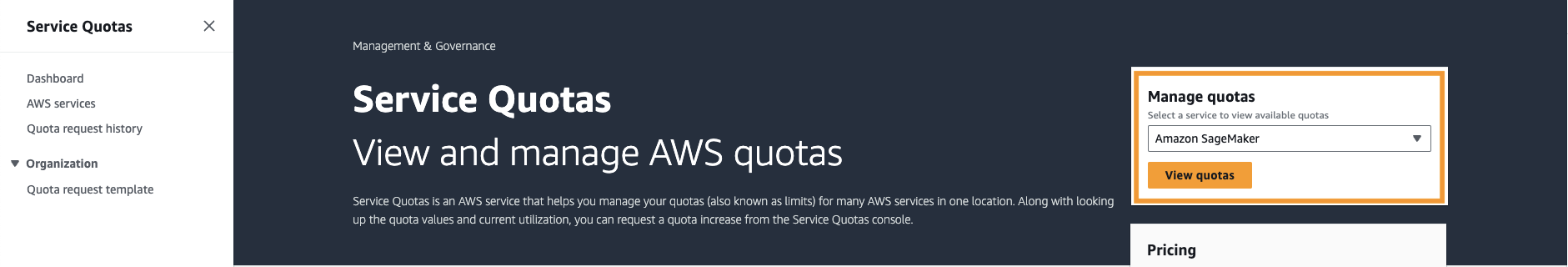

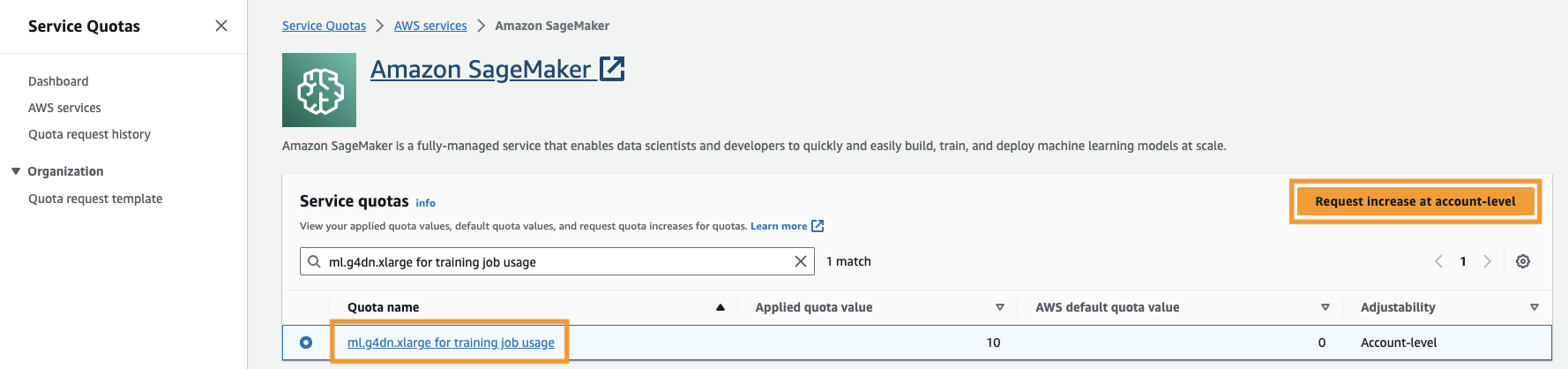

Anda juga perlu meningkatkannya kuota layanan untuk mengakses setidaknya tiga contoh ml.g4dn.xlarge di SageMaker. Jenis instans ml.g4dn.xlarge adalah instans GPU hemat biaya yang memungkinkan Anda menjalankan PyTorch secara asli. Untuk menambah kuota layanan, selesaikan langkah-langkah berikut:

- Di konsol, navigasikan ke Service Quotas.

- Untuk Kelola kuota, pilih Amazon SageMaker, Lalu pilih Lihat kuota.

- Cari “ml-g4dn.xlarge untuk penggunaan tugas pelatihan” dan pilih item kuota.

- Pilih Permintaan peningkatan di tingkat akun.

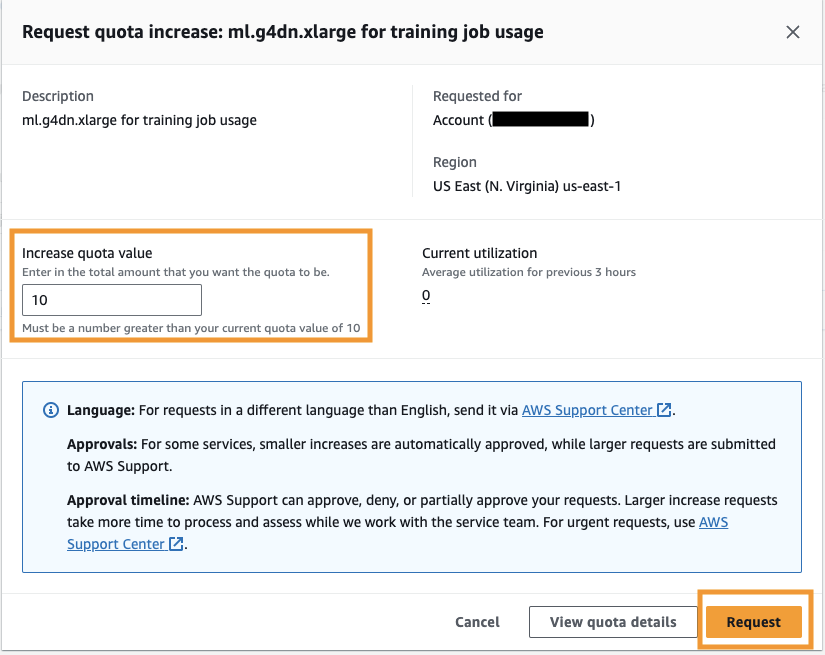

- Untuk Tingkatkan nilai kuota, masukkan nilai 5 atau lebih tinggi.

- Pilih Meminta.

Persetujuan kuota yang diminta mungkin memerlukan waktu untuk diselesaikan tergantung pada izin akun.

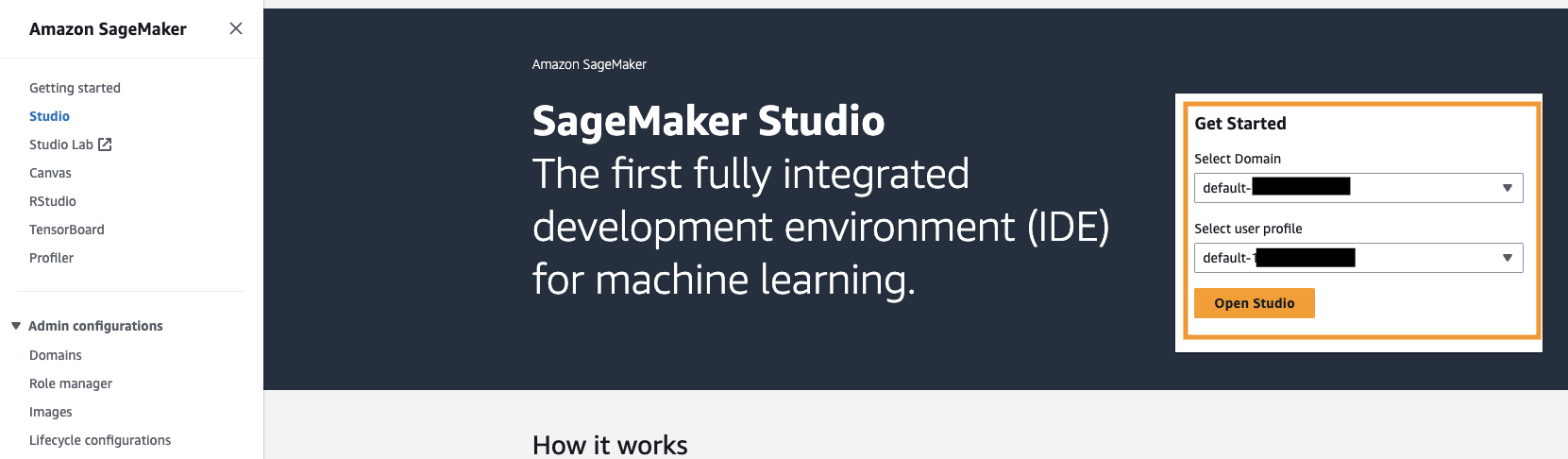

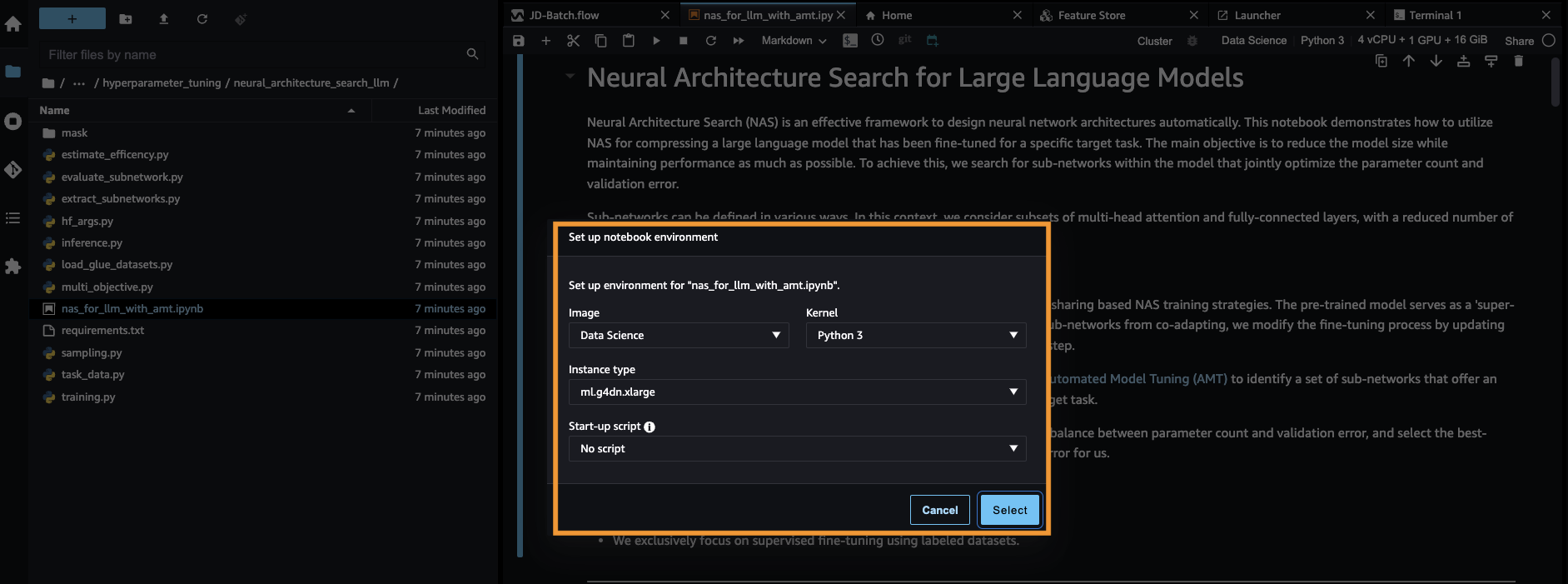

- Buka SageMaker Studio dari konsol SageMaker.

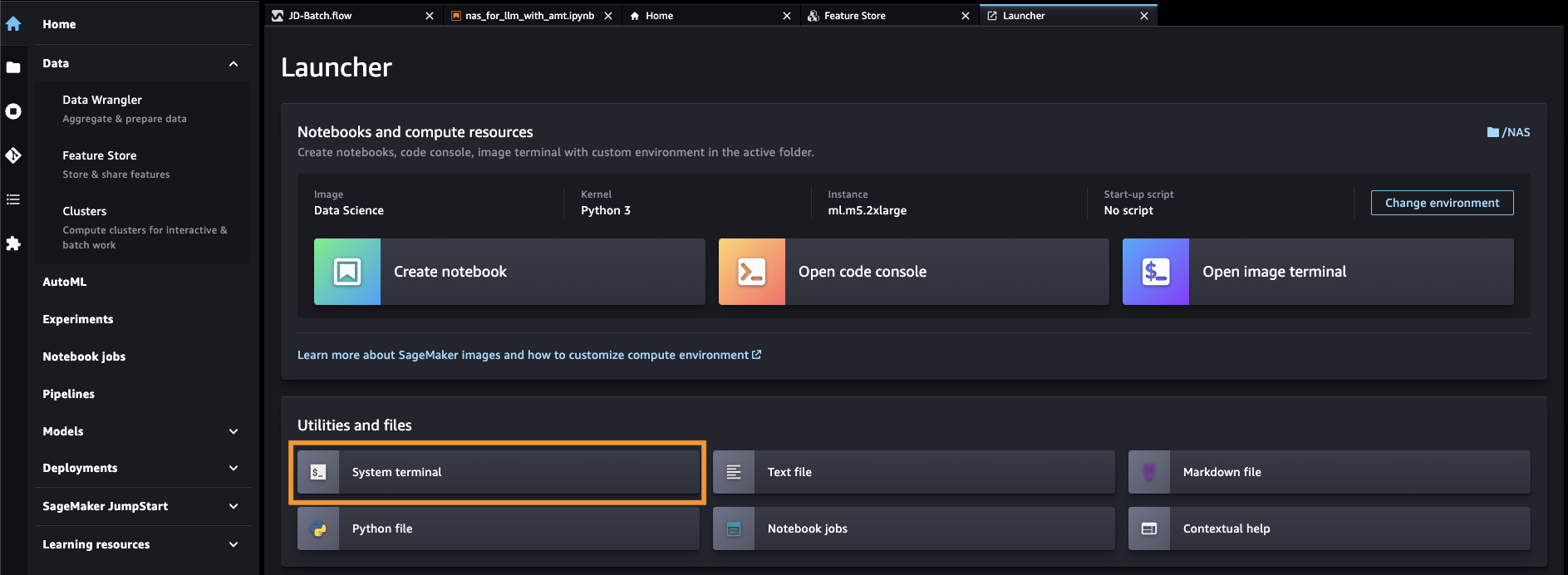

- Pilih Terminal sistem bawah Utilitas dan file.

- Jalankan perintah berikut untuk mengkloning GitHub repo ke instance SageMaker Studio:

- Navigasi ke

amazon-sagemaker-examples/hyperparameter_tuning/neural_architecture_search_llm. - Buka file

nas_for_llm_with_amt.ipynb. - Siapkan lingkungan dengan

ml.g4dn.xlargecontoh dan pilih Pilih.

Siapkan model BERT terlatih

Di bagian ini, kami mengimpor kumpulan data Recognizing Textual Entailment dari pustaka kumpulan data dan membagi kumpulan data menjadi kumpulan pelatihan dan validasi. Dataset ini terdiri dari pasangan kalimat. Tugas BERT PLM adalah mengenali, dengan adanya dua fragmen teks, apakah makna dari satu fragmen teks dapat disimpulkan dari fragmen lainnya. Pada contoh berikut, kita dapat menyimpulkan arti frasa pertama dari frasa kedua:

Kami memuat kumpulan data keterlibatan pengenalan tekstual dari LEM rangkaian pembandingan melalui perpustakaan kumpulan data dari Hugging Face dalam skrip pelatihan kami (./training.py). Kami membagi kumpulan data pelatihan asli dari GLUE menjadi kumpulan pelatihan dan validasi. Dalam pendekatan kami, kami menyempurnakan model BERT dasar menggunakan kumpulan data pelatihan, lalu kami melakukan penelusuran multi-tujuan untuk mengidentifikasi kumpulan sub-jaringan yang secara optimal menyeimbangkan antara metrik tujuan. Kami menggunakan kumpulan data pelatihan secara eksklusif untuk menyempurnakan model BERT. Namun, kami menggunakan data validasi untuk pencarian multi-tujuan dengan mengukur akurasi pada kumpulan data validasi ketidaksepakatan.

Sempurnakan BERT PLM menggunakan kumpulan data khusus domain

Kasus penggunaan umum untuk model BERT mentah mencakup prediksi kalimat berikutnya atau pemodelan bahasa bertopeng. Untuk menggunakan model BERT dasar untuk tugas-tugas hilir seperti persyaratan pengenalan teks, kita harus menyempurnakan model lebih lanjut menggunakan kumpulan data khusus domain. Anda dapat menggunakan model BERT yang disempurnakan untuk tugas-tugas seperti klasifikasi urutan, menjawab pertanyaan, dan klasifikasi token. Namun, untuk tujuan demo ini, kami menggunakan model klasifikasi biner yang telah disesuaikan. Kami menyempurnakan model BERT yang telah dilatih sebelumnya dengan kumpulan data pelatihan yang kami siapkan sebelumnya, menggunakan hyperparameter berikut:

Kami menyimpan pos pemeriksaan pelatihan model ke an Layanan Penyimpanan Sederhana Amazon (Amazon S3), sehingga model dapat dimuat selama pencarian multi-tujuan berbasis NAS. Sebelum melatih model, kami menentukan metrik seperti epoch, training loss, jumlah parameter, dan error validasi:

Setelah proses penyesuaian dimulai, tugas pelatihan memerlukan waktu sekitar 15 menit untuk diselesaikan.

Lakukan pencarian multi-tujuan untuk memilih sub-jaringan dan memvisualisasikan hasilnya

Pada langkah berikutnya, kami melakukan pencarian multi-objektif pada model BERT dasar yang telah disempurnakan dengan mengambil sampel sub-jaringan acak menggunakan SageMaker AMT. Untuk mengakses sub-jaringan dalam jaringan super (model BERT yang disempurnakan), kami menutupi semua komponen PLM yang bukan bagian dari sub-jaringan. Menutupi jaringan super untuk menemukan sub-jaringan dalam PLM adalah teknik yang digunakan untuk mengisolasi dan mengidentifikasi pola perilaku model. Perhatikan bahwa transformator Hugging Face memerlukan ukuran tersembunyi yang merupakan kelipatan dari jumlah kepala. Ukuran tersembunyi dalam PLM transformator mengontrol ukuran ruang vektor keadaan tersembunyi, yang berdampak pada kemampuan model untuk mempelajari representasi dan pola kompleks dalam data. Dalam BERT PLM, vektor keadaan tersembunyi berukuran tetap (768). Kita tidak bisa mengubah ukuran yang tersembunyi, oleh karena itu jumlah kepala harus di [1, 3, 6, 12].

Berbeda dengan optimasi tujuan tunggal, dalam pengaturan multi-tujuan, kita biasanya tidak memiliki solusi tunggal yang mengoptimalkan semua tujuan secara bersamaan. Sebaliknya, kami bertujuan untuk mengumpulkan serangkaian solusi yang mendominasi semua solusi lainnya setidaknya dalam satu tujuan (seperti kesalahan validasi). Sekarang kita dapat memulai pencarian multi-tujuan melalui AMT dengan mengatur metrik yang ingin kita kurangi (kesalahan validasi dan jumlah parameter). Sub-jaringan acak ditentukan oleh parameter max_jobs dan jumlah pekerjaan simultan ditentukan oleh parameter max_parallel_jobs. Kode untuk memuat pos pemeriksaan model dan mengevaluasi sub-jaringan tersedia di evaluate_subnetwork.py Script.

Pekerjaan penyetelan AMT memerlukan waktu sekitar 2 jam 20 menit untuk dijalankan. Setelah tugas penyetelan AMT berhasil dijalankan, kami menguraikan riwayat tugas dan mengumpulkan konfigurasi sub-jaringan, seperti jumlah kepala, jumlah lapisan, jumlah unit, dan metrik terkait seperti kesalahan validasi dan jumlah parameter. Tangkapan layar berikut menunjukkan ringkasan pekerjaan tuner AMT yang berhasil.

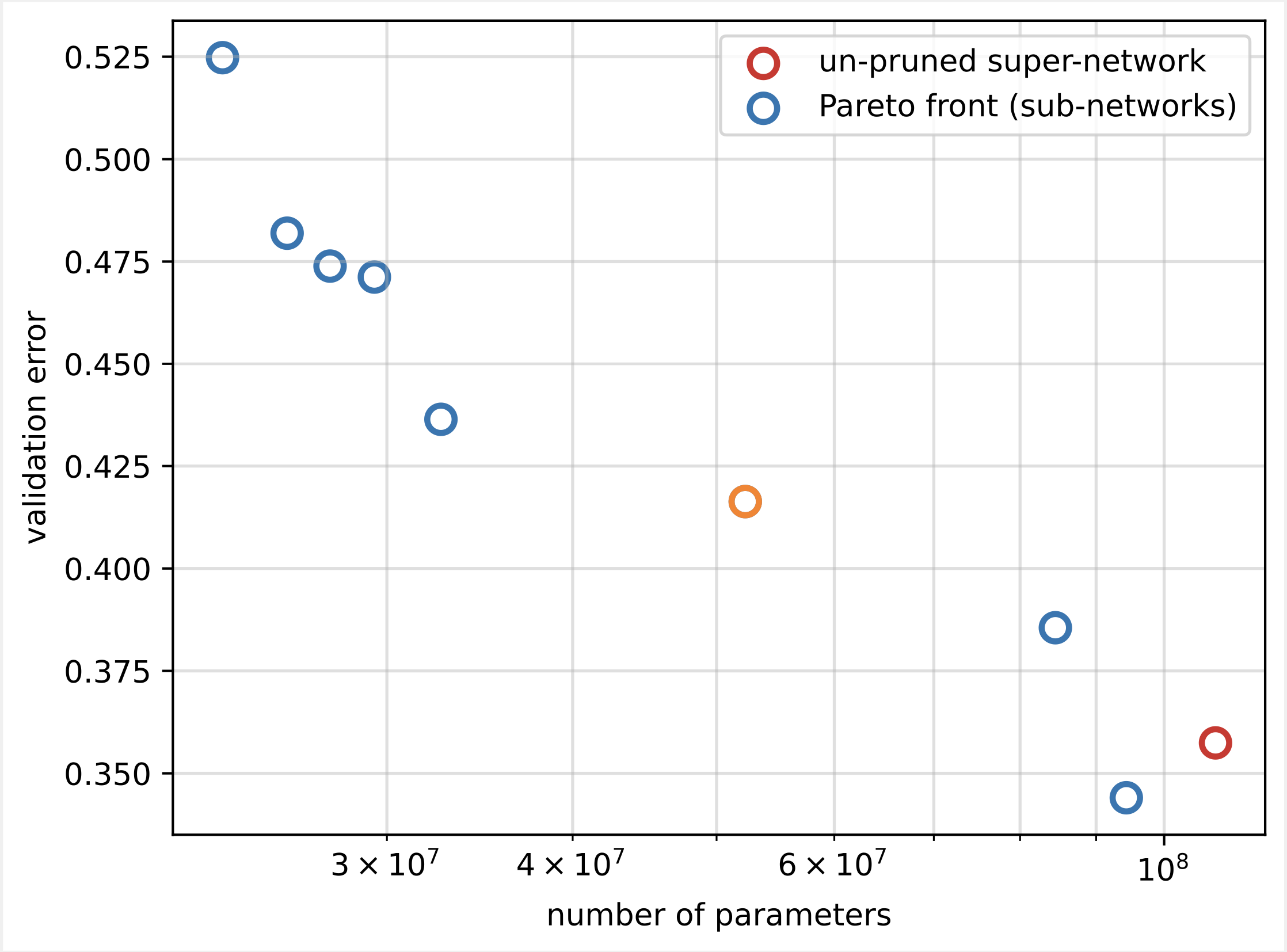

Selanjutnya, kami memvisualisasikan hasilnya menggunakan himpunan Pareto (juga dikenal sebagai Pareto frontier atau Pareto optimal set), yang membantu kami mengidentifikasi himpunan sub-jaringan optimal yang mendominasi semua sub-jaringan lain dalam metrik tujuan (kesalahan validasi):

Pertama, kami mengumpulkan data dari tugas penyetelan AMT. Kemudian kita memplot set Pareto menggunakan matplotlob.pyplot dengan jumlah parameter pada sumbu x dan kesalahan validasi pada sumbu y. Hal ini menyiratkan bahwa ketika kita berpindah dari satu sub-jaringan dari kumpulan Pareto ke sub-jaringan lainnya, kita harus mengorbankan kinerja atau ukuran model tetapi meningkatkan yang lain. Pada akhirnya, rangkaian Pareto memberi kita fleksibilitas untuk memilih sub-jaringan yang paling sesuai dengan preferensi kita. Kita dapat memutuskan seberapa besar kita ingin mengurangi ukuran jaringan kita dan seberapa besar kinerja yang ingin kita korbankan.

Terapkan model BERT yang telah disempurnakan dan model sub-jaringan yang dioptimalkan untuk NAS menggunakan SageMaker

Selanjutnya, kami menerapkan model terbesar dalam kumpulan Pareto kami yang menghasilkan penurunan kinerja paling kecil menjadi a Titik akhir SageMaker. Model terbaik adalah model yang memberikan trade-off optimal antara kesalahan validasi dan jumlah parameter untuk kasus penggunaan kita.

Perbandingan model

Kami mengambil model BERT dasar yang telah dilatih sebelumnya, menyempurnakannya menggunakan kumpulan data khusus domain, menjalankan penelusuran NAS untuk mengidentifikasi sub-jaringan dominan berdasarkan metrik objektif, dan menerapkan model yang telah dipangkas pada titik akhir SageMaker. Selain itu, kami mengambil model BERT dasar yang telah dilatih sebelumnya dan menerapkan model dasar pada titik akhir SageMaker kedua. Selanjutnya, kami berlari pengujian beban menggunakan Locust pada kedua titik akhir inferensi dan mengevaluasi kinerja dalam hal waktu respons.

Pertama, kami mengimpor perpustakaan Locust dan Boto3 yang diperlukan. Kemudian kami membuat metadata permintaan dan mencatat waktu mulai yang akan digunakan untuk pengujian beban. Kemudian payload diteruskan ke API pemanggilan titik akhir SageMaker melalui BotoClient untuk mensimulasikan permintaan pengguna sebenarnya. Kami menggunakan Locust untuk menelurkan beberapa pengguna virtual untuk mengirim permintaan secara paralel dan mengukur kinerja titik akhir di bawah beban. Pengujian dijalankan dengan meningkatkan jumlah pengguna untuk masing-masing dua titik akhir. Setelah pengujian selesai, Locust mengeluarkan file CSV statistik permintaan untuk setiap model yang diterapkan.

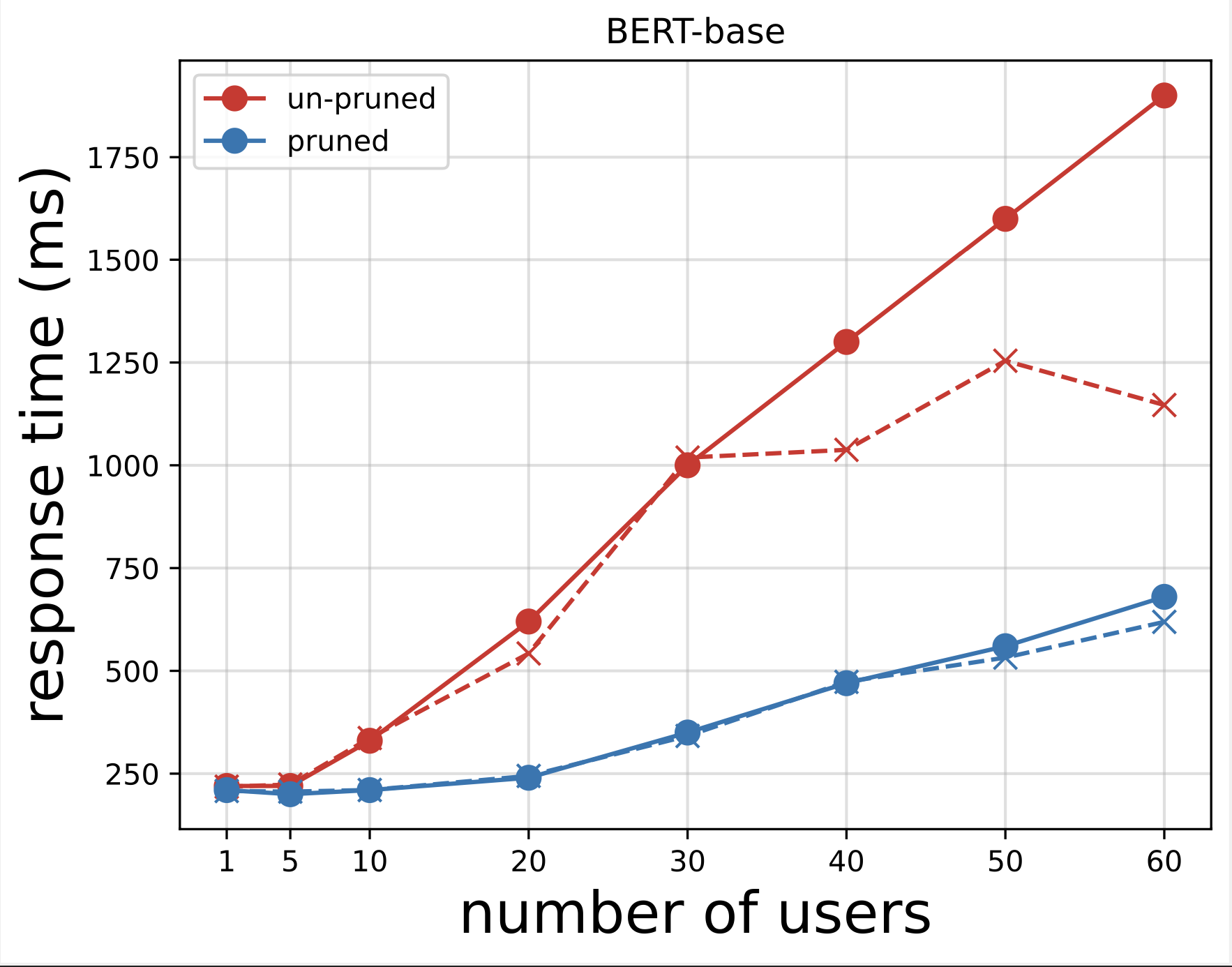

Selanjutnya, kami membuat plot waktu respons dari file CSV yang diunduh setelah menjalankan pengujian dengan Locust. Tujuan memplot waktu respons vs. jumlah pengguna adalah untuk menganalisis hasil pengujian beban dengan memvisualisasikan dampak waktu respons titik akhir model. Pada bagan berikut, kita dapat melihat bahwa titik akhir model yang dipangkas NAS mencapai waktu respons yang lebih rendah dibandingkan dengan titik akhir model BERT dasar.

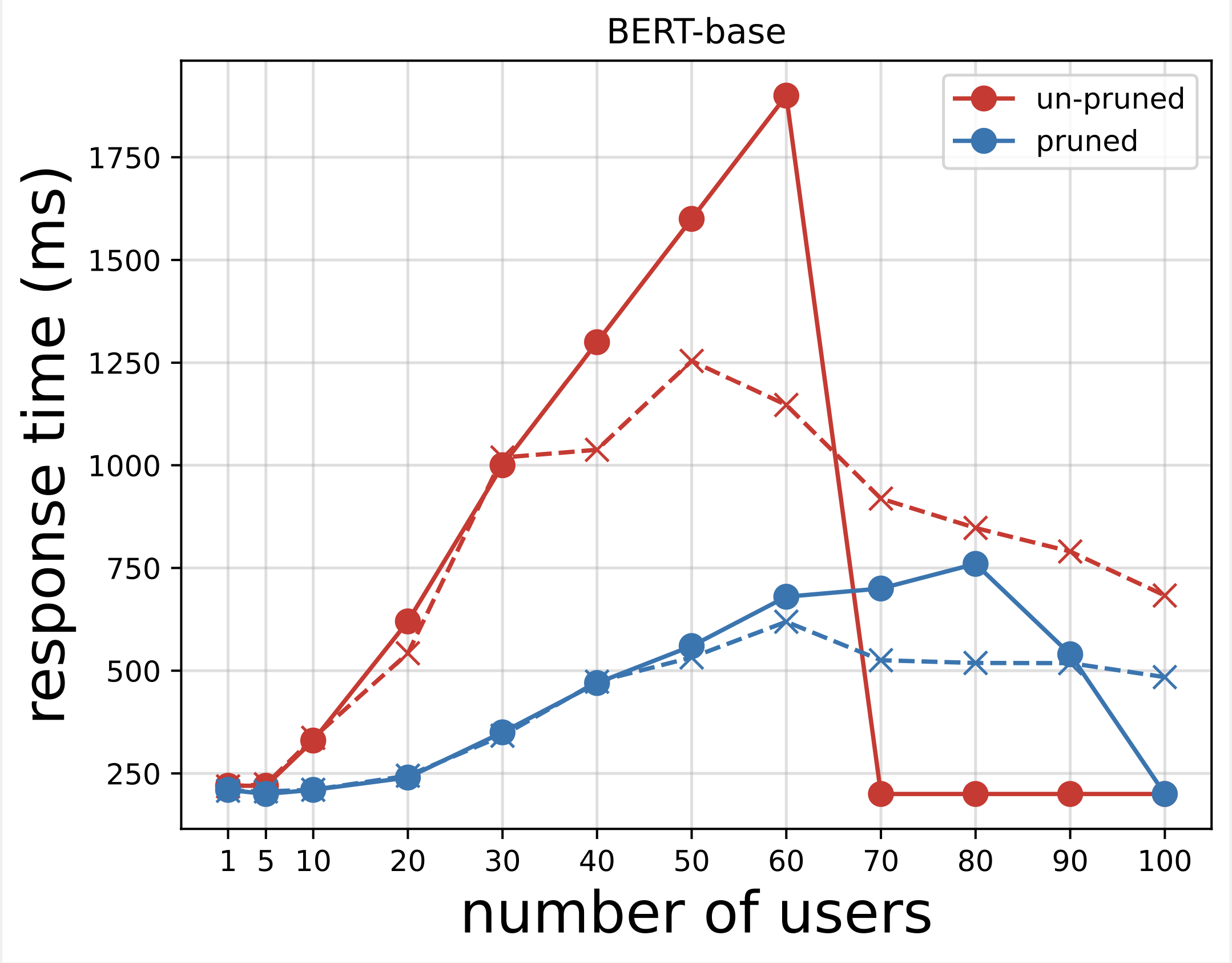

Pada bagan kedua, yang merupakan perpanjangan dari bagan pertama, kami mengamati bahwa setelah sekitar 70 pengguna, SageMaker mulai membatasi titik akhir model BERT dasar dan memberikan pengecualian. Namun, untuk titik akhir model yang dipangkas NAS, pembatasan terjadi antara 90–100 pengguna dan dengan waktu respons yang lebih rendah.

Dari dua diagram tersebut, kami mengamati bahwa model yang dipangkas memiliki waktu respons yang lebih cepat dan skala yang lebih baik jika dibandingkan dengan model yang tidak dipangkas. Saat kami menskalakan jumlah titik akhir inferensi, seperti halnya dengan pengguna yang menerapkan titik akhir inferensi dalam jumlah besar untuk aplikasi PLM mereka, manfaat biaya dan peningkatan kinerja mulai menjadi cukup besar.

Membersihkan

Untuk menghapus titik akhir SageMaker untuk model BERT dasar yang telah disempurnakan dan model yang dipangkas NAS, selesaikan langkah-langkah berikut:

- Di konsol SageMaker, pilih Kesimpulan dan Titik akhir di panel navigasi.

- Pilih titik akhir dan hapus.

Alternatifnya, dari notebook SageMaker Studio, jalankan perintah berikut dengan memberikan nama titik akhir:

Kesimpulan

Dalam postingan ini, kita membahas cara menggunakan NAS untuk memangkas model BERT yang telah disesuaikan. Kami pertama kali melatih model BERT dasar menggunakan data khusus domain dan menerapkannya ke titik akhir SageMaker. Kami melakukan pencarian multi-tujuan pada model BERT dasar yang disempurnakan menggunakan SageMaker AMT untuk tugas target. Kami memvisualisasikan bagian depan Pareto dan memilih model BERT optimal Pareto yang dipangkas NAS dan menerapkan model tersebut ke titik akhir SageMaker kedua. Kami melakukan pengujian beban menggunakan Locust untuk menyimulasikan pengguna yang menanyakan kedua titik akhir, dan mengukur serta mencatat waktu respons dalam file CSV. Kami merencanakan waktu respons vs. jumlah pengguna untuk kedua model.

Kami mengamati bahwa model BERT yang dipangkas memiliki kinerja yang jauh lebih baik dalam waktu respons dan ambang batas pembatasan instans. Kami menyimpulkan bahwa model yang dipangkas NAS lebih tahan terhadap peningkatan beban pada titik akhir, mempertahankan waktu respons yang lebih rendah bahkan ketika lebih banyak pengguna yang menekan sistem dibandingkan dengan model BERT dasar. Anda dapat menerapkan teknik NAS yang dijelaskan dalam postingan ini ke model bahasa besar apa pun untuk menemukan model yang dipangkas yang dapat melakukan tugas target dengan waktu respons yang jauh lebih rendah. Anda dapat lebih mengoptimalkan pendekatan ini dengan menggunakan latensi sebagai parameter selain kehilangan validasi.

Meskipun kami menggunakan NAS dalam postingan ini, kuantisasi adalah pendekatan umum lainnya yang digunakan untuk mengoptimalkan dan mengompresi model PLM. Kuantisasi mengurangi presisi bobot dan aktivasi dalam jaringan terlatih dari floating point 32-bit ke lebar bit yang lebih rendah seperti bilangan bulat 8-bit atau 16-bit, yang menghasilkan model terkompresi yang menghasilkan inferensi lebih cepat. Kuantisasi tidak mengurangi jumlah parameter; malah mengurangi presisi parameter yang ada untuk mendapatkan model terkompresi. Pemangkasan NAS menghilangkan jaringan yang berlebihan di PLM, sehingga menciptakan model yang jarang dengan parameter yang lebih sedikit. Biasanya, pemangkasan dan kuantisasi NAS digunakan bersama-sama untuk mengompresi PLM besar guna menjaga akurasi model, mengurangi kerugian validasi sekaligus meningkatkan kinerja, dan mengurangi ukuran model. Teknik lain yang umum digunakan untuk mengurangi ukuran PLM meliputi distilasi pengetahuan, faktorisasi matriks, dan kaskade distilasi.

Pendekatan yang diusulkan dalam postingan blog ini cocok untuk tim yang menggunakan SageMaker untuk melatih dan menyempurnakan model menggunakan data spesifik domain dan menerapkan titik akhir untuk menghasilkan inferensi. Jika Anda mencari layanan terkelola sepenuhnya yang menawarkan pilihan model fondasi berperforma tinggi yang diperlukan untuk membangun aplikasi AI generatif, pertimbangkan untuk menggunakan Batuan Dasar Amazon. Jika Anda mencari model sumber terbuka dan terlatih untuk berbagai kasus penggunaan bisnis dan ingin mengakses templat solusi dan contoh buku catatan, pertimbangkan untuk menggunakan Mulai Lompatan Amazon SageMaker. Versi terlatih dari model casing dasar Hugging Face BERT yang kami gunakan dalam postingan ini juga tersedia dari SageMaker JumpStart.

Tentang Penulis

Aparajithan Vaidyanathan adalah Arsitek Solusi Perusahaan Utama di AWS. Dia adalah Arsitek Cloud dengan pengalaman lebih dari 24 tahun dalam merancang dan mengembangkan sistem perangkat lunak perusahaan, berskala besar, dan terdistribusi. Ia berspesialisasi dalam AI Generatif dan Rekayasa Data Pembelajaran Mesin. Dia adalah calon pelari maraton dan hobinya meliputi hiking, bersepeda, dan menghabiskan waktu bersama istri dan dua putranya.

Aparajithan Vaidyanathan adalah Arsitek Solusi Perusahaan Utama di AWS. Dia adalah Arsitek Cloud dengan pengalaman lebih dari 24 tahun dalam merancang dan mengembangkan sistem perangkat lunak perusahaan, berskala besar, dan terdistribusi. Ia berspesialisasi dalam AI Generatif dan Rekayasa Data Pembelajaran Mesin. Dia adalah calon pelari maraton dan hobinya meliputi hiking, bersepeda, dan menghabiskan waktu bersama istri dan dua putranya.

Harun Klein adalah Ilmuwan Terapan Sr di AWS yang mengerjakan metode pembelajaran mesin otomatis untuk jaringan saraf dalam.

Harun Klein adalah Ilmuwan Terapan Sr di AWS yang mengerjakan metode pembelajaran mesin otomatis untuk jaringan saraf dalam.

Jacek Golebiowski adalah Ilmuwan Terapan Senior di AWS.

Jacek Golebiowski adalah Ilmuwan Terapan Senior di AWS.

- Konten Bertenaga SEO & Distribusi PR. Dapatkan Amplifikasi Hari Ini.

- PlatoData.Jaringan Vertikal Generatif Ai. Berdayakan Diri Anda. Akses Di Sini.

- PlatoAiStream. Intelijen Web3. Pengetahuan Diperkuat. Akses Di Sini.

- PlatoESG. Karbon, teknologi bersih, energi, Lingkungan Hidup, Tenaga surya, Penanganan limbah. Akses Di Sini.

- PlatoHealth. Kecerdasan Uji Coba Biotek dan Klinis. Akses Di Sini.

- Sumber: https://aws.amazon.com/blogs/machine-learning/reduce-inference-time-for-bert-models-using-neural-architecture-search-and-sagemaker-automated-model-tuning/

- :memiliki

- :adalah

- :bukan

- :Di mana

- ][P

- $NAIK

- 1

- 10

- 100

- 11

- 12

- 13

- 15%

- 17

- 19

- 20

- 26%

- 30

- 31

- 320

- 7

- 70

- 72

- 8

- 9

- a

- kemampuan

- Sanggup

- mengakses

- Akun

- ketepatan

- Mencapai

- Mencapai

- aktivasi

- tambahan

- Adopsi

- Setelah

- AI

- tujuan

- Bertujuan

- algoritma

- Semua

- mengizinkan

- Membiarkan

- memungkinkan

- juga

- Amazon

- Amazon Web Services

- jumlah

- an

- analisis

- analisis

- menganalisa

- dan

- Lain

- menjawab

- Apa pun

- api

- aplikasi

- terapan

- Mendaftar

- Menerapkan

- pendekatan

- persetujuan

- sekitar

- arsitektur

- ADALAH

- DAERAH

- daerah

- argumen

- sekitar

- buatan

- AS

- bercita-cita tinggi

- ditugaskan

- terkait

- At

- berusaha

- menghadiri

- Otomatis

- mengotomatiskan

- secara otomatis

- mengotomatisasi

- Otomatisasi

- tersedia

- AWS

- Sumbu

- Saldo

- mendasarkan

- berdasarkan

- BE

- menjadi

- sebelum

- laku

- benchmarking

- Manfaat

- TERBAIK

- Lebih baik

- antara

- Bit

- tubuh

- kedua

- membangun

- bisnis

- Proses bisnis

- tapi

- by

- CAN

- calon

- kemampuan

- kasus

- kasus

- katalog

- perubahan

- Grafik

- Charts

- chatbots

- pilihan

- Pilih

- terpilih

- kelas

- klasifikasi

- Klinis

- rapat

- awan

- kode

- mengumpulkan

- koleksi

- kombinasi

- komersial

- Umum

- umum

- dibandingkan

- lengkap

- Lengkap

- kompleks

- kompleksitas

- komponen

- komputasi

- menghitung

- konsep

- Disimpulkan

- Mempertimbangkan

- terdiri

- konsul

- kendala

- membangun

- konsumsi

- mengandung

- Konten

- pembuatan konten

- konteks

- terus

- kontras

- kontrol

- Sesuai

- Biaya

- Biaya

- menghitung

- membuat

- menciptakan

- penciptaan

- pelanggan

- Layanan Pelanggan

- data

- ilmu data

- kumpulan data

- tanggal Waktu

- memutuskan

- Pengambilan Keputusan

- dedicated

- mendalam

- menetapkan

- didefinisikan

- mendefinisikan

- demo

- mendemonstrasikan

- Tergantung

- menyebarkan

- dikerahkan

- penggelaran

- menyebarkan

- dijelaskan

- Mendesain

- merancang

- diinginkan

- berkembang

- berbeda

- dibahas

- didistribusikan

- dokumen

- Tidak

- dominan

- Mendominasi

- Dont

- dua

- selama

- e

- setiap

- efisiensi

- efisien

- antara

- Titik akhir

- Teknik

- Mesin

- cukup

- Enter

- Enterprise

- adopsi perusahaan

- entitas

- masuk

- Lingkungan Hidup

- masa

- kesalahan

- mengevaluasi

- dievaluasi

- evaluasi

- Bahkan

- peristiwa

- contoh

- Kecuali

- pengecualian

- khusus

- ada

- pengalaman

- Menjelaskan

- menjelaskan

- perpanjangan

- Menghadapi

- palsu

- lebih cepat

- Fitur

- umpan balik

- sedikit

- bidang

- File

- File

- terakhir

- Menemukan

- temuan

- Pertama

- tetap

- keluwesan

- mengambang

- berikut

- Tapak

- Untuk

- ditemukan

- Prinsip Dasar

- dari

- depan

- perbatasan

- sepenuhnya

- fungsi

- lebih lanjut

- menghasilkan

- menghasilkan

- generatif

- AI generatif

- mendapatkan

- diberikan

- tujuan

- GPU

- abu-abu

- Terjadi

- Memiliki

- he

- kepala

- kepala

- kesehatan

- membantu

- Tersembunyi

- berkinerja tinggi

- lebih tinggi

- -nya

- sejarah

- tuan rumah

- host

- JAM

- Seterpercayaapakah Olymp Trade? Kesimpulan

- How To

- Namun

- HTML

- http

- HTTPS

- MemelukWajah

- Optimalisasi Hyperparameter

- Penyesuaian Hyperparameter

- i

- mengenali

- BEI

- if

- menjelaskan

- Dampak

- dampak

- melaksanakan

- mengimpor

- memperbaiki

- ditingkatkan

- perbaikan

- meningkatkan

- in

- memasukkan

- Meningkatkan

- Pada meningkat

- meningkatkan

- informasi

- Infrastruktur

- memasukkan

- contoh

- sebagai gantinya

- Cerdas

- ke

- IT

- NYA

- Pekerjaan

- Jobs

- jpg

- json

- pengetahuan

- dikenal

- bahasa

- besar

- besar-besaran

- terbesar

- Latensi

- lapisan

- lapisan

- Memimpin

- BELAJAR

- pengetahuan

- paling sedikit

- membiarkan

- perpustakaan

- Perpustakaan

- baris

- memuat

- mencatat

- penebangan

- mencari

- lepas

- kerugian

- menurunkan

- mesin

- Mesin belajar

- memelihara

- mempertahankan

- pria

- berhasil

- Maraton

- masker

- matplotlib.dll

- maksimum

- Mungkin..

- makna

- mengukur

- ukur

- medis

- Pelajari

- Memori

- Metadata

- metode

- metrik

- Metrik

- mungkin

- menit

- ML

- model

- pemodelan

- model

- modular

- lebih

- pindah

- banyak

- beberapa

- harus

- nama

- Bernama

- nama

- di

- Alam

- Pengolahan Bahasa alami

- Arahkan

- Navigasi

- perlu

- Perlu

- dibutuhkan

- kebutuhan

- jaringan

- jaringan

- saraf

- saraf jaringan

- jaringan saraf

- berikutnya

- nLP

- None

- mencatat

- buku catatan

- sekarang

- jumlah

- obyek

- tujuan

- target

- mengamati

- of

- lepas

- menawarkan

- Penawaran

- on

- ONE

- secara online

- pengecer online

- hanya

- Buka

- open source

- optimal

- optimasi

- Optimize

- dioptimalkan

- Mengoptimalkan

- mengoptimalkan

- or

- urutan

- asli

- Lainnya

- kami

- di luar

- keluaran

- output

- lebih

- secara keseluruhan

- ikhtisar

- sendiri

- pasang

- pane

- Paralel

- parameter

- parameter

- Pareto

- bagian

- Lulus

- path

- pasien

- pola

- Melakukan

- prestasi

- dilakukan

- melakukan

- melakukan

- Izin

- plato

- Kecerdasan Data Plato

- Data Plato

- Titik

- poin

- posisi

- Pos

- Ketelitian

- ramalan

- Predictor

- preferensi

- siap

- prasyarat

- menyajikan

- sebelumnya

- Utama

- Masalah

- proses

- Otomatisasi proses

- proses

- pengolahan

- Produk

- produktifitas

- diusulkan

- pemberi

- menyediakan

- menyediakan

- menarik

- Menarik

- tujuan

- tujuan

- Ular sanca

- pytorch

- Q & A

- pertanyaan

- agak

- acak

- jarak

- cepat

- Tarif

- Mentah

- nyata

- pengakuan

- mengenali

- mengenali

- Rekomendasi

- rekomendasi

- catatan

- tercatat

- Merah

- menurunkan

- mengurangi

- mengurangi

- regex

- terkait

- menghapus

- menghapus

- laporan

- perwakilan

- permintaan

- permintaan

- wajib

- Persyaratan

- tabah

- sumber

- Sumber

- masing-masing

- tanggapan

- Hasil

- pengecer

- penahan

- Pengembalian

- naik

- Risiko

- BARIS

- Run

- pelari

- berjalan

- berjalan

- s

- mengorbankan

- pembuat bijak

- Inferensi SageMaker

- Save

- Skala

- sisik

- Ilmu

- ilmuwan

- skor

- naskah

- Pencarian

- Mesin pencari

- mencari

- Kedua

- Bagian

- melihat

- memilih

- terpilih

- DIRI

- mengirim

- putusan pengadilan

- sentimen

- Urutan

- layanan

- Layanan

- Sidang

- set

- set

- pengaturan

- Pertunjukkan

- sinyal

- signifikan

- Sederhana

- serentak

- tunggal

- Ukuran

- lebih kecil

- So

- Perangkat lunak

- larutan

- Solusi

- beberapa

- sumber

- Space

- khusus

- spesialisasi

- tertentu

- Secara khusus

- Pengeluaran

- membagi

- awal

- dimulai

- Negara

- statistika

- Langkah

- Tangga

- penyimpanan

- struktural

- tersusun

- studio

- besar

- sukses

- berhasil

- seperti itu

- cocok

- rangkaian

- RINGKASAN

- sistem

- sistem

- Mengambil

- Dibutuhkan

- target

- tugas

- tugas

- tim

- teknik

- teknik

- template

- istilah

- pengujian

- tes

- teks

- Klasifikasi Teks

- tekstual

- dari

- bahwa

- Grafik

- mereka

- kemudian

- Sana.

- karena itu

- Ini

- ini

- tiga

- ambang

- Melalui

- waktu

- kali

- untuk

- bersama

- token

- mengambil

- alat

- alat

- perdagangan

- Trading

- Pelatihan VE

- terlatih

- Pelatihan

- transformator

- transformer

- benar

- mencoba

- menyetel

- dua

- mengetik

- jenis

- khas

- khas

- Akhirnya

- bawah

- menjalani

- pemahaman

- unit

- us

- menggunakan

- gunakan case

- bekas

- Pengguna

- Pengguna

- kegunaan

- menggunakan

- pengesahan

- nilai

- Nilai - Nilai

- versi

- melalui

- maya

- membayangkan

- vs

- ingin

- adalah

- we

- jaringan

- layanan web

- BAIK

- ketika

- apakah

- yang

- sementara

- SIAPA

- lebar

- Rentang luas

- sangat

- istri

- Wikipedia

- akan

- rela

- dengan

- dalam

- Kerja

- alur kerja

- kerja

- X

- tahun

- Menghasilkan

- Kamu

- Anda

- zephyrnet.dll