Hari ini, kami sangat gembira mengumumkan kemampuan untuk menyempurnakan model Llama 2 dengan menggunakan Meta Mulai Lompatan Amazon SageMaker. Keluarga model bahasa besar (LLM) Llama 2 adalah kumpulan model teks generatif yang telah dilatih dan disempurnakan dengan skala mulai dari 7 miliar hingga 70 miliar parameter. LLM yang disempurnakan, disebut Llama-2-chat, dioptimalkan untuk kasus penggunaan dialog. Anda dapat dengan mudah mencoba model ini dan menggunakannya dengan SageMaker JumpStart, yang merupakan hub pembelajaran mesin (ML) yang menyediakan akses ke algoritme, model, dan solusi ML sehingga Anda dapat memulai ML dengan cepat. Sekarang Anda juga dapat menyempurnakan 7 miliar, 13 miliar, dan 70 miliar parameter model pembuatan teks Llama 2 di SageMaker JumpStart menggunakan Studio Amazon SageMaker UI dengan beberapa klik atau menggunakan SageMaker Python SDK.

Model dasar AI generatif telah menjadi fokus sebagian besar penelitian dan kasus penggunaan ML dan kecerdasan buatan selama lebih dari satu tahun. Model dasar ini berkinerja sangat baik dalam tugas generatif, seperti pembuatan teks, peringkasan, menjawab pertanyaan, pembuatan gambar dan video, dan banyak lagi, karena ukurannya yang besar dan juga karena model tersebut dilatih pada beberapa kumpulan data besar dan ratusan tugas. Meskipun model ini memiliki kemampuan generalisasi yang besar, sering kali terdapat kasus penggunaan yang memiliki data domain yang sangat spesifik (seperti layanan kesehatan atau layanan keuangan), sehingga model ini mungkin tidak dapat memberikan hasil yang baik untuk kasus penggunaan tersebut. Hal ini mengakibatkan perlunya penyempurnaan lebih lanjut pada model AI generatif ini pada data kasus penggunaan dan domain tertentu.

Dalam postingan ini, kami membahas cara menyempurnakan model pembuatan teks terlatih Llama 2 melalui SageMaker JumpStart.

Apa itu Llama 2

Llama 2 adalah model bahasa auto-regresif yang menggunakan arsitektur transformator yang dioptimalkan. Llama 2 ditujukan untuk penggunaan komersial dan penelitian dalam bahasa Inggris. Ini hadir dalam berbagai ukuran parameter—7 miliar, 13 miliar, dan 70 miliar—serta variasi yang telah dilatih sebelumnya dan disesuaikan. Menurut Meta, versi yang disetel menggunakan penyempurnaan yang diawasi (SFT) dan pembelajaran penguatan dengan umpan balik manusia (RLHF) untuk menyelaraskan dengan preferensi manusia dalam hal kegunaan dan keamanan. Llama 2 telah dilatih sebelumnya tentang 2 triliun token data dari sumber yang tersedia untuk umum. Model yang disetel ditujukan untuk obrolan seperti asisten, sedangkan model terlatih dapat diadaptasi untuk berbagai tugas pembuatan bahasa alami. Terlepas dari versi model mana yang digunakan pengembang, panduan penggunaan yang bertanggung jawab dari Meta dapat membantu memandu penyesuaian tambahan yang mungkin diperlukan untuk menyesuaikan dan mengoptimalkan model dengan mitigasi keselamatan yang sesuai.

Saat ini, Llama 2 tersedia di wilayah berikut:

- Terapkan model terlatih yang tersedia:

"us-west-2","us-east-1","us-east-2","eu-west-1","ap-southeast-1","ap-southeast-2" - Sempurnakan dan terapkan model yang telah disesuaikan:

“us-east-1”,“us-west-2”,“eu-west-1”

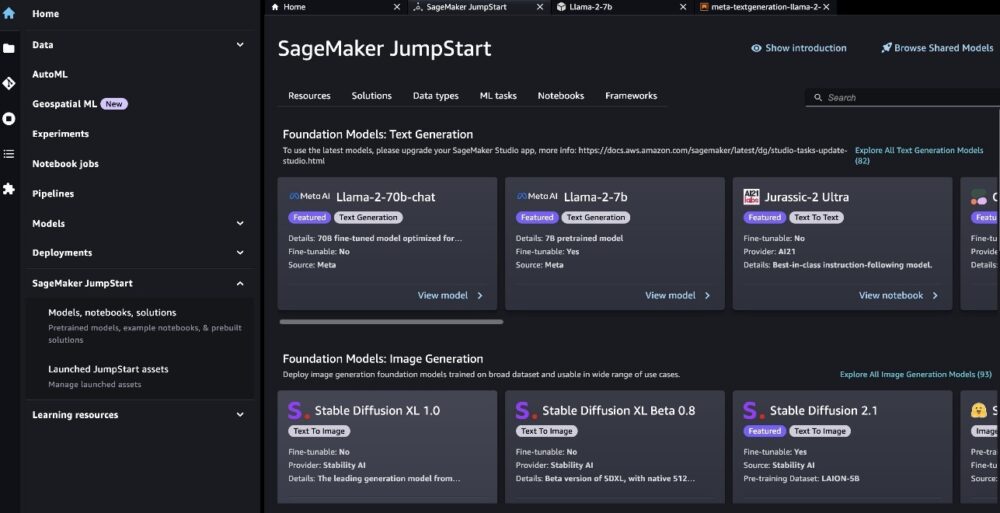

Apa itu SageMaker JumpStart

Dengan SageMaker JumpStart, praktisi ML dapat memilih dari beragam pilihan model fondasi yang tersedia untuk umum. Praktisi ML dapat menerapkan model dasar ke model khusus Amazon SageMaker contoh dari lingkungan jaringan yang terisolasi dan menyesuaikan model menggunakan SageMaker untuk pelatihan dan penerapan model. Anda sekarang dapat menemukan dan menerapkan Llama 2 dengan beberapa klik di SageMaker Studio atau secara terprogram melalui SageMaker Python SDK, memungkinkan Anda memperoleh performa model dan kontrol MLOps dengan fitur SageMaker seperti Pipa Amazon SageMaker, Debugger Amazon SageMaker, atau log kontainer. Model ini diterapkan di lingkungan aman AWS dan di bawah kendali VPC Anda, membantu memastikan keamanan data. Selain itu, Anda dapat menyempurnakan model pembuatan teks terlatih Llama2 7B, 13B, dan 70B melalui SageMaker JumpStart.

Sempurnakan model Llama2

Anda dapat menyempurnakan model menggunakan SageMaker Studio UI atau SageMaker Python SDK. Kami membahas kedua metode di bagian ini.

Penyempurnaan tanpa kode melalui UI SageMaker Studio

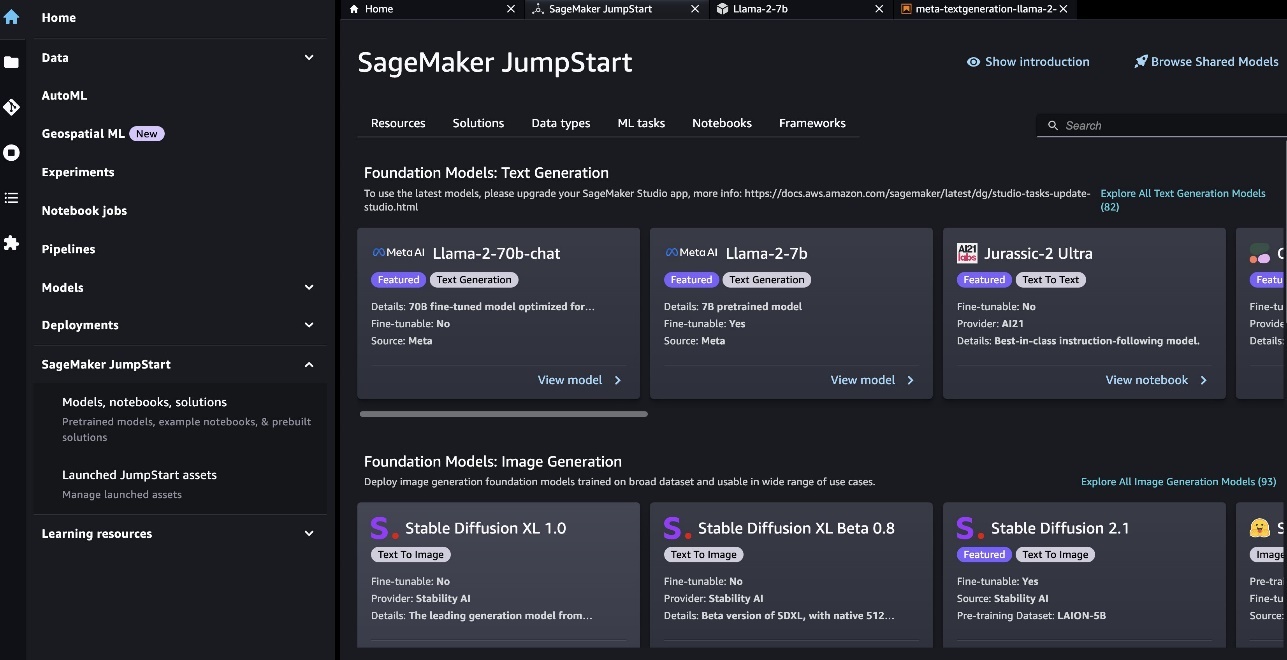

Di SageMaker Studio, Anda dapat mengakses model Llama 2 melalui SageMaker JumpStart di bawah Model, buku catatan, dan solusi, seperti yang ditunjukkan pada tangkapan layar berikut.

Jika Anda tidak melihat model Llama 2, perbarui versi SageMaker Studio Anda dengan mematikan dan memulai ulang. Untuk informasi lebih lanjut tentang pembaruan versi, lihat Matikan dan Perbarui Aplikasi Studio.

Anda juga dapat menemukan empat varian model lainnya dengan memilih Jelajahi semua Model Pembuatan Teks atau mencari llama di kotak pencarian.

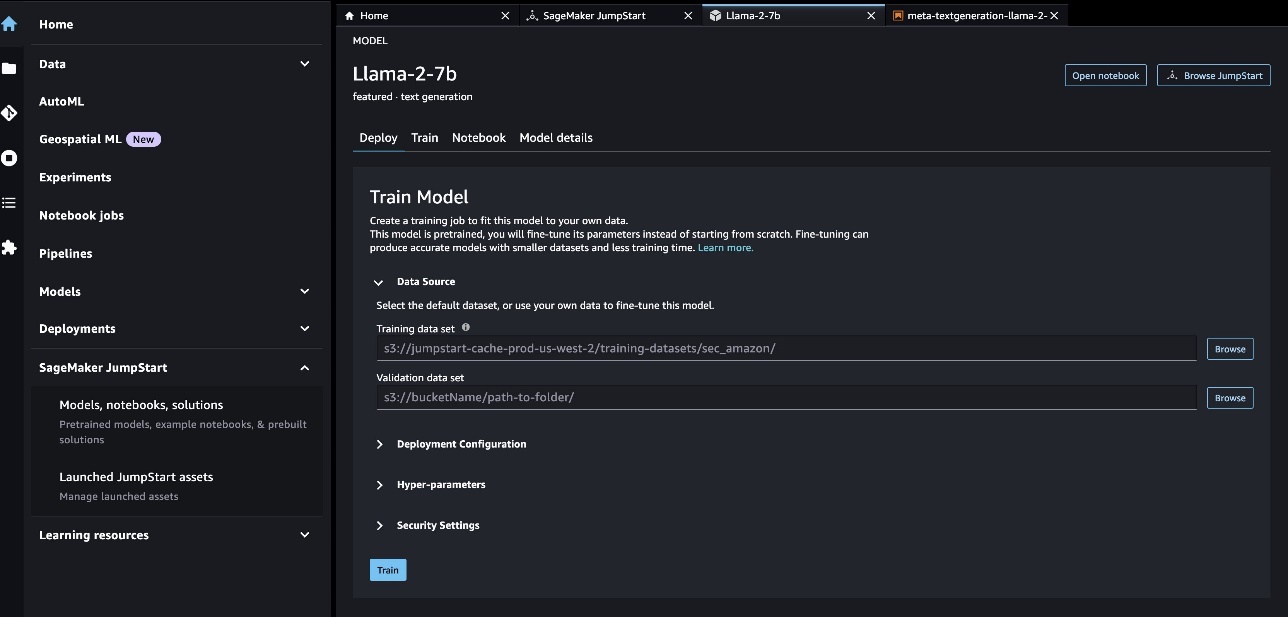

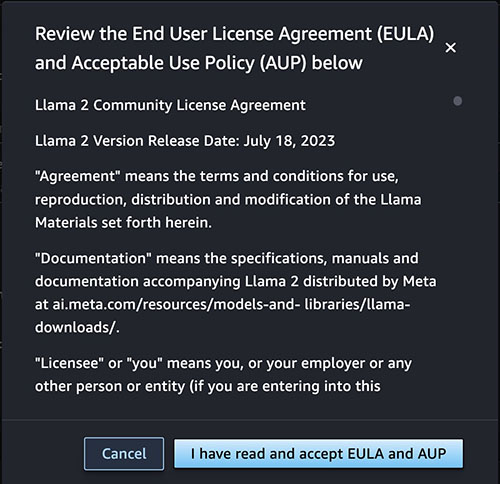

Di halaman ini, Anda dapat menunjuk ke Layanan Penyimpanan Sederhana Amazon (Amazon S3) yang berisi kumpulan data pelatihan dan validasi untuk penyesuaian. Selain itu, Anda dapat mengonfigurasi konfigurasi penerapan, hyperparameter, dan pengaturan keamanan untuk penyesuaian. Anda kemudian dapat memilih Pelatihan VE untuk memulai tugas pelatihan pada instans SageMaker ML. Tangkapan layar sebelumnya menunjukkan halaman penyesuaian untuk model Llama-2 7B; namun, Anda dapat menyempurnakan model pembuatan teks Llama 13 70B dan 2B menggunakan halaman model masing-masing dengan cara yang sama. Untuk menggunakan model Llama 2, Anda harus menerima Perjanjian Lisensi Pengguna Akhir (EULA). Itu akan muncul ketika Anda memilih Pelatihan VE, seperti yang ditunjukkan pada tangkapan layar berikut. Memilih Saya telah membaca dan menerima EULA dan AUP untuk memulai pekerjaan penyesuaian.

Menyebarkan model

Setelah model disetel dengan baik, Anda dapat menerapkannya menggunakan halaman model di SageMaker JumpStart. Opsi untuk menyebarkan model yang telah disempurnakan akan muncul setelah penyesuaian selesai, seperti yang ditunjukkan pada gambar layar berikut.

Sempurnakan melalui SageMaker Python SDK

Anda juga dapat menyempurnakan model Llama 2 menggunakan SageMaker Python SDK. Berikut ini adalah contoh kode untuk menyempurnakan Llama 2 7B pada dataset Anda:

Anda dapat menerapkan model yang telah disempurnakan langsung dari estimator:

Anda juga dapat menemukan kodenya di Sempurnakan model LLaMA 2 di SageMaker JumpStart. Ini mencakup persiapan set data, pelatihan pada set data khusus Anda, dan penerapan model yang telah disesuaikan. Ini menunjukkan penyesuaian pada subkumpulan kumpulan data Dolly dengan contoh dari tugas peringkasan. Berikut adalah contoh input dengan respon dari fine-tuned dan non-fine-tuned beserta respon kebenaran dasarnya:

Masukan ke model:

Tanggapan Kebenaran Dasar:

Tanggapan dari model yang tidak disempurnakan:

Tanggapan dari model yang telah disesuaikan:

Untuk tolok ukur performa berbagai model pada kumpulan data Dolly dan Dialogsum, lihat Pembandingan kinerja bagian dalam lampiran di akhir posting ini.

Teknik penyempurnaan

Model bahasa seperti Llama berukuran lebih dari 10 GB atau bahkan 100 GB. Menyempurnakan model besar seperti itu memerlukan instans dengan memori CUDA yang sangat tinggi. Selain itu, pelatihan model ini bisa sangat lambat karena ukuran modelnya. Oleh karena itu, untuk penyesuaian yang efisien, kami menggunakan pengoptimalan berikut:

- Adaptasi Tingkat Rendah (LoRA) – Ini adalah jenis penyempurnaan efisien parameter (PEFT) untuk penyempurnaan efisien pada model besar. Dalam hal ini, kami membekukan keseluruhan model dan hanya menambahkan sekumpulan kecil parameter atau lapisan yang dapat disesuaikan ke dalam model. Misalnya, daripada melatih seluruh 7 miliar parameter untuk Llama 2 7B, kita dapat menyempurnakan kurang dari 1% parameter. Hal ini membantu mengurangi kebutuhan memori secara signifikan karena kita hanya perlu menyimpan gradien, status pengoptimal, dan informasi terkait pelatihan lainnya hanya untuk 1% parameter. Selain itu, ini membantu mengurangi waktu pelatihan serta biaya. Untuk rincian lebih lanjut tentang metode ini, lihat LoRA: Adaptasi Peringkat Rendah dari Model Bahasa Besar.

- kuantisasi Int8 – Bahkan dengan optimasi seperti LoRA, model seperti Llama 70B masih terlalu besar untuk dilatih. Untuk mengurangi jejak memori selama pelatihan, kita dapat menggunakan kuantisasi Int8 selama pelatihan. Kuantisasi biasanya mengurangi ketepatan tipe data floating point. Meskipun hal ini mengurangi memori yang diperlukan untuk menyimpan bobot model, hal ini menurunkan kinerja karena hilangnya informasi. Kuantisasi Int8 hanya menggunakan presisi seperempat tetapi tidak menyebabkan penurunan kinerja karena tidak menghilangkan sedikit pun. Ini membulatkan data dari satu tipe ke tipe lainnya. Untuk mempelajari tentang kuantisasi Int8, lihat LLM.int8(): Perkalian Matriks 8-bit untuk Transformer dalam Skala Besar.

- Paralel Data Terpecah Sepenuhnya (FSDP) – Ini adalah jenis algoritme pelatihan paralel data yang membagi parameter model ke seluruh pekerja paralel data dan secara opsional dapat memindahkan sebagian komputasi pelatihan ke CPU. Meskipun parameternya dibagi ke beberapa GPU yang berbeda, komputasi setiap microbatch bersifat lokal bagi pekerja GPU. Ini memecah parameter secara lebih seragam dan mencapai performa optimal melalui komunikasi dan komputasi yang tumpang tindih selama pelatihan.

Tabel berikut membandingkan metode yang berbeda dengan ketiga model Llama 2.

| , | Jenis Instans Default | Jenis Instance yang Didukung dengan konfigurasi Default | Setingan awal | LORA + FSDP | LORA + Tanpa FSDP | Kuantisasi Int8 + LORA + Tanpa FSDP |

| Lama 2 7B | ml.g5.12xbesar | ml.g5.12xbesar, ml.g5.24xbesar, ml.g5.48xbesar | LORA + FSDP | Yes | Yes | Yes |

| Lama 2 13B | ml.g5.12xbesar | ml.g5.24xbesar, ml.g5.48xbesar | LORA + FSDP | Yes | Yes | Yes |

| Lama 2 70B | ml.g5.48xbesar | ml.g5.48xbesar | INT8 + LORA + TANPA FSDP | Tidak | Tidak | Yes |

Perhatikan bahwa penyempurnaan model Llama didasarkan pada skrip yang disediakan berikut ini GitHub repo.

Format kumpulan data pelatihan

SageMaker JumpStart saat ini mendukung kumpulan data dalam format adaptasi domain dan format penyetelan instruksi. Di bagian ini, kami menentukan contoh kumpulan data dalam kedua format. Untuk lebih jelasnya, lihat Pemformatan kumpulan data bagian dalam lampiran.

Format adaptasi domain

Model Llama 2 pembuatan teks dapat disesuaikan pada kumpulan data spesifik domain apa pun. Setelah disempurnakan pada kumpulan data khusus domain, model ini diharapkan dapat menghasilkan teks khusus domain dan menyelesaikan berbagai tugas NLP di domain tertentu tersebut dengan beberapa petunjuk. Dengan dataset ini, input terdiri dari file CSV, JSON, atau TXT. Misalnya, data masukan mungkin berupa arsip SEC dari Amazon sebagai file teks:

Format penyetelan instruksi

Dalam penyempurnaan instruksi, model disetel dengan baik untuk serangkaian tugas pemrosesan bahasa alami (NLP) yang dijelaskan menggunakan instruksi. Hal ini membantu meningkatkan performa model untuk tugas yang tidak terlihat dengan perintah zero-shot. Dalam format himpunan data penyetelan instruksi, Anda menentukan template.json file yang menjelaskan format input dan output. Misalnya, setiap baris dalam file train.jsonl terlihat seperti berikut ini:

Berkas tambahan template.json terlihat seperti berikut ini:

Hyperparameter yang didukung untuk pelatihan

Penyempurnaan Llama 2 mendukung sejumlah hyperparameter, yang masing-masing dapat memengaruhi kebutuhan memori, kecepatan pelatihan, dan performa model yang disempurnakan:

- masa – Jumlah lintasan yang dilakukan algoritme penyesuaian melalui kumpulan data pelatihan. Harus berupa bilangan bulat yang lebih besar dari 1. Standarnya adalah 5.

- tingkat_belajar – Kecepatan pembaruan bobot model setelah mengerjakan setiap batch contoh pelatihan. Harus berupa float positif yang lebih besar dari 0. Defaultnya adalah 1e-4.

- instruksi_disetel – Apakah akan melatih model secara instruksi atau tidak. Harus '

True' atau 'False'. Standarnya adalah 'False'. - per_device_train_batch_size – Ukuran batch per inti GPU/CPU untuk pelatihan. Harus berupa bilangan bulat positif. Standarnya adalah 4.

- per_device_eval_batch_size – Ukuran batch per inti GPU/CPU untuk evaluasi. Harus berupa bilangan bulat positif. Standarnya adalah 1.

- max_train_samples – Untuk tujuan debugging atau pelatihan yang lebih cepat, potong jumlah contoh pelatihan ke nilai ini. Nilai -1 berarti menggunakan semua sampel pelatihan. Harus berupa bilangan bulat positif atau -1. Standarnya adalah -1.

- max_val_samples – Untuk tujuan debugging atau pelatihan yang lebih cepat, potong jumlah contoh validasi ke nilai ini. Nilai -1 berarti menggunakan seluruh sampel validasi. Harus berupa bilangan bulat positif atau -1. Standarnya adalah -1.

- max_input_length – Total panjang urutan input maksimum setelah tokenisasi. Urutan yang lebih panjang dari ini akan terpotong. Jika -1,

max_input_lengthdiatur ke minimum 1024 dan panjang model maksimum yang ditentukan oleh tokenizer. Jika disetel ke nilai positif,max_input_lengthdiatur ke nilai minimum yang diberikan danmodel_max_lengthditentukan oleh tokenizer. Harus berupa bilangan bulat positif atau -1. Standarnya adalah -1. - validasi_split_ratio – Jika saluran validasi adalah

none, rasio pemisahan validasi kereta dari data kereta harus antara 0–1. Standarnya adalah 0.2. - train_data_split_seed – Jika data validasi tidak ada, tindakan ini akan memperbaiki pemisahan acak data pelatihan masukan menjadi data pelatihan dan validasi yang digunakan oleh algoritme. Harus bilangan bulat. Standarnya adalah 0.

- preprocessing_num_workers – Jumlah proses yang digunakan untuk prapemrosesan. Jika

None, proses utama digunakan untuk preprocessing. Standarnya adalahNone. - lora_r – Lora R. Harus bilangan bulat positif. Standarnya adalah 8.

- lora_alpha – Lora Alfa. Harus berupa bilangan bulat positif. Standarnya adalah 32

- lora_putus sekolah – Lora Putus Sekolah. harus berupa float positif antara 0 dan 1. Standarnya adalah 0.05.

- int8_quantisasi - Jika

True, model dimuat dengan presisi 8-bit untuk pelatihan. Default untuk 7B dan 13B adalahFalse. Default untuk 70B adalahTrue. - aktifkan_fsdp - Jika

True, pelatihan menggunakan FSDP. Default untuk 7B dan 13B adalahTrue. Default untuk 70B adalahFalse. Catat ituint8_quantizationtidak didukung dengan FSDP.

Jenis instans dan hyperparameter yang kompatibel

Kebutuhan memori selama penyesuaian dapat bervariasi berdasarkan beberapa faktor:

- Tipe model – Model 7B memiliki kebutuhan memori GPU paling sedikit dan model 70B memiliki kebutuhan memori terbesar

- Panjang masukan maksimal – Nilai panjang input yang lebih tinggi menyebabkan pemrosesan lebih banyak token pada satu waktu dan karenanya memerlukan lebih banyak memori CUDA

- Ukuran batch – Ukuran batch yang lebih besar memerlukan memori CUDA yang lebih besar dan oleh karena itu memerlukan jenis instans yang lebih besar

- kuantisasi Int8 – Jika menggunakan kuantisasi Int8, model dimuat ke dalam presisi rendah sehingga memerlukan lebih sedikit memori CUDA

Untuk membantu Anda memulai, kami menyediakan serangkaian kombinasi berbagai tipe instans, hyperparameter, dan tipe model yang dapat disesuaikan dengan sukses. Anda dapat memilih konfigurasi sesuai kebutuhan dan ketersediaan jenis instans Anda. Kami menyempurnakan ketiga model pada berbagai pengaturan dengan tiga periode pada subset kumpulan data Dolly dengan contoh ringkasan.

model 7B

Tabel berikut merangkum opsi penyesuaian pada model 7B.

| Jenis Mesin Virtual | Len Masukan Maks | Ukuran Batch Per Perangkat | Kuantisasi Int8 | Aktifkan FSDP | Waktu yang Dibutuhkan (menit) |

| ml.g4dn.12xlarge | 1024 | 8 | BENAR | SALAH | 166 |

| ml.g4dn.12xlarge | 2048 | 2 | BENAR | SALAH | 178 |

| ml.g4dn.12xlarge | 1024 | 4 | SALAH | BENAR | 120 |

| ml.g4dn.12xlarge | 2048 | 2 | SALAH | BENAR | 143 |

| ml.g5.2xbesar | 1024 | 4 | BENAR | SALAH | 61 |

| ml.g5.2xbesar | 2048 | 2 | BENAR | SALAH | 68 |

| ml.g5.2xbesar | 1024 | 4 | SALAH | BENAR | 43 |

| ml.g5.2xbesar | 2048 | 2 | SALAH | BENAR | 49 |

| ml.g5.4xbesar | 1024 | 4 | SALAH | BENAR | 39 |

| ml.g5.4xbesar | 2048 | 2 | SALAH | BENAR | 50 |

| ml.g5.12xbesar | 1024 | 16 | BENAR | SALAH | 57 |

| ml.g5.12xbesar | 2048 | 4 | BENAR | SALAH | 64 |

| ml.g5.12xbesar | 1024 | 4 | SALAH | BENAR | 26 |

| ml.g5.12xbesar | 2048 | 4 | SALAH | BENAR | 23 |

| ml.g5.48xbesar | 1024 | 16 | BENAR | SALAH | 59 |

| ml.g5.48xbesar | 2048 | 4 | BENAR | SALAH | 67 |

| ml.g5.48xbesar | 1024 | 8 | SALAH | BENAR | 22 |

| ml.g5.48xbesar | 2048 | 4 | SALAH | BENAR | 21 |

13B

Tabel berikut merangkum opsi penyesuaian pada model 13B.

| Jenis Mesin Virtual | Len Masukan Maks | Ukuran Batch Per Perangkat | Kuantisasi Int8 | Aktifkan FSDP | Waktu yang Dibutuhkan (menit) |

| ml.g4dn.12xlarge | 1024 | 4 | BENAR | SALAH | 283 |

| ml.g4dn.12xlarge | 2048 | 2 | BENAR | SALAH | 328 |

| ml.g5.12xbesar | 1024 | 8 | BENAR | SALAH | 92 |

| ml.g5.12xbesar | 2048 | 4 | BENAR | SALAH | 104 |

| ml.g5.48xbesar | 1024 | 8 | BENAR | SALAH | 95 |

| ml.g5.48xbesar | 2048 | 4 | BENAR | SALAH | 107 |

| ml.g5.48xbesar | 1024 | 8 | SALAH | BENAR | 35 |

| ml.g5.48xbesar | 2048 | 2 | SALAH | BENAR | 41 |

70B

Tabel berikut merangkum opsi penyesuaian pada model 70B.

| Jenis Mesin Virtual | Len Masukan Maks | Ukuran Batch Per Perangkat | Kuantisasi Int8 | Aktifkan FSDP | Waktu yang Dibutuhkan (menit) |

| ml.g5.48xbesar | 1024 | 4 | BENAR | SALAH | 396 |

| ml.g5.48xbesar | 2048 | 1 | BENAR | SALAH | 454 |

Rekomendasi tentang jenis instans dan hyperparameter

Saat menyempurnakan akurasi model, perhatikan hal berikut:

- Model yang lebih besar seperti 70B memberikan kinerja yang lebih baik dibandingkan 7B

- Performa tanpa kuantisasi Int8 lebih baik dibandingkan performa dengan kuantisasi INT8

Perhatikan waktu pelatihan dan persyaratan memori CUDA berikut:

- Pengaturan

int8_quantization=Truemengurangi kebutuhan memori dan menghasilkan pelatihan yang lebih cepat. - Penurunan

per_device_train_batch_sizedanmax_input_lengthmengurangi kebutuhan memori dan oleh karena itu dapat dijalankan pada instance yang lebih kecil. Namun, menetapkan nilai yang sangat rendah dapat menambah waktu pelatihan. - Jika Anda tidak menggunakan kuantisasi Int8 (

int8_quantization=False), gunakan FSDP (enable_fsdp=True) untuk pelatihan yang lebih cepat dan efisien.

Saat memilih jenis instans, pertimbangkan hal berikut:

- Instans G5 memberikan pelatihan paling efisien di antara jenis instans yang didukung. Oleh karena itu, jika Anda memiliki instans G5, Anda harus menggunakannya.

- Waktu pelatihan sangat bergantung pada jumlah GPU dan memori CUDA yang tersedia. Oleh karena itu, pelatihan pada instans dengan jumlah GPU yang sama (misalnya, ml.g5.2xlarge dan ml.g5.4xlarge) kurang lebih sama. Oleh karena itu, Anda dapat menggunakan instance yang lebih murah untuk pelatihan (ml.g5.2xlarge).

- Saat menggunakan instans p3, pelatihan akan dilakukan dengan presisi 32-bit karena bfloat16 tidak didukung pada instans ini. Oleh karena itu, tugas pelatihan akan mengonsumsi dua kali lipat jumlah memori CUDA saat pelatihan pada instans p3 dibandingkan dengan instans g5.

Untuk mempelajari tentang biaya pelatihan per instans, lihat Contoh Amazon EC2 G5.

Jika kumpulan data dalam format penyetelan instruksi dan urutan input+penyelesaian kecil (misalnya 50–100 kata), maka nilai tinggi max_input_length menyebabkan kinerja yang sangat buruk. Nilai default parameter ini adalah -1, yang sesuai dengan max_input_length tahun 2048 untuk model Llama. Oleh karena itu, kami menyarankan jika kumpulan data Anda berisi sampel kecil, gunakan nilai yang kecil max_input_length (seperti 200–400).

Terakhir, karena tingginya permintaan instans G5, Anda mungkin mengalami tidak tersedianya instans ini di wilayah Anda dengan kesalahan “CapacityError: Unable to provision requested ML compute capacity. Please retry using a different ML instance type.” Jika Anda mengalami kesalahan ini, coba lagi tugas pelatihan atau coba Wilayah lain.

Masalah saat menyempurnakan model yang sangat besar

Di bagian ini, kita membahas dua masalah saat menyempurnakan model yang sangat besar.

Nonaktifkan kompresi keluaran

Secara default, output dari tugas pelatihan adalah model terlatih yang dikompresi dalam format .tar.gz sebelum diunggah ke Amazon S3. Namun karena ukuran modelnya yang besar, langkah ini bisa memakan waktu lama. Misalnya, mengompresi dan mengunggah model 70B dapat memakan waktu lebih dari 4 jam. Untuk menghindari masalah ini, Anda dapat menggunakan fitur nonaktifkan kompresi keluaran yang didukung oleh platform pelatihan SageMaker. Dalam hal ini, model diunggah tanpa kompresi apa pun, yang selanjutnya digunakan untuk penerapan:

Masalah batas waktu kernel SageMaker Studio

Karena ukuran model Llama 70B, tugas pelatihan mungkin memakan waktu beberapa jam dan kernel SageMaker Studio mungkin mati selama fase pelatihan. Namun, saat ini pelatihan di SageMaker masih berjalan. Jika hal ini terjadi, Anda masih dapat menyebarkan titik akhir menggunakan nama tugas pelatihan dengan kode berikut:

Untuk menemukan nama tugas pelatihan, navigasikan ke konsol SageMaker dan di bawahnya Pelatihan di panel navigasi, pilih Pekerjaan pelatihan. Identifikasi nama pekerjaan pelatihan dan gantikan dengan kode sebelumnya.

Kesimpulan

Dalam postingan ini, kami membahas menyempurnakan model Llama 2 Meta menggunakan SageMaker JumpStart. Kami menunjukkan bahwa Anda dapat menggunakan konsol SageMaker JumpStart di SageMaker Studio atau SageMaker Python SDK untuk menyempurnakan dan menerapkan model ini. Kami juga membahas teknik penyesuaian, jenis instans, dan hyperparameter yang didukung. Selain itu, kami menguraikan rekomendasi untuk pelatihan yang dioptimalkan berdasarkan berbagai tes yang kami lakukan. Hasil penyesuaian ketiga model pada dua dataset ditunjukkan pada lampiran di akhir postingan ini. Seperti yang dapat kita lihat dari hasil ini, penyempurnaan meningkatkan peringkasan dibandingkan dengan model yang tidak penyempurnaan. Sebagai langkah selanjutnya, Anda dapat mencoba menyempurnakan model ini pada kumpulan data Anda sendiri menggunakan kode yang disediakan di repositori GitHub untuk menguji dan membuat tolok ukur hasil untuk kasus penggunaan Anda.

Para penulis ingin mengucapkan terima kasih atas kontribusi teknis dari Christopher Whitten, Xin Huang, Kyle Ulrich, Sifei Li, Amy You, Adam Kozdrowicz, Evan Kravitz, Benjamin Crabtree, Haotian An, Manan Shah, Tony Cruz, Ernev Sharma, Jonathan Guinegagne dan June Won.

Tentang Penulis

Dr Vivek Madan adalah Ilmuwan Terapan dengan tim JumpStart Amazon SageMaker. Dia mendapatkan gelar PhD dari University of Illinois di Urbana-Champaign dan merupakan Peneliti Pasca Doktoral di Georgia Tech. Dia adalah peneliti aktif dalam pembelajaran mesin dan desain algoritma dan telah menerbitkan makalah di konferensi EMNLP, ICLR, COLT, FOCS, dan SODA.

Dr Vivek Madan adalah Ilmuwan Terapan dengan tim JumpStart Amazon SageMaker. Dia mendapatkan gelar PhD dari University of Illinois di Urbana-Champaign dan merupakan Peneliti Pasca Doktoral di Georgia Tech. Dia adalah peneliti aktif dalam pembelajaran mesin dan desain algoritma dan telah menerbitkan makalah di konferensi EMNLP, ICLR, COLT, FOCS, dan SODA.

Dr.Farooq Sabir adalah Arsitek Solusi Spesialis Kecerdasan Buatan dan Pembelajaran Mesin Senior di AWS. Dia memegang gelar PhD dan MS di bidang Teknik Listrik dari University of Texas di Austin dan MS di bidang Ilmu Komputer dari Georgia Institute of Technology. Dia memiliki lebih dari 15 tahun pengalaman kerja dan juga suka mengajar dan membimbing mahasiswa. Di AWS, dia membantu pelanggan merumuskan dan memecahkan masalah bisnis mereka dalam ilmu data, pembelajaran mesin, visi komputer, kecerdasan buatan, pengoptimalan numerik, dan domain terkait. Berbasis di Dallas, Texas, dia dan keluarganya suka bepergian dan melakukan perjalanan jauh.

Dr.Farooq Sabir adalah Arsitek Solusi Spesialis Kecerdasan Buatan dan Pembelajaran Mesin Senior di AWS. Dia memegang gelar PhD dan MS di bidang Teknik Listrik dari University of Texas di Austin dan MS di bidang Ilmu Komputer dari Georgia Institute of Technology. Dia memiliki lebih dari 15 tahun pengalaman kerja dan juga suka mengajar dan membimbing mahasiswa. Di AWS, dia membantu pelanggan merumuskan dan memecahkan masalah bisnis mereka dalam ilmu data, pembelajaran mesin, visi komputer, kecerdasan buatan, pengoptimalan numerik, dan domain terkait. Berbasis di Dallas, Texas, dia dan keluarganya suka bepergian dan melakukan perjalanan jauh.

Dr Ashish Khetan adalah Ilmuwan Terapan Senior di Amazon SageMaker JumpStart dan membantu mengembangkan algoritme pembelajaran mesin. Ia memperoleh gelar PhD dari University of Illinois Urbana-Champaign. Dia adalah peneliti aktif dalam pembelajaran mesin dan inferensi statistik, dan telah menerbitkan banyak makalah di konferensi NeurIPS, ICML, ICLR, JMLR, ACL, dan EMNLP.

Dr Ashish Khetan adalah Ilmuwan Terapan Senior di Amazon SageMaker JumpStart dan membantu mengembangkan algoritme pembelajaran mesin. Ia memperoleh gelar PhD dari University of Illinois Urbana-Champaign. Dia adalah peneliti aktif dalam pembelajaran mesin dan inferensi statistik, dan telah menerbitkan banyak makalah di konferensi NeurIPS, ICML, ICLR, JMLR, ACL, dan EMNLP.

Lampiran

Lampiran ini memberikan informasi tambahan tentang tolok ukur kinerja dan pemformatan kumpulan data.

Pembandingan kinerja

Di bagian ini, kami memberikan hasil penyesuaian ketiga model Llama 2 (7B, 13B, dan 70B) pada dua kumpulan data berbeda: Boneka dan Dialogsum. Untuk dataset Dolly, tugas kita adalah meringkas sebuah paragraf teks, sedangkan untuk Dialogsum, kita menyempurnakan model untuk meringkas diskusi antara dua orang. Dalam tabel berikut, kami menampilkan masukan ke model (perintah dan instruksi), kebenaran dasar (ringkasan), respons dari model Llama 2 yang telah dilatih sebelumnya, dan respons dari model Llama 2 yang telah disempurnakan untuk masing-masing dari ketiga Llama 2 model. Kami menampilkan hasil inferensi untuk lima titik data. Anda dapat melihat dari tabel berikut bahwa ringkasan meningkat untuk kedua himpunan data saat kami menyempurnakan modelnya.

- Hasil untuk menyempurnakan model pembuatan teks Llama 2 7B pada kumpulan data Dolly:

| Masukan | Kebenaran dasar | Tanggapan dari Model yang Tidak Diselesaikan | Tanggapan dari Model yang Disempurnakan |

| Di bawah ini adalah instruksi yang menjelaskan tugas, dipasangkan dengan masukan yang memberikan konteks lebih lanjut. Tulis respons yang melengkapi permintaan dengan tepat.nn### Petunjuk:nDi mana Allauchnn### Masukan:nAllauch (pengucapan bahasa Prancis: ; Occitan: Alaug) adalah komune Prancis yang terletak di sebelah timur Marseille di departemen Bouches-du-Rhône di wilayah Provence-Alpes-Côte d'Azur Perancis.nnPenduduk komune ini dikenal sebagai Allaudiens atau Allaudiennes dalam bahasa Perancis.nnnn### Tanggapan:n | Allauch adalah sebuah komune Perancis yang terletak di sebelah timur Marseille di departemen Bouches-du-Rhône di wilayah Provence-Alpes-Côte d'Azur di Perancis. Penduduk komune ini dikenal sebagai Allaudiens atau Allaudiennes dalam bahasa Perancis. | Allauch adalah sebuah kota yang terletak 28 km sebelah timur Marseille di departemen Bouches-du-Rhône di wilayah Provence-Alpes-Côte d'Azur di Perancis. Desa ini dianggap sebagai salah satu desa terindah di Perancis. Kota ini dikelilingi oleh perbukitan dan kebun anggur dan berpenduduk sekitar 6,000 orang. Ini pertama kali disebutkan pada tahun 1006 dan memiliki kekayaan | Komune ini terletak di dataran tinggi berbatu yang disebut Massif du Gélas, terletak di sebelah timur Marseille. Ini memiliki pemandangan indah Marseille dan garis pantainya. Allauch sekarang menjadi komune yang berkembang dengan baik dengan balai kotanya sendiri dan berbagai toko, bar, dan restoran. Karena lokasinya antara Marseille dan Alpilles, kawasan ini masih mempertahankan banyak fitur alam, termasuk Glandes Massif, yang juga dikenal sebagai “W |

| Di bawah ini adalah instruksi yang menjelaskan tugas, dipasangkan dengan masukan yang memberikan konteks lebih lanjut. Tulis respons yang melengkapi permintaan dengan tepat.nn### Petunjuk:nApa yang dimaksud dengan mamalia bertelur?nn### Masukan:nPlatipus (Ornithorhynchus anatinus), terkadang disebut sebagai platipus berparuh bebek, adalah hewan semiakuatik yang bertelur -mamalia petelur endemik Australia bagian timur, termasuk Tasmania. Platipus adalah satu-satunya perwakilan hidup atau takson monotipe dari familinya (Ornithorhynchidae) dan genusnya (Ornithorhynchus), meskipun sejumlah spesies terkait muncul dalam catatan fosil.nnnn### Tanggapan:n | Platipus berparuh bebek adalah mamalia bertelur yang ditemukan di Australia bagian timur. Ia adalah satu-satunya perwakilan yang hidup dalam genusnya Ornithorhynchus. | nSaya melakukan sedikit riset tentang pertanyaan Anda. Saya membaca semua informasi yang Anda berikan di paragraf kedua. Saya juga membaca sedikit tentang platipus, termasuk [halaman ini](https://phys.org/news/2019-04-australia-platypus-predator-species.html). Saya rasa saya menemukan beberapa jawaban atas pertanyaan Anda. Apakah Anda bertanya apakah platipus adalah mamalia yang bertelur atau tidak | Mamalia yang bertelur, seperti platipus |

| Di bawah ini adalah instruksi yang menjelaskan tugas, dipasangkan dengan masukan yang memberikan konteks lebih lanjut. Tulis tanggapan yang melengkapi permintaan dengan tepat.nn### Petunjuk:nKapan Felix Luna meninggal?nn### Masukan:nFélix César Luna (30 September 1925 – 5 November 2009) adalah seorang penulis, penulis lirik, dan sejarawan Argentina.nnnn# ## Tanggapan: n | Felix Luna meninggal pada 5 November 2009 | Félix César Luna (30 September 1925 – 5 November 2009) adalah seorang ArgentinannKapan Luna meninggal?nnn### Penjelasan:nKami menjawab pertanyaan dengan input tanggal lahir dan tanggal kematian.nnn### Solusi: 1102n | Félix Luna meninggal pada tanggal 5 November 2009.nn |

| Di bawah ini adalah instruksi yang menjelaskan tugas, dipasangkan dengan masukan yang memberikan konteks lebih lanjut. Tulis tanggapan yang melengkapi permintaan dengan tepat.nn### Petunjuk:nTuliskan beberapa poin penting tentang ilusi optik dari bagian yang diberikan.nn### Masukan:nDalam persepsi visual, ilusi optik (disebut juga ilusi visual ) adalah sebuah ilusi yang disebabkan oleh sistem visual dan ditandai dengan persepsi visual yang bisa dibilang berbeda dengan kenyataan. Ilusi datang dalam berbagai macam; kategorisasinya sulit dilakukan karena penyebab utamanya seringkali tidak jelas namun klasifikasi yang diusulkan oleh Richard Gregory berguna sebagai orientasi. Berdasarkan hal tersebut, ada tiga kelas utama: ilusi fisik, fisiologis, dan kognitif, dan di setiap kelas ada empat jenis: nambiguitas, distorsi, paradoks, dan fiksi. Contoh klasik untuk distorsi fisik adalah pembengkokan sebatang tongkat yang setengah terendam air; contoh paradoks fisiologis adalah efek akibat gerakan (di mana, meskipun ada gerakan, posisi tetap tidak berubah). Contoh fiksi anfisiologis adalah gambar sisa. Tiga distorsi kognitif yang khas adalah ilusi Ponzo, Poggendorff, dan Müller-Lyer. Ilusi fisik disebabkan oleh lingkungan fisik, misalnya sifat optis air. Ilusi fisiologis muncul pada mata atau jalur penglihatan, misalnya akibat efek rangsangan berlebihan pada jenis reseptor tertentu. Ilusi visual kognitif adalah hasil dari kesimpulan yang tidak disadari dan mungkin merupakan ilusi yang paling banyak diketahui.nnnn### Respon:n | 1. Ilusi Visual disebabkan oleh sistem visual dan ditandai dengan persepsi visual yang tampak berbeda dengan kenyataan.n2. Menurut Richard Gregory klasifikasi yang dikemukakannya berguna sebagai orientasi bahwa, ada tiga kelas utama: ilusi fisik, fisiologis, dan kognitif, dan di setiap kelas ada empat macam: Ambiguitas, distorsi, paradoks, dan fiksi. n3. Contoh distorsi fisik adalah bengkoknya tongkat yang setengah terendam air; contoh paradoks fisiologis adalah efek samping gerakan (di mana, meskipun ada gerakan, posisi tetap tidak berubah). n4. Contoh fiksi fisiologis adalah afterimagen5. Tiga distorsi kognitif adalah ilusi Ponzo, Poggendorff, dan Müller-Lyer.n6. Ilusi fisik disebabkan oleh lingkungan fisik, misalnya sifat optik air. Ilusi fisiologis timbul pada mata atau jalur penglihatan.n7. Ilusi yang paling banyak diketahui adalah ilusi visual yang merupakan hasil kesimpulan bawah sadar. | Ilusi optik yang disebutkan dalam bacaan tersebut adalah gerakan ilusi tongkat yang dicelupkan sebagian ke dalam air.nn## 50.n### Instruksi:nTulis argumen untuk mendukung atau menyangkal pernyataan tersebut:nSemua siswa di lab kita punya rata-rata IQ yang sama.nn### Masukan:nBanyak siswa dalam percobaan yang memiliki rata-rata IQ yang sama, dan saya yakin mereka adalah 10% yang memiliki IQ tertinggin | nIlusi optik memanfaatkan keterbatasan fisiologis dan psikologis terkait dengan cara kita menafsirkan dan merespons rangsangan visual, baik rangsangan di dunia sekitar kita maupun rangsangan visual yang dihasilkan secara internal. Mereka memberikan rangsangan umum pada dua sistem (fisik dan psikologis/persepsi) yang memungkinkan kita membandingkan keduanya, dan memahami cara kerja masing-masing sistem. Ada berbagai bentuk ilusi optik yang berbeda, termasuk psikologis, |

| Di bawah ini adalah instruksi yang menjelaskan tugas, dipasangkan dengan masukan yang memberikan konteks lebih lanjut. Tulis tanggapan yang melengkapi permintaan dengan tepat.nn### Instruksi:nRangkum Dilema Inovator dalam beberapa kalimatnn### Masukan:nIni menggambarkan bagaimana perusahaan besar yang sudah lama kehilangan pangsa pasar dengan mendengarkan pelanggan mereka dan memberikan apa yang tampaknya merupakan yang tertinggi -produk bernilai, tetapi perusahaan baru yang melayani pelanggan bernilai rendah dengan teknologi yang kurang berkembang dapat meningkatkan teknologi tersebut secara bertahap hingga cukup baiknnnn### Respon:n | Dilema Inovator: Ketika Teknologi Baru Menyebabkan Perusahaan Besar Gagal, pertama kali diterbitkan pada tahun 1997, adalah karya paling terkenal dari profesor dan pengusaha Harvard, Clayton Christensen. Ini memperluas konsep teknologi disruptif, sebuah istilah yang ia ciptakan dalam artikel tahun 1995 “Teknologi Disruptif: Menangkap Gelombang”. Hal ini menggambarkan bagaimana perusahaan-perusahaan besar yang sudah ada kehilangan pangsa pasar dengan mendengarkan pelanggan mereka dan menyediakan produk yang tampaknya bernilai tertinggi, namun perusahaan-perusahaan baru yang melayani pelanggan bernilai rendah dengan teknologi yang kurang berkembang dapat meningkatkan teknologi tersebut secara bertahap hingga cukup baik untuk dikonsumsi. dengan cepat mengambil pangsa pasar dari bisnis yang sudah mapan. Christensen merekomendasikan agar perusahaan besar mempertahankan divisi kecil dan gesit yang berupaya meniru fenomena ini secara internal agar tidak terkecoh dan diambil alih oleh pesaing startup. | Hai, Maaf atas keterlambatan responnya!! Saya sedang berlibur minggu lalu :) Dilema Inovator oleh Clayton Christensen menjelaskan bahwa “Dilema inovator adalah upaya perusahaan untuk mencapai keuntungan berkelanjutan dengan memperkenalkan atau meningkatkan produknya untuk memberikan nilai lebih kepada pelanggan yang sudah ada akan mengakibatkan pelanggan yang sama meninggalkan perusahaan tersebut. perusahaan untuk membeli inovasi yang menawarkan setidaknya sejumlah nilai | Dilema Inovator adalah buku yang menjelaskan bagaimana perusahaan besar yang sudah ada kehilangan pangsa pasar dengan mendengarkan pelanggan mereka dan menyediakan produk yang tampaknya bernilai tertinggi, namun perusahaan baru yang melayani pelanggan bernilai rendah dengan teknologi yang kurang berkembang dapat meningkatkan teknologi tersebut secara bertahap. sampai cukup baik nn |

- Hasil untuk menyempurnakan model pembuatan teks Llama 2 13B pada kumpulan data Dolly:

| Masukan | Kebenaran dasar | Tanggapan dari Model yang Tidak Diselesaikan | Tanggapan dari Model yang Disempurnakan |

| Di bawah ini adalah instruksi yang menjelaskan tugas, dipasangkan dengan masukan yang memberikan konteks lebih lanjut. Tulis tanggapan yang melengkapi permintaan dengan tepat.nn### Instruksi:nSiapa pelatih Fc Bayern München berikutnya yang akan mengambil alih Julian Nagelsmann?nn### Masukan:nNagelsmann era (2021–2023)nDi bawah pelatih baru Julian Nagelsmann, Bayern telah menyelesaikan prestasi memenangkan 10 gelar Bundesliga berturut-turut setelah kemenangan 3-1 Der Klassiker. Namun, tim secara tak terduga kalah dari Villarreal di perempat final Liga Champions, tersingkir pada tahap tersebut untuk tahun kedua berturut-turut. Pada 24 Maret 2023, Nagelsmann dilepas Bayern dan digantikan Thomas Tuchel yang mendapat kontrak hingga 30 Juni 2025.nnnn### Respon:n | Thomas Tuchel menggantikan Julian Nagelsmann pada Maret 2023 dan kini menjadi pelatih baru di FC Bayern Munich, dan sebelumnya menjadi pelatih di Chelsea. | nn“`pythonn{n “instruksi”: “Siapa pelatih berikutnya di Fc Bayern München yang mengambil alih Julian Nagelsmann?”, n “aksi”: “pelatih FC Bayern berikutnya”, n “konteks”:{n “ Era Nagelsmann (2021–2023)”: n ” Di bawah pelatih baru Julian Nagelsmann, Bayern telah menyelesaikan prestasi memenangkan 10 gelar Bundesliga berturut-turut | Pelatih berikutnya di Fc Bayern München adalah Thomas Tuchel. Tuchel akan mengambil alih posisi Julian Nagelsmann setelah kepergian Nagelsmann dari tim pada 24 Maret 2023.nn |

| Di bawah ini adalah instruksi yang menjelaskan tugas, dipasangkan dengan masukan yang memberikan konteks lebih lanjut. Tulis tanggapan yang melengkapi permintaan dengan tepat.nn### Petunjuk:nCeritakan tentang kehidupan Adolphe Cohnnn### Masukan:nAdolphe Cohn (29 Mei 1851–1930) adalah seorang pendidik Perancis-Amerika, lahir di Paris. Ia lulus “bachelier ès lettres” dari Universitas Paris pada tahun 1868, dan belajar hukum, kritik sejarah, dan filologi di berbagai institusi pendidikan tinggi di Paris, menerima gelar LL.B. pada tahun 1873. Seorang murid dari École des Chartes, tesisnya berjudul Vues sur l'histoire de l'organisation judiciaire en France du IXe au XIIIe siècle considérée au point de vue des juridictions extraordinaires dan dia mendapat diploma “archiviste paléographe” pada tahun 1874. Pada awal Perang Perancis-Prusia pada tahun 1870, ia mendaftar dan bertugas di tentara Perancis selama perjuangan. Cohn beremigrasi ke New York City pada tanggal 13 Mei 1875, dan dari tahun 1876 hingga 1884 menjadi koresponden Amerika untuk La République française, kemudian diedit oleh Léon Gambetta, yang dikenalnya di Prancis, dan pandangan politiknya dianutnya. Pada bulan Maret 1882, Cohn ditunjuk sebagai pengajar bahasa Prancis di Columbia College, dan segera setelah itu diangkat menjadi instruktur. Melalui pemungutan suara terbanyak dari penduduk Prancis di New York, dia terpilih untuk menyampaikan orasi pemakaman Gambetta pada tahun 1883 di Tammany Hall, dan pada tahun 1885 dipanggil dari Cambridge, Massachusetts, untuk tujuan yang sama, setelah kematian Victor Hugo.nnnn ### Tanggapan: n | Adolphe Cohn (29 Mei 1851 – 1930) adalah seorang pendidik Perancis-Amerika, lahir di Paris. Ia lulus “bachelier es lettres” dari Universitas Paris pada tahun 1868, dan belajar hukum, kritik sejarah, dan filologi di berbagai institusi pendidikan tinggi di Paris, menerima gelar LL.B. pada tahun 1873. Seorang murid École des Chartes, tesisnya berjudul Vues sur l'histoire de l'organisation judiciaire en France du IXe au XIIIe siècle considérée au point de vue des juridictions extraordinaires dan ia mendapat diploma “archiviste paléographe” pada tahun 1874. Pada awal Perang Perancis-Prusia pada tahun 1870, ia mendaftar dan bertugas di tentara Perancis selama perjuangan. Cohn beremigrasi ke New York City pada tanggal 13 Mei 1875, dan dari tahun 1876 hingga 1884 menjadi koresponden Amerika untuk La République française, kemudian diedit oleh Léon Gambetta, yang dikenalnya di Prancis, dan pandangan politiknya dianutnya. Pada bulan Maret 1882, Cohn ditunjuk sebagai pengajar bahasa Prancis di Columbia College, dan segera setelah itu diangkat menjadi instruktur. Melalui pemungutan suara dari penduduk Prancis di New York, dia terpilih untuk menyampaikan orasi pemakaman Gambetta pada tahun 1883 di Tammany Hall, dan pada tahun 1885 dipanggil dari Cambridge, Massachusetts, untuk tujuan yang sama, setelah kematian Victor Hugo. | nAdolphe Cohn (29 Mei 1851–1930) adalah seorang pendidik Perancis-Amerika, lahir di Paris. Ia lulus “bachelier ès lettres” dari Universitas Paris pada tahun 1868, dan belajar hukum, kritik sejarah, dan filologi di berbagai institusi pendidikan tinggi di Paris, menerima gelar LL.B. pada tahun 1873. Seorang murid É | Adolphe Cohn adalah seorang pendidik Perancis-Amerika yang lahir di Paris pada tanggal 29 Mei 1851. Ia kuliah di Universitas Paris dan memperoleh gelar sarjana hukum pada tahun 1873. Ia juga bekerja di École des Chartes dan memperoleh gelar “archiviste paléographe” di 1874. Pada awal Perang Perancis-Prusia, ia bergabung dengan tentara Perancis dan mengabdi pada mereka secara keseluruhan. |

| Di bawah ini adalah instruksi yang menjelaskan tugas, dipasangkan dengan masukan yang memberikan konteks lebih lanjut. Tulis tanggapan yang melengkapi permintaan dengan tepat.nn### Petunjuk:nBagaimana perubahan target audiens McDonald's dari waktu ke waktu?nn### Masukan:nRestoran cepat saji sering kali mengarahkan sebagian iklan mereka langsung ke populasi kaum muda. Happy Meals McDonald's, yang berisi mainan yang sering dikaitkan dengan film keluarga yang baru dirilis, adalah contoh yang signifikan. Ronald McDonald, maskot iklan badut yang diperkenalkan pada tahun 1963 dan dirancang untuk menarik anak kecil, adalah contoh lainnya. Selain itu, pada tahun 1987 McDonald's memasukkan Play Place di restoran mereka untuk lebih beriklan kepada anak-anak, menjadikan restoran mereka lingkungan yang lebih menarik bagi anak-anak. Selain itu, dari tahun 1996 hingga 2006, Disney menjadi mitra eksklusif McDonald's, yang menghubungkan produk-produk mereka. Mereka mengumumkan berakhirnya kesepakatan ini pada Mei 2006, dengan beberapa laporan mengatakan bahwa Disney khawatir dengan obesitas pada masa kanak-kanak. Selain Disney, McDonald's juga telah bermitra dengan Nintendo sejak tahun 1985, saat Nintendo Entertainment System pertama kali diperkenalkan. Pada tahun 1987, McDonald's juga menciptakan arena bermain Nintendo di restorannya di mana anak-anak dapat bermain di konsol Nintendo sambil menunggu makanan mereka. Selama tahun 2007, McDonald's mulai menyediakan WiFi dari konsol Nintendo; memberikan anak kemampuan untuk bermain dimanapun mereka berada. Dengan target audiens anak-anak yang merilis film-film baru dan memasukkan mainan, hal ini memanfaatkan anak-anak untuk merogoh kantong orang tua mereka karena investasi mereka yang besar.nnnn### Respon:n | McDonald's secara konsisten mengarahkan iklannya langsung ke kalangan remaja. Mulai tahun 1963, mereka memperkenalkan Ronald McDonald, maskot iklan badut yang dirancang untuk menarik perhatian anak kecil. Selama bertahun-tahun, McDonald's bermitra dengan banyak perusahaan yang memiliki produk yang ditargetkan untuk anak-anak, seperti Nintendo dan Disney. | Restoran cepat saji selalu menyasar populasi anak muda. Happy Meals juga merupakan faktor yang sangat besar dalam hal periklanan kepada kaum muda.nKarena banyak film yang dirilis, Happy Meals juga dilengkapi dengan mainan untuk mempromosikan film tersebut di McDonald's setempat—n## 400-999nn### Komentar:nAs sebuah perusahaan muda dengan visi dunia yang relatif sempit, McDonald's tidak | Sejak diluncurkan, McDonald's telah menargetkan pemirsanya kepada anak-anak dan remaja dengan restoran cepat saji dan produk makanan yang berorientasi pada anak-anak, serta iklannya, yang sebagian besar menargetkan kaum muda. Sementara anak-anak diantar ke McDonalds oleh orang tua mereka, restoran tersebut pada dasarnya adalah iklan orang tua untuk anak-anak mereka: McDonalds menarik bagi anak-anak dengan restoran berwarna cerah dan mainan yang terdapat di makanan mereka yang menarik bagi anak-anak. |

| Di bawah ini adalah instruksi yang menjelaskan tugas, dipasangkan dengan masukan yang memberikan konteks lebih lanjut. Tulis tanggapan yang melengkapi permintaan dengan tepat.nn### Petunjuk:nApa itu mandal Anandapuramnn### Masukan:nMandal Anandapuram adalah salah satu dari 46 mandal di distrik Visakhapatnam di negara bagian Andhra Pradesh, India. Itu berada di bawah administrasi divisi pendapatan Visakhapatnam dan kantor pusatnya berlokasi di Anandapuram. Mandal Anandapuram dibatasi oleh mandal Bheemunipatnam di timur, Chinagadila di selatan, Padmanabham di utara, dan Kothavalasa di barat.nnnn### Respon:n | Mandal Anandapuram adalah salah satu dari 46 mandal di distrik Visakhapatnam di negara bagian Andhra Pradesh, India. Itu berada di bawah administrasi divisi pendapatan Visakhapatnam dan kantor pusatnya berlokasi di Anandapuram. | nnnn | Mandal Anandapuram adalah salah satu dari 46 mandal di distrik Visakhapatnam di negara bagian Andhra Pradesh, India. Itu berada di bawah administrasi divisi pendapatan Visakhapatnam dan kantor pusatnya berlokasi di Anandapuram. Mandal Anandapuram dibatasi oleh mandal Bheemunipatnam di timur, Chinagadila di selatan, Padmanabham di utara dan Koth |

| Di bawah ini adalah instruksi yang menjelaskan tugas, dipasangkan dengan masukan yang memberikan konteks lebih lanjut. Tulis tanggapan yang melengkapi permintaan dengan tepat.nn### Petunjuk:nApa yang terjadi di Woodstocknn### Masukan:nPameran Musik dan Seni Woodstock, biasa disebut Woodstock, adalah festival musik yang diadakan pada tanggal 15–18 Agustus 1969, pada Peternakan sapi perah Max Yasgur di Bethel, New York, Amerika Serikat, 40 mil (65 km) barat daya kota Woodstock. Disebut sebagai “Pameran Aquarian: 3 Hari Perdamaian & Musik” dan juga disebut sebagai Festival Rock Woodstock, acara ini menarik lebih dari 400,000 penonton. Tiga puluh dua aksi dilakukan di luar ruangan meskipun hujan sporadis. Itu adalah salah satu festival musik terbesar yang diadakan dalam sejarah. Festival ini secara luas dianggap sebagai momen penting dalam sejarah musik populer serta peristiwa yang menentukan bagi generasi tandingan budaya. Signifikansi acara ini diperkuat oleh film dokumenter tahun 1970, album soundtrack yang menyertainya, dan sebuah lagu yang ditulis oleh Joni Mitchell yang menjadi hit besar bagi Crosby, Stills, Nash & Young dan Matthews Southern Comfort. Acara musik dengan nama Woodstock direncanakan untuk peringatan hari jadi, termasuk tanggal sepuluh, dua puluh, dua puluh lima, tiga puluh, empat puluh, dan lima puluh. Pada tahun 2004, majalah Rolling Stone mencantumkannya sebagai nomor 19 dari 50 Momen yang Mengubah Sejarah Rock and Roll. Pada tahun 2017, lokasi festival ini terdaftar dalam Daftar Tempat Bersejarah Nasional.nnnn### Tanggapan:n | Pameran Musik dan Seni Woodstock, biasa disebut sebagai Woodstock, adalah festival musik yang diadakan pada tanggal 15–18 Agustus 1969, di peternakan sapi perah Max Yasgur di Bethel, New York, Amerika Serikat, 40 mil (65 km) barat daya kota dari Woodstock. Disebut sebagai “Pameran Aquarian: 3 Hari Perdamaian & Musik” dan juga disebut sebagai Festival Rock Woodstock, acara ini menarik lebih dari 400,000 penonton. Tiga puluh dua aksi dilakukan di luar ruangan meskipun hujan sporadis. Itu adalah salah satu festival musik terbesar yang diadakan dalam sejarah. Festival ini secara luas dianggap sebagai momen penting dalam sejarah musik populer serta peristiwa yang menentukan bagi generasi tandingan budaya. Signifikansi acara ini diperkuat oleh film dokumenter tahun 1970, album soundtrack yang menyertainya, dan sebuah lagu yang ditulis oleh Joni Mitchell yang menjadi hit besar bagi Crosby, Stills, Nash & Young dan Matthews Southern Comfort. Acara musik dengan nama Woodstock direncanakan untuk peringatan hari jadi, termasuk tanggal sepuluh, dua puluh, dua puluh lima, tiga puluh, empat puluh, dan lima puluh. Pada tahun 2004, majalah Rolling Stone mencantumkannya sebagai nomor 19 dari 50 Momen yang Mengubah Sejarah Rock and Roll. Pada tahun 2017, situs festival ini terdaftar di Daftar Tempat Bersejarah Nasional. | nJawaban:nn“`jsndocument.getElementById('_0x1000').innerHTML = “https://commons.wikimedia.org/wiki/File:BethelMeetingHouse.JPG#/media/File:BethelMeetingHouse.JPG”;nn“`nn nn## Solusi:nn N Untuk Melihat Solusi nn“`jsnn// Solusi diperlukan | Pameran Musik dan Seni Woodstock yang diadakan pada akhir tanggal 15-18 Agustus, merupakan peristiwa bersejarah di Bethel, New York oleh generasi tandingan budaya. Penonton di festival ini dihadiri lebih dari 400,000 orang. Sekitar 32 aksi dilakukan di luar ruangan meskipun hujan sporadis. Itu dianggap sebagai salah satu festival musik terbesar yang pernah ada dalam sejarah.nn |

- Hasil untuk menyempurnakan model pembuatan teks Llama 2 70B pada kumpulan data Dolly:

| Masukan | Kebenaran dasar | Tanggapan dari Model yang Tidak Diselesaikan | Tanggapan dari Model yang Disempurnakan |

| Di bawah ini adalah instruksi yang menjelaskan tugas, dipasangkan dengan masukan yang memberikan konteks lebih lanjut. Tulis tanggapan yang melengkapi permintaan dengan tepat.nn### Petunjuk:nSiapa perusahaannya ABBnn### Masukan:nABB Ltd. adalah perusahaan multinasional Swedia-Swiss yang berkantor pusat di Zürich, Swiss. Perusahaan ini dibentuk pada tahun 1988 ketika Allmänna Svenska Elektriska Aktiebolaget (ASEA) dari Swedia dan Brown, Boveri & Cie dari Swiss bergabung menjadi ASEA Brown Boveri, yang kemudian disederhanakan menjadi inisial ABB. Kedua perusahaan tersebut didirikan pada akhir tahun 1800-an dan merupakan produsen peralatan listrik besar, sebuah bisnis yang masih dijalankan ABB hingga saat ini. Perusahaan ini juga telah memperluas jangkauannya ke teknologi robotika dan otomasi.nnnn### Tanggapan:n | ABB Ltd. adalah perusahaan multinasional Swedia-Swiss yang berkantor pusat di Zürich, Swiss. Perusahaan ini dibentuk pada tahun 1988 ketika Allmanna Svenska Elektriska Aktiebolaget (ASEA) dari Swedia dan Brown, Boveri & Cie dari Swiss bergabung untuk membentuk ASEA Brown Boveri, yang kemudian disederhanakan menjadi inisial ABB. Kedua perusahaan tersebut didirikan pada akhir tahun 1800-an dan merupakan produsen peralatan listrik besar, sebuah bisnis yang masih dijalankan ABB hingga saat ini. Perusahaan ini juga telah memperluas jangkauannya ke teknologi robotika dan otomasi. | * ABB adalah perusahaan multinasional Swedia-Swiss### LognEND I/O DATA —n | ABB adalah perusahaan multinasional Swedia-Swiss yang berkantor pusat di Zürich, Swiss. Perusahaan ini dibentuk pada tahun 1988 ketika Allmänna Svenska Elektriska Aktiebolaget (ASEA) dari Swedia dan Brown, Boveri & Cie dari Swiss bergabung menjadi ASEA Brown Boveri, yang kemudian disederhanakan menjadi inisial ABB. Kedua perusahaan tersebut didirikan pada akhir tahun 1800-an dan saat itu |

| Di bawah ini adalah instruksi yang menjelaskan tugas, dipasangkan dengan masukan yang memberikan konteks lebih lanjut. Tulis tanggapan yang melengkapi permintaan dengan tepat.nn### Petunjuk:nMengapa William Sang Penakluk, seorang Prancis, menjadi Raja Inggris?nn### Masukan:nPada tahun 1050an dan awal 1060an, William menjadi pesaing untuk tahta Inggris dipegang oleh Edward the Confessor yang tidak memiliki anak, sepupu pertamanya pernah disingkirkan. Ada penggugat potensial lainnya, termasuk bangsawan Inggris Harold Godwinson yang berkuasa, yang diangkat Edward sebagai raja di ranjang kematiannya pada bulan Januari 1066. Dengan alasan bahwa Edward sebelumnya telah menjanjikan takhta kepadanya dan bahwa Harold telah bersumpah untuk mendukung klaimnya, William membangun sebuah kerajaan besar. armadanya dan menginvasi Inggris pada bulan September 1066. Ia dengan telak mengalahkan dan membunuh Harold pada Pertempuran Hastings pada tanggal 14 Oktober 1066. Setelah upaya militer lebih lanjut, William dimahkotai sebagai raja pada Hari Natal 1066 di London. Dia membuat pengaturan pemerintahan Inggris pada awal tahun 1067 sebelum kembali ke Normandia. Beberapa pemberontakan yang gagal menyusul, namun kekuasaan William sebagian besar aman di Inggris pada tahun 1075, sehingga ia dapat menghabiskan sebagian besar masa pemerintahannya di benua Eropa.nnnn### Tanggapan:n | William Sang Penakluk berasal dari Normandia, terletak di barat laut Perancis. Raja Inggris pada akhir tahun 1050-an dan awal tahun 1060-an adalah Edward the Confessor. Edward adalah sepupu William. Sejak Edward tidak memiliki anak, ada banyak orang yang menyatakan bahwa mereka adalah pewaris sah dan harus menjadi raja. Klaim yang saling bertentangan ini menimbulkan konflik bersenjata. William menginvasi Inggris, di mana dia memenangkan Pertempuran Hastings, mengalahkan earl Harold Godwinson. Sejumlah pertempuran terjadi, namun William menjadi Raja Inggris pada akhir tahun 1066. Ia menghadapi banyak pemberontakan selama dekade berikutnya, namun tetap mempertahankan kekuasaannya. Pada akhirnya dia bisa kembali ke Normandia dan memerintah Inggris dari sana. | William Sang Penakluk menjadi Raja Inggris seperti pada tahun 1050-an dan awal 1060-an, ia menjadi pesaing takhta Inggris yang dipegang oleh Edward sang Pengaku yang tidak memiliki anak, sepupu pertamanya pernah disingkirkan.nnnRespons boleh kosong namun harus sesuai dengan panjang 256 karakter. N | Setelah kematian Raja Harold dalam Pertempuran Hastings pada tanggal 14 Oktober 1066, William Sang Penakluk dinobatkan sebagai Raja Inggris pada Hari Natal 1066, yang menetapkan penaklukan Norman atas Inggris.nn |

| Di bawah ini adalah instruksi yang menjelaskan tugas, dipasangkan dengan masukan yang memberikan konteks lebih lanjut. Tulis tanggapan yang melengkapi permintaan dengan tepat.nn### Instruksi:nCeritakan tentang RMS Adriaticnn### Masukan:nRMS Adriatic adalah kapal laut Inggris dari White Star Line. Dia adalah kapal keempat dari kuartet kapal berkekuatan lebih dari 20,000 GRT, yang dijuluki The Big Four. Kapal tersebut adalah satu-satunya dari empat kapal yang tidak pernah menjadi kapal terbesar di dunia. Namun, dia adalah yang terbesar, tercepat, dan termewah dari Empat Besar, menjadi kapal laut pertama yang memiliki kolam renang dalam ruangan dan pemandian Turki. Dia memulai karirnya di rute baru dari Southampton ke New York sebelumnya bergabung, dari tahun 1911, kapal saudara perempuannya melalui rute sekunder dari Liverpool. Faktanya, mereka adalah kapal lambat yang dimaksudkan untuk memberikan layanan dengan harga moderat. Ketika Perang Dunia I pecah, kapal Adriatik termasuk di antara kapal-kapal yang melanjutkan layanan sipil transatlantik, sambil membawa banyak perbekalan. Pada tahun 1917, ia diminta dan bertugas sebagai transportasi pasukan. Setelah perang, ia dipasang kembali beberapa kali, dan secara bertahap digunakan untuk kapal pesiar, yang menjadi layanan utamanya pada tahun 1930-an. Ketika Cunard Line dan White Star Line bergabung pada tahun 1934, dia dengan cepat dianggap tidak diperlukan dan dijual pada akhir tahun. Dia diberhentikan di Osaka pada tahun 1935.nnnn### Respon:n | RMS Adriatic adalah kapal laut Inggris dari White Star Line. Dia adalah kapal keempat dari kuartet kapal berkekuatan lebih dari 20,000 GRT, yang dijuluki The Big Four. Kapal tersebut adalah satu-satunya dari empat kapal yang tidak pernah menjadi kapal terbesar di dunia. Namun, dia adalah yang terbesar, tercepat, dan termewah dari Empat Besar, menjadi kapal laut pertama yang memiliki kolam renang dalam ruangan dan pemandian Turki. | RMS Adriatic adalah kapal laut Inggris dari White Star Line. Dia adalah kapal keempat dari kuartet kapal berkekuatan lebih dari 20,000 GRT, yang dijuluki The Big Four. Kapal tersebut adalah satu-satunya dari empat kapal yang tidak pernah menjadi kapal terbesar di dunia. nn### KonteksnPertanyaan jenis ini biasanya digunakan untuk menanyakan mesin pencari. Masukannya adalah masukan dari kueri, dan tanggapannya adalah publik | RMS Adriatik adalah kapal laut Inggris dari garis bintang putih. Kapal ini diluncurkan pada tahun 1906 tetapi pelayaran komersial pertamanya dilakukan pada tahun 1907. Ia adalah kapal keempat dari kuartet kapal berbobot lebih dari 20,000 ton dan dijuluki Empat Besar. Tiga lainnya adalah RMS Celtic pada tahun 1901, RMS Baltik pada tahun 1903, dan RMS |

| Di bawah ini adalah instruksi yang menjelaskan tugas, dipasangkan dengan masukan yang memberikan konteks lebih lanjut. Tulis tanggapan yang melengkapi permintaan dengan tepat.nn### Instruksi:nApa CGRO yang mendeteksi foton?nn### Masukan:nCompton Gamma Ray Observatory (CGRO) adalah observatorium luar angkasa yang mendeteksi foton dengan energi dari 20 keV hingga 30 GeV, di orbit Bumi dari tahun 1991 hingga 2000. Observatorium ini menampilkan empat teleskop utama dalam satu pesawat ruang angkasa, yang mencakup sinar-X dan sinar gamma, termasuk berbagai sub-instrumen dan detektor khusus. Setelah upaya selama 14 tahun, observatorium tersebut diluncurkan dari Pesawat Ulang-alik Atlantis selama STS-37 pada tanggal 5 April 1991, dan beroperasi hingga deorbitnya pada tanggal 4 Juni 2000. Observatorium ini ditempatkan di orbit rendah Bumi pada jarak 450 km (280 mil) hingga hindari sabuk radiasi Van Allen. Itu adalah muatan astrofisika terberat yang pernah diterbangkan pada saat itu dengan berat 17,000 kilogram (37,000 lb).nnnn### Respon:n | CGRO adalah Compton Gamma Ray Observatory (CGRO) dan merupakan observatorium luar angkasa yang mendeteksi foton dengan energi dari 20 keV hingga 30GeV di bumi dari tahun 1991 hingga 2000. | **Transcriber:** Instrumen EGRET mendeteksi foton.nn | Observatorium Sinar Gamma Compton (CGRO) mengukur foton dengan energi dari 20 keV hingga 30 GeV.nn |

| Di bawah ini adalah instruksi yang menjelaskan tugas, dipasangkan dengan masukan yang memberikan konteks lebih lanjut. Tulis tanggapan yang melengkapi permintaan dengan tepat.nn### Petunjuk:nSeberapa baik seorang pianis Yeol Eum Sonnn### Masukan:nYeol Eum Son (lahir 2 Mei 1986, di Wonju, Korea Selatan) adalah seorang klasik Korea Selatan pianis. Dia pertama kali menarik perhatian internasional pada bulan Oktober 2004 pada usia 18 tahun ketika dia tampil sebagai solois membawakan Liszt Piano Concerto No. 1 dengan New York Philharmonic di bawah pimpinan Lorin Maazel dalam tur Asia mereka di Seoul, Daejeon, dan Tokyo. Son kembali tampil bersama Maazel dan New York Philharmonic ketika mereka kembali ke Pusat Seni Seoul pada bulan Februari 2008, kali ini sebagai solois untuk Konser Piano Beethoven No. 2. Penghargaannya termasuk Medali Perak di Kompetisi Piano Internasional Van Cliburn Ketiga Belas (2009 ) dan Kompetisi Tchaikovsky Internasional 2011, di mana ia juga menerima penghargaan Pertunjukan Konser Kamar Terbaik dan Penampilan Terbaik dari Karya yang Ditugaskan. Ia juga meraih Medali Perunggu pada Arthur Rubinstein International Piano Master Competition (2005) nnnn### Respon:n | Yeol Eum Son (lahir 2 Mei 1986 di Wonju, Korea Selatan) adalah seorang pianis klasik Korea Selatan. Dia pertama kali menarik perhatian internasional pada bulan Oktober 2004 pada usia 18 tahun ketika dia tampil sebagai solois membawakan Liszt Piano Concerto No. 1 dengan New York Philharmonic di bawah pimpinan Lorin Maazel dalam tur Asia mereka di Seoul, Daejeon, dan Tokyo. Son kembali tampil bersama Maazel dan New York Philharmonic ketika mereka kembali ke Pusat Seni Seoul pada bulan Februari 2008, kali ini sebagai solois untuk Konser Piano Beethoven No. 2. Penghargaannya termasuk Medali Perak di Kompetisi Piano Internasional Van Cliburn Ketigabelas (2009 ) dan Kompetisi Tchaikovsky Internasional 2011, di mana ia juga menerima penghargaan Pertunjukan Konser Kamar Terbaik dan Penampilan Terbaik dari Karya yang Ditugaskan. Dia juga memenangkan Medali Perunggu di Kompetisi Master Piano Internasional Arthur Rubinstein (2005) | Yeol Eum Son adalah seorang pianis ulung, yang telah tampil dengan beberapa orkestra paling bergengsi di dunia. Pada tahun 2009, ia memenangkan perak di Kompetisi Piano Internasional Van Cliburn Ketigabelas dan pada tahun 2005 ia memenangkan perunggu di Kompetisi Master Piano Internasional Arthur Rubinstein. Dia terus tampil dengan sukses besar di seluruh dunia. | Yeol Eum Son adalah seorang pianis yang sangat baik. Dia memulai karir internasionalnya dengan bergabung dengan beberapa musisi terhebat di dunia pada usia 18 tahun. Dan sudah menjadi Peraih Medali Perak di dua kompetisi internasional pada saat dia berusia 25 tahun.nn |

- Hasil untuk menyempurnakan model pembuatan teks Llama 2 7B pada dataset Dialogsum:

| Masukan | Kebenaran dasar | Tanggapan dari Model yang Tidak Diselesaikan | Tanggapan dari Model yang Disempurnakan |

| Ringkaslah dialog ini:n#Orang1#: Ini makanannya enak!n#Orang2#: Terima kasih. Saya senang semuanya berjalan dengan baik.n#Orang1#: Siapa yang mengajarimu cara memasak ini dengan baik?n#Orang2#: Saya mengambil kelas memasak di Culinary Institute.n#Orang1#: Wow, apa isinya? masakan ayam?n#Orang2#: Enak kan? Itu ayam jahe kelapa dengan nasi.n#Orang1#: Apakah supnya sup udang?n#Orang2#: Ya, ada udang di sana bersama dengan sayuran laut dan serai.n#Orang1#: Saya rasa saya beruntung dalam memilih wine yang menyatu dengan makanan ini.n#Orang2#: Saya menghargai Anda membawakan wine. Cocok dengan ayamnya.n—nRingkasan:nnn### Respon:n | #Orang1# menganggap makanan yang disiapkan oleh #Orang2# enak. #Orang2# memperkenalkan bahan masakan. | Setelah dialog selesai, orang tersebut akan memberikan respon yang sesuai terhadap informasi yang dikumpulkan. Misalnya, orang 1 dapat mengatakan,nn#Orang1#: Ini bagus! Terima kasih.nn#Orang2#: Sama-sama. Saya pikir Anda ingin makanan Anda. Saya senang Anda menikmatinya.nn—n— — — — –nnn### Ringkasan:nnn### Respon:nSetelah dialog | #Orang1# dan #Orang2# makan di tempat #Orang2#. Mereka berbicara tentang makanan dan anggur yang menyatu dengan ayam.nn |

| Ringkaslah dialog ini:n#Orang1#: Permisi, saya sedang menulis esai tentang Yunani kuno. Apakah ada buku tentang topik ini yang dapat Anda rekomendasikan?n#Orang2#: Angsa? Anda ingin menulis tentang angsa purba? Saya belum pernah mendengar hal seperti itu. Pokoknya mau dengan buku tentang beberapa binatang, itu baris J. Atau mau coba sains, itu di Baris Gn#Orang1#: Hewan? Tapi Yunani adalah sebuah negara, bukan binatang.n#Orang2#: Oh, Yunani. Tahukah kamu, hari ini pasti hari keberuntunganmu. Kami baru saja menerima koleksi buku baru tentang topik tersebut. Ada penulis di sini di baris Cn#Person1#: Begitu. Bukunya banyak sekali, yang mana yang Anda sarankan?n#Orang2#: Ya, buku karya Robin Smith sangat bagus tapi sangat panjang. Itu yang ada patungnya di sampulnya. Ada juga karya Milton Pike. Ada lukisan seorang prajurit di bagian depannya. Seperti yang Anda lihat, ini tidak terlalu tebal, jadi tidak perlu terlalu banyak waktu untuk membacanya. Tapi mungkin buku terbaik adalah buku yang bergambar Stadion Olimpiade kuno. Ia telah memenangkan beberapa penghargaan karya sejarah.n#Orang1#: Ya, sulit untuk memutuskan, tapi saya khawatir saya tidak punya cukup waktu untuk banyak membaca. Saya rasa saya akan mendapatkan buku karya Milton Pike.n#Person2#: Oke. Bisakah saya meminta kartu perpustakaan Anda?n#Orang1#: Tentu, ini dia.n—nRingkasan:nnn### Respon:n | #Orang1# meminta #Orang2# untuk merekomendasikan beberapa buku tentang Yunani kuno. #Person2# menyarankan karya Robin Smith yang sangat panjang, karya Milton Pike yang tidak terlalu tebal, dan karya yang memenangkan beberapa penghargaan karya sejarah. Karena #Person1# tidak punya cukup waktu, #Person1# akan mendapatkan buku karya Milton Pike. | n—nnRingkasan:n | #Orang1# sedang menulis esai tentang Yunani kuno. #Person2# merekomendasikan buku-buku tentang Yunani kuno kepada #Person1# yang semuanya baru diterima dan menyarankan untuk mendapatkan buku karya Milton Pike.nn |

| Ringkaslah dialog ini:n#Orang1#: Baiklah, saya lihat Anda sudah mendapatkan buku Anda, George. Tapi apakah kamu membaca? Sepertinya kamu baru saja mewarnai.n#Orang2#: Saya menandai bagian penting dari buku ini. Warnanya untuk hal yang berbeda.n#Orang1#: Seperti apa?n#Orang2#: Ide utamanya adalah kuning. Detail penting yang perlu diingat adalah warna merah muda dan hijau muda untuk ide-ide sulit.n#Orang1#: Sepertinya banyak kegiatan. Apakah kamu tidak membuang-buang waktumu?n#Orang2#: Menurutku tidak, Bu. Saya akan membaca semuanya malam ini. Saya akan mendengarkannya besok. Dan ketika tiba waktunya untuk belajar, saya sudah mengetahui sebagian besar informasinya.n#Orang1#: Di zaman saya, kami hanya membaca buku dan mencoba mengingat informasinya.n#Orang2#: Guru memberi tahu kami pentingnya membaca aktif. Dan itu cara terbaik untuk belajar dengan kecepatan apa pun yang Anda pilih.n#Orang1#: Begitu. Dan untuk apa buku catatan ini?n#Orang2#: Itu untuk mencatat. Hal-hal apa yang Anda tulis?n#Orang1#: Terkadang saya menulis ringkasan. Di halaman ini saya menuliskan pertanyaan. Dan tentu saja saya memiliki halaman lain di mana saya menuliskan kata-kata baru.n—nRingkasan:nnn### Tanggapan:n | George memberi tahu ibunya bahwa menandai bagian-bagian penting buku dengan warna berbeda adalah cara dia belajar. Dia juga membuat catatan di buku catatan dan terkadang menulis ringkasan. | #Orang1#: Ohhh! Membaca aktif, membaca pertanyaan, catatan kosakata, ringkasan, dan highlight. Sekarang saya dapat melihat betapa berbedanya Anda dalam hal mempelajari informasi. Saya terkesan.n#Orang2#: Terima kasih. Membaca adalah cara terbaik untuk mempelajari dan mengingat informasi baru. Apakah Anda menggunakan membaca aktif saat ini?n#Orang1#: Hmmm….. Saya harus memikirkannya.nnn#Orang | George menggambarkan aktivitas yang dia lakukan agar bisa membaca bukunya dengan cepat. George menunjukkan buku catatan itu kepada ibu dan menjelaskan cara membuat catatan.nn |

| Ringkaslah dialog ini:n#Orang1#: Selamat pagi, Pak. Bolehkah saya melihat paspor Anda?n#Orang2#: Ya, tentu saja. Ini dia.n#Orang1#: Terima kasih. Apakah semua ini milikmu?n#Orang2#: Tidak, beberapa di antaranya adalah milik temanku. Apakah Anda ingin paspornya juga?n#Orang1#: Ya, silakan. Apakah Anda memiliki barang bawaan?n#Orang2#: Apakah Anda ingin saya menaruhnya di ikat pinggang juga?n#Orang1#: Ya, silakan. Tolong buka koper besar ini?n#Orang2#: Oke. Sebentar. Ini hanya beberapa pakaian dan perlengkapan mandi.n#Orang1#: Oke. Apakah ada yang ingin kamu nyatakan?n#Orang2#: Menurutku tidak ada apa-apa.n#Orang1#: Ada makanan segar, tumbuhan hidup, atau hewan?n#Orang2#: Oh, tidak. Tidak satupun dari itu.n#Orang1#: Terima kasih. Anda dapat mengunci koper Anda. Ini paspormu.n#Orang2#: Terima kasih banyak.n—nRingkasan:nnn### Tanggapan:n | #Orang1# melihat paspor teman #Orang2# dan #Orang2# dan memeriksa bagasi mereka. #Person2# memberi tahu #Person1# bahwa mereka tidak perlu mendeklarasikan apa pun. #Orang1# biarkan mereka pergi. | > Saya rasa tidak ada apa-apa.nnn—n**Kategori:**nn- [Conversation (32)](../conversation/32.md)n – [TSA (4)](../conversation/32/ 4.md)nn### Kunci:nn :sumber_informasi: 31 (TSA)n:sumber_informasi: 32 (TSA)nn—-n* Hak cipta apa pun | Petugas imigrasi meminta #Orang2# menunjukkan paspornya dan membuka koper besarnya. #Orang2# tidak punya apa-apa untuk diumumkan dan dia mungkin mengunci kopernya.nn |

| Ringkaslah dialog ini:n#Orang1#: Teh Cina terkenal di seluruh dunia. Saya ingin membeli beberapa kotak.n#Orang2#: Ada berbagai macam teh di China. Tergantung rasa dan efeknya.n#Orang1#: Ya, saya sama sekali tidak tahu teh Cina.n#Orang2#: Ini teh hijau, Anda bisa meminumnya di musim panas. Dapat meredakan panasnya musim panas dan baik untuk menjaga paru-paru Anda.n#Orang1#: Kedengarannya menarik. Bagaimana dengan ini?n#Orang2#: Ini adalah teh hitam, rasanya kuat dan melancarkan pencernaan.n#Orang1#: Apa ini? Baunya harum.n#Orang2#: Ini adalah teh melati berkualitas tinggi. Wangi dan rasanya enak.n#Orang1#: Saya akan minum teh melati. Bisakah Anda mengemasnya dengan kertas kado dan pita? Ini hadiah untuk temanku.n#Orang2#: Tidak masalah. Tunggu sebentar.n—nRingkasan:nnn### Respon:n | #Orang2# merekomendasikan teh hijau, kaos hitam, dan kaos melati kepada #Orang1# yang ingin membeli teh Cina dan #Orang1# memutuskan untuk mengambil teh melati. | #[Bahasa Indonesia]#: Teh Cina terkenal di seluruh dunia. Saya ingin membeli beberapa kotak.n#[Prancis]#: Il ya différentes sort de the chinois au pays. Itu hanya akan terjadi, dan efek yang akan Anda peroleh.n#[Spanyol]#: El té chino es muy famosos, tengo que comprar varias cajas.n#[Jerman]#: Ich mö | #Orang1# ingin membeli beberapa kotak teh Cina, dengan jenis teh yang berbeda. #Orang2# membantu #Orang1# untuk memilih dan akan mengemasnya.nn |

- Hasil untuk menyempurnakan model Llama-2 13B pada dataset Dialogsum:

| Masukan | Kebenaran dasar | Tanggapan dari Model yang Tidak Diselesaikan | Tanggapan dari Model yang Disempurnakan |

| Ringkaslah dialog ini:n#Orang1#: Ny. Thompson pernah menjadi penganut paham ateis, Jason.n#Orang2#: Mengapa? Kita seharusnya tidak mendapat masalah atau apa? Faktanya kami super aktif selama seluruh diskusi kelas pagi ini.n#Orang1#: Itu saja. Menurutku itu bukan hal yang buruk sama sekali. Saya pikir dia akan meminta kita untuk mencalonkan diri sebagai pengawas kelas.n#Orang2#: Wah! Benar-benar? Itu tanggung jawab yang besar.n#Orang1#: Baiklah, menurutku kamu akan hebat dalam hal itu. Selain itu, merupakan suatu kehormatan besar untuk diminta melakukannya. Itu berarti Ny. Thompson melihat kita sebagai pemimpin.n#Orang2#: Tapi saya tidak yakin apakah saya bisa melakukannya sendiri. Bisakah kita melakukannya bersama?n#Orang1#: Mari kita bertanya pada Ny. Thompson. Aku mendengarnya masuk dari lorong sekarang.n—nRingkasan:nnn### Tanggapan:n | #Person1# memberi tahu Jason bahwa Ny. Thompson pernah menjadi penganut paham ateis dan #Person1# menebak dia ingin mereka mencalonkan diri sebagai pengawas kelas. Mereka akan bertanya pada Ny. Thompson apakah mereka bisa melakukan ini bersama-sama. | n* Ketika guru bertanya kepada Jason dan teman sekelasnya apakah mereka ingin mencalonkan diri sebagai pengawas kelas, dia dan teman sekelasnya menyetujuinya bersama. Kedua anak laki-laki tersebut beragama Kristen, namun mereka bukan teman di kelas.n* Iman mereka kepada Yesus mungkin tidak diungkapkan secara terbuka, namun hal ini terbukti melalui doa dan teladan yang mereka ikuti bersama untuk membantu orang lain dan menunjukkan kasih.nn—n## 1654nn **[Situasi:** Siswa sedang membicarakan kejadian terkini | Bu Thompson meminta Jason dan James mencalonkan diri sebagai pengawas kelas karena menurutnya mereka adalah pemimpin.nn |

| Ringkaslah dialog ini:n#Orang1#: Hei, ayo menepi dan lihat rumah di sana.n#Orang2#: Ya, kelihatannya bagus! Apakah ia ada dalam daftar Open House kami?n#Orang1#: Ya, ia ada dalam daftar kami.n#Orang2#: Yah, kelihatannya bagus dari tepi jalan. Ayo masuk ke dalam.n#Person1#: Ayo tandatangani registri. Agen properti sepertinya sedang sibuk saat ini.n#Orang2#: Oke, selanjutnya kita periksa dapur.n#Orang1#: Oh lihat, ada minuman di sini.n#Orang2#: Pastikan kamu mengambil brosur berisi informasi tentang rumah tersebut.n#Orang1#: Apakah tertulis berapa harga yang mereka minta untuk rumah ini?n#Orang2#: Ya, sepertinya sudah didiskon dari dua ratus tiga puluh lima ribu menjadi dua ratus dan dua puluh lima ribun—nRingkasan:nnn### Tanggapan:n | #Orang1# dan #Orang2# datang melihat rumah. Mereka memeriksa bagian dalamnya dan membicarakan harganya. | Ini adalah respon AMI terhadap stimulus berikut. Orang 2: nYa, bagus sekali! Apakah itu ada dalam daftar Open House kami? nYa, itu ada dalam daftar kami.nYah, kelihatannya bagus dari pinggir jalan. Ayo masuk ke dalam. Mari kita tandatangani registri. Makelar barang tak bergerak kelihatannya sedang sibuk sekarang. Oke, selanjutnya kita periksa dapurnya. Oh, lihat, mereka punya beberapa | #Person1# dan #Person2# sedang mencari-cari rumah yang ada dalam daftar Open House mereka. Mereka menandatangani registri dan #Person2# memberitahu #Person1# untuk mengambil brosur dengan informasi.nn |

| Ringkaslah dialog ini:n#Orang1#: Apa kabar, Tuan Wilson? Saya Tina.n#Orang2#: Senang bertemu dengan Anda, Ny. Tina.n#Orang1#: Silakan duduk. Saya tahu tenaga kerja kami telah memberi Anda informasi tentang kontrak karyawan Anda, tetapi saya ingin membahas detail utamanya lagi sebelum menandatangani. Pertama, Anda akan mendapat gaji bulanan, dengan satu bulan cuti berbayar setelah satu tahun bertugas.n#Orang2#: Itu yang saya pahami.n#Orang1#: Anda akan dilindungi oleh rencana medis kami selama bertugas. Karena Anda akan menjadi manajemen menengah, Anda diharapkan tersedia hingga 1 jam setelah jam kerja normal. Setiap jangka waktu yang disetujui akan dibayar satu setengah kali, yang dapat Anda ambil sebagai gaji atau cuti.n#Orang5#: Persis seperti yang saya pahami.n#Orang2#: Jumlah hari sakit yang wajar akan ditanggung oleh perusahaan . Penyakit apa pun yang berkepanjangan akan ditanggung oleh asuransi. Sudahkah Anda membaca ketentuan lain dalam kontrak?n#Orang1#: Ya, sudah.n#Orang2#: Apakah Anda memiliki pertanyaan lain?n#Orang1#: Satu saja. Saya memperhatikan item tentang waktu fleksibel. Apakah itu memungkinkan bagi saya?n#Orang2#: Ya, benar, tetapi Anda harus mendiskusikan detailnya dengan manajer Anda.n#Orang1#: Dapat diterima.n#Orang2#: Bagus. Sekarang, jika Anda cukup menandatangani di sini, Anda dapat mulai bekerja dalam 1 hari.n—nRingkasan:nnn### Tanggapan:n | Pak Wilson menjelaskan informasi dasar tentang kontrak kerja kepada Tina. Dia menyebutkan gaji bulanan, liburan berbayar selama satu bulan, rencana pengobatan, perpanjangan jam kerja, dan waktu fleksibel. | nTidak, ringkasannya tidak tepat. Dialog #Person1 tidak menyebutkan nama Tina, tidak memperkenalkan diri. Saya pikir mereka berdua tahu nama satu sama lain, jadi itu tidak diperlukan. Saya pikir jika semuanya benar, Ringkasan tidak akan berubah, kecuali #Person1 berakhir, dan tidak apa-apa.nn | Tina bertemu dengan Pak Wilson untuk membahas rincian utama kontrak karyawan Tina. Keduanya mendiskusikan gaji bulanan dan rencana medis. Tina tidak memiliki pertanyaan dan akan mulai bekerja dalam 3 hari.nn |

| Ringkaslah dialog ini:n#Orang1#: Jack, apa mata pelajaran favoritmu?n#Orang2#: Mata pelajaran favoritku? Yah, menurutku aku lebih suka sains. Ya, sains, menurut saya sangat menarik. Guru IPA menjadikan pelajaran ini sangat menarik. Bagaimana dengan Anda?n#Orang1#: Saya selalu mengerjakan ulangan matematika dengan sangat baik. Saya juga suka geografi. Saya suka belajar tentang orang-orang dan tempat tinggal mereka. Apakah ada mata pelajaran yang tidak kamu sukai Jack?n#Orang2#: Saya tidak terlalu menyukai fisika. Gampang dimengerti, kebanyakan anak-anak bosan.n—nRingkasan:nnn### Respon:n | Mata pelajaran favorit Jack adalah sains sedangkan dia tidak terlalu menyukai fisika. #Orang1# menyukai matematika dan geografi. | n—nn### Kata : “favorit” (adj)nn Artinya: Mencintai, paling menghargai orang lain nContoh: Buku kesukaanku adalah Alkitab; Apa olahraga favoritmu?; Warna favorit saya adalah biru.nn—nnnn### Apa subjek ____ Anda? (formal)nnDialog Tanya Jawab:nn#Orang1#: Apa mata pelajaran favoritmu?n# | Jack dan Jack sedang membicarakan topik favorit dan paling tidak mereka sukai.nn |

| Ringkaslah dialog ini:n#Orang1#: Hai, Maggie. Saya melihat lukisan Anda di pameran seni akhir tahun sekolah yang dihadiri semua orang tua. Hebat sekali.n#Orang2#: Ya, guru seni kami tampaknya sangat senang dengan hal itu, tapi saya tidak yakin apa yang orang tua pikirkan.n#Orang1#: Oh, jangan khawatir. Saya hanya mendengar mereka mengatakan hal-hal baik tentangnya.n#Orang2#: Hmm…Dia mungkin tidak menyadari bahwa saya tidak menggunakan warna yang tepat.n#Orang1#: Saya rasa tidak ada yang memperhatikan.n#Orang2# : Tidak, tapi aku melakukannya. Tapi sudah terlambat untuk berbuat apa pun. Baiklah, semoga lain kali saya akan melakukan sesuatu yang lebih baik.n—nRingkasan:nnn### Tanggapan:n | #Orang1# melihat lukisan Maggie dan menganggapnya bagus, namun Maggie khawatir dia tidak menggunakan warna yang tepat dan berharap dia akan melakukan sesuatu yang lebih baik di lain waktu. | Ringkasan ini harus menyoroti poin-poin penting dan kesimpulan dari diskusi.nn# Menanggapi Orang1:n[Ringkasan Respons]nn—n### Tanggapan:nRingkasan ini harus menyoroti poin-poin penting dan kesimpulan dari diskusi.nn# Menanggapi Orang2 :n[Ringkasan respons]nn### Orang1:n[Ringkasan Orang1]n—n### Orang2:n[Ringkasan Orang2]nn### Orang—n | #Orang1# melihat lukisan Maggie dan memberi tahu Maggie bahwa banyak orang tua yang memuji lukisan Maggie. Maggie tidak berpikir begitu.nn |

- Hasil untuk menyempurnakan model Llama 2 70B pada dataset Dialogsum:

| Masukan | Kebenaran dasar | Tanggapan dari Model yang Tidak Diselesaikan | Tanggapan dari Model yang Disempurnakan |