Mulai Lompatan Amazon SageMaker adalah pusat Pembelajaran Mesin (ML) dari SageMaker yang menyediakan model pra-terlatih yang tersedia untuk umum untuk berbagai jenis masalah guna membantu Anda memulai pembelajaran mesin.

Memahami perilaku pelanggan adalah pikiran utama untuk setiap bisnis saat ini. Mendapatkan wawasan tentang mengapa dan bagaimana pelanggan membeli dapat membantu meningkatkan pendapatan. Churn pelanggan adalah masalah yang dihadapi oleh berbagai perusahaan, mulai dari telekomunikasi hingga perbankan, di mana pelanggan biasanya kalah dari pesaing. Merupakan kepentingan terbaik perusahaan untuk mempertahankan pelanggan yang sudah ada daripada mendapatkan pelanggan baru, karena biasanya biayanya jauh lebih mahal untuk menarik pelanggan baru. Saat mencoba mempertahankan pelanggan, perusahaan sering memfokuskan upaya mereka pada pelanggan yang kemungkinan besar akan pergi. Log obrolan perilaku pengguna dan dukungan pelanggan dapat berisi indikator berharga tentang kemungkinan pelanggan mengakhiri layanan. Dalam solusi ini, kami melatih dan menerapkan model prediksi churn yang menggunakan model pemrosesan bahasa alami (NLP) canggih untuk menemukan sinyal berguna dalam teks. Selain input tekstual, model ini menggunakan input data terstruktur tradisional seperti bidang numerik dan kategori.

Multimodalitas adalah bidang penelitian multi-disiplin yang membahas beberapa tujuan awal kecerdasan buatan dengan mengintegrasikan dan memodelkan berbagai modalitas. Posting ini bertujuan untuk membangun model yang dapat memproses dan menghubungkan informasi dari berbagai modalitas seperti fitur tabular dan tekstual.

Kami menunjukkan kepada Anda cara melatih, menerapkan, dan menggunakan model prediksi churn yang telah memproses fitur numerik, kategori, dan tekstual untuk membuat prediksinya. Meskipun kami mendalami kasus penggunaan prediksi churn dalam postingan ini, Anda dapat menggunakan solusi ini sebagai template untuk menggeneralisasi model pra-pelatihan fine-tuning dengan set data Anda sendiri, dan selanjutnya menjalankan optimasi hyperparameter (HPO) untuk meningkatkan akurasi. Anda bahkan dapat mengganti kumpulan data contoh dengan milik Anda dan menjalankannya dari ujung ke ujung untuk menyelesaikan kasus penggunaan Anda sendiri. Solusi yang diuraikan dalam pos tersedia di GitHub.

Templat solusi JumpStart

Mulai Lompatan Amazon SageMaker memberikan solusi end-to-end sekali klik untuk banyak kasus penggunaan ML yang umum. Jelajahi kasus penggunaan berikut untuk informasi selengkapnya tentang template solusi yang tersedia:

Template solusi JumpStart mencakup berbagai kasus penggunaan, di mana masing-masing template menawarkan beberapa template solusi yang berbeda (solusi Pemahaman Dokumen ini berada di bawah kasus penggunaan "Mengekstrak dan menganalisis data dari dokumen").

Pilih template solusi yang paling sesuai dengan kasus penggunaan Anda dari halaman arahan JumpStart. Untuk informasi selengkapnya tentang solusi spesifik di bawah setiap kasus penggunaan dan cara meluncurkan solusi JumpStart, lihat Templat Solusi.

Ikhtisar solusi

Gambar berikut menunjukkan bagaimana Anda dapat menggunakan solusi ini Amazon SageMaker komponen. Tugas pelatihan SageMaker digunakan untuk melatih berbagai model NLP, dan titik akhir SageMaker digunakan untuk menerapkan model di setiap tahap. Kita gunakan Layanan Penyimpanan Sederhana Amazon (Amazon S3) bersama SageMaker untuk menyimpan data pelatihan dan artefak model, dan amazoncloudwatch untuk mencatat keluaran pelatihan dan titik akhir.

Kami mendekati pemecahan masalah prediksi churn dengan langkah-langkah berikut:

- Eksplorasi data untuk menyiapkan data agar siap ML.

- Latih model multimoda dengan a Transformator kalimat wajah memeluk dan Pengklasifikasi hutan acak Scikit-pelajari.

- Tingkatkan lebih lanjut kinerja model dengan menggunakan HPO Tuning model otomatis SageMaker.

- Kereta dua Model multimodal AutoGluon: model ansambel berbobot/tumpuk multimodal AutoGluon, dan model fusi multimodal AutoGluon.

- Evaluasi dan bandingkan performa model pada data uji holdout.

Prasyarat

Untuk mencoba larutan di akun Anda sendiri, pastikan Anda memiliki yang berikut ini:

- Akun AWS. Jika Anda tidak memiliki akun, Anda bisa mendaftar untuk satu.

- Solusi yang diuraikan dalam postingan adalah bagian dari SageMaker JumpStart. Untuk menjalankan solusi JumpStart ini dan menerapkan infrastruktur ke akun AWS Anda, Anda harus membuat yang aktif Studio Amazon SageMaker contoh (lihat Masuk ke Amazon SageMaker Studio). Saat instans Studio Anda siap, gunakan petunjuk di JumpStart untuk meluncurkan solusinya.

- Saat menjalankan ini buku catatan di Studio, Anda harus memastikan Python 3 (PyTorch 1.10 Python 3.8 CPU Dioptimalkan) gambar/kernel digunakan.

Anda dapat menginstal paket yang diperlukan sebagaimana diuraikan dalam solusi untuk menjalankan notebook ini:

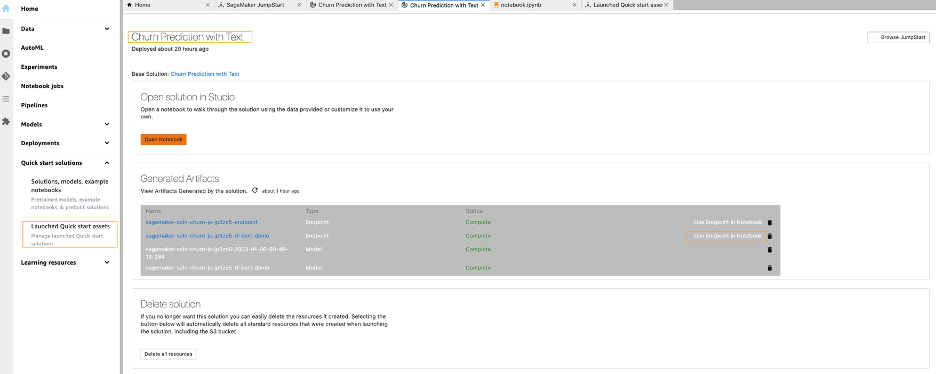

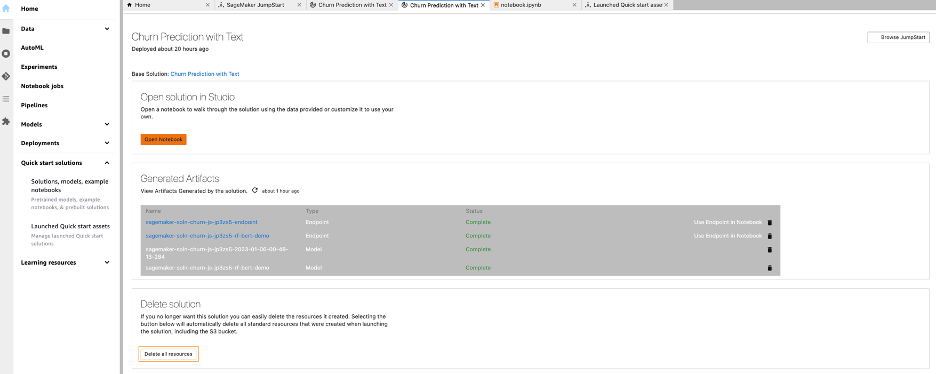

Buka kasus penggunaan prediksi churn

Di konsol Studio, pilih Solusi, model, contoh notebook bawah Solusi mulai cepat di panel navigasi. Arahkan ke Prediksi Churn dengan Teks solusi di JumpStart.

Sekarang kita dapat melihat lebih dekat beberapa aset yang termasuk dalam solusi ini.

Eksplorasi data

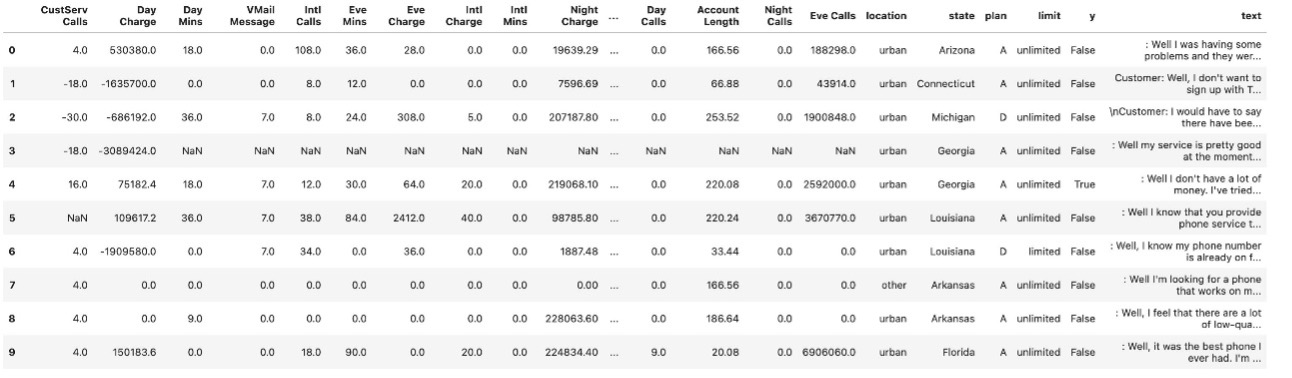

Pertama, mari unduh pengujian, validasi, dan latih dataset dari bucket sumber S3 dan unggah ke bucket S3 kita. Tangkapan layar berikut menunjukkan kepada kita 10 pengamatan dari data pelatihan.

Mari kita mulai menjelajahi kumpulan data kereta dan validasi.

Seperti yang Anda lihat, kami memiliki fitur yang berbeda seperti CustServ Calls, Day Charge, dan Day Calls yang kami gunakan untuk memprediksi kolom target y (apakah pelanggan meninggalkan layanan).

y dikenal sebagai atribut sasaran: atribut yang ingin diprediksi oleh model ML. Karena atribut target adalah biner, model kami melakukan prediksi biner, juga dikenal sebagai klasifikasi biner.

Ada 21 fitur, termasuk variabel target. Jumlah contoh untuk data pelatihan dan validasi masing-masing adalah 43,000 dan 5,000.

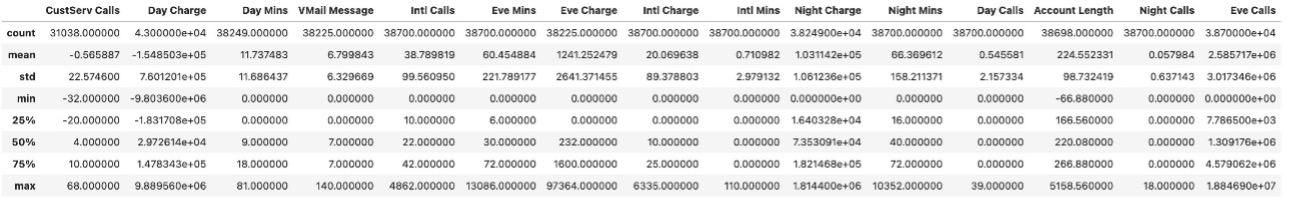

Tangkapan layar berikut menampilkan ringkasan statistik dari kumpulan data pelatihan.

Kami telah menjelajahi kumpulan data dan membaginya menjadi kumpulan pelatihan, validasi, dan pengujian. Set pelatihan dan validasi digunakan untuk pelatihan dan HPO. Set pengujian digunakan sebagai set penahan untuk evaluasi kinerja model. Kami sekarang melakukan langkah-langkah rekayasa fitur dan kemudian menyesuaikan modelnya.

Sesuaikan model multimodal dengan transformator kalimat Hugging Face dan Scikit-learn random forest classifier

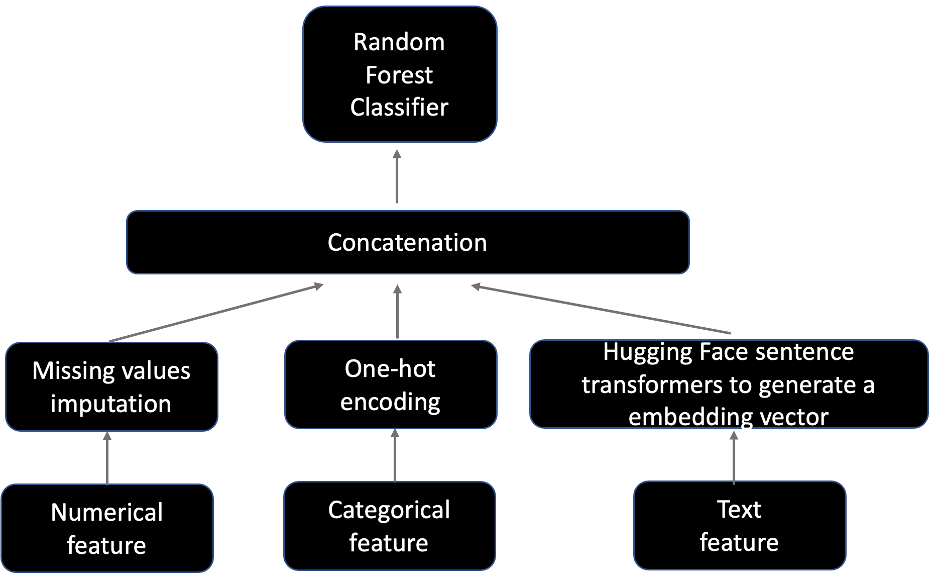

Pelatihan model terdiri dari dua komponen: langkah rekayasa fitur yang memproses fitur numerik, kategorikal, dan teks, dan langkah pemasangan model yang menyesuaikan fitur yang diubah menjadi Pengklasifikasi hutan acak Scikit-pelajari.

Untuk rekayasa fitur, kami menyelesaikan langkah-langkah berikut:

- Isi nilai yang hilang untuk fitur numerik.

- Mengkodekan fitur kategorikal ke dalam nilai one-hot, di mana nilai yang hilang dihitung sebagai salah satu kategori untuk setiap fitur.

- Menggunakan Transformator kalimat wajah memeluk untuk menyandikan fitur teks untuk menghasilkan vektor padat berdimensi X, di mana nilai X bergantung pada transformator kalimat tertentu.

Kami memilih tiga model transformator kalimat yang paling banyak diunduh dan menggunakannya dalam pemasangan model dan HPO berikut. Secara khusus, kami menggunakan semua-MiniLM-L6-v2, multi-qa-mpnet-base-dot-v1, dan parafrase-MiniLM-L6-v2. Untuk hyperparameter dari pengklasifikasi hutan acak, lihat GitHub repo.

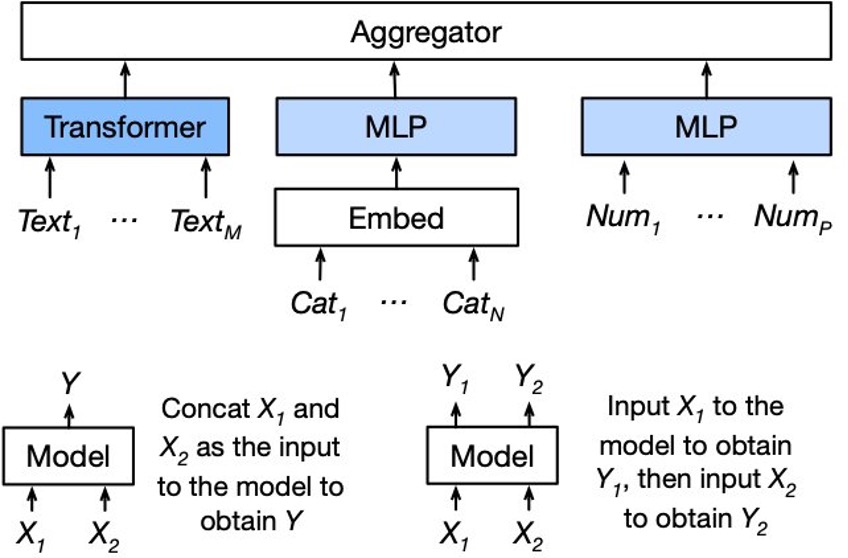

Gambar berikut menggambarkan diagram arsitektur model.

Ada banyak hyperparameter yang bisa Anda sesuaikan, seperti n-estimator, max-depth, dan bootstrap. Untuk detail lebih lanjut, lihat GitHub repo.

Untuk tujuan demonstrasi, kami hanya menggunakan fitur numerik CustServ Calls dan Account Length, fitur kategorikal plan, dan limit, dan fitur teks text agar sesuai dengan model. Beberapa fitur harus dipisahkan oleh ,.

Kami menerapkan model setelah pelatihan selesai:

Saat memanggil titik akhir baru kami dari notebook, kami menggunakan SDK SageMaker Predictor. Sebuah Predictor digunakan untuk mengirim data ke titik akhir (sebagai bagian dari permintaan) dan menginterpretasikan respons. JSON digunakan sebagai format untuk input data dan respons output karena merupakan format titik akhir standar dan respons titik akhir dapat berisi struktur data bersarang.

Dengan model kami berhasil diterapkan dan prediktor kami dikonfigurasi, kami dapat mencoba model prediksi churn pada input contoh:

Kode berikut menampilkan respons (probabilitas churn) dari kueri titik akhir:

Perhatikan bahwa probabilitas yang dikembalikan oleh model ini belum dikalibrasi. Ketika model memberikan probabilitas churn sebesar 20%, misalnya, ini tidak berarti bahwa 20% pelanggan dengan probabilitas 20% menghasilkan churn. Kalibrasi adalah properti yang berguna dalam keadaan tertentu, tetapi tidak diperlukan dalam kasus di mana diskriminasi antara kasus churn dan non-churn sudah cukup. Pengklasifikasi TerkalibrasiCV dari Scikit-belajar dapat digunakan untuk mengkalibrasi model.

Sekarang kami menanyakan titik akhir menggunakan data uji tahan, yang terdiri dari 1,939 contoh. Tabel berikut merangkum hasil evaluasi untuk model multimodal kami dengan transformator kalimat Hugging Face dan pengklasifikasi hutan acak Scikit-learn.

| metrik | BERT + Hutan Acak |

| Ketepatan | 0.77463 |

| AUC ROC | 0.75905 |

Performa model bergantung pada konfigurasi hyperparameter. Melatih model dengan satu set konfigurasi hyperparameter tidak akan menjamin model yang optimal. Hasilnya, kami menjalankan proses HPO di bagian berikut untuk lebih meningkatkan performa model.

Pasang model multimodal dengan HPO

Di bagian ini, kami semakin meningkatkan kinerja model dengan menambahkan penyetelan HPO Tuning model otomatis SageMaker. Penyesuaian model otomatis SageMaker, juga dikenal sebagai penyetelan hyperparameter, menemukan versi terbaik model dengan menjalankan banyak tugas pelatihan pada kumpulan data Anda menggunakan algoritme dan rentang hyperparameter yang Anda tentukan. Kemudian memilih nilai hyperparameter yang menghasilkan model yang berperforma terbaik, yang diukur dengan metrik yang Anda pilih. Model terbaik dan hyperparameter yang sesuai dipilih pada data validasi. Selanjutnya, model terbaik dievaluasi pada data uji tahan, yang merupakan data uji yang sama yang kami buat di bagian sebelumnya. Akhirnya, kami menunjukkan bahwa kinerja model yang dilatih dengan HPO secara signifikan lebih baik daripada model yang dilatih tanpa HPO.

Berikut ini adalah hyperparameter statis yang tidak kami sesuaikan dan hyperparameter dinamis yang ingin kami sesuaikan dan rentang pencariannya:

Kami mendefinisikan nama metrik objektif, definisi metrik (dengan pola regex), dan tipe objektif untuk pekerjaan penyetelan.

Pertama, kami menetapkan tujuan sebagai skor akurasi pada data validasi (roc auc score on validation data) dan menentukan metrik untuk tugas penyetelan dengan menentukan nama metrik tujuan dan ekspresi reguler (regex). Ekspresi reguler digunakan untuk mencocokkan keluaran log algoritme dan menangkap nilai numerik metrik.

Selanjutnya, kami menentukan rentang hyperparameter untuk memilih nilai hyperparameter terbaik. Kami menetapkan jumlah total pekerjaan penyetelan sebagai 10 dan mendistribusikan pekerjaan ini pada lima pekerjaan yang berbeda Cloud komputasi elastis Amazon (Amazon EC2) untuk menjalankan tugas penyetelan paralel.

Terakhir, kami meneruskan nilai tersebut untuk membuat instance objek SageMaker Estimator, serupa dengan yang kami lakukan di langkah pelatihan sebelumnya. Alih-alih memanggil fungsi fit dari objek Estimator, kita meneruskan objek Estimator sebagai parameter ke Hyperparameter Tuner konstruktor dan panggil fungsi fit untuk meluncurkan pekerjaan penyetelan:

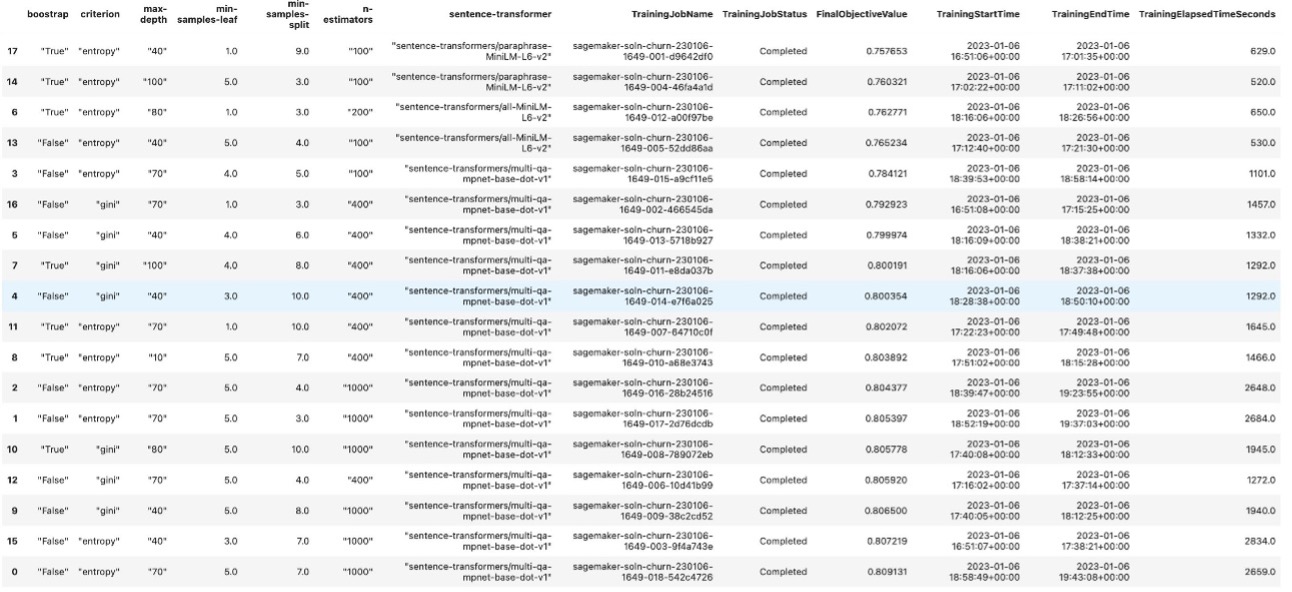

Saat pekerjaan penyetelan selesai, kita dapat membuat tabel ringkasan dari semua pekerjaan penyetelan.

Setelah tugas penyetelan selesai, kami menerapkan model yang memberikan skor metrik evaluasi terbaik pada set data validasi, melakukan inferensi pada set data uji tahan yang sama seperti yang kami lakukan di bagian sebelumnya, dan menghitung metrik evaluasi.

| metrik | BERT + Hutan Acak | BERT + Hutan Acak dengan HPO |

| Ketepatan | 0.77463 | 0.9278 |

| AUC ROC | 0.75905 | 0.79861 |

Kita dapat melihat menjalankan HPO dengan penyetelan model otomatis SageMaker secara signifikan meningkatkan kinerja model.

Selain HPO, performa model juga bergantung pada algoritme. Penting untuk melatih beberapa algoritme canggih, membandingkan performanya pada data uji tahan yang sama, dan memilih yang optimal. Oleh karena itu, kami melatih dua model multimodal AutoGluon lagi di bagian berikut.

Pasangkan model ansambel berbobot/tumpuk multimodal AutoGluon

Ada dua jenis multimodalitas AutoGluon:

- Latih beberapa model tabel serta

TextPredictormodel (memanfaatkanTextPredictormodel di dalamTabularPredictor), lalu gabungkan mereka melalui ansambel berbobot atau ansambel bertumpuk, seperti yang dijelaskan di AutoGluon-Tabular: AutoML yang Kuat dan Akurat untuk Data Terstruktur - Menggabungkan beberapa model jaringan saraf secara langsung dan menangani teks mentah (yang juga mampu menangani kolom numerik dan kategorikal tambahan)

Kami melatih model ansambel berbobot atau bertumpuk multimodal terlebih dahulu di bagian ini, dan melatih model jaringan saraf fusi di bagian selanjutnya.

Pertama, kami mengambil gambar pelatihan AutoGluon:

Selanjutnya, kami meneruskan hyperparameter. Tidak seperti kerangka AutoML yang ada yang terutama berfokus pada pemilihan model atau hyperparameter, AutoGluonTabular berhasil dengan menggabungkan beberapa model dan menumpuknya dalam beberapa lapisan. Oleh karena itu, HPO biasanya tidak diperlukan untuk model ansambel AutoGluon.

Akhirnya, kami membuat Pengukur SageMaker dan telepon estimator.fit() untuk memulai pekerjaan pelatihan:

Setelah pelatihan selesai, kami mengambil gambar inferensi AutoGluon dan menerapkan model:

Setelah kami menerapkan titik akhir, kami mengkueri titik akhir menggunakan set pengujian yang sama dan menghitung metrik evaluasi. Pada tabel berikut, kita dapat melihat ansambel multimodal AutoGluon meningkatkan sekitar 3% di ROC AUC dibandingkan dengan trafo kalimat BERT dan hutan acak dengan HPO.

| metrik | BERT + Hutan Acak | BERT + Hutan Acak dengan HPO | Ensemble Multimodal AutoGluon |

| Ketepatan | 0.77463 | 0.9278 | 0.92625 |

| AUC ROC | 0.75905 | 0.79861 | 0.82918 |

Pasang model fusi multimodal AutoGluon

Diagram berikut mengilustrasikan arsitektur model. Untuk detailnya, lihat AutoMM untuk Teks + Tabular – Mulai Cepat.

Secara internal, kami menggunakan jaringan yang berbeda untuk menyandikan kolom teks, kolom kategori, dan kolom numerik. Fitur yang dihasilkan oleh masing-masing jaringan dikumpulkan oleh agregator fusi akhir. Agregator dapat menampilkan logit atau prediksi skor.

Di sini, kami menggunakan tulang punggung NLP terlatih untuk mengekstrak fitur teks dan kemudian menggunakan dua menara lain untuk mengekstrak fitur dari kolom kategori dan kolom numerik.

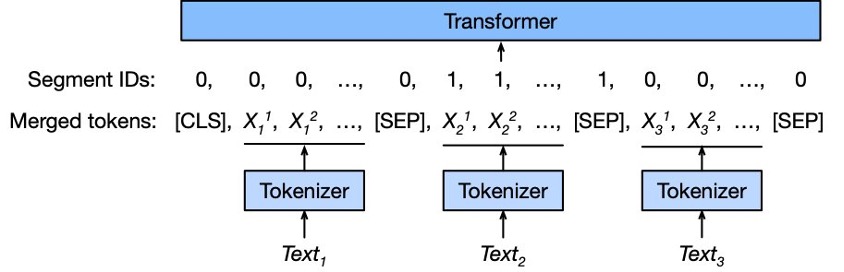

Selain itu, untuk menangani beberapa bidang teks, kami memisahkan bidang ini dengan token [SEP] dan mengganti 0 dan 1 sebagai ID segmen, seperti yang ditampilkan dalam diagram berikut.

Demikian pula, kami mengikuti instruksi di bagian sebelumnya untuk melatih dan menerapkan model fusi multimodal AutoGluon:

Tabel berikut merangkum hasil evaluasi untuk model fusi multimodal AutoGluon, bersama dengan tiga model yang kami evaluasi di bagian sebelumnya. Kita dapat melihat ansambel multimodal AutoGluon dan model fusi multimodal mencapai kinerja terbaik.

| Metrik | BERT + Hutan Acak | BERT + Hutan Acak dengan HPO | Ensemble Multimodal AutoGluon | Fusi Multimodal AutoGluon |

| Ketepatan | 0.77463 | 0.9278 | 0.92625 | 0.9247 |

| AUC ROC | 0.75905 | 0.79861 | 0.82918 | 0.81115 |

Perhatikan bahwa hasil dan performa relatif antara model ini bergantung pada kumpulan data yang Anda gunakan untuk pelatihan. Hasil ini representatif, dan meskipun kecenderungan algoritme tertentu untuk berperforma lebih baik didasarkan pada faktor yang relevan, keseimbangan kinerja dapat berubah karena distribusi data yang berbeda. Anda dapat mengganti kumpulan data contoh dengan data Anda sendiri untuk menentukan model mana yang paling cocok untuk Anda.

Buku catatan demo

Anda dapat menggunakan buku catatan demo untuk mengirim data contoh ke titik akhir model yang sudah diterapkan. Buku catatan demo dengan cepat memungkinkan Anda mendapatkan pengalaman langsung dengan menanyakan data contoh. Setelah Anda meluncurkan solusi Churn Prediction with Text, buka buku catatan demo dengan memilih Gunakan Endpoint di Notebook.

Membersihkan

Setelah selesai dengan solusi ini, pastikan Anda menghapus semua sumber daya AWS yang tidak diinginkan dengan memilih Hapus semua sumber daya.

Perhatikan bahwa Anda perlu menghapus sumber daya tambahan apa pun yang mungkin telah Anda buat di buku catatan ini secara manual.

Kesimpulan

Dalam postingan ini, kami menunjukkan cara menggunakan Sagemaker JumpStart untuk memprediksi churn menggunakan multimodalitas teks dan fitur tabular.

Jika Anda tertarik untuk mempelajari lebih lanjut tentang model churn pelanggan, lihat postingan berikut:

Tentang Penulis

Dr Xin Huang adalah Ilmuwan Terapan untuk Amazon SageMaker JumpStart dan algoritma bawaan Amazon SageMaker. Dia berfokus pada pengembangan algoritme pembelajaran mesin yang dapat diskalakan. Minat penelitiannya adalah di bidang pemrosesan bahasa alami, pembelajaran mendalam yang dapat dijelaskan pada data tabular, dan analisis yang kuat dari pengelompokan ruang-waktu non-parametrik. Dia telah menerbitkan banyak makalah di ACL, ICDM, konferensi KDD, dan jurnal Royal Statistical Society: Series A.

Dr Xin Huang adalah Ilmuwan Terapan untuk Amazon SageMaker JumpStart dan algoritma bawaan Amazon SageMaker. Dia berfokus pada pengembangan algoritme pembelajaran mesin yang dapat diskalakan. Minat penelitiannya adalah di bidang pemrosesan bahasa alami, pembelajaran mendalam yang dapat dijelaskan pada data tabular, dan analisis yang kuat dari pengelompokan ruang-waktu non-parametrik. Dia telah menerbitkan banyak makalah di ACL, ICDM, konferensi KDD, dan jurnal Royal Statistical Society: Series A.

Rajakumar Sampatkumar adalah Manajer Akun Teknis Utama di AWS, yang memberikan panduan kepada pelanggan tentang penyelarasan teknologi bisnis dan mendukung penemuan kembali model dan proses operasi cloud mereka. Dia bersemangat tentang cloud dan pembelajaran mesin. Raj juga merupakan spesialis pembelajaran mesin dan bekerja dengan pelanggan AWS untuk merancang, menerapkan, dan mengelola beban kerja dan arsitektur AWS mereka.

Rajakumar Sampatkumar adalah Manajer Akun Teknis Utama di AWS, yang memberikan panduan kepada pelanggan tentang penyelarasan teknologi bisnis dan mendukung penemuan kembali model dan proses operasi cloud mereka. Dia bersemangat tentang cloud dan pembelajaran mesin. Raj juga merupakan spesialis pembelajaran mesin dan bekerja dengan pelanggan AWS untuk merancang, menerapkan, dan mengelola beban kerja dan arsitektur AWS mereka.

- Konten Bertenaga SEO & Distribusi PR. Dapatkan Amplifikasi Hari Ini.

- Platoblockchain. Intelijen Metaverse Web3. Pengetahuan Diperkuat. Akses Di Sini.

- Sumber: https://aws.amazon.com/blogs/machine-learning/churn-prediction-using-multimodality-of-text-and-tabular-features-with-amazon-sagemaker-jumpstart/

- 000

- 1

- 10

- 100

- 28

- 7

- 70

- 9

- a

- Tentang Kami

- Akun

- ketepatan

- tepat

- Mencapai

- mengakuisisi

- aktif

- tambahan

- Tambahan

- alamat

- Setelah

- Agen

- Agregator

- bertujuan

- algoritma

- algoritma

- Semua

- memungkinkan

- di samping

- Meskipun

- Amazon

- Amazon EC2

- Amazon SageMaker

- Mulai Lompatan Amazon SageMaker

- analisis

- menganalisa

- dan

- terapan

- pendekatan

- arsitektur

- DAERAH

- buatan

- kecerdasan buatan

- Aktiva

- secara otomatis

- ML Otomatis

- tersedia

- AWS

- Tulang punggung

- Saldo

- Perbankan

- berdasarkan

- karena

- TERBAIK

- Lebih baik

- antara

- Bootstrap

- membangun

- built-in

- bisnis

- membeli

- panggilan

- panggilan

- Panggilan

- mampu

- menangkap

- membawa

- kasus

- kasus

- kategori

- tertentu

- kesempatan

- perubahan

- memeriksa

- Pilih

- memilih

- keadaan

- klasifikasi

- lebih dekat

- awan

- kekelompokan

- kode

- Kolom

- Kolom

- menggabungkan

- Umum

- Perusahaan

- Perusahaan

- membandingkan

- dibandingkan

- pesaing

- lengkap

- komponen

- menghitung

- konferensi

- konsul

- Wadah

- kontrak

- kontrak

- Sesuai

- Biaya

- menutupi

- membuat

- dibuat

- pelanggan

- perilaku pelanggan

- Layanan Pelanggan

- Customer Support

- pelanggan

- data

- transaksi

- berurusan

- memutuskan

- mendalam

- belajar mendalam

- tergantung

- tergantung

- menyebarkan

- dikerahkan

- Mendesain

- rincian

- Menentukan

- berkembang

- MELAKUKAN

- berbeda

- langsung

- mendistribusikan

- distribusi

- Buruh pelabuhan

- dokumen

- Tidak

- Dont

- Download

- dinamis

- setiap

- upaya

- antara

- ujung ke ujung

- Titik akhir

- Teknik

- dievaluasi

- evaluasi

- Bahkan

- contoh

- contoh

- ada

- pengalaman

- menjelaskan

- eksplorasi

- menyelidiki

- Dieksplorasi

- Menjelajahi

- ekstrak

- sangat

- Menghadapi

- dihadapi

- faktor

- Fitur

- Fitur

- bidang

- Fields

- Angka

- Akhirnya

- Menemukan

- menemukan

- Pertama

- cocok

- sesuai

- Fokus

- berfokus

- mengikuti

- berikut

- hutan

- format

- kerangka

- dari

- fungsi

- lebih lanjut

- fusi

- mendapatkan

- menghasilkan

- dihasilkan

- mendapatkan

- diberikan

- memberikan

- gluon

- Anda

- baik

- Tumbuh

- menjamin

- menangani

- Penanganan

- hands-on

- membantu

- bermanfaat

- Seterpercayaapakah Olymp Trade? Kesimpulan

- How To

- HTML

- HTTPS

- Pusat

- Optimalisasi Hyperparameter

- Penyesuaian Hyperparameter

- mengenali

- gambar

- mengimpor

- penting

- memperbaiki

- in

- termasuk

- Termasuk

- Meningkatkan

- indikator

- sendiri-sendiri

- informasi

- Infrastruktur

- memasukkan

- wawasan

- install

- contoh

- sebagai gantinya

- instruksi

- Mengintegrasikan

- Intelijen

- bunga

- tertarik

- kepentingan

- terlibat

- masalah

- IT

- Pekerjaan

- Jobs

- majalah

- json

- kunci

- Jenis

- dikenal

- pendaratan

- bahasa

- jalankan

- lapisan

- pengetahuan

- Meninggalkan

- Panjang

- Mungkin

- MEMBATASI

- baris

- Panjang

- melihat

- mesin

- Mesin belajar

- membuat

- mengelola

- manajer

- manual

- banyak

- Cocok

- Maksimalkan

- maksimum

- metrik

- Metrik

- mungkin

- keberatan

- hilang

- ML

- model

- model

- Bulan

- bulan

- lebih

- paling

- multi-disiplin

- beberapa

- nama

- Alam

- Pengolahan Bahasa alami

- Arahkan

- Navigasi

- perlu

- Perlu

- jaringan

- jaringan

- saraf jaringan

- New

- berikutnya

- nLP

- buku catatan

- jumlah

- obyek

- tujuan

- ditawarkan

- ONE

- Buka

- operasi

- optimal

- optimasi

- dioptimalkan

- asli

- Lainnya

- diuraikan

- sendiri

- paket

- pane

- dokumen

- Paralel

- parameter

- bagian

- tertentu

- bergairah

- pola

- Melakukan

- prestasi

- pertunjukan

- melakukan

- telepon

- memilih

- Tempat

- rencana

- plato

- Kecerdasan Data Plato

- Data Plato

- Pos

- Posts

- meramalkan

- ramalan

- Prediksi

- Predictor

- Mempersiapkan

- sebelumnya

- terutama

- Utama

- Masalah

- proses

- Diproses

- proses

- pengolahan

- milik

- menyediakan

- menyediakan

- di depan umum

- diterbitkan

- tujuan

- Ular sanca

- pytorch

- Cepat

- segera

- acak

- jarak

- Mentah

- RE

- siap

- regex

- reguler

- relevan

- menggantikan

- wakil

- permintaan

- wajib

- penelitian

- Sumber

- tanggapan

- responsif

- mengakibatkan

- Hasil

- pendapatan

- kuat

- kerajaan

- Run

- berjalan

- pembuat bijak

- Penyetelan Model Otomatis SageMaker

- sama

- terukur

- ilmuwan

- scikit-belajar

- SDK

- Pencarian

- mencari

- Bagian

- bagian

- ruas

- terpilih

- seleksi

- putusan pengadilan

- Seri

- Seri A

- layanan

- set

- set

- beberapa

- harus

- Menunjukkan

- ditunjukkan

- Pertunjukkan

- sinyal

- signifikan

- mirip

- Sederhana

- So

- Masyarakat

- larutan

- Solusi

- MEMECAHKAN

- Memecahkan

- beberapa

- sumber

- spesialis

- tertentu

- Secara khusus

- membagi

- Lari cepat

- ditumpuk

- menumpuk

- Tahap

- standar

- awal

- mulai

- state-of-the-art

- statistik

- statistika

- Langkah

- Tangga

- penyimpanan

- menyimpan

- tersusun

- studio

- Kemudian

- berhasil

- seperti itu

- cukup

- RINGKASAN

- mendukung

- pendukung

- tabel

- Mengambil

- target

- tech

- Teknis

- telekomunikasi

- Template

- template

- istilah

- uji

- Grafik

- Daerah

- Sumber

- mereka

- karena itu

- tiga

- untuk

- hari ini

- token

- puncak

- Total

- tradisional

- Pelatihan VE

- terlatih

- Pelatihan

- berubah

- benar

- jenis

- khas

- bawah

- pemahaman

- tak terbatas

- tidak diinginkan

- meningkatkan

- us

- menggunakan

- gunakan case

- Pengguna

- biasanya

- Memanfaatkan

- MENGESAHKAN

- pengesahan

- Berharga

- nilai

- Nilai - Nilai

- variasi

- berbagai

- Ve

- Verizon

- versi

- melalui

- Apa

- apakah

- yang

- SIAPA

- lebar

- Rentang luas

- akan

- tanpa

- Kerja

- bekerja

- akan

- Salah

- X

- Kamu

- Anda

- zephyrnet.dll