Beberapa tahun terakhir telah menunjukkan pertumbuhan luar biasa dalam jaringan saraf pembelajaran mendalam (DNN). Pertumbuhan ini dapat dilihat pada model yang lebih akurat dan bahkan membuka kemungkinan baru dengan AI generatif: model bahasa besar (LLM) yang mensintesis bahasa alami, generator teks-ke-gambar, dan banyak lagi. Kemampuan DNN yang meningkat ini datang dengan biaya memiliki model besar yang membutuhkan sumber daya komputasi yang signifikan untuk dilatih. Pelatihan terdistribusi mengatasi masalah ini dengan dua teknik: paralelisme data dan paralelisme model. Paralelisme data digunakan untuk menskalakan proses pelatihan pada beberapa node dan pekerja, dan paralelisme model membagi model dan menyesuaikannya dengan infrastruktur yang ditentukan. Amazon SageMaker pelatihan terdistribusi jobs memungkinkan Anda dengan satu klik (atau satu panggilan API) untuk menyiapkan kluster komputasi terdistribusi, melatih model, menyimpan hasilnya ke Layanan Penyimpanan Sederhana Amazon (Amazon S3), dan matikan cluster setelah selesai. Selain itu, SageMaker terus berinovasi dalam ruang pelatihan terdistribusi dengan meluncurkan fitur seperti cluster heterogen dan mendistribusikan perpustakaan pelatihan untuk paralelisme data dan model paralelisme.

Pelatihan yang efisien pada lingkungan terdistribusi memerlukan penyesuaian hyperparameter. Contoh umum praktik yang baik saat melatih beberapa GPU adalah mengalikan ukuran batch (atau mini-batch) dengan nomor GPU untuk mempertahankan ukuran batch yang sama per GPU. Namun, penyesuaian hyperparameter sering berdampak pada konvergensi model. Oleh karena itu, pelatihan terdistribusi perlu menyeimbangkan tiga faktor: distribusi, hyperparameter, dan akurasi model.

Dalam posting ini, kami mengeksplorasi efek pelatihan terdistribusi pada konvergensi dan cara menggunakannya Penyetelan Model Otomatis Amazon SageMaker untuk menyempurnakan hyperparameter model untuk pelatihan terdistribusi menggunakan paralelisme data.

Kode sumber yang disebutkan dalam posting ini dapat ditemukan di Repositori GitHub (instance m5.xlarge direkomendasikan).

Skalakan pelatihan dari lingkungan tunggal ke lingkungan terdistribusi

Paralelisme data adalah cara untuk menskalakan proses pelatihan ke beberapa sumber daya komputasi dan mencapai waktu pelatihan yang lebih cepat. Dengan paralelisme data, data dipartisi di antara node komputasi, dan setiap node menghitung gradien berdasarkan partisinya dan memperbarui modelnya. Pembaruan ini dapat dilakukan menggunakan satu atau beberapa server parameter dengan cara asinkron, satu-ke-banyak, atau semua-ke-semua. Cara lain bisa dengan menggunakan algoritma AllReduce. Misalnya, dalam algoritma ring-allreduce, setiap node berkomunikasi hanya dengan dua node tetangganya, sehingga mengurangi keseluruhan transfer data. Untuk mempelajari lebih lanjut tentang server parameter dan ring-allreduce, lihat Meluncurkan pelatihan terdistribusi TensorFlow dengan mudah menggunakan Horovod atau Server Parameter di Amazon SageMaker. Sehubungan dengan partisi data, jika ada n menghitung node, maka setiap node harus mendapatkan subset data, kira-kira 1/n dalam ukuran.

Untuk mendemonstrasikan efek pelatihan penskalaan pada konvergensi model, kami menjalankan dua eksperimen sederhana:

Setiap pelatihan model berjalan dua kali: pada satu instans dan didistribusikan ke beberapa instans. Untuk pelatihan terdistribusi DNN, agar dapat sepenuhnya memanfaatkan prosesor terdistribusi, kami mengalikan ukuran mini-batch dengan jumlah instans (empat). Tabel berikut merangkum penyiapan dan hasilnya.

| Jenis masalah | Klasifikasi gambar | Klasifikasi biner | ||

| Model | DNN | XGBoost | ||

| Contoh | ml.c4.xbesar | ml.m5.2lebih besar | ||

| Himpunan data |

(Gambar berlabel) |

Pemasaran Langsung (kategori tabular, numerik dan vektor) |

||

| Metrik validasi | Ketepatan | AUC | ||

| Epocs / Putaran | 20 | 150 | ||

| Jumlah Instance | 1 | 4 | 1 | 3 |

| Jenis distribusi | N / A | Server parameter | N / A | Semua Mengurangi |

| Waktu latihan (menit) | 8 | 3 | 3 | 1 |

| Skor Validasi Akhir | 0.97 | 0.11 | 0.78 | 0.63 |

Untuk kedua model, waktu pelatihan dikurangi hampir secara linear dengan faktor distribusi. Namun, konvergensi model mengalami penurunan yang signifikan. Perilaku ini konsisten untuk dua model yang berbeda, instans komputasi yang berbeda, metode distribusi yang berbeda, dan tipe data yang berbeda. Jadi, mengapa pendistribusian proses pelatihan memengaruhi akurasi model?

Ada sejumlah teori yang mencoba menjelaskan efek ini:

- Saat pembaruan tensor berukuran besar, lalu lintas antara pekerja dan server parameter dapat menjadi padat. Oleh karena itu, server parameter asinkron akan mengalami konvergensi yang jauh lebih buruk karena keterlambatan pembaruan bobot [1].

- Peningkatan ukuran batch dapat menyebabkan over-fitting dan generalisasi yang buruk, sehingga mengurangi akurasi validasi [2].

- Saat memperbarui parameter model secara asinkron, beberapa DNN mungkin tidak menggunakan bobot model terbaru yang diperbarui; oleh karena itu, mereka akan menghitung gradien berdasarkan bobot yang beberapa iterasi di belakangnya. Hal ini menyebabkan kebosanan berat [3] dan dapat disebabkan oleh sejumlah alasan.

- Beberapa hyperparameter khusus untuk model atau pengoptimal. Misalnya, dokumentasi resmi XGBoost mengatakan bahwa

exactnilai untuktree_modehyperparameter tidak mendukung pelatihan terdistribusi karena XGBoost menggunakan distribusi data pemisahan baris sedangkanexactmetode pohon bekerja pada format kolom yang diurutkan. - Beberapa peneliti mengusulkan bahwa mengonfigurasi mini-batch yang lebih besar dapat menyebabkan gradien dengan stochasticity yang lebih sedikit. Hal ini dapat terjadi ketika fungsi kerugian berisi minima lokal dan titik pelana dan tidak ada perubahan yang dilakukan pada ukuran langkah, untuk pengoptimalan yang macet di titik minimum atau pelana lokal tersebut [4].

Optimalkan untuk pelatihan terdistribusi

Optimasi Hyperparameter (HPO) adalah proses mencari dan memilih satu set hyperparameter yang optimal untuk algoritma pembelajaran. SageMaker Automatic Model Tuning (AMT) menyediakan HPO sebagai layanan terkelola dengan menjalankan beberapa tugas pelatihan pada set data yang disediakan. SageMaker AMT menelusuri rentang hyperparameter yang Anda tentukan dan menampilkan nilai terbaik, seperti diukur dengan metrik yang Anda pilih. Anda dapat menggunakan SageMaker AMT dengan algoritme bawaan atau menggunakan algoritme dan wadah khusus Anda.

Namun, pengoptimalan untuk pelatihan terdistribusi berbeda dari HPO biasa karena alih-alih meluncurkan satu instans per tugas pelatihan, setiap tugas sebenarnya meluncurkan sekelompok instans. Ini berarti dampak yang lebih besar pada biaya (terutama jika Anda mempertimbangkan instans berakselerasi GPU yang mahal, yang khas untuk DNN). Sebagai tambahan batas AMT, Anda mungkin bisa memukul Batas akun SageMaker untuk jumlah instans pelatihan yang bersamaan. Terakhir, peluncuran klaster dapat menimbulkan biaya operasional karena waktu mulai yang lebih lama. SageMaker AMT memiliki fitur khusus untuk mengatasi masalah ini. Hyperband dengan penghentian awal memastikan bahwa konfigurasi hyperparameter yang berperforma baik disetel dengan baik dan yang berperforma buruk dihentikan secara otomatis. Hal ini memungkinkan penggunaan waktu pelatihan yang efisien dan mengurangi biaya yang tidak perlu. Selain itu, SageMaker AMT mendukung penuh penggunaan Instans Spot Amazon EC2, yang dapat mengoptimalkan biaya pelatihan hingga 90% atas instans sesuai permintaan. Sehubungan dengan waktu mulai yang lama, SageMaker AMT secara otomatis menggunakan kembali instans pelatihan dalam setiap tugas penyetelan, sehingga mengurangi waktu mulai rata-rata setiap pekerjaan pelatihan sebanyak 20 kali. Selain itu, Anda harus mengikuti praktik terbaik AMT, seperti memilih hyperparameter yang relevan, rentang dan skala yang sesuai, dan jumlah terbaik dari tugas pelatihan bersamaan, dan menyetel seed acak untuk mereproduksi hasil.

Di bagian selanjutnya, kita melihat fitur-fitur ini beraksi saat kita mengonfigurasi, menjalankan, dan menganalisis tugas AMT menggunakan contoh XGBoost yang telah kita bahas sebelumnya.

Konfigurasikan, jalankan, dan analisis tugas penyetelan

Seperti disebutkan sebelumnya, kode sumber dapat ditemukan di GitHub repo. Pada Langkah 1–5, kami mengunduh dan menyiapkan data, membuat xgb3 estimator (estimator XGBoost terdistribusi diatur untuk menggunakan tiga instans), jalankan tugas pelatihan, dan amati hasilnya. Di bagian ini, kami menjelaskan cara menyetel tugas penyetelan untuk estimator tersebut, dengan asumsi Anda telah melewati Langkah 1–5.

Tugas penyetelan menghitung hyperparameter optimal untuk tugas pelatihan yang diluncurkan dengan menggunakan metrik untuk mengevaluasi performa. Kamu bisa konfigurasikan metrik Anda sendiri, yang akan diuraikan oleh SageMaker berdasarkan regex yang Anda konfigurasikan dan pancarkan stdout, atau gunakan metrik dari Algoritme bawaan SageMaker. Dalam contoh ini, kami menggunakan metrik tujuan XGBoost bawaan, jadi kita tidak perlu mengonfigurasi regex. Untuk mengoptimalkan konvergensi model, kami mengoptimalkan berdasarkan metrik validasi AUC:

Kami menyetel tujuh hyperparameter:

- nomor_bulat – Jumlah putaran untuk meningkatkan selama pelatihan.

- eta – Penyusutan ukuran langkah yang digunakan dalam pembaruan untuk mencegah overfitting.

- alfa – Istilah regularisasi L1 pada bobot.

- min_berat_anak – Jumlah minimum berat contoh (hessian) yang dibutuhkan pada seorang anak. Jika langkah partisi pohon menghasilkan simpul daun dengan jumlah bobot contoh kurang dari

min_child_weight, proses pembangunan menghentikan partisi lebih lanjut. - max_kedalaman - Kedalaman maksimum pohon.

- colsample_bylevel – Rasio subsampel kolom untuk setiap pemisahan, di setiap level. Subsampling ini terjadi sekali untuk setiap level kedalaman baru yang dicapai di pohon.

- colsample_bytree – Rasio subsampel kolom saat membangun setiap pohon. Untuk setiap pohon yang dibangun, subsampling terjadi sekali.

Untuk mempelajari selengkapnya tentang hyperparameter XGBoost, lihat Hyperparameter XGBoost. Kode berikut menunjukkan tujuh hyperparameter dan rentangnya:

Selanjutnya kami menyediakan konfigurasi untuk strategi Hyperband dan konfigurasi objek tuner menggunakan SageMaker SDK. HyperbandStrategyConfig dapat menggunakan dua parameter: max_resource (opsional) untuk jumlah iterasi maksimum yang akan digunakan untuk tugas pelatihan guna mencapai tujuan, dan min_resource – jumlah minimum iterasi yang akan digunakan oleh tugas pelatihan sebelum menghentikan pelatihan. Kita gunakan HyperbandStrategyConfig untuk mengonfigurasi StrategyConfig, yang kemudian digunakan oleh definisi tugas penyetelan. Lihat kode berikut:

Sekarang kita membuat HyperparameterTuner objek, yang kami berikan informasi berikut:

- Estimator XGBoost, disetel untuk dijalankan dengan tiga instans

- Nama dan definisi metrik objektif

- Rentang hyperparameter kami

- Menyetel konfigurasi sumber daya seperti jumlah tugas pelatihan yang akan dijalankan secara total dan berapa banyak tugas pelatihan yang dapat dijalankan secara paralel

- Pengaturan hyperband (strategi dan konfigurasi yang kami konfigurasikan pada langkah terakhir)

- Berhenti lebih awal (

early_stopping_type) mulaiOff

Mengapa kami menyetel penghentian lebih awal ke Nonaktif? Tugas pelatihan dapat dihentikan lebih awal jika tidak mungkin meningkatkan metrik objektif dari tugas penyetelan hyperparameter. Ini dapat membantu mengurangi waktu komputasi dan menghindari overfitting model Anda. Namun, Hyperband menggunakan mekanisme bawaan yang canggih untuk menerapkan penghentian lebih awal. Oleh karena itu, parameternya early_stopping_type harus disetel ke Off saat menggunakan fitur penghentian awal internal Hyperband. Lihat kode berikut:

Akhirnya, kami memulai pekerjaan penyetelan model otomatis dengan memanggil cocok metode. Jika Anda ingin meluncurkan pekerjaan secara asinkron, atur wait untuk False. Lihat kode berikut:

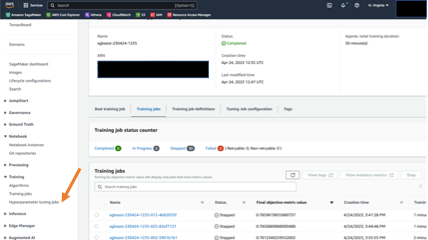

Anda dapat mengikuti progres dan ringkasan tugas di konsol SageMaker. Di panel navigasi, di bawah Pelatihan, pilih Pekerjaan penyetelan hyperparameter, lalu pilih tugas penyetelan yang relevan. Tangkapan layar berikut menunjukkan tugas penyetelan dengan detail tentang status dan kinerja tugas pelatihan.

Saat pekerjaan penyetelan selesai, kami dapat meninjau hasilnya. Dalam contoh notebook, kami menunjukkan cara mengekstrak hasil menggunakan SageMaker SDK. Pertama, kami memeriksa bagaimana pekerjaan penyetelan meningkatkan konvergensi model. Anda dapat melampirkan HyperparameterTuner objek menggunakan nama pekerjaan dan memanggil menggambarkan metode. Metode mengembalikan kamus yang berisi metadata dan hasil pekerjaan penyetelan.

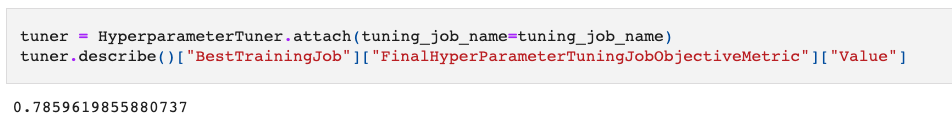

Dalam kode berikut, kami mengambil nilai tugas pelatihan dengan kinerja terbaik, yang diukur dengan metrik tujuan kami (AUC validasi):

Hasilnya adalah 0.78 di AUC pada set validasi. Itu peningkatan yang signifikan dari 0.63 awal!

Selanjutnya, mari kita lihat seberapa cepat pekerjaan pelatihan kita berjalan. Untuk itu, kami menggunakan HyperparameterTuningJobAnalytics metode di SDK untuk mengambil hasil tentang tugas penyetelan, dan membaca kerangka data Pandas untuk analisis dan visualisasi:

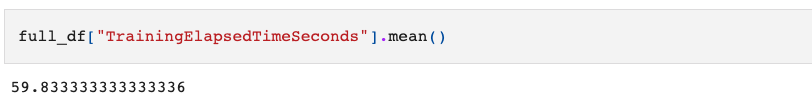

Mari kita lihat waktu rata-rata yang dibutuhkan tugas pelatihan dengan strategi Hyperband:

Waktu rata-rata memakan waktu sekitar 1 menit. Ini konsisten dengan mekanisme strategi Hyperband yang menghentikan pekerjaan pelatihan berkinerja buruk lebih awal. Dalam hal biaya, pekerjaan penyetelan membebani kami dengan total waktu pelatihan 30 menit. Tanpa penghentian awal Hyperband, total durasi pelatihan yang dapat ditagih diharapkan menjadi 90 menit (30 pekerjaan * 1 menit per pekerjaan * 3 instans per pekerjaan). Itu tiga kali lebih baik dalam penghematan biaya! Terakhir, kita melihat bahwa tugas penyetelan menjalankan 30 tugas pelatihan dan memakan waktu total 12 menit. Itu hampir 50% lebih sedikit dari waktu yang diharapkan (30 pekerjaan/4 pekerjaan secara paralel * 3 menit per pekerjaan).

Kesimpulan

Dalam posting ini, kami menjelaskan beberapa masalah konvergensi yang diamati saat melatih model dengan lingkungan terdistribusi. Kami melihat bahwa SageMaker AMT menggunakan Hyperband menangani masalah utama yang diperkenalkan oleh pengoptimalan pelatihan terdistribusi paralel data: konvergensi (yang meningkat lebih dari 10%), efisiensi operasional (pekerjaan penyetelan membutuhkan waktu 50% lebih sedikit daripada pekerjaan berurutan yang tidak dioptimalkan. telah diambil) dan efisiensi biaya (30 vs. 90 menit waktu kerja pelatihan yang dapat ditagih). Tabel berikut merangkum hasil kami:

| Metrik Peningkatan | Tidak Ada Tuning/Penyetelan Model Naif Implementasi | Penyetelan Model Otomatis Hyperband SageMaker | Peningkatan Terukur |

| Kualitas Model (Diukur dengan validasi AUC) |

0.63 | 0.78 | 15% |

| Biaya (Diukur dengan menit pelatihan yang dapat ditagih) |

90 | 30 | 66% |

| Efisiensi operasional (Diukur dengan total waktu berjalan) |

24 | 12 | 50% |

Untuk menyempurnakan penskalaan (ukuran cluster), Anda dapat mengulangi pekerjaan penyetelan dengan beberapa konfigurasi cluster dan membandingkan hasilnya untuk menemukan hyperparameter optimal yang memenuhi kecepatan dan akurasi model.

Kami menyertakan langkah-langkah untuk mencapai ini di bagian terakhir dari buku catatan.

Referensi

[1] Lian, Xiangru, dkk. “Penurunan gradien stokastik paralel terdesentralisasi asinkron.” Konferensi Internasional tentang Pembelajaran Mesin. PLR, 2018.

[2] Keskar, Nitish Shirish, dkk. “Pada pelatihan batch besar untuk pembelajaran mendalam: Kesenjangan generalisasi dan minima yang tajam.” arXiv preprint arXiv: 1609.04836 (2016).

[3] Dai, Wei, dkk. “Untuk memahami dampak staleness dalam pembelajaran mesin terdistribusi.” arXiv preprint arXiv: 1810.03264 (2018).

[4] Dauphin, Yann N., dkk. “Mengidentifikasi dan menyerang masalah titik pelana dalam optimasi non-cembung dimensi tinggi.” Kemajuan dalam sistem pemrosesan informasi saraf 27 (2014).

tentang Penulis

Uri Rosenberg adalah Manajer Teknis Spesialis AI & ML untuk Eropa, Timur Tengah, dan Afrika. Berbasis di Israel, Uri berupaya memberdayakan pelanggan perusahaan untuk merancang, membuat, dan mengoperasikan beban kerja ML dalam skala besar. Di waktu luangnya, ia senang bersepeda, hiking, dan mengeluh tentang persiapan data.

Uri Rosenberg adalah Manajer Teknis Spesialis AI & ML untuk Eropa, Timur Tengah, dan Afrika. Berbasis di Israel, Uri berupaya memberdayakan pelanggan perusahaan untuk merancang, membuat, dan mengoperasikan beban kerja ML dalam skala besar. Di waktu luangnya, ia senang bersepeda, hiking, dan mengeluh tentang persiapan data.

- Konten Bertenaga SEO & Distribusi PR. Dapatkan Amplifikasi Hari Ini.

- PlatoData.Jaringan Vertikal Generatif Ai. Berdayakan Diri Anda. Akses Di Sini.

- PlatoAiStream. Intelijen Web3. Pengetahuan Diperkuat. Akses Di Sini.

- PlatoESG. Otomotif / EV, Karbon, teknologi bersih, energi, Lingkungan Hidup, Tenaga surya, Penanganan limbah. Akses Di Sini.

- BlockOffset. Modernisasi Kepemilikan Offset Lingkungan. Akses Di Sini.

- Sumber: https://aws.amazon.com/blogs/machine-learning/effectively-solve-distributed-training-convergence-issues-with-amazon-sagemaker-hyperband-automatic-model-tuning/

- :memiliki

- :adalah

- :bukan

- $NAIK

- 1

- 10

- 100

- 12

- 15%

- 20

- 200

- 2014

- 2016

- 2018

- 24

- 27

- 30

- 7

- 8

- 9

- a

- Tentang Kami

- Akun

- ketepatan

- tepat

- Mencapai

- Tindakan

- sebenarnya

- tambahan

- Selain itu

- alamat

- alamat

- maju

- mempengaruhi

- Afrika

- AI

- AL

- algoritma

- algoritma

- alfa

- sudah

- juga

- menakjubkan

- Amazon

- Amazon EC2

- Amazon SageMaker

- Amazon Web Services

- antara

- an

- analisis

- analisis

- menganalisa

- dan

- Lain

- api

- Mendaftar

- sesuai

- sekitar

- ADALAH

- AS

- At

- melampirkan

- Menyerang

- secara otomatis

- secara otomatis

- rata-rata

- menghindari

- AWS

- Saldo

- berdasarkan

- BE

- karena

- sebelum

- laku

- di belakang

- TERBAIK

- Lebih baik

- antara

- Besar

- meningkatkan

- kedua

- membangun

- Bangunan

- built-in

- by

- menghitung

- panggilan

- panggilan

- CAN

- Bisa Dapatkan

- kemampuan

- kategori

- disebabkan

- perubahan

- dibebankan

- anak

- Pilih

- memilih

- Klik

- Kelompok

- kode

- Kolom

- Kolom

- bagaimana

- Umum

- membandingkan

- lengkap

- menghitung

- Kekhawatiran

- bersamaan

- Konferensi

- konfigurasi

- dikonfigurasi

- Mempertimbangkan

- konsisten

- konsul

- membangun

- Wadah

- mengandung

- terus menerus

- Konvergensi

- Biaya

- mahal

- Biaya

- bisa

- membuat

- adat

- pelanggan

- DAI

- data

- Persiapan data

- Terdesentralisasi

- mendalam

- belajar mendalam

- definisi

- keterlambatan

- mendemonstrasikan

- kedalaman

- menggambarkan

- dijelaskan

- Mendesain

- ditunjuk

- rincian

- MELAKUKAN

- berbeda

- dibahas

- didistribusikan

- pelatihan terdistribusi

- mendistribusikan

- distribusi

- do

- dokumentasi

- Tidak

- dilakukan

- Dont

- turun

- Download

- Menjatuhkan

- dua

- lamanya

- selama

- E&T

- setiap

- Terdahulu

- Awal

- mudah

- Timur

- efek

- efektif

- efisiensi

- efisien

- mempekerjakan

- memberdayakan

- aktif

- memungkinkan

- Memastikan

- Enterprise

- Lingkungan Hidup

- lingkungan

- terutama

- Eropa

- mengevaluasi

- Bahkan

- Setiap

- memeriksa

- contoh

- diharapkan

- eksperimen

- Menjelaskan

- menyelidiki

- ekstrak

- faktor

- faktor

- Fashion

- FAST

- lebih cepat

- Fitur

- Fitur

- beberapa

- Akhirnya

- Menemukan

- Pertama

- cocok

- mengikuti

- berikut

- Untuk

- format

- ditemukan

- empat

- FRAME

- dari

- sepenuhnya

- fungsi

- lebih lanjut

- Selanjutnya

- celah

- generatif

- AI generatif

- generator

- mendapatkan

- mendapatkan

- memberikan

- baik

- GPU

- GPU

- gradien

- lebih besar

- Pertumbuhan

- terjadi

- Memiliki

- memiliki

- he

- membantu

- -nya

- Memukul

- Seterpercayaapakah Olymp Trade? Kesimpulan

- How To

- Namun

- HTML

- http

- HTTPS

- Penyesuaian Hyperparameter

- if

- gambar

- Dampak

- dampak

- memperbaiki

- ditingkatkan

- perbaikan

- in

- termasuk

- Pada meningkat

- informasi

- Infrastruktur

- mulanya

- contoh

- sebagai gantinya

- intern

- ke

- memperkenalkan

- diperkenalkan

- Israel

- masalah

- IT

- iterasi

- NYA

- Pekerjaan

- Jobs

- Menjaga

- L1

- bahasa

- besar

- lebih besar

- Terakhir

- kemudian

- jalankan

- meluncurkan

- peluncuran

- memimpin

- Memimpin

- BELAJAR

- pengetahuan

- kurang

- Tingkat

- perpustakaan

- 'like'

- lokal

- Panjang

- lagi

- lepas

- mesin

- Mesin belajar

- terbuat

- Utama

- berhasil

- manajer

- banyak

- besar-besaran

- maksimum

- Mungkin..

- cara

- mekanisme

- tersebut

- Metadata

- metode

- metode

- metrik

- Metrik

- Tengah

- Timur Tengah

- mungkin

- minimum

- menit

- menit

- ML

- model

- model

- lebih

- paling

- beberapa

- dikalikan

- harus

- nama

- Alam

- Navigasi

- Perlu

- dibutuhkan

- kebutuhan

- jaringan

- jaringan saraf

- New

- berikutnya

- tidak

- simpul

- node

- buku catatan

- jumlah

- obyek

- tujuan

- mengamati

- of

- lepas

- resmi

- sering

- on

- Sesuai Permintaan

- sekali

- ONE

- hanya

- pembukaan

- beroperasi

- operasional

- optimal

- optimasi

- Optimize

- mengoptimalkan

- or

- urutan

- kami

- di luar

- lebih

- secara keseluruhan

- sendiri

- panda

- pane

- Paralel

- parameter

- parameter

- lulus

- untuk

- prestasi

- Tempat

- plato

- Kecerdasan Data Plato

- Data Plato

- Titik

- poin

- miskin

- kemungkinan

- mungkin

- Pos

- praktek

- persiapan

- Mempersiapkan

- mencegah

- Masalah

- proses

- pengolahan

- prosesor

- Kemajuan

- diusulkan

- memberikan

- disediakan

- menyediakan

- acak

- perbandingan

- tercapai

- Baca

- alasan

- baru

- direkomendasikan

- menurunkan

- mengurangi

- mengurangi

- mengurangi

- salam

- regex

- relevan

- ulangi

- membutuhkan

- membutuhkan

- peneliti

- sumber

- Sumber

- mengakibatkan

- Hasil

- Pengembalian

- ulasan

- putaran

- BARIS

- Run

- berjalan

- pembuat bijak

- Penyetelan Model Otomatis SageMaker

- sama

- Save

- melihat

- mengatakan

- SC

- Skala

- sisik

- skala

- SDK

- mencari

- Bagian

- melihat

- benih

- terlihat

- memilih

- Server

- layanan

- Layanan

- set

- pengaturan

- pengaturan

- penyiapan

- tujuh

- tajam

- harus

- Menunjukkan

- ditunjukkan

- Pertunjukkan

- menutup

- penting

- signifikan

- Sederhana

- tunggal

- Ukuran

- So

- MEMECAHKAN

- beberapa

- sumber

- kode sumber

- Space

- spesialis

- tertentu

- kecepatan

- membagi

- Berpisah

- Spot

- awal

- Mulai

- startup

- Status

- Langkah

- Tangga

- terhenti

- henti

- Berhenti

- penyimpanan

- Penyelarasan

- seperti itu

- menderita

- RINGKASAN

- mendukung

- Mendukung

- tabel

- diambil

- Dibutuhkan

- Teknis

- teknik

- tensorflow

- istilah

- istilah

- dari

- bahwa

- Grafik

- Sumber

- mereka

- Mereka

- kemudian

- Sana.

- dengan demikian

- karena itu

- Ini

- mereka

- ini

- itu

- tiga

- Melalui

- waktu

- kali

- untuk

- mengambil

- Total

- lalu lintas

- Pelatihan VE

- terlatih

- Pelatihan

- transfer

- pohon

- mencoba

- Dua kali

- dua

- jenis

- khas

- bawah

- pemahaman

- mungkin

- tidak perlu

- diperbarui

- Pembaruan

- memperbarui

- us

- menggunakan

- bekas

- kegunaan

- menggunakan

- Penggunaan

- pengesahan

- nilai

- Nilai - Nilai

- visualisasi

- vs

- ingin

- adalah

- Cara..

- we

- jaringan

- layanan web

- berat

- pergi

- ketika

- sedangkan

- yang

- mengapa

- Wikipedia

- akan

- dengan

- dalam

- tanpa

- pekerja

- bekerja

- lebih buruk

- akan

- XGBoost

- tahun

- Kamu

- Anda

- zephyrnet.dll