Pelanggan dihadapkan pada peningkatan ancaman dan kerentanan keamanan di seluruh infrastruktur dan sumber daya aplikasi seiring dengan meluasnya jejak digital mereka dan dampak bisnis dari aset digital tersebut. Tantangan umum terhadap keamanan siber ada dua:

- Menggunakan log dari sumber daya digital dalam format dan skema berbeda serta mengotomatiskan analisis temuan ancaman berdasarkan log tersebut.

- Baik log berasal dari Amazon Web Services (AWS), penyedia cloud lainnya, perangkat lokal, atau edge, pelanggan perlu memusatkan dan menstandardisasi data keamanan.

Selain itu, analisis untuk mengidentifikasi ancaman keamanan harus mampu ditingkatkan dan dikembangkan untuk memenuhi lanskap pelaku ancaman, vektor keamanan, dan aset digital yang terus berubah.

Pendekatan baru untuk memecahkan skenario analisis keamanan yang kompleks ini menggabungkan penggunaan penyerapan dan penyimpanan data keamanan Danau Keamanan Amazon dan menganalisis data keamanan dengan menggunakan pembelajaran mesin (ML). Amazon SageMaker. Amazon Security Lake adalah layanan yang dibuat khusus yang secara otomatis memusatkan data keamanan organisasi dari sumber cloud dan lokal ke dalam data lake yang dibuat khusus dan disimpan di akun AWS Anda. Amazon Security Lake mengotomatiskan pengelolaan pusat data keamanan, menormalkan log dari layanan AWS terintegrasi dan layanan pihak ketiga, serta mengelola siklus hidup data dengan retensi yang dapat disesuaikan dan juga mengotomatiskan tingkat penyimpanan. Amazon Security Lake menyerap file log di Buka Kerangka Kerja Skema Keamanan Siber (OCSF), dengan dukungan untuk mitra seperti Cisco Security, CrowdStrike, Palo Alto Networks, dan log OCSF dari sumber daya di luar lingkungan AWS Anda. Skema terpadu ini menyederhanakan konsumsi dan analisis hilir karena data mengikuti skema standar dan sumber baru dapat ditambahkan dengan perubahan saluran data yang minimal. Setelah data log keamanan disimpan di Amazon Security Lake, pertanyaannya adalah bagaimana menganalisisnya. Pendekatan efektif untuk menganalisis data log keamanan adalah menggunakan ML; khususnya, deteksi anomali, yang memeriksa data aktivitas dan lalu lintas dan membandingkannya dengan data dasar. Garis dasar menentukan aktivitas apa yang secara statistik normal untuk lingkungan tersebut. Deteksi anomali melampaui tanda peristiwa individual, dan dapat berkembang dengan pelatihan ulang berkala; lalu lintas yang tergolong tidak normal atau anomali kemudian dapat ditindaklanjuti dengan fokus dan urgensi yang diprioritaskan. Amazon SageMaker adalah layanan terkelola sepenuhnya yang memungkinkan pelanggan menyiapkan data dan membangun, melatih, dan menerapkan model ML untuk setiap kasus penggunaan dengan infrastruktur, alat, dan alur kerja yang terkelola sepenuhnya, termasuk penawaran tanpa kode untuk analis bisnis. SageMaker mendukung dua algoritma deteksi anomali bawaan: Wawasan IP dan Hutan Tebang Acak. Anda juga dapat menggunakan SageMaker untuk membuat model deteksi outlier kustom Anda sendiri menggunakan algoritma bersumber dari beberapa framework ML.

Dalam postingan ini, Anda mempelajari cara menyiapkan data yang bersumber dari Amazon Security Lake, lalu melatih dan menerapkan model ML menggunakan algoritma IP Insights di SageMaker. Model ini mengidentifikasi lalu lintas atau perilaku jaringan yang tidak wajar yang kemudian dapat disusun sebagai bagian dari solusi keamanan end-to-end yang lebih besar. Solusi seperti itu dapat meminta pemeriksaan autentikasi multi-faktor (MFA) jika pengguna masuk dari server yang tidak biasa atau pada waktu yang tidak biasa, memberi tahu staf jika ada pemindaian jaringan mencurigakan yang berasal dari alamat IP baru, memperingatkan administrator jika jaringan tidak biasa protokol atau port yang digunakan, atau memperkaya hasil klasifikasi wawasan IP dengan sumber data lain seperti Tugas Penjaga Amazon dan skor reputasi IP untuk menentukan peringkat temuan ancaman.

Ikhtisar solusi

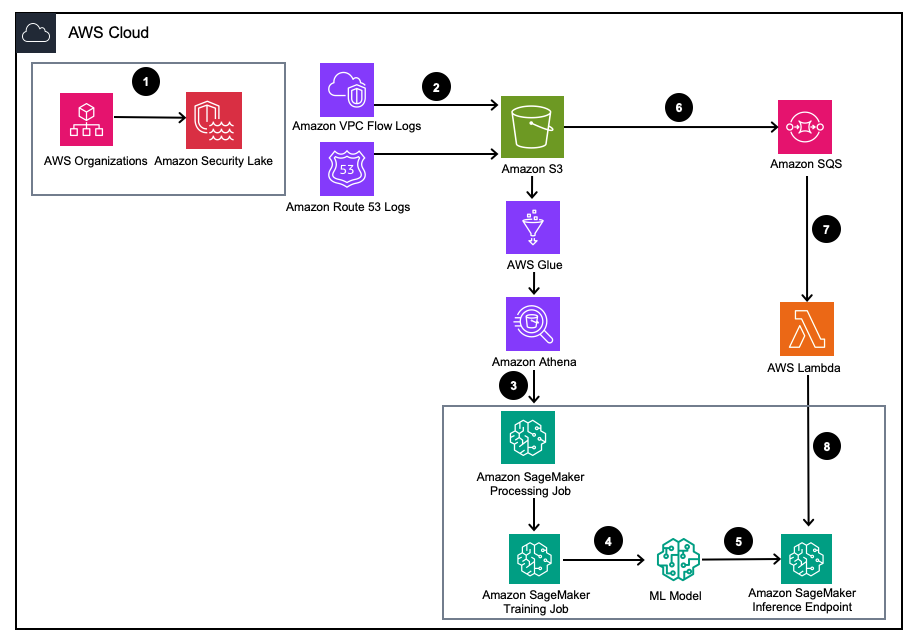

Gambar 1 – Arsitektur Solusi

- Aktifkan Amazon Security Lake dengan Organisasi AWS untuk akun AWS, Wilayah AWS, dan lingkungan TI eksternal.

- Siapkan sumber Security Lake dari Amazon Virtual Private Cloud (VPC Amazon) Log Aliran dan Rute Amazon53 Log DNS ke bucket Amazon Security Lake S3.

- Proses data log Amazon Security Lake menggunakan tugas SageMaker Processing untuk merekayasa fitur. Menggunakan Amazon Athena untuk menanyakan data log OCSF terstruktur Layanan Penyimpanan Sederhana Amazon (Amazon S3) melalui Lem AWS tabel yang dikelola oleh AWS LakeFormation.

- Latih model ML SageMaker menggunakan tugas Pelatihan SageMaker yang menggunakan log Amazon Security Lake yang diproses.

- Terapkan model ML terlatih ke titik akhir inferensi SageMaker.

- Simpan log keamanan baru di bucket S3 dan antrekan peristiwa di dalamnya Layanan Antrian Sederhana Amazon (Amazon SQS).

- Berlangganan sebuah AWS Lambda fungsi ke antrian SQS.

- Panggil titik akhir inferensi SageMaker menggunakan fungsi Lambda untuk mengklasifikasikan log keamanan sebagai anomali secara real-time.

Prasyarat

Untuk menyebarkan solusi, Anda harus menyelesaikan prasyarat berikut terlebih dahulu:

- Aktifkan Amazon Security Lake dalam organisasi Anda atau satu akun dengan Log Alur VPC dan log penyelesai Route 53 diaktifkan.

- Pastikan bahwa Identitas dan Manajemen Akses AWS (IAM) peran yang digunakan oleh pekerjaan pemrosesan dan buku catatan SageMaker telah diberikan kebijakan IAM termasuk Izin akses permintaan pelanggan Amazon Security Lake untuk database dan tabel Amazon Security lake terkelola yang dikelola oleh AWS Lake Formation. Pekerjaan pemrosesan ini harus dijalankan dari dalam akun analitik atau alat keamanan agar tetap patuh Arsitektur Referensi Keamanan AWS (AWS SRA).

- Pastikan bahwa IAM role yang digunakan oleh fungsi Lambda telah diberikan kebijakan IAM termasuk Izin akses data pelanggan Amazon Security Lake.

Terapkan solusinya

Untuk menyiapkan lingkungan, selesaikan langkah-langkah berikut:

- Luncurkan a Studio SageMaker atau notebook SageMaker Jupyter dengan a

ml.m5.largecontoh. Catatan: Ukuran instans bergantung pada kumpulan data yang Anda gunakan. - Kloning GitHub gudang.

- Buka buku catatan

01_ipinsights/01-01.amazon-securitylake-sagemaker-ipinsights.ipy. - Terapkan menyediakan kebijakan IAM dan kebijakan kepercayaan IAM yang sesuai untuk instans Notebook SageMaker Studio Anda untuk mengakses semua data yang diperlukan di S3, Lake Formation, dan Athena.

Blog ini menelusuri bagian kode yang relevan dalam buku catatan setelah diterapkan di lingkungan Anda.

Instal dependensi dan impor perpustakaan yang diperlukan

Gunakan kode berikut untuk menginstal dependensi, mengimpor pustaka yang diperlukan, dan membuat bucket SageMaker S3 yang diperlukan untuk pemrosesan data dan pelatihan model. Salah satu perpustakaan yang diperlukan, awswrangler, adalah Kerangka data AWS SDK untuk panda yang digunakan untuk menanyakan tabel yang relevan dalam Katalog Data AWS Glue dan menyimpan hasilnya secara lokal dalam kerangka data.

Kueri tabel log aliran VPC Amazon Security Lake

Bagian kode ini menggunakan AWS SDK for pandas untuk menanyakan tabel AWS Glue yang terkait dengan Log Aliran VPC. Seperti disebutkan dalam prasyarat, tabel Amazon Security Lake dikelola oleh Formasi Danau AWS, jadi semua izin yang sesuai harus diberikan pada peran yang digunakan oleh notebook SageMaker. Kueri ini akan menarik lalu lintas log aliran VPC selama beberapa hari. Dataset yang digunakan selama pengembangan blog ini kecil. Bergantung pada skala kasus penggunaan Anda, Anda harus menyadari batasan AWS SDK for pandas. Saat mempertimbangkan skala terabyte, Anda harus mempertimbangkan dukungan AWS SDK for pandas Modin.

Saat Anda melihat bingkai data, Anda akan melihat output dari satu kolom dengan bidang umum yang dapat ditemukan di Aktivitas Jaringan (4001) kelas OCSF.

Normalisasikan data log aliran VPC Amazon Security Lake ke dalam format pelatihan yang diperlukan untuk IP Insights.

Algoritme IP Insights mengharuskan data pelatihan dalam format CSV dan berisi dua kolom. Kolom pertama harus berupa string buram yang sesuai dengan pengidentifikasi unik suatu entitas. Kolom kedua harus berupa alamat IPv4 peristiwa akses entitas dalam notasi titik desimal. Dalam contoh kumpulan data untuk blog ini, pengidentifikasi uniknya adalah ID Instans instans EC2 yang terkait dengan instance_id nilai dalam dataframe. Alamat IPv4 akan diperoleh dari src_endpoint. Berdasarkan cara pembuatan kueri Amazon Athena, data yang diimpor sudah dalam format yang benar untuk melatih model IP Insights, sehingga tidak diperlukan rekayasa fitur tambahan. Jika Anda mengubah kueri dengan cara lain, Anda mungkin perlu memasukkan rekayasa fitur tambahan.

Kueri dan normalkan tabel log penyelesai Amazon Security Lake Route 53

Sama seperti yang Anda lakukan di atas, langkah selanjutnya dari notebook menjalankan kueri serupa terhadap tabel penyelesai Amazon Security Lake Route 53. Karena Anda akan menggunakan semua data yang mematuhi OCSF dalam notebook ini, tugas rekayasa fitur apa pun untuk log penyelesai Route 53 tetap sama seperti untuk Log Alur VPC. Anda kemudian menggabungkan dua bingkai data menjadi satu bingkai data yang digunakan untuk pelatihan. Karena kueri Amazon Athena memuat data secara lokal dalam format yang benar, tidak diperlukan rekayasa fitur lebih lanjut.

Dapatkan gambar pelatihan IP Insights dan latih model dengan data OCSF

Di bagian notebook berikutnya, Anda melatih model ML berdasarkan algoritma IP Insights dan menggunakan konsolidasi dataframe OCSF dari berbagai jenis log. Daftar hyperparmeter IP Insights dapat ditemukan di sini. Pada contoh di bawah ini kami memilih hyperparameter yang menghasilkan model berperforma terbaik, misalnya, 5 untuk epoch dan 128 untuk vector_dim. Karena kumpulan data pelatihan untuk sampel kami relatif kecil, kami menggunakan a ml.m5.large contoh. Hyperparameter dan konfigurasi pelatihan Anda seperti jumlah instans dan jenis instans harus dipilih berdasarkan metrik tujuan dan ukuran data pelatihan Anda. Salah satu kemampuan yang dapat Anda manfaatkan dalam Amazon SageMaker untuk menemukan versi terbaik model Anda adalah Amazon SageMaker penyetelan model otomatis yang mencari model terbaik di berbagai nilai hyperparameter.

Terapkan model terlatih dan uji dengan lalu lintas yang valid dan anomali

Setelah model dilatih, Anda menerapkan model ke titik akhir SageMaker dan mengirimkan serangkaian pengidentifikasi unik dan kombinasi alamat IPv4 untuk menguji model Anda. Bagian kode ini mengasumsikan Anda memiliki data pengujian yang disimpan di bucket S3 Anda. Data pengujian berupa file .csv, dengan kolom pertama adalah id instance dan kolom kedua adalah IP. Disarankan untuk menguji data yang valid dan tidak valid untuk melihat hasil model. Kode berikut menyebarkan titik akhir Anda.

Setelah titik akhir Anda diterapkan, Anda kini dapat mengirimkan permintaan inferensi untuk mengidentifikasi apakah lalu lintas berpotensi anomali. Di bawah ini adalah contoh tampilan data yang diformat. Dalam hal ini, pengidentifikasi kolom pertama adalah id instans dan kolom kedua adalah alamat IP terkait seperti yang ditunjukkan berikut ini:

Setelah Anda memiliki data dalam format CSV, Anda dapat mengirimkan data untuk inferensi menggunakan kode dengan membaca file .csv dari bucket S3.:

Output untuk model IP Insights memberikan ukuran tentang seberapa diharapkan alamat IP dan sumber daya online secara statistik. Namun rentang alamat dan sumber daya ini tidak terbatas, jadi ada pertimbangan tentang bagaimana Anda menentukan apakah kombinasi ID instans dan alamat IP harus dianggap anomali.

Pada contoh sebelumnya, empat kombinasi pengidentifikasi dan IP berbeda dikirimkan ke model. Dua kombinasi pertama adalah kombinasi ID instans dan alamat IP yang valid yang diharapkan berdasarkan set pelatihan. Kombinasi ketiga memiliki pengidentifikasi unik yang benar tetapi alamat IP berbeda dalam subnet yang sama. Model harus menentukan bahwa terdapat sedikit anomali karena penyematannya sedikit berbeda dari data pelatihan. Kombinasi keempat memiliki pengidentifikasi unik yang valid tetapi alamat IP dari subnet yang tidak ada dalam VPC mana pun di lingkungan tersebut.

Catatan: Data lalu lintas normal dan tidak normal akan berubah berdasarkan kasus penggunaan spesifik Anda, misalnya: jika Anda ingin memantau lalu lintas eksternal dan internal, Anda memerlukan pengidentifikasi unik yang selaras dengan setiap alamat IP dan skema untuk menghasilkan pengidentifikasi eksternal.

Untuk menentukan berapa ambang batas Anda untuk menentukan apakah lalu lintas anomali dapat dilakukan dengan menggunakan lalu lintas normal dan tidak normal yang diketahui. Langkah-langkah yang diuraikan dalam contoh buku catatan ini adalah sebagai berikut:

- Buatlah set pengujian untuk mewakili lalu lintas normal.

- Tambahkan lalu lintas abnormal ke dalam kumpulan data.

- Plot distribusinya

dot_productskor untuk model pada lalu lintas normal dan lalu lintas tidak normal. - Pilih nilai ambang batas yang membedakan subset normal dan subset abnormal. Nilai ini didasarkan pada toleransi positif palsu Anda

Siapkan pemantauan berkelanjutan terhadap lalu lintas log aliran VPC baru.

Untuk mendemonstrasikan bagaimana model ML baru ini dapat digunakan dengan Amazon Security Lake secara proaktif, kami akan mengonfigurasi fungsi Lambda untuk dipanggil pada setiap PutObject peristiwa dalam bucket terkelola Amazon Security Lake, khususnya data log aliran VPC. Di dalam Amazon Security Lake terdapat konsep pelanggan, yang menggunakan log dan peristiwa dari Amazon Security Lake. Fungsi Lambda yang merespons peristiwa baru harus diberikan langganan akses data. Pelanggan akses data diberitahu tentang objek Amazon S3 baru untuk sumber saat objek tersebut ditulis ke bucket Security Lake. Pelanggan dapat langsung mengakses objek S3 dan menerima notifikasi objek baru melalui titik akhir langganan atau dengan melakukan polling pada antrean Amazon SQS.

- Buka Konsol Security Lake.

- Di panel navigasi, pilih Pelanggan.

- Di halaman Pelanggan, pilih Buat pelanggan.

- Untuk detail Pelanggan, masukkan

inferencelambdauntuk Nama pelanggan dan opsional Deskripsi Produk. - Grafik Daerah secara otomatis ditetapkan sebagai Wilayah AWS yang Anda pilih saat ini dan tidak dapat diubah.

- Untuk Sumber log dan peristiwa, pilih Log dan sumber peristiwa tertentu Dan pilihlah Log Aliran VPC dan log Route 53

- Untuk Metode akses data, pilih S3.

- Untuk Kredensial pelanggan, berikan ID akun AWS Anda dari akun tempat fungsi Lambda akan berada dan yang ditentukan pengguna tanda pengenal eksternal.

Catatan: Jika melakukan ini secara lokal di dalam akun, Anda tidak perlu memiliki ID eksternal. - Pilih membuat.

Buat fungsi Lambda

Untuk membuat dan menerapkan fungsi Lambda, Anda dapat menyelesaikan langkah-langkah berikut atau menerapkan templat SAM bawaan 01_ipinsights/01.02-ipcheck.yaml di repo GitHub. Templat SAM mengharuskan Anda memberikan SQS ARN dan nama titik akhir SageMaker.

- Pada konsol Lambda, pilih Buat fungsi.

- Pilih Penulis dari awal.

- Untuk Nama Fungsi, Masuk

ipcheck. - Untuk Runtime, pilih Python 3.10.

- Untuk Arsitektur, pilih x86_64.

- Untuk Peran eksekusi, pilih Buat peran baru dengan izin Lambda.

- Setelah Anda membuat fungsi, masukkan konten ipcheck.py file dari repo GitHub.

- Di panel navigasi, pilih Variabel Lingkungan.

- Pilih Edit.

- Pilih Tambahkan variabel lingkungan.

- Untuk variabel lingkungan baru, enter

ENDPOINT_NAMEdan untuk nilai, masukkan ARN titik akhir yang dihasilkan selama penerapan titik akhir SageMaker. - Pilih Save.

- Pilih Menyebarkan.

- Di panel navigasi, pilih konfigurasi.

- Pilih pemicu.

- Pilih Tambahkan pemicu.

- Bawah Pilih sumber, pilih persegi.

- Bawah antrian SQS, masukkan ARN antrean SQS utama yang dibuat oleh Security Lake.

- Pilih kotak centang untuk Aktifkan pemicu.

- Pilih Add.

Validasi temuan Lambda

- Buka Konsol Amazon CloudWatch.

- Di panel sebelah kiri, pilih Grup log.

- Di bilah pencarian, masukkan ipcheck, lalu pilih grup log dengan nama

/aws/lambda/ipcheck. - Pilih aliran log terbaru di bawah Aliran log.

- Di dalam log, Anda akan melihat hasil seperti berikut untuk setiap log Amazon Security Lake baru:

{'predictions': [{'dot_product': 0.018832731992006302}, {'dot_product': 0.018832731992006302}]}

Fungsi Lambda ini terus menganalisis lalu lintas jaringan yang diserap oleh Amazon Security Lake. Hal ini memungkinkan Anda membangun mekanisme untuk memberi tahu tim keamanan Anda ketika ambang batas yang ditentukan dilanggar, yang akan mengindikasikan adanya lalu lintas yang tidak wajar di lingkungan Anda.

Membersihkan

Ketika Anda selesai bereksperimen dengan solusi ini dan untuk menghindari biaya pada akun Anda, bersihkan sumber daya Anda dengan menghapus bucket S3, titik akhir SageMaker, mematikan komputasi yang terpasang pada notebook SageMaker Jupyter, menghapus fungsi Lambda, dan menonaktifkan Amazon Security Danau di akun Anda.

Kesimpulan

Dalam postingan ini Anda mempelajari cara menyiapkan data lalu lintas jaringan yang bersumber dari Amazon Security Lake untuk pembelajaran mesin, lalu melatih dan menerapkan model ML menggunakan algoritma IP Insights di Amazon SageMaker. Semua langkah yang diuraikan dalam notebook Jupyter dapat direplikasi dalam pipeline ML end-to-end. Anda juga menerapkan fungsi AWS Lambda yang menggunakan log Amazon Security Lake baru dan mengirimkan inferensi berdasarkan model deteksi anomali yang dilatih. Respons model ML yang diterima oleh AWS Lambda dapat secara proaktif memberi tahu tim keamanan tentang lalu lintas yang tidak wajar ketika ambang batas tertentu terpenuhi. Peningkatan berkelanjutan pada model dapat dilakukan dengan menyertakan tim keamanan Anda dalam tinjauan loop untuk memberi label apakah lalu lintas yang diidentifikasi sebagai anomali merupakan positif palsu atau bukan. Ini kemudian dapat ditambahkan ke set pelatihan Anda dan juga ditambahkan ke set pelatihan Anda normal kumpulan data lalu lintas saat menentukan ambang batas empiris. Model ini dapat mengidentifikasi lalu lintas atau perilaku jaringan yang berpotensi anomali sehingga dapat dimasukkan sebagai bagian dari solusi keamanan yang lebih besar untuk memulai pemeriksaan MFA jika pengguna masuk dari server yang tidak biasa atau pada waktu yang tidak biasa, memperingatkan staf jika ada hal yang mencurigakan. pemindaian jaringan yang berasal dari alamat IP baru, atau gabungkan skor wawasan IP dengan sumber lain seperti Amazon Guard Duty untuk menentukan peringkat temuan ancaman. Model ini dapat menyertakan sumber log kustom seperti Azure Flow Logs atau log lokal dengan menambahkan sumber kustom ke penerapan Amazon Security Lake Anda.

Di bagian 2 dari seri postingan blog ini, Anda akan mempelajari cara membuat model deteksi anomali menggunakan Hutan Tebang Acak algoritma yang dilatih dengan sumber Amazon Security Lake tambahan yang mengintegrasikan data log keamanan jaringan dan host serta menerapkan klasifikasi anomali keamanan sebagai bagian dari solusi pemantauan keamanan otomatis dan komprehensif.

Tentang penulis

Joe Morotti adalah Arsitek Solusi di Amazon Web Services (AWS), membantu pelanggan Perusahaan di seluruh Midwest AS. Dia telah memegang berbagai peran teknis dan menikmati menunjukkan seni pelanggan yang mungkin. Di waktu luangnya, ia menikmati menghabiskan waktu berkualitas bersama keluarganya menjelajahi tempat-tempat baru dan menganalisis kinerja tim olahraganya secara berlebihan.

Joe Morotti adalah Arsitek Solusi di Amazon Web Services (AWS), membantu pelanggan Perusahaan di seluruh Midwest AS. Dia telah memegang berbagai peran teknis dan menikmati menunjukkan seni pelanggan yang mungkin. Di waktu luangnya, ia menikmati menghabiskan waktu berkualitas bersama keluarganya menjelajahi tempat-tempat baru dan menganalisis kinerja tim olahraganya secara berlebihan.

Bishr Tabbaa adalah arsitek solusi di Amazon Web Services. Bishr berspesialisasi dalam membantu pelanggan dengan aplikasi pembelajaran mesin, keamanan, dan pengamatan. Di luar pekerjaan, dia senang bermain tenis, memasak, dan menghabiskan waktu bersama keluarga.

Bishr Tabbaa adalah arsitek solusi di Amazon Web Services. Bishr berspesialisasi dalam membantu pelanggan dengan aplikasi pembelajaran mesin, keamanan, dan pengamatan. Di luar pekerjaan, dia senang bermain tenis, memasak, dan menghabiskan waktu bersama keluarga.

Sriharsh Adari adalah Arsitek Solusi Senior di Amazon Web Services (AWS), di mana dia membantu pelanggan bekerja mundur dari hasil bisnis untuk mengembangkan solusi inovatif di AWS. Selama bertahun-tahun, dia telah membantu banyak pelanggan dalam transformasi platform data di seluruh vertikal industri. Bidang keahlian utamanya meliputi Strategi Teknologi, Analisis Data, dan Ilmu Data. Di waktu luangnya, ia menikmati bermain tenis, menonton acara TV, dan bermain Tabla.

Sriharsh Adari adalah Arsitek Solusi Senior di Amazon Web Services (AWS), di mana dia membantu pelanggan bekerja mundur dari hasil bisnis untuk mengembangkan solusi inovatif di AWS. Selama bertahun-tahun, dia telah membantu banyak pelanggan dalam transformasi platform data di seluruh vertikal industri. Bidang keahlian utamanya meliputi Strategi Teknologi, Analisis Data, dan Ilmu Data. Di waktu luangnya, ia menikmati bermain tenis, menonton acara TV, dan bermain Tabla.

- Konten Bertenaga SEO & Distribusi PR. Dapatkan Amplifikasi Hari Ini.

- PlatoData.Jaringan Vertikal Generatif Ai. Berdayakan Diri Anda. Akses Di Sini.

- PlatoAiStream. Intelijen Web3. Pengetahuan Diperkuat. Akses Di Sini.

- PlatoESG. Karbon, teknologi bersih, energi, Lingkungan Hidup, Tenaga surya, Penanganan limbah. Akses Di Sini.

- PlatoHealth. Kecerdasan Uji Coba Biotek dan Klinis. Akses Di Sini.

- Sumber: https://aws.amazon.com/blogs/machine-learning/identify-cybersecurity-anomalies-in-your-amazon-security-lake-data-using-amazon-sagemaker/

- :memiliki

- :adalah

- :bukan

- :Di mana

- $NAIK

- 01

- 1

- 10

- 100

- 12

- 125

- 15%

- 17

- 20000

- 25

- 32

- 7

- 9

- a

- atas

- mengakses

- Akun

- Akun

- di seluruh

- kegiatan

- aktor

- menambahkan

- menambahkan

- Tambahan

- alamat

- alamat

- administrator

- Setelah

- terhadap

- Waspada

- algoritma

- algoritma

- selaras

- Semua

- memungkinkan

- sudah

- juga

- Amazon

- Amazon Athena

- Amazon SageMaker

- Amazon Web Services

- Layanan Web Amazon (AWS)

- an

- analisis

- Analis

- analisis

- menganalisa

- analisis

- menganalisis

- dan

- kelainan

- deteksi anomali

- Lain

- Apa pun

- Aplikasi

- aplikasi

- Mendaftar

- pendekatan

- arsitektur

- ADALAH

- DAERAH

- Seni

- AS

- Aktiva

- terkait

- mengasumsikan

- At

- Otentikasi

- Otomatis

- mengotomatiskan

- secara otomatis

- mengotomatisasi

- menghindari

- sadar

- AWS

- Lem AWS

- Formasi Danau AWS

- AWS Lambda

- Biru langit

- bar

- berdasarkan

- Dasar

- BE

- karena

- menjadi

- menjadi

- laku

- makhluk

- di bawah

- TERBAIK

- Luar

- Blog

- kedua

- membangun

- built-in

- bisnis

- tapi

- by

- CAN

- kemampuan

- mampu

- kasus

- katalog

- pusat

- memusatkan

- tertentu

- menantang

- perubahan

- Perubahan

- mengubah

- beban

- memeriksa

- Pilih

- terpilih

- Cisco

- kelas

- klasifikasi

- tergolong

- Klasifikasi

- membersihkan

- awan

- kode

- Kolom

- Kolom

- kombinasi

- kombinasi

- menggabungkan

- menggabungkan

- bagaimana

- kedatangan

- Umum

- lengkap

- kompleks

- compliant

- tersusun

- luas

- menghitung

- konsep

- Mempertimbangkan

- pertimbangan

- dianggap

- mengingat

- konsul

- dikonsumsi

- konsumsi

- mengandung

- isi

- terus-menerus

- kontinu

- Core

- benar

- berkorespondensi

- bisa

- membuat

- dibuat

- Sekarang

- adat

- pelanggan

- disesuaikan

- Memotong

- Keamanan cyber

- data

- akses data

- Data Analytics

- Danau Data

- Platform Data

- pengolahan data

- ilmu data

- Basis Data

- kumpulan data

- Hari

- Mendefinisikan

- mendemonstrasikan

- ketergantungan

- tergantung

- Tergantung

- menyebarkan

- dikerahkan

- penyebaran

- menyebarkan

- Berasal

- rincian

- Deteksi

- Menentukan

- menentukan

- mengembangkan

- Pengembangan

- Devices

- MELAKUKAN

- berbeda

- digital

- Aset-Aset Digital

- langsung

- distribusi

- dns

- doesn

- melakukan

- don

- dilakukan

- Dont

- turun

- selama

- e

- setiap

- Tepi

- Efektif

- antara

- lain

- embedding

- diaktifkan

- memungkinkan

- ujung ke ujung

- Titik akhir

- insinyur

- Teknik

- menikmati

- memperkaya

- Enter

- Enterprise

- Lingkungan Hidup

- lingkungan

- masa

- kesalahan

- Acara

- peristiwa

- berkembang

- berkembang

- Memeriksa

- contoh

- Kecuali

- ada

- diperluas

- diharapkan

- keahlian

- Menjelajahi

- luar

- dihadapi

- palsu

- keluarga

- Fitur

- Fitur

- Fields

- File

- File

- Menemukan

- Temuan

- Pertama

- aliran

- Fokus

- berikut

- berikut

- Tapak

- Untuk

- format

- pembentukan

- ditemukan

- empat

- Keempat

- FRAME

- kerangka

- Gratis

- dari

- sepenuhnya

- fungsi

- lebih lanjut

- menghasilkan

- GitHub

- diberikan

- Kelompok

- dewasa

- Penjaga

- Memiliki

- he

- Dimiliki

- membantu

- membantu

- membantu

- -nya

- tuan rumah

- Seterpercayaapakah Olymp Trade? Kesimpulan

- How To

- Namun

- HTML

- HTTPS

- ID

- diidentifikasi

- identifier

- pengidentifikasi

- mengidentifikasi

- mengenali

- mengidentifikasi

- identitas

- id

- if

- gambar

- Dampak

- diimplementasikan

- mengimpor

- perbaikan

- in

- memasukkan

- termasuk

- Termasuk

- menggabungkan

- meningkatkan

- menunjukkan

- sendiri-sendiri

- industri

- Infrastruktur

- memulai

- inovatif

- wawasan

- install

- contoh

- mengintegrasikan

- terpadu

- intern

- ke

- dipanggil

- IP

- Alamat IP

- Alamat IP

- IT

- Pekerjaan

- Jobs

- jpg

- json

- dikenal

- label

- danau

- pemandangan

- besar

- lebih besar

- BELAJAR

- belajar

- pengetahuan

- meninggalkan

- perpustakaan

- siklus hidup

- 'like'

- batas

- Daftar

- beban

- lokal

- mencatat

- melihat

- terlihat seperti

- mesin

- Mesin belajar

- Utama

- berhasil

- pengelolaan

- mengelola

- cara

- Mungkin..

- mengukur

- mekanisme

- Pelajari

- tersebut

- bertemu

- Metrik

- MFA

- midwest

- minimal

- hilang

- ML

- model

- model

- sederhana

- dimodifikasi

- memodifikasi

- Memantau

- pemantauan

- paling

- beberapa

- harus

- nama

- Navigasi

- perlu

- Perlu

- dibutuhkan

- jaringan

- lalu lintas jaringan

- jaringan

- New

- berikutnya

- tidak

- tidak ada

- normal

- buku catatan

- pemberitahuan

- novel

- sekarang

- tujuan

- objek

- of

- Penawaran

- on

- ONE

- secara online

- buram

- or

- organisasi

- OS

- Lainnya

- kami

- hasil

- orang asing

- diuraikan

- keluaran

- di luar

- lebih

- sendiri

- halaman

- Palo Alto

- panda

- pane

- bagian

- rekan

- melakukan

- berkala

- izin

- Izin

- pipa saluran

- Tempat

- Platform

- plato

- Kecerdasan Data Plato

- Data Plato

- bermain

- kebijaksanaan

- bagian

- port

- positif

- mungkin

- Pos

- berpotensi

- mendahului

- Prediksi

- Predictor

- Mempersiapkan

- prasyarat

- diprioritaskan

- swasta

- Proaktif

- Diproses

- pengolahan

- tepat

- protokol

- memberikan

- penyedia

- menyediakan

- kualitas

- pertanyaan

- menaikkan

- jarak

- peringkat

- Bacaan

- nyata

- real-time

- menerima

- diterima

- baru

- direkomendasikan

- referensi

- wilayah

- daerah

- terkait

- relatif

- relevan

- tinggal

- direplikasi

- mewakili

- reputasi

- permintaan

- wajib

- membutuhkan

- sumber

- Sumber

- tanggapan

- tanggapan

- mengakibatkan

- Hasil

- penyimpanan

- Review

- Peran

- peran

- Rute

- Run

- berjalan

- pembuat bijak

- Inferensi SageMaker

- Universitas

- sama

- Contoh kumpulan data

- disimpan

- Skala

- sisik

- skala

- pemindaian

- skenario

- skema

- Ilmu

- skor

- SDK

- Pencarian

- pencarian

- Kedua

- keamanan

- Ancaman keamanan

- melihat

- memilih

- terpilih

- mengirim

- senior

- Seri

- Server

- layanan

- Layanan

- Sidang

- set

- harus

- ditunjukkan

- Pertunjukkan

- mematikan

- sisi

- tanda tangan

- penandatanganan

- mirip

- Sederhana

- sejak

- tunggal

- Ukuran

- sedikit berbeda

- kecil

- So

- larutan

- Solusi

- MEMECAHKAN

- sumber

- bersumber

- sumber

- spesialisasi

- tertentu

- Secara khusus

- ditentukan

- Pengeluaran

- Olahraga

- Staf

- Langkah

- Tangga

- penyimpanan

- menyimpan

- tersimpan

- Penyelarasan

- aliran

- merampingkan

- Tali

- tersusun

- studio

- menyerahkan

- disampaikan

- subnet

- langganan

- pelanggan

- berlangganan

- seperti itu

- mendukung

- Mendukung

- mencurigakan

- tabel

- tugas

- tim

- tim

- Teknis

- Teknologi

- Strategi Teknologi

- Template

- tenis

- uji

- bahwa

- Grafik

- mereka

- kemudian

- Sana.

- mereka

- Ketiga

- pihak ketiga

- ini

- itu

- ancaman

- aktor ancaman

- ancaman

- ambang

- Melalui

- waktu

- untuk

- alat

- lalu lintas

- Pelatihan VE

- terlatih

- Pelatihan

- transformasi

- Kepercayaan

- mencoba

- tv

- dua

- dua kali lipat

- mengetik

- jenis

- bawah

- terpadu

- unik

- atas

- urgensi

- us

- menggunakan

- gunakan case

- bekas

- Pengguna

- kegunaan

- menggunakan

- Penggunaan

- dimanfaatkan

- sah

- nilai

- Nilai - Nilai

- variabel

- versi

- vertikal

- View

- dilanggar

- maya

- Kerentanan

- berjalan

- ingin

- adalah

- Cara..

- we

- jaringan

- layanan web

- adalah

- Apa

- ketika

- apakah

- yang

- lebar

- Rentang luas

- akan

- dengan

- dalam

- Kerja

- Alur kerja

- akan

- tertulis

- tahun

- Kamu

- Anda

- zephyrnet.dll