Ottenere la certificazione AWS può aiutarti a dare slancio alla tua carriera, sia che tu stia cercando di trovare un nuovo ruolo, mostrare le tue capacità per affrontare un nuovo progetto o diventare l'esperto di riferimento del tuo team. E poiché gli esami di certificazione AWS sono creati da esperti nel ruolo o nell'area tecnica pertinente, la preparazione per uno di questi esami ti aiuta a sviluppare le competenze richieste identificate da professionisti qualificati nel settore.

Leggere la pagina delle FAQ dei servizi AWS rilevanti per il tuo esame di certificazione è importante per acquisire una comprensione più approfondita del servizio. Tuttavia, questo potrebbe richiedere del tempo. La lettura delle FAQ anche di un solo servizio può richiedere mezza giornata per essere letta e compresa. Ad esempio, il Amazon Sage Maker FAQ contiene circa 33 pagine (stampate) di contenuti solo su SageMaker.

Non sarebbe un'esperienza di apprendimento più semplice e divertente se potessi utilizzare un sistema per metterti alla prova sulle pagine delle FAQ del servizio AWS? In realtà, puoi sviluppare un sistema del genere usando modelli di linguaggio all'avanguardia e poche righe di Python.

In questo post, presentiamo una guida completa per la distribuzione di una soluzione di quiz a scelta multipla per le pagine delle domande frequenti di qualsiasi servizio AWS, basata sul modello di base AI21 Jurassic-2 Jumbo Instruct su Avviamento di Amazon SageMaker.

Grandi modelli linguistici

Negli ultimi anni, i modelli linguistici hanno visto un enorme aumento di dimensioni e popolarità. Nel 2018, BERT-large ha fatto il suo debutto con i suoi 340 milioni di parametri e l'innovativa architettura del trasformatore, stabilendo il punto di riferimento per le prestazioni nelle attività di PNL. In pochi anni, lo stato dell'arte in termini di dimensioni del modello è aumentato di oltre 500 volte; GPT-3 e Bloom 176 B di OpenAI, entrambi con 175 miliardi di parametri, e AI21 Jurassic-2 Jumbo Instruct con 178 miliardi di parametri sono solo tre esempi di modelli di linguaggio di grandi dimensioni (LLM) che alzano il livello dell'accuratezza dell'elaborazione del linguaggio naturale (NLP).

Modelli di fondazione SageMaker

SageMaker fornisce una gamma di modelli da hub di modelli popolari tra cui Hugging Face, PyTorch Hub e TensorFlow Hub e modelli proprietari da AI21, Cohere e LightOn, a cui puoi accedere all'interno del tuo flusso di lavoro di sviluppo di machine learning (ML) in SageMaker. I recenti progressi nel machine learning hanno dato origine a una nuova classe di modelli noti come modelli di fondazione, che hanno miliardi di parametri e vengono addestrati su enormi quantità di dati. Questi modelli di base possono essere adattati a un'ampia gamma di casi d'uso, come il riepilogo del testo, la generazione di arte digitale e la traduzione linguistica. Poiché questi modelli possono essere costosi da addestrare, i clienti desiderano utilizzare i modelli di base pre-addestrati esistenti e perfezionarli secondo necessità, piuttosto che addestrare questi modelli da soli. SageMaker fornisce un elenco curato di modelli tra cui puoi scegliere sulla console SageMaker.

Con JumpStart, puoi trovare modelli di base di diversi fornitori, consentendoti di iniziare rapidamente con i modelli di base. Puoi esaminare le caratteristiche del modello e i termini di utilizzo e provare questi modelli utilizzando un widget dell'interfaccia utente di prova. Quando sei pronto per utilizzare un modello di base su larga scala, puoi farlo facilmente senza uscire da SageMaker utilizzando i notebook predefiniti dei fornitori di modelli. I tuoi dati, siano essi utilizzati per la valutazione o per l'utilizzo del modello su larga scala, non vengono mai condivisi con terze parti perché i modelli sono ospitati e distribuiti su AWS.

AI21 Jurassic-2 Jumbo Istruzione

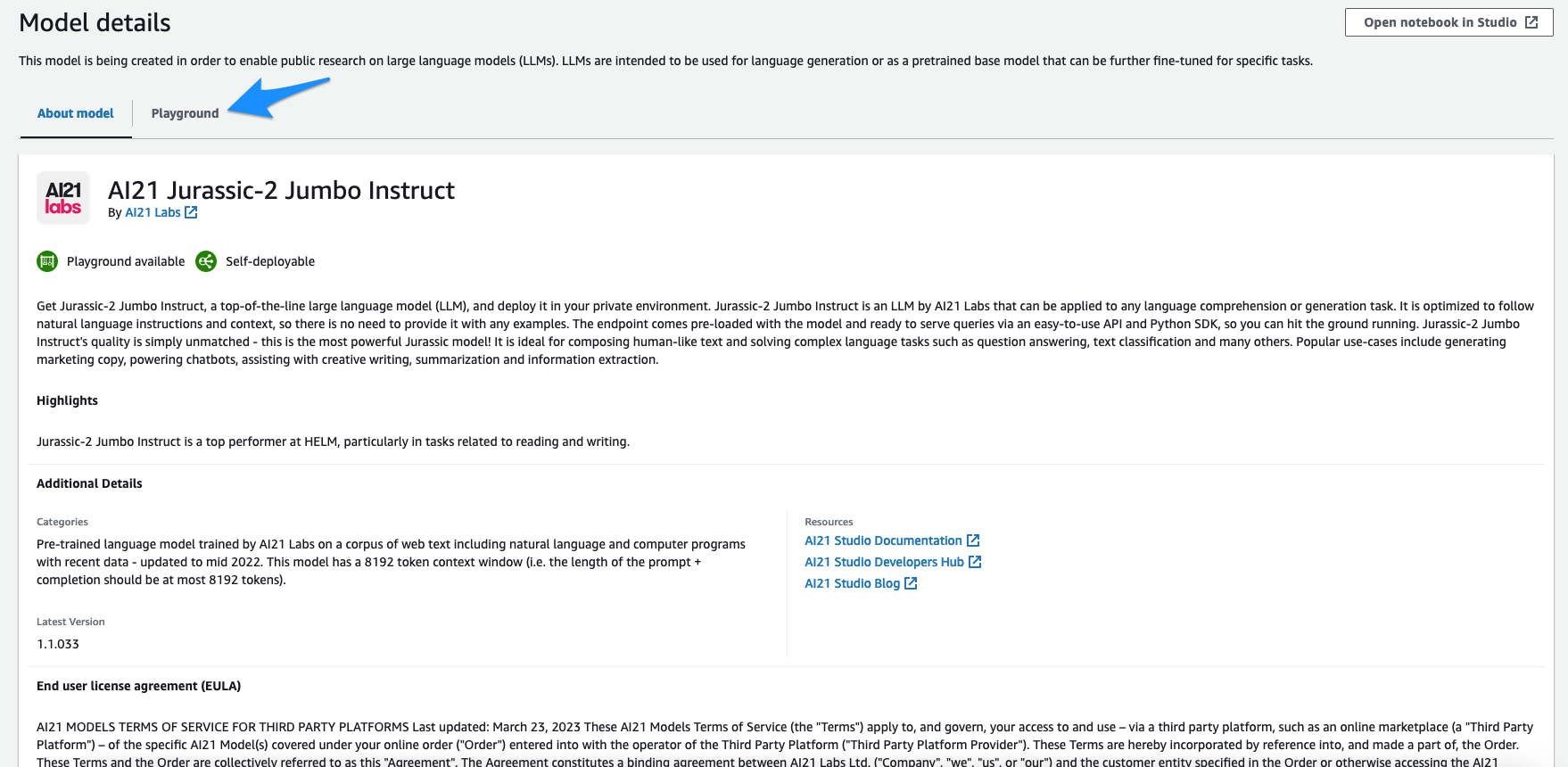

Jurassic-2 Jumbo Instruct è un LLM di AI21 Labs che può essere applicato a qualsiasi attività di comprensione o generazione della lingua. È ottimizzato per seguire le istruzioni e il contesto del linguaggio naturale, quindi non è necessario fornire esempi. L'endpoint viene fornito precaricato con il modello ed è pronto per servire le query tramite un'API di facile utilizzo e Python SDK, in modo da poter iniziare subito. Jurassic-2 Jumbo Instruct è uno dei migliori in HELM, in particolare nelle attività relative alla lettura e alla scrittura.

Panoramica della soluzione

Nelle sezioni seguenti, esaminiamo i passaggi per testare il modello Jurassic-2 Jumbo instruct in SageMaker:

- Scegli il modello di istruzioni Jurassic-2 Jumbo sulla console SageMaker.

- Valuta il modello usando il playground.

- Usa un notebook associato al modello di base per distribuirlo nel tuo ambiente.

Accedi a Jurassic-2 Jumbo Instruct tramite la console SageMaker

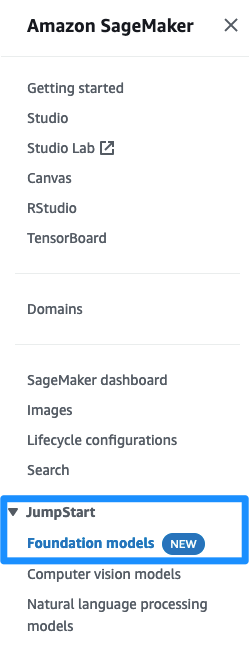

Il primo passo è accedere alla console SageMaker. Sotto inizio di salto nel pannello di navigazione, scegli Modelli di fondazione per richiedere l'accesso all'elenco dei modelli.

Dopo che il tuo account è stato autorizzato nell'elenco, puoi visualizzare un elenco di modelli in questa pagina e cercare il modello Jurassic-2 Jumbo Instruct.

Valuta il modello Jurassic-2 Jumbo Instruct nel parco giochi modello

Nell'elenco AI21 Jurassic-2 Jumbo Instruct, scegli Vedi il modello. Vedrai una descrizione del modello e le attività che puoi eseguire. Leggere l'EULA per il modello prima di procedere.

Proviamo prima il modello per generare un test basato sulla pagina delle domande frequenti di SageMaker. Naviga verso il Parco giochi scheda.

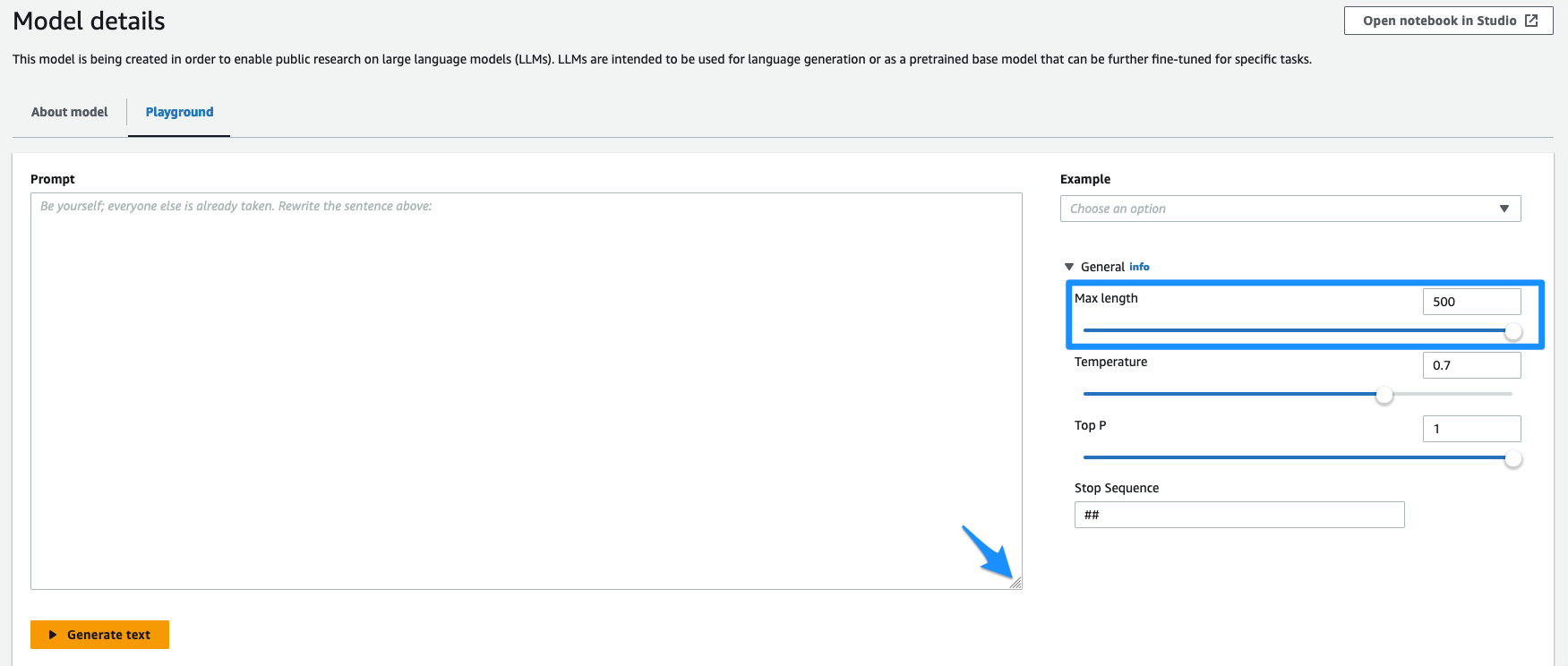

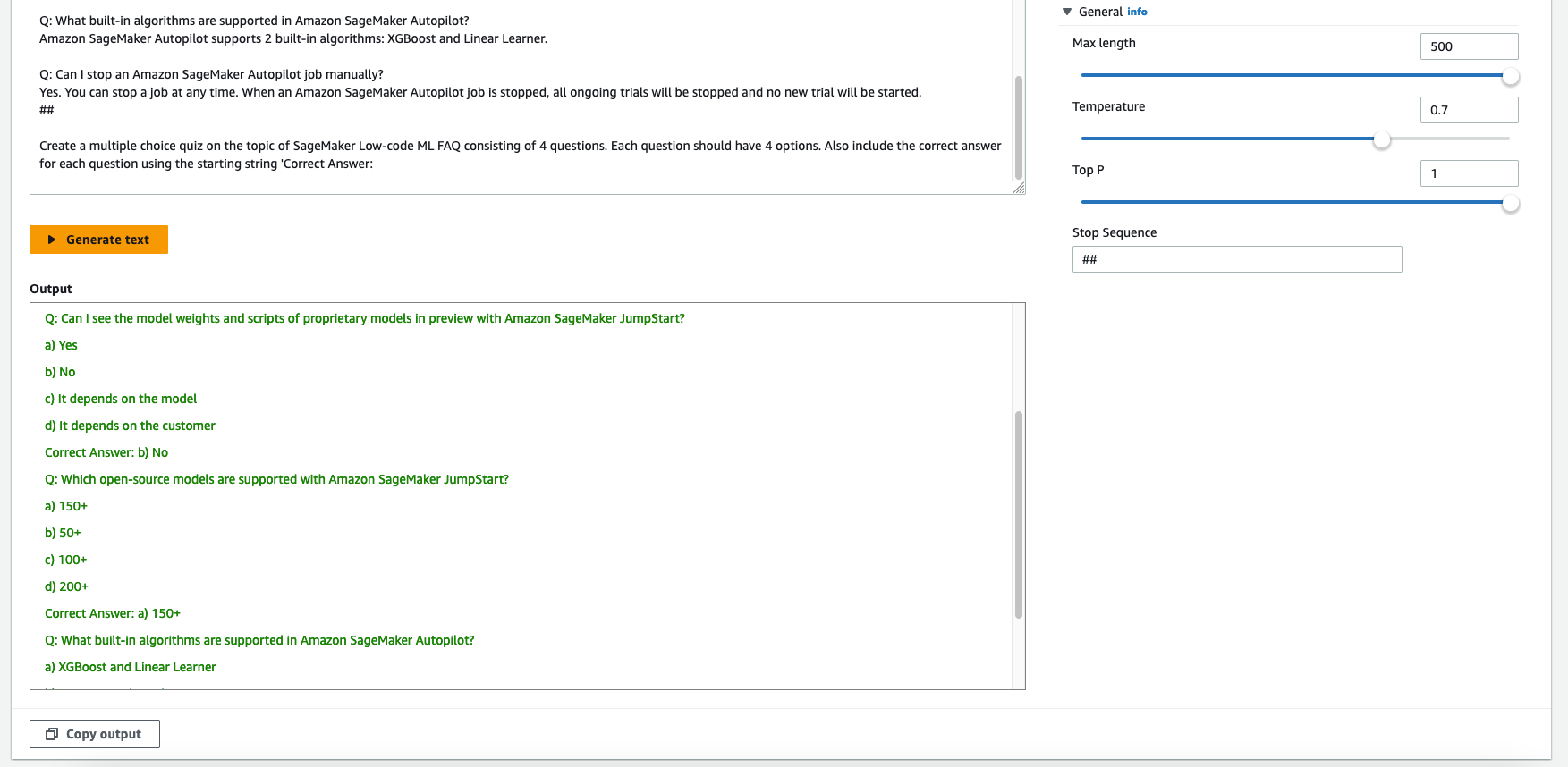

Sulla Parco giochi scheda, puoi fornire prompt di esempio al modello Jurassic-2 Jumbo Instruct e visualizzare l'output.

Tieni presente che puoi utilizzare un massimo di 500 token. Impostiamo la lunghezza massima su 500, che è il numero massimo di token da generare. Questo modello ha una finestra di contesto di 8,192 token (la lunghezza del prompt più il completamento dovrebbe essere al massimo di 8,192 token).

Per facilitare la visualizzazione del prompt, è possibile ingrandire il file Richiesta scatola.

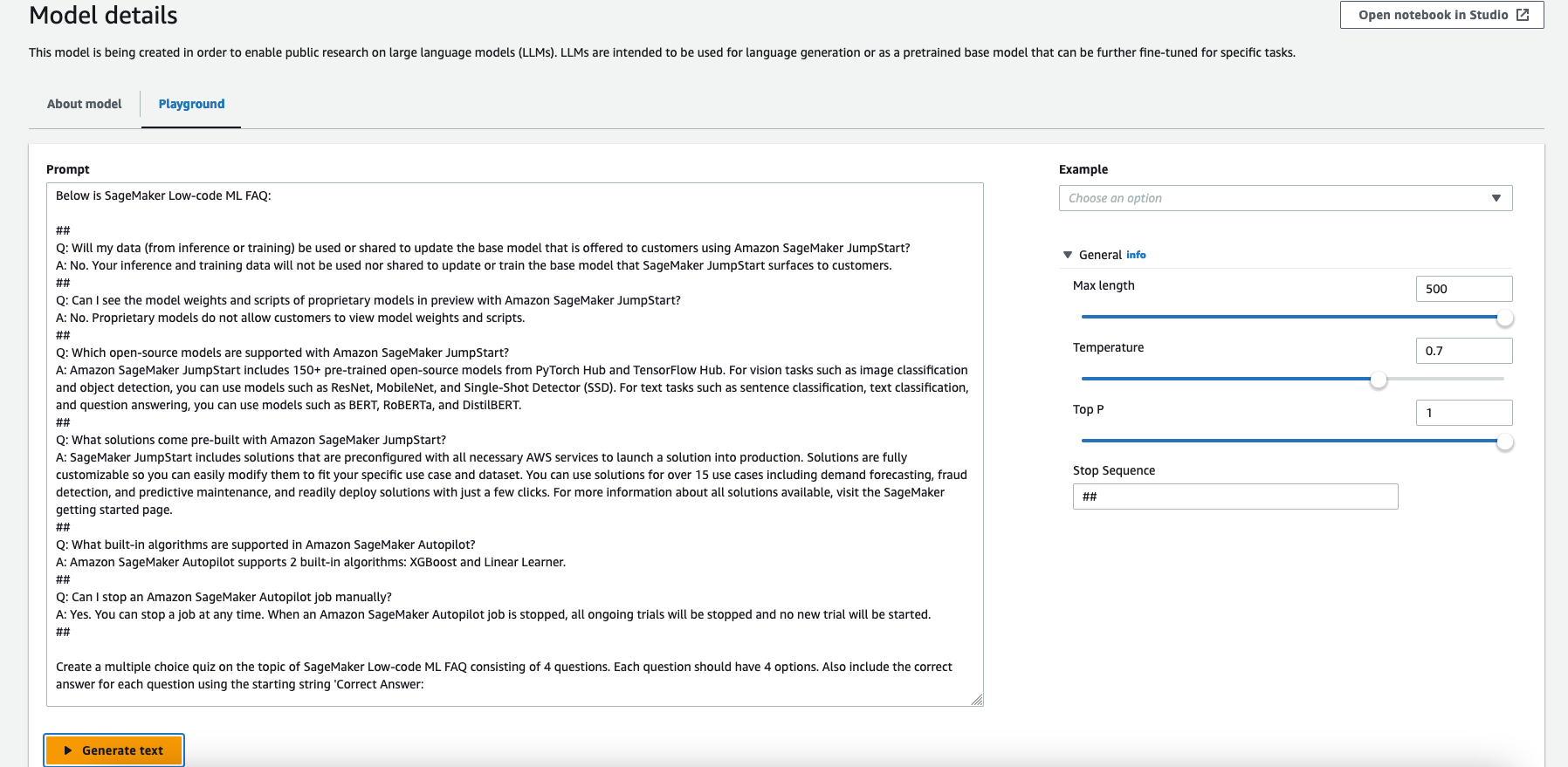

Poiché possiamo utilizzare un massimo di 500 token, prendiamo una piccola parte del Pagina delle domande frequenti su Amazon SageMaker, le ML a basso codice sezione, per il nostro prompt di prova.

Usiamo il seguente prompt:

L'ingegnerizzazione rapida è un processo iterativo. Dovresti essere chiaro e specifico e dare al modello il tempo di pensare.

Qui abbiamo specificato il contesto con ## come sequenze di arresto, che segnalano al modello di interrompere la generazione dopo la generazione di questo carattere o stringa. È utile quando si utilizza un prompt di pochi colpi.

Successivamente, siamo chiari e molto specifici nel nostro prompt, chiedendo un quiz a scelta multipla, composto da quattro domande con quattro opzioni. Chiediamo al modello di includere la risposta corretta per ogni domanda utilizzando la stringa iniziale 'Correct Answer:' quindi possiamo analizzarlo in seguito usando Python:

Un prompt ben progettato può rendere il modello più creativo e generalizzato in modo che possa adattarsi facilmente a nuove attività. I prompt possono anche aiutare a incorporare la conoscenza del dominio su attività specifiche e migliorare l'interpretabilità. L'ingegnerizzazione rapida può migliorare notevolmente le prestazioni dei modelli di apprendimento zero-shot e few-shot. La creazione di prompt di alta qualità richiede un'attenta considerazione dell'attività da svolgere, nonché una profonda comprensione dei punti di forza e dei limiti del modello.

Nell'ambito di questo post, non copriamo ulteriormente questa vasta area.

Copia il prompt e inseriscilo nel file Richiesta casella, quindi scegli Genera testo.

Questo invia il prompt al modello Jurassic-2 Jumbo Instruct per l'inferenza. Nota che sperimentare nel parco giochi è gratuito.

Tieni inoltre presente che, nonostante la natura all'avanguardia degli LLM, sono ancora soggetti a pregiudizi, errori e allucinazioni.

Dopo aver letto l'output del modello in modo completo e attento, possiamo vedere che il modello ha generato un buon quiz!

Dopo aver giocato con il modello, è il momento di utilizzare il notebook e distribuirlo come endpoint nel proprio ambiente. Usiamo una piccola funzione Python per analizzare l'output e simulare un test interattivo.

Distribuisci il modello di base Jurassic-2 Jumbo Instruct da un notebook

Puoi usare quanto segue taccuino di esempio per distribuire Jurassic-2 Jumbo Instruct utilizzando SageMaker. Si noti che questo esempio utilizza un'istanza ml.p4d.24xlarge. Se il tuo limite predefinito per il tuo account AWS è 0, devi farlo richiedere un aumento del limite per questa istanza GPU.

Creiamo l'endpoint utilizzando l'inferenza di SageMaker. Innanzitutto, impostiamo le variabili necessarie, quindi distribuiamo il modello dal pacchetto del modello:

Dopo la distribuzione dell'endpoint, puoi eseguire query di inferenza sul modello.

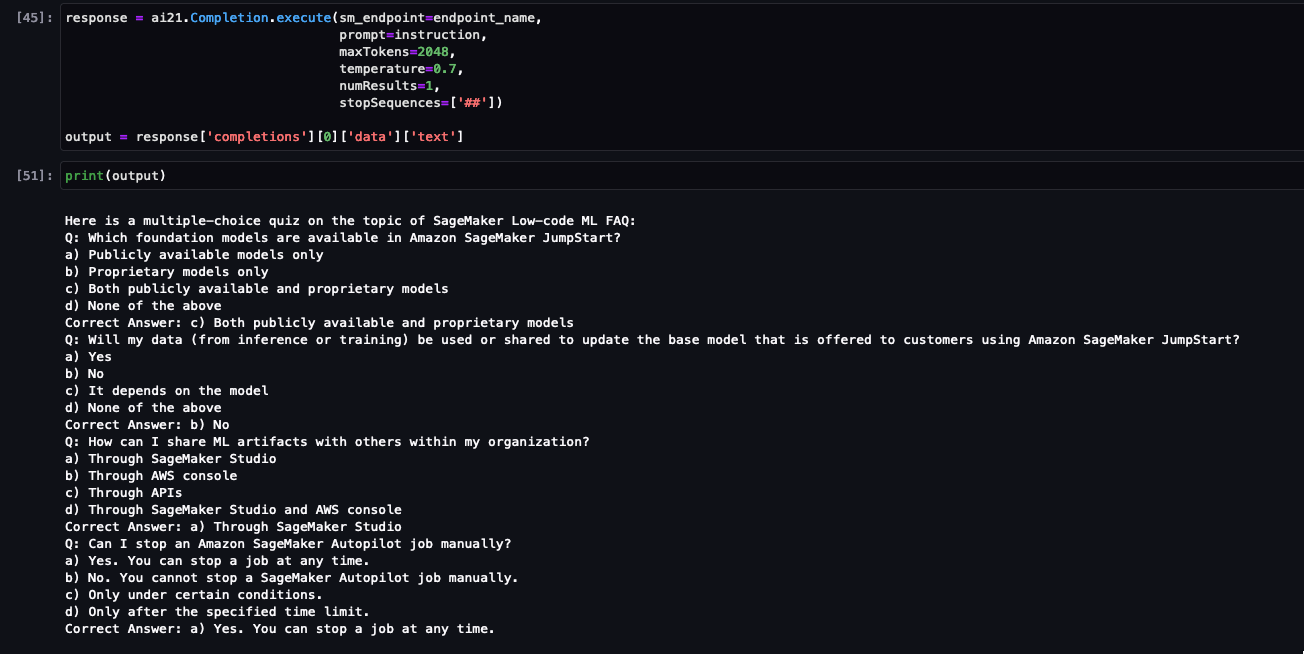

Dopo che il modello è stato distribuito, puoi interagire con l'endpoint distribuito utilizzando il seguente frammento di codice:

Con il modello di base Jurassic-2 Jumbo Instruct distribuito su un endpoint SageMaker dell'istanza ml.p4d.24xlarge, puoi utilizzare un prompt con 4,096 token. Puoi prendere lo stesso suggerimento che abbiamo usato nel parco giochi e aggiungere molte altre domande. In questo esempio, abbiamo aggiunto l'intero file FAQ ML a basso codice section come contesto nel prompt.

Possiamo vedere l'output del modello, che ha generato un quiz a scelta multipla con quattro domande e quattro opzioni per ogni domanda.

Ora puoi sviluppare una funzione Python per analizzare l'output e creare un quiz interattivo a scelta multipla.

È abbastanza semplice sviluppare una funzione del genere con poche righe di codice. Puoi analizzare facilmente la risposta perché il modello ha creato una riga con "Risposta corretta:" per ogni domanda, esattamente come richiesto nel prompt. Non forniamo il codice Python per la generazione del quiz nell'ambito di questo post.

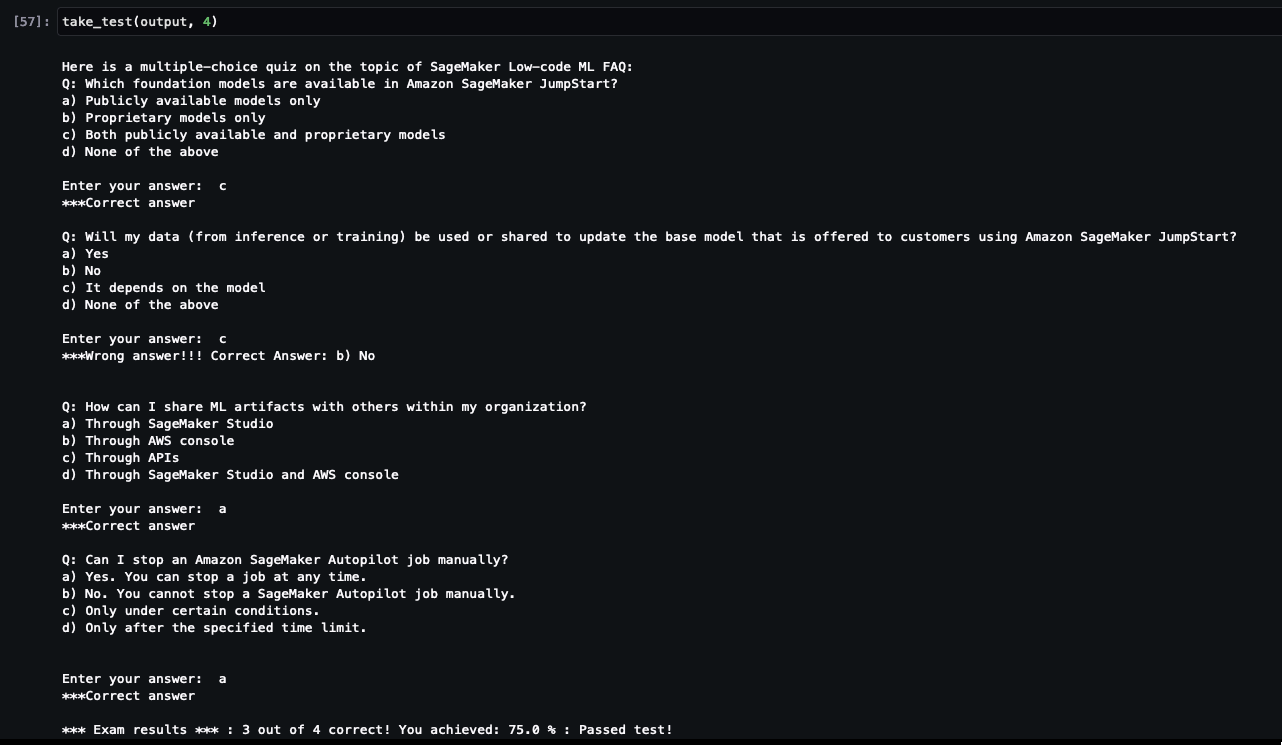

Esegui il quiz sul quaderno

Utilizzando la funzione Python creata in precedenza e l'output del modello di base Jurassic-2 Jumbo Instruct, eseguiamo il quiz interattivo nel notebook.

Puoi vedere che ho risposto correttamente a tre domande su quattro e ho ottenuto un voto del 75%. Forse devo leggere le FAQ di SageMaker ancora qualche volta!

ripulire

Dopo aver provato l'endpoint, assicurati di rimuovere l'endpoint di inferenza SageMaker e il modello per evitare eventuali addebiti:

Conclusione

In questo post, ti abbiamo mostrato come testare e utilizzare il modello Jurassic-21 Jumbo Instruct di AI2 utilizzando SageMaker per creare un sistema di generazione automatica di quiz. Ciò è stato ottenuto utilizzando un prompt piuttosto semplice con il testo di una pagina delle domande frequenti di SageMaker disponibile pubblicamente incorporato e alcune righe di codice Python.

Simile a questo esempio menzionato nel post, puoi personalizzare un modello di base per la tua attività con solo alcuni esempi etichettati. Poiché tutti i dati sono crittografati e non lasciano il tuo account AWS, puoi essere certo che i tuoi dati rimarranno privati e riservati.

Richiedi l'accesso a prova il modello di base in SageMaker oggi e facci sapere il tuo feedback!

L'autore

Eitan Sela è un architetto specializzato in soluzioni di machine learning con Amazon Web Services. Collabora con i clienti AWS per fornire guida e assistenza tecnica, aiutandoli a creare e utilizzare soluzioni di machine learning su AWS. Nel tempo libero, Eitan si diverte a fare jogging e leggere gli ultimi articoli sull'apprendimento automatico.

Eitan Sela è un architetto specializzato in soluzioni di machine learning con Amazon Web Services. Collabora con i clienti AWS per fornire guida e assistenza tecnica, aiutandoli a creare e utilizzare soluzioni di machine learning su AWS. Nel tempo libero, Eitan si diverte a fare jogging e leggere gli ultimi articoli sull'apprendimento automatico.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoAiStream. Intelligenza dei dati Web3. Conoscenza amplificata. Accedi qui.

- Coniare il futuro con Adryenn Ashley. Accedi qui.

- Acquista e vendi azioni in società PRE-IPO con PREIPO®. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/accelerate-your-learning-towards-aws-certification-exams-with-automated-quiz-generation-using-amazon-sagemaker-foundations-models/

- :ha

- :È

- :non

- 1

- 100

- 14

- 15%

- 17

- 2018

- 23

- 500

- 7

- 8

- 9

- a

- WRI

- accelerare

- accesso

- Il mio account

- precisione

- raggiunto

- acquisire

- effettivamente

- adattare

- aggiungere

- aggiunto

- avanzamenti

- Dopo shavasana, sedersi in silenzio; saluti;

- contro

- Algoritmi

- Tutti

- consentire

- anche

- Amazon

- Amazon Sage Maker

- Pilota automatico Amazon SageMaker

- JumpStart di Amazon SageMaker

- Amazon Web Services

- importi

- an

- ed

- rispondere

- in qualsiasi

- api

- applicato

- architettura

- SONO

- RISERVATA

- Arte

- news

- AS

- Assistenza

- associato

- At

- Automatizzata

- disponibile

- AWS

- bar

- base

- basato

- BE

- perché

- diventare

- prima

- Segno di riferimento

- pregiudizi

- Miliardo

- miliardi

- Fioritura

- entrambi

- Scatola

- costruire

- incassato

- affari

- by

- Materiale

- Career

- attento

- attentamente

- Custodie

- casi

- Certificazione

- Certificato

- carattere

- caratteristiche

- oneri

- scegliere

- Scegli

- classe

- classificazione

- pulire campo

- codice

- Venire

- viene

- completamento

- globale

- considerazione

- Consistente

- consolle

- contiene

- contenuto

- contesto

- correggere

- potuto

- coprire

- creare

- creato

- Creazione

- Creative

- a cura

- Clienti

- personalizzabile

- personalizzare

- bordo tagliente

- dati

- giorno

- deep

- più profondo

- Predefinito

- Richiesta

- Previsione della domanda

- schierare

- schierato

- distribuzione

- descrizione

- Nonostante

- rivelazione

- sviluppare

- Mercato

- diverso

- digitale

- Arte digitale

- do

- non

- dominio

- Dont

- ogni

- In precedenza

- più facile

- facilmente

- facile da usare

- incorporato

- consentendo

- crittografato

- endpoint

- Ingegneria

- ingrandire

- entrare

- Intero

- Ambiente

- errori

- la valutazione

- Anche

- di preciso

- e la

- esempio

- Esempi

- esistente

- costoso

- esperienza

- esperto

- esperti

- Faccia

- FAQ

- pochi

- campo

- Trovate

- Nome

- in forma

- seguire

- i seguenti

- Nel

- Fondazione

- Fondazioni

- quattro

- frode

- rilevazione di frodi

- Gratis

- da

- completamente

- ti divertirai

- function

- ulteriormente

- generare

- generato

- la generazione di

- ELETTRICA

- ottenere

- ottenere

- Dare

- dato

- Go

- buono

- GPU

- grado

- molto

- Terra

- guida

- guida

- Metà

- cura

- Avere

- he

- Aiuto

- aiutare

- aiuta

- alta qualità

- il suo

- Colpire

- ospitato

- Come

- Tuttavia

- HTML

- HTTPS

- Hub

- Enorme

- i

- identificato

- if

- Immagine

- Classificazione delle immagini

- importante

- competenze

- in

- includere

- inclusi

- Compreso

- incorporare

- informazioni

- creativi e originali

- ingresso

- esempio

- istruzioni

- interagire

- interattivo

- ai miglioramenti

- IT

- SUO

- Lavoro

- ad appena

- mantenere

- Sapere

- conoscenze

- conosciuto

- Labs

- Lingua

- grandi

- dopo

- con i più recenti

- lanciare

- apprendimento

- Lasciare

- partenza

- Lunghezza

- lasciare

- LIMITE

- limiti

- linea

- Linee

- Lista

- elencati

- annuncio

- LLM

- ceppo

- cerca

- macchina

- machine learning

- fatto

- manutenzione

- make

- manualmente

- molti

- massiccio

- max

- massimo

- menzionato

- milione

- mente

- ML

- modello

- modelli

- modificare

- Scopri di più

- maggior parte

- multiplo

- my

- Naturale

- Elaborazione del linguaggio naturale

- Natura

- Navigare

- Navigazione

- necessaria

- Bisogno

- di applicazione

- mai

- New

- nlp

- no

- taccuino

- numero

- oggetto

- Rilevazione dell'oggetto

- of

- offerto

- on

- ONE

- quelli

- in corso

- open source

- operare

- ottimizzati

- Opzioni

- or

- minimo

- nostro

- su

- produzione

- ancora

- pacchetto

- pagina

- vetro

- parametri

- particolarmente

- parti

- Eseguire

- performance

- esecutore

- Forse

- Platone

- Platone Data Intelligence

- PlatoneDati

- giocato

- più

- Popolare

- popolarità

- porzione

- Post

- Predictor

- preparazione

- presenti

- prevenire

- Anteprima

- un bagno

- processi

- lavorazione

- Produzione

- progetto

- Spingere

- proprio

- fornire

- fornitori

- fornisce

- pubblicamente

- Python

- pytorch

- query

- domanda

- Domande

- rapidamente

- raccolta

- gamma

- piuttosto

- Leggi

- Lettura

- pronto

- recente

- relazionato

- pertinente

- rimanere

- rimuovere

- richiesta

- necessario

- richiede

- recensioni

- Aumento

- Ruolo

- Correre

- running

- sagemaker

- Inferenza di SageMaker

- stesso

- Scala

- portata

- script

- sdk

- Cerca

- Sezione

- sezioni

- vedere

- visto

- invia

- condanna

- servire

- servizio

- Servizi

- set

- regolazione

- condiviso

- Corti

- dovrebbero

- vetrina

- ha mostrato

- Segnali

- Un'espansione

- Taglia

- qualificato

- abilità

- piccole

- So

- soluzione

- Soluzioni

- alcuni

- specialista

- specifico

- specificato

- iniziato

- Di partenza

- state-of-the-art

- step

- Passi

- Ancora

- Fermare

- fermato

- lineare

- punti di forza

- Corda

- tale

- supportato

- supporti

- ondata

- sistema

- Fai

- Task

- task

- Consulenza

- tensorflow

- condizioni

- test

- Classificazione del testo

- di

- che

- Il

- Li

- si

- poi

- Là.

- Strumenti Bowman per analizzare le seguenti finiture:

- di

- think

- Terza

- terzi

- questo

- a fondo

- quelli

- tre

- Attraverso

- tempo

- volte

- a

- oggi

- Tokens

- top

- argomento

- verso

- Treni

- allenato

- Training

- trasformatore

- Traduzione

- prova

- studi clinici

- provato

- Affidati ad

- prova

- ui

- per

- capire

- e una comprensione reciproca

- Aggiornanento

- us

- Impiego

- uso

- caso d'uso

- utilizzato

- usa

- utilizzando

- molto

- via

- Visualizza

- visione

- Visita

- volere

- Prima

- we

- sito web

- servizi web

- WELL

- Che

- quando

- se

- quale

- largo

- Vasta gamma

- volere

- con

- entro

- senza

- flusso di lavoro

- lavori

- scrittura

- XGBoost

- anni

- sì

- Tu

- Trasferimento da aeroporto a Sharm

- te stesso

- zefiro