Questo post è stato scritto in collaborazione con Kostia Kofman e Jenny Tokar di Booking.com.

In qualità di leader globale nel settore dei viaggi online, Booking.com è sempre alla ricerca di modi innovativi per migliorare i propri servizi e fornire ai clienti esperienze su misura e senza soluzione di continuità. Il team Ranking di Booking.com svolge un ruolo fondamentale nel garantire che gli algoritmi di ricerca e raccomandazione siano ottimizzati per fornire i migliori risultati ai propri utenti.

Condividendo le risorse interne con altri team interni, gli scienziati del machine learning (ML) del team Ranking hanno spesso dovuto affrontare lunghi tempi di attesa per accedere alle risorse per l'addestramento e la sperimentazione dei modelli, mettendo a dura prova la loro capacità di sperimentare e innovare rapidamente. Riconoscendo la necessità di un'infrastruttura ML modernizzata, il team di Ranking ha intrapreso un viaggio per sfruttare la potenza di Amazon Sage Maker per creare, addestrare e distribuire modelli ML su larga scala.

Booking.com ha collaborato con Servizi professionali AWS creare una soluzione per accelerare il time-to-market per modelli ML migliorati attraverso i seguenti miglioramenti:

- Riduzione dei tempi di attesa delle risorse per la formazione e la sperimentazione

- Integrazione di funzionalità ML essenziali come l'ottimizzazione degli iperparametri

- Un ciclo di sviluppo ridotto per i modelli ML

Tempi di attesa ridotti significherebbero che il team potrebbe iterare e sperimentare rapidamente i modelli, ottenendo informazioni a un ritmo molto più rapido. L'utilizzo delle istanze disponibili on-demand di SageMaker ha consentito una riduzione dei tempi di attesa di dieci volte. In locale mancavano funzionalità essenziali di ML, come l'ottimizzazione degli iperparametri e la spiegabilità del modello. Il percorso di modernizzazione del team ha introdotto queste funzionalità Ottimizzazione automatica del modello di Amazon SageMaker ed Amazon SageMaker Chiarire. Infine, l'aspirazione del team era quella di ricevere un feedback immediato su ogni modifica apportata al codice, riducendo il ciclo di feedback da pochi minuti a un istante e riducendo così il ciclo di sviluppo dei modelli ML.

In questo post, approfondiamo il viaggio intrapreso dal team Ranking di Booking.com mentre ha sfruttato le capacità di SageMaker per modernizzare il proprio framework di sperimentazione ML. In questo modo, non solo hanno superato le sfide esistenti, ma hanno anche migliorato la loro esperienza di ricerca, avvantaggiando in definitiva milioni di viaggiatori in tutto il mondo.

Approccio alla modernizzazione

Il team di Ranking è composto da diversi scienziati ML, ciascuno dei quali deve sviluppare e testare il proprio modello offline. Quando un modello viene ritenuto positivo in base alla valutazione offline, può essere spostato nel test A/B di produzione. Se mostra miglioramenti online, può essere distribuito a tutti gli utenti.

L'obiettivo di questo progetto era creare un ambiente facile da usare per gli scienziati di ML da eseguire facilmente e personalizzabile Condutture per la costruzione di modelli Amazon SageMaker per testare le proprie ipotesi senza la necessità di codificare moduli lunghi e complicati.

Una delle numerose sfide affrontate è stata l'adattamento della soluzione pipeline locale esistente per l'utilizzo su AWS. La soluzione prevedeva due componenti chiave:

- Modifica ed estensione del codice esistente – La prima parte della nostra soluzione prevedeva la modifica e l'estensione del nostro codice esistente per renderlo compatibile con l'infrastruttura AWS. Ciò è stato fondamentale per garantire una transizione fluida dall'elaborazione on-premise a quella basata su cloud.

- Sviluppo pacchetto cliente – È stato sviluppato un pacchetto client che funge da wrapper attorno alle API SageMaker e al codice precedentemente esistente. Questo pacchetto combina i due, consentendo agli esperti di machine learning di configurare e distribuire facilmente pipeline di machine learning senza codifica.

Configurazione della pipeline SageMaker

La personalizzazione è fondamentale per la pipeline di creazione del modello ed è stata ottenuta attraverso config.ini, un ampio file di configurazione. Questo file funge da centro di controllo per tutti gli input e i comportamenti della pipeline.

Configurazioni disponibili all'interno config.ini includono:

- Dettagli della pipeline – Il professionista può definire il nome della pipeline, specificare quali passaggi devono essere eseguiti, determinare dove devono essere archiviati gli output Servizio di archiviazione semplice Amazon (Amazon S3) e seleziona quali set di dati utilizzare

- Dettagli dell'account AWS – Puoi decidere in quale regione deve essere eseguita la pipeline e quale ruolo deve essere utilizzato

- Configurazione specifica per passo – Per ogni passaggio della pipeline, puoi specificare dettagli come il numero e il tipo di istanze da utilizzare, insieme ai relativi parametri

Il codice seguente mostra un file di configurazione di esempio:

config.ini è un file con controllo della versione gestito da Git, che rappresenta la configurazione minima richiesta per un'esecuzione corretta della pipeline di addestramento. Durante lo sviluppo è possibile utilizzare file di configurazione locali che non sono controllati dalla versione. Questi file di configurazione locale devono contenere solo le impostazioni rilevanti per una corsa specifica, introducendo flessibilità senza complessità. Il client di creazione della pipeline è progettato per gestire più file di configurazione, dove l'ultimo ha la precedenza sulle impostazioni precedenti.

Passaggi della pipeline SageMaker

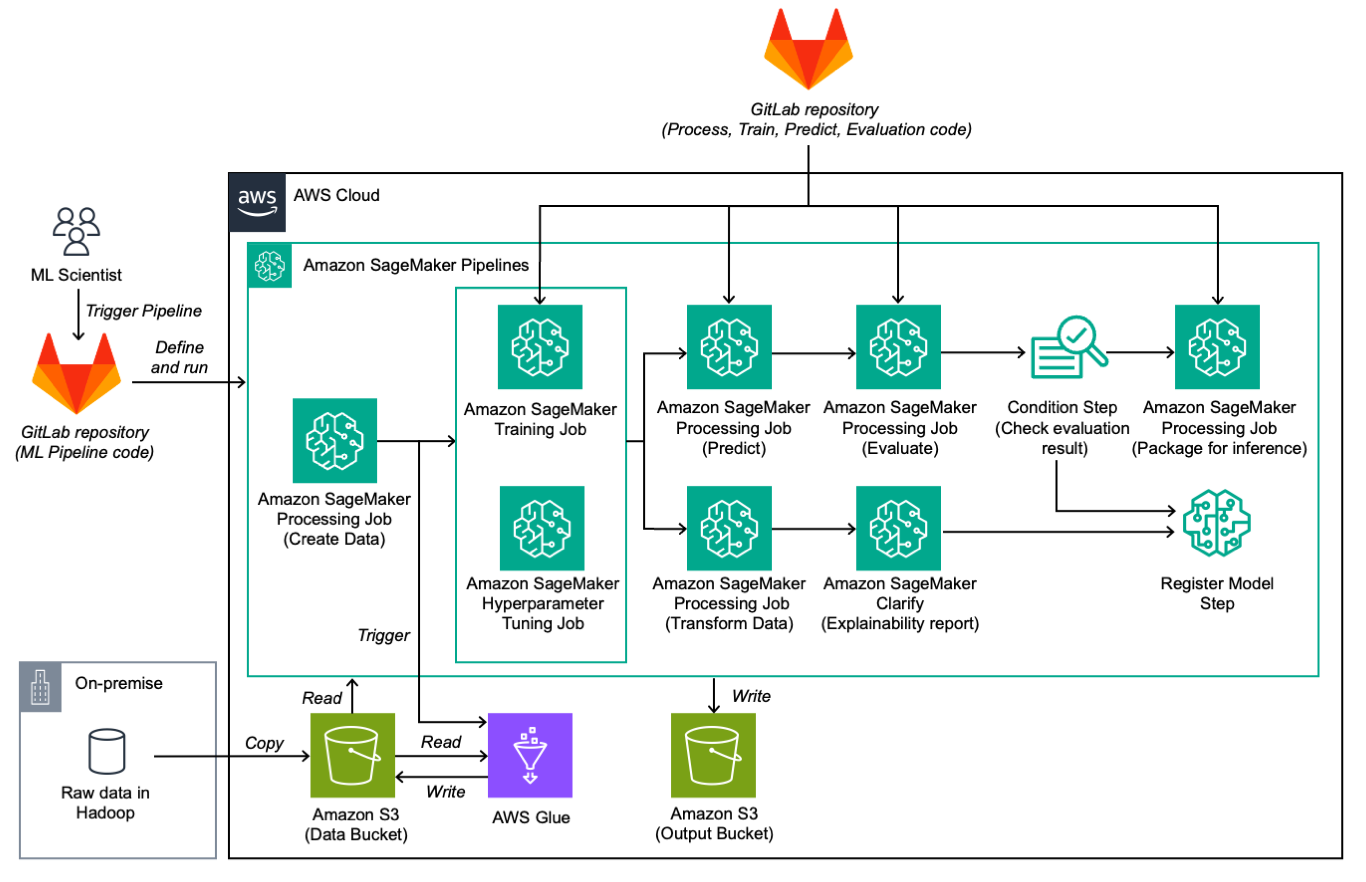

La pipeline è suddivisa nei seguenti passaggi:

- Preparazione dei dati di training e test – Terabyte di dati grezzi vengono copiati in un bucket S3, elaborati utilizzando Colla AWS lavori per l'elaborazione Spark, risultanti in dati strutturati e formattati per la compatibilità.

- Treni – La fase di training utilizza lo stimatore TensorFlow per i processi di training SageMaker. L'addestramento avviene in modo distribuito utilizzando Horovod e l'artefatto del modello risultante viene archiviato in Amazon S3. Per l'ottimizzazione degli iperparametri, è possibile avviare un processo di ottimizzazione degli iperparametri (HPO), selezionando il modello migliore in base alla metrica oggettiva.

- Prevedere – In questa fase, un processo di elaborazione SageMaker utilizza l'artefatto del modello archiviato per effettuare previsioni. Questo processo viene eseguito in parallelo sulle macchine disponibili e i risultati della previsione vengono archiviati in Amazon S3.

- Valutare – Un processo di elaborazione PySpark valuta il modello utilizzando uno script Spark personalizzato. Il report di valutazione viene quindi archiviato in Amazon S3.

- Condizione – Dopo la valutazione si decide sulla qualità del modello. Questa decisione si basa su una metrica di condizione definita nel file di configurazione. Se la valutazione è positiva, il modello viene registrato come approvato; in caso contrario viene registrato come rifiutato. In entrambi i casi, la relazione di valutazione e di spiegabilità, se generata, viene registrata nell'anagrafica del modello.

- Modello di pacchetto per l'inferenza – Utilizzando un processo di elaborazione, se i risultati della valutazione sono positivi, il modello viene assemblato, archiviato in Amazon S3 e reso pronto per il caricamento nel portale ML interno.

- Spiegare – SageMaker Clarify genera un rapporto di spiegabilità.

Vengono utilizzati due repository distinti. Il primo repository contiene la definizione e il codice di compilazione per la pipeline ML, mentre il secondo repository contiene il codice eseguito all'interno di ogni passaggio, ad esempio elaborazione, training, previsione e valutazione. Questo approccio a doppio repository consente una maggiore modularità e consente ai team scientifici e ingegneristici di eseguire iterazioni in modo indipendente sul codice ML e sui componenti della pipeline ML.

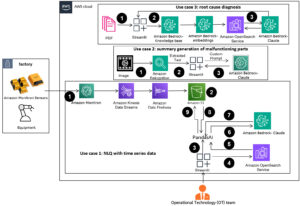

Il diagramma seguente illustra il flusso di lavoro della soluzione.

Ottimizzazione automatica del modello

L'addestramento dei modelli ML richiede un approccio iterativo di più esperimenti di addestramento per creare un modello finale robusto e performante per uso aziendale. Gli scienziati ML devono selezionare il tipo di modello appropriato, creare i set di dati di input corretti e regolare l'insieme di iperparametri che controllano il processo di apprendimento del modello durante l'addestramento.

La selezione di valori appropriati per gli iperparametri per il processo di training del modello può influenzare in modo significativo le prestazioni finali del modello. Tuttavia, non esiste un modo univoco o definito per determinare quali valori sono appropriati per un caso d'uso specifico. Nella maggior parte dei casi, gli scienziati ML dovranno eseguire più processi di addestramento con set di iperparametri leggermente diversi, osservare le metriche di addestramento del modello e quindi provare a selezionare valori più promettenti per l'iterazione successiva. Questo processo di ottimizzazione delle prestazioni del modello è noto anche come ottimizzazione degli iperparametri (HPO) e talvolta può richiedere centinaia di esperimenti.

Il team di Ranking eseguiva l'HPO manualmente nel proprio ambiente locale poiché poteva avviare solo un numero molto limitato di attività di formazione in parallelo. Pertanto, hanno dovuto eseguire l'HPO in sequenza, testare e selezionare manualmente diverse combinazioni di valori degli iperparametri e monitorare regolarmente i progressi. Ciò ha prolungato il processo di sviluppo e messa a punto del modello e ha limitato il numero complessivo di esperimenti HPO che potevano essere eseguiti in un periodo di tempo fattibile.

Con il passaggio ad AWS, il team di Ranking ha potuto utilizzare la funzionalità di ottimizzazione automatica dei modelli (AMT) di SageMaker. AMT consente agli scienziati di Ranking ML di avviare automaticamente centinaia di processi di formazione all'interno degli intervalli di iperparametri di interesse per trovare la versione con le migliori prestazioni del modello finale in base alla metrica scelta. Il team di Ranking può ora scegliere tra quattro diverse strategie di ottimizzazione automatica per la selezione degli iperparametri:

- Ricerca a griglia – AMT si aspetterà che tutti gli iperparametri siano valori categoriali e avvierà lavori di formazione per ciascuna combinazione categoriale distinta, esplorando l'intero spazio degli iperparametri.

- Ricerca casuale – AMT selezionerà in modo casuale le combinazioni di valori degli iperparametri entro gli intervalli forniti. Poiché non esiste alcuna dipendenza tra i diversi lavori di addestramento e la selezione del valore del parametro, con questo metodo è possibile avviare più lavori di addestramento paralleli, accelerando il processo di selezione dei parametri ottimale.

- Ottimizzazione bayesiana – AMT utilizza l’implementazione dell’ottimizzazione bayesiana per indovinare il miglior insieme di valori di iperparametri, trattandolo come un problema di regressione. Considererà le combinazioni di iperparametri precedentemente testate e il loro impatto sui lavori di formazione del modello con la nuova selezione dei parametri, ottimizzando per una selezione dei parametri più intelligente con meno esperimenti, ma avvierà anche i lavori di formazione solo in sequenza per essere sempre in grado di imparare dai corsi di formazione precedenti.

- Iperbanda – AMT utilizzerà i risultati intermedi e finali dei lavori di formazione in esecuzione per riallocare dinamicamente le risorse verso lavori di formazione con configurazioni di iperparametri che mostrano risultati più promettenti, interrompendo automaticamente quelli con prestazioni inferiori.

AMT su SageMaker ha consentito al team di Ranking di ridurre il tempo impiegato nel processo di ottimizzazione degli iperparametri per lo sviluppo del modello consentendo loro, per la prima volta, di eseguire più esperimenti paralleli, utilizzare strategie di ottimizzazione automatica ed eseguire processi di formazione a due cifre in pochi giorni. qualcosa che non era fattibile in sede.

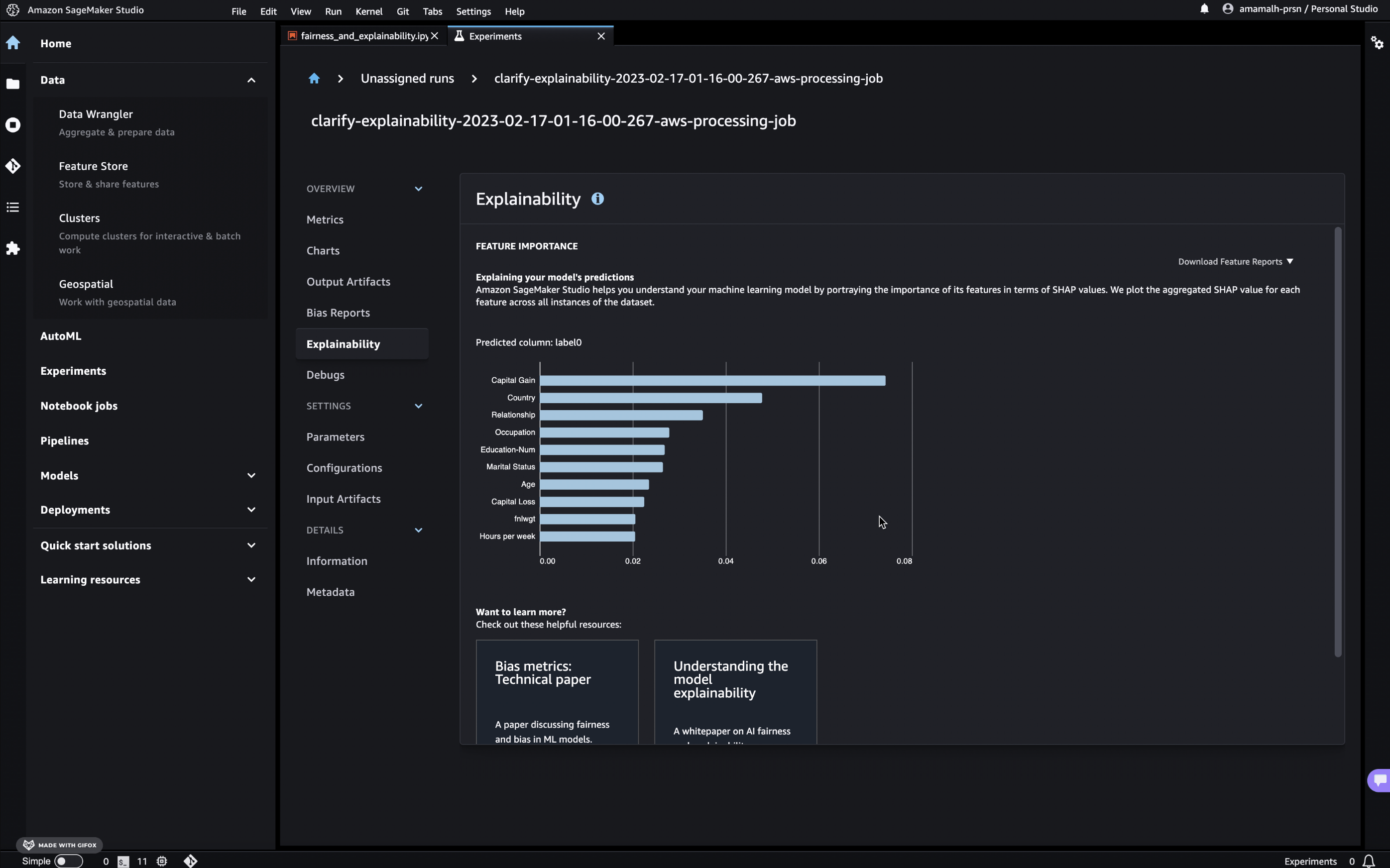

Spiegabilità del modello con SageMaker Clarify

La spiegabilità del modello consente ai professionisti del machine learning di comprendere la natura e il comportamento dei propri modelli di machine learning fornendo informazioni preziose per la progettazione delle funzionalità e le decisioni di selezione, che a loro volta migliorano la qualità delle previsioni del modello. Il team di Ranking desiderava valutare le proprie intuizioni sulla spiegabilità in due modi: comprendere in che modo gli input delle funzionalità influenzano gli output del modello nell'intero set di dati (interpretabilità globale) ed essere anche in grado di scoprire l'influenza delle funzionalità di input per una specifica previsione del modello su un punto dati di interesse ( interpretabilità locale). Con questi dati, gli scienziati di Ranking ML possono prendere decisioni informate su come migliorare ulteriormente le prestazioni del modello e tenere conto dei risultati di previsione impegnativi che il modello potrebbe occasionalmente fornire.

SageMaker Clarify consente di generare report sulla spiegabilità del modello utilizzando Spiegazioni sugli additivi Shapley (SHAP) durante l'addestramento dei modelli su SageMaker, supportando l'interpretabilità del modello sia globale che locale. Oltre ai report sulla spiegabilità del modello, SageMaker Clarify supporta l'esecuzione di analisi per metriche di bias pre-addestramento, metriche di bias post-addestramento e grafici di dipendenza parziale. Il lavoro verrà eseguito come lavoro di elaborazione SageMaker all'interno dell'account AWS e si integra direttamente con le pipeline SageMaker.

Il rapporto di interpretabilità globale verrà generato automaticamente nell'output del lavoro e visualizzato nel file Amazon Sage Maker Studio ambiente come parte dell'esecuzione dell'esperimento di formazione. Se questo modello viene quindi registrato nel registro dei modelli SageMaker, il report verrà inoltre collegato all'artefatto del modello. Utilizzando entrambe queste opzioni, il team di Ranking è stato in grado di rintracciare facilmente le diverse versioni del modello e i relativi cambiamenti comportamentali.

Per esplorare l'impatto delle funzionalità di input su una singola previsione (valori di interpretabilità locale), il team di Ranking ha abilitato il parametro save_local_shap_values nei lavori SageMaker Clarify ed è stato in grado di caricarli dal bucket S3 per ulteriori analisi nei notebook Jupyter in SageMaker Studio.

Le immagini precedenti mostrano un esempio di come apparirebbe la spiegabilità del modello per un modello ML arbitrario.

Ottimizzazione della formazione

L’ascesa del deep learning (DL) ha portato il machine learning a fare sempre più affidamento sulla potenza di calcolo e su grandi quantità di dati. I professionisti del machine learning si trovano spesso ad affrontare l'ostacolo di utilizzare in modo efficiente le risorse durante l'addestramento di questi modelli complessi. Quando si esegue la formazione su cluster di elaborazione di grandi dimensioni, sorgono varie sfide nell'ottimizzazione dell'utilizzo delle risorse, inclusi problemi come colli di bottiglia I/O, ritardi nell'avvio del kernel, vincoli di memoria e risorse sottoutilizzate. Se la configurazione del processo di formazione non è ottimizzata per l'efficienza, questi ostacoli possono comportare un utilizzo dell'hardware non ottimale, durate di formazione prolungate o addirittura cicli di formazione incompleti. Questi fattori aumentano i costi del progetto e ritardano i tempi.

La profilazione dell'utilizzo di CPU e GPU aiuta a comprendere queste inefficienze, a determinare il consumo di risorse hardware (tempo e memoria) delle varie operazioni TensorFlow nel tuo modello, a risolvere i colli di bottiglia delle prestazioni e, in definitiva, a rendere il modello più veloce.

Il team di classificazione ha utilizzato la funzionalità di profilazione del framework di Debugger di Amazon SageMaker (ora deprecato a favore di Profilo di Amazon SageMaker) per ottimizzare questi lavori di formazione. Ciò consente di tenere traccia di tutte le attività su CPU e GPU, come utilizzi di CPU e GPU, esecuzioni del kernel su GPU, lanci del kernel su CPU, operazioni di sincronizzazione, operazioni di memoria tra GPU, latenze tra lanci del kernel ed esecuzioni corrispondenti e trasferimento di dati tra CPU e GPU.

Anche la squadra di classifica ha utilizzato il file Profilo TensorFlow caratteristica di Scheda Tensor, che ha ulteriormente contribuito a profilare la formazione del modello TensorFlow. SageMaker è ora ulteriormente integrato con TensorBoard e porta gli strumenti di visualizzazione di TensorBoard su SageMaker, integrati con la formazione e i domini di SageMaker. TensorBoard ti consente di eseguire attività di debug del modello utilizzando i plug-in di visualizzazione TensorBoard.

Con l'aiuto di questi due strumenti, il team di Ranking ha ottimizzato il modello TensorFlow ed è stato in grado di identificare i colli di bottiglia e ridurre il tempo medio del passaggio di addestramento da 350 millisecondi a 140 millisecondi su CPU e da 170 millisecondi a 70 millisecondi su GPU, con accelerazioni del 60% e 59%, rispettivamente.

Risultati aziendali

Gli sforzi di migrazione si sono concentrati sul miglioramento di disponibilità, scalabilità ed elasticità, che collettivamente hanno portato l'ambiente ML verso un nuovo livello di eccellenza operativa, esemplificato dalla maggiore frequenza di addestramento del modello e dalla riduzione degli errori, tempi di addestramento ottimizzati e funzionalità ML avanzate.

Frequenza e guasti dell'addestramento del modello

Il numero di lavori mensili di formazione dei modelli è quintuplicato, portando a ottimizzazioni dei modelli significativamente più frequenti. Inoltre, il nuovo ambiente ML ha portato a una riduzione del tasso di fallimento delle corse delle pipeline, scendendo da circa il 50% al 20%. Il tempo di elaborazione dei processi non riusciti è diminuito drasticamente, da oltre un'ora in media a 5 secondi trascurabili. Ciò ha notevolmente aumentato l’efficienza operativa e ridotto lo spreco di risorse.

Tempo di allenamento ottimizzato

La migrazione ha portato con sé un aumento dell'efficienza attraverso la formazione GPU basata su SageMaker. Questo spostamento ha ridotto il tempo di addestramento del modello a un quinto della durata precedente. In precedenza, i processi di training per i modelli di deep learning consumavano circa 60 ore sulla CPU; questo è stato ridotto a circa 12 ore su GPU. Questo miglioramento non solo fa risparmiare tempo, ma accelera anche il ciclo di sviluppo, consentendo iterazioni e miglioramenti del modello più rapidi.

Funzionalità di machine learning avanzate

Fondamentale per il successo della migrazione è l'uso del set di funzionalità SageMaker, che comprende l'ottimizzazione degli iperparametri e la spiegabilità del modello. Inoltre, la migrazione ha consentito il monitoraggio continuo degli esperimenti utilizzando Esperimenti Amazon SageMaker, consentendo una sperimentazione più approfondita e produttiva.

Ancora più importante, il nuovo ambiente di sperimentazione ML ha supportato lo sviluppo di successo di un nuovo modello che è ora in produzione. Questo modello è di deep learning anziché basato su alberi e ha introdotto notevoli miglioramenti nelle prestazioni del modello online.

Conclusione

Questo post ha fornito una panoramica della collaborazione tra AWS Professional Services e Booking.com che ha portato all'implementazione di un framework ML scalabile e ha ridotto con successo il time-to-market dei modelli ML del loro team di Ranking.

Il team di Ranking di Booking.com ha appreso che la migrazione al cloud e a SageMaker si è rivelata vantaggiosa e che l'adattamento delle pratiche delle operazioni di machine learning (MLOps) consente agli ingegneri e agli scienziati ML di concentrarsi sulle proprie attività e aumentare la velocità di sviluppo. Il team sta condividendo gli insegnamenti e il lavoro svolto con l'intera comunità ML su Booking.com, attraverso colloqui e sessioni dedicate con professionisti ML in cui condividono il codice e le funzionalità. Ci auguriamo che questo post possa servire come un altro modo per condividere la conoscenza.

AWS Professional Services è pronto ad aiutare il tuo team a sviluppare ML scalabile e pronto per la produzione in AWS. Per ulteriori informazioni, vedere Servizi professionali AWS oppure contatta il tuo account manager per contattarci.

Informazioni sugli autori

Laurens van der Maas è un ingegnere di machine learning presso AWS Professional Services. Lavora a stretto contatto con i clienti che creano le loro soluzioni di machine learning su AWS, è specializzato in formazione distribuita, sperimentazione e intelligenza artificiale responsabile ed è appassionato di come l'apprendimento automatico sta cambiando il mondo come lo conosciamo.

Laurens van der Maas è un ingegnere di machine learning presso AWS Professional Services. Lavora a stretto contatto con i clienti che creano le loro soluzioni di machine learning su AWS, è specializzato in formazione distribuita, sperimentazione e intelligenza artificiale responsabile ed è appassionato di come l'apprendimento automatico sta cambiando il mondo come lo conosciamo.

Daniele Zagyva è un data scientist presso AWS Professional Services. È specializzato nello sviluppo di soluzioni di machine learning scalabili di livello produttivo per i clienti AWS. La sua esperienza si estende in diverse aree, tra cui l'elaborazione del linguaggio naturale, l'intelligenza artificiale generativa e le operazioni di apprendimento automatico.

Daniele Zagyva è un data scientist presso AWS Professional Services. È specializzato nello sviluppo di soluzioni di machine learning scalabili di livello produttivo per i clienti AWS. La sua esperienza si estende in diverse aree, tra cui l'elaborazione del linguaggio naturale, l'intelligenza artificiale generativa e le operazioni di apprendimento automatico.

Kostia Kofmann è un Senior Machine Learning Manager presso Booking.com, a capo del team Search Ranking ML e supervisiona il sistema ML più ampio di Booking.com. Con esperienza in personalizzazione e posizionamento, prospera sfruttando la tecnologia all'avanguardia per migliorare l'esperienza del cliente.

Kostia Kofmann è un Senior Machine Learning Manager presso Booking.com, a capo del team Search Ranking ML e supervisiona il sistema ML più ampio di Booking.com. Con esperienza in personalizzazione e posizionamento, prospera sfruttando la tecnologia all'avanguardia per migliorare l'esperienza del cliente.

Jenny Tokar è un ingegnere senior di machine learning presso il team di ranking di ricerca di Booking.com. È specializzata nello sviluppo di pipeline ML end-to-end caratterizzate da efficienza, affidabilità, scalabilità e innovazione. L'esperienza di Jenny consente al suo team di creare modelli di ranking all'avanguardia che servono milioni di utenti ogni giorno.

Jenny Tokar è un ingegnere senior di machine learning presso il team di ranking di ricerca di Booking.com. È specializzata nello sviluppo di pipeline ML end-to-end caratterizzate da efficienza, affidabilità, scalabilità e innovazione. L'esperienza di Jenny consente al suo team di creare modelli di ranking all'avanguardia che servono milioni di utenti ogni giorno.

Aleksandra Dokic è un Senior Data Scientist presso AWS Professional Services. Le piace supportare i clienti nella creazione di soluzioni AI/ML innovative su AWS ed è entusiasta delle trasformazioni aziendali attraverso la potenza dei dati.

Aleksandra Dokic è un Senior Data Scientist presso AWS Professional Services. Le piace supportare i clienti nella creazione di soluzioni AI/ML innovative su AWS ed è entusiasta delle trasformazioni aziendali attraverso la potenza dei dati.

Luba Protsiva è un Engagement Manager presso AWS Professional Services. È specializzata nella fornitura di soluzioni dati e GenAI/ML che consentono ai clienti AWS di massimizzare il valore aziendale e accelerare la velocità dell'innovazione.

Luba Protsiva è un Engagement Manager presso AWS Professional Services. È specializzata nella fornitura di soluzioni dati e GenAI/ML che consentono ai clienti AWS di massimizzare il valore aziendale e accelerare la velocità dell'innovazione.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- Platone Salute. Intelligence sulle biotecnologie e sulle sperimentazioni cliniche. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/how-booking-com-modernized-its-ml-experimentation-framework-with-amazon-sagemaker/

- :ha

- :È

- :non

- :Dove

- $ SU

- 1

- 100

- 12

- 130

- 140

- 16

- 350

- 60

- 7

- 70

- a

- capacità

- capace

- WRI

- accelerare

- accesso

- Secondo

- Il mio account

- raggiunto

- operanti in

- attività

- atti

- adattamento

- aggiunta

- Inoltre

- Avanzate

- influenzare

- Dopo shavasana, sedersi in silenzio; saluti;

- AI

- AI / ML

- Algoritmi

- Tutti

- permesso

- consente

- lungo

- anche

- sempre

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- quantità

- importi

- an

- Analisi

- ed

- Un altro

- API

- approccio

- opportuno

- approvato

- circa

- arbitrario

- SONO

- aree

- sorgere

- in giro

- AS

- aspirazione

- At

- Automatico

- automaticamente

- disponibilità

- disponibile

- media

- AWS

- Servizi professionali AWS

- precedente

- basato

- bayesiano

- BE

- perché

- diventando

- comportamento

- comportamentale

- comportamenti

- benefico

- beneficiando

- MIGLIORE

- fra

- pregiudizio

- riunioni

- Booking.com

- entrambi

- strozzature

- Porta

- portato

- costruire

- Costruzione

- affari

- ma

- by

- Materiale

- funzionalità

- Custodie

- casi

- centro

- centrato

- sfide

- impegnativo

- il cambiamento

- Modifiche

- cambiando

- caratterizzato

- Scegli

- scelto

- cliente

- strettamente

- Cloud

- codice

- codifica

- collaborato

- collaborazione

- collettivamente

- COM

- combinazione

- combinazioni

- combina

- comunemente

- comunità

- compatibilità

- compatibile

- complesso

- complessità

- complicato

- componenti

- computazionale

- potenza computazionale

- Calcolare

- condizione

- Configurazione

- Prendere in considerazione

- consiste

- vincoli

- consumato

- consumo

- contenere

- contiene

- di controllo

- correggere

- Corrispondente

- Costi

- potuto

- artigianali

- creare

- creazione

- cruciale

- costume

- cliente

- Clienti

- personalizzabile

- bordo tagliente

- tecnologia all'avanguardia

- ciclo

- dati

- Preparazione dei dati

- scienziato di dati

- dataset

- giorno

- Giorni

- decide

- decisione

- decisioni

- diminuita

- dedicato

- ritenuto

- deep

- apprendimento profondo

- definire

- definito

- definizione

- ritardo

- ritardi

- consegnare

- consegna

- scavare

- dipendenza

- Dipendenza

- schierare

- schierato

- deprecato

- progettato

- dettagli

- Determinare

- sviluppare

- sviluppato

- in via di sviluppo

- Mercato

- diagramma

- diverso

- direttamente

- scopri

- visualizzati

- distinto

- distribuito

- formazione distribuita

- Diviso

- fare

- domini

- fatto

- drasticamente

- lancio

- durata

- durante

- dinamicamente

- ogni

- facilmente

- efficienza

- in modo efficiente

- sforzi

- imbarcato

- Potenzia

- enable

- abilitato

- Abilita

- consentendo

- che comprende

- da un capo all'altro

- Fidanzamento

- ingegnere

- Ingegneria

- Ingegneri

- accrescere

- migliorando

- assicurando

- Intero

- Ambiente

- epoche

- essential

- valutare

- valutazione

- Anche

- Ogni

- ogni giorno

- esempio

- Eccellenza

- eccitato

- esemplificato

- esistente

- attenderti

- accelera

- esperienza

- Esperienze

- esperimento

- esperimenti

- competenza

- Spiegare

- esplora

- Esplorare

- estendendo

- si estende

- estensione

- estensivo

- Faccia

- di fronte

- Fattori

- fallito

- Fallimento

- fallimenti

- falso

- più veloce

- favorire

- fattibile

- caratteristica

- Caratteristiche

- feedback

- meno

- Compila il

- File

- finale

- Infine

- Trovate

- Nome

- prima volta

- Flessibilità

- Focus

- i seguenti

- Nel

- quattro

- Contesto

- Frequenza

- frequente

- da

- ulteriormente

- Inoltre

- guadagnando

- generare

- generato

- genera

- generativo

- AI generativa

- ottenere

- Idiota

- globali

- scopo

- GPU

- GPU

- maggiore

- indovinare

- ha avuto

- maniglia

- Hardware

- imbrigliato

- Avere

- he

- Aiuto

- aiutato

- aiuta

- suo

- il suo

- speranza

- ora

- ORE

- Come

- Tutorial

- Tuttavia

- HTML

- http

- HTTPS

- centinaia

- ostacolo

- Ottimizzazione dell'iperparametro

- Sintonia iperparametro

- identificare

- if

- illustra

- immagini

- immediato

- Impact

- implementazione

- importante

- competenze

- migliorata

- miglioramento

- miglioramenti

- migliora

- in

- includere

- Compreso

- Aumento

- è aumentato

- Aumenta

- sempre più

- indipendentemente

- industria

- inefficienze

- influenza

- informazioni

- informati

- Infrastruttura

- avviato

- innovare

- Innovazione

- creativi e originali

- ingresso

- Ingressi

- interno

- perspicace

- intuizioni

- immediato

- integrato

- Integra

- interesse

- interno

- ai miglioramenti

- introdotto

- l'introduzione di

- coinvolto

- sicurezza

- IT

- iterazione

- iterazioni

- SUO

- Lavoro

- Offerte di lavoro

- viaggio

- jpg

- Le

- Sapere

- conoscenze

- conosciuto

- carente

- Lingua

- grandi

- con i più recenti

- lanciare

- lanciato

- lancia

- leader

- principale

- IMPARARE

- imparato

- apprendimento

- Guidato

- Livello

- leveraging

- piace

- Limitato

- connesso

- caricare

- locale

- Lunghi

- Guarda

- una

- macchina

- machine learning

- macchine

- fatto

- make

- gestito

- direttore

- modo

- manualmente

- Massimizzare

- significare

- Memorie

- metodo

- metrico

- Metrica

- la migrazione

- migrazione

- milioni

- millisecondi

- minimo

- Minuti

- ML

- MLOp

- modello

- modelli

- modernizzare

- moduli

- Monitorare

- mensile

- Scopri di più

- maggior parte

- cambiano

- mosso

- molti

- multiplo

- Nome

- Naturale

- Elaborazione del linguaggio naturale

- Natura

- Bisogno

- New

- GENERAZIONE

- no

- adesso

- numero

- obiettivo

- osservare

- ostacoli

- of

- offline

- di frequente

- on

- On-Demand

- ONE

- online

- esclusivamente

- operativa

- Operazioni

- ottimale

- ottimizzazione

- ottimizzazioni

- OTTIMIZZA

- ottimizzati

- ottimizzazione

- Opzioni

- or

- Altro

- altrimenti

- nostro

- su

- produzione

- uscite

- ancora

- complessivo

- supervisionando

- panoramica

- proprio

- Pace

- pacchetto

- confezionati

- Parallel

- parametro

- parte

- appassionato

- Eseguire

- performance

- esecuzione

- personalizzazione

- conduttura

- centrale

- Platone

- Platone Data Intelligence

- PlatoneDati

- gioca

- i plugin

- punto

- Portale

- positivo

- Post

- energia

- pratiche

- precedente

- predire

- predizione

- Previsioni

- preparazione

- precedente

- in precedenza

- Problema

- processi

- Elaborato

- i processi

- lavorazione

- Produzione

- produttivo

- professionale

- Profilo

- profiling

- Progressi

- progetto

- promettente

- dimostrato

- fornire

- purché

- fornitura

- qualità

- rapidamente

- gamme

- Posizione

- rapidamente

- tasso

- piuttosto

- Crudo

- raggiungere

- pronto

- ricevere

- riconoscendo

- Consigli

- registrato

- ridurre

- Ridotto

- riducendo

- riduzione

- per quanto riguarda

- regione

- registro

- registrato

- registro

- regolarmente

- Respinto..

- pertinente

- problemi di

- rapporto

- Report

- deposito

- che rappresenta

- richiedere

- necessario

- richiede

- risolvere

- risorsa

- Risorse

- rispettivamente

- responsabile

- colpevole

- risultante

- Risultati

- Aumento

- robusto

- Ruolo

- Correre

- running

- corre

- sagemaker

- Pipeline SageMaker

- Scalabilità

- scalabile

- Scala

- Scienze

- Scienziato

- scienziati

- copione

- senza soluzione di continuità

- Cerca

- Secondo

- secondo

- vedere

- cerca

- select

- Selezione

- prodotti

- anziano

- servire

- serve

- Servizi

- sessioni

- set

- Set

- impostazioni

- alcuni

- Condividi

- compartecipazione

- lei

- spostamento

- dovrebbero

- mostrare attraverso le sue creazioni

- Spettacoli

- significativamente

- Un'espansione

- singolo

- leggermente diversa

- più intelligente

- lisciare

- So

- soluzione

- Soluzioni

- qualcosa

- lo spazio

- Scintilla

- specializzata

- specifico

- velocità

- esaurito

- step

- Passi

- sosta

- conservazione

- memorizzati

- strategie

- aerodinamico

- fortemente

- strutturato

- studio

- subottimale

- il successo

- di successo

- Con successo

- tale

- supportato

- Supporto

- supporti

- sync.

- sistema

- su misura

- presa

- trattativa

- task

- team

- le squadre

- Tecnologia

- tensorflow

- test

- testato

- Testing

- di

- che

- Il

- il mondo

- loro

- Li

- poi

- Là.

- in tal modo

- perciò

- Strumenti Bowman per analizzare le seguenti finiture:

- di

- questo

- quelli

- prospera

- Attraverso

- tempo

- timeline

- volte

- a

- strumenti

- toccare

- verso

- pista

- Tracking

- Treni

- Training

- corsi di formazione

- trasferimento

- trasformazioni

- transizione

- viaggiare

- industria del turismo

- Viaggiatori

- trattare

- vero

- prova

- sintonia

- TURNO

- seconda

- Digitare

- in definitiva

- capire

- unico

- Impiego

- uso

- caso d'uso

- utilizzato

- user-friendly

- utenti

- usa

- utilizzando

- utilizzati

- Prezioso

- APPREZZIAMO

- Valori

- vario

- Fisso

- Velocità

- versione

- versioni

- molto

- visualizzazione

- aspettare

- ricercato

- Prima

- Modo..

- modi

- we

- sito web

- servizi web

- sono stati

- quando

- quale

- while

- OMS

- volere

- con

- entro

- senza

- Lavora

- flusso di lavoro

- lavori

- mondo

- In tutto il mondo

- sarebbe

- Tu

- Trasferimento da aeroporto a Sharm

- zefiro