Introduzione

Le auto e gli aerei senza conducente non sono più il futuro. Nella sola città di San Francisco, due compagnie di taxi hanno percorso complessivamente 8 milioni di miglia di guida autonoma fino all’agosto 2023. E negli Stati Uniti sono registrati più di 850,000 veicoli aerei autonomi, o droni, senza contare quelli di proprietà dei militari.

Ma ci sono legittime preoccupazioni sulla sicurezza. Ad esempio, in un periodo di 10 mesi terminato a maggio 2022, la National Highway Traffic Safety Administration segnalati quasi 400 incidenti che hanno coinvolto automobili che utilizzavano una qualche forma di controllo autonomo. In seguito a questi incidenti morirono sei persone e cinque rimasero gravemente ferite.

Il modo consueto di affrontare questo problema, a volte chiamato “test per esaurimento”, prevede di testare questi sistemi finché non sei soddisfatto che siano sicuri. Ma non puoi mai essere sicuro che questo processo rivelerà tutti i potenziali difetti. “Le persone eseguono i test finché non hanno esaurito le proprie risorse e la propria pazienza”, ha affermato Saiyan Mitra, scienziato informatico presso l'Università dell'Illinois, Urbana-Champaign. I soli test, tuttavia, non possono fornire garanzie.

Mitra e i suoi colleghi possono. La sua squadra è riuscita a farlo dimostrare , il sicurezza delle funzionalità di rilevamento della corsia per le auto e sistemi di atterraggio per aerei autonomi. La loro strategia viene ora utilizzata per aiutare a far atterrare i droni sulle portaerei e Boeing prevede di testarla su un aereo sperimentale quest’anno. "Il loro metodo di fornire garanzie di sicurezza end-to-end è molto importante", ha affermato Corina Pasareanu, ricercatore presso la Carnegie Mellon University e l'Ames Research Center della NASA.

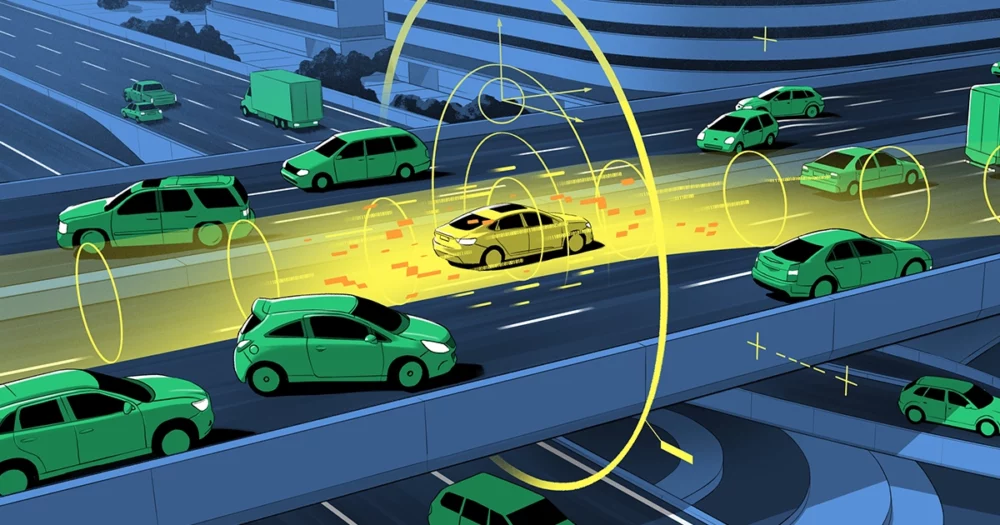

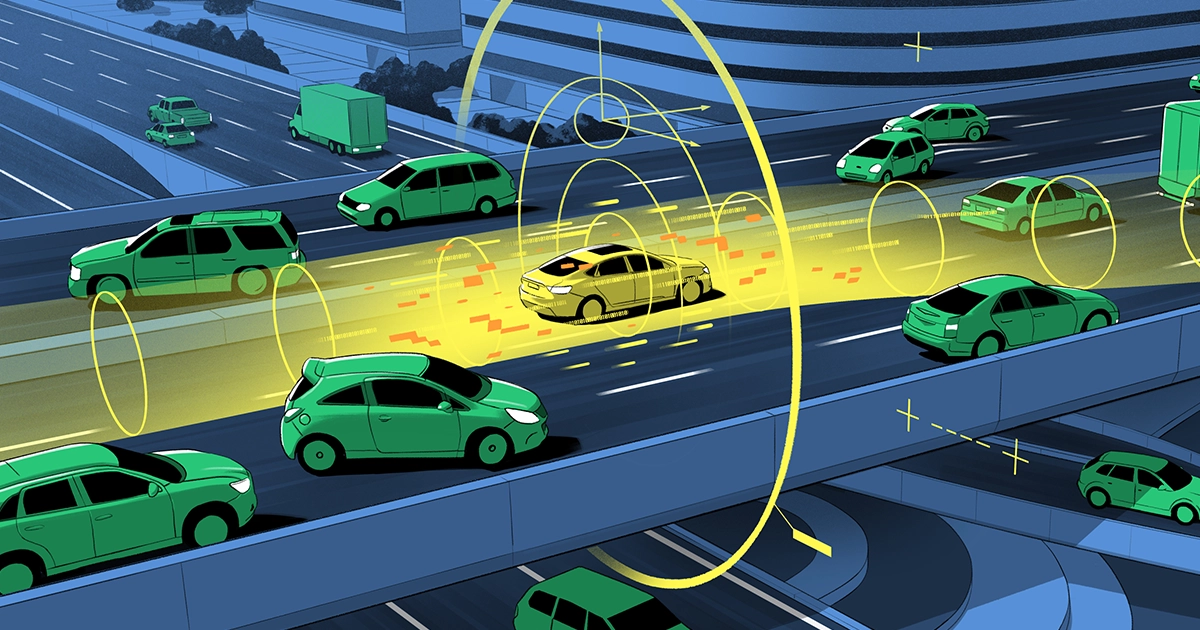

Il loro lavoro consiste nel garantire i risultati degli algoritmi di apprendimento automatico utilizzati per informare i veicoli autonomi. Ad alto livello, molti veicoli autonomi hanno due componenti: un sistema percettivo e un sistema di controllo. Il sistema di percezione ti dice, ad esempio, quanto è distante la tua auto dal centro della corsia, o in quale direzione sta andando un aereo e qual è il suo angolo rispetto all'orizzonte. Il sistema funziona fornendo dati grezzi provenienti da telecamere e altri strumenti sensoriali ad algoritmi di apprendimento automatico basati su reti neurali, che ricreano l’ambiente all’esterno del veicolo.

Queste valutazioni vengono poi inviate a un sistema separato, il modulo di controllo, che decide cosa fare. Se si avvicina un ostacolo, ad esempio, decide se frenare o sterzare. Secondo Luca Carlone, professore associato presso il Massachusetts Institute of Technology, sebbene il modulo di controllo si basi su una tecnologia consolidata, "prende decisioni basate sui risultati della percezione e non vi è alcuna garanzia che tali risultati siano corretti".

Per fornire una garanzia di sicurezza, il team di Mitra ha lavorato per garantire l’affidabilità del sistema di percezione del veicolo. Innanzitutto hanno ipotizzato che sia possibile garantire la sicurezza quando è disponibile una rappresentazione perfetta del mondo esterno. Hanno quindi determinato la quantità di errori che il sistema di percezione introduce nella ricostruzione dell’ambiente circostante il veicolo.

La chiave di questa strategia è quantificare le incertezze coinvolte, note come banda di errore – o “incognite note”, come dice Mitra. Questo calcolo deriva da quello che lui e il suo team chiamano contratto di percezione. Nell'ingegneria del software, un contratto è un impegno secondo cui, per un dato input in un programma per computer, l'output rientrerà in un intervallo specificato. Capire questo intervallo non è facile. Quanto sono accurati i sensori dell’auto? Quanta nebbia, pioggia o abbagliamento solare può tollerare un drone? Ma se si riesce a mantenere il veicolo entro uno specifico intervallo di incertezza, e se la determinazione di tale intervallo è sufficientemente accurata, il team di Mitra ha dimostrato che è possibile garantirne la sicurezza.

Introduzione

È una situazione familiare per chiunque abbia un tachimetro impreciso. Se sai che il dispositivo non si spegne mai a più di 5 miglia orarie, puoi comunque evitare di accelerare rimanendo sempre 5 miglia orarie al di sotto del limite di velocità (come indicato dal tuo tachimetro inaffidabile). Un contratto di percezione offre una garanzia simile della sicurezza di un sistema imperfetto che dipende dall’apprendimento automatico.

“Non hai bisogno di una percezione perfetta”, ha detto Carlone. "Vuoi solo che sia abbastanza buono da non mettere a rischio la sicurezza." I maggiori contributi del team, ha detto, sono “l’introduzione dell’intera idea dei contratti di percezione” e la fornitura dei metodi per costruirli. Lo hanno fatto attingendo a tecniche del ramo dell’informatica chiamato verifica formale, che fornisce un modo matematico per confermare che il comportamento di un sistema soddisfa una serie di requisiti.

"Anche se non sappiamo esattamente come la rete neurale fa quello che fa", ha detto Mitra, hanno dimostrato che è ancora possibile dimostrare numericamente che l'incertezza dell'output di una rete neurale rientra entro determinati limiti. E, se così fosse, il sistema sarà sicuro. “Possiamo quindi fornire una garanzia statistica sul fatto se (e in che misura) una determinata rete neurale rispetterà effettivamente tali limiti”.

L’azienda aerospaziale Sierra Nevada sta attualmente testando queste garanzie di sicurezza durante l’atterraggio di un drone su una portaerei. Questo problema è in qualche modo più complicato che guidare un’auto a causa della dimensione extra coinvolta nel volo. "Durante l'atterraggio, ci sono due compiti principali", ha detto Dragos Margineantu, capo tecnico dell'intelligenza artificiale della Boeing, "allineando l'aereo con la pista e assicurandosi che la pista sia priva di ostacoli. Il nostro lavoro con Sayan prevede l’ottenimento di garanzie per queste due funzioni”.

"Le simulazioni che utilizzano l'algoritmo di Sayan mostrano che l'allineamento [di un aereo prima dell'atterraggio] migliora", ha affermato. Il prossimo passo, previsto per la fine dell’anno, sarà quello di utilizzare questi sistemi durante l’atterraggio di un aereo sperimentale Boeing. Una delle sfide più grandi, ha osservato Margineantu, sarà capire cosa non sappiamo – “determinare l’incertezza nelle nostre stime” – e vedere come ciò influisce sulla sicurezza. “La maggior parte degli errori si verifica quando facciamo cose che pensiamo di sapere – e si scopre che non è così”.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- Platone Salute. Intelligence sulle biotecnologie e sulle sperimentazioni cliniche. Accedi qui.

- Fonte: https://www.quantamagazine.org/how-to-guarantee-the-safety-of-autonomous-vehicles-20240116/

- :ha

- :È

- :non

- ][P

- 000

- 2022

- 2023

- 400

- 8

- a

- WRI

- incidenti

- Secondo

- preciso

- ACM

- effettivamente

- indirizzamento

- amministrazione

- Aeronautico

- AI

- aereo

- algoritmo

- Algoritmi

- allineamento

- Tutti

- da solo

- sempre

- an

- ed

- chiunque

- APPLICA

- SONO

- in giro

- AS

- valutazioni

- Associate

- assunto

- At

- AGOSTO

- autonomo

- veicoli autonomi

- disponibile

- evitare

- BAND

- basato

- BE

- perché

- comportamento

- essendo

- sotto

- Maggiore

- Boeing

- limiti

- Branch di società

- ma

- by

- calcolo

- chiamata

- detto

- telecamere

- Materiale

- non può

- funzionalità

- auto

- Carnegie Mellon

- vettori

- trasportare

- auto

- Custodie

- centro

- certo

- sfide

- capo

- Città

- colleghi

- collettivamente

- viene

- impegno

- Aziende

- azienda

- complicato

- componenti

- computer

- Informatica

- preoccupazioni

- costruire

- contratto

- contributi

- di controllo

- correggere

- conteggio

- Attualmente

- dati

- decisioni

- Laurea

- dipende

- determinazione

- determinato

- dispositivo

- DID

- morto

- Dimensioni

- direzione

- do

- effettua

- Dont

- disegno

- guida

- Fuco

- Droni

- facile

- da un capo all'altro

- finito

- Ingegneria

- abbastanza

- garantire

- assicurando

- Intero

- Ambiente

- errore

- errori

- di preciso

- esempio

- sperimentale

- extra

- Autunno

- familiare

- lontano

- alimentazione

- Nome

- cinque

- difetti

- volante

- Nebbia

- Nel

- modulo

- formale

- Francisco

- Gratis

- da

- funzioni

- futuro

- ottenere

- dato

- buono

- di garanzia

- garanzie

- accadere

- Avere

- he

- Titolo

- Aiuto

- Alta

- Autostrada

- il suo

- orizzonte

- ora

- Come

- Tutorial

- Tuttavia

- HTML

- HTTPS

- idea

- IEEE

- if

- Illinois

- importante

- competenze

- in

- indicato

- far sapere

- ingresso

- esempio

- Istituto

- ai miglioramenti

- Introduce

- coinvolto

- coinvolgendo

- problema

- IT

- SUO

- ad appena

- mantenere

- Le

- Sapere

- conosciuto

- Paese

- atterraggio

- Corsia

- dopo

- apprendimento

- legittimo

- Livello

- si trova

- LIMITE

- registrati

- più a lungo

- macchina

- machine learning

- rivista

- Principale

- Fare

- gestito

- molti

- Massachusetts

- Istituto di Tecnologia del Massachussetts

- matematico

- Maggio..

- Soddisfare

- Mellon

- metodo

- metodi

- Militare

- milione

- CON

- Moduli

- Scopri di più

- molti

- il

- quasi

- Bisogno

- Rete

- reti

- neurale

- rete neurale

- reti neurali

- NEVADA

- mai

- GENERAZIONE

- no

- noto

- adesso

- ostacolo

- ostacoli

- of

- MENO

- on

- ONE

- opera

- or

- Altro

- nostro

- su

- produzione

- al di fuori

- Di proprietà

- Pazienza

- Persone

- per

- pubblica

- perfetta

- periodo

- piano

- previsto

- piani

- Platone

- Platone Data Intelligence

- PlatoneDati

- possibile

- potenziale

- Precedente

- Problema

- processi

- Insegnante

- Programma

- Dimostra

- dimostrato

- fornire

- fornisce

- fornitura

- metti

- RAIN

- gamma

- Crudo

- registrato

- problemi di

- interpretazione

- Requisiti

- riparazioni

- Risorse

- rispetto

- colpevole

- Risultati

- Rischio

- pista

- sicura

- Sicurezza

- Suddetto

- San

- San Francisco

- soddisfatte

- Scienze

- Scienziato

- vedendo

- sensore

- inviato

- separato

- sul serio

- set

- mostrare attraverso le sue creazioni

- ha mostrato

- simile

- situazione

- SIX

- So

- Software

- Ingegneria del software

- solare

- alcuni

- a volte

- specificato

- velocità

- stati

- statistiche

- soggiorno

- guidare

- step

- Ancora

- Strategia

- sicuro

- sistema

- SISTEMI DI TRATTAMENTO

- task

- team

- tecniche

- tecnologo

- Tecnologia

- dice

- test

- Testing

- test

- di

- che

- Il

- Il futuro

- loro

- Li

- poi

- Là.

- Strumenti Bowman per analizzare le seguenti finiture:

- di

- cose

- think

- questo

- quest'anno

- quelli

- anche se?

- Attraverso

- a

- strumenti

- traffico

- si

- seconda

- incertezze

- Incertezza

- scoprire

- Unito

- Stati Uniti

- Università

- fino a quando

- imminenti

- utilizzato

- utilizzando

- solito

- veicolo

- Veicoli

- Convalida

- molto

- volere

- Modo..

- modi

- we

- WebP

- sono stati

- Che

- quando

- se

- quale

- while

- volere

- con

- entro

- Lavora

- lavorato

- mondo

- anno

- Tu

- Trasferimento da aeroporto a Sharm

- zefiro