Questo post del blog è stato scritto in collaborazione con Tuana Çelik di deepset.

La ricerca aziendale è una componente fondamentale dell’efficienza organizzativa attraverso la digitalizzazione dei documenti e la gestione della conoscenza. La ricerca aziendale riguarda l'archiviazione di documenti come file digitali, l'indicizzazione dei documenti per la ricerca e la fornitura di risultati pertinenti in base alle query degli utenti. Con l'avvento dei modelli linguistici di grandi dimensioni (LLM), possiamo implementare esperienze conversazionali nel fornire i risultati agli utenti. Tuttavia, dobbiamo garantire che i LLM limitino le risposte ai dati aziendali, mitigando così le allucinazioni del modello.

In questo post, mostriamo come creare un'applicazione AI generativa end-to-end per la ricerca aziendale con Retrieval Augmented Generation (RAG) utilizzando le pipeline Haystack e il modello Falcon-40b-instruct di JumpStart di Amazon SageMaker ed Servizio Amazon OpenSearch. Il codice sorgente per l'esempio presentato in questo post è disponibile nel file Repository GitHub

Panoramica della soluzione

Per limitare le risposte generative delle applicazioni AI ai soli dati aziendali, dobbiamo utilizzare una tecnica chiamata Retrieval Augmented Generation (RAG). Un'applicazione che utilizza l'approccio RAG recupera le informazioni più rilevanti per la richiesta dell'utente dalla knowledge base o dal contenuto aziendale, le raggruppa come contesto insieme alla richiesta dell'utente come prompt e quindi le invia a LLM per ottenere una risposta. I LLM hanno limitazioni riguardo al conteggio massimo delle parole per le richieste di input, quindi la scelta dei passaggi giusti tra migliaia o milioni di documenti nell'azienda ha un impatto diretto sulla precisione del LLM.

La tecnica RAG è diventata sempre più importante nella ricerca d'impresa. In questo post, mostriamo un flusso di lavoro che sfrutta SageMaker JumpStart per distribuire un modello di istruzione Falcon-40b e utilizza Haystack per progettare ed eseguire una pipeline di risposta alle domande aumentata di recupero. Il flusso di lavoro di miglioramento del recupero finale copre i seguenti passaggi di alto livello:

- La query dell'utente viene utilizzata per un componente retriever, che esegue una ricerca vettoriale, per recuperare il contesto più rilevante dal nostro database.

- Questo contesto è incorporato in un prompt progettato per istruire un LLM a generare una risposta solo dal contesto fornito.

- LLM genera una risposta alla query originale considerando solo il contesto incorporato nel prompt ricevuto.

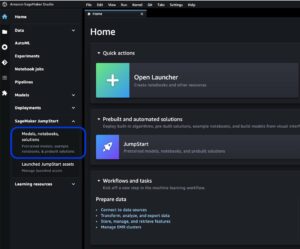

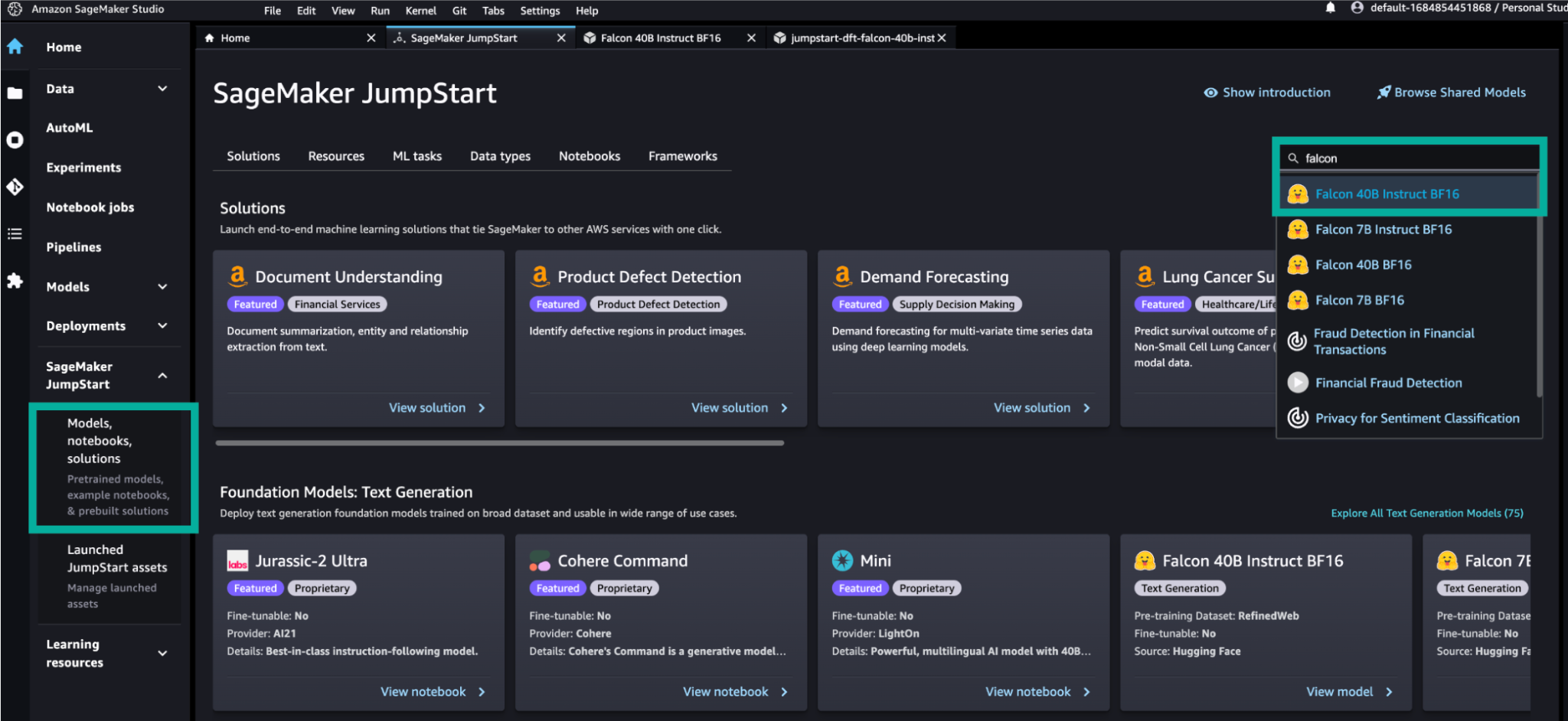

SageMaker JumpStart

SageMaker JumpStart funge da hub di modelli che incapsula un'ampia gamma di modelli di deep learning per casi d'uso di testo, visione, audio e incorporamento. Con oltre 500 modelli, il suo hub di modelli comprende modelli pubblici e proprietari di partner AWS come AI21, Stability AI, Cohere e LightOn. Ospita anche modelli di base sviluppati esclusivamente da Amazon, come AlexaTM. Alcuni modelli offrono funzionalità per ottimizzarli con i tuoi dati. SageMaker JumpStart fornisce inoltre modelli di soluzioni che configurano l'infrastruttura per casi d'uso comuni e notebook di esempio eseguibili per l'apprendimento automatico (ML) con SageMaker.

Pagliaio

Pagliaio è un framework open source di deepset che consente agli sviluppatori di orchestrare applicazioni LLM costituite da diversi componenti come modelli, DB vettoriali, convertitori di file e innumerevoli altri moduli. Haystack fornisce oleodotti ed Agenti, due potenti strutture per la progettazione di applicazioni LLM per vari casi d'uso tra cui ricerca, risposta alle domande e intelligenza artificiale conversazionale. Con una grande attenzione ai metodi di recupero all'avanguardia e ai solidi parametri di valutazione, ti fornisce tutto ciò di cui hai bisogno per fornire un'applicazione affidabile e affidabile. È possibile serializzare le pipeline su File YAML, esporli tramite a API RESTe scalali in modo flessibile in base ai tuoi carichi di lavoro, semplificando il passaggio della tua applicazione dalla fase di prototipo alla produzione.

AmazonOpenSearch

OpenSearch Service è un servizio completamente gestito che semplifica la distribuzione, la scalabilità e il funzionamento di OpenSearch nel cloud AWS. OpenSearch è una suite software open source scalabile, flessibile ed estensibile per applicazioni di ricerca, analisi, monitoraggio della sicurezza e osservabilità, concessa in licenza con la licenza Apache 2.0.

Negli ultimi anni, le tecniche ML sono diventate sempre più popolari per migliorare la ricerca. Tra questi ci sono l'uso di modelli di inclusione, un tipo di modello in grado di codificare una grande quantità di dati in uno spazio n-dimensionale in cui ciascuna entità è codificata in un vettore, un punto dati in quello spazio e organizzato in modo tale che entità simili siano più vicine tra loro. Un database vettoriale fornisce un'efficiente ricerca di similarità vettoriale fornendo indici specializzati come gli indici k-NN.

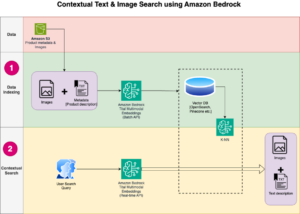

Con le funzionalità del database vettoriale di OpenSearch Service, puoi implementare la ricerca semantica, RAG con LLM, motori di raccomandazione e ricerca rich media. In questo post, utilizziamo RAG per consentirci di integrare i LLM generativi con una base di conoscenza esterna che viene generalmente creata utilizzando un database vettoriale idratato con articoli di conoscenza codificati in vettore.

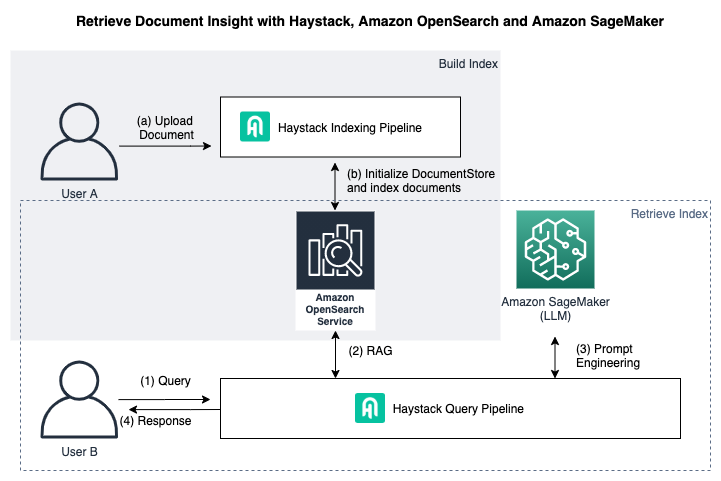

Panoramica dell'applicazione

Il diagramma seguente illustra la struttura dell'applicazione finale.

In questa applicazione, utilizziamo Haystack Indexing Pipeline per gestire i documenti caricati e indicizzare i documenti e Haystack Query Pipeline per eseguire il recupero della conoscenza dai documenti indicizzati.

La pipeline di indicizzazione Haystack include i seguenti passaggi di alto livello:

- Carica un documento.

- Inizializzare

DocumentStoree indicizzare i documenti.

Usiamo OpenSearch come nostro DocumentStore e un pagliaio pipeline di indicizzazione per preelaborare e indicizzare i nostri file su OpenSearch. Pagliaio Convertitori di file ed Preprocessore consentono di pulire e preparare i file non elaborati affinché abbiano una forma e un formato che la pipeline di elaborazione del linguaggio naturale (NLP) e il modello linguistico preferito possano gestire. Utilizza anche la pipeline di indicizzazione che abbiamo utilizzato qui sentence-transformers/all-MiniLM-L12-v2 per creare incorporamenti per ciascun documento, che utilizziamo per un recupero efficiente.

La pipeline di query Haystack include i seguenti passaggi di alto livello:

- Inviamo una query alla pipeline RAG.

- An EmbeddingRetriever Il componente funge da filtro che recupera quelli più rilevanti

top_kdocumenti dai nostri documenti indicizzati in OpenSearch. Usiamo la nostra scelta del modello di incorporamento per incorporare sia la query che i documenti (durante l'indicizzazione) per raggiungere questo obiettivo. - I documenti recuperati sono incorporati nel nostro prompt per il modello Falcon-40b-istruct.

- Il LLM restituisce una risposta basata sui documenti recuperati.

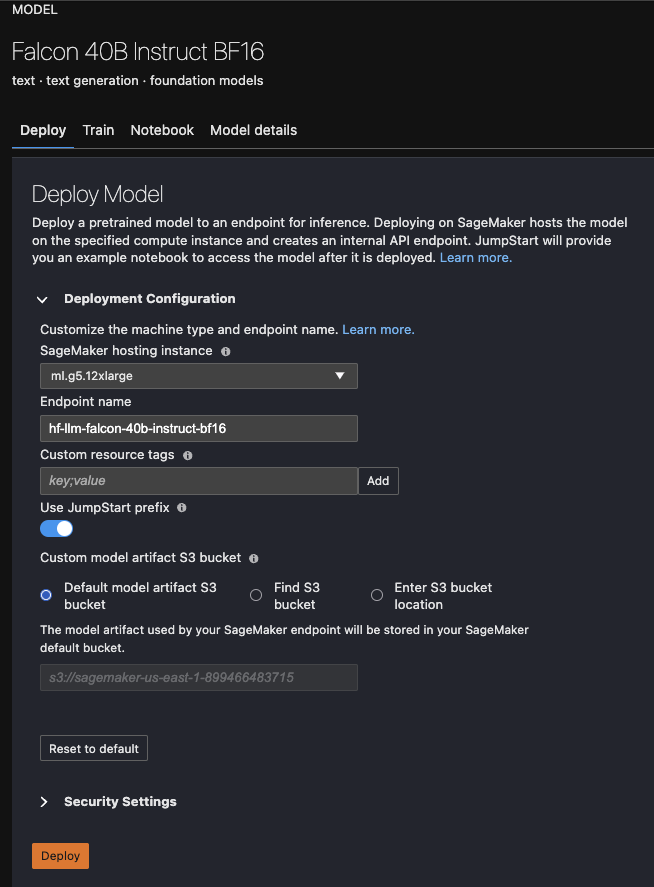

Per la distribuzione dei modelli, utilizziamo SageMaker JumpStart, che semplifica la distribuzione dei modelli premendo semplicemente un pulsante. Sebbene abbiamo utilizzato e testato Falcon-40b-instruct per questo esempio, puoi utilizzare qualsiasi modello Hugging Face disponibile su SageMaker.

La soluzione finale è disponibile su produttore di salvia nel pagliaio repository e utilizza il sito Web e la documentazione di OpenSearch (per OpenSearch 2.7) come dati di esempio su cui eseguire il recupero della risposta alle domande aumentata.

Prerequisiti

La prima cosa da fare prima di poter utilizzare qualsiasi servizio AWS è assicurarsi di aver registrato e creato un account AWS. Quindi dovresti creare un utente e un gruppo amministrativi. Per istruzioni su entrambi i passaggi, fare riferimento a Configura i prerequisiti di Amazon SageMaker.

Per poter utilizzare Haystack, dovrai installare il file farm-haystack pacchetto con le dipendenze richieste. Per ottenere ciò, utilizzare il file requirements.txt file nella Repository GitHub correndo pip install requirements.txt.

Indicizzare i documenti su OpenSearch

Haystack offre una serie di connettori ai database, chiamati DocumentStores. Per questo flusso di lavoro RAG, utilizziamo il file OpenSearchDocumentStore. L'esempio deposito include una pipeline di indicizzazione e AWS CloudFormazione modello per configurare un file OpenSearchDocumentStore con documenti scansionati dal sito Web OpenSearch e dalle pagine della documentazione.

Spesso, per far funzionare un'applicazione NLP per casi d'uso di produzione, finiamo per dover pensare alla preparazione e alla pulizia dei dati. Questo è coperto Pipeline di indicizzazione Haystack, che ti consente di progettare le tue fasi di preparazione dei dati, che alla fine scrivono i tuoi documenti nel database di tua scelta.

Una pipeline di indicizzazione può anche includere un passaggio per creare incorporamenti per i tuoi documenti. Questo è molto importante per la fase di recupero. Nel nostro esempio, usiamo trasformatori di frasi/all-MiniLM-L12-v2 come nostro modello di incorporamento. Questo modello viene utilizzato per creare incorporamenti per tutti i nostri documenti indicizzati, ma anche per la query dell'utente al momento della query.

Per indicizzare i documenti nel file OpenSearchDocumentStore, forniamo due opzioni con istruzioni dettagliate nel file README del repository di esempio. Qui, esaminiamo i passaggi per l'indicizzazione in un servizio OpenSearch distribuito su AWS.

Avvia un servizio OpenSearch

Usa il fornito Modello CloudFormation per configurare un servizio OpenSearch su AWS. Eseguendo il comando seguente, avrai un servizio OpenSearch vuoto. Puoi quindi scegliere di indicizzare i dati di esempio che abbiamo fornito o utilizzare i tuoi dati, che puoi pulire e preelaborare utilizzando il comando Pipeline di indicizzazione Haystack. Tieni presente che ciò crea un'istanza aperta a Internet, il che non è consigliato per l'uso in produzione.

Attendere circa 30 minuti per il completamento dell'avvio dello stack. Puoi verificarne l'avanzamento sulla console AWS CloudFormation accedendo al file Stacks page e cercando lo stack denominato HaystackOpensearch.

Indicizzare i documenti in OpenSearch

Ora che abbiamo un servizio OpenSearch in esecuzione, possiamo utilizzare la classe OpenSearchDocumentStore per connetterci ad esso e scrivervi i nostri documenti.

Per ottenere il nome host per OpenSearch, esegui il comando seguente:

Innanzitutto, esporta quanto segue:

Quindi, puoi usare il opensearch_indexing_pipeline.py script per preelaborare e indicizzare i dati dimostrativi forniti.

Se desideri utilizzare i tuoi dati, modifica la pipeline di indicizzazione in opensearch_indexing_pipeline.py includere il Convertitore di file ed Preprocessore passaggi di configurazione richiesti.

Implementare la pipeline di risposta alle domande aumentata per il recupero

Ora che abbiamo indicizzato i dati in OpenSearch, possiamo eseguire risposte alle domande su questi documenti. Per questa pipeline RAG utilizziamo il modello Falcon-40b-instruct che abbiamo distribuito su SageMaker JumpStart.

Hai anche la possibilità di distribuire il modello a livello di codice da un notebook Jupyter. Per istruzioni, fare riferimento a Repository GitHub.

- Cerca il modello Falcon-40b-instruct su SageMaker JumpStart.

- Distribuisci il tuo modello su SageMaker JumpStart e prendi nota del nome dell'endpoint.

- Esporta i seguenti valori:

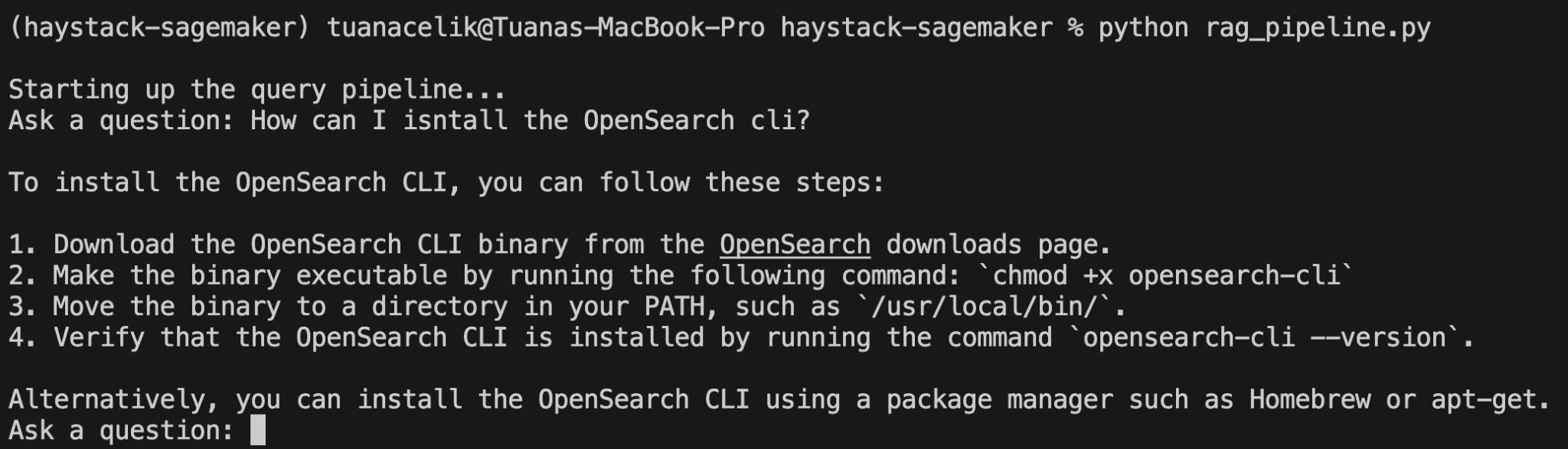

- Correre

python rag_pipeline.py.

Verrà avviata un'utilità della riga di comando che attende la domanda di un utente. Ad esempio, chiediamo "Come posso installare la CLI di OpenSearch?"

Questo risultato è stato ottenuto perché abbiamo definito il nostro prompt nel file Modello di richiesta del pagliaio essere il seguente:

Ulteriori personalizzazioni

È possibile apportare ulteriori personalizzazioni a diversi elementi della soluzione, come le seguenti:

- I dati – Abbiamo fornito OpenSearch documentazione ed sito web dati come dati di esempio. Ricordati di modificare il

opensearch_indexing_pipeline.pyscript per soddisfare le tue esigenze se scegli di utilizzare i tuoi dati. - Il modello – In questo esempio, abbiamo utilizzato il modello Falcon-40b-instruct. Sei libero di distribuire e utilizzare qualsiasi altro modello Hugging Face su SageMaker. Tieni presente che modificare un modello probabilmente significa che dovresti adattare il tuo prompt a qualcosa per cui è progettato.

- il prompt – Per questo post ne abbiamo creato uno nostro

PromptTemplateche istruisce il modello a rispondere alle domande in base al contesto fornito e a rispondere "Non lo so" se il contesto non include informazioni rilevanti. È possibile modificare questo prompt per sperimentare diversi prompt con Falcon-40b-instruct. Puoi anche semplicemente estrarre alcuni dei nostri suggerimenti dal file PromptHub. - Il modello di incorporamento – Per la fase di recupero, utilizziamo un modello di incorporamento leggero: trasformatori di frasi/all-MiniLM-L12-v2. Tuttavia, puoi anche modificarlo in base alle tue esigenze. Ricordati di modificare le dimensioni di incorporamento previste nel tuo file

DocumentStoredi conseguenza. - Il numero di documenti recuperati – Puoi anche scegliere di giocare con il numero di documenti che chiedi

EmbeddingRetrieverda recuperare per ogni query. Nella nostra configurazione, questo è impostato su top_k=5. Puoi provare a modificare questa cifra per vedere se fornire più contesto migliora la precisione dei risultati.

Prontezza di produzione

La soluzione proposta in questo post può accelerare il time to value del processo di sviluppo del progetto. Puoi creare un progetto facilmente scalabile con l'ambiente di sicurezza e privacy sul cloud AWS.

Per la sicurezza e la privacy, il servizio OpenSearch fornisce la protezione dei dati identità e gestione degli accessi ed prevenzione dei proxy confusi tra servizi. È possibile utilizzare un controllo capillare dell'accesso utente in modo che l'utente possa accedere solo ai dati a cui è autorizzato ad accedere. Inoltre, SageMaker fornisce impostazioni di sicurezza configurabili per controllo degli accessi, protezione datie registrazione e monitoraggio. Puoi proteggere i tuoi dati a riposo e in transito con Servizio di gestione delle chiavi AWS (AWS KMS). Puoi anche tenere traccia del registro della distribuzione del modello SageMaker o dell'accesso all'endpoint utilizzando Amazon Cloud Watch. Per ulteriori informazioni, fare riferimento a Monitora Amazon SageMaker con Amazon CloudWatch.

Per l'elevata scalabilità del servizio OpenSearch, puoi modificarlo tramite dimensionamento dei domini del servizio OpenSearch e impiegando migliori pratiche operative. Puoi anche sfruttare il ridimensionamento automatico del tuo endpoint SageMaker: puoi ridimensionare automaticamente i modelli SageMaker per regolare l'endpoint sia quando il traffico aumenta sia quando le risorse non vengono utilizzate.

ripulire

Per risparmiare sui costi, elimina tutte le risorse che hai distribuito come parte di questo post. Se hai avviato lo stack CloudFormation, puoi eliminarlo tramite la console AWS CloudFormation. Allo stesso modo, puoi eliminare qualsiasi endpoint SageMaker che potresti aver creato tramite la console SageMaker.

Conclusione

In questo post, abbiamo mostrato come creare un'applicazione di intelligenza artificiale generativa end-to-end per la ricerca aziendale con RAG utilizzando le pipeline Haystack e il modello Falcon-40b-instruct di SageMaker JumpStart e OpenSearch Service. L'approccio RAG è fondamentale nella ricerca aziendale perché garantisce che le risposte generate siano all'interno del dominio e quindi mitigano le allucinazioni. Utilizzando le pipeline Haystack, siamo in grado di orchestrare applicazioni LLM costituite da diversi componenti come modelli e database vettoriali. SageMaker JumpStart ci fornisce una soluzione con un clic per l'implementazione di LLM e abbiamo utilizzato OpenSearch Service come database vettoriale per i nostri dati indicizzati. Puoi iniziare a sperimentare e creare prove di concetto RAG per le tue applicazioni di intelligenza artificiale generativa aziendale, utilizzando i passaggi descritti in questo post e il codice sorgente disponibile nel Repository GitHub.

Informazioni sugli autori

Tuana Celik è Lead Developer Advocate presso deepset, dove si concentra sulla comunità open source per Haystack. Dirige la funzione delle relazioni con gli sviluppatori e parla regolarmente a eventi sulla PNL e crea materiali didattici per la comunità.

Tuana Celik è Lead Developer Advocate presso deepset, dove si concentra sulla comunità open source per Haystack. Dirige la funzione delle relazioni con gli sviluppatori e parla regolarmente a eventi sulla PNL e crea materiali didattici per la comunità.

Roy Allela è un Senior AI/ML Specialist Solutions Architect presso AWS con sede a Monaco, Germania. Roy aiuta i clienti AWS, dalle piccole startup alle grandi imprese, a formare e distribuire modelli linguistici di grandi dimensioni in modo efficiente su AWS. Roy è appassionato di problemi di ottimizzazione computazionale e di miglioramento delle prestazioni dei carichi di lavoro di intelligenza artificiale.

Roy Allela è un Senior AI/ML Specialist Solutions Architect presso AWS con sede a Monaco, Germania. Roy aiuta i clienti AWS, dalle piccole startup alle grandi imprese, a formare e distribuire modelli linguistici di grandi dimensioni in modo efficiente su AWS. Roy è appassionato di problemi di ottimizzazione computazionale e di miglioramento delle prestazioni dei carichi di lavoro di intelligenza artificiale.

Mia Chang è un ML Specialist Solutions Architect per Amazon Web Services. Lavora con clienti nell'area EMEA e condivide le best practice per l'esecuzione di carichi di lavoro AI/ML sul cloud con il suo background in matematica applicata, informatica e AI/ML. Si concentra su carichi di lavoro specifici della PNL e condivide la sua esperienza come relatrice di conferenze e autrice di libri. Nel tempo libero le piacciono le escursioni, i giochi da tavolo e la preparazione del caffè.

Mia Chang è un ML Specialist Solutions Architect per Amazon Web Services. Lavora con clienti nell'area EMEA e condivide le best practice per l'esecuzione di carichi di lavoro AI/ML sul cloud con il suo background in matematica applicata, informatica e AI/ML. Si concentra su carichi di lavoro specifici della PNL e condivide la sua esperienza come relatrice di conferenze e autrice di libri. Nel tempo libero le piacciono le escursioni, i giochi da tavolo e la preparazione del caffè.

Inaam Syed è uno Startup Solutions Architect presso AWS, con una forte attenzione all'assistenza alle startup B2B e SaaS nel ridimensionamento e nel raggiungimento della crescita. Possiede una profonda passione per le architetture serverless e AI/ML. Nel suo tempo libero, Inaam trascorre momenti di qualità con la sua famiglia e si abbandona al suo amore per la bicicletta e il badminton.

Inaam Syed è uno Startup Solutions Architect presso AWS, con una forte attenzione all'assistenza alle startup B2B e SaaS nel ridimensionamento e nel raggiungimento della crescita. Possiede una profonda passione per le architetture serverless e AI/ML. Nel suo tempo libero, Inaam trascorre momenti di qualità con la sua famiglia e si abbandona al suo amore per la bicicletta e il badminton.

David Tipetti è il Senior Developer Advocate che lavora su OpenSearch open source presso AWS. Il suo lavoro coinvolge tutte le aree di OpenSearch, dalla ricerca e pertinenza all'osservabilità e all'analisi della sicurezza.

David Tipetti è il Senior Developer Advocate che lavora su OpenSearch open source presso AWS. Il suo lavoro coinvolge tutte le aree di OpenSearch, dalla ricerca e pertinenza all'osservabilità e all'analisi della sicurezza.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Automobilistico/VE, Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- Platone Salute. Intelligence sulle biotecnologie e sulle sperimentazioni cliniche. Accedi qui.

- Grafico Prime. Migliora il tuo gioco di trading con ChartPrime. Accedi qui.

- BlockOffset. Modernizzare la proprietà della compensazione ambientale. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/build-production-ready-generative-ai-applications-for-enterprise-search-using-haystack-pipelines-and-amazon-sagemaker-jumpstart-with-llms/

- :ha

- :È

- :non

- :Dove

- $ SU

- 100

- 12

- 13

- 30

- 500

- 7

- 8

- a

- capace

- WRI

- accelerare

- accesso

- realizzare

- di conseguenza

- Il mio account

- precisione

- Raggiungere

- raggiunto

- il raggiungimento

- atti

- adattare

- aggiuntivo

- Inoltre

- amministrativo

- Vantaggio

- Avvento

- avvocato

- AI

- AI / ML

- Tutti

- consentire

- consente

- lungo

- anche

- Sebbene il

- Amazon

- Amazon Sage Maker

- JumpStart di Amazon SageMaker

- Amazon Web Services

- tra

- an

- analitica

- ed

- rispondere

- in qualsiasi

- Apache

- Applicazioni

- applicazioni

- applicato

- approccio

- circa

- SONO

- aree

- in giro

- Italia

- Arte

- news

- AS

- assistere

- At

- Audio

- aumentata

- autore

- autorizzato

- auto

- disponibile

- AWS

- AWS CloudFormazione

- B2B

- sfondo

- base

- basato

- BE

- perché

- diventare

- prima

- essendo

- sotto

- MIGLIORE

- best practice

- Big

- Blog

- tavola

- Giochi da tavolo

- stile di vita

- libro

- entrambi

- ampio

- costruire

- Costruzione

- costruito

- pachetti sconto

- ma

- pulsante

- by

- detto

- Materiale

- funzionalità

- casi

- il cambiamento

- cambiando

- dai un'occhiata

- scegliere

- Scegli

- la scelta

- ha scelto

- classe

- Pulizia

- più vicino

- Cloud

- codice

- Caffè

- Uncommon

- comunità

- azienda

- Complemento

- completamento di una

- componente

- componenti

- incluso

- computer

- Informatica

- concetto

- Convegno

- confuso

- Connettiti

- considerando

- consolle

- contenute

- contenuto

- contesto

- di controllo

- discorsivo

- AI conversazionale

- Costi

- coperto

- Copertine

- creare

- creato

- crea

- critico

- Clienti

- dati

- Preparazione dei dati

- protezione dati

- Banca Dati

- banche dati

- DBS

- affare

- deep

- apprendimento profondo

- definito

- dimostrazione

- dipendenze

- schierare

- schierato

- distribuzione

- deployment

- Design

- progettato

- progettazione

- dettagliati

- sviluppato

- Costruttori

- sviluppatori

- Mercato

- diverso

- digitale

- digitalizzazione

- dimensioni

- dirette

- do

- documento

- documentazione

- documenti

- effettua

- non

- don

- Dont

- ogni

- facile

- efficienza

- efficiente

- in modo efficiente

- o

- elementi

- incastrare

- incorporato

- incorporamento

- enable

- fine

- da un capo all'altro

- endpoint

- Motori

- accrescere

- garantire

- assicura

- Impresa

- entità

- entità

- Ambiente

- valutazione

- eventi

- qualunque cosa

- esempio

- previsto

- esperienza

- Esperienze

- esperimento

- export

- esterno

- Faccia

- famiglia

- figura

- Compila il

- File

- filtro

- finale

- Nome

- in forma

- flessibile

- flessibilmente

- Focus

- si concentra

- i seguenti

- Nel

- formato

- Fondazione

- Contesto

- Gratis

- da

- completamente

- function

- Giochi

- generare

- generato

- genera

- ELETTRICA

- generativo

- AI generativa

- Germania

- ottenere

- dato

- Gruppo

- Crescita

- maniglia

- Avere

- avendo

- he

- aiuta

- suo

- qui

- Alta

- alto livello

- vivamente

- il suo

- padroni di casa

- Come

- Tutorial

- Tuttavia

- HTML

- http

- HTTPS

- Hub

- i

- Identità

- if

- Impact

- realizzare

- importante

- miglioramento

- in

- includere

- inclusi

- Compreso

- è aumentato

- sempre più

- Index

- indicizzati

- indici

- informazioni

- Infrastruttura

- ingresso

- install

- esempio

- istruzioni

- Internet

- ai miglioramenti

- IT

- SUO

- jpg

- Le

- Tasti

- Sapere

- conoscenze

- Gestione della conoscenza

- Lingua

- grandi

- lanciare

- lanciato

- portare

- Leads

- apprendimento

- Licenza

- Autorizzato

- leggero

- piace

- probabile

- LIMITE

- limiti

- linea

- LLM

- ceppo

- registrazione

- cerca

- amore

- macchina

- machine learning

- fatto

- make

- FA

- Fare

- gestire

- gestito

- gestione

- Materiale

- matematica

- massimo

- Maggio..

- significare

- Media

- metodi

- Metrica

- milioni

- Minuti

- attenuante

- ML

- modello

- modelli

- modificare

- moduli

- Moments

- monitoraggio

- Scopri di più

- maggior parte

- cambiano

- Nome

- Detto

- Naturale

- Elaborazione del linguaggio naturale

- navigazione

- Bisogno

- esigenze

- nlp

- taccuino

- numero

- of

- offrire

- Offerte

- on

- esclusivamente

- aprire

- open source

- Software open source

- operare

- ottimizzazione

- Opzione

- Opzioni

- or

- organizzativa

- Organizzato

- i

- Altro

- nostro

- delineato

- ancora

- proprio

- pacchetto

- pagina

- pagine

- parte

- partner

- passione

- appassionato

- Eseguire

- performance

- conduttura

- Platone

- Platone Data Intelligence

- PlatoneDati

- Giocare

- per favore

- punto

- Popolare

- Post

- potente

- pratiche

- preparazione

- Preparare

- Privacy

- problemi

- processi

- lavorazione

- Produzione

- Progressi

- progetto

- prove

- proposto

- proprio

- protegge

- protezione

- prototipo

- fornire

- purché

- fornisce

- fornitura

- delega

- la percezione

- Spingi

- qualità

- query

- domanda

- Domande

- Crudo

- ricevuto

- recente

- Consigli

- raccomandato

- regolarmente

- relazioni

- rilevanza

- pertinente

- affidabile

- ricorda

- deposito

- richiesta

- richiedere

- necessario

- Requisiti

- Risorse

- risposta

- risposte

- REST

- limitare

- colpevole

- Risultati

- problemi

- Ricco

- destra

- roy

- Correre

- running

- SaaS

- sagemaker

- Risparmi

- dire

- Scalabilità

- scalabile

- Scala

- scala

- Scienze

- Cerca

- problemi di

- vedere

- inviare

- invia

- anziano

- serverless

- serve

- servizio

- Servizi

- set

- impostazioni

- flessibile.

- Forma

- azioni

- lei

- NAVE

- dovrebbero

- mostrare attraverso le sue creazioni

- vetrina

- in mostra

- firmato

- simile

- Allo stesso modo

- Un'espansione

- semplicemente

- piccole

- So

- Software

- unicamente

- solido

- soluzione

- Soluzioni

- alcuni

- qualcosa

- Fonte

- codice sorgente

- lo spazio

- Speaker

- Parla

- specialista

- specializzata

- Stabilità

- pila

- Stage

- inizia a

- startup

- Startup

- step

- Passi

- memorizzare

- forte

- La struttura

- tale

- suite

- sicuro

- Fai

- prende

- tecniche

- modelli

- testato

- che

- Il

- L’ORIGINE

- Li

- poi

- in tal modo

- perciò

- Strumenti Bowman per analizzare le seguenti finiture:

- di

- cosa

- think

- questo

- migliaia

- Attraverso

- tempo

- a

- insieme

- pista

- traffico

- transito

- affidabili sul mercato

- seconda

- Digitare

- tipicamente

- in definitiva

- per

- caricato

- us

- uso

- utilizzato

- Utente

- utenti

- usa

- utilizzando

- utilità

- APPREZZIAMO

- Valori

- vario

- via

- visione

- attese

- we

- sito web

- servizi web

- Sito web

- quando

- quale

- volere

- con

- entro

- Word

- Lavora

- flusso di lavoro

- lavoro

- lavori

- sarebbe

- scrivere

- YAML

- anni

- Tu

- Trasferimento da aeroporto a Sharm

- zefiro