L'aumento della ricerca contestuale e semantica ha reso la ricerca delle attività di e-commerce e di vendita al dettaglio semplice per i suoi consumatori. I motori di ricerca e i sistemi di raccomandazione basati sull’intelligenza artificiale generativa possono migliorare esponenzialmente l’esperienza di ricerca dei prodotti comprendendo le query in linguaggio naturale e restituendo risultati più accurati. Ciò migliora l'esperienza utente complessiva, aiutando i clienti a trovare esattamente ciò che stanno cercando.

Servizio Amazon OpenSearch ora supporta il somiglianza del coseno metrica per indici k-NN. La somiglianza del coseno misura il coseno dell'angolo tra due vettori, dove un angolo di coseno più piccolo denota una maggiore somiglianza tra i vettori. Con la somiglianza del coseno, puoi misurare l'orientamento tra due vettori, il che lo rende una buona scelta per alcune specifiche applicazioni di ricerca semantica.

In questo post, mostriamo come creare un motore di ricerca contestuale di testo e immagini per consigli sui prodotti utilizzando Modello di incorporamento multimodale di Amazon Titan, disponibili in Roccia Amazzonica, con Amazon OpenSearch senza server.

Un modello di incorporamento multimodale è progettato per apprendere rappresentazioni congiunte di diverse modalità come testo, immagini e audio. Attraverso l'addestramento su set di dati su larga scala contenenti immagini e le didascalie corrispondenti, un modello di incorporamento multimodale impara a incorporare immagini e testi in uno spazio latente condiviso. Quella che segue è una panoramica di alto livello di come funziona concettualmente:

- Encoder separati – Questi modelli dispongono di codificatori separati per ciascuna modalità: un codificatore di testo per il testo (ad esempio, BERT o RoBERTa), un codificatore di immagini per immagini (ad esempio, CNN per immagini) e codificatori audio per l'audio (ad esempio, modelli come Wav2Vec) . Ogni codificatore genera incorporamenti che catturano caratteristiche semantiche delle rispettive modalità

- Fusione delle modalità – Gli incorporamenti degli encoder unimodali vengono combinati utilizzando ulteriori strati di rete neurale. L’obiettivo è apprendere le interazioni e le correlazioni tra le modalità. Gli approcci comuni alla fusione includono la concatenazione, le operazioni basate sugli elementi, il pooling e i meccanismi di attenzione.

- Spazio di rappresentazione condiviso – Gli strati di fusione aiutano a proiettare le modalità individuali in uno spazio di rappresentazione condiviso. Attraverso l'addestramento su set di dati multimodali, il modello apprende uno spazio di incorporamento comune in cui gli incorporamenti di ciascuna modalità che rappresentano lo stesso contenuto semantico sottostante sono più vicini tra loro.

- Compiti a valle – Gli incorporamenti multimodali congiunti generati possono quindi essere utilizzati per varie attività a valle come il recupero, la classificazione o la traduzione multimodale. Il modello utilizza correlazioni tra modalità per migliorare le prestazioni su questi compiti rispetto ai singoli incorporamenti modali. Il vantaggio principale è la capacità di comprendere le interazioni e la semantica tra modalità come testo, immagini e audio attraverso la modellazione congiunta.

Panoramica della soluzione

La soluzione fornisce un'implementazione per la creazione di un prototipo di motore di ricerca basato su Large Language Model (LLM) per recuperare e consigliare prodotti in base a query di testo o immagini. Descriviamo in dettaglio i passaggi per utilizzare un Incorporamenti multimodali di Amazon Titan modello per codificare immagini e testo in incorporamenti, importare incorporamenti in un indice del servizio OpenSearch ed eseguire query sull'indice utilizzando il servizio OpenSearch Funzionalità k-vicini più vicini (k-NN)..

Questa soluzione include i seguenti componenti:

- Modello di incorporamento multimodale di Amazon Titan – Questo modello di fondazione (FM) genera incorporamenti delle immagini del prodotto utilizzate in questo post. Con Amazon Titan Multimodal Embeddings, puoi generare incorporamenti per i tuoi contenuti e archiviarli in un database vettoriale. Quando un utente finale invia qualsiasi combinazione di testo e immagine come query di ricerca, il modello genera incorporamenti per la query di ricerca e li abbina agli incorporamenti archiviati per fornire risultati di ricerca e consigli pertinenti agli utenti finali. Puoi personalizzare ulteriormente il modello per migliorare la comprensione dei tuoi contenuti unici e fornire risultati più significativi utilizzando coppie immagine-testo per la messa a punto. Per impostazione predefinita, il modello genera vettori (incorporamenti) di 1,024 dimensioni ed è accessibile tramite Amazon Bedrock. Puoi anche generare dimensioni più piccole per ottimizzare la velocità e le prestazioni

- Amazon OpenSearch senza server – È una configurazione serverless su richiesta per il servizio OpenSearch. Utilizziamo Amazon OpenSearch Serverless come database vettoriale per l'archiviazione degli incorporamenti generati dal modello Amazon Titan Multimodal Embeddings. Un indice creato nella raccolta Amazon OpenSearch Serverless funge da archivio vettoriale per la nostra soluzione Retrieval Augmented Generation (RAG).

- Amazon Sage Maker Studio – È un ambiente di sviluppo integrato (IDE) per l’apprendimento automatico (ML). I professionisti del machine learning possono eseguire tutte le fasi di sviluppo del machine learning, dalla preparazione dei dati alla creazione, formazione e distribuzione di modelli di machine learning.

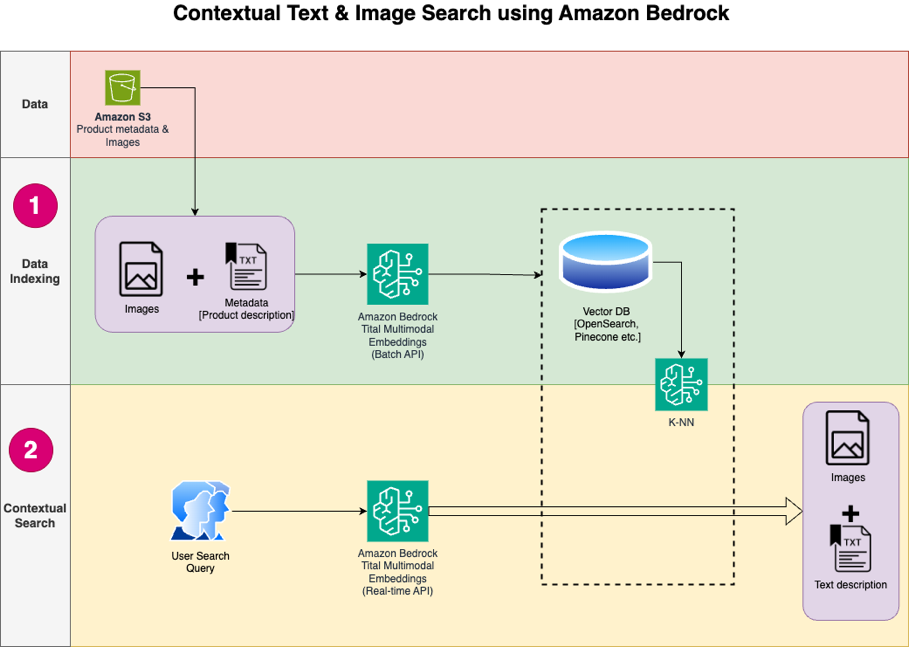

Il progetto della soluzione è composto da due parti: indicizzazione dei dati e ricerca contestuale. Durante l'indicizzazione dei dati, elabori le immagini del prodotto per generare incorporamenti per queste immagini e quindi popolare l'archivio dati vettoriali. Questi passaggi vengono completati prima dei passaggi di interazione con l'utente.

Nella fase di ricerca contestuale, una query di ricerca (testo o immagine) dell'utente viene convertita in incorporamenti e viene eseguita una ricerca di somiglianza sul database vettoriale per trovare le immagini di prodotti simili in base alla ricerca di somiglianza. Vengono quindi visualizzati i primi risultati simili. Tutto il codice per questo post è disponibile nel file Repository GitHub.

Il diagramma seguente illustra l'architettura della soluzione.

Di seguito sono riportati i passaggi del flusso di lavoro della soluzione:

- Scarica il testo e le immagini della descrizione del prodotto dal pubblico Servizio di archiviazione semplice Amazon (Amazon S3) secchio.

- Esaminare e preparare il set di dati.

- Genera incorporamenti per le immagini del prodotto utilizzando il modello Amazon Titan Multimodal Embeddings (amazon.titan-embed-image-v1). Se hai un numero enorme di immagini e descrizioni, puoi facoltativamente utilizzare il file Inferenza batch per Amazon Bedrock.

- Memorizza gli incorporamenti nel file Amazon OpenSearch senza server come motore di ricerca.

- Infine, recupera la query dell'utente in linguaggio naturale, convertila in incorporamenti utilizzando il modello Amazon Titan Multimodal Embeddings ed esegui una ricerca k-NN per ottenere i risultati di ricerca pertinenti.

Utilizziamo SageMaker Studio (non mostrato nel diagramma) come IDE per sviluppare la soluzione.

Questi passaggi vengono discussi in dettaglio nelle sezioni seguenti. Includiamo anche screenshot e dettagli dell'output.

Prerequisiti

Per implementare la soluzione fornita in questo post, dovresti avere quanto segue:

- An Account AWS e familiarità con FM, Amazon Bedrock, Amazon Sage Makere il servizio OpenSearch.

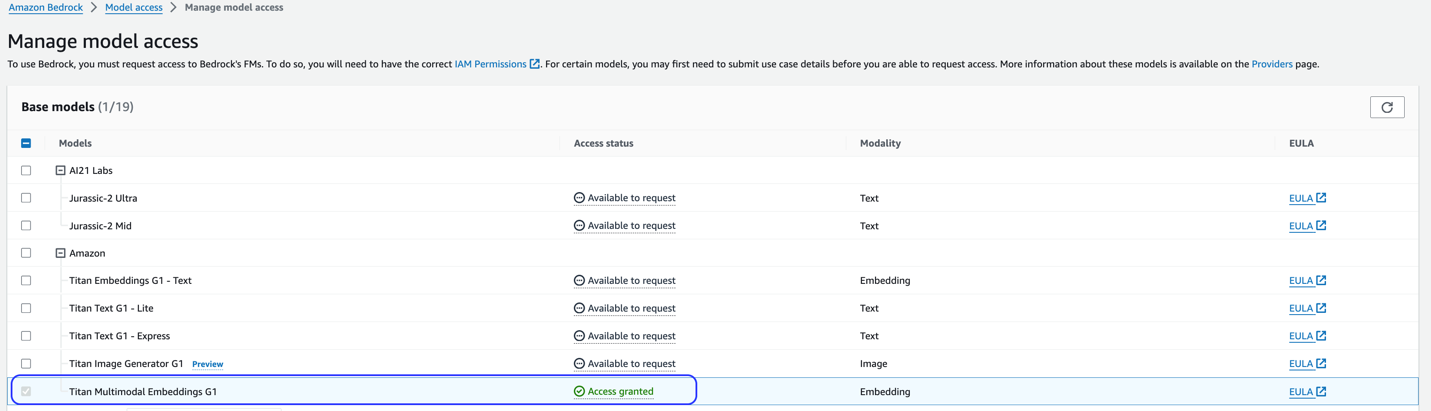

- Il modello di incorporamento multimodale di Amazon Titan abilitato in Amazon Bedrock. Puoi confermare che sia abilitato su Accesso al modello pagina della console Amazon Bedrock. Se gli incorporamenti multimodali di Amazon Titan sono abilitati, lo stato di accesso verrà visualizzato come Accesso garantito, come mostrato nella seguente schermata.

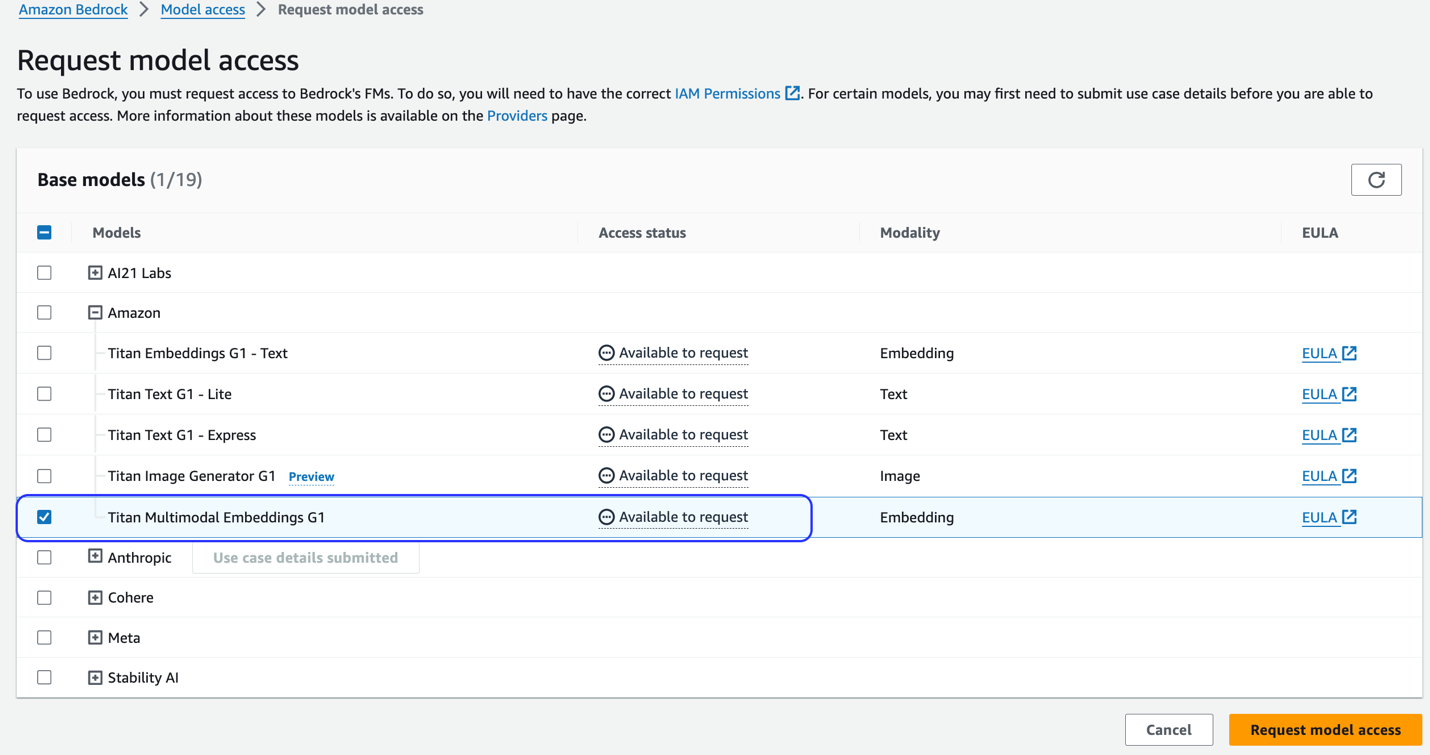

Se il modello non è disponibile, abilitare l'accesso al modello scegliendo Gestire l'accesso al modello, selezionando Incorporamenti multimodali di Amazon Titan G1e scegliendo Richiedi l'accesso al modello. Il modello è abilitato per l'uso immediatamente.

Imposta la soluzione

Una volta completati i passaggi prerequisiti, sei pronto per configurare la soluzione:

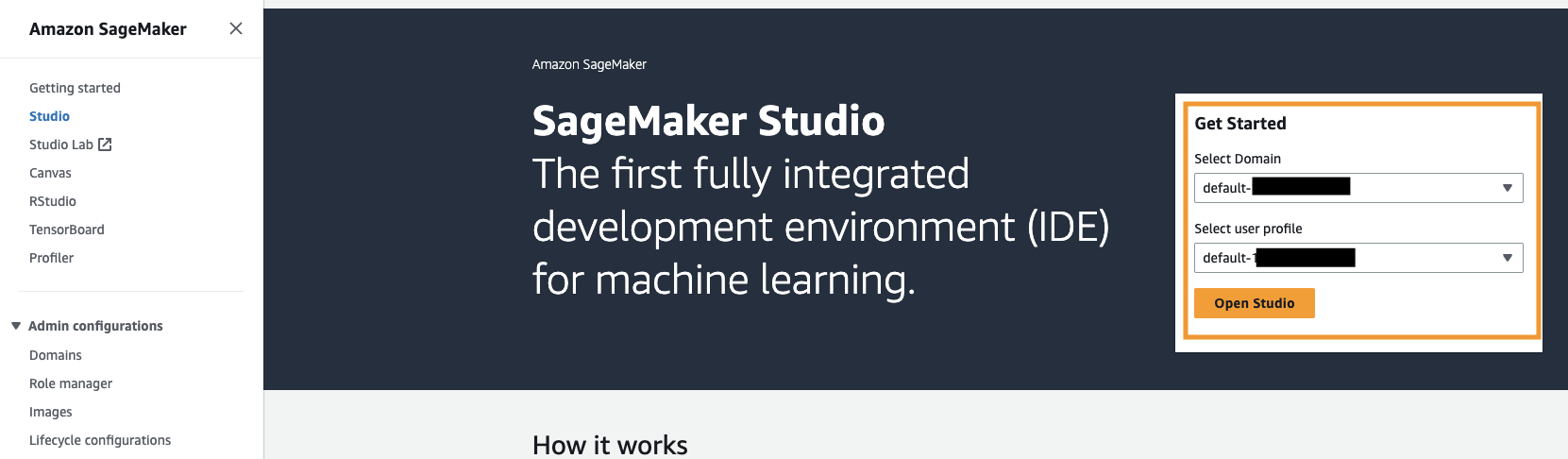

- Nel tuo account AWS, apri la console SageMaker e scegli Studio nel pannello di navigazione.

- Scegli il tuo dominio e il tuo profilo utente, quindi scegli Apri Studio.

Il tuo dominio e il nome del tuo profilo utente potrebbero essere diversi.

- Scegli Terminale di sistema per Utilità e file.

- Esegui il comando seguente per clonare il file Repository GitHub all'istanza di SageMaker Studio:

- Passare alla

multimodal/Titan/titan-multimodal-embeddings/amazon-bedrock-multimodal-oss-searchengine-e2ecartella. - Aprire il

titan_mm_embed_search_blog.ipynbtaccuino.

Esegui la soluzione

Aprire il file titan_mm_embed_search_blog.ipynb e utilizzare il kernel Data Science Python 3. Sul Correre menù, scegliere Esegui tutte le celle per eseguire il codice in questo blocco appunti.

Questo notebook esegue i seguenti passaggi:

- Installa i pacchetti e le librerie necessari per questa soluzione.

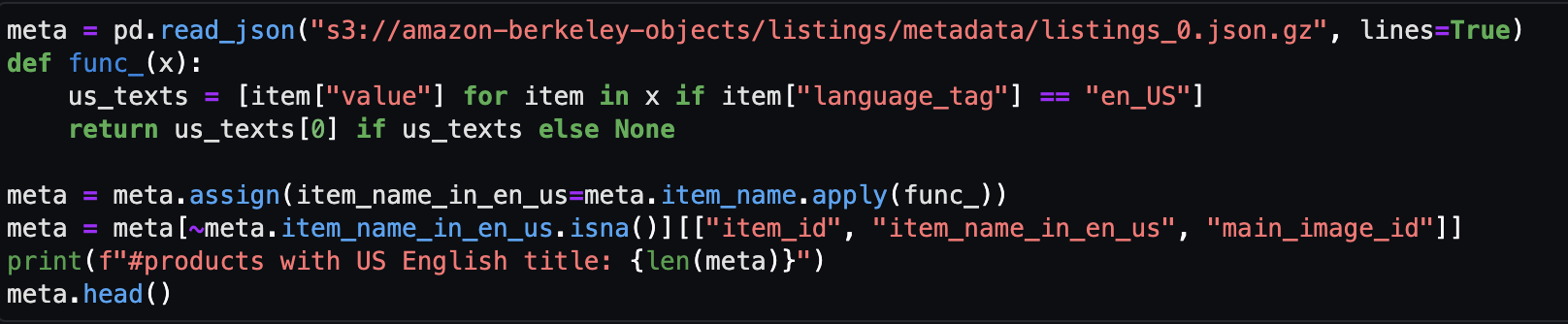

- Carica il disponibile al pubblico Set di dati di oggetti di Amazon Berkeley e metadati in un frame di dati panda.

Il set di dati è una raccolta di 147,702 elenchi di prodotti con metadati multilingue e 398,212 immagini di catalogo uniche. Per questo post, utilizzerai le immagini e i nomi degli articoli solo in inglese americano. Utilizzi circa 1,600 prodotti.

- Genera incorporamenti per le immagini degli articoli utilizzando il modello Amazon Titan Multimodal Embeddings utilizzando il file

get_titan_multomodal_embedding()funzione. Per motivi di astrazione, abbiamo definito tutte le funzioni importanti utilizzate in questo notebook nel fileutils.pyfile.

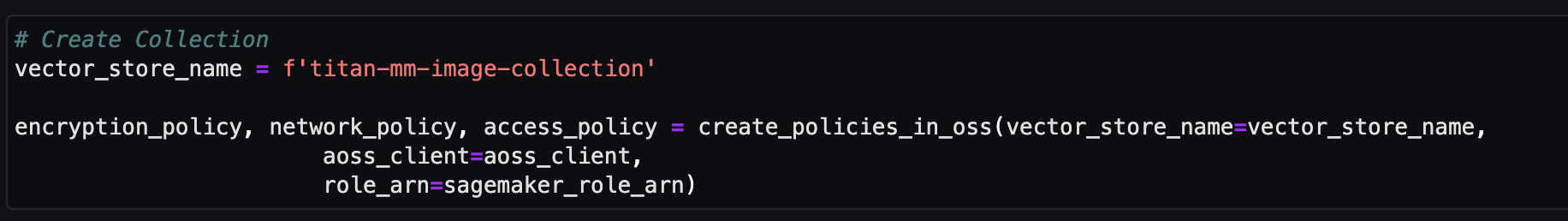

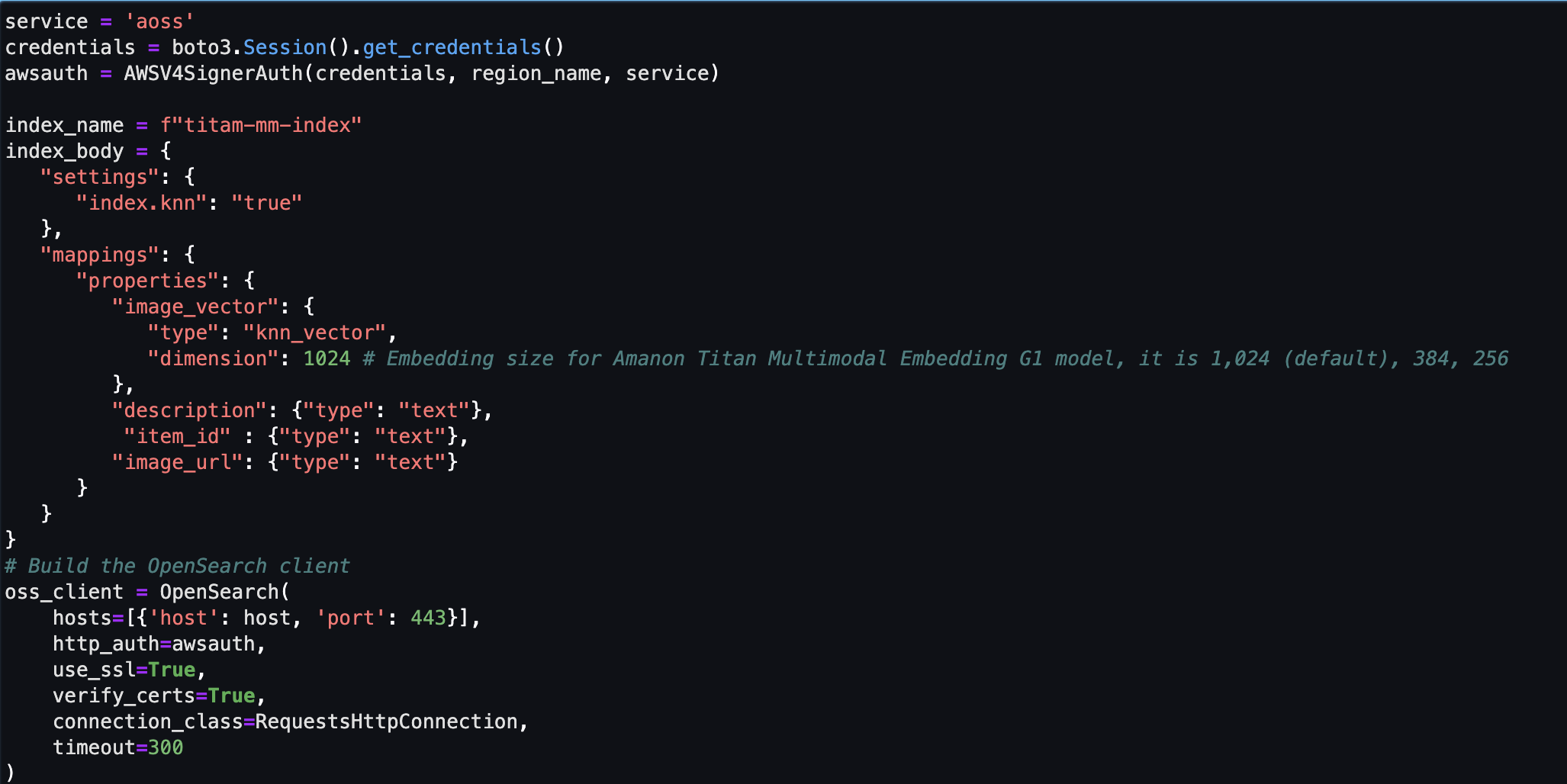

Successivamente, creerai e configuri un archivio vettoriale Amazon OpenSearch Serverless (raccolta e indice).

- Prima di creare la nuova raccolta e indice di ricerca vettoriale, è necessario creare tre policy del servizio OpenSearch associate: la policy di sicurezza della crittografia, la policy di sicurezza della rete e la policy di accesso ai dati.

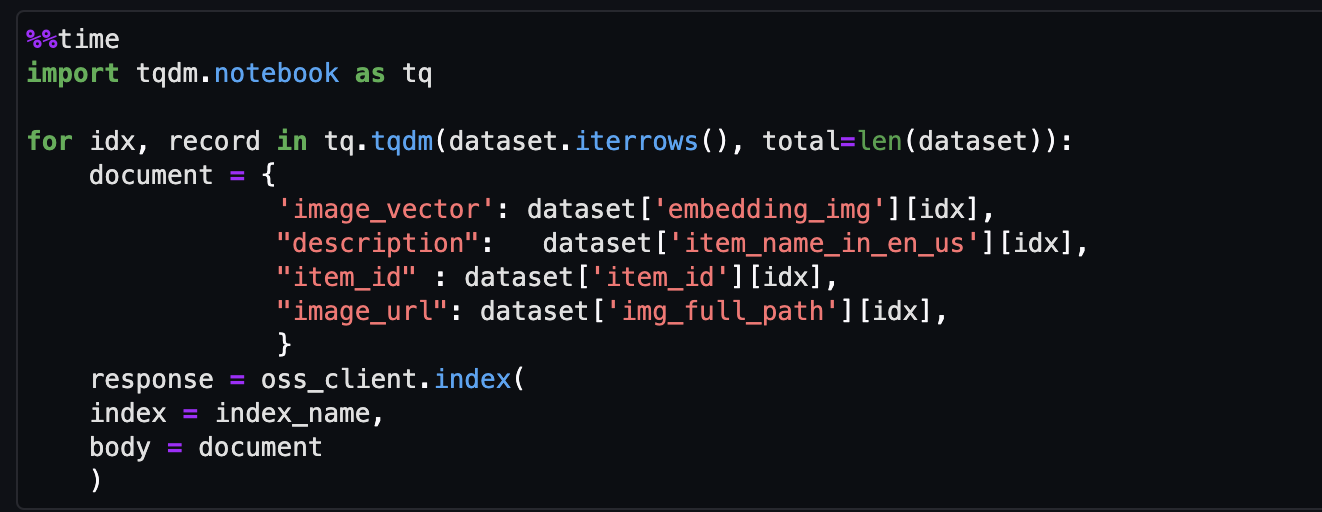

- Infine, inserisci l'incorporamento dell'immagine nell'indice del vettore.

Ora puoi eseguire una ricerca multimodale in tempo reale.

Esegui una ricerca contestuale

In questa sezione mostriamo i risultati della ricerca contestuale basata su una query di testo o immagine.

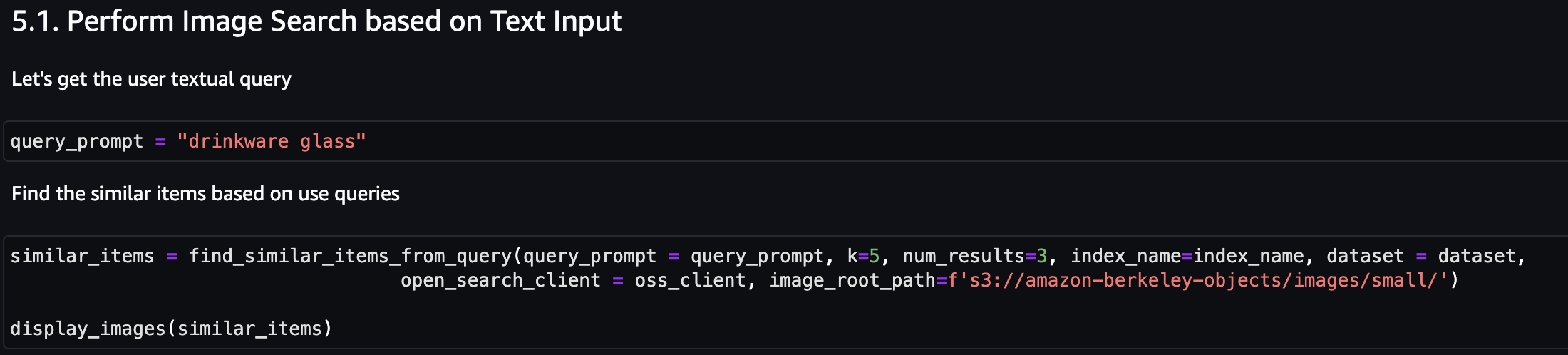

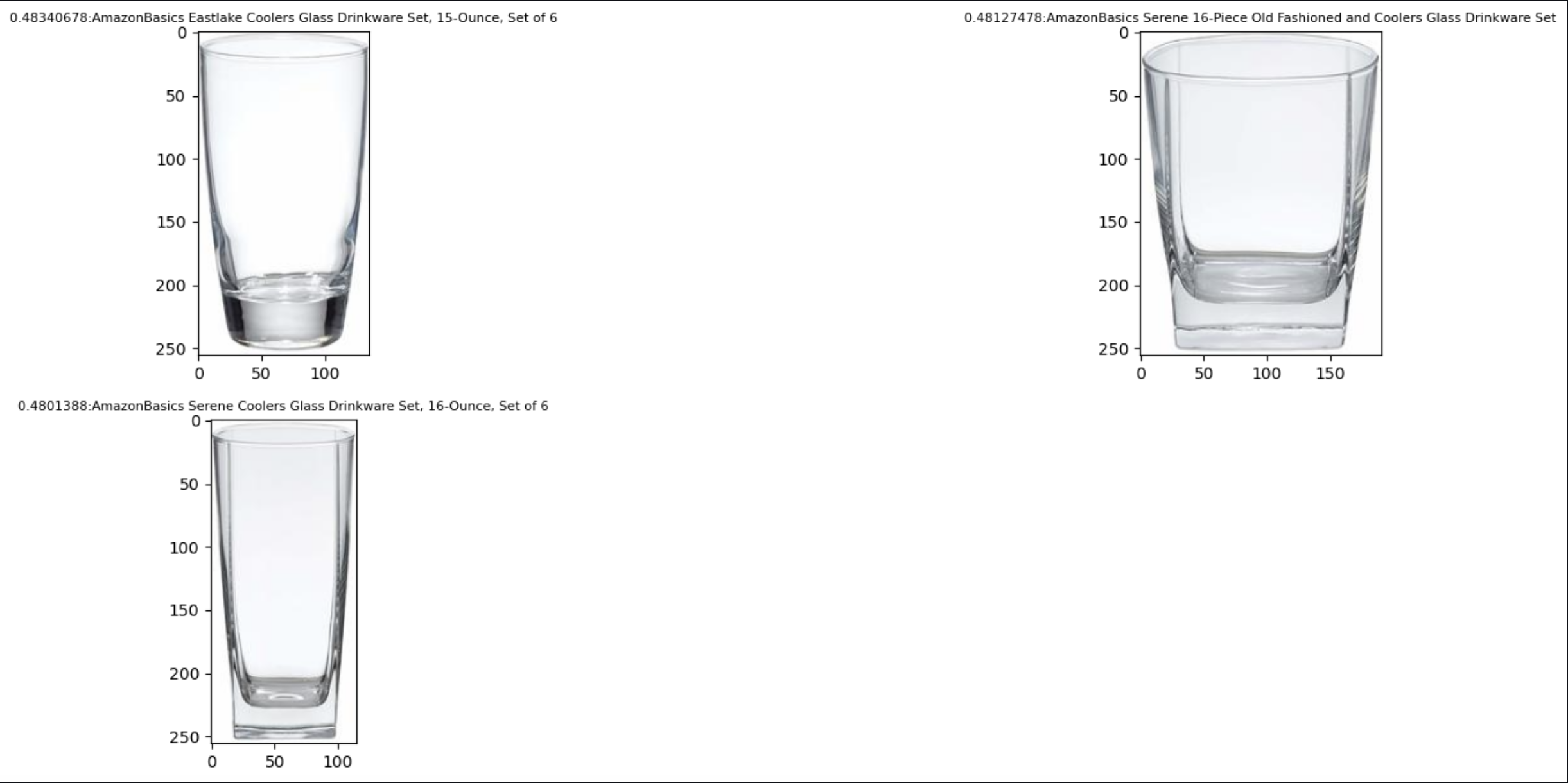

Innanzitutto, eseguiamo una ricerca di immagini basata sull'immissione di testo. Nell'esempio seguente utilizziamo l'input di testo “drinkware glass” e lo inviamo al motore di ricerca per trovare articoli simili.

Lo screenshot seguente mostra i risultati.

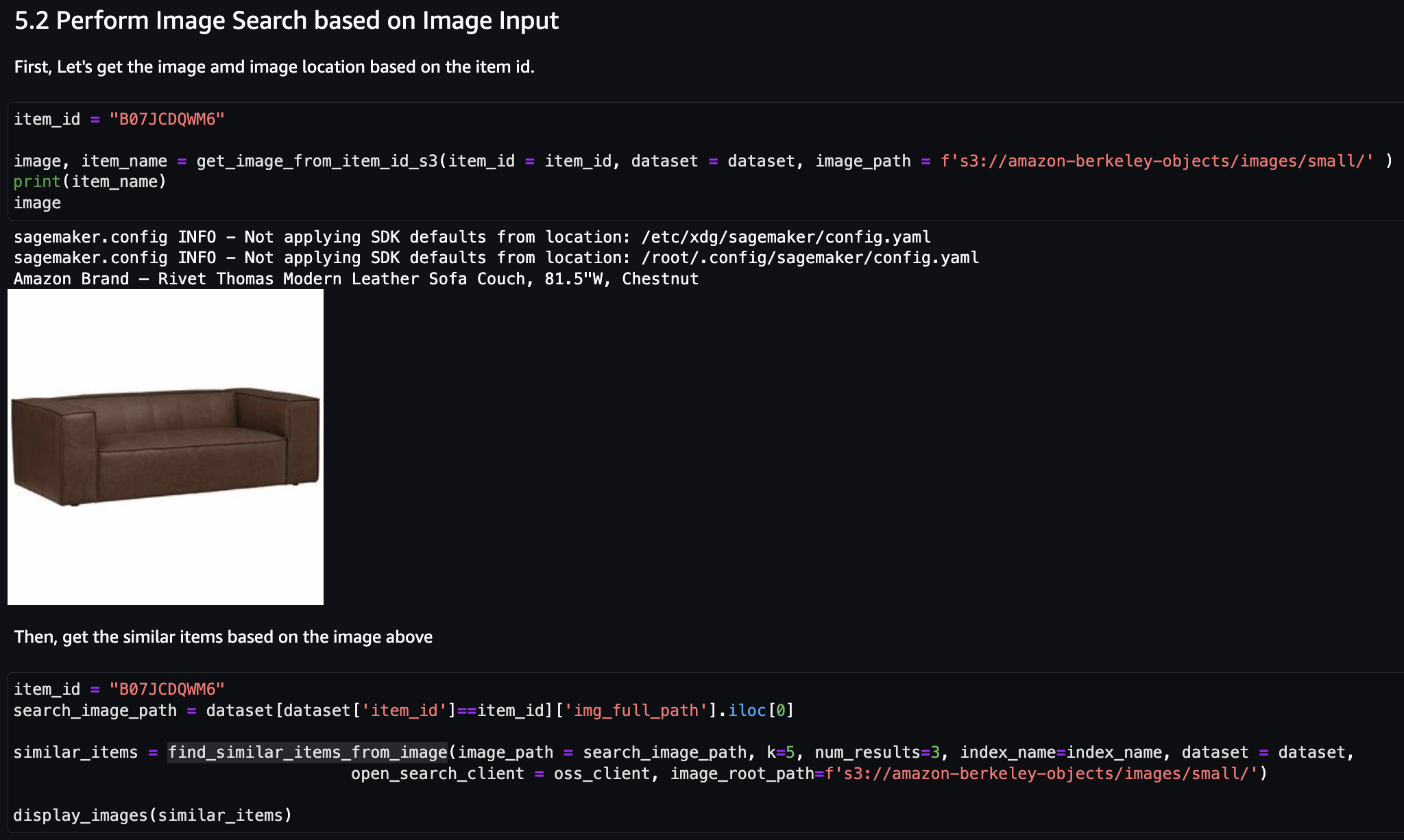

Ora diamo un'occhiata ai risultati basandoci su una semplice immagine. L'immagine di input viene convertita in incorporamenti di vettori e, in base alla ricerca di somiglianza, il modello restituisce il risultato.

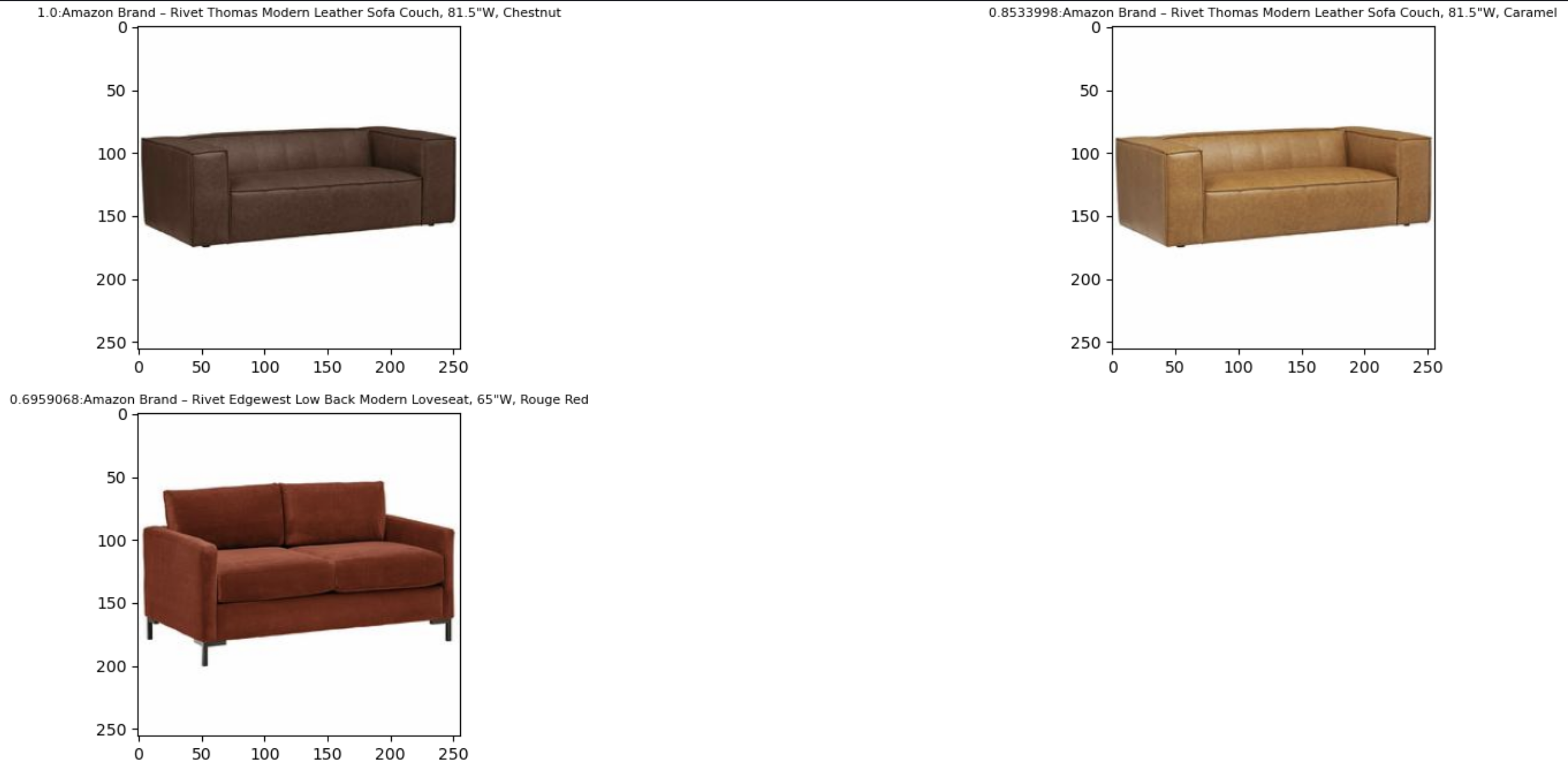

Puoi utilizzare qualsiasi immagine, ma per l'esempio seguente utilizziamo un'immagine casuale dal set di dati in base all'ID articolo (ad esempio, item_id = “B07JCDQWM6”), quindi invia questa immagine al motore di ricerca per trovare articoli simili.

Lo screenshot seguente mostra i risultati.

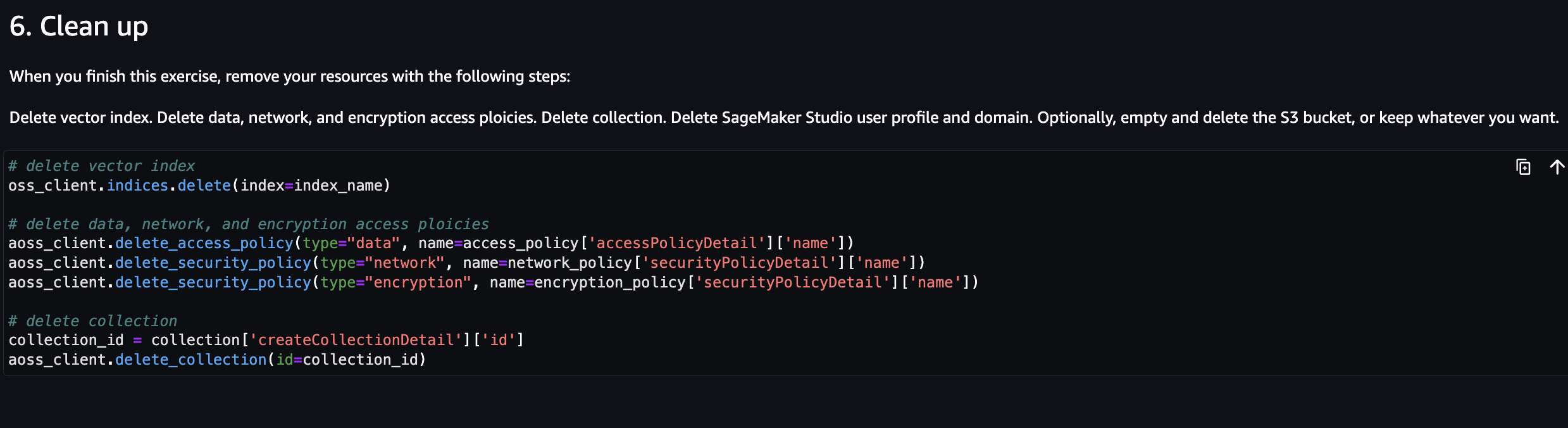

ripulire

Per evitare di incorrere in addebiti futuri, elimina le risorse utilizzate in questa soluzione. Puoi farlo eseguendo la sezione di pulizia del notebook.

Conclusione

Questo post ha presentato una procedura dettagliata sull'utilizzo del modello Amazon Titan Multimodal Embeddings in Amazon Bedrock per creare potenti applicazioni di ricerca contestuale. In particolare, abbiamo dimostrato un esempio di un'applicazione di ricerca di elenchi di prodotti. Abbiamo visto come il modello di incorporamento consenta la scoperta efficiente e accurata di informazioni da immagini e dati testuali, migliorando così l'esperienza dell'utente durante la ricerca degli elementi rilevanti.

Amazon Titan Multimodal Embeddings ti aiuta a fornire agli utenti finali esperienze di ricerca multimodale, consigli e personalizzazione più accurate e contestualmente pertinenti. Ad esempio, un'azienda di fotografia stock con centinaia di milioni di immagini può utilizzare il modello per potenziare la propria funzionalità di ricerca, in modo che gli utenti possano cercare immagini utilizzando una frase, un'immagine o una combinazione di immagine e testo.

Il modello Amazon Titan Multimodal Embeddings in Amazon Bedrock è ora disponibile nelle regioni AWS Stati Uniti orientali (Virginia settentrionale) e Stati Uniti occidentali (Oregon). Per saperne di più, fare riferimento a Amazon Titan Image Generator, incorporamenti multimodali e modelli di testo sono ora disponibili in Amazon Bedrock, le Pagina del prodotto Amazon Titan, e il Guida per l'utente di Amazon Bedrock. Per iniziare con gli incorporamenti multimodali di Amazon Titan in Amazon Bedrock, visita il sito Console Amazon Bedrock.

Inizia a costruire con il modello Amazon Titan Multimodal Embeddings in Roccia Amazzonica oggi.

Informazioni sugli autori

Sandeep Singh è un Senior Generative AI Data Scientist presso Amazon Web Services e aiuta le aziende a innovare con l'intelligenza artificiale generativa. È specializzato in intelligenza artificiale generativa, intelligenza artificiale, machine learning e progettazione di sistemi. La sua passione è lo sviluppo di soluzioni all'avanguardia basate su AI/ML per risolvere problemi aziendali complessi per diversi settori, ottimizzando efficienza e scalabilità.

Sandeep Singh è un Senior Generative AI Data Scientist presso Amazon Web Services e aiuta le aziende a innovare con l'intelligenza artificiale generativa. È specializzato in intelligenza artificiale generativa, intelligenza artificiale, machine learning e progettazione di sistemi. La sua passione è lo sviluppo di soluzioni all'avanguardia basate su AI/ML per risolvere problemi aziendali complessi per diversi settori, ottimizzando efficienza e scalabilità.

Mani Khanuja è Tech Lead – Generative AI Specialists, autrice del libro Applied Machine Learning and High Performance Computing su AWS e membro del Consiglio di amministrazione della Women in Manufacturing Education Foundation. Conduce progetti di machine learning in vari settori come la visione artificiale, l'elaborazione del linguaggio naturale e l'intelligenza artificiale generativa. Parla a conferenze interne ed esterne come AWS re:Invent, Women in Manufacturing West, webinar su YouTube e GHC 23. Nel tempo libero le piace fare lunghe corse lungo la spiaggia.

Mani Khanuja è Tech Lead – Generative AI Specialists, autrice del libro Applied Machine Learning and High Performance Computing su AWS e membro del Consiglio di amministrazione della Women in Manufacturing Education Foundation. Conduce progetti di machine learning in vari settori come la visione artificiale, l'elaborazione del linguaggio naturale e l'intelligenza artificiale generativa. Parla a conferenze interne ed esterne come AWS re:Invent, Women in Manufacturing West, webinar su YouTube e GHC 23. Nel tempo libero le piace fare lunghe corse lungo la spiaggia.

Rupinder Grewal è un Senior AI/ML Specialist Solutions Architect presso AWS. Attualmente si concentra sulla fornitura di modelli e MLOps su Amazon SageMaker. Prima di questo ruolo, ha lavorato come ingegnere di machine learning, costruendo e ospitando modelli. Fuori dal lavoro gli piace giocare a tennis e andare in bicicletta sui sentieri di montagna.

Rupinder Grewal è un Senior AI/ML Specialist Solutions Architect presso AWS. Attualmente si concentra sulla fornitura di modelli e MLOps su Amazon SageMaker. Prima di questo ruolo, ha lavorato come ingegnere di machine learning, costruendo e ospitando modelli. Fuori dal lavoro gli piace giocare a tennis e andare in bicicletta sui sentieri di montagna.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- Platone Salute. Intelligence sulle biotecnologie e sulle sperimentazioni cliniche. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/build-a-contextual-text-and-image-search-engine-for-product-recommendations-using-amazon-bedrock-and-amazon-opensearch-serverless/

- :ha

- :È

- :non

- :Dove

- $ SU

- 1

- 100

- 125

- 212

- 23

- 258

- 411

- 600

- 7

- 89

- a

- capacità

- Chi siamo

- astrazione

- accesso

- accessibile

- Il mio account

- preciso

- operanti in

- aggiuntivo

- Vantaggio

- AI

- Dati AI

- AI / ML

- Tutti

- lungo

- anche

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- an

- ed

- angolo

- in qualsiasi

- Applicazioni

- applicazioni

- applicato

- approcci

- circa

- architettura

- SONO

- artificiale

- intelligenza artificiale

- AS

- associato

- At

- attenzione

- Audio

- aumentata

- autore

- disponibile

- evitare

- AWS

- AWS re: Invent

- basato

- BE

- Beach

- Berkeley

- fra

- tavola

- Consiglio di Amministrazione

- libro

- costruire

- Costruzione

- affari

- aziende

- ma

- by

- Materiale

- didascalie

- Catturare

- oneri

- scegliere

- Scegli

- la scelta

- classificazione

- più vicino

- CNN

- codice

- collezione

- combinazione

- combinato

- Uncommon

- azienda

- rispetto

- completamento di una

- Completato

- complesso

- componenti

- computer

- Visione computerizzata

- informatica

- concettualmente

- conferenze

- Configurazione

- Confermare

- consiste

- consolle

- Consumatori

- contenuto

- contestuale

- convertire

- convertito

- correlazioni

- Corrispondente

- creare

- creato

- Attualmente

- Clienti

- personalizzare

- dati

- l'accesso ai dati

- scienza dei dati

- scienziato di dati

- Banca Dati

- dataset

- Predefinito

- definito

- dimostrato

- denota

- distribuzione

- descrizione

- Design

- progettato

- dettaglio

- dettagli

- sviluppare

- in via di sviluppo

- Mercato

- diagramma

- diverso

- dimensioni

- Amministrazione

- scoperta

- discusso

- Dsiplay

- paesaggio differenziato

- do

- dominio

- domini

- durante

- ogni

- est

- ecommerce

- Istruzione

- efficienza

- efficiente

- incastrare

- incorporamento

- enable

- abilitato

- Abilita

- crittografia

- motore

- ingegnere

- Motori

- Inglese

- accrescere

- Migliora

- migliorando

- Ambiente

- di preciso

- esempio

- esperienza

- Esperienze

- in modo esponenziale

- esterno

- Familiarità

- Caratteristiche

- Compila il

- Trovare

- Nome

- si concentra

- i seguenti

- Nel

- Fondazione

- TELAIO

- Gratis

- da

- function

- funzionalità

- funzioni

- ulteriormente

- fusione

- futuro

- generare

- generato

- genera

- ELETTRICA

- generativo

- AI generativa

- generatore

- ottenere

- si

- Go

- scopo

- buono

- Avere

- he

- Aiuto

- aiutare

- aiuta

- suo

- Alta

- alto livello

- superiore

- di hosting

- Come

- Tutorial

- HTML

- http

- HTTPS

- Enorme

- centinaia

- centinaia di milioni

- ID

- if

- illustra

- Immagine

- Ricerca immagini

- immagini

- subito

- realizzare

- implementazione

- importante

- competenze

- in

- includere

- inclusi

- Index

- indici

- individuale

- industrie

- informazioni

- innovare

- ingresso

- esempio

- integrato

- Intelligence

- interazione

- interazioni

- interno

- ai miglioramenti

- IT

- elementi

- SUO

- giunto

- jpeg

- Le

- Lingua

- grandi

- larga scala

- galline ovaiole

- portare

- Leads

- IMPARARE

- apprendimento

- impara

- biblioteche

- piace

- piace

- annuncio

- Annunci

- LLM

- Lunghi

- Guarda

- cerca

- macchina

- machine learning

- fatto

- FA

- consigliato per la

- fiammiferi

- Maggio..

- significativo

- misurare

- analisi

- meccanismi di

- membro

- Menu

- Metadati

- metrico

- milioni

- ML

- MLOp

- modello

- modellismo

- modelli

- Scopri di più

- La Montagna

- devono obbligatoriamente:

- Nome

- nomi

- Naturale

- Elaborazione del linguaggio naturale

- Navigazione

- vicinato

- Rete

- Sicurezza di rete

- neurale

- rete neurale

- New

- taccuino

- adesso

- numero

- oggetti

- of

- on

- On-Demand

- esclusivamente

- aprire

- Operazioni

- OTTIMIZZA

- ottimizzazione

- or

- Oregon

- nostro

- produzione

- al di fuori

- complessivo

- panoramica

- Packages

- coppie

- panda

- vetro

- particolare

- Ricambi

- appassionato

- Eseguire

- performance

- esegue

- personalizzazione

- fase

- fotografia

- Platone

- Platone Data Intelligence

- PlatoneDati

- gioco

- Termini e Condizioni

- politica

- messa in comune

- Post

- energia

- alimentato

- potente

- Preparare

- preparazione

- necessario

- presentata

- Precedente

- problemi

- processi

- lavorazione

- Prodotto

- Prodotti

- Profilo

- progetto

- progetti

- prototipo

- fornire

- purché

- fornisce

- la percezione

- pubblicamente

- Python

- query

- domanda

- straccio

- casuale

- RE

- pronto

- tempo reale

- raccomandare

- Consigli

- raccomandazioni

- riferimento

- regioni

- pertinente

- rappresentare

- rappresentazione

- necessario

- Risorse

- quelli

- colpevole

- Risultati

- nello specifico retail

- richiamo

- di ritorno

- problemi

- Aumento

- Ruolo

- Correre

- running

- corre

- sagemaker

- sake

- stesso

- sega

- Scalabilità

- Scienze

- Scienziato

- screenshot

- Cerca

- motore di ricerca

- Motori di ricerca

- ricerca

- Sezione

- sezioni

- problemi di

- Selezione

- semantico

- semantica

- inviare

- anziano

- separato

- serverless

- serve

- servizio

- Servizi

- servizio

- set

- condiviso

- lei

- dovrebbero

- mostrare attraverso le sue creazioni

- mostrato

- Spettacoli

- simile

- Un'espansione

- inferiore

- So

- soluzione

- Soluzioni

- RISOLVERE

- alcuni

- lo spazio

- Parla

- specialista

- specialisti

- specializzata

- specifico

- velocità

- iniziato

- state-of-the-art

- Stato dei servizi

- Passi

- azione

- conservazione

- Tornare al suo account

- memorizzati

- memorizzare

- lineare

- studio

- tale

- supporti

- sistema

- SISTEMI DI TRATTAMENTO

- task

- Tech

- tennis

- testo

- testuale

- che

- I

- il giunto

- loro

- Li

- poi

- in tal modo

- Strumenti Bowman per analizzare le seguenti finiture:

- questo

- tre

- Attraverso

- tempo

- titano

- a

- oggi

- insieme

- top

- Training

- Traduzione

- seconda

- per

- sottostante

- capire

- e una comprensione reciproca

- unico

- us

- uso

- utilizzato

- Utente

- Esperienza da Utente

- utenti

- usa

- utilizzando

- vario

- via

- Virginia

- visione

- Visita

- walkthrough

- we

- sito web

- servizi web

- Webinars

- ovest

- Che

- quando

- quale

- while

- wikipedia

- volere

- con

- Donna

- Lavora

- lavorato

- flusso di lavoro

- lavori

- Tu

- Trasferimento da aeroporto a Sharm

- youtube

- zefiro