Amazon SageMaker Ground Truth Plus ti aiuta a preparare set di dati di addestramento di alta qualità rimuovendo il lavoro pesante indifferenziato associato alla creazione di applicazioni di etichettatura dei dati e gestendo la forza lavoro di etichettatura. Tutto ciò che fai è condividere i dati insieme ai requisiti di etichettatura e Ground Truth Plus imposta e gestisce il tuo flusso di lavoro di etichettatura dei dati in base a questi requisiti. Da lì, una forza lavoro esperta che viene addestrata su una varietà di attività di machine learning (ML) etichetta i tuoi dati. Non hai nemmeno bisogno di una profonda esperienza di ML o conoscenza della progettazione del flusso di lavoro e della gestione della qualità per utilizzare Ground Truth Plus. Ora, Ground Truth Plus serve i clienti che necessitano di etichettatura dei dati e feedback umano per perfezionare i modelli di base per le applicazioni di intelligenza artificiale generativa.

In questo post, imparerai i recenti progressi nel feedback umano per l'IA generativa disponibile tramite SageMaker Ground Truth Plus. Ciò include nuovi flussi di lavoro e interfacce utente (UI) disponibili per la preparazione di set di dati dimostrativi utilizzati nella messa a punto supervisionata, la raccolta di feedback umani di alta qualità per creare set di dati di preferenza per allineare i modelli di base dell'IA generativa con le preferenze umane, nonché la personalizzazione dei modelli per i costruttori di applicazioni ' requisiti di stile, sostanza e voce.

Sfide per iniziare con l'IA generativa

Le applicazioni di intelligenza artificiale generativa in tutto il mondo incorporano modelli di base sia monomodali che multimodali per risolvere molti casi d'uso diversi. Comuni tra loro sono chatbot, generatori di immagini e generatori di video. I modelli di linguaggio di grandi dimensioni (LLM) vengono utilizzati nei chatbot per attività creative, assistenti accademici e personali, strumenti di business intelligence e strumenti di produttività. È possibile utilizzare modelli di testo in immagine per generare arte e risorse di marketing AI astratte o realistiche. I modelli text-to-video vengono utilizzati per generare video per progetti artistici, pubblicità altamente coinvolgenti, sviluppo di videogiochi e persino sviluppo di film.

Due dei problemi più importanti da risolvere sia per i produttori di modelli che creano modelli di base sia per i costruttori di applicazioni che utilizzano modelli di base generativi esistenti per creare i propri strumenti e applicazioni sono:

- Ottimizzazione di questi modelli di base per essere in grado di eseguire attività specifiche

- Allineandoli alle preferenze umane per garantire che forniscano informazioni utili, accurate e innocue

I modelli di base sono in genere preaddestrati su grandi corpora di dati non etichettati e pertanto non funzionano bene seguendo le istruzioni del linguaggio naturale. Per un LLM, ciò significa che potrebbero essere in grado di analizzare e generare il linguaggio in generale, ma potrebbero non essere in grado di rispondere alle domande in modo coerente o riassumere il testo fino alla qualità richiesta dall'utente. Ad esempio, quando un utente richiede un riepilogo di un testo in un prompt, un modello che non è stato messo a punto su come riassumere il testo potrebbe semplicemente recitare il testo del prompt all'utente o rispondere con qualcosa di irrilevante. Se un utente pone una domanda su un argomento, la risposta di un modello potrebbe essere solo una recitazione della domanda. Per i modelli multimodali, come i modelli da testo a immagine o da testo a video, i modelli possono restituire contenuto non correlato al prompt. Ad esempio, se un grafico aziendale richiede a un modello di testo in immagine di creare un nuovo logo o un'immagine per un annuncio pubblicitario, il modello potrebbe non generare un elemento grafico pertinente correlato al prompt se ha solo un concetto generale di immagine ed elementi di un'immagine. In alcuni casi, un modello può produrre un'immagine o un video dannoso, mettendo a rischio la fiducia dell'utente o la reputazione dell'azienda.

Anche se i modelli sono messi a punto per eseguire compiti specifici, potrebbero non essere allineati con le preferenze umane rispetto al significato, allo stile o alla sostanza del loro contenuto di output. In un LLM, ciò potrebbe manifestarsi come contenuto impreciso o addirittura dannoso generato dal modello. Ad esempio, un modello che non è allineato con le preferenze umane attraverso la messa a punto può generare istruzioni pericolose, non etiche o addirittura illegali quando richiesto da un utente. Non sarà stata prestata alcuna attenzione per limitare il contenuto generato dal modello per garantire che sia allineato con le preferenze umane per essere accurato, pertinente e utile. Questo disallineamento può essere un problema per le aziende che si affidano a modelli di intelligenza artificiale generativa per le loro applicazioni, come i chatbot e la creazione multimediale. Per i modelli multimodali, ciò può assumere la forma di immagini o video tossici, pericolosi o offensivi generati. Questo è un rischio quando i prompt vengono immessi nel modello senza l'intenzione di generare contenuto sensibile e anche se il produttore del modello o il costruttore dell'applicazione non intendeva consentire al modello di generare quel tipo di contenuto, ma è stato comunque generato.

Per risolvere i problemi di capacità specifiche per attività e allineare i modelli di base generativa con le preferenze umane, i produttori di modelli e i costruttori di applicazioni devono mettere a punto i modelli con i dati utilizzando dimostrazioni guidate dall'uomo e feedback umano degli output del modello.

Tipi di dati e formazione

Esistono diversi tipi di metodi di messa a punto con diversi tipi di dati etichettati che sono classificati come messa a punto delle istruzioni o come insegnare a un modello come seguire le istruzioni. Tra questi vi sono la messa a punto supervisionata (SFT) che utilizza dati dimostrativi e l'apprendimento per rinforzo dal feedback umano (RLHF) che utilizza dati sulle preferenze.

Dati dimostrativi per il fine tuning supervisionato

Per mettere a punto i modelli di base per eseguire attività specifiche come rispondere a domande o riassumere testo con alta qualità, i modelli vengono sottoposti a SFT con dati dimostrativi. Lo scopo dei dati dimostrativi è guidare il modello fornendogli esempi etichettati (dimostrazioni) di attività completate eseguite da esseri umani. Ad esempio, per insegnare a un LLM come rispondere alle domande, un annotatore umano creerà un set di dati etichettato di coppie di domande e risposte generate dall'uomo per dimostrare come funziona linguisticamente un'interazione di domanda e risposta e cosa significa semanticamente il contenuto. Questo tipo di SFT addestra il modello a riconoscere i modelli di comportamento dimostrati dagli esseri umani nei dati di addestramento dimostrativo. I produttori di modelli devono eseguire questo tipo di messa a punto per dimostrare che i loro modelli sono in grado di eseguire tali attività per gli utilizzatori a valle. I creatori di applicazioni che utilizzano modelli di base esistenti per le loro applicazioni di intelligenza artificiale generativa potrebbero dover perfezionare i loro modelli con dati dimostrativi su queste attività con dati specifici del settore o dell'azienda per migliorare la pertinenza e l'accuratezza delle loro applicazioni.

Dati di preferenza per l'ottimizzazione delle istruzioni come RLHF

Per allineare ulteriormente i modelli di base con le preferenze umane, i produttori di modelli, e in particolare i costruttori di applicazioni, devono generare set di dati sulle preferenze per eseguire l'ottimizzazione delle istruzioni. I dati sulle preferenze nel contesto dell'ottimizzazione delle istruzioni sono dati etichettati che catturano il feedback umano rispetto a un insieme di opzioni emesse da un modello di base generativo. In genere include la valutazione o la classificazione di diverse inferenze o il confronto a coppie di due inferenze da un modello di base in base a un attributo specifico. Per gli LLM, questi attributi possono essere disponibilità, accuratezza e innocuità. Per i modelli testo-immagine, può trattarsi di una qualità estetica o di un allineamento testo-immagine. Questi dati sulle preferenze basati sul feedback umano possono quindi essere utilizzati in vari metodi di ottimizzazione delle istruzioni, incluso RLHF, al fine di perfezionare ulteriormente un modello per allinearlo alle preferenze umane.

L'ottimizzazione delle istruzioni utilizzando i dati delle preferenze gioca un ruolo cruciale nel migliorare la personalizzazione e l'efficacia dei modelli di base. Questo è un passaggio chiave nella creazione di applicazioni personalizzate su modelli di base preaddestrati ed è un metodo potente per garantire che i modelli generino contenuto utile, accurato e innocuo. Un esempio comune di messa a punto delle istruzioni consiste nell'istruire un chatbot a generare tre risposte a una query e fare in modo che un essere umano legga e classifichi tutte e tre in base a una dimensione specificata, come tossicità, accuratezza fattuale o leggibilità. Ad esempio, un'azienda può utilizzare un chatbot per il proprio reparto marketing e desidera assicurarsi che il contenuto sia allineato al messaggio del brand, non mostri pregiudizi e sia chiaramente leggibile. L'azienda richiederebbe al chatbot durante la messa a punto delle istruzioni di produrre tre esempi e chiedere ai propri esperti interni di selezionare quelli più allineati al loro obiettivo. Nel tempo, costruiscono un set di dati utilizzato per insegnare al modello quale stile di contenuto preferisce l'uomo attraverso l'apprendimento per rinforzo. Ciò consente all'applicazione chatbot di produrre contenuti più pertinenti, leggibili e sicuri.

SageMaker Ground Truth Plus

Ground Truth Plus ti aiuta ad affrontare entrambe le sfide, generando set di dati dimostrativi con capacità specifiche per attività e raccogliendo set di dati sulle preferenze dal feedback umano per allineare i modelli alle preferenze umane. Puoi richiedere progetti per LLM e modelli multimodali come text-to-image e text-to-video. Per gli LLM, i set di dati dimostrativi chiave includono la generazione di domande e risposte (Q&A), il riepilogo del testo, la generazione del testo e la rielaborazione del testo ai fini della moderazione del contenuto, del cambio di stile o della lunghezza. I principali set di dati sulle preferenze LLM includono la classificazione e la classificazione degli output di testo. Per i modelli multimodali, i tipi di attività chiave includono i sottotitoli di immagini o video, nonché la registrazione di timestamp di eventi nei video. Pertanto, Ground Truth Plus può aiutare sia i produttori di modelli che i costruttori di applicazioni nel loro viaggio verso l'IA generativa.

In questo post, approfondiamo il viaggio dell'annotatore umano e del feedback su quattro casi che coprono sia i dati dimostrativi che i dati sulle preferenze sia per i LLM che per i modelli multimodali: generazione di coppie di domande e risposte e classificazione del testo per i LLM, nonché didascalia delle immagini e sottotitoli video per modelli multimodali.

Grandi modelli linguistici

In questa sezione, discutiamo le coppie di domande e risposte e la classificazione del testo per gli LLM, insieme alle personalizzazioni che potresti desiderare per il tuo caso d'uso.

Coppie di domande e risposte

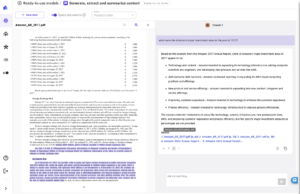

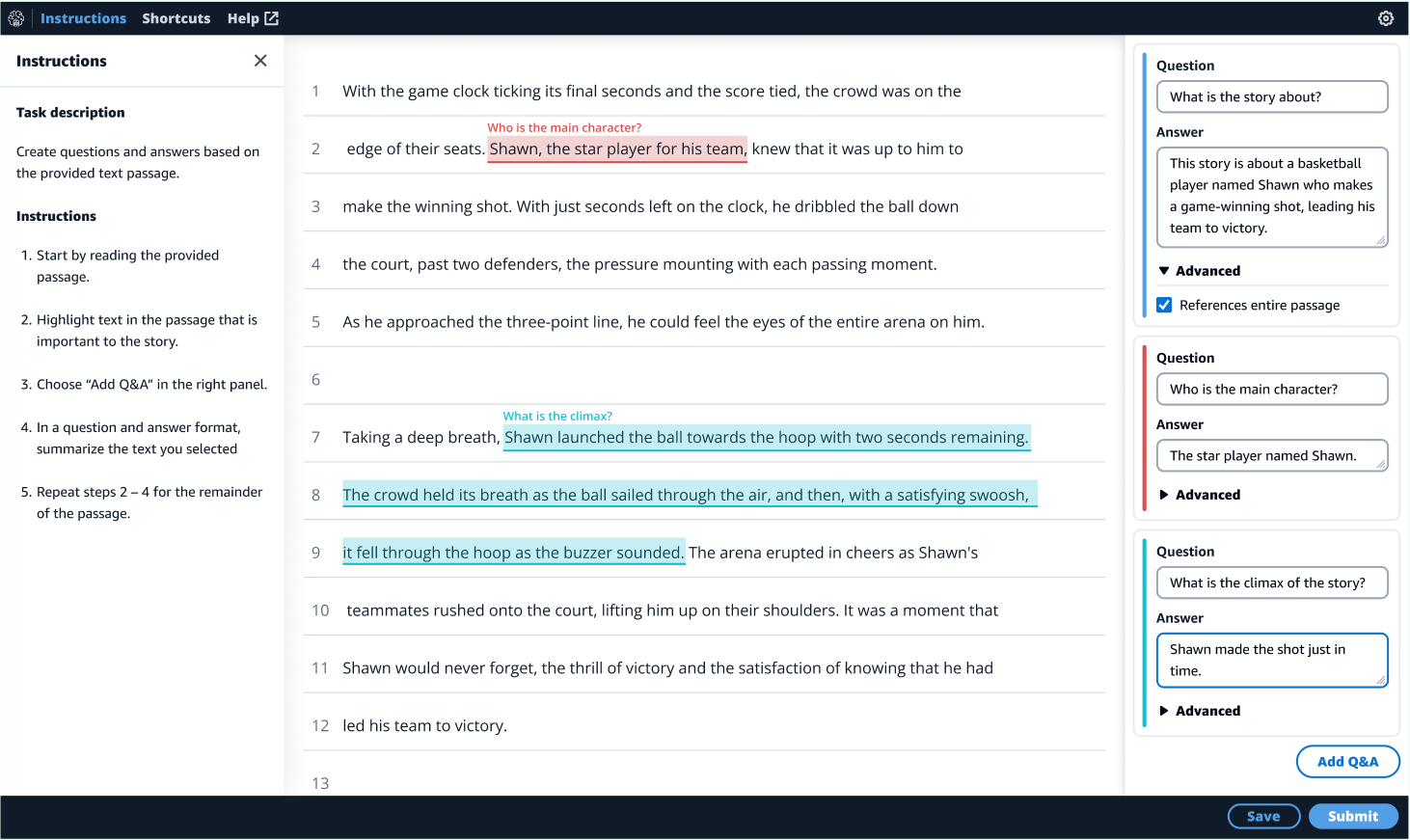

Lo screenshot seguente mostra un'interfaccia utente di etichettatura in cui un annotatore umano leggerà un passaggio di testo e genererà sia domande che risposte nel processo di creazione di un set di dati dimostrativo di domande e risposte.

Esaminiamo un tour dell'interfaccia utente nei panni dell'annotatore. Sul lato sinistro dell'interfaccia utente, le istruzioni specifiche del richiedente lavoro vengono presentate all'annotatore. In questo caso, l'annotatore dovrebbe leggere il passaggio di testo presentato al centro dell'interfaccia utente e creare domande e risposte basate sul testo. Sul lato destro sono mostrate le domande e le risposte che l'annotatore ha scritto. Il passaggio del testo così come il tipo, la lunghezza e il numero di domande e risposte possono essere personalizzati dal richiedente del lavoro durante l'impostazione del progetto con il team di Ground Truth Plus. In questo caso, l'annotatore ha creato una domanda che richiede la comprensione dell'intero passaggio di testo per rispondere ed è contrassegnata da a Fa riferimento all'intero passaggio casella di controllo. Le altre due domande e risposte si basano su parti specifiche del passaggio di testo, come mostrato dalle evidenziazioni dell'annotatore con corrispondenza codificata a colori. Facoltativamente, potresti voler richiedere che le domande e le risposte vengano generate senza un passaggio di testo fornito e fornire altre linee guida per gli annotatori umani, anche questo è supportato da Ground Truth Plus.

Dopo che le domande e le risposte sono state inviate, possono passare a un flusso di lavoro del ciclo di controllo della qualità facoltativo in cui altri revisori umani confermeranno che la distribuzione definita dal cliente e i tipi di domande e risposte sono stati creati. Se c'è una discrepanza tra i requisiti del cliente e ciò che l'annotatore umano ha prodotto, il lavoro verrà reindirizzato a un essere umano per la rielaborazione prima di essere esportato come parte del set di dati da consegnare al cliente. Quando il set di dati ti viene restituito, è pronto per essere incorporato nel flusso di lavoro di fine tuning supervisionato a tua discrezione.

Classificazione del testo

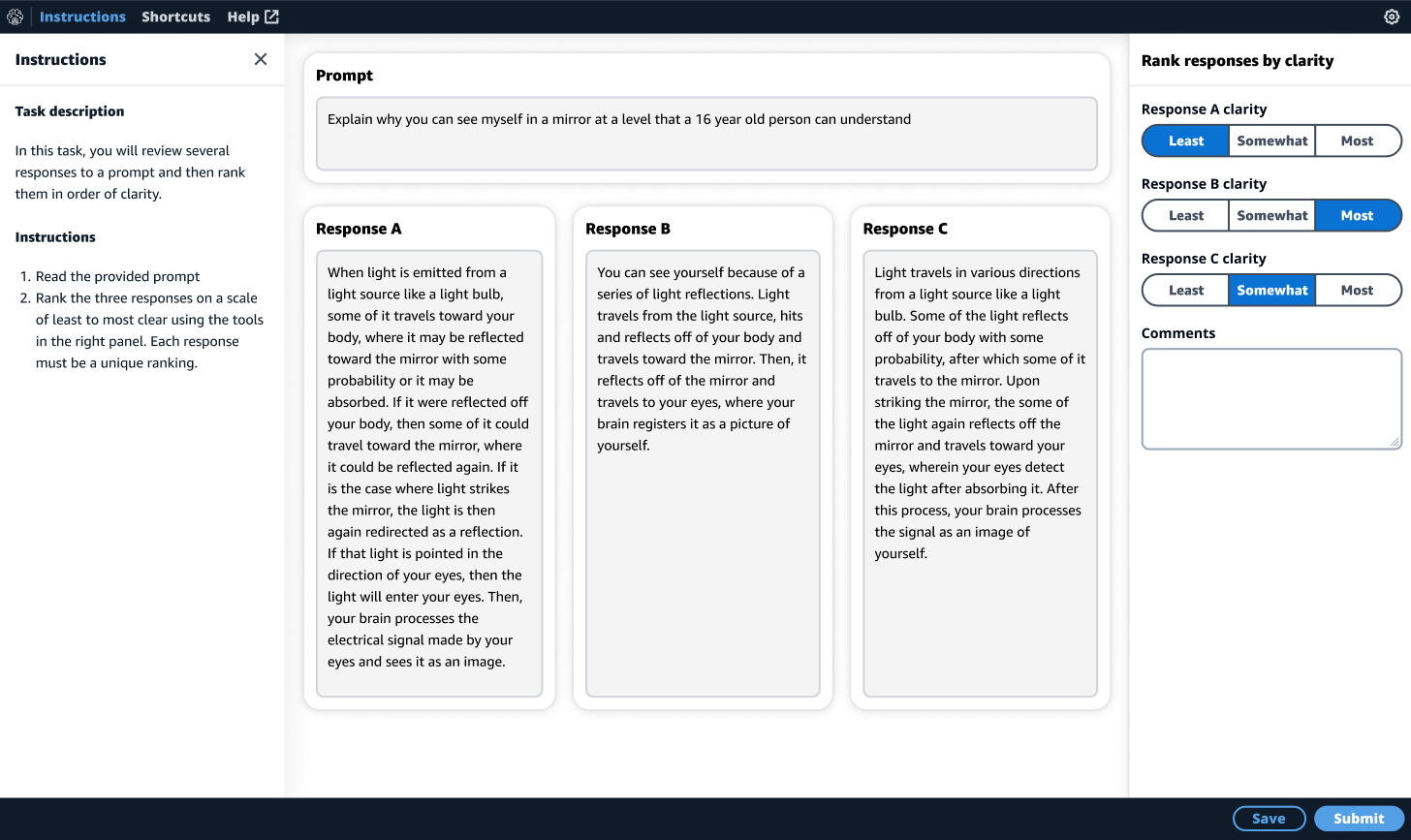

Lo screenshot seguente mostra un'interfaccia utente per classificare gli output di un LLM in base a un prompt.

Puoi semplicemente scrivere le istruzioni per il revisore umano e portare suggerimenti e risposte pre-generate al team del progetto Ground Truth Plus per iniziare il lavoro. In questo caso, abbiamo richiesto a un revisore umano di classificare tre risposte per richiesta da un LLM sulla dimensione della chiarezza della scrittura (leggibilità). Anche in questo caso, il riquadro di sinistra mostra le istruzioni fornite al revisore dal richiedente lavoro. Al centro, il prompt è nella parte superiore della pagina e le tre risposte pre-generate sono il corpo principale per facilità d'uso. Sul lato destro dell'interfaccia utente, il revisore umano li classificherà in ordine di scrittura dalla più chiara alla meno chiara.

I clienti che desiderano generare questo tipo di set di dati sulle preferenze includono costruttori di applicazioni interessati a creare chatbot di tipo umano e quindi desiderano personalizzare le istruzioni per il proprio utilizzo. La lunghezza del prompt, il numero di risposte e la dimensione della classifica possono essere personalizzati. Ad esempio, potresti voler classificare cinque risposte in ordine dal più accurato al meno fattuale, distorto o tossico, o persino classificare e classificare più dimensioni contemporaneamente. Queste personalizzazioni sono supportate in Ground Truth Plus.

Modelli multimodali

In questa sezione, vengono discussi i sottotitoli di immagini e video per l'addestramento di modelli multimodali come i modelli da testo a immagine e da testo a video, nonché le personalizzazioni che potresti voler apportare per il tuo particolare caso d'uso.

Didascalie delle immagini

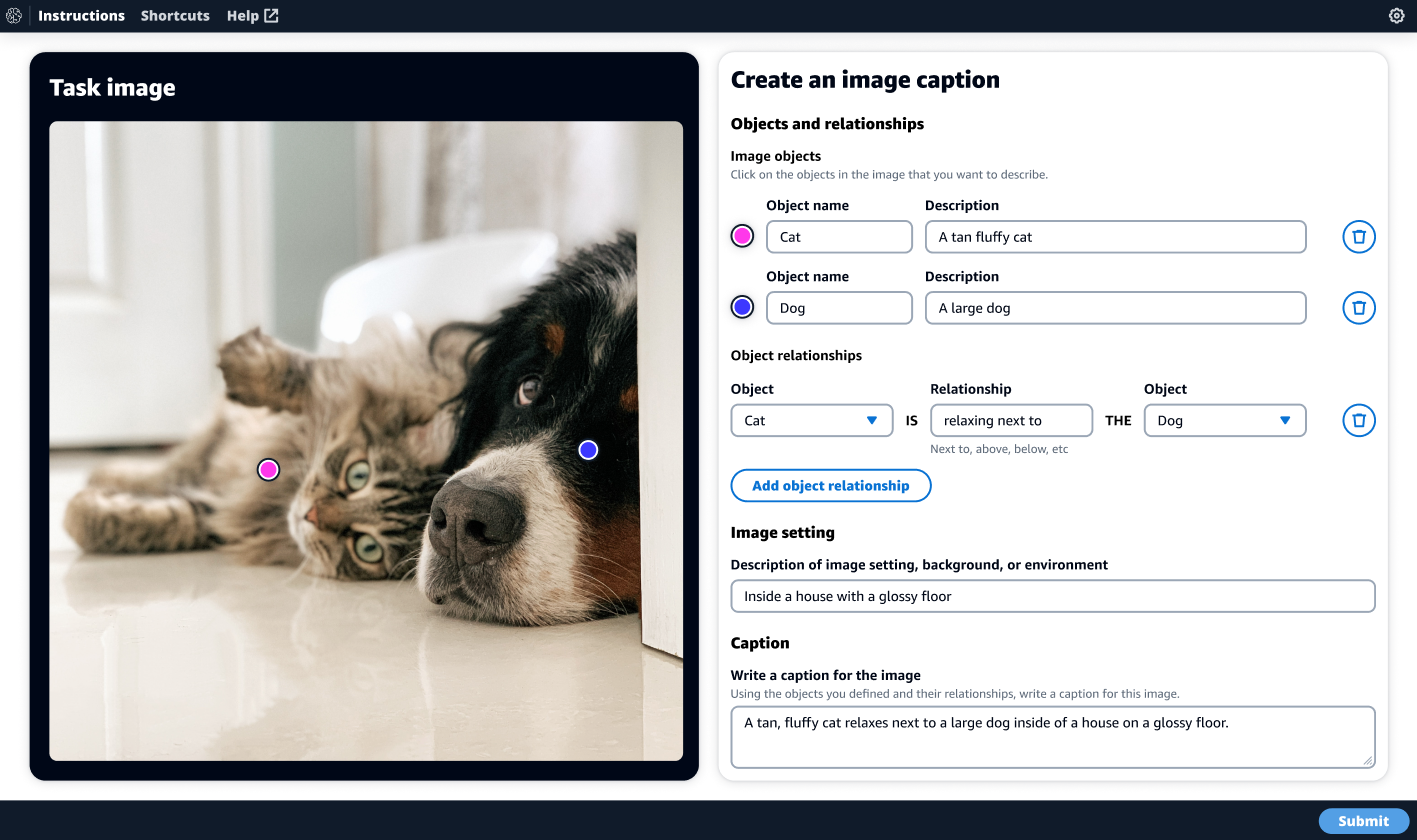

Lo screenshot seguente mostra un'interfaccia utente di etichettatura per i sottotitoli delle immagini. Puoi richiedere un progetto con sottotitoli di immagini per raccogliere dati per addestrare un modello da testo a immagine o un modello da immagine a testo.

In questo caso, abbiamo richiesto di addestrare un modello text-to-image e abbiamo stabilito requisiti specifici sulla didascalia in termini di lunghezza e dettaglio. L'interfaccia utente è progettata per guidare gli annotatori umani attraverso il processo cognitivo di generazione di ricche didascalie fornendo una struttura mentale attraverso strumenti di assistenza e descrittivi. Abbiamo scoperto che fornire questa struttura mentale per gli annotatori si traduce in didascalie più descrittive e accurate rispetto alla semplice fornitura di una casella di testo modificabile da sola.

Il primo passo nel framework è che l'annotatore umano identifichi gli oggetti chiave nell'immagine. Quando l'annotatore sceglie un oggetto nell'immagine, sull'oggetto viene visualizzato un punto con codice colore. In questo caso, l'annotatore ha scelto sia il cane che il gatto, creando due campi modificabili sul lato destro dell'interfaccia utente in cui l'annotatore inserirà i nomi degli oggetti, gatto e cane, insieme a una descrizione dettagliata di ciascun oggetto. Successivamente, l'annotatore viene guidato per identificare tutte le relazioni tra tutti gli oggetti nell'immagine. In questo caso, il gatto si rilassa accanto al cane. Successivamente, all'annotatore viene chiesto di identificare attributi specifici sull'immagine, come l'impostazione, lo sfondo o l'ambiente. Infine, nella casella di testo di input della didascalia, all'annotatore viene chiesto di combinare tutto ciò che ha scritto nei campi oggetti, relazioni e impostazione dell'immagine in un'unica didascalia descrittiva completa dell'immagine.

Facoltativamente, puoi configurare questa didascalia dell'immagine in modo che venga sottoposta a un ciclo di controllo della qualità basato sull'uomo con istruzioni specifiche per garantire che la didascalia soddisfi i requisiti. Se viene identificato un problema, ad esempio un oggetto chiave mancante, tale didascalia può essere inviata a un essere umano per correggere il problema prima dell'esportazione come parte del set di dati di addestramento.

Sottotitoli video

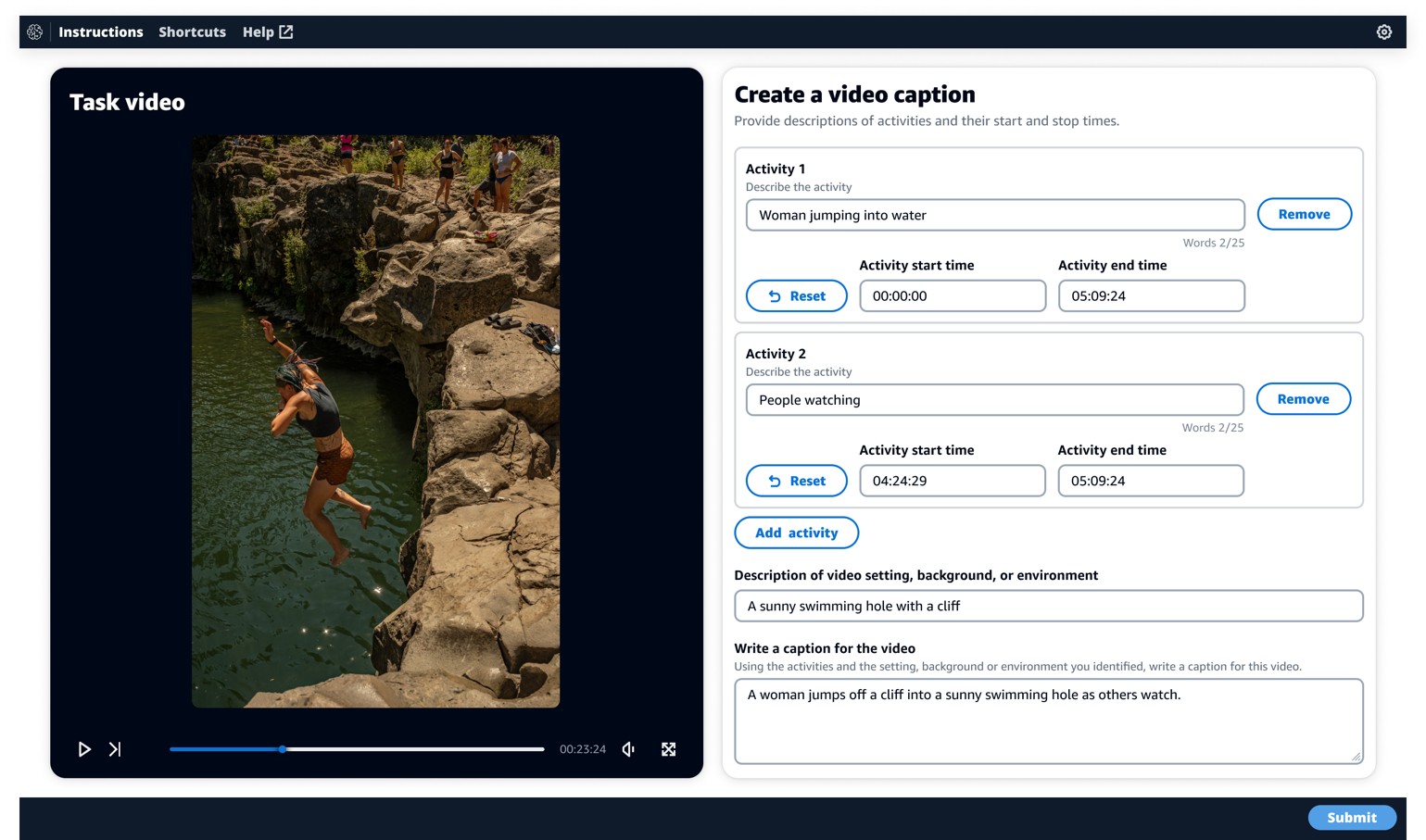

Lo screenshot seguente mostra un'interfaccia utente di sottotitoli video per generare sottotitoli video avanzati con tag timestamp. Puoi richiedere un progetto di sottotitoli video per raccogliere dati per creare modelli da testo a video o da video a testo.

In questa interfaccia utente di etichettatura, abbiamo creato una struttura mentale simile per garantire che vengano scritte didascalie di alta qualità. L'annotatore umano può controllare il video sul lato sinistro e creare descrizioni e timestamp per ogni attività mostrata nel video sul lato destro con gli elementi dell'interfaccia utente. Analogamente all'interfaccia utente dei sottotitoli delle immagini, c'è anche un posto in cui l'annotatore può scrivere una descrizione dettagliata dell'impostazione, dello sfondo e dell'ambiente del video. Infine, all'annotatore viene chiesto di combinare tutti gli elementi in una didascalia video coerente.

Analogamente al caso della didascalia delle immagini, le didascalie dei video possono facoltativamente passare attraverso un flusso di lavoro di controllo della qualità basato sull'uomo per determinare se i requisiti sono soddisfatti. Se si verifica un problema con i sottotitoli del video, verrà inviato per essere rielaborato dalla forza lavoro dell'annotatore umano.

Conclusione

Ground Truth Plus può aiutarti a preparare set di dati di alta qualità per mettere a punto modelli di base per attività di intelligenza artificiale generativa, dalla risposta alle domande alla generazione di immagini e video. Consente inoltre a forza lavoro umana qualificata di rivedere i risultati del modello per garantire che siano allineati con le preferenze umane. Inoltre, consente ai creatori di applicazioni di personalizzare i modelli utilizzando i dati del settore o dell'azienda per garantire che l'applicazione rappresenti la voce e lo stile preferiti. Queste sono le prime di molte innovazioni in Ground Truth Plus e altre sono in fase di sviluppo. Resta sintonizzato per i post futuri.

Sei interessato ad avviare un progetto per costruire o migliorare i tuoi modelli e applicazioni di intelligenza artificiale generativa? Inizia con Ground Truth Plus di entrare in contatto con il nostro team oggi.

Circa gli autori

Jesse Mander è un Senior Product Manager nel team AWS AI/ML human in the loop services. Lavora all'intersezione tra intelligenza artificiale e interazione umana con l'obiettivo di creare e migliorare prodotti e servizi AI/ML per soddisfare le nostre esigenze. In precedenza, Jesse ha ricoperto ruoli di leadership nell'ingegneria presso Apple e Lumileds ed è stato scienziato senior in una startup della Silicon Valley. Ha una laurea magistrale e un dottorato di ricerca. presso l'Università della Florida e un MBA presso l'Università della California, Berkeley, Haas School of Business.

Jesse Mander è un Senior Product Manager nel team AWS AI/ML human in the loop services. Lavora all'intersezione tra intelligenza artificiale e interazione umana con l'obiettivo di creare e migliorare prodotti e servizi AI/ML per soddisfare le nostre esigenze. In precedenza, Jesse ha ricoperto ruoli di leadership nell'ingegneria presso Apple e Lumileds ed è stato scienziato senior in una startup della Silicon Valley. Ha una laurea magistrale e un dottorato di ricerca. presso l'Università della Florida e un MBA presso l'Università della California, Berkeley, Haas School of Business.

Romì Datta è Senior Manager of Product Management nel team Amazon SageMaker responsabile dei servizi Human in the Loop. È in AWS da oltre 4 anni, ricoprendo diversi ruoli di leadership nella gestione dei prodotti in SageMaker, S3 e IoT. Prima di AWS ha lavorato in vari ruoli di gestione dei prodotti, ingegneria e leadership operativa presso IBM, Texas Instruments e Nvidia. Ha una laurea magistrale e un dottorato di ricerca. in Ingegneria Elettrica e Informatica presso l'Università del Texas ad Austin e un MBA presso la Booth School of Business dell'Università di Chicago.

Romì Datta è Senior Manager of Product Management nel team Amazon SageMaker responsabile dei servizi Human in the Loop. È in AWS da oltre 4 anni, ricoprendo diversi ruoli di leadership nella gestione dei prodotti in SageMaker, S3 e IoT. Prima di AWS ha lavorato in vari ruoli di gestione dei prodotti, ingegneria e leadership operativa presso IBM, Texas Instruments e Nvidia. Ha una laurea magistrale e un dottorato di ricerca. in Ingegneria Elettrica e Informatica presso l'Università del Texas ad Austin e un MBA presso la Booth School of Business dell'Università di Chicago.

Jonathan Buck è un Software Engineer presso Amazon Web Services che lavora all'intersezione tra machine learning e sistemi distribuiti. Il suo lavoro prevede la produzione di modelli di apprendimento automatico e lo sviluppo di nuove applicazioni software basate sull'apprendimento automatico per mettere le ultime funzionalità nelle mani dei clienti.

Jonathan Buck è un Software Engineer presso Amazon Web Services che lavora all'intersezione tra machine learning e sistemi distribuiti. Il suo lavoro prevede la produzione di modelli di apprendimento automatico e lo sviluppo di nuove applicazioni software basate sull'apprendimento automatico per mettere le ultime funzionalità nelle mani dei clienti.

Alex Williams è uno scienziato applicato nel team scientifico Human-in-the-loop presso AWS AI, dove conduce ricerche sui sistemi interattivi all'intersezione tra l'interazione uomo-computer (HCI) e l'apprendimento automatico. Prima di entrare in Amazon, è stato professore presso il Dipartimento di ingegneria elettrica e informatica dell'Università del Tennessee, dove ha co-diretto il laboratorio di ricerca su persone, agenti, interazioni e sistemi (PAIRS). Ha anche ricoperto incarichi di ricerca presso Microsoft Research, Mozilla Research e l'Università di Oxford. Pubblica regolarmente il suo lavoro nelle principali sedi di pubblicazione per HCI, come CHI, CSCW e UIST. Ha conseguito un dottorato di ricerca presso l'Università di Waterloo.

Alex Williams è uno scienziato applicato nel team scientifico Human-in-the-loop presso AWS AI, dove conduce ricerche sui sistemi interattivi all'intersezione tra l'interazione uomo-computer (HCI) e l'apprendimento automatico. Prima di entrare in Amazon, è stato professore presso il Dipartimento di ingegneria elettrica e informatica dell'Università del Tennessee, dove ha co-diretto il laboratorio di ricerca su persone, agenti, interazioni e sistemi (PAIRS). Ha anche ricoperto incarichi di ricerca presso Microsoft Research, Mozilla Research e l'Università di Oxford. Pubblica regolarmente il suo lavoro nelle principali sedi di pubblicazione per HCI, come CHI, CSCW e UIST. Ha conseguito un dottorato di ricerca presso l'Università di Waterloo.

Sarah Gao è un Software Development Manager in Amazon SageMaker Human In the Loop (HIL) responsabile della creazione della piattaforma di etichettatura basata su ML. Sarah è in AWS da oltre 4 anni, ricoprendo diversi ruoli di leadership nella gestione del software nella sicurezza EC2 e SageMaker. Prima di AWS ha lavorato in vari ruoli di gestione ingegneristica presso Oracle e Sun Microsystem.

Sarah Gao è un Software Development Manager in Amazon SageMaker Human In the Loop (HIL) responsabile della creazione della piattaforma di etichettatura basata su ML. Sarah è in AWS da oltre 4 anni, ricoprendo diversi ruoli di leadership nella gestione del software nella sicurezza EC2 e SageMaker. Prima di AWS ha lavorato in vari ruoli di gestione ingegneristica presso Oracle e Sun Microsystem.

Erran Li è il responsabile della scienza applicata presso Human-in-the-loop services, AWS AI, Amazon. I suoi interessi di ricerca sono il deep learning 3D e l'apprendimento della rappresentazione della visione e del linguaggio. In precedenza è stato scienziato senior presso Alexa AI, capo del machine learning presso Scale AI e capo scienziato presso Pony.ai. Prima di allora, era con il team di percezione di Uber ATG e il team della piattaforma di apprendimento automatico di Uber lavorando sull'apprendimento automatico per la guida autonoma, sui sistemi di apprendimento automatico e sulle iniziative strategiche dell'IA. Ha iniziato la sua carriera presso i Bell Labs ed è stato professore a contratto presso la Columbia University. Ha co-insegnato tutorial presso ICML'17 e ICCV'19 e ha co-organizzato diversi workshop presso NeurIPS, ICML, CVPR, ICCV sull'apprendimento automatico per la guida autonoma, la visione 3D e la robotica, i sistemi di apprendimento automatico e l'apprendimento automatico avverso. Ha un dottorato di ricerca in informatica presso la Cornell University. È ACM Fellow e IEEE Fellow.

Erran Li è il responsabile della scienza applicata presso Human-in-the-loop services, AWS AI, Amazon. I suoi interessi di ricerca sono il deep learning 3D e l'apprendimento della rappresentazione della visione e del linguaggio. In precedenza è stato scienziato senior presso Alexa AI, capo del machine learning presso Scale AI e capo scienziato presso Pony.ai. Prima di allora, era con il team di percezione di Uber ATG e il team della piattaforma di apprendimento automatico di Uber lavorando sull'apprendimento automatico per la guida autonoma, sui sistemi di apprendimento automatico e sulle iniziative strategiche dell'IA. Ha iniziato la sua carriera presso i Bell Labs ed è stato professore a contratto presso la Columbia University. Ha co-insegnato tutorial presso ICML'17 e ICCV'19 e ha co-organizzato diversi workshop presso NeurIPS, ICML, CVPR, ICCV sull'apprendimento automatico per la guida autonoma, la visione 3D e la robotica, i sistemi di apprendimento automatico e l'apprendimento automatico avverso. Ha un dottorato di ricerca in informatica presso la Cornell University. È ACM Fellow e IEEE Fellow.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoAiStream. Intelligenza dei dati Web3. Conoscenza amplificata. Accedi qui.

- Coniare il futuro con Adryenn Ashley. Accedi qui.

- Acquista e vendi azioni in società PRE-IPO con PREIPO®. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/high-quality-human-feedback-for-your-generative-ai-applications-from-amazon-sagemaker-ground-truth-plus/

- :ha

- :È

- :non

- :Dove

- $ SU

- 100

- 3d

- 7

- a

- capace

- WRI

- ABSTRACT

- accademico

- Secondo

- precisione

- preciso

- ACM

- attività

- Inoltre

- indirizzo

- adottanti

- avanzamenti

- contraddittorio

- pubblicità

- ancora

- agenti

- AI

- oh arte

- AI / ML

- Alexa

- allineare

- Allineati

- allineamento

- Tutti

- consentire

- consente

- da solo

- lungo

- anche

- Amazon

- Amazon Sage Maker

- Amazon SageMaker verità fondamentale

- Amazon Web Services

- tra

- an

- ed

- rispondere

- risposte

- appare

- Apple

- Applicazioni

- applicazioni

- applicato

- SONO

- in giro

- Arte

- AS

- Attività

- assistenti

- associato

- At

- gli attributi

- austin

- autonomo

- disponibile

- AWS

- precedente

- sfondo

- basato

- BE

- stato

- prima

- essendo

- Campana

- Berkeley

- fra

- parziale

- pregiudizi

- stile di vita

- entrambi

- Scatola

- marca

- portare

- costruire

- costruttore

- costruttori

- Costruzione

- costruito

- affari

- business intelligence

- ma

- by

- California

- Materiale

- funzionalità

- capace

- didascalie

- cattura

- che

- Career

- Custodie

- casi

- CAT

- centro

- il cambiamento

- chatbot

- chatbots

- dai un'occhiata

- Chicago

- capo

- scelto

- chiarezza

- classificare

- pulire campo

- chiaramente

- conoscitivo

- COERENTE

- COLUMBIA

- combinare

- Uncommon

- Aziende

- azienda

- confronto

- completamento di una

- Completato

- computer

- Ingegneria Informatica

- Informatica

- concetto

- comportamenti

- fiducia

- Confermare

- contenuto

- contesto

- di controllo

- cornell

- Aziende

- correggere

- potuto

- copertura

- creare

- creato

- Creazione

- creazione

- Creative

- cruciale

- costume

- cliente

- Clienti

- personalizzare

- personalizzate

- Pericoloso

- dati

- dataset

- deep

- apprendimento profondo

- più profondo

- consegnare

- consegnato

- dimostrare

- dimostrato

- Shirts Department

- descrizione

- Design

- progettato

- Designer

- dettaglio

- dettagliati

- Determinare

- in via di sviluppo

- Mercato

- diverso

- Dimensioni

- dimensioni

- discrezione

- discutere

- distribuito

- sistemi distribuiti

- distribuzione

- do

- non

- Cane

- fatto

- Dont

- DOT

- guida

- durante

- ogni

- alleviare

- facilità d'uso

- efficacia

- elementi

- Abilita

- impegnandosi

- ingegnere

- Ingegneria

- migliorando

- garantire

- entrare

- Intero

- Ambiente

- particolarmente

- Anche

- eventi

- esempio

- Esempi

- mostra

- esistente

- esperto

- competenza

- esperti

- feedback

- compagno

- campi

- Film

- Infine

- Nome

- Florida

- flusso

- seguire

- i seguenti

- Nel

- modulo

- essere trovato

- Fondazione

- quattro

- Contesto

- da

- ulteriormente

- futuro

- gioco

- sviluppo del gioco

- GAO

- raccogliere

- raccolta

- Generale

- generare

- generato

- la generazione di

- ELETTRICA

- generativo

- AI generativa

- Generatori

- ottenere

- ottenere

- dato

- scopo

- Grafico

- Terra

- guida

- linee guida

- ha avuto

- Mani

- dannoso

- Avere

- HCI

- he

- capo

- pesante

- sollevamento pesante

- Eroe

- Aiuto

- utile

- aiuta

- Alta

- alta qualità

- evidenzia

- vivamente

- il suo

- possesso

- detiene

- Come

- Tutorial

- HTML

- HTTPS

- umano

- Gli esseri umani

- IBM

- identificato

- identificare

- IEEE

- if

- Illegale

- Immagine

- immagini

- importante

- competenze

- miglioramento

- in

- impreciso

- includere

- inclusi

- incorporare

- industria

- specifici del settore

- iniziative

- innovazioni

- ingresso

- istruzioni

- strumenti

- Intelligence

- destinato

- Intenzione

- interazione

- interazioni

- interattivo

- interessato

- interessi

- interfacce

- interno

- intersezione

- ai miglioramenti

- IoT

- problema

- sicurezza

- IT

- SUO

- stessa

- Lavoro

- accoppiamento

- viaggio

- jpg

- ad appena

- Le

- Genere

- conoscenze

- etichettatura

- per il tuo brand

- di laboratorio

- Labs

- Lingua

- grandi

- con i più recenti

- Leadership

- IMPARARE

- apprendimento

- meno

- a sinistra

- Lunghezza

- di sollevamento

- LIMITE

- LLM

- registrazione

- logo

- macchina

- machine learning

- Principale

- make

- gestione

- direttore

- gestisce

- gestione

- molti

- segnato

- Marketing

- corrispondenza

- Maggio..

- significato

- si intende

- Soddisfare

- Soddisfa

- mentale

- messaggio

- metodo

- metodi

- Microsoft

- mancante

- ML

- modello

- modelli

- moderazione

- Scopri di più

- maggior parte

- Mozilla

- Multimedia

- multiplo

- devono obbligatoriamente:

- nomi

- Naturale

- Bisogno

- esigenze

- New

- GENERAZIONE

- no

- romanzo

- adesso

- numero

- Nvidia

- oggetto

- oggetti

- of

- on

- quelli

- esclusivamente

- operativa

- Opzioni

- or

- oracolo

- minimo

- Altro

- nostro

- produzione

- ancora

- proprio

- Oxford

- pagina

- coppia

- coppie

- vetro

- parte

- particolare

- Ricambi

- Passato

- modelli

- Persone

- pubblica

- Eseguire

- esecuzione

- cronologia

- personalizzazione

- posto

- piattaforma

- Platone

- Platone Data Intelligence

- PlatoneDati

- gioca

- più

- posizioni

- Post

- Post

- alimentato

- potente

- preferire

- preferenze

- preferito

- premier

- Preparare

- preparazione

- presentata

- in precedenza

- Precedente

- Problema

- problemi

- processi

- produrre

- Prodotto

- produttore

- Produttori

- Prodotto

- gestione del prodotto

- product manager

- della produttività

- Prodotti

- Insegnante

- progetto

- progetti

- fornire

- purché

- fornitura

- Pubblicazione

- Pubblica

- scopo

- fini

- metti

- Domande e risposte

- qualità

- domanda

- Domande

- Posizione

- valutazione

- Leggi

- pronto

- realistico

- recente

- riconoscere

- regolarmente

- relazionato

- Relazioni

- pertinente

- fare affidamento

- rimozione

- rappresentazione

- rappresenta

- reputazione

- richiesta

- richieste

- necessario

- Requisiti

- richiede

- riparazioni

- rispetto

- Rispondere

- risposta

- risposte

- responsabile

- Risultati

- recensioni

- Ricco

- destra

- Rischio

- rischiando

- robotica

- Ruolo

- ruoli

- s

- sicura

- sagemaker

- Scala

- scala ai

- di moto

- Scienze

- Scienziato

- Sezione

- problemi di

- anziano

- delicata

- inviato

- Servizi

- servizio

- set

- Set

- regolazione

- flessibile.

- alcuni

- Condividi

- lei

- mostrare attraverso le sue creazioni

- mostrato

- Spettacoli

- lato

- Silicio

- Silicon Valley

- simile

- semplicemente

- contemporaneamente

- singolo

- qualificato

- Software

- lo sviluppo del software

- Software Engineer

- RISOLVERE

- alcuni

- qualcosa

- specifico

- specificato

- inizia a

- iniziato

- Di partenza

- startup

- soggiorno

- step

- Strategico

- style

- presentata

- sostanza

- tale

- riassumere

- SOMMARIO

- Dom.

- supportato

- suppone

- SISTEMI DI TRATTAMENTO

- Fai

- preso

- Task

- task

- Insegnamento

- team

- Tennessee

- condizioni

- Texas

- di

- che

- Il

- il mondo

- loro

- Li

- poi

- Là.

- perciò

- Strumenti Bowman per analizzare le seguenti finiture:

- di

- questo

- tre

- Attraverso

- tempo

- timestamp

- a

- oggi

- strumenti

- top

- argomento

- Tour

- Treni

- allenato

- Training

- forma

- Verità

- esercitazioni

- seconda

- Digitare

- Tipi di

- tipicamente

- Uber

- ui

- e una comprensione reciproca

- Università

- University of California

- University of Chicago

- Università di Oxford

- uso

- caso d'uso

- utilizzato

- Utente

- utilizzando

- Valle

- varietà

- vario

- sedi

- Video

- videogiochi

- Video

- visione

- Voce

- volere

- volendo

- vuole

- Prima

- we

- sito web

- servizi web

- WELL

- Che

- quando

- quale

- OMS

- tutto

- volere

- con

- senza

- Lavora

- lavorato

- flusso di lavoro

- flussi di lavoro

- Forza lavoro

- lavoro

- lavori

- Corsi

- mondo

- sarebbe

- scrivere

- scrittura

- scritto

- anni

- Tu

- Trasferimento da aeroporto a Sharm

- zefiro