Il mondo dell'intelligenza artificiale (AI) e dell'apprendimento automatico (ML) ha assistito a un cambio di paradigma con l'ascesa di modelli di intelligenza artificiale generativa in grado di creare testo, immagini, codice e audio simili a quelli umani. Rispetto ai modelli ML classici, i modelli di IA generativa sono significativamente più grandi e complessi. Tuttavia, la loro crescente complessità comporta anche costi elevati per l'inferenza e una crescente necessità di potenti risorse di calcolo. L'elevato costo dell'inferenza per i modelli di intelligenza artificiale generativa può rappresentare una barriera all'ingresso per aziende e ricercatori con risorse limitate, rendendo necessaria la necessità di soluzioni più efficienti ed economiche. Inoltre, la maggior parte dei casi d'uso dell'IA generativa coinvolge l'interazione umana o scenari del mondo reale, che richiedono hardware in grado di fornire prestazioni a bassa latenza. AWS ha innovato con chip appositamente realizzati per soddisfare la crescente esigenza di hardware di elaborazione potente, efficiente e conveniente.

Oggi siamo entusiasti di annunciarlo Amazon Sage Maker supporta AWS Inferenziale2 (ml.inf2) e AWSTrainium (ml.trn1) basate su istanze SageMaker per ospitare modelli di intelligenza artificiale generativa per l'inferenza asincrona e in tempo reale. Le istanze ml.inf2 sono disponibili per la distribuzione del modello su SageMaker negli Stati Uniti orientali (Ohio) e le istanze ml.trn1 negli Stati Uniti orientali (Virginia settentrionale).

Puoi utilizzare queste istanze su SageMaker per ottenere prestazioni elevate a basso costo per i modelli di intelligenza artificiale generativa, inclusi i modelli di linguaggio di grandi dimensioni (LLM), la diffusione stabile e i trasformatori di visione. Inoltre, puoi usare Raccomandatore di inferenza Amazon SageMaker per aiutarti a eseguire test di carico e valutare i vantaggi in termini di prezzo e prestazioni della distribuzione del tuo modello su queste istanze.

Puoi utilizzare le istanze ml.inf2 e ml.trn1 per eseguire le tue applicazioni ML su SageMaker per il riepilogo del testo, la generazione di codice, la generazione di video e immagini, il riconoscimento vocale, la personalizzazione, il rilevamento di frodi e altro ancora. Puoi iniziare facilmente specificando le istanze ml.trn1 o ml.inf2 durante la configurazione del tuo endpoint SageMaker. Puoi utilizzare i DLC (DLC) AWS compatibili con ml.trn1 e ml.inf2 per PyTorch, TensorFlow, Hugging Face e Large Model Inference (LMI) per iniziare facilmente. Per l'elenco completo con le versioni, vedere Immagini disponibili dei contenitori di apprendimento profondo.

In questo post, mostriamo il processo di distribuzione di un modello di linguaggio di grandi dimensioni su AWS Inferentia2 utilizzando SageMaker, senza richiedere alcuna codifica aggiuntiva, sfruttando il contenitore LMI. Noi usiamo il GPT4ALL-J, un modello GPT-J 7B perfezionato che fornisce un'interazione in stile chatbot.

Panoramica delle istanze ml.trn1 e ml.inf2

Le istanze ml.trn1 sono alimentate dall'acceleratore Trainium, creato appositamente per l'addestramento di deep learning ad alte prestazioni di modelli di intelligenza artificiale generativa, compresi gli LLM. Tuttavia, queste istanze supportano anche carichi di lavoro di inferenza per modelli ancora più grandi di quelli che rientrano in Inf2. La dimensione dell'istanza più grande, istanze trn1.32xlarge, presenta 16 Acceleratori Trainium con 512 GB di memoria di accelerazione in una singola istanza che offre fino a 3.4 petaflop di potenza di calcolo FP16/BF16. 16 acceleratori Trainium sono collegati con NeuronLinkv2 ad altissima velocità per comunicazioni collettive semplificate.

Le istanze ml.Inf2 sono alimentate da Acceleratore AWS Inferentia2, un acceleratore appositamente costruito per l'inferenza. Offre prestazioni di calcolo tre volte superiori, un throughput fino a quattro volte superiore e una latenza fino a 10 volte inferiore rispetto ad AWS Inferentia di prima generazione. La dimensione dell'istanza più grande, Inf2.48xlarge, presenta 12 acceleratori AWS Inferentia2 con 384 GB di memoria dell'acceleratore in una singola istanza per una potenza di calcolo combinata di 2.3 petaflop per BF16/FP16. Consente di implementare fino a un modello da 175 miliardi di parametri in una singola istanza. Inf2 è l'unica istanza ottimizzata per l'inferenza che offre questa interconnessione, una funzionalità disponibile solo in istanze di addestramento più costose. Per i modelli ultra-grandi che non entrano in un singolo acceleratore, i dati fluiscono direttamente tra gli acceleratori con NeuronLink, bypassando completamente la CPU. Con NeuronLink, Inf2 supporta un'inferenza distribuita più rapida e migliora il throughput e la latenza.

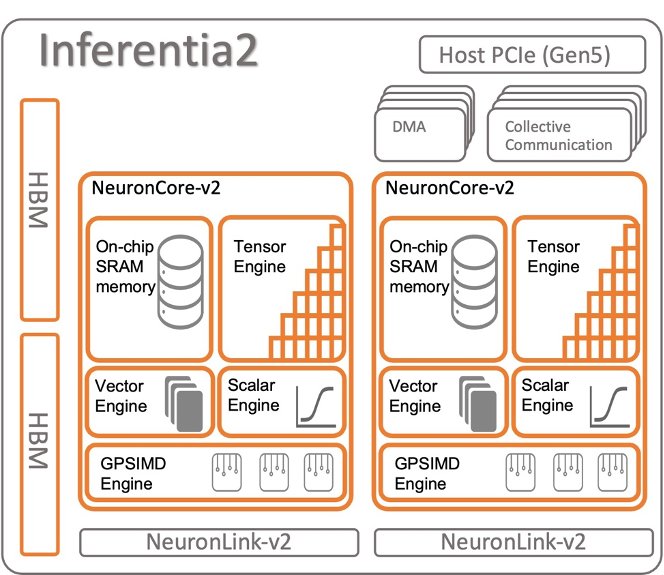

Entrambi gli acceleratori AWS Inferentia2 e Trainium ne hanno due NeuronCores-v2, stack di memoria HBM da 32 GB e motori di calcolo collettivo dedicati, che ottimizzano automaticamente il tempo di esecuzione sovrapponendo il calcolo e la comunicazione durante l'inferenza multi-acceleratore. Per maggiori dettagli sull'architettura, fare riferimento a Dispositivi Trainium e Inferentia.

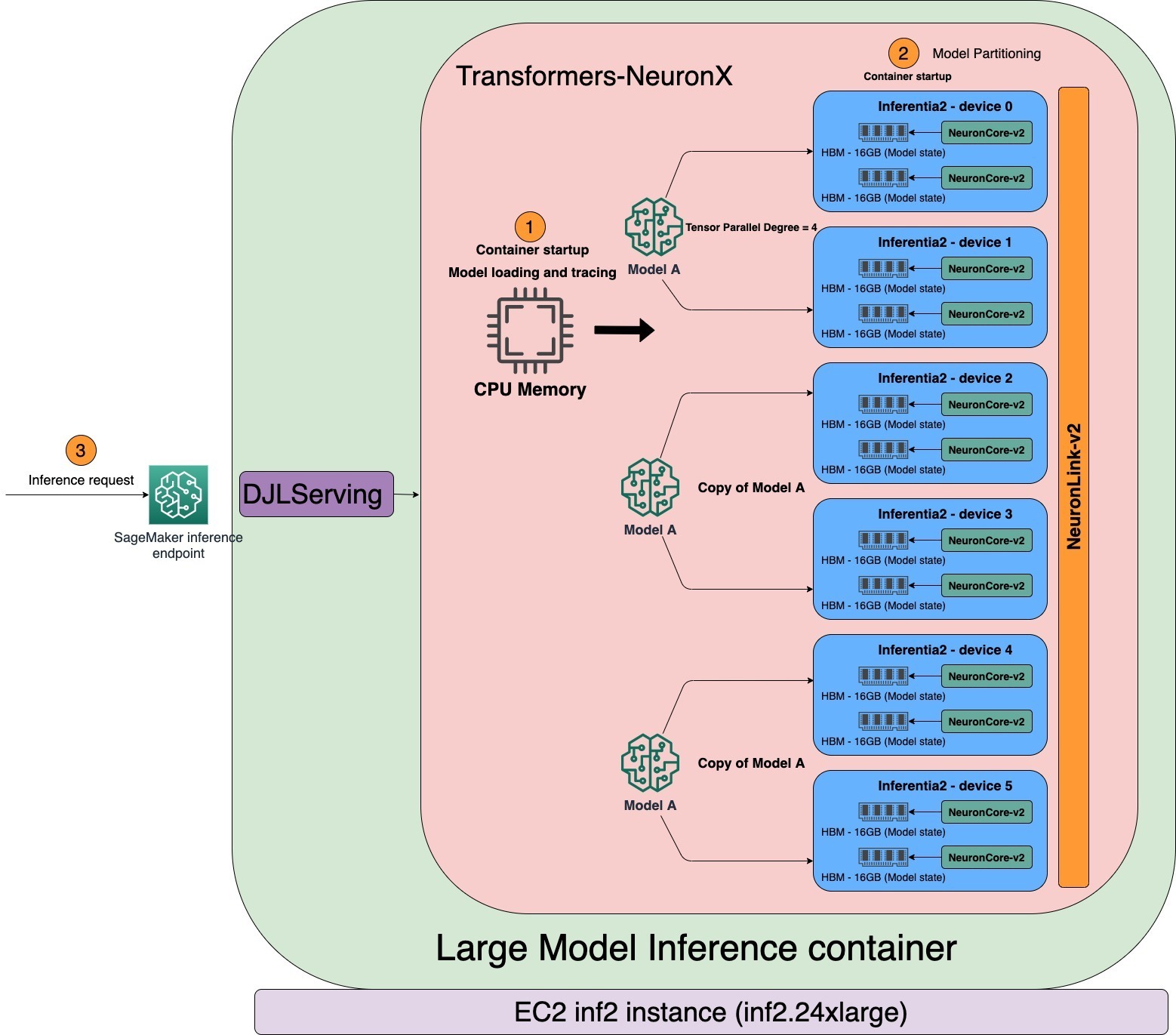

Il diagramma seguente mostra un esempio di architettura che utilizza AWS Inferentia2.

SDK di AWS Neuron

Neurone AWS è l'SDK utilizzato per eseguire carichi di lavoro di deep learning su istanze basate su AWS Inferentia e Trainium. AWS Neuron include un compilatore di deep learning, runtime e strumenti integrati in modo nativo in TensorFlow e PyTorch. Con Neuron puoi sviluppare, profilare e distribuire carichi di lavoro ML ad alte prestazioni su ml.trn1 e ml.inf2.

Il Compilatore di neuroni accetta modelli ML in vari formati (TensorFlow, PyTorch, XLA HLO) e li ottimizza per l'esecuzione su dispositivi Neuron. Il compilatore Neuron viene richiamato all'interno del framework ML, dove i modelli ML vengono inviati al compilatore dal plug-in del framework Neuron. L'artefatto del compilatore risultante è chiamato file NEFF (Neuron Executable File Format) che a sua volta viene caricato dal runtime Neuron sul dispositivo Neuron.

Il Durata del neurone è costituito da driver del kernel e librerie C/C++, che forniscono API per accedere ai dispositivi AWS Inferentia e Trainium Neuron. I plug-in dei framework Neuron ML per TensorFlow e PyTorch utilizzano il runtime di Neuron per caricare ed eseguire modelli su NeuronCores. Il runtime di Neuron carica i modelli di deep learning (NEFF) compilati nei dispositivi Neuron ed è ottimizzato per throughput elevato e bassa latenza.

Ospita modelli NLP utilizzando le istanze ml.inf2 di SageMaker

Prima di immergerci in profondità nel servire gli LLM con trasformatori-neuronx, che è una libreria open source per suddividere le matrici di peso elevato del modello su più NeuronCore, esaminiamo brevemente il flusso di distribuzione tipico per un modello che può adattarsi al singolo NeuronCore.

Controlla il elenco dei modelli supportati per garantire che il modello sia supportato su AWS Inferentia2. Successivamente, il modello deve essere precompilato dal Neuron Compiler. Puoi usare un taccuino SageMaker o un Cloud di calcolo elastico di Amazon (Amazon EC2) per compilare il modello. Puoi utilizzare SageMaker Python SDK per distribuire i modelli utilizzando i framework di deep learning più diffusi come PyTorch, come mostrato nel codice seguente. Puoi distribuire il tuo modello ai servizi di hosting SageMaker e ottenere un endpoint che può essere utilizzato per l'inferenza. Questi endpoint sono completamente gestiti e supportano il ridimensionamento automatico.

Fare riferimento a Flussi dello sviluppatore per maggiori dettagli sui flussi di sviluppo tipici di Inf2 su SageMaker con script di esempio.

Ospita LLM utilizzando le istanze ml.inf2 di SageMaker

I modelli di linguaggio di grandi dimensioni con miliardi di parametri sono spesso troppo grandi per stare su un singolo acceleratore. Ciò richiede l'uso di tecniche di modello parallelo per l'hosting di LLM su più acceleratori. Un altro requisito cruciale per l'hosting di LLM è l'implementazione di una soluzione di servizio di modelli ad alte prestazioni. Questa soluzione dovrebbe caricare in modo efficiente il modello, gestire il partizionamento e servire senza problemi le richieste tramite endpoint HTTP.

SageMaker include contenitori di deep learning (DLC), librerie e strumenti specializzati per il parallelismo dei modelli e l'inferenza di modelli di grandi dimensioni. Per le risorse per iniziare con LMI su SageMaker, fare riferimento a Parallelismo dei modelli e grande inferenza dei modelli. SageMaker mantiene DLC con librerie open source popolari per l'hosting di modelli di grandi dimensioni come GPT, T5, OPT, BLOOM e Stable Diffusion sull'infrastruttura AWS. Questi DLC specializzati sono indicati come contenitori SageMaker LMI.

Contenitori SageMaker LMI utilizza DJLServing, un server modello integrato con la libreria transformers-neuronx per supportare il parallelismo tensoriale tra NeuronCores. Per saperne di più su come funziona DJLServing, fare riferimento a Distribuisci modelli di grandi dimensioni su Amazon SageMaker utilizzando DJLServing e l'inferenza parallela del modello DeepSpeed. Il server modello DJL e la libreria transformers-neuronx fungono da componenti principali del contenitore, che include anche l'SDK Neuron. Questa configurazione facilita il caricamento dei modelli sugli acceleratori AWS Inferentia2, parallelizza il modello su più NeuronCores e consente di servire tramite endpoint HTTP.

Il contenitore LMI supporta il caricamento di modelli da un file Servizio di archiviazione semplice Amazon (Amazon S3) o Hugging Face Hub. Lo script del gestore predefinito carica il modello, lo compila e lo converte in un formato ottimizzato per Neuron e lo carica. Per utilizzare il contenitore LMI per ospitare LLM, abbiamo due opzioni:

- A senza codice (preferito) – Questo è il modo più semplice per distribuire un LLM utilizzando un contenitore LMI. In questo metodo, puoi utilizzare il file fornito gestore predefinito e basta passare il nome del modello e i parametri richiesti

serving.propertiesfile per caricare e ospitare il modello. Per utilizzare il gestore predefinito, forniamo il fileentryPointparametro comedjl_python.transformers-neuronx. - Porta la tua sceneggiatura – In questo approccio, hai la possibilità di creare il tuo file model.py, che contiene il codice necessario per caricare e servire il modello. Questo file funge da intermediario tra i file

DJLServingAPI e iltransformers-neuronxAPI. Per personalizzare il processo di caricamento del modello, puoi fornireserving.propertiescon parametri configurabili. Per un elenco completo dei parametri configurabili disponibili, fare riferimento a Tutte le opzioni di configurazione DJL. Ecco un esempio di a modello.py file.

Architettura di runtime

Il tensor_parallel_degree Il valore della proprietà determina la distribuzione dei moduli tensoriali paralleli su più NeuronCores. Ad esempio, inf2.24xlarge ha sei acceleratori AWS Inferentia2. Ogni acceleratore AWS Inferentia2 ha due NeuronCores. Ogni NeuronCore ha una memoria dedicata ad alta larghezza di banda (HBM) di 16 GB che memorizza moduli tensoriali paralleli. Con un grado tensoriale parallelo di 4, l'LMI assegnerà tre copie del modello dello stesso modello, ciascuna utilizzando quattro NeuronCores. Come mostrato nel diagramma seguente, all'avvio del contenitore LMI, il modello verrà caricato e tracciato per primo nella memoria indirizzabile della CPU. Quando il tracciato è completo, il modello viene partizionato tra i NeuronCores in base al grado parallelo del tensore.

LMI utilizza DJLServing come stack di servizio del modello. Dopo che il controllo dello stato del contenitore è passato in SageMaker, il contenitore è pronto per servire la richiesta di inferenza. DJLServing avvia più processi Python equivalenti a TOTAL NUMBER OF NEURON CORES/TENSOR_PARALLEL_DEGREE. Ogni processo Python contiene thread in C++ equivalenti a TENSOR_PARALLEL_DEGREE. Ogni thread C++ contiene un frammento del modello su un NeuronCore.

Molti professionisti (processo Python) tendono a eseguire l'inferenza in sequenza quando il server viene richiamato con più richieste indipendenti. Sebbene sia più semplice da configurare, in genere non è consigliabile utilizzare la potenza di calcolo dell'acceleratore. Per risolvere questo problema, DJLServing offre le ottimizzazioni integrate del batch dinamico per combinare queste richieste di inferenza indipendenti sul lato server per formare un batch più grande in modo dinamico per aumentare il throughput. Tutte le richieste raggiungono il batcher dinamico prima di entrare nelle code di lavoro effettive per attendere l'inferenza. È possibile impostare le dimensioni batch preferite per il batch dinamico utilizzando il file batch_size impostazioni in serving.properties. Puoi anche configurare max_batch_delay per specificare il tempo di ritardo massimo nel batcher per attendere che altre richieste si uniscano al batch in base ai requisiti di latenza. La velocità effettiva dipende anche dal numero di copie del modello e dai gruppi di processi Python avviati nel contenitore. Come mostrato nel diagramma seguente, con il grado parallelo del tensore impostato su 4, il contenitore LMI avvia tre gruppi di processi Python, ciascuno contenente la copia completa del modello. Ciò consente di aumentare le dimensioni del batch e ottenere un throughput più elevato.

Notebook SageMaker per la distribuzione di LLM

In questa sezione, viene fornita una procedura dettagliata per la distribuzione di GPT4All-J, un modello da 6 miliardi di parametri pari a 24 GB in FP32. GPT4All-J è un chatbot popolare che è stato addestrato su una vasta gamma di contenuti di interazione come problemi di parole, dialoghi, codice, poesie, canzoni e storie. GPT4all-J è un modello GPT-J perfezionato che genera risposte simili alle interazioni umane.

Il taccuino completo per questo esempio è fornito su GitHub. Possiamo utilizzare SageMaker Python SDK per distribuire il modello in un'istanza Inf2. Usiamo il fornito gestore predefinito per caricare il modello. Con questo, dobbiamo solo fornire a porzioni.proprietà file. Questo file ha le configurazioni richieste per il server modello DJL per scaricare e ospitare il modello. Possiamo specificare il nome del modello Hugging Face utilizzando il model_id parametro per scaricare il modello direttamente dal repository Hugging Face. In alternativa, puoi scaricare il modello da Amazon S3 fornendo il file s3url parametro. Il entryPoint parametro è configurato per puntare alla libreria per caricare il modello. Per maggiori dettagli su djl_python.fastertransformer, fare riferimento a codice GitHub.

Il tensor_parallel_degree Il valore della proprietà determina la distribuzione dei moduli tensoriali paralleli su più dispositivi. Ad esempio, con 12 NeuronCores e un grado tensoriale parallelo di 4, LMI assegnerà tre copie del modello, ciascuna utilizzando quattro NeuronCores. È inoltre possibile definire il tipo di precisione utilizzando la proprietà dtype. n_position Il parametro definisce la somma della lunghezza massima della sequenza di input e output per il modello. Vedere il seguente codice:

Costruisci il tarball contenente serving.properties e caricalo in un bucket S3. Anche se in questo esempio viene utilizzato il gestore predefinito, è possibile sviluppare a model.py file per personalizzare il processo di caricamento e servizio. Se sono presenti pacchetti che richiedono l'installazione, includerli nel file requirements.txt file. Vedere il seguente codice:

Recupera l'immagine del contenitore DJL e crea il modello SageMaker:

Successivamente, creiamo l'endpoint SageMaker con la configurazione del modello definita in precedenza. Il contenitore scarica il modello nel file /tmp space perché SageMaker mappa il file /tmp a Negozio di blocchi elastici di Amazon (Amazon EBS). Dobbiamo aggiungere a volume_size parametro per garantire il /tmp directory ha spazio sufficiente per scaricare e compilare il modello. Prepariamo container_startup_health_check_timeout a 3,600 secondi per garantire che il controllo dello stato venga avviato dopo che il modello è pronto. Usiamo l'istanza ml.inf2.8xlarge. Vedere il seguente codice:

Dopo che l'endpoint SageMaker è stato creato, possiamo fare previsioni in tempo reale sugli endpoint SageMaker utilizzando il Predictor oggetto:

ripulire

Elimina gli endpoint per risparmiare sui costi dopo aver terminato i test:

Conclusione

In questo post, abbiamo presentato la funzionalità appena lanciata di SageMaker, che ora supporta le istanze ml.inf2 e ml.trn1 per l'hosting di modelli di intelligenza artificiale generativa. Abbiamo dimostrato come distribuire GPT4ALL-J, un modello di intelligenza artificiale generativa, su AWS Inferentia2 utilizzando SageMaker e il contenitore LMI, senza scrivere alcun codice. Abbiamo anche mostrato come puoi utilizzare DJLServing e transformers-neuronx per caricare un modello, partizionarlo e servirlo.

Le istanze Inf2 forniscono il modo più conveniente per eseguire modelli di intelligenza artificiale generativa su AWS. Per i dettagli sulle prestazioni, fare riferimento a Prestazioni Inf2.

Guarda la GitHub repository per un notebook di esempio. Provalo e facci sapere se hai qualche domanda!

Informazioni sugli autori

Vivek Gangasani è Senior Machine Learning Solutions Architect presso Amazon Web Services. Collabora con le startup di Machine Learning per creare e distribuire applicazioni AI/ML su AWS. Attualmente è concentrato sulla fornitura di soluzioni per MLOps, ML Inference e ML low-code. Ha lavorato a progetti in diversi domini, tra cui Natural Language Processing e Computer Vision.

Vivek Gangasani è Senior Machine Learning Solutions Architect presso Amazon Web Services. Collabora con le startup di Machine Learning per creare e distribuire applicazioni AI/ML su AWS. Attualmente è concentrato sulla fornitura di soluzioni per MLOps, ML Inference e ML low-code. Ha lavorato a progetti in diversi domini, tra cui Natural Language Processing e Computer Vision.

Hiroshi Tokyo è un architetto di soluzioni presso AWS Annapurna Labs. Con sede in Giappone, è entrato a far parte di Annapurna Labs anche prima dell'acquisizione da parte di AWS e ha costantemente aiutato i clienti con la tecnologia Annapurna Labs. Il suo focus recente è sulle soluzioni di Machine Learning basate su silicio appositamente costruito, AWS Inferentia e Trainium.

Hiroshi Tokyo è un architetto di soluzioni presso AWS Annapurna Labs. Con sede in Giappone, è entrato a far parte di Annapurna Labs anche prima dell'acquisizione da parte di AWS e ha costantemente aiutato i clienti con la tecnologia Annapurna Labs. Il suo focus recente è sulle soluzioni di Machine Learning basate su silicio appositamente costruito, AWS Inferentia e Trainium.

Dhawal Patel è un Principal Machine Learning Architect presso AWS. Ha lavorato con organizzazioni che vanno dalle grandi imprese alle startup di medie dimensioni su problemi legati all'informatica distribuita e all'intelligenza artificiale. Si concentra sull'apprendimento profondo, inclusi i domini della PNL e della visione artificiale. Aiuta i clienti a ottenere l'inferenza del modello ad alte prestazioni su SageMaker.

Dhawal Patel è un Principal Machine Learning Architect presso AWS. Ha lavorato con organizzazioni che vanno dalle grandi imprese alle startup di medie dimensioni su problemi legati all'informatica distribuita e all'intelligenza artificiale. Si concentra sull'apprendimento profondo, inclusi i domini della PNL e della visione artificiale. Aiuta i clienti a ottenere l'inferenza del modello ad alte prestazioni su SageMaker.

Qing Lan è un ingegnere di sviluppo software in AWS. Ha lavorato su diversi prodotti impegnativi in Amazon, tra cui soluzioni di inferenza ML ad alte prestazioni e sistema di registrazione ad alte prestazioni. Il team di Qing ha lanciato con successo il primo modello di miliardi di parametri in Amazon Advertising con una latenza molto bassa richiesta. Qing ha una conoscenza approfondita dell'ottimizzazione dell'infrastruttura e dell'accelerazione del Deep Learning.

Qing Lan è un ingegnere di sviluppo software in AWS. Ha lavorato su diversi prodotti impegnativi in Amazon, tra cui soluzioni di inferenza ML ad alte prestazioni e sistema di registrazione ad alte prestazioni. Il team di Qing ha lanciato con successo il primo modello di miliardi di parametri in Amazon Advertising con una latenza molto bassa richiesta. Qing ha una conoscenza approfondita dell'ottimizzazione dell'infrastruttura e dell'accelerazione del Deep Learning.

QingweiLi è uno specialista in machine learning presso Amazon Web Services. Ha conseguito il dottorato di ricerca. in Ricerca Operativa dopo che ha rotto il conto dell'assegno di ricerca del suo consulente e non è riuscito a consegnare il premio Nobel che aveva promesso. Attualmente aiuta i clienti nel settore dei servizi finanziari e assicurativi a creare soluzioni di machine learning su AWS. Nel tempo libero gli piace leggere e insegnare.

QingweiLi è uno specialista in machine learning presso Amazon Web Services. Ha conseguito il dottorato di ricerca. in Ricerca Operativa dopo che ha rotto il conto dell'assegno di ricerca del suo consulente e non è riuscito a consegnare il premio Nobel che aveva promesso. Attualmente aiuta i clienti nel settore dei servizi finanziari e assicurativi a creare soluzioni di machine learning su AWS. Nel tempo libero gli piace leggere e insegnare.

Alan Tan è un Senior Product Manager con SageMaker che guida gli sforzi sull'inferenza di modelli di grandi dimensioni. È appassionato di applicare il Machine Learning all'area dell'analisi. Al di fuori del lavoro, ama la vita all'aria aperta.

Alan Tan è un Senior Product Manager con SageMaker che guida gli sforzi sull'inferenza di modelli di grandi dimensioni. È appassionato di applicare il Machine Learning all'area dell'analisi. Al di fuori del lavoro, ama la vita all'aria aperta.

Varun Syal è un Software Development Engineer presso AWS Sagemaker che lavora su funzionalità critiche rivolte ai clienti per la piattaforma ML Inference. È appassionato di lavorare nei sistemi distribuiti e nello spazio AI. Nel tempo libero ama leggere e fare giardinaggio.

Varun Syal è un Software Development Engineer presso AWS Sagemaker che lavora su funzionalità critiche rivolte ai clienti per la piattaforma ML Inference. È appassionato di lavorare nei sistemi distribuiti e nello spazio AI. Nel tempo libero ama leggere e fare giardinaggio.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoAiStream. Intelligenza dei dati Web3. Conoscenza amplificata. Accedi qui.

- Coniare il futuro con Adryenn Ashley. Accedi qui.

- Acquista e vendi azioni in società PRE-IPO con PREIPO®. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/achieve-high-performance-with-lowest-cost-for-generative-ai-inference-using-aws-inferentia2-and-aws-trainium-on-amazon-sagemaker/

- :ha

- :È

- :non

- :Dove

- $ SU

- 10

- 100

- 12

- 13

- 14

- 15%

- 22

- 24

- 7

- 8

- 9

- a

- WRI

- acceleratore

- acceleratori

- accetta

- accesso

- Il mio account

- Raggiungere

- acquisizione

- operanti in

- atti

- aggiungere

- aggiunta

- indirizzo

- indirizzabile

- Vantaggio

- Pubblicità

- Dopo shavasana, sedersi in silenzio; saluti;

- contro

- AI

- casi d'uso ai

- AI / ML

- Tutti

- consente

- anche

- Sebbene il

- Amazon

- Amazon EC2

- Amazon Sage Maker

- Amazon Web Services

- an

- analitica

- ed

- Annunciare

- Un altro

- in qualsiasi

- API

- applicazioni

- AMMISSIONE

- approccio

- architettura

- SONO

- RISERVATA

- artificiale

- intelligenza artificiale

- Intelligenza artificiale (AI)

- AS

- At

- Audio

- auto

- automaticamente

- disponibile

- AWS

- AWS Inferenza

- palla

- Larghezza di banda

- barriera

- basato

- BE

- perché

- stato

- prima

- vantaggi

- MIGLIORE

- fra

- Big

- maggiore

- miliardi

- Bloccare

- Blog

- Fioritura

- brevemente

- Rotto

- costruire

- costruito

- incassato

- aziende

- by

- C++

- detto

- Materiale

- casi

- impegnativo

- chatbot

- dai un'occhiata

- Chips

- codice

- codifica

- Collective

- combinare

- combinato

- viene

- Comunicazione

- Comunicazioni

- rispetto

- compatibile

- completamento di una

- completamente

- complesso

- complessità

- componenti

- globale

- calcolo

- Calcolare

- computer

- Visione computerizzata

- informatica

- Configurazione

- collegato

- Contenitore

- Tecnologie Container

- contiene

- contenuto

- Nucleo

- Costo

- costo effettivo

- Costi

- creare

- creato

- critico

- cruciale

- Attualmente

- cliente

- Clienti

- personalizzare

- dati

- dedicato

- deep

- apprendimento profondo

- Predefinito

- definito

- definisce

- Laurea

- ritardo

- consegnare

- consegna

- fornisce un monitoraggio

- dimostrato

- dipende

- schierare

- distribuzione

- deployment

- dettagli

- rivelazione

- determina

- sviluppare

- Mercato

- dispositivo

- dispositivi

- diverso

- Emittente

- direttamente

- distribuito

- calcolo distribuito

- sistemi distribuiti

- distribuzione

- fare

- domini

- Dont

- scaricare

- download

- autista

- dinamico

- dinamicamente

- ogni

- In precedenza

- più facile

- più semplice

- facilmente

- est

- efficiente

- in modo efficiente

- sforzi

- Abilita

- fine

- endpoint

- ingegnere

- Motori

- abbastanza

- garantire

- entrare

- aziende

- iscrizione

- Equivalente

- valutare

- Anche

- esempio

- eccitato

- costoso

- extra

- Faccia

- facilita

- di fronte

- fallito

- più veloce

- caratteristica

- Caratteristiche

- Compila il

- finanziario

- servizio finanziario

- finire

- Nome

- in forma

- flusso

- flussi

- Focus

- concentrato

- si concentra

- i seguenti

- Nel

- modulo

- formato

- quattro

- Contesto

- quadri

- frode

- rilevazione di frodi

- da

- pieno

- completamente

- Inoltre

- genera

- ELETTRICA

- generativo

- AI generativa

- ottenere

- Go

- concedere

- Gruppo

- Crescita

- Hardware

- Avere

- he

- Salute e benessere

- Aiuto

- aiutato

- aiuta

- qui

- Alta

- Alte prestazioni

- superiore

- il suo

- possesso

- detiene

- host

- di hosting

- servizi di hosting

- Casa

- Come

- Tutorial

- Tuttavia

- HTML

- http

- HTTPS

- Hub

- umano

- if

- Immagine

- immagini

- implementazione

- importare

- in

- Uno sguardo approfondito sui miglioramenti dei pneumatici da corsa di Bridgestone.

- includere

- inclusi

- Compreso

- Aumento

- crescente

- studente indipendente

- industria

- Infrastruttura

- innovare

- ingresso

- Ingressi

- installazione

- esempio

- assicurazione

- integrato

- Intelligence

- interazione

- interazioni

- procacciatore d'affari

- ai miglioramenti

- invocato

- coinvolgere

- IT

- SUO

- Giappone

- Lavoro

- join

- congiunto

- jpg

- json

- ad appena

- Sapere

- conoscenze

- Labs

- Lingua

- grandi

- Grandi imprese

- superiore, se assunto singolarmente.

- maggiore

- Latenza

- lanciato

- lancia

- principale

- IMPARARE

- apprendimento

- Lunghezza

- lasciare

- biblioteche

- Biblioteca

- piace

- piace

- Limitato

- Lista

- LLM

- caricare

- Caricamento in corso

- carichi

- registrazione

- Basso

- inferiore

- minore

- macchina

- machine learning

- principalmente

- mantiene

- Maggioranza

- make

- gestire

- gestito

- direttore

- Maps

- max

- massimo

- Memorie

- metodo

- ML

- MLOp

- modello

- modelli

- moduli

- Scopri di più

- più efficiente

- maggior parte

- multiplo

- Nome

- Naturale

- Elaborazione del linguaggio naturale

- necessaria

- Bisogno

- esigenze

- New

- New York

- GENERAZIONE

- nlp

- premio Nobel

- taccuino

- adesso

- numero

- oggetto

- of

- offrire

- Offerte

- di frequente

- Ohio

- on

- ONE

- esclusivamente

- open source

- Operazioni

- ottimizzazione

- OTTIMIZZA

- ottimizzati

- Ottimizza

- Opzione

- Opzioni

- or

- organizzazioni

- Altro

- nostro

- su

- all'aperto

- produzione

- al di fuori

- proprio

- Packages

- paradigma

- Parallel

- parametro

- parametri

- passare

- Passi

- appassionato

- performance

- personalizzazione

- piattaforma

- Platone

- Platone Data Intelligence

- PlatoneDati

- plug-in

- i plugin

- punto

- Popolare

- Post

- energia

- alimentato

- potente

- pratica

- Precisione

- Previsioni

- Predictor

- preferito

- Direttore

- premio

- problemi

- processi

- i processi

- lavorazione

- Prodotto

- product manager

- Prodotti

- Profilo

- progetti

- promesso

- proprietà

- proprietà

- fornire

- purché

- fornisce

- fornitura

- scopo

- Python

- pytorch

- che vanno

- raggiungere

- Lettura

- pronto

- mondo reale

- tempo reale

- ricevuto

- recente

- riconoscimento

- di cui

- relazionato

- richiesta

- richieste

- necessario

- requisito

- Requisiti

- riparazioni

- ricercatori

- Risorse

- risposte

- risultante

- Aumento

- Correre

- sagemaker

- Inferenza di SageMaker

- stesso

- Risparmi

- scala

- Scenari

- script

- sdk

- senza soluzione di continuità

- secondo

- Sezione

- vedere

- anziano

- Sequenza

- servire

- servizio

- Servizi

- servizio

- set

- impostazioni

- flessibile.

- alcuni

- spostamento

- dovrebbero

- mostrare attraverso le sue creazioni

- in mostra

- mostrato

- Spettacoli

- lato

- significativamente

- Silicio

- simile

- Un'espansione

- singolo

- SIX

- Taglia

- Dimensioni

- So

- Software

- lo sviluppo del software

- soluzione

- Soluzioni

- lo spazio

- specialista

- specializzata

- discorso

- Riconoscimento vocale

- stabile

- pila

- Stacks

- inizia a

- iniziato

- inizio

- Startup

- conservazione

- Storie

- memorizzare

- aerodinamico

- style

- Con successo

- tale

- supporto

- supportato

- supporti

- sistema

- SISTEMI DI TRATTAMENTO

- presa

- Insegnamento

- team

- tecniche

- Tecnologia

- tensorflow

- test

- di

- che

- Il

- L'area

- loro

- Li

- Là.

- Strumenti Bowman per analizzare le seguenti finiture:

- questo

- tre

- Attraverso

- portata

- tempo

- volte

- a

- pure

- strumenti

- Tracciato

- allenato

- Training

- trasformatori

- TURNO

- seconda

- Digitare

- tipico

- caricato

- us

- uso

- utilizzato

- utilizzando

- generalmente

- utilizzare

- Utilizzando

- APPREZZIAMO

- varietà

- vario

- Fisso

- molto

- via

- Video

- Virginia

- visione

- aspettare

- walkthrough

- Modo..

- we

- sito web

- servizi web

- peso

- Che

- quando

- quale

- volere

- con

- entro

- senza

- testimoniando

- Word

- Lavora

- lavorato

- lavoro

- lavori

- mondo

- scrivere

- scrittura

- York

- Tu

- Trasferimento da aeroporto a Sharm

- zefiro