Gestore di dati di Amazon SageMaker riduce il tempo necessario per raccogliere e preparare i dati per il machine learning (ML) da settimane a minuti. Puoi semplificare il processo di progettazione delle funzionalità e preparazione dei dati con SageMaker Data Wrangler e completare ogni fase del flusso di lavoro di preparazione dei dati (inclusa selezione, purificazione, esplorazione, visualizzazione ed elaborazione dei dati su larga scala) all'interno di un'unica interfaccia visiva. I dati vengono spesso conservati in data lake che possono essere gestiti Formazione AWS Lake, offrendoti la possibilità di implementare un controllo capillare degli accessi utilizzando una semplice procedura di concessione o revoca. SageMaker Data Wrangler supporta il controllo granulare dell'accesso ai dati con Lake Formation e Amazzone Atena connessioni.

Siamo lieti di annunciare che SageMaker Data Wrangler ora supporta l'utilizzo di Lake Formation con Amazon EMR per fornire questa restrizione dettagliata dell'accesso ai dati.

I professionisti dei dati come i data scientist vogliono sfruttare la potenza di Apache Spark, Alvearee Presto in esecuzione su Amazon EMR per una rapida preparazione dei dati; tuttavia, la curva di apprendimento è ripida. I nostri clienti desideravano la possibilità di connettersi ad Amazon EMR per eseguire query SQL ad hoc su Hive o Presto per eseguire query sui dati nel metastore interno o nel metastore esterno (come il Catalogo dati di AWS Glue) e preparare i dati in pochi clic.

In questo post mostriamo come utilizzare Lake Formation come funzionalità centrale di governance dei dati e Amazon EMR come motore di query per big data per consentire l'accesso a SageMaker Data Wrangler. Le funzionalità di Lake Formation semplificano la protezione e la gestione dei data Lake distribuiti su più account attraverso un approccio centralizzato, fornendo un controllo capillare degli accessi.

Panoramica della soluzione

Dimostriamo questa soluzione con un caso d'uso end-to-end utilizzando un set di dati di esempio, the Modello di dati TPC. Questi dati rappresentano i dati delle transazioni per i prodotti e includono informazioni come i dati demografici dei clienti, l'inventario, le vendite web e le promozioni. Per dimostrare le autorizzazioni di accesso ai dati granulari, consideriamo i seguenti due utenti:

- David, uno scienziato dei dati nel team di marketing. Ha il compito di costruire un modello sulla segmentazione dei clienti ed è autorizzato ad accedere solo ai dati dei clienti non sensibili.

- Tina, una scienziata dei dati nel team di vendita. Ha il compito di creare il modello di previsione delle vendite e ha bisogno di accedere ai dati di vendita per la regione specifica. Sta anche aiutando il team di prodotto con l'innovazione e quindi ha bisogno di accedere anche ai dati di prodotto.

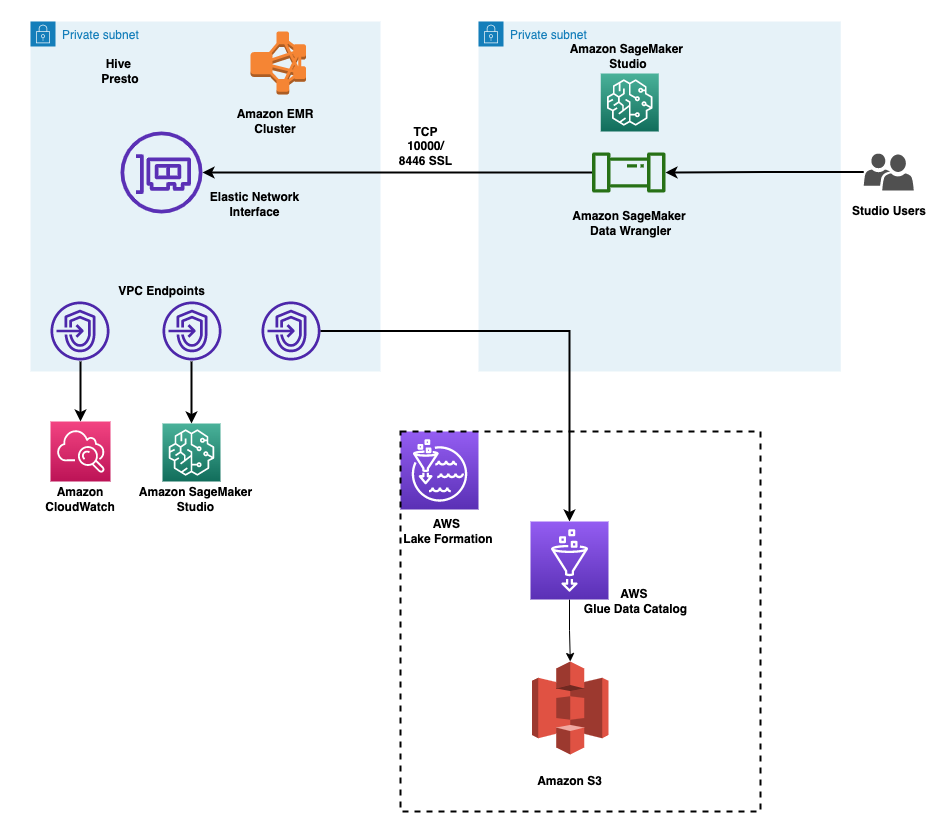

L'architettura è implementata come segue:

- Lake Formation gestisce il data Lake e i dati grezzi sono disponibili in Servizio di archiviazione semplice Amazon Secchi (Amazon S3).

- Amazon EMR viene utilizzato per interrogare i dati dal data lake ed eseguire la preparazione dei dati utilizzando Spark

- Gestione dell'identità e dell'accesso di AWS I ruoli (IAM) vengono utilizzati per gestire l'accesso ai dati utilizzando Lake Formation

- SageMaker Data Wrangler viene utilizzato come unica interfaccia visiva per interrogare e preparare i dati in modo interattivo

Il diagramma seguente illustra questa architettura. L'account A è l'account data Lake che ospita tutti i dati pronti per il machine learning ottenuti tramite processi di estrazione, trasformazione e caricamento (ETL). L'account B è l'account di data science in cui un gruppo di data scientist compila ed esegue trasformazioni di dati utilizzando SageMaker Data Wrangler. Affinché SageMaker Data Wrangler nell'Account B possa accedere alle tabelle di dati nel data Lake dell'Account A tramite le autorizzazioni Lake Formation, dobbiamo attivare i diritti necessari.

Puoi usare il file AWS CloudFormazione stack per configurare i componenti dell'architettura per questa soluzione.

Prerequisiti

Prima di iniziare, assicurati di avere i seguenti prerequisiti:

- An Account AWS

- Un utente IAM con accesso amministratore

- Un secchio S3

Fornisci risorse con AWS CloudFormation

Forniamo un modello CloudFormation che distribuisce i servizi nell'architettura per test end-to-end e per facilitare distribuzioni ripetute. Gli output di questo modello sono i seguenti:

- Un bucket S3 per il data lake.

- Un cluster EMR con ruoli runtime EMR abilitati. Per ulteriori dettagli sull'utilizzo dei ruoli runtime con Amazon EMR, consulta Configura i ruoli di runtime per le fasi di Amazon EMR. L'associazione dei ruoli di runtime ai cluster EMR è supportata in Amazon EMR 6.9. Assicurarsi che sia presente la seguente configurazione:

- Crea una configurazione di sicurezza in Amazon EMR.

- La policy di attendibilità del ruolo runtime EMR dovrebbe consentire al profilo dell'istanza EC2 EMR di assumere il ruolo.

- Il ruolo del profilo dell'istanza EMR EC2 dovrebbe essere in grado di assumere i ruoli di runtime EMR.

- Il cluster EMR deve essere creato con crittografia in transito.

- Ruoli IAM per l'accesso ai dati nel data lake, con autorizzazioni granulari:

- Ruolo di accesso ai dati di marketing

- Ruolo di accesso ai dati di vendita

- An Dominio Amazon SageMaker Studio e due profili utente. I ruoli di esecuzione di SageMaker Studio per gli utenti consentono agli utenti di assumere i rispettivi ruoli runtime EMR corrispondenti.

- Una configurazione del ciclo di vita per abilitare la selezione del ruolo da utilizzare per la connessione EMR.

- Un database Lake Formation popolato con i dati TPC.

- Risorse di rete necessarie per la configurazione, come VPC, sottoreti e gruppi di sicurezza.

Crea certificati di crittografia Amazon EMR per i dati in transito

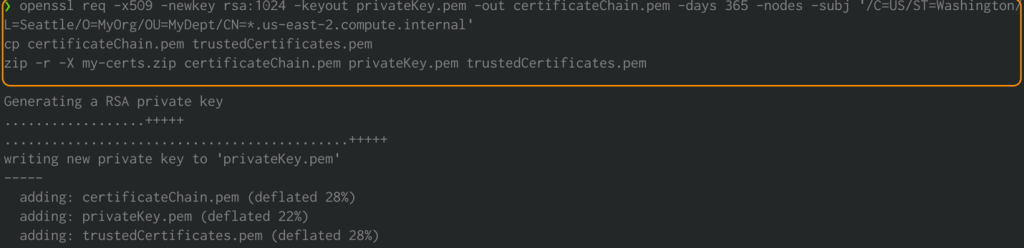

Con la versione 4.8.0 o successiva di Amazon EMR, hai la possibilità di specificare elementi per crittografare i dati in transito utilizzando una configurazione di sicurezza. Creiamo manualmente i certificati PEM, li includiamo in un file .zip, lo carichiamo su un bucket S3 e quindi facciamo riferimento al file .zip in Amazon S3. Probabilmente vorrai configurare il file PEM della chiave privata come un certificato con caratteri jolly che consenta l'accesso al dominio VPC in cui risiedono le istanze del cluster. Ad esempio, se il tuo cluster risiede nella regione us-east-1, potresti specificare un nome comune nella configurazione del certificato che consenta l'accesso al cluster specificando CN=*.ec2.internal nella definizione dell'oggetto del certificato. Se il tuo cluster risiede in us-west-2, potresti specificare CN=*.us-west-2.compute.internal.

Esegui i seguenti comandi utilizzando il terminale di sistema. Questo genererà i certificati PEM e li raccoglierà in un file .zip:

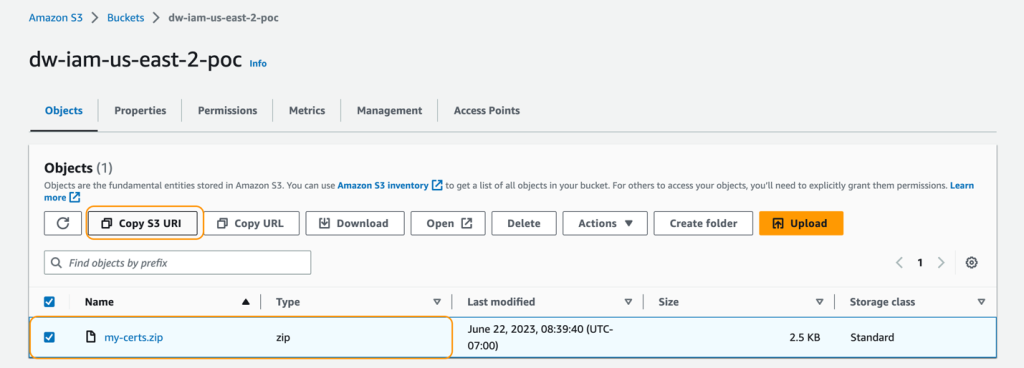

Caricare my-certs.zip a un bucket S3 nella stessa regione in cui intendi eseguire questo esercizio. Copia l'URI S3 per il file caricato. Ne avrai bisogno durante l'avvio del modello CloudFormation.

Questo esempio è solo una dimostrazione di prova del concetto. L'utilizzo di certificati autofirmati non è consigliato e presenta un potenziale rischio per la sicurezza. Per i sistemi di produzione, utilizzare un'autorità di certificazione (CA) attendibile per emettere certificati.

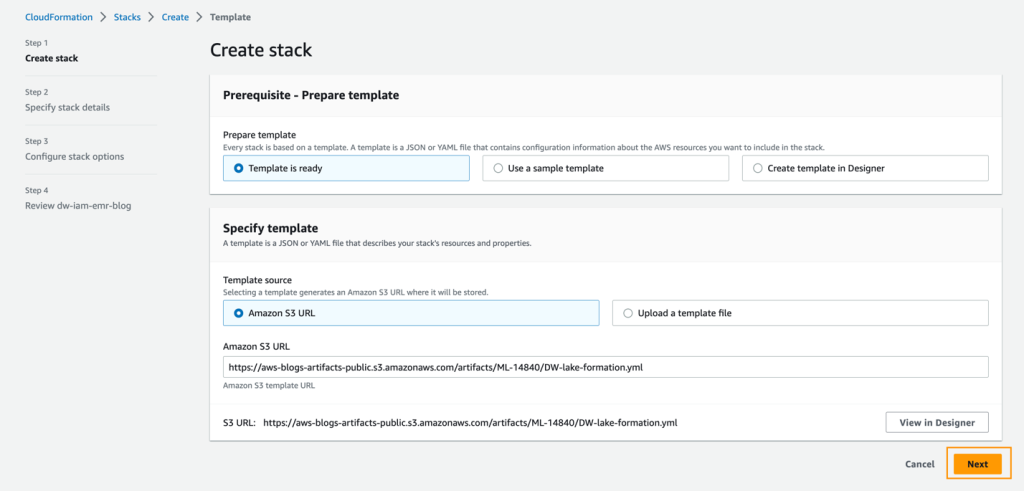

Distribuzione del modello CloudFormation

Per distribuire la soluzione, completare i seguenti passaggi:

- Accedi al Console di gestione AWS come utente IAM, preferibilmente un utente amministratore.

- Scegli Avvia Stack per avviare il modello CloudFormation:

- Scegli Avanti.

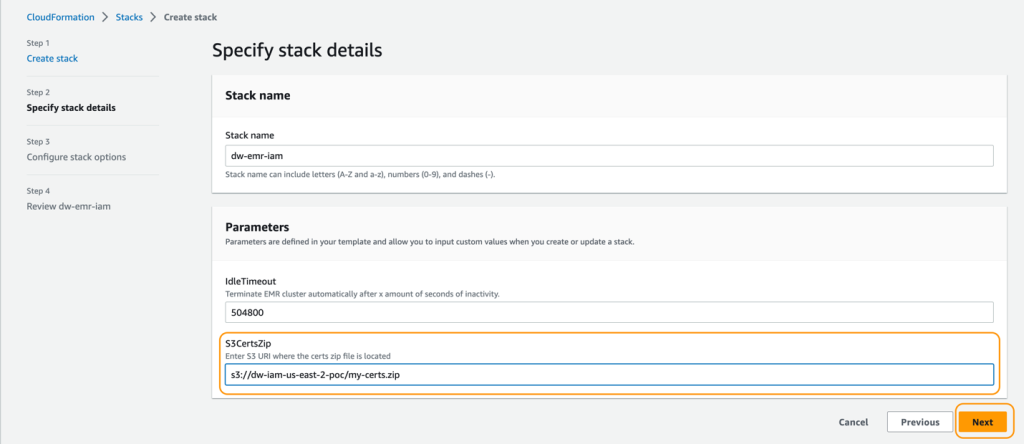

- Nel Nome dello stack, inserisci un nome per lo stack.

- Nel IdleTimeout, inserisci un valore per il timeout di inattività per il cluster EMR (per evitare di pagare per il cluster quando non viene utilizzato).

- Nel S3CertsZip, inserisci un URI S3 con la chiave di crittografia EMR.

Per istruzioni su come generare una chiave e un file .zip specifici per la propria regione, fare riferimento a Fornitura di certificati per la crittografia dei dati in transito con la crittografia Amazon EMR. Se esegui la distribuzione negli Stati Uniti orientali (Virginia settentrionale), ricorda di utilizzare CN=*.ec2.internal. Per ulteriori informazioni, fare riferimento a Crea chiavi e certificati per la crittografia dei dati. Assicurati di caricare il file .zip in un bucket S3 nella stessa regione della distribuzione dello stack CloudFormation.

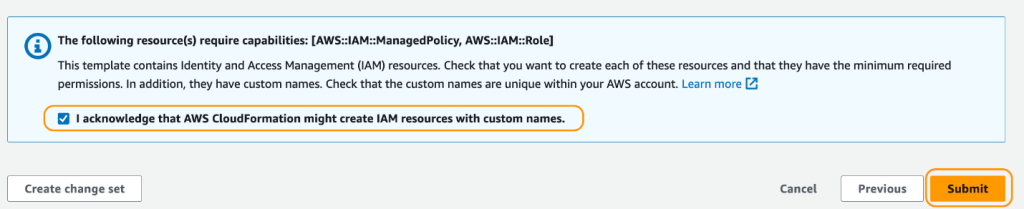

- Nella pagina di revisione, seleziona la casella di controllo per confermare che AWS CloudFormation potrebbe creare risorse.

- Scegli Crea stack.

Attendi fino a quando lo stato dello stack cambia da CREATE_IN_PROGRESS a CREATE_COMPLETE. Il processo richiede in genere 10-15 minuti.

Dopo aver creato lo stack, consenti ad Amazon EMR di eseguire query su Lake Formation aggiornando il file Filtraggio dei dati esterni impostazioni su Lake Formation. Per istruzioni, fare riferimento a Iniziare con la formazione del lago. Specifica Amazon EMR per Valori dei tag di sessione e inserisci l'ID del tuo account AWS sotto ID account AWS.

Testare le autorizzazioni di accesso ai dati

Ora che è disponibile l'infrastruttura necessaria, puoi verificare che i due utenti di SageMaker Studio abbiano accesso ai dati granulari. Per verificare, David non dovrebbe avere accesso ad alcuna informazione privata sui tuoi clienti. Tina ha accesso alle informazioni sulle vendite. Mettiamo alla prova ogni tipo di utente.

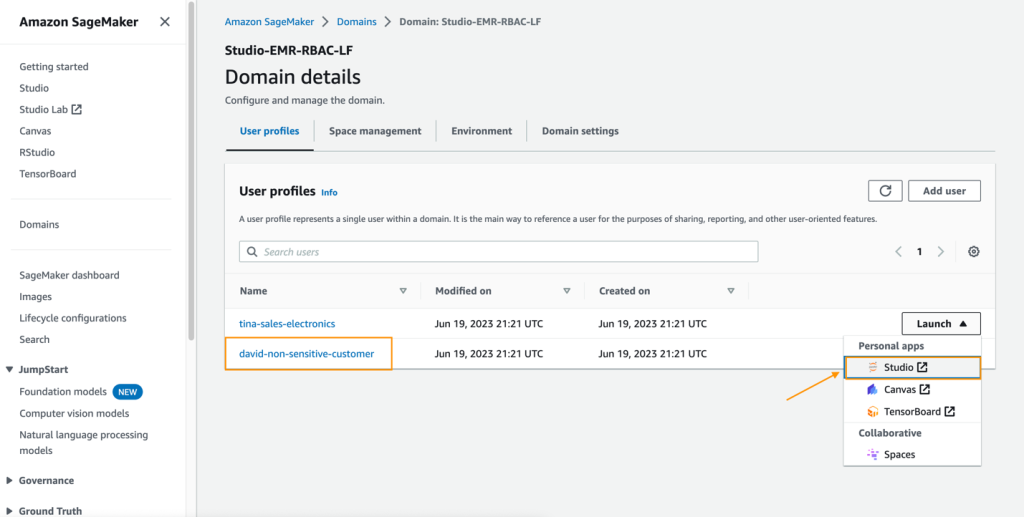

Metti alla prova il profilo utente di David

Per testare il tuo accesso ai dati con il profilo utente di David, completa i seguenti passaggi:

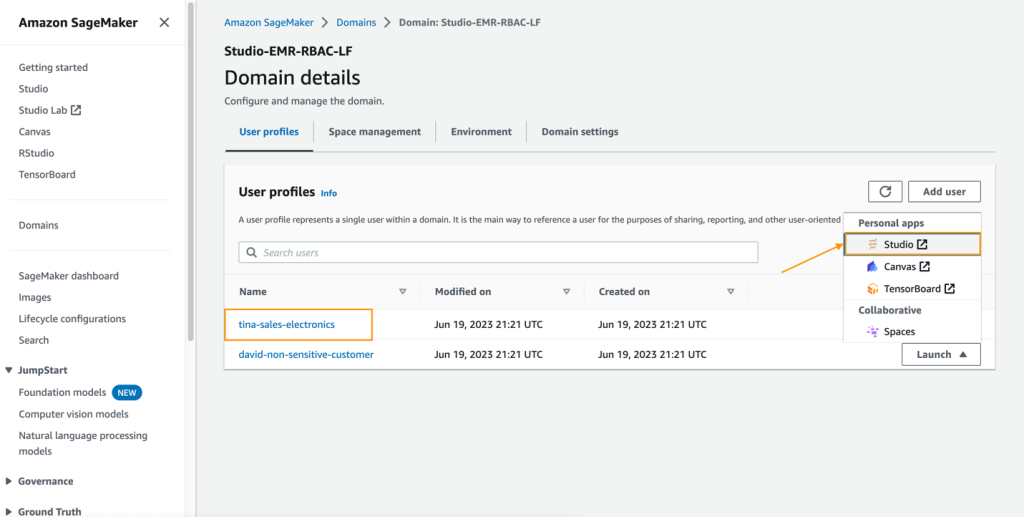

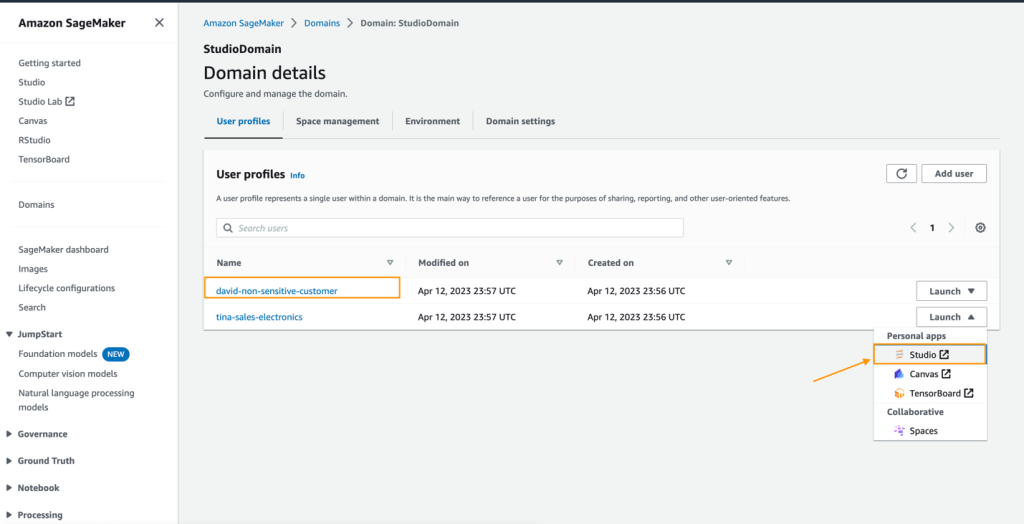

- Sulla console di SageMaker, scegli Domini nel pannello di navigazione.

- Dal dominio SageMaker Studio, avvia SageMaker Studio dal profilo utente david-non-sensitive-customer.

- Nel tuo ambiente SageMaker Studio, crea un file Gestore di dati di Amazon SageMaker fluire e scegliere Importa e prepara visivamente i dati.

In alternativa, sul Compila il menù, scegliere New, Quindi scegliere Flusso di Data Wrangler.

Discuteremo questi passaggi per creare un flusso di dati in dettaglio più avanti in questo post.

Metti alla prova il profilo utente di Tina

Il ruolo di esecuzione di SageMaker Studio di Tina le consente di accedere al database Lake Formation utilizzando due ruoli di esecuzione EMR. Ciò si ottiene elencando gli ARN del ruolo in un file di configurazione nella directory dei file di Tina. Questi ruoli possono essere impostati utilizzando Configurazioni del ciclo di vita di SageMaker Studio per rendere persistenti i ruoli tra i riavvii dell'app. Per testare l'accesso di Tina, completare i seguenti passaggi:

- Nella console SageMaker, vai al dominio SageMaker Studio.

- Avvia SageMaker Studio dal profilo utente

tina-sales-electronics.

È buona norma chiudere eventuali sessioni precedenti di SageMaker Studio sul browser quando si cambiano i profili utente. Può esserci una sola sessione utente SageMaker Studio attiva alla volta.

- Creare un flusso di dati di Data Wrangler.

Nelle sezioni seguenti, mostriamo la creazione di un flusso di dati all'interno di SageMaker Data Wrangler e la connessione ad Amazon EMR come origine dati. David e Tina avranno esperienze simili con la preparazione dei dati, ad eccezione delle autorizzazioni di accesso, quindi vedranno tabelle diverse.

Creare un flusso di dati SageMaker Data Wrangler

In questa sezione, trattiamo la connessione al cluster EMR esistente creato tramite il modello CloudFormation come origine dati in SageMaker Data Wrangler. A scopo dimostrativo, utilizziamo il profilo utente di David.

Per creare il tuo flusso di dati, completa i seguenti passaggi:

- Sulla console di SageMaker, scegli Domini nel pannello di navigazione.

- Scegli StudioDomain, che è stato creato eseguendo il modello CloudFormation.

- Seleziona un profilo utente (ad esempio, quello di David) e avvia SageMaker Studio.

- Scegli Apri Studio.

- In SageMaker Studio, crea un nuovo flusso di dati e scegli Importa e prepara visivamente i dati.

In alternativa, sul Compila il menù, scegliere New, Quindi scegliere Flusso di Data Wrangler.

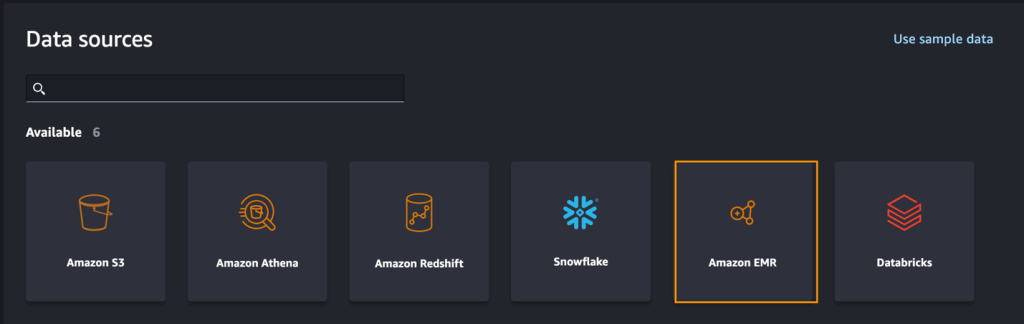

La creazione di un nuovo flusso può richiedere alcuni minuti. Dopo che il flusso è stato creato, vedrai il file Importa le date .

- Per aggiungere Amazon EMR come origine dati in SageMaker Data Wrangler, nel file Aggiungi origine dati menù, scegliere Amazon EMR.

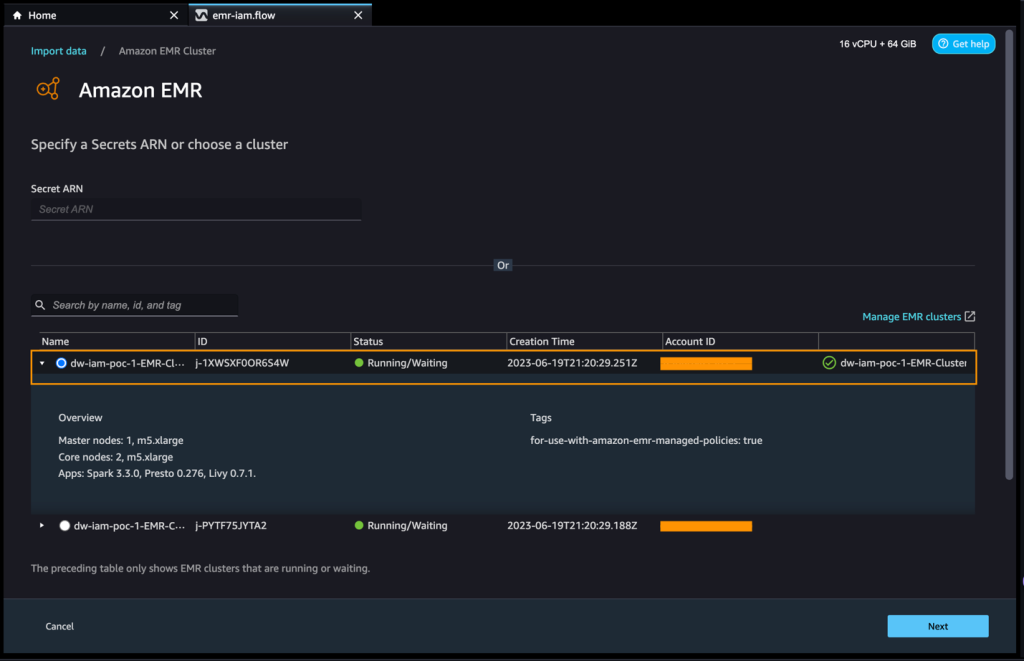

Puoi sfogliare tutti i cluster EMR per i quali il tuo ruolo di esecuzione SageMaker Studio è autorizzato a visualizzare. Hai due opzioni per connetterti a un cluster: una è tramite l'interfaccia utente interattiva e l'altra è la prima creare un segreto utilizzando AWS Secrets Manager con un URL JDBC, incluse le informazioni sul cluster EMR, quindi fornire l'ARN segreto AWS archiviato nell'interfaccia utente per connettersi a Presto o Hive. In questo post utilizziamo il primo metodo.

- Seleziona uno dei cluster che desideri utilizzare, quindi scegli Avanti.

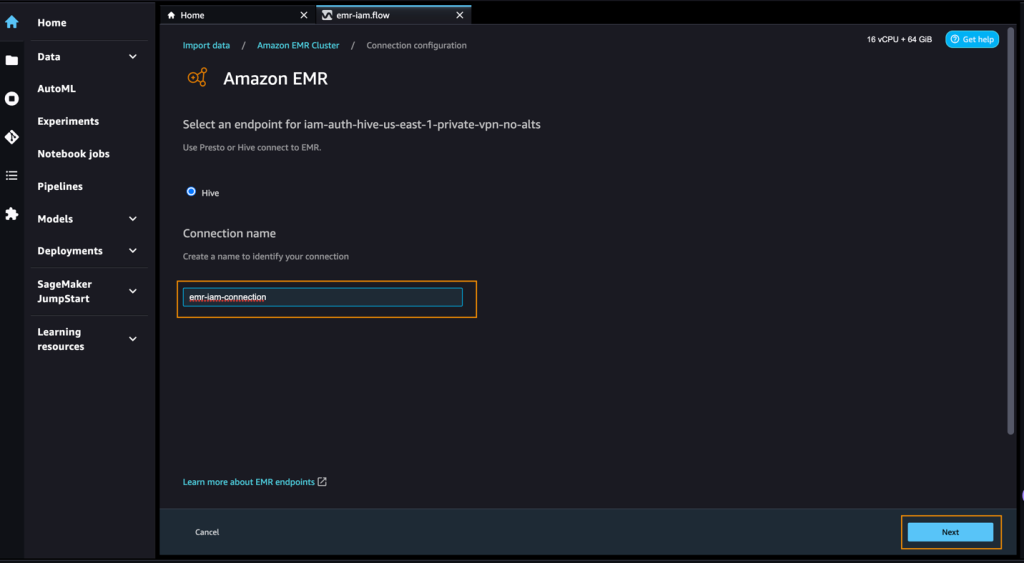

- Seleziona quale endpoint desideri utilizzare.

- Inserisci un nome per identificare la tua connessione, ad esempio

emr-iam-connection, Quindi scegliere Avanti.

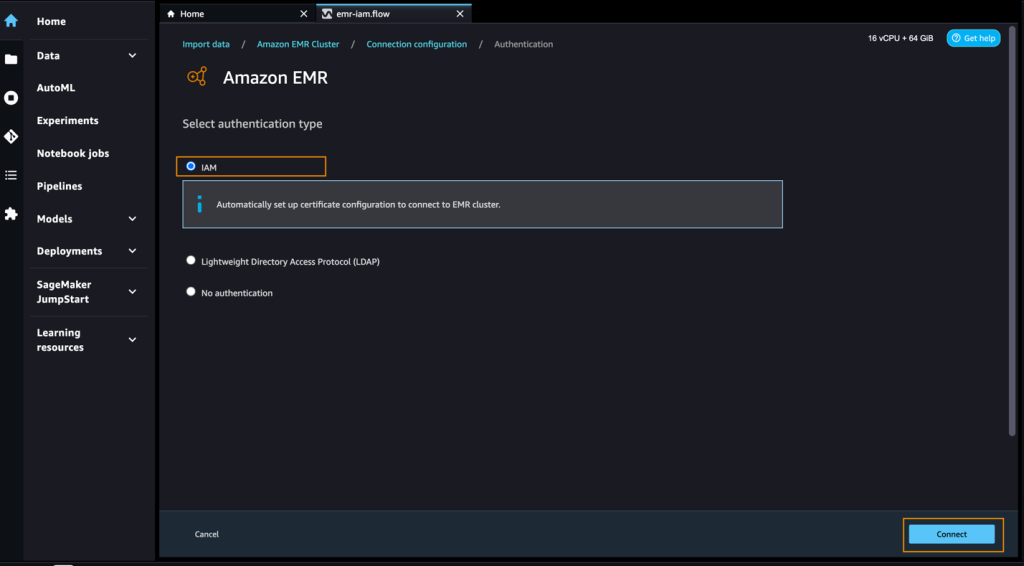

- Seleziona IAM come tipo di autenticazione e scegli Connettiti.

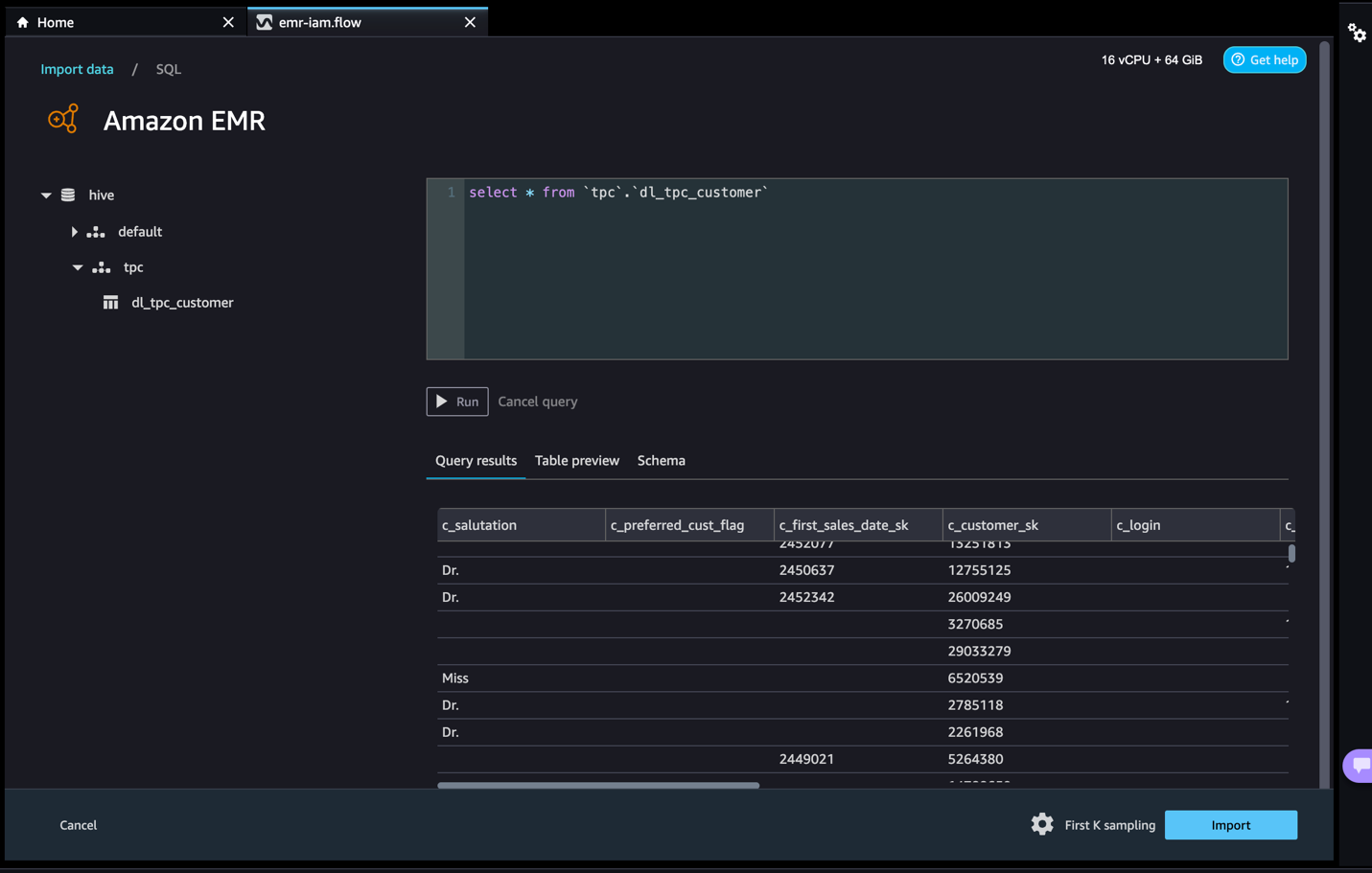

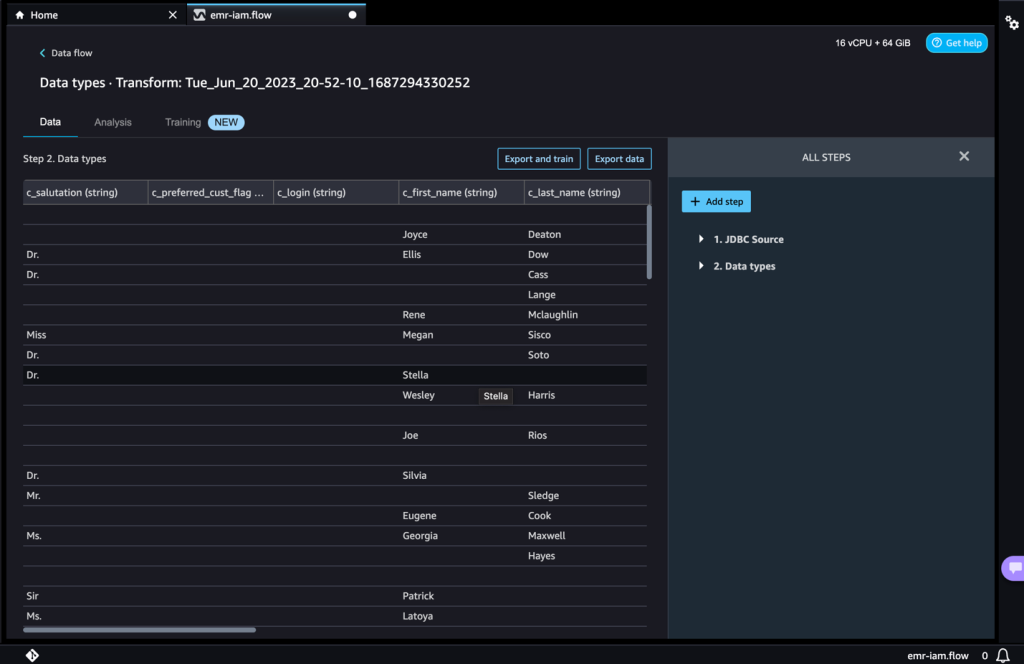

Quando sei connesso, puoi visualizzare in modo interattivo la struttura del database e l'anteprima o lo schema della tabella. Puoi anche eseguire query, esplorare e visualizzare i dati da Amazon EMR. Per un'anteprima, viene visualizzato un limite di 100 record per impostazione predefinita. Dopo aver fornito un'istruzione SQL nell'editor di query e scelto Correre, la query viene eseguita sul motore Amazon EMR Hive per visualizzare in anteprima i dati. Scegliere Annulla domanda per annullare le query in corso se impiegano un tempo insolitamente lungo.

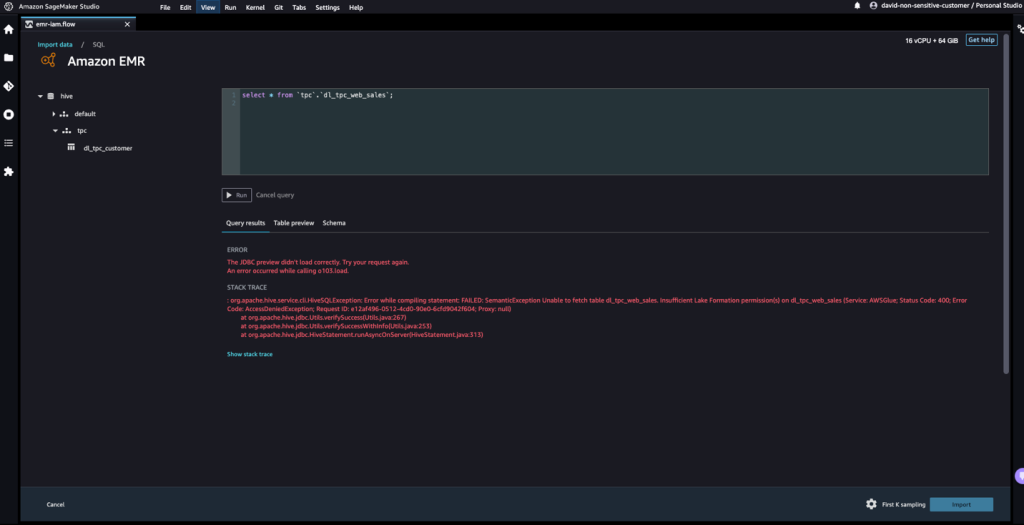

- Accediamo ai dati dalla tabella per la quale David non dispone delle autorizzazioni.

La query genererà il messaggio di errore “Unable to fetch table dl_tpc_web_sales. Insufficient Lake Formation permission(s) on dl_tpc_web_sales.”

L'ultimo passaggio consiste nell'importare i dati. Quando sei pronto con i dati interrogati, hai la possibilità di aggiornare le impostazioni di campionamento per la selezione dei dati in base al tipo di campionamento (FirstK, Casuale o Stratificato) e alla dimensione del campionamento per importare i dati in Data Wrangler.

- Scegli Importare per importare i dati.

Nella pagina successiva è possibile aggiungere varie trasformazioni e analisi essenziali al set di dati.

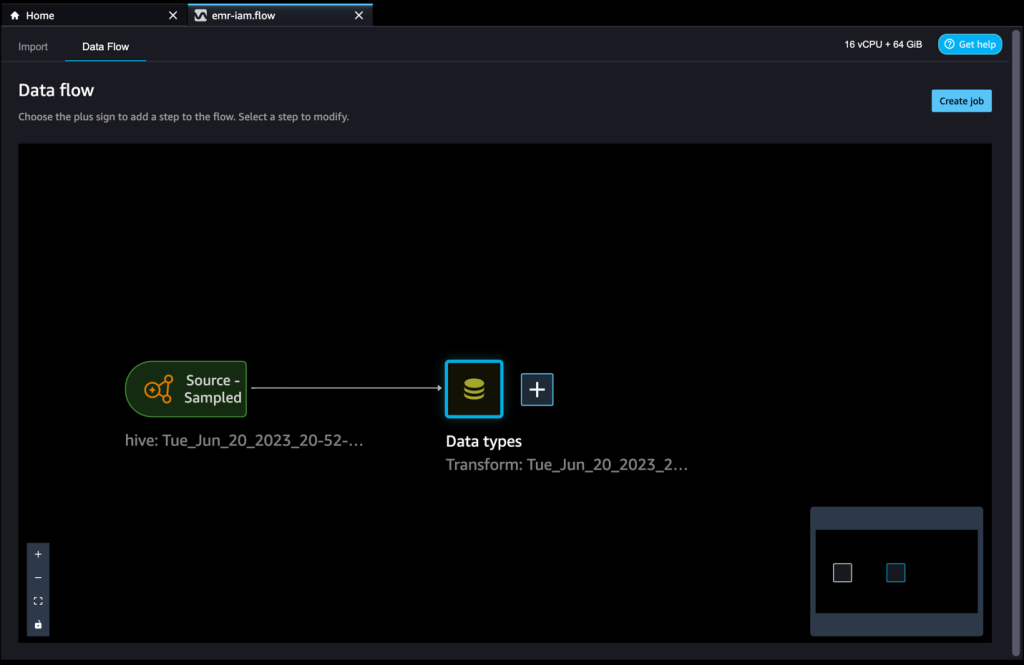

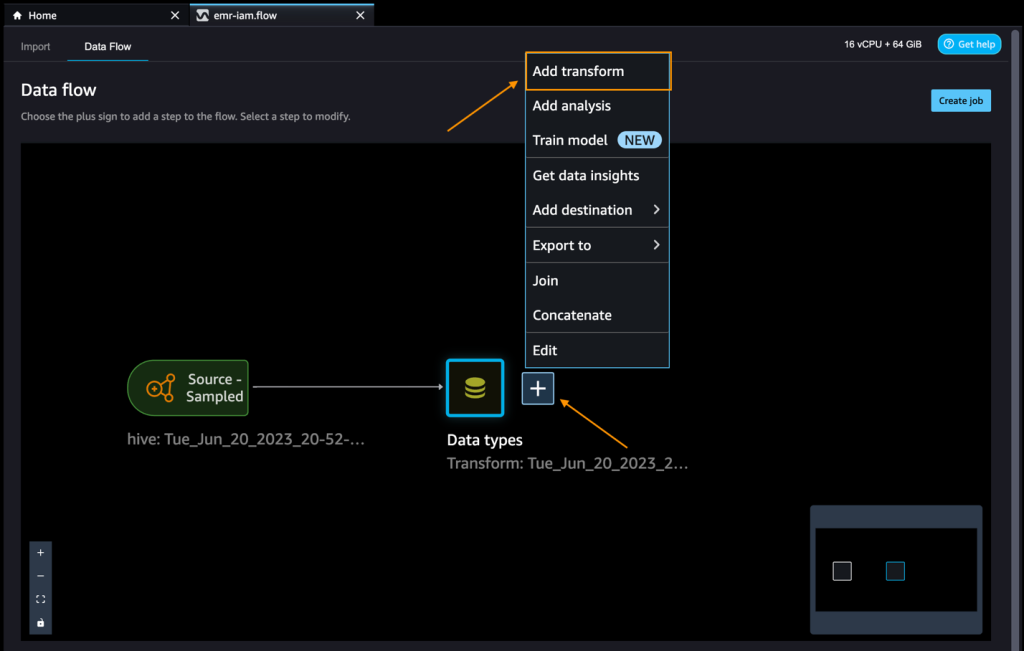

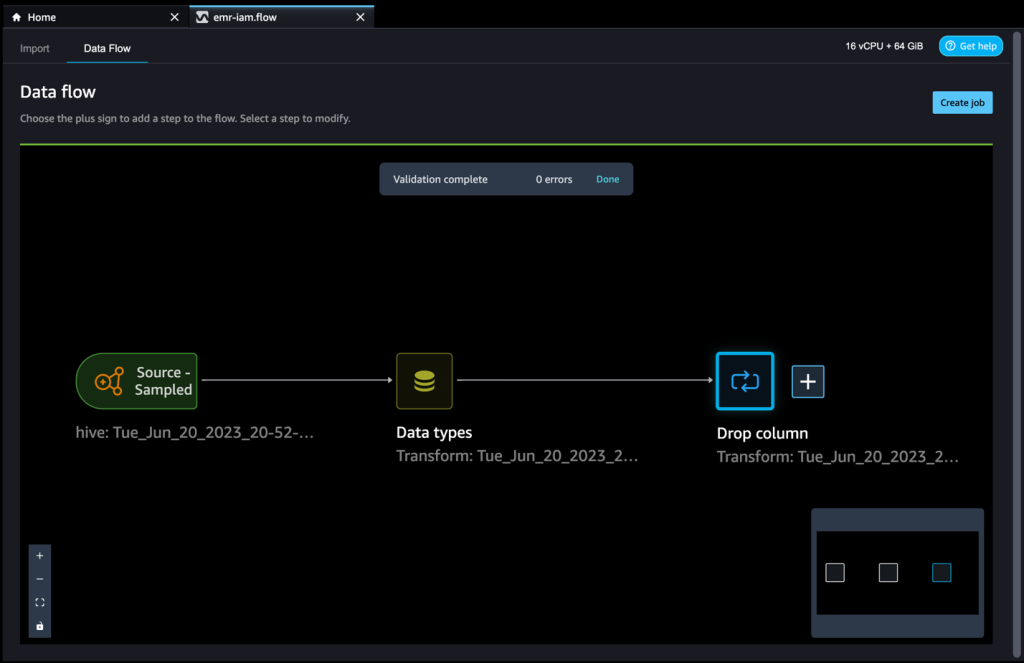

- Passare al flusso di dati e aggiungere ulteriori passaggi al flusso secondo necessità per trasformazioni e analisi.

Puoi eseguire un file rapporto di approfondimento dei dati per identificare i problemi di qualità dei dati e ottenere consigli per risolverli. Diamo un'occhiata ad alcuni esempi di trasformazioni.

- Nel Flusso di dati vista, dovresti vedere che stiamo utilizzando Amazon EMR come origine dati utilizzando il connettore Hive.

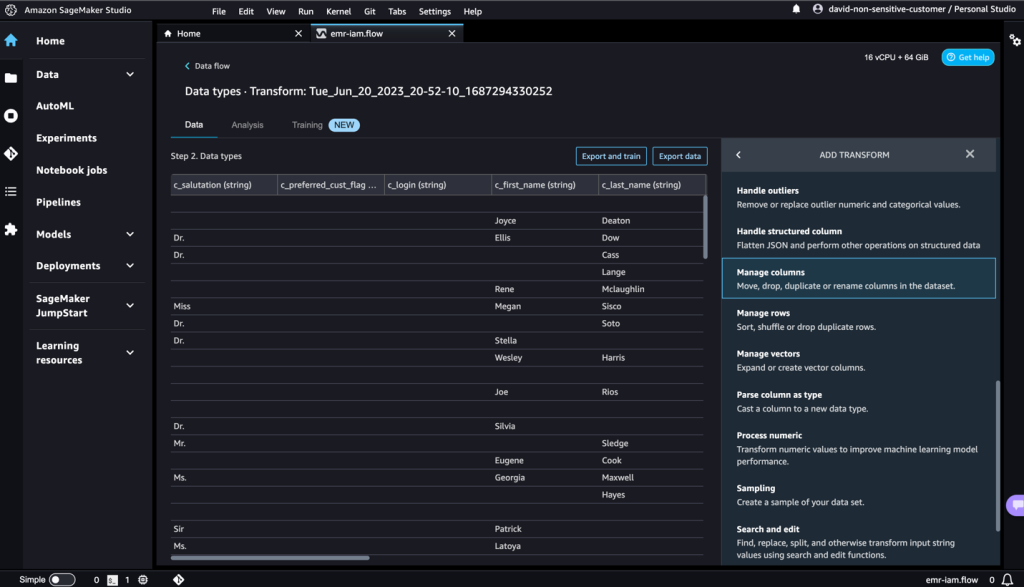

- Scegli il segno più accanto a Tipi di dati e scegli Aggiungi trasformazione.

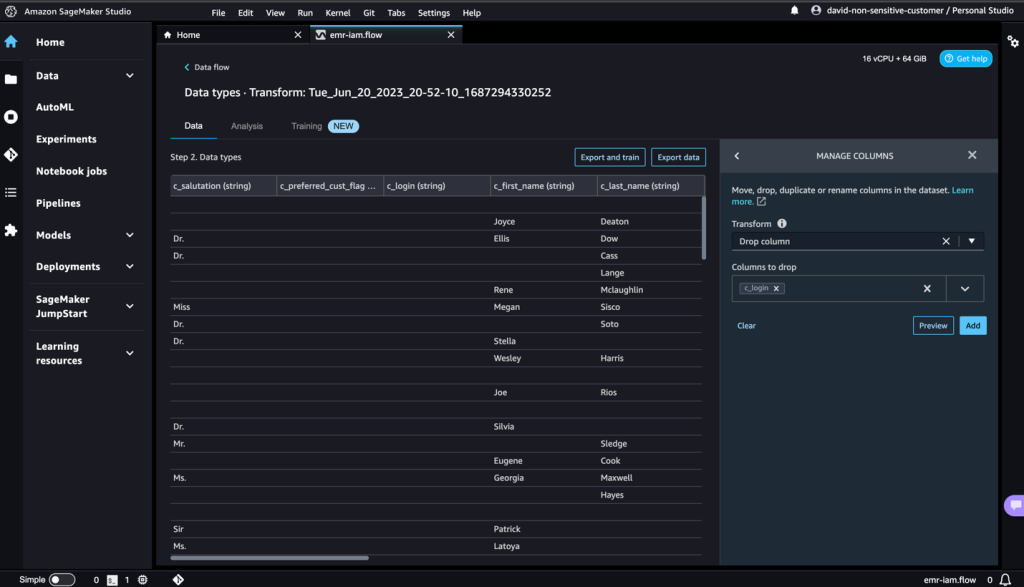

Esploriamo i dati e applichiamo una trasformazione. Ad esempio, il c_login la colonna è vuota e non aggiungerà valore come funzionalità. Eliminiamo la colonna.

- Nel Tutti i passaggi riquadro, scegli Aggiungi passaggio.

- Scegli Gestisci colonne.

- Nel Trasformarescegli Colonna di rilascio.

- Nel Colonne da eliminare, scegli il

c_logincolonna. - Scegli Anteprima, Quindi scegliere Aggiungi.

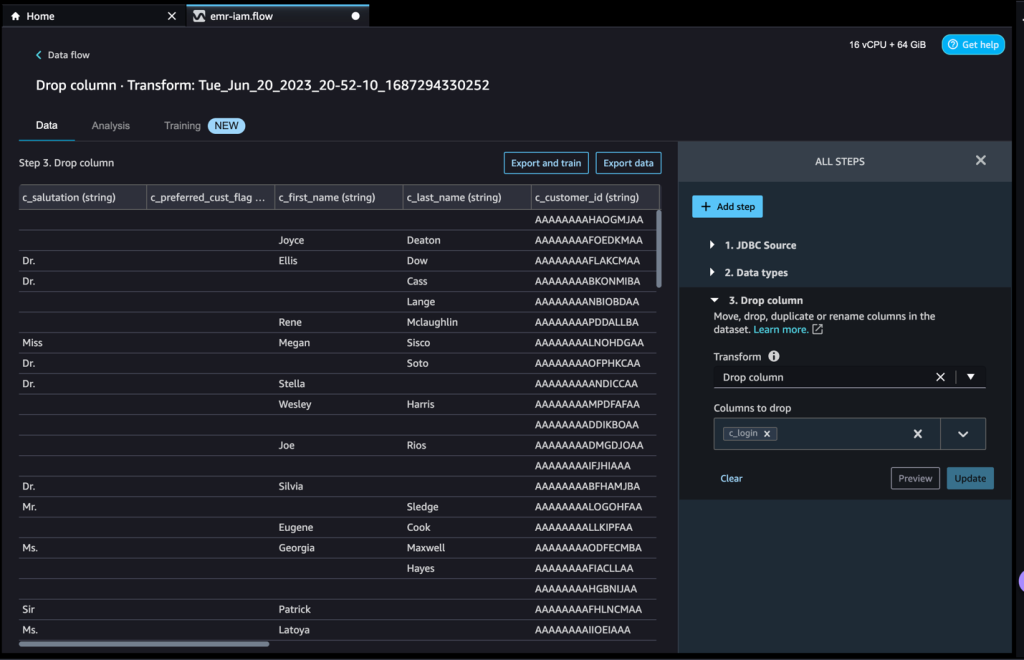

- Verificare il passaggio espandendo il file Colonna di rilascio .

Puoi continuare ad aggiungere passaggi in base alle diverse trasformazioni richieste per il tuo set di dati. Torniamo al nostro flusso di dati. Ora puoi vedere il Colonna di rilascio blocco che mostra la trasformazione che abbiamo eseguito.

I professionisti del machine learning dedicano molto tempo alla creazione del codice di ingegneria delle funzionalità, applicandolo ai set di dati iniziali, addestrando i modelli sui set di dati ingegnerizzati e valutando l'accuratezza del modello. Data la natura sperimentale di questo lavoro, anche il progetto più piccolo porterà a molteplici iterazioni. Lo stesso codice di progettazione delle funzionalità viene spesso eseguito più e più volte, sprecando tempo e risorse di calcolo nel ripetere le stesse operazioni. Nelle grandi organizzazioni, ciò può causare una perdita di produttività ancora maggiore perché team diversi spesso eseguono lavori identici o addirittura scrivono codici di progettazione delle funzionalità duplicati perché non sono a conoscenza del lavoro precedente. Per evitare la rielaborazione delle funzionalità, possiamo esportare le nostre funzionalità trasformate in Negozio di funzionalità Amazon SageMaker. Per ulteriori informazioni, fare riferimento a Novità: archivia, scopri e condividi funzionalità di machine learning con Amazon SageMaker Feature Store.

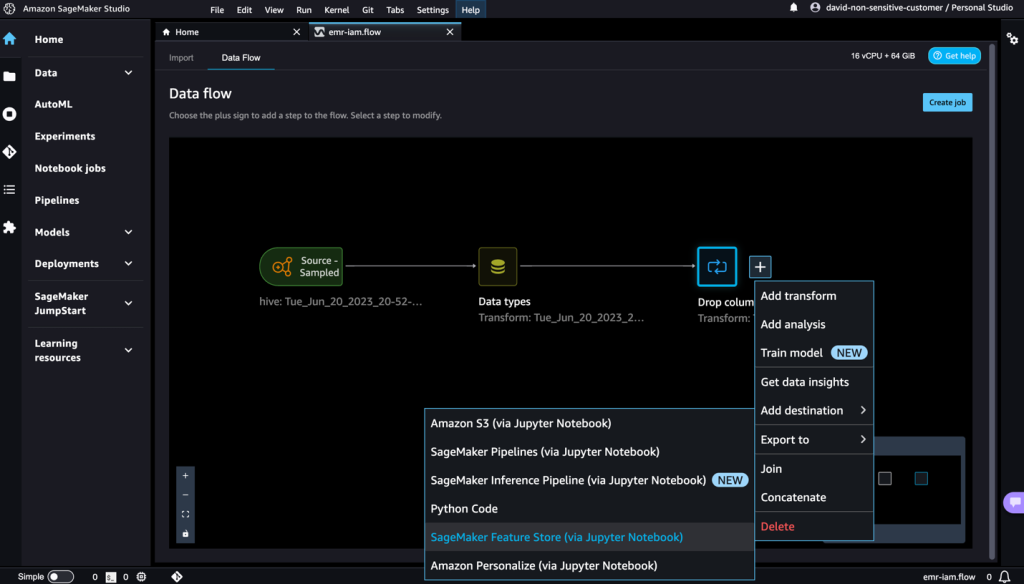

- Scegli il segno più accanto a Colonna di rilascio.

- Scegli Esporta a ed Negozio di funzionalità SageMaker (tramite notebook Jupyter).

Puoi esportare facilmente le funzionalità generate in SageMaker Feature Store specificandolo come destinazione. È possibile salvare le funzionalità in un gruppo di funzionalità esistente o crearne uno nuovo. Per ulteriori informazioni, fare riferimento a Crea e archivia facilmente funzionalità in Amazon SageMaker senza codice.

Ora abbiamo creato funzionalità con SageMaker Data Wrangler e le abbiamo archiviate in SageMaker Feature Store. Abbiamo mostrato un flusso di lavoro di esempio per l'ingegneria delle funzionalità nell'interfaccia utente di SageMaker Data Wrangler.

ripulire

Se il tuo lavoro con SageMaker Data Wrangler è completo, elimina le risorse che hai creato per evitare di incorrere in costi aggiuntivi.

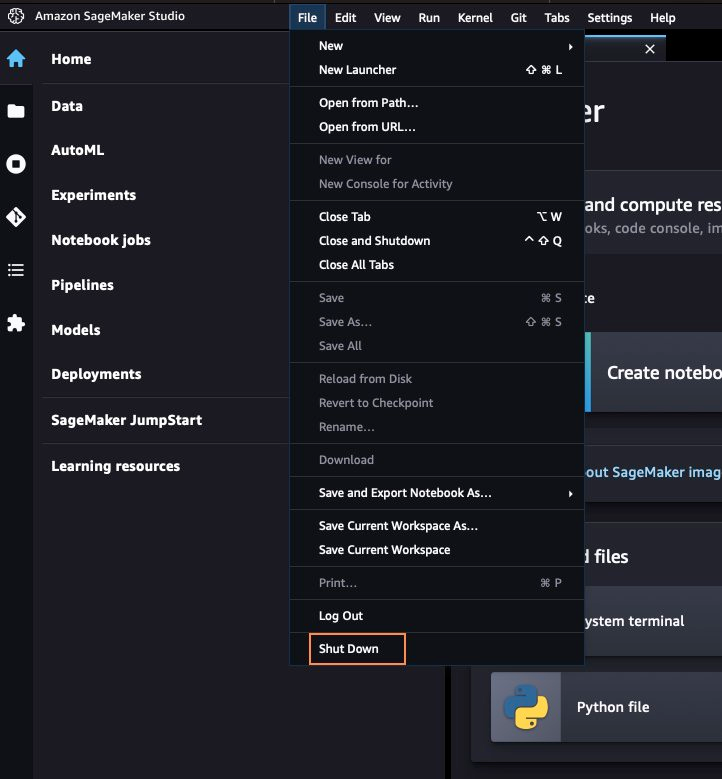

- In SageMaker Studio, chiudi tutte le schede, quindi sul file Compila il menù, scegliere fermare.

- Quando richiesto, scegliere Chiudi tutto.

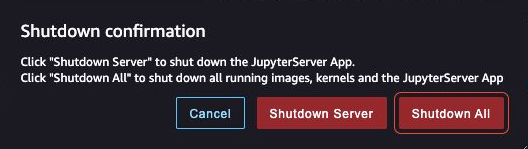

L'arresto potrebbe richiedere alcuni minuti in base al tipo di istanza. Assicurati che tutte le app associate a ciascun profilo utente siano state eliminate. Se non sono stati eliminati, elimina manualmente l'app associata a ciascun profilo utente creato utilizzando il modello CloudFormation.

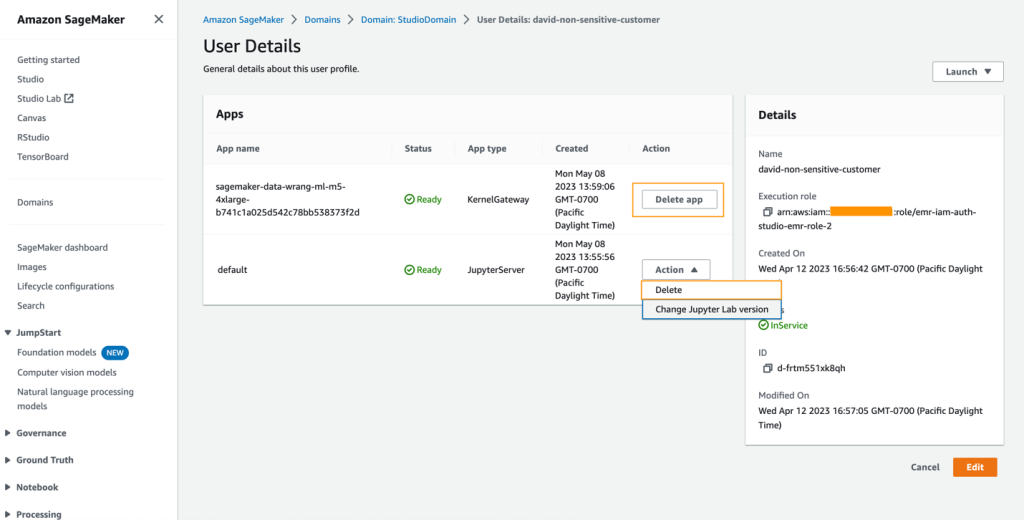

- Nella console Amazon S3, svuota tutti i bucket S3 creati dal modello CloudFormation durante il provisioning dei cluster.

I bucket devono avere lo stesso prefisso del nome dello stack di lancio di CloudFormation e cf-templates-.

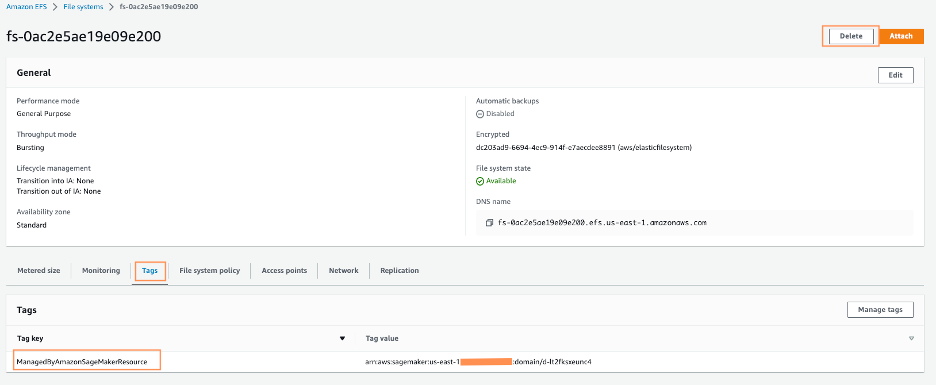

- Nella console Amazon EFS, elimina il file system SageMaker Studio.

Puoi confermare di avere il file system corretto scegliendo l'ID del file system e confermando il tag ManagedByAmazonSageMakerResource sul canale tag scheda.

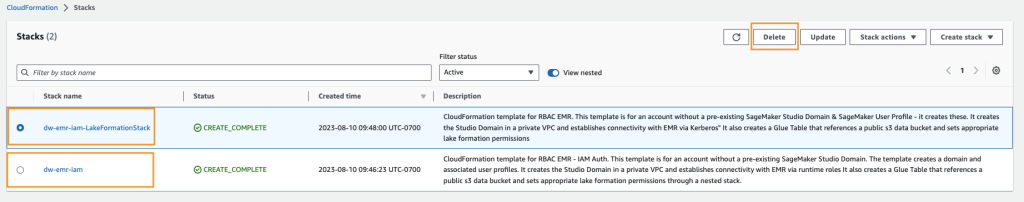

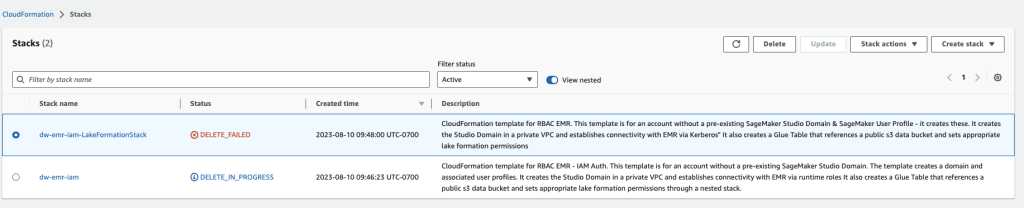

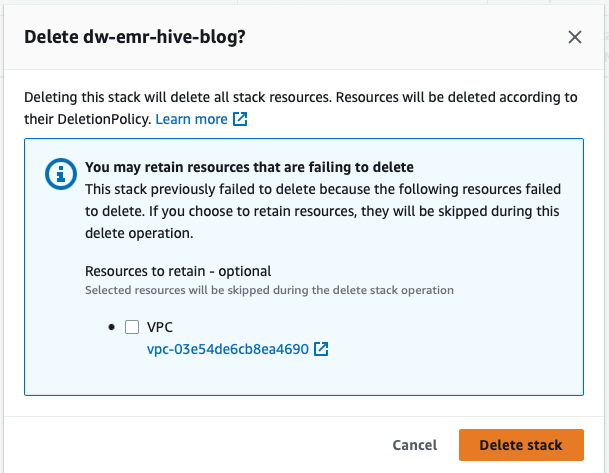

- Nella console AWS CloudFormation, seleziona lo stack che hai creato e scegli Elimina.

Riceverai un messaggio di errore, come previsto. Torneremo su questo e lo ripuliremo nei passaggi successivi.

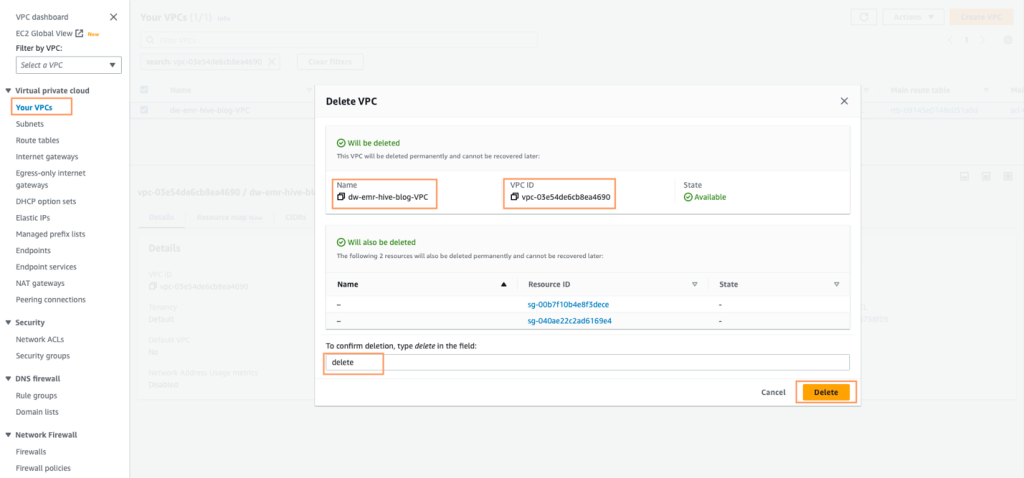

- Identificare il VPC creato dallo stack CloudFormation, denominato dw-emr-e segui le istruzioni per eliminare il VPC.

- Torna alla console AWS CloudFormation e riprova l'eliminazione dello stack per dw-emr-.

Tutte le risorse fornite dal modello CloudFormation descritto in questo post sono state ora rimosse dal tuo account.

Conclusione

In questo post, abbiamo esaminato come applicare il controllo degli accessi granulare con Lake Formation e accedere ai dati utilizzando Amazon EMR come origine dati in SageMaker Data Wrangler, come trasformare e analizzare un set di dati e come esportare i risultati in un flusso di dati da utilizzare in un notebook Jupyter. Dopo aver visualizzato il nostro set di dati utilizzando le funzionalità analitiche integrate di SageMaker Data Wrangler, abbiamo ulteriormente migliorato il nostro flusso di dati. Il fatto che abbiamo creato una pipeline di preparazione dei dati senza scrivere una sola riga di codice è significativo.

Per iniziare con SageMaker Data Wrangler, fare riferimento a Prepara i dati ML con Amazon SageMaker Data Wrangler.

Informazioni sugli autori

Ajjay Govindaram è Senior Solutions Architect presso AWS. Lavora con clienti strategici che utilizzano AI/ML per risolvere problemi aziendali complessi. La sua esperienza risiede nel fornire indicazioni tecniche e assistenza alla progettazione per distribuzioni di applicazioni AI/ML da modeste a grandi dimensioni. Le sue conoscenze spaziano dall'architettura delle applicazioni ai big data, all'analisi e all'apprendimento automatico. Gli piace ascoltare la musica mentre riposa, vivere la vita all'aria aperta e passare il tempo con i suoi cari.

Ajjay Govindaram è Senior Solutions Architect presso AWS. Lavora con clienti strategici che utilizzano AI/ML per risolvere problemi aziendali complessi. La sua esperienza risiede nel fornire indicazioni tecniche e assistenza alla progettazione per distribuzioni di applicazioni AI/ML da modeste a grandi dimensioni. Le sue conoscenze spaziano dall'architettura delle applicazioni ai big data, all'analisi e all'apprendimento automatico. Gli piace ascoltare la musica mentre riposa, vivere la vita all'aria aperta e passare il tempo con i suoi cari.

Isha Dua è un Senior Solutions Architect con sede nella San Francisco Bay Area. Aiuta i clienti aziendali di AWS a crescere comprendendo i loro obiettivi e le loro sfide e li guida su come possono progettare le loro applicazioni in modo cloud-native, garantendo al tempo stesso resilienza e scalabilità. È appassionata di tecnologie di machine learning e sostenibilità ambientale.

Isha Dua è un Senior Solutions Architect con sede nella San Francisco Bay Area. Aiuta i clienti aziendali di AWS a crescere comprendendo i loro obiettivi e le loro sfide e li guida su come possono progettare le loro applicazioni in modo cloud-native, garantendo al tempo stesso resilienza e scalabilità. È appassionata di tecnologie di machine learning e sostenibilità ambientale.

Parte Patel è Senior Solutions Architect presso AWS nella zona della Baia di San Francisco. Parth guida i clienti aziendali ad accelerare il loro percorso verso il cloud e li aiuta ad adottare e crescere con successo sul cloud AWS. È appassionato di tecnologie di machine learning, sostenibilità ambientale e modernizzazione delle applicazioni.

Parte Patel è Senior Solutions Architect presso AWS nella zona della Baia di San Francisco. Parth guida i clienti aziendali ad accelerare il loro percorso verso il cloud e li aiuta ad adottare e crescere con successo sul cloud AWS. È appassionato di tecnologie di machine learning, sostenibilità ambientale e modernizzazione delle applicazioni.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Automobilistico/VE, Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- Platone Salute. Intelligence sulle biotecnologie e sulle sperimentazioni cliniche. Accedi qui.

- Grafico Prime. Migliora il tuo gioco di trading con ChartPrime. Accedi qui.

- BlockOffset. Modernizzare la proprietà della compensazione ambientale. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/apply-fine-grained-data-access-controls-with-aws-lake-formation-in-amazon-sagemaker-data-wrangler/

- :ha

- :È

- :non

- :Dove

- $ SU

- 10

- 100

- 11

- 12

- 13

- 14

- 15%

- 16

- 20

- 202

- 22

- 7

- 8

- 9

- a

- capacità

- capace

- WRI

- accelerare

- accesso

- Accedendo

- Secondo

- Il mio account

- conti

- precisione

- raggiunto

- operanti in

- attivo

- Ad

- aggiungere

- l'aggiunta di

- aggiuntivo

- Admin

- adottare

- Dopo shavasana, sedersi in silenzio; saluti;

- ancora

- AI / ML

- Tutti

- consentire

- consente

- anche

- Amazon

- Amazon EMR

- Amazon Sage Maker

- Gestore di dati di Amazon SageMaker

- Amazon Web Services

- an

- .

- Analitico

- analitica

- analizzare

- ed

- Annunciare

- in qualsiasi

- App

- Applicazioni

- applicazioni

- APPLICA

- AMMISSIONE

- approccio

- applicazioni

- architettonico

- architettura

- SONO

- RISERVATA

- AS

- Assistenza

- associato

- assumere

- At

- Autenticazione

- autorità

- disponibile

- evitare

- AWS

- AWS CloudFormazione

- Formazione AWS Lake

- precedente

- basato

- Baia

- BE

- perché

- stato

- essendo

- Big

- Big Data

- Scatola

- del browser

- Costruzione

- incassato

- affari

- by

- CA

- Materiale

- funzionalità

- capacità

- Custodie

- Causare

- centrale

- centralizzata

- a livello internazionale

- certificato

- Certificazione

- sfide

- Modifiche

- dai un'occhiata

- Scegli

- la scelta

- Chiudi

- Cloud

- Cluster

- codice

- raccogliere

- Colonna

- Venire

- Uncommon

- completamento di una

- complesso

- componenti

- Calcolare

- concetto

- Configurazione

- Confermare

- Connettiti

- collegato

- Collegamento

- veloce

- Connessioni

- Prendere in considerazione

- consolle

- continua

- di controllo

- controlli

- correggere

- Corrispondente

- potuto

- coprire

- creare

- creato

- Creazione

- curva

- cliente

- dati dei clienti

- Clienti

- dati

- l'accesso ai dati

- Lago di dati

- Preparazione dei dati

- scienza dei dati

- scienziato di dati

- Banca Dati

- dataset

- David

- Predefinito

- definizione

- Dati Demografici

- dimostrare

- schierare

- distribuzione

- deployment

- implementazioni

- Distribuisce

- descritta

- Design

- destinazione

- dettaglio

- dettagli

- diverso

- direzione

- scopri

- discutere

- distribuito

- non

- dominio

- ogni

- facilmente

- est

- editore

- enable

- abilitato

- Abilita

- crittografia

- da un capo all'altro

- endpoint

- motore

- Ingegneria

- migliorata

- assicurando

- entrare

- Impresa

- Ambiente

- ambientale

- Sostenibilità Ambientale

- errore

- essential

- la valutazione

- Anche

- esempio

- Tranne

- esecuzione

- Esercitare

- esistente

- espansione

- previsto

- esperienza

- Esperienze

- sperimentare

- sperimentale

- esplorazione

- esplora

- export

- esterno

- estratto

- facilitare

- fatto

- FAST

- caratteristica

- Caratteristiche

- Costi

- pochi

- Compila il

- finire

- Nome

- Fissare

- flusso

- seguire

- i seguenti

- segue

- Nel

- Previsione

- formazione

- Francisco

- frequentemente

- da

- ulteriormente

- generare

- generato

- ottenere

- dato

- Dare

- Go

- Obiettivi

- buono

- la governance

- concedere

- maggiore

- Gruppo

- Gruppo

- Crescere

- Guide

- contento

- Avere

- he

- Aiuto

- aiutare

- aiuta

- suo

- il suo

- Alveare

- case

- Come

- Tutorial

- Tuttavia

- HTML

- http

- HTTPS

- ID

- identico

- identificare

- Identità

- Idle

- if

- illustra

- realizzare

- implementato

- importare

- importazione

- in

- includere

- inclusi

- Compreso

- informazioni

- Infrastruttura

- inizialmente

- Innovazione

- intuizione

- esempio

- istruzioni

- intendono

- interattivo

- Interfaccia

- interno

- ai miglioramenti

- inventario

- problema

- sicurezza

- IT

- iterazioni

- Offerte di lavoro

- viaggio

- jpg

- tenere

- Le

- Tasti

- conoscenze

- lago

- grandi

- larga scala

- Cognome

- dopo

- lanciare

- lancio

- portare

- apprendimento

- si trova

- ciclo di vita

- probabile

- LIMITE

- linea

- Ascolto

- annuncio

- caricare

- Lunghi

- a lungo

- Guarda

- spento

- lotto

- amato

- macchina

- machine learning

- make

- gestire

- gestito

- gestione

- gestisce

- gestione

- modo

- manualmente

- Marketing

- Menu

- messaggio

- metodo

- forza

- Minuti

- ML

- modello

- modelli

- modesto

- Scopri di più

- multiplo

- Musica

- devono obbligatoriamente:

- Nome

- Detto

- Natura

- Navigare

- Navigazione

- necessaria

- Bisogno

- di applicazione

- esigenze

- New

- GENERAZIONE

- no

- taccuino

- adesso

- ottenuto

- of

- di frequente

- on

- ONE

- quelli

- in corso

- esclusivamente

- Operazioni

- Opzione

- Opzioni

- or

- minimo

- organizzazioni

- Altro

- nostro

- all'aperto

- ancora

- pagina

- vetro

- particolare

- appassionato

- pagamento

- Eseguire

- eseguita

- permessi

- conduttura

- posto

- Platone

- Platone Data Intelligence

- PlatoneDati

- più

- politica

- popolata

- Post

- potenziale

- energia

- pratica

- preparazione

- Preparare

- prerequisiti

- presents

- Anteprima

- precedente

- Precedente

- un bagno

- informazioni riservate

- chiave privata

- problemi

- procedura

- processi

- i processi

- lavorazione

- Prodotto

- Produzione

- della produttività

- Prodotti

- Scelto dai professionisti

- Profilo

- Profili

- progetto

- Promozioni

- prova

- prova del concetto

- fornire

- purché

- fornitura

- fini

- metti

- qualità

- query

- casuale

- Crudo

- pronto

- ricevere

- raccomandazioni

- raccomandato

- record

- riduce

- regione

- rilasciare

- ricorda

- rimosso

- ripetuto

- rappresenta

- necessario

- elasticità

- Risorse

- riposo

- restrizione

- colpevole

- Risultati

- recensioni

- diritti

- Rischio

- Ruolo

- ruoli

- rsa

- Correre

- running

- s

- sagemaker

- vendite

- stesso

- Set di dati di esempio

- San

- San Francisco

- Risparmi

- Scalabilità

- Scala

- Scienze

- Scienziato

- scienziati

- Segreto

- Sezione

- sezioni

- fissaggio

- problemi di

- vedere

- segmentazione

- prodotti

- anziano

- Servizi

- Sessione

- sessioni

- set

- impostazioni

- flessibile.

- Condividi

- lei

- dovrebbero

- mostrare attraverso le sue creazioni

- vetrina

- ha mostrato

- segno

- significativa

- simile

- Un'espansione

- semplificare

- singolo

- Taglia

- So

- soluzione

- Soluzioni

- RISOLVERE

- alcuni

- Fonte

- specifico

- spendere

- Spendere

- pila

- Stage

- iniziato

- dichiarazione

- Stato dei servizi

- step

- Passi

- conservazione

- Tornare al suo account

- memorizzati

- lineare

- Strategico

- snellire

- studio

- soggetto

- sottoreti

- successivo

- Con successo

- tale

- supportato

- supporti

- sicuro

- Sostenibilità

- sistema

- SISTEMI DI TRATTAMENTO

- tavolo

- TAG

- Fai

- prende

- presa

- team

- le squadre

- Consulenza

- Tecnologie

- modello

- terminal

- test

- Testing

- che

- Il

- loro

- Li

- poi

- Là.

- perciò

- Strumenti Bowman per analizzare le seguenti finiture:

- di

- questo

- quelli

- Attraverso

- tempo

- a

- Training

- delle transazioni

- Trasformare

- Trasformazione

- trasformazioni

- trasformato

- trasforma

- transito

- albero

- Affidati ad

- di fiducia

- seconda

- Digitare

- ui

- per

- e una comprensione reciproca

- fino a quando

- Aggiornanento

- aggiornamento

- caricato

- URL

- us

- uso

- caso d'uso

- utilizzato

- Utente

- utenti

- utilizzando

- generalmente

- APPREZZIAMO

- vario

- verificare

- versione

- via

- Visualizza

- Virginia

- visualizzazione

- volere

- ricercato

- Prima

- we

- sito web

- servizi web

- Settimane

- WELL

- è andato

- sono stati

- quando

- quale

- while

- OMS

- volere

- con

- entro

- senza

- Lavora

- flusso di lavoro

- lavori

- scrivere

- scrittura

- Tu

- Trasferimento da aeroporto a Sharm

- zefiro

- Codice postale