Questo post è stato scritto in collaborazione con Ming (Melvin) Qin, David Bericat e Brad Genereaux di NVIDIA.

I ricercatori e gli sviluppatori di intelligenza artificiale per imaging medico necessitano di un framework aziendale scalabile per creare, distribuire e integrare le loro applicazioni di intelligenza artificiale. AWS e NVIDIA si sono uniti per trasformare questa visione in realtà. AWS, NVIDIA e altri partner creare applicazioni e soluzioni per rendere l'assistenza sanitaria più accessibile, conveniente ed efficiente accelerando la connettività cloud dell'imaging aziendale. MONAI Distribuzione è uno dei moduli chiave all'interno MONAI (Medical Open Network for Artificial Intelligence) sviluppato da un consorzio di leader accademici e di settore, tra cui NVIDIA. AWS Health Imaging (AHI) è un archivio di immagini mediche idoneo all'HIPAA, altamente scalabile, performante ed economico. Abbiamo sviluppato un connettore MONAI Deploy per AHI per integrare applicazioni AI di imaging medico con latenze di recupero delle immagini inferiori al secondo su larga scala, basate su API native del cloud. È possibile ospitare i modelli e le applicazioni AI MONAI Amazon Sage Maker, che è un servizio completamente gestito per distribuire modelli di machine learning (ML) su larga scala. SageMaker si occupa della configurazione e della gestione delle istanze per l'inferenza e fornisce parametri e log integrati per gli endpoint che puoi utilizzare per monitorare e ricevere avvisi. Offre anche una varietà di Istanze GPU NVIDIA per l'inferenza ML, nonché più opzioni di distribuzione del modello con ridimensionamento automatico, tra cui inferenza in tempo reale, inferenza senza server, inferenza asincronae trasformazione batch.

In questo post, dimostriamo come distribuire un MONAI Application Package (MAP) con il connettore ad AWS HealthImaging, utilizzando un endpoint multimodello SageMaker per l'inferenza in tempo reale e l'inferenza asincrona. Queste due opzioni coprono la maggior parte dei casi d'uso della pipeline di inferenza di imaging medico quasi in tempo reale.

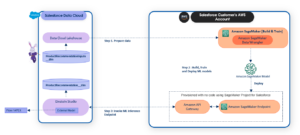

Panoramica della soluzione

Il diagramma seguente illustra l'architettura della soluzione.

Prerequisiti

Completa i seguenti passaggi prerequisiti:

- Utilizza un account AWS con una delle seguenti regioni in cui AWS HealthImaging è disponibile: Virginia settentrionale (

us-east-1), Oregon (us-west-2), Irlanda (eu-west-1) e Sydney (ap-southeast-2). - Creare un Amazon Sage Maker Studio dominio e profilo utente con Gestione dell'identità e dell'accesso di AWS (IAM) autorizzazione per accedere ad AWS HealthImaging.

- Abilita l'estensione JupyterLab v3 e installa l'estensione Imjoy-jupyter se desideri visualizzare le immagini mediche sul notebook SageMaker in modo interattivo utilizzando itkwidgets.

Connettore MAP per AWS HealthImaging

AWS HealthImaging importa file DICOM P10 e li converte in ImageSet, che sono una rappresentazione ottimizzata di una serie DICOM. AHI fornisce l'accesso API ai metadati ImageSet e agli ImageFrames. I metadati contengono tutti gli attributi DICOM in un documento JSON. Gli ImageFrames vengono restituiti codificati nel file JPEG2000 ad alta produttività (HTJ2K) formato senza perdita di dati, che può essere decodificato estremamente velocemente. Gli ImageSet possono essere recuperati utilizzando il file Interfaccia della riga di comando di AWS (AWS CLI) o SDK AWS.

MONAI è un framework di intelligenza artificiale per imaging medico che porta le scoperte della ricerca e le applicazioni dell'intelligenza artificiale nell'impatto clinico. MONAI Deploy è la pipeline di elaborazione che abilita il flusso di lavoro end-to-end, inclusi il confezionamento, il test, la distribuzione e l'esecuzione di applicazioni AI di imaging medico nella produzione clinica. Comprende il MONAI Distribuire l'SDK dell'app, MONAI Distribuisci Express, Responsabile del flusso di lavoroe Portale informatico. L'SDK dell'app MONAI Deploy fornisce algoritmi pronti all'uso e un framework per accelerare la creazione di applicazioni AI di imaging medico, nonché strumenti di utilità per confezionare l'applicazione in un contenitore MAP. Le funzionalità basate su standard integrate nell'SDK dell'app consentono al MAP di integrarsi facilmente nelle reti IT sanitarie, che richiedono l'uso di standard come DICOM, HL7 e FHIR, e nei data center e negli ambienti cloud. Le MAP possono utilizzare operatori sia predefiniti che personalizzati per il caricamento delle immagini DICOM, la selezione delle serie, l'inferenza del modello e la postelaborazione

Abbiamo sviluppato a Modulo Python utilizzando l'SDK Boto3 di AWS HealthImaging Python. Puoi installarlo tramite pip e utilizzare la funzione di supporto per recuperare le istanze SOP (Service-Object Pair) DICOM come segue:

!pip install -q AHItoDICOMInterface

from AHItoDICOMInterface.AHItoDICOM import AHItoDICOM

helper = AHItoDICOM()

instances = helper.DICOMizeImageSet(datastore_id=datastoreId , image_set_id=next(iter(imageSetIds)))Le istanze SOP di output possono essere visualizzate utilizzando il visualizzatore di immagini mediche 3D interattivo itkwidgets di seguito taccuino. AHItoDICOM la classe sfrutta più processi per recuperare fotogrammi di pixel da AWS HealthImaging in parallelo e decodificare , il BLOB binari HTJ2K usando il Libreria Python OpenJPEG. Gli ImageSetId provengono dai file di output di un determinato processo di importazione AWS HealthImaging. Dati DatastoreId e import JobId, puoi recuperare ImageSetId, che equivale all'UID dell'istanza della serie DICOM, come segue:

imageSetIds = {}

try: response = s3.head_object(Bucket=OutputBucketName, Key=f"output/{res_createstore['datastoreId']}-DicomImport-{res_startimportjob['jobId']}/job-output-manifest.json") if response['ResponseMetadata']['HTTPStatusCode'] == 200: data = s3.get_object(Bucket=OutputBucketName, Key=f"output/{res_createstore['datastoreId']}-DicomImport-{res_startimportjob['jobId']}/SUCCESS/success.ndjson") contents = data['Body'].read().decode("utf-8") for l in contents.splitlines(): isid = json.loads(l)['importResponse']['imageSetId'] if isid in imageSetIds: imageSetIds[isid]+=1 else: imageSetIds[isid]=1

except ClientError: passCon ImageSetId, puoi recuperare i metadati dell'intestazione DICOM e i pixel dell'immagine separatamente utilizzando le funzioni API native di AWS HealthImaging. IL Aggregati esportatori DICOM le intestazioni DICOM e i pixel dell'immagine nel file Pydicom set di dati, che può essere elaborato dal file Operatore caricatore dati MAP DICOM. Utilizzando la funzione DICOMizeImageSet(), abbiamo creato un connettore per caricare i dati di immagine da AWS HealthImaging, basato sulla MAP Operatore del caricatore dati DICOM:

class AHIDataLoaderOperator(Operator): def __init__(self, ahi_client, must_load: bool = True, *args, **kwargs): self.ahi_client = ahi_client … def _load_data(self, input_obj: string): study_dict = {} series_dict = {} sop_instances = self.ahi_client.DICOMizeImageSet(input_obj['datastoreId'], input_obj['imageSetId'])Nel codice precedente, ahi_client è un'istanza della classe di esportazione DICOM AHItoDICOM, con le funzioni di recupero dei dati illustrate. Abbiamo incluso questo nuovo operatore del caricatore dati in a Applicazione AI per la segmentazione della milza 3D creata dall'SDK dell'app MONAI Deploy. Puoi prima esplorare come creare ed eseguire questa applicazione su un'istanza di notebook locale, quindi distribuire questa applicazione MAP negli endpoint di inferenza gestiti SageMaker.

Inferenza asincrona di SageMaker

Un SageMaker inferenza asincrona l'endpoint viene utilizzato per richieste con grandi dimensioni di payload (fino a 1 GB), tempi di elaborazione lunghi (fino a 15 minuti) e requisiti di latenza quasi in tempo reale. Quando non ci sono richieste da elaborare, questa opzione di distribuzione può ridurre il conteggio delle istanze a zero per risparmiare sui costi, il che è ideale per i carichi di lavoro di inferenza ML di imaging medico. Seguire i passaggi in taccuino di esempio per creare e richiamare l'endpoint di inferenza asincrona SageMaker. A creare un endpoint di inferenza asincrono, dovrai prima creare un modello SageMaker e una configurazione dell'endpoint. Per creare un modello SageMaker, dovrai caricare un pacchetto model.tar.gz con a struttura di directory definita in un contenitore Docker. Il pacchetto model.tar.gz include un file model.ts di segmentazione della milza pre-addestrato e un file inference.py personalizzato. Abbiamo utilizzato un contenitore predefinito con le versioni del framework Python 3.8 e PyTorch 1.12.1 per caricare il modello ed eseguire previsioni.

Nel personalizzato inferenza.py file, istanziamo una classe helper AHItoDICOM da AHItoDICOMInterface e la utilizziamo per creare un'istanza MAP nel model_fn() funzione ed eseguiamo l'applicazione MAP su ogni richiesta di inferenza nel file predict_fn() funzione:

from app import AISpleenSegApp

from AHItoDICOMInterface.AHItoDICOM import AHItoDICOM

helper = AHItoDICOM()

def model_fn(model_dir, context): … monai_app_instance = AISpleenSegApp(helper, do_run=False,path="/home/model-server") def predict_fn(input_data, model): with open('/home/model-server/inputImageSets.json', 'w') as f: f.write(json.dumps(input_data)) output_folder = "/home/model-server/output" if not os.path.exists(output_folder): os.makedirs(output_folder) model.run(input='/home/model-server/inputImageSets.json', output=output_folder, workdir='/home/model-server', model='/opt/ml/model/model.ts')A richiamare l'endpoint asincrono, dovrai caricare il payload di input della richiesta su Servizio di archiviazione semplice Amazon (Amazon S3), che è un file JSON che specifica l'ID del datastore AWS HealthImaging e l'ID ImageSet su cui eseguire l'inferenza su:

sess = sagemaker.Session()

InputLocation = sess.upload_data('inputImageSets.json', bucket=sess.default_bucket(), key_prefix=prefix, extra_args={"ContentType": "application/json"})

response = runtime_sm_client.invoke_endpoint_async(EndpointName=endpoint_name, InputLocation=InputLocation, ContentType="application/json", Accept="application/json")

output_location = response["OutputLocation"]L'output può essere trovato anche in Amazon S3.

Inferenza in tempo reale multimodello SageMaker

SageMaker inferenza in tempo reale gli endpoint soddisfano i requisiti interattivi e di bassa latenza. Questa opzione può ospitare più modelli in un contenitore dietro un endpoint, che rappresenta una soluzione scalabile ed economica per la distribuzione di diversi modelli ML. UN L'endpoint multimodello SageMaker utilizza NVIDIA Triton Inference Server con GPU per eseguire più inferenze di modelli di deep learning.

In questa sezione viene illustrato come creare e richiamare un endpoint multi-modello adattando il proprio contenitore di inferenza nel seguente taccuino di esempio. Diversi modelli possono essere serviti in un contenitore condiviso sulla stessa flotta di risorse. Gli endpoint multimodello riducono il sovraccarico di distribuzione e scalano le inferenze del modello in base ai modelli di traffico verso l'endpoint. Abbiamo usato Strumenti per sviluppatori AWS Compreso Amazon CodeCommit, AmazonCodeBuilde Amazon CodePipeline costruire il contenitore personalizzato per l'inferenza del modello SageMaker. Abbiamo preparato un model_handler.py per portare il tuo contenitore invece del file inference.py nell'esempio precedente e implementato le funzioni inizializza(), preprocess() e inference():

from app import AISpleenSegApp

from AHItoDICOMInterface.AHItoDICOM import AHItoDICOM

class ModelHandler(object): def __init__(self): self.initialized = False self.shapes = None def initialize(self, context): self.initialized = True properties = context.system_properties model_dir = properties.get("model_dir") gpu_id = properties.get("gpu_id") helper = AHItoDICOM() self.monai_app_instance = AISpleenSegApp(helper, do_run=False, path="/home/model-server/") def preprocess(self, request): inputStr = request[0].get("body").decode('UTF8') datastoreId = json.loads(inputStr)['inputs'][0]['datastoreId'] imageSetId = json.loads(inputStr)['inputs'][0]['imageSetId'] with open('/tmp/inputImageSets.json', 'w') as f: f.write(json.dumps({"datastoreId": datastoreId, "imageSetId": imageSetId})) return '/tmp/inputImageSets.json' def inference(self, model_input): self.monai_app_instance.run(input=model_input, output="/home/model-server/output/", workdir="/home/model-server/", model=os.environ["model_dir"]+"/model.ts")Dopo che il contenitore è stato costruito e spinto Registro dei contenitori Amazon Elastic (Amazon ECR), puoi creare un modello SageMaker con esso, oltre a diversi pacchetti di modelli (file tar.gz) in un determinato percorso Amazon S3:

model_name = "DEMO-MONAIDeployModel" + strftime("%Y-%m-%d-%H-%M-%S", gmtime())

model_url = "s3://{}/{}/".format(bucket, prefix)

container = "{}.dkr.ecr.{}.amazonaws.com/{}:dev".format( account_id, region, prefix )

container = {"Image": container, "ModelDataUrl": model_url, "Mode": "MultiModel"}

create_model_response = sm_client.create_model(ModelName=model_name, ExecutionRoleArn=role, PrimaryContainer=container)È interessante notare che il model_url qui specifica solo il percorso di una cartella di file tar.gz e specifichi quale pacchetto di modelli utilizzare per l'inferenza quando richiami l'endpoint, come mostrato nel codice seguente:

Payload = {"inputs": [ {"datastoreId": datastoreId, "imageSetId": next(iter(imageSetIds))} ]}

response = runtime_sm_client.invoke_endpoint(EndpointName=endpoint_name, ContentType="application/json", Accept="application/json", TargetModel="model.tar.gz", Body=json.dumps(Payload))Possiamo aggiungere più modelli all'endpoint di inferenza multimodello esistente senza dover aggiornare l'endpoint o crearne uno nuovo.

ripulire

Non dimenticare di completare il Elimina le risorse di hosting passo in laboratorio-3 ed laboratorio-4 notebook per eliminare gli endpoint di inferenza SageMaker. Dovresti rifiutare l'istanza del notebook SageMaker anche per risparmiare sui costi. Infine, puoi chiamare la funzione API AWS HealthImaging o utilizzare la console AWS HealthImaging per eliminare i set di immagini e l'archivio dati creati in precedenza:

for s in imageSetIds.keys(): medicalimaging.deleteImageSet(datastoreId, s)

medicalimaging.deleteDatastore(datastoreId)Conclusione

In questo post, ti abbiamo mostrato come creare un connettore MAP per AWS HealthImaging, riutilizzabile nelle applicazioni create con l'SDK dell'app MONAI Deploy, per integrare e accelerare il recupero dei dati di immagine da un archivio DICOM nativo del cloud ai carichi di lavoro AI di imaging medico . L'SDK MONAI Deploy può essere utilizzato per supportare le operazioni ospedaliere. Abbiamo anche dimostrato due opzioni di hosting per distribuire applicazioni MAP AI su SageMaker su larga scala.

Esamina i taccuini di esempio nel file Repository GitHub per saperne di più su come distribuire applicazioni MONAI su SageMaker con immagini mediche archiviate in AWS HealthImaging. Per sapere cosa AWS può fare per te, contatta un Rappresentante AWS.

Per ulteriori risorse, fare riferimento a quanto segue:

Informazioni sugli autori

Ming (Melvin) Qin è un collaboratore indipendente del team Healthcare di NVIDIA, focalizzato sullo sviluppo di un framework e di una piattaforma applicativa per l'inferenza dell'intelligenza artificiale per portare l'intelligenza artificiale nei flussi di lavoro dell'imaging medico. Prima di unirsi a NVIDIA nel 2018 come membro fondatore di Clara, Ming ha trascorso 15 anni sviluppando Radiology PACS e Workflow SaaS come ingegnere/architetto capo presso Stentor Inc., successivamente acquisita da Philips Healthcare per formare la sua Enterprise Imaging.

Ming (Melvin) Qin è un collaboratore indipendente del team Healthcare di NVIDIA, focalizzato sullo sviluppo di un framework e di una piattaforma applicativa per l'inferenza dell'intelligenza artificiale per portare l'intelligenza artificiale nei flussi di lavoro dell'imaging medico. Prima di unirsi a NVIDIA nel 2018 come membro fondatore di Clara, Ming ha trascorso 15 anni sviluppando Radiology PACS e Workflow SaaS come ingegnere/architetto capo presso Stentor Inc., successivamente acquisita da Philips Healthcare per formare la sua Enterprise Imaging.

Davide Bericat è product manager per il settore sanitario presso NVIDIA, dove guida il gruppo di lavoro del progetto MONAI Deploy per portare l'intelligenza artificiale dalla ricerca alle implementazioni cliniche. La sua passione è accelerare l'innovazione sanitaria a livello globale traducendola in un vero impatto clinico. In precedenza, David ha lavorato presso Red Hat, implementando i principi open source all'intersezione tra intelligenza artificiale, cloud, edge computing e IoT. I suoi momenti di cui va più orgoglioso includono l'escursionismo al campo base dell'Everest e il gioco del calcio per oltre 20 anni.

Davide Bericat è product manager per il settore sanitario presso NVIDIA, dove guida il gruppo di lavoro del progetto MONAI Deploy per portare l'intelligenza artificiale dalla ricerca alle implementazioni cliniche. La sua passione è accelerare l'innovazione sanitaria a livello globale traducendola in un vero impatto clinico. In precedenza, David ha lavorato presso Red Hat, implementando i principi open source all'intersezione tra intelligenza artificiale, cloud, edge computing e IoT. I suoi momenti di cui va più orgoglioso includono l'escursionismo al campo base dell'Everest e il gioco del calcio per oltre 20 anni.

Brad Genereaux è Global Lead, Healthcare Alliances presso NVIDIA, dove è responsabile delle relazioni con gli sviluppatori con particolare attenzione all'imaging medico per accelerare l'intelligenza artificiale e le soluzioni di deep learning, visualizzazione, virtualizzazione e analisi. Brad promuove l'adozione e l'integrazione onnipresenti di flussi di lavoro sanitari e di imaging medico senza soluzione di continuità nella pratica clinica quotidiana, con oltre 20 anni di esperienza nell'IT sanitario.

Brad Genereaux è Global Lead, Healthcare Alliances presso NVIDIA, dove è responsabile delle relazioni con gli sviluppatori con particolare attenzione all'imaging medico per accelerare l'intelligenza artificiale e le soluzioni di deep learning, visualizzazione, virtualizzazione e analisi. Brad promuove l'adozione e l'integrazione onnipresenti di flussi di lavoro sanitari e di imaging medico senza soluzione di continuità nella pratica clinica quotidiana, con oltre 20 anni di esperienza nell'IT sanitario.

Banda Fu è un architetto di soluzioni sanitarie presso AWS. Ha conseguito un dottorato in scienze farmaceutiche presso l'Università del Mississippi e ha oltre 10 anni di esperienza nella ricerca tecnologica e biomedica. È appassionato di tecnologia e dell'impatto che può avere sull'assistenza sanitaria.

Banda Fu è un architetto di soluzioni sanitarie presso AWS. Ha conseguito un dottorato in scienze farmaceutiche presso l'Università del Mississippi e ha oltre 10 anni di esperienza nella ricerca tecnologica e biomedica. È appassionato di tecnologia e dell'impatto che può avere sull'assistenza sanitaria.

JP Leger è un Senior Solutions Architect che supporta centri medici accademici e flussi di lavoro di imaging medico presso AWS. Vanta oltre 20 anni di esperienza nell'ingegneria del software, nell'IT sanitario e nell'imaging medico, con una vasta esperienza nell'architettura di sistemi per prestazioni, scalabilità e sicurezza in distribuzioni distribuite di grandi volumi di dati in sede, nel cloud e ibride con analisi e intelligenza artificiale .

JP Leger è un Senior Solutions Architect che supporta centri medici accademici e flussi di lavoro di imaging medico presso AWS. Vanta oltre 20 anni di esperienza nell'ingegneria del software, nell'IT sanitario e nell'imaging medico, con una vasta esperienza nell'architettura di sistemi per prestazioni, scalabilità e sicurezza in distribuzioni distribuite di grandi volumi di dati in sede, nel cloud e ibride con analisi e intelligenza artificiale .

Chris Hafey è Principal Solutions Architect presso Amazon Web Services. Vanta oltre 25 anni di esperienza nel settore dell'imaging medicale ed è specializzato nella realizzazione di sistemi scalabili ad alte prestazioni. È il creatore del popolare progetto open source CornerstoneJS, che alimenta il popolare visualizzatore zero footprint open source OHIF. Ha contribuito alle specifiche DICOMweb e continua a lavorare per migliorarne le prestazioni per la visualizzazione basata sul web.

Chris Hafey è Principal Solutions Architect presso Amazon Web Services. Vanta oltre 25 anni di esperienza nel settore dell'imaging medicale ed è specializzato nella realizzazione di sistemi scalabili ad alte prestazioni. È il creatore del popolare progetto open source CornerstoneJS, che alimenta il popolare visualizzatore zero footprint open source OHIF. Ha contribuito alle specifiche DICOMweb e continua a lavorare per migliorarne le prestazioni per la visualizzazione basata sul web.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- Platone Salute. Intelligence sulle biotecnologie e sulle sperimentazioni cliniche. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/build-a-medical-imaging-ai-inference-pipeline-with-monai-deploy-on-aws/

- :ha

- :È

- :non

- :Dove

- $ SU

- 1

- 10

- 100

- 12

- 15 anni

- 15%

- 20

- 20 anni

- 200

- 2018

- 25

- 3d

- 7

- 8

- a

- WRI

- accademico

- accelerare

- accelerando

- accesso

- accessibile

- Il mio account

- acquisito

- operanti in

- aggiungere

- aggiuntivo

- Adozione

- Vantaggio

- conveniente

- AI

- Modelli AI

- Avvisi

- Algoritmi

- Tutti

- fedi nuziali

- consentire

- anche

- Amazon

- Amazon Web Services

- an

- analitica

- ed

- api

- Accesso API

- API

- App

- Applicazioni

- applicazioni

- architettura

- SONO

- artificiale

- intelligenza artificiale

- AS

- At

- gli attributi

- Automatico

- disponibile

- AWS

- base

- basato

- BE

- prima

- dietro

- biomedico

- stile di vita

- entrambi

- brad

- innovazioni

- portare

- costruire

- Costruzione

- costruito

- incassato

- by

- chiamata

- Campo

- Materiale

- che

- casi

- centro

- centri

- Clara

- classe

- Info su

- Cloud

- codice

- Venire

- completamento di una

- incluso

- informatica

- Configurazione

- Connettività

- consolle

- consorzio

- contatti

- Contenitore

- contiene

- testuali

- contesto

- continua

- contribuito

- collaboratore

- Costo

- risparmi

- costo effettivo

- Costi

- coprire

- coscritto

- creare

- creato

- Creatore

- personalizzate

- dati

- Banca dati

- David

- deep

- apprendimento profondo

- dimostrare

- dimostrato

- schierare

- distribuzione

- deployment

- implementazioni

- Dev

- sviluppato

- Costruttori

- sviluppatori

- in via di sviluppo

- diverso

- distribuito

- do

- docker

- documento

- giù

- In precedenza

- bordo

- edge computing

- efficiente

- o

- altro

- Abilita

- da un capo all'altro

- endpoint

- Ingegneria

- Impresa

- ambienti

- Equivalente

- Everest

- Ogni

- quotidiano

- esempio

- Tranne

- esistente

- esperienza

- competenza

- esplora

- estensivo

- Conclamata Esperienza

- estremamente

- falso

- FAST

- Compila il

- File

- Infine

- Nome

- FLOTTA

- Focus

- concentrato

- seguire

- i seguenti

- segue

- Orma

- Nel

- modulo

- formato

- essere trovato

- fondazione

- Contesto

- da

- fu

- completamente

- function

- funzionalità

- funzioni

- GitHub

- dato

- globali

- Globalmente

- GPU

- Gruppo

- ha

- Avere

- avendo

- he

- intestazioni

- Salute e benessere

- assistenza sanitaria

- qui

- Alte prestazioni

- vivamente

- il suo

- detiene

- ospedale

- host

- ospitato

- di hosting

- Come

- Tutorial

- HTML

- http

- HTTPS

- IBRIDO

- ID

- ideale

- Identità

- if

- illustra

- Immagine

- immagini

- Imaging

- Impact

- implementato

- Implementazione

- importare

- importazioni

- miglioramento

- in

- Inc.

- includere

- incluso

- inclusi

- Compreso

- studente indipendente

- industria

- Innovazione

- ingresso

- Ingressi

- install

- esempio

- invece

- integrare

- integrazione

- Intelligence

- interattivo

- intersezione

- ai miglioramenti

- IoT

- Irlanda

- IT

- SUO

- Lavoro

- accoppiamento

- jpg

- json

- Le

- Sapere

- grandi

- Latenza

- dopo

- portare

- capi

- Leads

- IMPARARE

- apprendimento

- linea

- caricare

- caricatore

- Caricamento in corso

- locale

- Lunghi

- macchina

- machine learning

- Maggioranza

- make

- gestito

- direttore

- gestione

- carta geografica

- Maps

- medicale

- Soddisfare

- membro

- Metadati

- Metrica

- Minuti

- ML

- Moda

- modello

- modelli

- moduli

- Moments

- Monitorare

- Scopri di più

- Endpoint multimodello

- multiplo

- nativo

- Bisogno

- Rete

- reti

- New

- no

- Nessuna

- Nord

- taccuino

- degno di nota

- Nvidia

- oggetto

- of

- Offerte

- on

- ONE

- esclusivamente

- aprire

- rete aperta

- open source

- Operazioni

- operatore

- Operatori

- ottimizzati

- Opzione

- Opzioni

- or

- Oregon

- OS

- Altro

- produzione

- ancora

- proprio

- pacchetto

- Packages

- imballaggio

- coppia

- Parallel

- passione

- appassionato

- sentiero

- modelli

- performance

- autorizzazione

- Pharmaceutical

- phd

- conduttura

- pixel

- piattaforma

- Platone

- Platone Data Intelligence

- PlatoneDati

- gioco

- più

- Popolare

- Post

- alimentato

- potenze

- pratica

- Previsioni

- preparato

- precedente

- in precedenza

- Direttore

- principi

- processi

- Elaborato

- i processi

- lavorazione

- Prodotto

- product manager

- Produzione

- progetto

- proprietà

- fornisce

- spinto

- Python

- pytorch

- tempo reale

- Realtà

- ricevere

- Rosso

- Red Hat

- ridurre

- riferimento

- regione

- regioni

- relazioni

- rappresentazione

- richiesta

- richieste

- Requisiti

- richiede

- riparazioni

- ricercatori

- Risorse

- risposta

- responsabile

- ritorno

- riutilizzabile

- Correre

- running

- s

- SaaS

- sagemaker

- Inferenza di SageMaker

- stesso

- Risparmi

- Risparmio

- Scalabilità

- scalabile

- Scala

- scala

- Scienze

- sdk

- senza soluzione di continuità

- Sezione

- problemi di

- segmentazione

- prodotti

- AUTO

- anziano

- Serie

- servito

- servizio

- Servizi

- Set

- regolazione

- alcuni

- forme

- condiviso

- dovrebbero

- ha mostrato

- mostrato

- Un'espansione

- Dimensioni

- liscio

- Calcio

- Software

- Ingegneria del software

- soluzione

- Soluzioni

- Fonte

- specializzata

- specificazione

- esaurito

- standard

- step

- Passi

- conservazione

- Tornare al suo account

- memorizzati

- Corda

- tale

- supporto

- Supporto

- sydney

- SISTEMI DI TRATTAMENTO

- prende

- team

- Tecnologia

- Testing

- di

- che

- Il

- loro

- Li

- poi

- Là.

- Strumenti Bowman per analizzare le seguenti finiture:

- questo

- Attraverso

- volte

- a

- insieme

- strumenti

- verso

- traffico

- tritone

- vero

- prova

- TURNO

- seconda

- onnipresente

- Università

- Aggiornanento

- uso

- utilizzato

- Utente

- usa

- utilizzando

- utilità

- varietà

- versioni

- visualizzazione

- Virginia

- visione

- visualizzazione

- visualizzare

- volumi

- W

- camminare

- volere

- we

- sito web

- servizi web

- Web-basata

- WELL

- Che

- quando

- quale

- volere

- con

- entro

- senza

- Lavora

- lavorato

- flusso di lavoro

- flussi di lavoro

- lavoro

- Gruppo di lavoro

- anni

- Tu

- Trasferimento da aeroporto a Sharm

- zefiro

- zero