Nel panorama sanitario odierno in rapida evoluzione, i medici si trovano di fronte a grandi quantità di dati clinici provenienti da varie fonti, come note del caregiver, cartelle cliniche elettroniche e referti di imaging. Questa ricchezza di informazioni, sebbene essenziale per la cura del paziente, può anche essere travolgente e richiedere molto tempo per i professionisti medici da vagliare e analizzare. Riepilogare in modo efficiente ed estrarre informazioni da questi dati è fondamentale per una migliore cura del paziente e un migliore processo decisionale. Le informazioni sintetiche sui pazienti possono essere utili per una serie di processi a valle come l'aggregazione dei dati, la codifica efficace dei pazienti o il raggruppamento di pazienti con diagnosi simili per la revisione.

I modelli di intelligenza artificiale (AI) e machine learning (ML) si sono dimostrati molto promettenti nell'affrontare queste sfide. I modelli possono essere addestrati per analizzare e interpretare grandi volumi di dati di testo, condensando efficacemente le informazioni in riepiloghi concisi. Automatizzando il processo di riepilogo, i medici possono ottenere rapidamente l'accesso alle informazioni pertinenti, consentendo loro di concentrarsi sulla cura del paziente e prendere decisioni più informate. Vedere quanto segue caso di studio per saperne di più su un caso d'uso reale.

Amazon Sage Maker, un servizio ML completamente gestito, fornisce una piattaforma ideale per l'hosting e l'implementazione di vari modelli e approcci di riepilogo basati su AI/ML. In questo post, esploriamo diverse opzioni per implementare le tecniche di riepilogo su SageMaker, incluso l'utilizzo JumpStart di Amazon SageMaker modelli di base, messa a punto di modelli pre-addestrati da Hugging Face e creazione di modelli di riepilogo personalizzati. Discutiamo anche i pro ei contro di ciascun approccio, consentendo agli operatori sanitari di scegliere la soluzione più adatta per generare riepiloghi concisi e accurati di dati clinici complessi.

Due termini importanti da conoscere prima di iniziare: pre-addestrato ed ritocchi. Un modello pre-addestrato o di base è un modello che è stato costruito e addestrato su un ampio corpus di dati, in genere per la conoscenza generale della lingua. La messa a punto è il processo mediante il quale a un modello pre-addestrato viene fornito un altro set di dati più specifico del dominio per migliorarne le prestazioni su un'attività specifica. In un contesto sanitario, ciò significherebbe fornire al modello alcuni dati tra cui frasi e terminologia pertinenti specificamente alla cura del paziente.

Crea modelli di riepilogo personalizzati su SageMaker

Sebbene sia l'approccio più impegnativo, alcune organizzazioni potrebbero preferire creare da zero modelli di riepilogo personalizzati su SageMaker. Questo approccio richiede una conoscenza più approfondita dei modelli AI/ML e può comportare la creazione di un'architettura del modello da zero o l'adattamento di modelli esistenti per soddisfare esigenze specifiche. La creazione di modelli personalizzati può offrire maggiore flessibilità e controllo sul processo di riepilogo, ma richiede anche più tempo e risorse rispetto agli approcci che partono da modelli preaddestrati. È essenziale valutare attentamente i vantaggi e gli svantaggi di questa opzione prima di procedere, perché potrebbe non essere adatta a tutti i casi d'uso.

Modelli di base SageMaker JumpStart

Un'ottima opzione per implementare il riepilogo su SageMaker è l'utilizzo dei modelli di base JumpStart. Questi modelli, sviluppati dalle principali organizzazioni di ricerca sull'intelligenza artificiale, offrono una gamma di modelli linguistici preaddestrati ottimizzati per varie attività, incluso il riepilogo del testo. SageMaker JumpStart offre due tipi di modelli di base: modelli proprietari e modelli open source. SageMaker JumpStart fornisce anche l'idoneità HIPAA, rendendolo utile per i carichi di lavoro sanitari. Alla fine spetta al cliente garantire la conformità, quindi assicurati di adottare le misure appropriate. Vedere Progettazione per sicurezza e conformità HIPAA su Amazon Web Services per ulteriori dettagli.

Modelli di fondazione proprietari

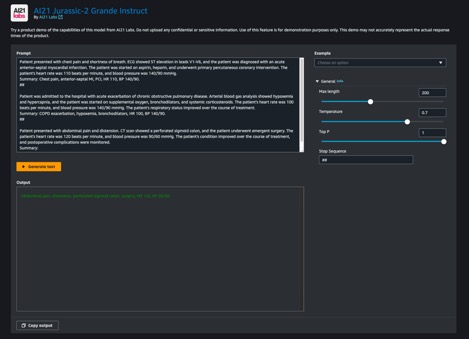

I modelli proprietari, come i modelli Jurassic di AI21 e il modello Cohere Generate di Cohere, possono essere scoperti tramite SageMaker JumpStart su Console di gestione AWS e sono attualmente in anteprima. L'utilizzo di modelli proprietari per il riepilogo è l'ideale quando non è necessario ottimizzare il modello su dati personalizzati. Ciò offre una soluzione pronta all'uso facile da usare in grado di soddisfare i requisiti di riepilogo con una configurazione minima. Utilizzando le funzionalità di questi modelli pre-addestrati, puoi risparmiare tempo e risorse che altrimenti verrebbero spesi per l'addestramento e la messa a punto di un modello personalizzato. Inoltre, i modelli proprietari in genere vengono forniti con API e SDK intuitivi, semplificando il processo di integrazione con i sistemi e le applicazioni esistenti. Se le tue esigenze di riepilogo possono essere soddisfatte da modelli proprietari preaddestrati senza richiedere personalizzazioni o regolazioni specifiche, essi offrono una soluzione conveniente, conveniente ed efficiente per le tue attività di riepilogo del testo. Poiché questi modelli non sono addestrati specificamente per i casi d'uso sanitari, la qualità non può essere garantita per il linguaggio medico pronto all'uso senza una messa a punto.

Jurassic-2 Grande Instruct è un modello di linguaggio di grandi dimensioni (LLM) di AI21 Labs, ottimizzato per istruzioni in linguaggio naturale e applicabile a varie attività linguistiche. Offre un'API e un SDK Python di facile utilizzo, bilanciando qualità e convenienza. Gli usi popolari includono la generazione di copie di marketing, l'alimentazione di chatbot e il riepilogo del testo.

Sulla console SageMaker, vai a SageMaker JumpStart, trova il modello AI21 Jurassic-2 Grande Instruct e scegli Prova il modello.

Se desideri distribuire il modello su un endpoint SageMaker che gestisci, puoi seguire i passaggi in questo esempio taccuino, che mostra come distribuire Jurassic-2 Large utilizzando SageMaker.

Modelli di fondazione open source

I modelli open source includono i modelli FLAN T5, Bloom e GPT-2 che possono essere scoperti tramite SageMaker JumpStart nel Amazon Sage Maker Studio Interfaccia utente, SageMaker JumpStart sulla console SageMaker e API SageMaker JumpStart. Questi modelli possono essere ottimizzati e distribuiti agli endpoint tramite il tuo account AWS, offrendoti la piena proprietà dei pesi del modello e dei codici di script.

Flan-T5 XL è un modello potente e versatile progettato per un'ampia gamma di attività linguistiche. Ottimizzando il modello con i dati specifici del tuo dominio, puoi ottimizzarne le prestazioni per il tuo particolare caso d'uso, come il riepilogo del testo o qualsiasi altra attività NLP. Per dettagli su come ottimizzare Flan-T5 XL utilizzando l'interfaccia utente di SageMaker Studio, fare riferimento a Ottimizzazione delle istruzioni per FLAN T5 XL con Amazon SageMaker Jumpstart.

Ottimizzazione dei modelli pre-addestrati con Hugging Face su SageMaker

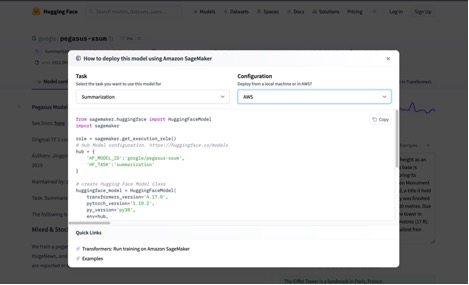

Una delle opzioni più popolari per implementare il riepilogo su SageMaker è la messa a punto di modelli pre-addestrati utilizzando Hugging Face Trasformatori biblioteca. Hugging Face offre un'ampia gamma di modelli di trasformatore preaddestrati specificamente progettati per varie attività di elaborazione del linguaggio naturale (NLP), incluso il riepilogo del testo. Con la libreria Hugging Face Transformers, puoi facilmente ottimizzare questi modelli pre-addestrati sui dati specifici del tuo dominio utilizzando SageMaker. Questo approccio presenta diversi vantaggi, come tempi di addestramento più rapidi, prestazioni migliori su domini specifici e pacchettizzazione e distribuzione di modelli più semplici utilizzando strumenti e servizi SageMaker integrati. Se non riesci a trovare un modello adatto in SageMaker JumpStart, puoi scegliere qualsiasi modello offerto da Hugging Face e perfezionarlo utilizzando SageMaker.

Per iniziare a lavorare con un modello per conoscere le funzionalità di ML, tutto ciò che devi fare è aprire SageMaker Studio, trovare un modello pre-addestrato che desideri utilizzare nel Hub del modello del viso che abbracciae scegli SageMaker come metodo di distribuzione. Hugging Face ti darà il codice da copiare, incollare ed eseguire sul tuo taccuino. È così facile! Non è richiesta alcuna esperienza di ingegneria ML.

La libreria Hugging Face Transformers consente ai builder di operare sui modelli preaddestrati ed eseguire attività avanzate come la messa a punto, che esploreremo nelle sezioni seguenti.

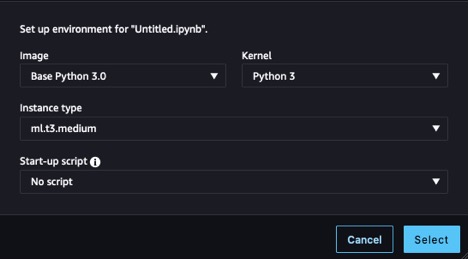

Fornire risorse

Prima di poter iniziare, dobbiamo eseguire il provisioning di un notebook. Per istruzioni, fare riferimento ai passaggi 1 e 2 in Costruisci e addestra un modello di Machine Learning a livello locale. Per questo esempio, abbiamo usato le impostazioni mostrate nello screenshot seguente.

Abbiamo anche bisogno di creare un file Servizio di archiviazione semplice Amazon (Amazon S3) per archiviare i dati di addestramento e gli artefatti di addestramento. Per le istruzioni, fare riferimento a Creare un secchio.

Prepara il set di dati

Per mettere a punto il nostro modello per avere una migliore conoscenza del dominio, dobbiamo ottenere dati adatti all'attività. Durante la formazione per un caso d'uso aziendale, dovrai eseguire una serie di attività di ingegneria dei dati per preparare i tuoi dati in modo che siano pronti per la formazione. Tali compiti non rientrano nell'ambito di questo post. Per questo esempio, abbiamo generato alcuni dati sintetici per emulare le note infermieristiche e li abbiamo archiviati in Amazon S3. L'archiviazione dei nostri dati in Amazon S3 ci consente di farlo progettare i nostri carichi di lavoro per la conformità HIPAA. Iniziamo prendendo quelle note e caricandole sull'istanza in cui è in esecuzione il nostro notebook:

Le note sono composte da una colonna contenente la voce completa, nota, e una colonna contenente una versione abbreviata che esemplifica quale dovrebbe essere l'output desiderato, riepilogo. Lo scopo dell'utilizzo di questo set di dati è migliorare il vocabolario biologico e medico del nostro modello in modo che sia più in sintonia con la sintesi in un contesto sanitario, chiamato messa a punto del dominioe mostra al nostro modello come strutturare il suo output di riepilogo. In alcuni casi di riepilogo, potremmo voler creare un riassunto da un articolo o una sinossi di una riga di una recensione, ma in questo caso, stiamo cercando di ottenere dal nostro modello una versione abbreviata dei sintomi e delle azioni intraprese per un paziente finora.

Carica il modello

Il modello che usiamo come base è una versione di Pegasus di Google, resa disponibile in Hugging Face Hub, chiamata pegaso-xsum. È già pre-addestrato per il riepilogo, quindi il nostro processo di messa a punto può concentrarsi sull'estensione della sua conoscenza del dominio. La modifica dell'attività eseguita dal nostro modello è un tipo diverso di messa a punto non trattata in questo post. La libreria Transformer ci fornisce una classe per caricare la definizione del modello dal nostro model_checkpoint: google/pegasus-xsum. Questo caricherà il modello dall'hub e ne creerà un'istanza nel nostro notebook in modo da poterlo utilizzare in seguito. Perché pegasus-xsum è un modello sequenza-sequenza, vogliamo usare il tipo Seq2Seq di Modello automatico classe:

Ora che abbiamo il nostro modello, è il momento di porre la nostra attenzione sugli altri componenti che ci consentiranno di eseguire il nostro ciclo di allenamento.

Crea un tokenizzatore

Il primo di questi componenti è il tokenizer. tokenizzazione è il processo mediante il quale le parole dei dati di input vengono trasformate in rappresentazioni numeriche che il nostro modello può comprendere. Ancora una volta, la libreria Transformer ci fornisce una classe per caricare una definizione di tokenizer dallo stesso checkpoint che abbiamo usato per istanziare il modello:

Con questo oggetto tokenizer, possiamo creare una funzione di pre-elaborazione e mapparla sul nostro set di dati per darci token pronti per essere inseriti nel modello. Infine, formattiamo l'output tokenizzato e rimuoviamo le colonne contenenti il nostro testo originale, perché il modello non sarà in grado di interpretarle. Ora ci resta un input tokenizzato pronto per essere inserito nel modello. Vedere il seguente codice:

Con i nostri dati tokenizzati e il nostro modello istanziato, siamo quasi pronti per eseguire un ciclo di addestramento. I prossimi componenti che vogliamo creare sono il raccoglitore di dati e l'ottimizzatore. Il raccoglitore di dati è un'altra classe fornita da Hugging Face tramite la libreria Transformers, che usiamo per creare batch dei nostri dati tokenizzati per l'addestramento. Possiamo facilmente crearlo usando il tokenizer e gli oggetti modello che abbiamo già semplicemente trovando il tipo di classe corrispondente che abbiamo usato in precedenza per il nostro modello (Seq2Seq) per la classe collator. La funzione dell'ottimizzatore è mantenere lo stato di allenamento e aggiornare i parametri in base alla nostra perdita di allenamento mentre lavoriamo attraverso il ciclo. Per creare un ottimizzatore, possiamo importare il file optim pacchetto dal modulo torcia, dove sono disponibili una serie di algoritmi di ottimizzazione. Alcuni comuni che potresti aver incontrato prima sono Stochastic Gradient Descent e Adam, l'ultima delle quali è applicata nel nostro esempio. Il costruttore di Adam accetta i parametri del modello e il tasso di apprendimento parametrizzato per l'esecuzione di training specificata. Vedere il seguente codice:

Gli ultimi passaggi prima di poter iniziare la formazione sono costruire l'acceleratore e lo scheduler del tasso di apprendimento. L'acceleratore proviene da una libreria diversa (abbiamo utilizzato principalmente Transformers) prodotta da Hugging Face, giustamente chiamata Accelerate, e astrarrà la logica richiesta per gestire i dispositivi durante l'addestramento (utilizzando più GPU, ad esempio). Per il componente finale, rivisitiamo la sempre utile libreria Transformers per implementare il nostro pianificatore del tasso di apprendimento. Specificando il tipo di pianificatore, il numero totale di passaggi di addestramento nel nostro ciclo e l'ottimizzatore creato in precedenza, il file get_scheduler La funzione restituisce un oggetto che ci consente di regolare il nostro tasso di apprendimento iniziale durante il processo di formazione:

Ora siamo completamente pronti per l'allenamento! Impostiamo un processo di addestramento, iniziando con l'istanziare il file training_args utilizzando la libreria Transformers e scegliendo i valori dei parametri. Possiamo passare questi, insieme agli altri nostri componenti e set di dati preparati, direttamente al file allenatore e iniziare l'addestramento, come mostrato nel codice seguente. A seconda delle dimensioni del set di dati e dei parametri scelti, questa operazione potrebbe richiedere molto tempo.

Impacchettare il modello per l'inferenza

Dopo l'esecuzione dell'addestramento, l'oggetto modello è pronto per essere utilizzato per l'inferenza. Come best practice, salviamo il nostro lavoro per un uso futuro. Dobbiamo creare i nostri artefatti del modello, comprimerli insieme e caricare il nostro tarball su Amazon S3 per l'archiviazione. Per preparare il nostro modello per la compressione, dobbiamo scartare il modello ora perfezionato, quindi salvare il file binario del modello e i file di configurazione associati. Dobbiamo anche salvare il nostro tokenizer nella stessa directory in cui abbiamo salvato i nostri artefatti del modello in modo che sia disponibile quando utilizziamo il modello per l'inferenza. Nostro model_dir La cartella dovrebbe ora assomigliare al seguente codice:

Non resta che eseguire un comando tar per comprimere la nostra directory e caricare il file tar.gz su Amazon S3:

Il nostro modello appena messo a punto è ora pronto e disponibile per essere utilizzato per l'inferenza.

Eseguire l'inferenza

Per utilizzare questo artefatto del modello per l'inferenza, aprire un nuovo file e utilizzare il codice seguente, modificando il file model_data parametro per adattare la posizione di salvataggio dell'artefatto in Amazon S3. IL HuggingFaceModel costruttore ricostruirà il nostro modello dal checkpoint in cui abbiamo salvato model.tar.gz, che possiamo quindi distribuire per l'inferenza utilizzando il metodo deploy. La distribuzione dell'endpoint richiederà alcuni minuti.

Dopo che l'endpoint è stato distribuito, possiamo usare il predittore che abbiamo creato per testarlo. Passa il predict metodo un carico utile di dati ed esegui la cella, e otterrai la risposta dal tuo modello ottimizzato:

Per vedere i vantaggi della messa a punto di un modello, eseguiamo un rapido test. La tabella seguente include un prompt e i risultati del passaggio di tale prompt al modello prima e dopo il fine tuning.

| Richiesta | Risposta senza messa a punto | Risposta con la messa a punto |

| Riassumi i sintomi che il paziente sta vivendo. Il paziente è un maschio di 45 anni con lamentele di dolore toracico sottosternale che si irradia al braccio sinistro. Il dolore è un inizio improvviso mentre stava facendo lavori in giardino, associato a lieve mancanza di respiro e diaforesi. All'arrivo la frequenza cardiaca del paziente era 120, la frequenza respiratoria 24, la pressione sanguigna 170/95. Elettrocardiogramma a 12 derivazioni eseguito all'arrivo al pronto soccorso e tre nitroglicerina sublinguale somministrata senza sollievo dal dolore toracico. L'elettrocardiogramma mostra un sopraslivellamento del tratto ST nelle derivazioni anteriori che dimostra un infarto miocardico anteriore acuto. Abbiamo contattato il laboratorio di cateterismo cardiaco e la preparazione per il cateterismo cardiaco da parte del cardiologo. | Presentiamo un caso di infarto miocardico acuto. | Dolore toracico, IM anteriore, PCI. |

Come puoi vedere, il nostro modello perfezionato utilizza la terminologia sanitaria in modo diverso e siamo stati in grado di modificare la struttura della risposta per adattarla ai nostri scopi. Si noti che i risultati dipendono dal set di dati e dalle scelte di progettazione effettuate durante l'addestramento. La tua versione del modello potrebbe offrire risultati molto diversi.

ripulire

Quando hai finito con il tuo notebook SageMaker, assicurati di spegnerlo per evitare costi derivanti da risorse a esecuzione prolungata. Tieni presente che l'arresto dell'istanza comporterà la perdita di tutti i dati archiviati nella memoria temporanea dell'istanza, quindi dovresti salvare tutto il tuo lavoro nell'archivio permanente prima della pulizia. Dovrai anche andare al endpoint page sulla console SageMaker ed eliminare tutti gli endpoint distribuiti per l'inferenza. Per rimuovere tutti gli artefatti, devi anche accedere alla console Amazon S3 per eliminare i file caricati nel tuo bucket.

Conclusione

In questo post, abbiamo esplorato varie opzioni per implementare tecniche di riepilogo del testo su SageMaker per aiutare gli operatori sanitari a elaborare ed estrarre in modo efficiente informazioni da grandi quantità di dati clinici. Abbiamo discusso dell'utilizzo dei modelli di base SageMaker Jumpstart, della messa a punto di modelli pre-addestrati da Hugging Face e della creazione di modelli di riepilogo personalizzati. Ogni approccio ha i suoi vantaggi e svantaggi, soddisfacendo esigenze e requisiti diversi.

La creazione di modelli di riepilogo personalizzati su SageMaker consente molta flessibilità e controllo, ma richiede più tempo e risorse rispetto all'utilizzo di modelli preaddestrati. I modelli base SageMaker Jumpstart forniscono una soluzione facile da usare e conveniente per le organizzazioni che non richiedono personalizzazione o messa a punto specifiche, nonché alcune opzioni per la messa a punto semplificata. La messa a punto dei modelli pre-addestrati da Hugging Face offre tempi di addestramento più rapidi, migliori prestazioni specifiche del dominio e un'integrazione perfetta con gli strumenti e i servizi SageMaker in un ampio catalogo di modelli, ma richiede un certo sforzo di implementazione. Al momento della stesura di questo post, Amazon ha annunciato un'altra opzione, Roccia Amazzonica, che offrirà funzionalità di riepilogo in un ambiente ancora più gestito.

Comprendendo i pro ei contro di ciascun approccio, gli operatori sanitari e le organizzazioni possono prendere decisioni informate sulla soluzione più adatta per generare riepiloghi concisi e accurati di dati clinici complessi. In definitiva, l'utilizzo di modelli di riepilogo basati su AI/ML su SageMaker può migliorare significativamente l'assistenza ai pazienti e il processo decisionale, consentendo ai professionisti medici di accedere rapidamente alle informazioni pertinenti e concentrarsi sulla fornitura di cure di qualità.

Risorse

Per lo script completo discusso in questo post e alcuni dati di esempio, fare riferimento al file Repository GitHub. Per ulteriori informazioni su come eseguire carichi di lavoro ML su AWS, consulta le seguenti risorse:

Circa gli autori

CodyCollins è un Solutions Architect con sede a New York presso Amazon Web Services. Lavora con i clienti ISV per creare soluzioni leader del settore nel cloud. Ha realizzato con successo progetti complessi per diversi settori, ottimizzando l'efficienza e la scalabilità. Nel tempo libero ama leggere, viaggiare e praticare jiu jitsu.

CodyCollins è un Solutions Architect con sede a New York presso Amazon Web Services. Lavora con i clienti ISV per creare soluzioni leader del settore nel cloud. Ha realizzato con successo progetti complessi per diversi settori, ottimizzando l'efficienza e la scalabilità. Nel tempo libero ama leggere, viaggiare e praticare jiu jitsu.

Ameer Hakme è un architetto di soluzioni AWS residente in Pennsylvania. Il suo obiettivo professionale prevede la collaborazione con fornitori di software indipendenti in tutto il nord-est, guidandoli nella progettazione e costruzione di piattaforme scalabili e all'avanguardia su AWS Cloud.

Ameer Hakme è un architetto di soluzioni AWS residente in Pennsylvania. Il suo obiettivo professionale prevede la collaborazione con fornitori di software indipendenti in tutto il nord-est, guidandoli nella progettazione e costruzione di piattaforme scalabili e all'avanguardia su AWS Cloud.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Automobilistico/VE, Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- BlockOffset. Modernizzare la proprietà della compensazione ambientale. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/exploring-summarization-options-for-healthcare-with-amazon-sagemaker/

- :ha

- :È

- :non

- :Dove

- $ SU

- 1

- 10

- 100

- 12

- 14

- 15%

- 24

- 33

- 7

- 8

- 9

- a

- capace

- WRI

- ABSTRACT

- accelerare

- acceleratore

- accesso

- Il mio account

- preciso

- operanti in

- azioni

- Adam

- indirizzamento

- amministrato

- Avanzate

- vantaggi

- Dopo shavasana, sedersi in silenzio; saluti;

- ancora

- aggregazione

- AI

- ricerca ai

- AI / ML

- Algoritmi

- Tutti

- Consentire

- consente

- lungo

- già

- anche

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- quantità

- importi

- an

- analizzare

- ed

- ha annunciato

- Un altro

- in qualsiasi

- api

- API

- applicabile

- applicazioni

- applicato

- approccio

- approcci

- opportuno

- architettura

- SONO

- ARM

- arrivo

- articolo

- AS

- associato

- At

- attenzione

- Automatizzare

- disponibile

- evitare

- lontano

- AWS

- bilanciamento

- basato

- BE

- perché

- stato

- prima

- iniziare

- beneficio

- vantaggi

- MIGLIORE

- Meglio

- BIN

- sangue

- Miglioramento della pressione sanguigna

- Fioritura

- Scatola

- Breath

- ampio

- costruire

- costruttori

- Costruzione

- costruito

- incassato

- ma

- by

- chiamata

- detto

- Materiale

- funzionalità

- che

- attentamente

- Custodie

- casi

- catalogo

- Causare

- sfide

- il cambiamento

- chatbots

- scelte

- Scegli

- la scelta

- scelto

- classe

- Info su

- Cloud

- codice

- codici

- codifica

- collaborando

- Colonna

- colonne

- Venire

- viene

- Uncommon

- rispetto

- reclami

- complesso

- conformità

- componente

- componenti

- composto

- conciso

- Configurazione

- Svantaggi

- consolle

- costruire

- contesto

- di controllo

- Comodo

- Corrispondente

- costo effettivo

- Costi

- potuto

- coperto

- creare

- creato

- Creazione

- cruciale

- Attualmente

- costume

- cliente

- Clienti

- personalizzazione

- dati

- dataset

- Decision Making

- decisioni

- definizione

- consegnato

- dimostrando

- Shirts Department

- dipendente

- Dipendente

- schierare

- schierato

- distribuzione

- deployment

- Design

- progettato

- progettazione

- desiderato

- dettagli

- sviluppato

- dispositivi

- diverso

- direttamente

- scoperto

- discutere

- discusso

- paesaggio differenziato

- do

- Dottori

- fare

- dominio

- domini

- fatto

- Dont

- giù

- inconvenienti

- durante

- ogni

- più facile

- facilmente

- facile

- facile da usare

- in maniera efficace

- efficienza

- efficiente

- in modo efficiente

- sforzo

- Elettronico

- Cartelle sanitarie elettroniche

- eleggibilità

- emergenza

- enable

- Abilita

- consentendo

- endpoint

- Ingegneria

- accrescere

- garantire

- Impresa

- iscrizione

- Ambiente

- epoca

- essential

- Anche

- evoluzione

- esempio

- esistente

- esperienza

- sperimentare

- esplora

- Esplorazione

- Esplorare

- estendendo

- estratto

- Faccia

- di fronte

- lontano

- più veloce

- Federale

- pochi

- Compila il

- File

- finale

- Infine

- Trovate

- ricerca

- Nome

- in forma

- Flessibilità

- Focus

- seguire

- i seguenti

- Nel

- formato

- Fondazione

- da

- pieno

- completamente

- function

- Inoltre

- futuro

- Guadagno

- Generale

- generare

- generato

- la generazione di

- ottenere

- ottenere

- Dare

- dato

- Dare

- Go

- GPU

- grande

- maggiore

- garantito

- Avere

- he

- Salute e benessere

- assistenza sanitaria

- Cuore

- Aiuto

- il suo

- di hosting

- Come

- Tutorial

- HTML

- http

- HTTPS

- Hub

- abbracciare il viso

- ideale

- if

- Imaging

- realizzare

- implementazione

- Implementazione

- importare

- importante

- competenze

- in

- Uno sguardo approfondito sui miglioramenti dei pneumatici da corsa di Bridgestone.

- includere

- inclusi

- Compreso

- studente indipendente

- industrie

- industria

- informazioni

- informati

- inizialmente

- ingresso

- Ingressi

- intuizioni

- esempio

- istruzioni

- integrazione

- Intelligence

- ai miglioramenti

- coinvolgere

- IT

- SUO

- Lavoro

- json

- ad appena

- Sapere

- conoscenze

- laboratorio

- Labs

- paesaggio

- Lingua

- grandi

- Cognome

- dopo

- portare

- principale

- Leads

- IMPARARE

- apprendimento

- a sinistra

- Biblioteca

- piace

- LLM

- caricare

- Caricamento in corso

- località

- logica

- Guarda

- perdere

- spento

- macchina

- machine learning

- fatto

- mantenere

- make

- Fare

- gestire

- gestito

- gestione

- carta geografica

- Marketing

- Maggio..

- significare

- medicale

- Soddisfare

- Memorie

- di cartone

- metodo

- forza

- minimo

- Minuti

- ML

- modello

- modelli

- Moduli

- Scopri di più

- maggior parte

- Più popolare

- multiplo

- Detto

- Naturale

- Elaborazione del linguaggio naturale

- Navigare

- Bisogno

- esigenze

- New

- New York

- recentemente

- GENERAZIONE

- nlp

- no

- taccuino

- Note

- adesso

- numero

- oggetto

- oggetti

- of

- offrire

- offerto

- Offerte

- Vecchio

- on

- ONE

- quelli

- inizio

- su

- aprire

- open source

- operare

- ottimizzazione

- OTTIMIZZA

- ottimizzati

- ottimizzazione

- Opzione

- Opzioni

- or

- minimo

- organizzazioni

- i

- Altro

- altrimenti

- nostro

- su

- produzione

- al di fuori

- ancora

- proprio

- proprietà

- pacchetto

- imballaggio

- pagina

- Dolore

- parametro

- parametri

- particolare

- passare

- Di passaggio

- paziente

- pazienti

- Pegasus

- Pennsylvania

- performance

- pertinente

- Frasi

- piattaforma

- Piattaforme

- Platone

- Platone Data Intelligence

- PlatoneDati

- punto

- Popolare

- Post

- potente

- Accensione

- pratica

- Predictor

- preferire

- Preparare

- preparato

- presenti

- pressione

- Anteprima

- in precedenza

- principalmente

- processi

- i processi

- lavorazione

- Prodotto

- professionale

- Scelto dai professionisti

- progetti

- PROMETTIAMO

- proprio

- PROS

- fornire

- purché

- fornisce

- fornitura

- fornitura

- scopo

- fini

- metti

- Python

- qualità

- Presto

- rapidamente

- gamma

- rapidamente

- tasso

- Lettura

- pronto

- mondo reale

- record

- pertinente

- sollievo

- rimuovere

- Report

- richiedere

- necessario

- Requisiti

- richiede

- riparazioni

- Risorse

- risposta

- Risultati

- problemi

- recensioni

- Ruolo

- Correre

- running

- corre

- sagemaker

- stesso

- Risparmi

- Scalabilità

- scalabile

- portata

- graffiare

- sdk

- sdk

- senza soluzione di continuità

- sezioni

- problemi di

- vedere

- separato

- servizio

- Servizi

- set

- regolazione

- impostazioni

- alcuni

- accorciato

- dovrebbero

- mostrare attraverso le sue creazioni

- mostrato

- Spettacoli

- chiudendo

- Vagliare

- significativa

- significativamente

- simile

- Un'espansione

- semplificata

- Taglia

- So

- finora

- Software

- soluzione

- Soluzioni

- alcuni

- qualcosa

- fonti

- specifico

- in particolare

- esaurito

- inizia a

- Di partenza

- Regione / Stato

- state-of-the-art

- Passi

- conservazione

- Tornare al suo account

- memorizzati

- memorizzare

- razionalizzazione

- La struttura

- studio

- sublinguale

- Con successo

- tale

- improvviso

- Completo

- adatto

- SOMMARIO

- sicuro

- Sintomi

- sinossi

- sintetico

- dati sintetici

- SISTEMI DI TRATTAMENTO

- tavolo

- Fai

- preso

- prende

- Task

- task

- tecniche

- terminologia

- condizioni

- test

- di

- che

- Il

- l'hub

- Li

- poi

- Strumenti Bowman per analizzare le seguenti finiture:

- di

- questo

- quelli

- tre

- Attraverso

- per tutto

- tempo

- richiede tempo

- volte

- a

- di oggi

- insieme

- token

- Tokens

- strumenti

- torcia

- Totale

- Treni

- allenato

- Training

- trasformato

- trasformatore

- trasformatori

- Di viaggio

- seconda

- Digitare

- Tipi di

- tipicamente

- ui

- in definitiva

- incapace

- per

- capire

- e una comprensione reciproca

- Aggiornanento

- caricato

- us

- uso

- caso d'uso

- utilizzato

- user-friendly

- usa

- utilizzando

- Utilizzando

- convalida

- Valori

- vario

- Fisso

- fornitori

- versatile

- versione

- molto

- volumi

- volere

- Prima

- we

- Ricchezza

- sito web

- servizi web

- pesare

- WELL

- Che

- quando

- quale

- while

- largo

- Vasta gamma

- volere

- con

- senza

- parole

- Lavora

- lavoro

- lavori

- sarebbe

- scrittura

- anno

- York

- Tu

- Trasferimento da aeroporto a Sharm

- zefiro

- Codice postale