Questo post è scritto in collaborazione con Brad Duncan, Rachel Johnson e Richard Alcock di MathWorks.

MATLAB è uno strumento di programmazione popolare per un'ampia gamma di applicazioni, come elaborazione dati, calcolo parallelo, automazione, simulazione, apprendimento automatico e intelligenza artificiale. È ampiamente utilizzato in molti settori come quello automobilistico, aerospaziale, delle comunicazioni e della produzione. Negli ultimi anni, MathWorks ha portato molte offerte di prodotti nel cloud, in particolare su Amazon Web Services (AWS). Per ulteriori dettagli sui prodotti cloud MathWorks, vedere MATLAB e Simulink nel cloud or e-mail Mathworks.

In questo post introduciamo le funzionalità di machine learning di MATLAB Amazon Sage Maker, che presenta numerosi vantaggi significativi:

- Risorse di calcolo: L'utilizzo dell'ambiente informatico ad alte prestazioni offerto da SageMaker può accelerare la formazione sull'apprendimento automatico.

- Collaborazione: MATLAB e SageMaker insieme forniscono una solida piattaforma che i team possono utilizzare per collaborare in modo efficace alla creazione, al test e all'implementazione di modelli di machine learning.

- Distribuzione e accessibilità: i modelli possono essere distribuiti come endpoint in tempo reale SageMaker, rendendoli facilmente accessibili ad altre applicazioni per elaborare dati in streaming live.

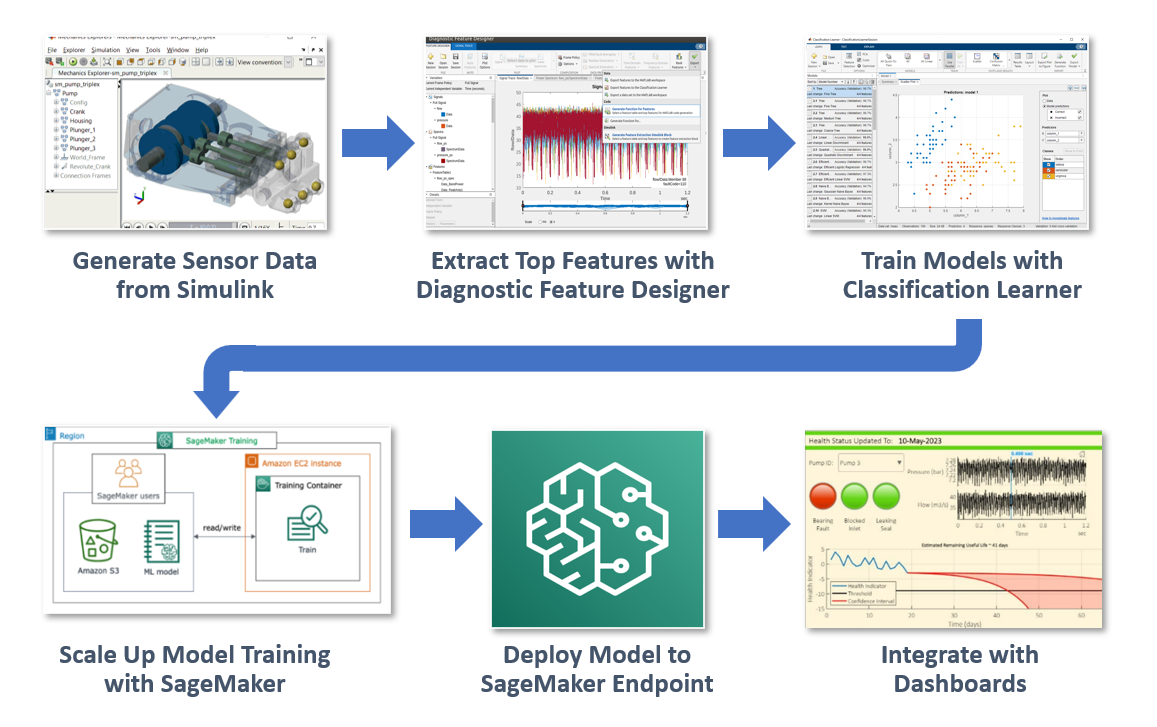

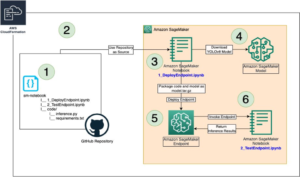

Ti mostriamo come addestrare un modello di machine learning MATLAB come lavoro di formazione SageMaker e quindi distribuire il modello come endpoint in tempo reale SageMaker in modo che possa elaborare dati in streaming in tempo reale.

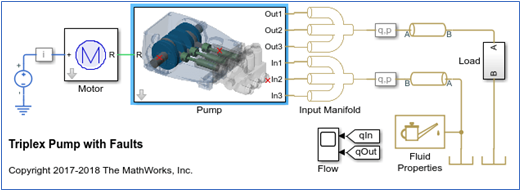

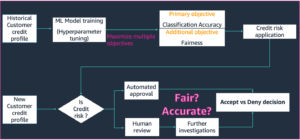

Per fare ciò, utilizzeremo un esempio di manutenzione predittiva in cui classifichiamo i guasti in una pompa operativa che trasmette in streaming i dati del sensore in tempo reale. Abbiamo accesso a un ampio archivio di dati etichettati generati da a Simlink simulazione che presenta tre possibili tipi di guasto in varie combinazioni possibili (ad esempio, uno stato integro e sette guasti). Poiché disponiamo di un modello del sistema e i guasti sono rari durante il funzionamento, possiamo sfruttare i dati simulati per addestrare il nostro algoritmo. Il modello può essere ottimizzato per corrispondere ai dati operativi della nostra pompa reale utilizzando tecniche di stima dei parametri in MATLAB e Simulink.

Il nostro obiettivo è dimostrare la potenza combinata di MATLAB e Amazon SageMaker utilizzando questo esempio di classificazione dei guasti.

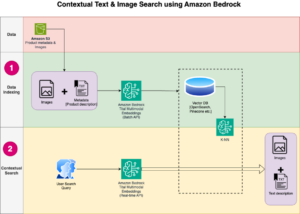

Iniziamo addestrando un modello di classificazione sul nostro desktop con MATLAB. Innanzitutto, estraiamo le funzionalità da un sottoinsieme del set di dati completo utilizzando il file Progettista di funzionalità diagnostiche app, quindi esegui l'addestramento del modello localmente con un modello di albero decisionale MATLAB. Una volta che siamo soddisfatti delle impostazioni dei parametri, possiamo generare una funzione MATLAB e inviare il lavoro insieme al set di dati a SageMaker. Ciò ci consente di ampliare il processo di formazione per accogliere set di dati molto più grandi. Dopo aver addestrato il nostro modello, lo distribuiamo come endpoint live che può essere integrato in un'app o in un dashboard downstream, come un'app Web MATLAB.

Questo esempio riassumerà ogni passaggio, fornendo una comprensione pratica di come sfruttare MATLAB e Amazon SageMaker per le attività di machine learning. Il codice completo e la descrizione dell'esempio sono disponibili in questo deposito.

Prerequisiti

- Ambiente di lavoro di MATLAB 2023a o versione successiva con MATLAB Compiler e Statistics and Machine Learning Toolbox su Linux. Ecco un guida veloce su come eseguire MATLAB su AWS.

- Docker installato in un file Amazon Elastic Compute Cloud (Amazon EC2) istanza in cui è in esecuzione MATLAB. O Ubuntu or Linux.

- Installazione di Interfaccia a riga di comando di AWS (AWS CLI), AWS Configurae Python3.

- AWS CLI dovrebbe essere già installato se hai seguito la guida all'installazione da step 1.

- Configura AWS Configure per interagire con le risorse AWS.

- Verifica l'installazione di Python3 eseguendo

python -Vorpython --versioncomando sul tuo terminale. Installa Python se necessario.

- Copia questo repository in una cartella nella tua macchina Linux eseguendo:

- Controlla l'autorizzazione sulla cartella del repository. Se non dispone dell'autorizzazione di scrittura, esegui il seguente comando shell:

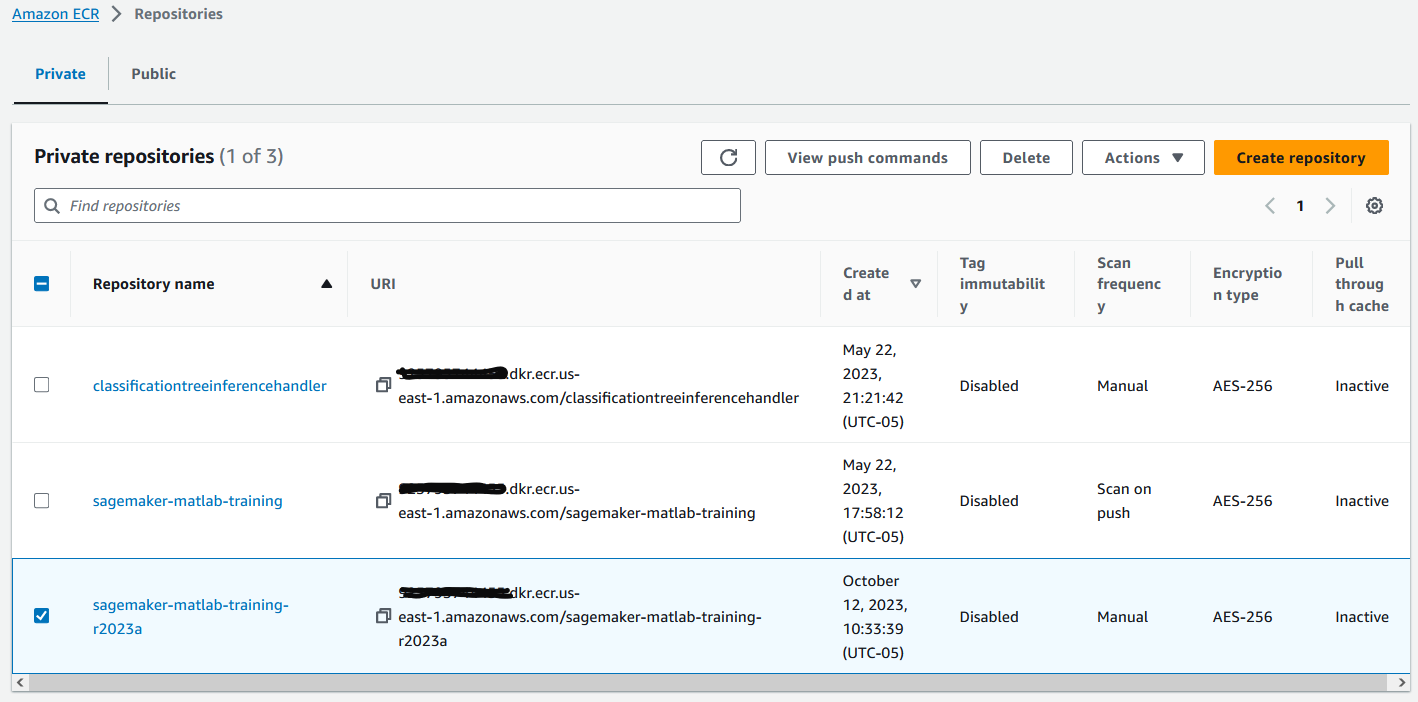

- Costruisci il contenitore di formazione MATLAB e invialo al file Registro dei contenitori elastici Amazon (Amazon ECR).

- Vai alla cartella

docker - Crea un repository Amazon ECR utilizzando l'AWS CLI (sostituisci REGION con la tua regione AWS preferita)

- Esegui il seguente comando docker:

- Vai alla cartella

- Apri MATLAB e apri il live script chiamato

PumpFaultClassificationMATLABSageMaker.mlxnella cartellaexamples/PumpFaultClassification. Rendi questa cartella la tua cartella di lavoro corrente in MATLAB.

Parte 1: Preparazione dei dati ed estrazione delle caratteristiche

Il primo passo in qualsiasi progetto di machine learning è preparare i dati. MATLAB fornisce un'ampia gamma di strumenti per importare, pulire ed estrarre funzionalità dai tuoi dati:

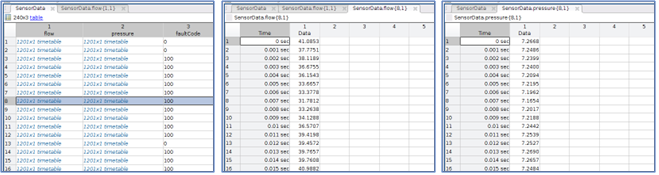

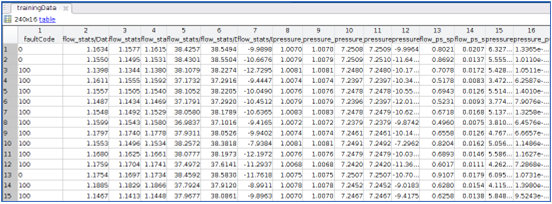

Il SensorData.mat il set di dati contiene 240 record. Ogni record ha due orari: flow ed pressure. La colonna di destinazione è faultcode, che è una rappresentazione binaria di tre possibili combinazioni di guasti nella pompa. Per queste tabelle di serie temporali, ciascuna tabella ha 1,201 righe che imitano 1.2 secondi di misurazione del flusso e della pressione della pompa con incrementi di 0.001 secondi.

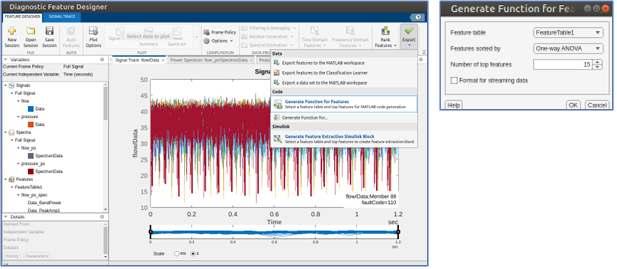

Successivamente, l'app Diagnostic Feature Designer consente di estrarre, visualizzare e classificare una varietà di funzionalità dai dati. Ecco, usi Funzionalità automatiche, che estrae rapidamente un ampio insieme di funzionalità nel dominio del tempo e della frequenza dal set di dati e classifica i migliori candidati per l'addestramento del modello. È quindi possibile esportare una funzione MATLAB che ricalcolerà le prime 15 funzionalità classificate dai nuovi dati di input. Chiamiamo questa funzione extractFeaturesTraining. Questa funzione può essere configurata per acquisire i dati tutti in un batch o come dati in streaming.

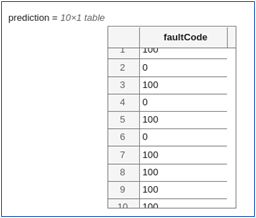

Questa funzione produce una tabella delle caratteristiche con i codici guasto associati, come mostrato nella figura seguente:

Parte 2: organizzare i dati per SageMaker

Successivamente, è necessario organizzare i dati in modo che SageMaker possa utilizzarli per la formazione sul machine learning. In genere, ciò comporta la suddivisione dei dati in set di training e convalida e la suddivisione dei dati dei predittori dalla risposta target.

In questa fase potrebbero essere necessarie altre operazioni più complesse di pulizia e filtraggio dei dati. In questo esempio, i dati sono già puliti. Potenzialmente, se l'elaborazione dei dati è molto complessa e richiede molto tempo, i lavori di elaborazione SageMaker possono essere utilizzati per eseguire questi lavori separatamente dalla formazione di SageMaker in modo che possano essere separati in due passaggi.

trainPredictors = trainingData(:,2:end);

trainResponse = trainingData(:,1);

Parte 3: addestrare e testare un modello di machine learning in MATLAB

Prima di passare a SageMaker, è una buona idea creare e testare il modello di machine learning localmente in MATLAB. Ciò consente di eseguire rapidamente l'iterazione e il debug del modello. È possibile configurare e addestrare localmente un semplice classificatore di alberi decisionali.

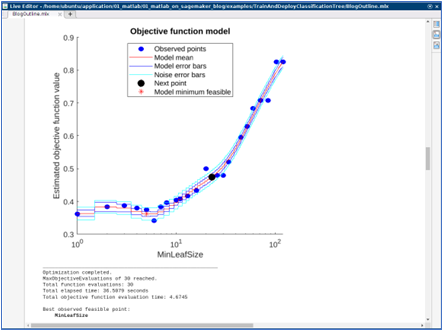

classifierModel = fitctree(... trainPredictors,... trainResponse,... OptimizeHyperparameters='auto');

Il completamento del lavoro di formazione qui dovrebbe richiedere meno di un minuto e genera alcuni grafici per indicare l'avanzamento della formazione. Al termine della formazione, viene prodotto un modello di machine learning MATLAB. IL Studente di classificazione L'app può essere utilizzata per provare molti tipi di modelli di classificazione e ottimizzarli per ottenere le migliori prestazioni, quindi produrre il codice necessario per sostituire il codice di addestramento del modello sopra.

Dopo aver verificato i parametri di precisione per il modello addestrato localmente, possiamo spostare l'addestramento in Amazon SageMaker.

Parte 4: addestra il modello in Amazon SageMaker

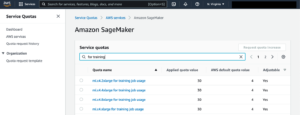

Una volta che sei soddisfatto del modello, puoi addestrarlo su larga scala utilizzando SageMaker. Per iniziare a chiamare gli SDK SageMaker, è necessario avviare una sessione SageMaker.

session = sagemaker.Session();

Specificare un'esecuzione SageMaker Ruolo IAM che verranno utilizzati dai processi di formazione e dall'hosting degli endpoint.

role = "arn:aws:iam::ACCOUNT:role/service-role/AmazonSageMaker-ExecutionRole-XXXXXXXXXXXXXXX";

Da MATLAB, salva i dati di training come file .csv in un file Servizio di archiviazione semplice Amazon (Amazon S3) secchio.

writetable(trainingData,'pump_training_data.csv');

trainingDataLocation = "s3:// "+session.DefaultBucket+ +"/cooling_system/input/pump_training";

copyfile("pump_training_data.csv", trainingDataLocation);

Crea uno stimatore SageMaker

Successivamente, è necessario creare uno stimatore SageMaker e trasmettergli tutti i parametri necessari, come un'immagine della finestra mobile di addestramento, una funzione di addestramento, variabili di ambiente, dimensioni dell'istanza di addestramento e così via. L'URI dell'immagine di training deve essere l'URI Amazon ECR creato nella fase dei prerequisiti con il formato ACCOUNT.dkr.ecr.us-east-1.amazonaws.com/sagemaker-matlab-training-r2023a:latest. La funzione di formazione dovrebbe essere fornita nella parte inferiore del live script MATLAB.

Invia il lavoro di formazione SageMaker

La chiamata al metodo di adattamento dallo stimatore invia il lavoro di formazione a SageMaker.

est.fit(training=struct(Location=trainingDataLocation, ContentType="text/csv"))

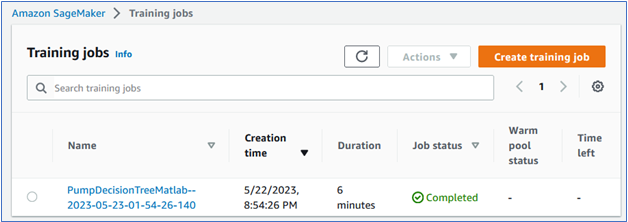

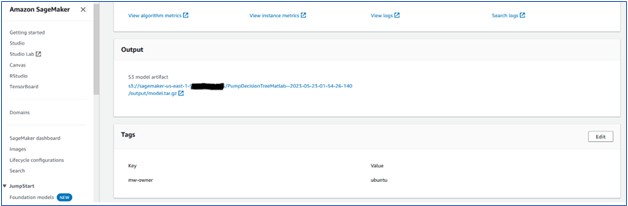

Puoi anche controllare lo stato del lavoro di formazione dalla console SageMaker:

Al termine dei lavori di formazione, selezionando il collegamento del lavoro si accede alla pagina di descrizione del lavoro dove è possibile vedere il modello MATLAB salvato nel bucket S3 dedicato:

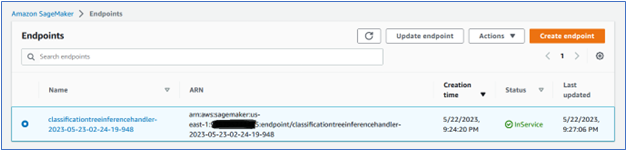

Parte 5: distribuire il modello come endpoint SageMaker in tempo reale

Dopo l'addestramento, puoi distribuire il modello come endpoint SageMaker in tempo reale, che puoi utilizzare per fare previsioni in tempo reale. Per fare ciò, chiamare il metodo deploy dallo stimatore. Qui è dove puoi impostare la dimensione dell'istanza desiderata per l'hosting in base al carico di lavoro.

Dietro le quinte, questa fase crea un'immagine docker di inferenza e la invia al repository Amazon ECR; all'utente non è richiesto nulla per creare il contenitore di inferenza. L'immagine contiene tutte le informazioni necessarie per soddisfare la richiesta di inferenza, come la posizione del modello, le informazioni di autenticazione MATLAB e gli algoritmi. Successivamente, Amazon SageMaker crea una configurazione dell'endpoint SageMaker e infine distribuisce l'endpoint in tempo reale. L'endpoint può essere monitorato nella console SageMaker e può essere terminato in qualsiasi momento se non viene più utilizzato.

Parte 6: testare l'endpoint

Ora che l'endpoint è attivo e in esecuzione, puoi testarlo fornendogli alcuni record da prevedere. Utilizza il codice seguente per selezionare 10 record dai dati di training e inviarli all'endpoint per la previsione. Il risultato della previsione viene restituito dall'endpoint e mostrato nell'immagine seguente.

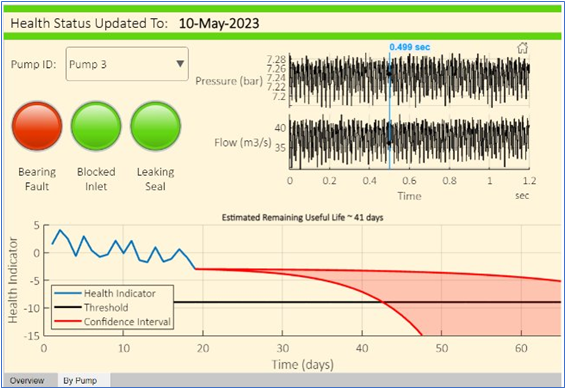

Parte 7: integrazione del dashboard

L'endpoint SageMaker può essere chiamato da molti servizi AWS nativi. Può anche essere utilizzato come API REST standard se distribuito insieme a un file AWS Lambda funzione e gateway API, integrabile con qualsiasi applicazione web. Per questo particolare caso d'uso, puoi utilizzare l'acquisizione di streaming con Amazon SageMaker Feature Store e Amazon Managed Streaming for Apache Kafka, MSK, per prendere decisioni supportate dal machine learning quasi in tempo reale. Un'altra possibile integrazione è l'utilizzo di una combinazione di Cinesi amazzonica, SageMaker e Apache Flink per creare un'applicazione gestita, affidabile, scalabile e altamente disponibile in grado di effettuare inferenze in tempo reale su un flusso di dati.

Dopo che gli algoritmi sono stati distribuiti su un endpoint SageMaker, potresti voler visualizzarli utilizzando una dashboard che mostra le previsioni di streaming in tempo reale. Nell'app Web MATLAB personalizzata che segue, puoi visualizzare i dati di pressione e flusso per pompa e previsioni di guasti in tempo reale dal modello distribuito.

In questo dashboard è incluso un modello di vita utile residua (RUL) per prevedere il tempo necessario al guasto per ciascuna pompa in questione. Per informazioni su come addestrare gli algoritmi RUL, vedere Toolbox per la manutenzione predittiva.

Ripulire

Dopo aver eseguito questa soluzione, assicurati di ripulire eventuali risorse AWS non necessarie per evitare costi imprevisti. Puoi ripulire queste risorse utilizzando il file SDK Python di SageMaker o la Console di gestione AWS per i servizi specifici utilizzati qui (SageMaker, Amazon ECR e Amazon S3). Eliminando queste risorse, eviti ulteriori addebiti per le risorse che non utilizzi più.

Conclusione

Abbiamo dimostrato come portare MATLAB in SageMaker per un caso d'uso di manutenzione predittiva della pompa con l'intero ciclo di vita del machine learning. SageMaker fornisce un ambiente completamente gestito per l'esecuzione di carichi di lavoro di machine learning e la distribuzione di modelli con un'ampia selezione di istanze di calcolo che soddisfano varie esigenze.

Negazione di responsabilità: Il codice utilizzato in questo post è di proprietà e gestito da MathWorks. Fare riferimento ai termini di licenza nel repository GitHub. Per eventuali problemi con il codice o le richieste di funzionalità, aprire un problema GitHub nel repository

Riferimenti

Informazioni sugli autori

Brad Duncan è il product manager per le funzionalità di machine learning in Statistics and Machine Learning Toolbox presso MathWorks. Lavora con i clienti per applicare l'intelligenza artificiale in nuove aree dell'ingegneria, come l'integrazione di sensori virtuali in sistemi ingegnerizzati, la creazione di modelli di apprendimento automatico spiegabili e la standardizzazione dei flussi di lavoro dell'intelligenza artificiale utilizzando MATLAB e Simulink. Prima di approdare a MathWorks, ha guidato team per la simulazione 3D e l'ottimizzazione dell'aerodinamica dei veicoli, dell'esperienza utente per la simulazione 3D e della gestione del prodotto per il software di simulazione. Brad è anche docente ospite presso la Tufts University nel campo dell'aerodinamica dei veicoli.

Brad Duncan è il product manager per le funzionalità di machine learning in Statistics and Machine Learning Toolbox presso MathWorks. Lavora con i clienti per applicare l'intelligenza artificiale in nuove aree dell'ingegneria, come l'integrazione di sensori virtuali in sistemi ingegnerizzati, la creazione di modelli di apprendimento automatico spiegabili e la standardizzazione dei flussi di lavoro dell'intelligenza artificiale utilizzando MATLAB e Simulink. Prima di approdare a MathWorks, ha guidato team per la simulazione 3D e l'ottimizzazione dell'aerodinamica dei veicoli, dell'esperienza utente per la simulazione 3D e della gestione del prodotto per il software di simulazione. Brad è anche docente ospite presso la Tufts University nel campo dell'aerodinamica dei veicoli.

Riccardo Alcock è il responsabile dello sviluppo senior per le integrazioni della piattaforma cloud presso MathWorks. In questo ruolo, è determinante nell'integrazione perfetta dei prodotti MathWorks nelle piattaforme cloud e container. Crea soluzioni che consentono a ingegneri e scienziati di sfruttare tutto il potenziale di MATLAB e Simulink in ambienti basati su cloud. In precedenza ha lavorato come ingegnere del software presso MathWorks, sviluppando soluzioni per supportare flussi di lavoro informatici paralleli e distribuiti.

Riccardo Alcock è il responsabile dello sviluppo senior per le integrazioni della piattaforma cloud presso MathWorks. In questo ruolo, è determinante nell'integrazione perfetta dei prodotti MathWorks nelle piattaforme cloud e container. Crea soluzioni che consentono a ingegneri e scienziati di sfruttare tutto il potenziale di MATLAB e Simulink in ambienti basati su cloud. In precedenza ha lavorato come ingegnere del software presso MathWorks, sviluppando soluzioni per supportare flussi di lavoro informatici paralleli e distribuiti.

Rachel Johnson è il product manager per la manutenzione predittiva presso MathWorks ed è responsabile della strategia generale del prodotto e del marketing. In precedenza è stata ingegnere applicativo a supporto diretto dell'industria aerospaziale su progetti di manutenzione predittiva. Prima di MathWorks, Rachel era un ingegnere di simulazione di aerodinamica e propulsione per la Marina degli Stati Uniti. Ha anche trascorso diversi anni insegnando matematica, fisica e ingegneria.

Rachel Johnson è il product manager per la manutenzione predittiva presso MathWorks ed è responsabile della strategia generale del prodotto e del marketing. In precedenza è stata ingegnere applicativo a supporto diretto dell'industria aerospaziale su progetti di manutenzione predittiva. Prima di MathWorks, Rachel era un ingegnere di simulazione di aerodinamica e propulsione per la Marina degli Stati Uniti. Ha anche trascorso diversi anni insegnando matematica, fisica e ingegneria.

Shun Mao è un Senior AI/ML Partner Solutions Architect nel team Emerging Technologies di Amazon Web Services. La sua passione è lavorare con clienti e partner aziendali per progettare, distribuire e scalare applicazioni AI/ML per ricavarne i valori aziendali. Fuori dal lavoro gli piace pescare, viaggiare e giocare a ping-pong.

Shun Mao è un Senior AI/ML Partner Solutions Architect nel team Emerging Technologies di Amazon Web Services. La sua passione è lavorare con clienti e partner aziendali per progettare, distribuire e scalare applicazioni AI/ML per ricavarne i valori aziendali. Fuori dal lavoro gli piace pescare, viaggiare e giocare a ping-pong.

Ramesh Jatiya è un Solutions Architect nel team Independent Software Vendor (ISV) di Amazon Web Services. La sua passione è lavorare con i clienti ISV per progettare, distribuire e scalare le loro applicazioni nel cloud per ricavarne i valori aziendali. Sta inoltre conseguendo un MBA in Machine Learning e Business Analytics presso il Babson College di Boston. Fuori dal lavoro gli piace correre, giocare a tennis e cucinare.

Ramesh Jatiya è un Solutions Architect nel team Independent Software Vendor (ISV) di Amazon Web Services. La sua passione è lavorare con i clienti ISV per progettare, distribuire e scalare le loro applicazioni nel cloud per ricavarne i valori aziendali. Sta inoltre conseguendo un MBA in Machine Learning e Business Analytics presso il Babson College di Boston. Fuori dal lavoro gli piace correre, giocare a tennis e cucinare.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- Platone Salute. Intelligence sulle biotecnologie e sulle sperimentazioni cliniche. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/machine-learning-with-matlab-and-amazon-sagemaker/

- :ha

- :È

- :non

- :Dove

- $ SU

- 001

- 1

- 10

- 100

- 15%

- 152

- 19

- 20

- 3d

- 7

- 8

- a

- WRI

- sopra

- accesso

- accessibile

- ospitare

- Il mio account

- precisione

- Vantaggio

- Aeronautico

- Dopo shavasana, sedersi in silenzio; saluti;

- AI

- AI / ML

- algoritmo

- Algoritmi

- Tutti

- consente

- lungo

- già

- anche

- Amazon

- Amazon EC2

- Amazon Sage Maker

- Amazon Web Services

- an

- analitica

- ed

- Un altro

- in qualsiasi

- Apache

- a parte

- api

- App

- l'app consente

- Applicazioni

- applicazioni

- APPLICA

- SONO

- RISERVATA

- aree

- artificiale

- intelligenza artificiale

- AS

- associato

- At

- Autenticazione

- auto

- Automazione

- settore automobilistico

- disponibile

- evitare

- AWS

- Console di gestione AWS

- Babson

- precedente

- BE

- perché

- prima

- iniziare

- vantaggi

- MIGLIORE

- Boston

- Parte inferiore

- brad

- portare

- ampio

- portato

- costruire

- Costruzione

- costruisce

- affari

- by

- chiamata

- detto

- chiamata

- Materiale

- i candidati

- funzionalità

- capace

- Custodie

- oneri

- dai un'occhiata

- verifica

- classificazione

- classificare

- cavedano

- Pulizia

- Cloud

- cloud Platform

- codice

- codici

- collaboreranno

- collaborazione

- College

- Colonna

- COM

- combinazione

- combinazioni

- combinato

- arrivo

- Comunicazione

- complesso

- Calcolare

- informatica

- Configurazione

- configurato

- consolle

- consumo

- Contenitore

- contiene

- Costi

- creare

- creato

- crea

- Corrente

- costume

- Clienti

- cruscotto

- dati

- Preparazione dei dati

- elaborazione dati

- dataset

- decisione

- decisioni

- dedicato

- dimostrare

- dimostrato

- Dipendente

- schierare

- schierato

- distribuzione

- Distribuisce

- derivare

- descrizione

- Design

- Designer

- desiderato

- tavolo

- dettagli

- in via di sviluppo

- Mercato

- diagnostica

- direttamente

- display

- distribuito

- calcolo distribuito

- do

- docker

- effettua

- dominio

- duncan

- ogni

- in maniera efficace

- o

- emergenti del mondo

- tecnologie emergenti

- enable

- fine

- endpoint

- ingegnere

- progettato

- Ingegneria

- Ingegneri

- Impresa

- Intero

- Ambiente

- ambienti

- particolarmente

- esempio

- esecuzione

- esperienza

- export

- estratto

- estratti

- Fallimento

- guasti

- difettoso

- caratteristica

- Caratteristiche

- pochi

- figura

- Compila il

- filtraggio

- Infine

- finire

- Nome

- Pesca

- in forma

- flusso

- seguito

- i seguenti

- segue

- Nel

- formato

- Frequenza

- da

- pieno

- completamente

- function

- ulteriormente

- porta

- generare

- generato

- genera

- GitHub

- Dare

- buono

- grafici

- grande

- GUEST

- guida

- cintura da arrampicata

- Avere

- he

- Salute e benessere

- sano

- pesantemente

- qui

- Alte prestazioni

- vivamente

- di hosting

- Come

- Tutorial

- HTML

- HTTPS

- idea

- if

- Immagine

- importazione

- in

- inclusi

- incorporando

- incremento

- studente indipendente

- indicare

- industrie

- industria

- informazioni

- avviare

- ingresso

- install

- installazione

- installato

- esempio

- strumentale

- integrato

- Integrazione

- integrazione

- integrazioni

- Intelligence

- interagire

- Interfaccia

- ai miglioramenti

- problema

- sicurezza

- isv

- IT

- Lavoro

- Offerte di lavoro

- Johnson

- jpg

- grandi

- superiore, se assunto singolarmente.

- dopo

- con i più recenti

- IMPARARE

- apprendimento

- Guidato

- meno

- Leva

- Licenza

- Vita

- ciclo di vita

- LINK

- linux

- vivere

- a livello locale

- località

- accesso

- più a lungo

- macchina

- machine learning

- manutenzione

- make

- Fare

- gestito

- gestione

- direttore

- consigliato per la

- molti

- Marketing

- partita

- matematica

- metodo

- Metrica

- forza

- minuto

- ML

- modello

- modelli

- Monitorare

- monitorati

- Scopri di più

- cambiano

- in movimento

- molti

- Detto

- nativo

- Vicino

- necessaria

- Bisogno

- di applicazione

- esigenze

- New

- no

- Niente

- obiettivo

- of

- offerto

- offerte

- on

- una volta

- ONE

- aprire

- operazione

- operativa

- Operazioni

- ottimizzazione

- or

- Altro

- nostro

- produzione

- al di fuori

- complessivo

- Di proprietà

- pagina

- Parallel

- parametro

- parametri

- particolare

- partner

- partner

- passare

- appassionato

- performance

- autorizzazione

- Fisica

- piattaforma

- Piattaforme

- Platone

- Platone Data Intelligence

- PlatoneDati

- gioco

- per favore

- Popolare

- possibile

- Post

- potenziale

- potenzialmente

- energia

- Pratico

- predire

- predizione

- Previsioni

- Predictor

- preferito

- preparazione

- Preparare

- pressione

- prevenire

- in precedenza

- Precedente

- processi

- lavorazione

- produrre

- Prodotto

- produce

- Prodotto

- gestione del prodotto

- product manager

- Prodotti

- Programmazione

- Progressi

- progetto

- progetti

- propulsione

- fornire

- purché

- fornisce

- fornitura

- pompa

- Spingi

- spinge

- Python

- domanda

- rapidamente

- gamma

- classifica

- classificato

- ranghi

- RARO

- prontamente

- di rose

- tempo reale

- recente

- record

- record

- riferimento

- regione

- registro

- affidabile

- rimanente

- sostituire

- deposito

- rappresentazione

- richiesta

- richieste

- necessario

- Risorse

- risposta

- responsabile

- REST

- colpevole

- Richard

- robusto

- Ruolo

- Correre

- running

- sagemaker

- soddisfatte

- soddisfatto

- Risparmi

- salvato

- scalabile

- Scala

- Scene

- scienziati

- copione

- sdk

- senza soluzione di continuità

- secondo

- vedere

- Selezione

- prodotti

- inviare

- anziano

- sensore

- inviato

- Serie

- servire

- servizio

- Servizi

- servizio

- Sessione

- set

- Set

- impostazioni

- Sette

- alcuni

- lei

- Conchiglia

- dovrebbero

- mostrare attraverso le sue creazioni

- mostrato

- significativa

- Un'espansione

- simulazione

- Taglia

- So

- Software

- Ingegneria del software

- soluzione

- Soluzioni

- alcuni

- specifico

- velocità

- esaurito

- Stage

- Standard

- standardizzazione

- inizia a

- stati

- statistica

- Stato dei servizi

- step

- Passi

- conservazione

- Tornare al suo account

- Strategia

- ruscello

- Streaming

- tale

- riassumere

- supporto

- Supporto

- sicuro

- sistema

- SISTEMI DI TRATTAMENTO

- tavolo

- TAG

- Fai

- prende

- Target

- task

- Insegnamento

- team

- le squadre

- tecniche

- Tecnologie

- terminal

- condizioni

- test

- Testing

- di

- che

- Il

- L'area

- loro

- Li

- poi

- Strumenti Bowman per analizzare le seguenti finiture:

- di

- questo

- quelli

- tre

- tempo

- Serie storiche

- a

- insieme

- Strumenti

- strumenti

- top

- Treni

- Training

- Di viaggio

- albero

- prova

- sintonizzare

- sintonizzato

- seconda

- Tipi di

- tipicamente

- e una comprensione reciproca

- Inaspettato

- Università

- us

- uso

- caso d'uso

- utilizzato

- Utente

- Esperienza da Utente

- utilizzando

- convalida

- Valori

- varietà

- vario

- veicolo

- venditore

- molto

- virtuale

- visualizzare

- volere

- Prima

- Modo..

- we

- sito web

- applicazioni web

- servizi web

- quale

- largo

- Vasta gamma

- volere

- con

- Lavora

- flussi di lavoro

- lavoro

- lavori

- scrivere

- scritto

- anni

- Tu

- Trasferimento da aeroporto a Sharm

- zefiro