Di recente abbiamo introdotto una nuova funzionalità in SDK Python di Amazon SageMaker che consente ai data scientist di eseguire il proprio codice di machine learning (ML) creato nel proprio ambiente di sviluppo integrato (IDE) preferito e nei notebook insieme alle dipendenze di runtime associate come Amazon Sage Maker lavori di formazione con modifiche minime al codice rispetto alla sperimentazione eseguita localmente. I data scientist in genere eseguono diverse iterazioni di sperimentazione nell'elaborazione dei dati e nei modelli di addestramento mentre lavorano su qualsiasi problema di machine learning. Vogliono eseguire questo codice ML ed eseguire la sperimentazione con facilità d'uso e modifiche minime al codice. Formazione del modello Amazon SageMaker aiuta i data scientist a eseguire lavori di formazione su larga scala completamente gestiti sull'infrastruttura di calcolo di AWS. SageMaker Training aiuta anche i data scientist con strumenti avanzati come Debugger di Amazon SageMaker e Profiler per eseguire il debug e analizzare i loro lavori di formazione su larga scala.

Per i clienti con budget limitati, team ridotti e tempistiche ristrette, ogni singolo nuovo concetto e riga di codice riscritta per l'esecuzione su SageMaker li rende meno produttivi rispetto alle attività principali, ovvero l'elaborazione dei dati e l'addestramento dei modelli ML. Vogliono scrivere il codice una volta nel framework di loro scelta ed essere in grado di passare senza problemi dall'esecuzione del codice nei loro notebook o laptop all'esecuzione del codice su larga scala utilizzando le funzionalità di SageMaker.

Con questa nuova funzionalità di SageMaker Python SDK, i data scientist possono integrare il proprio codice ML nella piattaforma SageMaker Training in pochi minuti. Devi solo aggiungere una singola riga di codice al tuo codice ML e SageMaker comprende in modo intelligente il tuo codice insieme ai set di dati e alla configurazione dell'ambiente dell'area di lavoro e lo esegue come un lavoro di formazione SageMaker. Puoi quindi sfruttare le funzionalità chiave della piattaforma SageMaker Training, come la capacità di ridimensionare facilmente i lavori e altri strumenti associati come Debugger e Profiler. In questa versione, puoi eseguire il tuo codice Python di machine learning (ML) locale come processo di addestramento Amazon SageMaker a nodo singolo o più processi paralleli. I lavori di formazione distribuiti (su più nodi) non sono supportati dalle funzioni remote.

In questo post, ti mostriamo come utilizzare questa nuova funzionalità per eseguire codice ML locale come processo di formazione SageMaker.

Panoramica della soluzione

Ora puoi eseguire il tuo codice ML scritto nel tuo IDE o notebook come un lavoro di formazione SageMaker annotando la funzione, che funge da punto di ingresso alla base di codice dell'utente, con un semplice decoratore. Al momento dell'invocazione, questa funzionalità acquisisce automaticamente un'istantanea di tutte le variabili, funzioni, pacchetti, variabili di ambiente e altri requisiti di runtime associati dal tuo codice ML, li serializza e li invia come processo di formazione SageMaker. Si integra con quello recentemente annunciato Funzione SageMaker Python SDK per l'impostazione dei valori predefiniti per i parametri. Questa funzionalità semplifica i costrutti di SageMaker che devi imparare per poter eseguire il codice utilizzando SageMaker Training. I data scientist possono scrivere, eseguire il debug e iterare il proprio codice in qualsiasi IDE preferito (ad esempio Amazon Sage Maker Studio, notebook, VS Code o PyCharm). Quando sei pronto, puoi annotare la tua funzione Python con il file @remote decorator ed eseguirlo come lavoro SageMaker su larga scala.

Questa funzionalità accetta oggetti Python open source familiari come argomenti e output. Inoltre, non è necessario comprendere la gestione del ciclo di vita dei container e puoi semplicemente eseguire i tuoi carichi di lavoro in diversi contesti di elaborazione (come un IDE locale, Studio o processi di formazione) con costi generali di configurazione minimi. Per eseguire qualsiasi codice locale come un lavoro SageMaker Training, questa funzionalità deduce le configurazioni necessarie per eseguire i lavori, come il Gestione dell'identità e dell'accesso di AWS (IAM), chiave di crittografia e configurazione di rete, dalle impostazioni di Studio o IDE (che possono essere il file impostazioni predefinite) e li passa alla piattaforma per impostazione predefinita. Hai la flessibilità di personalizzare il tuo runtime nell'infrastruttura gestita di SageMaker utilizzando la configurazione dedotta o di sovrascriverli a livello di SDK passandoli come argomenti al decoratore.

Questa nuova funzionalità di SageMaker Python SDK trasforma il tuo codice ML in un ambiente di lavoro esistente e qualsiasi codice di elaborazione dati e set di dati associati in un lavoro di formazione SageMaker. Questa funzionalità cerca il codice ML racchiuso all'interno di un file @remote decoratore e lo traduce automaticamente in un lavoro che viene eseguito in Studio o in un IDE locale come PyCharm.

Nelle sezioni seguenti, esaminiamo le funzionalità di questa nuova funzionalità e come avviare le funzioni Python come processi di formazione SageMaker.

Prerequisiti

Per utilizzare questa nuova funzionalità SageMaker Python SDK ed eseguire il codice associato a questo post, sono necessari i seguenti prerequisiti:

- Un account AWS che conterrà tutte le tue risorse AWS

- Un ruolo IAM per accedere a SageMaker

- Accesso a Studio o a un'istanza notebook SageMaker o a un IDE come PyCharm

Utilizza l'SDK dei notebook Studio e SageMaker

Puoi utilizzare questa funzionalità da Studio avviando un notebook e avvolgendo il tuo codice con a @remote decoratore all'interno del taccuino. Devi prima importare la funzione remota usando il seguente codice:

from sagemaker.remote_function import remoteQuando utilizzi la funzione decoratore, questa funzionalità interpreterà automaticamente la funzione del tuo codice e lo eseguirà come un lavoro di formazione SageMaker.

Puoi anche utilizzare questa funzionalità da un'istanza notebook SageMaker. Devi prima avviare un'istanza notebook, aprire Jupyter o Jupyter Lab su di essa e avviare un notebook. Quindi importa la funzione remota come mostrato nel codice precedente e avvolgi il tuo codice con il file @remote decoratore. Includiamo un esempio di come utilizzare la funzione decoratore e le impostazioni associate più avanti in questo post.

Usa l'SDK dal tuo ambiente locale

Puoi anche utilizzare questa funzionalità dal tuo IDE locale. Come prerequisito, devi avere il Interfaccia della riga di comando di AWS (AWS CLI), SageMaker Python SDK e SDK AWS per Python (Boto3) installato nell'ambiente locale. Devi importare queste librerie nel tuo codice, impostare la sessione SageMaker, specificare le impostazioni e decorare la tua funzione con il file @remote decoratore. Nel seguente codice di esempio, eseguiamo una semplice funzione di divisione come processo di formazione SageMaker:

import boto3

import sagemaker

from sagemaker.remote_function import remote sm_session = sagemaker.Session(boto_session=boto3.session.Session(region_name="us-west-2"))

settings = dict(

sagemaker_session=sm_session,

role=<IAM_ROLE_NAME>

instance_type="ml.m5.xlarge",

)

@remote(**settings)

def divide(x, y):

return x / y

if __name__ == "__main__":

print(divide(2, 3.0))Possiamo utilizzare una metodologia simile per eseguire funzioni avanzate come lavori di addestramento, come mostrato nella sezione successiva.

Avvia le funzioni Python come lavori SageMaker

La nuova funzionalità SageMaker Python SDK ti consente di eseguire le funzioni Python come file Lavori di formazione SageMaker. Qualsiasi codice Python, codice di formazione ML sviluppato da data scientist utilizzando i loro IDE locali preferiti (PyCharm, VS Code), notebook SageMaker o notebook Studio può essere avviato come processo SageMaker gestito.

Nei carichi di lavoro ML che utilizzano questa funzionalità, i set di dati associati, le dipendenze e le impostazioni dell'ambiente dell'area di lavoro vengono serializzati utilizzando il codice ML ed eseguiti come processo SageMaker in modo sincrono e asincrono.

Puoi aggiungere un @remote un'annotazione del decoratore a qualsiasi codice Python, inclusa un'elaborazione ML locale o una funzione di addestramento per avviarlo come un lavoro di formazione SageMaker gestito, sfruttando così i vantaggi in termini di scalabilità, prestazioni e costi di SageMaker. Ciò può essere ottenuto con modifiche minime al codice aggiungendo un decoratore al codice della funzione Python. L'invocazione alla funzione decorata viene eseguita in modo sincrono e l'esecuzione della funzione attende fino al completamento del processo SageMaker.

Nell'esempio seguente, utilizziamo il @remote decorator per avviare i processi SageMaker in modalità decoratore utilizzando un'istanza ml.m5.large. SageMaker utilizza i lavori di addestramento per avviare questa funzione come lavoro gestito.

from sagemaker.remote_function import remote

from numpy as np @remote(instance_type="ml.m5.large")

def matrix_multiply(a, b): return np.matmul(a, b) a = np.array([[1, 0], [0, 1]])

b = np.array([1, 2]) assert matrix_multiply(a, b) == np.array([1,2])Puoi anche utilizzare la modalità decoratore per avviare processi SageMaker, pacchetti Python e dipendenze. Puoi includere variabili di ambiente come VPC, sottoreti e gruppi di sicurezza per avviare i processi di addestramento di SageMaker nel file environment.yml file. Ciò consente agli ingegneri e agli amministratori di ML di configurare queste variabili di ambiente in modo che i data scientist possano concentrarsi sulla creazione di modelli ML e iterare più velocemente. Vedere il seguente codice:

from sagemaker.remote_function import remote @remote(instance_type="ml.g4dn.xlarge",dependencies = "./environment.yml")

def train_hf_model(

train_input_path,test_input_path,s3_output_path = None,

*,epochs = 1, train_batch_size = 32, eval_batch_size = 64,

warmup_steps = 500,learning_rate = 5e-5

):

model_name = "distilbert-base-uncased"

model = AutoModelForSequenceClassification.from_pretrained(model_name)

... <TRUCNATED>

return os.path.join(s3_output_path, model_dir), eval_resultPuoi usare RemoteExecutor per avviare funzioni Python come lavori SageMaker in modo asincrono. L'esecutore esegue il polling asincrono dei lavori SageMaker Training per aggiornare lo stato del lavoro. IL RemoteExecutor class è un'implementazione di futures.concurrent.Esecutore, che viene utilizzato per inviare i lavori SageMaker Training in modo asincrono. Vedere il seguente codice:

from sagemaker.remote_function import RemoteExecutor def train_hf_model(

train_input_path,test_input_path,s3_output_path = None,

*,epochs = 1, train_batch_size = 32, eval_batch_size = 64,

warmup_steps = 500,learning_rate = 5e-5

):

model_name = "distilbert-base-uncased"

model = AutoModelForSequenceClassification.from_pretrained(model_name)

...<TRUNCATED>

return os.path.join(s3_output_path, model_dir), eval_result with RemoteExecutor(instance_type="ml.g4dn.xlarge", dependencies = './requirements.txt') as e:

future = e.submit(train_hf_model, train_input_path,test_input_path,s3_output_path,

epochs, train_batch_size, eval_batch_size,warmup_steps,learning_rate)Personalizza l'ambiente di runtime

Modalità decoratore e RemoteExecutor consentono di definire e personalizzare gli ambienti di runtime per il lavoro SageMaker. Le dipendenze di runtime, inclusi i pacchetti Python e le variabili di ambiente per i lavori SageMaker, possono essere specificate per personalizzare il runtime. Per eseguire il codice Python locale come lavori gestiti da SageMaker, il pacchetto Python e le dipendenze devono essere resi disponibili a SageMaker. Gli ingegneri ML o gli amministratori di data science possono configurare configurazioni di rete e sicurezza come VPC, sottoreti e gruppi di sicurezza per i lavori SageMaker, in modo che i data scientist possano utilizzare queste configurazioni gestite centralmente durante l'avvio dei lavori SageMaker. Puoi usare sia a requirements.txt file o a Conda environment.yaml file.

Quando le dipendenze sono definite con requirements.txt, i pacchetti verranno installati utilizzando pip nel runtime del processo. Se l'immagine utilizzata per l'esecuzione del processo viene fornita con gli ambienti Conda, i pacchetti verranno installati nell'ambiente Conda dichiarato da utilizzare per i processi. Il codice seguente mostra un esempio requirements.txt file:

datasets

transformers

torch

scikit-learn

s3fs==0.4.2

sagemaker>=2.148.0Puoi passare il tuo Conda environment.yaml file per creare l'ambiente Conda in cui si desidera eseguire il codice durante il processo di addestramento. Se l'immagine utilizzata per eseguire il processo dichiara un ambiente Conda in cui eseguire il codice, aggiorneremo l'ambiente Conda dichiarato con la specifica specificata. Il codice seguente è un esempio di a Conda environment.yaml file:

name: sagemaker_example

channels: - conda-forge

dependencies: - python=3.10 - pandas - pip: - sagemakerIn alternativa, puoi impostare dependencies=”auto_capture” per consentire a SageMaker Python SDK di acquisire le dipendenze installate nell'ambiente Conda attivo. È necessario disporre di un ambiente Conda attivo per auto_capture lavorare. Si noti che ci sono prerequisiti per auto_capture lavorare; ti consigliamo di passare le tue dipendenze come a requirement.txt or Conda environment.yml file come descritto nella sezione precedente.

Per maggiori dettagli, consultare Esegui il tuo codice locale come processo di formazione SageMaker.

Configurazioni per lavori SageMaker

Le impostazioni relative all'infrastruttura possono essere scaricate in un file di configurazione che gli utenti amministratori potrebbero aiutare a configurare. Devi configurarlo solo una volta. Le impostazioni dell'infrastruttura riguardano la configurazione di rete, i ruoli IAM, Servizio di archiviazione semplice Amazon (Amazon S3) cartella per input, dati di output e tag. Fare riferimento a Configurazione e utilizzo delle impostazioni predefinite con SageMaker Python SDK per ulteriori dettagli.

SchemaVersion: '1.0'

SageMaker:

PythonSDK:

Modules:

RemoteFunction:

Dependencies: path/to/requirements.txt

EnvironmentVariables: {"EnvVarKey": "EnvVarValue"}

ImageUri: 366666666666.dkr.ecr.us-west-2.amazonaws.com/my-image:latest

InstanceType: ml.m5.large

RoleArn: arn:aws:iam::366666666666:role/MyRole

S3KmsKeyId: somekmskeyid

S3RootUri: s3://my-bucket/my-project

SecurityGroupIds:

- sg123

Subnets:

- subnet-1234

Tags:

- {"Key": "someTagKey", "Value": "someTagValue"}

VolumeKmsKeyId: somekmskeyidImplementazione

I modelli di deep learning come PyTorch o TensorFlow possono anche essere eseguiti all'interno di Studio eseguendo il codice come processo di addestramento all'interno del notebook. Per mostrare questa funzionalità in Studio, puoi clonare questo repository in Studio ed eseguire il notebook che si trova in GitHub repository.

Questo esempio mostra un caso d'uso di classificazione del testo binario end-to-end. Stiamo utilizzando i trasformatori Hugging Face e la libreria di set di dati per mettere a punto un trasformatore pre-addestrato sulla classificazione del testo binario. In particolare, il modello pre-addestrato sarà messo a punto utilizzando il Set di dati IMDb.

Quando si clona il repository, è necessario individuare i seguenti file:

- config.yaml – La maggior parte degli argomenti del decoratore può essere scaricata nel file di configurazione per separare le impostazioni relative all'infrastruttura dalla base di codice

- abbracciandofaccia.ipynb – Questo contiene il codice per addestrare un modello HuggingFace pre-addestrato, che verrà messo a punto utilizzando il set di dati IMDB

- requirements.txt – Questo file contiene tutte le dipendenze per eseguire la funzione che verrà utilizzata in questo notebook per eseguire il codice ed eseguire l'addestramento in remoto in un'istanza GPU come processo di addestramento

Quando si apre il notebook, verrà richiesto di configurare l'ambiente del notebook. Puoi selezionare l'immagine Data Science 3.0 con il kernel Python 3 e ml.m5.large come tipo di istanza di avvio rapido per l'esecuzione del codice notebook. Questo tipo di istanza è significativamente più veloce nell'avviare un ambiente.

Il processo di addestramento verrà eseguito in un'istanza ml.g4dn.xlarge come definito nel config.yaml file:

SchemaVersion: '1.0'

SageMaker:

PythonSDK:

Modules:

RemoteFunction:

# role arn is not required if in SageMaker Notebook instance or SageMaker Studio

# Uncomment the following line and replace with the right execution role if in a local IDE

# RoleArn: <IAM_ROLE_ARN>

InstanceType: ml.g4dn.xlarge

Dependencies: ./requirements.txtIl requirements.txt le dipendenze dei file per eseguire la funzione per l'addestramento del modello Hugging Face includono quanto segue:

datasets

transformers

torch

scikit-learn

# lock s3fs to this specific version as more recent ones introduce dependency on aiobotocore, which is not compatible with botocore

s3fs==0.4.2

sagemaker>=2.148.0,<3Il taccuino Hugging Face mostra come eseguire la formazione in remoto tramite il @remote funzione, che viene eseguita in modo sincrono. Pertanto, la funzione eseguita per l'addestramento del modello attenderà fino al completamento del processo di addestramento di SageMaker. L'addestramento verrà eseguito in remoto con un'istanza GPU in cui il tipo di istanza è definito nel file di configurazione precedente.

Dopo aver eseguito il processo di training, puoi eseguire il resto delle celle nel notebook per ispezionare le metriche di valutazione e classificare il testo nel nostro modello addestrato.

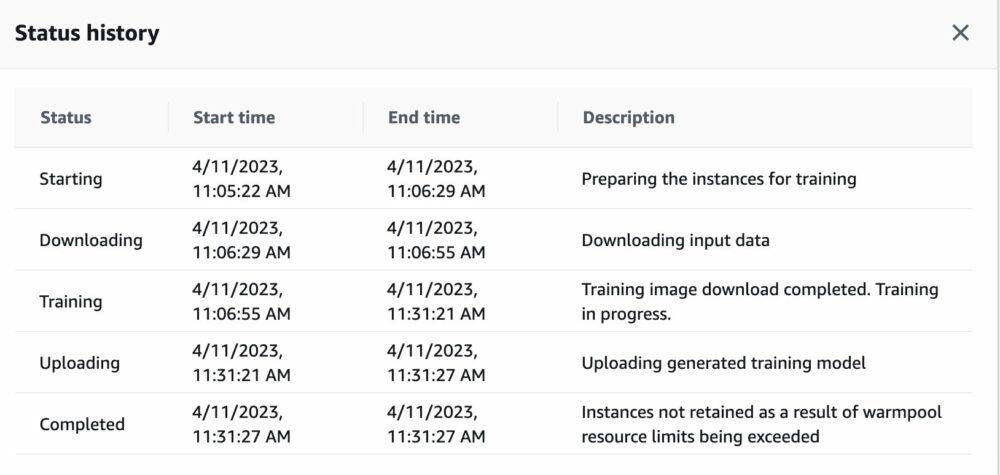

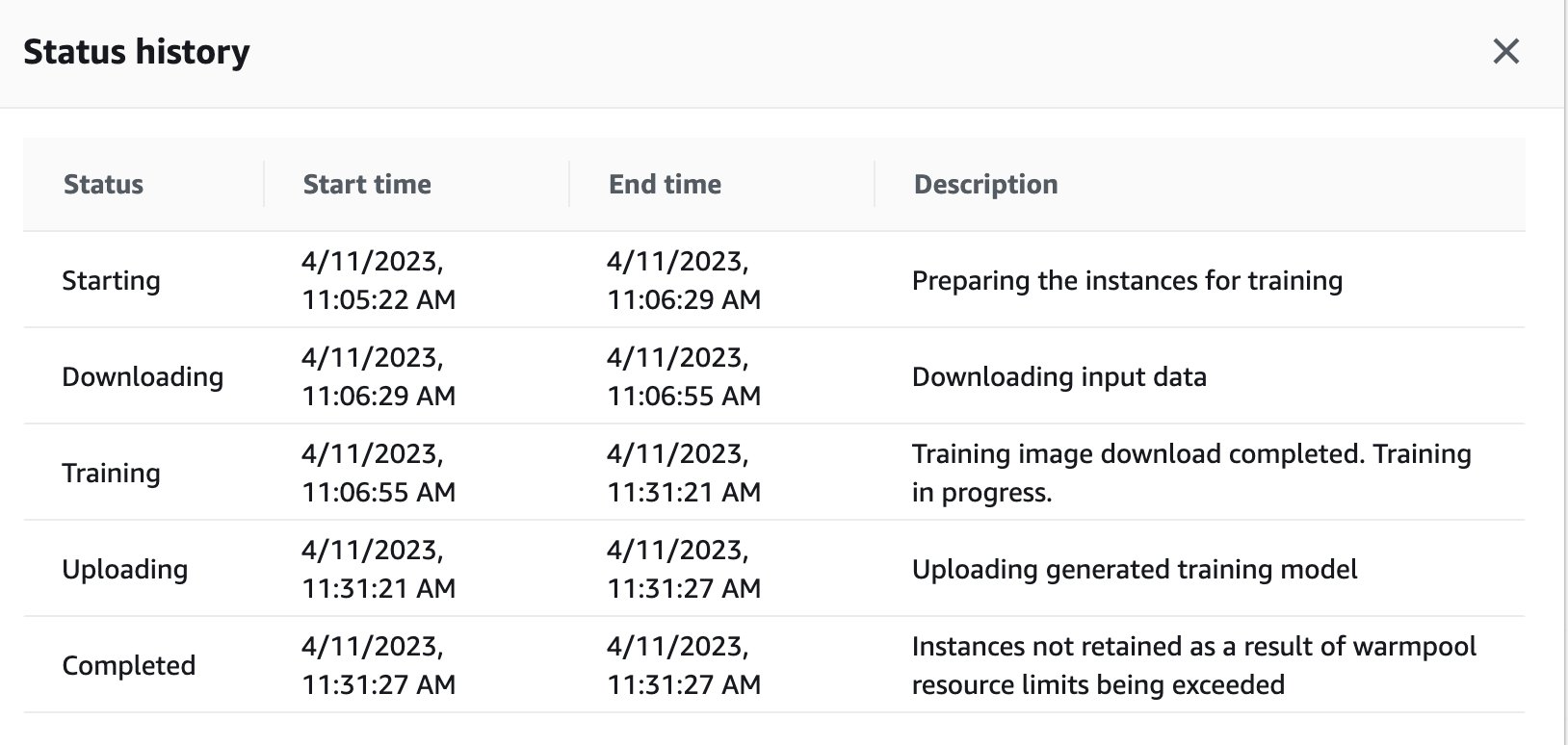

Puoi anche visualizzare lo stato del processo di addestramento che è stato attivato in remoto nell'istanza GPU sulla dashboard di SageMaker tornando alla console di SageMaker.

Non appena il lavoro di formazione è completato, continua a eseguire le istruzioni nel taccuino per la valutazione e la classificazione. Lavori simili possono essere addestrati ed eseguiti tramite la funzione esecutore remoto incorporata nei notebook Studio per eseguire le esecuzioni in modo asincrono.

Integrazione con esperimenti SageMaker all'interno di una funzione @remote

Puoi passare il nome dell'esperimento, il nome dell'esecuzione e altri parametri nella funzione remota per creare un'esecuzione degli esperimenti SageMaker. L'esempio di codice seguente importa il nome dell'esperimento, il nome dell'esecuzione e i parametri da registrare per ogni esecuzione:

from sagemaker.remote_function import remote

from sagemaker.experiments.run import Run

# Define your remote function

@remote

def train(value_1, value_2, exp_name, run_name):

...

...

#Creates the experiment

with Run( experiment_name=exp_name, run_name=run_name, sagemaker_session=sagemaker_session

) as run:

...

...

#Define values for the parameters to log

run.log_parameter("param_1", value_1)

run.log_parameter("param_2", value_2)

...

...

#Define metrics to log

run.log_metric("metric_a", 0.5)

run.log_metric("metric_b", 0.1) # Invoke your remote function

train(1.0, 2.0, "my-exp-name", "my-run-name") Nell'esempio precedente, i parametri p1 ed p2 vengono registrati nel tempo all'interno di un ciclo di addestramento. I parametri comuni possono includere la dimensione del batch o le epoche. Nell'esempio, le metriche A ed B vengono registrati per una corsa nel tempo all'interno di un ciclo di allenamento. Le metriche comuni possono includere l'accuratezza o la perdita. Per ulteriori informazioni, vedere Crea un esperimento Amazon SageMaker.

Conclusione

In questo post, abbiamo introdotto una nuova funzionalità SageMaker Python SDK che consente ai data scientist di eseguire il loro codice ML nel loro IDE preferito come lavori di SageMaker Training. Abbiamo discusso i prerequisiti necessari per utilizzare questa funzionalità insieme alle sue funzionalità. Abbiamo anche mostrato come utilizzare questa funzionalità in Studio, nelle istanze notebook SageMaker e nel tuo IDE locale. Inoltre, abbiamo fornito esempi di codice di esempio per dimostrare come utilizzare questa funzionalità. Come passaggio successivo, ti consigliamo di provare questa funzionalità nel tuo IDE o SageMaker seguendo il file esempi di codice citato in questo post.

Informazioni sugli autori

Dipankar Patrò è un Software Development Engineer presso AWS SageMaker, che innova e crea soluzioni MLOps per aiutare i clienti ad adottare soluzioni AI/ML su larga scala. Ha una laurea magistrale in Informatica e le sue aree di interesse sono Sicurezza informatica, Sistemi distribuiti e AI/ML.

Dipankar Patrò è un Software Development Engineer presso AWS SageMaker, che innova e crea soluzioni MLOps per aiutare i clienti ad adottare soluzioni AI/ML su larga scala. Ha una laurea magistrale in Informatica e le sue aree di interesse sono Sicurezza informatica, Sistemi distribuiti e AI/ML.

Farooq Sabir è Senior Artificial Intelligence and Machine Learning Specialist Solutions Architect presso AWS. Ha conseguito un dottorato di ricerca e un master in ingegneria elettrica presso l'Università del Texas ad Austin e un master in informatica presso il Georgia Institute of Technology. Ha oltre 15 anni di esperienza lavorativa e gli piace anche insegnare e fare da mentore agli studenti universitari. In AWS, aiuta i clienti a formulare e risolvere i loro problemi aziendali in data science, machine learning, visione artificiale, intelligenza artificiale, ottimizzazione numerica e domini correlati. Con sede a Dallas, in Texas, lui e la sua famiglia amano viaggiare e fare lunghi viaggi.

Farooq Sabir è Senior Artificial Intelligence and Machine Learning Specialist Solutions Architect presso AWS. Ha conseguito un dottorato di ricerca e un master in ingegneria elettrica presso l'Università del Texas ad Austin e un master in informatica presso il Georgia Institute of Technology. Ha oltre 15 anni di esperienza lavorativa e gli piace anche insegnare e fare da mentore agli studenti universitari. In AWS, aiuta i clienti a formulare e risolvere i loro problemi aziendali in data science, machine learning, visione artificiale, intelligenza artificiale, ottimizzazione numerica e domini correlati. Con sede a Dallas, in Texas, lui e la sua famiglia amano viaggiare e fare lunghi viaggi.

Manoj Ravi è Senior Product Manager per Amazon SageMaker. È appassionato di creare prodotti IA di nuova generazione e lavora su software e strumenti per semplificare l'apprendimento automatico su larga scala per i clienti. Ha conseguito un MBA presso la Haas School of Business e un Master in Information Systems Management presso la Carnegie Mellon University. Nel tempo libero, Manoj ama giocare a tennis e dedicarsi alla fotografia paesaggistica.

Manoj Ravi è Senior Product Manager per Amazon SageMaker. È appassionato di creare prodotti IA di nuova generazione e lavora su software e strumenti per semplificare l'apprendimento automatico su larga scala per i clienti. Ha conseguito un MBA presso la Haas School of Business e un Master in Information Systems Management presso la Carnegie Mellon University. Nel tempo libero, Manoj ama giocare a tennis e dedicarsi alla fotografia paesaggistica.

Shikhar Kwatra è un AI/ML Specialist Solutions Architect presso Amazon Web Services, che lavora con uno dei principali integratori di sistemi globali. Si è guadagnato il titolo di uno dei più giovani maestri inventori indiani con oltre 500 brevetti nei domini AI/ML e IoT. Shikhar aiuta a progettare, costruire e mantenere ambienti cloud scalabili ed economici per l'organizzazione e supporta il partner GSI nella creazione di soluzioni di settore strategiche su AWS. A Shikhar piace suonare la chitarra, comporre musica e praticare la consapevolezza nel tempo libero.

Shikhar Kwatra è un AI/ML Specialist Solutions Architect presso Amazon Web Services, che lavora con uno dei principali integratori di sistemi globali. Si è guadagnato il titolo di uno dei più giovani maestri inventori indiani con oltre 500 brevetti nei domini AI/ML e IoT. Shikhar aiuta a progettare, costruire e mantenere ambienti cloud scalabili ed economici per l'organizzazione e supporta il partner GSI nella creazione di soluzioni di settore strategiche su AWS. A Shikhar piace suonare la chitarra, comporre musica e praticare la consapevolezza nel tempo libero.

Vikram Elango è Sr. AI/ML Specialist Solutions Architect presso AWS, con sede in Virginia, USA. Attualmente si occupa di intelligenza artificiale generativa, LLM, ingegneria rapida, ottimizzazione dell'inferenza di modelli di grandi dimensioni e scalabilità del machine learning tra le aziende. Vikram aiuta i clienti del settore finanziario e assicurativo con leadership di progettazione e pensiero a creare e distribuire applicazioni di machine learning su larga scala. Nel tempo libero ama viaggiare, fare escursioni, cucinare e fare campeggio.

Vikram Elango è Sr. AI/ML Specialist Solutions Architect presso AWS, con sede in Virginia, USA. Attualmente si occupa di intelligenza artificiale generativa, LLM, ingegneria rapida, ottimizzazione dell'inferenza di modelli di grandi dimensioni e scalabilità del machine learning tra le aziende. Vikram aiuta i clienti del settore finanziario e assicurativo con leadership di progettazione e pensiero a creare e distribuire applicazioni di machine learning su larga scala. Nel tempo libero ama viaggiare, fare escursioni, cucinare e fare campeggio.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoAiStream. Intelligenza dei dati Web3. Conoscenza amplificata. Accedi qui.

- Coniare il futuro con Adryenn Ashley. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/run-your-local-machine-learning-code-as-amazon-sagemaker-training-jobs-with-minimal-code-changes/

- :ha

- :È

- :non

- $ SU

- 1

- 10

- 100

- 15 anni

- 500

- 7

- a

- capacità

- capace

- WRI

- accesso

- Il mio account

- precisione

- raggiunto

- operanti in

- attivo

- atti

- aggiungere

- l'aggiunta di

- aggiunta

- Admin

- amministratori

- adottare

- Avanzate

- Vantaggio

- AI

- AI / ML

- AIDS

- Tutti

- consente

- lungo

- anche

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- an

- analizzare

- ed

- ha annunciato

- in qualsiasi

- applicazioni

- SONO

- aree

- argomenti

- artificiale

- intelligenza artificiale

- Intelligenza artificiale e apprendimento automatico

- AS

- associato

- At

- austin

- automaticamente

- disponibile

- AWS

- precedente

- base

- basato

- BE

- vantaggi

- Per i bilanci

- costruire

- Costruzione

- affari

- by

- Materiale

- funzionalità

- catturare

- Carnegie Mellon

- trasportare

- Custodie

- Celle

- il cambiamento

- Modifiche

- canali

- scegliere

- classe

- classificazione

- classificare

- Cloud

- codice

- base del codice

- College

- viene

- Uncommon

- compatibile

- completamento di una

- Calcolare

- computer

- Informatica

- Computer Security

- Visione computerizzata

- concetto

- Configurazione

- consolle

- contenere

- Contenitore

- contiene

- contesti

- continua

- Nucleo

- Costo

- potuto

- coprire

- creare

- Attualmente

- Clienti

- personalizzare

- Dallas

- cruscotto

- dati

- elaborazione dati

- scienza dei dati

- dataset

- dichiara

- Predefinito

- defaults

- definito

- dimostrare

- dimostra

- Dipendenza

- schierare

- descritta

- Design

- dettagli

- sviluppato

- Costruttori

- Mercato

- diverso

- discusso

- distribuito

- sistemi distribuiti

- formazione distribuita

- domini

- fatto

- Dont

- durante

- e

- ogni

- guadagnato

- facilità d'uso

- più facile

- facilmente

- o

- incorporato

- Abilita

- crittografia

- da un capo all'altro

- ingegnere

- Ingegneria

- Ingegneri

- aziende

- iscrizione

- Ambiente

- ambienti

- epoca

- epoche

- valutazione

- Ogni

- esempio

- Esempi

- esecuzione

- esistente

- esperienza

- esperimento

- Faccia

- familiare

- famiglia

- FAST

- più veloce

- caratteristica

- Caratteristiche

- pochi

- Compila il

- File

- finanziario

- Nome

- Flessibilità

- Focus

- concentrato

- i seguenti

- Nel

- Contesto

- da

- completamente

- function

- funzioni

- Inoltre

- futuro

- Futures

- generativo

- AI generativa

- Georgia

- dato

- globali

- Go

- GPU

- Gruppo

- Avere

- he

- Aiuto

- aiuta

- il suo

- detiene

- Come

- Tutorial

- HTML

- http

- HTTPS

- abbracciare il viso

- Identità

- if

- Immagine

- implementazione

- importare

- importazioni

- in

- includere

- Compreso

- indiano

- industria

- informazioni

- Sistemi di informazione

- Infrastruttura

- innovare

- ingresso

- installato

- esempio

- Istituto

- istruzioni

- assicurazione

- integrato

- Integra

- Intelligence

- interesse

- ai miglioramenti

- introdurre

- introdotto

- Inventori

- IoT

- IT

- iterazioni

- SUO

- Lavoro

- Offerte di lavoro

- jpg

- ad appena

- Le

- laboratorio

- paesaggio

- computer portatili

- grandi

- larga scala

- con i più recenti

- lanciare

- lanciato

- lancio

- Leadership

- principale

- IMPARARE

- apprendimento

- lasciare

- Consente di

- biblioteche

- Biblioteca

- ciclo di vita

- piace

- piace

- linea

- locale

- a livello locale

- collocato

- ceppo

- registrati

- Lunghi

- SEMBRA

- spento

- amore

- macchina

- machine learning

- fatto

- Mantenere

- make

- FA

- gestito

- gestione

- direttore

- Mastercard

- Maggio..

- Mellon

- Metodologia

- Metrica

- Mindfulness

- minimo

- Minuti

- ML

- MLOp

- Moda

- modello

- modelli

- moduli

- Scopri di più

- maggior parte

- cambiano

- MS

- multiplo

- Musica

- Nome

- cioè

- navigazione

- Bisogno

- di applicazione

- Rete

- internazionale

- New

- GENERAZIONE

- nodi

- taccuino

- adesso

- numpy

- oggetti

- of

- on

- Onboard

- una volta

- ONE

- esclusivamente

- aprire

- open source

- ottimizzazione

- or

- minimo

- organizzazione

- OS

- Altro

- nostro

- su

- produzione

- ancora

- Override

- pacchetto

- Packages

- panda

- Parallel

- parametri

- particolare

- partner

- passare

- Passi

- Di passaggio

- appassionato

- Brevetti

- sentiero

- performance

- fotografia

- piattaforma

- Platone

- Platone Data Intelligence

- PlatoneDati

- gioco

- punto

- Post

- preferito

- prerequisiti

- precedente

- Problema

- problemi

- lavorazione

- Prodotto

- product manager

- produttivo

- Prodotti

- purché

- Python

- pytorch

- pronto

- recente

- recentemente

- raccomandare

- relazionato

- rilasciare

- a distanza

- sostituire

- deposito

- necessario

- Requisiti

- REST

- ritorno

- strada

- Ruolo

- ruoli

- Correre

- running

- sagemaker

- scalabile

- Scala

- scala

- di moto

- Scienze

- scienziati

- scikit-impara

- sdk

- senza soluzione di continuità

- Sezione

- sezioni

- problemi di

- vedere

- anziano

- separato

- Servizi

- Sessione

- set

- regolazione

- impostazioni

- flessibile.

- alcuni

- dovrebbero

- mostrare attraverso le sue creazioni

- vetrina

- mostrato

- Spettacoli

- significativamente

- simile

- Un'espansione

- semplicemente

- singolo

- Taglia

- piccole

- Istantanea

- So

- Software

- lo sviluppo del software

- Soluzioni

- RISOLVERE

- specialista

- specifico

- specificazione

- specificato

- inizia a

- Di partenza

- Stato dei servizi

- step

- conservazione

- Strategico

- Gli studenti

- studio

- inviare

- sottoreti

- tale

- supportato

- supporti

- sistema

- SISTEMI DI TRATTAMENTO

- Fai

- prende

- presa

- task

- le squadre

- Tecnologia

- tensorflow

- Texas

- Classificazione del testo

- che

- Il

- loro

- Li

- poi

- Là.

- in tal modo

- perciò

- Strumenti Bowman per analizzare le seguenti finiture:

- di

- questo

- pensiero

- leadership di pensiero

- Attraverso

- tempo

- Titolo

- a

- strumenti

- torcia

- verso

- Treni

- allenato

- Training

- trasformatori

- viaggiare

- Di viaggio

- innescato

- Digitare

- tipicamente

- per

- capire

- Università

- Aggiornanento

- us

- uso

- caso d'uso

- utilizzato

- utenti

- utilizzando

- APPREZZIAMO

- Valori

- versione

- via

- Visualizza

- Virginia

- visione

- vs

- vs codice

- aspettare

- volere

- we

- sito web

- servizi web

- quando

- quale

- while

- volere

- con

- entro

- Lavora

- lavoro

- lavori

- sarebbe

- avvolgere

- Avvolto

- scrivere

- scrivere codice

- scritto

- X

- anni

- Tu

- Minore

- Trasferimento da aeroporto a Sharm

- zefiro