PyTorch היא מסגרת למידת מכונה (ML) שנמצאת בשימוש נרחב על ידי לקוחות AWS עבור מגוון יישומים, כגון ראייה ממוחשבת, עיבוד שפה טבעית, יצירת תוכן ועוד. עם המהדורה האחרונה של PyTorch 2.0, לקוחות AWS יכולים כעת לעשות את אותם דברים שהם יכולים לעשות עם PyTorch 1.x אך מהר יותר ובקנה מידה עם מהירויות אימון משופרות, שימוש נמוך יותר בזיכרון ויכולות מבוזרות משופרות. מספר טכנולוגיות חדשות כולל torch.compile, TorchDynamo, AOTAutograd, PrimTorch ו-TorchInductor נכללו במהדורת PyTorch2.0. מתייחס PyTorch 2.0: מהדורת הדור הבא שלנו, מהירה יותר, פייתונית ודינאמית מתמיד לקבלת פרטים.

פוסט זה מדגים את הביצועים והקלות של הפעלת הדרכה ופריסה של מודל ML מבוזר בקנה מידה גדול ובעל ביצועים גבוהים באמצעות PyTorch 2.0 ב-AWS. פוסט זה מוביל בהמשך יישום שלב אחר שלב של כוונון עדין של מודל RobERTa (גישת קדם אימון אופטימלית של BERT) לניתוח סנטימנטים באמצעות AMIs למידה עמוקה של AWS (AWS DLAMI) ו מיכלי למידה עמוקה של AWS (DLCs) פועל ענן מחשוב אלסטי של אמזון (Amazon EC2 p4d.24xlarge) עם מהירות נצפית של 42% בשימוש עם PyTorch 2.0 torch.compile + bf16 + fused AdamW. לאחר מכן נפרס על הדגם המכוונן AWS Gravitonמבוסס על מופע C7g EC2 אמזון SageMaker עם מהירות נצפית של 10% בהשוואה ל-PyTorch 1.13.

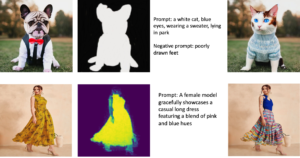

האיור הבא מציג רף ביצועים של כוונון עדין של דגם RobERTa ב-Amazon EC2 p4d.24xlarge עם AWS PyTorch 2.0 DLAMI + DLC.

עיין הסקת PyTorch 2.0 אופטימלית עם מעבדי AWS Graviton לפרטים על מדדי ביצועי הסקת מופעים מבוססי AWS Graviton עבור PyTorch 2.0.

תמיכה ב- PyTorch 2.0 ב-AWS

התמיכה ב-PyTorch2.0 אינה מוגבלת לשירותים ולמחשוב המוצגים בדוגמה לשימוש בפוסט זה; זה משתרע לרבים אחרים ב-AWS, עליהם אנו דנים בסעיף זה.

דרישה עסקית

לקוחות AWS רבים, על פני מערך מגוון של תעשיות, משנים את העסקים שלהם על ידי שימוש בבינה מלאכותית (AI), במיוחד בתחום של AI גנרטיבי ומודלים של שפות גדולות (LLMs) שנועדו ליצור טקסט דמוי אדם. אלה בעצם מודלים גדולים המבוססים על טכניקות למידה עמוקה שמאומנים במאות מיליארדי פרמטרים. הגידול במידות הדגמים מגדיל את זמן האימון מימים לשבועות, ואפילו חודשים במקרים מסוימים. זה מוביל לעלייה אקספוננציאלית בעלויות ההדרכה וההסקה, מה שדורש, יותר מתמיד, מסגרת כמו PyTorch 2.0 עם תמיכה מובנית של אימון מודלים מואץ ותשתית אופטימלית של AWS המותאמת לעומסי העבודה ולצורכי הביצועים הספציפיים.

בחירת מחשוב

AWS מספקת תמיכה ב-PyTorch 2.0 במבחר הרחב ביותר של מחשוב רב עוצמה, רשתות במהירות גבוהה ואפשרויות אחסון בעלות ביצועים גבוהים שניתן להרחיב בהן אתה יכול להשתמש עבור כל פרויקט או יישום ML ולהתאים אישית כדי להתאים לדרישות הביצועים והתקציב שלך. זה בא לידי ביטוי בתרשים בסעיף הבא; בשכבה התחתונה, אנו מספקים מבחר רחב של מופעי מחשוב המופעלים על ידי מעבדי AWS Graviton, Nvidia, AMD ו-Intel.

עבור פריסות דגמים, אתה יכול להשתמש במעבדים מבוססי ARM כגון המופע מבוסס AWS Graviton שהוכרז לאחרונה המספק ביצועי הסקה עבור PyTorch 2.0 עם עד פי 3.5 מהמהירות עבור Resnet50 בהשוואה למהדורת PyTorch הקודמת, ועד פי 1.4 מהירות עבור BERT, מה שהופך את המופעים מבוססי ה-AWS Graviton למופעים המותאמים למחשוב המהירים ביותר ב-AWS עבור פתרונות הסקת מודל מבוססי CPU.

מבחר שירותי ML

כדי להשתמש במחשוב AWS, אתה יכול לבחור מתוך קבוצה רחבה של שירותים מבוססי ענן גלובליים לפיתוח ML, מחשוב ותזמור זרימת עבודה. בחירה זו מאפשרת לך ליישר קו עם האסטרטגיות העסקיות והענן שלך ולהפעיל עבודות PyTorch 2.0 בפלטפורמה שתבחר. לדוגמה, אם יש לך הגבלות מקומיות או השקעות קיימות במוצרי קוד פתוח, אתה יכול להשתמש באמזון EC2, ParallelCluster של AWS, או AWS UltraCluster להפעיל עומסי עבודה של הדרכה מבוזרת המבוססת על גישה בניהול עצמי. אתה יכול גם להשתמש בשירות מנוהל במלואו כמו SageMaker עבור תשתית הדרכה מותאמת לעלות, מנוהלת במלואה ובקנה מידה ייצור. SageMaker גם משתלב עם כלים שונים של MLOps, המאפשרים לך להגדיל את פריסת המודל שלך, להפחית עלויות מסקנות, לנהל מודלים בצורה יעילה יותר בייצור ולהפחית את העומס התפעולי.

באופן דומה, אם יש לך השקעות קיימות של Kubernetes, אתה יכול גם להשתמש שירות קוברנט של אמזון (אמזון EKS) ו Kubeflow ב-AWS ליישם צינור ML להדרכה מבוזרת או להשתמש בשירות תזמור קונטיינר מקורי של AWS כמו שירות מיכלים אלסטי של אמזון (Amazon ECS) לאימון מודלים ופריסה. האפשרויות לבניית פלטפורמת ה-ML שלך אינן מוגבלות לשירותים אלה; אתה יכול לבחור בהתאם לדרישות הארגוניות שלך עבור משרות PyTorch 2.0 שלך.

הפעלת PyTorch 2.0 עם AWS DLAMI ו-AWS DLC

כדי להשתמש בערימה האמורה של שירותי AWS ומחשוב רב עוצמה, עליך להתקין גרסת קומפילציה אופטימלית של מסגרת PyTorch2.0 והתלות הנדרשת שלה, שרבים מהם הם פרויקטים עצמאיים, ולבדוק אותם מקצה לקצה. ייתכן שתזדקק גם לספריות ספציפיות ל-CPU עבור שגרות מתמטיקה מואצות, ספריות ספציפיות ל-GPU עבור שגרות תקשורת מואצת של מתמטיקה ואינטר-GPU, ומנהלי התקנים של GPU שצריכים להיות מיושרים עם מהדר ה-GPU המשמש לקומפילציה של ספריות ה-GPU. אם התפקידים שלך דורשים הכשרה מרובה-צמתים בקנה מידה גדול, אתה צריך רשת אופטימלית שיכולה לספק את השהיה הנמוכה ביותר והתפוקה הגבוהה ביותר. לאחר שתבנה את המחסנית שלך, עליך לסרוק ולתקן אותן באופן קבוע לאיתור פרצות אבטחה ולבנות מחדש ולבדוק מחדש את המחסנית לאחר כל שדרוג גרסת מסגרת.

AWS עוזרת להפחית את המשימות הכבדות הללו על ידי הצעת מערך מאובטח ומאובטח של מסגרות, תלות וכלים להאצת למידה עמוקה בענן. AWS DLAMIs ו DLCs של AWS. תמונות מכונות ומכולות אלה שנבנו מראש ונבדקו מותאמים ללמידה עמוקה בסוגי מופעי מחשוב מואצים של EC2, ומאפשרים לך להרחיב את הגודל לצמתים מרובים עבור עומסי עבודה מבוזרים בצורה יעילה וקלה יותר. הוא כולל פריט בנוי מראש מתאם בד אלסטי (EFA), מחסנית GPU של Nvidia ומסגרות למידה עמוקה רבות (TensorFlow, MXNet ו-PyTorch עם המהדורה האחרונה של 2.0) להדרכה מבוזרת בעלת ביצועים גבוהים. אינך צריך להשקיע זמן בהתקנה ופתרון בעיות של תוכנות למידה עמוקה ומנהלי התקנים או בניית תשתית ML, וגם אינך צריך לשאת בעלות החוזרת של תיקון תמונות אלה עבור פרצות אבטחה או יצירה מחדש של התמונות לאחר כל שדרוג גרסת מסגרת חדשה. במקום זאת, אתה יכול להתמקד במאמץ בעל ערך מוסף גבוה יותר של עבודות הכשרה בקנה מידה בפרק זמן קצר יותר וחזרה על דגמי ה-ML שלך מהר יותר.

סקירת פתרונות

בהתחשב בכך שהדרכה על GPU והסקת מסקנות על CPU היא מקרה שימוש פופולרי עבור לקוחות AWS, כללנו כחלק מפוסט זה יישום שלב אחר שלב של ארכיטקטורה היברידית (כפי שמוצג בתרשים הבא). נחקור את אמנות האפשר ונשתמש במופע P4 EC2 עם תמיכה ב-BF16 המאוחל עם Base GPU DLAMI כולל מנהלי התקנים של NVIDIA, CUDA, NCCL, EFA stack ו- PyTorch2.0 DLC לכוונון עדין של מודל ניתוח סנטימנטים של RobERTa המעניק לך שליטה וגמישות לשימוש בכל ספריות קוד פתוח או קנייניות. לאחר מכן אנו משתמשים ב-SageMaker עבור תשתית אירוח מודל מנוהלת במלואה כדי לארח את המודל שלנו על מבוסס AWS Graviton3 מופעי C7g. בחרנו ב-C7g ב-SageMaker מכיוון שהוכח שהוא מפחית את עלויות ההסקה בשיעור של עד 50% ביחס למקרי EC2 דומים עבור מסקנות בזמן אמת ב- SageMaker. התרשים הבא ממחיש ארכיטקטורה זו.

אימון המודל והאירוח במקרה שימוש זה מורכב מהשלבים הבאים:

- הפעל מופע EC2 Ubuntu מבוסס GPU DLAMI ב-VPC שלך והתחבר למופע שלך באמצעות SSH.

- לאחר שתתחבר למופע ה-EC2 שלך, הורד את AWS PyTorch 2.0 DLC.

- הפעל את מיכל ה-DLC שלך עם סקריפט אימון מודל כדי לכוונן את מודל ה-RoBERTa.

- לאחר השלמת הכשרת המודל, ארוז את המודל שנשמר, סקריפטים להסקת מסקנות וכמה קבצי מטא נתונים לקובץ tar שהסקת SageMaker יכולה להשתמש בו ולהעלות את חבילת המודל לקובץ שירות אחסון פשוט של אמזון (אמזון S3) דלי.

- פרוס את המודל באמצעות SageMaker וצור נקודת קצה להסקת HTTPS. נקודת הקצה של SageMaker מכילה מאזן עומסים ומופע אחד או יותר של מיכל ההסקה שלך באזורי זמינות שונים. אתה יכול לפרוס גרסאות מרובות של אותו דגם או מודלים שונים לחלוטין מאחורי נקודת קצה יחידה זו. בדוגמה זו, אנו מארחים דגם בודד.

- הפעל את נקודת הקצה של הדגם שלך על ידי שליחת נתוני בדיקה ואמת את פלט ההסקה.

בסעיפים הבאים, אנו מציגים כוונון עדין של מודל RobERTa לניתוח סנטימנטים. רוברטה פותחה על ידי Facebook AI, תוך שיפור במודל BERT הפופולרי על ידי שינוי הפרמטרים המפתחים והכשרה מוקדמת על קורפוס גדול יותר. זה מוביל לשיפור הביצועים בהשוואה לוניל BERT.

אנו משתמשים רוֹבּוֹטרִיקִים הספרייה של Hugging Face כדי להכשיר מראש את מודל ה-RoBERTa בכ-124 מיליון ציוצים, ואנו מכווננים אותו במערך הנתונים של טוויטר לניתוח סנטימנטים.

תנאים מוקדמים

ודא שאתה עומד בדרישות הקדם הבאות:

- יש לך חשבון AWS.

- ודא שאתה נמצא ב

us-west-2אזור להפעיל את הדוגמה הזו. (דוגמה זו נבדקה בus-west-2; עם זאת, אתה יכול לרוץ בכל אזור אחר.) - צור תפקיד עם השם

sagemakerrole. הוסף מדיניות מנוהלתAmazonSageMakerFullAccessוAmazonS3FullAccessכדי לתת ל-SageMaker גישה לדלי S3. - צור תפקיד EC2 עם השם

ec2_role. השתמש במדיניות ההרשאות הבאה:

1. הפעל את מופע הפיתוח שלך

אנו יוצרים מופע p4d.24xlarge המציע 8 NVIDIA A100 Tensor Core GPUs ב us-west-2:

בעת בחירת AMI, עקוב אחר ה- מכתבי שחרור כדי להפעיל פקודה זו באמצעות ה ממשק שורת הפקודה של AWS (AWS CLI) כדי למצוא את מזהה AMI להשתמש בו us-west-2:

ודא שגודל נפח השורש של gp3 הוא 200 GiB.

הצפנת נפח EBS אינה מופעלת כברירת מחדל. שקול לשנות זאת בעת העברת פתרון זה לייצור.

2. הורד קונטיינר ללמידה עמוקה

DLCs של AWS זמינים כתמונות Docker ב אמזון אלסטי מיכל רישום ציבורי, שירות רישום תמונות מיכל של AWS מנוהל שהוא מאובטח, ניתן להרחבה ואמין. כל תמונת Docker בנויה להדרכה או הסקה על גרסת מסגרת למידה עמוקה ספציפית, גרסת Python, עם תמיכה במעבד או GPU. בחר את המסגרת של PyTorch 2.0 מרשימת הזמינים תמונות מיכלי למידה עמוקה.

השלם את השלבים הבאים כדי להוריד את ה-DLC שלך:

א. SSH למופע. כברירת מחדל, קבוצת האבטחה המשמשת עם EC2 פותחת את יציאת SSH לכולם. אנא שקול זאת אם אתה מעביר את הפתרון הזה לייצור:

כברירת מחדל, קבוצת האבטחה המשמשת עם Amazon EC2 פותחת את יציאת SSH לכולם. שקול לשנות זאת אם אתה מעביר את הפתרון הזה לייצור.

ב. הגדר את משתני הסביבה הדרושים להפעלת השלבים הנותרים של יישום זה:

Amazon ECR תומך במאגרי תמונות ציבוריים עם הרשאות מבוססות משאבים באמצעות AWS זהות וניהול גישה (IAM) כך שמשתמשים או שירותים ספציפיים יוכלו לגשת לתמונות.

ג. היכנס לרישום DLC:

ד. משוך פנימה את מיכל PyTorch 2.0 העדכני ביותר עם תמיכה ב-GPU us-west-2

אם אתה מקבל את השגיאה "לא נותר מקום במכשיר", ודא שאתה להגביר נפח EC2 EBS ל-200 GiB ולאחר מכן להאריך מערכת הקבצים לינוקס.

3. שכבו את הסקריפטים העדכניים ביותר שהותאמו ל- PyTorch 2.0

שכבו את הסקריפטים עם הקוד הבא:

מכיוון שאנו משתמשים ב-Hugging Face transformers API עם הגרסה העדכנית ביותר 4.28.1, הוא כבר אפשר תמיכה ב-PyTorch 2.0. הוספנו את הארגומנט הבא ל-trainer API ב train_sentiment.py כדי להפעיל תכונות חדשות של PyTorch 2.0:

- לפיד קומפילציה - חווה מהירות ממוצעת של 43% ב-Nvidia A100 GPUs עם קו שינוי יחיד.

- BF16 סוג נתונים - תמיכה בסוג נתונים חדש (נקודה צפה במוח) עבור GPUs אמפר או חדשים יותר.

- אופטימיזציית AdamW התמזגה - מימוש AdamW התמזג כדי להאיץ עוד יותר את האימונים. שיטת אופטימיזציה סטוכסטית זו משנה את היישום הטיפוסי של דעיכה במשקל באדם על ידי ניתוק ריקבון משקל מעדכון הגרדיאנט.

4. בנה תמונת Docker חדשה עם תלות

אנו מרחיבים את תמונת PyTorch 2.0 DLC הבנויה מראש כדי להתקין את שנאי Hugging Face וספריות אחרות שאנו צריכים כדי לכוונן את הדגם שלנו. זה מאפשר לך להשתמש בספריות ובהגדרות של למידה עמוקה שנבדקו והמוטבים הכלולים מבלי ליצור תמונה מאפס. ראה את הקוד הבא:

5. התחל אימון באמצעות המיכל

הפעל את פקודת Docker הבאה כדי להתחיל בכוונון עדין של הדגם ב- tweet_eval מערך נתונים של סנטימנטים. אנו משתמשים בארגומנטים של ה-Docker Container (גודל זיכרון משותף, מקסימום זיכרון נעול וגודל מחסנית) מומלץ על ידי Nvidia לעומסי עבודה של למידה עמוקה.

אתה צריך לצפות לפלט הבא. התסריט מוריד תחילה את מערך הנתונים TweetEval, המורכב משבע משימות הטרוגניות בטוויטר, כולן ממוסגרות כסיווג ציוצים רב-מעמדי. המשימות כוללות אירוניה, שנאה, פגיעה, עמדה, אימוג'י, רגש וסנטימנט.

לאחר מכן, הסקריפט מוריד את מודל הבסיס ומתחיל את תהליך הכוונון העדין. מדדי הדרכה והערכה מדווחים בסוף כל תקופה.

נתונים סטטיסטיים על ביצועים

עם PyTorch 2.0 וספריית השנאים העדכנית ביותר של Hugging Face 4.28.1, ראינו מהירות של 42% במופע יחיד של p4d.24xlarge עם 8 A100 40GB GPUs. שיפורי הביצועים מגיעים משילוב של torch.compile, סוג הנתונים BF16 ו-AdamW האופטימיזציה הממוזגת. הקוד הבא הוא התוצאה הסופית של שתי ריצות אימון עם ובלי תכונות חדשות:

6. בדוק את הדגם המאומן באופן מקומי לפני הכנה להסקת SageMaker

תוכל למצוא את הקבצים הבאים תחת $ml_working_dir/saved_model/ אחרי אימון:

בואו נוודא שנוכל להפעיל הסקה מקומית לפני שנתכונן להסקת SageMaker. אנו יכולים לטעון את המודל השמור ולהפעיל הסקה מקומית באמצעות ה test_trained_model.py תַסרִיט:

אתה צריך לצפות לפלט הבא עם הקלט "מקרי קוביד גדלים במהירות!":

7. הכן את הדגם Tarball להסקת SageMaker

מתחת לספרייה שבה נמצא הדגם, צור ספרייה חדשה בשם code:

בספרייה החדשה, צור את הקובץ inference.py והוסיפו לו את הדברים הבאים:

בסופו של דבר, אמור להיות לך מבנה התיקיות הבא:

הדגם מוכן לארוז ולהעלות לאמזון S3 לשימוש עם מסקנות של SageMaker:

8. פרוס את המודל על מופע SageMaker AWS Graviton

דורות חדשים של מעבדים מציעים שיפור משמעותי בביצועים בהסקת ML הודות להוראות מובנות מיוחדות. במקרה שימוש זה, אנו משתמשים בתשתית אירוח המנוהלת במלואה של SageMaker עם מופעי C3g מבוססי AWS Graviton7. AWS גם מדדה עד 50% חיסכון בעלויות עבור מסקנות PyTorch עם מופעי EC3 C2g מבוססי AWS Graviton7 על פני Torch Hub ResNet50, ומספר דגמי Hugging Face ביחס למופעי EC2 דומים.

כדי לפרוס את המודלים למופעי AWS Graviton, אנו משתמשים ב-AWS DLCs המספקים תמיכה עבור PyTorch 2.0 ו-TorchServe 0.8.0, או שאתה יכול הביאו מכולות משלכם התואמים לארכיטקטורת ARMv8.2.

אנו משתמשים במודל שאימנו קודם לכן: s3://<your-s3-bucket>/twitter-roberta-base-sentiment-latest.tar.gz. אם לא השתמשת ב- SageMaker בעבר, בדוק התחל לעבוד עם Amazon SageMaker.

כדי להתחיל, ודא שחבילת SageMaker מעודכנת:

מכיוון שזו דוגמה, צור קובץ בשם start_endpoint.py והוסיפו את הקוד הבא. זה יהיה הסקריפט של Python כדי להתחיל נקודת קצה של מסקנות של SageMaker עם המצב:

אנו משתמשים ב-ml.c7g.4xlarge עבור המופע ומחזירים PT 2.0 עם היקף תמונה inference_graviton. זהו מופע ה-AWS Graviton3 שלנו.

לאחר מכן, אנו יוצרים את הקובץ שמריץ את החיזוי. אנחנו עושים את זה כתסריטים נפרדים כדי שנוכל להריץ את התחזיות כמה פעמים שנרצה. לִיצוֹר predict.py עם הקוד הבא:

עם הסקריפטים שנוצרו, נוכל כעת להתחיל נקודת קצה, לבצע תחזיות כנגד נקודת הקצה, ולנקות כשנסיים:

9. לנקות

לבסוף, אנחנו רוצים לנקות מהדוגמה הזו. צור cleanup.py והוסף את הקוד הבא:

סיכום

AWS DLAMIs ו-DLCs הפכו לסטנדרט הרצוי להפעלת עומסי עבודה של למידה עמוקה במבחר רחב של שירותי מחשוב ו-ML ב-AWS. לצד השימוש ב-DLC ספציפי למסגרת בשירותי AWS ML, אתה יכול גם להשתמש במסגרת יחידה ב-Amazon EC2, אשר מסירה את המשימות הכבדות הנדרשות למפתחים כדי לבנות ולתחזק יישומי למידה עמוקה. מתייחס הערות שחרור עבור DLAMI ו תמונות מכולות זמינות למידה עמוקה כדי להתחיל בעבודה.

פוסט זה הראה אפשרות אחת מיני רבות להכשיר ולשרת את המודל הבא שלך ב-AWS ודן בכמה פורמטים שתוכל לאמץ כדי לעמוד ביעדים העסקיים שלך. נסה את הדוגמה הזו או השתמש בשירותי AWS ML האחרים שלנו כדי להרחיב את פרודוקטיביות הנתונים עבור העסק שלך. כללנו בעיה פשוטה של ניתוח סנטימנטים כדי שלקוחות חדשים ב-ML יוכלו להבין כמה פשוט להתחיל עם PyTorch 2.0 ב-AWS. אנו נסקור מקרי שימוש מתקדמים יותר, דגמים וטכנולוגיות AWS בפוסטים הבאים בבלוג.

על המחברים

Kanwaljit Khurmi הוא אדריכל פתרונות ראשי בשירותי האינטרנט של אמזון. הוא עובד עם לקוחות AWS כדי לספק הדרכה וסיוע טכני שעוזרים להם לשפר את הערך של הפתרונות שלהם בעת השימוש ב-AWS. Kanwaljit מתמחה בסיוע ללקוחות עם יישומי מכולות ולמידת מכונה.

Kanwaljit Khurmi הוא אדריכל פתרונות ראשי בשירותי האינטרנט של אמזון. הוא עובד עם לקוחות AWS כדי לספק הדרכה וסיוע טכני שעוזרים להם לשפר את הערך של הפתרונות שלהם בעת השימוש ב-AWS. Kanwaljit מתמחה בסיוע ללקוחות עם יישומי מכולות ולמידת מכונה.

מייק שניידר הוא מפתח מערכות, שבסיסו בפיניקס AZ. הוא חבר בקונטיינרים של Deep Learning, התומך בתמונות מיכל שונות של Framework, כולל Graviton Inference. הוא מסור ליעילות ויציבות התשתית.

מייק שניידר הוא מפתח מערכות, שבסיסו בפיניקס AZ. הוא חבר בקונטיינרים של Deep Learning, התומך בתמונות מיכל שונות של Framework, כולל Graviton Inference. הוא מסור ליעילות ויציבות התשתית.

לאי ווי הוא מהנדס תוכנה בכיר בחברת Amazon Web Services. הוא מתמקד בבניית מסגרות למידה עמוקה קלות לשימוש, בעלות ביצועים גבוהים וניתנות להרחבה להאצת אימון מודלים מבוזרים. מחוץ לעבודה, הוא נהנה לבלות עם משפחתו, לטייל ולעשות סקי.

לאי ווי הוא מהנדס תוכנה בכיר בחברת Amazon Web Services. הוא מתמקד בבניית מסגרות למידה עמוקה קלות לשימוש, בעלות ביצועים גבוהים וניתנות להרחבה להאצת אימון מודלים מבוזרים. מחוץ לעבודה, הוא נהנה לבלות עם משפחתו, לטייל ולעשות סקי.

- הפצת תוכן ויחסי ציבור מופעל על ידי SEO. קבל הגברה היום.

- PlatoAiStream. Web3 Data Intelligence. הידע מוגבר. גישה כאן.

- הטבעת העתיד עם אדריאן אשלי. גישה כאן.

- קנה ומכירה של מניות בחברות PRE-IPO עם PREIPO®. גישה כאן.

- מקור: https://aws.amazon.com/blogs/machine-learning/part-1-build-high-performance-ml-models-using-pytorch-2-0-on-aws/

- :יש ל

- :הוא

- :לֹא

- :איפה

- $ למעלה

- 1

- 10

- 100

- 11

- 12

- 13

- 14

- 15%

- 16

- 17

- 20

- 200

- 23

- 25

- 26%

- 28

- 31

- 7

- 8

- 9

- a

- להאיץ

- מוּאָץ

- מאיצה

- לְקַבֵּל

- גישה

- לרוחב

- פעולה

- אדם

- להוסיף

- הוסיף

- לְאַמֵץ

- מתקדם

- לאחר

- נגד

- AI

- ליישר

- מיושר

- תעשיות

- להתיר

- מאפשר

- מאפשר

- לאורך

- כְּבָר

- גם

- אמזון בעברית

- אמזון

- אמזון שירותי אינטרנט

- AMD

- כמות

- an

- אנליזה

- לנתח

- ו

- הודיע

- אחר

- כל

- API

- בקשה

- יישומים

- גישה

- בערך

- ארכיטקטורה

- ARE

- AREA

- טענה

- טיעונים

- מלאכותי

- בינה מלאכותית

- בינה מלאכותית (AI)

- AS

- סיוע

- At

- זמינות

- זמין

- מְמוּצָע

- AWS

- איזון

- בסיס

- מבוסס

- בעיקרון

- BE

- כי

- להיות

- היה

- לפני

- להתחיל

- מאחור

- בנצ 'מרק

- מבחני ביצועים

- גָדוֹל

- מיליארדים

- BIN

- בלוג

- בלוג הודעות

- גוּף

- תַחתִית

- מוֹחַ

- רחב

- תקציב

- לִבנוֹת

- בִּניָן

- נבנה

- מובנה

- ניטל

- עסקים

- עסקים

- אבל

- by

- שיחה

- נקרא

- קוראים

- CAN

- יכולות

- מקרה

- מקרים

- CD

- שינוי

- משתנה

- בחירה

- בחרו

- מיון

- לקוחות

- ענן

- קוד

- COM

- שילוב

- מגיע

- תקשורת

- השוואה

- לעומת

- תואם

- להשלים

- לחשב

- המחשב

- ראייה ממוחשבת

- מחשוב

- לְחַבֵּר

- לשקול

- מורכב

- קונסול

- מכולה

- מכולות

- תוכן

- יצירת תוכן

- לִשְׁלוֹט

- ליבה

- עלות

- חיסכון עלויות

- עלויות

- יכול

- כיסוי

- לִיצוֹר

- נוצר

- יצירה

- אישורים

- אוצר

- נוֹכְחִי

- לקוחות

- אישית

- נתונים

- תַאֲרִיך

- ימים

- מוקדש

- עמוק

- למידה עמוקה

- בְּרִירַת מֶחדָל

- מדגים

- תלוי

- לפרוס

- פרס

- פריסה

- פריסות

- מעוצב

- פרטים

- מפותח

- מפתח

- מפתחים

- צעצועי התפתחות

- אחר

- תקציר

- לדון

- נָדוֹן

- מופץ

- הכשרה מבוזרת

- שונה

- do

- סַוָר

- עשה

- לא

- להורדה

- הורדות

- נהג

- נהגים

- נהיגה

- ראוי

- דינמי

- כל אחד

- מוקדם יותר

- להקל

- בקלות

- קל

- השפעה

- יעילות

- יְעִילוּת

- יעילות

- מאמץ

- או

- לאפשר

- מופעל

- הצף

- סוף

- נקודת קצה

- מהנדס

- משופר

- לַחֲלוּטִין

- סביבה

- תקופה

- שגיאה

- להעריך

- הערכה

- אֲפִילוּ

- אי פעם

- כל

- דוגמה

- קיימים

- לְהַרְחִיב

- לצפות

- ניסיון

- לחקור

- מעריכי

- יצוא

- להאריך

- משתרע

- בד

- פָּנִים

- פייסבוק

- משפחה

- מהר יותר

- המהיר ביותר

- תכונות

- מעטים

- תרשים

- שלח

- קבצים

- סופי

- ראשון

- מתאים

- גמישות

- צף

- להתמקד

- התמקדות

- לעקוב

- הבא

- בעד

- מסגרת

- מסגרות

- החל מ-

- לגמרי

- נוסף

- ליצור

- נוצר

- דור

- דורות

- גנרטטיבית

- AI Generative

- לקבל

- Git

- GitHub

- לתת

- נותן

- גלוֹבָּלִי

- GPU

- GPUs

- קְבוּצָה

- צמיחה

- הדרכה

- יש

- יש

- he

- כבד

- הרמת כבד

- עזרה

- עוזר

- ביצועים גבוהים

- גבוה יותר

- הגבוה ביותר

- שֶׁלוֹ

- מחזיק

- המארח

- אירוח

- איך

- אולם

- HTML

- http

- HTTPS

- טבור

- מאות

- היברידי

- ID

- זהות

- if

- מדגים

- תמונה

- תמונות

- ליישם

- הפעלה

- לייבא

- לשפר

- משופר

- השבחה

- שיפורים

- שיפור

- in

- לכלול

- כלול

- כולל

- כולל

- להגדיל

- גדל

- עצמאי

- תעשיות

- תשתית

- קלט

- להתקין

- מותקן

- התקנה

- למשל

- במקום

- הוראות

- משלב

- אינטל

- מוֹדִיעִין

- אל תוך

- השקעות

- IP

- אירוניה

- IT

- שֶׁלָה

- מקומות תעסוקה

- jpg

- ג'סון

- מפתח

- תווית

- שפה

- גָדוֹל

- בקנה מידה גדול

- גדול יותר

- חֶבִיוֹן

- האחרון

- המהדורה האחרונה

- לשגר

- מוביל

- למידה

- עזבו

- ספריות

- סִפְרִיָה

- רמה

- כמו

- מוגבל

- קו

- לינוקס

- רשימה

- לִטעוֹן

- באופן מקומי

- ממוקם

- נעול

- היכנס

- התחבר

- את

- להוריד

- הנמוך ביותר

- מכונה

- למידת מכונה

- לתחזק

- לעשות

- עשייה

- לנהל

- הצליח

- רב

- מתמטיקה

- מקסימום

- מאי..

- לִפְגוֹשׁ

- חבר

- זכרון

- מתמזג

- מידע נוסף

- שיטה

- מדדים

- מִילִיוֹן

- ML

- MLOps

- מצב

- מודל

- מודלים

- מודולים

- חודשים

- יותר

- נע

- מספר

- שם

- טבעי

- עיבוד שפה טבעית

- הכרחי

- צורך

- נחוץ

- צרכי

- שלילי

- רשת

- רשתות

- נטרל

- חדש

- תכונות חדשות

- טכנולוגיות חדשות

- הבא

- צמתים

- הערות

- הודעה..

- עַכשָׁיו

- Nvidia

- יעדים

- of

- מתקפה

- הַצָעָה

- הצעה

- המיוחדות שלנו

- on

- ONE

- קוד פתוח

- נפתח

- מבצעי

- אופטימיזציה

- אופטימיזציה

- אפשרויות

- or

- תזמור

- אִרְגוּנִי

- OS

- אחר

- אחרים

- שלנו

- הַחוּצָה

- תפוקה

- בחוץ

- שֶׁלוֹ

- חבילה

- ארוז

- פרמטרים

- חלק

- תיקון

- תיקון

- ביצועים

- רשות

- הרשאות

- פניקס

- לבחור

- הרים

- צינור

- פלטפורמה

- אפלטון

- מודיעין אפלטון

- אפלטון נתונים

- אנא

- נקודה

- מדיניות

- מדיניות

- פופולרי

- אפשרויות

- הודעה

- הודעות

- מופעל

- חזק

- לחזות

- נבואה

- התחזיות

- להכין

- העריכה

- תנאים מוקדמים

- קודם

- מנהל

- בעיה

- תהליך

- תהליך

- מעבדים

- הפקה

- פִּריוֹן

- מוצרים

- פּרוֹיֶקט

- פרויקטים

- קניינית

- מוכח

- לספק

- מספק

- ציבורי

- גם

- פיתון

- פיטורך

- מוכן

- לאחרונה

- לאחרונה

- חוזר

- להפחית

- באזור

- רישום

- באופן קבוע

- קרוב משפחה

- לשחרר

- אָמִין

- נותר

- דווח

- לדרוש

- נדרש

- דרישות

- דורש

- משאב

- תגובה

- הגבלות

- תוצאה

- לַחֲזוֹר

- סקירה

- תפקיד

- שורש

- הפעלה

- ריצה

- בעל חכמים

- SageMaker Inference

- אותו

- חיסכון

- להרחבה

- סולם

- סריקה

- סקיקיט-לימוד

- היקף

- ציון

- לגרד

- סקריפטים

- סעיף

- סעיפים

- לבטח

- אבטחה

- לִרְאוֹת

- בחירה

- מבחר

- שליחה

- לחצני מצוקה לפנסיונרים

- רגש

- נפרד

- לשרת

- שרות

- שירותים

- מושב

- סט

- הגדרות

- התקנה

- שבע

- כמה

- SHA256

- משותף

- צריך

- ראווה

- הראה

- הראה

- הופעות

- משמעותי

- פָּשׁוּט

- יחיד

- מידה

- גדל

- So

- תוכנה

- מהנדס תוכנה

- פִּתָרוֹן

- פתרונות

- כמה

- מֶרחָב

- מיוחד

- מתמחה

- ספציפי

- במיוחד

- מְהִירוּת

- מהירויות

- לבלות

- הוצאה

- יציבות

- לערום

- תֶקֶן

- התחלה

- החל

- התחלות

- הצהרה

- סטטיסטיקה

- שלב

- צעדים

- אחסון

- אפשרויות אחסון

- אסטרטגיות

- מִבְנֶה

- כזה

- תמיכה

- נתמך

- מסייע

- תומך

- מערכת

- מערכות

- מותאם

- משימות

- טכני

- טכניקות

- טכנולוגיות

- tensorflow

- מבחן

- נבדק

- מֵאֲשֶׁר

- זֶה

- השמיים

- האזור

- שֶׁלָהֶם

- אותם

- אז

- אלה

- הֵם

- דברים

- זֶה

- אם כי?

- דרך

- תפוקה

- נִדבָּך

- זמן

- פִּי

- ל

- כלים

- לפיד

- רכבת

- מְאוּמָן

- הדרכה

- שנאי

- רוֹבּוֹטרִיקִים

- הפיכה

- לנסות

- ציוץ

- טוויטים

- שתיים

- סוג

- סוגים

- טיפוסי

- אובונטו

- תחת

- להבין

- בקרוב ב

- עדכון

- מְעוּדכָּן

- שדרוג

- נטען

- נוֹהָג

- להשתמש

- במקרה להשתמש

- מְשׁוּמָשׁ

- משתמשים

- באמצעות

- תועלת

- ערך

- מגוון

- שונים

- לאמת

- גרסה

- חזון

- כֶּרֶך

- פגיעויות

- רוצה

- we

- אינטרנט

- שירותי אינטרנט

- שבועות

- מִשׁקָל

- ברוך הבא

- מתי

- אשר

- באופן נרחב

- יצטרך

- עם

- לְלֹא

- תיק עבודות

- זרימת עבודה

- עובד

- לכתוב

- כתיבה

- X

- אתה

- זפירנט

- אזורי