אמזון SageMaker נקודות קצה מרובות (MME) הם יכולת מנוהלת במלואה של מסקנות של SageMaker המאפשרת לך לפרוס אלפי דגמים בנקודת קצה אחת. בעבר, MMEs הקצו מראש כוח מחשוב CPU למודלים באופן סטטי ללא קשר לעומס התעבורה של המודל, באמצעות שרת מרובי דגמים (MMS) בתור שרת הדגם שלו. בפוסט זה, אנו דנים בפתרון שבו MME יכול להתאים באופן דינמי את כוח המחשוב המוקצה לכל מודל בהתבסס על דפוס התעבורה של המודל. פתרון זה מאפשר לך להשתמש במחשוב הבסיסי של MMEs בצורה יעילה יותר ולחסוך בעלויות.

MMEs טוענים ופורקים באופן דינמי מודלים המבוססים על תעבורה נכנסת לנקודת הקצה. כאשר משתמשים ב-MMS כשרת המודל, MMEs מקצים מספר קבוע של עובדי מודל לכל דגם. למידע נוסף, עיין ב דפוסי אירוח מודלים באמזון SageMaker, חלק 3: הפעל וייעול מסקנות מרובות דגמים עם נקודות קצה מרובי דגמים של אמזון SageMaker.

עם זאת, זה יכול להוביל לכמה בעיות כאשר דפוס התנועה שלך משתנה. נניח שיש לך דגמים בודדים או מעטים שמקבלים כמות גדולה של תנועה. אתה יכול להגדיר את ה-MMS להקצות מספר גבוה של עובדים עבור המודלים האלה, אבל זה מוקצה לכל המודלים שמאחורי ה-MME מכיוון שזו תצורה סטטית. זה מוביל למספר רב של עובדים שמשתמשים במחשוב חומרה - אפילו בדגמי הסרק. הבעיה ההפוכה יכולה לקרות אם תגדיר ערך קטן למספר העובדים. לדגמים הפופולריים לא יהיו מספיק עובדים ברמת שרת הדגם כדי להקצות כראוי מספיק חומרה מאחורי נקודת הקצה עבור הדגמים הללו. הבעיה העיקרית היא שקשה להישאר אגנוסטית לדפוסי התעבורה אם אינך יכול לבצע קנה מידה דינמי של העובדים שלך ברמת שרת המודל כדי להקצות את כמות המחשוב הדרושה.

הפתרון שאנו דנים בו בפוסט זה משתמש DJLSserving בתור שרת המודל, שיכול לעזור להפחית חלק מהבעיות שדנו בהן ולאפשר קנה מידה לכל דגם ולאפשר ל-MMEs להיות אגנוסטיים לדפוסי תנועה.

ארכיטקטורת MME

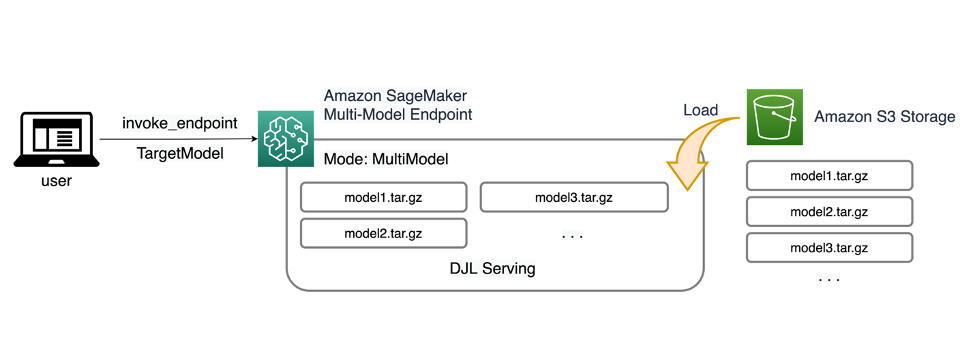

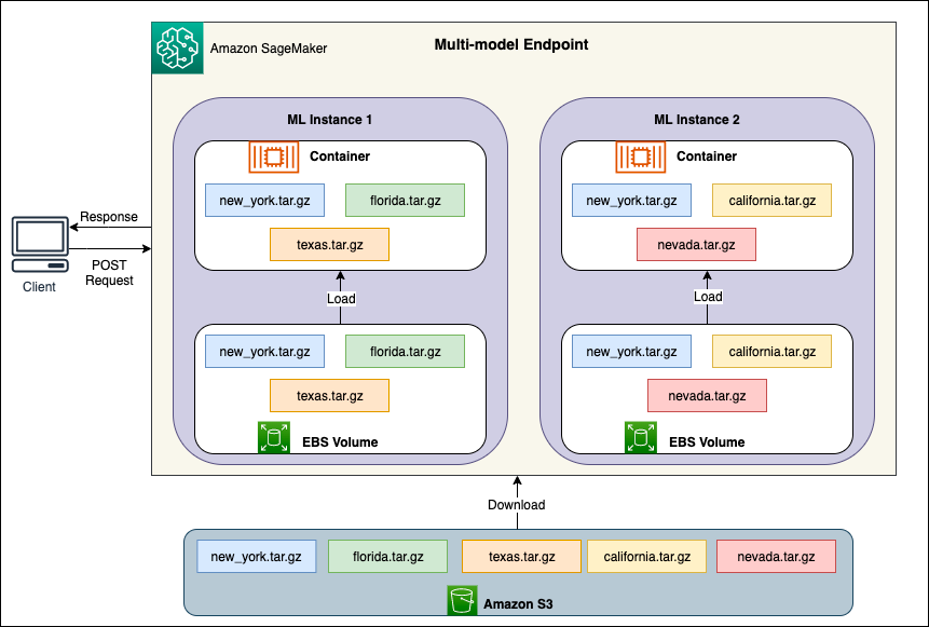

MME של SageMaker מאפשרים לך לפרוס מודלים מרובים מאחורי נקודת קצה אחת של מסקנות שעשויה להכיל מופע אחד או יותר. כל מופע נועד לטעון ולשרת דגמים מרובים עד לזיכרון ולקיבולת ה-CPU/GPU שלו. עם ארכיטקטורה זו, עסק של תוכנה כשירות (SaaS) יכול לשבור את העלות הגוברת באופן ליניארי של אירוח דגמים מרובים ולהשיג שימוש חוזר בתשתית בהתאם למודל ריבוי הדיירות המיושם במקומות אחרים בערימת היישומים. התרשים הבא ממחיש ארכיטקטורה זו.

SageMaker MME טוען באופן דינמי דגמים מ שירות אחסון פשוט של אמזון (Amazon S3) כאשר מופעל, במקום להוריד את כל הדגמים כאשר נקודת הקצה נוצרת לראשונה. כתוצאה מכך, פנייה ראשונית למודל עשויה לראות חביון מסקנות גבוה יותר מההסקות הבאות, אשר מושלמות עם חביון נמוך. אם המודל כבר נטען על הקונטיינר בעת הפעלתו, דילוג על שלב ההורדה והמודל מחזיר את המסקנות עם חביון נמוך. לדוגמה, נניח שיש לך דגם שמשתמשים בו רק כמה פעמים ביום. זה נטען אוטומטית לפי דרישה, בעוד שדגמים שנגישים אליהם לעתים קרובות נשמרים בזיכרון ומופעלים עם זמן אחזור נמוך באופן עקבי.

מאחורי כל MME יש מופעי אירוח של מודל, כפי שמתואר בתרשים הבא. מקרים אלו טוענים ומוציאים דגמים מרובים אל הזיכרון וממנו על סמך דפוסי התעבורה למודלים.

SageMaker ממשיכה לנתב בקשות מסקנות עבור מודל למקרה שבו המודל כבר נטען כך שהבקשות מוגשות מעותק מודל שמור (ראה את הדיאגרמה הבאה, המציגה את נתיב הבקשה לבקשת החיזוי הראשונה לעומת החיזוי המאוחסן במטמון נתיב בקשה). עם זאת, אם המודל מקבל בקשות הפעלה רבות, וישנם מופעים נוספים עבור ה-MME, SageMaker מנתב כמה בקשות למופע אחר כדי להתאים לגידול. כדי לנצל את קנה המידה האוטומטי של מודלים ב- SageMaker, ודא שיש לך הגדרת שינוי קנה מידה אוטומטי של מופע לספק קיבולת מופע נוספת. הגדר את מדיניות קנה המידה שלך ברמת נקודות הקצה עם פרמטרים מותאמים אישית או שיחות לדקה (מומלץ) כדי להוסיף מופעים נוספים לצי נקודות הקצה.

סקירה כללית של שרתים

שרת מודל הוא רכיב תוכנה המספק סביבת זמן ריצה לפריסה והגשה של מודלים של למידת מכונה (ML). הוא משמש כממשק בין המודלים המאומנים ליישומי הלקוח שרוצים לבצע תחזיות באמצעות המודלים הללו.

המטרה העיקרית של שרת מודל היא לאפשר אינטגרציה ללא מאמץ ופריסה יעילה של דגמי ML במערכות ייצור. במקום להטמיע את המודל ישירות באפליקציה או במסגרת ספציפית, שרת המודל מספק פלטפורמה מרכזית שבה ניתן לפרוס, לנהל ולהגיש מספר דגמים.

שרתי מודל מציעים בדרך כלל את הפונקציות הבאות:

- טעינת דגם – השרת טוען את דגמי ה-ML המאומנים לזיכרון, מה שהופך אותם מוכנים לתחזיות הגשה.

- Inference API – השרת חושף API המאפשר ליישומי לקוח לשלוח נתוני קלט ולקבל תחזיות מהמודלים הפרוסים.

- דרוג - שרתי דגם מתוכננים לטפל בבקשות במקביל ממספר לקוחות. הם מספקים מנגנונים לעיבוד מקביל ולניהול משאבים ביעילות כדי להבטיח תפוקה גבוהה והשהייה נמוכה.

- אינטגרציה עם מנועי אחורי - לשרתי מודל יש אינטגרציות עם מסגרות עורפיות כמו DeepSpeed ו-FasterTransformer כדי לחלק דגמים גדולים ולהפעיל הסקה אופטימלית ביותר.

ארכיטקטורת DJL

הגשת DJL הוא שרת מודל אוניברסלי בקוד פתוח, בעל ביצועים גבוהים. DJL Serving בנוי על גבי Djl, ספריית למידה עמוקה הכתובה בשפת התכנות Java. זה יכול לקחת מודל למידה עמוקה, מספר מודלים או זרימות עבודה ולהפוך אותם לזמינים דרך נקודת קצה HTTP. DJL Serving תומך בפריסת דגמים ממספר מסגרות כמו PyTorch, TensorFlow, Apache MXNet, ONNX, TensorRT, Hugging Face Transformers, DeepSpeed, FasterTransformer ועוד.

DJL Serving מציע תכונות רבות המאפשרות לך לפרוס את הדגמים שלך עם ביצועים גבוהים:

- קל לשימוש - DJL Serving יכול לשרת את רוב הדגמים מחוץ לקופסה. פשוט תביא את חפצי הדגם, ו-DJL Serving יכול לארח אותם.

- תמיכה במספר מכשירים ובמאיץ - DJL Serving תומך בפריסת דגמים על CPU, GPU ו Afer Inferentia.

- ביצוע - DJL Serving מפעיל הסקה מרובה הליכי ב-JVM יחיד כדי להגביר את התפוקה.

- אצווה דינמית - DJL Serving תומך באצווה דינמית כדי להגדיל את התפוקה.

- קנה מידה אוטומטי - DJL Serving יבצע קנה מידה אוטומטי של עובדים למעלה ולמטה בהתבסס על עומס התנועה.

- תמיכה בריבוי מנועים - DJL Serving יכול לארח בו זמנית דגמים באמצעות מסגרות שונות (כגון PyTorch ו- TensorFlow).

- מודלים של אנסמבל וזרימת עבודה - DJL Serving תומך בפריסת זרימות עבודה מורכבות המורכבות ממספר דגמים, ומריצה חלקים מזרימת העבודה על CPU וחלקים על GPU. מודלים בתוך זרימת עבודה יכולים להשתמש במסגרות שונות.

במיוחד, תכונת ההרחבה האוטומטית של DJL Serving הופכת את זה לפשוט להבטיח שהדגמים מותאמים כראוי לתנועה הנכנסת. כברירת מחדל, DJL Serving קובע את המספר המרבי של עובדים עבור דגם שניתן לתמוך בו על סמך החומרה הזמינה (ליבות מעבד, התקני GPU). אתה יכול להגדיר גבולות תחתונים ועליונים עבור כל דגם כדי לוודא שתמיד ניתן להגיש רמת תעבורה מינימלית, ושמודל בודד אינו צורך את כל המשאבים הזמינים.

DJL Serving משתמש ב-a Netty חזית על גבי בריכות חוטי עובדים אחוריות. החזית משתמשת בהגדרת Netty אחת עם מספר HttpRequestHandlers. מטפלי בקשות שונים יספקו תמיכה עבור Inference API, ניהול API, או ממשקי API אחרים הזמינים מתוספים שונים.

הקצה האחורי מבוסס סביב ה WorkLoadManager מודול (WLM). ה-WLM דואג למספר חוטי עובדים עבור כל דגם יחד עם האצווה וניתוב הבקשות אליהם. כאשר מוצגים דגמים מרובים, WLM בודק תחילה את גודל תור בקשת ההסקה של כל דגם. אם גודל התור גדול מפי שניים מגודל האצווה של דגם, WLM מגדיל את מספר העובדים שהוקצו למודל זה.

סקירת פתרונות

היישום של DJL עם MME שונה מהגדרת ברירת המחדל של MMS. עבור DJL Serving עם MME, אנו דוחסים את הקבצים הבאים בפורמט model.tar.gz ש-SageMaker Inference מצפה לו:

- model.joblib - עבור יישום זה, אנו דוחפים ישירות את המטא-נתונים של המודל לתוך ה-tarball. במקרה זה, אנו עובדים עם א

.joblibקובץ, אז אנחנו מספקים את הקובץ הזה ב-tarball שלנו לקריאה של סקריפט ההסקה שלנו. אם החפץ גדול מדי, אתה יכול גם לדחוף אותו לאמזון S3 ולהצביע על זה בתצורת ההגשה שאתה מגדיר עבור DJL. - הגשה.נכסים - כאן אתה יכול להגדיר כל דגם הקשור לשרת משתני סביבה. הכוח של DJL כאן הוא שאתה יכול להגדיר

minWorkersוmaxWorkersעבור כל דגם טארבול. זה מאפשר לכל דגם להגדיל ולהקטין ברמת שרת הדגם. לדוגמה, אם מודל יחיד מקבל את רוב התעבורה עבור MME, שרת המודל יגדיל את גודל העובדים באופן דינמי. בדוגמה זו, איננו מגדירים את המשתנים הללו ונותנים ל-DJL לקבוע את המספר הדרוש של עובדים בהתאם לדפוס התעבורה שלנו. - model.py - זהו סקריפט ההסקה לכל עיבוד מקדים או לאחר עיבוד מותאם אישית שתרצה ליישם. ה-model.py מצפה שהלוגיקה שלך תהיה מובלעת בשיטת טיפול כברירת מחדל.

- requirements.txt (אופציונלי) - כברירת מחדל, DJL מגיע מותקן עם PyTorch, אך ניתן לדחוף לכאן כל תלות נוספת שאתה צריך.

עבור דוגמה זו, אנו מציגים את הכוח של DJL עם MME על ידי נטילת דגם SKLearn לדוגמה. אנחנו מפעילים עבודת הדרכה עם המודל הזה ואז יוצרים 1,000 עותקים של חפץ המודל הזה כדי לגבות את ה-MME שלנו. לאחר מכן אנו מציגים כיצד DJL יכול להתאים באופן דינמי להתמודד עם כל סוג של דפוס תעבורה שה-MME שלך עשוי לקבל. זה יכול לכלול חלוקה שווה של התעבורה על פני כל הדגמים או אפילו כמה דגמים פופולריים שמקבלים את רוב התעבורה. אתה יכול למצוא את כל הקוד בקטע הבא GitHub ריפו.

תנאים מוקדמים

עבור דוגמה זו, אנו משתמשים במופע מחברת SageMaker עם ליבת conda_python3 ומופע ml.c5.xlarge. כדי לבצע את בדיקות העומס, אתה יכול להשתמש ב- ענן מחשוב אלסטי של אמזון (Amazon EC2) מופע או מופע מחברת SageMaker גדול יותר. בדוגמה זו, אנו מדרגים ליותר מאלף עסקאות בשנייה (TPS), ולכן אנו מציעים לבדוק על מופע EC2 כבד יותר כגון ml.c5.18xlarge כדי שיהיה לך יותר מחשוב לעבוד איתו.

צור חפץ דגם

ראשית עלינו ליצור חפץ מודל ונתונים שבהם אנו משתמשים בדוגמה זו. במקרה זה, אנו מייצרים כמה נתונים מלאכותיים עם NumPy ומתאמנים באמצעות מודל רגרסיה ליניארית של SKLearn עם קטע הקוד הבא:

לאחר שתפעיל את הקוד הקודם, אמור להיות לך א model.joblib קובץ שנוצר בסביבה המקומית שלך.

משוך את תמונת ה-DJL Docker

תמונת Docker djl-inference:0.23.0-cpu-full-v1.0 היא מיכל ההגשה שלנו ל-DJL המשמש בדוגמה זו. אתה יכול להתאים את כתובת האתר הבאה בהתאם לאזור שלך:

inference_image_uri = "474422712127.dkr.ecr.us-east-1.amazonaws.com/djl-serving-cpu:latest"

לחלופין, אתה יכול גם להשתמש בתמונה זו כתמונת בסיס ולהרחיב אותה כדי לבנות עליה תמונת Docker משלך מרשם מיכל אלסטי של אמזון (Amazon ECR) עם כל תלות אחרת שאתה צריך.

צור את קובץ הדגם

ראשית, אנו יוצרים קובץ בשם serving.properties. זה מורה ל- DJLServing להשתמש במנוע Python. אנחנו גם מגדירים את max_idle_time של עובד להיות 600 שניות. זה מוודא שלוקח לנו יותר זמן להקטין את מספר העובדים שיש לנו לכל דגם. אנחנו לא מסתגלים minWorkers ו maxWorkers שאנו יכולים להגדיר וניתן ל-DJL לחשב באופן דינמי את מספר העובדים הדרושים בהתאם לתעבורה שכל דגם מקבל. ה-serving.properties מוצגים כדלקמן. כדי לראות את הרשימה המלאה של אפשרויות התצורה, עיין ב תצורת מנוע.

לאחר מכן, אנו יוצרים את הקובץ model.py שלנו, המגדיר את הלוגיקה של טעינת המודל וההסקה. עבור MMEs, כל קובץ model.py הוא ספציפי לדגם. דגמים מאוחסנים בנתיבים שלהם מתחת לחנות הדגמים (בדרך כלל /opt/ml/model/). בעת טעינת דגמים, הם ייטענו תחת נתיב חנות הדגמים בספרייה משלהם. את הדוגמה המלאה של model.py בהדגמה זו ניתן לראות ב- GitHub ריפו.

אנו יוצרים a model.tar.gz קובץ הכולל את הדגם שלנו (model.joblib), model.py, ו serving.properties:

למטרות הדגמה, אנו יוצרים 1,000 עותקים של אותו model.tar.gz קובץ כדי לייצג את המספר הגדול של דגמים שיתארח. בהפקה, אתה צריך ליצור א model.tar.gz קובץ עבור כל אחד מהדגמים שלך.

לבסוף, אנו מעלים את הדגמים הללו לאמזון S3.

צור מודל של SageMaker

כעת אנו יוצרים א דגם SageMaker. אנו משתמשים בתמונת ה-ECR שהוגדרה קודם לכן ובחפץ הדגם מהשלב הקודם כדי ליצור את מודל SageMaker. בהגדרת הדגם, אנו מגדירים את מצב כ-MultiModel. זה אומר ל-DJLServing שאנחנו יוצרים MME.

צור נקודת קצה של SageMaker

בהדגמה זו, אנו משתמשים ב-20 ml.c5d.18xlarge מופעים כדי לשנות קנה מידה ל-TPS בטווח של אלפי. הקפד לקבל הגדלת הגבלה על סוג המופע שלך, במידת הצורך, כדי להשיג את ה-TPS שאליו אתה מכוון.

בדיקת עומס

בזמן כתיבת שורות אלה, כלי בדיקת העומס הביתי של SageMaker אמזון SageMaker Inference Recommend אינו תומך באופן מקורי בבדיקות עבור MMEs. לכן, אנו משתמשים בכלי Python בקוד פתוח אַרְבֶּה. את Locust היא פשוטה להגדרה ויכולה לעקוב אחר מדדים כגון TPS והשהייה מקצה לקצה. להבנה מלאה כיצד להגדיר את זה עם SageMaker, ראה שיטות עבודה מומלצות לבדיקת עומס נקודות קצה של אמזון SageMaker בזמן אמת.

במקרה השימוש הזה, יש לנו שלושה דפוסי תעבורה שונים שאנחנו רוצים לדמות עם MMEs, אז יש לנו את שלושת הסקריפטים הבאים של Python שמתיישרים עם כל דפוס. המטרה שלנו כאן היא להוכיח שללא קשר לדפוס התנועה שלנו, אנחנו יכולים להשיג את אותו יעד TPS ולהגדיל אותו בצורה מתאימה.

אנו יכולים לציין משקל בסקריפט Locust שלנו כדי להקצות תעבורה לחלקים שונים של הדגמים שלנו. לדוגמה, עם המודל החם היחיד שלנו, אנו מיישמים שתי שיטות כדלקמן:

לאחר מכן נוכל להקצות משקל מסוים לכל שיטה, כלומר כאשר שיטה מסוימת מקבלת אחוז מסוים מהתנועה:

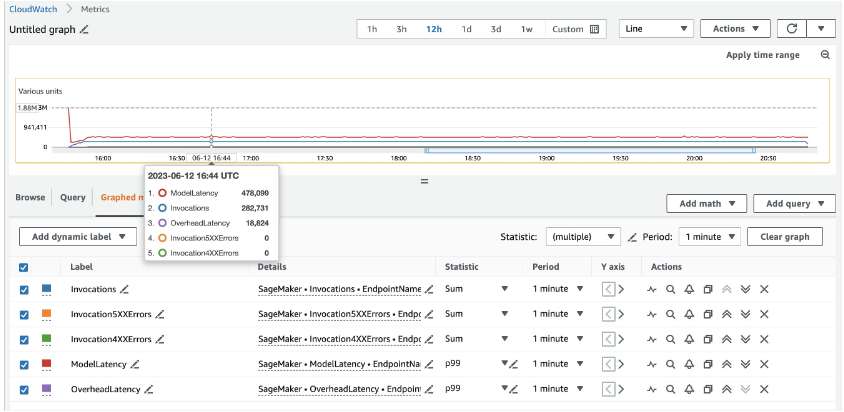

עבור מופעים של 20 ml.c5d.18xlarge, אנו רואים את מדדי ההתקשרות הבאים על אמזון CloudWatch לְנַחֵם. ערכים אלה נשארים עקביים למדי בכל שלושת דפוסי התנועה. כדי להבין טוב יותר את מדדי CloudWatch עבור מסקנות בזמן אמת ו-MME של SageMaker, עיין ב מדדי הזמנת נקודת קצה של SageMaker.

אתה יכול למצוא את שאר התסריטים של לוקוס ב- ספריית locust-utils במאגר GitHub.

<br> סיכום

בפוסט זה, דנו כיצד MME יכול להתאים באופן דינמי את כוח המחשוב המוקצה לכל מודל בהתבסס על דפוס התעבורה של המודל. תכונה זו שהושקה לאחרונה זמינה בכל אזורי AWS שבהם SageMaker זמין. שים לב שבזמן ההכרזה, רק מופעי CPU נתמכים. למידע נוסף, עיין ב אלגוריתמים, מסגרות ומופעים נתמכים.

על הכותבים

רם וג'יראג'ו הוא אדריכל ML עם צוות שירות SageMaker. הוא מתמקד בסיוע ללקוחות לבנות ולמטב את פתרונות ה-AI/ML שלהם ב-Amazon SageMaker. בזמנו הפנוי הוא אוהב לטייל ולכתוב.

רם וג'יראג'ו הוא אדריכל ML עם צוות שירות SageMaker. הוא מתמקד בסיוע ללקוחות לבנות ולמטב את פתרונות ה-AI/ML שלהם ב-Amazon SageMaker. בזמנו הפנוי הוא אוהב לטייל ולכתוב.

צ'ינגווי לי הוא מומחה למידת מכונה בשירותי האינטרנט של אמזון. הוא קיבל את הדוקטורט. במחקר מבצעים לאחר ששבר את חשבון מענקי המחקר של יועצו ולא הצליח להעניק את פרס נובל שהבטיח. נכון לעכשיו הוא מסייע ללקוחות בענף השירותים הפיננסיים וביטוח לבנות פתרונות למידת מכונה ב- AWS. בזמנו הפנוי הוא אוהב לקרוא ולהוריד.

צ'ינגווי לי הוא מומחה למידת מכונה בשירותי האינטרנט של אמזון. הוא קיבל את הדוקטורט. במחקר מבצעים לאחר ששבר את חשבון מענקי המחקר של יועצו ולא הצליח להעניק את פרס נובל שהבטיח. נכון לעכשיו הוא מסייע ללקוחות בענף השירותים הפיננסיים וביטוח לבנות פתרונות למידת מכונה ב- AWS. בזמנו הפנוי הוא אוהב לקרוא ולהוריד.

ג'יימס וו הוא ארכיטקט פתרונות מומחה בינה מלאכותית/ML בכיר ב-AWS. עוזר ללקוחות לתכנן ולבנות פתרונות AI/ML. עבודתו של ג'יימס מכסה מגוון רחב של מקרי שימוש ב-ML, עם עניין עיקרי בראייה ממוחשבת, למידה עמוקה והרחבת ML ברחבי הארגון. לפני שהצטרף ל-AWS, ג'יימס היה אדריכל, מפתח ומוביל טכנולוגיה במשך למעלה מ-10 שנים, כולל 6 שנים בהנדסה ו-4 שנים בתעשיות שיווק ופרסום.

ג'יימס וו הוא ארכיטקט פתרונות מומחה בינה מלאכותית/ML בכיר ב-AWS. עוזר ללקוחות לתכנן ולבנות פתרונות AI/ML. עבודתו של ג'יימס מכסה מגוון רחב של מקרי שימוש ב-ML, עם עניין עיקרי בראייה ממוחשבת, למידה עמוקה והרחבת ML ברחבי הארגון. לפני שהצטרף ל-AWS, ג'יימס היה אדריכל, מפתח ומוביל טכנולוגיה במשך למעלה מ-10 שנים, כולל 6 שנים בהנדסה ו-4 שנים בתעשיות שיווק ופרסום.

סאוראב טריקאנדה הוא מנהל מוצר בכיר עבור Amazon SageMaker Inference. הוא נלהב לעבוד עם לקוחות ומוטיבציה היא המטרה של דמוקרטיזציה של למידת מכונה. הוא מתמקד באתגרי ליבה הקשורים לפריסת יישומי ML מורכבים, מודלים של ML מרובי דיירים, אופטימיזציות עלויות והפיכת פריסת מודלים של למידה עמוקה לנגישה יותר. בזמנו הפנוי, סאוראב נהנה לטייל, ללמוד על טכנולוגיות חדשניות, לעקוב אחר TechCrunch ולבלות עם משפחתו.

סאוראב טריקאנדה הוא מנהל מוצר בכיר עבור Amazon SageMaker Inference. הוא נלהב לעבוד עם לקוחות ומוטיבציה היא המטרה של דמוקרטיזציה של למידת מכונה. הוא מתמקד באתגרי ליבה הקשורים לפריסת יישומי ML מורכבים, מודלים של ML מרובי דיירים, אופטימיזציות עלויות והפיכת פריסת מודלים של למידה עמוקה לנגישה יותר. בזמנו הפנוי, סאוראב נהנה לטייל, ללמוד על טכנולוגיות חדשניות, לעקוב אחר TechCrunch ולבלות עם משפחתו.

שו דנג הוא מנהל מהנדס תוכנה בצוות SageMaker. הוא מתמקד בסיוע ללקוחות לבנות ולמטב את חווית ההסקת AI/ML שלהם באמזון SageMaker. בזמנו הפנוי, הוא אוהב לטייל ולעשות סנובורד.

שו דנג הוא מנהל מהנדס תוכנה בצוות SageMaker. הוא מתמקד בסיוע ללקוחות לבנות ולמטב את חווית ההסקת AI/ML שלהם באמזון SageMaker. בזמנו הפנוי, הוא אוהב לטייל ולעשות סנובורד.

סידהארת' ונקטסן הוא מהנדס תוכנה ב-AWS Deep Learning. כיום הוא מתמקד בבניית פתרונות להסקת מודלים גדולים. לפני AWS הוא עבד בארגון מכולת אמזון בבניית תכונות תשלום חדשות ללקוחות ברחבי העולם. מחוץ לעבודה, הוא נהנה מסקי, בחוץ וצפייה בספורט.

סידהארת' ונקטסן הוא מהנדס תוכנה ב-AWS Deep Learning. כיום הוא מתמקד בבניית פתרונות להסקת מודלים גדולים. לפני AWS הוא עבד בארגון מכולת אמזון בבניית תכונות תשלום חדשות ללקוחות ברחבי העולם. מחוץ לעבודה, הוא נהנה מסקי, בחוץ וצפייה בספורט.

רוהיט נאלמאדי הוא מהנדס פיתוח תוכנה ב-AWS. הוא עובד על אופטימיזציה של עומסי עבודה של למידה עמוקה על GPUs, בניית פתרונות ML ביצועים גבוהים והגשה. לפני כן, הוא עבד על בניית שירותי מיקרו המבוססים על AWS עבור עסקי Amazon F3. מחוץ לעבודה הוא נהנה לשחק ולצפות בספורט.

רוהיט נאלמאדי הוא מהנדס פיתוח תוכנה ב-AWS. הוא עובד על אופטימיזציה של עומסי עבודה של למידה עמוקה על GPUs, בניית פתרונות ML ביצועים גבוהים והגשה. לפני כן, הוא עבד על בניית שירותי מיקרו המבוססים על AWS עבור עסקי Amazon F3. מחוץ לעבודה הוא נהנה לשחק ולצפות בספורט.

- הפצת תוכן ויחסי ציבור מופעל על ידי SEO. קבל הגברה היום.

- PlatoData.Network Vertical Generative Ai. העצים את עצמך. גישה כאן.

- PlatoAiStream. Web3 Intelligence. הידע מוגבר. גישה כאן.

- PlatoESG. פחמן, קלינטק, אנרגיה, סביבה, שמש, ניהול פסולת. גישה כאן.

- PlatoHealth. מודיעין ביוטכנולוגיה וניסויים קליניים. גישה כאן.

- מקור: https://aws.amazon.com/blogs/machine-learning/run-ml-inference-on-unplanned-and-spiky-traffic-using-amazon-sagemaker-multi-model-endpoints/

- :הוא

- :איפה

- $ למעלה

- 000

- 1

- 10

- 100

- 116

- 118

- 12

- 16

- 17

- 20

- 23

- 31

- 600

- 7

- 9

- a

- אודות

- מאיץ

- נצפה

- נגיש

- להתאים

- חֶשְׁבּוֹן

- להשיג

- לרוחב

- מעשים

- להוסיף

- נוסף

- יתרון

- פרסום

- לאחר

- AI / ML

- אלגוריתמים

- ליישר

- תעשיות

- להקצות

- מוּקצֶה

- להתיר

- מאפשר

- לאורך

- כְּבָר

- גם

- תמיד

- אמזון בעברית

- אמזון

- אמזון SageMaker

- אמזון שירותי אינטרנט

- כמות

- an

- ו

- הַכרָזָה

- אחר

- כל

- אַפָּשׁ

- API

- ממשקי API

- בקשה

- יישומים

- יישומית

- כראוי

- ארכיטקטורה

- ARE

- סביב

- מלאכותי

- AS

- שהוקצה

- לְהַנִיחַ

- At

- המכונית

- אוטומטי

- באופן אוטומטי

- זמין

- AWS

- בחזרה

- קצה אחורי

- בסיס

- מבוסס

- אצווה

- BE

- כי

- מאחור

- מוטב

- בֵּין

- גוּף

- לְהַגבִּיר

- גבולות

- אריזה מקורית

- לשבור

- להביא

- חסר פרוטה

- לִבנוֹת

- בִּניָן

- נבנה

- עסקים

- אבל

- by

- נקרא

- CAN

- יכולת

- קיבולת

- אשר

- מקרה

- מקרים

- תא

- מְרוּכָּז

- מסוים

- האתגרים

- בדיקות

- בכיתה

- לקוחות

- לקוחות

- קוד

- מגיע

- להשלים

- השלמת

- מורכב

- רְכִיב

- מורכב

- לחשב

- המחשב

- ראייה ממוחשבת

- מחשוב

- - כוח מחשוב

- במקביל

- תְצוּרָה

- עִקבִי

- באופן עקבי

- קונסול

- לצרוך

- להכיל

- מכולה

- הקשר

- ממשיך

- ליבה

- עלות

- עלויות

- מכסה

- לִיצוֹר

- נוצר

- יוצרים

- כיום

- מנהג

- לקוחות

- נתונים

- יְוֹם

- עמוק

- למידה עמוקה

- בְּרִירַת מֶחדָל

- לְהַגדִיר

- מוגדר

- מגדיר

- למסור

- דרישה

- הדגמה

- דמוקרטיזציה

- תלות

- תלוי

- מתואר

- לפרוס

- פרס

- פריסה

- פריסה

- עיצוב

- מעוצב

- לקבוע

- קובע

- מפתח

- צעצועי התפתחות

- מכשיר

- התקנים

- תרשים

- אחר

- קשה

- ישירות

- בספרייה

- לדון

- נָדוֹן

- הפצה

- סַוָר

- לא

- לא

- מטה

- להורדה

- הורדה

- דינמי

- באופן דינמי

- כל אחד

- מוקדם יותר

- יעיל

- יעילות

- ללא מאמץ

- או

- במקום אחר

- הטבעה

- לאפשר

- מאפשר

- כמוס

- מקצה לקצה

- נקודת קצה

- מנוע

- מהנדס

- הנדסה

- מספיק

- לְהַבטִיחַ

- מִפְעָל

- סביבה

- שגיאה

- אֲפִילוּ

- דוגמה

- יוצא מן הכלל

- מצפה

- מצפה

- ניסיון

- להאריך

- פָּנִים

- נכשל

- למדי

- משפחה

- מאפיין

- תכונות

- מעטים

- שלח

- קבצים

- כספי

- שירות כלכלי

- ראשון

- קבוע

- צי

- מתמקד

- הבא

- כדלקמן

- בעד

- פוּרמָט

- מסגרת

- מסגרות

- בתדירות גבוהה

- החל מ-

- ממשק

- מלא

- לגמרי

- פונקציות

- ליצור

- לקבל

- מקבל

- GitHub

- מטרה

- GPU

- GPUs

- להעניק

- יותר

- לטפל

- לקרות

- חומרה

- יש

- he

- לעזור

- עזרה

- עוזר

- כאן

- גָבוֹהַ

- גבוה יותר

- מאוד

- שֶׁלוֹ

- המארח

- אירח

- אירוח

- חַם

- איך

- איך

- אולם

- HTML

- http

- HTTPS

- להתבטל

- if

- מדגים

- תמונה

- ליישם

- הפעלה

- לייבא

- in

- לכלול

- כולל

- כולל

- נכנס

- להגדיל

- גדל

- תעשיות

- תעשייה

- מידע

- תשתית

- בתחילה

- חדשני

- טכנולוגיות חדשניות

- קלט

- מותקן

- למשל

- במקום

- ביטוח

- השתלבות

- ואינטגרציות

- אינטרס

- מִמְשָׁק

- אל תוך

- הופעל

- סוגיה

- בעיות

- IT

- שֶׁלָה

- ג'יימס

- Java

- עבודה

- הצטרפות

- jpg

- רק

- שפה

- גָדוֹל

- גדול יותר

- חֶבִיוֹן

- האחרון

- הושק

- עוֹפֶרֶת

- מנהיג

- מוביל

- לִלמוֹד

- למידה

- לתת

- רמה

- סִפְרִיָה

- כמו

- אוהב

- להגביל

- קווים

- רשימה

- לִטעוֹן

- טוען

- המון

- מקומי

- הגיון

- עוד

- אוהב

- נמוך

- להוריד

- מכונה

- למידת מכונה

- ראשי

- הרוב

- לעשות

- עושה

- עשייה

- הצליח

- מנהל

- ניהול

- רב

- שיווק

- שיווק ופרסום

- מקסימום

- מאי..

- מנגנוני

- זכרון

- מידע נוסף

- שיטה

- שיטות

- מדדים

- מיקרו

- יכול

- מינימום

- דקה

- להקל

- ML

- מצב

- מודל

- מודלים

- מודול

- יותר

- רוב

- מוטיבציה

- מספר

- שם

- במקור

- הכרחי

- צורך

- נחוץ

- חדש

- חדש

- פרס נובל

- ללא חתימה

- הערות

- מחברה

- עַכשָׁיו

- מספר

- קהות

- of

- הַצָעָה

- המיוחדות שלנו

- on

- ONE

- רק

- לפתוח

- קוד פתוח

- תפעול

- מול

- אופטימיזציות

- מטב

- אופטימיזציה

- מיטוב

- אפשרויות

- or

- אחר

- שלנו

- הַחוּצָה

- בחוץ

- תפוקה

- בחוץ

- יותר

- שֶׁלוֹ

- מקביל

- פרמטרים

- חלק

- מסוים

- חלקים

- לוהט

- נתיב

- שבילים

- תבנית

- דפוסי

- תשלום

- עבור

- אחוזים

- לְבַצֵעַ

- ביצועים

- מקטרת

- פלטפורמה

- אפלטון

- מודיעין אפלטון

- אפלטון נתונים

- משחק

- תוספים

- נקודה

- מדיניות

- ברכות

- פופולרי

- הודעה

- כּוֹחַ

- פרקטיקות

- קודם

- נבואה

- התחזיות

- קודם

- קוֹדֶם

- יְסוֹדִי

- קודם

- הפרס

- בעיה

- תהליך

- תהליך

- המוצר

- מנהל מוצר

- הפקה

- תכנות

- מוּבטָח

- כמו שצריך

- נכסים

- להוכיח

- לספק

- מספק

- אַספָּקָה

- מטרה

- למטרות

- דחוף

- דחף

- פיתון

- פיטורך

- אקראי

- רכס

- חומר עיוני

- קריאה

- מוכן

- זמן אמת

- לקבל

- קיבלו

- מקבל

- קבלה

- מוּמלָץ

- להתייחס

- ללא קשר

- באזור

- אזורים

- קָשׁוּר

- להשאר

- להחליף

- מאגר

- לייצג

- לבקש

- בקשות

- דרישות

- מחקר

- משאבים

- תגובה

- REST

- תוצאה

- החזרות

- שימוש חוזר

- מסלול

- נתיבים

- ניתוב

- הפעלה

- פועל

- זמן ריצה

- SaaS

- בעל חכמים

- SageMaker Inference

- אותו

- לִטעוֹם

- שמור

- לומר

- סולם

- סולם

- מאזניים

- דרוג

- תסריט

- סקריפטים

- שְׁנִיָה

- שניות

- לִרְאוֹת

- לראות

- עצמי

- לשלוח

- לחצני מצוקה לפנסיונרים

- לשרת

- שירת

- שרת

- שרתים

- שרות

- שירותים

- הגשה

- סט

- סטים

- התקנה

- כמה

- צריך

- ראווה

- הראה

- הופעות

- פָּשׁוּט

- לדמות

- בו זמנית

- יחיד

- יחיד

- מידה

- קטן

- קטע

- So

- תוכנה

- תוכנה כשירות

- פיתוח תוכנה

- מהנדס תוכנה

- פִּתָרוֹן

- פתרונות

- כמה

- מָקוֹר

- מומחה

- ספציפי

- הוצאה

- לפצל

- ספורט

- לערום

- סטטי

- שלב

- אחסון

- חנות

- מאוחסן

- פשוט

- לאחר מכן

- כזה

- להציע

- תמיכה

- נתמך

- תומך

- בטוח

- מערכות

- לקחת

- לוקח

- נטילת

- יעד

- מיקוד

- הוראה

- נבחרת

- TechCrunch

- טכנולוגיות

- טכנולוגיה

- אומר

- tensorflow

- בדיקות

- בדיקות

- מֵאֲשֶׁר

- זֶה

- השמיים

- שֶׁלָהֶם

- אותם

- אז

- שם.

- לכן

- אלה

- הֵם

- זֶה

- אלה

- אלף

- אלפים

- שְׁלוֹשָׁה

- דרך

- תפוקה

- זמן

- פִּי

- ל

- גַם

- כלי

- חלק עליון

- לקראת

- Tps

- לעקוב

- תְנוּעָה

- רכבת

- מְאוּמָן

- הדרכה

- עסקות

- רוֹבּוֹטרִיקִים

- נסיעה

- לנסות

- שתיים

- סוג

- בדרך כלל

- תחת

- בְּסִיסִי

- להבין

- הבנה

- אוניברסלי

- כתובת האתר

- להשתמש

- במקרה להשתמש

- מְשׁוּמָשׁ

- שימושים

- באמצעות

- בְּדֶרֶך כְּלַל

- ניצול

- ערך

- ערכים

- משתנה

- שונים

- חזון

- vs

- רוצה

- היה

- צופה

- we

- אינטרנט

- שירותי אינטרנט

- מִשׁקָל

- מה

- מתי

- ואילו

- אשר

- רָחָב

- טווח רחב

- יצטרך

- עם

- בתוך

- תיק עבודות

- עבד

- עובד

- עובדים

- זרימת עבודה

- זרימות עבודה

- עובד

- עובד

- היה

- כתיבה

- כתוב

- X

- שנים

- אתה

- זפירנט