我々はそれを発表することに興奮している Amazon SageMaker ジャンプスタート 大規模言語モデル (LLM) 推論応答をストリーミングできるようになりました。 トークン ストリーミングを使用すると、LLM による応答生成の完了を待ってから使用または表示できるようになるのではなく、生成中のモデル応答出力を確認できます。 SageMaker JumpStart のストリーミング機能は、エンドユーザーに低遅延の印象を与えることで、より優れたユーザー エクスペリエンスを備えたアプリケーションを構築するのに役立ちます。

この投稿では、デプロイしてからの応答をストリーミングする方法について説明します。 ファルコン 7B インストラクトモデル エンドポイントを使用して定義します

この記事の執筆時点では、SageMaker JumpStart で利用可能な次の LLM がストリーミングをサポートしています。

- ミストラル AI 7B、ミストラル AI 7B 命令

- ファルコン 180B、ファルコン 180B チャット

- ファルコン 40B、ファルコン 40B 命令

- ファルコン 7B、ファルコン 7B 命令

- Rinna 日本語 GPT NeoX 4B 命令 PPO

- Rinna 日本語 GPT NeoX 3.6B 命令 PPO

SageMaker JumpStart でストリーミングをサポートするモデルのリストの更新を確認するには、次の場所で「huggingface-llm」を検索します。 事前トレーニング済みのモデル テーブルを使用した組み込みアルゴリズム.

を使用できることに注意してください ストリーミング機能 of アマゾンセージメーカー で説明されているように、SageMaker TGI Deep Learning Container (DLC) を使用してデプロイされたモデルをすぐにホスティングできます。 Amazon SageMaker での新しい Hugging Face LLM 推論コンテナの開始を発表.

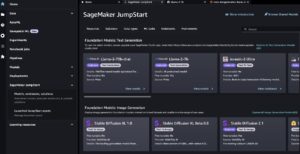

SageMaker の基盤モデル

SageMaker JumpStart は、Hugging Face、PyTorch Hub、TensorFlow Hub などの一般的なモデル ハブのさまざまなモデルへのアクセスを提供し、SageMaker の ML 開発ワークフロー内で使用できます。 ML の最近の進歩により、として知られる新しいクラスのモデルが誕生しました。 基礎モデルこれらは通常、数十億のパラメータでトレーニングされ、テキストの要約、デジタル アートの生成、言語翻訳など、幅広いカテゴリのユースケースに適応できます。 これらのモデルのトレーニングにはコストがかかるため、顧客はこれらのモデルを自分でトレーニングするのではなく、既存の事前トレーニングされた基礎モデルを使用し、必要に応じて微調整することを望んでいます。 SageMaker は、SageMaker コンソールで選択できる厳選されたモデルのリストを提供します。

SageMaker JumpStart 内でさまざまなモデルプロバイダーの基礎モデルを検索できるようになり、基礎モデルをすぐに開始できるようになりました。 SageMaker JumpStart は、さまざまなタスクまたはモデルプロバイダーに基づいた基礎モデルを提供し、モデルの特性と使用条件を簡単に確認できます。 テスト UI ウィジェットを使用してこれらのモデルを試すこともできます。 基礎モデルを大規模に使用したい場合は、モデルプロバイダーが提供する事前構築済みのノートブックを使用することで、SageMaker を離れることなく使用できます。 モデルは AWS でホストおよびデプロイされるため、モデルの評価または大規模な使用に使用されるデータがサードパーティと共有されないことが信頼できます。

トークンストリーミング

トークン ストリーミングを使用すると、モデルによって生成される推論応答を返すことができます。 こうすることで、完全な応答を提供する前にモデルの終了を待つのではなく、段階的に生成される応答を確認できます。 ストリーミングは、エンドユーザーの待ち時間の認識を軽減するため、より良いユーザー エクスペリエンスを実現するのに役立ちます。 出力の生成と同時に表示を開始できるため、出力が目的に役に立たないと思われる場合は、生成を早期に停止できます。 ストリーミングは、特に長時間実行されるクエリの場合に大きな違いを生む可能性があります。これは、出力が生成されたときに表示されるようになるため、エンドツーエンドの待ち時間が同じであっても、待ち時間が短くなったように感じる可能性があります。

この記事の執筆時点では、Hugging Face LLM を利用するモデルに対して SageMaker JumpStart でストリーミングを使用できます。 テキスト生成の推論 DLC。

| 蒸気を出さずに応答 | ストリーミングによる応答 |

ソリューションの概要

この投稿では、Falcon 7B Instruct モデルを使用して、SageMaker JumpStart ストリーミング機能を紹介します。

次のコードを使用すると、ストリーミングをサポートする SageMaker JumpStart 内の他のモデルを見つけることができます。

ストリーミングをサポートする次のモデル ID を取得します。

前提条件

ノートブックを実行する前に、セットアップに必要な初期手順がいくつかあります。 次のコマンドを実行します。

モデルを展開する

最初のステップとして、SageMaker JumpStart を使用して Falcon 7B Instruct モデルをデプロイします。 完全な手順については、以下を参照してください。 TII の Falcon 180B 基礎モデルが Amazon SageMaker JumpStart 経由で入手可能になりました。 次のコードを使用します。

エンドポイントをクエリして応答をストリームする

次に、デプロイされたエンドポイントを呼び出すためのペイロードを構築します。 重要なのは、ペイロードにはキーと値のペアが含まれている必要があることです。 "stream": True。 これは、テキスト生成推論サーバーにストリーミング応答を生成するように指示します。

エンドポイントをクエリする前に、エンドポイントからのバイト ストリーム応答を解析できるイテレータを作成する必要があります。 各トークンのデータは応答内の個別の行として提供されるため、この反復子はストリーミング バッファーで新しい行が識別されるたびにトークンを返します。 このイテレータは最小限に設計されているため、ユースケースに合わせてその動作を調整することができます。 たとえば、このイテレータはトークン文字列を返しますが、行データにはトークン ログの確率など、興味深い可能性のある他の情報が含まれています。

Boto3を使用できるようになりました。 invoke_endpoint_with_response_stream 作成したエンドポイント上の API を反復処理することでストリーミングを有効にします。 TokenIterator インスタンス:

空の指定 end へのパラメータ print 関数は、改行文字を挿入せずにビジュアル ストリームを有効にします。 これにより、次の出力が生成されます。

このコードをノートブックや Streamlit や Gradio などの他のアプリケーションで使用して、ストリーミングの動作とそれが顧客に提供するエクスペリエンスを確認できます。

クリーンアップ

最後に、追加コストの発生を避けるために、デプロイされたモデルとエンドポイントをクリーンアップすることを忘れないでください。

まとめ

この投稿では、SageMaker JumpStart で新しくリリースされたストリーミング機能の使用方法を説明しました。 トークン ストリーミング機能を使用して、より良いユーザー エクスペリエンスを実現するため、低遅延を必要とするインタラクティブなアプリケーションを構築していただければ幸いです。

著者について

ラクナ チャダ は、AWS の戦略アカウントにおける AI/ML のプリンシパル ソリューション アーキテクトです。 Rachna は楽観主義者で、AI を倫理的かつ責任をもって使用することで将来の社会を改善し、経済的および社会的繁栄をもたらすことができると信じています。 余暇には、家族と一緒に時間を過ごしたり、ハイキングをしたり、音楽を聴いたりするのが好きです。

ラクナ チャダ は、AWS の戦略アカウントにおける AI/ML のプリンシパル ソリューション アーキテクトです。 Rachna は楽観主義者で、AI を倫理的かつ責任をもって使用することで将来の社会を改善し、経済的および社会的繁栄をもたらすことができると信じています。 余暇には、家族と一緒に時間を過ごしたり、ハイキングをしたり、音楽を聴いたりするのが好きです。

カイル・ウルリッヒ博士 応用科学者であり、 AmazonSageMakerの組み込みアルゴリズム チーム。 彼の研究対象には、スケーラブルな機械学習アルゴリズム、コンピューター ビジョン、時系列、ベイジアン ノンパラメトリック、およびガウス過程が含まれます。 彼はデューク大学で博士号を取得しており、NeurIPS、Cell、Neuron で論文を発表しています。

カイル・ウルリッヒ博士 応用科学者であり、 AmazonSageMakerの組み込みアルゴリズム チーム。 彼の研究対象には、スケーラブルな機械学習アルゴリズム、コンピューター ビジョン、時系列、ベイジアン ノンパラメトリック、およびガウス過程が含まれます。 彼はデューク大学で博士号を取得しており、NeurIPS、Cell、Neuron で論文を発表しています。

アシッシュ・ケタン博士 は、Amazon SageMaker 組み込みアルゴリズムを使用する上級応用科学者であり、機械学習アルゴリズムの開発を支援しています。 イリノイ大学アーバナシャンペーン校で博士号を取得。 彼は機械学習と統計的推論の活発な研究者であり、NeurIPS、ICML、ICLR、JMLR、ACL、および EMNLP カンファレンスで多くの論文を発表しています。

アシッシュ・ケタン博士 は、Amazon SageMaker 組み込みアルゴリズムを使用する上級応用科学者であり、機械学習アルゴリズムの開発を支援しています。 イリノイ大学アーバナシャンペーン校で博士号を取得。 彼は機械学習と統計的推論の活発な研究者であり、NeurIPS、ICML、ICLR、JMLR、ACL、および EMNLP カンファレンスで多くの論文を発表しています。

- SEO を活用したコンテンツと PR 配信。 今日増幅されます。

- PlatoData.Network 垂直生成 Ai。 自分自身に力を与えましょう。 こちらからアクセスしてください。

- プラトアイストリーム。 Web3 インテリジェンス。 知識増幅。 こちらからアクセスしてください。

- プラトンESG。 カーボン、 クリーンテック、 エネルギー、 環境、 太陽、 廃棄物管理。 こちらからアクセスしてください。

- プラトンヘルス。 バイオテクノロジーと臨床試験のインテリジェンス。 こちらからアクセスしてください。

- 情報源: https://aws.amazon.com/blogs/machine-learning/stream-large-language-model-responses-in-amazon-sagemaker-jumpstart/

- :持っている

- :は

- $UP

- 1

- 10

- 100

- 12

- 13

- 14

- 19

- 7

- 8

- a

- 私たちについて

- アクセス

- アカウント

- Action

- アクティブ

- 加えます

- NEW

- 進歩

- アドバイス

- AI

- AI / ML

- アルゴリズム

- ことができます

- また

- Amazon

- アマゾンセージメーカー

- Amazon SageMaker ジャンプスタート

- Amazon Webサービス

- an

- および

- アナウンス

- どれか

- API

- 適用された

- です

- 宝品

- AS

- At

- 利用できます

- 避ける

- AWS

- ベース

- ベイジアン

- BE

- なぜなら

- 行動

- さ

- と考えています

- より良いです

- ビッグ

- 億

- ボディ

- ボックス

- 持って来る

- バッファ

- ビルド

- 内蔵

- 焙煎が極度に未発達や過発達のコーヒーにて、クロロゲン酸の味わいへの影響は強くなり、金属を思わせる味わいと乾いたマウスフィールを感じさせます。

- by

- 缶

- 機能

- 場合

- 例

- カテゴリー

- 特性

- 文字

- チェック

- 選択する

- class

- クライアント

- コード

- コンプリート

- 複雑な

- コンピュータ

- Computer Vision

- 会議

- 領事

- 構築する

- 含む

- コンテナ

- コンテナ

- 含まれています

- コンテンツ

- コスト

- 可能性

- 作ります

- 作成した

- 作成

- CSS

- キュレーション

- Customers

- データ

- 減少

- 深いです

- 深い学習

- 展開します

- 展開

- 記載された

- 設計

- 設計

- デザイナー

- 決定する

- 開発する

- Developer

- 開発

- 違い

- 異なります

- デジタル

- デジタルアート

- ディスプレイ

- do

- ドメイン

- ドメイン名

- デューク

- デューク大学

- 各

- 早い

- 簡単に

- 経済

- enable

- 有効にする

- 端から端まで

- エンドポイント

- エンジン

- 確保

- 特に

- 倫理的な

- 評価します

- さらに

- 例

- 興奮した

- 既存の

- 高価な

- 体験

- 顔

- 家族

- 特徴

- フィルター

- もう完成させ、ワークスペースに掲示しましたか?

- 仕上げ

- 名

- フォロー中

- Foundation

- フレームワーク

- から

- フル

- function

- 未来

- 一般に

- 生成する

- 生成された

- 生成

- 世代

- 取得する

- 与えられた

- 目標

- だ

- ガイド

- 持ってる

- he

- 助けます

- 役立つ

- ことができます

- 彼女の

- 彼の

- 希望

- 主催

- ホスティング

- 認定条件

- How To

- HTML

- HTTPS

- ハブ

- ハブ

- 抱き合う顔

- i

- 特定され

- イド

- if

- イリノイ州

- import

- 重要なこと

- 改善します

- in

- include

- 含めて

- を示し

- 情報

- 初期

- 入力

- install

- を取得する必要がある者

- 説明書

- 相互作用的

- 関心

- 利益

- IT

- ITS

- 日本語

- JavaScriptを

- JSON

- キープ

- 既知の

- カイル

- 言語

- 大

- レイテンシ

- 起動する

- 打ち上げ

- 学習

- 残す

- ような

- 好き

- LINE

- リスト

- 耳を傾ける

- LLM

- ログ

- 探して

- ロー

- 下側

- 機械

- 機械学習

- 製

- 維持する

- make

- 多くの

- 五月..

- かもしれない

- ML

- モデル

- 音楽を聴く際のスピーカーとして

- 名

- 必要

- 必要とされる

- 新作

- 新しく

- いいえ

- ノート

- 今

- of

- オファー

- on

- オンライン

- 最適化

- or

- その他

- でる

- 出力

- outputs

- が

- ペア

- 論文

- パラメーター

- パラメータ

- パーティー

- 知覚

- 博士号

- プラトン

- プラトンデータインテリジェンス

- プラトデータ

- 人気

- ポスト

- Predictor

- 校長

- プロセス

- ラボレーション

- 生産する

- 正しく

- 繁栄

- 提供

- プロバイダー

- プロバイダ

- は、大阪で

- 提供

- 公表

- 目的

- 目的

- パイトーチ

- クエリ

- すぐに

- 範囲

- むしろ

- 最近

- 参照する

- 定期的に

- 覚えています

- の提出が必要です

- 研究

- 研究者

- リソース

- 応答

- 回答

- 責任

- return

- 収益

- レビュー

- 上昇

- ラン

- ランニング

- セージメーカー

- 同じ

- ド電源のデ

- 規模

- 科学者

- を検索

- 検索エンジン

- 見ること

- Seek

- 自己

- シニア

- 別

- シリーズ

- サービス

- shared

- すべき

- ショーケース

- 示されました

- スムーズに

- So

- 社会

- 社会

- 溶液

- 一部

- 支出

- start

- 開始

- 統計的

- 手順

- ステップ

- Force Stop

- 戦略的

- 流れ

- ストリーミング

- そのような

- サポート

- 支援する

- 仕事

- タスク

- チーム

- テンプレート

- テンソルフロー

- 条件

- test

- 클라우드 기반 AI/ML및 고성능 컴퓨팅을 통한 디지털 트윈의 기초 – Edward Hsu, Rescale CPO 많은 엔지니어링 중심 기업에게 클라우드는 R&D디지털 전환의 첫 단계일 뿐입니다. 클라우드 자원을 활용해 엔지니어링 팀의 제약을 해결하는 단계를 넘어, 시뮬레이션 운영을 통합하고 최적화하며, 궁극적으로는 모델 기반의 협업과 의사 결정을 지원하여 신제품을 결정할 때 데이터 기반 엔지니어링을 적용하고자 합니다. Rescale은 이러한 혁신을 돕기 위해 컴퓨팅 추천 엔진, 통합 데이터 패브릭, 메타데이터 관리 등을 개발하고 있습니다. 이번 자리를 빌려 비즈니스 경쟁력 제고를 위한 디지털 트윈 및 디지털 스레드 전략 개발 방법에 대한 인사이트를 나누고자 합니다.

- より

- それ

- この線

- それら

- 自分自身

- そこ。

- したがって、

- ボーマン

- 三番

- 第三者

- この

- しかし?

- 介して

- 時間

- 時系列

- 〜へ

- トークン

- トレーニング

- 訓練された

- インタビュー

- true

- 信頼

- 試します

- チュートリアル

- 一般的に

- ui

- 大学

- アップデイト

- 更新版

- 使用法

- つかいます

- 使用事例

- 中古

- ユーザー

- 操作方法

- 活用する

- 、

- ビジョン

- wait

- 待っています

- 歩く

- 欲しいです

- 仕方..

- we

- ウェブ

- Webサービス

- ウェブサイト

- いつ

- かどうか

- which

- while

- 誰

- ワイド

- 意志

- 以内

- 無し

- ワークフロー

- ワーキング

- 書き込み

- You

- あなたの

- ゼファーネット