近年、ディープラーニング ニューラル ネットワーク (DNN) は驚くべき成長を遂げています。 この成長は、より正確なモデルで見られ、自然言語を合成する大規模言語モデル (LLM)、テキストから画像へのジェネレーターなど、生成 AI の新たな可能性を開くことさえあります。 DNN のこうした機能の向上には、トレーニングに大量の計算リソースを必要とする大規模なモデルを用意するというコストが伴います。 分散トレーニングでは、データ並列処理とモデル並列処理という XNUMX つの手法を使用してこの問題に対処します。 データ並列処理は、複数のノードとワーカーにわたってトレーニング プロセスをスケールするために使用され、モデル並列処理はモデルを分割し、指定されたインフラストラクチャ上にそれらを適合させます。 アマゾンセージメーカー 分散トレーニング ジョブを使用すると、ワンクリック (または XNUMX 回の API 呼び出し) で分散コンピューティング クラスターのセットアップ、モデルのトレーニング、結果の保存を行うことができます。 Amazon シンプル ストレージ サービス (Amazon S3)、完了したらクラスターをシャットダウンします。 さらに、SageMaker は、次のような機能をリリースすることにより、分散トレーニング領域で継続的に革新を行ってきました。 異種クラスタ および分散トレーニング ライブラリ データの並列処理 および モデルの並列処理.

分散環境で効率的にトレーニングするには、ハイパーパラメータを調整する必要があります。 複数の GPU でトレーニングする場合の一般的な良い実践例は、GPU ごとに同じバッチ サイズを維持するために、バッチ (またはミニバッチ) サイズに GPU 番号を乗算することです。 ただし、ハイパーパラメーターの調整はモデルの収束に影響を与えることがよくあります。 したがって、分散トレーニングでは、分散、ハイパーパラメーター、モデルの精度という XNUMX つの要素のバランスを取る必要があります。

この投稿では、分散トレーニングが収束に及ぼす影響とその使用方法について検討します。 Amazon SageMaker 自動モデルチューニング データ並列処理を使用して分散トレーニング用にモデルのハイパーパラメータを微調整します。

この投稿で言及されているソース コードは、次の場所にあります。 GitHubリポジトリ (m5.xlarge インスタンスが推奨されます)。

トレーニングを単一環境から分散環境にスケールアウト

データ並列処理は、トレーニング プロセスを複数のコンピューティング リソースに拡張し、トレーニング時間を短縮する方法です。 データ並列処理では、データが計算ノード間で分割され、各ノードがその分割に基づいて勾配を計算し、モデルを更新します。 これらの更新は、XNUMX つまたは複数のパラメーター サーバーを使用して、非同期、XNUMX 対多、または全対全の方法で実行できます。 もう XNUMX つの方法は、AllReduce アルゴリズムを使用することです。 たとえば、ring-allreduce アルゴリズムでは、各ノードは隣接する XNUMX つのノードのみと通信するため、全体のデータ転送が削減されます。 パラメータサーバーとring-allreduceの詳細については、を参照してください。 Amazon SageMaker の Horovod またはパラメータサーバーを使用して TensorFlow 分散トレーニングを簡単に起動する。 データのパーティショニングに関しては、 n ノードを計算すると、各ノードはデータのサブセット (約 1/) を取得する必要があります。n サイズで。

モデルの収束に対するスケールアウト トレーニングの効果を実証するために、XNUMX つの簡単な実験を実行します。

各モデルのトレーニングは XNUMX 回実行されました。XNUMX つのインスタンス上で実行され、複数のインスタンスに分散されました。 DNN 分散トレーニングでは、分散プロセッサを最大限に活用するために、ミニバッチ サイズにインスタンス数 (XNUMX つ) を掛けました。 次の表は、セットアップと結果をまとめたものです。

| 問題の種類 | 画像分類 | バイナリ分類 | ||

| モデル | DNN | XGブースト | ||

| インスタンス | ml.c4.xlarge | ml.m5.2xラージ | ||

| データセット |

(ラベル付き画像) |

Direct Marketing (表形式、数値カテゴリ、およびベクトル化されたカテゴリ) |

||

| 検証メトリック | 正確さ | AUC | ||

| エポック/ラウンド | 20 | 150 | ||

| インスタンス数 | 1 | 4 | 1 | 3 |

| 分布タイプ | 無し | パラメータサーバー | 無し | すべてリデュース |

| トレーニング時間(分) | 8 | 3 | 3 | 1 |

| 最終検証スコア | 0.97 | 0.11 | 0.78 | 0.63 |

どちらのモデルでも、トレーニング時間は分配係数によってほぼ直線的に短縮されました。 ただし、モデルの収束性は大幅に低下しました。 この動作は、XNUMX つの異なるモデル、異なるコンピューティング インスタンス、異なる分散方法、および異なるデータ型でも一貫しています。 では、なぜトレーニング プロセスの分散がモデルの精度に影響を与えるのでしょうか?

この効果を説明しようとする理論は数多くあります。

- テンソル更新のサイズが大きい場合、ワーカーとパラメーター サーバー間のトラフィックが混雑する可能性があります。 したがって、非同期パラメータ サーバーは、重み更新の遅延により、収束が大幅に悪化することになります [1]。

- バッチ サイズを増やすと、過剰適合や一般化の低下につながる可能性があり、その結果、検証精度が低下します [2]。

- モデル パラメーターを非同期的に更新する場合、一部の DNN は最新の更新されたモデルの重みを使用していない可能性があります。 したがって、数回の反復後の重みに基づいて勾配を計算します。 これは体重の老化につながります [3]。これにはさまざまな理由が考えられます。

- 一部のハイパーパラメータはモデルまたはオプティマイザに固有です。 たとえば、XGBoost 公式ドキュメントには次のように書かれています。

exactの値tree_modeXGBoost は行分割データ分散を採用しているのに対し、ハイパーパラメータは分散トレーニングをサポートしていません。exactツリーメソッドはソートされた列形式で機能します。 - 一部の研究者は、より大きなミニバッチを構成すると、確率性が低い勾配が得られる可能性があると提案しました。 これは、損失関数に極小値と鞍点が含まれており、ステップ サイズに変更が加えられない場合に発生する可能性があり、最適化がそのような極小値または鞍点で行き詰まってしまいます [4]。

分散トレーニング向けに最適化する

ハイパーパラメータ最適化 (HPO) は、学習アルゴリズムに最適なハイパーパラメータのセットを検索して選択するプロセスです。 SageMaker 自動モデル チューニング (AMT) は、提供されたデータセット上で複数のトレーニング ジョブを実行することにより、マネージド サービスとして HPO を提供します。 SageMaker AMT は、指定したハイパーパラメータの範囲を検索し、選択したメトリックによって測定された最適な値を返します。 SageMaker AMT を組み込みアルゴリズムとともに使用することも、カスタム アルゴリズムとコンテナーを使用することもできます。

ただし、分散トレーニングの最適化は、トレーニング ジョブごとに XNUMX つのインスタンスを起動するのではなく、実際には各ジョブがインスタンスのクラスターを起動するため、一般的な HPO とは異なります。 これは、コストへの影響が大きくなることを意味します (特に、DNN では一般的な、高価な GPU アクセラレーション インスタンスを考慮した場合)。 に加えて AMTの制限、もしかしたら当たるかもしれない SageMaker アカウントの制限 同時トレーニング インスタンスの数。 最後に、クラスターを起動すると、起動時間が長くなるため、運用上のオーバーヘッドが発生する可能性があります。 SageMaker AMT には、これらの問題に対処するための特定の機能があります。 早期停止を伴うハイパーバンド パフォーマンスの良いハイパーパラメータ構成が微調整され、パフォーマンスが低いハイパーパラメータ構成が自動的に停止されるようにします。 これにより、トレーニング時間を効率的に使用できるようになり、不必要なコストが削減されます。 また、SageMaker AMT は、Amazon EC2 スポット インスタンスの使用を完全にサポートしており、 トレーニング費用は最大 90% オンデマンド インスタンス上で。 起動時間が長い場合、SageMaker AMT は各チューニング ジョブ内でトレーニング インスタンスを自動的に再利用するため、各チューニング ジョブの平均起動時間が短縮されます。 トレーニングジョブを20倍にする。 さらに、次のことを行う必要があります AMT のベスト プラクティスこれには、関連するハイパーパラメータ、その適切な範囲とスケール、同時トレーニング ジョブの最適な数の選択、結果を再現するためのランダム シードの設定などがあります。

次のセクションでは、前に説明した XGBoost の例を使用して AMT ジョブを構成、実行、分析するときに、これらの機能が実際に動作する様子を見ていきます。

チューニング ジョブの構成、実行、分析

前述したように、ソース コードは次の場所にあります。 GitHubレポ。 ステップ 1 ~ 5 では、データをダウンロードして準備し、 xgb3 推定器 (分散 XGBoost 推定器は 1 つのインスタンスを使用するように設定されています)、トレーニング ジョブを実行し、結果を観察します。 このセクションでは、ステップ 5 ~ XNUMX をすでに完了していることを前提として、その推定器の調整ジョブを設定する方法について説明します。

チューニング ジョブは、パフォーマンスを評価するメトリックを使用して、起動するトレーニング ジョブの最適なハイパーパラメーターを計算します。 あなたはできる 独自のメトリクスを構成する、SageMaker は、設定して出力する正規表現に基づいて解析します。 stdout、または次のメトリクスを使用します。 SageMaker 組み込みアルゴリズム. この例では、 組み込みの XGBoost 目標メトリックしたがって、正規表現を構成する必要はありません。 モデルの収束を最適化するために、検証 AUC メトリクスに基づいて最適化します。

XNUMX つのハイパーパラメータを調整します。

- num_round – トレーニング中のブーストのラウンド数。

- イータ – オーバーフィッティングを防ぐために更新で使用されるステップ サイズの縮小。

- アルファ – 重みに関する L1 正則化項。

- min_child_weight – 子に必要なインスタンスの重み (ヘシアン) の最小合計。 ツリー分割ステップの結果、インスタンスの重みの合計が以下のリーフ ノードになった場合

min_child_weight、構築プロセスはそれ以上の分割をあきらめます。 - max_depth – ツリーの最大深度。

- Colsample_bylevel – 各レベルの各分割の列のサブサンプル比率。 このサブサンプリングは、ツリー内で新しい深さレベルに到達するたびに XNUMX 回実行されます。

- Colsample_bytree – 各ツリーを構築するときの列のサブサンプル率。 構築されたツリーごとに、サブサンプリングが XNUMX 回発生します。

XGBoost ハイパーパラメータの詳細については、を参照してください。 XGBoostハイパーパラメータ。 次のコードは、XNUMX つのハイパーパラメータとその範囲を示しています。

次に提供するのは、 ハイパーバンド戦略の構成 SageMaker SDK を使用したチューナー オブジェクトの設定。 HyperbandStrategyConfig 次の XNUMX つのパラメータを使用できます。 max_resource (オプション) 目的を達成するためにトレーニング ジョブに使用される反復の最大数、および min_resource – トレーニングを停止するまでにトレーニング ジョブで使用される最小反復回数。 を使用しております HyperbandStrategyConfig 構成する StrategyConfigこれは、後でチューニング ジョブ定義によって使用されます。 次のコードを参照してください。

ここで、 HyperparameterTuner オブジェクトに次の情報を渡します。

- XGBoost エスティメーター、XNUMX つのインスタンスで実行するように設定

- 客観的なメトリクスの名前と定義

- ハイパーパラメータの範囲

- 合計で実行するトレーニング ジョブの数や、並行して実行できるトレーニング ジョブの数などのリソース構成のチューニング

- ハイパーバンド設定 (最後のステップで構成した戦略と構成)

- 早期停止(

early_stopping_type) に設定Off

早期停止をオフに設定するのはなぜですか? トレーニング ジョブは、ハイパーパラメーター調整ジョブの客観的なメトリックを改善する可能性が低い場合、早期に停止できます。 これは、計算時間を短縮し、モデルの過剰適合を回避するのに役立ちます。 ただし、Hyperband は高度な組み込みメカニズムを使用して早期停止を適用します。 したがって、パラメータは early_stopping_type 設定する必要があります Off Hyperband の内部早期停止機能を使用する場合。 次のコードを参照してください。

最後に、を呼び出して自動モデル調整ジョブを開始します。 フィット 方法。 ジョブを非同期で起動する場合は、次のように設定します。 wait 〜へ False。 次のコードを参照してください。

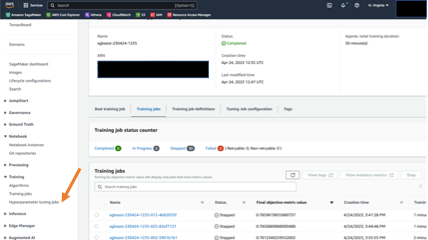

SageMaker コンソールでジョブの進行状況と概要を追跡できます。 ナビゲーション ペインの次の トレーニング、選択する ハイパーパラメータ調整ジョブをクリックし、関連するチューニング ジョブを選択します。 次のスクリーンショットは、トレーニング ジョブのステータスとパフォーマンスの詳細を含むチューニング ジョブを示しています。

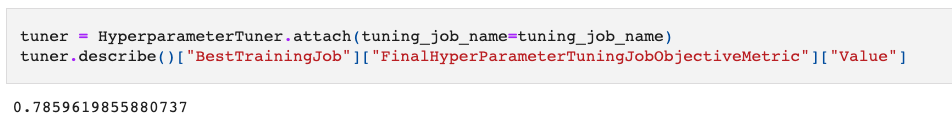

調整ジョブが完了したら、結果を確認できます。 ノートブックの例では、SageMaker SDK を使用して結果を抽出する方法を示します。 まず、調整ジョブによってモデルの収束がどのように向上したかを調べます。 添付することができます HyperparameterTuner ジョブ名を使用してオブジェクトを呼び出し、 説明する 方法。 このメソッドは、チューニング ジョブのメタデータと結果を含むディクショナリを返します。

次のコードでは、客観的な指標 (検証 AUC) によって測定された、最もパフォーマンスの高いトレーニング ジョブの値を取得します。

結果は、検証セットの AUC で 0.78 です。 これは、最初の 0.63 に比べて大幅な改善です。

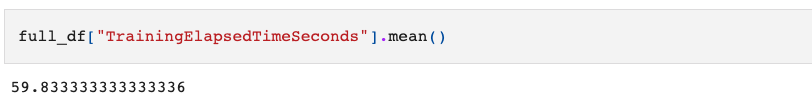

次に、トレーニング ジョブの実行速度を見てみましょう。 そのために、 ハイパーパラメータチューニングジョブアナリティクス SDK のメソッドを使用してチューニング ジョブに関する結果を取得し、分析と視覚化のために Pandas データ フレームに読み込みます。

ハイパーバンド戦略でのトレーニング ジョブにかかった平均時間を見てみましょう。

平均所要時間は約 1 分でした。 これは、パフォーマンスの低いトレーニング ジョブを早期に停止するハイパーバンド戦略メカニズムと一致しています。 コストの点では、調整作業には合計 30 分のトレーニング時間がかかりました。 Hyperband の早期停止がなければ、請求対象となるトレーニング時間の合計は 90 分 (30 ジョブ * ジョブあたり 1 分 * ジョブあたり 3 インスタンス) になると予想されました。 コスト削減においては 30 倍も優れています。 最後に、チューニング ジョブが 12 のトレーニング ジョブを実行し、合計 50 分かかったことがわかります。 これは、予想時間 (30 ジョブ/並列 4 ジョブ * ジョブあたり 3 分) のほぼ XNUMX% 短縮されます。

まとめ

この投稿では、分散環境でモデルをトレーニングするときに観察されたいくつかの収束の問題について説明しました。 Hyperband を使用した SageMaker AMT は、データの並列分散トレーニングの最適化によって生じる主な懸念事項、つまり収束 (10% 以上改善)、運用効率 (最適化されていないシーケンシャル ジョブよりもチューニング ジョブにかかる時間が 50% 短縮された) に対処していることがわかりました。所要時間)とコスト効率(請求対象となるトレーニング ジョブ時間の 30 分に対して 90 分)。 次の表は結果をまとめたものです。

| 改善指標 | チューニングなし/単純なモデルチューニングの実装 | SageMaker Hyperband 自動モデルチューニング | 測定された改善 |

| モデルの品質 (検証AUCにより測定) |

0.63 | 0.78 | 視聴者の38%が |

| 費用 (課金対象のトレーニング時間によって測定) |

90 | 30 | 視聴者の38%が |

| 運用効率 (総走行時間で計測) |

24 | 12 | 視聴者の38%が |

スケーリング (クラスター サイズ) に関して微調整するには、複数のクラスター構成で調整ジョブを繰り返し、結果を比較して、速度とモデルの精度を満たす最適なハイパーパラメーターを見つけることができます。

これを達成するための手順は、このガイドの最後のセクションに記載されています。 ノート.

参考文献

[1] Lian、Xiangru、他。 「非同期分散並列確率的勾配降下法」 機械学習に関する国際会議。 PMLR、2018年。

[2] Keskar、Nitish Shirish、他。 「深層学習の大規模バッチトレーニングについて: 汎化ギャップと鋭い最小値」 arXivプレプリントarXiv:1609.04836 とします。

[3] Dai、Wei、他。 「分散機械学習における古さの影響の理解に向けて。」 arXivプレプリントarXiv:1810.03264 とします。

[4] Dauphin、Yann N.、他。 「高次元の非凸最適化における鞍点問題を特定して攻撃する。」 神経情報処理システムの進歩 27(2014)。

著者について

Uri Rosenberg は、ヨーロッパ、中東、アフリカの AI および ML スペシャリスト テクニカル マネージャーです。 Uri はイスラエルを拠点に、企業顧客が ML ワークロードを大規模に設計、構築、運用できるようにすることに取り組んでいます。 余暇には、サイクリングやハイキングを楽しんだり、データの準備について愚痴ったりすることを楽しんでいます。

Uri Rosenberg は、ヨーロッパ、中東、アフリカの AI および ML スペシャリスト テクニカル マネージャーです。 Uri はイスラエルを拠点に、企業顧客が ML ワークロードを大規模に設計、構築、運用できるようにすることに取り組んでいます。 余暇には、サイクリングやハイキングを楽しんだり、データの準備について愚痴ったりすることを楽しんでいます。

- SEO を活用したコンテンツと PR 配信。 今日増幅されます。

- PlatoData.Network 垂直生成 Ai。 自分自身に力を与えましょう。 こちらからアクセスしてください。

- プラトアイストリーム。 Web3 インテリジェンス。 知識増幅。 こちらからアクセスしてください。

- プラトンESG。 自動車/EV、 カーボン、 クリーンテック、 エネルギー、 環境、 太陽、 廃棄物管理。 こちらからアクセスしてください。

- ブロックオフセット。 環境オフセット所有権の近代化。 こちらからアクセスしてください。

- 情報源: https://aws.amazon.com/blogs/machine-learning/effectively-solve-distributed-training-convergence-issues-with-amazon-sagemaker-hyperband-automatic-model-tuning/

- :持っている

- :は

- :not

- $UP

- 1

- 10

- 100

- 12

- 視聴者の38%が

- 20

- 200

- 2014

- 2016

- 2018

- 24

- 27

- 30

- 7

- 8

- 9

- a

- 私たちについて

- 精度

- 正確な

- 達成する

- Action

- 実際に

- 添加

- さらに

- 住所

- アドレス

- 高度な

- 影響を及ぼす

- アフリカ

- AI

- AL

- アルゴリズム

- アルゴリズム

- アルファ

- 既に

- また

- 驚くべき

- Amazon

- Amazon EC2

- アマゾンセージメーカー

- Amazon Webサービス

- 間で

- an

- 分析

- 分析論

- 分析します

- および

- 別の

- API

- 申し込む

- 適切な

- 約

- です

- AS

- At

- アタッチ

- 攻撃

- オートマチック

- 自動的に

- 平均

- 避ける

- AWS

- ベース

- BE

- なぜなら

- 行動

- 背後に

- BEST

- より良いです

- の間に

- ビッグ

- 後押し

- 両言語で

- ビルド

- 建物

- 内蔵

- by

- 計算

- コール

- 呼び出し

- 缶

- 取得することができます

- 機能

- カテゴリ

- 生じました

- 変化する

- 荷担した

- 子

- 選択する

- 選択する

- クリック

- クラスタ

- コード

- コラム

- コラム

- 来ます

- コマンドと

- 比較します

- コンプリート

- 計算

- 懸念事項

- 同時

- 講演

- 設定された

- 検討

- 整合性のある

- 領事

- 構築

- コンテナ

- 含まれています

- 連続的に

- 収束

- 費用

- 高額で

- コスト

- 可能性

- 作ります

- カスタム

- Customers

- DAI

- データ

- データの準備

- 分権化された

- 深いです

- 深い学習

- 定義

- 遅延

- 実証します

- 深さ

- 説明する

- 記載された

- 設計

- 指定された

- 細部

- DID

- 異なります

- 議論する

- 配布

- 分散トレーニング

- 配布する

- ディストリビューション

- do

- ドキュメント

- そうではありません

- 行われ

- ドント

- ダウン

- ダウンロード

- Drop

- 原因

- デュレーション

- 間に

- E&T

- 各

- 前

- 早い

- 簡単に

- 東

- 効果

- 効果的に

- 効率

- 効率的な

- 従業員

- エンパワー

- enable

- 可能

- 確実に

- Enterprise

- 環境

- 環境

- 特に

- ヨーロッパ

- 評価する

- さらに

- あらゆる

- 調べる

- 例

- 予想される

- 実験

- 説明する

- 探る

- エキス

- 要因

- 要因

- ファッション

- スピーディー

- 速いです

- 特徴

- 特徴

- 少数の

- 最後に

- もう完成させ、ワークスペースに掲示しましたか?

- 名

- フィット

- フォロー中

- 形式でアーカイブしたプロジェクトを保存します.

- 発見

- 4

- FRAME

- から

- 完全に

- function

- さらに

- さらに

- ギャップ

- 生々しい

- 生成AI

- 発電機

- 取得する

- 受け

- 与える

- 良い

- GPU

- GPU

- 勾配

- 大きい

- 成長性

- 起こる

- 持ってる

- 持って

- he

- 助けます

- 彼の

- ヒット

- 認定条件

- How To

- しかしながら

- HTML

- HTTP

- HTTPS

- ハイパーパラメータ調整

- if

- 画像

- 影響

- 影響

- 改善します

- 改善されました

- 改善

- in

- 含まれました

- 増加した

- 情報

- インフラ関連事業

- 初期

- を取得する必要がある者

- 内部

- に

- 紹介する

- 導入

- イスラエル

- 問題

- IT

- 繰り返し

- ITS

- ジョブ

- Jobs > Create New Job

- キープ

- L1

- 言語

- 大

- より大きい

- 姓

- 後で

- 起動する

- 起動

- 発射

- つながる

- リード

- LEARN

- 学習

- less

- レベル

- ライブラリ

- ような

- ローカル

- 長い

- より長いです

- 損失

- 機械

- 機械学習

- 製

- メイン

- マネージド

- マネージャー

- 多くの

- 大規模な

- 五月..

- 手段

- メカニズム

- 言及した

- 方法

- メソッド

- メトリック

- メトリック

- 真ん中

- 中東

- かもしれない

- 最小

- 分

- 分

- ML

- モデル

- 他には?

- 最も

- の試合に

- 掛け

- しなければなりません

- 名

- ナチュラル

- ナビゲーション

- 必要

- 必要とされる

- ニーズ

- ネットワーク

- ニューラルネットワーク

- 新作

- 次の

- いいえ

- ノード

- ノート

- 数

- オブジェクト

- 客観

- 観察する

- of

- オフ

- 公式

- 頻繁に

- on

- オンデマンド

- かつて

- ONE

- の

- 開設

- 操作する

- オペレーショナル

- 最適な

- 最適化

- 最適化

- 最適化

- or

- 注文

- 私たちの

- でる

- が

- 全体

- 自分の

- パンダ

- ペイン

- 並列シミュレーションの設定

- パラメーター

- パラメータ

- パス

- 以下のために

- パフォーマンス

- 場所

- プラトン

- プラトンデータインテリジェンス

- プラトデータ

- ポイント

- ポイント

- 貧しいです

- の可能性

- おそらく

- ポスト

- 練習

- 準備

- 準備

- 防ぐ

- 問題

- プロセス

- 処理

- プロセッサ

- 進捗

- 提案された

- 提供します

- 提供

- は、大阪で

- ランダム

- 比

- 達した

- 読む

- 理由は

- 最近

- 推奨される

- 減らします

- 電話代などの費用を削減

- 軽減

- 縮小

- よろしく

- 正規表現

- 関連した

- 繰り返す

- 必要とする

- 必要

- 研究者

- リソースを追加する。

- リソース

- 結果

- 結果

- 収益

- レビュー

- ラウンド

- 行

- ラン

- ランニング

- セージメーカー

- SageMaker自動モデルチューニング

- 同じ

- Save

- 見ました

- 言う

- SC

- 規模

- 秤

- スケーリング

- SDDK

- 検索

- セクション

- シード

- 見て

- 選択

- サーバー

- サービス

- サービス

- セッションに

- 設定

- 設定

- セブン

- シャープ

- すべき

- 表示する

- 示す

- 作品

- シャットダウン

- 重要

- 著しく

- 簡単な拡張で

- サイズ

- So

- 解決する

- 一部

- ソース

- ソースコード

- スペース

- 専門家

- 特定の

- スピード

- split

- 分割

- Spot

- start

- 起動

- スタートアップ

- Status:

- 手順

- ステップ

- 停止

- 停止

- 停止する

- ストレージ利用料

- 戦略

- そのような

- 苦しんだ

- 概要

- サポート

- サポート

- テーブル

- 撮影

- 取り

- 技術的

- テクニック

- テンソルフロー

- 期間

- 条件

- より

- それ

- ソース

- アプリ環境に合わせて

- それら

- その後

- そこ。

- それによって

- したがって、

- ボーマン

- 彼ら

- この

- それらの

- 三

- 介して

- 時間

- <font style="vertical-align: inherit;">回数</font>

- 〜へ

- 取った

- トータル

- トラフィック

- トレーニング

- 訓練された

- トレーニング

- 転送

- ツリー

- 試します

- Twice

- 2

- 典型的な

- 下

- 理解する

- ありそうもない

- 不要

- 更新しました

- 更新版

- 更新

- us

- つかいます

- 中古

- 使用されます

- 活用する

- 値

- 価値観

- 可視化

- vs

- 欲しいです

- ました

- 仕方..

- we

- ウェブ

- Webサービス

- 重量

- went

- いつ

- 一方

- which

- なぜ

- Wikipedia

- 意志

- 以内

- 無し

- 労働者

- 作品

- もっと悪い

- でしょう

- XGブースト

- 年

- You

- あなたの

- ゼファーネット