機械学習 (ML) モデルを構築、トレーニング、および評価して、提案された意図したビジネス上の問題を解決していることを確認したら、そのモデルをデプロイして、事業運営における意思決定を可能にします。 ビジネスに不可欠な機能をサポートするモデルは、モデル リリース戦略が導入されている運用環境にデプロイされます。 データが継続的に変化する ML モデルの性質を考えると、デプロイされたモデルが新しいデータに引き続き関連し、そうでない場合にモデルが更新されるようにする必要もあります。 これには、リスクとダウンタイムを最小限に抑える展開戦略の選択が含まれます。 この最適な展開戦略では、モデルの高可用性を維持し、既に運用されているものより劣るモデルを展開するビジネス コストを考慮し、以前のモデル バージョンに簡単にロールバックする機能を含める必要があります。 これらの推奨される考慮事項と展開パターンの多くは、 AWS よく設計されたフレームワーク – Machine Learning Lens.

適切な展開戦略を選択するだけでなく、MLOps プラクティスを含む信頼できるメカニズムを使用してその戦略を実装する必要があります。 MLOps には、ML ワークロードをリリース管理、CI/CD、および運用に統合するプラクティスが含まれており、モデルのデプロイと監視に関する考慮事項など、ML プロジェクトの固有の側面を説明しています。 MLOps用のAmazonSageMaker 高度なデプロイ パターンを使用して新しいモデルをデプロイおよび管理する機能など、ML ライフサイクル全体のステップを自動化および標準化するための専用ツールを提供します。

この投稿では、ML モデルをデプロイする方法について説明します アマゾンセージメーカー 繰り返し可能で自動化された方法で、 生産バリアント および 展開のガードレール MLOps ソリューションを使用した SageMaker の機能。 リアルタイムの単一モデルのエンドポイントに焦点を当てて、SageMaker の MLOps ツールを SageMaker モデルのデプロイ パターンと統合する方法を紹介します。

ソリューションの概要

次のモデルのテストとガードレール パターン、および SageMaker MLOps ツールとの統合について説明します。

- モデルテスト – 現在のモデル バージョンを置き換える前に、生産中のさまざまなモデル バージョンを比較します。 この投稿では、次のモデル テスト機能を比較します。

- A / Bテスト – A/B テストでは、モデル バリアント間でエンドポイント トラフィックを分散することにより、本番環境でモデルのさまざまなバージョンを比較します。 A/B テストは、クローズド ループのフィードバックがモデルの出力を下流のビジネス メトリックに直接結び付けることができるシナリオで使用されます。 このフィードバックは、あるモデルから別のモデルへの変更の統計的有意性を判断するために使用され、実稼働テストを通じて最適なモデルを選択するのに役立ちます。

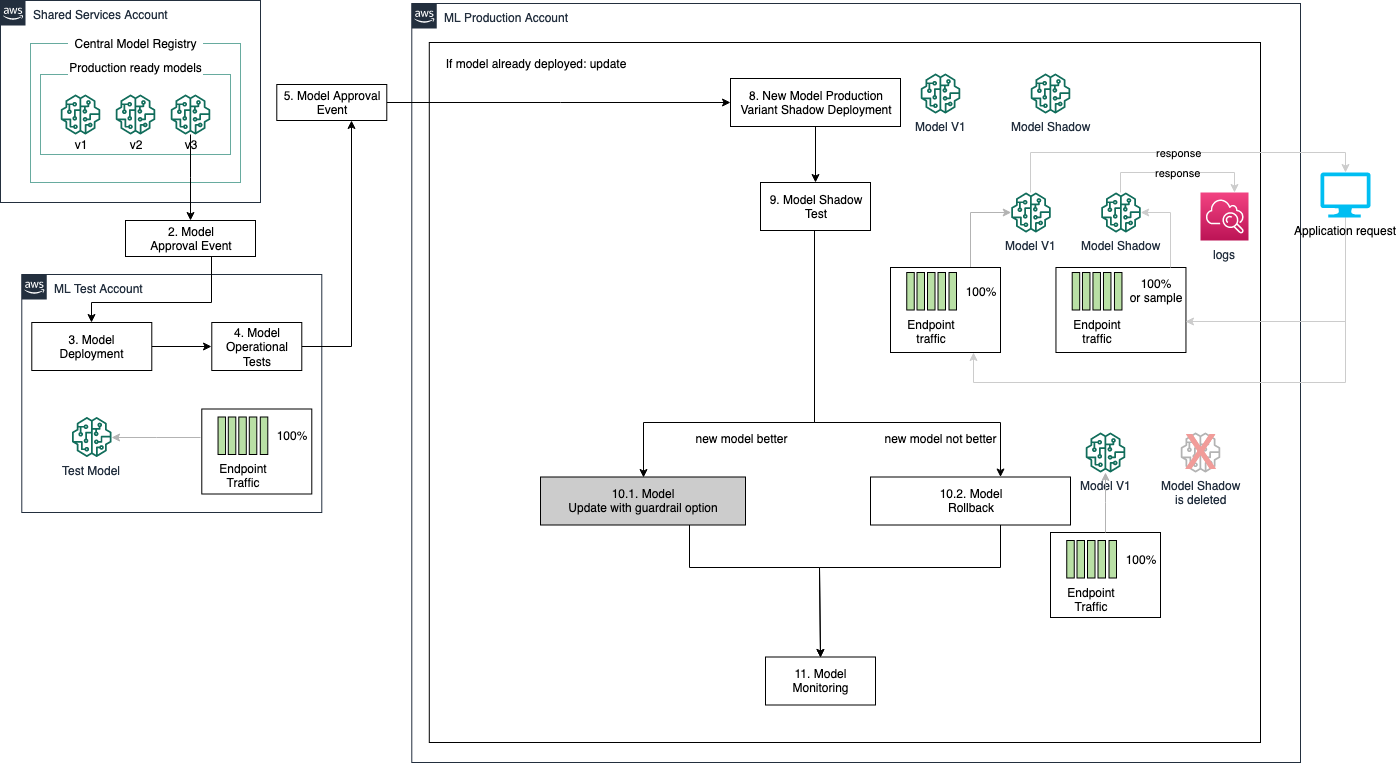

- シャドーテスト – シャドー テストでは、実稼働モデルと新しいモデルに並行して要求を送信することにより、実稼働環境でモデルの新しいバージョンをテストします。 本番モデルからの予測応答データはアプリケーションに提供されますが、新しいモデル バージョンの予測はテスト用に保存されますが、本番アプリケーションには提供されません。 シャドウ テストは、ビジネス メトリックをモデルの予測にマッピングする閉ループ フィードバックがない状況で使用されます。 このシナリオでは、下流のビジネス メトリックに影響を与えるのではなく、モデルの品質と運用メトリックを使用して複数のモデルを比較します。

- 交通量の変化 – モデルの新しいバージョンをテストし、そのパフォーマンスに満足したら、次のステップは、現在のモデルから新しいモデルにトラフィックを移行することです。 の 青/緑の展開ガードレール SageMaker では、現在の運用中のモデル (ブルーフリート) から新しいモデル (グリーンフリート) に制御された方法で簡単に切り替えることができます。 Blue/Green デプロイでは、インプレース デプロイ シナリオの場合と同様に、モデルの更新中のダウンタイムが回避されます。 モデルの可用性を最大化するために、この記事の執筆時点では、Blue/Green デプロイメントが SageMaker でのモデル更新のデフォルトのオプションになっています。 この投稿では、次のトラフィック シフト方法について説明します。

- 一気にトラフィックがシフト – グリーン フリートが使用可能になった後、エンドポイント トラフィックの 100% がブルー フリートからグリーン フリートに移行されます。 を使用しております アラーム in アマゾンクラウドウォッチ グリーンフリートを一定時間監視します( 焼成期間) アラームがトリガーされない場合、ブルーフリートはベーキング期間後に SageMaker によって削除されます。

- カナリア トラフィックのシフト – グリーン フリートが最初にさらされるトラフィックの割合は少なくなります (a カナリア) そして、青いフリートがほとんどのエンドポイント トラフィックを受信し続ける間、ベーキング期間に CloudWatch アラームを使用して問題がないか検証します。 緑のフリートが検証されると、すべてのトラフィックが新しいフリートに移行され、青のフリートは SageMaker によって削除されます。

- 青/緑の線形トラフィックのシフト ガードレール – ステップ アプローチでトラフィックをブルー フリートからグリーン フリートに徐々にシフトします。 その後、モデルは、Blue フリートが完全に置き換えられる前の各ステップのベーキング期間、CloudWatch アラームで監視されます。

この投稿では、SageMaker MLOps 機能を利用して、リストされているデプロイ ガードレールとモデリング テスト戦略を介してモデルの制御されたデプロイを実行するアーキテクチャについて説明することに焦点を当てています。 これらのパターンの一般的な情報については、次を参照してください。 AmazonSageMakerデプロイメントガードレールを使用して高度なデプロイメント戦略を活用する および 展開ガードレール.

SageMaker でモデルをデプロイする

SageMaker は幅広い機能を提供します 展開オプション 低レイテンシと高スループットから実行時間の長い推論ジョブまでさまざまです。 これらのオプションには、バッチ、リアルタイム、または ほぼリアルタイムの推論. 各オプションは、単一のエンドポイントで複数のモデルを実行する機能など、さまざまな高度な機能を提供します。 ただし、前述のように、この投稿では、単一モデルのエンドポイントを使用した MLOps 展開パターンのみを取り上げます。 リアルタイム推論のためのより高度な SageMaker デプロイ機能をさらに掘り下げるには、以下を参照してください。 Amazon SageMaker でのモデルホスティングパターン、パート 2: SageMaker でリアルタイムモデルのデプロイを開始する.

継続的デリバリー (CD) パイプラインを使用した高度なデプロイ パターンの実装を理解するために、最初に SageMaker 内の重要な概念について説明しましょう。 モデルバリアント.

SageMaker モデルバリアント

モデル バリアントを使用すると、モデルの複数のバージョンを同じエンドポイントにデプロイして、モデルをテストできます。 モデル バリアントは個別のインスタンスにデプロイされるため、XNUMX つが更新されても他のバリアントに影響はありません。 SageMaker では、モデルバリアントは本番バリアントおよびシャドウバリアントとして実装されます。

生産バリアント モデルの複数のバージョンを A/B テストして、パフォーマンスを比較できます。 このシナリオでは、モデルのすべてのバージョンがモデル リクエストへの応答を返します。 エンドポイント トラフィックは、各バリアントに重みを割り当てるトラフィック分散によって、または特定のパラメーター (地域や市場など) によって呼び出されるモデルが決定されるターゲット バリアントによって、既存のバリアント間で分散されます。

影の亜種 モデルの新しいバージョンをシャドウ テストできます。 このシナリオでは、モデルにプロダクション バリアントとシャドウ バリアントが同じエンドポイントに並行してデプロイされています。 シャドウ バリアントは、エンドポイントから完全な (またはサンプリングされた) データ トラフィックを受信します。 ただし、プロダクション バリアントの予測のみがアプリケーションのユーザーに返され、シャドウ バリアントからの予測は分析のためにログに記録されます。 シャドウ バリアントは本番バリアントとは別のインスタンスで起動されるため、このテストでは本番バリアントへのパフォーマンスの影響はありません。 このオプションを使用すると、新しいモデルをテストしてパフォーマンスの低いモデルのリスクを最小限に抑え、両方のモデルのパフォーマンスを同じデータで比較できます。

SageMaker デプロイのガードレール

ガードレールは、ソフトウェア開発の不可欠な部分です。 アプリケーションを保護し、アプリケーションの新しいバージョンがデプロイされるリスクを最小限に抑えます。 同様に、SageMaker デプロイ ガードレールを使用すると、あるモデル バージョンから別のモデル バージョンに制御された方法で切り替えることができます。 2022 年 XNUMX 月の時点で、SageMaker ガードレールは、ブルー/グリーン、カナリア、およびリニア トラフィック シフティング デプロイ オプションの実装を提供します。 モデル バリアントと組み合わせると、デプロイメント ガードレールをモデルの本番バリアントとシャドウ バリアントの両方に適用できます。これにより、新しいバリアントの更新中にダウンタイムが発生せず、選択したオプションに従ってトラフィックのシフトが制御されます。

モデル デプロイの MLOps 基盤

ML モデルの構築とデプロイのワークフローのより広いコンテキストでは、ML ワークフロー専用に構築された CI/CD プラクティスを採用したいと考えています。 従来の CI/CD システムと同様に、ソフトウェア テスト、統合テスト、本番環境へのデプロイを自動化したいと考えています。 ただし、モデルのトレーニング、モデルの実験、モデルのテスト、モデルの監視など、従来のソフトウェア開発ライフサイクルには存在しない ML ライフサイクルに関する特定の操作を含める必要もあります。

これらの ML 固有の機能を実現するために、自動モデル テスト、デプロイ ガードレール、マルチアカウント デプロイ、自動モデル ロールバックなどの MLOps 基盤がモデル デプロイ プロセスに追加されます。 これにより、既に説明した機能により、モデルのテストが可能になり、モデルの更新プロセス中のダウンタイムが回避されます。 また、生産準備完了モデルの継続的な改善に必要な信頼性とトレーサビリティも提供します。 さらに、既存のソリューションを再利用可能なテンプレートにパッケージ化し、マルチアカウント設定でモデルを展開する機能などの機能により、投稿で説明したモデル展開パターンを組織全体の複数のモデルに拡張できます。

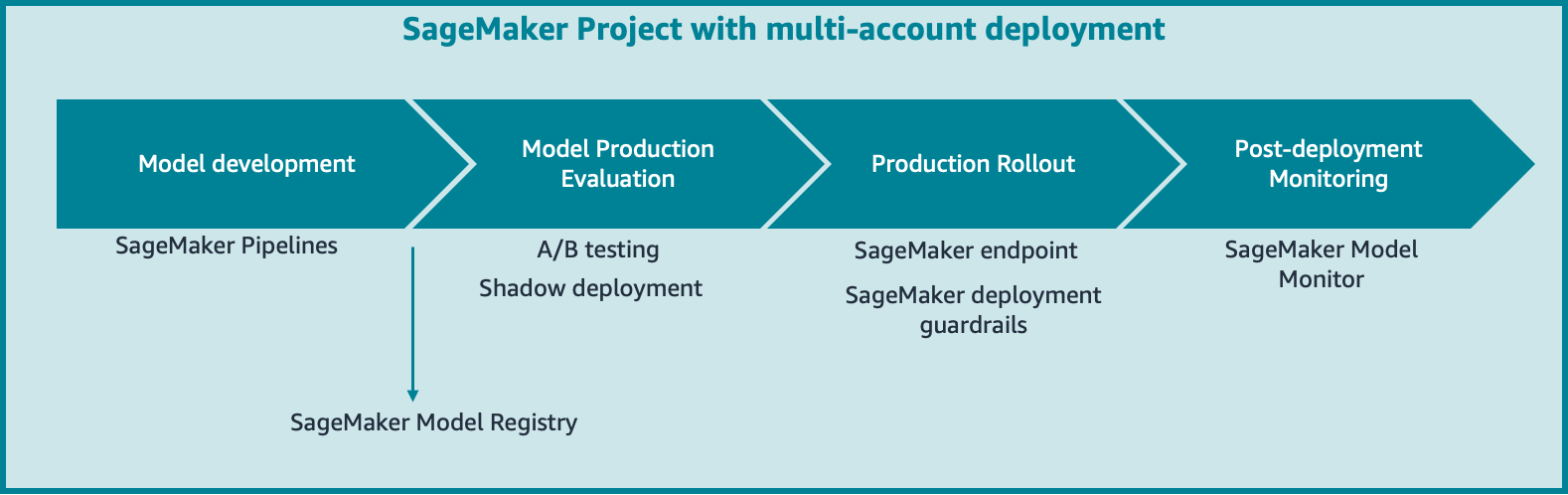

次の図は、エンドツーエンドのモデル構築およびデプロイ パイプラインを作成するための SageMaker 機能の接続の一般的なパターンを示しています。 この例では、モデルは SageMaker で以下を使用して開発されます。 SageMaker処理ジョブ ML アルゴリズム用のデータを準備するために使用されるデータ処理コードを実行します。 SageMaker トレーニング ジョブ 次に、処理ジョブによって生成されたデータで ML モデルをトレーニングするために使用されます。 モデル アーティファクトと関連するメタデータは、 SageMakerモデルレジストリ トレーニング プロセスの最後のステップとして。 これは SageMakerパイプラインは、大規模な ML ワークフローの自動化と管理を支援する ML 専用の CI/CD サービスです。

モデルが承認されると、A/B テストまたはシャドウ デプロイのいずれかを使用して、運用環境でテストされます。 モデルが本番環境で検証された後、モデル レジストリを使用して、デプロイメント ガードレール オプションの XNUMX つを使用して、SageMaker エンドポイントへの本番ロールアウトのモデルを承認します。

モデルの更新プロセスが完了すると、 SageMakerモデルモニター モデルとデータ品質へのドリフトについて、モデルのパフォーマンスを継続的に監視します。 このプロセスは、次を使用して複数のユースケースに自動化されています SageMaker プロジェクト 完全なリソースの分離とより簡単なコスト管理を確実にするために、インフラストラクチャの展開をマルチアカウント設定にマッピングするテンプレート。

単一モデルのエンドポイントの展開パターン

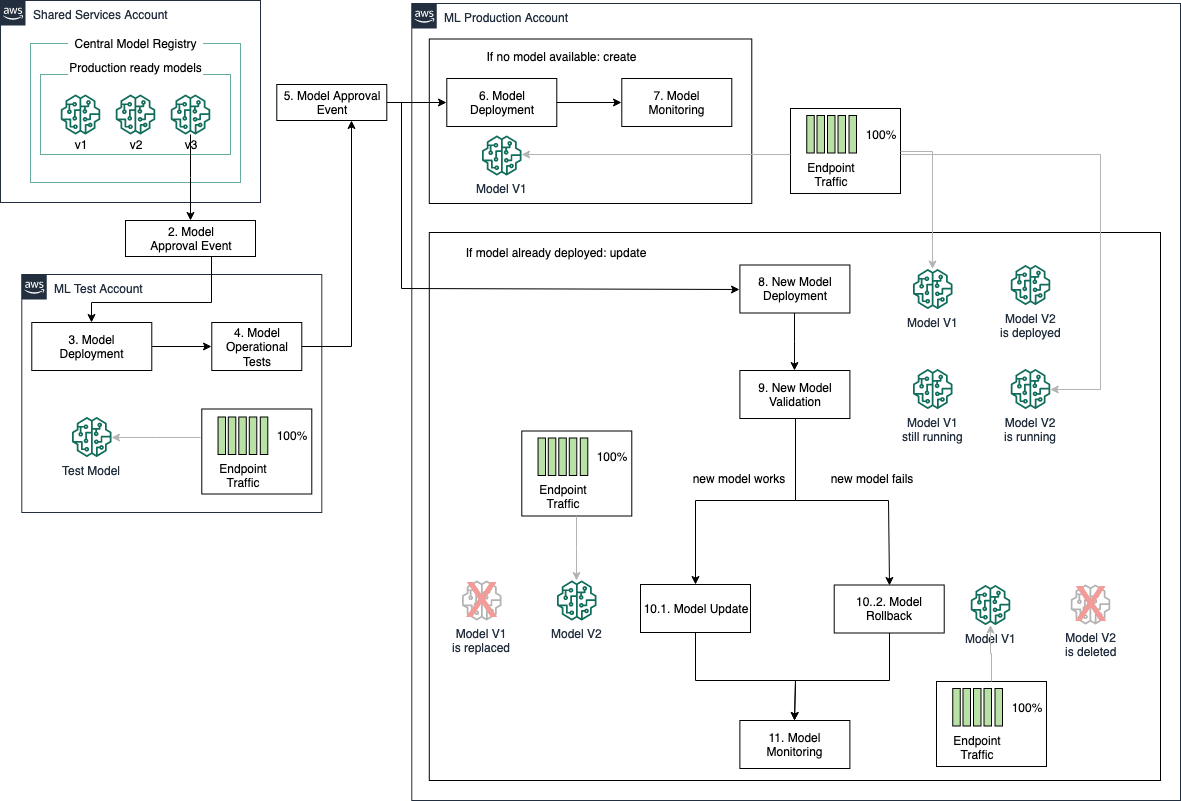

モデルを初めて運用環境にデプロイするときは、比較対象となる実行中のモデルがなく、デプロイされたモデルがビジネス アプリケーションで使用されるモデルになります。 モデルを運用環境にデプロイして監視した後、新しいデータが利用可能になったとき、またはモデルのパフォーマンス ギャップが検出されたときに、定期的またはオンデマンドでモデルを更新することができます。 既存のモデルを更新するときは、新しいモデルが現在のモデルよりも優れたパフォーマンスを発揮し、ビジネス アプリケーションからの予測リクエスト トラフィックを処理できるようにする必要があります。 この検証期間中は、アプリケーションのダウンタイムのリスクを最小限に抑えるために、可能なロールバックのために現在のモデルを引き続き使用できるようにする必要があります。

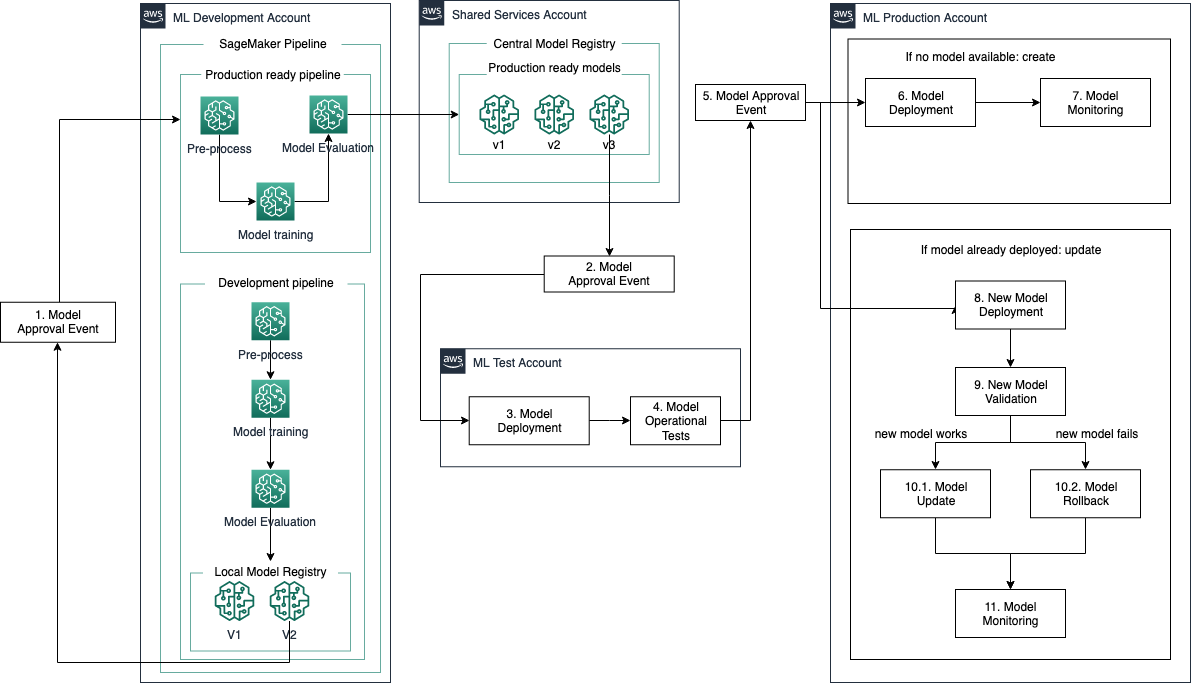

より広いモデル開発の図では、モデルは通常、データ サイエンス開発アカウントでトレーニングされます。 これには、モデルの開発でよく使用される実験ワークフローや、本番対応のパイプラインで使用される再トレーニング ワークフローが含まれます。 これらの実験のすべてのメタデータは、次を使用して追跡できます。 AmazonSageMakerの実験 開発中。 ワークフローが本番環境で使用するためにパイプラインに組み込まれた後、メタデータは SageMaker パイプラインを通じて自動的に追跡されます。 実行可能な生産モデルを XNUMX か所で追跡するには、実験によってモデルのパフォーマンス メトリック (精度、再現率など) が生産に許容されるレベルになった後、 条件ステップ SageMaker パイプラインでは、モデルをモデル レジストリに登録できます。

モデル レジストリを使用すると、手動または自動の承認プロセスを使用して、このモデルの展開をトリガーできます。 このデプロイは ML テスト アカウントで行われ、統合テスト、単体テスト、モデル レイテンシ、追加のモデル検証などの運用テストを新しいモデル バージョンに対して実行できます。 A/B テストとシャドウ テストは、ML テスト アカウントではなく、ML 運用アカウントで実行されることに注意してください。

モデルがテスト アカウントですべての検証に合格すると、運用環境にデプロイする準備が整います。 新しい承認プロセスがこのデプロイをトリガーし、SageMaker デプロイ ガードレールにより、選択されたトラフィック シフト モードに応じて、制御されたリリースと透過的なモデル更新プロセスが可能になります。

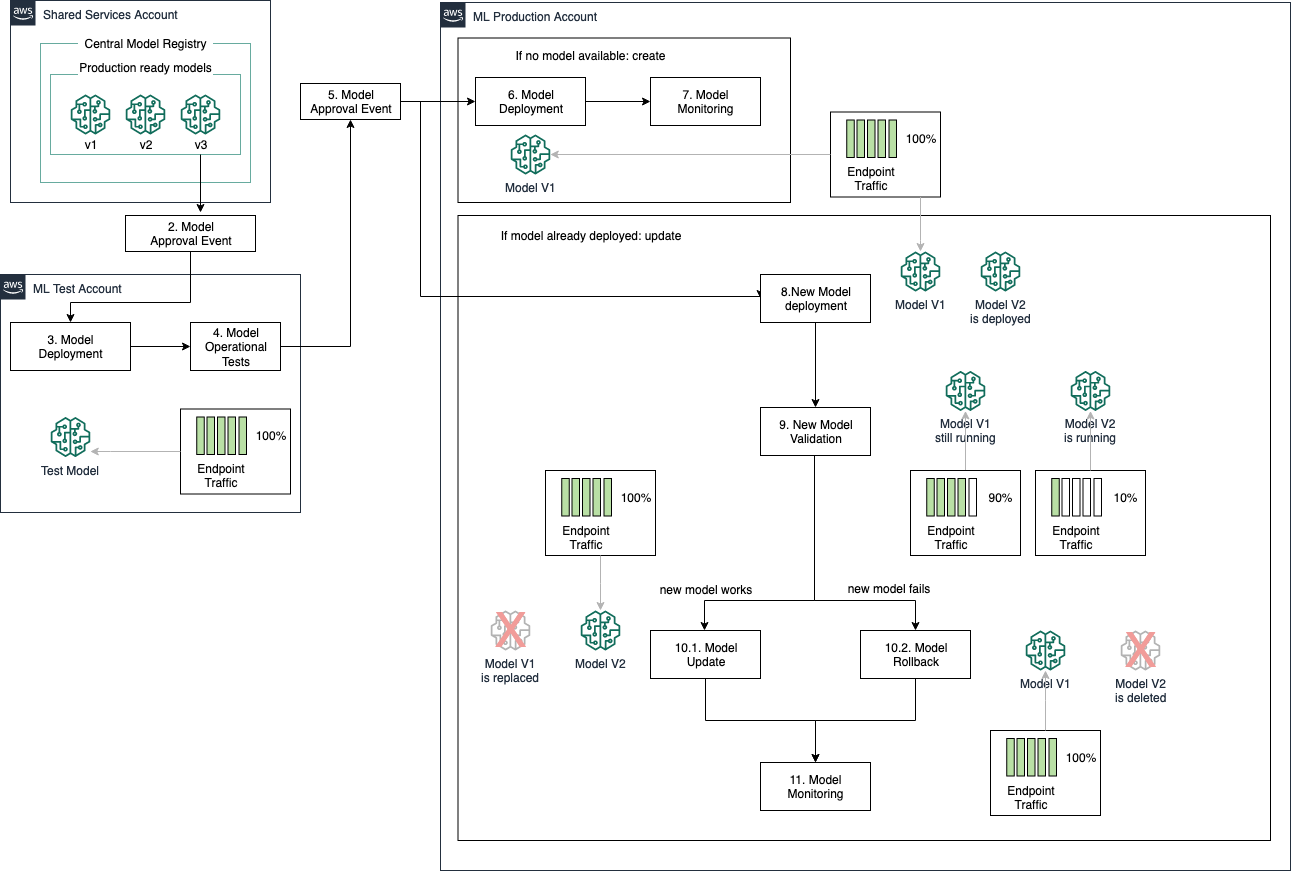

次の図は、このソリューションアーキテクチャを示しています。

一気にトラフィックがシフト

一斉交通移行モード 現在のモデル (ブルー フリート) から新しいモデルにトラフィックの 100% を完全に移行することで、新しいモデル バージョン (グリーン フリート) を更新できます。 このオプションを使用すると、モデルの両方のバージョンがまだ実行されているベイク期間を構成でき、新しいモデルが期待どおりに動作しない場合は、現在のバージョンにすばやく自動的にロールバックできます。 このオプションの欠点は、すべてのデータ トラフィックが一度に影響を受けることです。そのため、モデルのデプロイに問題がある場合、デプロイ プロセス中にアプリケーションを使用しているすべてのユーザーが影響を受けます。 次のアーキテクチャは、一度にトラフィックをシフトするオプションがモデルの更新を処理する方法を示しています。

エンドポイントの展開構成を ブルーグリーンアップデートポリシー に設定 ALL_AT_ONCE. MLOps パイプラインで、新しいモデルが ML 本番アカウントへのデプロイが承認された後、SageMaker はモデルのエンドポイントが既に存在するかどうかを確認します。 もしそうなら、 ALL_AT_ONCE 構成は、アーキテクチャに従うエンドポイントの更新をトリガーします。 エンドポイントのロールバックは以下に基づいて制御されます CloudWatch アラーム エンドポイントによって定義された AutoRollbackConfiguration、トリガーされると、現在のモデル バージョンへのモデルのロールバックが自動的に開始されます。

カナリア トラフィックのシフト

カナリア トラフィックのシフト モードでは、カナリア テストの結果に応じて、実行中のモデル (ブルー フリート) を新しいバージョンに更新するか、新しいバージョンをロールバックする前に、少量のデータ トラフィックで新しいモデル (グリーン フリート) をテストできます。 新しいモデルをテストするために使用されるトラフィックの一部はカナリアと呼ばれます。このオプションでは、更新時間を最小限に抑えながら、問題のある新しいモデルのリスクがカナリア トラフィックに最小限に抑えられます。

カナリア デプロイを使用すると、新しいモデル バージョンを少数のユーザー グループに公開して、一定期間の効果を監視することで、新しいモデル バージョンを実装するリスクを最小限に抑えることができます。 欠点は、パフォーマンスへの影響を判断するのに十分な意味のあるパフォーマンス メトリックを収集できるように、一定期間にわたって複数のバージョンを管理することです。 利点は、リスクを少数のユーザー グループに分離できることです。

Canary トラフィック シフトは、エンドポイントの展開構成を ブルーグリーンアップデートポリシー に設定 CANARY と定義 CanarySize 新しいモデル バージョンにリダイレクトするエンドポイント トラフィックの量を決定します。 一度にまとめてオプションと同様に、MLOps パイプラインで、新しいモデルが ML 本番アカウントへのデプロイが承認された後、SageMaker はモデルのエンドポイントがすでに存在するかどうかを確認します。 もしそうなら、 CANARY 構成は、次の図で概説されているアーキテクチャに従うエンドポイントの更新をトリガーします。 エンドポイントのロールバックは、エンドポイントで定義された CloudWatch アラームに基づいて制御されます AutoRollbackConfiguration トリガーされると、現在のモデル バージョンへのモデルのロールバックが自動的に開始されます。 ここで展開するのに役立つアラーム タイプは、500 ステータス コードとモデル レイテンシです。 ただし、これらのアラーム設定は、特定のビジネス ユース ケースと ML テクノロジーに合わせてカスタマイズする必要があります。

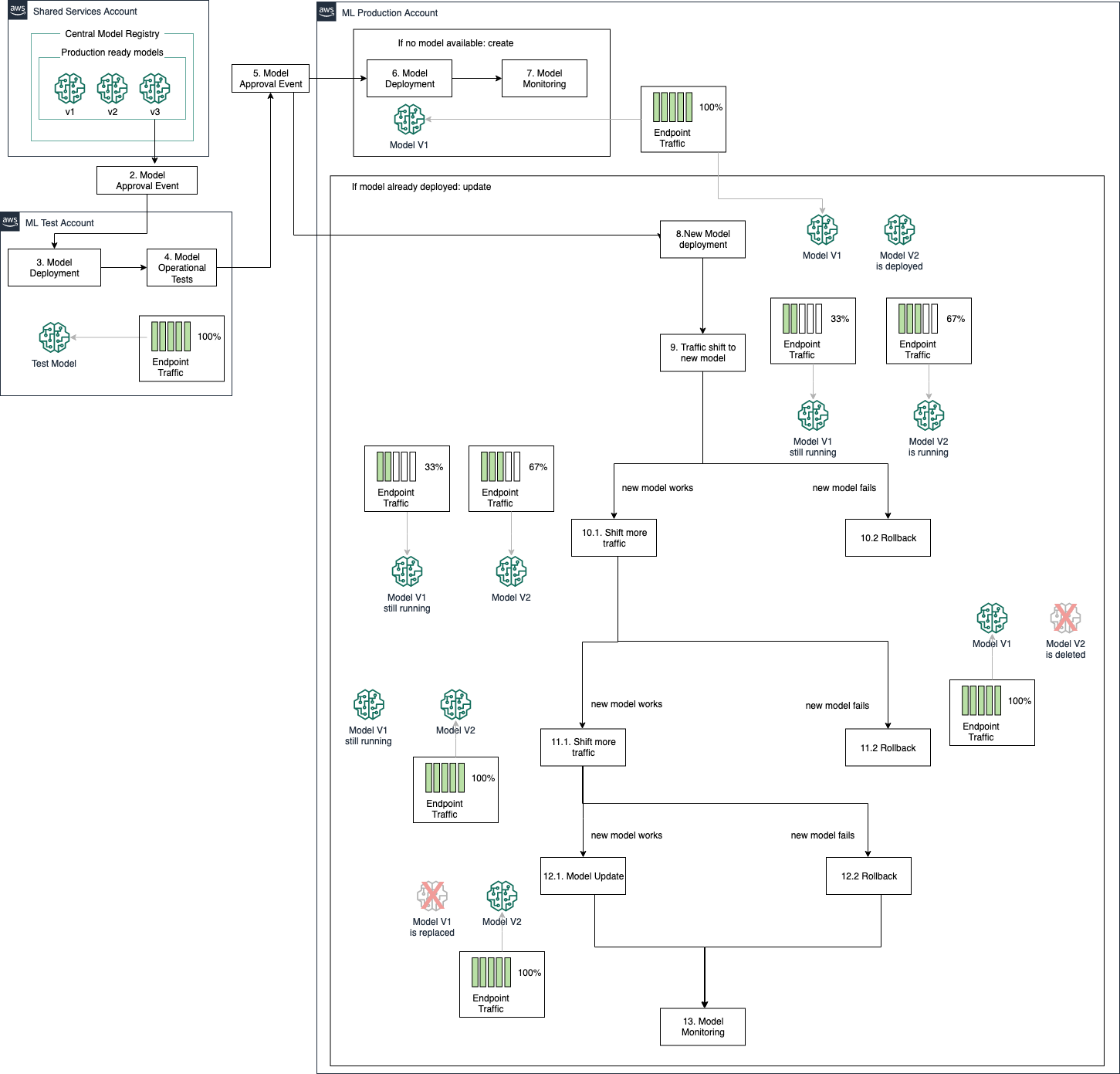

直線的なトラフィックのシフト

直線的なトラフィックシフト 新しいモデルに送信されるデータ トラフィックを段階的に増やして、現在のモデル (ブルー フリート) から新しいモデル バージョン (グリーン フリート) にトラフィックを徐々に変更します。 このように、新しいモデル バージョンをテストするために使用されるトラフィックの割合は、各ステップで徐々に増加し、各ステップのベイク時間により、モデルが新しいトラフィックで引き続き動作することが保証されます。 このオプションを使用すると、パフォーマンスの低いモデルをデプロイするリスクを最小限に抑え、新しいモデルをより多くのデータ トラフィックに徐々に公開します。 このアプローチの欠点は、更新時間が長くなり、両方のモデルを並行して実行するコストが増加することです。

BlueGreenUpdatePolicy を次のように設定してエンドポイントのデプロイ構成を定義することにより、MLOps ツールに線形のトラフィック シフトを組み込むことができます。 LINEAR と定義 LinearStepSize 各ステップで新しいモデルにリダイレクトするトラフィックの量を決定します。 一度にまとめてオプションと同様に、MLOps パイプラインで、新しいモデルが ML 本番アカウントへのデプロイが承認された後、SageMaker はモデルのエンドポイントがすでに存在するかどうかを確認します。 もしそうなら、 LINEAR 構成は、次の図に示されているアーキテクチャに従うエンドポイントの更新をトリガーします。 エンドポイントのロールバックは、エンドポイントで定義された CloudWatch アラームに基づいて制御されます AutoRollbackConfiguration トリガーされると、現在のモデル バージョンへのモデルのロールバックが自動的に開始されます。

モデル プロダクション バリアントを使用した展開パターン

アプリケーションに選択したデプロイ パターンとは別に、プロダクション バリアントを利用して、エンドポイントを更新する前にモデルのパフォーマンスを検証したり、シャドウ デプロイなどの追加のデプロイ パターンを実装したりすることもできます。 この場合、手動または自動化されたプロセスを追加して、エンドポイントを更新する前にデプロイする最適なモデルを選択します。 次のアーキテクチャは、エンドポイントのトラフィックと応答がシャドウ デプロイ シナリオでどのように動作するかを示しています。 このシナリオでは、各予測リクエストが新しいモデルとデプロイされたモデルの両方に送信されます。 ただし、現在デプロイされているモデルのみがビジネス アプリケーションへの予測応答を提供しますが、新しいモデルから提供される予測は、現在デプロイされているモデルに対するパフォーマンスの分析のためにのみ維持されます。 モデルのパフォーマンスが評価された後、新しいモデル バージョンを展開して、ビジネス アプリケーションへの予測応答トラフィックを処理できます。

ロールバック

モデルのデプロイに選択したデプロイ戦略とは別に、新しいモデルのパフォーマンスが現在のモデルのパフォーマンスよりも低い場合は、以前のモデル バージョンにロールバックできるようにする必要があります。 アプリケーションのダウンタイムを最小限に抑えながらこれを行うには、新しいモデルのパフォーマンスが現在のモデルよりも優れていると確信できるまで、現在のモデルを新しいモデルと並行して実行し続ける必要があります。

SageMaker デプロイ ガードレールを使用すると、アラームを設定し、モデルの検証期間中に以前のモデル バージョンに自動的にロールバックできます。 検証期間が終了した後も、モデルの更新が完了した後に発見された新しい問題を解決するために、以前のモデル バージョンにロールバックする必要がある場合があります。 そのために、SageMaker モデルレジストリを利用して、 モデルの拒否と承認 トリガーします ロールバック プロセス.

まとめ

この投稿では、モデル開発用のエンドツーエンドのパターンを作成するために、SageMaker エンドポイント モデル バリアントとデプロイ ガードレールを MLOps 機能と組み合わせる方法を学びました。 SageMaker カスタム プロジェクトを介して SageMaker パイプラインとモデル レジストリに接続されたカナリアおよび線形シフト デプロイメント ガードレールの実装例を提供しました。 次のステップとして、以下を適応させてみてください template 組織の展開戦略を実装します。

参考文献

著者について

マイラ・ラデイラ・タンケ AWS の ML スペシャリスト ソリューション アーキテクトです。 データ サイエンスのバックグラウンドを持つ彼女は、さまざまな業界の顧客と共に ML アプリケーションの設計と構築に 9 年間携わってきました。 彼女はテクニカル リーダーとして、新しいテクノロジと革新的なソリューションを通じて、顧客がビジネス価値の達成を加速するのを支援しています。 マイラは自由な時間に旅行を楽しんだり、暖かい場所で家族と過ごしたりしています。

マイラ・ラデイラ・タンケ AWS の ML スペシャリスト ソリューション アーキテクトです。 データ サイエンスのバックグラウンドを持つ彼女は、さまざまな業界の顧客と共に ML アプリケーションの設計と構築に 9 年間携わってきました。 彼女はテクニカル リーダーとして、新しいテクノロジと革新的なソリューションを通じて、顧客がビジネス価値の達成を加速するのを支援しています。 マイラは自由な時間に旅行を楽しんだり、暖かい場所で家族と過ごしたりしています。

クレイ・エルモア AWS の AI/ML スペシャリスト ソリューション アーキテクトです。 材料研究所で何時間も過ごした後、機械学習への関心を追求するために、彼の化学工学のバックグラウンドはすぐに取り残されました。 彼は、エネルギー取引からホスピタリティ マーケティングに至るまで、さまざまな業界で ML アプリケーションに取り組んできました。 Clay は、ソフトウェア開発プラクティスを ML に導入し、これらの原則を使用して顧客を反復可能でスケーラブルなソリューションに導くことに特別な関心を持っています。 余暇には、スキー、ルービック キューブの解決、読書、料理を楽しんでいます。

クレイ・エルモア AWS の AI/ML スペシャリスト ソリューション アーキテクトです。 材料研究所で何時間も過ごした後、機械学習への関心を追求するために、彼の化学工学のバックグラウンドはすぐに取り残されました。 彼は、エネルギー取引からホスピタリティ マーケティングに至るまで、さまざまな業界で ML アプリケーションに取り組んできました。 Clay は、ソフトウェア開発プラクティスを ML に導入し、これらの原則を使用して顧客を反復可能でスケーラブルなソリューションに導くことに特別な関心を持っています。 余暇には、スキー、ルービック キューブの解決、読書、料理を楽しんでいます。

シェルビーアイゲンブロード AWS のプリンシパル AI および機械学習スペシャリスト ソリューション アーキテクトです。 彼女は 24 年間、複数の業界、テクノロジ、役割にまたがってテクノロジに携わってきました。 彼女は現在、DevOps と ML のバックグラウンドを MLOps のドメインに組み合わせて、顧客が ML ワークロードを大規模に提供および管理できるようにすることに注力しています。 さまざまなテクノロジー分野で 35 を超える特許を取得しており、継続的なイノベーションとデータを使用してビジネスの成果を推進することに情熱を注いでいます。 Shelbee は、Coursera の Practical Data Science 専門講座の共同作成者であり、講師でもあります。 彼女はまた、Women In Big Data (WiBD) のデンバー支部の共同ディレクターでもあります。 余暇には、家族、友人、活発すぎる犬と過ごすのが好きです。

シェルビーアイゲンブロード AWS のプリンシパル AI および機械学習スペシャリスト ソリューション アーキテクトです。 彼女は 24 年間、複数の業界、テクノロジ、役割にまたがってテクノロジに携わってきました。 彼女は現在、DevOps と ML のバックグラウンドを MLOps のドメインに組み合わせて、顧客が ML ワークロードを大規模に提供および管理できるようにすることに注力しています。 さまざまなテクノロジー分野で 35 を超える特許を取得しており、継続的なイノベーションとデータを使用してビジネスの成果を推進することに情熱を注いでいます。 Shelbee は、Coursera の Practical Data Science 専門講座の共同作成者であり、講師でもあります。 彼女はまた、Women In Big Data (WiBD) のデンバー支部の共同ディレクターでもあります。 余暇には、家族、友人、活発すぎる犬と過ごすのが好きです。

趙奇雲 Amazon SageMaker 推論プラットフォームチームのシニアソフトウェア開発エンジニアです。 彼はデプロイ ガードレールとシャドウ デプロイの主任開発者であり、お客様が高可用性を備えた大規模な ML ワークロードとデプロイを管理できるよう支援することに重点を置いています。 彼はまた、迅速で安全な ML ジョブの展開と ML オンライン実験の実行を容易にするためのプラットフォーム アーキテクチャの進化にも取り組んでいます。 余暇には、読書、ゲーム、旅行を楽しんでいます。

趙奇雲 Amazon SageMaker 推論プラットフォームチームのシニアソフトウェア開発エンジニアです。 彼はデプロイ ガードレールとシャドウ デプロイの主任開発者であり、お客様が高可用性を備えた大規模な ML ワークロードとデプロイを管理できるよう支援することに重点を置いています。 彼はまた、迅速で安全な ML ジョブの展開と ML オンライン実験の実行を容易にするためのプラットフォーム アーキテクチャの進化にも取り組んでいます。 余暇には、読書、ゲーム、旅行を楽しんでいます。

- SEO を活用したコンテンツと PR 配信。 今日増幅されます。

- Platoblockchain。 Web3メタバースインテリジェンス。 知識の増幅。 こちらからアクセスしてください。

- 情報源: https://aws.amazon.com/blogs/machine-learning/mlops-deployment-best-practices-for-real-time-inference-model-serving-endpoints-with-amazon-sagemaker/

- 100

- 2022

- 7

- 9

- a

- 能力

- できる

- 加速する

- ことができます。

- 従った

- 会計

- 達成する

- 達成

- 越えて

- 追加されました

- 添加

- NEW

- さらに

- 高度な

- 利点

- 後

- に対して

- AI

- AI / ML

- アラーム

- アルゴリズム

- すべて

- ことができます

- 既に

- Amazon

- アマゾンセージメーカー

- 量

- 分析

- および

- 別の

- 申し込み

- 適用された

- アプローチ

- 承認

- 承認する

- 承認された

- 建築

- 周りに

- 側面

- 関連する

- 自動化する

- 自動化

- 自動的に

- 賃貸条件の詳細・契約費用のお見積り等について

- 利用できます

- AWS

- バック

- 背景

- ベース

- 基礎

- なぜなら

- になる

- 背後に

- さ

- 恩恵

- BEST

- ベストプラクティス

- より良いです

- の間に

- ビッグ

- ビッグデータ

- 青

- 持参

- 広い

- より広い

- た

- ビルド

- 建物

- 内蔵

- ビジネス

- ビジネスアプリケーション

- 呼ばれます

- 機能

- 場合

- 例

- CD

- 一定

- 変化する

- 変化

- 章

- 小切手

- 化学物質

- 選択する

- 選んだ

- 閉まっている

- コード

- 組み合わせる

- 組み合わせた

- 結合

- コマンドと

- 比較します

- コンプリート

- 完全に

- コンセプト

- 確信して

- 交流

- 接続

- 検討

- 検討事項

- 含む

- コンテキスト

- 継続的に

- 連続的な

- 連続的に

- コントロール

- 制御

- 費用

- コスト

- カバー

- カバー

- 作ります

- 電流プローブ

- 現在

- カスタム

- Customers

- カスタマイズ

- データ

- データ処理

- データサイエンス

- 12月

- 意思決定

- デフォルト

- 定義済みの

- 定義

- 配信する

- 配達

- 需要

- 実証

- デンバー

- によっては

- 展開します

- 展開

- 展開する

- 展開

- 配備

- 記載された

- 検出された

- 決定する

- 発展した

- Developer

- 開発

- 異なります

- 直接に

- 発見

- 話し合います

- 議論する

- 配布

- 配布する

- ディストリビューション

- そうではありません

- ドメイン

- ドメイン

- ドント

- 下側

- ダウンタイム

- ドライブ

- 間に

- 各

- 容易

- 簡単に

- 有効

- どちら

- 新興の

- enable

- 端から端まで

- エンドポイント

- エネルギー

- エンジニア

- エンジニアリング

- 十分な

- 確保

- 確実に

- 確保する

- 環境

- 本質的な

- 評価する

- 評価

- 進化

- 例

- 既存の

- 存在

- 予想される

- 体験

- 探る

- 露出した

- 家族

- スピーディー

- 特徴

- フィードバック

- フィギュア

- 名

- 初回

- 艦隊

- 焦点を当てて

- 焦点

- フォロー中

- 次

- 財団

- フレームワーク

- 無料版

- 友達

- から

- フル

- 機能性

- 機能

- さらに

- 賭博

- ギャップ

- 集まり

- 受け

- 与える

- 与えられた

- 徐々に

- 付与された

- グリーン

- グループ

- ハンドル

- ハンドル

- 助けます

- 助け

- ことができます

- こちら

- ハイ

- ホスピタリティー

- ホスティング

- HOURS

- 認定条件

- How To

- しかしながら

- HTML

- HTTPS

- 影響

- 実装する

- 実装

- 実装

- 実装

- 改善

- in

- include

- 含ま

- 含めて

- Incorporated

- 増加した

- 増加

- の増加

- 産業

- 情報

- インフラ関連事業

- 革新的手法

- 革新的な

- を取得する必要がある者

- 統合する

- 統合

- 統合

- 関心

- 概要

- 分離

- 問題

- 問題

- IT

- ジョブ

- Jobs > Create New Job

- キープ

- キー

- ラボ

- 姓

- レイテンシ

- 打ち上げ

- つながる

- 学んだ

- 学習

- レベル

- wifecycwe

- リストされた

- ライブ

- より長いです

- ロー

- 機械

- 機械学習

- 維持する

- 管理します

- 管理

- 管理する

- マニュアル

- 多くの

- マッピング

- 市場

- マーケティング

- 材料

- 最大化します

- 意味のある

- メカニズム

- 言及した

- メソッド

- メトリック

- メトリック

- かもしれない

- 最小化

- ML

- MLOps

- モード

- モデルテスト

- モデル

- モニター

- 監視対象

- モニタリング

- モニター

- 他には?

- 最も

- の試合に

- 自然

- 必要

- 必要

- 新作

- 次の

- オファー

- ONE

- オンライン

- オペレーショナル

- 業務執行統括

- 最適な

- オプション

- オプション

- 注文

- 組織

- その他

- 結果

- 概説

- パッケージ

- 並列シミュレーションの設定

- パラメーター

- 部

- パス

- 情熱

- 特許

- パターン

- パターン

- 実行する

- パフォーマンス

- 実行する

- 期間

- 画像

- パイプライン

- 場所

- プラットフォーム

- プラトン

- プラトンデータインテリジェンス

- プラトデータ

- 可能

- ポスト

- 実用的

- プラクティス

- 精度

- 予測

- 予測

- 準備

- 現在

- 前

- 前に

- 校長

- 原則

- 問題

- プロセス

- 処理

- 生産された

- 生産

- プロジェクト

- プロジェクト(実績作品)

- 提案された

- 守る

- 提供します

- 提供

- は、大阪で

- 目的

- 置きます

- 品質

- すぐに

- 範囲

- 測距

- リーディング

- 準備

- リアル

- への

- 受け取り

- 受け入れ

- 推奨される

- 地域

- 登録された

- レジストリ

- レギュラー

- リリース

- 関連した

- 信頼性

- 信頼性のある

- 繰り返し可能

- 置き換え

- 要求

- リクエスト

- 研究

- リソースを追加する。

- 応答

- return

- 再利用可能な

- リスク

- リスク

- 役割

- ロール

- 圧延

- ラン

- ランニング

- セージメーカー

- SageMaker の推論

- SageMakerパイプライン

- 同じ

- 満足

- に満足

- スケーラビリティ

- ド電源のデ

- 規模

- シナリオ

- シナリオ

- 科学

- 安全に

- 選択

- 送信

- シニア

- 別

- 仕える

- サービス

- サービング

- セッションに

- 設定

- いくつかの

- Shadow

- シャドーテスト

- シフト

- シフト

- すべき

- 作品

- 意義

- 同様の

- 同様に

- 状況

- 小さい

- より小さい

- So

- ソフトウェア

- ソフトウェア開発

- 溶液

- ソリューション

- 解決する

- 解決

- 特別

- 専門家

- 特定の

- 過ごす

- 支出

- 開始

- 開始

- 統計的

- Status:

- 手順

- ステップ

- まだ

- 保存され

- 作戦

- 戦略

- 提出された

- そのような

- サポート

- スイッチ

- システム

- 取る

- 取り

- ターゲット

- チーム

- 技術的

- テクノロジー

- テクノロジー

- テンプレート

- test

- テスト

- テスト

- アプリ環境に合わせて

- 介して

- スループット

- TIE

- 時間

- 〜へ

- 豊富なツール群

- に向かって

- トレーサビリティ

- 追跡する

- トレーディング

- 伝統的な

- トラフィック

- トレーニング

- 訓練された

- トレーニング

- トランスペアレント

- 旅行

- トリガー

- トリガ

- 一般的に

- わかる

- ユニーク

- 単位

- アップデイト

- 更新しました

- 更新版

- 更新

- つかいます

- 使用事例

- users

- 活用する

- 検証

- 検証済み

- 値

- バリアント

- さまざまな

- バージョン

- 、

- 実行可能な

- 暖かいです

- 重量

- この試験は

- 何ですか

- which

- while

- 意志

- 以内

- レディース

- 働いていました

- ワークフロー

- 作品

- でしょう

- 書き込み

- 年

- You

- あなたの

- ゼファーネット