生成人工知能 (generative AI) モデルは、高品質のテキスト、画像、その他のコンテンツを生成する優れた機能を実証しています。 ただし、これらのモデルがその可能性を最大限に発揮するには、大量のクリーンで構造化されたトレーニング データが必要です。 実際のデータのほとんどは PDF などの非構造化形式で存在するため、効果的に使用するには前処理が必要です。

による IDC, 現在、非構造化データはビジネス データ全体の 80% 以上を占めています。 これには、電子メール、PDF、スキャンしたドキュメント、画像、音声、ビデオなどの形式が含まれます。 このデータには貴重な洞察が含まれていますが、その非構造化の性質により、AI アルゴリズムがデータを解釈して学習することが困難になります。 によると デロイトによる 2019 年の調査、非構造化データを活用できたと報告した企業はわずか 18% でした。

AI の導入が加速し続けるにつれ、非構造化データを消化して学習するための効率的なメカニズムを開発することが今後さらに重要になります。 これには、より優れた前処理ツール、半教師あり学習技術、自然言語処理の進歩が含まれる可能性があります。 非構造化データを最も効果的に使用する企業は、AI によって大きな競争上の優位性を得ることができます。 モデルのパフォーマンスを向上させるには、クリーンなデータが重要です。 抽出されたテキストには、依然として大量の意味不明な定型テキストが含まれています (HTML を読むなど)。 インターネットからスクレイピングされたデータには、多くの重複が含まれることがよくあります。 ソーシャル メディア、レビュー、またはユーザー生成コンテンツからのデータには、有害で偏ったコンテンツが含まれている可能性があるため、いくつかの前処理手順を使用してそれらを除外する必要がある場合があります。 また、低品質のコンテンツやボットが生成したテキストが多数存在する可能性もありますが、これらは付随するメタデータを使用して除外できます (顧客評価が低い顧客サービスの応答を除外するなど)。

データの準備は、検索拡張生成の複数の段階で重要です (RAG)モデル。 ナレッジ ソース ドキュメントには、効率的にインデックスを作成して取得できるように、テキストのクリーニングやセマンティック埋め込みの生成などの前処理が必要です。 ユーザーの自然言語クエリにも前処理が必要なので、ベクトルにエンコードしてドキュメントの埋め込みと比較できます。 関連するコンテキストを取得した後、ユーザーのクエリに連結して基礎モデルの最終プロンプトを作成する前に、切り捨てなどの追加の前処理が必要になる場合があります。 Amazon SageMaker キャンバス を活用した包括的なデータ準備機能をサポートするようになりました。 AmazonSageMakerデータラングラー。 この統合により、SageMaker Canvas は、データを準備し、ML および基盤モデルを構築および使用して、データからビジネスの洞察を得るまでの時間を短縮するためのエンドツーエンドのノーコードワークスペースを顧客に提供します。 50 を超えるデータ ソースからデータを簡単に検出して集計し、SageMaker Canvas のビジュアル インターフェイスで 300 を超える組み込みの分析と変換を使用してデータを探索および準備できるようになりました。

ソリューションの概要

この投稿では、PDF ドキュメント データセットを使用します。アマゾンの岩盤 ユーザーガイド。 さらに、RAG 用にデータセットを前処理する方法を示します。 具体的には、データをクリーンアップし、RAG アーティファクトを作成して、データセットの内容に関する質問に答えます。 次の機械学習 (ML) 問題を考えてみましょう: ユーザーが大規模言語モデル (LLM) の質問をします: 「Amazon Bedrock でモデルをフィルタリングして検索する方法は?」。 LLM はトレーニングまたは微調整の段階でドキュメントを見ていないため、質問に答えることができず、おそらく幻覚を起こすでしょう。 この投稿の目標は、PDF (つまり RAG) から関連するテキストを見つけてプロンプトに添付し、LLM がこのドキュメント固有の質問に回答できるようにすることです。

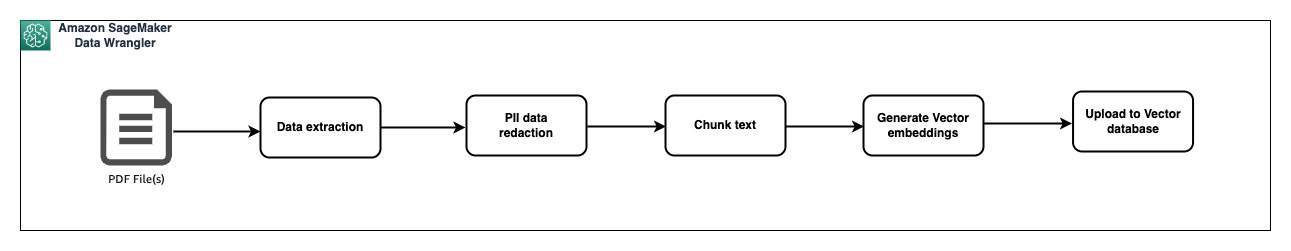

以下では、これらすべての主要な前処理ステップを実行する方法を示します。 Amazon SageMaker キャンバス (搭載 AmazonSageMakerデータラングラー):

- PDF ドキュメントからのテキストの抽出 (Textract を利用)

- 機密情報を削除する (Comprehend を利用)

- テキストを細かく分割します。

- 各ピースのエンベディングを作成します (Bedrock を利用)。

- 埋め込みをベクター データベースにアップロード (OpenSearch を利用)

前提条件

このウォークスルーでは、次のものが必要です。

Note: 指示に従って OpenSearch Service ドメインを作成します こちら。 わかりやすくするために、きめ細かいアクセス制御のためにマスター ユーザー名とパスワードを使用するオプションを選択しましょう。 ドメインが作成されたら、次のマッピングを使用してベクトルインデックスを作成し、ベクトル次元 1536 が Amazon Titan 埋め込みと一致します。

チュートリアル

データフローを構築する

このセクションでは、PDF からテキストとメタデータを抽出し、データをクリーンアップして処理し、Amazon Bedrock を使用してエンベディングを生成し、Amazon OpenSearch でデータにインデックスを付けるためのデータフローを構築する方法について説明します。

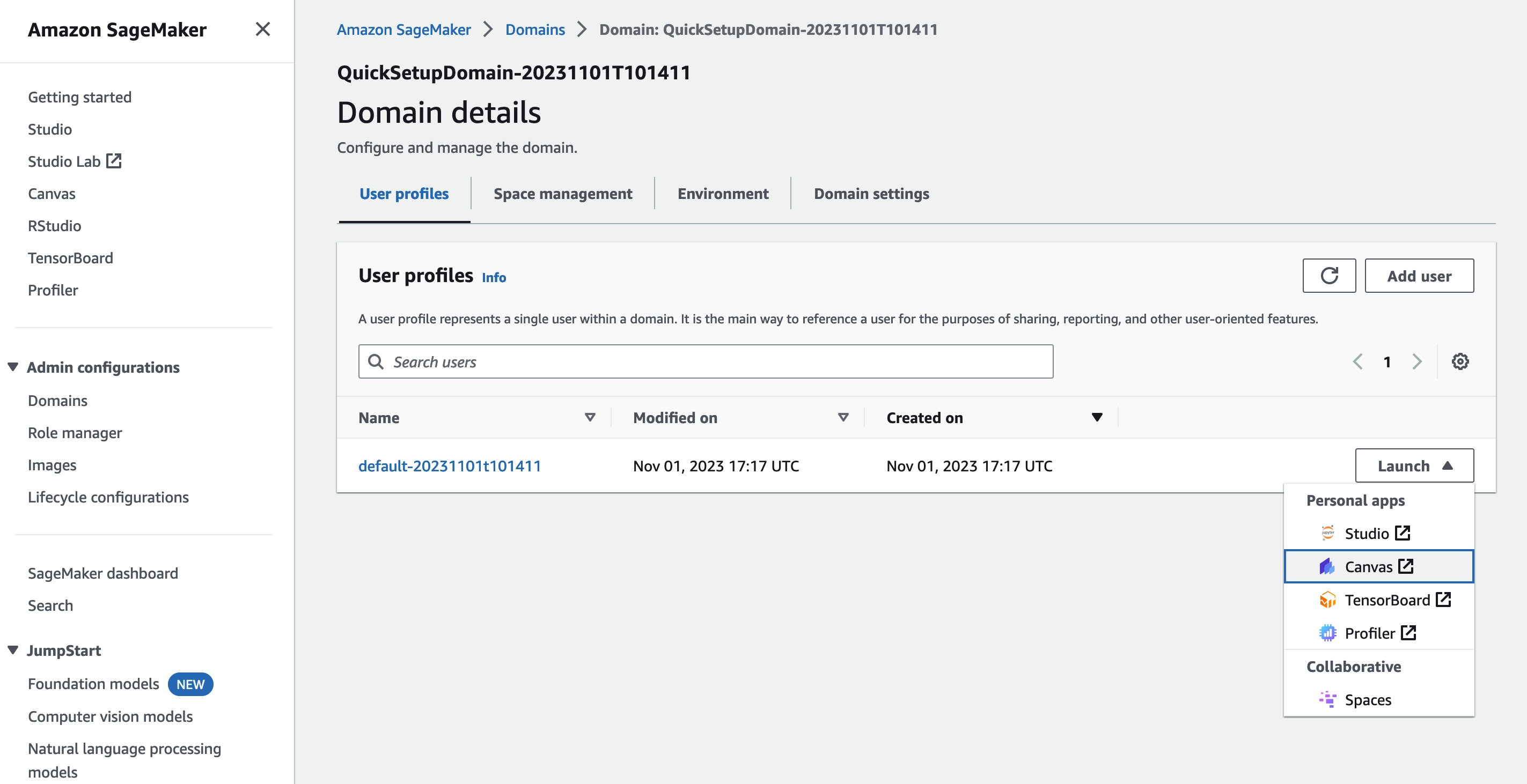

SageMaker Canvas を起動する

SageMaker Canvas を起動するには、次の手順を実行します。

- アマゾンで SageMaker コンソール、選択する ドメイン ナビゲーションペインに表示されます。

- ドメインを選択します。

- 起動メニューで、選択します キャンバス.

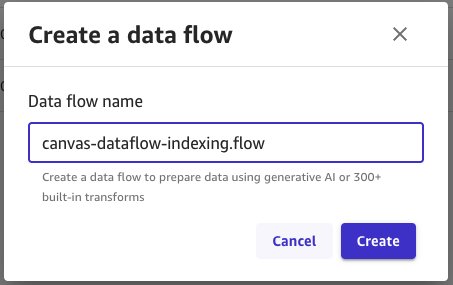

データフローを作成する

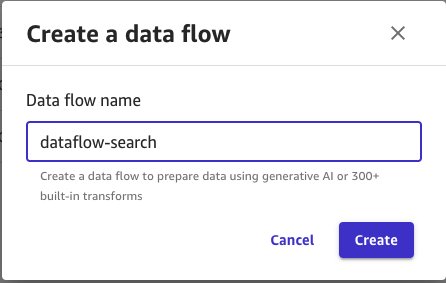

SageMaker Canvas でデータフローを作成するには、次の手順を実行します。

- SageMaker Canvas のホームページで、 データラングラー.

- 選択する 創造する ページの右側で、データ フロー名を指定し、選択します 創造する.

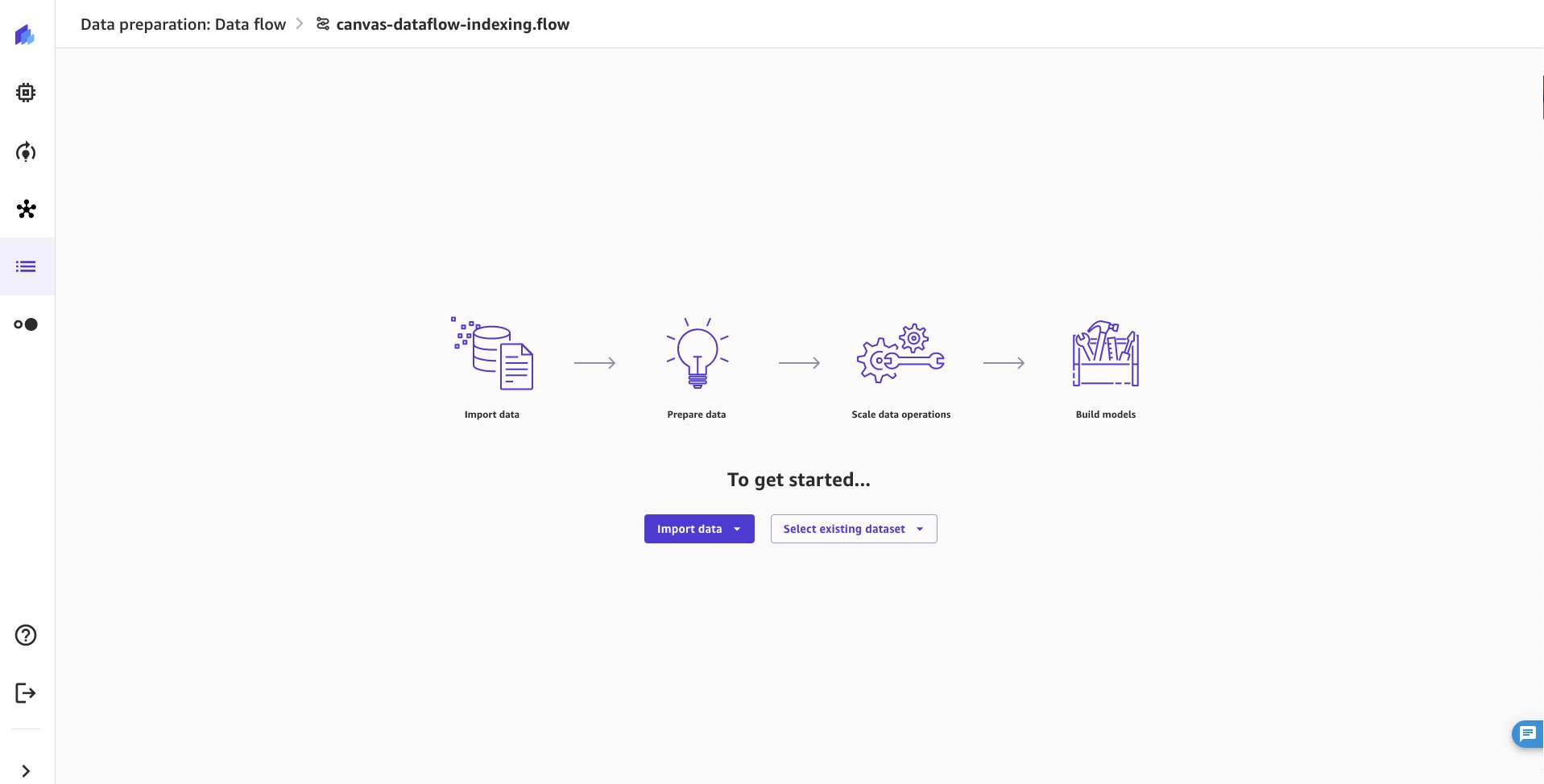

- これにより、データ フロー ページが表示されます。

- 選択する インポート日、表形式のデータを選択します。

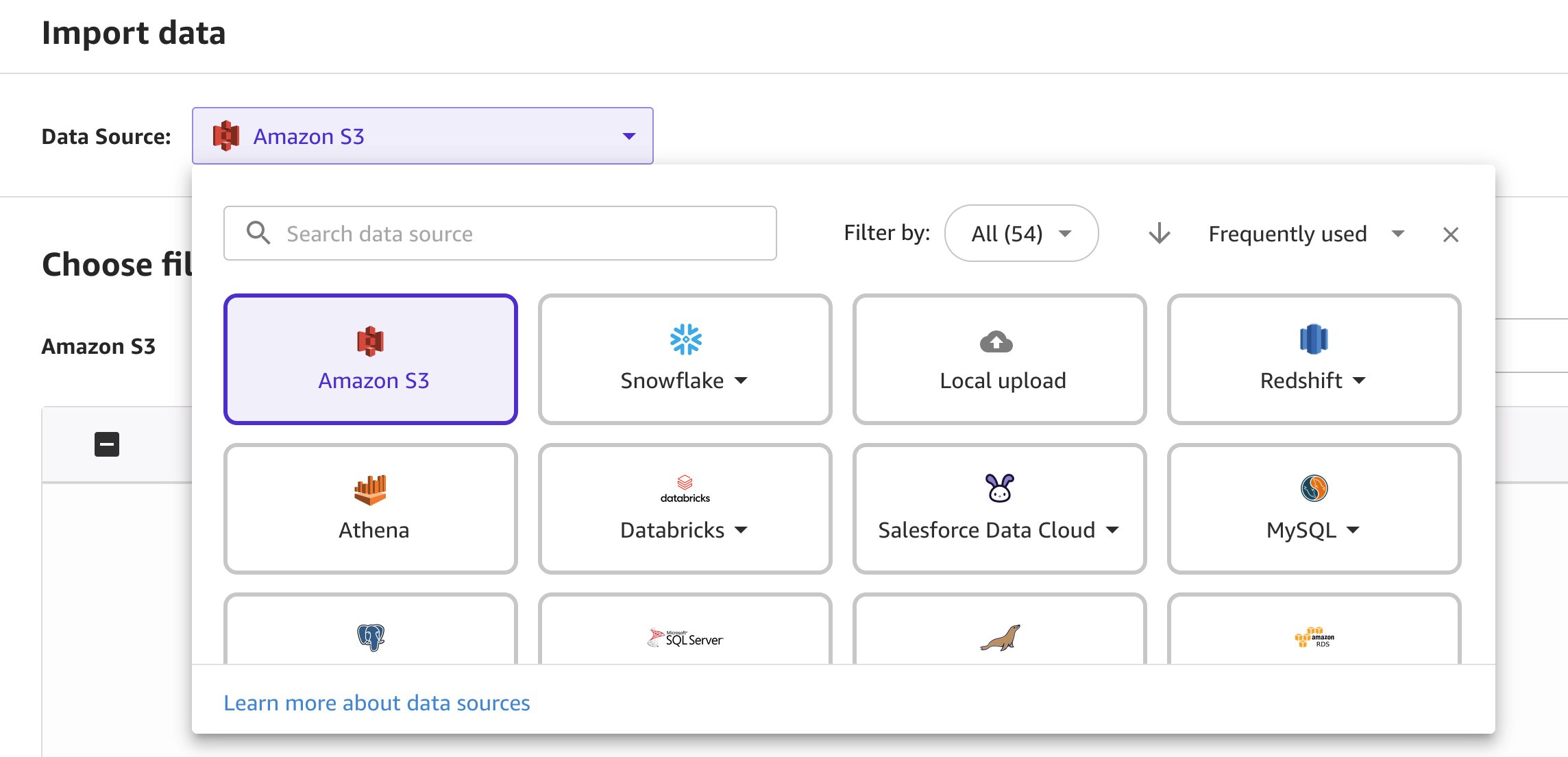

次に、Amazon S3 バケットからデータをインポートしましょう。

- 選択する インポート日 をクリックして 表形式 ドロップダウンリストから選択します。

- 情報元 をクリックして アマゾンS3 ドロップダウンリストから選択します。

- PDF ファイルの場所を含むメタ データ ファイルに移動し、ファイルを選択します。

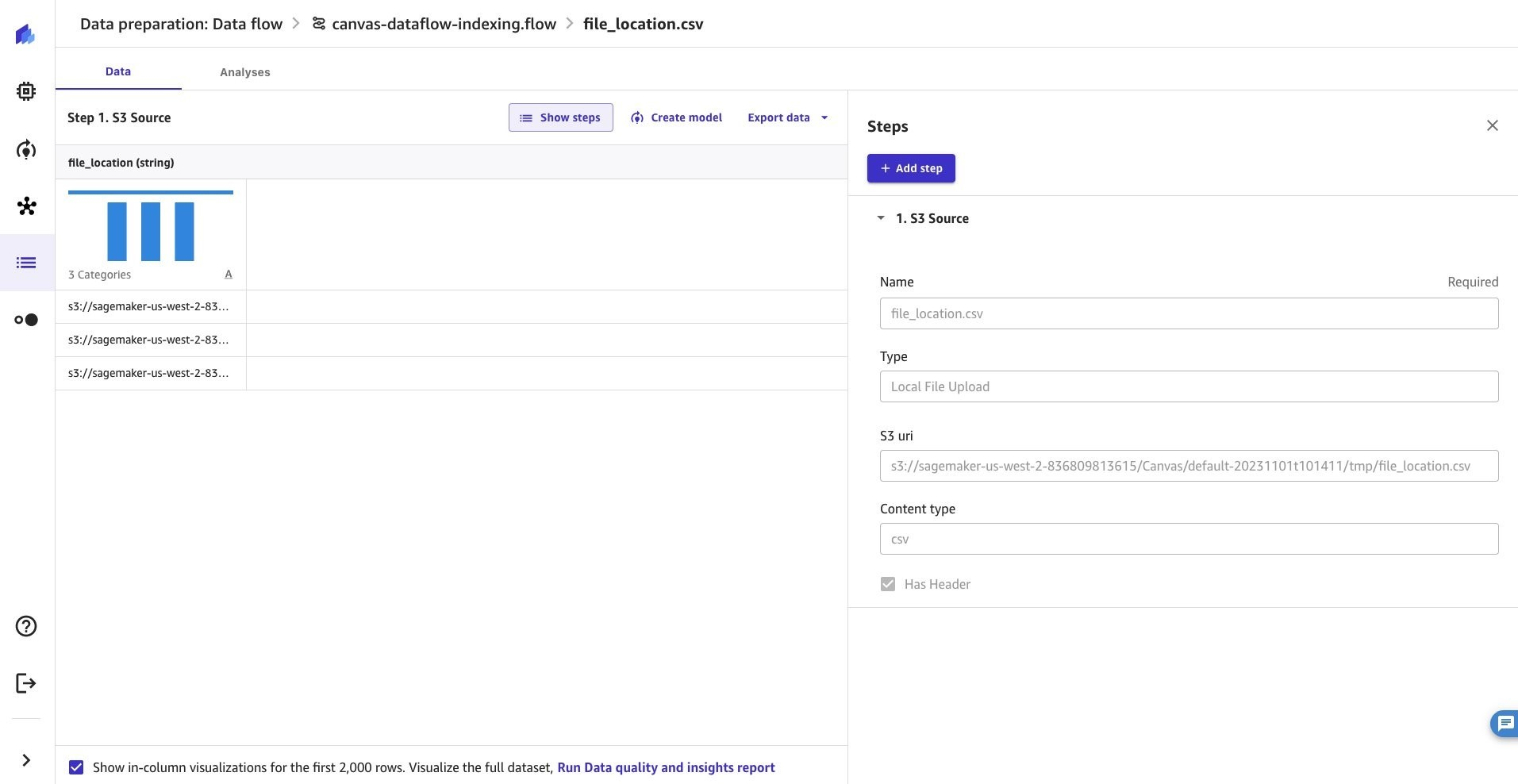

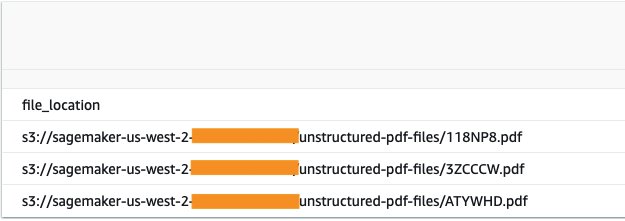

- これで、メタデータ ファイルがデータ準備データ フローにロードされ、データとインデックスを Amazon に変換する次のステップの追加に進むことができます。 Opensearch。 この場合、ファイルには次のメタデータがあり、Amazon S3 ディレクトリ内の各ファイルの場所が示されます。

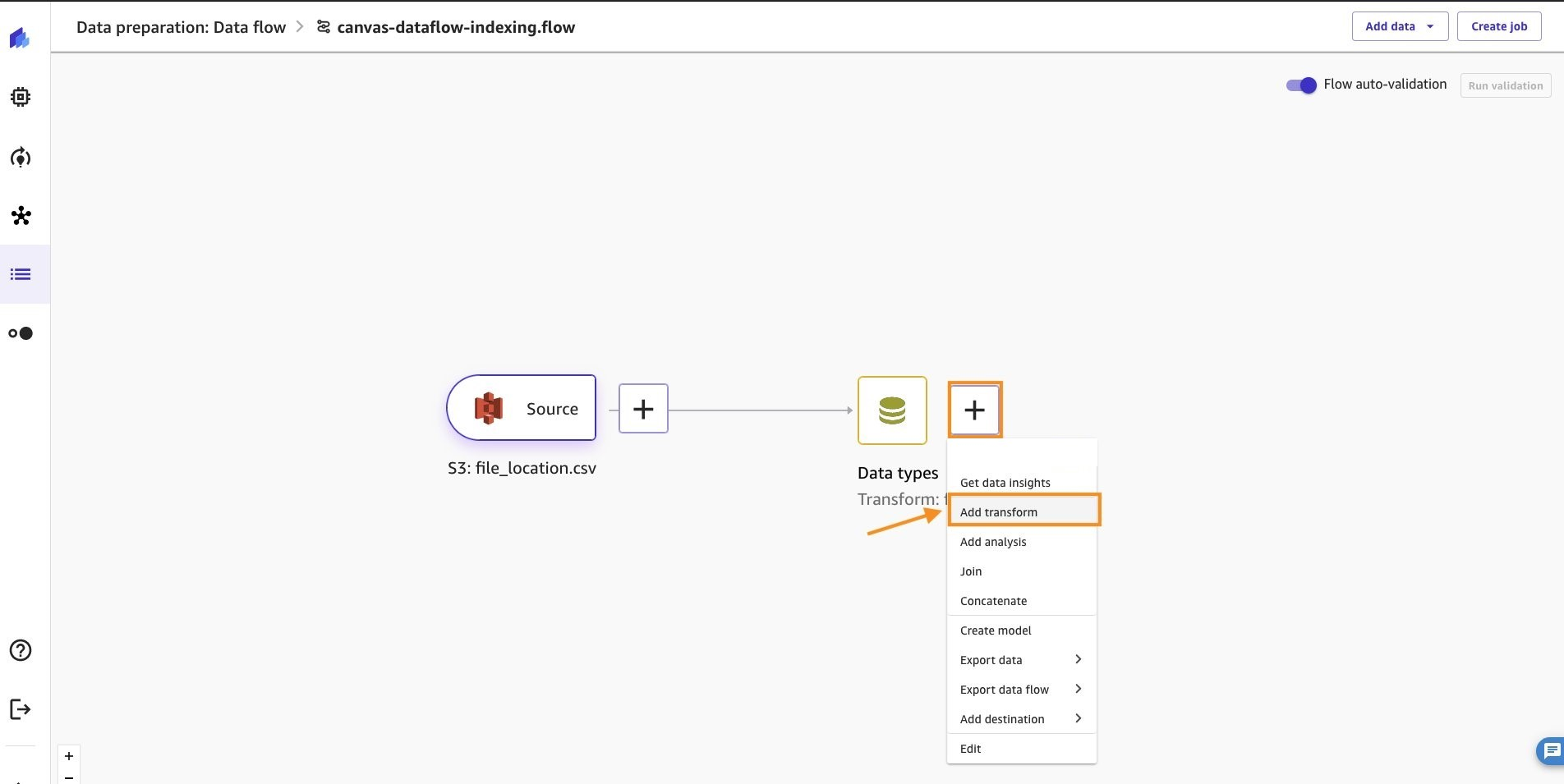

新しい変換を追加するには、次の手順を実行します。

- プラス記号を選択し、 変換を追加.

- 選択する ステップを追加 選択して カスタム変換.

- Pandas、PySpark、Python ユーザー定義関数、SQL PySpark を使用してカスタム変換を作成できます。 選ぶ Python(PySpark) このユースケースでは。

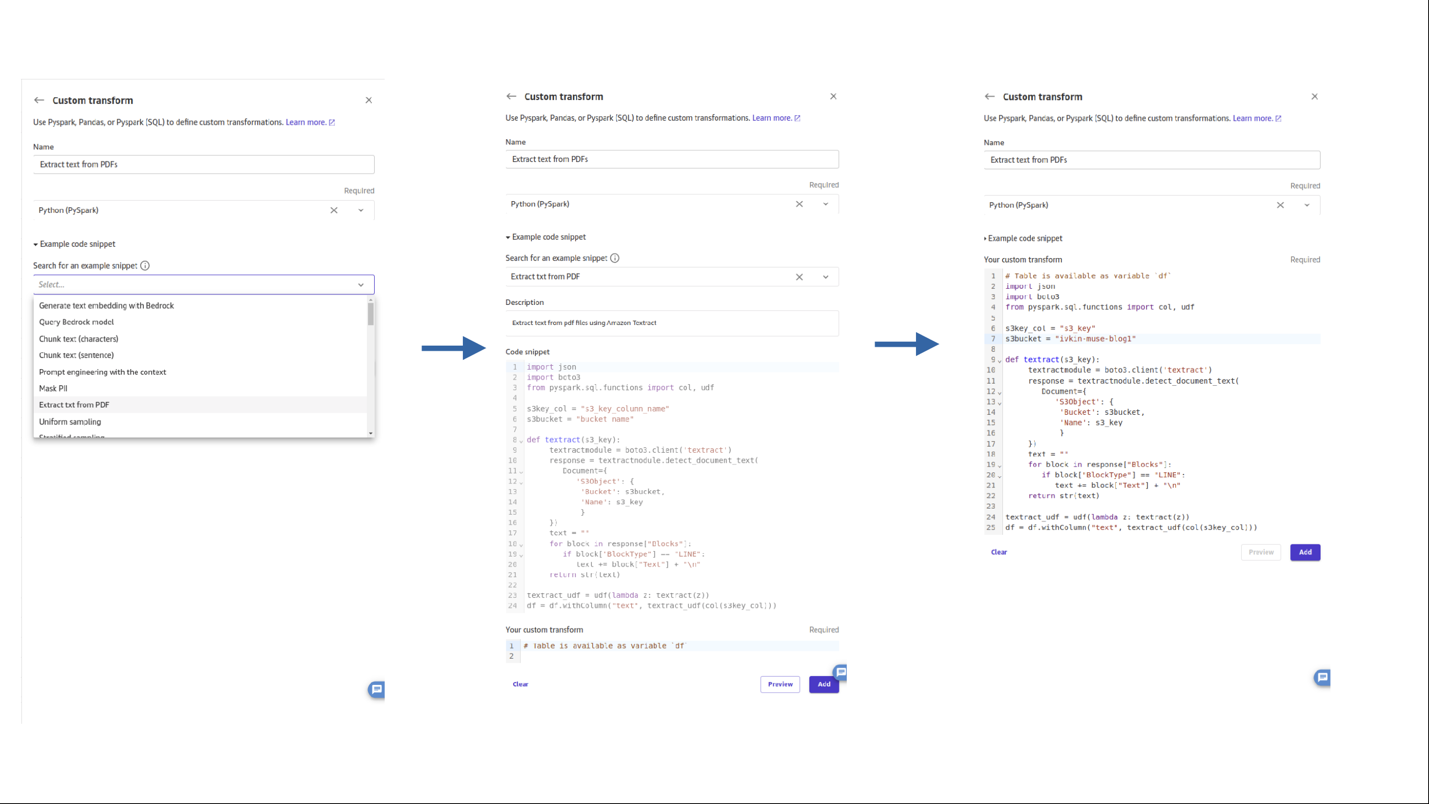

- ステップの名前を入力します。 サンプルコードスニペットから参照して選択します PDFからテキストを抽出する。 コードスニペットに必要な変更を加えて選択します Add.

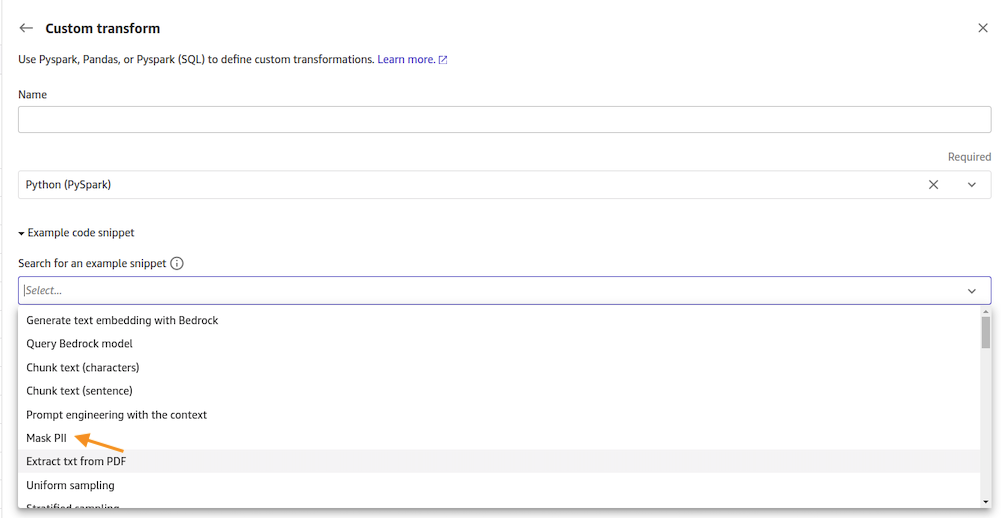

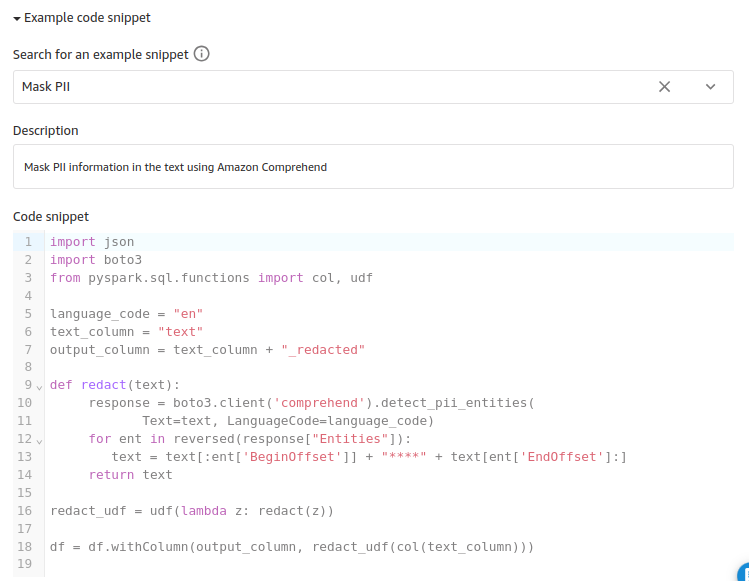

- を利用して、抽出されたデータから個人識別情報 (PII) データを編集するステップを追加してみましょう。 Amazon Comprehend。 選択してください ステップを追加 選択して カスタム変換。 そして、 Python (PySpark)。

サンプルコードスニペットから参照して選択します マスクPII。 コードスニペットに必要な変更を加えて選択します 追加します。

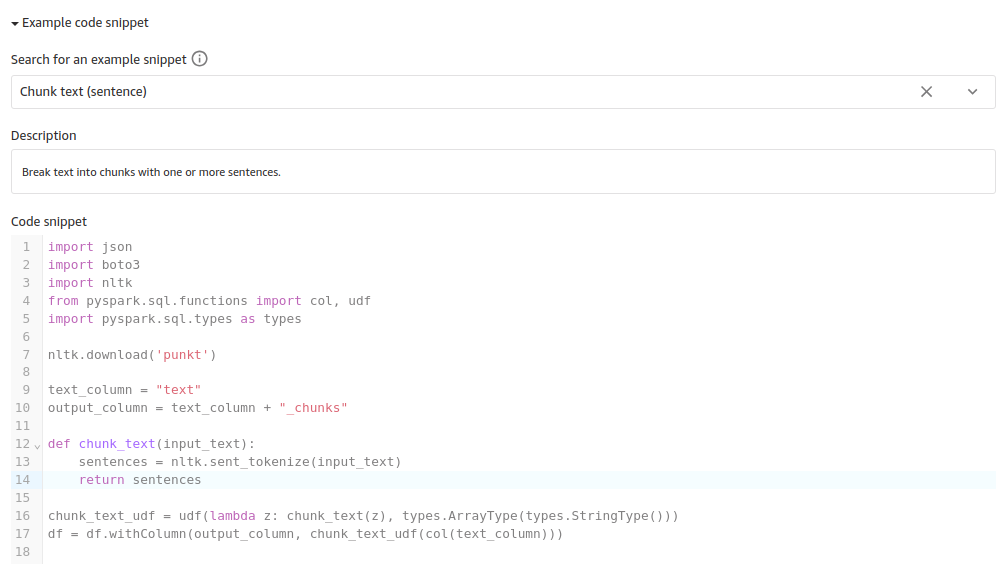

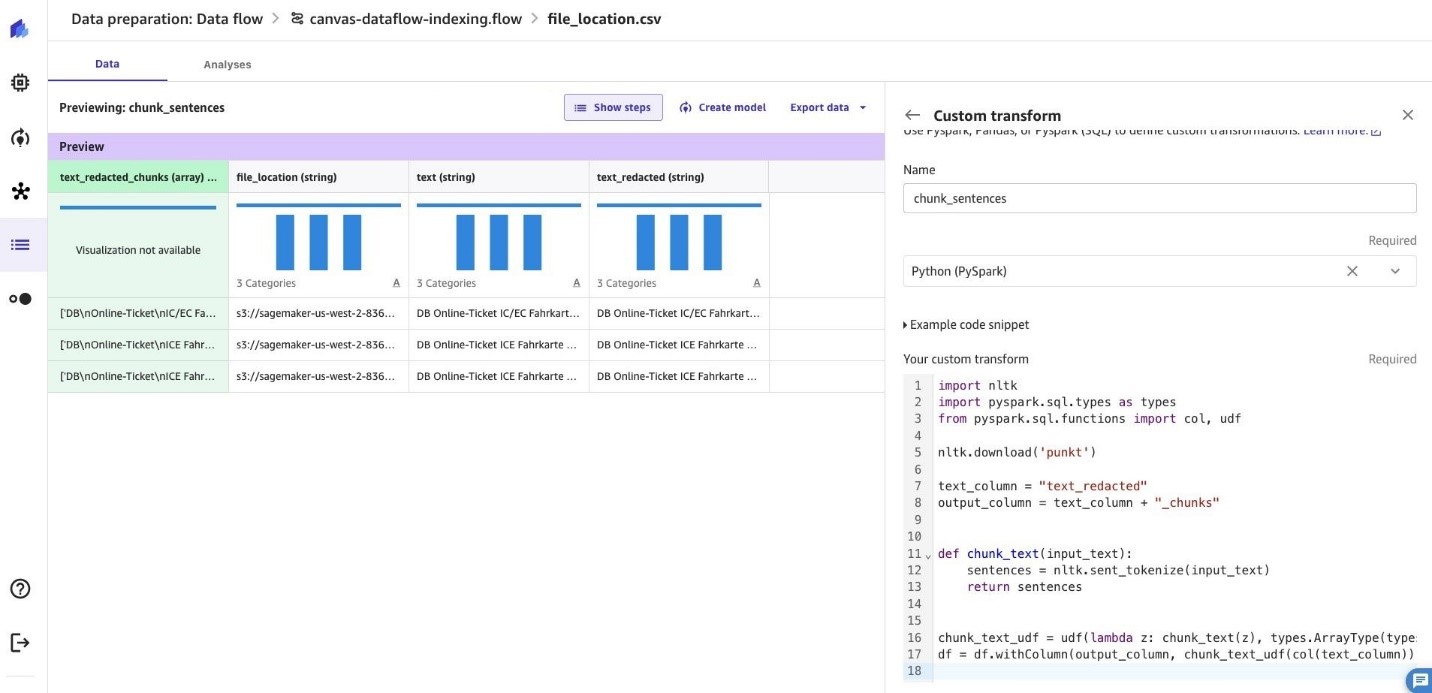

- 次のステップは、テキスト コンテンツをチャンク化することです。 選ぶ ステップを追加 選択して カスタム変換。 そして、 Python (PySpark)。

サンプルコードスニペットから参照して選択します チャンクテキスト。 コードスニペットに必要な変更を加えて選択します 追加します。

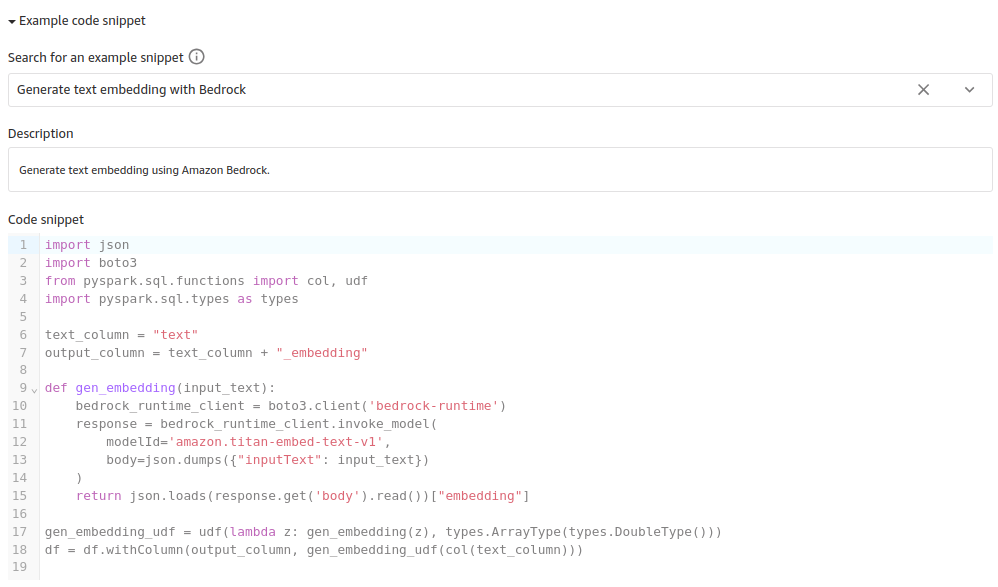

- を使用してテキスト コンテンツをベクトル埋め込みに変換しましょう。 アマゾンの岩盤 Titan 埋め込みモデル。 選ぶ ステップを追加 選択して カスタム変換。 そして、 Python (PySpark)。

サンプルコードスニペットから参照して選択します Bedrock を使用してテキスト埋め込みを生成します。 コードスニペットに必要な変更を加えて選択します 追加します。

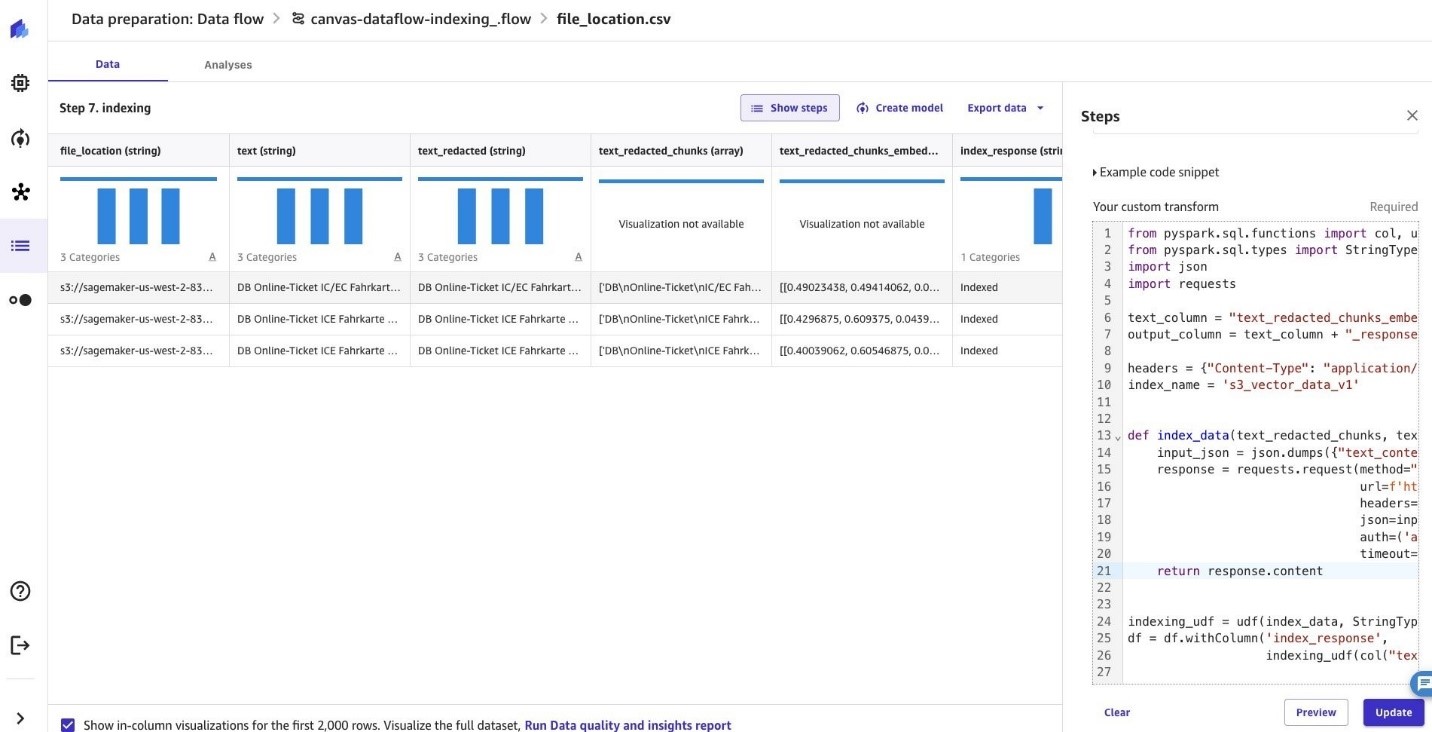

- これで、PDF ファイルのコンテンツにベクトル埋め込みを使用できるようになりました。 先に進み、データを Amazon OpenSearch にインデックス付けしましょう。 選ぶ ステップを追加 選択して カスタム変換。 そして、 Python (PySpark)。 次のコードを自由に書き換えて、好みのベクトル データベースを使用できます。 わかりやすくするために、OpenSearch API へのアクセスにはマスター ユーザー名とパスワードを使用します。実稼働ワークロードの場合は、組織のポリシーに従ってオプションを選択します。

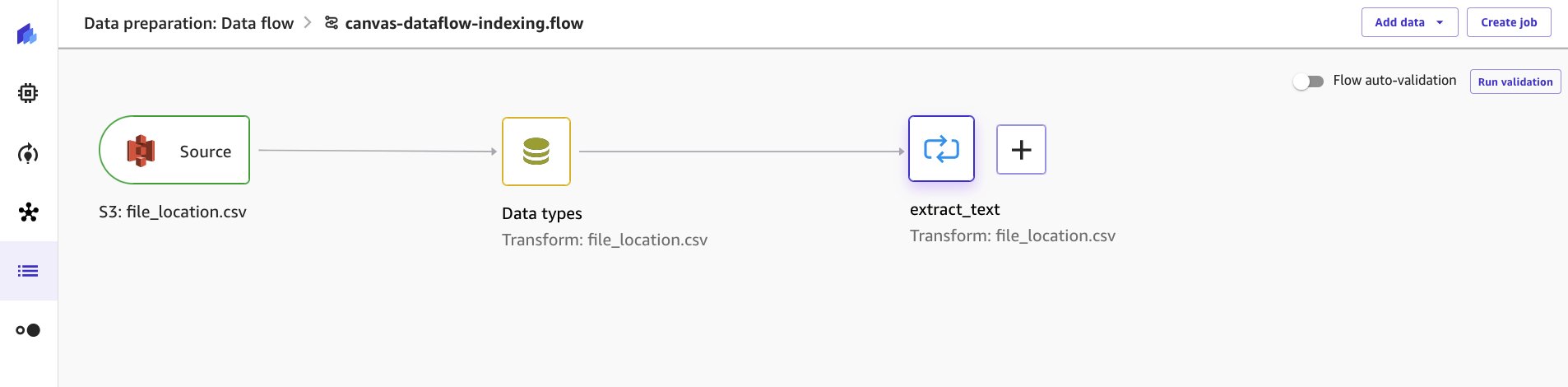

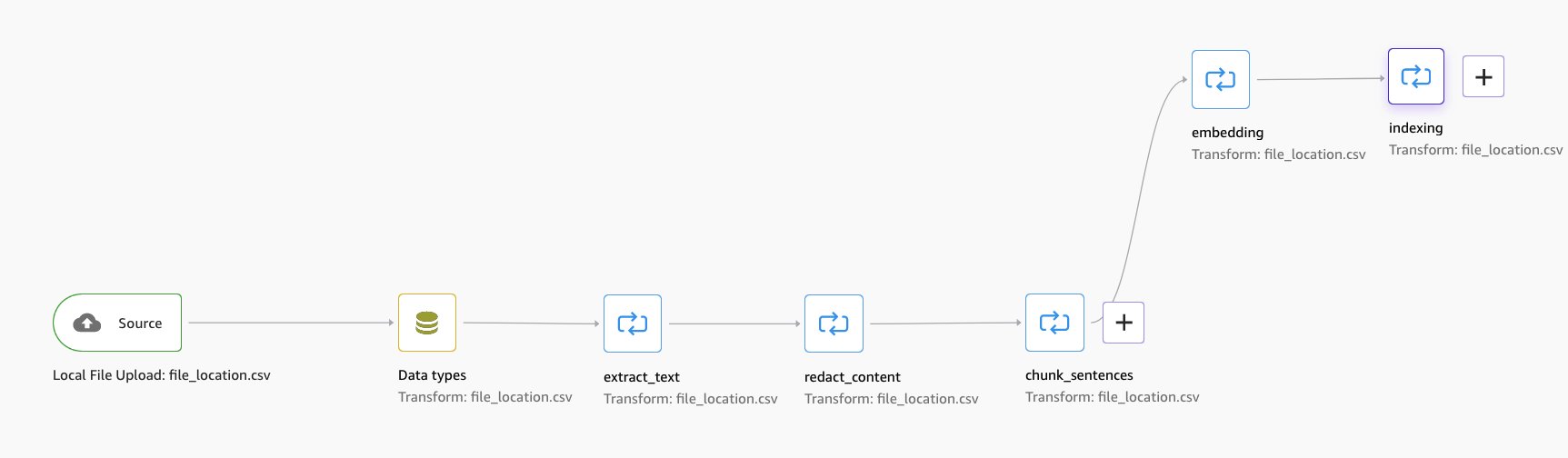

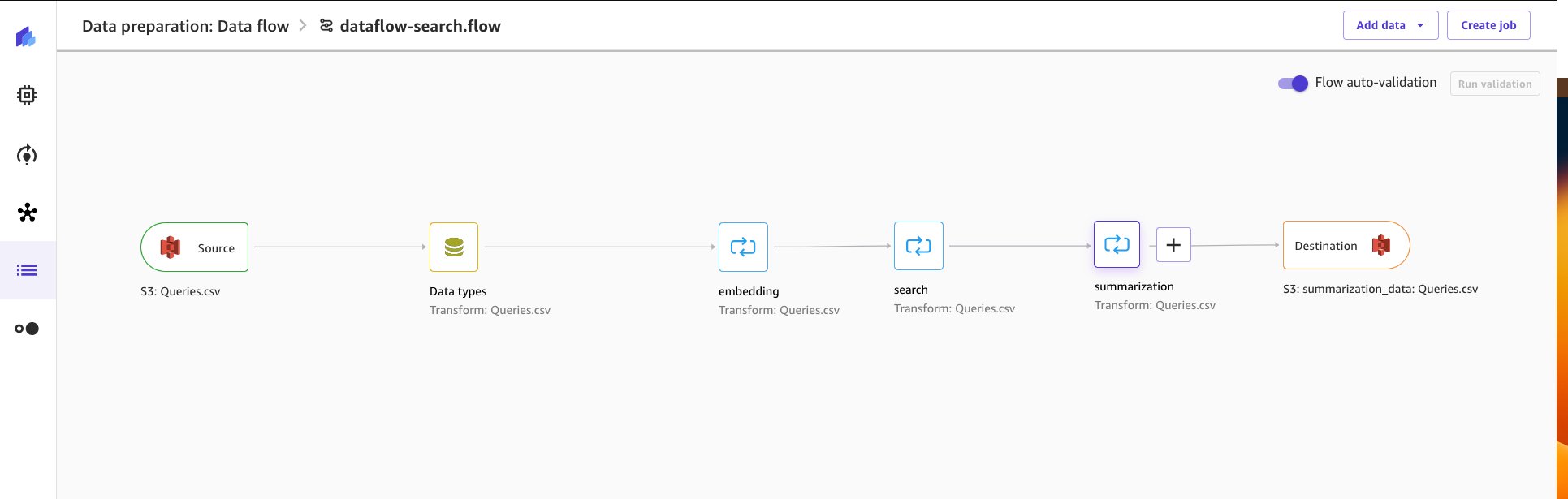

最終的に作成されるデータフローは次のようになります。

このデータフローでは、PDF ファイルのデータが読み取られ、Amazon OpenSearch のベクトル埋め込みでインデックス付けされます。 次に、インデックス付きデータをクエリするためのクエリを含むファイルを作成し、それを Amazon S3 の場所に保存します。 検索データフローをファイルに向け、対応する結果を含むファイルを Amazon S3 の場所にある新しいファイルに出力します。

プロンプトの準備

PDF からナレッジ ベースを作成したら、ナレッジ ベースでいくつかのサンプル クエリを検索してテストできます。 各クエリを次のように処理します。

- クエリの埋め込みを生成します (Amazon Bedrock を利用)

- 最近傍コンテキストのベクトル データベースをクエリします (Amazon OpenSearch を利用)

- クエリとコンテキストをプロンプトに結合します。

- プロンプトを使用して LLM をクエリする (Amazon Bedrock を利用)

- SageMaker Canvas のホームページで、 データの準備.

- 選択する 創造する ページの右側で、データ フロー名を指定し、選択します 創造する.

次に、ユーザーの質問をロードし、質問と同様のドキュメントを組み合わせてプロンプトを作成しましょう。 このプロンプトは、ユーザーの質問に対する回答を生成するために LLM に提供されます。

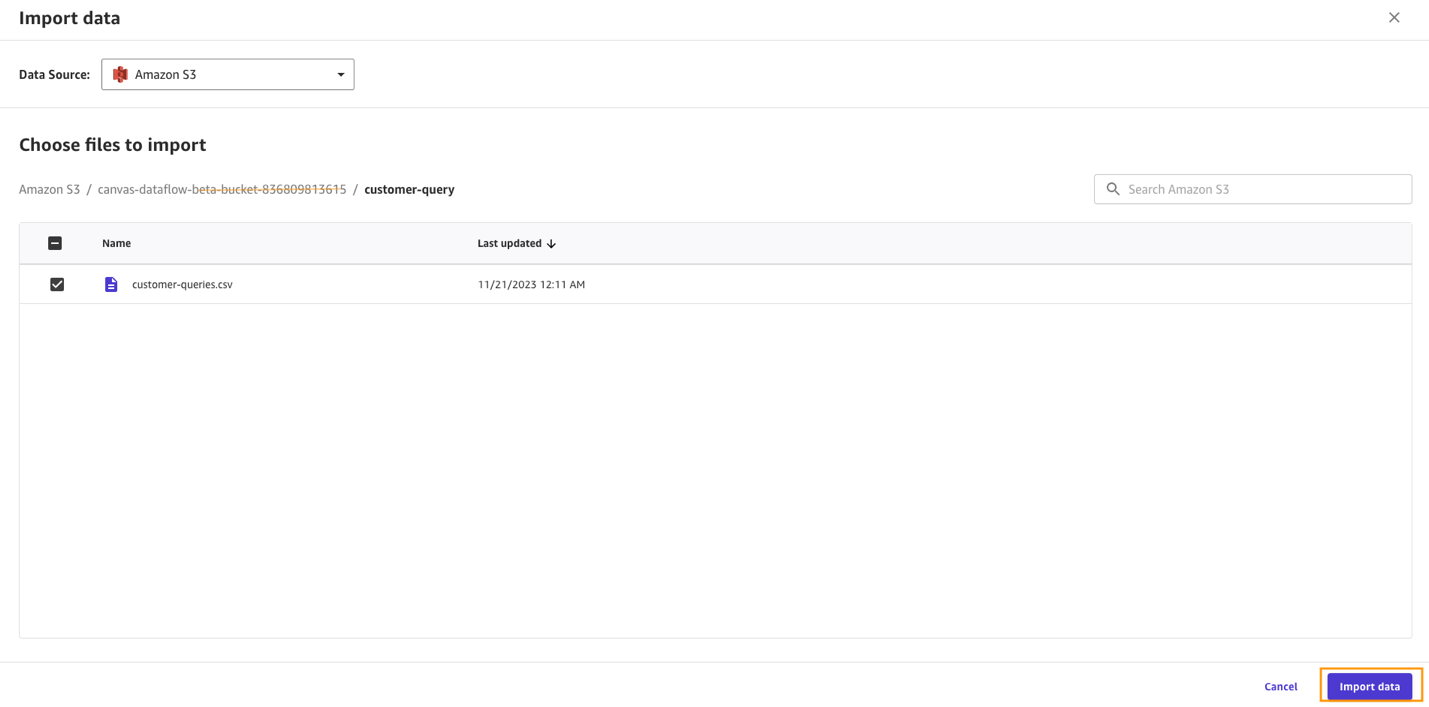

- ユーザーの質問を含む CSV ファイルをロードしてみましょう。 選ぶ データのインポート をクリックして 表形式 ドロップダウンリストから選択します。

- 情報元、 をクリックして アマゾンS3 ドロップダウンリストから。 あるいは、ユーザーのクエリを含むファイルをアップロードすることもできます。

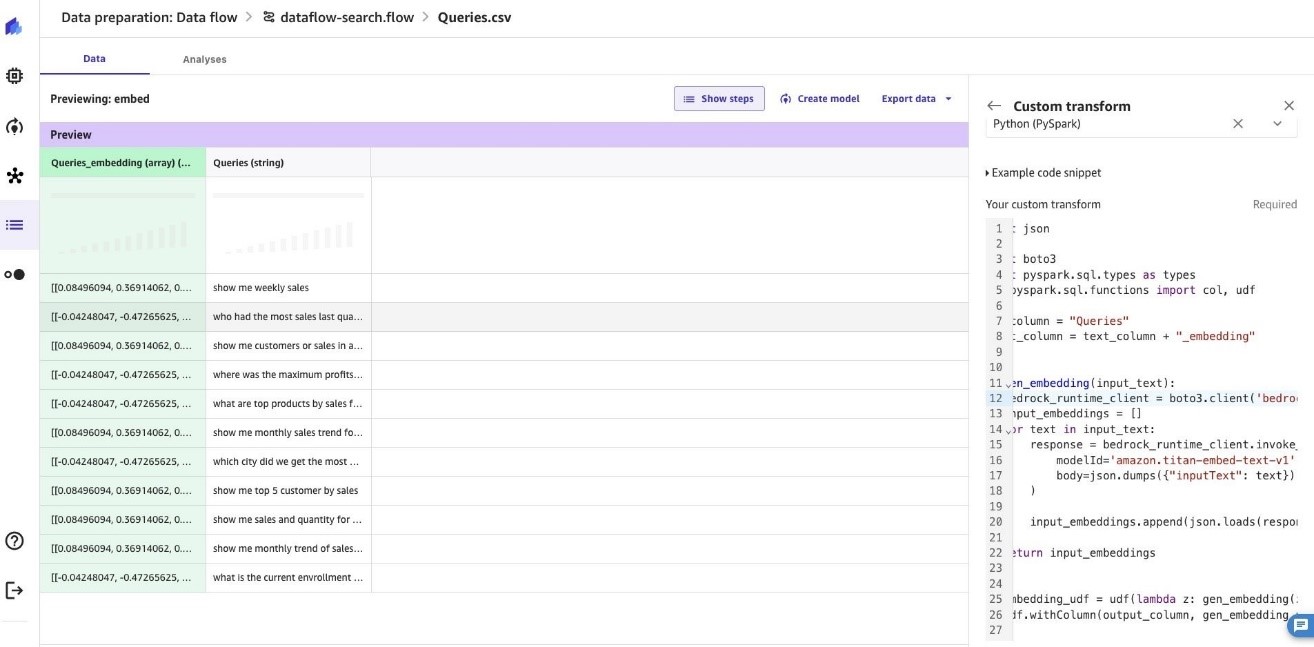

- データをベクトル埋め込みに変換するカスタム変換を追加して、Amazon OpenSearch から関連する埋め込みを検索してから、ナレッジベースからのクエリとコンテキストを含むプロンプトを Amazon Bedrock に送信しましょう。 クエリの埋め込みを生成するには、同じサンプル コード スニペットを使用できます。 Bedrock を使用してテキスト埋め込みを生成する 上記のステップ#7で説明したとおりです。

Amazon OpenSearch API を呼び出して、生成されたベクトル埋め込みの関連ドキュメントを検索してみましょう。 Python (PySpark) を使用してカスタム変換を追加します。

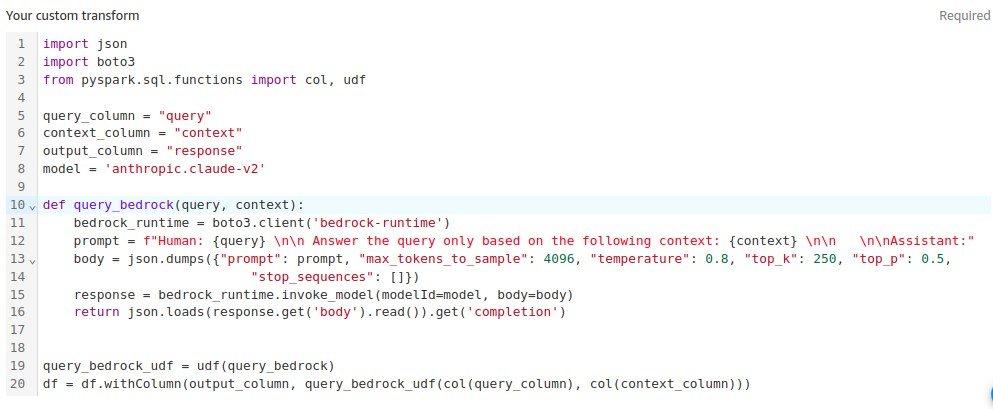

クエリ応答のために Amazon Bedrock API を呼び出し、Amazon OpenSearch ナレッジベースからドキュメントを渡すカスタム変換を追加しましょう。 サンプルコードスニペットから参照して選択します コンテキストを使用して Bedrock をクエリします。 コードスニペットに必要な変更を加えて選択します 追加します。

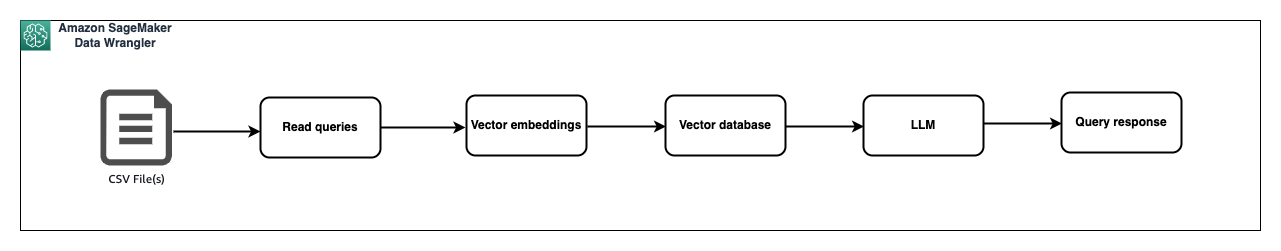

要約すると、RAG ベースの質問応答データフローは次のとおりです。

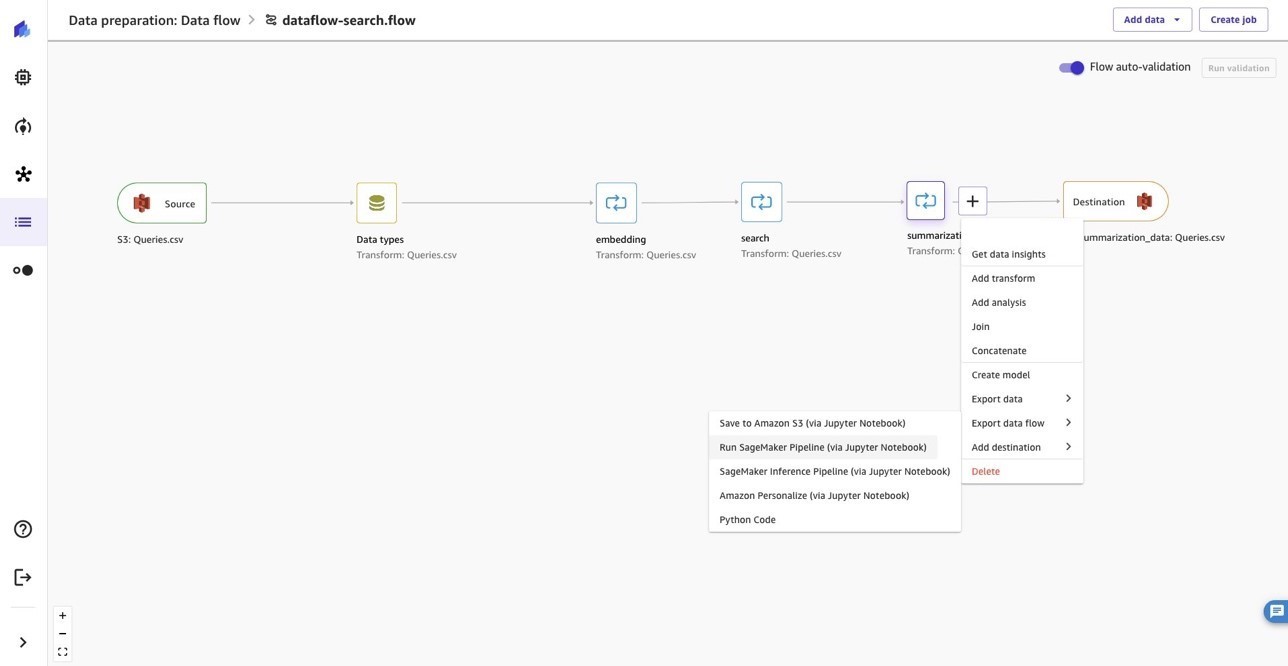

ML 実践者は、特徴量エンジニアリング コードの作成、初期データセットへの適用、エンジニアリングされたデータセットでのモデルのトレーニング、モデルの精度の評価に多くの時間を費やします。 この作業の実験的な性質を考慮すると、たとえ最小のプロジェクトであっても複数回の反復が必要になります。 同じ特徴エンジニアリング コードが何度も実行されることが多く、同じ操作を繰り返すことで時間とコンピューティング リソースが無駄になります。 大規模な組織では、異なるチームが以前の作業の知識がないために同じジョブを実行したり、重複した機能エンジニアリング コードを作成したりすることがよくあるため、これにより生産性がさらに失われる可能性があります。 フィーチャの再処理を回避するために、データ フローを Amazon にエクスポートします。 SageMaker パイプライン。 を選択しましょう クエリの右側にある + ボタン。 データ フローのエクスポートを選択し、 SageMaker パイプラインを実行する (Jupyter ノートブック経由)。

清掃

今後料金が発生しないようにするには、この投稿のフォロー中に作成したリソースを削除するかシャットダウンしてください。 参照する Amazon SageMaker Canvas からのログアウト のガイドをご参照ください。

まとめ

この投稿では、LLM 用にデータを準備するデータプロフェッショナルの役割を想定して、Amazon SageMaker Canvas のエンドツーエンド機能をどのように活用するかを説明しました。 インタラクティブなデータ準備により、データを迅速にクリーニング、変換、分析して有益な機能を設計できるようになりました。 SageMaker Canvas はコーディングの複雑さを取り除くことで、迅速な反復を可能にして高品質のトレーニング データセットを作成できます。 この加速されたワークフローは、ビジネスに影響を与えるパフォーマンスの高い機械学習モデルの構築、トレーニング、展開に直接つながりました。 SageMaker Canvas は、包括的なデータ準備とデータから洞察に至るまでの統合エクスペリエンスにより、ユーザーが ML の成果を向上できるようにします。

探索してさらに学ぶことをお勧めします AmazonSageMakerデータラングラー, Amazon SageMaker キャンバス, アマゾンタイタン モデル、 アマゾンの岩盤、およびAmazon OpenSearch サービス この投稿で提供されているサンプル実装とビジネスに関連するデータセットを使用してソリューションを構築します。 ご質問やご提案がございましたら、コメントを残してください。

著者について

アジャイ・ゴビンダラム AWS のシニア ソリューション アーキテクトです。 彼は、AI/ML を使用して複雑なビジネス上の問題を解決している戦略的な顧客と協力しています。 彼の経験は、中規模から大規模の AI / ML アプリケーションの展開に対して、技術的な方向性と設計支援を提供することにあります。 彼の知識は、アプリケーション アーキテクチャからビッグ データ、分析、機械学習にまで及びます。 休息中に音楽を聴いたり、アウトドアを体験したり、愛する人と過ごす時間を楽しんでいます。

アジャイ・ゴビンダラム AWS のシニア ソリューション アーキテクトです。 彼は、AI/ML を使用して複雑なビジネス上の問題を解決している戦略的な顧客と協力しています。 彼の経験は、中規模から大規模の AI / ML アプリケーションの展開に対して、技術的な方向性と設計支援を提供することにあります。 彼の知識は、アプリケーション アーキテクチャからビッグ データ、分析、機械学習にまで及びます。 休息中に音楽を聴いたり、アウトドアを体験したり、愛する人と過ごす時間を楽しんでいます。

ニキータ・イヴキン Amazon SageMaker Data Wrangler の上級応用科学者で、機械学習とデータクリーニングアルゴリズムに関心があります。

ニキータ・イヴキン Amazon SageMaker Data Wrangler の上級応用科学者で、機械学習とデータクリーニングアルゴリズムに関心があります。

- SEO を活用したコンテンツと PR 配信。 今日増幅されます。

- PlatoData.Network 垂直生成 Ai。 自分自身に力を与えましょう。 こちらからアクセスしてください。

- プラトアイストリーム。 Web3 インテリジェンス。 知識増幅。 こちらからアクセスしてください。

- プラトンESG。 カーボン、 クリーンテック、 エネルギー、 環境、 太陽、 廃棄物管理。 こちらからアクセスしてください。

- プラトンヘルス。 バイオテクノロジーと臨床試験のインテリジェンス。 こちらからアクセスしてください。

- 情報源: https://aws.amazon.com/blogs/machine-learning/simplify-data-prep-for-gen-ai-with-amazon-sagemaker-data-wrangler/

- :持っている

- :は

- :not

- 100

- 14

- 20

- 25

- 28

- 50

- 7

- 8

- 804

- a

- できる

- 私たちについて

- 上記の.

- 加速する

- 加速された

- アクセス

- 従った

- アカウント

- 精度

- 加えます

- NEW

- 養子縁組

- 進歩

- 利点

- 利点

- 後

- 再び

- 集計

- 先んじて

- AI

- AI / ML

- アルゴリズム

- 整列

- すべて

- 許可されて

- また

- Amazon

- アマゾンセージメーカー

- AmazonSageMakerデータラングラー

- Amazon Webサービス

- 金額

- an

- 分析

- 分析論

- 分析する

- および

- 回答

- どれか

- API

- 申し込み

- 適用された

- 適用

- 建築

- です

- 人工の

- 人工知能

- AS

- 援助

- At

- アタッチ

- オーディオ

- 増強された

- 利用できます

- 避ける

- AWS

- ベース

- ベース

- BE

- なぜなら

- になる

- き

- さ

- より良いです

- 偏った

- ビッグ

- ビッグデータ

- ビルド

- 建物

- 内蔵

- ビジネス

- ビジネス

- (Comma Separated Values) ボタンをクリックして、各々のジョブ実行の詳細(開始/停止時間、変数値など)のCSVファイルをダウンロードします。

- by

- コール

- 缶

- キャンバス

- 機能

- 場合

- 原因となる

- 変更

- 課金

- 選択する

- クリーニング

- コード

- コーディング

- 結合

- コメント

- 企業

- 比べ

- 競争力のある

- コンプリート

- 複雑な

- 複雑さ

- 理解する

- 包括的な

- 計算

- 検討

- 領事

- 含む

- 含まれています

- コンテンツ

- 中身

- コンテキスト

- 文脈

- 続ける

- コントロール

- 変換

- 対応する

- 可能性

- カバー

- 作ります

- 作成した

- 重大な

- カスタム

- 顧客

- 顧客サービス

- Customers

- データ

- データの準備

- データベース

- データセット

- デロイト

- 実証

- 展開する

- 配備

- 設計

- 細部

- 開発

- 異なります

- 難しい

- 次元

- 方向

- 直接に

- 発見する

- do

- ドキュメント

- ドキュメント

- ドキュメント

- ドメイン

- ドメイン

- ダウン

- 間に

- e

- 各

- 簡単に

- 効果的に

- 効率的な

- 効率良く

- メール

- 埋め込み

- 力を与える

- 使用可能

- 有効にする

- 奨励する

- 端から端まで

- エンジニア

- 設計された

- エンジニアリング

- 評価します

- さらに

- 例

- 存在

- 体験

- 体験

- 実験的

- 探る

- 探る

- export

- エキス

- 特徴

- 特徴

- 少数の

- フィールズ

- File

- filter

- ファイナル

- もう完成させ、ワークスペースに掲示しましたか?

- フロー

- 続いて

- フォロー中

- 次

- フォーブス

- Foundation

- 財団

- 無料版

- から

- フル

- 機能

- さらに

- 未来

- 利得

- 生成する

- 生成された

- 生成

- 世代

- 生々しい

- 生成AI

- 取得する

- 与える

- 与えられた

- グローバル

- Go

- 目標

- 良い

- 大きい

- 持ってる

- he

- ヘッダーの

- 高品質

- 彼の

- 保持している

- ホーム

- 認定条件

- How To

- しかしながら

- HTML

- HTTPS

- i

- 同一の

- if

- 画像

- 影響

- 実装

- import

- 重要

- 印象的

- 改善します

- in

- 含ま

- index

- 索引付けされた

- 情報

- 有益な

- 初期

- 洞察

- 説明書

- 統合

- インテリジェンス

- 相互作用的

- 利益

- インタフェース

- インターネット

- に

- 巻き込む

- IT

- 繰り返し

- 繰り返し

- ITS

- Jobs > Create New Job

- JPG

- JSON

- 知識

- 土地

- 言語

- 大

- 大規模

- 起動する

- リード

- LEARN

- 学習

- コメントを残す

- ツェッペリン

- 活用

- ある

- ような

- リスト

- 耳を傾ける

- LLM

- 負荷

- 場所

- 場所

- 損失

- たくさん

- 愛され

- ロー

- 機械

- 機械学習

- メイン

- make

- 作る

- mask

- 大規模な

- マスター

- 五月..

- メカニズム

- メディア

- メニュー

- Meta

- ML

- モデル

- 控えめな

- 他には?

- 最も

- の試合に

- 音楽を聴く際のスピーカーとして

- 名

- ナチュラル

- 自然言語処理

- 自然

- ナビゲーション

- 必要

- 必要

- 新作

- 次の

- いいえ

- ノート

- 今

- of

- 頻繁に

- on

- かつて

- もの

- の

- 業務執行統括

- オプション

- or

- 組織

- 組織

- その他

- 私たちの

- でる

- 成果

- 屋外で

- 出力

- が

- ページ

- パンダ

- ペイン

- 通過

- パスワード

- パフォーマンス

- 個人的な

- 選ぶ

- ピース

- ピース

- パイプライン

- プラトン

- プラトンデータインテリジェンス

- プラトデータ

- お願いします

- さらに

- ポイント

- ポリシー

- ポスト

- 潜在的な

- パワード

- 優先

- 準備

- 準備

- 準備中

- 事前の

- 多分

- 問題

- 問題

- 進む

- プロセス

- 処理

- 生産

- 生産性

- プロ

- プロジェクト

- プロパティ

- 提供

- は、大阪で

- 提供

- Python

- クエリ

- 質問

- 質問

- すぐに

- 範囲

- 急速な

- 評価

- リーチ

- 読む

- 現実の世界

- 受け

- 参照する

- 関連する

- 関連した

- 除去

- 報告

- リクエスト

- 必要とする

- 必要

- リソース

- 応答

- 回答

- 安静

- 結果

- return

- レビュー

- 右

- 職種

- ラン

- セージメーカー

- 同じ

- Save

- 科学者

- を検索

- 検索

- セクション

- 見て

- select

- 送信

- シニア

- 敏感な

- サービス

- サービス

- 設定

- すべき

- 表示する

- 示されました

- シャット

- シャットダウン

- 側

- 符号

- 重要

- 同様の

- 単純

- 簡素化する

- サイズ

- スニペット

- So

- 社会

- ソーシャルメディア

- 溶液

- ソリューション

- 解決する

- 一部

- ソース

- ソース

- 特定の

- 特に

- 過ごす

- 支出

- ステージ

- ステージ

- 手順

- ステップ

- まだ

- 戦略的

- 構造化された

- 概要

- サポート

- Survey

- 取る

- チーム

- 技術的

- テクニック

- test

- 클라우드 기반 AI/ML및 고성능 컴퓨팅을 통한 디지털 트윈의 기초 – Edward Hsu, Rescale CPO 많은 엔지니어링 중심 기업에게 클라우드는 R&D디지털 전환의 첫 단계일 뿐입니다. 클라우드 자원을 활용해 엔지니어링 팀의 제약을 해결하는 단계를 넘어, 시뮬레이션 운영을 통합하고 최적화하며, 궁극적으로는 모델 기반의 협업과 의사 결정을 지원하여 신제품을 결정할 때 데이터 기반 엔지니어링을 적용하고자 합니다. Rescale은 이러한 혁신을 돕기 위해 컴퓨팅 추천 엔진, 통합 데이터 패브릭, 메타데이터 관리 등을 개발하고 있습니다. 이번 자리를 빌려 비즈니스 경쟁력 제고를 위한 디지털 트윈 및 디지털 스레드 전략 개발 방법에 대한 인사이트를 나누고자 합니다.

- それ

- 未来

- アプリ環境に合わせて

- それら

- その後

- そこ。

- ボーマン

- 彼ら

- この

- 従って

- 時間

- タイタン

- 〜へ

- 今日

- 豊富なツール群

- トレーニング

- 最適化の適用

- 変換

- 変換

- 変換

- true

- 切り捨て

- type

- 統一

- us

- つかいます

- 中古

- ユーザー

- users

- 貴重な

- 、

- ビデオ

- ビジュアル

- ウォークスルー

- we

- ウェブ

- Webサービス

- WELL

- which

- while

- 誰

- 意志

- 仕事

- ワークフロー

- 作品

- でしょう

- 書きます

- You

- あなたの

- ゼファーネット