Wilt u gegevens uit gedrukte of handgeschreven formulieren halen? Uitchecken Nanonetten™ formulier gegevensextractor gratis en automatiseer de export van informatie vanuit elke vorm!

Vormen zijn overal; ze worden gedefinieerd als documenten die zijn gemaakt om informatie te verzamelen door de deelnemers te vragen de benodigde informatie in een specifiek formaat in te vullen. Ze zijn nuttig vanwege hun vermogen om in korte tijd veel gegevens te verzamelen. Niet alle formulieren hebben echter dezelfde capaciteit voor het verzamelen van gegevens en vereisen later vaak handmatig werk. Daarom vertrouwen we op tools en algoritmen om het proces van het extraheren van formuliergegevens op intelligente wijze te automatiseren. Deze blogpost gaat dieper in op verschillende scenario's en technieken om gegevens uit formulieren te extraheren met behulp van OCR en Deep Learning.

- Wat is formuliergegevensextractie?

- Wat maakt het probleem uitdagend?

- De diepte van het formulierextractieprobleem

- Hoe zijn de oplossingen voor het extraheren van formuliergegevens geëvolueerd?

- Formuliergegevensextractie met OCR's

- Formuliergegevensextractie oplossen met behulp van Deep Learning

- Voer Nanonets in

Wat is formuliergegevensextractie?

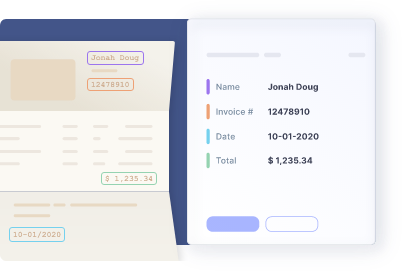

Formuliergegevensextractie is het proces van het extraheren van gegevens uit formulieren - zowel online als offline. Deze gegevens kunnen in elk formaat worden gevonden, meestal met een formulier met de relevante informatie. Het extraheren van deze gegevens is echter niet altijd een gemakkelijke taak, omdat veel lay-outs en ontwerpen het niet mogelijk maken om tekst gemakkelijk te selecteren. Er is geen native manier om gegevens van hen te kopiëren. Daarom vertrouwen we op geautomatiseerde technieken om gegevens uit formulieren te extraheren die effectiever en minder foutgevoelig zijn.

Tegenwoordig zijn bijvoorbeeld veel gebruikers afhankelijk van op PDF gebaseerde formulieren om contactgegevens te verzamelen. Dit is een zeer efficiënte manier om informatie te verzamelen, omdat de afzender en de ontvanger geen input hoeven te leveren. Maar het extraheren van deze gegevens uit een PDF-formulier kan een uitdaging en duur zijn.

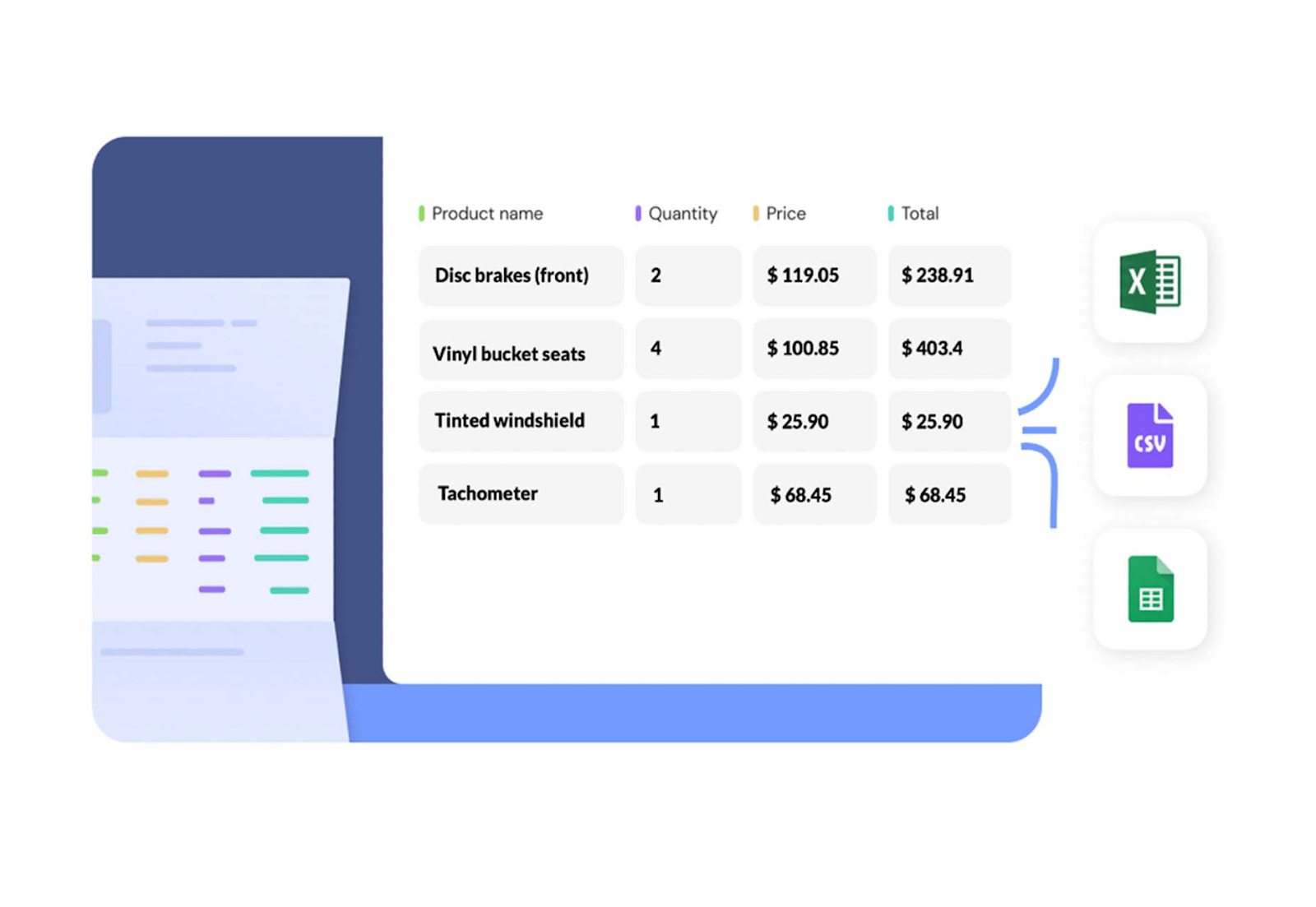

Hier kan extractie van formuliergegevens helpen bij het extraheren van gegevens uit een PDF-formulier, zoals naam, e-mailadres, telefoonnummer, enz. Het kan worden geïmporteerd in een andere toepassing zoals Excel, Spreadsheets of een ander gestructureerd formaat. De manier waarop het werkt, is dat de extractietools het PDF-bestand lezen, automatisch eruit halen wat het nodig heeft en het in een gemakkelijk leesbare indeling ordenen. Deze gegevens kunnen worden geëxporteerd naar andere indelingen zoals Excel, CSV, JSON en andere goed gestructureerde gegevensindelingen. Laten we in de volgende sectie eens kijken naar enkele van de veelvoorkomende uitdagingen bij het bouwen van algoritmen voor het extraheren van formuliergegevens.

Wilt u gegevens uit gedrukte of handgeschreven formulieren halen? Bekijk Nanonetten™ formulier data extractor gratis & automatiseer de export van informatie vanuit elke vorm!

Wat maakt het extraheren van formuliergegevens zo uitdagend?

Gegevensextractie is om verschillende redenen een opwindend probleem. Ten eerste is het een probleem met beeldherkenning, maar het moet ook rekening houden met de tekst die in de afbeelding aanwezig kan zijn en de lay-out van het formulier, wat het bouwen van een algoritme complexer maakt. In deze sectie worden enkele veelvoorkomende uitdagingen besproken die mensen tegenkomen bij het bouwen van algoritmen voor het extraheren van formuliergegevens.

- Tekort aan data: Algoritmen voor gegevensextractie worden meestal gebouwd met behulp van krachtige algoritmen voor diep leren en computervisie. Deze zijn doorgaans afhankelijk van enorme hoeveelheden gegevens om state-of-the-art prestaties te bereiken. Het vinden van een consistente en betrouwbare dataset en het verwerken ervan is dus cruciaal voor elke vorm van data-extractietool of software. Stel dat we formulieren hebben met meerdere sjablonen, dan zouden deze algoritmen een breed scala aan formulieren moeten kunnen begrijpen; daarom zou het trainen van hen op een robuuste dataset een nauwkeurigere prestatie hebben.

- Omgaan met lettertypen, talen en lay-outs: Er zijn duizelingwekkende hoeveelheden verschillende lettertypen, ontwerpen en sjablonen beschikbaar voor verschillende soorten formuliergegevens. Ze kunnen in verschillende totaal verschillende classificaties vallen, wat het een uitdaging maakt om nauwkeurige herkenning te garanderen wanneer er een groot aantal verschillende karaktertypen in aanmerking moeten worden genomen. Daarom is het belangrijk om de verzameling lettertypen te beperken tot een bepaalde taal en type, omdat het veel processen zal creëren die soepel verlopen zodra je die documenten op de juiste manier hebt verwerkt. In meertalige gevallen moet jongleren tussen karakters uit meerdere talen worden voorbereid en ook zorgen voor complexe typografie.

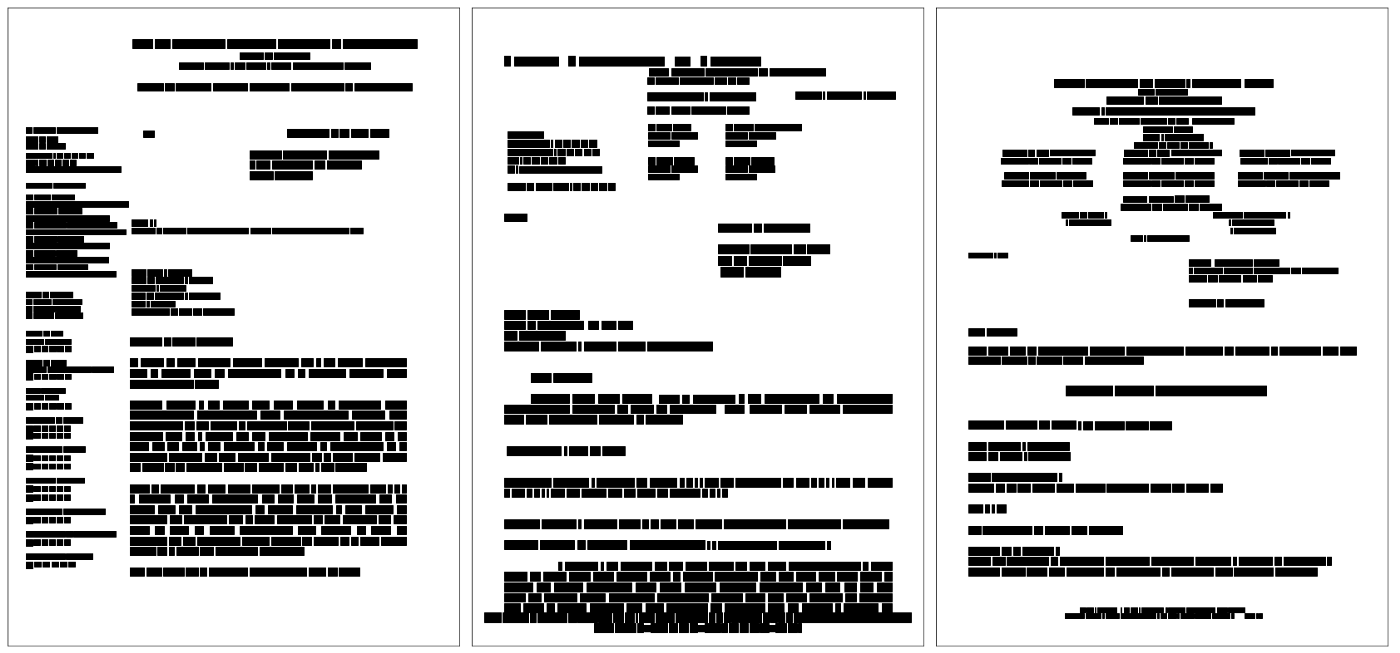

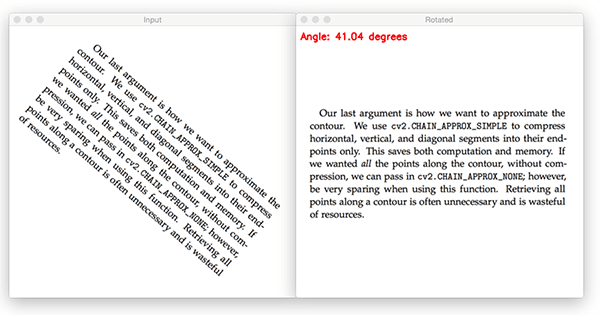

- Oriëntatie en scheefstand (rotatie): Tijdens het beheren van gegevens scannen we vaak afbeeldingen om algoritmen te trainen voor het verzamelen van invoergegevens. Als je ooit een scanner of digitale camera hebt gebruikt, is het je misschien opgevallen dat de hoek waaronder je afbeeldingen van documenten vastlegt er soms voor kan zorgen dat ze scheef lijken. Dit staat bekend als scheefheid die verwijst naar de mate van hoek. Deze scheefheid kan de nauwkeurigheid van het model verminderen. Gelukkig kunnen verschillende technieken worden gebruikt om dit probleem op te lossen door simpelweg te wijzigen hoe onze software functies in bepaalde delen van de afbeelding detecteert. Een voorbeeld van een dergelijke techniek zijn Projection Profile-methoden of Fourier Transformation-methoden, die veel schonere resultaten mogelijk maken in vorm-, dimensie- en textuurherkenning! Hoewel oriëntatie en scheefheid eenvoudige fouten kunnen zijn, kunnen deze in grote aantallen de nauwkeurigheid van het model beïnvloeden.

- Gegevensveiligheid: Als u gegevens uit verschillende bronnen haalt voor het verzamelen van gegevens, is het belangrijk om op de hoogte te zijn van de geldende beveiligingsmaatregelen. Anders loopt u het risico de informatie die wordt overgedragen in gevaar te brengen. Dit kan leiden tot situaties waarin persoonlijke informatie wordt geschonden of de informatie die naar een API wordt verzonden, niet veilig is. Daarom moet men zich bij het werken met ETL-scripts en online API's voor gegevensextractie ook bewust zijn van problemen met gegevensbeveiliging.

- Tabel Extractie: Soms zien we formuliergegevens in tabellen; het bouwen van een robuust algoritme dat zowel formulierextractie als tabelextractie aankan, kan een uitdaging zijn. De gebruikelijke benadering is om deze algoritmen zelfstandig te bouwen en op de data toe te passen, maar dit zal leiden tot het gebruik van meer rekenkracht, wat de kosten verhoogt. Daarom zou een ideale vormextractie in staat moeten zijn om zowel formuliergegevens als gegevens uit een bepaald document te extraheren.

- Uitvoer na verwerken/exporteren: De uitvoergegevens van elke gegevensextractie zijn niet recht. Daarom vertrouwen ontwikkelaars op nabewerkingstechnieken om de resultaten in een meer gestructureerd formaat te filteren. Na verwerking van de gegevens worden ze geëxporteerd naar een meer gestructureerd formaat zoals CSV, Excel of een database. Organisaties vertrouwen op integraties van derden of ontwikkelen API's om dit proces te automatiseren, wat wederom tijdrovend is. Daarom moeten ideale algoritmen voor gegevensextractie flexibel zijn en gemakkelijk te communiceren met externe gegevensbronnen.

Wilt u gegevens uit gedrukte of handgeschreven formulieren halen? Bekijk Nanonetten™ formulier data extractor gratis & automatiseer de export van informatie vanuit elke vorm!

De diepte van de formulierextractie begrijpen met verschillende scenario's

Tot nu toe hebben we de basisprincipes en uitdagingen van het extraheren van formuliergegevens besproken. In deze sectie gaan we dieper in op verschillende scenario's en begrijpen we de diepte van het extraheren van formuliergegevens. We zullen ook bekijken hoe we het extractieproces voor deze specifieke scenario's kunnen automatiseren.

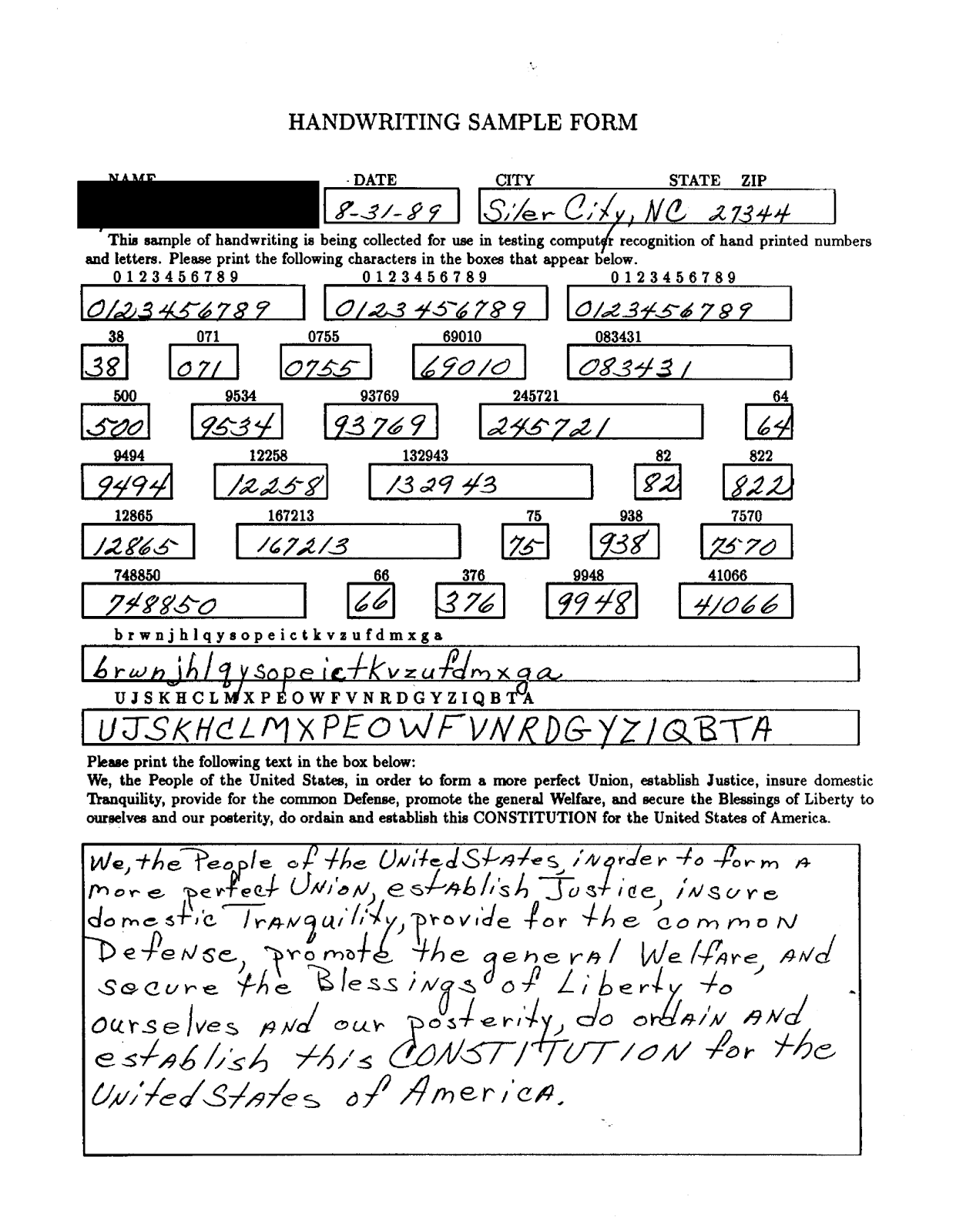

Scenario #1: Handgeschreven herkenning voor offline formulieren

Offline formulieren komen veel voor in het dagelijks leven. Het is absoluut noodzakelijk dat de formulieren gemakkelijk in te vullen en in te dienen zijn. Het handmatig digitaliseren van offline formulieren kan een hectische en dure taak zijn, daarom zijn deep learning-algoritmen nodig. Handgeschreven documenten zijn een grote uitdaging om gegevens uit te extraheren vanwege de complexiteit van de handgeschreven karakters. Daarom worden veel algoritmen voor gegevensherkenning gebruikt waarmee een machine de handgeschreven tekst leert lezen en interpreteren. Het proces omvat het scannen van afbeeldingen van handgeschreven woorden en het omzetten ervan in gegevens die kunnen worden verwerkt en geanalyseerd door een algoritme. Het algoritme maakt vervolgens een karakterkaart op basis van streken en herkent corresponderende letters om de tekst te extraheren.

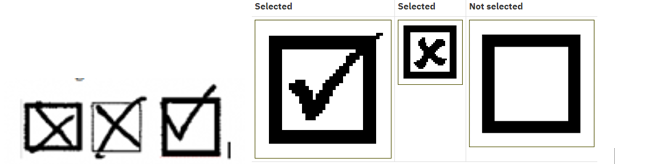

Scenario #2: Identificatie van selectievakjes op formulieren

Checkbox-formulieren zijn een vorm van gegevensinvoer die wordt gebruikt om informatie van een gebruiker in een invoerveld te verzamelen. Dit type gegevens wordt meestal aangetroffen in lijsten en tabellen waarin de gebruiker een of meer items moet selecteren, zoals items waarmee contact moet worden opgenomen. Het kan op een aantal plaatsen worden gevonden - online formulieren, vragenlijsten en enquêtes, enzovoort. Tegenwoordig kunnen sommige algoritmen het gegevensextractieproces zelfs vanuit de selectievakjes automatiseren. Het primaire doel van dit algoritme is om de invoergebieden te identificeren met behulp van computervisietechnieken. Het gaat om het identificeren van lijnen (horizontaal en verticaal), het toepassen van filters, contouren en het detecteren van randen op de afbeeldingen. Nadat het invoergebied is geïdentificeerd, is het eenvoudig om de inhoud van het selectievakje te extraheren die is gemarkeerd of niet is gemarkeerd.

Scenario #3: Lay-out Wijzigingen van het formulier van tijd tot tijd

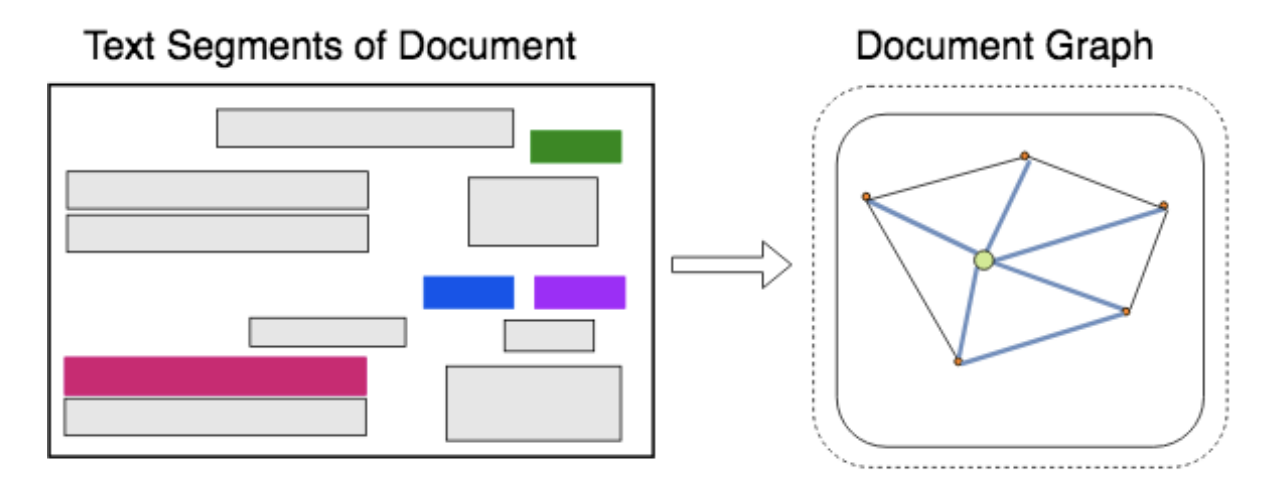

Als het gaat om het invullen van formulieren, zijn er meestal twee verschillende soorten opties. Voor sommige formulieren moeten we onze informatie verstrekken door in alle relevante velden te schrijven, terwijl we voor andere formulieren de informatie kunnen verstrekken door een aantal selectievakjes te selecteren. De lay-out van het formulier verandert ook afhankelijk van het type formulier en de context. Daarom is het essentieel om een algoritme te bouwen dat meerdere ongestructureerde documenten kan verwerken en op intelligente wijze inhoud kan extraheren, afhankelijk van de formulierlabels. Een populaire techniek van deep learning-architectuur om documentlay-outs te verwerken, zijn Graph CNN's. Het idee achter Graph Convolutional Networks (GCN's) is ervoor te zorgen dat de neuronactivaties datagestuurd zijn. Ze zijn ontworpen om te functioneren op grafieken, die zijn samengesteld uit knooppunten en randen. Een grafische convolutionele laag is in staat om patronen te herkennen bij afwezigheid van een taakspecifiek trainingssignaal. Daarom zijn deze geschikt wanneer de gegevens robuust zijn.

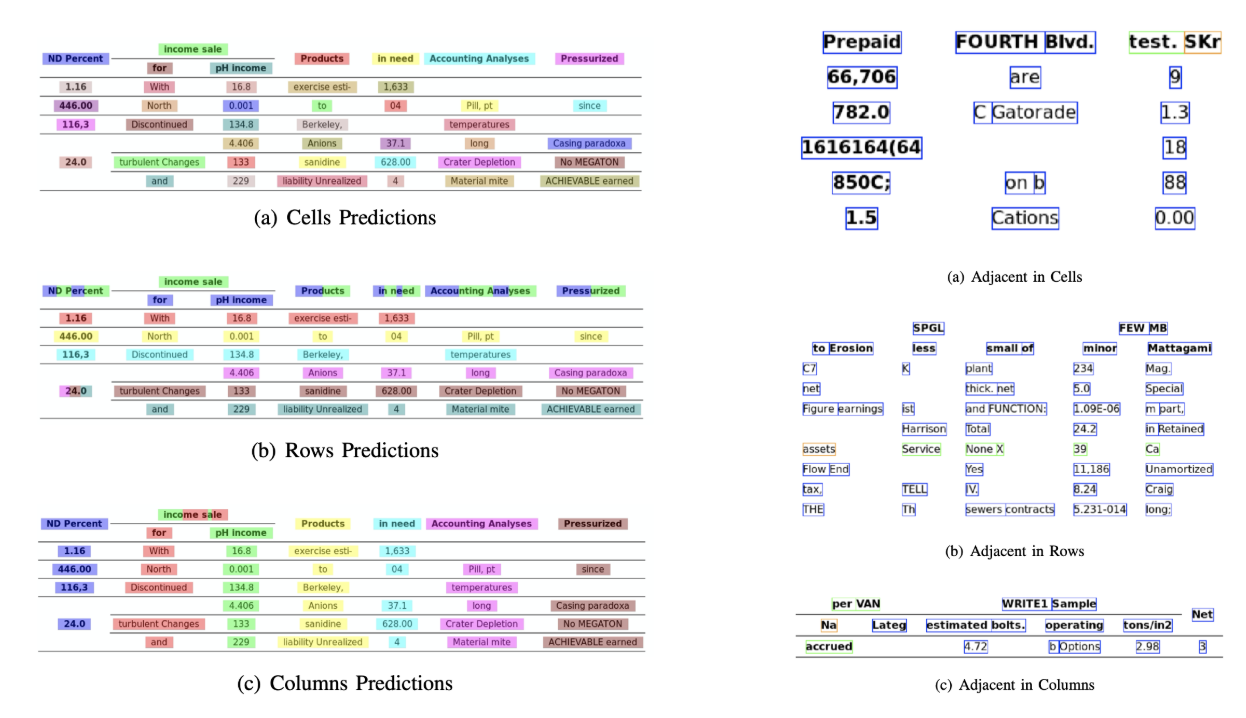

Scenario #4: Tabelceldetectie

In sommige gevallen komen bedrijven speciale soorten formulieren tegen die bestaan uit tabelcellen. Tabelcellen zijn rechthoekige gebieden binnen een tabel waar gegevens worden opgeslagen. Ze kunnen worden geclassificeerd als koppen, rijen of kolommen. Een ideaal algoritme zou al deze soorten cellen en hun grenzen moeten identificeren om de gegevens eruit te extraheren. Enkele populaire technieken voor tabelextractie zijn Stream en Lattice; dit zijn algoritmen die kunnen helpen bij het detecteren van lijnen, vormen en polygonen door middel van eenvoudige isomorfe bewerkingen op afbeeldingen.

Hoe zijn de oplossingen voor het extraheren van formuliergegevens geëvolueerd?

Extractie van formuliergegevens vindt zijn oorsprong in de pre-computertijd toen mensen met papieren formulieren omgingen. Met de komst van computers werd het mogelijk om gegevens elektronisch op te slaan. De computerprogramma's zouden de gegevens kunnen gebruiken om rapporten te maken, zoals verkoopstatistieken. Deze software kan ook worden gebruikt voor het afdrukken van adresetiketten, zoals de naam en het adres van klanten, en het afdrukken van facturen, zoals het verschuldigde bedrag en het adres waarnaar het moet worden verzonden. Vandaag zien we echter een andere versie van de software voor het extraheren van formuliergegevens; deze zijn zeer nauwkeurig, sneller en leveren de gegevens op een zeer georganiseerde en gestructureerde manier. Laten we nu kort verschillende soorten technieken voor het extraheren van formuliergegevens bespreken.

- Op regels gebaseerd van gegevensextractie: Op regels gebaseerde extractie is een techniek die automatisch gegevens extraheert uit een bepaald sjabloonformulier. Het kan gegevens extraheren zonder menselijke tussenkomst. Ze werken door verschillende velden op de pagina te onderzoeken en te beslissen welke ze moeten extraheren op basis van omringende tekst, labels en andere contextuele aanwijzingen. Deze algoritmen worden meestal ontwikkeld en geautomatiseerd met behulp van ETL-scripts of webscraping. Wanneer ze echter worden getest op ongeziene gegevens, falen ze volledig.

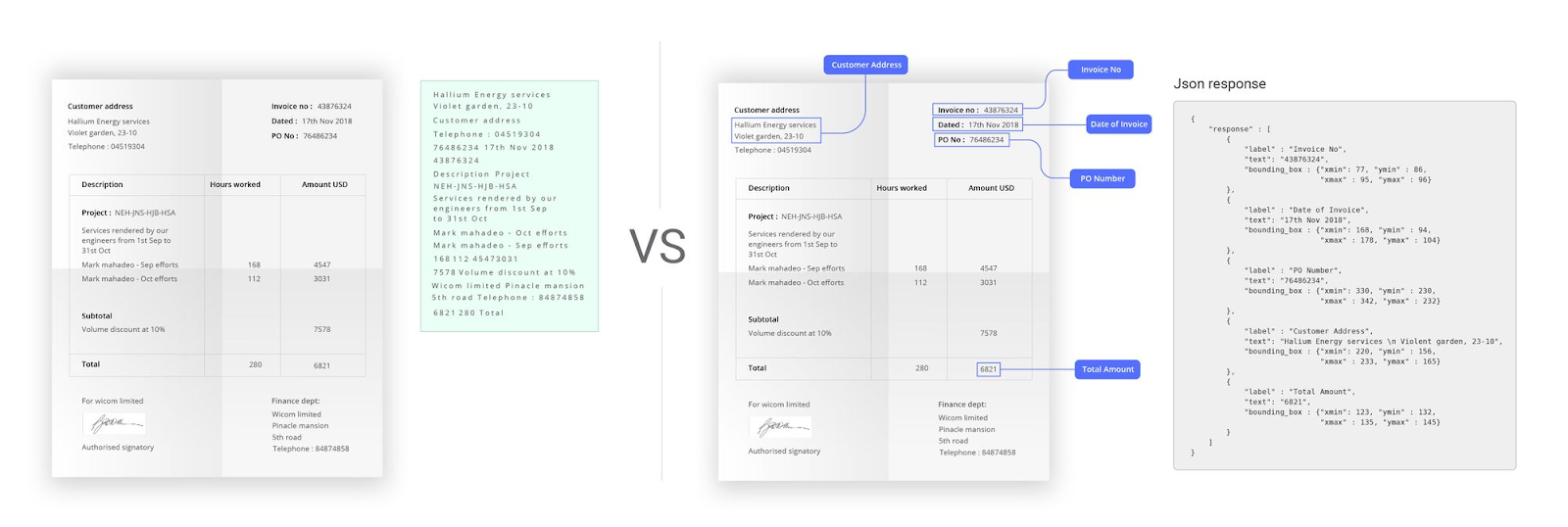

- Formuliergegevensextractie met OCR: OCR is een go-to-oplossing voor elke vorm van gegevensextractieprobleem. Men moet echter aanvullende scripts en programma's schrijven om nauwkeurige prestaties te bereiken. Om OCR te laten werken, is de invoer van een afbeelding met tekst erop vereist. De software leest vervolgens elke pixel en vergelijkt elke pixel met de bijbehorende letter. Als het overeenkomt, wordt die letter en alle cijfers of symbolen uitgevoerd die dicht genoeg bij de letter liggen. De grootste uitdaging bij OCR is uitzoeken hoe letters te scheiden. Als de noten bijvoorbeeld dicht bij elkaar liggen of elkaar overlappen, zoals 'a' en 'e'. Daarom werken deze mogelijk niet wanneer we offline formulieren extraheren.

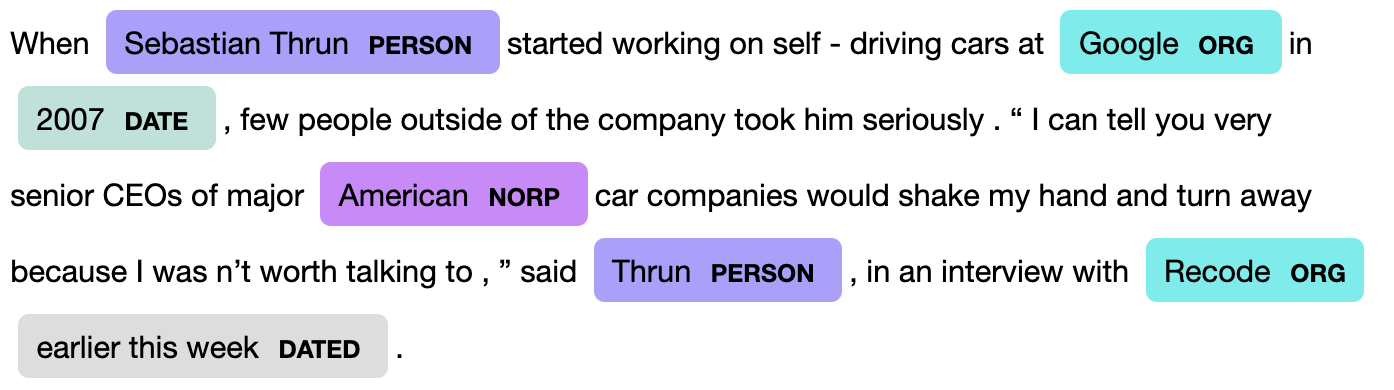

- NER voor extractie van formuliergegevens: Herkenning van benoemde entiteiten is de taak van het identificeren en classificeren van vooraf gedefinieerde entiteiten in tekst in natuurlijke taal. Het wordt vaak gebruikt om informatie uit formulieren te halen, waar mensen namen, adressen, opmerkingen, enz. typen. De taak van het herkennen van genoemde entiteiten hangt nauw samen met de bredere taak van coreference-resolutie, die bepaalt of vermeldingen van dezelfde entiteiten verwijzen naar de dezelfde real-world entiteiten. Tegenwoordig kunnen we met geavanceerde programmeertools en frameworks gebruikmaken van vooraf getrainde modellen om op NER gebaseerde modellen te bouwen voor informatie-extractietaken.

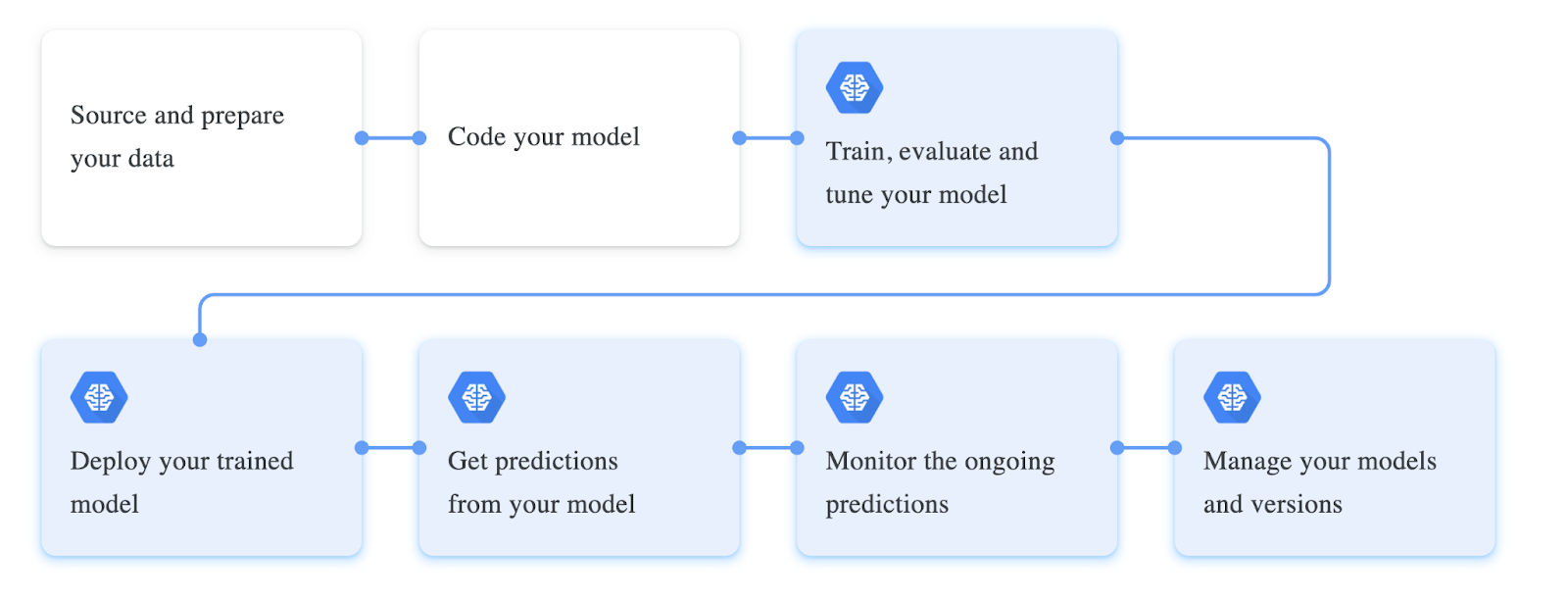

- Deep Learning gebruiken voor het extraheren van formuliergegevens: Deep learning is niet nieuw, het bestaat al tientallen jaren, maar recente ontwikkelingen in deep learning-architecturen en rekenkracht hebben tot baanbrekende resultaten geleid. Formuliergegevensextractie met behulp van deep learning bereikte state-of-the-art prestaties in bijna elk formaat, of het nu digitaal of handgeschreven is. Het proces begint door het diepe neurale netwerk (DNN) duizenden of miljoenen verschillende voorbeelden te geven die zijn gelabeld met wat ze zijn. Bijvoorbeeld labels in afbeeldingsvorm met zijn entiteiten zoals naam, e-mail, id, enz. De DNN verwerkt al deze informatie en leert zelf hoe deze stukjes met elkaar verbonden zijn. Het bouwen van een zeer nauwkeurig model vereist echter veel expertise en experimenten.

Wilt u gegevens uit gedrukte of handgeschreven formulieren halen? Bekijk Nanonetten™ formulier data extractor gratis & automatiseer de export van informatie vanuit elke vorm!

Formuliergegevensextractie met OCR's

Er zijn veel verschillende bibliotheken beschikbaar voor het extraheren van gegevens uit formulieren. Maar wat als u gegevens wilt extraheren uit een afbeelding van een formulier? Dit is waar Tesseract OCR (Optical Character Recognition) om de hoek komt kijken. Tesseract is een open-source OCR (Optical Character Recognition) engine ontwikkeld door HP. Met Tesseract OCR is het mogelijk om gescande documenten, zoals papieren facturen, bonnen en cheques, om te zetten in doorzoekbare, bewerkbare digitale bestanden. Het is beschikbaar in verschillende talen en kan karakters in verschillende afbeeldingsformaten herkennen. Tesseract wordt meestal gebruikt in combinatie met andere bibliotheken om afbeeldingen te verwerken om tekst te extraheren.

Om dit uit te testen, moet u ervoor zorgen dat u Tesseract op uw lokale computer installeert. U kunt Tesseract CLI- of Python-bindingen gebruiken om de OCR uit te voeren. Python-tesseract is een wrapper voor Google's Tesseract-OCR Engine. Het kan worden gebruikt om alle afbeeldingstypen te lezen die worden ondersteund door de Pillow en Leptonica-beeldvormingsbibliotheken, inclusief jpeg, png, gif, bmp, tiff en andere. U kunt het gemakkelijk gebruiken als een op zichzelf staand aanroepscript om indien nodig te tesseracteren.

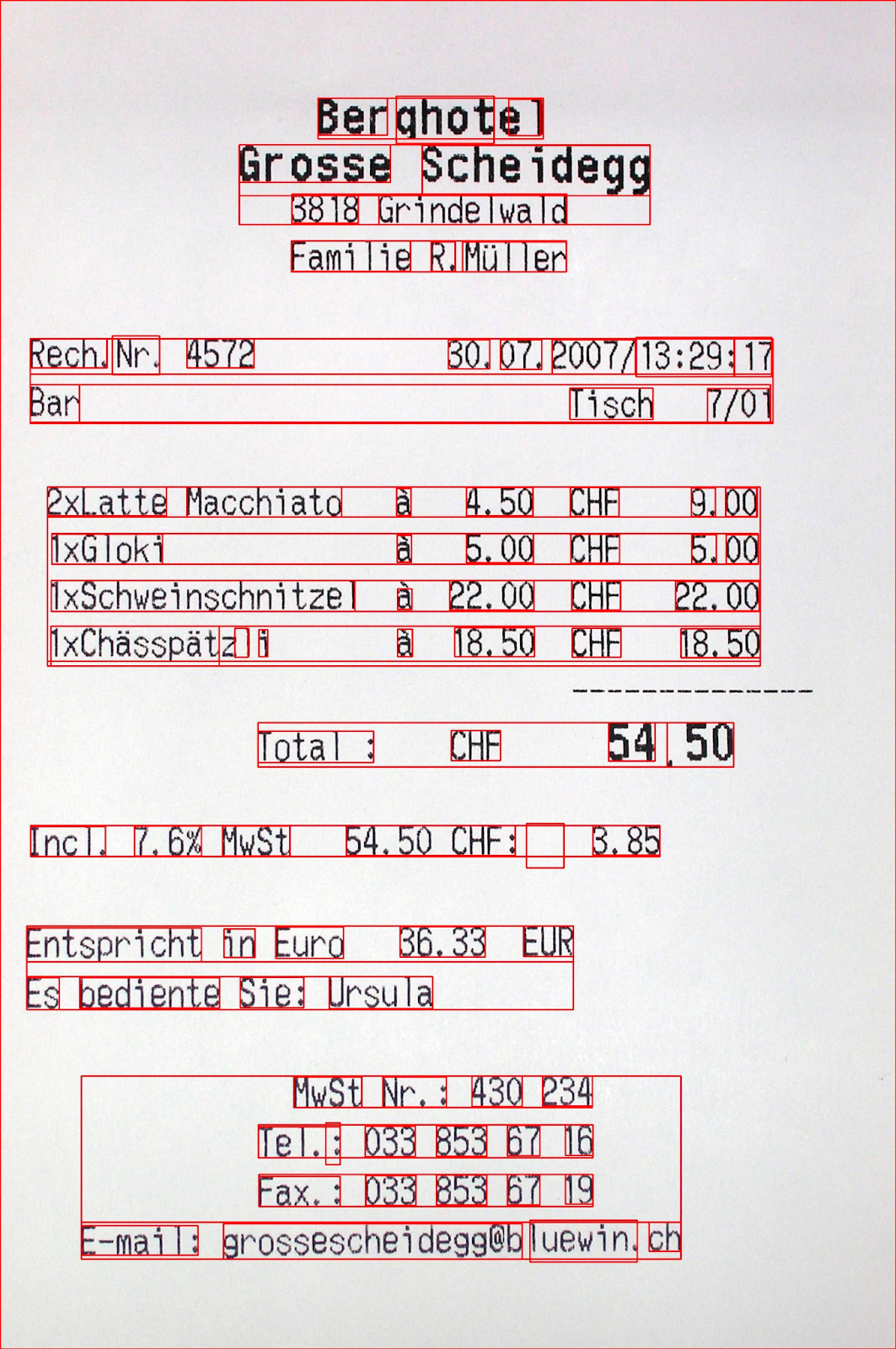

Laten we nu een ontvangstbewijs met formuliergegevens nemen en proberen de locatie van de tekst te identificeren met behulp van Computer Vision en Tesseract.

import pytesseract

from pytesseract import Output

import cv2 img = cv2.imread('receipt.jpg')

d = pytesseract.image_to_data(img, output_type=Output.DICT)

n_boxes = len(d['level'])

for i in range(n_boxes): (x, y, w, h) = (d['left'][i], d['top'][i], d['width'][i], d['height'][i]) img = cv2.rectangle(img, (x, y), (x + w, y + h), (0, 0, 255), 2) cv2.imshow(img,'img')

Hier, in de uitvoer, was het programma, zoals we kunnen zien, in staat om alle tekst in het formulier te identificeren. Laten we nu OCR hierop toepassen om alle informatie te extraheren. We kunnen dit eenvoudig doen door de afbeelding_naar_tekenreeks functie in Python.

extracted_text = pytesseract.image_to_string(img, lang = 'deu')

Output:

Berghotel

Grosse Scheidegg

3818 Grindelwald

Familie R.Müller Rech.Nr. 4572 30.07.2007/13:29: 17

Bar Tisch 7/01

2xLatte Macchiato &ä 4.50 CHF 9,00

1xGloki a 5.00 CH 5.00

1xSchweinschnitzel ä 22.00 CHF 22.00

IxChässpätz 1 a 18.50 CHF 18.50 Total: CHF 54.50 Incl. 7.6% MwSt 54.50 CHF: 3.85 Entspricht in Euro 36.33 EUR

Es bediente Sie: Ursula MwSt Nr. : 430 234

Tel.: 033 853 67 16

Fax.: 033 853 67 19

E-mail: grossescheidegs@b luewin. Ch Hier kunnen we alle informatie uit het formulier halen. In de meeste gevallen zal het gebruik van alleen OCR echter niet helpen, omdat de geëxtraheerde gegevens volledig ongestructureerd zijn. Daarom vertrouwen gebruikers op sleutel-waardepaarextractie op formulieren, die alleen specifieke entiteiten kunnen identificeren, zoals ID, datums, belastingbedrag, enz. Dit is alleen mogelijk met diepgaand leren. Laten we in de volgende sectie bekijken hoe we verschillende deep learning-technieken kunnen gebruiken om algoritmen voor informatie-extractie te bouwen.

Formuliergegevensextractie oplossen met behulp van Deep Learning

Graph Convolution voor multimodale informatie-extractie uit visueel rijke documenten

Grafiek convolutionele netwerken (Graph CNN's) zijn een klasse van diepe convolutionele neurale netwerken (CNN's) die in staat zijn om effectief zeer niet-lineaire functies in grafische datastructuren te leren met behoud van knooppunt- en randstructuur. Ze kunnen grafische datastructuren als invoer nemen en 'feature maps' genereren voor knooppunten en randen. De resulterende functies kunnen worden gebruikt voor grafiekclassificatie, clustering of communitydetectie. GCN's bieden een krachtige oplossing voor het extraheren van informatie uit grote, visueel rijke documenten zoals facturen en ontvangstbewijzen. Om deze te verwerken, moet elke afbeelding worden omgezet in een grafiek die bestaat uit knopen en randen. Elk woord op de afbeelding wordt vertegenwoordigd door zijn eigen knoop; visualisatie van de rest van de gegevens is gecodeerd in de kenmerkvector van het knooppunt.

Dit model codeert eerst elk tekstsegment in het document in grafische inbedding. Hierdoor wordt de visuele en tekstuele context rondom elk tekstelement vastgelegd, samen met de positie of locatie binnen een tekstblok. Vervolgens combineert het deze grafieken met ingesloten tekst om een algemene weergave te krijgen van de structuur van het document en wat erin is geschreven. Het model leert hogere gewichten toe te kennen aan teksten die waarschijnlijk entiteiten zijn op basis van hun locatie ten opzichte van elkaar en de context waarin ze binnen een groter lezersblok verschijnen. Ten slotte past het een standaard BiLSTM-CRF-model toe voor entiteitsextractie. De resultaten laten zien dat dit algoritme ruimschoots beter presteert dan het basismodel (BiLSTM-CRF).

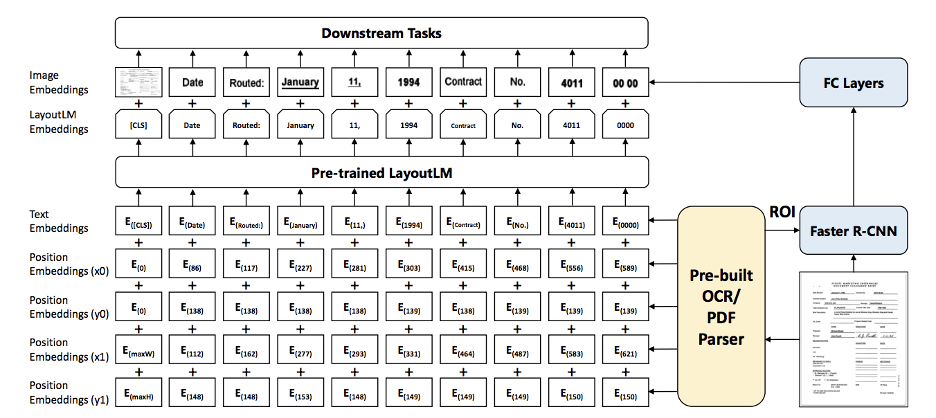

LayoutLM: Pre-training van tekst en lay-out voor het begrijpen van documentafbeeldingen

De architectuur van het LayoutLM-model is sterk geïnspireerd door BERT en bevat beeldinbeddingen van een Faster R-CNN. LayoutLM-invoerinbeddingen worden gegenereerd als een combinatie van tekst- en positie-inbeddingen, en vervolgens gecombineerd met de beeldinbeddingen gegenereerd door het Faster R-CNN-model. Gemaskeerde visuele taalmodellen en documentclassificatie met meerdere labels worden voornamelijk gebruikt als voorbereidende taken voor LayoutLM. Het LayoutLM-model is waardevol, dynamisch en sterk genoeg voor elke taak waarvoor begrip van de lay-out vereist is, zoals extractie van formulieren/bonnen, classificatie van documentafbeeldingen of zelfs het beantwoorden van visuele vragen kan met dit trainingsmodel worden uitgevoerd.

Het LayoutLM-model is getraind op de IIT-CDIP Test Collection 1.0, die meer dan 6 miljoen documenten en meer dan 11 miljoen gescande documentafbeeldingen bevat, in totaal meer dan 12 GB aan gegevens. Dit model presteerde aanzienlijk beter dan verschillende vooraf getrainde SOTA-modellen op het gebied van formulierbegrip, begrip van ontvangstbewijzen en classificatie van gescande documentafbeeldingen.

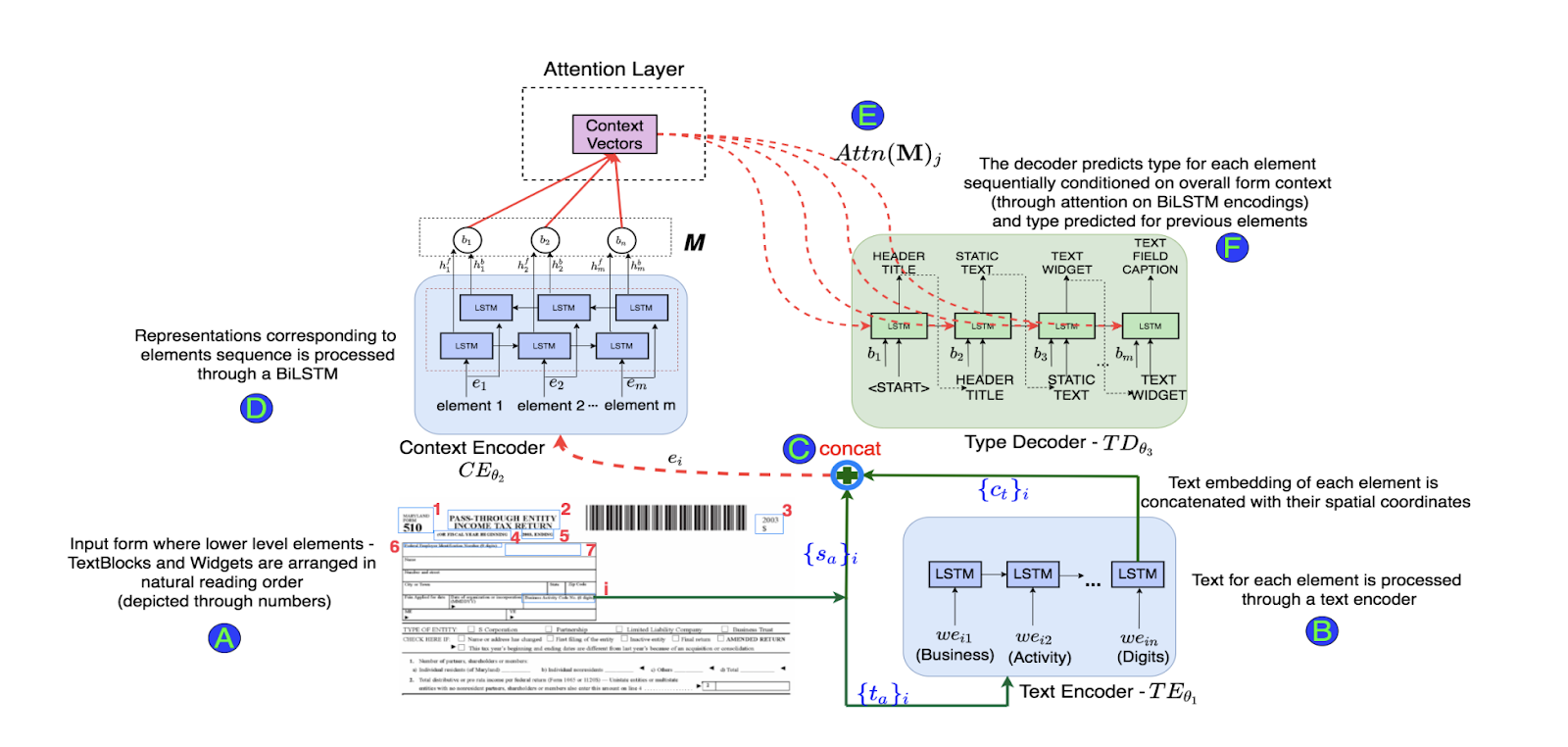

Form2Seq: een raamwerk voor extractie van formulierstructuren van hogere orde

Form2Seq is een raamwerk dat zich richt op het extraheren van structuren uit invoertekst met behulp van positionele reeksen. In tegenstelling tot traditionele seq2seq-frameworks, maakt Form2Seq gebruik van relatieve ruimtelijke posities van de structuren in plaats van hun volgorde.

Bij deze methode classificeren we eerst elementen op laag niveau die een betere verwerking en organisatie mogelijk maken. Er zijn 10 soorten formulieren, zoals veldbijschriften, lijstitems, enzovoort. Vervolgens groeperen we elementen op een lager niveau, zoals tekstvelden en keuzevelden, in constructies van hogere orde die ChoiceGroups worden genoemd. Deze worden gebruikt als mechanismen voor het verzamelen van informatie om een betere gebruikerservaring te bereiken met elementen op een lager niveau in constructies van een hogere orde, zoals tekstvelden, keuzevelden en keuzegroepen, die worden gebruikt als mechanismen voor het verzamelen van informatie in formulieren. Dit is mogelijk door de samenstellende elementen in een lineaire volgorde in natuurlijke leesvolgorde te rangschikken en hun ruimtelijke en tekstuele representaties aan het Seq2Seq-raamwerk te geven. Het Seq2Seq-raamwerk maakt opeenvolgend voorspellingen voor elk element van een zin, afhankelijk van de context. Hierdoor kan het meer informatie verwerken en tot een beter begrip van de taak komen.

Het model behaalde een nauwkeurigheid van 90% op de classificatietaak, wat hoger was dan die van op segmentatie gebaseerde basislijnmodellen. De F1 op tekstblokken, tekstvelden en keuzevelden was respectievelijk 86.01%, 61.63%. Dit raamwerk bereikte de staat van de resultaten op de ICDAR-dataset voor herkenning van tabelstructuren.

Wilt u gegevens uit gedrukte of handgeschreven formulieren halen? Bekijk Nanonetten™ formulier data extractor gratis & automatiseer de export van informatie vanuit elke vorm!

Waarom op AI gebaseerde OCR van Nanonet de beste optie is

Hoewel OCR-software gescande afbeeldingen van tekst kan converteren naar geformatteerde digitale bestanden zoals PDF's, DOC's en PPT's, is dit niet altijd nauwkeurig. De toonaangevende software van vandaag, zoals het op AI gebaseerde OCR deep learning-systeem van Nanonet, heeft veel uitdagingen overwonnen waarmee traditionele OCR-systemen werden geconfronteerd bij het maken van een bewerkbaar bestand van een gescand document. Het is de beste optie geworden voor gegevensextractie omdat het hoge nauwkeurigheidspercentages en hoge tolerantieniveaus kan bieden voor ruis, grafische elementen en opmaakwijzigingen. Laten we nu een paar punten bespreken over hoe op AI gebaseerde OCR de beste optie is.

- OCR, zoals besproken, is een eenvoudige techniek om gegevens te extraheren. Ze zullen echter niet consistent werken wanneer ze op ongeziene/nieuwe gegevens worden geplaatst. Op AI gebaseerde OCR kan dergelijke situaties echter aan, omdat ze trainen op een breed scala aan gegevens.

- Normale OCR's kunnen geen complexe lay-outs aan voor extracties van formuliergegevens. Daarom geven ze, wanneer ze worden aangedreven door deep learning of AI, de beste resultaten door de lay-outs, tekst en context van de gegevens te begrijpen.

- OCR's presteren mogelijk ondermaats als er ruis in gegevens is, zoals scheefheid, gescande afbeeldingen bij weinig licht, enz., terwijl deep learning-modellen dergelijke omstandigheden aankunnen en toch zeer nauwkeurige resultaten opleveren.

- Op AI gebaseerde OCR's zijn in hoge mate aanpasbaar en flexibel in vergelijking met traditionele OCR's; ze kunnen op verschillende soorten gegevens worden gebouwd om ongestructureerde gegevens in elk gestructureerd formaat om te zetten.

- De output van nabewerking van op AI gebaseerde OCR is toegankelijk in vergelijking met gewone OCR; ze kunnen rechtstreeks vanuit het model worden geëxporteerd naar alle gegevensindelingen zoals JSON, CSV, Excel Spreadsheets of zelfs een database zoals Postgres.

- AI-gebaseerde OCR kan worden geëxporteerd als een eenvoudige API met behulp van vooraf getrainde modellen. Dit is nog steeds mogelijk in andere traditionele methoden, maar het kan moeilijk zijn om de modellen consistent en tijdig te verbeteren. Op AI-gebaseerde OCR kan het automatisch worden afgesteld door fouten.

- Tabelextractie is hoogst onmogelijk met rechte OCR. Het kan echter gemakkelijk worden gedaan met de kracht van AI/DL. Tegenwoordig kunnen op AI gebaseerde OCR's op een positieve manier tabelgebaseerde formulieren in documenten verwijzen en informatie extraheren.

- Als er financiële of vertrouwelijke gegevens in documenten staan, kunnen AI-modellen ook fraudecontroles uitvoeren. Het zoekt in feite naar bewerkte/wazige tekst van de gescande documenten en stelt de beheerders op de hoogte. Via deze modellen kunnen ook dubbele documenten of informatie worden geïdentificeerd. Terwijl OCR in dergelijke gevallen gewoon faalt.

- &

- 67

- 7

- 9

- Account

- accuraat

- bereikt

- over

- Extra

- adres

- vergevorderd

- AI

- algoritme

- algoritmen

- Alles

- Hoewel

- bedragen

- hoeveelheden

- Nog een

- api

- APIs

- Aanvraag

- Het toepassen van

- nadering

- architectuur

- rond

- geautomatiseerde

- Beschikbaar

- achtergrond

- Baseline

- Eigenlijk

- basis

- worden

- wezen

- BEST

- Grootste

- Blok

- Blog

- grens

- bouw

- Gebouw

- ondernemingen

- Inhoud

- bijschriften

- verzorging

- gevallen

- Veroorzaken

- uitdagen

- uitdagingen

- Controles

- classificatie

- verzamelen

- Het verzamelen van

- Collectie

- combinatie van

- gecombineerde

- opmerkingen

- Gemeen

- gemeenschap

- vergeleken

- complex

- computergebruik

- computer kracht

- content

- inhoud

- Kosten

- kon

- creëert

- Wij creëren

- cruciaal

- Klanten

- gegevens

- gegevensbeveiliging

- Database

- Data

- ontwerpen

- Opsporing

- ontwikkelen

- ontwikkelde

- ontwikkelaars

- ontwikkelingen

- anders

- digitaal

- Afmeting

- bespreken

- documenten

- dynamisch

- gemakkelijk

- rand

- effectief

- doeltreffend

- essentieel

- Euro

- voorbeeld

- Excel

- ervaring

- expertise

- extracten

- geconfronteerd

- sneller

- Kenmerk

- Voordelen

- Velden

- filters

- Tot slot

- financieel

- Voornaam*

- Bepalen

- stroom

- formulier

- formaat

- formulieren

- gevonden

- Achtergrond

- bedrog

- Gratis

- functie

- Fundamentals

- voortbrengen

- doel

- Groep

- hulp

- nuttig

- Hoge

- zeer

- Hoe

- How To

- HTTPS

- idee

- Identificatie

- identificeren

- beeld

- Impact

- belangrijk

- onmogelijk

- verbeteren

- Anders

- omvatten

- Inclusief

- informatie

- geinspireerd

- integraties

- problemen

- IT

- Jobomschrijving:

- bekend

- labels

- taal

- Talen

- Groot

- groter

- leiden

- leren

- LED

- Hefboomwerking

- hefbomen

- Lijst

- lijsten

- lokaal

- plaats

- locaties

- machine

- groot

- handboek

- handmatig

- kaart

- vermeldt

- miljoen

- miljoenen

- model

- modellen

- meest

- namen

- Naturel

- netwerk

- netwerken

- knooppunten

- Geluid

- Opmerkingen

- nummers

- online.

- Operations

- Keuze

- Opties

- bestellen

- organisatie

- organisaties

- Overige

- anders-

- Papier

- deelnemers

- Mensen

- prestatie

- persoonlijk

- Populair

- mogelijk

- energie

- krachtige

- Voorspellingen

- presenteren

- primair

- probleem

- processen

- Profiel

- Programma

- Programming

- Programma's

- Projectie

- zorgen voor

- vraag

- reeks

- Tarieven

- RE

- lezers

- lezing

- redenen

- erkent

- verminderen

- Rapporten

- vereisen

- REST

- Resultaten

- Risico

- lopend

- verkoop

- aftasten

- het scannen

- beveiligen

- veiligheid

- segmentatie

- gekozen

- vormen

- Bermuda's

- Eenvoudig

- So

- Software

- Oplossingen

- gestart

- Land

- state-of-the-art

- statistiek

- shop

- stream

- sterke

- ondersteunde

- system

- Systems

- taken

- belasting

- technieken

- proef

- van derden

- duizenden kosten

- Door

- niet de tijd of

- tijdrovend

- vandaag

- samen

- tolerantie

- tools

- traditioneel

- Trainingen

- Transformatie

- begrijpen

- .

- gebruikers

- doorgaans

- visie

- visualisatie

- W

- web

- Wat

- Wat is

- of

- binnen

- zonder

- woorden

- Mijn werk

- werkzaam

- Bedrijven

- het schrijven van

- X