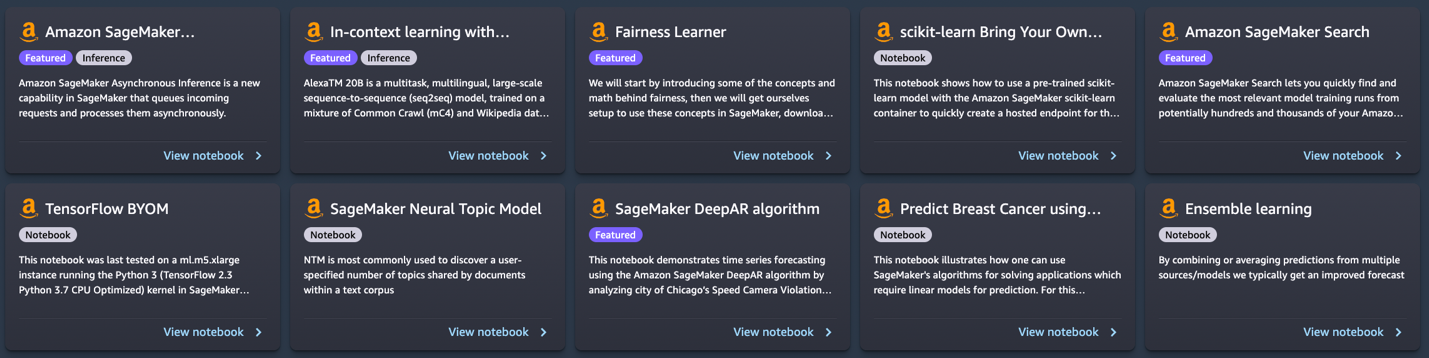

Amazon SageMaker JumpStart is de Machine Learning (ML) hub van SageMaker die vooraf getrainde, openbaar beschikbare modellen biedt voor een breed scala aan probleemtypes om u te helpen aan de slag te gaan met machine learning.

JumpStart biedt ook voorbeelden van notebooks die gebruik maken van Amazon Sage Maker functies zoals training van lokale instanties en experimenten met een grote verscheidenheid aan modeltypen en use-cases. Deze voorbeeldnotitieblokken bevatten code die laat zien hoe ML-oplossingen kunnen worden toegepast met behulp van SageMaker en JumpStart. Ze kunnen worden aangepast aan uw eigen behoeften en kunnen zo de ontwikkeling van applicaties versnellen.

Onlangs hebben we 10 nieuwe notebooks toegevoegd aan JumpStart in Amazon SageMaker Studio. Dit bericht richt zich op deze nieuwe notebooks. Op het moment van schrijven biedt JumpStart 56 notebooks, variërend van het gebruik van geavanceerde natuurlijke taalverwerkingsmodellen (NLP) tot het corrigeren van vertekening in datasets bij het trainen van modellen.

De 10 nieuwe notitieboekjes kunnen je op de volgende manieren helpen:

- Ze bieden voorbeeldcode die u kunt uitvoeren zoals deze is vanuit de JumpStart-gebruikersinterface in Studio en zien hoe de code werkt

- Ze tonen het gebruik van verschillende SageMaker- en JumpStart-API's

- Ze bieden een technische oplossing die u verder kunt aanpassen op basis van uw eigen behoeften

Het aantal notebooks dat via JumpStart wordt aangeboden, neemt regelmatig toe naarmate er meer notebooks worden toegevoegd. Deze notitieboekjes zijn ook verkrijgbaar op GitHub.

Notitieboekjes overzicht

De 10 nieuwe notebooks zijn als volgt:

- In-context leren met AlexaTM 20B – Demonstreert hoe AlexaTM 20B te gebruiken voor in-context leren met zero-shot en few-shot leren op vijf voorbeeldtaken: tekstsamenvatting, natuurlijke taalgeneratie, automatische vertaling, extractieve vraagbeantwoording en natuurlijke taalinferentie en classificatie.

- Eerlijkheid lineaire leerling in SageMaker - Er zijn recentelijk zorgen geuit over vertekening in ML-algoritmen als gevolg van het nabootsen van bestaande menselijke vooroordelen. Dit notitieboek past rechtvaardigheidsconcepten toe om modelvoorspellingen op de juiste manier aan te passen.

- Beheer ML-experimenten met behulp van SageMaker Search - Met Amazon SageMaker Search kunt u snel de meest relevante modeltrainingen vinden en evalueren van potentieel honderden en duizenden SageMaker-modeltrainingstaken.

- SageMaker neuraal onderwerpmodel - SageMaker Neural Topic Model (NTM) is een leeralgoritme zonder toezicht dat probeert een reeks waarnemingen te beschrijven als een mix van verschillende categorieën.

- Voorspel overtredingen van de rijsnelheid – Het SageMaker DeepAR-algoritme kan worden gebruikt om een model voor meerdere straten tegelijk te trainen en overtredingen voor meerdere straatcamera's te voorspellen.

- Borstkanker voorspelling – Dit notitieboek gebruikt UCI's diagnostische dataset voor borstkanker om een voorspellend model te bouwen dat aangeeft of een beeld van een borstmassa een goedaardige of kwaadaardige tumor aangeeft.

- Verzamel voorspellingen van meerdere modellen - Door voorspellingen van meerdere bronnen en modellen te combineren of te middelen, krijgen we meestal een verbeterde prognose. Dit notitieboekje illustreert dit concept.

- SageMaker asynchrone gevolgtrekking - Asynchrone inferentie is een nieuwe inferentieoptie voor near-real-time inferentiebehoeften. Het kan tot 15 minuten duren voordat aanvragen zijn verwerkt en de payload kan oplopen tot 1 GB.

- TensorFlow neem je eigen model mee – Leer hoe u een TensorFlow-model lokaal traint en implementeert op SageMaker met behulp van deze notebook.

- Scikit-leer breng je eigen model mee – Deze notebook laat zien hoe u een vooraf getraind Scikit-learn-model kunt gebruiken met de SageMaker Scikit-learn-container om snel een gehost eindpunt voor dat model te maken.

Voorwaarden

Om deze notebooks te gebruiken, moet u ervoor zorgen dat u toegang hebt tot Studio met een uitvoeringsrol waarmee u SageMaker-functionaliteit kunt uitvoeren. De korte video hieronder helpt u bij het navigeren naar JumpStart-notebooks.

In de volgende secties nemen we elk van de 10 nieuwe oplossingen door en bespreken we enkele van hun interessante details.

In-context leren met AlexaTM 20B

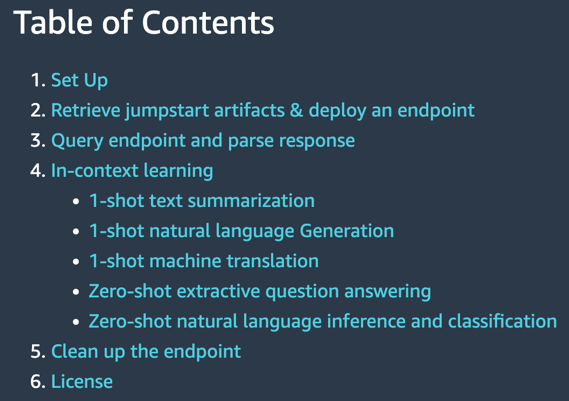

AlexaTM 20B is een multitask, meertalig, grootschalig sequence-to-sequence (seq2seq) model, getraind op een mix van Common Crawl (mC4) en Wikipedia data in 12 talen, met behulp van denoising en Causal Language Modeling (CLM) taken. Het bereikt state-of-the-art prestaties bij algemene in-context taaltaken, zoals one-shot samenvatting en one-shot machinevertaling, en presteert beter dan decoder-only modellen zoals Open AI's GPT3 en Google's PaLM, die meer dan acht keer groter zijn.

In-context leren, ook wel bekend als gevraagd, verwijst naar een methode waarbij u een NLP-model gebruikt voor een nieuwe taak zonder het te hoeven verfijnen. Een paar taakvoorbeelden worden alleen aan het model gegeven als onderdeel van de inferentie-invoer, een paradigma dat bekend staat als weinig-shot in-context leren. In sommige gevallen kan het model goed presteren zonder trainingsgegevens, alleen als er wordt uitgelegd wat er moet worden voorspeld. Dit heet zero-shot in-context leren.

Deze notebook demonstreert hoe u AlexaTM 20B implementeert via de JumpStart API en inferentie uitvoert. Het laat ook zien hoe AlexaTM 20B kan worden gebruikt voor in-context leren met vijf voorbeeldtaken: tekstsamenvatting, natuurlijke taalgeneratie, automatische vertaling, extractieve vraagbeantwoording en natuurlijke taalinferentie en classificatie.

|

|

De notebook laat het volgende zien:

- Eenmalige tekstsamenvatting, natuurlijke taalgeneratie en automatische vertaling met behulp van een enkel trainingsvoorbeeld voor elk van deze taken

- Zero-shot vraagbeantwoording en natuurlijke taalinferentie plus classificatie met behulp van het model zoals het is, zonder dat er trainingsvoorbeelden nodig zijn.

Probeer uw eigen tekst tegen dit model uit te voeren en kijk hoe het tekst samenvat, Q&A extraheert of van de ene taal naar de andere vertaalt.

Eerlijkheid lineaire leerling in SageMaker

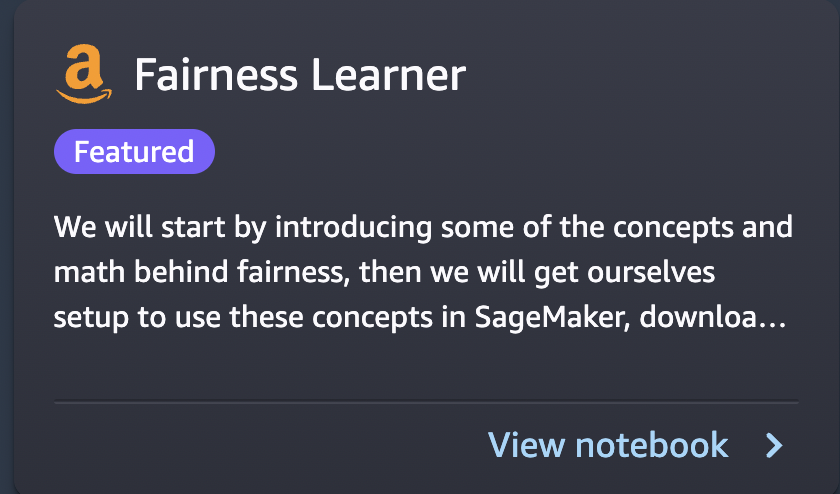

Er zijn recentelijk zorgen geuit over vertekening in ML-algoritmen als gevolg van het nabootsen van bestaande menselijke vooroordelen. Tegenwoordig hebben verschillende ML-methoden sterke sociale implicaties, ze worden bijvoorbeeld gebruikt om bankleningen, verzekeringstarieven of advertenties te voorspellen. Helaas zal een algoritme dat leert van historische gegevens natuurlijk vooroordelen uit het verleden overnemen. Dit notitieboek laat zien hoe dit probleem kan worden opgelost door SageMaker en eerlijke algoritmen te gebruiken in de context van lineaire leerlingen.

Het begint met het introduceren van enkele van de concepten en wiskunde achter rechtvaardigheid, vervolgens downloadt het gegevens, traint een model en past ten slotte rechtvaardigheidsconcepten toe om modelvoorspellingen op de juiste manier aan te passen.

|

|

De notebook laat het volgende zien:

- Uitvoeren van een standaard lineair model op UCI's volwassen dataset.

- Oneerlijkheid tonen in modelvoorspellingen

- Gegevens corrigeren om vooroordelen weg te nemen

- Het model opnieuw trainen

Probeer uw eigen gegevens uit te voeren met behulp van deze voorbeeldcode en detecteer of er sprake is van vooringenomenheid. Probeer daarna eventuele vooringenomenheid in uw dataset te verwijderen met behulp van de geboden functies in dit voorbeeldnotitieboekje.

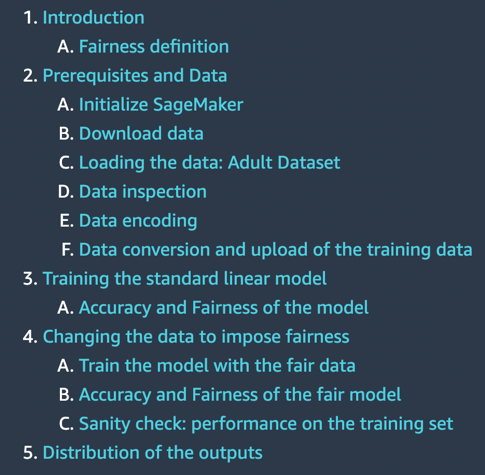

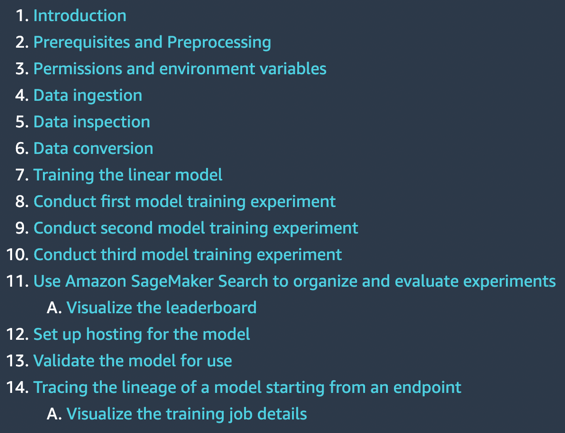

Beheer ML-experimenten met behulp van SageMaker Search

Met SageMaker Search kunt u snel de meest relevante modeltrainingen vinden en evalueren van potentieel honderden en duizenden SageMaker-modeltrainingstaken. Het ontwikkelen van een ML-model vereist continu experimenteren, het uitproberen van nieuwe leeralgoritmen en het afstemmen van hyperparameters, terwijl de impact van dergelijke wijzigingen op de prestaties en nauwkeurigheid van het model wordt geobserveerd. Deze iteratieve oefening leidt vaak tot een explosie van honderden modeltrainingsexperimenten en modelversies, waardoor de convergentie en ontdekking van een winnend model wordt vertraagd. Bovendien maakt de informatie-explosie het in de loop van de tijd erg moeilijk om de afstamming van een modelversie te traceren - de unieke combinatie van datasets, algoritmen en parameters die dat model in de eerste plaats hebben gemaakt.

Dit notitieboekje laat zien hoe u SageMaker Search kunt gebruiken om uw modeltrainingstaken op SageMaker snel en eenvoudig te organiseren, volgen en evalueren. U kunt zoeken op alle bepalende attributen van het gebruikte leeralgoritme, hyperparameterinstellingen, gebruikte trainingsdatasets en zelfs de tags die u hebt toegevoegd aan de modeltrainingstaken. U kunt uw trainingsruns ook snel vergelijken en rangschikken op basis van hun prestatiestatistieken, zoals trainingsverlies en validatienauwkeurigheid, en zo leaderboards creëren voor het identificeren van de winnende modellen die kunnen worden ingezet in productieomgevingen. SageMaker Search kan snel de volledige afstamming traceren van een modelversie die in een live omgeving is geïmplementeerd, tot aan de datasets die worden gebruikt bij het trainen en valideren van het model.

|

|

De notebook laat het volgende zien:

- Drie keer een lineair model trainen

- SageMaker Search gebruiken om deze experimenten te organiseren en te evalueren

- De resultaten visualiseren in een leaderboard

- Een model implementeren op een eindpunt

- Afstamming van het model volgen vanaf het eindpunt

Bij uw eigen ontwikkeling van voorspellende modellen voert u mogelijk verschillende experimenten uit. Probeer SageMaker Search te gebruiken in dergelijke experimenten en ervaar hoe het u op meerdere manieren kan helpen.

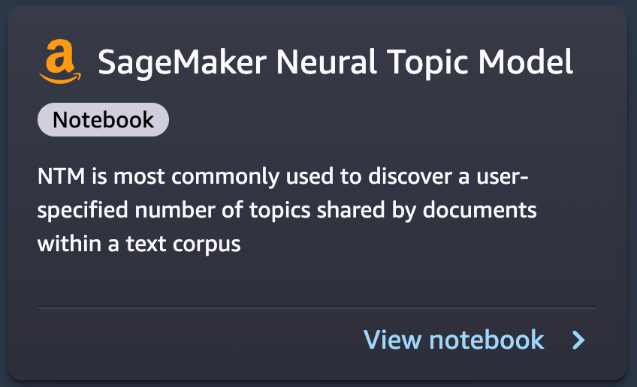

SageMaker neuraal onderwerpmodel

SageMaker Neural Topic Model (NTM) is een leeralgoritme zonder toezicht dat probeert een reeks waarnemingen te beschrijven als een mix van verschillende categorieën. NTM wordt meestal gebruikt om een door de gebruiker opgegeven aantal onderwerpen te ontdekken dat wordt gedeeld door documenten binnen een tekstcorpus. Hier is elke observatie een document, de kenmerken zijn de aanwezigheid (of het aantal keren dat het voorkomt) van elk woord en de categorieën zijn de onderwerpen. Omdat de methode zonder toezicht is, worden de onderwerpen niet vooraf gespecificeerd en is het niet gegarandeerd dat ze overeenkomen met hoe een mens documenten van nature kan categoriseren. De onderwerpen worden geleerd als kansverdeling over de woorden die in elk document voorkomen. Elk document wordt op zijn beurt beschreven als een mix van onderwerpen.

Deze notebook gebruikt het SageMaker NTM-algoritme om een model te trainen op de 20NewsGroups-dataset. Deze dataset wordt veel gebruikt als benchmark voor onderwerpmodellering.

|

|

De notebook laat het volgende zien:

- Een SageMaker-trainingstaak maken op een dataset om een NTM-model te produceren

- Het model gebruiken om gevolgtrekkingen uit te voeren met een SageMaker-eindpunt

- Het getrainde model verkennen en geleerde onderwerpen visualiseren

U kunt dit notitieboek eenvoudig aanpassen aan uw tekstdocumenten en deze opdelen in verschillende onderwerpen.

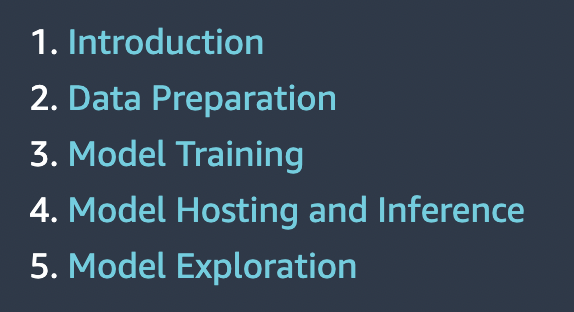

Voorspel snelheidsovertredingen

Dit notebook demonstreert tijdreeksvoorspellingen met behulp van het SageMaker DeepAR-algoritme door de dataset Flitsersovertredingen van de stad Chicago te analyseren. De dataset wordt gehost door Data.gov en wordt beheerd door de Amerikaanse General Services Administration, Technology Transformation Service.

Deze overtredingen worden vastgelegd door camerasystemen en zijn beschikbaar om het leven van het publiek te verbeteren via het dataportaal van de stad Chicago. De dataset Overtreding flitsers kan worden gebruikt om patronen in de gegevens te onderscheiden en zinvolle inzichten te verkrijgen.

De dataset bevat meerdere cameralocaties en dagelijkse overtredingen. Elke dagelijkse overtredingstelling voor een camera kan worden beschouwd als een afzonderlijke tijdreeks. U kunt het SageMaker DeepAR-algoritme gebruiken om een model voor meerdere straten tegelijk te trainen en overtredingen voor meerdere straatcamera's te voorspellen.

|

|

De notebook laat het volgende zien:

- Het SageMaker DeepAR-algoritme trainen op de tijdreeksgegevensset met behulp van spotinstanties

- Gevolgtrekkingen maken op het getrainde model om voorspellingen te doen over verkeersovertredingen

Met dit notitieboek kunt u leren hoe tijdreeksproblemen kunnen worden opgelost met behulp van het DeepAR-algoritme in SageMaker en kunt u het toepassen op uw eigen tijdreeksgegevenssets.

Voorspelling van borstkanker

Dit notitieboekje neemt een voorbeeld voor de voorspelling van borstkanker met behulp van UCI's diagnostische dataset voor borstkanker. Het gebruikt deze dataset om een voorspellend model te bouwen van de vraag of een beeld van de borstmassa een goedaardige of kwaadaardige tumor aangeeft.

|

|

De notebook laat het volgende zien:

- Basisinstellingen voor het gebruik van SageMaker

- Datasets converteren naar Protobuf-indeling die wordt gebruikt door de SageMaker-algoritmen en uploaden naar Amazon eenvoudige opslagservice (Amazone S3)

- Een lineair leerlingmodel van SageMaker trainen op de dataset

- Het getrainde model hosten

- Scoren met behulp van het getrainde model

U kunt dit notitieboek doornemen om te leren hoe u een zakelijk probleem oplost met SageMaker en om de stappen te begrijpen die nodig zijn voor het trainen en hosten van een model.

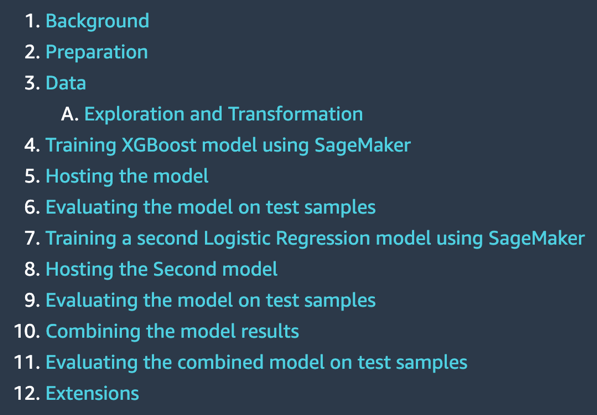

Verzamel voorspellingen van meerdere modellen

In praktische toepassingen van ML op voorspellende taken is één model vaak niet voldoende. Bij de meeste voorspellingswedstrijden moeten prognoses van meerdere bronnen worden gecombineerd om een betere voorspelling te krijgen. Door voorspellingen van meerdere bronnen of modellen te combineren of te middelen, krijgen we meestal een verbeterde prognose. Dit gebeurt omdat er grote onzekerheid bestaat in de keuze van het model en er in veel praktische toepassingen niet één echt model is. Daarom is het voordelig om voorspellingen van verschillende modellen te combineren. In de Bayesiaanse literatuur wordt dit idee aangeduid als Bayesiaanse modelmiddeling, en het is aangetoond dat het veel beter werkt dan slechts één model kiezen.

Dit notitieboekje geeft een illustratief voorbeeld om te voorspellen of een persoon meer dan $ 50,000 per jaar verdient op basis van informatie over zijn opleiding, werkervaring, geslacht en meer.

|

|

De notebook laat het volgende zien:

- Uw SageMaker-notebook voorbereiden

- Een dataset laden van Amazon S3 met behulp van SageMaker

- Onderzoeken en transformeren van de gegevens zodat deze kunnen worden ingevoerd in SageMaker-algoritmen

- Een model schatten met behulp van het SageMaker XGBoost-algoritme (Extreme Gradient Boosting).

- Hosting van het model op SageMaker om doorlopende voorspellingen te doen

- Schatting van een tweede model met behulp van de SageMaker lineaire leermethode

- De voorspellingen van beide modellen combineren en de gecombineerde voorspelling evalueren

- Het genereren van definitieve voorspellingen op de testdataset

Probeer dit notitieblok uit te voeren op uw dataset en meerdere algoritmen te gebruiken. Probeer te experimenteren met verschillende combinaties van modellen aangeboden door SageMaker en JumpStart en kijk welke combinatie van modelcombinaties de beste resultaten geeft op uw eigen gegevens.

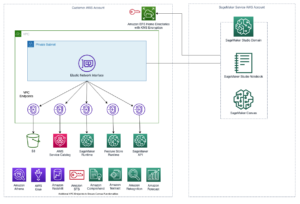

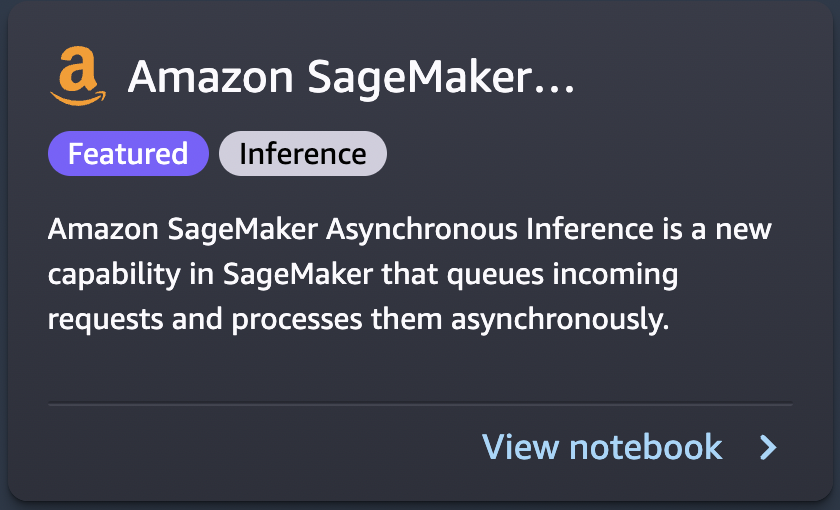

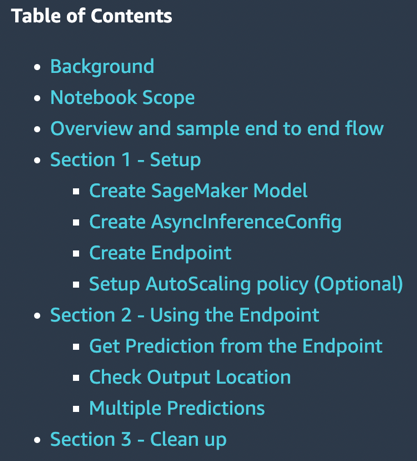

SageMaker asynchrone gevolgtrekking

SageMaker asynchrone inferentie is een nieuwe mogelijkheid in SageMaker die inkomende verzoeken in een wachtrij plaatst en asynchroon verwerkt. SageMaker biedt momenteel twee inferentie-opties voor klanten om ML-modellen te implementeren: een real-time optie voor werklasten met een lage latentie en batchtransformatie, een offline optie om inferentieverzoeken te verwerken op vooraf beschikbare databatches. Realtime inferentie is geschikt voor workloads met een payload van minder dan 6 MB en waarbij deductieverzoeken binnen 60 seconden moeten worden verwerkt. Batchtransformatie is geschikt voor offline gevolgtrekkingen op batches gegevens.

Asynchrone inferentie is een nieuwe inferentieoptie voor near-real-time inferentiebehoeften. Het kan tot 15 minuten duren voordat aanvragen zijn verwerkt en de payload kan oplopen tot 1 GB. Asynchrone gevolgtrekking is geschikt voor workloads die geen latentievereisten van minder dan een seconde hebben en die versoepelde latentievereisten hebben. U moet bijvoorbeeld binnen 5 minuten een gevolgtrekking op een grote afbeelding van meerdere MB's verwerken. Bovendien kunt u met asynchrone inferentie-eindpunten de kosten beheersen door het aantal eindpuntinstanties terug te brengen tot nul wanneer ze inactief zijn, zodat u alleen betaalt wanneer uw eindpunten verzoeken verwerken.

|

|

De notebook laat het volgende zien:

- Een SageMaker-model maken

- Een eindpunt maken met behulp van dit model en asynchrone inferentieconfiguratie

- Voorspellingen doen tegen dit asynchrone eindpunt

Dit notitieboek toont u een werkend voorbeeld van het samenstellen van een asynchroon eindpunt voor een SageMaker-model.

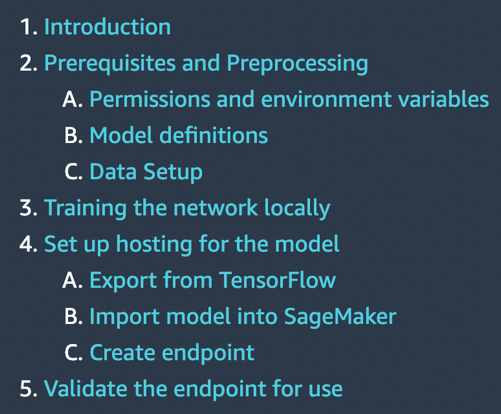

TensorFlow neem je eigen model mee

Een TensorFlow-model wordt lokaal getraind op een classificatietaak waarop deze notebook wordt uitgevoerd. Vervolgens wordt het geïmplementeerd op een SageMaker-eindpunt.

|

|

De notebook laat het volgende zien:

- Lokaal een TensorFlow-model trainen op de IRIS-dataset

- Dat model importeren in SageMaker

- Hosting op een eindpunt

Als u TensorFlow-modellen hebt die u zelf hebt ontwikkeld, kan dit voorbeeldlaptop u helpen uw model te hosten op een door SageMaker beheerd eindpunt.

Scikit-leer breng je eigen model mee

SageMaker bevat functionaliteit ter ondersteuning van een gehoste notebookomgeving, gedistribueerde, serverloze training en real-time hosting. Het werkt het beste als deze drie services samen worden gebruikt, maar ze kunnen ook afzonderlijk worden gebruikt. Sommige use-cases vereisen mogelijk alleen hosting. Misschien is het model getraind voordat SageMaker bestond, in een andere service.

De notebook laat het volgende zien:

- Een vooraf getraind Scikit-learn-model gebruiken met de SageMaker Scikit-learn-container om snel een gehost eindpunt voor dat model te maken

Als u Scikit-learn-modellen hebt die u zelf hebt ontwikkeld, kan dit voorbeeldnotitieblok u helpen uw model te hosten op een door SageMaker beheerd eindpunt.

Ruim middelen op

Nadat u klaar bent met het uitvoeren van een notebook in JumpStart, moet u dit doen Alle bronnen verwijderen zodat alle bronnen die u tijdens het proces hebt gemaakt, worden verwijderd en uw facturering wordt stopgezet. De laatste cel in deze notebooks verwijdert meestal eindpunten die zijn gemaakt.

Samengevat

Dit bericht leidde je door 10 nieuwe voorbeeldnotitieboekjes die onlangs aan JumpStart zijn toegevoegd. Hoewel deze post gericht was op deze 10 nieuwe notebooks, zijn er op het moment van schrijven in totaal 56 beschikbare notebooks. We moedigen u aan om in te loggen bij Studio en zelf de JumpStart-notebooks te verkennen en er onmiddellijk waarde uit te halen. Voor meer informatie, zie Amazon SageMaker Studio en SageMaker JumpStart.

Over de auteur

Dr Raju Penmatcha is een AI/ML Specialist Solutions Architect in AI Platforms bij AWS. Hij promoveerde aan de Stanford University. Hij werkt nauw samen aan de low/no-code suite-services in SageMaker waarmee klanten eenvoudig machine learning-modellen en -oplossingen kunnen bouwen en implementeren.

Dr Raju Penmatcha is een AI/ML Specialist Solutions Architect in AI Platforms bij AWS. Hij promoveerde aan de Stanford University. Hij werkt nauw samen aan de low/no-code suite-services in SageMaker waarmee klanten eenvoudig machine learning-modellen en -oplossingen kunnen bouwen en implementeren.

- AI

- ai kunst

- ai kunst generator

- je hebt een robot

- Amazon Sage Maker

- Amazon SageMaker JumpStart

- kunstmatige intelligentie

- certificering van kunstmatige intelligentie

- kunstmatige intelligentie in het bankwezen

- kunstmatige intelligentie robot

- kunstmatige intelligentie robots

- kunstmatige intelligentiesoftware

- AWS-machine learning

- blockchain

- blockchain conferentie ai

- vindingrijk

- conversatie kunstmatige intelligentie

- crypto conferentie ai

- van dall

- diepgaand leren

- google ai

- machine learning

- Plato

- plato ai

- Plato gegevensintelligentie

- Plato-spel

- PlatoData

- platogamen

- schaal ai

- syntaxis

- zephyrnet