Vandaag kondigen we met trots aan dat de Meta Llama 3 foundation-modellen verkrijgbaar zijn via Amazon SageMaker JumpStart om gevolgtrekkingen in te zetten en uit te voeren. De Llama 3-modellen zijn een verzameling vooraf getrainde en verfijnde generatieve tekstmodellen.

In dit bericht bekijken we hoe u Llama 3-modellen kunt ontdekken en implementeren via SageMaker JumpStart.

Wat is Meta Llama 3

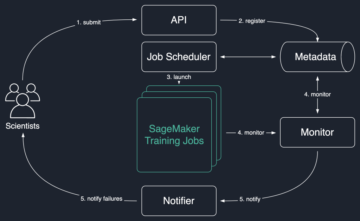

Llama 3 wordt geleverd in twee parametergroottes – 8B en 70B met een contextlengte van 8k – die een breed scala aan gebruiksscenario’s kunnen ondersteunen met verbeteringen in redenering, codegeneratie en het volgen van instructies. Llama 3 maakt gebruik van een transformatorarchitectuur die alleen voor een decoder werkt en een nieuwe tokenizer die verbeterde modelprestaties biedt met een grootte van 128k. Bovendien verbeterde Meta de post-trainingsprocedures die het aantal valse weigeringen aanzienlijk verminderden, de afstemming verbeterden en de diversiteit in modelreacties vergrootten. U kunt nu de gecombineerde voordelen van Llama 3-prestaties en MLOps-besturingselementen ontlenen met Amazon SageMaker-functies zoals SageMaker Pipelines, SageMaker Debugger of containerlogboeken. Bovendien wordt het model geïmplementeerd in een AWS-beveiligde omgeving onder uw VPC-controle, waardoor gegevensbeveiliging wordt geboden.

Wat is SageMaker JumpStart

Met SageMaker JumpStart kunt u kiezen uit een brede selectie openbaar beschikbare funderingsmodellen. ML-beoefenaars kunnen basismodellen implementeren op speciale SageMaker-instanties vanuit een netwerkgeïsoleerde omgeving en modellen aanpassen met behulp van SageMaker voor modeltraining en -implementatie. U kunt nu met een paar klikken Llama 3-modellen ontdekken en implementeren Amazon SageMaker Studio of programmatisch via de SageMaker Python SDK, zodat u modelprestaties en MLOps-besturingselementen kunt afleiden met SageMaker-functies zoals SageMaker-pijpleidingen, SageMaker-foutopsporingof containerlogboeken. Het model wordt geïmplementeerd in een AWS-beveiligde omgeving en onder uw VPC-controle, waardoor gegevensbeveiliging wordt geboden. Llama 3-modellen zijn vandaag beschikbaar voor implementatie en gevolgtrekking in Amazon SageMaker Studio in us-east-1 (N.Virginia), us-east-2 (Ohio), us-west-2 (Oregon), eu-west-1 (Ierland) en ap-northeast-1 (Tokio) AWS-regio's.

Ontdek modellen

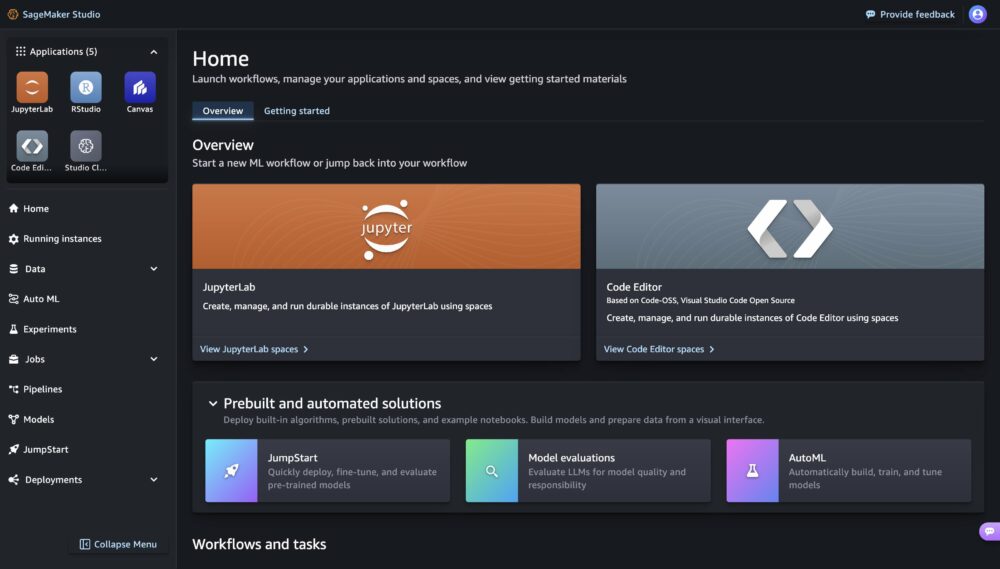

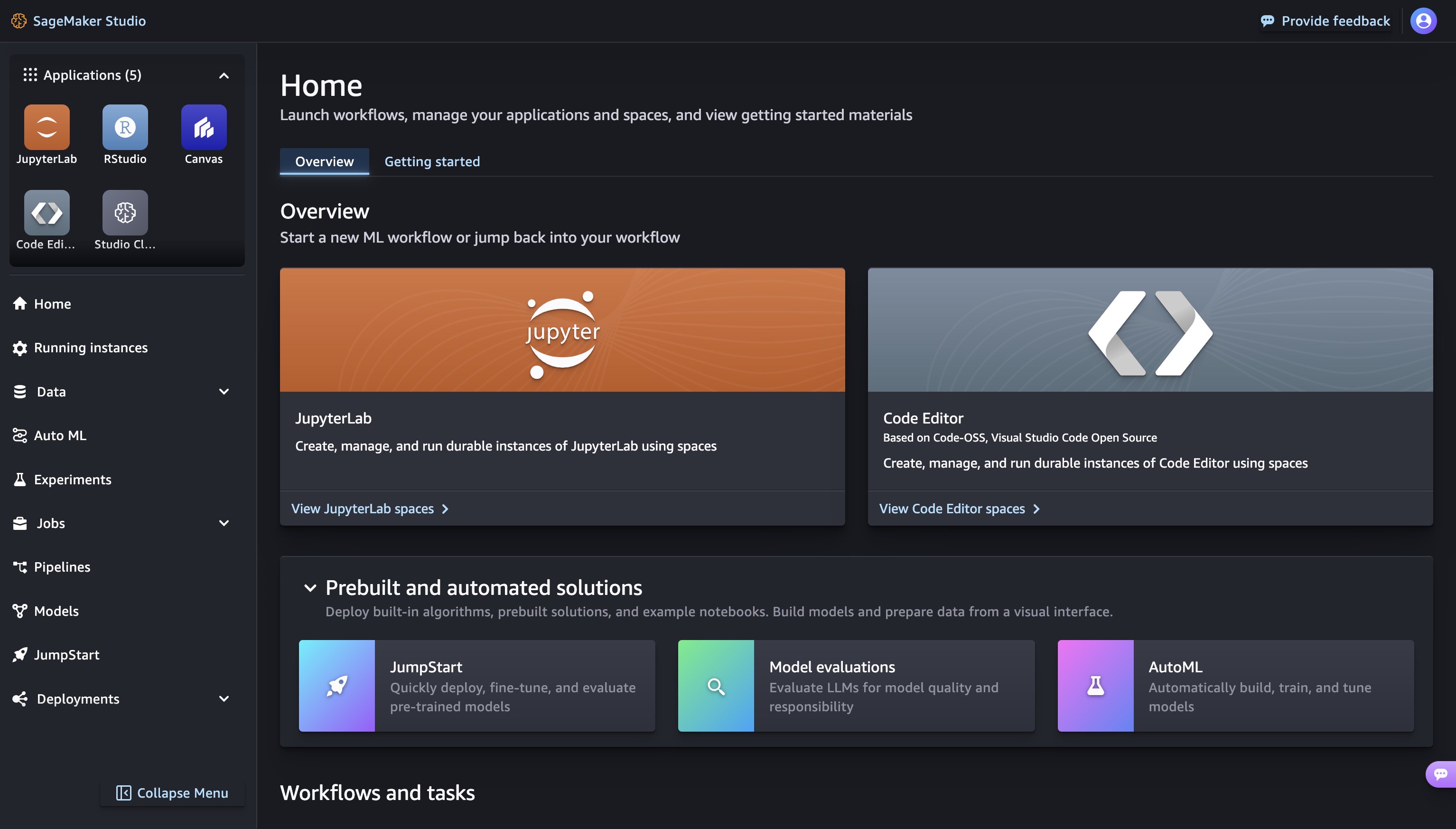

U hebt toegang tot de basismodellen via SageMaker JumpStart in de gebruikersinterface van SageMaker Studio en de SageMaker Python SDK. In dit gedeelte bespreken we hoe u de modellen in SageMaker Studio kunt ontdekken.

SageMaker Studio is een geïntegreerde ontwikkelomgeving (IDE) die een enkele webgebaseerde visuele interface biedt waar u toegang hebt tot speciaal gebouwde tools om alle ML-ontwikkelingsstappen uit te voeren, van het voorbereiden van gegevens tot het bouwen, trainen en implementeren van uw ML-modellen. Raadpleeg voor meer informatie over hoe u aan de slag kunt gaan en SageMaker Studio kunt instellen Amazon SageMaker Studio.

In SageMaker Studio heeft u toegang tot SageMaker JumpStart, dat vooraf getrainde modellen, notebooks en vooraf gebouwde oplossingen bevat onder Kant-en-klare en geautomatiseerde oplossingen.

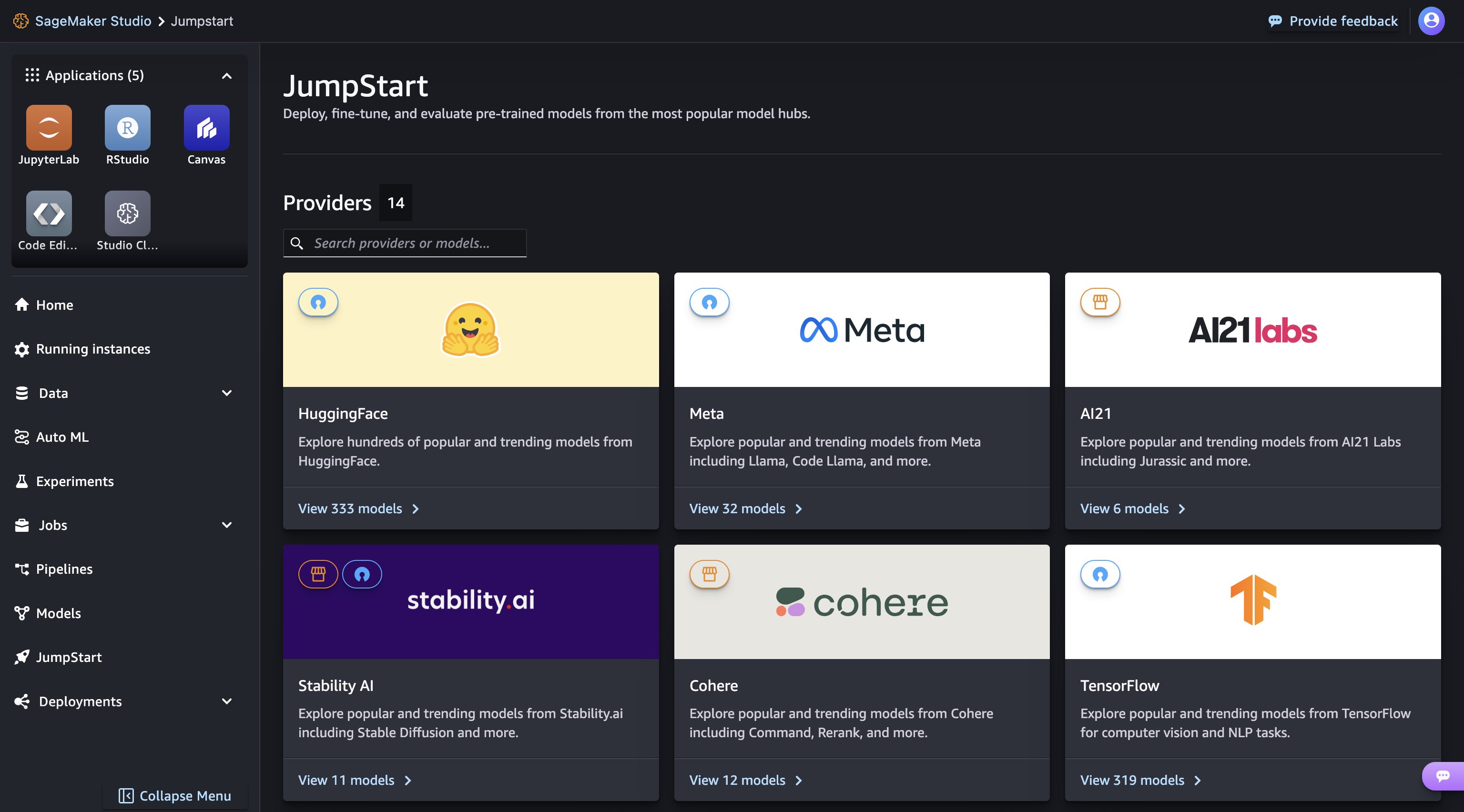

Vanaf de startpagina van SageMaker JumpStart kunt u eenvoudig verschillende modellen ontdekken door door verschillende hubs te bladeren die zijn vernoemd naar modelaanbieders. Je kunt Llama 3-modellen vinden in Meta-hub. Als u de Llama 3-modellen niet ziet, update dan uw SageMaker Studio-versie door deze af te sluiten en opnieuw op te starten. Voor meer informatie, zie Sluit Studio Classic-apps af en update deze.

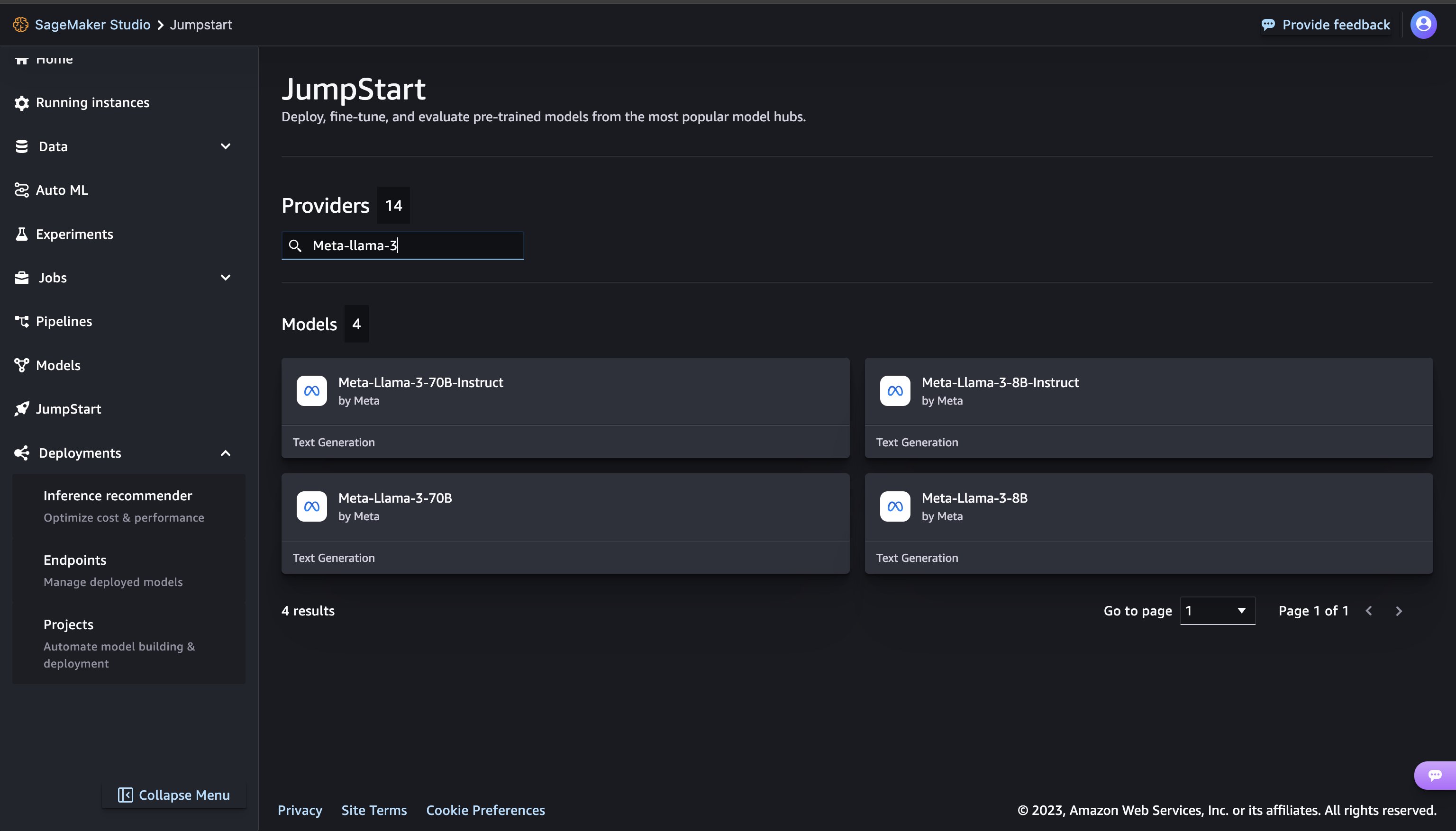

Je kunt Llama 3-modellen vinden door te zoeken naar “Meta-llama-3” in het zoekvak linksboven.

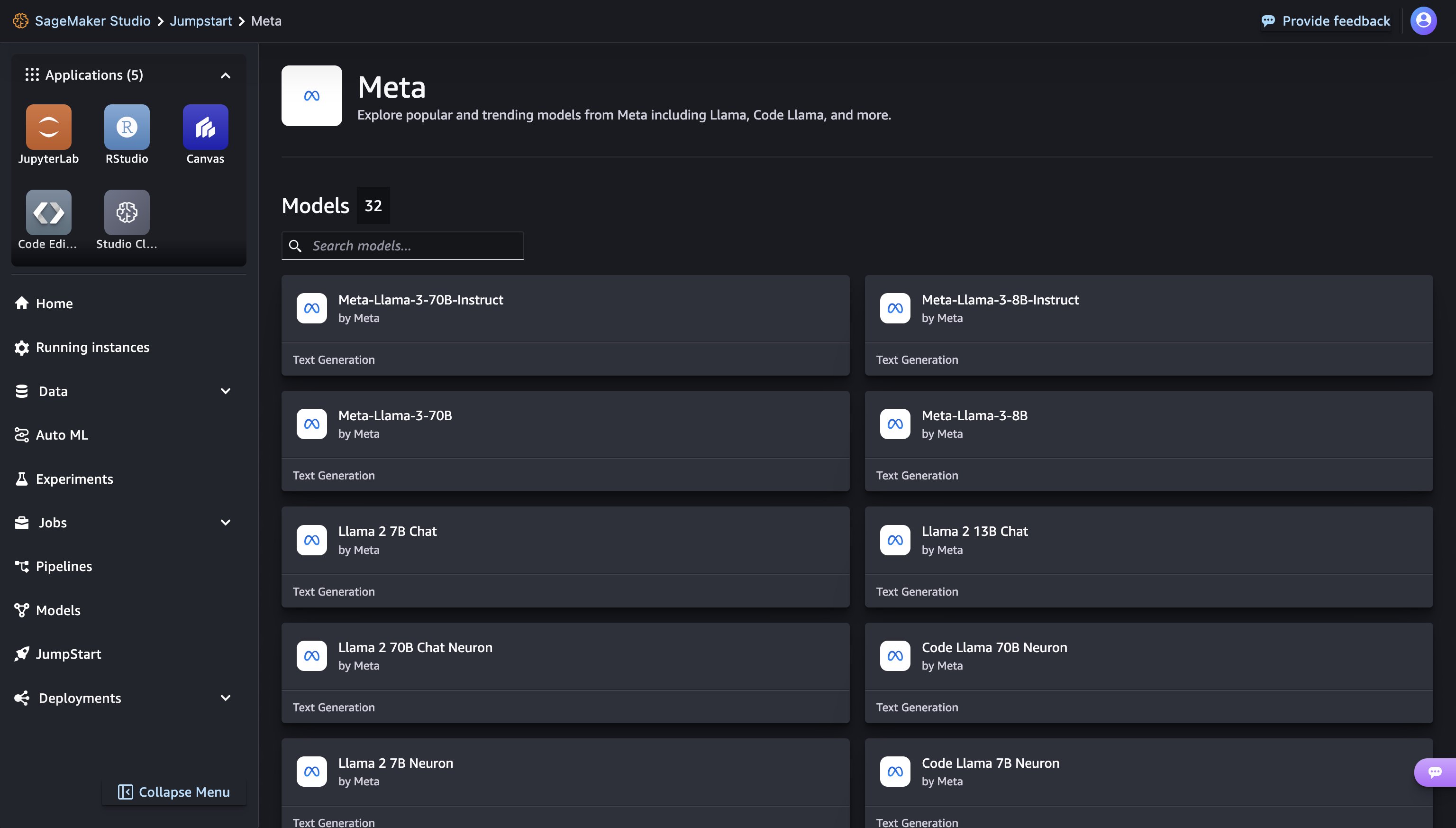

U kunt alle Meta-modellen ontdekken die beschikbaar zijn in SageMaker JumpStart door op Meta-hub te klikken.

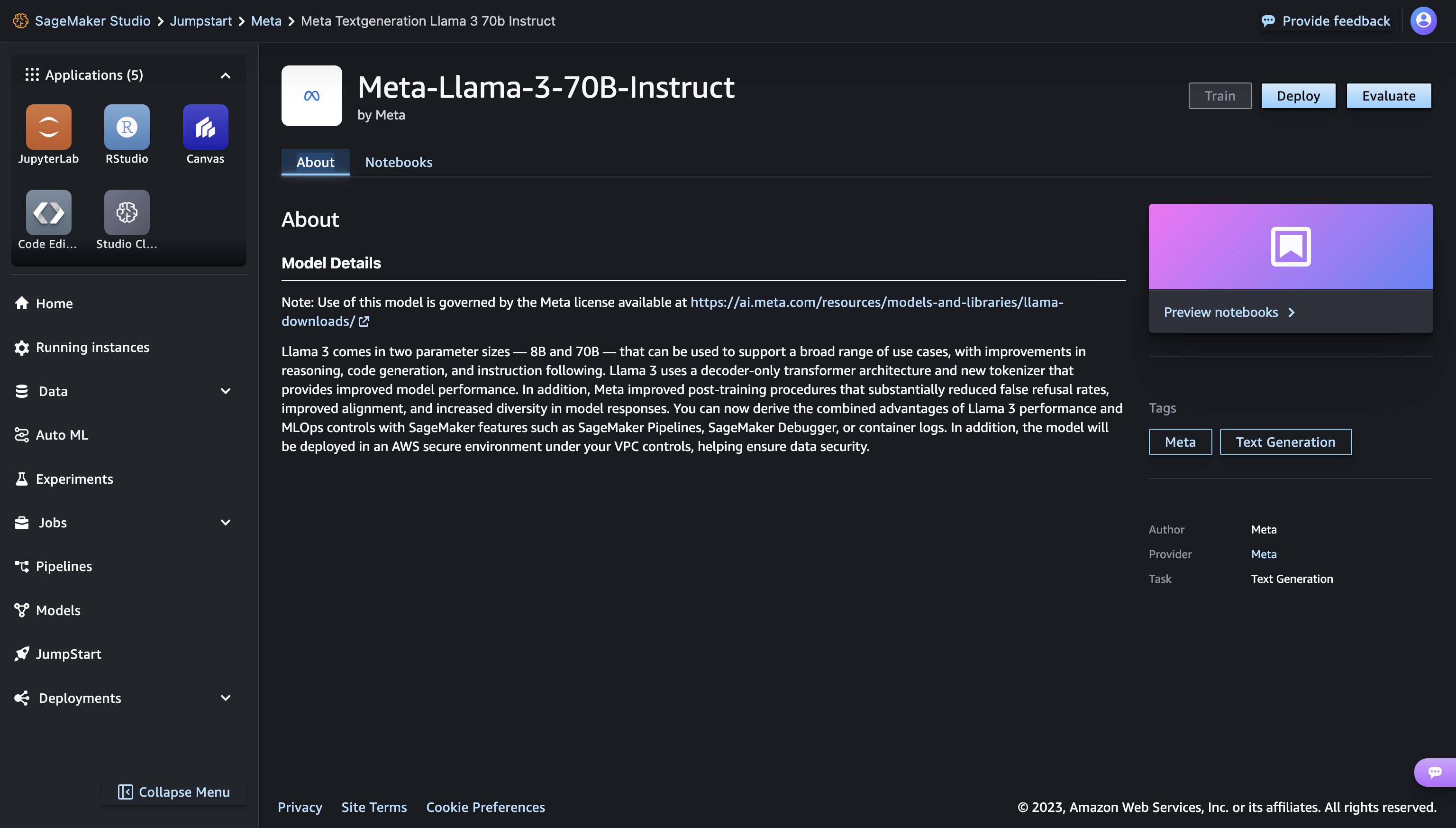

Als u op een modelkaart klikt, wordt de bijbehorende modeldetailpagina geopend, van waaruit u het model eenvoudig kunt implementeren.

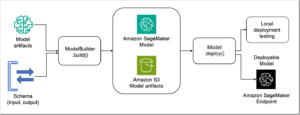

Een model implementeren

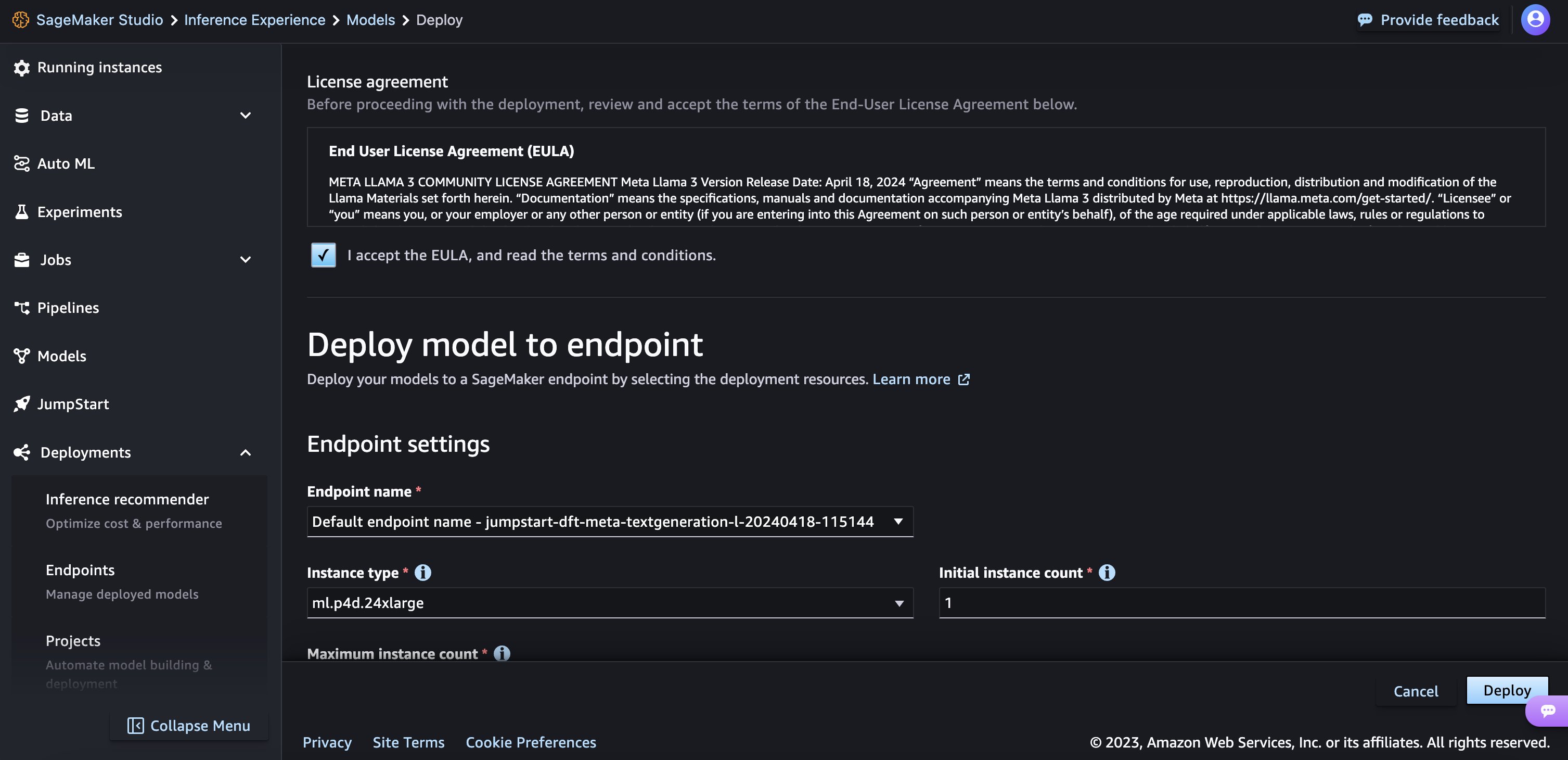

Wanneer je kiest Implementeren en de EULA-voorwaarden erkent, zal de implementatie starten.

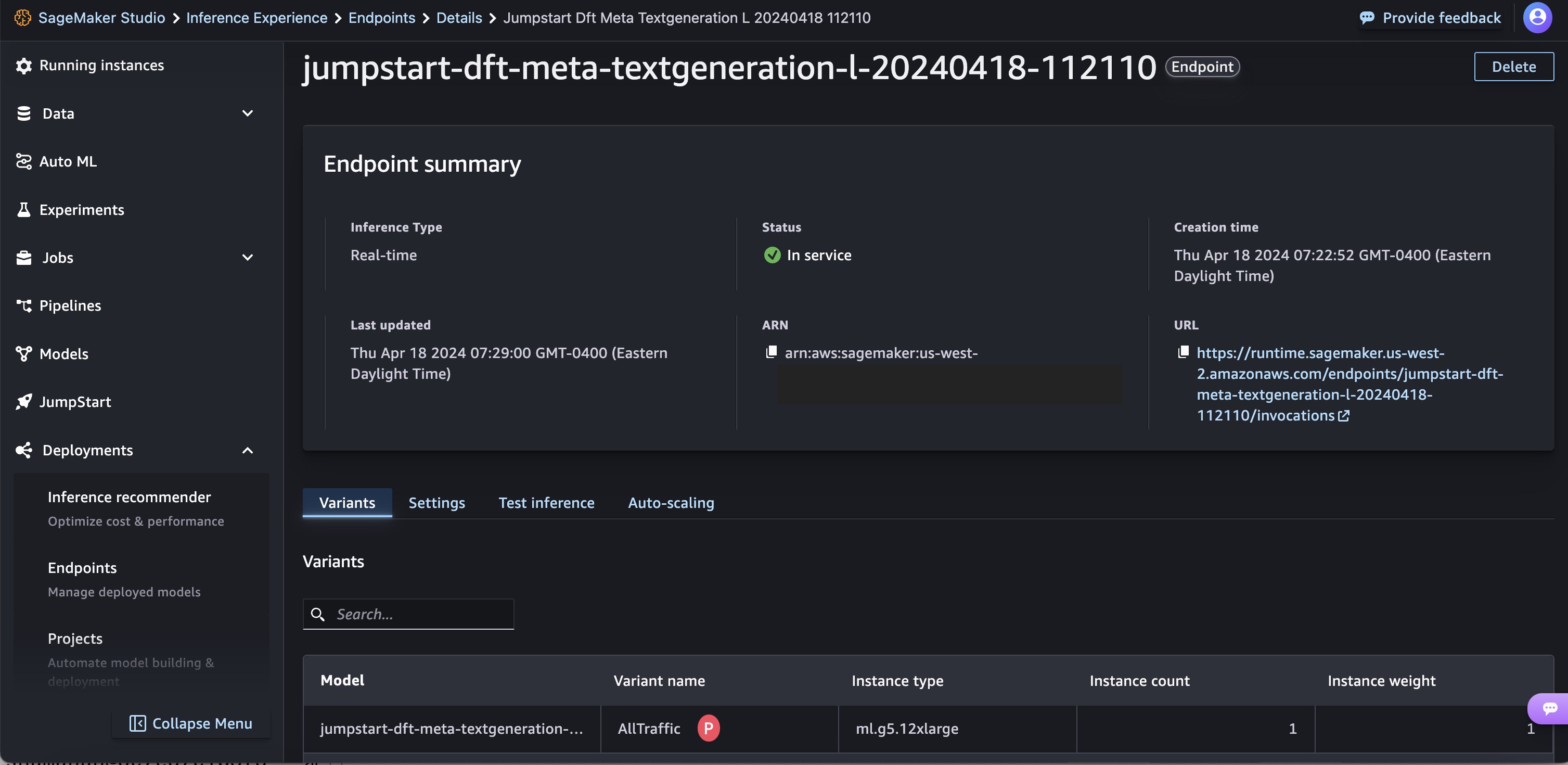

U kunt de voortgang van de implementatie volgen op de pagina die verschijnt nadat u op de knop Implementeren hebt geklikt.

Je kunt ook kiezen Notitieblok openen implementeren via het voorbeeldnotebook. Het voorbeeldnotebook biedt end-to-end richtlijnen voor het implementeren van het model voor gevolgtrekking en het opschonen van bronnen.

Om de notebook te gebruiken, begint u met het selecteren van een geschikt model, gespecificeerd door de model_id. U kunt elk van de geselecteerde modellen op SageMaker implementeren met de volgende code.

Standaard accept_eula is ingesteld op False. Om het eindpunt succesvol te kunnen implementeren, moet u de EULA handmatig accepteren. Door dit te doen, accepteert u de gebruikerslicentieovereenkomst en het acceptabele gebruiksbeleid. Ook kunt u de licentieovereenkomst vinden Lama-website. Hiermee wordt het model op SageMaker geïmplementeerd met standaardconfiguraties, inclusief het standaardinstantietype en standaard VPC-configuraties. U kunt deze configuratie wijzigen door niet-standaardwaarden op te geven in JumpStartModel. Raadpleeg het volgende voor meer informatie documentatie.

De volgende tabel bevat alle Llama 3-modellen die beschikbaar zijn in SageMaker JumpStart, samen met de model_ids, standaardinstantietypen en het maximale aantal totale tokens (som van het aantal invoertokens en het aantal gegenereerde tokens) dat voor elk van deze modellen wordt ondersteund.

| Modelnaam | Model ID | Maximale totale tokens | Standaardinstantietype |

| Meta-Llama-3-8B | meta-textgeneration-llama-3-8B | 8192 | ml.g5.12xgroot |

| Meta-Llama-3-8B-Instrueer | meta-textgeneration-llama-3-8B-instruct | 8192 | ml.g5.12xgroot |

| Meta-Llama-3-70B | meta-tekstgeneratie-lama-3-70b | 8192 | ml.p4d.24xgroot |

| Meta-Llama-3-70B-Instrueer | meta-textgeneration-llama-3-70b-instruct | 8192 | ml.p4d.24xgroot |

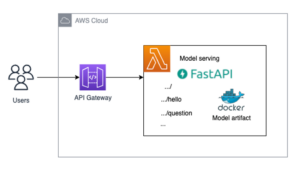

Voer gevolgtrekking uit

Nadat u het model hebt geïmplementeerd, kunt u gevolgtrekkingen uitvoeren op het geïmplementeerde eindpunt via de SageMaker-voorspeller. Verfijnde instructiemodellen (Llama 3: 8B Instruct en 70B Instruct) accepteren een geschiedenis van chats tussen de gebruiker en de chatassistent en genereren de daaropvolgende chat. De vooraf getrainde modellen (Llama 3: 8B en 70B) vereisen een tekenreeksprompt en voeren tekstaanvulling uit op de opgegeven prompt.

Inferentieparameters bepalen het tekstgeneratieproces op het eindpunt. De Max nieuwe tokens bepalen de grootte van de uitvoer die door het model wordt gegenereerd. Dit is niet hetzelfde als het aantal woorden, omdat de woordenschat van het model niet hetzelfde is als de Engelse woordenschat, en elk token hoeft geen Engelstalig woord te zijn. De temperatuurparameter regelt de willekeur in de uitvoer. Hogere temperaturen resulteren in creatievere en hallucinantere resultaten. Alle gevolgtrekkingsparameters zijn optioneel.

Voorbeeldvragen voor het 70B-model

U kunt Llama 3-modellen gebruiken voor tekstaanvulling voor elk stuk tekst. Door het genereren van tekst kunt u een verscheidenheid aan taken uitvoeren, zoals het beantwoorden van vragen, het vertalen van talen en het analyseren van sentimenten, en meer. De invoerpayload naar het eindpunt ziet eruit als de volgende code:

Hieronder volgen enkele voorbeeldprompts en de tekst die door het model wordt gegenereerd. Alle uitvoer wordt gegenereerd met inferentieparameters {"max_new_tokens":64, "top_p":0.9, "temperature":0.6}.

In het volgende voorbeeld laten we zien hoe u Llama 3-modellen kunt gebruiken met weinig in-context leren, waarbij we trainingsvoorbeelden ter beschikking stellen van het model. We voeren alleen gevolgtrekkingen uit op het geïmplementeerde model en tijdens dit proces veranderen de modelgewichten niet.

Voorbeeldvragen voor het 70B-Instruct-model

Met Llama 3-instructiemodellen die zijn geoptimaliseerd voor dialooggebruiksscenario's, is de invoer voor de eindpunten van het instrueringsmodel de eerdere geschiedenis tussen de chatassistent en de gebruiker. U kunt vragen stellen die verband houden met het gesprek dat tot nu toe heeft plaatsgevonden. U kunt ook de systeemconfiguratie opgeven, zoals persona's, die het gedrag van de chatassistent bepalen. Hoewel het invoerpayloadformaat hetzelfde is als het vooraf getrainde basismodel, moet de invoertekst op de volgende manier worden opgemaakt:

In dit instructiesjabloon kunt u optioneel beginnen met a system rol en neem zoveel afwisselende rollen op als gewenst in de turn-based geschiedenis. De laatste rol zou altijd moeten zijn assistant en eindig met twee nieuwe regelfeeds.

Bekijk vervolgens enkele voorbeeldprompts en reacties uit het model. In het volgende voorbeeld stelt de gebruiker een eenvoudige vraag aan de assistent.

In het volgende voorbeeld heeft de gebruiker een gesprek met de assistent over toeristische bezienswaardigheden in Parijs. Vervolgens informeert de gebruiker naar de eerste optie die door de chatassistent wordt aanbevolen.

In de volgende voorbeelden stellen we de systeemconfiguratie in.

Opruimen

Nadat u klaar bent met het uitvoeren van de notebook, moet u ervoor zorgen dat u alle bronnen verwijdert die u tijdens het proces hebt gemaakt, zodat de facturering wordt stopgezet. Gebruik de volgende code:

Conclusie

In dit bericht hebben we u laten zien hoe u aan de slag kunt gaan met Llama 3-modellen in SageMaker Studio. Je hebt nu toegang tot vier Llama 3-funderingsmodellen die miljarden parameters bevatten. Omdat basismodellen vooraf zijn getraind, kunnen ze ook helpen de training- en infrastructuurkosten te verlagen en maatwerk voor uw gebruiksscenario mogelijk te maken. Uitchecken SageMaker JumpStart in SageMaker Studio nu om aan de slag te gaan.

Over auteurs

Kyle Ulrich is een Applied Scientist II bij AWS

Xin Huang is een Senior Applied Scientist bij AWS

Qing Lan is een Senior Software Developer Engineer bij AWS

Haotiaanse An is een Software Developer Engineer II bij AWS

Christoffel Whitten is een Software Development Engineer II bij AWS

Tyler Osterberg is een Software Development Engineer I bij AWS

Manan Sjah is softwareontwikkelingsmanager bij AWS

Jonathan Guinegagne is een Senior Software Developer Engineer bij AWS

Adriana Simmons is een Senior Product Marketing Manager bij AWS

juni gewonnen is senior productmanager bij AWS

Asish Khetan is een Senior Applied Scientist bij AWS

Rachna Chadha is een Principal Solution Architect – AI/ML bij AWS

Deepak Rupakula is een Principal GTM-specialist bij AWS

- Door SEO aangedreven content en PR-distributie. Word vandaag nog versterkt.

- PlatoData.Network Verticale generatieve AI. Versterk jezelf. Toegang hier.

- PlatoAiStream. Web3-intelligentie. Kennis versterkt. Toegang hier.

- PlatoESG. carbon, CleanTech, Energie, Milieu, Zonne, Afvalbeheer. Toegang hier.

- Plato Gezondheid. Intelligentie op het gebied van biotech en klinische proeven. Toegang hier.

- Bron: https://aws.amazon.com/blogs/machine-learning/meta-llama-3-models-are-now-available-in-amazon-sagemaker-jumpstart/

- : heeft

- :is

- :niet

- :waar

- $UP

- 1

- 10

- 11

- 120

- 19

- 360 graden

- 43

- 7

- 8

- 8k

- 9

- a

- Over

- ACCEPTEREN

- aanvaardbaar

- toegang

- beschikbaar

- erkennen

- toevoegen

- toegevoegd

- toevoeging

- voordelen

- Na

- weer

- tegen

- Overeenkomst

- AI / ML

- opstelling

- Alles

- langs

- ook

- altijd

- am

- Amazone

- Amazon Sage Maker

- Amazon SageMaker JumpStart

- Amazon SageMaker Studio

- Amazon Web Services

- ambiance

- an

- analyse

- en

- en infrastructuur

- aankondigen

- beantwoorden

- beantwoorden

- elke

- Apple

- toegepast

- passend

- architectuur

- ZIJN

- Kunst

- AS

- vragen

- vragen

- Assistent

- geassocieerd

- At

- Sfeer

- aantrekkingskracht

- attracties

- geautomatiseerde

- Beschikbaar

- vermijd

- AWS

- baseren

- BE

- Beer

- prachtige

- omdat

- geweest

- gedrag

- Beijing

- geloofd wie en wat je bent

- tussen

- factuuradres

- miljarden

- Box camera's

- breaks

- adembenemend

- breed

- Kapot

- Bladeren

- Gebouw

- bebouwd

- maar

- by

- oproepen

- CAN

- hoofdstad

- kaart

- geval

- gevallen

- verandering

- de chat

- katten

- controle

- Kies

- Plaats

- klassiek

- schoon

- code

- Collectie

- combinatie van

- gecombineerde

- komt

- Communicatie

- voltooiing

- Configuratie

- Overwegen

- constante

- bevatten

- Containers

- bevat

- verband

- contextual

- doorlopend

- onder controle te houden

- controles

- gemakkelijk

- Gesprek

- Overeenkomend

- Kosten

- en je merk te creëren

- aangemaakt

- Creatieve

- cruciaal

- Culture

- beker

- Klanten

- maatwerk

- aan te passen

- gegevens

- gegevensbeveiliging

- de

- toegewijd aan

- Standaard

- bepalen

- implementeren

- ingezet

- het inzetten

- inzet

- ontplooit

- Derive

- gewenste

- bestemmingen

- detail

- gegevens

- Ontwikkelaar

- Ontwikkeling

- Dialoog

- verschil

- anders

- diners

- Onthul Nu

- Verscheidenheid

- do

- doesn

- doen

- don

- gedaan

- verdubbelde

- beneden

- gedurende

- Schemering

- e

- elk

- gemakkelijk

- inspanningen

- in staat stellen

- waardoor

- einde

- eind tot eind

- Endpoint

- ingenieur

- Engineering

- Engels

- genoeg

- zorgen

- Milieu

- Zelfs

- Alle

- iedereen

- voorbeeld

- voorbeelden

- opgewonden

- ervaring

- eerlijk

- vals

- beroemd

- ver

- prestatie

- uitgelicht

- Voordelen

- Voeten

- weinig

- films

- finale

- VIND DE PLEK DIE PERFECT VOOR JOU IS

- Voornaam*

- smaak

- Vlotter

- stroom

- volgend

- Voet

- Voor

- formaat

- Foundation

- vier

- Frankrijk

- Frans

- vers

- oppompen van

- Algemeen

- Algemene relativiteitstheorie

- voortbrengen

- gegenereerde

- generatie

- generatief

- zacht

- Duits

- krijgen

- glas

- Go

- gaan

- geleidelijk

- groot

- baanbrekende

- leiding

- geleide

- gebeuren

- gebeurd

- Hard

- hard werken

- Hebben

- hulp

- het helpen van

- hier

- hoger

- historisch

- geschiedenis

- houden

- Home

- uur

- behuizing

- Hoe

- How To

- HTML

- HTTPS

- Naaf

- hubs

- i

- iconische

- if

- ii

- importeren

- indrukwekkend

- verbeterd

- verbeteringen

- in

- omvatten

- Inclusief

- Laat uw omzet

- meer

- meer

- informatie

- Infrastructuur

- invoer

- instantie

- ogenblikkelijk

- geïntegreerde

- Interface

- in

- Ierland

- geïsoleerd

- IT

- HAAR

- jpg

- voor slechts

- Houden

- blijven

- bekend

- landing

- oriëntatiepunten

- taal

- grootste

- lancering

- Wetten

- LEARN

- leren

- links

- Lengte

- Vergunning

- Life

- Lifted

- licht

- lichter

- als

- Lijn

- lijsten

- literatuur

- Elke kleine stap levert grote resultaten op!

- leven

- Lives

- Lama

- gelegen

- LOOKS

- lot

- te verlagen

- gemaakt

- maken

- maken

- manager

- manier

- handmatig

- veel

- Marketing

- max

- maximaal

- Mei..

- betekenis

- Bericht

- meta

- middernacht

- minuten

- menger

- mengsel

- ML

- MLops

- model

- modellen

- monitor

- meer

- meest

- Meest populair

- veel

- Museum

- musea

- Genoemd

- Noodzaak

- nodig

- netwerk

- New

- volgende

- nacht

- geen

- notitieboekje

- nu

- aantal

- NY

- observatie

- waarnemers

- zich voordoen

- of

- bieden

- het aanbieden van

- Aanbod

- vaak

- Ohio

- Olie

- on

- EEN

- Slechts

- opent

- optimale

- geoptimaliseerde

- Keuze

- or

- bestellen

- Oregon

- Overig

- onze

- dragen

- uit

- uitgang

- uitgangen

- over

- pagina

- parameter

- parameters

- Parijs

- deel

- Uitvoeren

- prestatie

- Fysica

- stuk

- plaats

- Plato

- Plato gegevensintelligentie

- PlatoData

- gespeeld

- dan

- beleidsmaatregelen

- Populair

- Post

- predictor

- voorbereiding

- vorig

- Principal

- procedures

- Product

- product manager

- Profielen

- Voortgang

- prompts

- voorstellen

- zorgen voor

- mits

- providers

- biedt

- publiek

- openbaar vervoer

- in het openbaar

- doel

- zetten

- Python

- vraag

- Contact

- willekeurigheid

- reeks

- Tarieven

- RE

- bereikt

- redenen

- recept

- aanbevolen

- Gereduceerd

- verwijzen

- weigering

- betreft de

- regio

- relativiteit

- vereisen

- hulpbron

- Resources

- reacties

- Resultaten

- Rivier

- Rol

- rollen

- romance

- Kamer

- lopen

- lopend

- s

- sagemaker

- SageMaker-pijpleidingen

- zout

- dezelfde

- monster

- ervaren

- Wetenschapper

- sdk

- Ontdek

- zoeken

- Tweede

- sectie

- beveiligen

- veiligheid

- zien

- gekozen

- selecteren

- selectie

- senior

- sentiment

- Diensten

- serveer-

- reeks

- verscheidene

- Vorm

- schot

- moet

- tonen

- vertoonde

- Shows

- het afsluiten van

- aanzienlijke

- Eenvoudig

- eenvoudigweg

- single

- Locaties

- Maat

- maten

- traag

- Langzaam

- glad

- So

- dusver

- Software

- software development

- oplossing

- Oplossingen

- sommige

- Fonkeling

- special

- specialist

- gespecificeerd

- specificeren

- snelheid

- Spot

- staan

- staand

- begin

- gestart

- Staten

- vast

- Stappen

- stop

- gestopt

- stream

- Draad

- structuur

- studio

- Prachtige

- volgend

- wezenlijk

- Met goed gevolg

- dergelijk

- ondersteuning

- ondersteunde

- zeker

- symbool

- system

- tafel

- kleermaker

- Nemen

- neemt

- het nemen

- taken

- smaak

- team

- sjabloon

- termen

- tekst

- bedanken

- dat

- De

- De hoofdstad

- de wereld

- harte

- theorie

- Er.

- Deze

- ze

- dun

- dit

- duizenden kosten

- Door

- niet de tijd of

- naar

- vandaag

- samen

- teken

- tokens

- tokyo

- ook

- tools

- top

- Totaal

- Tour

- Tower

- Trainingen

- transformator

- vertalen

- Vertaling

- vervoer

- twee

- type dan:

- types

- ui

- voor

- unieke

- tot

- bijwerken

- .

- use case

- Gebruiker

- toepassingen

- gebruik

- waardevol

- Values

- variaties

- variëteit

- divers

- versie

- zeer

- via

- .

- Virginia

- visuele

- volume

- vs

- lopen

- gezocht

- oorlog

- was

- Water

- manieren

- we

- web

- webservices

- Web-based

- bruiloften

- GOED

- gegaan

- Wat

- wanneer

- welke

- en

- wit

- Waarom

- wil

- ruiten

- WIJN

- Met

- wonder

- Woord

- woorden

- Mijn werk

- wereld

- You

- Your

- zephyrnet